A nagy mennyiségű szövegből származó pontos és éles válaszok feloldása egy izgalmas lehetőség, amelyet a nagy nyelvi modellek (LLM) tesznek lehetővé. Az LLM-alkalmazások építése során gyakran szükség van külső adatforrások csatlakoztatására és lekérdezésére, hogy releváns kontextust biztosítsunk a modellhez. Az egyik népszerű megközelítés a Retrieval Augmented Generation (RAG) alkalmazása olyan kérdés-felelet rendszerek létrehozására, amelyek felfogják az összetett információkat és természetes válaszokat adnak a lekérdezésekre. A RAG lehetővé teszi a modellek számára, hogy hatalmas tudásbázisokhoz kapcsolódjanak, és emberszerű párbeszédet folytassanak olyan alkalmazásokhoz, mint a chatbotok és a vállalati keresési asszisztensek.

Ebben a bejegyzésben megvizsgáljuk, hogyan hasznosíthatjuk az erejét CallIndex, Láma 2-70B-Chatés LangChain hatékony Q&A alkalmazások létrehozásához. Ezekkel a legmodernebb technológiákkal szövegkorpusokat tölthet be, kritikus ismereteket indexelhet, és olyan szöveget állíthat elő, amely pontosan és egyértelműen válaszol a felhasználók kérdéseire.

Láma 2-70B-Chat

A Llama 2-70B-Chat egy erőteljes LLM, amely a vezető modellekkel versenyez. Előzetesen két billió szöveges tokenre van kiképezve, és a Meta célja a felhasználók chat-segítése. A képzés előtti adatok nyilvánosan elérhető adatokból származnak, és 2022 szeptemberében, a finomhangolási adatok pedig 2023 júliusában fejeződnek be. A modell képzési folyamatáról, biztonsági megfontolásairól, tanulságairól és tervezett felhasználásáról további részleteket a dokumentumban talál. Láma 2: Nyílt alapítvány és finomhangolt chatmodellek. A Llama 2 modellek itt érhetők el Amazon SageMaker JumpStart a gyors és egyszerű telepítés érdekében.

CallIndex

CallIndex egy adatkeretrendszer, amely lehetővé teszi LLM alkalmazások építését. Olyan eszközöket biztosít, amelyek adatösszekötőket kínálnak a meglévő adatok különböző forrásokból és formátumokból (PDF-ek, dokumentumok, API-k, SQL és egyebek) történő feldolgozásához. Függetlenül attól, hogy adatbázisokban vagy PDF-fájlokban tárolt adatokat, a LlamaIndex egyszerűvé teszi az adatok felhasználását az LLM-ek számára. Amint azt ebben a bejegyzésben bemutatjuk, a LlamaIndex API-k egyszerűvé teszik az adatok elérését, és lehetővé teszik hatékony egyéni LLM-alkalmazások és munkafolyamatok létrehozását.

Ha LLM-ekkel kísérletezik és épít, valószínűleg ismeri a LangChaint, amely robusztus keretrendszert kínál, leegyszerűsítve az LLM-alapú alkalmazások fejlesztését és telepítését. A LangChain-hez hasonlóan a LlamaIndex is számos eszközt kínál, köztük adatösszekötőket, adatindexeket, motorokat és adatügynököket, valamint alkalmazásintegrációkat, például eszközöket és megfigyelhetőséget, nyomkövetést és kiértékelést. A LlamaIndex az adatok és a hatékony LLM-ek közötti szakadék áthidalására összpontosít, és felhasználóbarát funkciókkal egyszerűsíti az adatfeladatokat. A LlamaIndexet kifejezetten kereső és visszakereső alkalmazások, például RAG építésére tervezték és optimalizálták, mivel egyszerű felületet biztosít az LLM-ek lekérdezéséhez és a releváns dokumentumok lekéréséhez.

Megoldás áttekintése

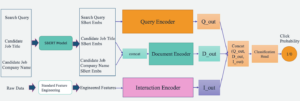

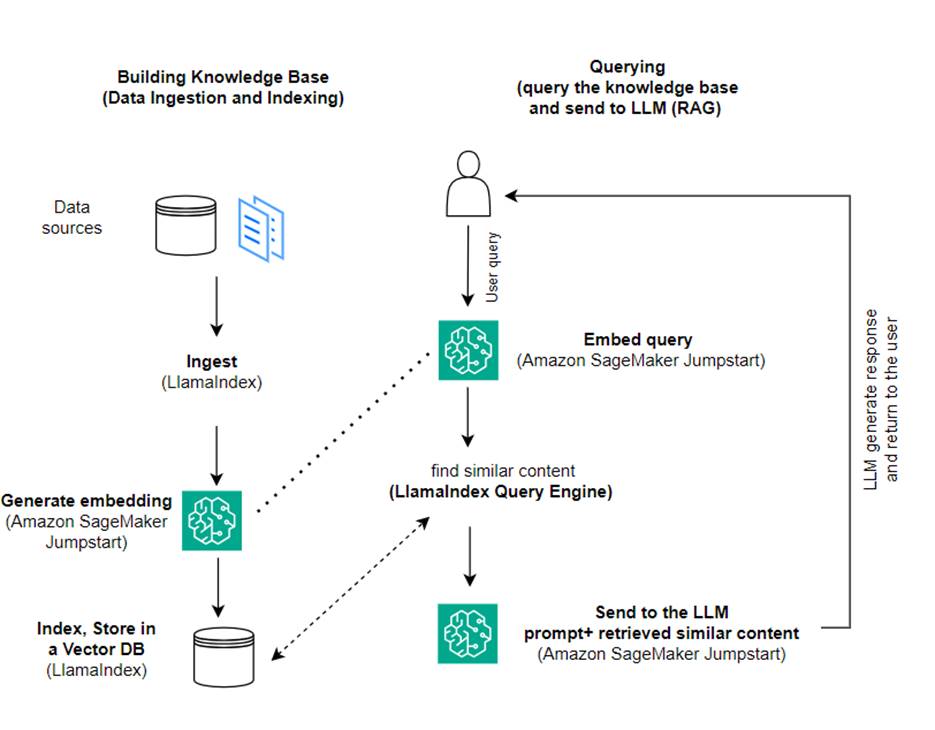

Ebben a bejegyzésben bemutatjuk, hogyan hozhat létre RAG-alapú alkalmazást LlamaIndex és LLM segítségével. Az alábbi ábra a megoldás lépésről lépésre felvázolt architektúráját mutatja be, amelyet a következő szakaszok vázolnak fel.

A RAG egyesíti az információ-visszakeresést a természetes nyelv generálásával, hogy éleslátóbb válaszokat adjon. Amikor a rendszer kéri, a RAG először a szöveges korpuszokban keres, hogy lekérje a bemenetre leginkább releváns példákat. A válaszgenerálás során a modell ezeket a példákat úgy tekinti, hogy bővíti képességeit. A releváns leolvasott szövegrészek beépítésével a RAG-válaszok tényszerűbbek, koherensebbek és kontextussal konzisztensebbek az alapvető generatív modellekhez képest. Ez a visszakeresés és generálás keretrendszer kihasználja a visszakeresés és a generálás erősségeit, segítve az olyan problémák kezelését, mint az ismétlés és a kontextus hiánya, amelyek a tisztán autoregresszív társalgási modellekből származhatnak. A RAG hatékony megközelítést mutat be a kontextusra szabott, kiváló minőségű válaszokkal rendelkező beszélgetőpartnerek és AI-asszisztensek létrehozására.

A megoldás elkészítése a következő lépésekből áll:

- Beállítása Amazon SageMaker Studio fejlesztői környezetként, és telepítse a szükséges függőségeket.

- Telepítsen egy beágyazási modellt az Amazon SageMaker JumpStart hubról.

- Töltse le a sajtóközleményeket, amelyeket külső tudásbázisunkként használhat.

- Készítsen indexet a sajtóközleményekből, hogy lekérdezhessen, és további kontextusként hozzáadhassa a promptot.

- Kérdezze le a tudásbázist.

- Hozzon létre egy Q&A alkalmazást a LlamaIndex és LangChain ügynökök segítségével.

A bejegyzésben szereplő összes kód elérhető a GitHub repo.

Előfeltételek

Ebben a példában egy AWS-fiókra van szüksége SageMaker-domainnel és megfelelő AWS Identity and Access Management (IAM) engedélyek. A fiók beállításához lásd: Hozzon létre egy AWS-fiókot. Ha még nem rendelkezik SageMaker domainnel, tekintse meg a Amazon SageMaker domain áttekintést egy létrehozásához. Ebben a bejegyzésben a AmazonSageMakerFullAccess szerep. Nem ajánlott ezt a hitelesítő adatot éles környezetben használni. Ehelyett a legkevesebb jogosultsággal rendelkező szerepkört kell létrehoznia és használnia. Azt is megvizsgálhatja, hogyan használhatja Amazon SageMaker Role Manager személy-alapú IAM-szerepek létrehozása és kezelése az általános gépi tanulási igényekhez közvetlenül a SageMaker konzolon keresztül.

Ezenkívül hozzá kell férnie legalább a következő példányméretekhez:

- ml.g5.2xnagy a végpont használatához a telepítéskor Átölelő arc GPT-J szövegbeágyazási modell

- ml.g5.48xnagy végpont használatához a Llama 2-Chat modell végpontjának telepítésekor

A kvóta növeléséhez lásd: Kvótaemelés kérése.

Telepítsen egy GPT-J beágyazási modellt a SageMaker JumpStart segítségével

Ez a szakasz két lehetőséget kínál a SageMaker JumpStart modellek telepítéséhez. Használhat kódalapú központi telepítést a mellékelt kód használatával, vagy használhatja a SageMaker JumpStart felhasználói felületet (UI).

Telepítse a SageMaker Python SDK-val

Használhatja a SageMaker Python SDK-t az LLM-ek üzembe helyezéséhez, amint az a kód elérhető a tárolóban. Hajtsa végre a következő lépéseket:

- Állítsa be a példányméretet, amelyet a beágyazási modell telepítéséhez használjon

instance_type = "ml.g5.2xlarge" - Keresse meg a beágyazásokhoz használandó modell azonosítóját. A SageMaker JumpStartban a következőképpen azonosítható:

model_id = "huggingface-textembedding-gpt-j-6b-fp16" - Szerezze le az előre betanított modelltárolót, és helyezze üzembe következtetésekhez.

A SageMaker visszaadja a modell végpontjának nevét és a következő üzenetet, ha a beágyazási modell sikeresen üzembe került:

Telepítse a SageMaker JumpStart segítségével a SageMaker Studio alkalmazásban

A modell Studio SageMaker JumpStart segítségével történő üzembe helyezéséhez hajtsa végre a következő lépéseket:

- A SageMaker Studio konzolon válassza a JumpStart lehetőséget a navigációs panelen.

- Keresse meg és válassza ki a GPT-J 6B Embedding FP16 modellt.

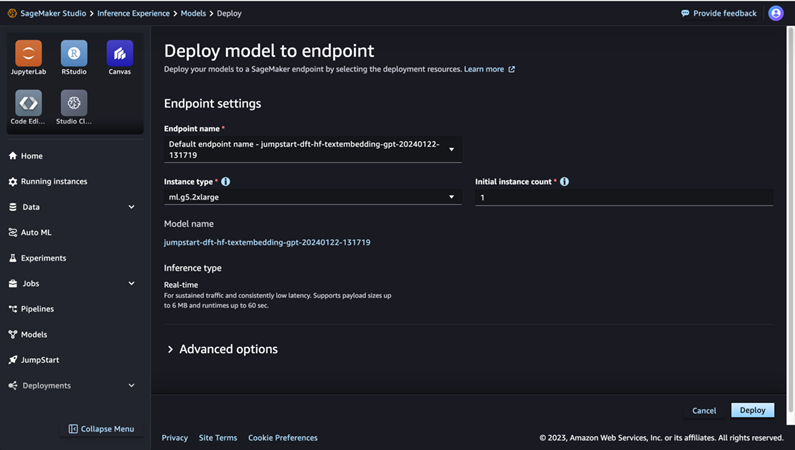

- Válassza a Telepítés lehetőséget, és szabja testre a telepítési konfigurációt.

- Ehhez a példához szükségünk van egy ml.g5.2xlarge példányra, amely a SageMaker JumpStart által javasolt alapértelmezett példány.

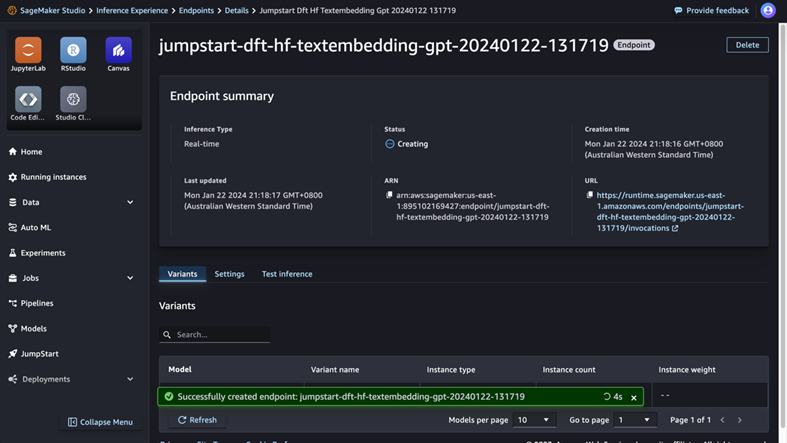

- A végpont létrehozásához válassza újra a Telepítés lehetőséget.

A végpont körülbelül 5–10 percet vesz igénybe, amíg üzembe helyezi.

A beágyazási modell üzembe helyezése után a LangChain integráció SageMaker API-kkal való használatához létre kell hoznia egy függvényt a bemenetek (nyers szöveg) kezelésére, és a modell segítségével beágyazásokká kell átalakítania azokat. Ezt egy osztály létrehozásával teheti meg ContentHandler, amely a bemeneti adatok JSON-ját veszi fel, és a szöveges beágyazások JSON-ját adja vissza: class ContentHandler(EmbeddingsContentHandler).

Adja át a modell végpont nevét a ContentHandler függvény a szöveg konvertálásához és a beágyazások visszaadásához:

A végpont nevét az SDK kimenetében vagy a SageMaker JumpStart felhasználói felület központi telepítési részleteiben találhatja meg.

Tesztelheti, hogy a ContentHandler A függvény és a végpont a várt módon működik némi nyers szöveg bevitelével és a embeddings.embed_query(text) funkció. Használhatja a megadott példát text = "Hi! It's time for the beach" vagy próbálja ki a saját szövegét.

Telepítse és tesztelje a Llama 2-Chat a SageMaker JumpStart segítségével

Most már üzembe helyezheti azt a modellt, amely képes interaktív beszélgetéseket folytatni a felhasználókkal. Ebben az esetben a Llama 2 chat modellek egyikét választjuk, amelyet a segítségével azonosítunk

A modellt valós idejű végpontra kell telepíteni a használatával predictor = my_model.deploy(). A SageMaker visszaadja a modell végpontjának nevét, amelyet a következőhöz használhat endpoint_name változó későbbi hivatkozásra.

Ön meghatározza a print_dialogue függvény bemenetet küld a csevegési modellnek, és megkapja a kimeneti választ. A hasznos adat a modell hiperparamétereit tartalmazza, beleértve a következőket:

- max_new_tokens – A modell által a kimenetekben generálható tokenek maximális számát jelenti.

- top_p – A modell által a kimenetek generálásakor megtartható tokenek kumulatív valószínűségére utal

- hőmérséklet – A modell által generált kimenetek véletlenszerűségére utal. A 0-nál nagyobb vagy 1-gyel egyenlő hőmérséklet növeli a véletlenszerűséget, míg a 0 hőmérséklet a legvalószínűbb tokeneket generálja.

A hiperparamétereket a használati eset alapján kell kiválasztania, és megfelelően tesztelnie kell őket. Az olyan modelleknél, mint a Llama család, meg kell adni egy további paramétert, amely azt jelzi, hogy elolvasta és elfogadta a végfelhasználói licencszerződést (EULA):

A modell teszteléséhez cserélje ki a bemeneti hasznos tartalom tartalmi részét: "content": "what is the recipe of mayonnaise?". Használhatja saját szöveges értékeit, és frissítheti a hiperparamétereket, hogy jobban megértse őket.

A beágyazási modellhez hasonlóan a Llama-70B-Chat a SageMaker JumpStart UI használatával is telepíthető:

- A SageMaker Studio konzolon válassza a lehetőséget ugrás indítás a navigációs ablakban

- Keresse meg és válassza ki a

Llama-2-70b-Chat model - Fogadja el az EULA-t, és válasszon Telepítése, ismét az alapértelmezett példányt használva

A beágyazási modellhez hasonlóan használhatja a LangChain integrációt úgy, hogy létrehoz egy tartalomkezelő sablont a csevegési modell bemeneteihez és kimeneteihez. Ebben az esetben a bemeneteket úgy határozza meg, mint amelyek egy felhasználótól származnak, és jelzi, hogy azokat a system prompt Az system prompt tájékoztatja a modellt a felhasználó segítésében betöltött szerepéről egy adott használati esetben.

A modell meghívásakor ezt a tartalomkezelőt adják át a fent említett hiperparaméterek és egyéni attribútumok mellett (EULA elfogadás). Ezeket az attribútumokat a következő kóddal elemezheti:

Ha a végpont elérhető, tesztelheti, hogy a várt módon működik-e. Frissíthetsz llm("what is amazon sagemaker?") saját szövegével. Meg kell határozni a konkrétumot is ContentHandler hogy meghívja az LLM-et a LangChain segítségével, ahogy az a kód és a következő kódrészletet:

Használja a LlamaIndexet a RAG felépítéséhez

A folytatáshoz telepítse a LlamaIndexet a RAG alkalmazás létrehozásához. A LlamaIndexet a pip segítségével telepítheti: pip install llama_index

Először be kell töltenie adatait (tudásbázisát) a LlamaIndexbe az indexeléshez. Ez néhány lépésből áll:

- Válasszon adatbetöltőt:

A LlamaIndex számos adatcsatlakozót kínál a következő helyen LlamaHub általános adattípusokhoz, például JSON-, CSV- és szövegfájlokhoz, valamint más adatforrásokhoz, lehetővé téve különféle adatkészletek feldolgozását. Ebben a bejegyzésben használjuk SimpleDirectoryReader néhány PDF-fájl feldolgozásához a kódban látható módon. Adatmintánk két Amazon-sajtóközlemény PDF változatban a sajtóközlemények mappát a kódtárunkban. A PDF-ek betöltése után láthatja, hogy a rendszer 11 elemből álló listává konvertálta őket.

A dokumentumok közvetlen betöltése helyett elrejtheti a Document tárgyat bele Node objektumokat, mielőtt elküldi őket az indexbe. Választás a teljes küldemény között Document objektumot az indexre, vagy konvertálja a dokumentumot Node Az indexelés előtti objektumok az Ön konkrét használati esetétől és az adatok szerkezetétől függ. A csomópontok megközelítése általában jó választás hosszú dokumentumokhoz, ahol a dokumentum bizonyos részeit szeretné megtörni és visszakeresni, nem pedig a teljes dokumentumot. További információkért lásd: Dokumentumok / csomópontok.

- Példányosítsa a betöltőt és töltse be a dokumentumokat:

Ez a lépés inicializálja a betöltő osztályt és a szükséges konfigurációkat, például a rejtett fájlok figyelmen kívül hagyását. További részletekért lásd: SimpleDirectoryReader.

- Hívja a rakodót

load_datamódszerrel elemzi a forrásfájlokat és -adatokat, és konvertálja azokat LlamaIndex Document objektumokká, amelyek készen állnak az indexelésre és a lekérdezésre. A következő kóddal fejezheti be az adatbevitelt és a teljes szöveges keresésre való felkészülést a LlamaIndex indexelési és visszakeresési képességeivel:

- Építsd fel az indexet:

A LlamaIndex legfontosabb jellemzője, hogy képes szervezett indexeket létrehozni az adatokon, amelyeket dokumentumokként vagy csomópontokként ábrázolnak. Az indexelés megkönnyíti az adatok hatékony lekérdezését. Az indexünket az alapértelmezett memórián belüli vektortárral és az általunk meghatározott beállítási konfigurációval hozzuk létre. A LlamaIndex beállítások egy konfigurációs objektum, amely általánosan használt erőforrásokat és beállításokat biztosít az indexelési és lekérdezési műveletekhez egy LlamaIndex alkalmazásban. Egyetlen objektumként működik, így lehetővé teszi a globális konfigurációk beállítását, ugyanakkor lehetővé teszi bizonyos összetevők helyi felülbírálását, közvetlenül az azokat használó interfészekre (például LLM-ekre, beágyazó modellekre) történő átadással. Ha egy adott összetevő nincs kifejezetten megadva, a LlamaIndex keretrendszer visszaáll a Settings objektum globális alapértelmezettként. Beágyazó és LLM modelljeink LangChainnel történő használatához és a Settings telepítenünk kell llama_index.embeddings.langchain és a llama_index.llms.langchain. Beállíthatjuk a Settings objektum, mint a következő kódban:

Alapértelmezésben, VectorStoreIndex memóriát használ SimpleVectorStore amely az alapértelmezett tárolási környezet részeként inicializálva van. Valós használati esetekben gyakran kell csatlakozni külső vektortárolókhoz, mint pl Amazon OpenSearch szolgáltatás. További részletekért lásd: Vector Engine az Amazon OpenSearch szerver nélküli számára.

Most már futtathatja a kérdéseket és válaszokat a dokumentumokon a következő használatával query_engine a LlamaIndextől. Ehhez adja át a lekérdezésekhez korábban létrehozott indexet, és tegye fel kérdését. A lekérdezőmotor egy általános interfész az adatok lekérdezéséhez. Természetes nyelvű lekérdezést használ bemenetként, és gazdag választ ad vissza. A lekérdezőmotor általában egy vagy több elemre épül indexek segítségével retrieverek.

Láthatja, hogy a RAG megoldás képes lekérni a helyes választ a megadott dokumentumokból:

Használjon LangChain eszközöket és ügynököket

Loader osztály. A betöltőt úgy tervezték, hogy adatokat töltsön be a LlamaIndexbe, vagy ezt követően eszközként a LangChain ügynök. Ez nagyobb teljesítményt és rugalmasságot biztosít Önnek, hogy ezt az alkalmazás részeként használja. Kezdje azzal, hogy meghatározza a sajátját szerszám a LangChain ügynök osztályból. Az eszköznek átadott függvény lekérdezi a LlamaIndex segítségével a dokumentumok fölé épített indexet.

Ezután válassza ki az ügynök megfelelő típusát, amelyet használni szeretne a RAG megvalósításához. Ebben az esetben használja a chat-zero-shot-react-description ügynök. Ezzel az ügynökkel az LLM a rendelkezésre álló eszközt használja (ebben a forgatókönyvben a RAG a tudásbázis felett) a válasz megadásához. Ezután inicializálja az ügynököt az eszköz, az LLM és az ügynöktípus átadásával:

Láthatja, ahogy az ügynök átmegy thoughts, actionsés observation , használja az eszközt (ebben a forgatókönyvben az indexelt dokumentumok lekérdezése); és adja vissza az eredményt:

A végpontok közötti megvalósítási kódot a mellékelt dokumentumban találja GitHub repo.

Tisztítsuk meg

A szükségtelen költségek elkerülése érdekében megtisztíthatja erőforrásait a következő kódrészletek vagy az Amazon JumpStart UI segítségével.

A Boto3 SDK használatához használja a következő kódot a szövegbeágyazási modell végpontjának és a szöveggenerálási modell végpontjának, valamint a végpont konfigurációknak a törléséhez:

A SageMaker konzol használatához hajtsa végre a következő lépéseket:

- A SageMaker konzolon a navigációs ablak Következtetés részében válassza a Végpontok lehetőséget

- Keresse meg a beágyazási és szöveggenerálási végpontokat.

- A végpont részleteit tartalmazó oldalon válassza a Törlés lehetőséget.

- A megerősítéshez válassza ismét a Törlés lehetőséget.

Következtetés

A keresésre és visszakeresésre összpontosító felhasználási esetekben a LlamaIndex rugalmas lehetőségeket biztosít. Kiválóan teljesít az LLM-ek indexelésében és visszakeresésében, így hatékony eszköz az adatok mélyreható feltárásához. A LlamaIndex lehetővé teszi szervezett adatindexek létrehozását, különböző LLM-ek használatát, az adatok bővítését a jobb LLM-teljesítmény érdekében, és az adatok természetes nyelven történő lekérdezését.

Ez a bejegyzés bemutatott néhány kulcsfontosságú LlamaIndex koncepciót és képességet. A GPT-J-t használtuk a beágyazáshoz, a Llama 2-Chat pedig LLM-ként egy RAG-alkalmazás felépítéséhez, de használhat bármilyen megfelelő modellt. Fedezze fel a SageMaker JumpStart-on elérhető modellek átfogó választékát.

Azt is bemutattuk, hogy a LlamaIndex hogyan tud hatékony, rugalmas eszközöket nyújtani az adatok összekapcsolásához, indexeléséhez, visszakereséséhez és integrálásához más keretrendszerekkel, például a LangChainnel. A LlamaIndex integrációkkal és a LangChainnel erősebb, sokoldalúbb és éleslátóbb LLM-alkalmazásokat készíthet.

A szerzőkről

Dr. Romina Sharifpour az Amazon Web Services (AWS) gépi tanulási és mesterséges intelligencia megoldások vezető építésze. Több mint 10 évet töltött az ML és az AI fejlődésének köszönhetően innovatív, teljes körű megoldások tervezésében és megvalósításában. Romina érdeklődési területei a természetes nyelvi feldolgozás, a nagy nyelvi modellek és az MLOp-k.

Dr. Romina Sharifpour az Amazon Web Services (AWS) gépi tanulási és mesterséges intelligencia megoldások vezető építésze. Több mint 10 évet töltött az ML és az AI fejlődésének köszönhetően innovatív, teljes körű megoldások tervezésében és megvalósításában. Romina érdeklődési területei a természetes nyelvi feldolgozás, a nagy nyelvi modellek és az MLOp-k.

Nicole Pinto egy AI/ML Specialist Solutions Architect Sydney-ben, Ausztráliában. Az egészségügyi és pénzügyi szolgáltatások terén szerzett múltja egyedülálló perspektívát ad az ügyfelek problémáinak megoldásában. Szenvedélyesen törekszik arra, hogy a gépi tanulás révén lehetővé tegye ügyfelei számára, valamint a nők következő generációjának megerősítését a STEM területén.

Nicole Pinto egy AI/ML Specialist Solutions Architect Sydney-ben, Ausztráliában. Az egészségügyi és pénzügyi szolgáltatások terén szerzett múltja egyedülálló perspektívát ad az ügyfelek problémáinak megoldásában. Szenvedélyesen törekszik arra, hogy a gépi tanulás révén lehetővé tegye ügyfelei számára, valamint a nők következő generációjának megerősítését a STEM területén.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/build-knowledge-powered-conversational-applications-using-llamaindex-and-llama-2-chat/

- :van

- :is

- :nem

- :ahol

- $ UP

- 1

- 10

- 100

- 11

- 13

- 14

- 15%

- 16

- 2022

- 2023

- 22

- 500

- 7

- 8

- 9

- a

- képesség

- Képes

- Rólunk

- elfogadás

- elfogadott

- elfogadja

- hozzáférés

- Szerint

- Fiók

- pontos

- cselekmények

- hozzá

- mellett

- További

- cím

- fejlesztések

- Előny

- Után

- újra

- Ügynök

- szerek

- Megállapodás

- AI

- ai kutatás

- AI / ML

- Minden termék

- lehetővé téve

- lehetővé teszi, hogy

- már

- Is

- amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Az Amazon Web Services

- Amazon Web Services (AWS)

- Összegek

- an

- és a

- válasz

- üzenetrögzítő

- válaszok

- bármilyen

- API-k

- Alkalmazás

- alkalmazások

- megközelítés

- megfelelő

- megfelelő

- körülbelül

- építészet

- VANNAK

- területek

- felmerülhet

- mesterséges

- mesterséges intelligencia

- AS

- kérdez

- Támogatás

- asszisztensek

- segítő

- At

- attribútumok

- fokozza

- bővített

- Ausztrália

- elérhető

- elkerülése érdekében

- AWS

- vissza

- háttér

- bázis

- alapján

- alapvető

- BE

- strand

- mert

- óta

- előtt

- Jobb

- között

- mindkét

- szünet

- áthidaló

- hoz

- épít

- Épület

- épült

- de

- by

- hívott

- TUD

- képességek

- képesség

- eset

- esetek

- csevegés

- chatbots

- választás

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- osztály

- ragadozó ölyv

- világosan

- vásárló

- kód

- ÖSSZEFÜGGŐ

- kombájnok

- érkező

- Közös

- általában

- vállalat

- képest

- versenyez

- teljes

- bonyolult

- összetevő

- alkatrészek

- megért

- átfogó

- fogalmak

- arra a következtetésre jut

- Configuration

- konfigurálása

- megerősít

- Csatlakozás

- csatlakozók

- megfontolások

- úgy véli,

- következetes

- áll

- Konzol

- konstrukció

- Konténer

- tartalom

- kontextus

- folytatódik

- társalgó

- beszélgetések

- megtérít

- átalakított

- konvertáló

- kijavítására

- Költség

- költségmegtakarítás

- kiadások

- tudott

- teremt

- készítette

- létrehozása

- HITELEZÉS

- kritikai

- szokás

- vevő

- Ügyfelek

- testre

- vágás

- dátum

- adat hozzáférés

- adatbázisok

- adatkészletek

- mély

- alapértelmezett

- meghatározott

- meghatározott

- meghatározó

- szállít

- bizonyítani

- igazolták

- függőségek

- függ

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- Design

- tervezett

- részletek

- Fejlesztés

- diagram

- Párbeszéd

- DICT

- közvetlenül

- számos

- do

- docs

- dokumentum

- dokumentumok

- domain

- ne

- hajtott

- alatt

- Korábban

- Hatékony

- hatékony

- megerőltetés nélküli

- bármelyik

- elemek

- beágyazás

- képessé

- engedélyezve

- lehetővé teszi

- lehetővé téve

- végén

- végtől végig

- Endpoint

- Motor

- Motorok

- Vállalkozás

- Egész

- Környezet

- egyenlő

- értékelés

- példa

- példák

- izgalmas

- létező

- várható

- kísérletezik

- kifejezetten

- kutatás

- feltárása

- külső

- Arc

- megkönnyíti

- Vízesés

- ismerős

- család

- Funkció

- Jellemzők

- kevés

- Fájlok

- pénzügyi

- pénzügyi szolgáltatások

- Találjon

- vezetéknév

- Rugalmasság

- rugalmas

- összpontosított

- koncentrál

- következő

- A

- Alapítvány

- Keretrendszer

- keretek

- ból ből

- funkció

- rés

- általában

- generál

- generált

- generáló

- generáció

- nemző

- ad

- Globális

- megy

- jó

- szabályozott

- nagyobb

- fogantyú

- hám

- Legyen

- egészségügyi

- segít

- neki

- Rejtett

- jó minőségű

- Hogyan

- How To

- azonban

- HTML

- HTTPS

- Kerékagy

- ID

- azonosított

- Identitás

- if

- figyelmen kívül hagy

- végrehajtás

- fejlesztések

- in

- tartalmaz

- magában foglalja a

- Beleértve

- amely magában foglalja

- Növelje

- Növeli

- index

- indexelt

- indexek

- jelez

- jelezve

- információ

- tájékoztatja

- Infrastruktúra

- Innováció

- újító

- bemenet

- bemenet

- bevitel

- éleslátó

- telepíteni

- példa

- helyette

- utasítás

- integrálni

- integráció

- integrációk

- Intelligencia

- szándékolt

- interaktív

- kamat

- Felület

- interfészek

- bele

- Bemutatja

- jár

- kérdések

- IT

- ITS

- jpg

- json

- július

- Kulcs

- tudás

- hiány

- nyelv

- nagy

- a későbbiekben

- vezető

- tanulás

- szint

- Engedély

- mint

- Valószínű

- Lista

- Láma

- LLM

- kiszámításának

- rakodó

- betöltés

- helyileg

- Hosszú

- gép

- gépi tanulás

- csinál

- KÉSZÍT

- Gyártás

- kezelése

- maximális

- Lehet..

- említett

- üzenet

- meta

- módszer

- vándorló

- elvándorlás

- minimum

- Perc

- ML

- MLOps

- modell

- modellek

- több

- a legtöbb

- sok

- név

- Természetes

- Természetes nyelvi feldolgozás

- Navigáció

- elengedhetetlen

- Szükség

- szükséges

- igények

- következő

- csomópontok

- szám

- tárgy

- objektumok

- of

- ajánlat

- Ajánlatok

- gyakran

- on

- ONE

- csak

- -ra

- nyitva

- operatív

- Művelet

- optimalizált

- Opciók

- or

- érdekében

- Szervezett

- Más

- mi

- ki

- vázolt

- teljesítmény

- kimenetek

- felett

- felülírás

- áttekintés

- saját

- oldal

- üvegtábla

- Papír

- paraméter

- paraméterek

- rész

- különös

- alkatrészek

- elhalad

- szakaszok

- Elmúlt

- Múló

- szenvedélyes

- teljesítmény

- engedélyek

- perspektíva

- Plató

- Platón adatintelligencia

- PlatoData

- Népszerű

- állás

- hatalom

- erős

- pontosan

- Predictor

- előkészítés

- nyomja meg a

- CIKK

- Hírek

- problémák

- folyamat

- feldolgozás

- gyárt

- Termelés

- ad

- feltéve,

- biztosít

- nyilvánosan

- tiszta

- Piton

- Kérdések és válaszok

- lekérdezések

- kérdés

- kérdés

- Kérdések

- Quick

- rongy

- véletlenszerűség

- hatótávolság

- Inkább

- Nyers

- Olvass

- kész

- real-time

- kap

- recept

- ajánlott

- Csökkent

- utal

- referencia

- kifejezés

- újrabefektetés

- engedje

- Releases

- cserélni

- raktár

- képviselők

- szükség

- kötelező

- kutatás

- kutatás és fejlesztés

- Tudástár

- válasz

- válaszok

- eredményez

- visszakeresés

- visszatérés

- Visszatér

- Gazdag

- jobb

- erős

- Szerep

- szerepek

- futás

- futás

- s

- Biztonság

- sagemaker

- minta

- Megtakarítás

- forgatókönyv

- sdk

- Keresés

- keresések

- Rész

- szakaszok

- lát

- válasszuk

- MAGA

- küld

- elküldés

- idősebb

- szeptember

- szolgáltatás

- Szolgáltatások

- készlet

- beállítás

- beállítások

- felépítés

- ő

- kellene

- kimutatta,

- mutatott

- Műsorok

- hasonló

- Egyszerű

- egyszerűsítése

- óta

- Méret

- méretek

- töredék

- So

- megoldások

- Megoldások

- Megoldása

- néhány

- forrás

- származó

- Források

- szakember

- különleges

- kifejezetten

- költött

- kezdet

- csúcs-

- Államok

- Származik

- Lépés

- Lépései

- tárolás

- tárolni

- memorizált

- árnyékolók

- egyértelmű

- ésszerűsítése

- erősségek

- struktúra

- stúdió

- Később

- sikeresen

- ilyen

- megfelelő

- sydney

- rendszer

- Systems

- Vesz

- tart

- Érintse

- feladatok

- Technologies

- sablon

- Inkább

- teszt

- szöveg

- mint

- hogy

- A

- Őket

- akkor

- Ezek

- ők

- ezt

- azok

- Keresztül

- idő

- nak nek

- tokenek

- szerszám

- szerszámok

- felső

- nyomkövetés

- Képzések

- Átalakítás

- Trillió

- megpróbál

- kettő

- típus

- típusok

- jellemzően

- ui

- alatt

- megért

- egyedi

- felesleges

- Frissítések

- Használat

- használ

- használati eset

- használt

- hasznos

- használó

- felhasználói felület

- barátságos felhasználói

- Felhasználók

- használ

- segítségével

- Értékek

- változó

- fajta

- különféle

- Hatalmas

- sokoldalú

- változat

- keresztül

- akar

- we

- háló

- webes szolgáltatások

- JÓL

- Mit

- Mi

- amikor

- mivel

- vajon

- ami

- míg

- lesz

- val vel

- Női

- munkafolyamatok

- dolgozó

- lenne

- év

- te

- A te

- zephyrnet