A nagy nyelvi modellek (LLM) széles körű tudásukkal szinte bármilyen témában képesek emberszerű szöveget generálni. A hatalmas adatkészletekkel kapcsolatos képzésük azonban korlátozza azok hasznosságát speciális feladatokhoz. Folyamatos tanulás nélkül ezek a modellek figyelmen kívül hagyják a kezdeti betanításuk után megjelenő új adatokat és trendeket. Ezen túlmenően az új LLM-ek képzésének költségei sok vállalati környezetben túl magasnak bizonyulhatnak. Mindazonáltal lehetséges a modellválasz és az eredeti speciális tartalom kereszthivatkozása, így elkerülhető egy új LLM-modell betanítása a Retrieval-Augmented Generation (RAG) használatával.

A RAG felhatalmazza az LLM-eket azáltal, hogy lehetővé teszi számukra a külső tudás visszaszerzését és beépítését. Ahelyett, hogy kizárólag az előre betanított tudásukra hagyatkoznának, a RAG lehetővé teszi a modelleknek, hogy adatokat gyűjtsenek dokumentumokból, adatbázisokból és egyebekből. A modell aztán ügyesen integrálja ezt a külső információt a generált szövegébe. A kontextus szempontjából releváns adatok beszerzésével a modell tájékozott, naprakész válaszokat tud adni az Ön használati esetére szabva. A tudásbővítés csökkenti a hallucinációk és a pontatlan vagy értelmetlen szövegek valószínűségét is. A RAG segítségével az alapmodellek alkalmazkodó szakértőkké válnak, amelyek tudásbázisának növekedésével fejlődnek.

Ma izgatottan várjuk, hogy bemutathassunk három generatív AI-demót, amelyek licence alá tartozik MIT-0 licenc:

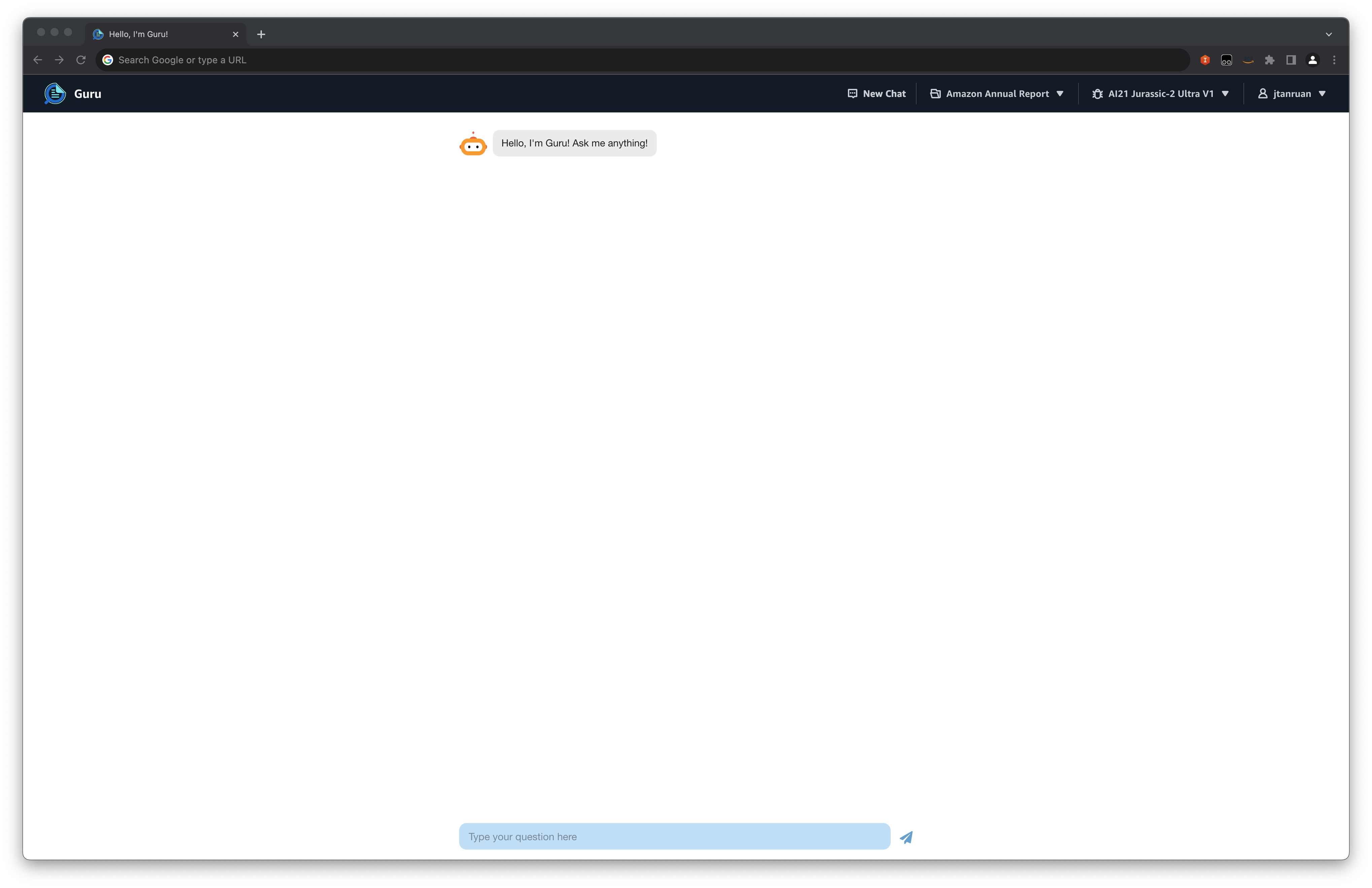

- Amazon Kendra alapozó LLM-mel – Kihasználja a mélykeresési képességeket Amazon Kendra kombinálva az LLM-ek kiterjedt tudásával. Ez az integráció precíz és környezettudatos válaszokat ad összetett lekérdezésekre, sokféle forrásból merítve.

- Beágyazási modell alapozó LLM-mel – Egyesíti a beágyazások erejét – ez a technika a szavak és kifejezések szemantikai jelentésének rögzítésére – az LLM-ek hatalmas tudásbázisával. Ez a szinergia pontosabb témamodellezést, tartalomajánlást és szemantikus keresési lehetőségeket tesz lehetővé.

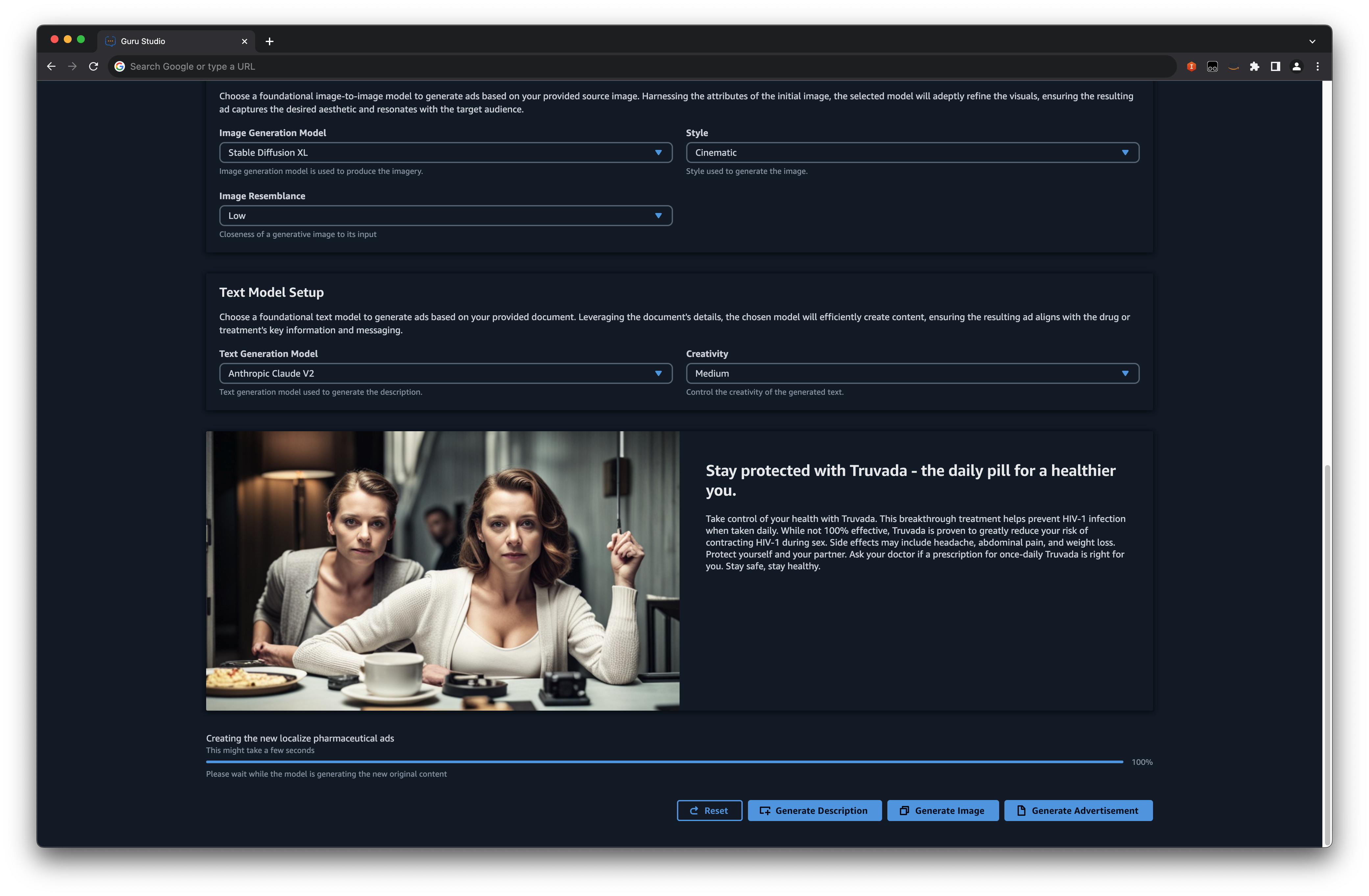

- Foundation Models Pharma Ad Generator – Egy speciális alkalmazás a gyógyszeripar számára. Az alapmodellek generatív képességeit kihasználva ez az eszköz meggyőző és megfelelő gyógyszerészeti reklámokat hoz létre, biztosítva, hogy a tartalom megfeleljen az iparági szabványoknak és előírásoknak.

Ezek a demók zökkenőmentesen telepíthetők az AWS-fiókjában, alapvető betekintést és útmutatást nyújtva az AWS-szolgáltatások használatához a legmodernebb LLM-generatív mesterségesintelligencia-kérdések és -válaszok bot- és tartalomgeneráló létrehozásához.

Ebben a bejegyzésben megvizsgáljuk, hogy a RAG az Amazon Kendrával vagy az egyéni beágyazásokkal kombinálva hogyan tudja leküzdeni ezeket a kihívásokat, és hogyan adhat kifinomult válaszokat a természetes nyelvű lekérdezésekre.

Megoldás áttekintése

A megoldás elfogadásával a következő előnyökhöz juthat:

- Továbbfejlesztett információ-hozzáférés – A RAG lehetővé teszi a modellek számára, hogy hatalmas külső forrásokból vonják be az információkat, ami különösen akkor lehet hasznos, ha az előre betanított modell tudása elavult vagy hiányos.

- skálázhatóság – Ahelyett, hogy a modellt az összes rendelkezésre álló adatra betanítaná, a RAG lehetővé teszi a modellek számára, hogy menet közben lekérjék a releváns információkat. Ez azt jelenti, hogy amint új adatok válnak elérhetővé, hozzáadhatók a visszakeresési adatbázishoz anélkül, hogy a teljes modellt újra kellene tanítani.

- A memória hatékonysága – Az LLM-ek jelentős memóriát igényelnek a paraméterek tárolásához. A RAG segítségével a modell kisebb is lehet, mert nem kell minden részletet megjegyeznie; szükség esetén visszakeresheti őket.

- Dinamikus tudásfrissítés – A beállított tudásvégponttal rendelkező hagyományos modellektől eltérően a RAG külső adatbázisa rendszeresen frissíthető, így a modell hozzáférhet a naprakész információkhoz. A visszakeresés funkció finomhangolható különböző feladatokhoz. Például egy orvosi diagnosztikai feladat orvosi folyóiratokból nyerhet adatokat, így biztosítva, hogy a modell szakértői és releváns betekintést nyerjen.

- Elfogultság mérséklése – A jól gondozott adatbázisból való merítés lehetősége lehetőséget kínál a torzítások minimalizálására a kiegyensúlyozott és pártatlan külső források biztosításával.

Mielőtt belevágna az Amazon Kendra és az alapszintű LLM-ek integrációjába, elengedhetetlen, hogy felszerelje magát a szükséges eszközökkel és rendszerkövetelményekkel. A megfelelő beállítás az első lépés a demók zökkenőmentes telepítése felé.

Előfeltételek

A következő előfeltételekkel kell rendelkeznie:

Bár az oktatóanyagban részletezett infrastruktúra beállítható és üzembe helyezhető helyi számítógépéről, AWS Cloud9 kényelmes alternatívát kínál. Az olyan eszközökkel előre felszerelve, mint az AWS CLI, AWS CDK és Docker, az AWS Cloud9 üzembe helyezési munkaállomásként is működhet. A szolgáltatás használatához egyszerűen állítsa be a környezetet keresztül AWS Cloud9 konzol.

Az előfeltételek hiányában merüljünk el az Amazon Kendra szolgáltatásaiban és képességeiben az alapvető LLM-ekkel.

Amazon Kendra alapozó LLM-mel

Az Amazon Kendra egy gépi tanulással (ML) továbbfejlesztett fejlett vállalati keresőszolgáltatás, amely kész szemantikus keresési lehetőségeket biztosít. A természetes nyelvi feldolgozást (NLP) alkalmazva az Amazon Kendra felfogja a dokumentumok tartalmát és a felhasználói lekérdezések mögöttes szándékát is, így a RAG alapú megoldások tartalomkereső eszközeként pozicionálja. Ha a Kendra nagy pontosságú keresési tartalmát RAG-rakományként használja, jobb LLM-válaszokat kaphat. Az Amazon Kendra használata ebben a megoldásban személyre szabott keresést is lehetővé tesz a válaszok szűrésével a végfelhasználói tartalom-hozzáférési engedélyek szerint.

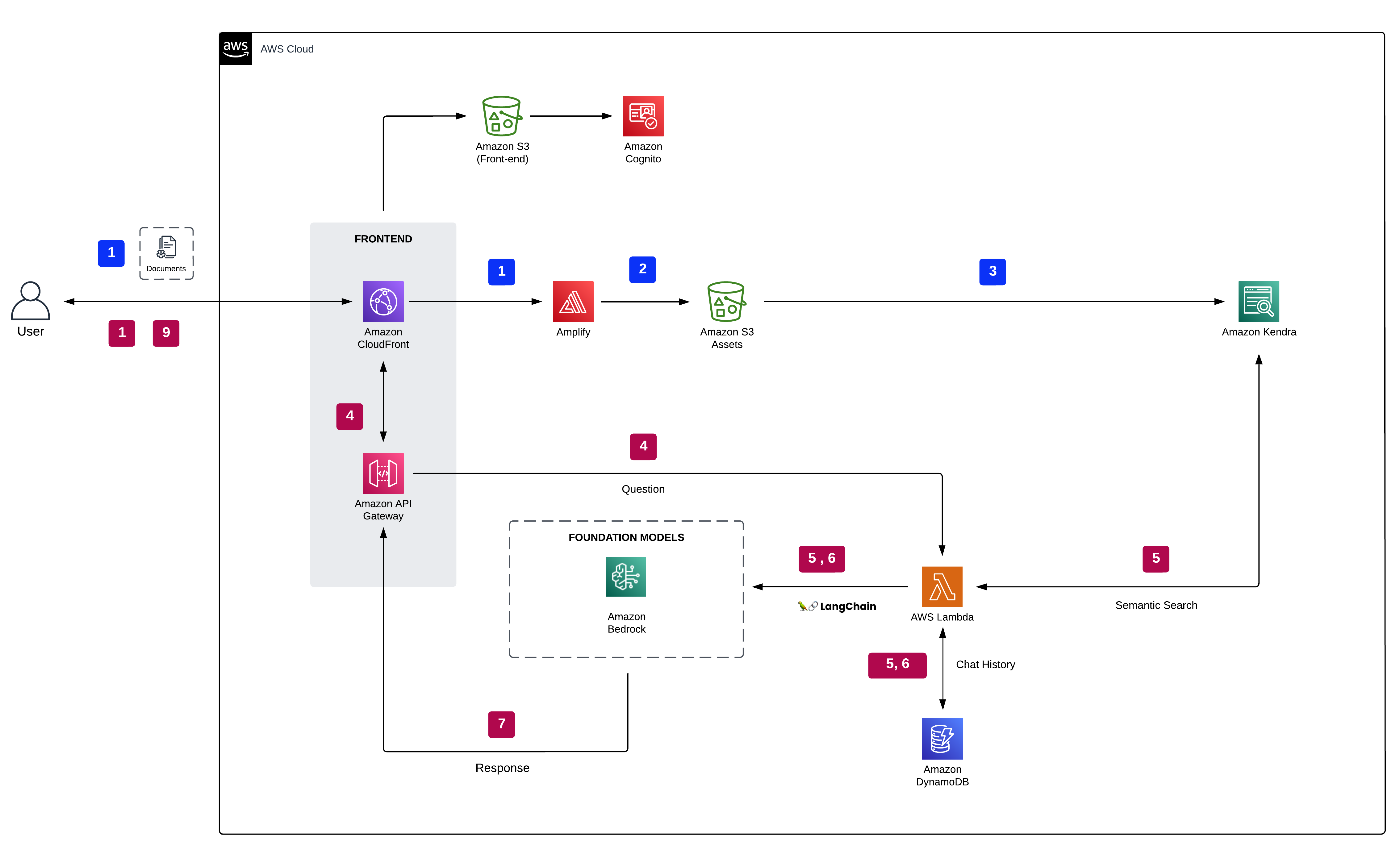

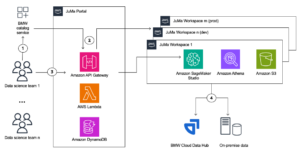

A következő diagram egy generatív mesterséges intelligencia alkalmazás architektúráját mutatja be a RAG megközelítést alkalmazva.

A dokumentumokat az Amazon Kendra dolgozza fel és indexeli a Amazon Simple Storage Service (Amazon S3) csatlakozó. Az Amazon Kendra ügyfélkérelmei és kontextuális adatai egy Amazon alapkőzet alapozó modell. A demó lehetővé teszi az Amazon Bedrock által támogatott Amazon Titan, AI21 Jurassic és Anthropic Claude modelljei közötti választást. A beszélgetési előzmények mentése ide kerül Amazon DynamoDB, amely további kontextust kínál az LLM számára a válaszok generálásához.

Ezt a bemutatót a GitHub repo. Tekintse meg a readme fájlban található telepítési utasításokat az AWS-fiókba való üzembe helyezéséhez.

A következő lépések felvázolják a folyamatot, amikor a felhasználó interakcióba lép a generatív AI alkalmazással:

- A felhasználó bejelentkezik az általa hitelesített webalkalmazásba Amazon Cognito.

- A felhasználó egy vagy több dokumentumot tölt fel az Amazon S3-ba.

- A felhasználó egy Amazon Kendra szinkronizálási feladatot futtat, hogy az S3 dokumentumokat az Amazon Kendra indexbe töltse.

- A felhasználó kérdése a webhelyen tárolt biztonságos WebSocket API-n keresztül történik Amazon API átjáró mögött a AWS Lambda funkciót.

- A Lambda funkció, amelyet a LangChain A keretrendszer – egy sokoldalú eszköz az AI nyelvi modellek által vezérelt alkalmazások létrehozására – csatlakozik az Amazon Bedrock végpontjához, hogy a csevegési előzmények alapján újrafogalmazhassa a felhasználó kérdését. Az újrafogalmazás után a kérdést a Retrieve API segítségével továbbítják az Amazon Kendra-nak. Válaszul az Amazon Kendra index megjeleníti a keresési eredményeket, és kivonatokat ad a vállalat által bevitt adatokból származó releváns dokumentumokból.

- A felhasználó kérdése az indexből leolvasott adatokkal együtt kontextusként kerül elküldésre az LLM promptban. Az LLM-től kapott válasz csevegési előzményekként kerül tárolásra a DynamoDB-n belül.

- Végül az LLM válaszát visszaküldi a felhasználónak.

Dokumentumindexelési munkafolyamat

A dokumentumok feldolgozásának és indexelésének eljárása a következő:

- A felhasználók a felhasználói felületen (UI) keresztül nyújtják be a dokumentumokat.

- A dokumentumok egy S3 vödörbe kerülnek átvitelre a AWS erősítés API.

- Az Amazon Kendra az Amazon Kendra S3 csatlakozón keresztül indexeli az új dokumentumokat az S3 tárolóban.

Előnyök

Az alábbi lista kiemeli ennek a megoldásnak az előnyeit:

- Vállalati szintű visszakeresés – Az Amazon Kendra vállalati keresésre készült, így alkalmas a hatalmas mennyiségű strukturált és strukturálatlan adattal rendelkező szervezetek számára.

- Szemantikai megértés – Az Amazon Kendra ML képességei biztosítják, hogy a visszakeresés mély szemantikai megértésen, és ne csak a kulcsszavak egyezésén alapuljon.

- skálázhatóság – Az Amazon Kendra képes kezelni a nagyméretű adatforrásokat, és gyors és releváns keresési eredményeket biztosít.

- Rugalmasság – Az alapmodell sokféle kontextus alapján képes válaszokat generálni, biztosítva a rendszer sokoldalúságát.

- Integrációs képességek – Az Amazon Kendra integrálható különféle AWS szolgáltatásokkal és adatforrásokkal, így adaptálható a különböző szervezeti igényekhez.

Beágyazási modell alapozó LLM-mel

An beágyazás egy numerikus vektor, amely a különféle adattípusok lényegét képviseli, beleértve a szöveget, képeket, hangokat és dokumentumokat. Ez az ábrázolás nemcsak az adatok belső jelentését ragadja meg, hanem a gyakorlati alkalmazások széles körére is adaptálja. A modellek beágyazása, az ML egyik ága összetett adatokat, például szavakat vagy kifejezéseket alakít át folytonos vektorterekké. Ezek a vektorok eredendően megragadják az adatok közötti szemantikai kapcsolatokat, lehetővé téve a mélyebb és élesebb összehasonlítást.

A RAG zökkenőmentesen egyesíti az alapmodellek, például a transzformátorok erősségeit a beágyazások pontosságával, hogy hatalmas adatbázisokat keressen a releváns információkért. Lekérdezés fogadásakor a rendszer beágyazásokat használ a releváns szakaszok azonosítására és kinyerésére egy kiterjedt adathalmazból. Az alapmodell ezután kontextuálisan pontos választ fogalmaz meg ezen kivont információk alapján. Az adatok visszakeresése és a válaszgenerálás közötti tökéletes szinergia lehetővé teszi, hogy a rendszer alapos válaszokat adjon, merítve a kiterjedt adatbázisokban tárolt hatalmas tudásból.

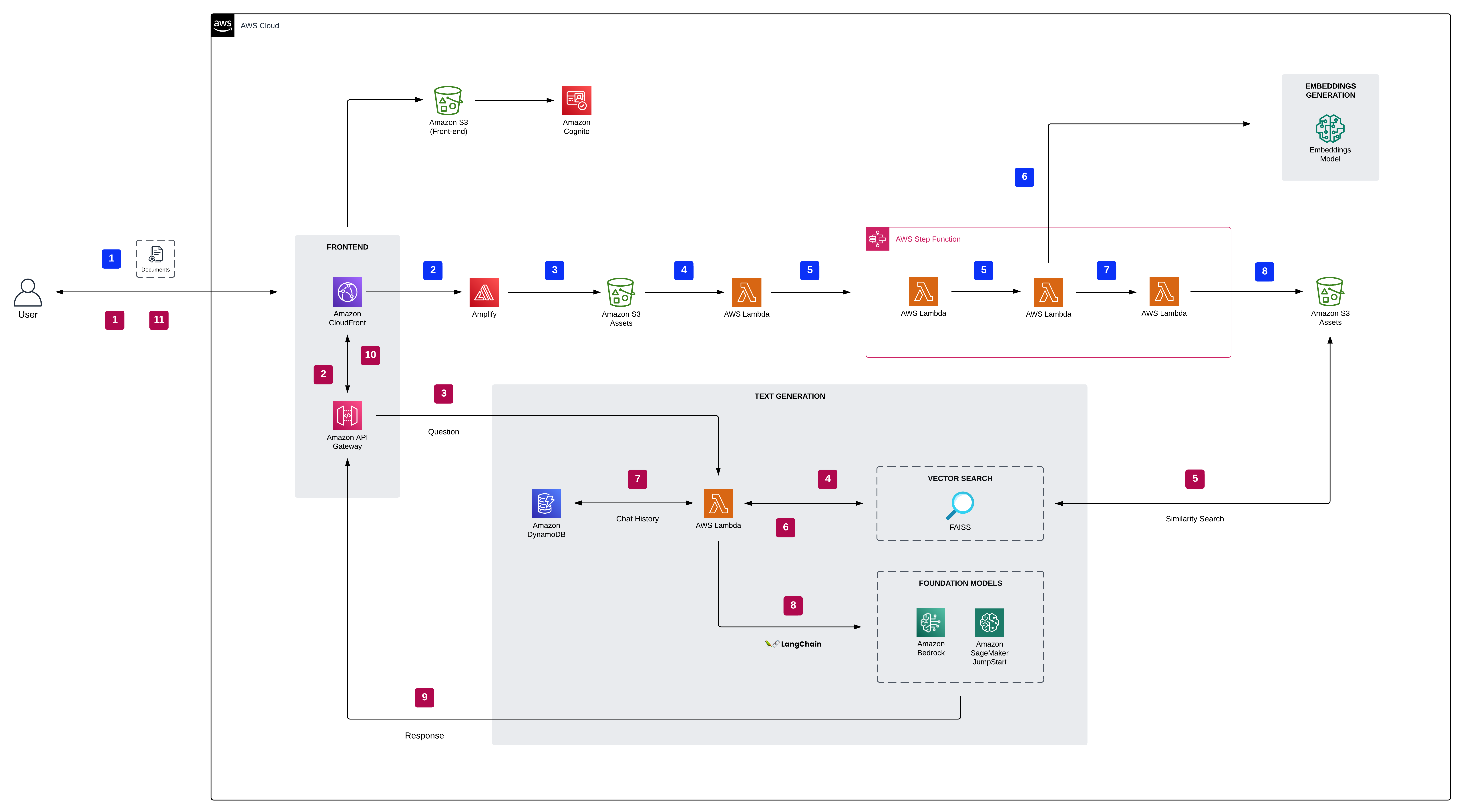

Az építészeti elrendezésben a felhasználói felület kiválasztása alapján a felhasználókat vagy az Amazon Bedrock-hoz, ill. Amazon SageMaker JumpStart alapozó modellek. A dokumentumok feldolgozáson esnek át, és a vektoros beágyazásokat a beágyazási modell hozza létre. Ezeket a beágyazásokat ezután a rendszer indexeli FAISS hogy lehetővé tegye a hatékony szemantikai keresést. A DynamoDB megőrzi a beszélgetési előzményeket, gazdagítva a kontextust az LLM számára a válaszok elkészítéséhez.

A következő diagram a megoldás architektúráját és munkafolyamatát mutatja be.

Ezt a bemutatót a GitHub repo. Tekintse meg a readme fájlban található telepítési utasításokat az AWS-fiókba való üzembe helyezéséhez.

Beágyazási modell

A beágyazási modell feladatai a következők:

- Ez a modell felelős a szövegek (például dokumentumok vagy szövegrészek) sűrű vektoros ábrázolásokká, közismert nevén beágyazásokká alakításáért.

- Ezek a beágyazások megragadják a szöveg szemantikai jelentését, lehetővé téve a különböző szövegrészek hatékony és szemantikailag értelmes összehasonlítását.

- A beágyazási modell ugyanazon a hatalmas korpuszon betanítható, mint az alapmodell, vagy speciális tartományokra specializálódhat.

Kérdések és válaszok munkafolyamat

A következő lépések a dokumentumokon keresztüli kérdések megválaszolásának munkafolyamatát írják le:

- A felhasználó bejelentkezik az Amazon Cognito által hitelesített webalkalmazásba.

- A felhasználó egy vagy több dokumentumot tölt fel az Amazon S3-ra.

- A dokumentum átvitelekor egy S3 eseményértesítés elindít egy Lambda függvényt, amely meghívja a SageMaker beágyazási modell végpontját, hogy létrehozza az új dokumentum beágyazásait. A beágyazási modell a kérdést sűrű vektoros reprezentációvá alakítja (beágyazás). Az eredményül kapott vektorfájl biztonságosan tárolva van az S3 tárolóban.

- A FAISS retriever összehasonlítja ezt a kérdésbeágyazást az adatbázisban található összes dokumentum vagy szövegrész beágyazásával, hogy megtalálja a legrelevánsabb részeket.

- A szövegrészek a felhasználó kérdésével együtt az alapmodell kontextusaként szolgálnak. A Lambda függvény a LangChain könyvtárat használja, és egy környezettel kitöltött lekérdezéssel csatlakozik az Amazon Bedrock vagy a SageMaker JumpStart végponthoz.

- Az LLM-től kapott válasz a DynamoDB-ben tárolódik a felhasználó lekérdezésével, az időbélyeggel, az egyedi azonosítóval és az elem egyéb tetszőleges azonosítóival, például a kérdéskategóriával együtt. A kérdés és a válasz különálló elemként való tárolása lehetővé teszi a Lambda funkció számára, hogy könnyen újra létrehozza a felhasználó beszélgetési előzményeit a kérdések feltevésének időpontja alapján.

- Végül a válasz HTTPs-kéréssel visszaküldésre kerül a felhasználónak az API Gateway WebSocket API integrációs válaszán keresztül.

Előnyök

Az alábbi lista a megoldás előnyeit írja le:

- Szemantikai megértés – A beágyazási modell biztosítja, hogy a retriever mély szemantikai megértés alapján válassza ki a szövegrészeket, nem csak a kulcsszóegyezések alapján.

- skálázhatóság – A beágyazások hatékony hasonlóság-összehasonlítást tesznek lehetővé, lehetővé téve a dokumentumok hatalmas adatbázisaiban való gyors keresést.

- Rugalmasság – Az alapmodell sokféle kontextus alapján képes válaszokat generálni, biztosítva a rendszer sokoldalúságát.

- Domain alkalmazkodóképesség – A beágyazási modell betanítható vagy finomhangolható meghatározott tartományokhoz, lehetővé téve a rendszer adaptálását különféle alkalmazásokhoz.

Foundation Models Pharma Ad Generator

Napjaink felgyorsult gyógyszeriparában a hatékony és lokalizált reklámozás fontosabb, mint valaha. Itt jön képbe egy innovatív megoldás, amely a generatív mesterséges intelligencia erejét felhasználva lokalizált gyógyszerészeti hirdetéseket készít forrásképekből és PDF-fájlokból. Ez a megközelítés a hirdetésgenerálási folyamat pusztán felgyorsításán túl leegyszerűsíti az Medical Legal Review (MLR) folyamatát. Az MLR egy szigorú felülvizsgálati mechanizmus, amelyben az orvosi, jogi és szabályozói csoportok aprólékosan értékelik a promóciós anyagokat, hogy garantálják azok pontosságát, tudományos alátámasztását és a szabályozási megfelelést. A hagyományos tartalomkészítési módszerek nehézkesek lehetnek, gyakran manuális módosításokat és kiterjedt felülvizsgálatokat igényelnek, hogy biztosítsák a regionális megfelelőséggel és relevanciával való összhangot. A generatív mesterséges intelligencia megjelenésével azonban már automatizálhatjuk a helyi közönség számára valóban rezonáló hirdetések készítését, miközben betartjuk a szigorú szabványokat és irányelveket.

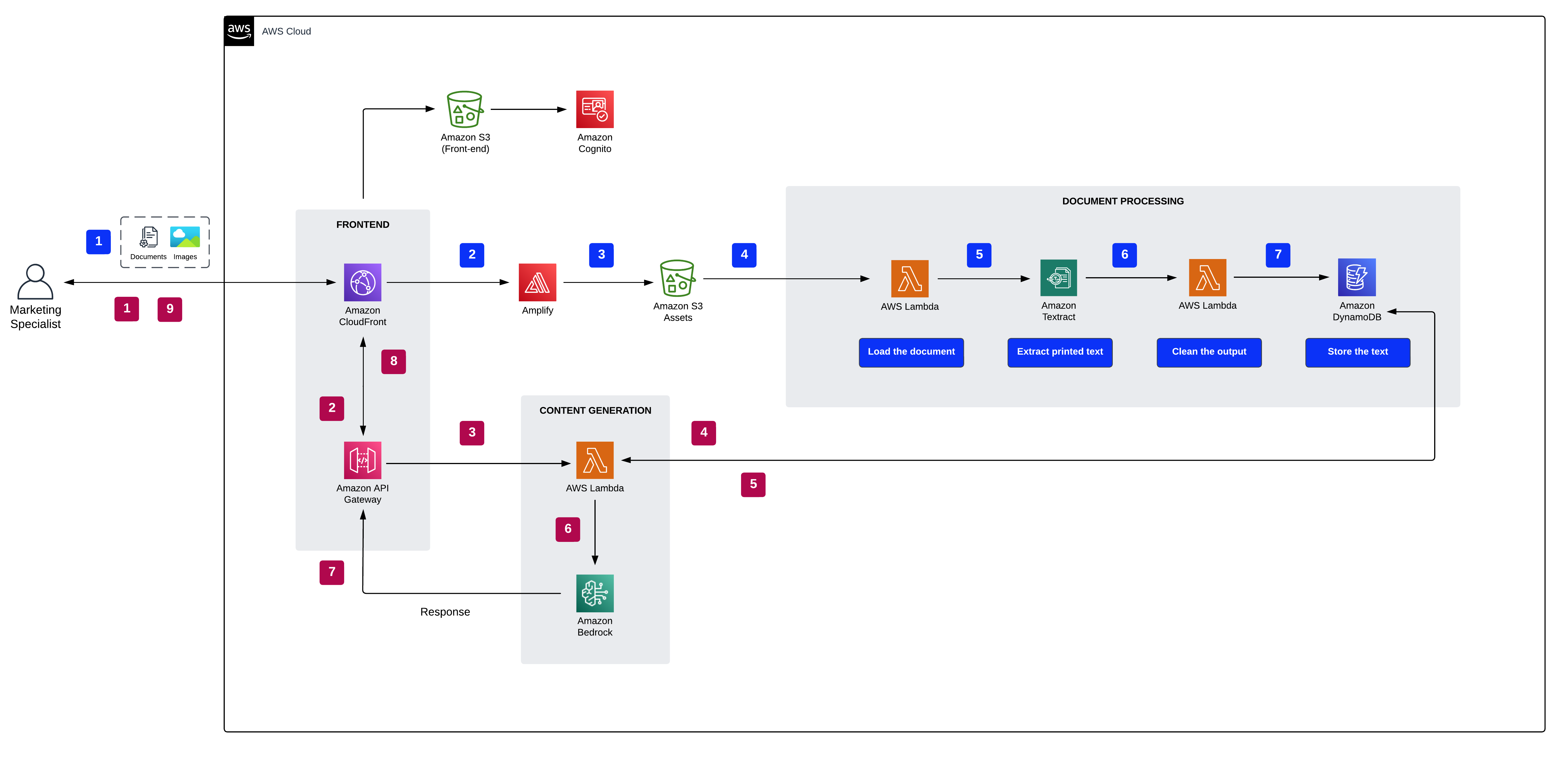

A következő ábra a megoldás architektúráját mutatja be.

Az építészeti elrendezésben a kiválasztott modell és hirdetési preferenciák alapján a felhasználók zökkenőmentesen az Amazon Bedrock alapozási modelljeihez vezetnek. Ez az egyszerűsített megközelítés biztosítja, hogy az új hirdetések pontosan a kívánt konfigurációnak megfelelően jönnek létre. A folyamat részeként a dokumentumokat hatékonyan kezeli Amazon szöveg, az eredményül kapott szöveg biztonságosan tárolva a DynamoDB-ben. Kiemelkedő tulajdonsága a moduláris felépítés a kép- és szöveggeneráláshoz, amely rugalmasságot biztosít bármely komponens igény szerinti önálló regenerálásához.

Ezt a bemutatót a GitHub repo. Tekintse meg a readme fájlban található telepítési utasításokat az AWS-fiókba való üzembe helyezéséhez.

Tartalomgeneráló munkafolyamat

A következő lépések felvázolják a tartalom létrehozásának folyamatát:

- A felhasználó kiválasztja a dokumentumot, a forrásképet, a hirdetéselhelyezést, a nyelvet és a képstílust.

- A webalkalmazáshoz való biztonságos hozzáférést az Amazon Cognito hitelesítés biztosítja.

- A webalkalmazás kezelőfelületét az Amplify tárolja.

- Az API Gateway által kezelt WebSocket API megkönnyíti a felhasználói kéréseket. Ezeket a kéréseket hitelesítik AWS Identity and Access Management (ÉN VAGYOK).

- Az Amazon Bedrock-kal való integráció a következő lépéseket tartalmazza:

- A Lambda függvény a LangChain könyvtárat használja az Amazon Bedrock végpontjához való csatlakozáshoz egy kontextusban gazdag lekérdezéssel.

- A szövegről szövegre alapozó modell a kontextusnak megfelelő hirdetést készít az adott kontextus és beállítások alapján.

- A szöveg-kép alapmodell személyre szabott képet hoz létre, amelyet a forráskép, a választott stílus és a helyszín befolyásol.

- A felhasználó HTTPS-kéréssel kapja meg a választ az integrált API Gateway WebSocket API-n keresztül.

Dokumentum- és képfeldolgozási munkafolyamat

A dokumentumok és képek feldolgozásának folyamata a következő:

- A felhasználó a megadott felhasználói felületen keresztül tölt fel tartalmakat.

- Az Amplify API átviszi a dokumentumokat egy S3 vödörbe.

- Miután az eszköz átkerült az Amazon S3-ra, a következő műveletek egyike történik:

- Ha ez egy dokumentum, akkor egy Lambda-függvény az Amazon Textract segítségével dolgozza fel és bontsa ki a szöveget a hirdetések létrehozásához.

- Ha egy képről van szó, akkor a Lambda függvény base64 formátumra konvertálja, amely alkalmas a Stable Diffusion modell számára, hogy új képet hozzon létre a forrásból.

- A kivont szöveget vagy base64-képkarakterláncot biztonságosan menti a DynamoDB.

Előnyök

Az alábbi lista a megoldás előnyeit írja le:

- Hatékonyság – A generatív mesterséges intelligencia használata jelentősen felgyorsítja a hirdetésgenerálási folyamatot, így nincs szükség manuális beállításra.

- Megfelelőség betartása – A megoldás biztosítja, hogy a generált hirdetések megfeleljenek bizonyos útmutatásoknak és előírásoknak, például az FDA marketingre vonatkozó irányelveinek.

- Költséghatékony – A személyre szabott hirdetések létrehozásának automatizálásával a cégek jelentősen csökkenthetik a hirdetések előállításával és átdolgozásával kapcsolatos költségeket.

- Áramvonalas MLR folyamat – A megoldás leegyszerűsíti az MLR folyamatot, csökkenti a súrlódási pontokat és simább áttekintést biztosít.

- Lokalizált rezonancia – A generatív mesterséges intelligencia olyan hirdetéseket állít elő, amelyek a helyi közönség körében rezonálnak, biztosítva a relevanciát és a hatást a különböző régiókban.

- Szabványosítás – A megoldás fenntartja a szükséges szabványokat és irányelveket, biztosítva a konzisztenciát az összes generált hirdetés között.

- skálázhatóság – A mesterséges intelligencia által vezérelt megközelítés a forrásképekből és PDF-fájlokból álló hatalmas adatbázisokat képes kezelni, így lehetővé teszi nagyszabású hirdetésgenerálást.

- Csökkentett kézi beavatkozás – Az automatizálás csökkenti az emberi beavatkozás szükségességét, minimalizálja a hibákat és biztosítja a konzisztenciát.

Az oktatóanyagban szereplő infrastruktúrát telepítheti helyi számítógépéről, vagy használhatja az AWS Cloud9-et telepítési munkaállomásként. Az AWS Cloud9 előre telepítve van az AWS CLI-vel, az AWS CDK-val és a Dockerrel. Ha az AWS Cloud9 mellett dönt, megteremteni a környezetet tól AWS Cloud9 konzol.

Tisztítsuk meg

A felesleges költségek elkerülése érdekében tisztítsa meg az AWS CloudFormation konzolon keresztül létrehozott összes infrastruktúrát, vagy futtassa a következő parancsot a munkaállomáson:

Ezenkívül ne felejtsen el leállítani minden SageMaker-végpontot, amelyet a SageMaker konzolon keresztül kezdeményezett. Ne feledje, hogy az Amazon Kendra index törlése nem távolítja el az eredeti dokumentumokat a tárhelyről.

Következtetés

A generatív mesterséges intelligencia, amelyet az LLM-ek megtestesítenek, paradigmaváltást hirdet az információk elérésében és előállításában. Bár ezek a modellek erősek, gyakran korlátozzák a képzési adataik korlátait. A RAG megbirkózik ezzel a kihívással, és gondoskodik arról, hogy az ezekben a modellekben található hatalmas tudás következetesen át legyen árasztva releváns, aktuális ismeretekkel.

RAG-alapú demóink ennek kézzelfogható bizonyítékát adják. Bemutatják az Amazon Kendra, a vektorbeágyazások és az LLM-ek közötti zökkenőmentes szinergiát, létrehozva egy olyan rendszert, ahol az információ nemcsak hatalmas, hanem pontos és időszerű is. Ahogy belemerül ezekbe a demókba, első kézből fedezheti fel az előre betanított tudás és a RAG dinamikus képességeinek egyesítésében rejlő átalakítási lehetőségeket, amelyek megbízható és a vállalati tartalomra szabott eredményeket eredményeznek.

Bár az LLM-ek által működtetett generatív mesterséges intelligencia új utat nyit az információs betekintés megszerzéséhez, ezeknek a betekintéseknek megbízhatónak kell lenniük, és a RAG-megközelítést használó vállalati tartalomra kell korlátozódniuk. Ezek a RAG-alapú bemutatók lehetővé teszik, hogy pontos és naprakész információkkal rendelkezzen. Ezeknek a betekintéseknek a minősége a szemantikai relevanciától függ, amelyet az Amazon Kendra és a vektoros beágyazások tesznek lehetővé.

Ha készen áll a generatív AI erejének további felfedezésére és hasznosítására, íme a következő lépések:

- Vegyen részt bemutatóinkkal – A gyakorlati tapasztalat felbecsülhetetlen. Fedezze fel a funkciókat, ismerje meg az integrációkat, és ismerkedjen meg a felülettel.

- Mélyítse el tudását – Használja ki a rendelkezésre álló forrásokat. Az AWS mélyreható dokumentációt, oktatóanyagokat és közösségi támogatást kínál a mesterséges intelligencia utazásához.

- Kezdeményezz egy kísérleti projektet – Fontolja meg a generatív mesterséges intelligencia kis léptékű bevezetését a vállalkozásában. Ez betekintést nyújt a rendszer gyakorlatiasságába és alkalmazkodóképességébe az Ön konkrét környezetében.

Az AWS-en futó generatív AI-alkalmazásokkal kapcsolatos további információkért tekintse meg a következőket:

Ne feledje, a mesterséges intelligencia környezete folyamatosan fejlődik. Legyen naprakész, maradjon kíváncsi, és mindig készen áll az alkalmazkodásra és az innovációra.

A szerzőkről

Jin Tan Ruan az AWS Industries Prototyping and Customer Engineering (PACE) csapatának prototípus-fejlesztője, az NLP-re és a generatív AI-ra szakosodott. Szoftverfejlesztési háttérrel és kilenc AWS-tanúsítvánnyal rendelkező Jin rengeteg tapasztalattal segíti az AWS ügyfeleit AI/ML és generatív mesterséges intelligencia elképzeléseik megvalósításában az AWS platform segítségével. A Syracuse Egyetemen szerzett mesterfokozatot számítástechnika és szoftvermérnöki szakon. A munkán kívül Jin szeret videojátékokkal játszani, és elmerülni a horrorfilmek izgalmas világában.

Jin Tan Ruan az AWS Industries Prototyping and Customer Engineering (PACE) csapatának prototípus-fejlesztője, az NLP-re és a generatív AI-ra szakosodott. Szoftverfejlesztési háttérrel és kilenc AWS-tanúsítvánnyal rendelkező Jin rengeteg tapasztalattal segíti az AWS ügyfeleit AI/ML és generatív mesterséges intelligencia elképzeléseik megvalósításában az AWS platform segítségével. A Syracuse Egyetemen szerzett mesterfokozatot számítástechnika és szoftvermérnöki szakon. A munkán kívül Jin szeret videojátékokkal játszani, és elmerülni a horrorfilmek izgalmas világában.

Aravind Kodandaramaiah az AWS Industries Prototyping and Customer Engineering (PACE) csapatán belüli Senior Prototyping Full Stack megoldásépítő. Arra összpontosít, hogy segítse az AWS ügyfeleit abban, hogy az innovatív ötleteket mérhető és kellemes eredményeket mutató megoldásokká alakítsák. Szenvedélyesen foglalkozik számos témakörrel, beleértve a felhőbiztonságot, a DevOps-t és az AI/ML-t, és általában ezekkel a technológiákkal foglalkozik.

Aravind Kodandaramaiah az AWS Industries Prototyping and Customer Engineering (PACE) csapatán belüli Senior Prototyping Full Stack megoldásépítő. Arra összpontosít, hogy segítse az AWS ügyfeleit abban, hogy az innovatív ötleteket mérhető és kellemes eredményeket mutató megoldásokká alakítsák. Szenvedélyesen foglalkozik számos témakörrel, beleértve a felhőbiztonságot, a DevOps-t és az AI/ML-t, és általában ezekkel a technológiákkal foglalkozik.

Arjun Shakdher az AWS Industries Prototyping (PACE) csapatának fejlesztője, aki szenvedélyesen törekszik a technológia belekeverésére az élet szövetébe. A Purdue Egyetemen szerzett mesterfokozatot szerzett Arjun jelenlegi szerepe a legkorszerűbb prototípusok tervezése és építése körül forog, amelyek egy sor tartományt felölelnek, és jelenleg kiemelkedően az AI/ML és az IoT területei. Ha nincs elmerülve a kódolásban és a digitális tájakban, Arjun belemerül a kávé világába, felfedezi az órarend bonyolult mechanikáját, vagy gyönyörködik az autók művészi alkotásaiban.

Arjun Shakdher az AWS Industries Prototyping (PACE) csapatának fejlesztője, aki szenvedélyesen törekszik a technológia belekeverésére az élet szövetébe. A Purdue Egyetemen szerzett mesterfokozatot szerzett Arjun jelenlegi szerepe a legkorszerűbb prototípusok tervezése és építése körül forog, amelyek egy sor tartományt felölelnek, és jelenleg kiemelkedően az AI/ML és az IoT területei. Ha nincs elmerülve a kódolásban és a digitális tájakban, Arjun belemerül a kávé világába, felfedezi az órarend bonyolult mechanikáját, vagy gyönyörködik az autók művészi alkotásaiban.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :is

- :nem

- :ahol

- $ UP

- 100

- 150

- 7

- a

- képesség

- Rólunk

- gyorsul

- hozzáférés

- Szerint

- Fiók

- pontosság

- pontos

- át

- cselekvések

- Ad

- alkalmazkodni

- alkalmazkodik

- hozzáadott

- címek

- tapad

- kiigazítások

- Elfogadása

- hirdetések

- fejlett

- Előny

- előnyei

- megérkezés

- Hirdetés

- Után

- AI

- AI / ML

- Támogatás

- igazítás

- Minden termék

- lehetővé

- lehetővé téve

- lehetővé teszi, hogy

- majdnem

- mentén

- Is

- alternatív

- mindig

- amazon

- Amazon Cognito

- Amazon Kendra

- Amazon szöveg

- Az Amazon Web Services

- Összegek

- erősít

- an

- és a

- válasz

- válaszok

- bármilyen

- api

- app

- Alkalmazás

- alkalmazások

- megközelítés

- megfelelő

- építészeti

- építészet

- VANNAK

- körül

- Sor

- művésziesség

- AS

- vagyontárgy

- Eszközök

- segít

- társult

- közönség

- hang-

- hitelesített

- Hitelesítés

- automatizált

- automatizálás

- Automatizálás

- elérhető

- elkerülése érdekében

- elkerülve

- AWS

- AWS Cloud9

- AWS felhőképződés

- vissza

- háttal ellátott

- háttér

- támogatás

- bázis

- alapján

- BE

- mert

- válik

- válik

- Előnyök

- Jobb

- között

- Túl

- torzítások

- keverési

- test

- Bot

- mindkét

- Ág

- Bring

- széles

- építész

- Épület

- de

- by

- kéri

- TUD

- Kaphat

- képességek

- elfog

- fogások

- eset

- Kategória

- tanúsítványok

- kihívás

- kihívások

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- választott

- ragadozó ölyv

- felhő

- Cloud Security

- Cloud9

- kód

- Kávé

- kombinált

- kombájnok

- jön

- általában

- közösség

- Companies

- összehasonlítások

- bonyolult

- teljesítés

- engedékeny

- összetevő

- felfogja

- számítógép

- Computer Science

- Configuration

- Csatlakozás

- kapcsolatok

- összeköt

- Fontolja

- következetesen

- Konzol

- állandóan

- tartalom

- Tartalomgenerálás

- tartalomalkotás

- kontextus

- kontextusok

- szövegre vonatkozó

- tovább

- folyamatos

- Kényelmes

- hagyományos

- Beszélgetés

- konvertáló

- Mag

- Költség

- kiadások

- kézműves

- teremt

- készítette

- teremt

- létrehozása

- teremtés

- kritikus

- nehézkes

- kíváncsi

- Jelenlegi

- szokás

- vevő

- Ügyfelek

- élvonalbeli

- dátum

- adatbázis

- adatbázisok

- adatkészletek

- találka

- mély

- mélyebb

- Fok

- elbűvölő

- demó

- Demo

- függő

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- leírni

- Design

- tervezett

- kívánatos

- elpusztítani

- részletes

- részletek

- Fejlesztő

- Fejlesztés

- diagnosztikai

- különböző

- Diffusion

- digitális

- irányított

- kijelzők

- különböző

- merülés

- számos

- búvárkodás

- Dokkmunkás

- dokumentum

- dokumentáció

- dokumentumok

- Nem

- domainek

- húz

- rajz

- hajtott

- dinamikus

- könnyen

- hatékonyság

- hatékony

- eredményesen

- bármelyik

- megszüntetése

- beágyazás

- felmerül

- alkalmaz

- felhatalmazott

- felhatalmazza

- lehetővé

- engedélyezve

- lehetővé teszi

- lehetővé téve

- végén

- Endpoint

- Mérnöki

- fokozott

- gazdagító

- biztosítására

- biztosítani

- biztosítja

- biztosítása

- Vállalkozás

- Egész

- felszerelt

- hibák

- különösen

- lényeg

- értékelni

- esemény

- EVER

- fejlődik

- fejlődik

- példa

- izgatott

- kiterjedt

- tapasztalat

- szakértő

- szakértők

- feltárása

- Feltárása

- kiterjedt

- külső

- kivonat

- szövet

- megkönnyíti

- ismerkedjen

- pörgős

- FB

- megvalósítható

- Funkció

- Jellemzők

- Featuring

- filé

- szűrő

- Találjon

- vezetéknév

- Rugalmasság

- koncentrál

- következő

- következik

- A

- formátum

- talált

- Alapítvány

- súrlódás

- ból ből

- front

- Front end

- Tele

- Teljes verem

- funkció

- funkciós

- további

- Továbbá

- Nyereség

- egyre

- Games

- gateway

- generál

- generált

- generáció

- nemző

- Generatív AI

- generátor

- kap

- adott

- Giving

- nyújtó

- fogás

- növekszik

- garancia

- útmutatást

- vezetett

- irányelvek

- fogantyú

- hands-on

- hám

- hasznosítása

- Legyen

- tekintettel

- he

- segít

- hírnökei

- itt

- kiemeli

- saját maga

- történetek

- történelem

- holding

- tart

- borzalom

- házigazdája

- Hogyan

- azonban

- HTML

- http

- HTTPS

- emberi

- ötletek

- azonosító

- azonosítók

- azonosítani

- Identitás

- if

- illusztrálja

- kép

- képek

- elmerült

- Hatás

- végrehajtás

- in

- mélyreható

- pontatlan

- magában foglalja a

- Beleértve

- bele

- függetlenül

- index

- indexelt

- indexek

- iparágak

- ipar

- ipari szabványok

- befolyásolható

- információ

- tájékoztatták

- Infrastruktúra

- eredendően

- kezdetben

- kezdeményezett

- újít

- újító

- éleslátó

- meglátások

- helyette

- utasítás

- integrált

- integrál

- integráció

- integrációk

- A szándék

- kölcsönhatásba lép

- Felület

- beavatkozás

- bele

- belső

- felbecsülhetetlen

- tárgyak internete

- IT

- tételek

- ITS

- Munka

- utazás

- jpg

- éppen

- tudás

- ismert

- táj

- nyelv

- nagy

- nagyarányú

- elrendezés

- tanulás

- Jogi

- Lets

- könyvtár

- Engedélyezett

- élet

- mint

- valószínűség

- Korlátozott

- határértékek

- Lista

- LLM

- helyi

- elhelyezkedés

- gép

- gépi tanulás

- fenntartja

- Gyártás

- sikerült

- kézikönyv

- sok

- Marketing

- tömeges

- mester

- gyufa

- anyagok

- jelenti

- jelentőségteljes

- jelentése

- eszközök

- mechanika

- mechanizmus

- orvosi

- Memory design

- csupán

- összeolvad

- egyesülő

- mód

- aprólékosan

- minimalizálása

- enyhítés

- ML

- modell

- modellezés

- modellek

- moduláris

- több

- a legtöbb

- Filmek

- kell

- Természetes

- Természetes nyelvi feldolgozás

- elengedhetetlen

- Szükség

- szükséges

- igénylő

- igények

- Új

- következő

- kilenc

- NLP

- bejelentés

- Most

- of

- felajánlás

- Ajánlatok

- gyakran

- on

- ONE

- csak

- nyit

- or

- szervezeti

- szervezetek

- eredeti

- Más

- mi

- ki

- eredmények

- vázlat

- kimenetek

- kívül

- felett

- Overcome

- Béke

- paradigma

- paraméterek

- rész

- szenvedélyes

- tökéletes

- engedélyek

- Személyre

- Pharma

- Gyógyszeripari

- kifejezés

- darabok

- pilóta

- demó projekt

- Hely

- elhelyezés

- emelvény

- Plató

- Platón adatintelligencia

- PlatoData

- játszani

- játék

- pont

- helymeghatározás

- lehetséges

- állás

- potenciális

- hatalom

- powered

- erős

- Gyakorlati

- pontos

- pontosan

- Pontosság

- preferenciák

- előfeltételek

- jelenleg

- eljárás

- folyamat

- Feldolgozott

- feldolgozás

- Készült

- termel

- Termelés

- program

- promóciós

- prototípusok

- prototípus

- Bizonyít

- ad

- feltéve,

- biztosít

- amely

- világítás

- lekérdezések

- kérdés

- Kérdések

- Quick

- gyorsan

- hatótávolság

- kész

- birodalmak

- kap

- fogadó

- Ajánlást

- csökkenteni

- csökkenti

- csökkentő

- utal

- kifinomult

- regionális

- régiók

- szabályos

- előírások

- szabályozók

- Előírásoknak való megfelelés

- relevancia

- támaszkodva

- marad

- maradványok

- eszébe jut

- eltávolítása

- átfogalmazva

- képviselet

- jelentése

- kérni

- kéri

- szükség

- kötelező

- követelmények

- rezonátor

- Tudástár

- válasz

- válaszok

- felelősség

- felelős

- eredő

- kapott

- Eredmények

- Kritika

- Vélemények

- változathoz

- forog

- jobb

- szigorú

- Szerep

- futás

- fut

- sagemaker

- azonos

- mentett

- Tudomány

- tudományos

- zökkenőmentes

- zökkenőmentesen

- Keresés

- szakaszok

- biztonság

- biztosan

- biztonság

- kiválasztott

- kiválasztás

- idősebb

- küldött

- szolgáltatás

- Szolgáltatások

- készlet

- beállítások

- felépítés

- váltás

- kirakat

- Műsorok

- Szitál

- jelentős

- jelentősen

- Egyszerű

- egyszerűen

- kisebb

- simább

- szoftver

- szoftverfejlesztés

- szoftverfejlesztés

- Kizárólag

- megoldások

- Megoldások

- forrás

- származó

- Források

- Sourcing

- terek

- arasz

- specializált

- szakosodott

- különleges

- meghatározott

- stabil

- verem

- szabványok

- Kezdve

- csúcs-

- tartózkodás

- Lépés

- Lépései

- megáll

- tárolás

- tárolni

- memorizált

- tárolása

- áramvonalas

- erősségek

- Húr

- szigorú

- szerkesztett

- stílus

- beküldése

- ilyen

- megfelelő

- támogatás

- Támogatott

- szinergia

- rendszer

- szabott

- Vesz

- tart

- megfogható

- Feladat

- feladatok

- csapat

- csapat

- technika

- Technologies

- Technológia

- végrendelet

- szöveg

- mint

- hogy

- A

- A táj

- The Source

- a világ

- azok

- Őket

- akkor

- ezáltal

- Ezek

- ők

- ezt

- három

- izgató

- Keresztül

- idő

- időszerű

- időbélyeg

- titán-

- nak nek

- mai

- szerszám

- szerszámok

- téma

- Témakörök

- felé

- hagyományos

- Vonat

- kiképzett

- Képzések

- átruházás

- átment

- transzferek

- Átalakítás

- transzformációs

- transzformerek

- Trends

- valóban

- megbízható

- FORDULAT

- oktatói

- oktatóanyagok

- típusok

- ui

- mennek

- mögöttes

- megért

- megértés

- egyedi

- egyetemi

- nem úgy mint

- felesleges

- leleplez

- up-to-date

- Frissítések

- frissítve

- Frissítés

- tiszteletben

- upon

- használ

- használati eset

- használó

- felhasználói felület

- Felhasználók

- használ

- segítségével

- rendszerint

- hasznosítja

- kihasználva

- különféle

- Hatalmas

- sokoldalú

- keresztül

- videó

- videojátékok

- jövőképek

- Út..

- we

- Vagyon

- háló

- webalkalmazás

- webes szolgáltatások

- websocket

- voltak

- amikor

- ami

- míg

- WHO

- széles

- Széleskörű

- lesz

- val vel

- belül

- nélkül

- szavak

- Munka

- munkafolyamat

- munkaállomás

- világ

- te

- A te

- magad

- zephyrnet