ZOO Digitális végpontok közötti lokalizációs és médiaszolgáltatásokat nyújt az eredeti TV- és filmtartalom különböző nyelvekhez, régiókhoz és kultúrákhoz való adaptálásához. Ez megkönnyíti a globalizációt a világ legjobb tartalomkészítői számára. A szórakoztatóipar legnagyobb nevei által megbízott ZOO Digital magas színvonalú lokalizációs és médiaszolgáltatásokat nyújt széles skálán, beleértve a szinkronizálást, a feliratozást, a szkriptelést és a megfelelőséget.

A tipikus lokalizációs munkafolyamatok kézi hangszóró naplózást igényelnek, ahol a hangfolyamot a hangszóró személye alapján szegmentálják. Ezt az időigényes folyamatot be kell fejezni, mielőtt a tartalmat más nyelvre át lehet szinkronizálni. Manuális módszerekkel egy 30 perces epizód lokalizálása 1-3 órát is igénybe vehet. Az automatizálás révén a ZOO Digital célja a lokalizáció 30 percen belüli elérése.

Ebben a bejegyzésben a skálázható gépi tanulási (ML) modellek bevezetését tárgyaljuk a médiatartalom naplózásához Amazon SageMaker, amelynek középpontjában a WhisperX modell.

Háttér

A ZOO Digital víziója a lokalizált tartalom gyorsabb feldolgozása. Ezt a célt akadályozza a gyakorlatok manuálisan intenzív jellege, amelyhez hozzátartozik a tartalom manuális lokalizálására képes szakképzett emberek kis létszáma. A ZOO Digital több mint 11,000 600 szabadúszóval dolgozik együtt, és csak 2022-ben több mint XNUMX millió szót lokalizált. A képzett emberek kínálatát azonban meghaladja a tartalom iránti növekvő kereslet, ami automatizálást igényel a lokalizációs munkafolyamatok segítéséhez.

A tartalom munkafolyamatainak gépi tanuláson keresztül történő lokalizálásának felgyorsítása érdekében a ZOO Digital bevonta az AWS Prototyping-et, az AWS befektetési programját, amellyel a munkaterheléseket az ügyfelekkel együtt építheti fel. A megbízás a lokalizációs folyamat funkcionális megoldására összpontosított, miközben gyakorlati képzést nyújtott a ZOO Digital fejlesztői számára a SageMakerrel, Amazon átiratés Amazon Translate.

Ügyfél kihívás

A cím (film vagy egy TV-sorozat epizódja) átírása után a beszéd minden egyes szakaszához hozzá kell rendelni a hangszórókat, hogy azokat megfelelően hozzá lehessen rendelni a karakterek eljátszására kiírt hangművészekhez. Ezt a folyamatot beszélői naplózásnak nevezik. A ZOO Digital azzal a kihívással néz szembe, hogy a tartalmat nagy méretben naplózza, miközben gazdaságilag életképes.

Megoldás áttekintése

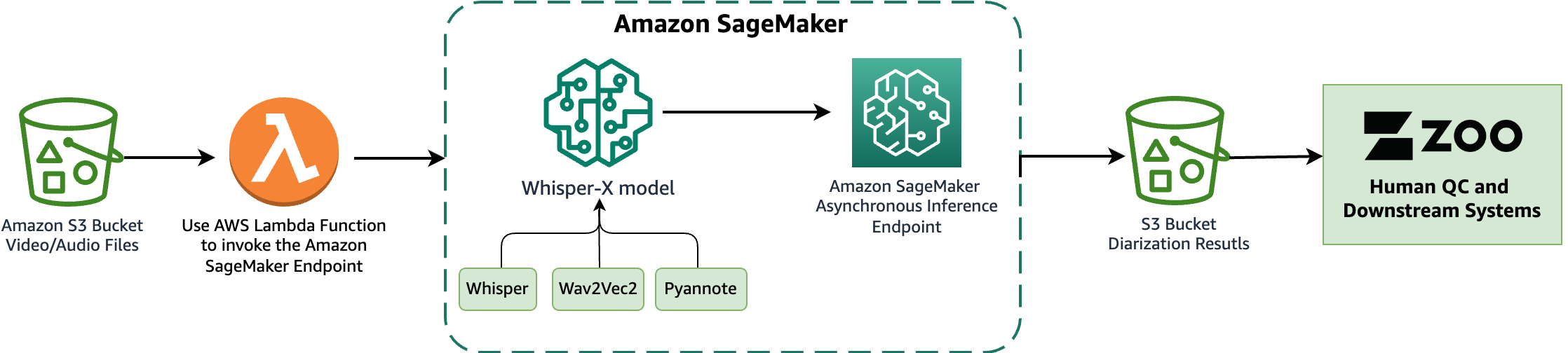

Ebben a prototípusban az eredeti médiafájlokat egy megadott helyen tároltuk Amazon egyszerű tárolási szolgáltatás (Amazon S3) vödör. Ez az S3 tároló úgy lett beállítva, hogy eseményt küldjön ki, amikor új fájlokat észlel benne, és elindít egy eseményt AWS Lambda funkció. A trigger konfigurálására vonatkozó utasításokért tekintse meg az oktatóanyagot Amazon S3 trigger használata Lambda függvény meghívására. Ezt követően a Lambda függvény a SageMaker végpontot hívta meg következtetések levonásához a Boto3 SageMaker Runtime kliens.

A WhisperX modellje alapján OpenAI's Whisper, átírásokat és naplózást végez a médiaeszközök számára. Arra épül Gyorsabb Suttogás újraimplementáció, amely akár négyszer gyorsabb átírást kínál a Whisperhez képest jobb szószintű időbélyeg-igazítással. Ezenkívül bevezeti a hangszóró naplózását, amely az eredeti Whisper modellben nincs jelen. A WhisperX a Whisper modellt használja az átírásokhoz, a Wav2Vec2 modell az időbélyegek igazításának javítására (az átírt szöveg szinkronizálásának biztosítása hang időbélyegekkel), és a pyannote modell a naplózáshoz. FFmpeg hang betöltésére szolgál forrás adathordozóról, támogatva a különböző médiaformátumok. Az átlátható és moduláris modellarchitektúra rugalmasságot tesz lehetővé, mert a jövőben a modell minden komponense szükség szerint kicserélhető. Fontos azonban megjegyezni, hogy a WhisperX nem rendelkezik teljes körű felügyeleti funkciókkal, és nem vállalati szintű termék. Karbantartás és támogatás nélkül előfordulhat, hogy nem alkalmas termelési telepítésre.

Ebben az együttműködésben telepítettük és kiértékeltük a WhisperX-et a SageMakeren egy an aszinkron következtetés végpontja hogy vendégül láthassa a modellt. A SageMaker aszinkron végpontjai 1 GB-ig támogatják a feltöltési méretet, és olyan automatikus skálázási funkciókat tartalmaznak, amelyek hatékonyan mérséklik a forgalmi kiugrásokat, és költséget takarítanak meg csúcsidőn kívül. Az aszinkron végpontok különösen alkalmasak nagy fájlok, például filmek és tévésorozatok feldolgozására a mi használati esetünkben.

Az alábbi ábra szemlélteti az együttműködés során végzett kísérleteink fő elemeit.

A következő szakaszokban a WhisperX modell SageMakeren történő telepítésének részleteibe nyúlunk bele, és értékeljük a naplózási teljesítményt.

Töltse le a modellt és összetevőit

A WhisperX egy olyan rendszer, amely több modellt tartalmaz az átíráshoz, a kényszerített igazításhoz és a naplózáshoz. A SageMaker zökkenőmentes működéséhez, anélkül, hogy a következtetés során le kellene kérnie a modelltermékeket, elengedhetetlen az összes modellműtermék előzetes letöltése. Ezek a műtermékek ezután betöltődnek a SageMaker kiszolgáló tartályba az inicializálás során. Mivel ezek a modellek nem érhetők el közvetlenül, leírásokat és mintakódot kínálunk a WhisperX forrásból, amelyek útmutatást adnak a modell és összetevői letöltéséhez.

A WhisperX hat modellt használ:

A legtöbb ilyen modell beszerezhető Átölelő arc a huggingface_hub könyvtár használatával. A következőket használjuk download_hf_model() funkció segítségével lekérheti ezeket a modelltermékeket. A Hugging Face hozzáférési tokenje szükséges, amelyet a következő pyannote modellekhez tartozó felhasználói szerződések elfogadása után generálnak:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

A VAD-modell az Amazon S3-ból, a Wav2Vec2-modell pedig a torchaudio.pipelines modulból származik. A következő kód alapján lekérhetjük az összes modell műtermékét, beleértve a Hugging Face-ből származókat is, és elmenthetjük a megadott helyi modellkönyvtárba:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Válassza ki a megfelelő AWS Deep Learning tárolót a modell kiszolgálásához

Miután a modellműtermékeket az előző mintakóddal elmentette, választhat az előre elkészített AWS Deep Learning Containers (DLC-k) a következőkből GitHub repo. A Docker-kép kiválasztásakor vegye figyelembe a következő beállításokat: keretrendszer (Hugging Face), feladat (következtetés), Python-verzió és hardver (például GPU). A következő kép használatát javasoljuk: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 Ezen a képen az összes szükséges rendszercsomag előre telepítve van, például az ffmpeg. Ne felejtse el lecserélni a [REGION]-t az Ön által használt AWS-régióra.

Más szükséges Python-csomagokhoz hozzon létre a requirements.txt fájl a csomagok és verzióik listájával. Ezek a csomagok az AWS DLC elkészítésekor lesznek telepítve. A következő kiegészítő csomagok szükségesek a WhisperX modell SageMaker-en való üzemeltetéséhez:

Hozzon létre egy következtetési szkriptet a modellek betöltéséhez és a következtetés futtatásához

Ezután létrehozunk egy egyedit inference.py szkript, amely felvázolja, hogyan töltődik be a WhisperX modell és összetevői a tárolóba, és hogyan kell futtatni a következtetési folyamatot. A szkript két funkciót tartalmaz: model_fn és a transform_fn Az model_fn függvényt hívják meg a modellek betöltéséhez a megfelelő helyükről. Ezt követően ezeket a modelleket átadják a transform_fn függvény a következtetés során, ahol transzkripciós, igazítási és diarizációs folyamatokat hajtanak végre. Az alábbiakban egy kódminta látható inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

A modell könyvtárán belül a requirements.txt fájl meglétének biztosítására inference.py kód alkönyvtárában. A models a könyvtárnak a következőhöz kell hasonlítania:

Hozzon létre egy tarballt a modellekből

A modellek és kódkönyvtárak létrehozása után a következő parancssorok segítségével tömörítheti a modellt tarballba (.tar.gz fájl), és feltöltheti az Amazon S3-ba. A cikk írásakor a gyorsabb suttogású Large V2 modellt használva a SageMaker modellt reprezentáló tarball 3 GB méretű. További információkért lásd: Modelltárhely-minták az Amazon SageMakerben, 2. rész: A valós idejű modellek SageMakeren való üzembe helyezésének első lépései.

Hozzon létre egy SageMaker-modellt, és telepítsen egy végpontot egy aszinkron előrejelzővel

Most létrehozhatja a SageMaker modellt, a végpont konfigurációját és az aszinkron végpontot AsyncPredictor az előző lépésben létrehozott tarball modell segítségével. Az utasításokat lásd Hozzon létre egy aszinkron következtetési végpontot.

Értékelje a naplózási teljesítményt

A WhisperX modell naplózási teljesítményének különböző forgatókönyvekben való értékeléséhez három-három epizódot választottunk ki két angol címből: egy drámacímet, amely 30 perces epizódokból, és egy dokumentumfilm címet 45 perces epizódokból áll. A pyannote metrika eszközkészletét használtuk, pyannote.metrics, kiszámításához a diarizációs hibaarány (DER). Az értékelésben a ZOO által biztosított manuálisan átírt és naplózott átiratok szolgáltak az alapigazságként.

A DER-t a következőképpen határoztuk meg:

Végösszeg a földi igazság videó hossza. FA A (hamis riasztás) azon szegmensek hossza, amelyeket beszédnek tekintenek az előrejelzésekben, de nem az alapigazságban. Hiányzik azoknak a szegmenseknek a hossza, amelyek az alapigazságban beszédnek számítanak, de az előrejelzésben nem. hiba, Más néven Zűrzavar, azoknak a szegmenseknek a hossza, amelyek előrejelzésben és alapigazságban különböző beszélőkhöz vannak hozzárendelve. Az összes mértékegység mérése másodpercben történik. A DER tipikus értékei az adott alkalmazástól, adatkészlettől és a naplózó rendszer minőségétől függően változhatnak. Vegye figyelembe, hogy a DER nagyobb lehet 1.0-nál. Az alacsonyabb DER jobb.

Ahhoz, hogy ki tudjuk számítani a DER értékét egy adathordozóra, egy alapigazság naplózásra, valamint a WhisperX átírt és naplózott kimeneteire van szükség. Ezeket elemezni kell, és eredményül olyan sorok listája jön létre, amelyek tartalmazzák a hangszóró címkéjét, a beszédszegmens kezdési idejét és a beszédszegmens befejezési idejét a médiában minden beszédszegmenshez. A hangszóró címkéinek nem kell megegyezniük a WhisperX és a földi igazság naplózása között. Az eredmények többnyire a szegmensek idejére épülnek. A pyannote.metrics az alapigazság-diarizációk és a kimeneti naplózások sorát veszi át (amelyekre a pyannote.metrics dokumentációban hivatkozik referencia és a hipotézis) a DER kiszámításához. Eredményeinket az alábbi táblázat foglalja össze.

| Videó típusa | DER | Helyes | Hiányzik | hiba | Téves riasztás |

| Dráma | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Dokumentumfilm | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| Átlagos | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Ezek az eredmények jelentős teljesítménybeli különbséget mutatnak a dráma és a dokumentumfilm címei között, mivel a modell lényegesen jobb eredményeket ért el (a DER-t összesített mérőszámként használva) a drámaepizódok tekintetében, mint a dokumentumfilm címe. A címek alaposabb elemzése betekintést nyújt a teljesítménybeli különbségek kialakulásához hozzájáruló lehetséges tényezőkbe. Az egyik kulcsfontosságú tényező lehet a beszéddel átfedő háttérzene gyakori jelenléte a dokumentumfilm címében. Bár a médiák előfeldolgozása a naplózás pontosságának javítására, például a háttérzaj eltávolítása a beszéd elkülönítése érdekében, nem terjedt ki ennek a prototípusnak a hatókörére, utakat nyit a jövőbeni munka számára, amely potenciálisan javíthatja a WhisperX teljesítményét.

Következtetés

Ebben a bejegyzésben az AWS és a ZOO Digital közötti együttműködési partnerséget vizsgáltuk, gépi tanulási technikákat alkalmazva a SageMakerrel és a WhisperX modellel a naplózási munkafolyamat javítása érdekében. Az AWS csapata kulcsfontosságú szerepet játszott abban, hogy segítse a ZOO-t a prototípusok elkészítésében, értékelésében és a kifejezetten naplózáshoz tervezett egyéni ML modellek hatékony alkalmazásának megértésében. Ez magában foglalta az automatikus méretezést a SageMaker segítségével a méretezhetőség érdekében.

A mesterséges intelligencia naplózáshoz való felhasználása jelentős költség- és időmegtakarítást eredményez a ZOO számára lokalizált tartalom generálásakor. Azáltal, hogy segíti az átírókat a hangszórók gyors és pontos létrehozásában és azonosításában, ez a technológia kezeli a feladat hagyományosan időigényes és hibás természetét. A hagyományos eljárás gyakran több videón való áthaladásból és további minőségellenőrzési lépésekből áll a hibák minimalizálása érdekében. A mesterséges intelligencia diarizálásra való alkalmazása célzottabb és hatékonyabb megközelítést tesz lehetővé, ezáltal rövidebb időn belül növeli a termelékenységet.

Felvázoltuk a WhisperX modell SageMaker aszinkron végponton történő üzembe helyezésének kulcsfontosságú lépéseit, és arra biztatjuk, hogy próbálja ki saját maga a mellékelt kód segítségével. Ha további betekintést szeretne kapni a ZOO Digital szolgáltatásaiba és technológiájába, látogasson el ide A ZOO Digital hivatalos oldala. Az OpenAI Whisper modell SageMakeren történő telepítésével és a különféle következtetési lehetőségekkel kapcsolatos részletekért lásd: Hozd a Whisper modellt az Amazon SageMakeren: a következtetési lehetőségek felfedezése. Nyugodtan ossza meg gondolatait a megjegyzésekben.

A szerzőkről

Ying Hou, PhD, az AWS gépi tanulási prototípus-készítő építésze. Elsődleges érdeklődési területe a Deep Learning, amelynek középpontjában a GenAI, a Computer Vision, az NLP és az idősoros adatok előrejelzése áll. Szabadidejében szívesen tölt el minőségi pillanatokat családjával, elmélyül a regényekben, és túrázik az Egyesült Királyság nemzeti parkjaiban.

Ying Hou, PhD, az AWS gépi tanulási prototípus-készítő építésze. Elsődleges érdeklődési területe a Deep Learning, amelynek középpontjában a GenAI, a Computer Vision, az NLP és az idősoros adatok előrejelzése áll. Szabadidejében szívesen tölt el minőségi pillanatokat családjával, elmélyül a regényekben, és túrázik az Egyesült Királyság nemzeti parkjaiban.

Ethan Cumberland A ZOO Digital mesterséges intelligenciakutató mérnöke, ahol a mesterséges intelligencia és a gépi tanulás segítőtechnológiáinak használatával dolgozik a beszéd, a nyelv és a lokalizáció munkafolyamatainak javítása érdekében. Szoftvermérnöki és kutatási háttérrel rendelkezik a biztonsági és rendészeti területen, elsősorban a webről strukturált információk kinyerésére, valamint a nyílt forráskódú ML modellek felhasználására az összegyűjtött adatok elemzésére és gazdagítására összpontosít.

Ethan Cumberland A ZOO Digital mesterséges intelligenciakutató mérnöke, ahol a mesterséges intelligencia és a gépi tanulás segítőtechnológiáinak használatával dolgozik a beszéd, a nyelv és a lokalizáció munkafolyamatainak javítása érdekében. Szoftvermérnöki és kutatási háttérrel rendelkezik a biztonsági és rendészeti területen, elsősorban a webről strukturált információk kinyerésére, valamint a nyílt forráskódú ML modellek felhasználására az összegyűjtött adatok elemzésére és gazdagítására összpontosít.

Gaurav Kaila vezeti az AWS prototípuskészítő csapatát az Egyesült Királyságban és Írországban. Csapata a legkülönbözőbb iparágakban dolgozó ügyfelekkel dolgozik, hogy megtervezze és közösen fejlessze az üzleti szempontból kritikus munkaterheléseket, felhatalmazással, hogy felgyorsítsa az AWS-szolgáltatások bevezetését.

Gaurav Kaila vezeti az AWS prototípuskészítő csapatát az Egyesült Királyságban és Írországban. Csapata a legkülönbözőbb iparágakban dolgozó ügyfelekkel dolgozik, hogy megtervezze és közösen fejlessze az üzleti szempontból kritikus munkaterheléseket, felhatalmazással, hogy felgyorsítsa az AWS-szolgáltatások bevezetését.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :van

- :is

- :nem

- :ahol

- $ UP

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- Képes

- gyorsul

- elfogadó

- hozzáférés

- hozzáférhető

- pontosság

- Elérése

- elérése

- át

- alkalmazkodni

- További

- Ezen kívül

- címek

- Örökbefogadás

- Után

- adalékanyag

- megállapodások

- AI

- ai kutatás

- cél

- célok

- riasztás

- összehangolása

- igazítás

- igazítás

- Minden termék

- lehetővé teszi, hogy

- kizárólag

- mellett

- Is

- Bár

- amazon

- Amazon SageMaker

- Az Amazon Web Services

- an

- Elemzés

- elemzés

- és a

- Másik

- Alkalmazás

- megközelítés

- megfelelő

- építészet

- VANNAK

- területek

- Előadók

- AS

- értékeli

- Eszközök

- kijelölt

- segít

- segítő

- At

- hang-

- felhatalmazott

- auto

- Automatizálás

- utakat

- AWS

- háttér

- alapján

- BE

- mert

- óta

- előtt

- hogy

- BEST

- Jobb

- között

- Túl

- Legnagyobb

- BIN

- mindkét

- épült

- üzleti

- de

- by

- számít

- hívott

- TUD

- eset

- kihívás

- karakter

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- közelebb

- kód

- együttműködés

- kollaboratív

- Hozzászólások

- képest

- Befejezett

- teljesítés

- összetevő

- alkatrészek

- súlyosbítja

- számítógép

- Számítógépes látás

- lefolytatott

- konfigurálva

- konfigurálása

- Fontolja

- figyelembe vett

- Összeáll

- Konténer

- tartalmaz

- tartalom

- tartalomkészítők

- hozzájáruló

- ellenőrzés

- hagyományos

- Mag

- helyesen

- Költség

- kiadások

- tudott

- teremt

- készítette

- létrehozása

- alkotók

- kritikai

- kultúrák

- szokás

- Ügyfelek

- dátum

- mély

- mély tanulás

- meghatározott

- átadó

- szállít

- ás

- Kereslet

- attól

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- tervezett

- részletek

- észlelt

- fejlesztők

- eszköz

- diagram

- DICT

- különbség

- különböző

- digitális

- Digitálisan

- közvetlenül

- könyvtárak

- könyvtár

- megvitatni

- számos

- Dokkmunkás

- dokumentumfilm

- dokumentáció

- domain

- ne

- letöltés

- letöltései

- Dráma

- szinkronizált

- alatt

- minden

- könnyebb

- Hatékony

- hatékony

- eredményesen

- elemek

- más

- beágyazás

- foglalkoztatás

- lehetővé teszi

- felölel

- ösztönzése

- végén

- végtől végig

- Endpoint

- elkötelezett

- eljegyzés

- mérnök

- Mérnöki

- Angol

- növelése

- gazdagító

- biztosítására

- biztosítása

- vállalati szintű

- Szórakozás

- epizód

- hiba

- hibák

- alapvető

- értékelni

- értékelték

- értékelő

- értékelés

- esemény

- Minden

- példa

- Gyakorol

- kísérletek

- feltárt

- Feltárása

- Arc

- arcok

- tényező

- tényezők

- hamis

- család

- gyorsabb

- Jellemzők

- érez

- Elhozták

- filé

- Fájlok

- Rugalmasság

- Összpontosít

- összpontosított

- összpontosítás

- következő

- következik

- A

- kényszerű

- négy

- Keretrendszer

- Ingyenes

- gyakori

- ból ből

- Tele

- funkció

- funkcionális

- funkciók

- további

- jövő

- rés

- genai

- generált

- generáló

- szerzés

- GitHub

- globalizáció

- cél

- GPU

- Földi

- hands-on

- hardver

- he

- neki

- jó minőségű

- övé

- vendéglátó

- tárhely

- NYITVATARTÁS

- Hogyan

- azonban

- HTML

- http

- HTTPS

- HuggingFace

- azonosító

- Identitás

- if

- illusztrálja

- kép

- importál

- javul

- javított

- in

- beleértve

- magában foglalja a

- Beleértve

- bele

- amely magában foglalja

- növekvő

- iparágak

- információ

- kezdeményezés

- meglátások

- telepítve

- utasítás

- kamat

- bele

- Bemutatja

- beruházás

- hivatkozni

- jár

- Írország

- IT

- ITS

- jpg

- json

- Kulcs

- kulcstényező

- Címke

- Címkék

- nyelv

- Nyelvek

- nagy

- nagyobb

- vezet

- vezetékek

- tanulás

- Hossz

- erőfölény

- könyvtár

- vonalak

- Lista

- listák

- kiszámításának

- betöltés

- helyi

- Honosítás

- helyileg

- helyszínek

- log

- fakitermelés

- Hosszú

- alacsonyabb

- gép

- gépi tanulás

- karbantartás

- KÉSZÍT

- vezetés

- Megbízás

- kézikönyv

- kézzel

- Mérkőzés

- Lehet..

- Média

- Metaadatok

- mód

- metrikus

- Metrics

- millió

- minimalizálása

- Perc

- Enyhít

- ML

- modell

- modellek

- moduláris

- Modulok

- Pillanatok

- több

- többnyire

- film

- Filmek

- többszörös

- zene

- kell

- név

- nevek

- nemzeti

- Természet

- elengedhetetlen

- Szükség

- szükséges

- Új

- NLP

- Zaj

- nevezetesen

- megjegyezni

- kapott

- of

- ajánlat

- felajánlás

- hivatalos

- gyakran

- on

- ONE

- nyílt forráskódú

- OpenAI

- nyit

- működés

- Opciók

- or

- eredeti

- OS

- Más

- mi

- ki

- vázlat

- vázolt

- teljesítmény

- kimenetek

- felett

- csomagok

- rész

- különösen

- Létrehozása

- Elmúlt

- bérletek

- ösvény

- utak

- minták

- Emberek (People)

- Teljesít

- teljesítmény

- teljesített

- Előadja

- darab

- csővezeték

- döntő

- Plató

- Platón adatintelligencia

- PlatoData

- játszani

- játszott

- rendfenntartás

- állás

- potenciális

- potenciálisan

- megelőző

- pontosan

- előrejelzés

- Tippek

- jelenlét

- be

- előző

- elsődleges

- folyamat

- Folyamatok

- feldolgozás

- Termékek

- Termelés

- termelékenység

- Program

- prototípus

- prototípus

- ad

- feltéve,

- biztosít

- amely

- Piton

- világítás

- R

- Arány

- Olvass

- igazi

- real-time

- ajánl

- utal

- említett

- vidék

- régiók

- eszébe jut

- eltávolítása

- cserélni

- képviselő

- kérni

- szükség

- kötelező

- követelmények

- kutatás

- azok

- eredményez

- kapott

- Eredmények

- visszatérés

- Visszatér

- mutatják

- Szerep

- futás

- futás

- futásidejű

- s

- sagemaker

- minta

- Megtakarítás

- mentett

- Megtakarítás

- skálázhatóság

- skálázható

- Skála

- skálázás

- forgatókönyvek

- hatálya

- forgatókönyv

- másodperc

- szakaszok

- biztonság

- részes

- szegmentáció

- szegmensek

- kiválasztott

- kiválasztása

- Series of

- szolgált

- Szolgáltatások

- szolgáló

- beállítások

- Megosztás

- ő

- kellene

- jelentős

- Egyszerű

- SIX

- Méret

- méretek

- szakképzett

- kicsi

- sima

- So

- szoftver

- szoftverfejlesztés

- megoldások

- forrás

- Hangszóró

- hangszórók

- különleges

- kifejezetten

- meghatározott

- beszéd

- Költési

- tüskék

- kezdet

- kezdődött

- Lépés

- Lépései

- tárolás

- memorizált

- Történet

- folyam

- áramvonal

- szerkesztett

- Később

- lényeges

- ilyen

- megfelelő

- kínálat

- támogatás

- Támogató

- cserélték

- gyorsan

- összehangolás

- rendszer

- táblázat

- Vesz

- tart

- célzott

- Feladat

- csapat

- technikák

- Technologies

- Technológia

- ideiglenes

- szöveg

- mint

- hogy

- A

- A jövő

- Az Egyesült Királyságban

- azok

- Őket

- akkor

- ezáltal

- Ezek

- ők

- ezt

- azok

- három

- Keresztül

- idő

- Idősorok

- időigényes

- időkeret

- alkalommal

- időbélyeg

- időzítések

- Cím

- címei

- nak nek

- jelképes

- vett

- eszköztár

- fáklya

- hagyományosan

- forgalom

- Képzések

- átlátszó

- kiváltó

- kioldás

- Megbízható

- igazság

- megpróbál

- oktatói

- tv

- kettő

- tipikus

- Uk

- alatt

- 30 alatt

- megértés

- egységek

- Frissítések

- upon

- használ

- használati eset

- használt

- használó

- használ

- segítségével

- hasznosított

- hasznosítja

- Értékek

- különféle

- változik

- változat

- verzió

- életképes

- videó

- látomás

- Látogat

- Hang

- W

- volt

- we

- háló

- webes szolgáltatások

- JÓL

- amikor

- míg

- Suttogás

- lesz

- val vel

- belül

- nélkül

- szavak

- Munka

- munkafolyamat

- munkafolyamatok

- munkaerő

- művek

- világ

- írás

- yaml

- te

- A te

- magad

- zephyrnet

- ZOO