Membuka jawaban yang akurat dan berwawasan luas dari sejumlah besar teks adalah kemampuan menarik yang dimungkinkan oleh model bahasa besar (LLM). Saat membangun aplikasi LLM, sering kali perlu menghubungkan dan menanyakan sumber data eksternal untuk memberikan konteks yang relevan dengan model. Salah satu pendekatan yang populer adalah menggunakan Retrieval Augmented Generation (RAG) untuk menciptakan sistem Tanya Jawab yang memahami informasi kompleks dan memberikan respons alami terhadap pertanyaan. RAG memungkinkan model memanfaatkan basis pengetahuan yang luas dan menyampaikan dialog mirip manusia untuk aplikasi seperti chatbots dan asisten pencarian perusahaan.

Dalam postingan ini, kami mengeksplorasi cara memanfaatkan kekuatan Indeks Llama, Llama 2-70B-Obrolan, dan LangChain untuk membangun aplikasi Tanya Jawab yang kuat. Dengan teknologi canggih ini, Anda dapat menyerap korpora teks, mengindeks pengetahuan penting, dan menghasilkan teks yang menjawab pertanyaan pengguna dengan tepat dan jelas.

Llama 2-70B-Obrolan

Llama 2-70B-Chat adalah LLM kuat yang bersaing dengan model terkemuka. Ini telah dilatih sebelumnya pada dua triliun token teks, dan dimaksudkan oleh Meta untuk digunakan sebagai bantuan obrolan kepada pengguna. Data pra-pelatihan bersumber dari data yang tersedia untuk umum dan berakhir pada September 2022, dan data penyesuaian berakhir pada Juli 2023. Untuk detail selengkapnya tentang proses pelatihan model, pertimbangan keselamatan, pembelajaran, dan tujuan penggunaan, lihat makalah Llama 2: Open Foundation dan Model Obrolan yang Disempurnakan. Model Llama 2 tersedia di Mulai Lompatan Amazon SageMaker untuk penerapan yang cepat dan mudah.

Indeks Llama

Indeks Llama adalah kerangka data yang memungkinkan pembangunan aplikasi LLM. Ini menyediakan alat yang menawarkan konektor data untuk menyerap data Anda yang ada dengan berbagai sumber dan format (PDF, dokumen, API, SQL, dan lainnya). Baik Anda memiliki data yang disimpan dalam database atau PDF, LlamaIndex memudahkan penggunaan data tersebut untuk LLM. Seperti yang kami tunjukkan di postingan ini, API LlamaIndex membuat akses data menjadi mudah dan memungkinkan Anda membuat aplikasi dan alur kerja LLM kustom yang kuat.

Jika Anda bereksperimen dan membangun dengan LLM, Anda mungkin sudah familiar dengan LangChain, yang menawarkan kerangka kerja yang kuat, menyederhanakan pengembangan dan penerapan aplikasi yang didukung LLM. Mirip dengan LangChain, LlamaIndex menawarkan sejumlah alat, termasuk konektor data, indeks data, mesin, dan agen data, serta integrasi aplikasi seperti alat dan observabilitas, penelusuran, dan evaluasi. LlamaIndex berfokus pada menjembatani kesenjangan antara data dan LLM yang kuat, menyederhanakan tugas data dengan fitur yang mudah digunakan. LlamaIndex dirancang khusus dan dioptimalkan untuk membangun aplikasi pencarian dan pengambilan, seperti RAG, karena menyediakan antarmuka sederhana untuk menanyakan LLM dan mengambil dokumen yang relevan.

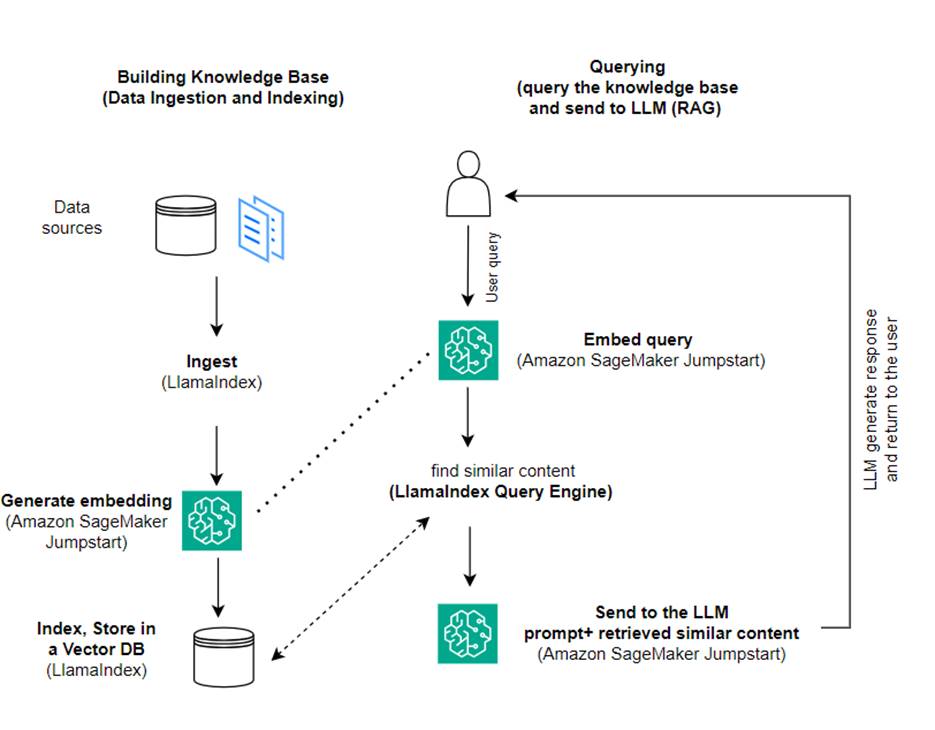

Ikhtisar solusi

Dalam postingan kali ini, kami mendemonstrasikan cara membuat aplikasi berbasis RAG menggunakan LlamaIndex dan LLM. Diagram berikut menunjukkan arsitektur langkah demi langkah dari solusi ini yang diuraikan di bagian berikut.

RAG menggabungkan pengambilan informasi dengan pembuatan bahasa alami untuk menghasilkan respons yang lebih berwawasan luas. Saat diminta, RAG pertama-tama mencari corpora teks untuk mengambil contoh paling relevan untuk masukan. Selama pembuatan respons, model mempertimbangkan contoh-contoh ini untuk meningkatkan kemampuannya. Dengan menggabungkan bagian-bagian yang relevan, tanggapan RAG cenderung lebih faktual, koheren, dan konsisten dengan konteks dibandingkan dengan model generatif dasar. Kerangka kerja pengambilan-hasil ini memanfaatkan kekuatan pengambilan dan pembuatan, membantu mengatasi masalah seperti pengulangan dan kurangnya konteks yang dapat timbul dari model percakapan autoregresif murni. RAG memperkenalkan pendekatan efektif untuk membangun agen percakapan dan asisten AI dengan respons yang kontekstual dan berkualitas tinggi.

Membangun solusi terdiri dari langkah-langkah berikut:

- Mendirikan Studio Amazon SageMaker sebagai lingkungan pengembangan dan menginstal dependensi yang diperlukan.

- Terapkan model penyematan dari hub Amazon SageMaker JumpStart.

- Unduh siaran pers untuk digunakan sebagai basis pengetahuan eksternal kami.

- Buat indeks dari siaran pers agar dapat melakukan kueri dan menambahkan konteks tambahan pada perintah.

- Kueri basis pengetahuan.

- Bangun aplikasi Tanya Jawab menggunakan agen LlamaIndex dan LangChain.

Semua kode dalam posting ini tersedia di GitHub repo.

Prasyarat

Untuk contoh ini, Anda memerlukan akun AWS dengan domain SageMaker dan sesuai Identitas AWS dan Manajemen Akses (IAM) izin. Untuk petunjuk pengaturan akun, lihat Buat Akun AWS. Jika Anda belum memiliki domain SageMaker, lihat Domain Amazon SageMaker ikhtisar untuk membuatnya. Dalam posting ini, kami menggunakan AmazonSageMakerAkses Penuh peran. Anda tidak disarankan menggunakan kredensial ini di lingkungan produksi. Sebaliknya, Anda harus membuat dan menggunakan peran dengan izin hak istimewa paling rendah. Anda juga dapat menjelajahi bagaimana Anda dapat menggunakannya Manajer Peran Amazon SageMaker untuk membangun dan mengelola peran IAM berbasis persona untuk kebutuhan pembelajaran mesin umum secara langsung melalui konsol SageMaker.

Selain itu, Anda memerlukan akses ke minimal ukuran instans berikut:

- ml.g5.2xbesar untuk penggunaan titik akhir saat menyebarkan Memeluk Wajah GPT-J model penyematan teks

- ml.g5.48xbesar untuk penggunaan titik akhir saat menyebarkan titik akhir model Llama 2-Chat

Untuk menambah kuota Anda, lihat Meminta penambahan kuota.

Terapkan model penyematan GPT-J menggunakan SageMaker JumpStart

Bagian ini memberi Anda dua opsi saat menerapkan model SageMaker JumpStart. Anda dapat menggunakan penerapan berbasis kode menggunakan kode yang disediakan, atau menggunakan antarmuka pengguna (UI) SageMaker JumpStart.

Terapkan dengan SageMaker Python SDK

Anda dapat menggunakan SageMaker Python SDK untuk menyebarkan LLM, seperti yang ditunjukkan di kode tersedia di repositori. Selesaikan langkah-langkah berikut:

- Tetapkan ukuran instans yang akan digunakan untuk penerapan model penyematan menggunakan

instance_type = "ml.g5.2xlarge" - Temukan ID model yang akan digunakan untuk penyematan. Di SageMaker JumpStart, ini diidentifikasi sebagai

model_id = "huggingface-textembedding-gpt-j-6b-fp16" - Ambil kontainer model terlatih dan terapkan untuk inferensi.

SageMaker akan mengembalikan nama titik akhir model dan pesan berikut ketika model embeddings berhasil diterapkan:

Terapkan dengan SageMaker JumpStart di SageMaker Studio

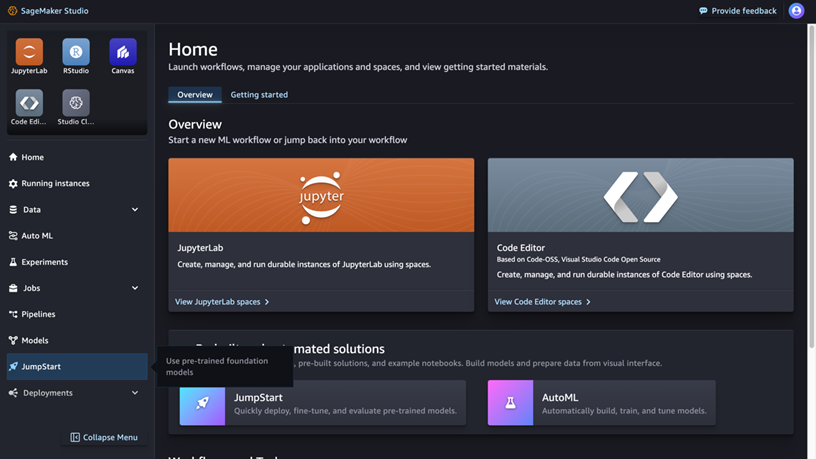

Untuk menyebarkan model menggunakan SageMaker JumpStart di Studio, selesaikan langkah-langkah berikut:

- Di konsol SageMaker Studio, pilih JumpStart di panel navigasi.

- Cari dan pilih model GPT-J 6B Embedding FP16.

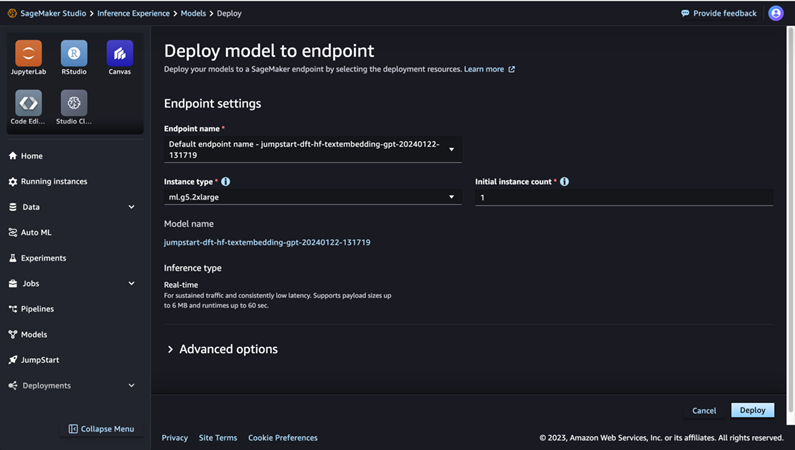

- Pilih Terapkan dan sesuaikan konfigurasi penerapan.

- Untuk contoh ini, kita memerlukan instance ml.g5.2xlarge, yang merupakan instance default yang disarankan oleh SageMaker JumpStart.

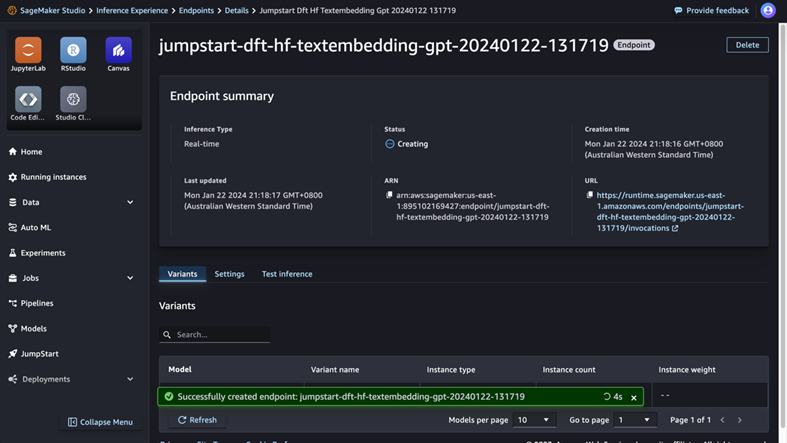

- Pilih Deploy lagi untuk membuat titik akhir.

Titik akhir akan memakan waktu sekitar 5–10 menit untuk dapat dilayani.

Setelah Anda menerapkan model penyematan, untuk menggunakan integrasi LangChain dengan API SageMaker, Anda perlu membuat fungsi untuk menangani masukan (teks mentah) dan mengubahnya menjadi penyematan menggunakan model tersebut. Anda melakukan ini dengan membuat kelas bernama ContentHandler, yang mengambil JSON data masukan, dan mengembalikan JSON penyematan teks: class ContentHandler(EmbeddingsContentHandler).

Berikan nama titik akhir model ke ContentHandler berfungsi untuk mengonversi teks dan mengembalikan embeddings:

Anda dapat menemukan nama titik akhir di output SDK atau di detail penerapan di UI SageMaker JumpStart.

Anda dapat mengujinya ContentHandler fungsi dan titik akhir berfungsi seperti yang diharapkan dengan memasukkan beberapa teks mentah dan menjalankannya embeddings.embed_query(text) fungsi. Anda dapat menggunakan contoh yang diberikan text = "Hi! It's time for the beach" atau coba teks Anda sendiri.

Terapkan dan uji Llama 2-Chat menggunakan SageMaker JumpStart

Sekarang Anda dapat menerapkan model yang mampu melakukan percakapan interaktif dengan pengguna Anda. Dalam contoh ini, kami memilih salah satu model 2-obrolan Llama, yang diidentifikasi melalui

Model perlu diterapkan ke titik akhir waktu nyata menggunakan predictor = my_model.deploy(). SageMaker akan mengembalikan nama titik akhir model, yang dapat Anda gunakan untuk endpoint_name variabel untuk referensi nanti.

Anda mendefinisikan a print_dialogue berfungsi untuk mengirim masukan ke model obrolan dan menerima respons keluarannya. Payloadnya mencakup hyperparameter untuk model, termasuk yang berikut:

- max_new_tokens – Mengacu pada jumlah maksimum token yang dapat dihasilkan model dalam keluarannya.

- atas_p – Mengacu pada probabilitas kumulatif token yang dapat dipertahankan oleh model saat menghasilkan keluarannya

- suhu – Mengacu pada keacakan keluaran yang dihasilkan oleh model. Suhu yang lebih besar dari 0 atau sama dengan 1 meningkatkan tingkat keacakan, sedangkan suhu 0 akan menghasilkan token yang paling mungkin.

Anda harus memilih hyperparameter berdasarkan kasus penggunaan Anda dan mengujinya dengan tepat. Model seperti keluarga Llama mengharuskan Anda menyertakan parameter tambahan yang menunjukkan bahwa Anda telah membaca dan menerima Perjanjian Lisensi Pengguna Akhir (EULA):

Untuk menguji model, ganti bagian konten payload masukan: "content": "what is the recipe of mayonnaise?". Anda dapat menggunakan nilai teks Anda sendiri dan memperbarui hyperparameter untuk memahaminya dengan lebih baik.

Mirip dengan penerapan model embeddings, Anda dapat menerapkan Llama-70B-Chat menggunakan SageMaker JumpStart UI:

- Di konsol SageMaker Studio, pilih Tingkatkan di panel navigasi

- Cari dan pilih

Llama-2-70b-Chat model - Terima EULA dan pilih Menyebarkan, menggunakan instance default lagi

Mirip dengan model penyematan, Anda dapat menggunakan integrasi LangChain dengan membuat templat pengendali konten untuk masukan dan keluaran model obrolan Anda. Dalam hal ini, Anda mendefinisikan masukan sebagai masukan yang berasal dari pengguna, dan menunjukkan bahwa masukan tersebut diatur oleh system prompt. itu system prompt menginformasikan model perannya dalam membantu pengguna untuk kasus penggunaan tertentu.

Pengendali konten ini kemudian diteruskan saat memanggil model, selain hyperparameter dan atribut khusus yang disebutkan di atas (penerimaan EULA). Anda mengurai semua atribut ini menggunakan kode berikut:

Ketika titik akhir tersedia, Anda dapat menguji apakah titik akhir tersebut berfungsi seperti yang diharapkan. Anda dapat memperbarui llm("what is amazon sagemaker?") dengan teks Anda sendiri. Anda juga perlu mendefinisikan secara spesifik ContentHandler untuk memanggil LLM menggunakan LangChain, seperti yang ditunjukkan pada kode dan cuplikan kode berikut:

Gunakan LlamaIndex untuk membuat RAG

Untuk melanjutkan, instal LlamaIndex untuk membuat aplikasi RAG. Anda dapat menginstal LlamaIndex menggunakan pip: pip install llama_index

Anda harus terlebih dahulu memuat data Anda (basis pengetahuan) ke LlamaIndex untuk pengindeksan. Ini melibatkan beberapa langkah:

- Pilih pemuat data:

LlamaIndex menyediakan sejumlah konektor data yang tersedia LlamaHub untuk tipe data umum seperti JSON, CSV, dan file teks, serta sumber data lainnya, memungkinkan Anda menyerap berbagai kumpulan data. Dalam posting ini, kami menggunakan SimpleDirectoryReader untuk menyerap beberapa file PDF seperti yang ditunjukkan dalam kode. Sampel data kami adalah dua siaran pers Amazon dalam versi PDF di siaran pers folder di repositori kode kami. Setelah Anda memuat PDF, Anda dapat melihat bahwa PDF tersebut telah dikonversi ke daftar 11 elemen.

Daripada memuat dokumen secara langsung, Anda juga dapat menyembunyikannya Document objek ke dalam Node objek sebelum mengirimkannya ke indeks. Pilihan antara mengirimkan keseluruhan Document objek ke indeks atau mengubah Dokumen menjadi Node objek sebelum pengindeksan bergantung pada kasus penggunaan spesifik Anda dan struktur data Anda. Pendekatan node umumnya merupakan pilihan yang baik untuk dokumen panjang, di mana Anda ingin memecah dan mengambil bagian tertentu dari dokumen, bukan keseluruhan dokumen. Untuk informasi lebih lanjut, lihat Dokumen / Node.

- Buat instance loader dan muat dokumen:

Langkah ini menginisialisasi kelas loader dan konfigurasi apa pun yang diperlukan, seperti apakah akan mengabaikan file tersembunyi. Untuk lebih jelasnya, lihat Pembaca Direktori Sederhana.

- Hubungi loader

load_datametode untuk mengurai file dan data sumber Anda dan mengubahnya menjadi objek Dokumen LlamaIndex, siap untuk pengindeksan dan pembuatan kueri. Anda dapat menggunakan kode berikut untuk menyelesaikan penyerapan data dan persiapan untuk pencarian teks lengkap menggunakan kemampuan pengindeksan dan pengambilan LlamaIndex:

- Bangun indeks:

Fitur utama LlamaIndex adalah kemampuannya untuk membuat indeks terorganisir atas data, yang direpresentasikan sebagai dokumen atau node. Pengindeksan memfasilitasi kueri data yang efisien. Kami membuat indeks kami dengan penyimpanan vektor dalam memori default dan dengan konfigurasi pengaturan yang kami tentukan. Indeks Llama Settings adalah objek konfigurasi yang menyediakan sumber daya dan pengaturan yang umum digunakan untuk operasi pengindeksan dan kueri dalam aplikasi LlamaIndex. Ini bertindak sebagai objek tunggal, sehingga memungkinkan Anda mengatur konfigurasi global, sekaligus memungkinkan Anda mengganti komponen tertentu secara lokal dengan meneruskannya langsung ke antarmuka (seperti LLM, model penyematan) yang menggunakannya. Ketika komponen tertentu tidak disediakan secara eksplisit, kerangka LlamaIndex akan kembali ke pengaturan yang ditentukan dalam Settings objek sebagai default global. Untuk menggunakan model penyematan dan LLM kami dengan LangChain dan mengonfigurasinya Settings kita perlu menginstal llama_index.embeddings.langchain dan llama_index.llms.langchain. Kita dapat mengkonfigurasinya Settings objek seperti pada kode berikut:

Secara default, VectorStoreIndex menggunakan dalam memori SimpleVectorStore itu diinisialisasi sebagai bagian dari konteks penyimpanan default. Dalam kasus penggunaan kehidupan nyata, Anda sering kali perlu terhubung ke penyimpanan vektor eksternal seperti Layanan Pencarian Terbuka Amazon. Untuk lebih jelasnya, lihat Mesin Vektor untuk Amazon OpenSearch Tanpa Server.

Sekarang Anda dapat menjalankan Tanya Jawab atas dokumen Anda dengan menggunakan mesin_kueri dari LlamaIndex. Untuk melakukannya, teruskan indeks yang Anda buat sebelumnya untuk kueri dan ajukan pertanyaan Anda. Mesin kueri adalah antarmuka umum untuk menanyakan data. Dibutuhkan kueri bahasa alami sebagai masukan dan mengembalikan respons yang kaya. Mesin kueri biasanya dibangun di atas satu atau lebih indeks menggunakan retriever.

Anda dapat melihat bahwa solusi RAG mampu mengambil jawaban yang benar dari dokumen yang disediakan:

Gunakan alat dan agen LangChain

Loader kelas. Pemuat dirancang untuk memuat data ke LlamaIndex atau selanjutnya sebagai alat di a Agen LangChain. Ini memberi Anda lebih banyak kekuatan dan fleksibilitas untuk menggunakannya sebagai bagian dari aplikasi Anda. Anda mulai dengan mendefinisikan Anda alat dari kelas agen LangChain. Fungsi yang Anda teruskan ke alat Anda menanyakan indeks yang Anda buat pada dokumen Anda menggunakan LlamaIndex.

Kemudian Anda memilih jenis agen yang tepat yang ingin Anda gunakan untuk implementasi RAG Anda. Dalam hal ini, Anda menggunakan chat-zero-shot-react-description agen. Dengan agen ini, LLM akan menggunakan alat yang tersedia (dalam skenario ini, RAG atas basis pengetahuan) untuk memberikan respons. Anda kemudian menginisialisasi agen dengan meneruskan alat, LLM, dan jenis agen Anda:

Anda dapat melihat agen melewatinya thoughts, actions, dan observation , gunakan alat tersebut (dalam skenario ini, menanyakan dokumen yang diindeks); dan mengembalikan hasilnya:

Anda dapat menemukan kode implementasi end-to-end di lampiran GitHub repo.

Membersihkan

Untuk menghindari biaya yang tidak perlu, Anda dapat membersihkan sumber daya Anda, baik melalui cuplikan kode berikut atau UI Amazon JumpStart.

Untuk menggunakan Boto3 SDK, gunakan kode berikut untuk menghapus titik akhir model penyematan teks dan titik akhir model pembuatan teks, serta konfigurasi titik akhir:

Untuk menggunakan konsol SageMaker, selesaikan langkah-langkah berikut:

- Di konsol SageMaker, di bawah Inferensi di panel navigasi, pilih Titik Akhir

- Cari titik akhir penyematan dan pembuatan teks.

- Pada halaman detail titik akhir, pilih Hapus.

- Pilih Hapus lagi untuk mengonfirmasi.

Kesimpulan

Untuk kasus penggunaan yang berfokus pada pencarian dan pengambilan, LlamaIndex menyediakan kemampuan yang fleksibel. Ini unggul dalam pengindeksan dan pengambilan untuk LLM, menjadikannya alat yang ampuh untuk eksplorasi data yang mendalam. LlamaIndex memungkinkan Anda membuat indeks data terorganisir, menggunakan beragam LLM, menambah data untuk kinerja LLM yang lebih baik, dan membuat kueri data dengan bahasa alami.

Posting ini menunjukkan beberapa konsep dan kemampuan utama LlamaIndex. Kami menggunakan GPT-J untuk penyematan dan Llama 2-Chat sebagai LLM untuk membangun aplikasi RAG, namun Anda dapat menggunakan model apa pun yang sesuai. Anda dapat menjelajahi rangkaian lengkap model yang tersedia di SageMaker JumpStart.

Kami juga menunjukkan bagaimana LlamaIndex dapat menyediakan alat yang kuat dan fleksibel untuk menghubungkan, mengindeks, mengambil, dan mengintegrasikan data dengan kerangka kerja lain seperti LangChain. Dengan integrasi LlamaIndex dan LangChain, Anda dapat membangun aplikasi LLM yang lebih kuat, serbaguna, dan berwawasan luas.

Tentang Penulis

Dr.Romina Sharifpour adalah Arsitek Senior Pembelajaran Mesin dan Solusi Kecerdasan Buatan di Amazon Web Services (AWS). Dia telah menghabiskan lebih dari 10 tahun memimpin desain dan implementasi solusi end-to-end inovatif yang dimungkinkan oleh kemajuan dalam ML dan AI. Bidang minat Romina adalah pemrosesan bahasa alami, model bahasa besar, dan MLOps.

Dr.Romina Sharifpour adalah Arsitek Senior Pembelajaran Mesin dan Solusi Kecerdasan Buatan di Amazon Web Services (AWS). Dia telah menghabiskan lebih dari 10 tahun memimpin desain dan implementasi solusi end-to-end inovatif yang dimungkinkan oleh kemajuan dalam ML dan AI. Bidang minat Romina adalah pemrosesan bahasa alami, model bahasa besar, dan MLOps.

Nicole Pinto adalah Arsitek Solusi Spesialis AI/ML yang berbasis di Sydney, Australia. Latar belakangnya di bidang kesehatan dan jasa keuangan memberinya perspektif unik dalam memecahkan masalah pelanggan. Dia bersemangat untuk memberdayakan pelanggan melalui pembelajaran mesin dan memberdayakan generasi perempuan berikutnya di STEM.

Nicole Pinto adalah Arsitek Solusi Spesialis AI/ML yang berbasis di Sydney, Australia. Latar belakangnya di bidang kesehatan dan jasa keuangan memberinya perspektif unik dalam memecahkan masalah pelanggan. Dia bersemangat untuk memberdayakan pelanggan melalui pembelajaran mesin dan memberdayakan generasi perempuan berikutnya di STEM.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/build-knowledge-powered-conversational-applications-using-llamaindex-and-llama-2-chat/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 11

- 13

- 14

- 15%

- 16

- 2022

- 2023

- 22

- 500

- 7

- 8

- 9

- a

- kemampuan

- Sanggup

- Tentang Kami

- penerimaan

- diterima

- Menerima

- mengakses

- Menurut

- Akun

- tepat

- tindakan

- menambahkan

- tambahan

- Tambahan

- alamat

- kemajuan

- Keuntungan

- Setelah

- lagi

- Agen

- agen

- Persetujuan

- AI

- ai penelitian

- AI / ML

- Semua

- Membiarkan

- memungkinkan

- sudah

- juga

- Amazon

- Amazon SageMaker

- Mulai Lompatan Amazon SageMaker

- Amazon Web Services

- Layanan Web Amazon (AWS)

- jumlah

- an

- dan

- menjawab

- menjawab

- jawaban

- Apa pun

- Lebah

- Aplikasi

- aplikasi

- pendekatan

- sesuai

- tepat

- sekitar

- arsitektur

- ADALAH

- daerah

- timbul

- buatan

- kecerdasan buatan

- AS

- meminta

- Bantuan

- asisten

- membantu

- At

- atribut

- menambah

- ditambah

- Australia

- tersedia

- menghindari

- AWS

- kembali

- latar belakang

- mendasarkan

- berdasarkan

- dasar

- BE

- Pantai

- karena

- menjadi

- sebelum

- Lebih baik

- antara

- kedua

- Istirahat

- menjembatani

- membawa

- membangun

- Bangunan

- dibangun di

- tapi

- by

- bernama

- CAN

- kemampuan

- kemampuan

- kasus

- kasus

- mengobrol

- chatbots

- pilihan

- Pilih

- kelas

- membersihkan

- Jelas

- klien

- kode

- KOHEREN

- menggabungkan

- kedatangan

- Umum

- umum

- perusahaan

- dibandingkan

- bersaing

- lengkap

- kompleks

- komponen

- komponen

- memahami

- luas

- konsep

- menyimpulkan

- konfigurasi

- mengkonfigurasi

- Memastikan

- Terhubung

- konektor

- pertimbangan

- menganggap

- konsisten

- terdiri

- konsul

- membangun

- Wadah

- Konten

- konteks

- terus

- percakapan

- percakapan

- mengubah

- dikonversi

- mengkonversi

- benar

- Biaya

- penghematan biaya

- Biaya

- bisa

- membuat

- dibuat

- membuat

- MANDAT

- kritis

- adat

- pelanggan

- pelanggan

- menyesuaikan

- Memotong

- data

- akses data

- database

- kumpulan data

- mendalam

- Default

- menetapkan

- didefinisikan

- mendefinisikan

- menyampaikan

- mendemonstrasikan

- menunjukkan

- ketergantungan

- tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- Mendesain

- dirancang

- rincian

- Pengembangan

- diagram

- Dialog

- DICT

- langsung

- beberapa

- do

- docs

- dokumen

- dokumen

- domain

- Dont

- didorong

- selama

- Terdahulu

- Efektif

- efisien

- tanpa usaha

- antara

- elemen

- embedding

- memberdayakan

- diaktifkan

- memungkinkan

- memungkinkan

- akhir

- ujung ke ujung

- Titik akhir

- Mesin

- Mesin

- Enterprise

- Seluruh

- Lingkungan Hidup

- sama

- evaluasi

- contoh

- contoh

- menarik

- ada

- diharapkan

- bereksperimen

- secara eksplisit

- eksplorasi

- menyelidiki

- luar

- Menghadapi

- memfasilitasi

- Air terjun

- akrab

- keluarga

- Fitur

- Fitur

- beberapa

- File

- keuangan

- jasa keuangan

- Menemukan

- Pertama

- keluwesan

- fleksibel

- terfokus

- berfokus

- berikut

- Untuk

- Prinsip Dasar

- Kerangka

- kerangka

- dari

- fungsi

- celah

- umumnya

- menghasilkan

- dihasilkan

- menghasilkan

- generasi

- generatif

- memberikan

- Aksi

- akan

- baik

- diatur

- lebih besar

- menangani

- memanfaatkan

- Memiliki

- kesehatan

- membantu

- dia

- Tersembunyi

- berkualitas tinggi

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- Pusat

- ID

- diidentifikasi

- identitas

- if

- mengabaikan

- implementasi

- perbaikan

- in

- memasukkan

- termasuk

- Termasuk

- menggabungkan

- Meningkatkan

- Meningkatkan

- indeks

- diindeks

- indeks

- menunjukkan

- Menunjukkan

- informasi

- menginformasikan

- Infrastruktur

- Innovation

- inovatif

- memasukkan

- input

- memasukkan

- berwawasan luas

- install

- contoh

- sebagai gantinya

- instruksi

- mengintegrasikan

- integrasi

- integrasi

- Intelijen

- dimaksudkan

- interaktif

- bunga

- Antarmuka

- interface

- ke

- Memperkenalkan

- melibatkan

- masalah

- IT

- NYA

- jpg

- json

- Juli

- kunci

- pengetahuan

- Kekurangan

- bahasa

- besar

- kemudian

- terkemuka

- pengetahuan

- Tingkat

- Lisensi

- 'like'

- Mungkin

- Daftar

- Llama

- LLM

- memuat

- pemuat

- pemuatan

- lokal

- Panjang

- mesin

- Mesin belajar

- membuat

- MEMBUAT

- Membuat

- mengelola

- maksimum

- Mungkin..

- tersebut

- pesan

- meta

- metode

- bermigrasi

- migrasi

- minimum

- menit

- ML

- MLOps

- model

- model

- lebih

- paling

- banyak

- nama

- Alam

- Pengolahan Bahasa alami

- Navigasi

- perlu

- Perlu

- dibutuhkan

- kebutuhan

- berikutnya

- node

- jumlah

- obyek

- objek

- of

- menawarkan

- Penawaran

- sering

- on

- ONE

- hanya

- ke

- Buka

- operasional

- Operasi

- dioptimalkan

- Opsi

- or

- urutan

- terorganisir

- Lainnya

- kami

- di luar

- diuraikan

- keluaran

- output

- lebih

- mengesampingkan

- ikhtisar

- sendiri

- halaman

- pane

- kertas

- parameter

- parameter

- bagian

- tertentu

- bagian

- lulus

- bagian

- Lulus

- Lewat

- bergairah

- prestasi

- Izin

- perspektif

- plato

- Kecerdasan Data Plato

- Data Plato

- Populer

- Pos

- kekuasaan

- kuat

- tepat

- Predictor

- persiapan

- pers

- Jumpa pers

- Siaran pers

- masalah

- proses

- pengolahan

- menghasilkan

- Produksi

- memberikan

- disediakan

- menyediakan

- di depan umum

- murni

- Ular sanca

- Q & A

- query

- pertanyaan

- pertanyaan

- Pertanyaan

- Cepat

- lap

- keserampangan

- jarak

- agak

- Mentah

- Baca

- siap

- real-time

- menerima

- resep

- direkomendasikan

- mengurangi

- lihat

- referensi

- mengacu

- menginvestasikan kembali

- melepaskan

- Pers

- relevan

- menggantikan

- gudang

- diwakili

- membutuhkan

- wajib

- penelitian

- penelitian dan pengembangan

- Sumber

- tanggapan

- tanggapan

- mengakibatkan

- pengambilan

- kembali

- Pengembalian

- Kaya

- benar

- kuat

- Peran

- peran

- Run

- berjalan

- s

- Safety/keselamatan

- pembuat bijak

- mencicipi

- Tabungan

- skenario

- SDK

- Pencarian

- pencarian

- Bagian

- bagian

- melihat

- memilih

- DIRI

- mengirim

- mengirim

- senior

- September

- layanan

- Layanan

- set

- pengaturan

- pengaturan

- penyiapan

- dia

- harus

- menunjukkan

- ditunjukkan

- Pertunjukkan

- mirip

- Sederhana

- menyederhanakan

- sejak

- Ukuran

- ukuran

- potongan

- So

- larutan

- Solusi

- Memecahkan

- beberapa

- sumber

- bersumber

- sumber

- spesialis

- tertentu

- Secara khusus

- menghabiskan

- awal

- state-of-the-art

- Negara

- batang

- Langkah

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- toko

- mudah

- pelurusan

- kekuatan

- struktur

- studio

- Kemudian

- berhasil

- seperti itu

- cocok

- sydney

- sistem

- sistem

- Mengambil

- Dibutuhkan

- Tap

- tugas

- Teknologi

- Template

- Cenderung

- uji

- teks

- dari

- bahwa

- Grafik

- Mereka

- kemudian

- Ini

- mereka

- ini

- itu

- Melalui

- waktu

- untuk

- Token

- alat

- alat

- puncak

- jiplakan

- Pelatihan

- Mengubah

- Triliun

- mencoba

- dua

- mengetik

- jenis

- khas

- ui

- bawah

- memahami

- unik

- tidak perlu

- Memperbarui

- penggunaan

- menggunakan

- gunakan case

- bekas

- berguna

- Pengguna

- User Interface

- user-friendly

- Pengguna

- kegunaan

- menggunakan

- Nilai - Nilai

- variabel

- variasi

- berbagai

- Luas

- serba guna

- versi

- melalui

- ingin

- we

- jaringan

- layanan web

- BAIK

- Apa

- Apa itu

- ketika

- sedangkan

- apakah

- yang

- sementara

- akan

- dengan

- Wanita

- Alur kerja

- kerja

- akan

- tahun

- Kamu

- Anda

- zephyrnet.dll