Entri blog ini ditulis bersama Hwalsuk Lee di Upstage.

Hari ini, kami dengan gembira mengumumkan bahwa Tenaga surya model pondasi yang dikembangkan oleh Upstage sekarang tersedia untuk digunakan pelanggan Mulai Lompatan Amazon SageMaker. Solar adalah model bahasa besar (LLM) yang 100% telah dilatih sebelumnya Amazon SageMaker yang mengungguli dan menggunakan ukurannya yang ringkas serta rekam jejak yang kuat untuk berspesialisasi dalam pelatihan tujuan, menjadikannya serbaguna dalam berbagai bahasa, domain, dan tugas.

Sekarang Anda dapat menggunakan Obrolan Mini Tenaga Surya dan Obrolan Mini Tenaga Surya – Kuantitas model terlatih dalam SageMaker JumpStart. SageMaker JumpStart adalah pusat pembelajaran mesin (ML) SageMaker yang menyediakan akses ke model dasar selain algoritme bawaan untuk membantu Anda memulai ML dengan cepat.

Dalam postingan ini, kami membahas cara menemukan dan menerapkan model Solar melalui SageMaker JumpStart.

Apa model suryanya?

Solar adalah model yang ringkas dan kuat untuk bahasa Inggris dan Korea. Ini secara khusus disesuaikan untuk tujuan obrolan multi-putaran, menunjukkan peningkatan kinerja di berbagai tugas pemrosesan bahasa alami.

Model Solar Mini Chat didasarkan pada Tenaga Surya 10.7B, dengan 32 lapisan Lama 2 struktur, dan diinisialisasi dengan bobot terlatih dari Mistral 7B kompatibel dengan arsitektur Llama 2. Penyempurnaan ini melengkapinya dengan kemampuan untuk menangani percakapan panjang dengan lebih efektif, membuatnya sangat mahir untuk aplikasi interaktif. Ini menggunakan metode penskalaan yang disebut peningkatan kedalaman (DUS), yang terdiri dari penskalaan mendalam dan pra-pelatihan lanjutan. DUS memungkinkan pembesaran model yang lebih kecil secara lebih mudah dan efisien dibandingkan metode penskalaan lainnya seperti campuran para ahli (MoE).

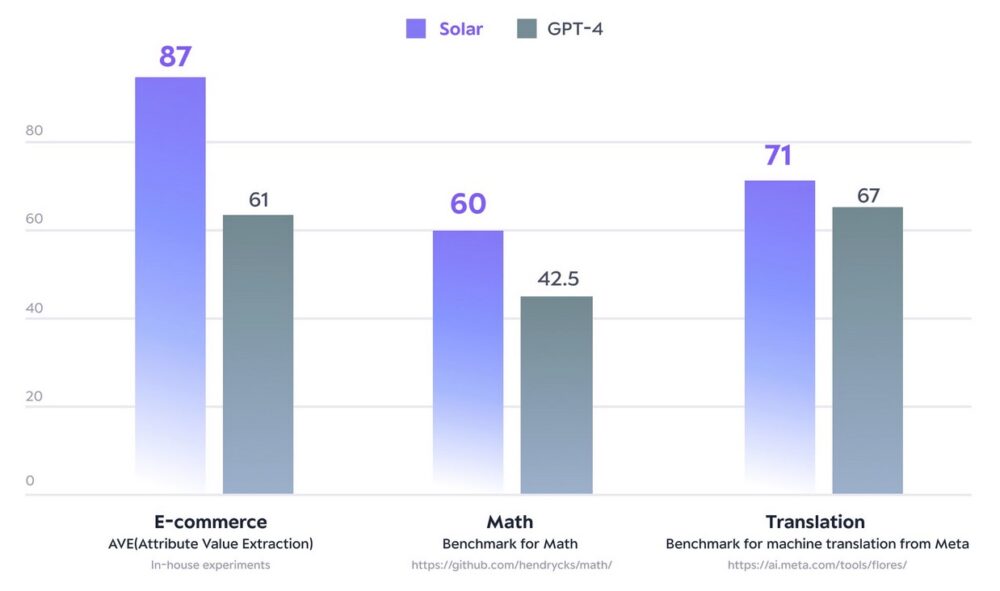

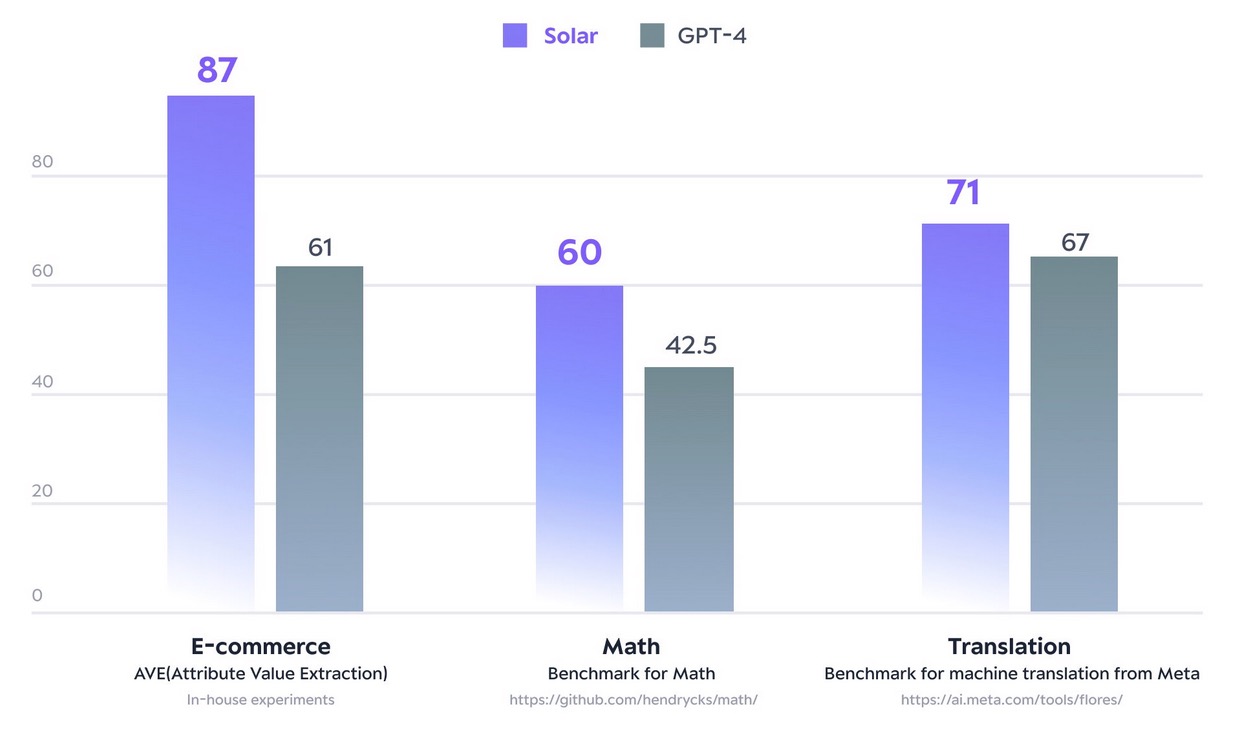

Pada bulan Desember 2023, model Solar 10.7B membuat heboh dengan mencapai puncaknya Buka Papan Peringkat LLM dari Memeluk Wajah. Menggunakan parameter yang jauh lebih sedikit, Solar 10.7B memberikan respons yang sebanding dengan GPT-3.5, namun 2.5 kali lebih cepat. Selain menduduki puncak Papan Peringkat LLM Terbuka, Solar 10.7B mengungguli GPT-4 dengan model yang dilatih khusus pada domain dan tugas tertentu.

Gambar berikut mengilustrasikan beberapa metrik tersebut:

sumber: https://www.upstage.ai/solar-llm

Dengan SageMaker JumpStart, Anda dapat menerapkan model terlatih berbasis Solar 10.7B: Solar Mini Chat dan Solar Mini Chat versi terkuantisasi, yang dioptimalkan untuk aplikasi obrolan dalam bahasa Inggris dan Korea. Model Solar Mini Chat memberikan pemahaman lebih lanjut tentang nuansa bahasa Korea, yang secara signifikan meningkatkan interaksi pengguna dalam lingkungan obrolan. Ini memberikan respons yang tepat terhadap masukan pengguna, memastikan komunikasi yang lebih jelas dan penyelesaian masalah yang lebih efisien dalam aplikasi obrolan bahasa Inggris dan Korea.

Memulai model surya di SageMaker JumpStart

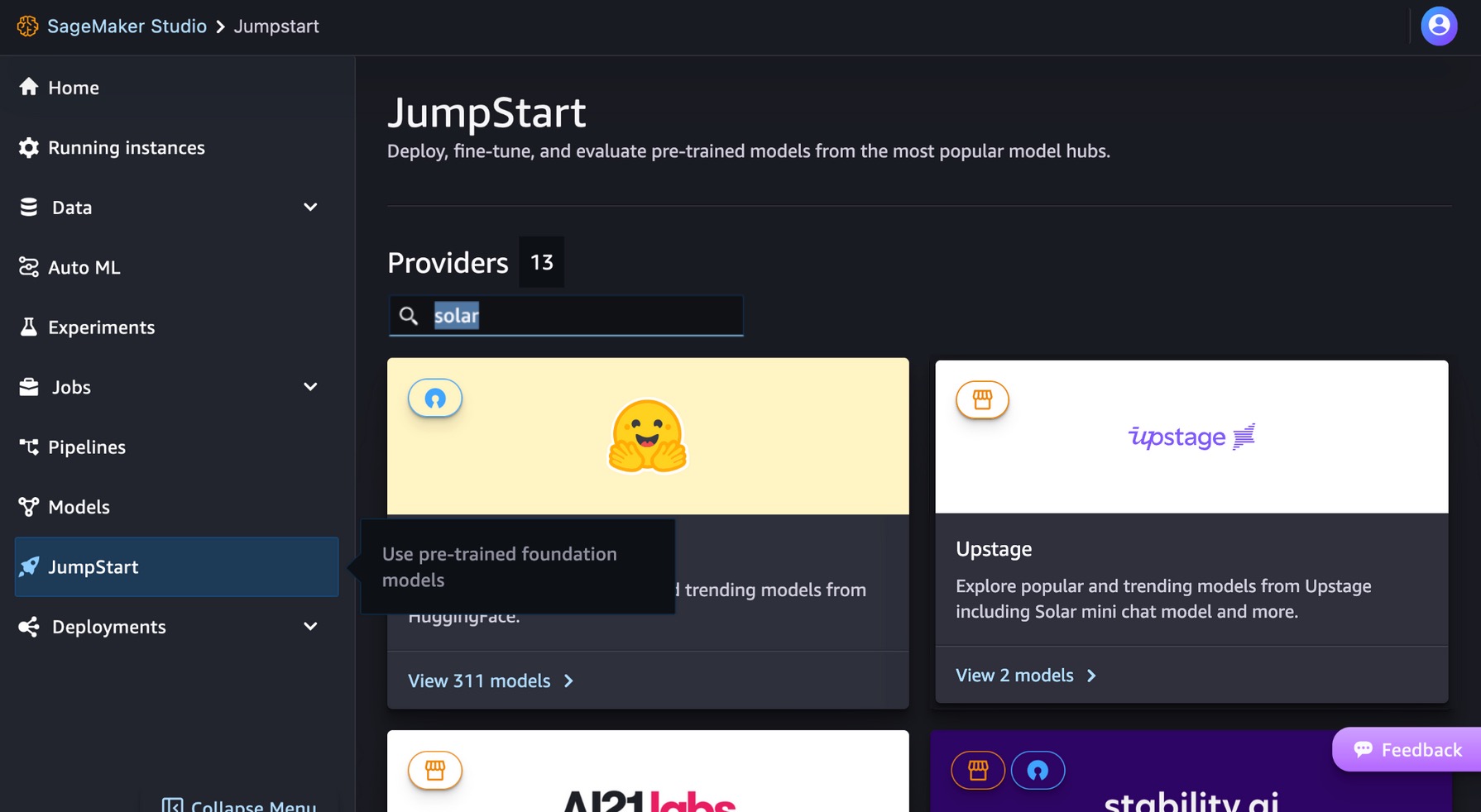

Untuk memulai model Solar, Anda dapat menggunakan SageMaker JumpStart, layanan hub ML yang terkelola sepenuhnya untuk menerapkan model ML yang telah dibuat sebelumnya ke dalam lingkungan host yang siap produksi. Anda dapat mengakses model Solar melalui SageMaker JumpStart di Studio Amazon SageMaker, lingkungan pengembangan terintegrasi (IDE) berbasis web tempat Anda dapat mengakses alat yang dibuat khusus untuk melakukan semua langkah pengembangan ML, mulai dari menyiapkan data hingga membuat, melatih, dan menerapkan model ML Anda.

Di konsol SageMaker Studio, pilih Tingkatkan di panel navigasi. Anda dapat memasukkan "surya" di bilah pencarian untuk menemukan model surya Upstage.

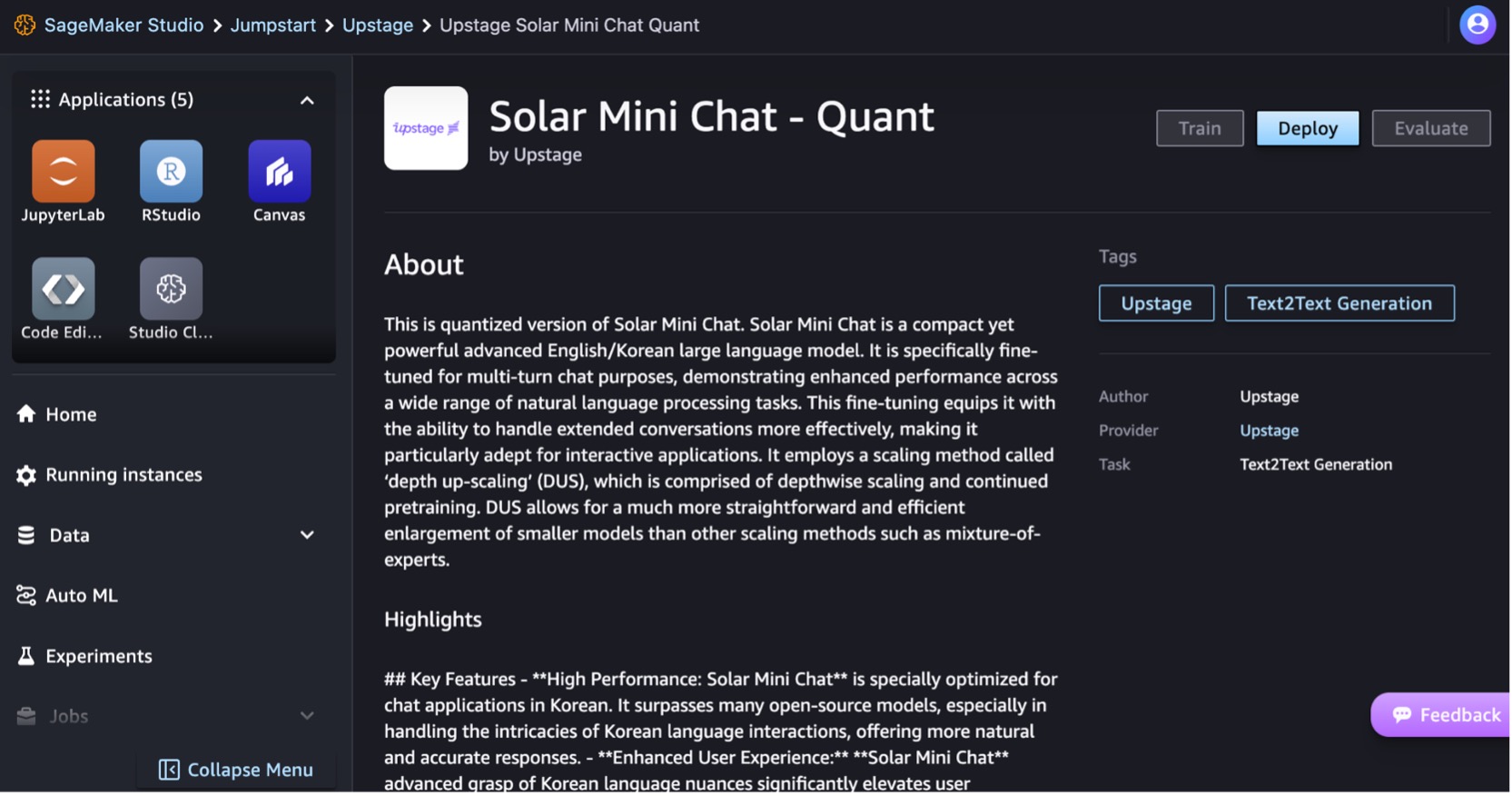

Mari terapkan model Solar Mini Chat – Quant. Pilih kartu model untuk melihat detail tentang model seperti lisensi, data yang digunakan untuk melatih, dan cara menggunakan model. Anda juga akan menemukan a Menyebarkan opsi, yang membawa Anda ke halaman landing tempat Anda dapat menguji inferensi dengan contoh payload.

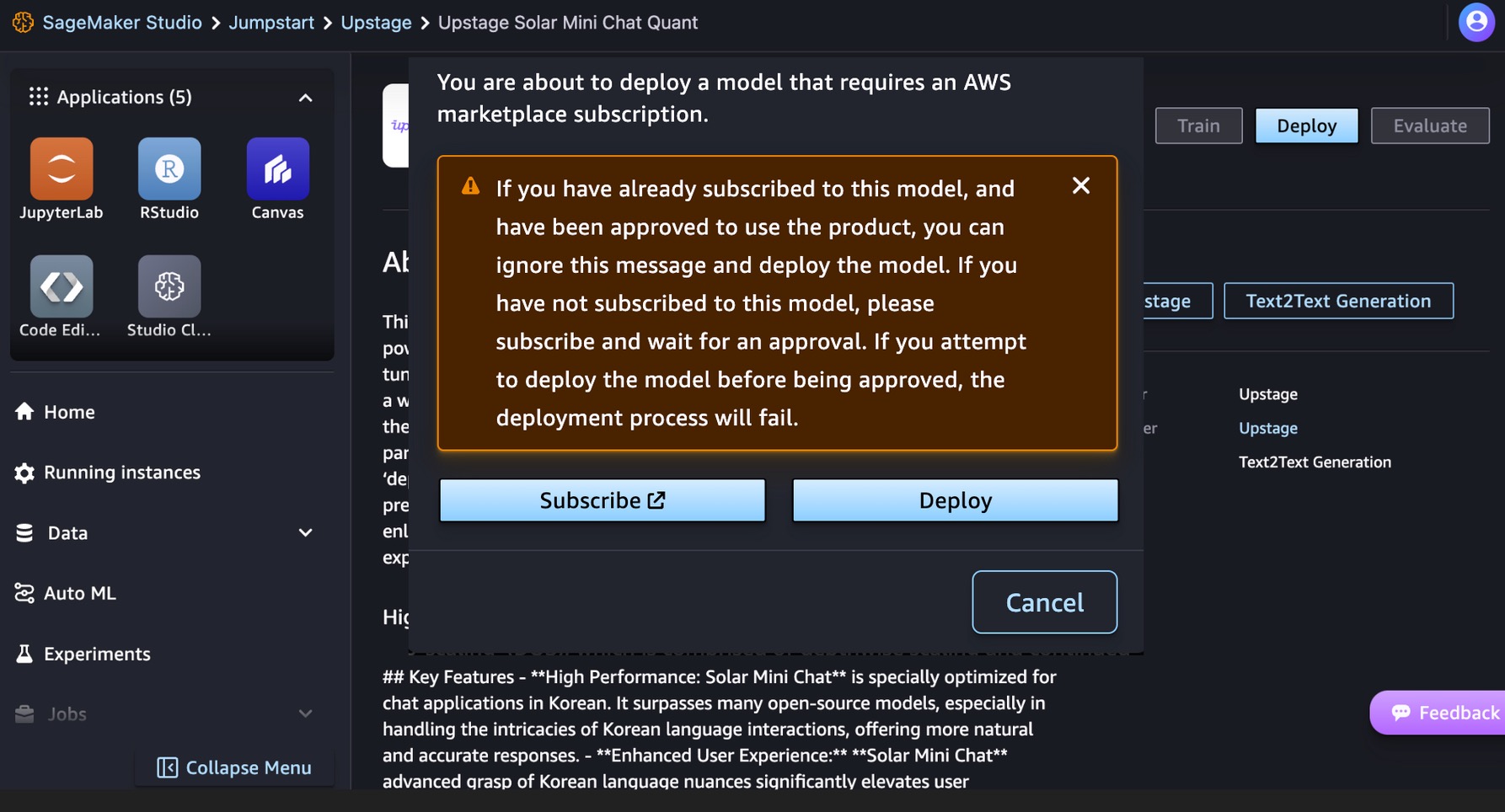

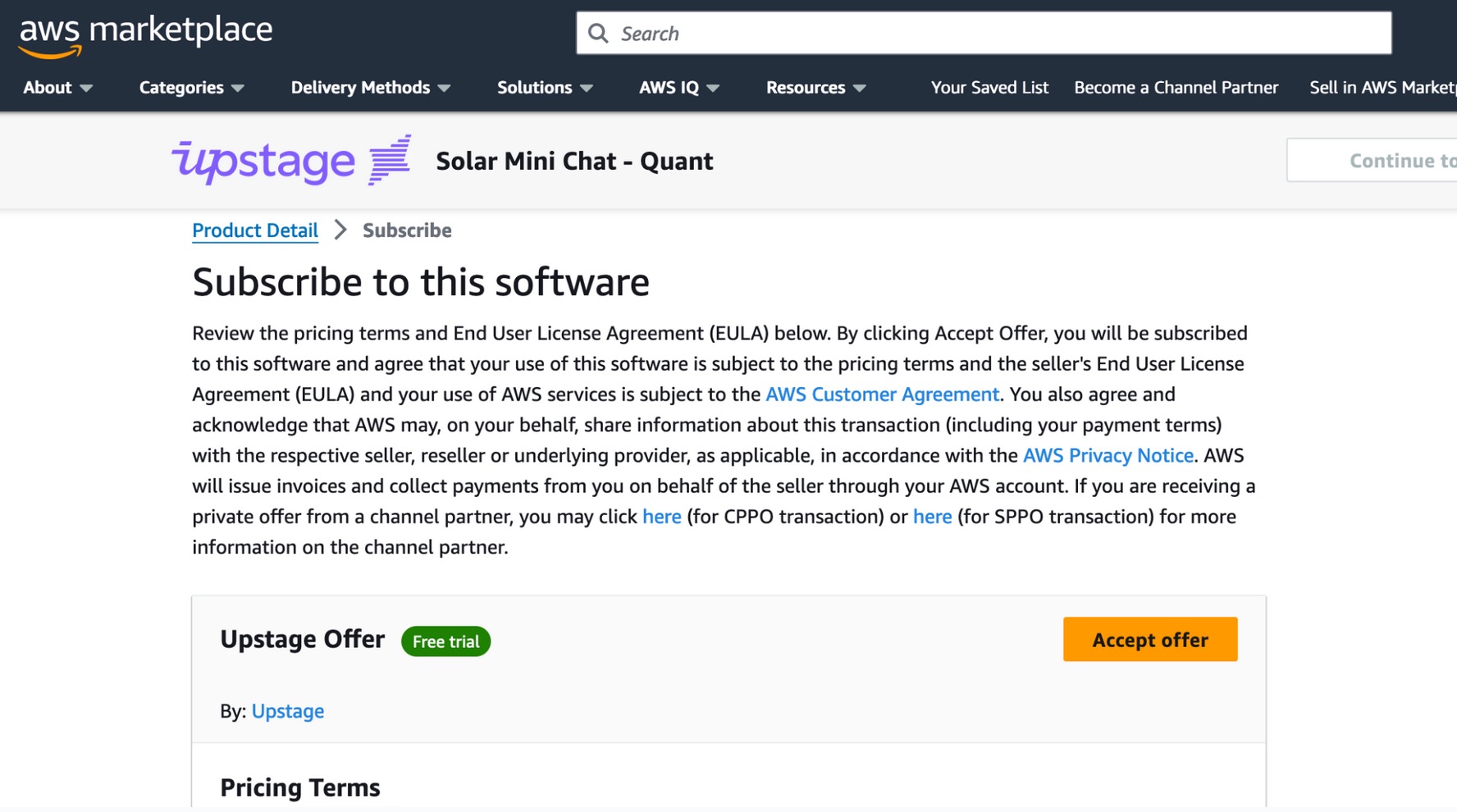

Model ini memerlukan sebuah Pasar AWS berlangganan. Jika Anda sudah berlangganan model ini, dan telah disetujui untuk menggunakan produk, Anda dapat menerapkan model tersebut secara langsung.

Jika Anda belum berlangganan model ini, pilih Berlangganan, buka AWS Marketplace, tinjau ketentuan harga dan Perjanjian Lisensi Pengguna Akhir (EULA), lalu pilih Terima penawaran.

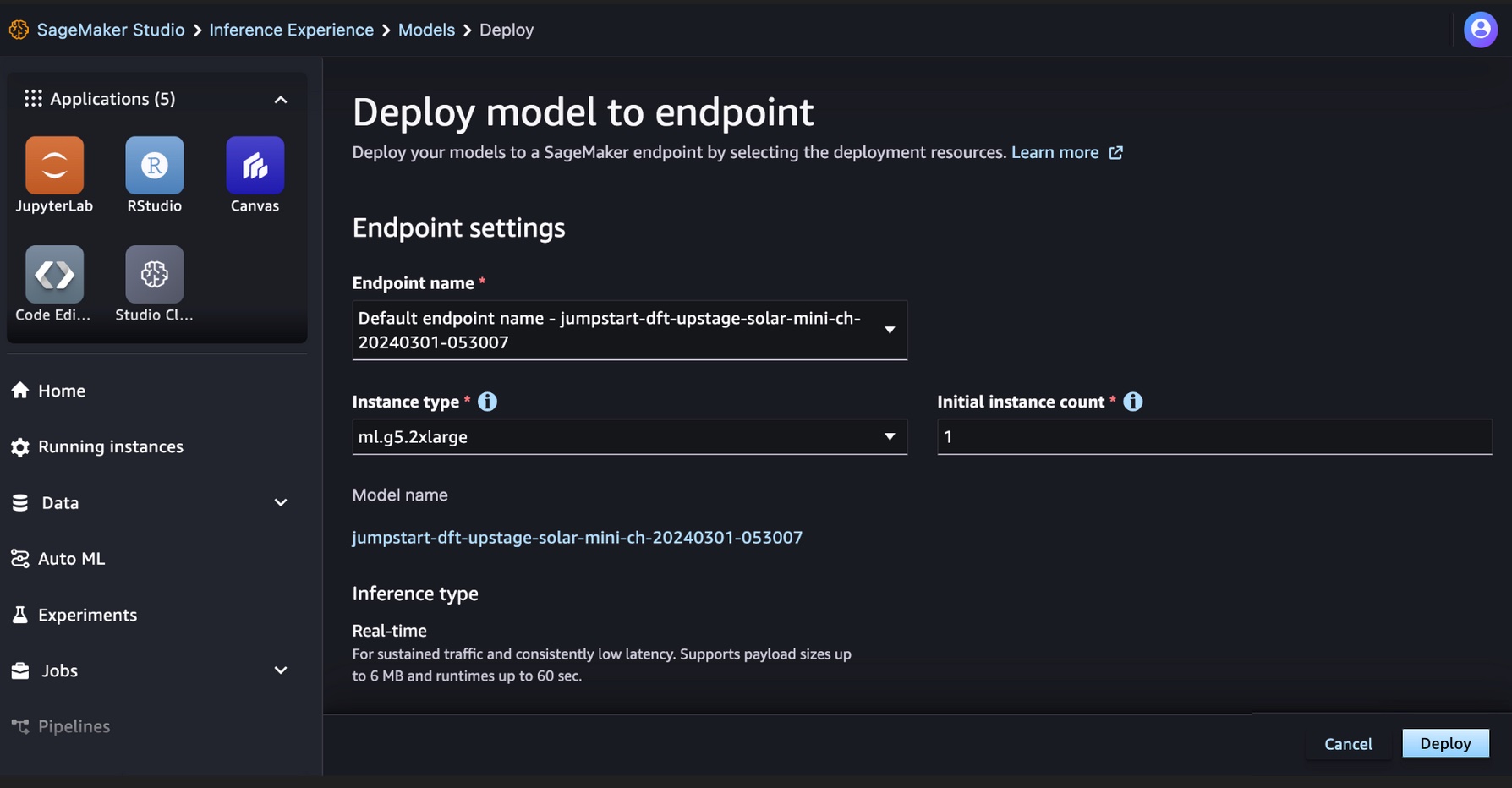

Setelah berlangganan model, Anda dapat menerapkan model Anda ke titik akhir SageMaker dengan memilih sumber daya penerapan, seperti jenis instans dan jumlah instans awal. Memilih Menyebarkan dan tunggu titik akhir dibuat untuk inferensi model. Anda dapat memilih sebuah ml.g5.2xlarge misalnya sebagai pilihan yang lebih murah untuk inferensi dengan model Solar.

Ketika titik akhir SageMaker Anda berhasil dibuat, Anda dapat mengujinya melalui berbagai lingkungan aplikasi SageMaker.

Jalankan kode Anda untuk model Solar di SageMaker Studio JupyterLab

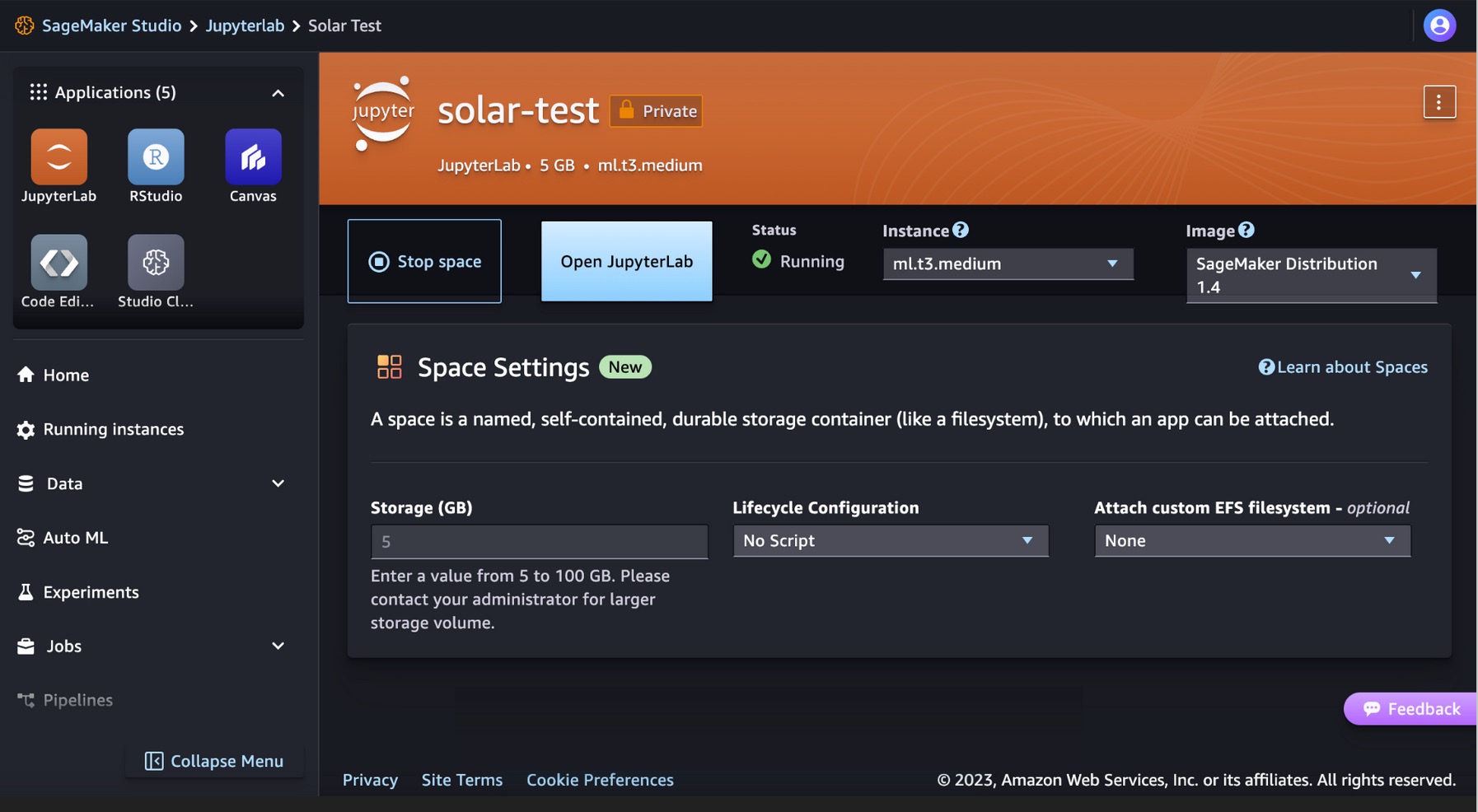

SageMaker Studio mendukung berbagai lingkungan pengembangan aplikasi, termasuk JupyterLab, serangkaian kemampuan yang menambah penawaran notebook yang dikelola sepenuhnya. Ini mencakup kernel yang dimulai dalam hitungan detik, runtime yang telah dikonfigurasi sebelumnya dengan ilmu data populer, kerangka kerja ML, dan penyimpanan blok pribadi berkinerja tinggi. Untuk informasi lebih lanjut, lihat SageMaker JupyterLab.

Buat ruang JupyterLab dalam SageMaker Studio yang mengelola penyimpanan dan sumber daya komputasi yang diperlukan untuk menjalankan aplikasi JupyterLab.

Anda dapat menemukan kode yang menunjukkan penerapan model Solar di SageMaker JumpStart dan contoh cara menggunakan model yang diterapkan di GitHub repo. Anda sekarang dapat menerapkan model menggunakan SageMaker JumpStart. Kode berikut menggunakan instans default ml.g5.2xlarge untuk titik akhir inferensi model Solar Mini Chat – Quant.

Model surya mendukung muatan permintaan/respons yang kompatibel dengan titik akhir penyelesaian Obrolan OpenAI. Anda dapat menguji contoh obrolan satu putaran atau beberapa putaran dengan Python.

# Get a SageMaker endpoint

sagemaker_runtime = boto3.client("sagemaker-runtime")

endpoint_name = sagemaker.utils.name_from_base(model_name)

# Multi-turn chat prompt example

input = {

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "Can you provide a Python script to merge two sorted lists?"

},

{

"role": "assistant",

"content": """Sure, here is a Python script to merge two sorted lists:

```python

def merge_lists(list1, list2):

return sorted(list1 + list2)

```

"""

},

{

"role": "user",

"content": "Can you provide an example of how to use this function?"

}

]

}

# Get response from the model

response = sagemaker_runtime.invoke_endpoint(EndpointName=endpoint_name, ContentType='application/json', Body=json.dumps (input))

result = json.loads(response['Body'].read().decode())

print resultAnda telah berhasil melakukan inferensi waktu nyata dengan model Solar Mini Chat.

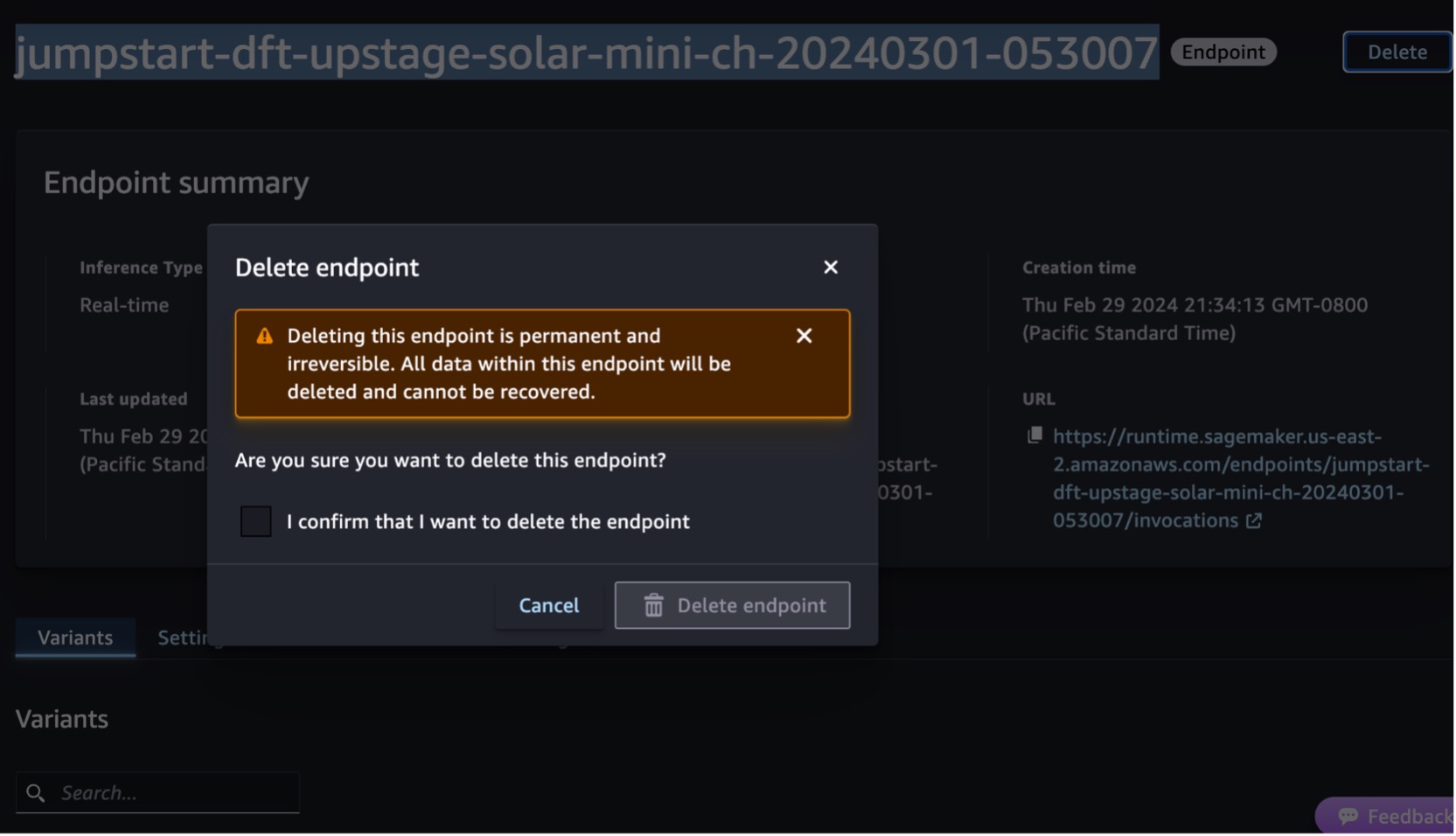

Membersihkan

Setelah Anda menguji titik akhir, hapus titik akhir inferensi SageMaker dan hapus model untuk menghindari dikenakan biaya.

Anda juga dapat menjalankan kode berikut untuk menghapus titik akhir dan mode di notebook SageMaker Studio JupyterLab:

# Delete the endpoint

model.sagemaker_session.delete_endpoint(endpoint_name)

model.sagemaker_session.delete_endpoint_config(endpoint_name)

# Delete the model

model.delete_model()Untuk informasi lebih lanjut, lihat Hapus Titik Akhir dan Sumber Daya. Selain itu, Anda bisa matikan sumber daya SageMaker Studio yang tidak diperlukan lagi.

Kesimpulan

Dalam postingan ini, kami menunjukkan kepada Anda cara memulai model Solar Upstage di SageMaker Studio dan menerapkan model tersebut untuk inferensi. Kami juga menunjukkan kepada Anda bagaimana Anda dapat menjalankan kode sampel Python di SageMaker Studio JupyterLab.

Karena model Solar sudah dilatih sebelumnya, model ini dapat membantu menurunkan biaya pelatihan dan infrastruktur serta memungkinkan penyesuaian untuk aplikasi AI generatif Anda.

Cobalah di Konsol SageMaker JumpStart or Konsol SageMaker Studio! Anda juga dapat menonton video berikut, Coba 'Solar' dengan Amazon SageMaker.

Panduan ini hanya untuk tujuan informasi. Anda tetap harus melakukan penilaian independen, dan mengambil tindakan untuk memastikan bahwa Anda mematuhi praktik dan standar kendali mutu spesifik Anda, serta peraturan, undang-undang, peraturan, lisensi, dan ketentuan penggunaan setempat yang berlaku untuk Anda, konten Anda, dan model pihak ketiga yang dirujuk dalam panduan ini. AWS tidak memiliki kendali atau wewenang atas model pihak ketiga yang dirujuk dalam panduan ini, dan tidak membuat pernyataan atau jaminan apa pun bahwa model pihak ketiga aman, bebas virus, operasional, atau kompatibel dengan lingkungan dan standar produksi Anda. AWS tidak membuat pernyataan, jaminan, atau jaminan apa pun bahwa informasi apa pun dalam panduan ini akan menghasilkan keluaran atau akibat tertentu.

Tentang Penulis

Channy Yun adalah Advokat Pengembang Utama di AWS, dan bersemangat membantu pengembang membangun aplikasi modern pada layanan AWS terbaru. Dia adalah seorang pengembang dan blogger yang pragmatis, dan dia menyukai pembelajaran berbasis komunitas dan berbagi teknologi.

Channy Yun adalah Advokat Pengembang Utama di AWS, dan bersemangat membantu pengembang membangun aplikasi modern pada layanan AWS terbaru. Dia adalah seorang pengembang dan blogger yang pragmatis, dan dia menyukai pembelajaran berbasis komunitas dan berbagi teknologi.

Hwalsuk Lee adalah Chief Technology Officer (CTO) di Upstage. Dia pernah bekerja untuk Samsung Techwin, NCSOFT, dan Naver sebagai Peneliti AI. Ia sedang mengejar gelar PhD di bidang Teknik Komputer dan Listrik di Korea Advanced Institute of Science and Technology (KAIST).

Hwalsuk Lee adalah Chief Technology Officer (CTO) di Upstage. Dia pernah bekerja untuk Samsung Techwin, NCSOFT, dan Naver sebagai Peneliti AI. Ia sedang mengejar gelar PhD di bidang Teknik Komputer dan Listrik di Korea Advanced Institute of Science and Technology (KAIST).

Brandon Lee adalah Arsitek Solusi Senior di AWS, dan terutama membantu pelanggan besar teknologi pendidikan di Sektor Publik. Beliau memiliki pengalaman lebih dari 20 tahun memimpin pengembangan aplikasi di perusahaan global dan perusahaan besar.

Brandon Lee adalah Arsitek Solusi Senior di AWS, dan terutama membantu pelanggan besar teknologi pendidikan di Sektor Publik. Beliau memiliki pengalaman lebih dari 20 tahun memimpin pengembangan aplikasi di perusahaan global dan perusahaan besar.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/solar-models-from-upstage-are-now-available-in-amazon-sagemaker-jumpstart/

- :memiliki

- :adalah

- :bukan

- :Di mana

- 10

- 120

- 152

- 20

- 20 tahun

- 2023

- 7

- 990

- a

- kemampuan

- Tentang Kami

- Setuju

- mengakses

- di seluruh

- tambahan

- Selain itu

- mahir

- maju

- pengacara

- Persetujuan

- AI

- algoritma

- Semua

- memungkinkan

- sepanjang

- sudah

- juga

- Amazon

- Amazon SageMaker

- Mulai Lompatan Amazon SageMaker

- Amazon Web Services

- an

- dan

- dan infrastruktur

- Mengumumkan

- Apa pun

- Aplikasi

- Pengembangan Aplikasi

- aplikasi

- Mendaftar

- disetujui

- arsitektur

- ADALAH

- AS

- penilaian

- Asisten

- At

- menambah

- kewenangan

- tersedia

- menghindari

- AWS

- Pasar AWS

- bar

- berdasarkan

- BE

- menjadi

- Memblokir

- Blog

- tubuh

- Brandon

- membangun

- Bangunan

- built-in

- tapi

- by

- bernama

- CAN

- kemampuan

- kartu

- tertentu

- beban

- mengobrol

- murah

- kepala

- Chief Technology Officer

- Pilih

- lebih jelas

- kode

- Komunikasi

- Didorong oleh Komunitas

- padat

- Perusahaan

- sebanding

- cocok

- penyelesaian

- memenuhi

- Terdiri dari

- menghitung

- komputer

- konsul

- Konten

- terus

- kontrol

- percakapan

- Perusahaan

- Biaya

- menghitung

- membuat

- dibuat

- CTO

- pelanggan

- kustomisasi

- data

- ilmu data

- Desember

- Default

- memberikan

- menunjukkan

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- rincian

- dikembangkan

- Pengembang

- pengembang

- Pengembangan

- langsung

- menemukan

- tidak

- domain

- turun

- edukasi

- efektif

- efisien

- meninggikan

- mempekerjakan

- aktif

- akhir

- Titik akhir

- Teknik

- Inggris

- ditingkatkan

- memastikan

- memastikan

- Enter

- Lingkungan Hidup

- lingkungan

- contoh

- contoh

- gembira

- pengalaman

- luas

- Menghadapi

- lebih cepat

- sedikit

- Angka

- Menemukan

- berikut

- Untuk

- Prinsip Dasar

- kerangka

- dari

- sepenuhnya

- fungsi

- generatif

- AI generatif

- mendapatkan

- Aksi

- Go

- memahami

- jaminan

- bimbingan

- menangani

- Memiliki

- he

- Hati

- membantu

- bermanfaat

- membantu

- membantu

- di sini

- kinerja tinggi

- -nya

- host

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- HTTPS

- Pusat

- if

- menggambarkan

- in

- termasuk

- Termasuk

- independen

- informasi

- Informational

- Infrastruktur

- mulanya

- memasukkan

- input

- contoh

- Lembaga

- terpadu

- interaksi

- interaktif

- ke

- IT

- NYA

- jpg

- json

- Korea

- Korea

- pendaratan

- bahasa

- Bahasa

- besar

- Terbaru

- Hukum

- leaderboard

- terkemuka

- pengetahuan

- Lee

- Lisensi

- lisensi

- daftar

- Llama

- LLM

- lokal

- lagi

- mencintai

- menurunkan

- mesin

- Mesin belajar

- terbuat

- membuat

- Membuat

- berhasil

- mengelola

- pasar

- ukuran

- Bergabung

- pesan

- meta

- metode

- metode

- Metrik

- ML

- mode

- model

- model

- modern

- lebih

- lebih efisien

- banyak

- Alam

- Pengolahan Bahasa alami

- Naver

- Navigasi

- dibutuhkan

- tidak

- terutama

- buku catatan

- sekarang

- nuansa

- of

- menawarkan

- menawarkan

- Petugas

- on

- hanya

- Buka

- operasional

- dioptimalkan

- pilihan

- or

- Lainnya

- di luar

- Hasil

- Mengungguli

- lebih

- sendiri

- halaman

- pane

- parameter

- tertentu

- khususnya

- bergairah

- Melakukan

- prestasi

- dilakukan

- phd

- foto

- puncak

- plato

- Kecerdasan Data Plato

- Data Plato

- Populer

- Pos

- kuat

- praktek

- pragmatis

- perlu

- mempersiapkan

- di harga

- terutama

- Utama

- Mencetak

- swasta

- Masalah

- pengolahan

- Produk

- Produksi

- memberikan

- menyediakan

- publik

- tujuan

- Ular sanca

- kualitas

- Bergalah

- segera

- jarak

- mencapai

- nyata

- real-time

- arsip

- direferensikan

- peraturan

- wajib

- membutuhkan

- peneliti

- Resolusi

- Sumber

- tanggapan

- tanggapan

- mengakibatkan

- kembali

- ulasan

- Peran

- aturan

- Run

- runtime

- pembuat bijak

- Inferensi SageMaker

- mencicipi

- Samsung

- skala

- Ilmu

- Sains dan Teknologi

- naskah

- Pencarian

- detik

- sektor

- aman

- melihat

- memilih

- memilih

- senior

- layanan

- Layanan

- set

- berbagi

- harus

- menunjukkan

- menunjukkan

- signifikan

- Ukuran

- lebih kecil

- tenaga surya

- Solusi

- beberapa

- Space

- mengkhususkan

- tertentu

- Secara khusus

- standar

- awal

- mulai

- Tangga

- Masih

- penyimpanan

- mudah

- struktur

- studio

- berlangganan

- berlangganan

- berhasil

- seperti itu

- mendukung

- Mendukung

- yakin

- sistem

- Mengambil

- Dibutuhkan

- tugas

- Teknologi

- istilah

- uji

- diuji

- dari

- bahwa

- Grafik

- Ini

- mereka

- pihak ketiga

- ini

- Melalui

- waktu

- kali

- untuk

- alat

- jalur

- Pelatihan VE

- Pelatihan

- dua

- mengetik

- menggunakan

- bekas

- Pengguna

- kegunaan

- menggunakan

- berbagai

- serba guna

- versi

- melalui

- Video

- View

- menunggu

- berjalan

- jaminan

- Menonton

- ombak

- we

- jaringan

- layanan web

- berbasis web

- yang

- lebar

- Rentang luas

- akan

- dengan

- dalam

- bekerja

- tahun

- Kamu

- Anda

- Youtube

- zephyrnet.dll