Anima Anandkumar, Bren Professore di informatica al California Institute of Technology e direttore senior della ricerca sull'apprendimento automatico presso Nvidia, ha un osso da scegliere con la matrice. I suoi dubbi non riguardano i film di fantascienza, ma le matrici matematiche: griglie di numeri o variabili utilizzate nell'informatica. Sebbene i ricercatori utilizzino in genere le matrici per studiare le relazioni e gli schemi che si nascondono all'interno di grandi insiemi di dati, questi strumenti sono più adatti per le relazioni bidirezionali. Processi complicati come le dinamiche sociali, d'altra parte, coinvolgono interazioni di ordine superiore.

Fortunatamente, Anandkumar ha assaporato a lungo tali sfide. Quando ricorda Ugadi, una festa di capodanno che celebrava da bambina a Mysore (ora Mysuru), in India, spiccano due sapori: il jaggery, uno zucchero grezzo che rappresenta la dolcezza della vita, e il neem, fiori amari che rappresentano le battute d'arresto e le difficoltà della vita. "È una delle cose più amare a cui puoi pensare", ha detto.

Di solito caricava il neem, disse. "Voglio sfide".

Questo appetito per lo sforzo la spinse a studiare ingegneria elettrica presso l'Indian Institute of Technology di Madras. Ha conseguito il dottorato presso la Cornell University ed è stata post-dottorato presso il Massachusetts Institute of Technology. Ha quindi avviato il suo gruppo come assistente professore presso l'Università della California, a Irvine, concentrandosi sull'apprendimento automatico, un sottoinsieme dell'intelligenza artificiale in cui un computer può acquisire conoscenze senza una programmazione esplicita. A Irvine, Anandkumar si è tuffato nel mondo della "modellazione di argomenti", un tipo di apprendimento automatico in cui un computer cerca di raccogliere argomenti importanti dai dati; un esempio potrebbe essere un algoritmo su Twitter che identifica le tendenze nascoste. Ma la connessione tra le parole è una di quelle interazioni di ordine superiore troppo sottili per le relazioni tra matrici: le parole possono avere più significati, più parole possono riferirsi allo stesso argomento e il linguaggio si evolve così rapidamente che nulla rimane stabile a lungo.

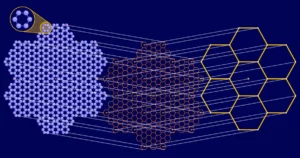

Ciò ha portato Anandkumar a sfidare la dipendenza dell'IA dai metodi a matrice. Ha dedotto che per mantenere un algoritmo sufficientemente attento da imparare in mezzo a un tale caos, i ricercatori devono progettarlo per afferrare l'algebra di dimensioni superiori. Quindi si rivolse a quello che era stato a lungo uno strumento sottoutilizzato in algebra chiamato tensore. I tensori sono come le matrici, ma possono estendersi a qualsiasi dimensione, andando oltre le due dimensioni di righe e colonne di una matrice. Di conseguenza, i tensori sono strumenti più generali, rendendoli meno suscettibili all'"overfitting", quando i modelli corrispondono strettamente ai dati di addestramento ma non possono ospitare nuovi dati. Ad esempio, se ti piacciono molti generi musicali ma riproduci in streaming solo brani jazz, l'IA della tua piattaforma di streaming potrebbe imparare a prevedere quali brani jazz ti piacerebbero, ma le sue previsioni R&B sarebbero infondate. Anandkumar crede che i tensori rendano l'apprendimento automatico più adattabile.

Non è l'unica sfida che ha accettato. Anandkumar è un mentore e un sostenitore dei cambiamenti ai sistemi che spingono i gruppi emarginati fuori dal campo. Nel 2018, ha organizzato una petizione per cambiare il nome della conferenza annuale sui sistemi di elaborazione delle informazioni neurali del suo campo da un acronimo diretto a "NeurIPS". Il consiglio della conferenza ha respinto la petizione in ottobre. Ma Anandkumar e i suoi coetanei si rifiutarono di arrendersi e settimane dopo il consiglio invertì la rotta.

Quanta ha parlato con Anandkumar nel suo ufficio di Pasadena della sua educazione, dei suoi tensori e delle sfide etiche che l'IA deve affrontare. L'intervista è stata condensata e modificata per chiarezza.

In che modo i tuoi genitori hanno influenzato la tua percezione delle macchine?

All'inizio degli anni '1990 furono tra i primi a portare a Mysore macchine di produzione programmabili. A quel tempo era visto come qualcosa di strano: "Possiamo assumere operatori umani per fare questo, quindi qual è il bisogno di automazione?" I miei genitori hanno visto che ci possono essere enormi efficienze e possono farlo molto più velocemente rispetto alle macchine azionate dall'uomo.

È stata la tua introduzione all'automazione?

Sì. E la programmazione. Vedrei lo schermo verde dove mio padre scriveva il programma, e questo sposterebbe la torretta e gli strumenti. È stato davvero affascinante da vedere: capire la geometria, capire come dovrebbe muoversi lo strumento. Vedi il lato ingegneristico di come una macchina così massiccia può farlo.

Qual è stata l'esperienza di tua madre in ingegneria?

Mia madre è stata una pioniera in un certo senso. È stata una delle prime nella sua comunità e background familiare a dedicarsi all'ingegneria. Molti altri parenti consigliarono a mio nonno di non mandarla, dicendo che potrebbe non sposarsi facilmente. Mio nonno esitò. Fu allora che mia madre fece lo sciopero della fame per tre giorni.

Di conseguenza, non ho mai visto come qualcosa di strano per le donne interessarsi all'ingegneria. Mia madre ci ha inculcato presto quell'apprezzamento per la matematica e le scienze. Avere che è solo una parte naturale di ciò che sono dalla prima infanzia ha fatto molta strada. Se mia madre avesse mai visto il sessismo, lo farebbe notare e direbbe: "No, non accettarlo". Questo ha davvero aiutato.

Qualcos'altro ti ha entusiasmato per la matematica e la scienza?

Prima del liceo tutta la matematica che viene insegnata è deterministica. Addizioni, moltiplicazioni, tutto ciò che fai: c'è una risposta. Al liceo, ho iniziato a imparare la probabilità e che possiamo ragionare sulle cose con casualità. Per me ha più senso, perché c'è molto di più nella natura. C'è casualità e persino caos.

C'è così tanto nelle nostre vite che non possiamo prevedere. Ma non dobbiamo “adattarci” alle esperienze precedenti che non ci permetteranno di adattarci alle nuove condizioni della nostra vita. Mi sono reso conto che con l'IA dovresti avere flessibilità per generalizzare a cose nuove, apprendere nuove abilità.

Ed è per questo che hai iniziato a mettere in discussione le operazioni sulle matrici nell'apprendimento automatico?

In pratica, i metodi a matrice nell'apprendimento automatico non possono acquisire efficacemente relazioni di ordine superiore. In sostanza, non puoi imparare affatto. Quindi ci siamo chiesti: e se considerassimo [operazioni] di ordine superiore? Questo ci ha portato all'algebra tensoriale.

Con le loro molteplici dimensioni e flessibilità, i tensori sembrano una soluzione naturale per problemi di ordine superiore nell'IA. Perché nessuno li aveva usati prima?

Ero sicuro che la gente ci avrebbe pensato. Dopo aver escogitato un metodo, siamo tornati a fare una ricerca nella letteratura e vedere. In effetti, nel 1927 c'era un documento di psicometria che suggeriva che per analizzare diverse forme di intelligenza, dovresti fare queste operazioni sui tensori. Quindi le persone hanno proposto queste idee per un po'.

Ma i calcoli del tempo non potevano gestire queste [operazioni] di ordine superiore, il che significa generalmente correlazioni tra almeno tre parti. Inoltre non avevamo abbastanza dati. Il tempismo era importante. Avere l'hardware più recente, più dati, ci aiuterà ora a passare a metodi di ordine superiore.

Se riesci a rendere l'IA più flessibile, cosa succede allora?

Ripensare le basi dell'IA stessa.

Ad esempio, in molti domini scientifici non posso forzare i miei dati a trovarsi su una griglia fissa. I solutori numerici sono flessibili: se utilizzi un solutore tradizionale, puoi trovare facilmente una soluzione in qualsiasi punto dello spazio. Ma i modelli di machine learning standard non sono costruiti in questo modo. ImageNet [un database utilizzato per addestrare l'IA a riconoscere le immagini] ha una dimensione dell'immagine fissa, o risoluzione. Addestrerai una rete su quella risoluzione, quindi la testerai con la stessa risoluzione. Se ora usi questa rete ma modifichi la risoluzione, fallisce completamente. Non è utile nelle applicazioni reali. Gli scienziati vogliono flessibilità.

Abbiamo sviluppato operatori neurali che non hanno questo difetto. Ciò ha portato a significativi incrementi di velocità pur mantenendo la precisione. Ad esempio, possiamo prevedere con precisione la dinamica dei fluidi in tempo reale e prevediamo di implementarla su droni in grado di volare in condizioni di vento forte in un impianto di test del vento con droni a Caltech.

Da studente, hai fatto uno stage presso IBM e ora, oltre al tuo lavoro in Caltech, lavori con Nvidia. Perché mischia teoria accademica e applicazione industriale?

I miei genitori sono imprenditori. Ma il mio trisnonno da parte di mio padre è stato lo studioso che ha riscoperto questo antico testo chiamato Arthashastra. Quello fu il primo libro conosciuto di economia, del 300 a.C. Quindi crescendo, mi sono sempre chiesto: come faccio a cavalcare questi due mondi?

Penso che questo sia il luogo in cui questa era attuale è così grande. Stiamo riscontrando molta apertura nel modo in cui aziende come Nvidia stanno investendo nella ricerca aperta.

Hai detto di volere una sorta di giuramento di Ippocrate per la ricerca sull'IA. Come mai?

È sempre importante chiedersi come il nostro lavoro avrà un impatto sul mondo. Può essere difficile, soprattutto in una grande azienda, perché stai costruendo una parte di questo enorme sistema. Ma gran parte del modo in cui insegniamo nelle università deriva dalla scuola militare. L'ingegneria è nata da quel background e parte di essa indugia. Come pensare che scienziati e ingegneri dovrebbero concentrarsi sulle cose tecniche e lasciare che gli altri si occupino del resto. È sbagliato. Abbiamo tutti bisogno di un pensiero umano.

In che modo gli algoritmi rigidi di oggi contribuiscono a questi problemi etici?

Gli esseri umani sono stati condizionati a pensare che ci si possa fidare delle macchine. Prima, se chiedessi a una macchina di moltiplicarsi, sarebbe sempre corretto. Mentre gli esseri umani possono sbagliare, così come i nostri dati. Ora, quando i dati di addestramento di un'IA sono razzisti, ci adattiamo alle ipotesi dei dati di addestramento. Possiamo avere non solo risposte sbagliate, ma risposte sbagliate con grande sicurezza. Questo è pericoloso.

Allora come si va avanti?

In termini di costruzione di algoritmi migliori, dobbiamo almeno chiederci: possiamo dare il giusto livello di confidenza? Se un altro essere umano dice: "Forse sono sicuro al 60% che questa sia la risposta giusta", allora lo prendi in considerazione.

Quindi, se guardo fuori dalla mia finestra e vedo un animale simile a un gatto delle dimensioni di un edificio, posso pensare: "Sì, sembra un gatto, ma non sono ancora sicuro di cosa sia effettivamente".

Esattamente. Perché è allora che questi modelli hanno il problema dell'eccessiva sicurezza. Nella formazione standard, li stai incentivando a essere molto sicuri.

Hai fatto da mentore per Programma WAVE Fellows di Caltech, che porta gli studenti provenienti da ambienti sottorappresentati a fare ricerca. Quale pensi sia il ruolo del tutoraggio nell'IA?

Una delle donne anziane sul campo una volta si è lamentata con me che le donne sentono che siamo come isole. Siamo così disconnessi. Non sappiamo cosa sta succedendo agli altri. Non sappiamo di scale salariali, o altro. È questa sensazione di disconnessione — che non fai parte del sistema. Non ti senti di appartenere a qui. Penso che sia così importante da risolvere mostrando che c'è più di semplici gruppi di affinità, come WIML ed Nero in AI. C'è un insieme più ampio di mentori e persone che sono impegnate in questi sforzi.

È correlato alla tua esperienza con il cambio di nome NeurIPS? Perché quella battaglia è stata così importante per te?

Per molte persone, era come "Oh, uno sciocco cambio di nome". Ma ha portato tossicità. Non mi aspettavo che ci sarebbero stati lunghi thread su Reddit che prendevano in giro noi e il nostro aspetto, e tutti i tipi di minacce, tutti i tipi di tentativi di dox persone. Tanto di questo era sotterraneo. E ha esposto le persone a ciò che le donne avrebbero affrontato in queste conferenze.

In definitiva, direi che ha unito la comunità. Ha portato l'insieme moderato di persone inconsapevoli nell'ovile. E questo ha davvero contribuito a migliorare la nostra diversità e inclusione.

Anche se sei abituato a sfidare le persone, immagino sia stato comunque difficile parlare.

È stato davvero difficile. Sono una persona riservata, ma quando ho iniziato a parlare sui social media, anche solo pubblicando il lavoro che stavamo facendo o qualcosa di molto benigno, i commenti non erano filtrati. C'era tutta questa natura del “Evitiamo di parlare di cose negative. Seppelliamolo”. Ma sono della mentalità che dobbiamo portare questo allo scoperto e dobbiamo ritenerci responsabili.

Che le persone hanno bisogno di mangiare il loro neem?

Esatto, esatto. Devi accettare l'amara verità.