Questo è un guest post scritto in collaborazione con Tamir Rubinsky e Aviad Aranias di Nielsen Sports.

Nielsen Sport modella i media e i contenuti di tutto il mondo in qualità di leader globale nelle informazioni, nei dati e nell'analisi del pubblico. Attraverso la nostra comprensione delle persone e dei loro comportamenti su tutti i canali e le piattaforme, diamo ai nostri clienti un'intelligenza indipendente e utilizzabile in modo che possano connettersi e interagire con il loro pubblico, ora e in futuro.

In Nielsen Sports, la nostra missione è fornire ai nostri clienti, marchi e titolari dei diritti, la possibilità di misurare il ritorno sull'investimento (ROI) e l'efficacia di una campagna pubblicitaria di sponsorizzazione sportiva su tutti i canali, inclusi TV, online, social media e anche i giornali e per fornire un targeting accurato a livello locale, nazionale e internazionale.

In questo post descriviamo come Nielsen Sports ha modernizzato un sistema che esegue migliaia di diversi modelli di machine learning (ML) in produzione utilizzando Amazon Sage Maker endpoint multi-modello (MME) e costi operativi e finanziari ridotti del 75%.

Sfide con la segmentazione dei video dei canali

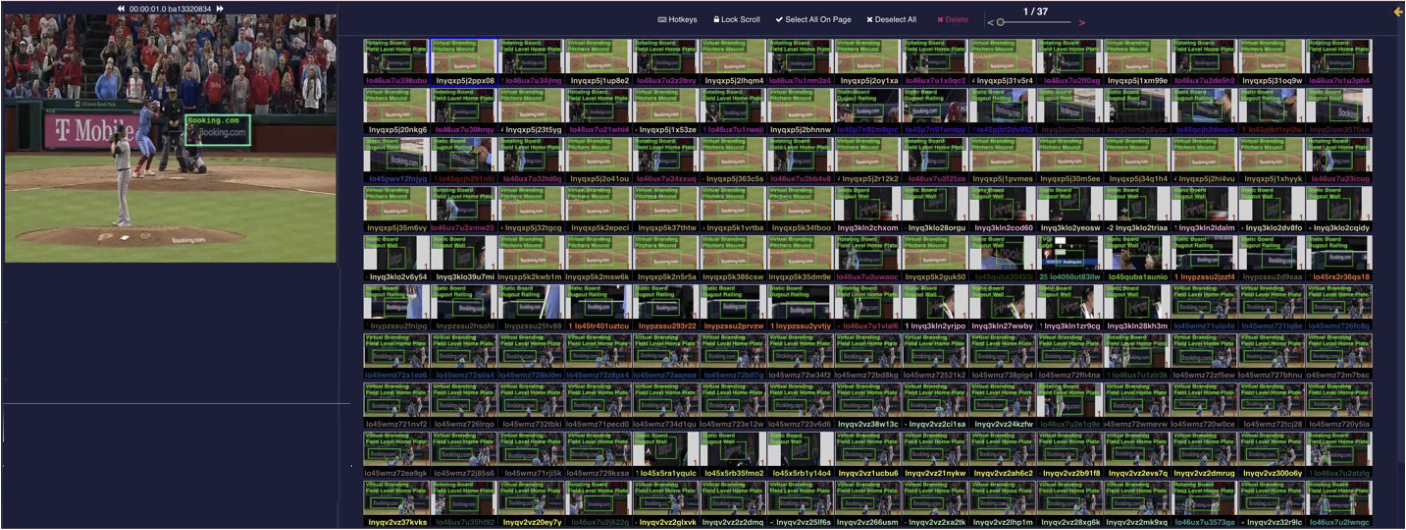

La nostra tecnologia si basa sull'intelligenza artificiale (AI) e in particolare sulla visione artificiale (CV), che ci consente di monitorare l'esposizione del marchio e identificarne accuratamente la posizione. Ad esempio, identifichiamo se il marchio è su uno striscione o su una maglietta. Inoltre, identifichiamo la posizione del marchio sull'articolo, come l'angolo superiore di un'insegna o la manica. La figura seguente mostra un esempio del nostro sistema di tagging.

Per comprendere le nostre sfide in termini di scalabilità e costi, diamo un'occhiata ad alcuni numeri rappresentativi. Ogni mese identifichiamo oltre 120 milioni di impressioni del marchio su diversi canali e il sistema deve supportare l'identificazione di oltre 100,000 marchi e varianti di marchi diversi. Abbiamo creato uno dei più grandi database di impressioni di marca al mondo con oltre 6 miliardi di punti dati.

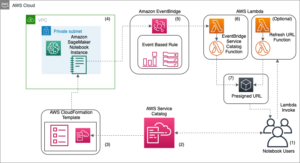

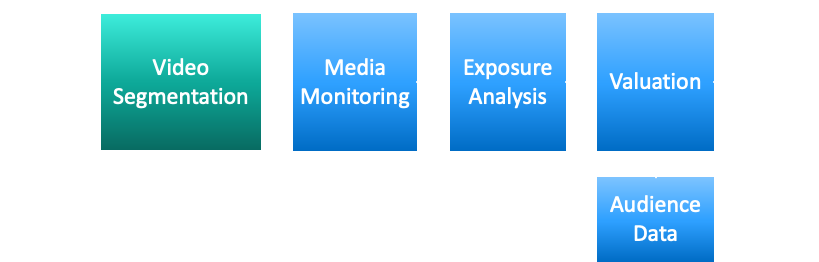

Il nostro processo di valutazione dei media comprende diverse fasi, come illustrato nella figura seguente:

- Innanzitutto, registriamo migliaia di canali in tutto il mondo utilizzando un sistema di registrazione internazionale.

- Trasmettiamo in streaming i contenuti in combinazione con il palinsesto di trasmissione (Guida elettronica alla programmazione) fino alla fase successiva, ovvero la segmentazione e la separazione tra le trasmissioni dei giochi stesse e altri contenuti o pubblicità.

- Eseguiamo il monitoraggio dei media, aggiungendo ulteriori metadati a ciascun segmento, come punteggi di campionato, squadre pertinenti e giocatori.

- Eseguiamo un'analisi dell'esposizione della visibilità dei marchi e quindi combiniamo le informazioni sul pubblico per calcolare la valutazione della campagna.

- Le informazioni vengono fornite al cliente tramite una dashboard o report degli analisti. L'analista ha accesso diretto ai dati grezzi o tramite il nostro data warehouse.

Poiché operiamo su una scala di oltre mille canali e decine di migliaia di ore di video all'anno, dobbiamo disporre di un sistema di automazione scalabile per il processo di analisi. La nostra soluzione segmenta automaticamente la trasmissione e sa come isolare i videoclip rilevanti dal resto del contenuto.

Lo facciamo utilizzando algoritmi e modelli dedicati da noi sviluppati per analizzare le caratteristiche specifiche dei canali.

In totale, stiamo eseguendo migliaia di modelli diversi in produzione per supportare questa missione, che è costosa, comporta costi operativi generali ed è soggetta a errori e lenta. Ci sono voluti mesi per mettere in produzione i modelli con la nuova architettura.

È qui che volevamo innovare e riprogettare il nostro sistema.

Scalabilità conveniente per i modelli CV utilizzando gli MME SageMaker

Il nostro vecchio sistema di segmentazione video era difficile da testare, modificare e mantenere. Alcune delle sfide includono lavorare con un vecchio framework ML, interdipendenze tra i componenti e un flusso di lavoro difficile da ottimizzare. Questo perché ci basavamo su RabbitMQ per la pipeline, che era una soluzione con stato. Per eseguire il debug di un componente, ad esempio l'estrazione delle funzionalità, abbiamo dovuto testare tutta la pipeline.

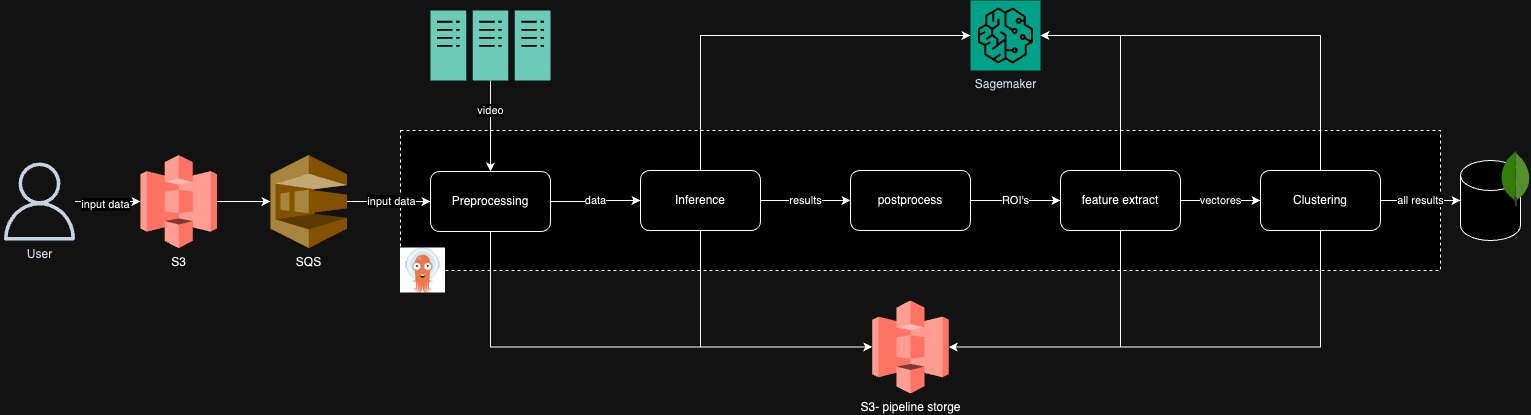

Il diagramma seguente illustra l'architettura precedente.

Nell'ambito della nostra analisi, abbiamo identificato colli di bottiglia prestazionali, come l'esecuzione di un singolo modello su una macchina, che mostrava un basso utilizzo della GPU pari al 30-40%. Abbiamo anche scoperto esecuzioni di pipeline e algoritmi di pianificazione inefficienti per i modelli.

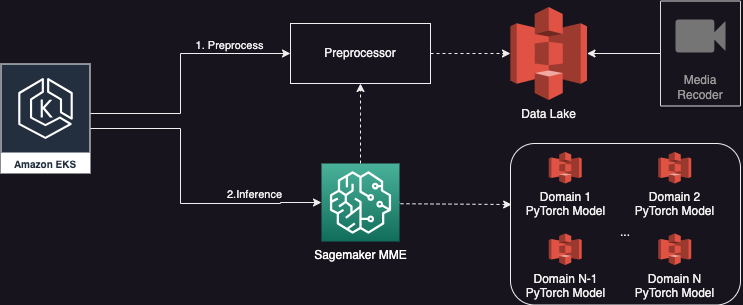

Pertanto, abbiamo deciso di creare una nuova architettura multi-tenant basata su SageMaker, che implementerebbe miglioramenti di ottimizzazione delle prestazioni, supporterebbe dimensioni batch dinamiche ed eseguirebbe più modelli contemporaneamente.

Ogni esecuzione del flusso di lavoro è destinata a un gruppo di video. Ogni video dura dai 30 ai 90 minuti e ogni gruppo ha più di cinque modelli da eseguire.

Esaminiamo un esempio: un video può durare 60 minuti, composto da 3,600 immagini e ciascuna immagine deve essere dedotta da tre diversi modelli ML durante la prima fase. Con gli MME SageMaker, possiamo eseguire batch di 12 immagini in parallelo e il batch completo viene completato in meno di 2 secondi. In una giornata normale abbiamo più di 20 gruppi di video e in una giornata intensa di fine settimana possiamo avere più di 100 gruppi di video.

Il diagramma seguente mostra la nostra nuova architettura semplificata utilizzando un MME SageMaker.

Risultati

Con la nuova architettura abbiamo ottenuto molti dei risultati desiderati e alcuni vantaggi invisibili rispetto alla vecchia architettura:

- Migliore autonomia – Aumentando le dimensioni dei batch (12 video in parallelo) ed eseguendo più modelli contemporaneamente (cinque modelli in parallelo), abbiamo ridotto il tempo di esecuzione complessivo della pipeline del 33%, da 1 ora a 40 minuti.

- Infrastruttura migliorata – Con SageMaker, abbiamo aggiornato la nostra infrastruttura esistente e ora utilizziamo istanze AWS più recenti con GPU più recenti come g5.xlarge. Uno dei maggiori vantaggi derivanti dal cambiamento è l'immediato miglioramento delle prestazioni derivante dall'utilizzo delle ottimizzazioni TorchScript e CUDA.

- Utilizzo ottimizzato dell'infrastruttura – Avendo un singolo endpoint che può ospitare più modelli, possiamo ridurre sia il numero di endpoint che il numero di macchine che dobbiamo mantenere e anche aumentare l'utilizzo di una singola macchina e della sua GPU. Per un'attività specifica con cinque video, ora utilizziamo solo cinque macchine con istanze g5, il che ci offre un vantaggio in termini di costi del 75% rispetto alla soluzione precedente. Per un carico di lavoro tipico durante il giorno, utilizziamo un singolo endpoint con una singola macchina g5.xlarge con un utilizzo della GPU superiore all'80%. Per fare un confronto, la soluzione precedente aveva un utilizzo inferiore al 40%.

- Maggiore agilità e produttività – L'utilizzo di SageMaker ci ha permesso di dedicare meno tempo alla migrazione dei modelli e più tempo al miglioramento dei nostri algoritmi e modelli principali. Ciò ha aumentato la produttività dei nostri team di ingegneria e scienza dei dati. Ora possiamo ricercare e implementare un nuovo modello ML in meno di 7 giorni, invece di oltre 1 mese in precedenza. Si tratta di un miglioramento del 75% in termini di velocità e pianificazione.

- Migliore qualità e fiducia – Con le funzionalità di test A/B di SageMaker, possiamo distribuire i nostri modelli in modo graduale ed essere in grado di eseguire il rollback in sicurezza. Il ciclo di vita più rapido verso la produzione ha inoltre aumentato la precisione e i risultati dei nostri modelli ML.

La figura seguente mostra l'utilizzo della GPU con l'architettura precedente (30-40% di utilizzo della GPU).

La figura seguente mostra il nostro utilizzo della GPU con la nuova architettura semplificata (90% di utilizzo della GPU).

Conclusione

In questo post, abbiamo condiviso come Nielsen Sports ha modernizzato un sistema che esegue migliaia di modelli diversi in produzione utilizzando gli MME SageMaker e ne ha ridotto i costi operativi e finanziari del 75%.

Per ulteriori letture, fare riferimento a quanto segue:

Informazioni sugli autori

Eitan Sela è un architetto di soluzioni specializzato in intelligenza artificiale generativa e machine learning presso Amazon Web Services. Collabora con i clienti AWS per fornire guida e assistenza tecnica, aiutandoli a creare e utilizzare soluzioni di intelligenza artificiale generativa e machine learning su AWS. Nel tempo libero, Eitan ama fare jogging e leggere gli ultimi articoli sul machine learning.

Eitan Sela è un architetto di soluzioni specializzato in intelligenza artificiale generativa e machine learning presso Amazon Web Services. Collabora con i clienti AWS per fornire guida e assistenza tecnica, aiutandoli a creare e utilizzare soluzioni di intelligenza artificiale generativa e machine learning su AWS. Nel tempo libero, Eitan ama fare jogging e leggere gli ultimi articoli sul machine learning.

Gal Goldman è un Senior Software Engineer e un Enterprise Senior Solution Architect in AWS con una passione per le soluzioni all'avanguardia. È specializzato e ha sviluppato numerosi servizi e soluzioni di machine learning distribuiti. Gal si concentra inoltre sull'aiutare i clienti AWS ad accelerare e superare le sfide di ingegneria e intelligenza artificiale generativa.

Gal Goldman è un Senior Software Engineer e un Enterprise Senior Solution Architect in AWS con una passione per le soluzioni all'avanguardia. È specializzato e ha sviluppato numerosi servizi e soluzioni di machine learning distribuiti. Gal si concentra inoltre sull'aiutare i clienti AWS ad accelerare e superare le sfide di ingegneria e intelligenza artificiale generativa.

Tal Panchek è un Senior Business Development Manager per l'intelligenza artificiale e l'apprendimento automatico con Amazon Web Services. In qualità di specialista BD, è responsabile della crescita dell'adozione, dell'utilizzo e dei ricavi per i servizi AWS. Raccoglie le esigenze dei clienti e del settore e collabora con i team di prodotto AWS per innovare, sviluppare e fornire soluzioni AWS.

Tal Panchek è un Senior Business Development Manager per l'intelligenza artificiale e l'apprendimento automatico con Amazon Web Services. In qualità di specialista BD, è responsabile della crescita dell'adozione, dell'utilizzo e dei ricavi per i servizi AWS. Raccoglie le esigenze dei clienti e del settore e collabora con i team di prodotto AWS per innovare, sviluppare e fornire soluzioni AWS.

Tamir Rubinskij è a capo dell'ingegneria globale di ricerca e sviluppo presso Nielsen Sports, apportando una vasta esperienza nella creazione di prodotti innovativi e nella gestione di team ad alte prestazioni. Il suo lavoro ha trasformato la valutazione dei media delle sponsorizzazioni sportive attraverso soluzioni innovative basate sull'intelligenza artificiale.

Tamir Rubinskij è a capo dell'ingegneria globale di ricerca e sviluppo presso Nielsen Sports, apportando una vasta esperienza nella creazione di prodotti innovativi e nella gestione di team ad alte prestazioni. Il suo lavoro ha trasformato la valutazione dei media delle sponsorizzazioni sportive attraverso soluzioni innovative basate sull'intelligenza artificiale.

Aviad Aranias è un team leader di MLOps e Nielsen Sports Analysis Architect specializzato nella creazione di pipeline complesse per l'analisi di video di eventi sportivi su numerosi canali. Eccelle nella creazione e nell'implementazione di modelli di deep learning per gestire in modo efficiente dati su larga scala. Nel tempo libero si diverte a preparare deliziose pizze napoletane.

Aviad Aranias è un team leader di MLOps e Nielsen Sports Analysis Architect specializzato nella creazione di pipeline complesse per l'analisi di video di eventi sportivi su numerosi canali. Eccelle nella creazione e nell'implementazione di modelli di deep learning per gestire in modo efficiente dati su larga scala. Nel tempo libero si diverte a preparare deliziose pizze napoletane.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/nielsen-sports-sees-75-cost-reduction-in-video-analysis-with-amazon-sagemaker-multi-model-endpoints/

- :ha

- :È

- :Dove

- 000

- 1

- 100

- 12

- 120

- 150

- 20

- 40

- 60

- 600

- 7

- a

- capacità

- capace

- accelerare

- accesso

- precisione

- preciso

- con precisione

- raggiunto

- operanti in

- processabile

- aggiungere

- aggiunta

- aggiuntivo

- Adozione

- vantaggi

- Pubblicità

- AI

- AI-alimentato

- Algoritmi

- Tutti

- permesso

- consente

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- .

- analista

- analitica

- l'analisi

- ed

- architettura

- SONO

- in giro

- news

- artificiale

- intelligenza artificiale

- Intelligenza artificiale (AI)

- Intelligenza artificiale e apprendimento automatico

- AS

- Assistenza

- At

- pubblico

- automaticamente

- Automazione

- AWS

- precedente

- bandiera

- basato

- BD

- BE

- perché

- comportamenti

- beneficio

- vantaggi

- fra

- Maggiore

- Miliardo

- entrambi

- strozzature

- marca

- marche

- Portare

- BROADCAST

- trasmissioni

- costruire

- Costruzione

- costruito

- affari

- sviluppo commerciale

- by

- calcolare

- Campagna

- Materiale

- funzionalità

- sfide

- il cambiamento

- canale

- canali

- caratteristiche

- clienti

- clip

- combinazione

- combinare

- confronto

- Completa

- complesso

- componente

- componenti

- computer

- Visione computerizzata

- fiducia

- Connettiti

- Consistente

- contenuto

- Nucleo

- Angolo

- Costo

- riduzione dei costi

- costoso

- lavorazione

- cliente

- Clienti

- bordo tagliente

- cruscotto

- dati

- punti dati

- scienza dei dati

- banche dati

- giorno

- Giorni

- deciso

- diminuita

- dedicato

- deep

- apprendimento profondo

- consegnare

- consegnato

- schierare

- distribuzione

- descrivere

- desiderato

- sviluppare

- sviluppato

- Mercato

- diagramma

- diverso

- difficile

- dirette

- Accesso diretto

- scoperto

- distribuito

- do

- durante

- dinamico

- ogni

- efficacia

- in modo efficiente

- Elettronico

- e potenza

- endpoint

- impegnarsi

- ingegnere

- Ingegneria

- Impresa

- valutazione

- Anche

- Evento

- Ogni

- esaminare

- esempio

- esistente

- esperienza

- Esposizione

- estrazione

- più veloce

- caratteristica

- figura

- finanziario

- Nome

- cinque

- si concentra

- i seguenti

- Nel

- Contesto

- da

- pieno

- ulteriormente

- futuro

- GAL

- gioco

- generativo

- AI generativa

- ottenere

- dato

- dà

- globali

- goldman

- GPU

- GPU

- graduale

- Gruppo

- Gruppo

- Crescita

- GUEST

- Ospite Messaggio

- guida

- guida

- ha avuto

- maniglia

- Avere

- avendo

- he

- aiutare

- ad alte prestazioni

- il suo

- host

- ora

- ORE

- Come

- Tutorial

- HTTPS

- Identificazione

- identificato

- identificare

- if

- illustra

- Immagine

- immagini

- immediato

- realizzare

- miglioramento

- miglioramenti

- miglioramento

- in

- includere

- inclusi

- Compreso

- Aumento

- è aumentato

- crescente

- studente indipendente

- industria

- inefficiente

- inferito

- informazioni

- Infrastruttura

- innovare

- creativi e originali

- intuizioni

- invece

- Intelligence

- Internazionale

- ai miglioramenti

- investimento

- IT

- SUO

- jpg

- conosce

- larga scala

- maggiore

- con i più recenti

- leader

- Leads

- Campionati

- apprendimento

- Eredità

- meno

- livelli

- ciclo di vita

- locale

- località

- Lunghi

- Guarda

- Basso

- macchina

- machine learning

- macchine

- mantenere

- direttore

- gestione

- molti

- misurare

- Media

- Metadati

- la migrazione

- milione

- Minuti

- Missione

- ML

- MLOp

- modello

- modelli

- monitoraggio

- Mese

- mese

- Scopri di più

- multiplo

- devono obbligatoriamente:

- il

- Bisogno

- esigenze

- New

- più nuovo

- Quotidiani

- GENERAZIONE

- adesso

- numero

- numeri

- numerose

- of

- Vecchio

- on

- ONE

- online

- esclusivamente

- operare

- operativa

- ottimizzazione

- ottimizzazioni

- or

- Altro

- nostro

- risultati

- ancora

- complessivo

- Superare

- alto

- imballato

- Parallel

- parte

- partner

- passione

- Persone

- Eseguire

- performance

- conduttura

- pianificazione

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- giocatori

- punti

- Post

- precedente

- in precedenza

- processi

- Prodotto

- Produzione

- della produttività

- Prodotti

- Programmazione

- fornire

- qualità

- R&D

- Crudo

- Lettura

- record

- registrazione

- ridurre

- Ridotto

- riduzione

- riferimento

- Basic

- pertinente

- Report

- rappresentante

- riparazioni

- responsabile

- REST

- Risultati

- ritorno

- Le vendite

- diritti

- ROI

- Rotolo

- Correre

- running

- corre

- runtime

- tranquillamente

- sagemaker

- scalabile

- Scala

- scala

- programma

- programmazione

- Scienze

- punteggi

- secondo

- vede

- segmento

- segmentazione

- segmenti

- anziano

- Servizi

- alcuni

- forme

- condiviso

- ha mostrato

- Spettacoli

- segno

- semplificata

- contemporaneamente

- singolo

- Dimensioni

- rallentare

- So

- Social

- Social Media

- Software

- Software Engineer

- soluzione

- Soluzioni

- alcuni

- specialista

- specializzata

- specifico

- in particolare

- spendere

- sponsorizzazione

- Gli Sport

- Sports

- Stage

- Passi

- ruscello

- tale

- supporto

- sistema

- mira

- obiettivi

- Task

- team

- le squadre

- Consulenza

- Tecnologia

- decine

- test

- Testing

- di

- che

- Il

- Il futuro

- il mondo

- loro

- Li

- si

- poi

- di

- questo

- mille

- migliaia

- tre

- Attraverso

- tempo

- a

- ha preso

- top

- Totale

- pista

- trasformato

- tv

- tipico

- per

- capire

- e una comprensione reciproca

- aggiornato

- us

- Impiego

- uso

- utilizzando

- Valorizzazione

- variazioni

- Fisso

- Velocità

- Video

- Video

- visibilità

- visione

- ricercato

- Prima

- Modo..

- we

- sito web

- servizi web

- fine settimana

- sono stati

- quale

- OMS

- con

- Lavora

- flusso di lavoro

- lavoro

- lavori

- mondo

- Il mondo di

- sarebbe

- anno

- zefiro