JumpStart di Amazon SageMaker è un hub di machine learning (ML) che può aiutarti ad accelerare il tuo viaggio nel machine learning. Con SageMaker JumpStart, puoi scoprire e implementare modelli di base disponibili pubblicamente e proprietari su siti dedicati Amazon Sage Maker istanze per le tue applicazioni di intelligenza artificiale generativa. SageMaker JumpStart consente di distribuire modelli di base da un ambiente isolato dalla rete e non condivide i dati di addestramento e inferenza dei clienti con i fornitori di modelli.

In questo post, esaminiamo come iniziare con modelli proprietari di fornitori di modelli come AI21, Cohere e LightOn da Amazon Sage Maker Studio. SageMaker Studio è un ambiente notebook in cui i clienti data scientist aziendali di SageMaker valutano e creano modelli per le loro prossime applicazioni AI generative.

Modelli di fondazione in SageMaker

I modelli di base sono modelli ML su larga scala che contengono miliardi di parametri e sono preaddestrati su terabyte di dati di testo e immagini in modo da poter eseguire un'ampia gamma di attività, come il riepilogo di articoli e la generazione di testo, immagini o video. Poiché i modelli di base sono pre-addestrati, possono contribuire a ridurre i costi di formazione e infrastruttura e consentire la personalizzazione per il tuo caso d'uso.

SageMaker JumpStart fornisce due tipi di modelli di base:

- Modelli proprietari – Questi modelli provengono da fornitori come AI21 con modelli Jurassic-2, Cohere con Cohere Command e LightOn con Mini addestrati su algoritmi e dati proprietari. Non puoi visualizzare gli artefatti del modello come il peso e gli script, ma puoi comunque distribuire alle istanze SageMaker per l'inferenza.

- Modelli disponibili pubblicamente - Questi provengono da hub di modelli popolari come Hugging Face with Stable Diffusion, Falcon e FLAN addestrati su algoritmi e dati disponibili pubblicamente. Per questi modelli, gli utenti hanno accesso agli artefatti del modello e sono in grado di ottimizzare i propri dati prima della distribuzione per l'inferenza.

Scopri i modelli

Puoi accedere ai modelli di base tramite SageMaker JumpStart nell'interfaccia utente di SageMaker Studio e SageMaker Python SDK. In questa sezione, esaminiamo come scoprire i modelli nell'interfaccia utente di SageMaker Studio.

SageMaker Studio è un ambiente di sviluppo integrato (IDE) basato sul Web per ML che ti consente di creare, addestrare, eseguire il debug, distribuire e monitorare i tuoi modelli ML. Per maggiori dettagli su come iniziare e configurare SageMaker Studio, fare riferimento a Amazon Sage Maker Studio.

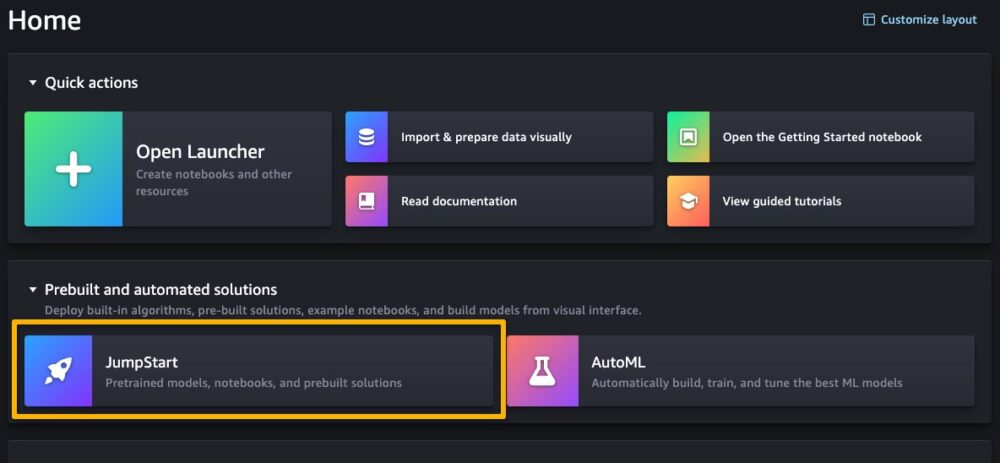

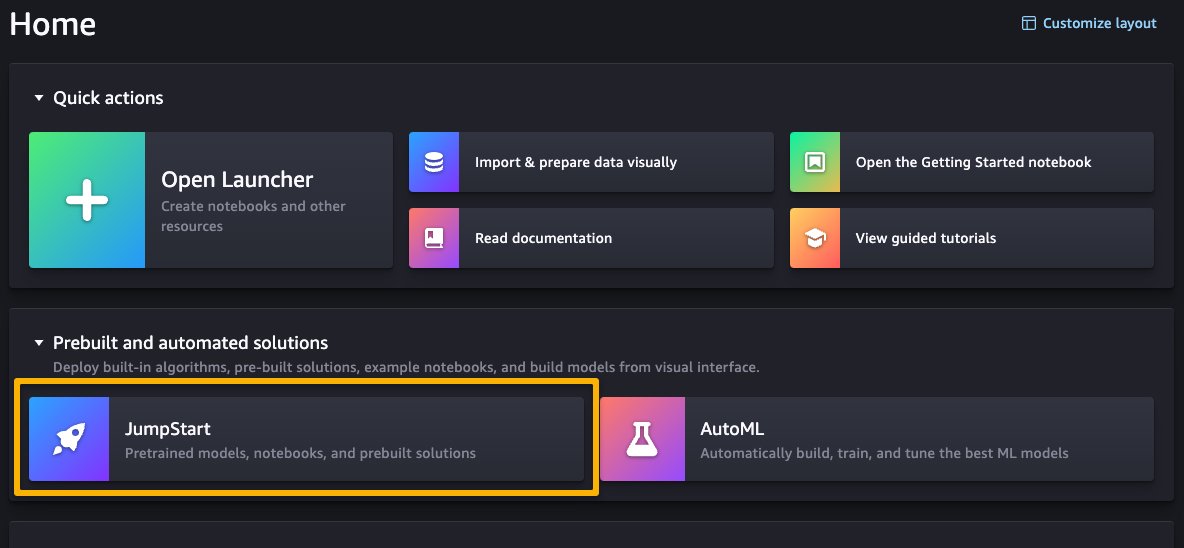

Una volta che sei nell'interfaccia utente di SageMaker Studio, puoi accedere a SageMaker JumpStart, che contiene modelli pre-addestrati, notebook e soluzioni predefinite, in Soluzioni predefinite e automatizzate.

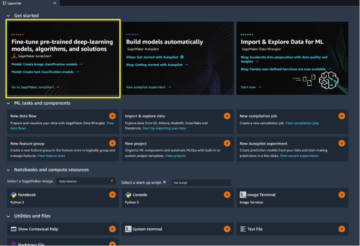

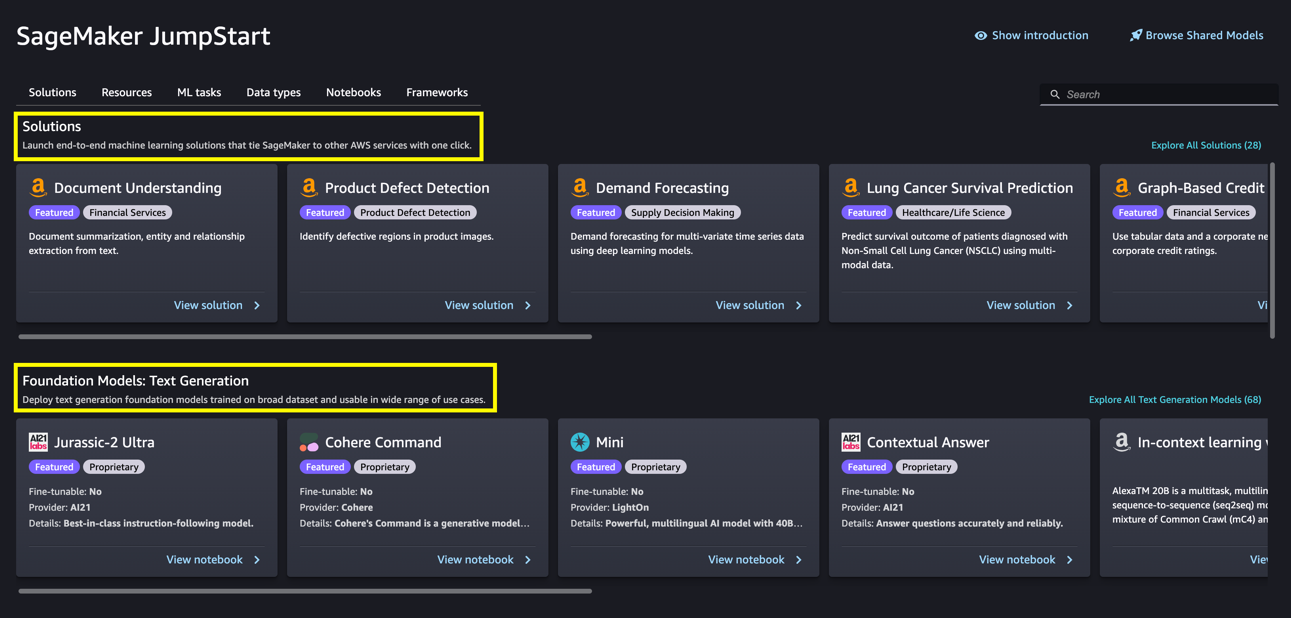

Dalla pagina di destinazione di SageMaker JumpStart, puoi cercare soluzioni, modelli, notebook e altre risorse. Lo screenshot seguente mostra un esempio della pagina di destinazione con soluzioni e modelli di base elencati.

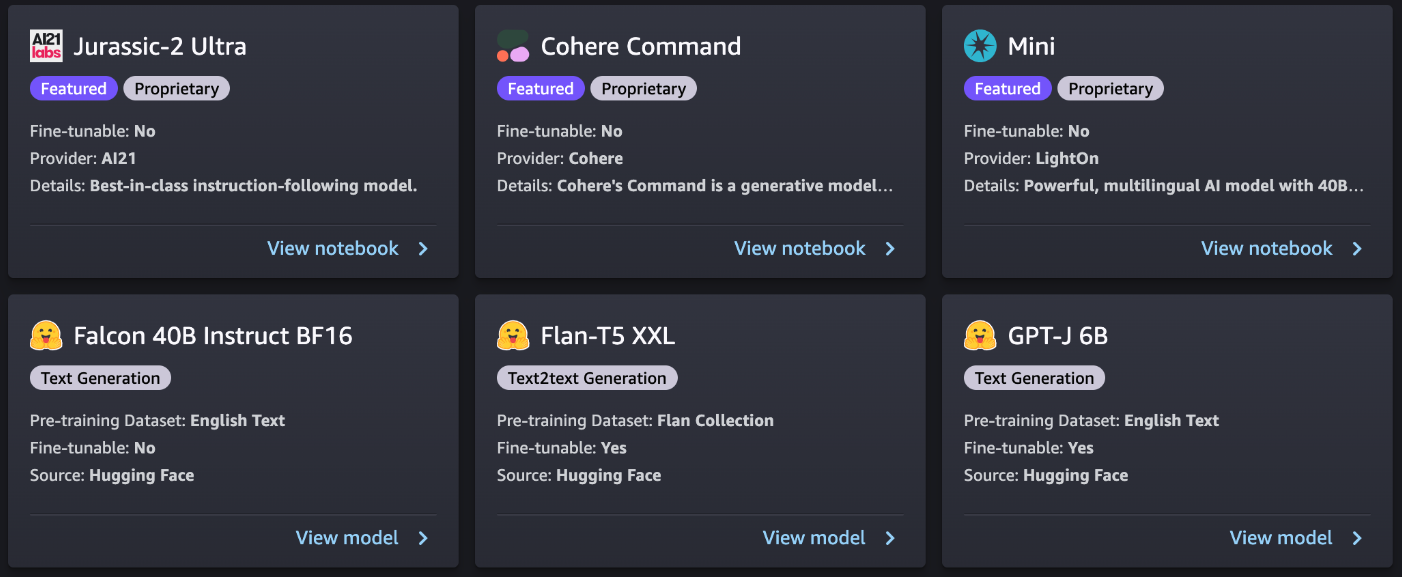

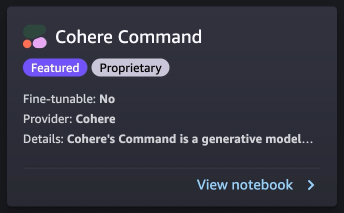

Ogni modello ha una scheda modello, come mostrato nello screenshot seguente, che contiene il nome del modello, se è regolabile o meno, il nome del provider e una breve descrizione del modello. Puoi anche aprire la scheda del modello per saperne di più sul modello e iniziare l'addestramento o la distribuzione.

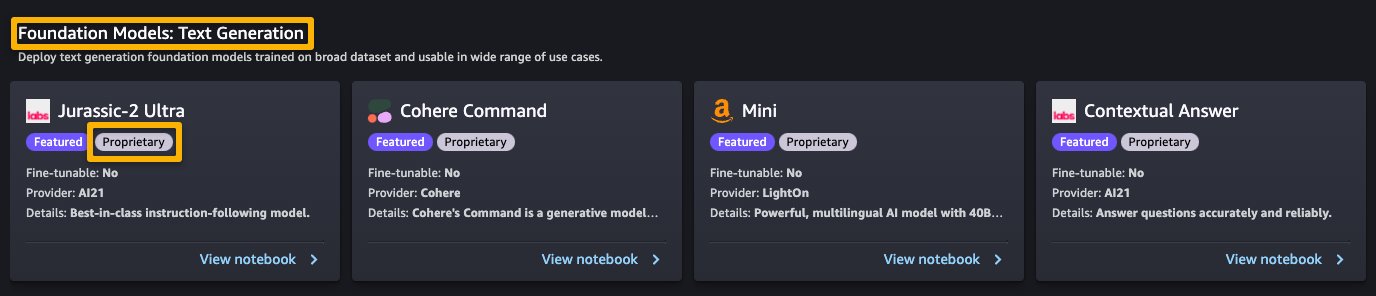

Abbonati ad AWS Marketplace

I modelli proprietari in SageMaker JumpStart sono pubblicati da fornitori di modelli come AI21, Cohere e LightOn. È possibile identificare i modelli proprietari tramite il tag "Proprietario" sulle schede modello, come mostrato nello screenshot seguente.

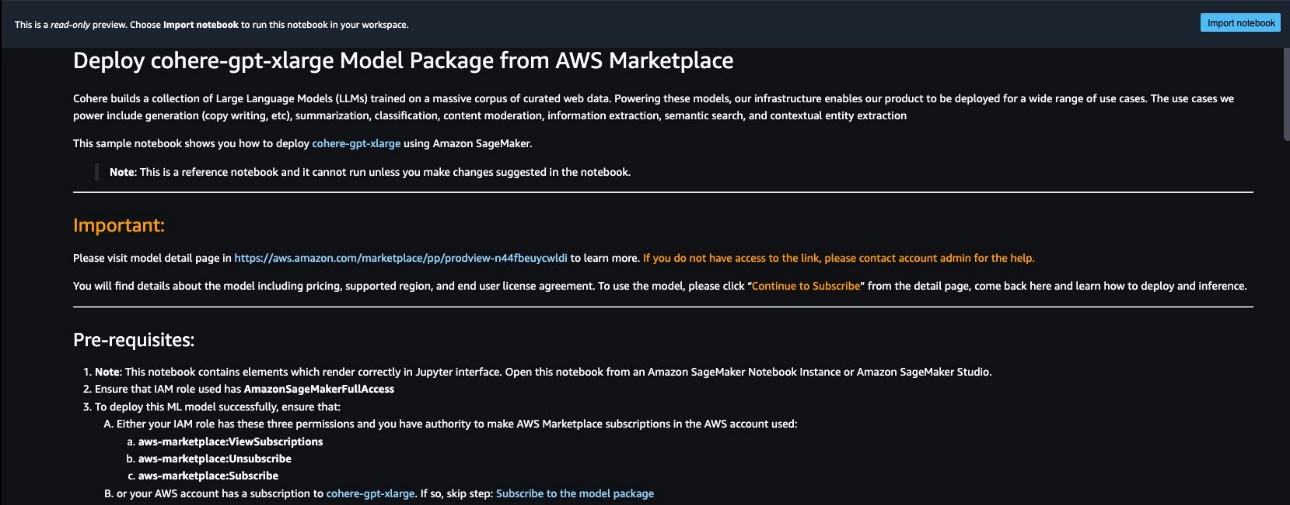

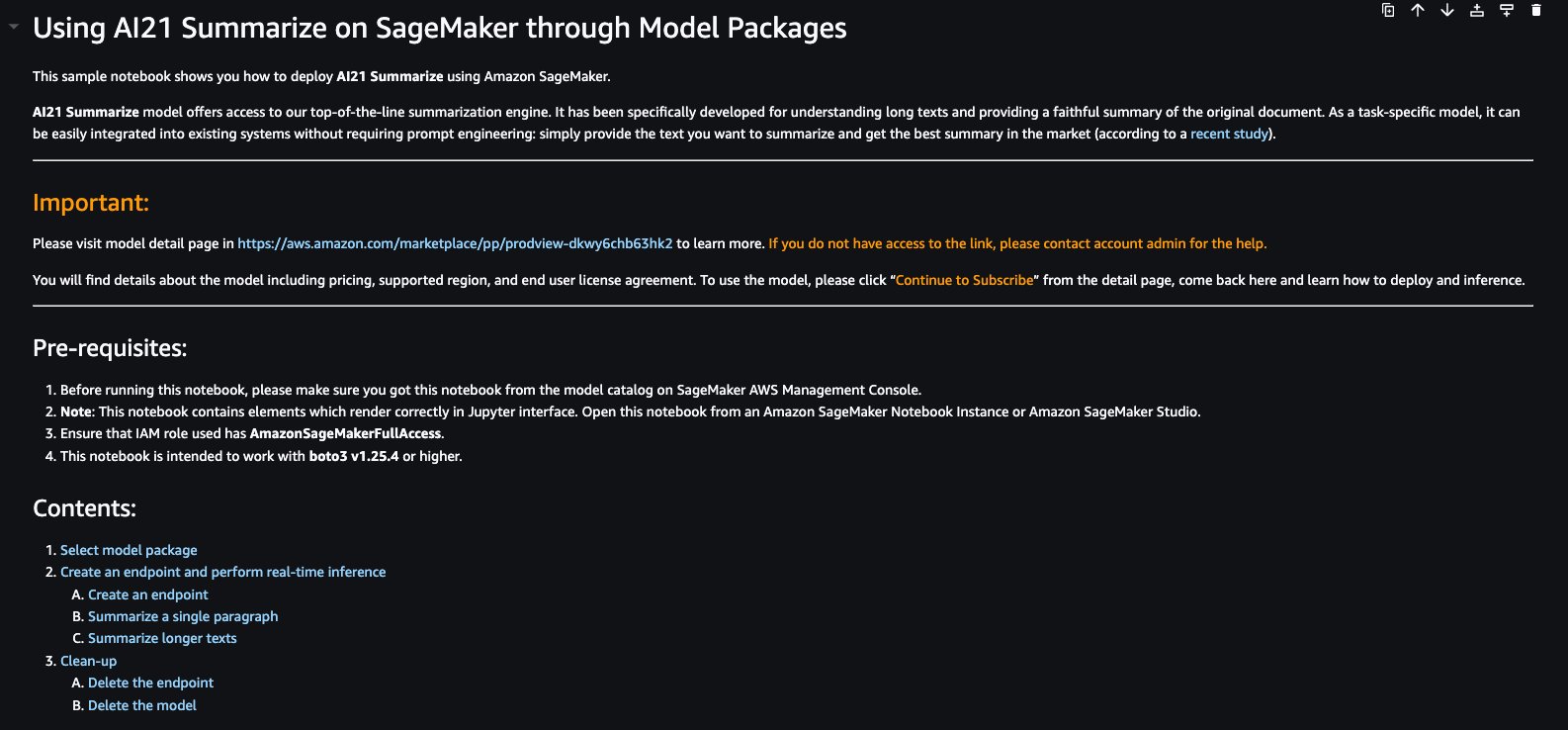

È possibile scegliere Visualizza taccuino sulla scheda del modello per aprire il notebook in modalità di sola lettura, come mostrato nello screenshot seguente. È possibile leggere il notebook per informazioni importanti sui prerequisiti e altre istruzioni per l'uso.

Dopo aver importato il notebook, è necessario selezionare l'ambiente notebook appropriato (immagine, kernel, tipo di istanza e così via) prima di eseguire i codici. Dovresti anche seguire le istruzioni per l'abbonamento e l'utilizzo per il taccuino selezionato.

Prima di utilizzare un modello proprietario, è necessario abbonarsi al modello da Mercato AWS:

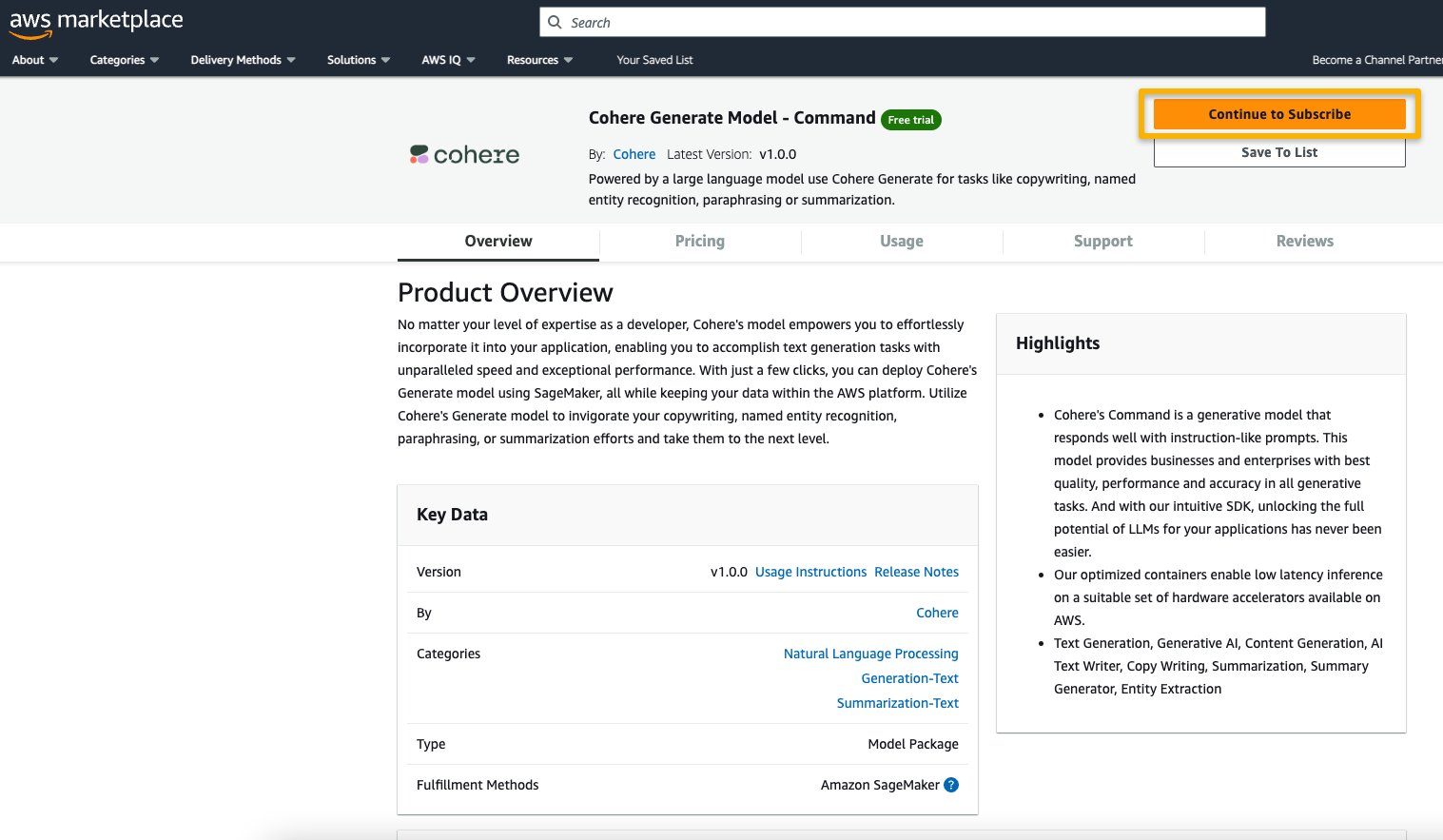

- Apri la pagina dell'elenco dei modelli in AWS Marketplace.

L'URL è fornito nel file Consigli sezione del blocco appunti oppure è possibile accedervi da Pagina del servizio SageMaker JumpStart. La pagina dell'elenco mostra la panoramica, i prezzi, l'utilizzo e le informazioni di supporto sul modello.

- Nell'elenco di AWS Marketplace, scegli Continua ad iscriverti.

Se non disponi delle autorizzazioni necessarie per visualizzare o iscriverti al modello, contatta l'amministratore IT o il punto di contatto per gli acquisti per iscriverti al modello. Molte aziende possono limitare le autorizzazioni di AWS Marketplace per controllare le azioni che qualcuno con tali autorizzazioni può intraprendere nel portale di gestione di AWS Marketplace.

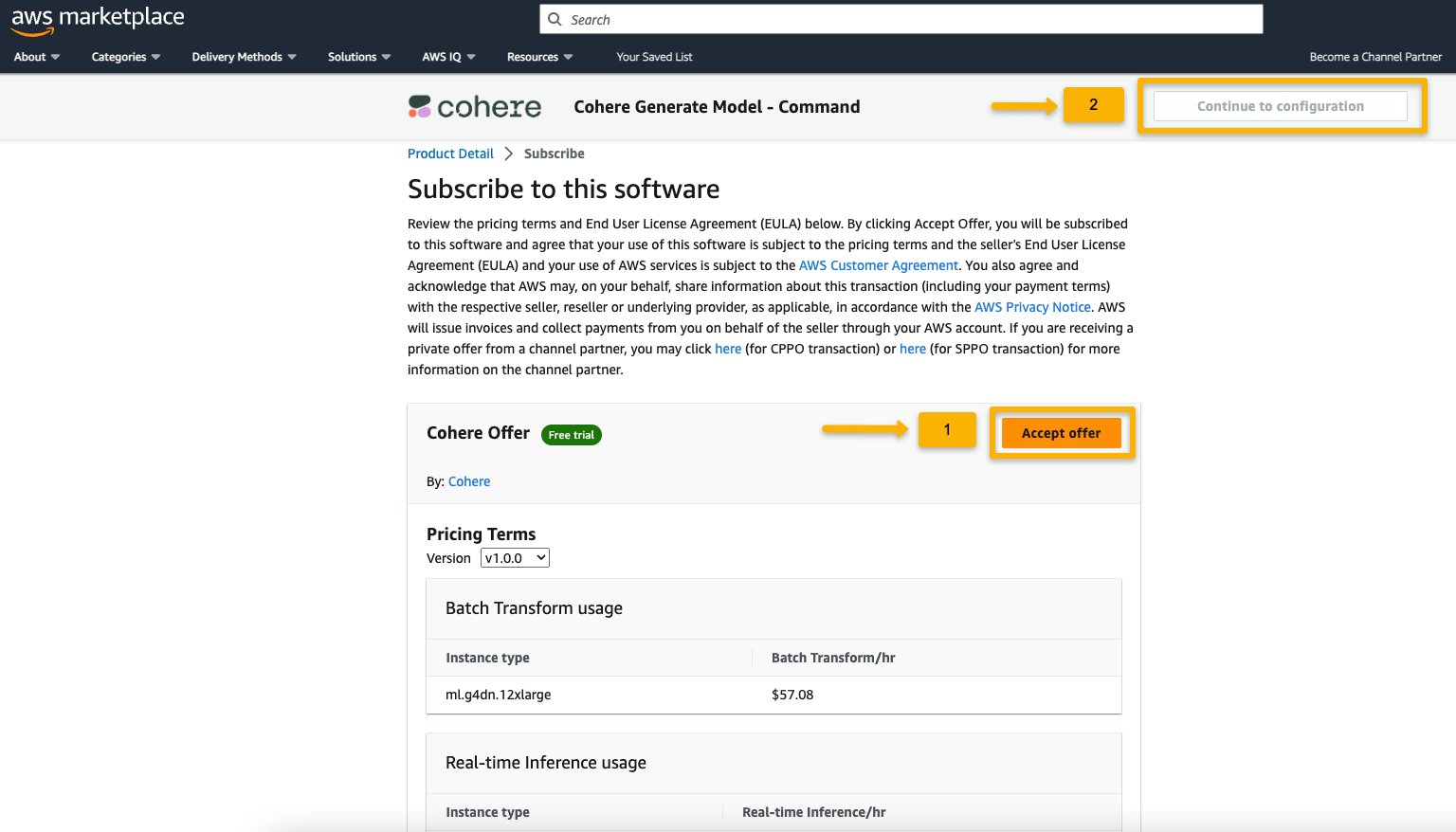

- Sulla Iscriviti a questa pagina del software, controlla i dettagli e scegli Accettare un'offerta se tu e la tua organizzazione siete d'accordo con l'EULA, i prezzi e i termini di supporto.

Se hai domande o una richiesta di sconto sul volume, contatta direttamente il fornitore del modello tramite l'e-mail di supporto fornita nella pagina dei dettagli o contatta il team dell'account AWS.

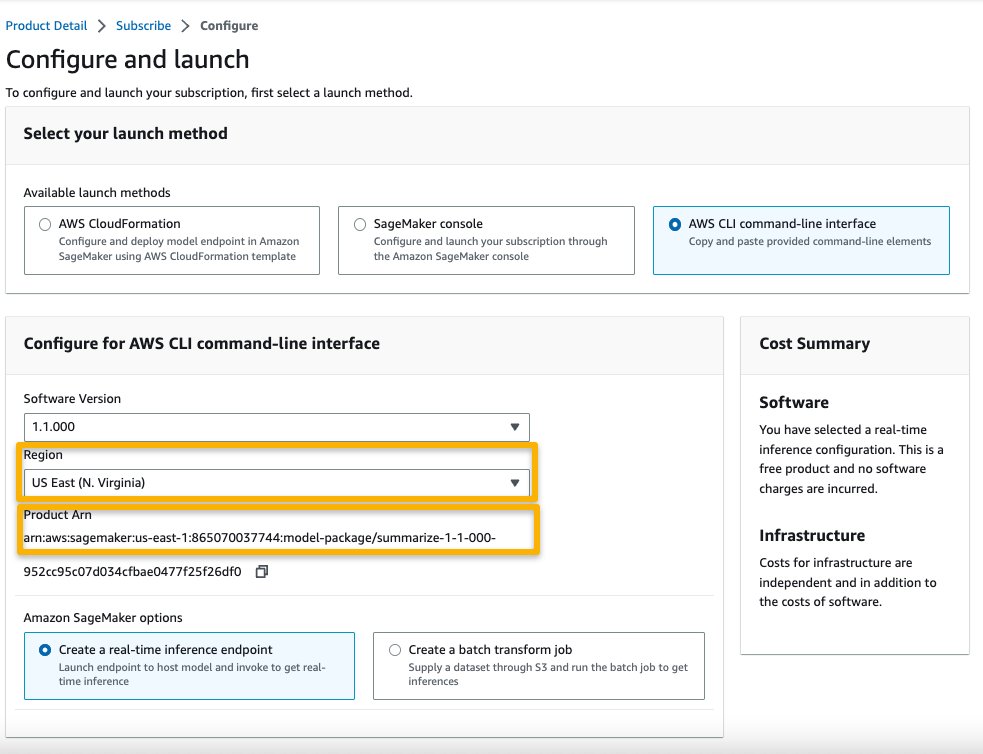

- Scegli Continua con la configurazione e scegli una Regione.

Verrà visualizzato un ARN del prodotto. Questo è l'ARN del pacchetto modello che devi specificare durante la creazione di un modello distribuibile utilizzando Boto3.

- Copia l'ARN corrispondente alla tua regione e specifica lo stesso nelle istruzioni della cella del notebook.

Esempio di inferenza con prompt di esempio

Diamo un'occhiata ad alcuni dei modelli base di esempio di A21 Labs, Cohere e LightOn individuabili da SageMaker JumpStart in SageMaker Studio. Tutti hanno le stesse istruzioni per iscriversi da AWS Marketplace e importare e configurare il notebook.

AI21 Riassumi

Il modello Summarize di A121 Labs condensa testi lunghi in parti brevi e di facile lettura che rimangono effettivamente coerenti con la fonte. Il modello viene addestrato per generare riepiloghi che catturano idee chiave basate su un corpo di testo. Non richiede alcun suggerimento. Basta inserire il testo che deve essere riassunto. Il tuo testo di origine può contenere fino a 50,000 caratteri, traducendosi in circa 10,000 parole o ben 40 pagine.

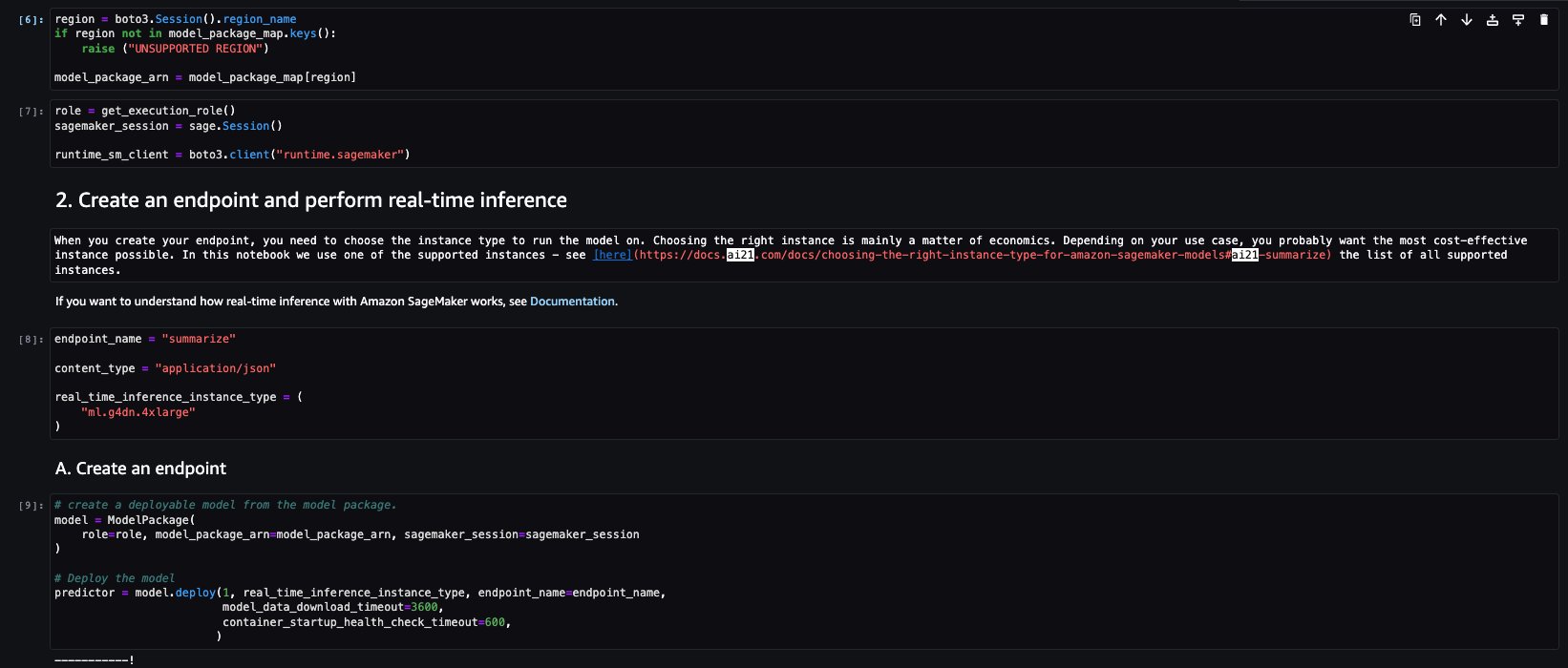

Il notebook di esempio per il modello Riepiloga AI21 fornisce importanti prerequisiti che devono essere seguiti. Ad esempio, il modello è sottoscritto da AWS Marketplace, dispone delle autorizzazioni dei ruoli IAM appropriate e richiede la versione boto3 ecc. Ti guida attraverso come selezionare il pacchetto del modello, creare endpoint per l'inferenza in tempo reale e quindi ripulire.

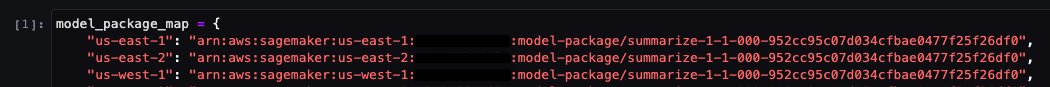

Il pacchetto del modello selezionato contiene la mappatura degli ARN alle regioni. Queste sono le informazioni che hai acquisito dopo aver scelto Continua con la configurazione nella pagina dell'abbonamento ad AWS Marketplace (nella sezione Valuta e iscriviti nel Marketplace) e quindi selezionando una regione per la quale verrà visualizzato l'ARN del prodotto corrispondente.

Il notebook potrebbe già avere l'ARN precompilato.

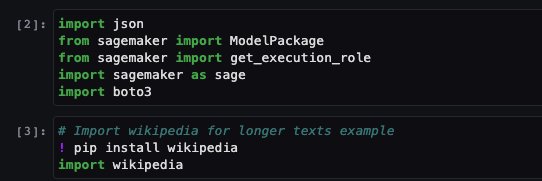

Quindi importi alcune librerie necessarie per eseguire questo notebook e installi wikipedia, che è una libreria Python che semplifica l'accesso e l'analisi dei dati da Wikipedia. Il taccuino lo usa in seguito per mostrare come riassumere un lungo testo da Wikipedia.

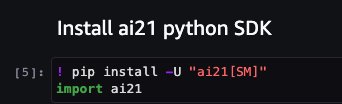

Il notebook procede anche all'installazione del file ai21 Python SDK, che è un wrapper per API SageMaker come deploy ed invoke endpoint.

Le prossime celle del taccuino seguono i seguenti passaggi:

- Seleziona la regione e recupera l'ARN del pacchetto modello dalla mappa del pacchetto modello

- Crea il tuo endpoint di inferenza selezionando un tipo di istanza (a seconda del caso d'uso e dell'istanza supportata per il modello; vedi Modelli specifici per attività per maggiori dettagli) su cui eseguire il modello

- Crea un modello distribuibile dal pacchetto del modello

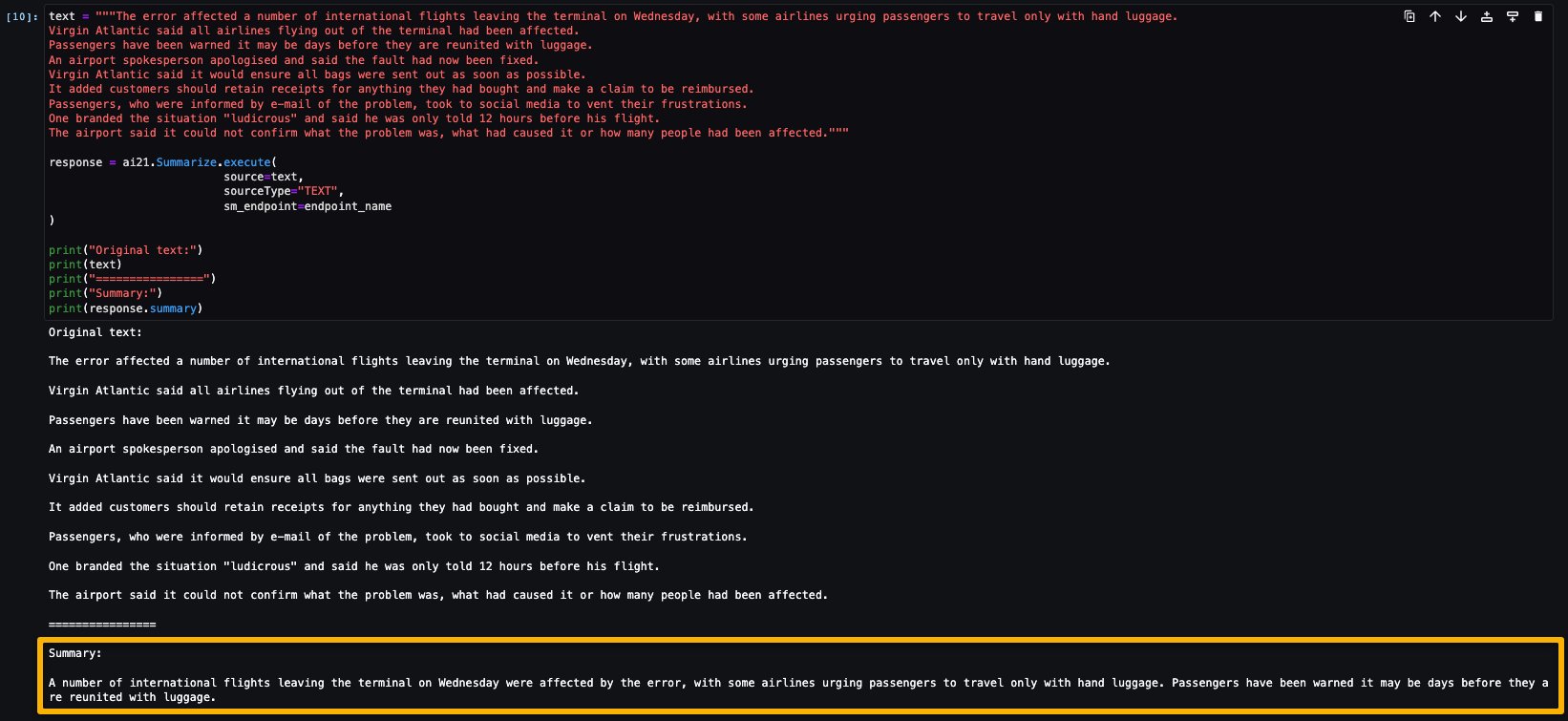

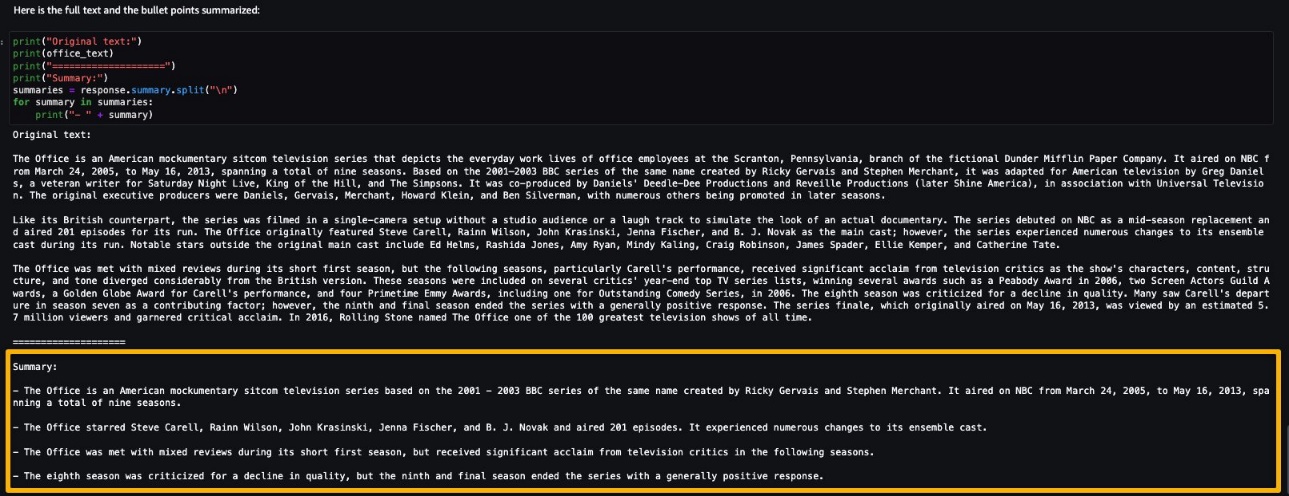

Eseguiamo l'inferenza per generare un riepilogo di un singolo paragrafo tratto da un articolo di notizie. Come puoi vedere nell'output, il testo riassunto viene presentato come output dal modello.

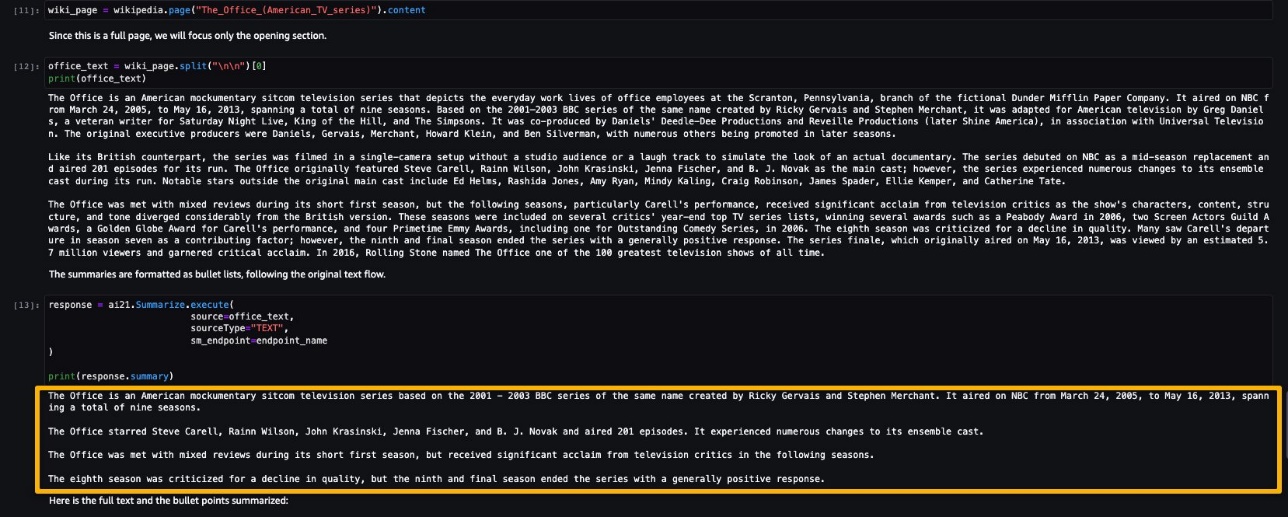

AI21 Riepiloga può gestire input fino a 50,000 caratteri. Questo si traduce in circa 10,000 parole o 40 pagine. A dimostrazione del comportamento del modello, carichiamo una pagina da Wikipedia.

Ora che hai eseguito un'inferenza in tempo reale per il test, potresti non aver più bisogno dell'endpoint. È possibile eliminare l'endpoint per evitare l'addebito.

Comando coerente

Cohere Command è un modello generativo che risponde bene con prompt simili a istruzioni. Questo modello offre alle aziende e alle imprese la migliore qualità, prestazioni e accuratezza in tutte le attività generative. Puoi utilizzare il modello di comando di Cohere per rinvigorire i tuoi sforzi di copywriting, riconoscimento di entità denominate, parafrasi o riepilogo e portarli al livello successivo.

Il notebook di esempio per il modello Cohere Command fornisce importanti prerequisiti che devono essere seguiti. Ad esempio, il modello è sottoscritto da AWS Marketplace, dispone delle autorizzazioni dei ruoli IAM appropriate e richiede la versione boto3 ecc. Ti guida attraverso come selezionare il pacchetto del modello, creare endpoint per l'inferenza in tempo reale e quindi ripulire.

Alcune delle attività sono simili a quelle trattate nell'esempio del notebook precedente, come l'installazione di Boto3, l'installazione cohere-sagemaker (il pacchetto fornisce funzionalità sviluppate per semplificare l'interfacciamento con il modello Cohere) e ottenere la sessione e la regione.

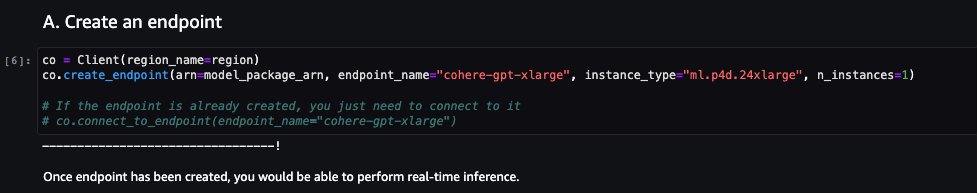

Esploriamo la creazione dell'endpoint. Fornisci l'ARN del pacchetto modello, il nome dell'endpoint, il tipo di istanza da utilizzare e il numero di istanze. Una volta creato, l'endpoint viene visualizzato nel tuo file endpoint sezione di SageMaker.

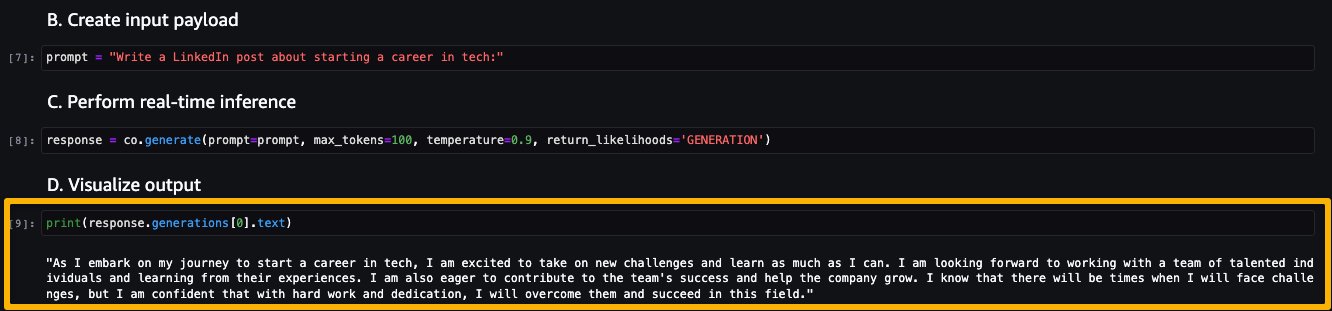

Ora eseguiamo l'inferenza per vedere alcuni degli output dal modello di comando.

Lo screenshot seguente mostra un esempio di generazione di un annuncio di lavoro e il relativo output. Come puoi vedere, il modello ha generato un post dal prompt specificato.

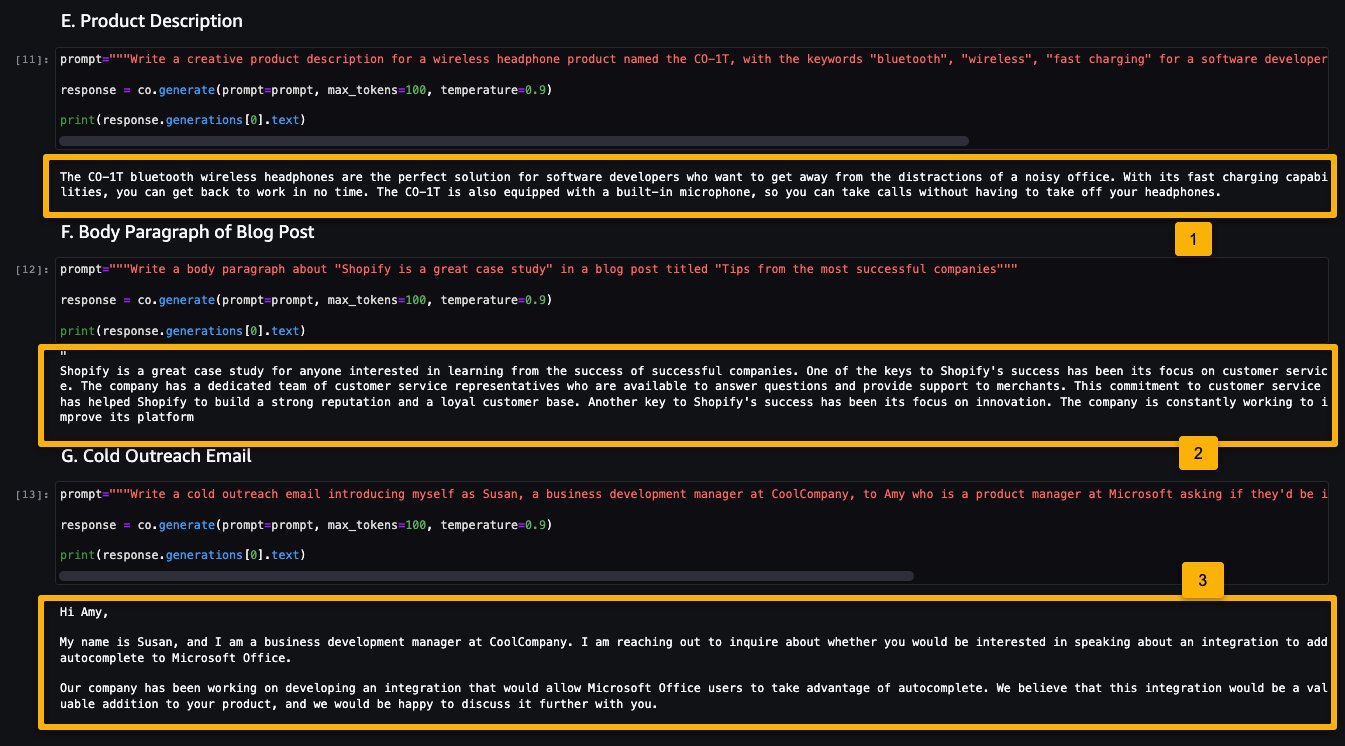

Ora diamo un'occhiata ai seguenti esempi:

- Genera una descrizione del prodotto

- Genera un paragrafo del corpo di un post sul blog

- Genera un'e-mail di sensibilizzazione

Come puoi vedere, il modello Cohere Command ha generato testo per varie attività generative.

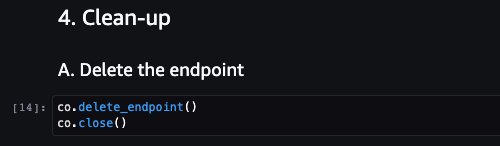

Ora che hai eseguito l'inferenza in tempo reale per i test, potresti non aver più bisogno dell'endpoint. È possibile eliminare l'endpoint per evitare l'addebito.

LightOn Mini-istruzione

Mini-instruct, un modello di intelligenza artificiale con 40 miliardi di miliardi di parametri creato da LightOn, è un potente sistema di intelligenza artificiale multilingue che è stato addestrato utilizzando dati di alta qualità provenienti da numerose fonti. È progettato per comprendere il linguaggio naturale e reagire a comandi specifici per le tue esigenze. Funziona egregiamente in prodotti di consumo come assistenti vocali, chatbot e dispositivi intelligenti. Dispone inoltre di un'ampia gamma di applicazioni aziendali, tra cui l'assistenza degli agenti e la produzione di linguaggio naturale per l'assistenza clienti automatizzata.

Il notebook di esempio per il modello LightOn Mini-istruct fornisce importanti prerequisiti che devono essere seguiti. Ad esempio, il modello è sottoscritto da AWS Marketplace, dispone delle autorizzazioni dei ruoli IAM appropriate e richiede la versione boto3 ecc. Ti guida attraverso come selezionare il pacchetto del modello, creare endpoint per l'inferenza in tempo reale e quindi ripulire.

Alcune delle attività sono simili a quelle trattate nell'esempio del notebook precedente, come l'installazione di Boto3 e l'ottenimento della regione della sessione.

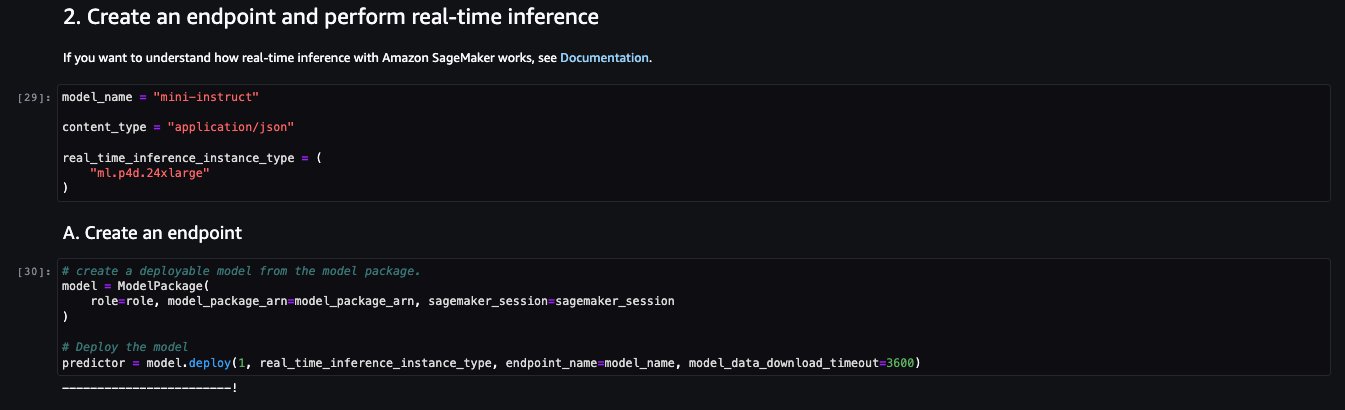

Diamo un'occhiata alla creazione dell'endpoint. Innanzitutto, fornisci l'ARN del pacchetto modello, il nome dell'endpoint, il tipo di istanza da utilizzare e il numero di istanze. Una volta creato, l'endpoint viene visualizzato nella sezione endpoint di SageMaker.

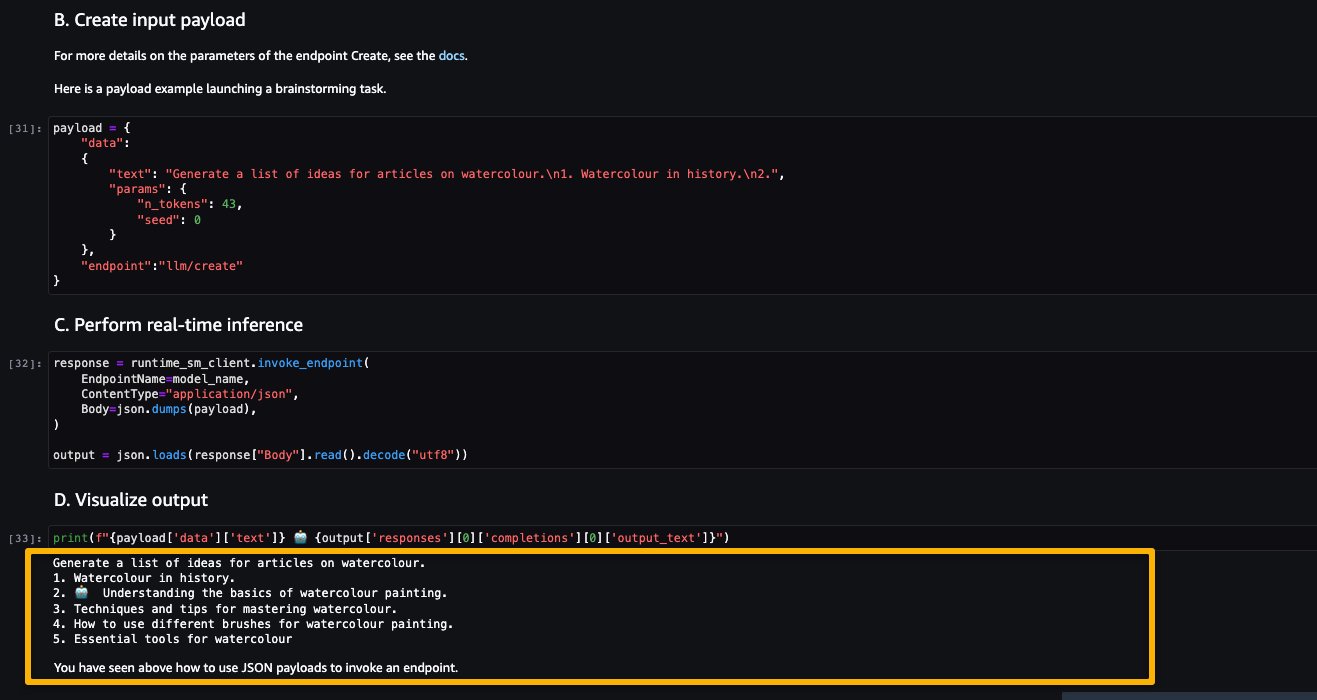

Ora proviamo a dedurre il modello chiedendogli di generare un elenco di idee per articoli per un argomento, in questo caso l'acquerello.

Come puoi vedere, il modello LightOn Mini-istruct è stato in grado di fornire testo generato in base al prompt specificato.

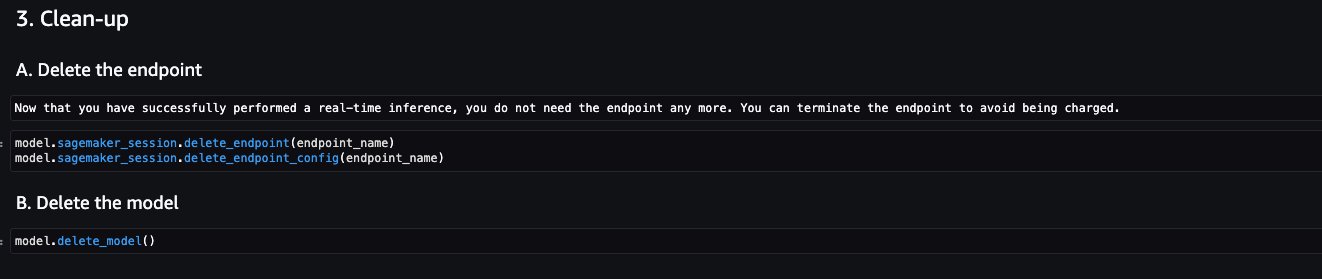

ripulire

Dopo aver testato i modelli e creato gli endpoint sopra per i modelli Foundation proprietari di esempio, assicurati di eliminare gli endpoint di inferenza SageMaker ed eliminare i modelli per evitare di incorrere in addebiti.

Conclusione

In questo post, ti abbiamo mostrato come iniziare con modelli proprietari di fornitori di modelli come AI21, Cohere e LightOn in SageMaker Studio. I clienti possono scoprire e utilizzare i Foundation Model proprietari in SageMaker JumpStart da Studio, SageMaker SDK e SageMaker Console. Con questo, hanno accesso a modelli ML su larga scala che contengono miliardi di parametri e sono preaddestrati su terabyte di dati di testo e immagine in modo che i clienti possano eseguire un'ampia gamma di attività come il riepilogo di articoli e la generazione di testo, immagini o video. Poiché i modelli di base sono preaddestrati, possono anche aiutare a ridurre i costi di formazione e infrastruttura e consentire la personalizzazione per il tuo caso d'uso.

Risorse

Circa gli autori

Giugno vinto è un product manager con SageMaker JumpStart. Si concentra sul rendere i modelli di base facilmente individuabili e utilizzabili per aiutare i clienti a creare applicazioni di IA generative.

Giugno vinto è un product manager con SageMaker JumpStart. Si concentra sul rendere i modelli di base facilmente individuabili e utilizzabili per aiutare i clienti a creare applicazioni di IA generative.

Mani Khanuja è una SA specializzata in Intelligenza Artificiale e Machine Learning presso Amazon Web Services (AWS). Aiuta i clienti che utilizzano l'apprendimento automatico per risolvere le loro sfide aziendali utilizzando AWS. Trascorre la maggior parte del suo tempo immergendosi in profondità e insegnando ai clienti progetti AI/ML relativi a visione artificiale, elaborazione del linguaggio naturale, previsione, ML all'edge e altro ancora. È appassionata di ML all'edge, quindi ha creato il suo laboratorio con kit di guida autonoma e linea di produzione di prototipi, dove trascorre molto del suo tempo libero.

Mani Khanuja è una SA specializzata in Intelligenza Artificiale e Machine Learning presso Amazon Web Services (AWS). Aiuta i clienti che utilizzano l'apprendimento automatico per risolvere le loro sfide aziendali utilizzando AWS. Trascorre la maggior parte del suo tempo immergendosi in profondità e insegnando ai clienti progetti AI/ML relativi a visione artificiale, elaborazione del linguaggio naturale, previsione, ML all'edge e altro ancora. È appassionata di ML all'edge, quindi ha creato il suo laboratorio con kit di guida autonoma e linea di produzione di prototipi, dove trascorre molto del suo tempo libero.

Nitin Eusebio è Sr. Enterprise Solutions Architect presso AWS con esperienza in ingegneria del software, architettura aziendale e AI/ML. Lavora con i clienti per aiutarli a creare applicazioni ben architettate sulla piattaforma AWS. È appassionato di risolvere le sfide tecnologiche e aiutare i clienti nel loro viaggio verso il cloud.

Nitin Eusebio è Sr. Enterprise Solutions Architect presso AWS con esperienza in ingegneria del software, architettura aziendale e AI/ML. Lavora con i clienti per aiutarli a creare applicazioni ben architettate sulla piattaforma AWS. È appassionato di risolvere le sfide tecnologiche e aiutare i clienti nel loro viaggio verso il cloud.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/use-proprietary-foundation-models-from-amazon-sagemaker-jumpstart-in-amazon-sagemaker-studio/

- :ha

- :È

- :non

- :Dove

- $ SU

- 000

- 10

- 100

- 40

- 50

- 500

- 7

- 87

- a

- capace

- WRI

- sopra

- accelerare

- accesso

- Il mio account

- precisione

- azioni

- Admin

- Dopo shavasana, sedersi in silenzio; saluti;

- Agente

- AI

- AI / ML

- Algoritmi

- Tutti

- consente

- già

- anche

- Amazon

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Amazon Sage Maker Studio

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- ed

- e infrastruttura

- in qualsiasi

- più

- API

- appare

- elettrodomestici

- applicazioni

- opportuno

- architettura

- SONO

- in giro

- articolo

- news

- artificiale

- intelligenza artificiale

- Intelligenza artificiale e apprendimento automatico

- AS

- Assistenza

- assistenti

- At

- Automatizzata

- disponibile

- evitare

- AWS

- Mercato AWS

- basato

- BE

- perché

- stato

- prima

- essendo

- MIGLIORE

- Miliardo

- miliardi

- Blog

- stile di vita

- costruire

- costruito

- affari

- Applicazioni aziendali

- aziende

- ma

- by

- Materiale

- catturare

- catturato

- carta

- Carte

- che

- Custodie

- Celle

- sfide

- caratteri

- carico

- oneri

- chatbots

- Scegli

- la scelta

- Cloud

- codici

- computer

- Visione computerizzata

- coerente

- consolle

- Consumer

- Prodotti di consumo

- contatti

- contenere

- contiene

- di controllo

- copy professionale

- Corrispondente

- Costi

- coperto

- creare

- creato

- Creazione

- cliente

- Clienti

- personalizzazione

- dati

- scienziato di dati

- dedicato

- deep

- Dipendente

- schierare

- distribuzione

- deployment

- descrizione

- dettaglio

- dettagli

- sviluppato

- Mercato

- Emittente

- direttamente

- Codice Sconto

- scopri

- visualizzati

- non

- Dont

- facilmente

- facile

- bordo

- sforzi

- enable

- endpoint

- Ingegneria

- Impresa

- aziende

- entità

- Ambiente

- eccetera

- valutare

- esempio

- Esempi

- esperienza

- esplora

- Faccia

- pochi

- Nome

- si concentra

- seguire

- seguito

- i seguenti

- Nel

- Fondazione

- Gratis

- da

- funzionalità

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- ottenere

- dato

- Go

- maniglia

- Avere

- he

- Aiuto

- aiutare

- aiuta

- suo

- alta qualità

- Come

- Tutorial

- HTML

- HTTPS

- Hub

- idee

- identificare

- if

- Immagine

- importare

- importante

- importazione

- impressionante

- in

- Compreso

- informazioni

- Infrastruttura

- ingresso

- Ingressi

- install

- installazione

- esempio

- istruzioni

- integrato

- Intelligence

- ai miglioramenti

- isolato

- IT

- SUO

- Lavoro

- viaggio

- jpg

- Le

- laboratorio

- Labs

- atterraggio

- Lingua

- larga scala

- dopo

- IMPARARE

- apprendimento

- Consente di

- Livello

- biblioteche

- Biblioteca

- piace

- LIMITE

- linea

- Lista

- elencati

- annuncio

- caricare

- Lunghi

- Guarda

- lotto

- inferiore

- macchina

- machine learning

- make

- FA

- Fare

- gestione

- direttore

- consigliato per la

- molti

- mappatura

- mercato

- Maggio..

- ML

- Moda

- modello

- modelli

- Monitorare

- Scopri di più

- maggior parte

- Nome

- Detto

- Naturale

- Elaborazione del linguaggio naturale

- necessaria

- Bisogno

- esigenze

- Rete

- notizie

- GENERAZIONE

- taccuino

- numero

- numerose

- of

- on

- una volta

- aprire

- or

- organizzazione

- Altro

- su

- produzione

- outreach

- ancora

- panoramica

- proprio

- pacchetto

- pagina

- parametri

- appassionato

- Eseguire

- performance

- eseguita

- esegue

- permessi

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- Popolare

- Portale

- Post

- potente

- prerequisiti

- presentata

- precedente

- prezzi

- Precedente

- ricavo

- lavorazione

- appalti

- Prodotto

- product manager

- Produzione

- Prodotti

- progetti

- proprio

- prototipo

- fornire

- purché

- fornitore

- fornitori

- fornisce

- pubblicamente

- pubblicato

- Python

- qualità

- Domande

- gamma

- raggiungere

- Reagire

- Leggi

- Modalità di sola lettura

- tempo reale

- riconoscimento

- per quanto riguarda

- regione

- regioni

- relazionato

- rimanere

- richiesta

- richiedere

- necessario

- Risorse

- recensioni

- ruoli

- approssimativamente

- Correre

- running

- SA

- sagemaker

- Inferenza di SageMaker

- stesso

- Scienziato

- script

- sdk

- Sezione

- vedere

- selezionato

- Selezione

- auto-guida

- servizio

- Servizi

- Sessione

- set

- Condividi

- lei

- Corti

- dovrebbero

- vetrina

- ha mostrato

- mostrato

- Spettacoli

- simile

- semplificare

- semplicemente

- singolo

- smart

- So

- Software

- Ingegneria del software

- Soluzioni

- RISOLVERE

- Soluzione

- alcuni

- Qualcuno

- Fonte

- fonti

- specialista

- specifico

- stabile

- inizia a

- iniziato

- Passi

- Ancora

- studio

- sottoscrivi

- sottoscrizione

- tale

- riassumere

- SOMMARIO

- supporto

- supportato

- sistema

- TAG

- Fai

- preso

- task

- Insegnamento

- team

- Tecnologia

- condizioni

- testato

- Testing

- che

- Il

- le informazioni

- L’ORIGINE

- loro

- Li

- poi

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- Attraverso

- tempo

- a

- argomento

- Treni

- allenato

- Training

- prova

- seconda

- Digitare

- Tipi di

- ui

- per

- capire

- URL

- utilizzabile

- Impiego

- uso

- caso d'uso

- utilizzato

- utenti

- usa

- utilizzando

- vario

- versione

- via

- Video

- Visualizza

- visione

- Voce

- volume

- Prima

- we

- sito web

- servizi web

- Web-basata

- peso

- WELL

- quale

- while

- largo

- Vasta gamma

- wikipedia

- volere

- con

- parole

- lavori

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro