מודלים של שפה גדולים (LLMs) עם מיליארדי פרמטרים נמצאים כיום בחזית עיבוד השפה הטבעית (NLP). המודלים האלה מרעידים את התחום עם היכולות המדהימות שלהם ליצור טקסט, לנתח סנטימנטים, לתרגם שפות ועוד הרבה יותר. עם גישה לכמויות אדירות של נתונים, ל-LLMs יש פוטנציאל לחולל מהפכה באופן שבו אנו מתקשרים עם השפה. למרות ש-LLMs מסוגלים לבצע משימות NLP שונות, הם נחשבים כלליים ולא מומחים. על מנת להכשיר LLM להפוך למומחה בתחום מסוים, נדרש בדרך כלל כוונון עדין.

אחד האתגרים העיקריים באימון ופריסה של LLMs עם מיליארדי פרמטרים הוא הגודל שלהם, מה שעלול להקשות על התאמתם לתוך GPUs בודדים, החומרה הנפוצה ללמידה עמוקה. קנה המידה העצום של דגמים אלה דורש משאבי מחשוב בעלי ביצועים גבוהים, כגון GPUs מיוחדים עם כמויות גדולות של זיכרון. בנוסף, גודלם של מודלים אלה יכול להפוך אותם ליקרים מבחינה חישובית, מה שיכול להגדיל משמעותית את זמני ההכשרה וההסקה.

בפוסט זה, אנו מדגימים כיצד אנו יכולים להשתמש אמזון SageMaker JumpStart כדי לכוונן בקלות מודל יצירת טקסט גדול בשפה על מערך נתונים ספציפי לדומיין באותו אופן שבו היית מתאמן ופריסה של כל מודל על אמזון SageMaker. בפרט, אנו מראים כיצד ניתן לכוונן את מודל השפה GPT-J 6B ליצירת טקסט פיננסי באמצעות ה-JumpStart SDK וגם סטודיו SageMaker של אמזון ממשק משתמש על מערך נתונים זמין לציבור של הגשות SEC.

JumpStart עוזר לך להתחיל במהירות ובקלות עם למידת מכונה (ML) ומספקת סט של פתרונות למקרי השימוש הנפוצים ביותר שניתן לאמן ולפרוס בקלות בכמה שלבים בלבד. כל השלבים בהדגמה זו זמינים במחברת המצורפת כוונון עדין של יצירת טקסט מודל GPT-J 6B על מערך נתונים ספציפי לתחום.

סקירת פתרונות

בסעיפים הבאים, אנו מספקים הדגמה שלב אחר שלב לכוונון עדין של LLM למשימות יצירת טקסט הן באמצעות ממשק המשתמש של JumpStart Studio והן של Python SDK. בפרט, אנו דנים בנושאים הבאים:

- סקירה כללית של נתוני הגשת ה-SEC בתחום הפיננסי שהמודל מכוון עליו

- סקירה כללית של דגם LLM GPT-J 6B שבחרנו לכוונן

- הדגמה של שתי דרכים שונות שבהן נוכל לכוונן את ה-LLM באמצעות JumpStart:

- השתמש ב-JumpStart באופן פרוגרמטי עם SageMaker Python SDK

- גש ל-JumpStart באמצעות ממשק המשתמש של Studio

- הערכה של המודל המכוונן על ידי השוואתו לדגם המאומן מראש ללא כוונון עדין

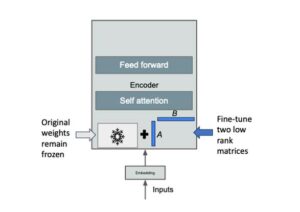

כוונון עדין מתייחס לתהליך של לקיחת מודל שפה מיומן מראש והכשרתו למשימה שונה אך קשורה תוך שימוש בנתונים ספציפיים. גישה זו ידועה גם בשם העברת למידה, הכרוך בהעברת הידע הנלמד ממשימה אחת לאחרת. LLMs כמו GPT-J 6B מאומנים על כמויות אדירות של נתונים ללא תווית וניתן לכוונן אותם על מערכי נתונים קטנים יותר, מה שהופך את המודל לביצועים טובים יותר בתחום ספציפי.

כדוגמה לשיפור הביצועים כאשר הדגם מכוון עדין, שקול לשאול אותו את השאלה הבאה:

"מה מניע את צמיחת המכירות באמזון?"

ללא כוונון עדין, התגובה תהיה:

"אמזון היא הקמעונאית המקוונת הגדולה בעולם. זהו גם השוק המקוון הגדול בעולם. זה גם העולם"

עם כוונון עדין, התגובה היא:

"גידול המכירות באמזון מונע בעיקר על ידי שימוש מוגבר של לקוחות, כולל הגדלת מבחר, מחירים נמוכים יותר והגברת הנוחות, והגדלת המכירות של מוכרים אחרים באתרים שלנו."

השיפור מכוונון עדין ניכר.

אנו משתמשים בטקסט פיננסי מהגשות של SEC כדי לכוונן עדין GPT-J 6B LLM עבור יישומים פיננסיים. בסעיפים הבאים, אנו מציגים את הנתונים ואת ה-LLM שיכוונו עדין.

מערך נתונים לתיוק של SEC

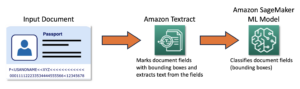

הגשות SEC הן קריטיות לרגולציה וחשיפה בתחום הכספים. הגשות מודיעות לקהילת המשקיעים על התנאים העסקיים של החברות ועל התחזית העתידית של החברות. הטקסט בהגשת ה-SEC מכסה את כל מכלול הפעילות והתנאים העסקיים של החברה. בגלל הערך החזוי הפוטנציאלי שלהם, הגשות אלה הן מקורות מידע טובים למשקיעים. למרות שבקשות ה-SEC הללו הן זמין לציבור לכל אחד, הורדת קבצים מנותחים ובניית מערך נתונים נקי עם תכונות נוספות היא תרגיל שגוזל זמן. אנו מאפשרים זאת בכמה קריאות API ב-JumpStart SDK לתעשייה.

באמצעות SageMaker API, הורדנו דוחות שנתיים (10-K הגשות; ראה כיצד לקרוא 10-K למידע נוסף) עבור מספר רב של חברות. אנו בוחרים את דוחות הגשת ה-SEC של אמזון לשנים 2021–2022 כנתוני ההדרכה כדי לכוונן את מודל GPT-J 6B. בפרט, אנו מצרפים את דוחות הגשת ה-SEC של החברה בשנים שונות לקובץ טקסט בודד למעט הסעיף "דיון וניתוח ניהולי", המכיל הצהרות צופות פני עתיד של הנהלת החברה ומשמשים כנתוני האימות.

הציפייה היא שאחרי כוונון עדין של מודל יצירת הטקסט של GPT-J 6B על מסמכי SEC הפיננסיים, המודל מסוגל לייצר פלט טקסטואלי הקשור לפיננסים בעל תובנות, ולכן ניתן להשתמש בו כדי לפתור משימות NLP מרובות לתחום ספציפי.

דגם שפה גדול GPT-J 6B

GPT-J 6B הוא מודל קוד פתוח של 6 מיליארד פרמטרים ששוחרר על ידי Eleuther AI. GPT-J 6B הוכשר על קורפוס גדול של נתוני טקסט והוא מסוגל לבצע משימות NLP שונות כגון הפקת טקסט, סיווג טקסט וסיכום טקסט. למרות שהמודל הזה מרשים במספר משימות NLP ללא צורך בכוונון עדין כלשהו, במקרים רבים תצטרכו לכוונן את המודל על מערך נתונים ספציפי ומשימות NLP שאתם מנסים לפתור. מקרי שימוש כוללים צ'אטבוטים מותאמים אישית, יצירת רעיונות, מיצוי ישויות, סיווג וניתוח סנטימנטים.

גישה ללימודי תואר שני ב- SageMaker

כעת, לאחר שזיהינו את מערך הנתונים ואת המודל שעליו אנו הולכים לכוונן, JumpStart מספקת שתי דרכים להתחיל להשתמש בכוונון עדין של יצירת טקסט: ה-SageMaker SDK ו-Studio.

השתמש ב-JumpStart באופן פרוגרמטי עם ה-SDK של SageMaker

כעת נעבור על דוגמה לאופן שבו אתה יכול להשתמש ב- SageMaker JumpStart SDK כדי לגשת ל-LLM (GPT-J 6B) ולכוונן אותו במערך התיוק של SEC. עם השלמת הכוונון העדין, נפרוס את המודל המכוונן ונסיק נגדו. כל השלבים בפוסט זה זמינים במחברת המצורפת: כוונון עדין של יצירת טקסט מודל GPT-J 6B על מערך נתונים ספציפי לתחום.

בדוגמה זו, JumpStart משתמש ב- מיכל למידה עמוקה של SageMaker Hugging Face (DLC) ו DeepSpeed ספרייה כדי לכוונן את המודל. ספריית DeepSpeed נועדה להפחית את כוח המחשוב והשימוש בזיכרון ולהכשיר דגמים מבוזרים גדולים עם מקביליות טובה יותר בחומרת המחשב הקיימת. הוא תומך באימון מבוזר בצמת בודד, תוך שימוש בבדיקת שיפוע ובמקביליות למודלים כדי לאמן דגמים גדולים על מופע אימון יחיד של SageMaker עם מספר GPUs. עם JumpStart, אנו משלבים עבורכם את ספריית DeepSpeed עם ה-DLC של SageMaker Hugging Face ודואגים להכל מתחת למכסה המנוע. אתה יכול בקלות לכוונן את המודל במערך הנתונים הספציפי לדומיין שלך מבלי להגדיר אותו באופן ידני.

כוונן את המודל שהוכשר מראש על נתונים ספציפיים לתחום

כדי לכוונן מודל נבחר, עלינו לקבל את ה-URI של הדגם הזה, כמו גם את סקריפט האימון ואת תמונת המאגר המשמשת לאימון. כדי להקל על הדברים, שלוש הכניסות הללו תלויות אך ורק בשם הדגם, הגרסה (לרשימה של הדגמים הזמינים, ראה אלגוריתמים מובנים עם טבלת מודל מיומנת מראש), וסוג המופע שבו ברצונך להתאמן. זה מודגם בקטע הקוד הבא:

אנו מאחזרים את model_id מתאים לאותו דגם בו אנו רוצים להשתמש. במקרה זה, אנו מכווננים huggingface-textgeneration1-gpt-j-6b.

הגדרת היפרפרמטרים כרוכה בהגדרת הערכים עבור פרמטרים שונים המשמשים במהלך תהליך האימון של מודל ML. פרמטרים אלו יכולים להשפיע על הביצועים והדיוק של המודל. בשלב הבא, אנו קובעים את הפרמטרים ההיפר על ידי שימוש בהגדרות ברירת המחדל וציון ערכים מותאמים אישית עבור פרמטרים כגון epochs ו learning_rate:

JumpStart מספק רשימה נרחבת של היפרפרמטרים הזמינים לכיוון. הרשימה הבאה מספקת סקירה כללית של חלק מפרמטרי ההיפר-פרמטרים העיקריים המשמשים לכוונון עדין של המודל. לרשימה מלאה של היפרפרמטרים, עיין במחברת כוונון עדין של יצירת טקסט מודל GPT-J 6B על מערך נתונים ספציפי לתחום.

- תקופות – מציין לכל היותר כמה עידנים של מערך הנתונים המקורי יחזרו.

- שיעור_למידה - שולט בגודל הצעד או קצב הלמידה של אלגוריתם האופטימיזציה במהלך האימון.

- eval_steps – מציין כמה שלבים לרוץ לפני הערכת המודל על ערכת האימות במהלך האימון. ערכת האימות היא תת-קבוצה של הנתונים שאינה משמשת לאימון, אלא משמשת לבדיקת ביצועי המודל על נתונים בלתי נראים.

- משקל_דעיכה - שולט בכוח הסדירות במהלך אימון המודל. רגוליזציה היא טכניקה שעוזרת למנוע מהמודל להתאים יתר על המידה את נתוני האימון, מה שעלול לגרום לביצועים טובים יותר בנתונים בלתי נראים.

- fp16 - שולט אם להשתמש באימון דיוק של fp16 16 סיביות (מעורבות) במקום אימון 32 סיביות.

- evaluation_strategy – אסטרטגיית ההערכה המשמשת במהלך האימון.

- צעדי_צבירת_הדרגה – מספר שלבי העדכונים שעבורם יש לצבור את ההדרגות לפני ביצוע מעבר אחורה/עדכון.

לפרטים נוספים לגבי היפרפרמטרים, פנה לגורם הרשמי תיעוד של מאמן פנים מחבק.

כעת תוכל לכוונן מודל JumpStart זה במערך הנתונים המותאם אישית שלך באמצעות ה-SDK של SageMaker. אנו משתמשים בנתוני הגשת ה-SEC שתיארנו קודם לכן. נתוני הרכבת והאימות מתארחים תחת train_dataset_s3_path ו validation_dataset_s3_path. הפורמט הנתמך של הנתונים כולל CSV, JSON ו-TXT. עבור נתוני ה-CSV וה-JSON, נעשה שימוש בנתוני הטקסט מהעמודה שנקראת text או העמודה הראשונה אם לא נמצאה עמודה בשם טקסט. מכיוון שזה מיועד לכוונון עדין של יצירת טקסט, אין צורך בתוויות של אמת יסוד. הקוד הבא הוא דוגמה של SDK כיצד לכוונן את המודל:

לאחר שהגדרנו את SageMaker Estimator עם ההיפרפרמטרים הנדרשים, אנו מייצרים מעריך SageMaker וקוראים ל- .fit שיטה להתחיל לכוונן את המודל שלנו, להעביר אותו את שירות אחסון פשוט של אמזון (Amazon S3) URI לנתוני האימונים שלנו. כפי שאתה יכול לראות, ה entry_point התסריט שסופק נקרא בשם transfer_learning.py (זהה עבור משימות ומודלים אחרים), וערוץ נתוני הקלט שהועבר אליו .fit חייב להיות שם רכבת ואימות.

JumpStart תומך גם באופטימיזציה של היפרפרמטרים עם כוונון הדגם האוטומטי של SageMaker. לפרטים, עיין בדוגמה מחברה.

פרוס את הדגם המכוונן

בסיום ההכשרה, תוכל לפרוס את המודל המכוונן שלך. לשם כך, כל מה שאנחנו צריכים להשיג הוא ה-URI של הסקת ההסקה (הקוד שקובע כיצד המודל משמש להסקת מסקנות לאחר פריסה) ואת ה-URI של תמונת מיכל ההסקה, הכוללת שרת מודל מתאים לארח את הדגם שבחרנו. ראה את הקוד הבא:

לאחר מספר דקות, המודל שלנו נפרס ונוכל לקבל ממנו תחזיות בזמן אמת!

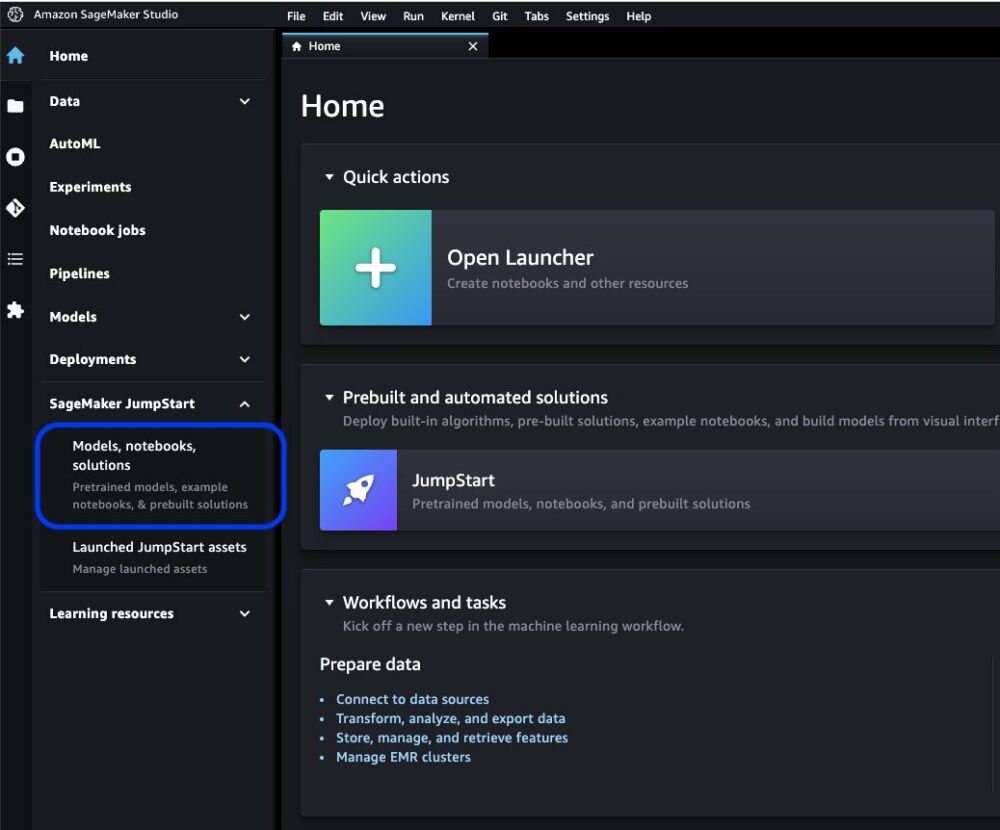

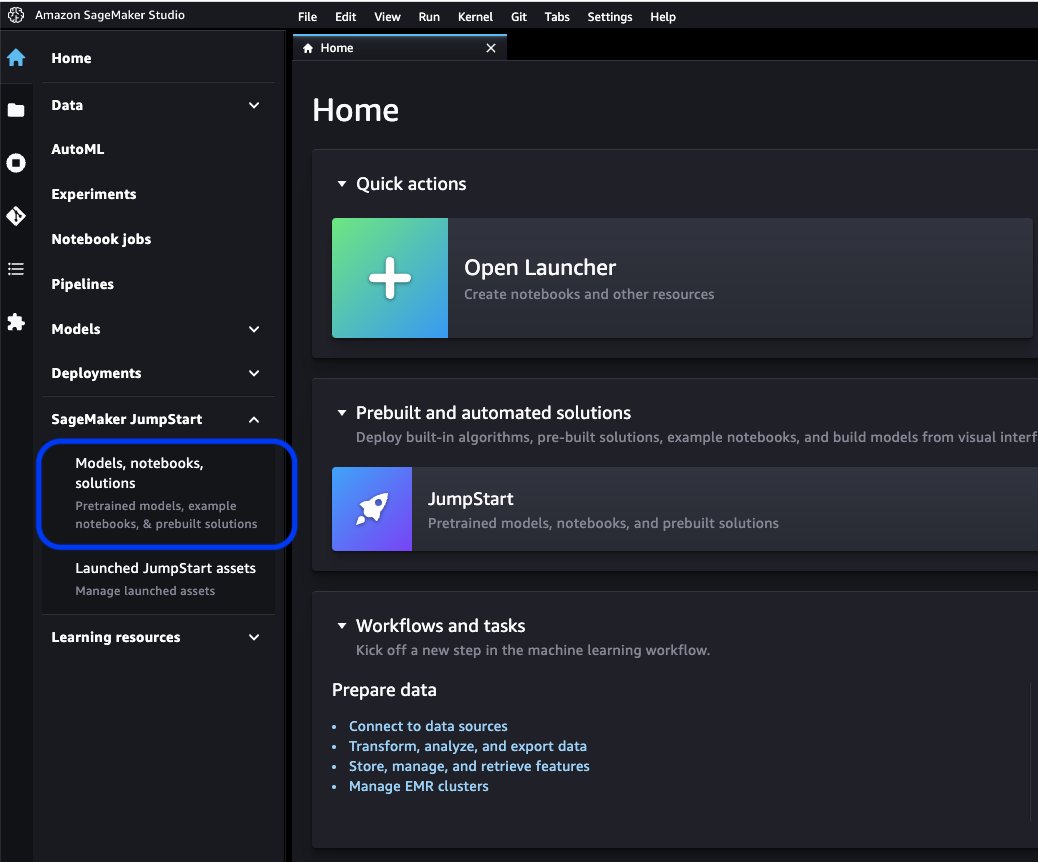

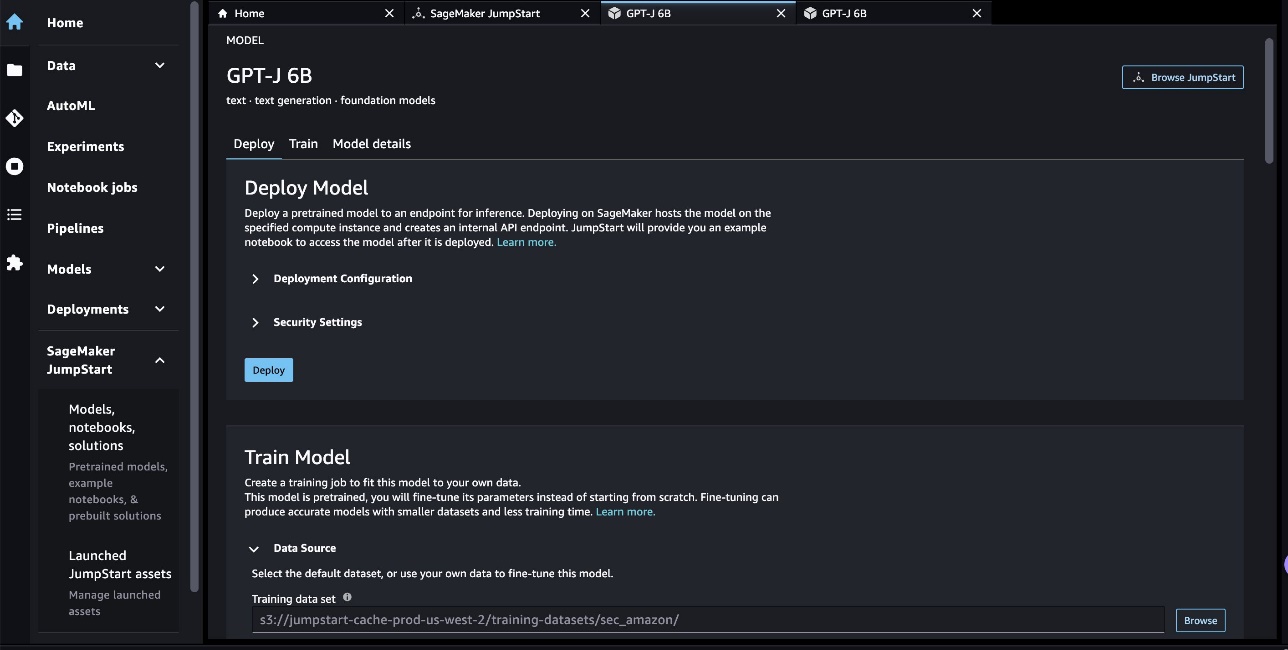

גש ל-JumpStart דרך ממשק המשתמש של Studio

דרך נוספת לכוונן ולפרוס דגמי JumpStart היא דרך ממשק המשתמש של Studio. ממשק משתמש זה מספק פתרון דל קוד/ללא קוד לכוונון עדין של LLMs.

במסוף Studio, בחר דגמים, מחברות, פתרונות תחת SageMaker JumpStart בחלונית הניווט.

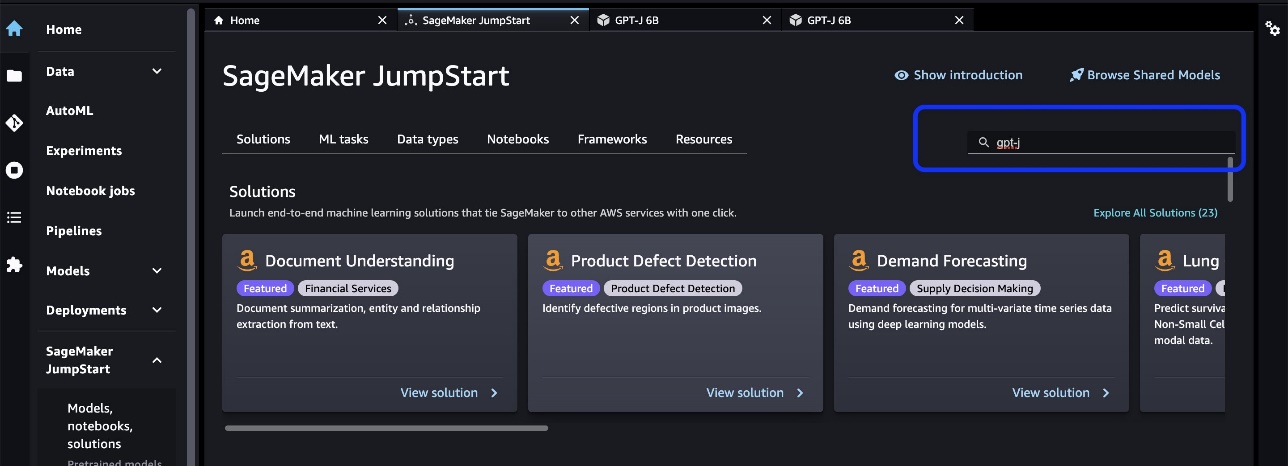

בשורת החיפוש, חפש את הדגם שברצונך לכוונן ולפרוס.

במקרה שלנו, בחרנו בכרטיס הדגם GPT-J 6B. כאן נוכל לכוונן או לפרוס את ה-LLM ישירות.

הערכת מודל

בעת הערכת LLM, אנו יכולים להשתמש בבלבול (PPL). PPL הוא מדד נפוץ למידת היכולת של מודל שפה לחזות את המילה הבאה ברצף. במילים פשוטות יותר, זו דרך למדוד עד כמה המודל יכול להבין וליצור שפה דמוית אדם.

ציון תמיהה נמוך יותר אומר שהמודל מציג ביצועים טובים יותר בחיזוי המילה הבאה. במונחים מעשיים, אנו יכולים להשתמש בתמיהה כדי להשוות מודלים שונים של שפה ולקבוע איזה מהם מתפקד טוב יותר במשימה נתונה. אנחנו יכולים גם להשתמש בו כדי לעקוב אחר הביצועים של דגם בודד לאורך זמן. לפרטים נוספים, עיין ב תמיהה של דגמים באורך קבוע.

אנו מעריכים את ביצועי המודל באמצעות השוואה של הביצועים לפני ואחרי כוונון עדין. PPL נפלט בעבודת ההדרכה אמזון CloudWatch יומנים. בנוסף, אנו מסתכלים על הפלט שנוצר על ידי המודל בתגובה להנחיות בדיקה ספציפיות.

| מדד הערכה על נתוני האימות | לפני כוונון עדין | לאחר כוונון עדין |

| תמיהה (PPL) | 8.147 | 1.437 |

הביצועים המשופרים של המודל מודגמים על ידי שני ניסויים:

- יצירת טקסטים – אנו מראים כי הפלט שה-GPT-J המכוונן יוצר טקסט בעל דמיון למערך הנתונים של SEC, מה שמצביע על כך שהוא למד לחקות את דפוסי השפה והמוסכמות של תחום הרגולציה הפיננסית

- למידה אפסית - אנו מדגימים שה-GPT-J המכוונן מראה ביצועים טובים יותר משמעותית מה-GPT-J הלא-מכוונן בתשובה לשאלה עם צילום אפס

עבור הניסוי של יצירת טקסט, אנו משתמשים בפרמטרי ההסקה הבאים כדי להשיג את התוצאות שלנו: max_length של 400 (מספר האסימונים שהוחזרו), num_return_sequences מתוך 1 (מספר דוגמאות לטקסט תגובה), top_k מתוך 250 (בחר מתוך אחד מ-250 המשכים האפשריים המובילים), top_p של 0.8 (בחר רק מתוך המשכים שסבירים לפחות 80%), do_sample is True (דגימה), ו temperature של 1 (טמפרטורה גבוהה היא אקראיות גדולה יותר בתגובות). לפרטים נוספים על הפרמטרים, עיין ב GenerationConfig. הטבלה הבאה משווה את ה-GPT-J המכוונן והלא מכוון במשימת השלמת טקסט.

| דוגמה להסקת מסקנות | פלט מ-GPT-J 6B לפני כוונון עדין | פלט מ-GPT-J 6B לאחר כוונון עדין |

| דוח טופס 10-K זה מראה זאת |

דוח טופס 10-K זה מראה כי: הרווח הנקי של החברה המיוחס לחברה לשנה שהסתיימה ב-31 בדצמבר 2016 היה 3,923,000 דולר, או 0.21 דולר למניה בדילול, בהשוואה ל-3,818,000 דולר או 0.21 דולר למניה בדילול, בשנה שהסתיימה ב-31 בדצמבר 2015. הרווח הנקי של החברה המיוחס לחברה לשנה שהסתיימה ב-31 בדצמבר 2016 היה 4,816,000 דולר, או 0.28 דולר למניה בדילול, בהשוואה ל-4,726,000 דולר או 0.27 דולר למניה בדילול, בשנה שהסתיימה ב-31 בדצמבר 2015. הרווח הנקי של החברה המיוחס לחברה לשנה שהסתיימה ב-31 בדצמבר 2016 היה 5,828,000 דולר, או 0.34 דולר למניה בדילול, בהשוואה ל-5,716,000 דולר או 0.33 דולר למניה בדילול, בשנה שהסתיימה ב-31 בדצמבר 2015. ב-21 באוגוסט 2009 הגישה החברה טופס 10-Q עבור הרבעון שהסתיים ב-31 בדצמבר 2008. ב-21 באוגוסט 2009 הגישה החברה טופס 10-Q עבור הרבעון שהסתיים ב-30 בספטמבר 2008. ב-21 באוגוסט 2009 הגישה החברה טופס 10-Q עבור הרבעון שהסתיים ב-31 במרץ 2009. |

דוח טופס 10-K זה מראה כי:(1) שמו, כתובתו ומספר הטלפון של הנרשם, הם כדלקמן:Amazon.com, Inc. c/o Ernst & Young LLPSeattle, וושינגטון שימו לב: מזכיר החברה (2) עבור מטרת סעיף III של חוק בורסת ניירות ערך משנת 1934, שמו וכתובתו של הנרשם הם כדלקמן:(3) פרק הזמן שניתן לדווח על חוק הבורסה של הנרשם הוא מ-1 בינואר 2020 ועד היום.(4) ההערכה הסובייקטיבית של הנרשם היא כי הדוחות הכספיים, ומידע פיננסי אחר הכלולים בדוח זה, מציגים בצורה הוגנת מכל הבחינות המהותיות את מצבו הכספי, תוצאות הפעילות ותזרימי המזומנים של הנרשם נכון לתקופות המוצגות בדוח זה, ולמשך, (5) הנהלת הנרשם. ההערכה היא שהדוחות הכספיים, ומידע פיננסי אחר הכלולים בדוח זה, מציגים בצורה הוגנת מכל הבחינות המהותיות את המצב הפיננסי, תוצאות הפעילות ותזרימי המזומנים של הנרשם נכון לתקופות המוצגות בדוח זה ולמשך התקופות המוצגות בדוח זה. & Young LLPSeattle, Washington, 29 בינואר, 2020EX-31.1 5 amzn-20201231xex311.htm EX-31.1 DocumentExhibit 31.1CERTIFICATIONSI, Andrew R. Jassy, מאשרים כי:1. סקרתי את טופס 10-K זה של Amazon.com, Inc.;2. בהתבסס על ידיעתי, דו"ח זה אינו מכיל כל הצהרה לא נכונה של עובדה מהותית או השמטת לציין עובדה מהותית הנחוצה להצהרות שנמסרו, לאור הנסיבות שבהן הצהרות אלה נאמרו, ואינה מטעה ביחס לתקופה המכוסה על ידי זה. להגיש תלונה; |

| אנו משרתים את הצרכנים באמצעות |

אנו משרתים את הצרכנים באמצעות: הבלוג שלנו האם אתה בעל עסק שמעוניין להרחיב את העסק שלך? רוצים ליצור עסק אפקטיבי ויעיל יותר? רוצה ללמוד איך להצמיח את העסק שלך? אם ענית "כן" על כל אחת מהשאלות האלה, אז אתה צריך לקרוא את המאמר הזה. הצעד הראשון להגדלת העסק שלך הוא להבין את העסק שלך. עליך להיות מסוגל לענות על השאלות הבאות לגבי העסק שלך: מי הם הלקוחות שלך? מה המוצר או השירות שלך? מה הצעת המכירה הייחודית שלך? מהי האסטרטגיה השיווקית שלך? מהי תחזית המכירות שלך? מהי תחזית המכירות שלך? מהי תחזית המכירות שלך? מהי תחזית המכירות שלך? מהי תחזית המכירות שלך? |

אנו משרתים צרכנים באמצעות: Amazon.com, קמעונאית של מוצרים פיזיים ודיגיטליים; Amazon Web Services, המספקת שירותי תשתית טכנולוגית המאפשרים למעשה כל סוג של עסקים; Amazon Enterprise Solutions, המספקת לחברות טכנולוגיה ושירותים מותאמים אישית כדי לאפשר תהליכים עסקיים טובים יותר ולשפר את היעילות והפרודוקטיביות; ו-Audible, מוציאה לאור של ספרי שמע דיגיטליים. אנו משרתים מפתחים וארגונים מכל הגדלים באמצעות AWS, המציעה מערך רחב של הצעות מחשוב, אחסון, מסד נתונים ושירותים אחרים. אנו גם מייצרים ומוכרים מכשירים אלקטרוניים. ארגנו את הפעילות שלנו בשני מגזרים עיקריים: צפון אמריקה והבינלאומי. ראה סעיף 8 של חלק ב', ""דוחות כספיים ונתונים משלימים - הערה 12 - מידע מגזרי." ראה סעיף 7 של חלק ב', ""דיון וניתוח ההנהלה של המצב הפיננסי ותוצאות הפעילות - תוצאות הפעילות - מידע משלים" " למידע משלים על המכירות נטו שלנו. צרכנים אנו משרתים את הצרכנים דרך החנויות המקוונות והפיזיות שלנו ומתמקדים במבחר, במחיר ונוחות. אנו מעצבים את החנויות שלנו כדי לאפשר למכור מאות מיליוני מוצרים ייחודיים על ידינו ועל ידי צדדים שלישיים בעשרות קטגוריות מוצרים. לקוחות ניגשים להצעות שלנו דרך אתרי האינטרנט שלנו, האפליקציות לנייד, Alexa וביקור פיזי בחנויות שלנו. אנו גם מייצרים ומוכרים מכשירי Kindledevices. אנו שואפים להציע ללקוחותינו את המחירים הנמוכים ביותר האפשריים באמצעות תמחור מוצרים יומיומיים והצעות משלוח נמוכות, ולשפר את יעילות התפעול שלנו כך שנוכל להמשיך ולהוזיל את המחירים עבור הלקוחות שלנו. אנו מספקים גם פונקציונליות קלה לשימוש, מילוי מהיר ואמין ושירות לקוחות בזמן. בנוסף, אנו מציעים את Amazon Prime, תוכנית חברות הכוללת משלוח חינם ללא הגבלה על למעלה מ-100 מיליון פריטים, גישה להזרמה בלתי מוגבלת של עשרות אלפי סרטים ו פרקי טלוויזיה והטבות נוספות. |

| השנה אנחנו מתמקדים במיוחד |

השנה אנו מתמקדים במיוחד ב: תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת תפקידה של מערכת הבריאות במניעת השמנת יתר וסוכרת |

השנה אנו מתמקדים במיוחד ב: - המשך התרחבות בינלאומית, לרבות פיתוח עסקים חדשים בפלחי שוק בינלאומיים קיימים, וכן בפיתוח של פלחי שוק בינלאומיים חדשים; -הרחבת בסיס הלקוחות שלנו, כולל הגדלת מכירות ללקוחות קיימים ומשיכת לקוחות חדשים; -פיתוח הזדמנויות עסקיות חדשות והתקשרות בהסכמים מסחריים, לרבות באמצעות רישוי והסדרים אחרים, עם חברות אחרות, או באמצעות רכישת חברות אחרות; -פיתוח טכנולוגיה המספקת שירות לקוחות משופר ומספקת ביעילות את המוצרים והשירותים שלנו; -פיתוח הצעות מוצרים ושירותים חדשים ושילוב אלה בהצעות מוצרים ושירותים קיימים וחדשים; -פיתוח מערכות יעילות ואפקטיביות לתמיכה בעסק שלנו; וכן -יוזמות עסקיות ואסטרטגיות אחרות. אנו מאמינים שהצעת מחירים נמוכים ללקוחותינו היא הבסיסית להצלחתנו העתידית. אחת הדרכים שבהן אנו מציעים מחירים נמוכים יותר היא באמצעות הצעות משלוח חינם שמביאות לעלות נטו עבורנו באספקת מוצרים, ודרך חברות באמזון פריים, המספקת משלוח חינם של מיליוני פריטים וגישה לסרטים ותכנים אחרים. אנו מציעים גם מבצעים אחרים המאפשרים לנו להפוך עלות נטו נמוכה יותר של מכירות. ארגנו את הפעילות שלנו לשני פלחים עיקריים: צפון אמריקה ובינלאומי. ראה סעיף 8 של חלק ב', ""דוחות כספיים ונתונים משלימים - הערה 12 - מידע מגזרי." למידע משלים על המכירות נטו שלנו. צרכנים אנו משרתים את הצרכנים דרך אתרי האינטרנט הקמעונאיים והחנויות הפיזיות שלנו ומתמקדים בבחירה, מחיר ונוחות. |

עבור הניסוי השני עם משימת תשובה לשאלה אפס, הגדרנו את max_length להיות ערך שונה (40, 200 ו-40, בהתאמה) על סמך הפלט שאנו מצפים מכל שאלה. הפרמטרים של top_k, top_p, do_sample, temperature מוגדרים כ-250, 0.8, False, ו-0, בהתאמה. הגדרנו את הטמפרטורה קרוב ל-0 כדי לשלוט באקראיות של הפלט, בעוד שבמטלת יצירת הטקסט הגדרנו אותה קרוב ל-1 כדי להפוך את המודל ליצירתי יותר. הטבלה הבאה משווה את התוצאות. עבור כל שאלה, הפלט מ-GPT-J המכוונן עדין הוא מדויק יותר מזה שאינו מכוון.

| קֶלֶט | פלט מ-GPT-J 6B לפני כוונון עדין | פלט מ-GPT-J 6B לאחר כוונון עדין |

| על מה עוסק פריט 7 בהגשת 10-K SEC?: |

על מה עוסק פריט 7 בהגשת 10-K SEC?: פריט 7 בהגשת 10-K SEC הוא הבא: "החברה לא קיבלה כל פגיעה מהותית |

סעיף 7. דיון וניתוח של ההנהלה על המצב הפיננסי ותוצאות הפעילות הצהרות צופות פני עתיד |

| כיצד השפיעה מגיפת COVID-19 על העסקים של אמזון?: |

כיצד השפיעה מגיפת COVID-19 על העסקים של אמזון?: העסקים של אמזון מושפעים ממגיפת COVID-19 במספר דרכים. החברה רואה ירידה במספר החברות בפריים, שהיא חלק גדול מהעסקים שלה. כמו כן, החברה רואה ירידה במספר החברות בפריים. אמזון גם רואה ירידה במספר ההזמנות שבוצעו באתר האינטרנט שלה. החברה גם רואה ירידה במספר האנשים שקונים באתר שלה. אמזון גם רואה ירידה במספר האנשים שקונים באתר שלה. אמזון גם רואה ירידה במספר האנשים שקונים באתר שלה. אמזון גם רואה ירידה במספר האנשים שקונים באתר שלה. אמזון גם רואה ירידה במספר האנשים שעושים קניות |

כיצד השפיעה מגיפת ה-COVID-19 על העסקים של אמזון?: מגיפת ה-COVID-19 השפיעה על העסק שלנו בכמה דרכים. ראשית, זה שיבש את שרשרת האספקה שלנו, וזה השפיע על הביקוש של הלקוחות, אשר בתורו השפיע על המכירות והתפעול שלנו. שנית, זה הגדיל את ההוצאה שלנו על פרסום ושיווק, מה שאולי לא יהיה אפקטיבי בטווח הארוך. שלישית, זה הגדיל את ההוצאה שלנו על תשתית טכנולוגית ויכולת מחשוב, שאולי לא תהיה אפקטיבית בטווח הארוך. רביעית, זה הגדיל את ההוצאה שלנו על הגשמה ושירות לקוחות, מה שאולי לא יהיה יעיל בטווח הארוך. לבסוף, זה הגדיל את ההוצאה שלנו על תוכן, מה שאולי לא יהיה יעיל בטווח הארוך. ראה סעיף 8 של חלק ב', "דוחות כספיים ונתונים משלימים - ביאור 1 - תיאור המדיניות העסקית והחשבונאית. |

| מה מניע את צמיחת המכירות באמזון?: | אמזון היא הקמעונאית המקוונת הגדולה בעולם. זהו גם השוק המקוון הגדול בעולם. זה גם העולם' | צמיחת המכירות באמזון מונעת בעיקר על ידי שימוש מוגבר של לקוחות, לרבות מבחר מוגבר, מחירים נמוכים יותר והגברת הנוחות, והגדלת המכירות על ידי מוכרים אחרים באתרים שלנו. |

לנקות את

כדי להימנע מחיובים מתמשכים, מחק את נקודות הקצה של SageMaker. אתה יכול למחוק את נקודות הקצה דרך מסוף SageMaker או מהמחברת באמצעות הפקודות הבאות:

סיכום

JumpStart היא יכולת ב- SageMaker המאפשרת לך להתחיל במהירות עם ML. JumpStart משתמש בקוד פתוח, מודלים מאומנים מראש כדי לפתור בעיות ML נפוצות כמו סיווג תמונה, זיהוי אובייקטים, סיווג טקסט, סיווג צמד משפטים ומענה לשאלות.

בפוסט זה, הראינו לכם כיצד לכוונן ולפרוס LLM (GPT-J 6B) מאומן מראש ליצירת טקסט על בסיס מערך המילוי של SEC. הדגמנו כיצד המודל הפך למומחה בתחום הפיננסים על ידי ביצוע תהליך כוונון עדין בשני דוחות שנתיים בלבד של החברה. כוונון עדין זה אפשר למודל לייצר תוכן עם הבנה של נושאים פיננסיים ודיוק רב יותר. נסה את הפתרון בעצמך וספר לנו איך זה הולך בתגובות.

חשוב: פוסט זה מיועד למטרות הדגמה בלבד. זה לא ייעוץ פיננסי ואין להסתמך עליו כייעוץ פיננסי או השקעות. הפוסט השתמש במודלים שהוכשרו מראש על נתונים שהתקבלו ממסד הנתונים של SEC EDGAR. אתה אחראי לעמידה בתנאי הגישה של EDGAR אם אתה משתמש בנתוני SEC.

למידע נוסף על JumpStart, עיין בפוסטים הבאים:

על הכותבים

ד"ר שין הואנג הוא מדען יישומי בכיר עבור האלגוריתמים המובנים של Amazon SageMaker JumpStart ו-Amazon SageMaker. הוא מתמקד בפיתוח אלגוריתמים של למידת מכונה ניתנים להרחבה. תחומי העניין שלו במחקר הם בתחום של עיבוד שפה טבעית, למידה עמוקה הניתנת להסבר על נתונים טבלאיים וניתוח חזק של צבירת מרחב-זמן לא פרמטרית. הוא פרסם מאמרים רבים בכנסים של ACL, ICDM, KDD וב-Royal Statistic Society: Series A.

ד"ר שין הואנג הוא מדען יישומי בכיר עבור האלגוריתמים המובנים של Amazon SageMaker JumpStart ו-Amazon SageMaker. הוא מתמקד בפיתוח אלגוריתמים של למידת מכונה ניתנים להרחבה. תחומי העניין שלו במחקר הם בתחום של עיבוד שפה טבעית, למידה עמוקה הניתנת להסבר על נתונים טבלאיים וניתוח חזק של צבירת מרחב-זמן לא פרמטרית. הוא פרסם מאמרים רבים בכנסים של ACL, ICDM, KDD וב-Royal Statistic Society: Series A.

מארק קארפ הוא אדריכל ML בצוות שירות Amazon SageMaker. הוא מתמקד בסיוע ללקוחות לתכנן, לפרוס ולנהל עומסי עבודה של ML בקנה מידה. בזמנו הפנוי הוא נהנה לטייל ולחקור מקומות חדשים.

מארק קארפ הוא אדריכל ML בצוות שירות Amazon SageMaker. הוא מתמקד בסיוע ללקוחות לתכנן, לפרוס ולנהל עומסי עבודה של ML בקנה מידה. בזמנו הפנוי הוא נהנה לטייל ולחקור מקומות חדשים.

ד"ר סנג'יב דאס הוא מלומד באמזון והפרופסור טרי למימון ומדעי הנתונים באוניברסיטת סנטה קלרה. הוא בעל תארים מתקדמים במימון (M.Phil ודוקטורט מאוניברסיטת ניו יורק) ומדעי המחשב (MS מאוניברסיטת ברקלי), ותואר שני במנהל עסקים מהמכון ההודי לניהול, אחמדאבאד. לפני שהיה אקדמאי, הוא עבד בעסקי הנגזרים באזור אסיה-פסיפיק כסגן נשיא בסיטיבנק. הוא עובד על למידת מכונה מולטי-מודאלית בתחום היישומים הפיננסיים.

ד"ר סנג'יב דאס הוא מלומד באמזון והפרופסור טרי למימון ומדעי הנתונים באוניברסיטת סנטה קלרה. הוא בעל תארים מתקדמים במימון (M.Phil ודוקטורט מאוניברסיטת ניו יורק) ומדעי המחשב (MS מאוניברסיטת ברקלי), ותואר שני במנהל עסקים מהמכון ההודי לניהול, אחמדאבאד. לפני שהיה אקדמאי, הוא עבד בעסקי הנגזרים באזור אסיה-פסיפיק כסגן נשיא בסיטיבנק. הוא עובד על למידת מכונה מולטי-מודאלית בתחום היישומים הפיננסיים.

ארון קומאר לוקנת'ה הוא אדריכל בכיר ML Solutions בצוות Amazon SageMaker Service. הוא מתמקד בסיוע ללקוחות לבנות, להכשיר ולהעביר עומסי עבודה של ייצור ML ל-SageMaker בקנה מידה. הוא מתמחה בלמידה עמוקה, במיוחד בתחום ה-NLP וה-CV. מחוץ לעבודה, הוא נהנה לרוץ ולטייל.

ארון קומאר לוקנת'ה הוא אדריכל בכיר ML Solutions בצוות Amazon SageMaker Service. הוא מתמקד בסיוע ללקוחות לבנות, להכשיר ולהעביר עומסי עבודה של ייצור ML ל-SageMaker בקנה מידה. הוא מתמחה בלמידה עמוקה, במיוחד בתחום ה-NLP וה-CV. מחוץ לעבודה, הוא נהנה לרוץ ולטייל.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- Platoblockchain. Web3 Metaverse Intelligence. ידע מוגבר. גישה כאן.

- הטבעת העתיד עם אדריאן אשלי. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/financial-text-generation-using-a-domain-adapted-fine-tuned-large-language-model-in-amazon-sagemaker-jumpstart/

- :יש ל

- :הוא

- $3

- $ למעלה

- 000

- 1

- 100

- 11

- 2016

- 2020

- 28

- 7

- 8

- 9

- a

- יכולות

- יכול

- אודות

- אקדמי

- גישה

- חשבונאות

- לצבור

- דיוק

- מדויק

- להשיג

- רכישה

- לרוחב

- לפעול

- הוסיף

- תכונות נוספות

- תוספת

- בנוסף

- כתובת

- פרסום

- עצה

- להשפיע על

- לאחר

- נגד

- AI

- Alexa

- אַלגוֹרִיתְם

- אלגוריתמים

- תעשיות

- מאפשר

- למרות

- אמזון בעברית

- אמזון SageMaker

- אמזון SageMaker JumpStart

- אמזון שירותי אינטרנט

- Amazon.com

- אמריקה

- כמויות

- אנליזה

- לנתח

- ו

- אנדרו

- שנתי

- אחר

- לענות

- כל

- כל אחד

- API

- יישומים

- יישומית

- גישה

- מתאים

- אפליקציות

- ARE

- AREA

- מאמר

- AS

- הערכה

- At

- תשומת לב

- למשוך

- אוגוסט

- מכני עם סלילה אוטומטית

- זמין

- AWS

- בָּר

- בסיס

- מבוסס

- BE

- כי

- להיות

- היה

- לפני

- להיות

- תאמינו

- הטבות

- ברקלי

- מוטב

- גָדוֹל

- מיליארדים

- רחב

- לִבנוֹת

- מובנה

- עסקים

- by

- שיחה

- נקרא

- שיחות

- CAN

- יכול לקבל

- מסוגל

- קיבולת

- כרטיס

- אשר

- מקרה

- מקרים

- לאשר

- שרשרת

- האתגרים

- ערוץ

- חיובים

- chatbots

- לבדוק

- בחרו

- בחר

- נבחר

- בנסיבות

- סיטיבנק

- קלרה

- מיון

- סְגוֹר

- קיבוץ

- קוד

- טור

- COM

- הערות

- Common

- בדרך כלל

- קהילה

- חברות

- חברה

- של החברה

- לְהַשְׁווֹת

- לעומת

- השוואה

- השוואה

- להשלים

- השלמה

- לחשב

- המחשב

- מדעי מחשב

- מחשוב

- - כוח מחשוב

- מצב

- תנאים

- כנסים

- לשקול

- נחשב

- קונסול

- בנייה

- צרכנים

- להכיל

- מכולה

- מכיל

- תוכן

- להמשיך

- לִשְׁלוֹט

- בקרות

- נוחות

- משותף

- תוֹאֵם

- עלות

- מכוסה

- מכסה

- תקופת הקורונה

- מגיפת COVID-19

- לִיצוֹר

- יְצִירָתִי

- קריטי

- כיום

- מנהג

- לקוח

- שירות לקוחות

- לקוחות

- נתונים

- מדע נתונים

- מסד נתונים

- מערכי נתונים

- דֵצֶמבֶּר

- ירידה

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- אספקה

- מספק

- דרישה

- להפגין

- מופגן

- לפרוס

- פרס

- פריסה

- נגזרים

- מְתוּאָר

- תיאור

- עיצוב

- מעוצב

- פרטים

- איתור

- לקבוע

- קובע

- מפתחים

- מתפתח

- צעצועי התפתחות

- התקנים

- DID

- אחר

- קשה

- דיגיטלי

- ישירות

- חשיפה

- לדון

- דיון

- מופץ

- הכשרה מבוזרת

- סַוָר

- מסמכים

- תחום

- עשרות

- מונע

- בְּמַהֲלָך

- כל אחד

- מוקדם יותר

- בקלות

- קל לשימוש

- אפקטיבי

- יעילות

- יְעִילוּת

- יעיל

- אֶלֶקטרוֹנִי

- לאפשר

- מופעל

- נקודת קצה

- משופר

- מִפְעָל

- חברות

- שלם

- ישות

- תקופות

- ארנסט אנד יאנג

- במיוחד

- להקים

- להעריך

- הערכה

- הערכה

- כל יום

- הכל

- דוגמה

- דוגמאות

- אלא

- חליפין

- תרגיל

- קיימים

- הרחבה

- לצפות

- תוחלת

- יקר

- לְנַסוֹת

- מומחה

- היכרות

- נרחב

- פָּנִים

- מהר

- תכונות

- מעטים

- שדה

- שלח

- תיוק

- בסופו של דבר

- לממן

- כספי

- יעוץ פיננסי

- מידע פיננסי

- סוף

- ראשון

- מתאים

- להתמקד

- מתמקד

- הבא

- כדלקמן

- בעד

- עבור משקיעים

- תַחֲזִית

- בחזית

- טופס

- פוּרמָט

- צופה פני עתיד

- מצא

- רביעית

- החל מ-

- מלא

- פונקציונלי

- יסודי

- נוסף

- עתיד

- ליצור

- נוצר

- מייצר

- דור

- לקבל

- נתן

- גלוֹבָּלִי

- Go

- Goes

- הולך

- טוב

- GPUs

- שיפועים

- יותר

- קרקע

- לגדול

- גדל

- צמיחה

- חומרה

- יש

- he

- בְּרִיאוּת

- בריאות הציבור

- עזרה

- עוזר

- כאן

- גָבוֹהַ

- ביצועים גבוהים

- מחזיק

- ברדס

- המארח

- אירח

- איך

- איך

- HTML

- http

- HTTPS

- חיבוק פנים

- מאות

- מאות מיליונים

- אופטימיזציה של היפר-פרמטרים

- i

- רעיון

- מזוהה

- תמונה

- סיווג תמונות

- פְּגִיעָה

- מושפעים

- לייבא

- מרשים

- לשפר

- השבחה

- in

- בע"מ

- לכלול

- כלול

- כולל

- כולל

- הַכנָסָה

- שילוב

- להגדיל

- גדל

- גדל

- מדהים

- הוֹדִי

- מידע

- תשתית

- יוזמות

- קלט

- למשל

- במקום

- מכון

- לשלב

- אינטראקציה

- אינטרסים

- ברמה בינלאומית

- מבוא

- השקעה

- Investopedia

- משקיע

- משקיעים

- IT

- פריטים

- שֶׁלָה

- עבודה

- jpg

- ג'סון

- מפתח

- לדעת

- ידע

- ידוע

- תוויות

- שפה

- שפות

- גָדוֹל

- הגדול ביותר

- לשגר

- לִלמוֹד

- למד

- למידה

- סִפְרִיָה

- רישוי

- אוֹר

- כמו

- רשימה

- LLM

- ארוך

- נראה

- הסתכלות

- את

- נמוך

- מחירים נמוכים

- מכונה

- למידת מכונה

- עשוי

- גדול

- לעשות

- עשייה

- לנהל

- ניהול

- באופן ידני

- רב

- צעדה

- שוק

- שיווק

- שוק

- מסיבי

- חוֹמֶר

- מאי..

- אומר

- למדוד

- חֲבֵרוּת

- חברויות

- זכרון

- שיטה

- מטרי

- נודד

- מִילִיוֹן

- מיליונים

- דקות

- מעורב

- ML

- סלולרי

- -לאפליקציות לנייד

- מודל

- מודלים

- יותר

- רוב

- סרטים

- MS

- מספר

- שם

- שם

- טבעי

- עיבוד שפה טבעית

- ניווט

- הכרחי

- צורך

- נטו

- חדש

- מוצר חדש

- ניו יורק

- הבא

- NLP

- צומת

- צפון

- צפון אמריקה

- מחברה

- מספר

- השמנה

- אובייקט

- זיהוי אובייקט

- להשיג

- מושג

- of

- הַצָעָה

- הצעה

- הצעות

- המיוחדות שלנו

- on

- ONE

- מתמשך

- באינטרנט

- שוק מקוון

- קמעונאי מקוון

- קוד פתוח

- פועל

- תפעול

- הזדמנויות

- אופטימיזציה

- להזמין

- הזמנות

- מאורגן

- מְקוֹרִי

- אחר

- שלנו

- Outlook

- תפוקה

- בחוץ

- יותר

- לעקוף

- סקירה

- שֶׁלוֹ

- בעלים

- מגיפה

- זגוגית

- ניירות

- פרמטרים

- חלק

- מסוים

- במיוחד

- צדדים

- לעבור

- עבר

- חולף

- נתיב

- דפוסי

- אֲנָשִׁים

- לְבַצֵעַ

- ביצועים

- ביצוע

- מבצע

- תקופה

- תקופות

- פיל

- גופני

- פיזית

- לבחור

- מקומות

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- מדיניות

- אפשרי

- הודעה

- הודעות

- פוטנציאל

- כּוֹחַ

- מעשי

- דיוק

- לחזות

- ניבוי

- התחזיות

- חיזוי

- להציג

- מוצג

- נשיא

- למנוע

- מניעה

- קודם

- מחיר

- מחירים

- תמחור

- בראש ובראשונה

- ראשוני

- מנהל

- קודם

- בעיות

- תהליך

- תהליכים

- תהליך

- המוצר

- הפקה

- פִּריוֹן

- מוצרים

- פרופסור

- תָכְנִית

- מבצע

- הצעה

- לספק

- ובלבד

- מספק

- בפומבי

- לאור

- מוציא לאור

- מטרה

- למטרות

- פיתון

- רובע

- שאלה

- שאלות

- מהירות

- אקראי

- ציון

- חומר עיוני

- ממשי

- קיבלו

- להפחית

- מתייחס

- בדבר

- regex

- באזור

- תקנה

- רגולטורים

- קָשׁוּר

- שוחרר

- לדווח

- דוחות לדוגמא

- נדרש

- דורש

- מחקר

- משאבים

- כבוד

- תגובה

- אחראי

- תוצאה

- תוצאות

- קמעוני

- קִמעוֹנַאִי

- סקר

- לְחוֹלֵל מַהְפֵּכָה

- חָסוֹן

- תפקיד

- מלכותי

- הפעלה

- ריצה

- בעל חכמים

- SageMaker Inference

- מכירות

- אותו

- סנטה

- להרחבה

- סולם

- מדע

- מַדְעָן

- ציון

- Sdk

- חיפוש

- ה-SEC

- הגשת SEC

- שְׁנִיָה

- מזכיר

- סעיף

- סעיפים

- ניירות ערך

- ראות

- מגזרים

- נבחר

- מבחר

- למכור

- סלרס

- מכירת

- לחצני מצוקה לפנסיונרים

- משפט

- רגש

- סֶפּטֶמבֶּר

- רצף

- סדרה

- סדרה א '

- לשרת

- שרות

- שירותים

- סט

- הצבה

- הגדרות

- כמה

- שיתוף

- משלוח

- קניות

- צריך

- לְהַצִיג

- הראה

- הופעות

- באופן משמעותי

- פָּשׁוּט

- יחיד

- מידה

- גדל

- קטן יותר

- So

- חֶברָה

- נמכרים

- פִּתָרוֹן

- פתרונות

- לפתור

- מקורות

- מומחים

- מיוחד

- מתמחה

- ספציפי

- הוצאה

- התחלה

- החל

- מדינה

- הצהרות

- סטטיסטי

- שלב

- צעדים

- אחסון

- חנויות

- אסטרטגי

- אִסטרָטֶגִיָה

- נהירה

- כוח

- לשאוף

- סטודיו

- הצלחה

- כזה

- לספק

- שרשרת אספקה

- נתמך

- מסייע

- תומך

- מערכת

- מערכות

- שולחן

- לקחת

- נטילת

- המשימות

- משימות

- נבחרת

- טכנולוגיה

- מונחים

- תנאים

- מבחן

- סיווג טקסט

- זֶה

- השמיים

- האזור

- העתיד

- שֶׁלָהֶם

- אותם

- לכן

- אלה

- דברים

- שְׁלִישִׁי

- צד שלישי

- שְׁלוֹשָׁה

- דרך

- זמן

- דורש זמן רב

- פִּי

- ל

- מטבעות

- חלק עליון

- נושאים

- לעקוב

- רכבת

- מְאוּמָן

- הדרכה

- מעביר

- טרנספורמציה

- לתרגם

- נסיעה

- אמת

- תור

- tv

- ui

- תחת

- להבין

- הבנה

- ייחודי

- אוניברסיטה

- בלתי מוגבל

- עדכונים

- us

- נוֹהָג

- להשתמש

- מְשׁוּמָשׁ

- בְּדֶרֶך כְּלַל

- מנוצל

- ניצול

- אימות

- ערך

- ערכים

- שונים

- גרסה

- באמצעות

- סגן הנשיא

- כמעט

- וושינגטון

- דֶרֶך..

- דרכים

- אינטרנט

- שירותי אינטרנט

- אתר

- אתרים

- טוֹב

- אם

- אשר

- מי

- יצטרך

- עם

- לְלֹא

- Word

- תיק עבודות

- עבד

- עובד

- של העולם

- היה

- שנה

- שנים

- אתה

- צעיר

- זפירנט