今日の急速に進化する医療環境において、医師は、介護者のメモ、電子医療記録、画像レポートなど、さまざまなソースからの膨大な臨床データに直面しています。 この豊富な情報は患者のケアには不可欠ですが、医療専門家が精査して分析するには膨大で時間がかかる場合もあります。 このデータを効率的に要約し、そこから洞察を抽出することは、より良い患者ケアと意思決定にとって非常に重要です。 要約された患者情報は、データの集約、患者の効果的なコード化、検討のための同様の診断を持つ患者のグループ化など、多くの下流プロセスに役立ちます。

人工知能 (AI) と機械学習 (ML) モデルは、これらの課題に対処する上で大きな期待を集めています。 モデルは、大量のテキスト データを分析および解釈するようにトレーニングでき、情報を効果的に簡潔な要約に凝縮できます。 要約プロセスを自動化することで、医師は関連情報に迅速にアクセスできるようになり、患者のケアに集中し、より多くの情報に基づいた意思決定を行うことができます。 以下を参照してください ケーススタディ 実際の使用例について詳しく知るには、

アマゾンセージメーカーフルマネージド ML サービスである は、さまざまな AI/ML ベースの要約モデルとアプローチをホストおよび実装するための理想的なプラットフォームを提供します。 この投稿では、SageMaker で要約手法を実装するためのさまざまなオプションを検討します。 Amazon SageMaker ジャンプスタート 基礎モデル、Hugging Face の事前トレーニング済みモデルの微調整、カスタム要約モデルの構築。 また、各アプローチの長所と短所についても説明し、医療専門家が複雑な臨床データの簡潔で正確な概要を生成するための最適なソリューションを選択できるようにします。

始める前に知っておくべき XNUMX つの重要な用語: 事前トレーニング済み および 微調整。 事前トレーニング済みモデルまたは基礎モデルは、通常は一般的な言語知識を対象として、大規模なデータ コーパスに基づいて構築およびトレーニングされたモデルです。 微調整は、特定のタスクでのパフォーマンスを向上させるために、事前トレーニングされたモデルに、よりドメイン固有の別のデータセットを与えるプロセスです。 医療現場では、これは、特に患者ケアに関連する語句や用語を含むデータをモデルに与えることを意味します。

SageMaker でカスタム要約モデルを構築する

最も労力のかかるアプローチですが、組織によっては、SageMaker でカスタム要約モデルを最初から構築することを好む場合があります。 このアプローチには、AI/ML モデルに関するより深い知識が必要であり、モデル アーキテクチャを最初から作成するか、特定のニーズに合わせて既存のモデルを適応させることが必要になる場合があります。 カスタム モデルを構築すると、要約プロセスの柔軟性と制御が向上しますが、事前トレーニングされたモデルから開始するアプローチと比較して、より多くの時間とリソースが必要になります。 このオプションはすべてのユースケースに適しているわけではないため、続行する前にこのオプションの利点と欠点を慎重に比較検討することが重要です。

SageMaker JumpStart 基盤モデル

SageMaker で要約を実装するための優れたオプションは、JumpStart 基盤モデルを使用することです。 これらのモデルは、主要な AI 研究組織によって開発され、テキストの要約などのさまざまなタスクに最適化された、事前トレーニングされたさまざまな言語モデルを提供します。 SageMaker JumpStart は、独自モデルとオープンソース モデルの XNUMX 種類の基盤モデルを提供します。 SageMaker JumpStart は HIPAA 資格も提供するため、医療ワークロードに役立ちます。 コンプライアンスを確実に達成するかどうかは最終的にはお客様の責任であるため、必ず適切な手順を講じてください。 見る アマゾン ウェブ サービスでの HIPAA セキュリティとコンプライアンスの設計 のガイドをご参照ください。

独自の基礎モデル

AI21 のジュラシック モデルや Cohere の Cohere Generate モデルなどの独自のモデルは、SageMaker JumpStart を通じて発見できます。 AWSマネジメントコンソール 現在プレビュー中です。 独自のモデルを要約に利用することは、カスタム データに基づいてモデルを微調整する必要がない場合に最適です。 これにより、最小限の構成で要約要件を満たすことができる、使いやすくすぐに使えるソリューションが提供されます。 これらの事前トレーニングされたモデルの機能を使用すると、カスタム モデルのトレーニングと微調整に費やされる時間とリソースを節約できます。 さらに、独自のモデルには通常、使いやすい API と SDK が付属しており、既存のシステムやアプリケーションとの統合プロセスを合理化します。 特定のカスタマイズや微調整を必要とせずに、事前トレーニングされた独自のモデルによって要約のニーズを満たすことができる場合、テキスト要約タスクに便利でコスト効率が高く、効率的なソリューションが提供されます。 これらのモデルは医療ユースケース向けに特別にトレーニングされていないため、微調整を行わなければ、そのままでは医療言語の品質を保証できません。

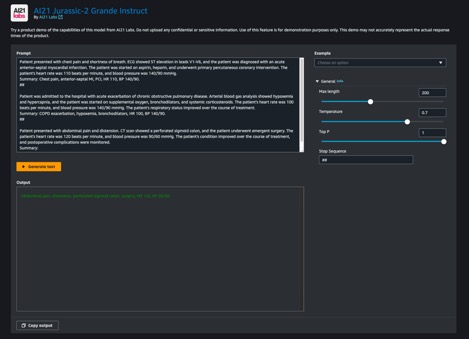

Jurassic-2 Grande Instruct は、AI21 Labs による大規模言語モデル (LLM) であり、自然言語命令用に最適化されており、さまざまな言語タスクに適用できます。 使いやすい API と Python SDK を提供し、品質と手頃な価格のバランスを保ちます。 一般的な用途には、マーケティング コピーの生成、チャットボットの強化、テキストの要約などがあります。

SageMaker コンソールで、SageMaker JumpStart に移動し、AI21 Jurassic-2 Grande Instruct モデルを見つけて、選択します モデルを試す.

自分が管理する SageMaker エンドポイントにモデルをデプロイする場合は、このサンプルの手順に従うことができます。 ノートここでは、SageMaker を使用して Jurassic-2 Large をデプロイする方法を示します。

オープンソースの基盤モデル

オープンソース モデルには、SageMaker JumpStart を通じて発見できる FLAN T5、Bloom、GPT-2 モデルが含まれます。 Amazon SageMakerスタジオ UI、SageMaker コンソール上の SageMaker JumpStart、および SageMaker JumpStart API。 これらのモデルは微調整して AWS アカウントのエンドポイントにデプロイできるため、モデルの重みとスクリプト コードの完全な所有権が得られます。

Flan-T5 XL は、幅広い言語タスク向けに設計された強力で多用途のモデルです。 ドメイン固有のデータを使用してモデルを微調整することで、テキストの要約やその他の NLP タスクなど、特定のユースケースに合わせてパフォーマンスを最適化できます。 SageMaker Studio UI を使用して Flan-T5 XL を微調整する方法の詳細については、以下を参照してください。 Amazon SageMaker Jumpstart を使用した FLAN T5 XL の命令の微調整.

SageMaker の Hugging Face を使用した事前トレーニング済みモデルの微調整

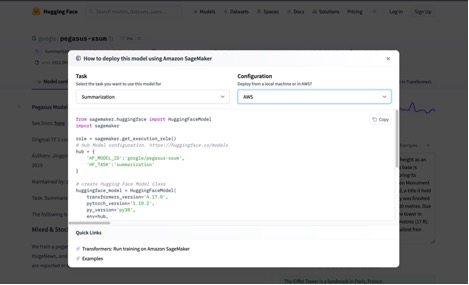

SageMaker で要約を実装するための最も一般的なオプションの XNUMX つは、Hugging Face を使用して事前トレーニングされたモデルを微調整することです。 トランスフォーマー 図書館。 Hugging Face は、テキスト要約などのさまざまな自然言語処理 (NLP) タスク用に特別に設計された、事前トレーニングされた幅広いトランスフォーマー モデルを提供します。 Hugging Face Transformers ライブラリを使用すると、SageMaker を使用してドメイン固有のデータに基づいてこれらの事前トレーニングされたモデルを簡単に微調整できます。 このアプローチには、トレーニング時間の短縮、特定のドメインでのパフォーマンスの向上、組み込みの SageMaker ツールとサービスを使用したモデルのパッケージ化とデプロイの容易さなど、いくつかの利点があります。 SageMaker JumpStart で適切なモデルが見つからない場合は、Hugging Face が提供するモデルを選択し、SageMaker を使用して微調整できます。

ML の機能について学ぶためにモデルの操作を開始するには、SageMaker Studio を開いて、使用する事前トレーニング済みモデルを見つけるだけです。 フェイスモデルハブを抱き締めるをクリックし、デプロイ方法として SageMaker を選択します。 顔をハグするとコードが表示されるので、ノートブックにコピーして貼り付けて実行します。 それはとても簡単です! ML エンジニアリングの経験は必要ありません。

Hugging Face Transformers ライブラリを使用すると、ビルダーは事前トレーニングされたモデルを操作し、次のセクションで説明する微調整などの高度なタスクを実行できます。

リソースのプロビジョニング

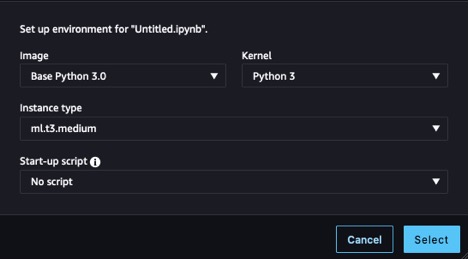

始める前に、ノートブックをプロビジョニングする必要があります。 手順については、「」のステップ 1 と 2 を参照してください。 機械学習モデルをローカルで構築してトレーニングする。 この例では、次のスクリーンショットに示す設定を使用しました。

また、 Amazon シンプル ストレージ サービス (Amazon S3) バケットにトレーニング データとトレーニング アーティファクトを保存します。 手順については、を参照してください。 バケットを作成する.

データセットを準備する

モデルを微調整してドメイン知識を高めるには、タスクに適したデータを取得する必要があります。 エンタープライズ ユースケースに合わせてトレーニングする場合、トレーニングに使用できるように独自のデータを準備するために、多くのデータ エンジニアリング タスクを実行する必要があります。 これらのタスクは、この投稿の範囲外です。 この例では、看護ノートをエミュレートする合成データを生成し、Amazon S3 に保存しました。 データを Amazon S3 に保存すると、次のことが可能になります。 HIPAA 準拠のためのワークロードを設計する。 まず、これらのノートを取得し、ノートブックが実行されているインスタンスにロードします。

メモは、完全なエントリを含む列 (メモ) と、必要な出力を例示する短縮版 (概要) を含む列で構成されます。 このデータセットを使用する目的は、モデルの生物学的および医学的語彙を改善して、と呼ばれる医療コンテキストでの要約にさらに適応できるようにすることです。 ドメインの微調整、そしてその要約された出力を構造化する方法をモデルに示します。 要約の場合によっては、記事から要約を作成したり、レビューの XNUMX 行の概要を作成したりすることがありますが、この場合は、症状と実行されたアクションの短縮版をモデルに出力させようとしています。これまでの患者さんに対して。

モデルをロードします

私たちが基盤として使用するモデルは、Hugging Face Hub で利用できる Google の Pegasus のバージョンです。 ペガサス-xsum。 要約用にすでに事前トレーニングされているため、微調整プロセスはドメイン知識を拡張することに集中できます。 モデルが実行するタスクの変更は、この投稿では取り上げない別のタイプの微調整です。 Transformer ライブラリは、モデル定義をロードするためのクラスを提供します。 model_checkpoint: google/pegasus-xsum。 これにより、ハブからモデルがロードされ、ノートブック内でインスタンス化され、後で使用できるようになります。 なぜなら pegasus-xsum はシーケンス間モデルなので、Seq2Seq タイプを使用したいと考えています。 自動モデル クラス:

モデルを作成したので、トレーニング ループの実行を可能にする他のコンポーネントに注目してみましょう。

トークナイザーを作成する

これらのコンポーネントの最初のものはトークナイザーです。 トークン化 入力データの単語がモデルが理解できる数値表現に変換されるプロセスです。 繰り返しになりますが、Transformer ライブラリは、モデルのインスタンス化に使用したのと同じチェックポイントからトークナイザー定義をロードするためのクラスを提供します。

このトークナイザー オブジェクトを使用すると、前処理関数を作成し、それをデータセットにマッピングして、モデルに入力できるトークンを提供できます。 最後に、トークン化された出力をフォーマットし、元のテキストを含む列を削除します。これは、モデルがそれらのテキストを解釈できないためです。 これで、モデルに入力する準備ができたトークン化された入力が残りました。 次のコードを参照してください。

データがトークン化され、モデルがインスタンス化されたので、トレーニング ループを実行する準備がほぼ整いました。 次に作成するコンポーネントは、データ照合器とオプティマイザーです。 データ コレーターは、Transformers ライブラリを通じて Hugging Face によって提供される別のクラスであり、トレーニング用にトークン化されたデータのバッチを作成するために使用されます。 すでに持っているトークナイザーとモデル オブジェクトを使用して、これを簡単に構築できます。これは、コレーター クラスのモデル (Seq2Seq) に以前使用した対応するクラス タイプを見つけるだけです。 オプティマイザーの機能は、トレーニング状態を維持し、ループの処理中にトレーニング損失に基づいてパラメーターを更新することです。 オプティマイザーを作成するには、 最適 torch モジュールからのパッケージを使用すると、さまざまな最適化アルゴリズムが利用可能になります。 あなたが以前に遭遇したかもしれない一般的なものとしては、確率的勾配降下法や確率的勾配降下法などがあります。 アダム後者がこの例に適用されます。 Adam のコンストラクターは、モデル パラメーターと、指定されたトレーニング実行のパラメーター化された学習率を受け取ります。 次のコードを参照してください。

トレーニングを開始する前の最後のステップは、アクセラレータと学習率スケジューラを構築することです。 このアクセラレータは、Hugging Face によって作成された、Accelerate という名前にふさわしい別のライブラリ (主に Transformers を使用しています) から来ており、トレーニング中にデバイスを管理するために必要なロジック (たとえば、複数の GPU を使用) を抽象化します。 最後のコンポーネントでは、学習率スケジューラーを実装するために、常に便利な Transformers ライブラリを再利用します。 スケジューラーのタイプ、ループ内のトレーニング ステップの合計数、および以前に作成したオプティマイザーを指定することにより、 get_scheduler 関数は、トレーニング プロセス全体で初期学習率を調整できるようにするオブジェクトを返します。

これでトレーニングの準備は完了です! トレーニング ジョブを設定しましょう。まず、 トレーニング_引数 Transformers ライブラリを使用し、パラメータ値を選択します。 これらを、準備した他のコンポーネントやデータセットとともに、 トレーナー 次のコードに示すように、トレーニングを開始します。 データセットのサイズと選択したパラメーターによっては、これにはかなりの時間がかかる場合があります。

推論用にモデルをパッケージ化する

トレーニングが実行されると、モデル オブジェクトを推論に使用できるようになります。 ベスト プラクティスとして、将来使用できるように作業内容を保存しましょう。 モデルアーティファクトを作成し、圧縮して、tarball を Amazon S3 にアップロードして保管する必要があります。 モデルを圧縮する準備をするには、微調整されたモデルをアンラップし、モデルのバイナリと関連する構成ファイルを保存する必要があります。 また、推論にモデルを使用するときに利用できるように、モデル アーティファクトを保存したのと同じディレクトリにトークナイザーを保存する必要があります。 私たちの model_dir フォルダーは次のコードのようになっているはずです。

残っているのは、tar コマンドを実行してディレクトリを圧縮し、tar.gz ファイルを Amazon S3 にアップロードすることだけです。

新しく微調整されたモデルの準備が整い、推論に使用できるようになりました。

推論を実行する

このモデル アーティファクトを推論に使用するには、新しいファイルを開いて次のコードを使用し、 model_data Amazon S3 内のアーティファクトの保存場所に合わせてパラメータを変更します。 の HuggingFaceModel コンストラクターは、保存したチェックポイントからモデルを再構築します。 model.tar.gzこれを、deploy メソッドを使用して推論用にデプロイできます。 エンドポイントのデプロイには数分かかります。

エンドポイントがデプロイされたら、作成した予測子を使用してテストできます。 を渡す predict データ ペイロードにメソッドを適用してセルを実行すると、微調整されたモデルから応答が得られます。

モデルを微調整する利点を確認するために、簡単なテストを行ってみましょう。 次の表には、プロンプトと、微調整の前後でそのプロンプトをモデルに渡した結果が含まれています。

| プロンプト | 微調整不要の応答性 | 微調整による応答 |

| 患者さんが感じている症状をまとめます。 患者は45歳の男性で、左腕に広がる胸骨下の痛みを訴えています。 痛みは庭仕事をしているときに突然始まり、軽度の息切れと発汗を伴いました。 到着時の患者の心拍数は 120、呼吸数は 24、血圧は 170/95 でした。 救急外来への到着時に12誘導心電図検査が行われ、胸痛は軽減されずニトログリセリン舌下XNUMX回投与が行われた。 心電図では、前部リードの ST 上昇が示され、急性前部心筋梗塞を示しています。 心臓カテーテル検査室に連絡し、心臓専門医による心臓カテーテル検査の準備をしています。 | 急性心筋梗塞の症例を紹介します。 | 胸痛、前部MI、PCI。 |

ご覧のとおり、微調整されたモデルでは健康用語が異なる方法で使用されており、目的に合わせて応答の構造を変更することができました。 結果はデータセットとトレーニング中に行った設計の選択に依存することに注意してください。 モデルのバージョンによっては、まったく異なる結果が得られる可能性があります。

クリーンアップ

SageMaker ノートブックの使用が終了したら、長時間実行されるリソースによるコストを避けるために必ずシャットダウンしてください。 インスタンスをシャットダウンすると、インスタンスの一時メモリに保存されているデータがすべて失われるため、クリーンアップの前にすべての作業を永続ストレージに保存する必要があることに注意してください。 また、次の場所に行く必要があります。 エンドポイント SageMaker コンソールのページに移動し、推論用にデプロイされたエンドポイントをすべて削除します。 すべてのアーティファクトを削除するには、Amazon S3 コンソールに移動して、バケットにアップロードされたファイルを削除する必要もあります。

まとめ

この投稿では、医療専門家が膨大な量の臨床データを効率的に処理して洞察を抽出できるように、SageMaker にテキスト要約技術を実装するためのさまざまなオプションを検討しました。 SageMaker Jumpstart 基礎モデルの使用、Hugging Face の事前トレーニング済みモデルの微調整、カスタム要約モデルの構築について説明しました。 各アプローチには独自の長所と短所があり、さまざまなニーズや要件に対応します。

SageMaker でカスタム要約モデルを構築すると、多くの柔軟性と制御が可能になりますが、事前トレーニングされたモデルを使用するよりも多くの時間とリソースが必要になります。 SageMaker Jumpstart 基盤モデルは、特定のカスタマイズや微調整を必要としない組織に、使いやすくコスト効率の高いソリューションと、微調整を簡略化するためのいくつかのオプションを提供します。 Hugging Face の事前トレーニング済みモデルを微調整すると、トレーニング時間が短縮され、ドメイン固有のパフォーマンスが向上し、幅広いモデルのカタログにわたる SageMaker ツールおよびサービスとのシームレスな統合が実現しますが、実装にはある程度の労力が必要です。 この記事の執筆時点で、Amazon は別のオプションを発表しました。 アマゾンの岩盤、さらに管理された環境で要約機能を提供します。

各アプローチの長所と短所を理解することで、医療専門家や組織は、複雑な臨床データの簡潔で正確な概要を生成するための最適なソリューションについて情報に基づいた意思決定を行うことができます。 最終的に、SageMaker で AI/ML ベースの要約モデルを使用すると、医療専門家が関連情報に迅速にアクセスし、質の高いケアの提供に集中できるようになるため、患者のケアと意思決定を大幅に強化できます。

リソース

この投稿で説明した完全なスクリプトといくつかのサンプル データについては、以下を参照してください。 GitHubレポ。 AWS で ML ワークロードを実行する方法の詳細については、次のリソースを参照してください。

著者について

コーディー・コリンズ ニューヨークを拠点とするアマゾン ウェブ サービスのソリューション アーキテクトです。 彼は ISV 顧客と協力して、業界をリードするソリューションをクラウドで構築しています。 彼は、効率と拡張性を最適化し、さまざまな業界の複雑なプロジェクトを成功裏に実現してきました。 余暇には、読書、旅行、柔術のトレーニングを楽しんでいます。

コーディー・コリンズ ニューヨークを拠点とするアマゾン ウェブ サービスのソリューション アーキテクトです。 彼は ISV 顧客と協力して、業界をリードするソリューションをクラウドで構築しています。 彼は、効率と拡張性を最適化し、さまざまな業界の複雑なプロジェクトを成功裏に実現してきました。 余暇には、読書、旅行、柔術のトレーニングを楽しんでいます。

アメール・ハクメ は、ペンシルベニア州在住の AWS ソリューション アーキテクトです。 彼の専門的な焦点は、北東部全域の独立系ソフトウェア ベンダーとの協力にあり、AWS クラウド上でのスケーラブルな最先端のプラットフォームの設計と構築を指導することです。

アメール・ハクメ は、ペンシルベニア州在住の AWS ソリューション アーキテクトです。 彼の専門的な焦点は、北東部全域の独立系ソフトウェア ベンダーとの協力にあり、AWS クラウド上でのスケーラブルな最先端のプラットフォームの設計と構築を指導することです。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 自動車/EV、 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- ブロックオフセット。 環境オフセット所有権の近代化。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 12

- 14

- 視聴者の38%が

- 24

- 33

- 7

- 8

- 9

- a

- できる

- 私たちについて

- 抽象

- 加速する

- 加速器

- アクセス

- 正確な

- 越えて

- 行動

- アダム

- アドレッシング

- 投与

- 高度な

- 利点

- 後

- 再び

- 凝集

- AI

- 愛の研究

- AI / ML

- アルゴリズム

- すべて

- 許可

- ことができます

- 沿って

- 既に

- また

- Amazon

- アマゾンセージメーカー

- Amazon Webサービス

- 量

- 金額

- an

- 分析します

- および

- 発表の

- 別の

- どれか

- API

- API

- 適用可能な

- 適用された

- アプローチ

- アプローチ

- 適切な

- 建築

- です

- ARM

- 到着

- 記事

- AS

- 関連する

- At

- 注意

- 自動化する

- 利用できます

- 避ける

- 離れて

- AWS

- バランシング

- ベース

- BE

- なぜなら

- き

- 始まる

- 恩恵

- 利点

- BEST

- より良いです

- BIN

- 血

- 血圧

- ブルーム

- ボックス

- 息

- 広い

- ビルド

- ビルダー

- 建物

- 内蔵

- 内蔵

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- コール

- 呼ばれます

- 缶

- 機能

- これ

- 慎重に

- 場合

- 例

- カタログ

- 原因となる

- 課題

- 変化する

- チャットボット

- 選択肢

- 選択する

- 選択する

- 選ばれた

- class

- 臨床

- クラウド

- コード

- コード

- コーディング

- 協業

- コラム

- コラム

- 来ます

- comes

- コマンドと

- 比べ

- 不満

- 複雑な

- コンプライアンス

- コンポーネント

- コンポーネント

- 構成

- 特徴

- デメリット

- 領事

- 構築

- コンテキスト

- コントロール

- 便利

- 対応する

- コスト効率の良い

- コスト

- 可能性

- カバー

- 作ります

- 作成した

- 作成

- 重大な

- 現在

- カスタム

- 顧客

- Customers

- カスタム化

- データ

- データセット

- 意思決定

- 決定

- 定義

- 配信

- デモ

- 部門

- 依存

- によっては

- 展開します

- 展開

- 展開する

- 展開

- 設計

- 設計

- 設計

- 希望

- 細部

- 発展した

- Devices

- 異なります

- 直接に

- 発見

- 話し合います

- 議論する

- 異なる

- do

- 医師

- すること

- ドメイン

- ドメイン

- 行われ

- ドント

- ダウン

- 欠点

- 間に

- 各

- 容易

- 簡単に

- 簡単に

- 使いやすい

- 効果的に

- 効率

- 効率的な

- 効率良く

- 努力

- エレクトロニック

- 電子健康記録 (Electronic Health Records)

- 適格性

- 緊急事態

- enable

- 可能

- 有効にする

- エンドポイント

- エンジニアリング

- 高めます

- 確保

- Enterprise

- エントリ

- 環境

- 時代

- 本質的な

- さらに

- 進化

- 例

- 既存の

- 体験

- 体験

- 探る

- 調査済み

- 探る

- 延伸

- エキス

- 顔

- 直面して

- 遠く

- 速いです

- FRBは

- 少数の

- File

- ファイナル

- 最後に

- もう完成させ、ワークスペースに掲示しましたか?

- 発見

- 名

- フィット

- 柔軟性

- フォーカス

- フォロー中

- 形式でアーカイブしたプロジェクトを保存します.

- Foundation

- から

- フル

- 完全に

- function

- さらに

- 未来

- 利得

- 生成する

- 生成された

- 生成

- 取得する

- 受け

- 与える

- 与えられた

- 与え

- Go

- Googleの

- GPU

- 素晴らしい

- 大きい

- 保証

- 持ってる

- he

- 健康

- ヘルスケア

- ハート

- 助けます

- 彼の

- ホスティング

- 認定条件

- How To

- HTML

- HTTP

- HTTPS

- ハブ

- 抱き合う顔

- 理想

- if

- イメージング

- 実装する

- 実装

- 実装

- import

- 重要

- 改善します

- in

- 綿密な

- include

- 含ま

- 含めて

- 独立しました

- 産業

- 産業を変えます

- 情報

- 情報に基づく

- 初期

- 入力

- 洞察

- 説明書

- 統合

- インテリジェンス

- に

- 巻き込む

- IT

- ITS

- ジョブ

- JSON

- ただ

- 知っている

- 知識

- ラボ

- ラボ

- 風景

- 言語

- 大

- 姓

- 後で

- つながる

- 主要な

- リード

- LEARN

- 学習

- 左

- 図書館

- ような

- LLM

- 負荷

- ローディング

- 場所

- ロジック

- 見て

- 失う

- 損失

- 機械

- 機械学習

- 製

- 維持する

- make

- 作成

- 管理します

- マネージド

- 管理

- 地図

- マーケティング

- 五月..

- 意味する

- 医療の

- 大会

- メモリ

- 会った

- 方法

- かもしれない

- 最小限の

- 分

- ML

- モデル

- モジュール

- 他には?

- 最も

- 一番人気

- の試合に

- 名前付き

- ナチュラル

- 自然言語処理

- ナビゲート

- 必要

- ニーズ

- 新作

- ニューヨーク

- 新しく

- 次の

- NLP

- いいえ

- ノート

- ノート

- 今

- 数

- オブジェクト

- オブジェクト

- of

- 提供

- 提供

- オファー

- 古い

- on

- ONE

- もの

- 開始

- 〜に

- 開いた

- オープンソース

- 操作する

- 最適化

- 最適化

- 最適化

- 最適化

- オプション

- オプション

- or

- 注文

- 組織

- オリジナル

- その他

- さもないと

- 私たちの

- でる

- 出力

- 外側

- が

- 自分の

- 所有権

- パッケージ

- 包装

- ページ

- 痛み

- パラメーター

- パラメータ

- 特定の

- パス

- 通過

- 患者

- 患者

- Pegasus

- ペンシルベニア州

- パフォーマンス

- 関連する

- フレーズ

- プラットフォーム

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- 人気

- ポスト

- 強力な

- 電源

- 練習

- Predictor

- 好む

- 準備

- 準備

- 現在

- 圧力

- プレビュー

- 前に

- 主に

- プロセス

- ラボレーション

- 処理

- 生産された

- プロ

- 専門家

- プロジェクト(実績作品)

- 約束

- 所有権

- PROS

- 提供します

- 提供

- は、大阪で

- 提供

- 準備

- 目的

- 目的

- 置きます

- Python

- 品質

- クイック

- すぐに

- 範囲

- 急速に

- レート

- リーディング

- 準備

- 現実の世界

- 記録

- 関連した

- 救済

- 削除します

- レポート

- 必要とする

- の提出が必要です

- 要件

- 必要

- 研究

- リソース

- 応答

- 結果

- 収益

- レビュー

- 職種

- ラン

- ランニング

- runs

- セージメーカー

- 同じ

- Save

- スケーラビリティ

- ド電源のデ

- スコープ

- スクラッチ

- SDDK

- SDK

- シームレス

- セクション

- セキュリティ

- 別

- サービス

- サービス

- セッションに

- 設定

- 設定

- いくつかの

- 短縮

- すべき

- 表示する

- 示す

- 作品

- シャットダウン

- ふるいにかける

- 重要

- 著しく

- 同様の

- 簡単な拡張で

- 簡略化されました

- サイズ

- So

- これまでのところ

- ソフトウェア

- 溶液

- ソリューション

- 一部

- 何か

- ソース

- 特定の

- 特に

- 費やした

- start

- 起動

- 都道府県

- 最先端の

- ステップ

- ストレージ利用料

- 店舗

- 保存され

- 保存

- 合理化

- 構造

- 研究

- 舌下

- 首尾よく

- そのような

- 突然の

- スーツ

- 適当

- 概要

- 確か

- 症状

- 概要

- 合成

- 合成データ

- システム

- テーブル

- 取る

- 撮影

- 取り

- 仕事

- タスク

- テクニック

- 用語

- 条件

- test

- より

- それ

- ハブ

- それら

- その後

- ボーマン

- 彼ら

- この

- それらの

- 三

- 介して

- 全体

- 時間

- 時間がかかる

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- 今日の

- 一緒に

- トークン化された

- トークン

- 豊富なツール群

- トーチ

- トータル

- トレーニング

- 訓練された

- トレーニング

- 変換

- トランス

- トランスフォーマー

- 旅行

- 2

- type

- 一般的に

- ui

- 最終的に

- できません

- 下

- わかる

- 理解する

- アップデイト

- アップロード

- us

- つかいます

- 使用事例

- 中古

- 「DeckleBenchは非常に使いやすく最適なソリューションを簡単に見つけることができるため、稼働率が向上しコストも削減した。当社の旧システムは良かったが改善は期待していなかった。

- 使用されます

- 活用

- 価値観

- さまざまな

- 広大な

- ベンダー

- 多才な

- バージョン

- 非常に

- ボリューム

- 欲しいです

- ました

- we

- 富

- ウェブ

- Webサービス

- 体重を計る

- WELL

- この試験は

- いつ

- which

- while

- ワイド

- 広い範囲

- 意志

- 無し

- 言葉

- 仕事

- ワーキング

- 作品

- でしょう

- 書き込み

- 年

- ヨーク

- You

- あなたの

- ゼファーネット

- 〒