ソーシャル ネットワーキングやオンライン ゲームなどのオンライン ソーシャル活動の増加は、多くの場合、ヘイト スピーチ、ネットいじめ、嫌がらせなどの一方的な発現につながる可能性のある敵対的または攻撃的な行為に満ちています。 たとえば、多くのオンライン ゲーム コミュニティは、ユーザー間のコミュニケーションを促進するためにボイス チャット機能を提供しています。 ボイスチャットはフレンドリーな冗談やくだらない会話をサポートすることがよくありますが、ヘイトスピーチ、ネットいじめ、嫌がらせ、詐欺などの問題を引き起こす可能性もあります。 有害な言語にフラグを立てることは、組織が会話を礼儀正しく保ち、ユーザーが自由に作成、共有、参加できる安全で包括的なオンライン環境を維持するのに役立ちます。 現在、多くの企業は有害なコンテンツのレビューを人間のモデレータのみに依存しています。 ただし、十分な品質と速度でこれらのニーズを満たすために人間のモデレーターを拡張するには、費用がかかります。 その結果、多くの組織は、高いユーザー減少率、風評被害、規制上の罰金に直面するリスクを抱えています。 さらに、モデレーターは有害なコンテンツをレビューすることで心理的な影響を受けることがよくあります。

Amazon Transcribe は、開発者が音声をテキストに変換する機能をアプリケーションに簡単に追加できるようにする自動音声認識 (ASR) サービスです。 本日は、嬉しいお知らせをさせていただきます Amazon Transcribe の毒性検出機械学習 (ML) を利用した機能で、音声ベースの合図とテキストベースの合図の両方を使用して、セクハラ、ヘイトスピーチ、脅迫、虐待、冒涜、侮辱、グラフィック言語を含む XNUMX つのカテゴリにわたる音声ベースの有害なコンテンツを識別して分類します。 。 毒性検出は、テキストに加えて、トーンやピッチなどの音声キューを使用して、音声内の有害な意図に焦点を当てます。

これは、意図を考慮せず、特定の用語のみに焦点を当てるように設計された標準的なコンテンツ モデレーション システムからの改良です。 ほとんどの企業では、ユーザーから報告されたコンテンツをレビューするために 7 ~ 15 日の SLA を設けています。これは、モデレーターが長い音声ファイルを聞いて、会話が有害になったかどうか、いつ有害になったかを評価する必要があるためです。 Amazon Transcribe Toxicity Detection を使用すると、モデレーターは有害なコンテンツのフラグが立てられた音声ファイルの特定の部分のみをレビューします (音声ファイル全体ではなく)。 モデレーターがレビューしなければならないコンテンツが 95% 削減されるため、顧客は SLA をわずか数時間に短縮できるだけでなく、ユーザーがフラグを立てたコンテンツ以外にも、より多くのコンテンツを積極的にモデレートできるようになります。 これにより、企業は大規模なコンテンツを自動的に検出して管理し、安全で包括的なオンライン環境を提供し、ユーザーの離脱や評判の低下を引き起こす前に対策を講じることができるようになります。 有害なコンテンツの検出に使用されるモデルは Amazon Transcribe によって維持され、精度と関連性を維持するために定期的に更新されます。

この投稿では、次の方法を学びます。

- Amazon Transcribe Toxicity Detection を使用して音声内の有害なコンテンツを特定する

- Amazon Transcribe コンソールを使用して毒性を検出する

- を使用して毒性検出を含む転写ジョブを作成します。 AWSコマンドラインインターフェイス (AWS CLI) と Python SDK

- Amazon Transcribe 毒性検出 API レスポンスを使用する

Amazon Transcribe Toxicity Detection を使用して音声チャットの毒性を検出する

Amazon Transcribe は、会話中の有害な言語にフラグを立てるためのシンプルな ML ベースのソリューションを提供するようになりました。 この機能はソーシャル メディア、ゲーム、一般的なニーズに特に役立ち、顧客が ML モデルをトレーニングするために独自のデータを提供する必要がなくなります。 Toxicity Detection は、有害なオーディオ コンテンツを次の 0 つのカテゴリに分類し、各カテゴリの信頼スコア (1 ~ XNUMX) を提供します。

- 冒涜 – 失礼、下品、または攻撃的な単語、フレーズ、または頭字語を含むスピーチ。

- ヘイトスピーチ – アイデンティティ(人種、民族、性別、宗教、性的指向、能力、出身国など)に基づいて個人またはグループを批判、侮辱、非難、または非人間化するような発言。

- 性的な – 身体の一部、身体的特徴、または性別への直接的または間接的な言及を使用して、性的関心、活動、または性的興奮を示すスピーチ。

- 侮辱 – 屈辱的、屈辱的、嘲笑的、侮辱的、または軽蔑的な言葉を含むスピーチ。 この種の言葉遣いはいじめとも呼ばれます。

- 暴力または脅迫 – 個人またはグループに対して苦痛、傷害、または敵意を与えようとする脅迫を含むスピーチ。

- グラフィック – 視覚的に説明的で不快なほど鮮明な画像を使用したスピーチ。 この種の言葉は、受け手の不快感を増幅させるために意図的に冗長になることがよくあります。

- ハラスメントまたは虐待 – 受け手の心理的幸福に影響を与えることを意図したスピーチ(屈辱的および客観的な言葉を含む)。

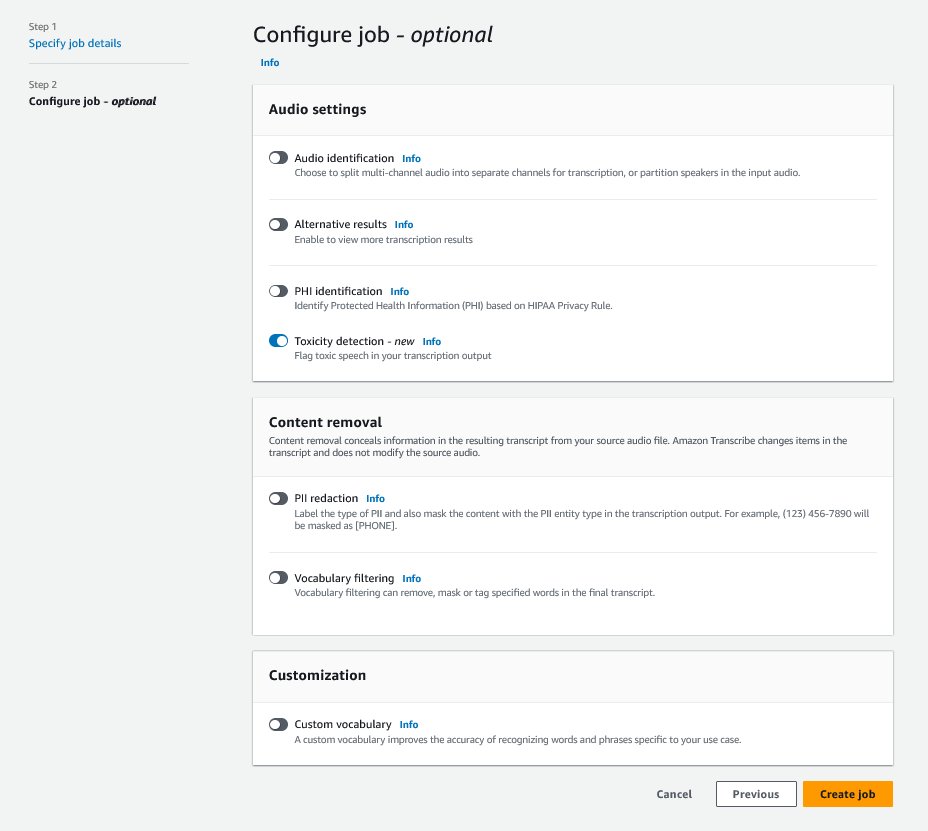

Toxicity Detection には、Amazon Transcribe コンソール経由でアクセスするか、AWS CLI または AWS SDK を使用して API を直接呼び出すことができます。 Amazon Transcribe コンソールでは、毒性をテストしたい音声ファイルをアップロードし、数回クリックするだけで結果を得ることができます。 Amazon Transcribe は、ハラスメント、ヘイトスピーチ、性的コンテンツ、暴力、侮辱、冒涜などの有害なコンテンツを特定して分類します。 Amazon Transcribe は、各カテゴリの信頼スコアも提供し、コンテンツの毒性レベルに関する貴重な洞察を提供します。 Toxicity Detection は現在、バッチ処理用の標準 Amazon Transcribe API で利用でき、米国英語をサポートしています。

Amazon Transcribe コンソールのチュートリアル

開始するには、 AWSマネジメントコンソール そしてAmazon Transcribeにアクセスしてください。 新しい文字起こしジョブを作成するには、録音したファイルを Amazon シンプル ストレージ サービス (Amazon S3) バケットを処理する前に。 次のスクリーンショットに示すように、オーディオ設定ページで、有効にします。 毒性検出 新しいジョブの作成に進みます。 Amazon Transcribe は文字起こしジョブをバックグラウンドで処理します。 ジョブが進行すると、ステータスが次のように変化することが期待できます。 完了しました プロセスが完了したとき。

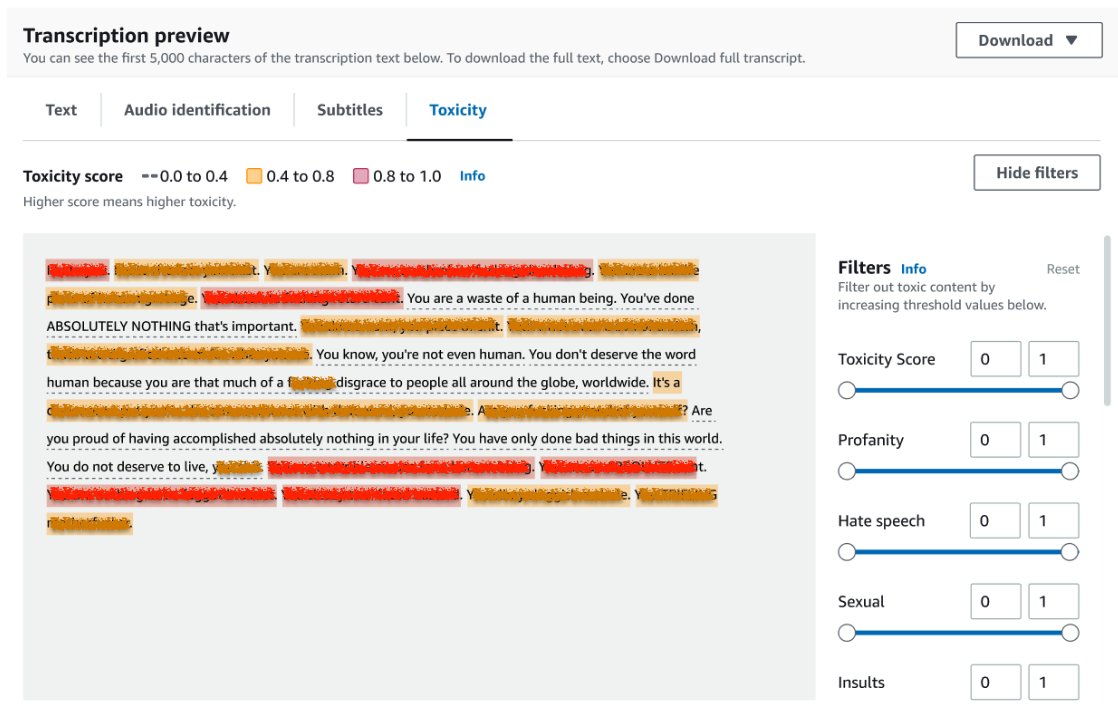

文字起こしジョブの結果を確認するには、ジョブ リストからジョブを選択して開きます。 下にスクロールして、 文字起こしのプレビュー 結果を確認するセクション 毒性 タブ。 UI には、信頼スコアによって決定された毒性のレベルを示す色分けされた転写セグメントが表示されます。 表示をカスタマイズするには、 フィルタ ペイン。 これらのバーを使用すると、しきい値を調整し、それに応じて毒性カテゴリをフィルタリングできます。

次のスクリーンショットでは、機密情報または有害な情報が存在するため、転写テキストの一部がカバーされています。

毒性検出リクエストを含む転写 API

このセクションでは、プログラミング インターフェイスを使用して毒性検出を伴う転写ジョブを作成する方法を説明します。 音声ファイルがまだ S3 バケットにない場合は、Amazon Transcribe によるアクセスを確保するためにアップロードします。 コンソールで文字起こしジョブを作成する場合と同様に、ジョブを呼び出すときは、次のパラメータを指定する必要があります。

- 文字起こしジョブ名 – 一意のジョブ名を指定します。

- メディアファイル Uri – Amazon S3 上のオーディオ ファイルの URI の場所を入力します。 Amazon Transcribe は次のオーディオ形式をサポートしています: MP3、MP4、WAV、FLAC、AMR、OGG、または WebM

- 言語コード - に設定

en-US。 この記事の執筆時点では、Toxicity Detection は米国英語のみをサポートしています。 - 毒性カテゴリ – 渡す

ALLサポートされているすべての毒性検出カテゴリを含める値。

以下は、Python3 を使用して毒性検出を有効にして転写ジョブを開始する例です。

次の AWS CLI コマンドを使用して、毒性検出を備えた同じ転写ジョブを呼び出すことができます。

毒性検出応答を備えた転写 API

Amazon Transcribe 毒性検出 JSON 出力には、結果フィールドに転写結果が含まれます。 毒性検出を有効にすると、次のフィールドが追加されます。 toxicityDetection 結果フィールドの下にあります。 toxicityDetection には、次のパラメータを持つ転写されたアイテムのリストが含まれています。

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다. – 転写された生のテキスト

- 毒性 – 検出の信頼スコア (0 ~ 1 の値)

- カテゴリ – 有害なスピーチの各カテゴリの信頼度スコア

- 始まる時間 – 音声ファイル内の検出開始位置(秒)

- 終了時間 – 音声ファイル内の検出終了位置(秒)

以下は、コンソールからダウンロードできる、簡略化された毒性検出応答のサンプルです。

まとめ

この投稿では、新しい Amazon Transcribe 毒性検出機能の概要を説明しました。 また、毒性検出の JSON 出力を解析する方法についても説明しました。 詳細については、Amazon Transcribe コンソールを確認し、毒性検出を備えた Transcription API を試してください。

Amazon Transcribe Toxicity Detection は、米国東部 (オハイオ)、米国東部 (バージニア北部)、米国西部 (オレゴン)、アジアパシフィック (シドニー)、欧州 (アイルランド)、および欧州 (ロンドン) の AWS リージョンで利用できるようになりました。 さらに詳しく知りたい場合は、次のサイトをご覧ください。 Amazon Transcribe.

詳細については、こちらから AWS でのコンテンツモデレーション と コンテンツモデレーション ML の使用例。 ~に向けて最初の一歩を踏み出しましょう AWS を使用してコンテンツモデレーション業務を合理化する.

著者,

ラナ・チャン AWS WWSO AI サービス チームのシニア ソリューション アーキテクトで、コンテンツ モデレーション、コンピューター ビジョン、自然言語処理のための AI と ML を専門としています。 彼女はその専門知識を活かして、AWS AI/ML ソリューションを推進し、ソーシャルメディア、ゲーム、電子商取引、広告とマーケティングを含むさまざまな業界にわたって顧客がビジネス ソリューションを変革できるよう支援することに専念しています。

ラナ・チャン AWS WWSO AI サービス チームのシニア ソリューション アーキテクトで、コンテンツ モデレーション、コンピューター ビジョン、自然言語処理のための AI と ML を専門としています。 彼女はその専門知識を活かして、AWS AI/ML ソリューションを推進し、ソーシャルメディア、ゲーム、電子商取引、広告とマーケティングを含むさまざまな業界にわたって顧客がビジネス ソリューションを変革できるよう支援することに専念しています。

スミットクマール は、AWS AI Language Services チームのテクニカル担当シニア プロダクト マネージャーです。 彼はさまざまな分野にわたる 10 年の製品管理の経験があり、AI/ML に情熱を持っています。 仕事以外では、スミットは旅行が大好きで、クリケットやローンテニスを楽しんでいます。

スミットクマール は、AWS AI Language Services チームのテクニカル担当シニア プロダクト マネージャーです。 彼はさまざまな分野にわたる 10 年の製品管理の経験があり、AI/ML に情熱を持っています。 仕事以外では、スミットは旅行が大好きで、クリケットやローンテニスを楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 自動車/EV、 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- ブロックオフセット。 環境オフセット所有権の近代化。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/flag-harmful-language-in-spoken-conversations-with-amazon-transcribe-toxicity-detection/

- :持っている

- :は

- :not

- 10

- 100

- 16

- 17

- 20

- 24

- 7

- 視聴者の38%が

- a

- 能力

- 私たちについて

- 虐待

- アクセス

- それに応じて

- 会計

- 精度

- 越えて

- Action

- 活動

- アクティビティ

- 加えます

- 添加

- 追加

- 広告運用

- 積極的な

- AI

- AIサービス

- AI / ML

- すべて

- 許す

- 既に

- また

- しかし

- Amazon

- Amazon Transcribe

- Amazon Webサービス

- 間で

- an

- および

- アナウンス

- API

- API

- です

- AS

- アジア

- アジア太平洋地域

- 支援する

- At

- 損耗

- オーディオ

- オートマチック

- 自動的に

- 利用できます

- AWS

- 背景

- バー

- 基礎

- BE

- になりました

- なぜなら

- 行動

- の間に

- 越えて

- ボディ

- 両言語で

- ブレーク

- 弱い者いじめ

- ビジネス

- by

- 呼ばれます

- 呼び出し

- 缶

- 機能

- カテゴリ

- カテゴリー

- 原因となる

- 変化する

- チェック

- 選択する

- 分類します

- コミュニケーション

- コミュニティ

- 企業

- コンプリート

- 記入済みの

- コンピュータ

- Computer Vision

- 信頼

- 領事

- 含まれています

- コンテンツ

- 会話

- 会話

- カバー

- 作ります

- 作成

- クリケット

- 批判する

- 現在

- Customers

- カスタマイズ

- データ

- 日

- 専用の

- 記載された

- 設計

- 検出

- 検出

- 決定

- 開発者

- 直接

- 直接に

- ディスプレイ

- 異なる

- ドメイン

- ダウン

- ダウンロード

- 原因

- eコマース

- 各

- 東

- 簡単に

- どちら

- 排除

- enable

- 使用可能

- 有効にする

- end

- 英語

- 確保

- 入力します

- 企業

- 全体

- 環境

- 特に

- 民族性

- ヨーロッパ

- 評価する

- 例

- 例

- 興奮した

- 期待する

- 高価な

- 体験

- 専門知識

- 余分な

- 容易にする

- 向い

- Failed:

- 特徴

- 少数の

- フィールド

- File

- filter

- 名

- フラグが立てられた

- フォーカス

- フォロー中

- 優しい

- から

- 機能性

- 賭博

- 性別

- 取得する

- Go

- ゴエス

- グラフィック

- グループ

- ガイド

- 有害な

- 持ってる

- he

- ことができます

- 彼女の

- こちら

- ハイ

- HOURS

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- 人間

- 識別する

- アイデンティティ

- if

- 影響を受けた

- import

- 改善

- in

- include

- 含ま

- 含めて

- 包括的

- 増える

- 示す

- を示し

- 産業

- 情報

- 洞察

- 侮辱

- 意図された

- 意図

- 意図

- 故意に

- 関心

- インターフェース

- に

- アイルランド

- IT

- リーディングシート

- ジョブ

- JPG

- JSON

- ただ

- キープ

- 言語

- つながる

- LEARN

- 学習

- レベル

- LINE

- リスト

- 場所

- ロンドン

- で

- 機械

- 機械学習

- 維持する

- 作る

- 管理

- マネージャー

- 多くの

- マーケティング

- メディア

- 大会

- ML

- モデル

- 節度

- 他には?

- 最も

- しなければなりません

- 名

- 国民

- ナチュラル

- 自然言語処理

- 必要

- ニーズ

- ネットワーキング

- 新作

- 今

- of

- 提供

- 頻繁に

- オハイオ

- on

- オンライン

- オンラインゲーム

- の

- 開いた

- 業務執行統括

- or

- オレゴン

- 組織

- 起源

- 私たちの

- でる

- 出力

- 外側

- 概要

- 自分の

- 太平洋

- ページ

- 痛み

- パラメータ

- 参加する

- 部品

- パス

- 情熱的な

- 人

- フレーズ

- 物理的な

- ピッチ

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 再生

- 部分

- 位置

- ポスト

- プレゼンス

- 問題

- プロセス

- 処理済み

- 処理

- プロダクト

- 製品管理

- プロダクトマネージャー

- 冒涜

- プログラミング

- 推進

- 提供します

- 提供

- は、大阪で

- 提供

- Python

- 品質

- レース

- 価格表

- Raw

- 準備

- 認識

- 記録された

- 減らします

- 電話代などの費用を削減

- リファレンス

- 地域

- レギュレータ

- 関連性

- 宗教

- 頼る

- 報告

- 応答

- 結果

- 結果

- レビュー

- レビュー

- リスク

- 安全な

- 同じ

- 規模

- スケーリング

- 詐欺

- スコア

- スクロール

- SDK

- 秒

- セクション

- を求める

- セグメント

- セグメント

- シニア

- 敏感な

- サービス

- サービス

- セッションに

- 設定

- セブン

- 性別

- 性的な

- シェアする

- 彼女

- 示す

- 作品

- 符号

- 同様の

- 簡単な拡張で

- 社会

- ソーシャルメディア

- ソーシャルネットワーキング

- もっぱら

- 溶液

- ソリューション

- 特化

- 特定の

- スピーチ

- 音声認識

- 音声テキスト

- スピード

- 話

- 標準

- start

- 開始

- 起動

- Status:

- 手順

- ストレージ利用料

- そのような

- 十分な

- サポート

- サポート

- シドニー

- システム

- 取る

- 会話

- チーム

- 技術的

- 条件

- test

- それ

- アプリ環境に合わせて

- それら

- ボーマン

- 彼ら

- この

- 脅威

- 介して

- 時間

- 〜へ

- 今日

- に向かって

- に向かって

- トレーニング

- 変換

- 旅行

- true

- 試します

- type

- ui

- 下

- ユニーク

- 要求されていない

- 更新しました

- us

- つかいます

- 中古

- ユーザー

- users

- 使用されます

- 貴重な

- 値

- 多様

- 、

- 暴力

- バージニア州

- ビジョン

- 訪問

- ボイス

- vs

- 低俗

- wait

- 欲しいです

- we

- ウェブ

- Webサービス

- WELL

- ウェスト

- いつ

- while

- 意志

- 無し

- 言葉

- 仕事

- 書き込み

- 年

- まだ

- You

- あなたの

- ゼファーネット