Po zbudowaniu, przeszkoleniu i ocenie modelu uczenia maszynowego (ML) w celu upewnienia się, że rozwiązuje on proponowany zamierzony problem biznesowy, chcesz wdrożyć ten model, aby umożliwić podejmowanie decyzji w operacjach biznesowych. Modele obsługujące funkcje o znaczeniu krytycznym dla biznesu są wdrażane w środowisku produkcyjnym, w którym wdrażana jest strategia udostępniania modeli. Biorąc pod uwagę charakter modeli ML, w których dane ciągle się zmieniają, chcesz również upewnić się, że wdrożony model jest nadal odpowiedni dla nowych danych i że model jest aktualizowany, gdy tak nie jest. Obejmuje to wybór strategii wdrożenia, która minimalizuje ryzyko i przestoje. Ta optymalna strategia wdrażania powinna zapewniać wysoką dostępność modelu, uwzględniać koszt biznesowy wdrożenia modelu gorszego od tego, który jest już w produkcji, oraz zawierać funkcje umożliwiające łatwe przywrócenie poprzedniej wersji modelu. Wiele z tych zalecanych zagadnień i wzorców wdrażania jest również omówionych w ramach AWS Well Architected Framework – Soczewka uczenia maszynowego.

Oprócz wybrania właściwej strategii wdrażania, strategia ta powinna zostać wdrożona przy użyciu niezawodnego mechanizmu, który obejmuje praktyki MLOps. MLOps obejmuje praktyki, które integrują obciążenia ML z zarządzaniem wersjami, CI/CD i operacjami, uwzględniając unikalne aspekty projektów ML, w tym kwestie dotyczące wdrażania i monitorowania modeli. Amazon SageMaker dla MLOps zapewnia specjalnie zaprojektowane narzędzia do automatyzacji i standaryzacji kroków w całym cyklu życia ML, w tym możliwości wdrażania nowych modeli i zarządzania nimi przy użyciu zaawansowanych wzorców wdrażania.

W tym poście omówimy sposób wdrażania modeli ML za pomocą Amazon Sage Maker w powtarzalny i zautomatyzowany sposób, integrując warianty produkcyjne i poręcze rozmieszczające możliwości SageMaker z rozwiązaniami MLOps. Przedstawiamy wprowadzenie do integracji narzędzi MLOps SageMaker z wzorcami wdrażania modelu SageMaker, koncentrując się na punktach końcowych pojedynczego modelu w czasie rzeczywistym.

Omówienie rozwiązania

Badamy następujące wzorce testowania modeli i poręczy oraz ich integrację z narzędziami SageMaker MLOps:

- Testowanie modelu – Porównujemy różne wersje modeli w produkcji przed wymianą aktualnej wersji modelu. W tym poście porównano następujące możliwości testowania modeli:

- Testy A / B – Dzięki testom A/B porównujesz różne wersje swojego modelu w produkcji, rozdzielając ruch w punkcie końcowym między wariantami modelu. Testy A/B są używane w scenariuszach, w których sprzężenie zwrotne w zamkniętej pętli może bezpośrednio powiązać wyniki modelu z metrykami biznesowymi niższego szczebla. Te informacje zwrotne są następnie wykorzystywane do określenia istotności statystycznej zmiany jednego modelu na inny, pomagając wybrać najlepszy model poprzez testy produkcyjne na żywo.

- Testy cienia – Dzięki testom w tle testujesz nową wersję swojego modelu w środowisku produkcyjnym, wysyłając równolegle żądania do modelu produkcyjnego i nowego modelu. Dane odpowiedzi predykcji z modelu produkcyjnego są dostarczane do aplikacji, podczas gdy predykcje nowej wersji modelu są przechowywane do testowania, ale nie są udostępniane aplikacji produkcyjnej. Testowanie w tle jest używane w sytuacjach, w których nie ma sprzężenia zwrotnego w zamkniętej pętli, które odwzorowuje metrykę biznesową z powrotem na przewidywania modelu. W tym scenariuszu używasz jakości modelu i metryk operacyjnych do porównywania wielu modeli zamiast jakiegokolwiek wpływu na metryki biznesowe niższego szczebla.

- Przesuwanie ruchu – Po przetestowaniu nowej wersji modelu i uzyskaniu satysfakcji z jej działania, kolejnym krokiem jest przeniesienie ruchu z obecnego modelu na nowy. The niebiesko-zielone poręcze rozmieszczania w SageMaker pozwalają w łatwy i kontrolowany sposób przejść z obecnego modelu w produkcji (niebieska flota) na nowy (zielona flota). Wdrożenia niebieskie/zielone pozwalają uniknąć przestojów podczas aktualizacji modelu, na przykład w scenariuszu wdrażania w miejscu. Aby zmaksymalizować dostępność modelu, od chwili pisania tego tekstu wdrożenia niebieskie/zielone są domyślną opcją aktualizacji modeli w SageMaker. W tym poście omawiamy następujące metody przenoszenia ruchu:

- Wszystko na raz zmiana ruchu – 100% ruchu w punktach końcowych jest przenoszone z niebieskiej floty do zielonej floty po udostępnieniu zielonej floty. Używamy alarmy in Amazon Cloud Watch które monitorują Twoją zieloną flotę przez określony czas (tzw okres pieczenia) i jeśli żaden alarm nie zostanie uruchomiony, niebieska flota zostanie usunięta przez SageMakera po okresie pieczenia.

- Zmiana ruchu na Kanarach – Twoja zielona flota jest najpierw narażona na mniejszą część ruchu (a kanarek) i zweryfikowano wszelkie problemy za pomocą alarmów CloudWatch przez okres pieczenia, podczas gdy niebieska flota nadal odbiera większość ruchu w punktach końcowych. Po zatwierdzeniu zielonej floty cały ruch jest przenoszony do nowej floty, a następnie niebieska flota jest usuwana przez SageMaker.

- Niebiesko-zielone liniowe przesuwanie ruchu poręczy – Stopniowo przenosisz ruch z floty niebieskiej do floty zielonej, krok po kroku. Twój model jest następnie monitorowany za pomocą alarmów CloudWatch przez pewien czas na każdym etapie, zanim niebieska flota zostanie całkowicie wymieniona.

Ten post koncentruje się na opisie architektur, które wykorzystują funkcje SageMaker MLOps do przeprowadzania kontrolowanych wdrożeń modeli za pośrednictwem wymienionych przez nas barier ochronnych i strategii testowania modelowania. Aby uzyskać ogólne informacje na temat tych wzorców, patrz Skorzystaj z zaawansowanych strategii wdrażania przy użyciu poręczy wdrażania Amazon SageMaker i Poręcze rozmieszczania.

Wdróż model za pomocą SageMaker

SageMaker oferuje szeroką gamę opcje wdrażania które różnią się od małych opóźnień i wysokiej przepustowości do długotrwałych zadań wnioskowania. Te opcje obejmują zagadnienia dotyczące partii, czasu rzeczywistego lub wnioskowanie w czasie zbliżonym do rzeczywistego. Każda opcja oferuje różne zaawansowane funkcje, takie jak możliwość uruchamiania wielu modeli na jednym punkcie końcowym. Jednak, jak wspomniano wcześniej, w tym poście omawiamy tylko wzorce wdrażania MLOps przy użyciu punktów końcowych z jednym modelem. Aby zagłębić się w bardziej zaawansowane funkcje wdrażania SageMaker w celu wnioskowania w czasie rzeczywistym, zobacz Wzorce hostingu modeli w Amazon SageMaker, część 2: Pierwsze kroki z wdrażaniem modeli czasu rzeczywistego w SageMaker.

Aby zrozumieć implementację zaawansowanych wzorców wdrażania przy użyciu potoków ciągłego dostarczania (CD), omówmy najpierw kluczową koncepcję w SageMaker o nazwie warianty modeli.

Warianty modeli SageMaker

Warianty modelu umożliwiają wdrożenie wielu wersji modelu w tym samym punkcie końcowym w celu przetestowania modelu. Warianty modelu są wdrażane w oddzielnych wystąpieniach, więc aktualizacja jednego z nich nie ma wpływu na inne warianty. W SageMaker warianty modeli są implementowane jako warianty produkcyjne i w tle.

Warianty produkcyjne umożliwiają testowanie A/B wielu wersji Twojego modelu w celu porównania ich wydajności. W tym scenariuszu wszystkie wersje modelu zwracają odpowiedzi na żądania modelu. Twój ruch w punkcie końcowym jest rozdzielany pomiędzy istniejące warianty albo według rozkładu ruchu, gdzie przypisujesz wagę dla każdego wariantu, albo według wariantu docelowego, gdzie określony parametr (np. Region lub rynek) decyduje o tym, który model powinien zostać wywołany.

Warianty cienia pozwalają ci przetestować w tle nową wersję twojego modelu. W tym scenariuszu model ma wariant produkcyjny i wariant w tle wdrożony równolegle w tym samym punkcie końcowym. Wariant w tle odbiera pełny (lub próbkowany) ruch danych z punktu końcowego. Jednak tylko prognozy wariantów produkcyjnych są wysyłane z powrotem do użytkowników Twojej aplikacji, a prognozy z wariantów ukrytych są rejestrowane do analizy. Ponieważ warianty w tle są uruchamiane w oddzielnych instancjach od wariantu produkcyjnego, w tym teście nie ma to wpływu na wydajność wariantu produkcyjnego. Dzięki tej opcji testujesz nowy model i minimalizujesz ryzyko związane z modelem o niskiej wydajności, a także możesz porównać wydajność obu modeli z tymi samymi danymi.

Poręcze wdrażania SageMaker

Poręcze są istotną częścią tworzenia oprogramowania. Chronią Twoją aplikację i minimalizują ryzyko wdrożenia nowej wersji Twojej aplikacji. Podobnie poręcze wdrażania SageMaker umożliwiają przełączanie z jednej wersji modelu na drugą w kontrolowany sposób. Od grudnia 2022 r. poręcze SageMaker zapewniają implementację opcji wdrożeń związanych z niebieskim/zielonym, kanaryjskim i liniowym przesunięciem ruchu. W połączeniu z wariantami modelu, poręcze wdrażania można zastosować zarówno do wersji produkcyjnej, jak i wariantu cienia Twojego modelu, zapewniając brak przestojów podczas aktualizacji nowego wariantu, przy czym ruch uliczny jest kontrolowany zgodnie z wybraną opcją.

Podstawy MLOps do wdrażania modeli

W szerszym kontekście budowania i wdrażania modelu ML chcemy zastosować praktyki CI/CD stworzone specjalnie dla przepływu pracy ML. Podobnie jak w przypadku tradycyjnych systemów CI/CD, chcemy zautomatyzować testy oprogramowania, testy integracyjne i wdrożenia produkcyjne. Jednak musimy również uwzględnić określone operacje wokół cyklu życia uczenia maszynowego, które nie są obecne w tradycyjnym cyklu tworzenia oprogramowania, takie jak szkolenie modeli, eksperymentowanie z modelami, testowanie modeli i monitorowanie modeli.

Aby osiągnąć te specyficzne możliwości ML, do procesu wdrażania modelu dodawane są podstawy MLOps, takie jak zautomatyzowane testowanie modelu, zabezpieczenia wdrażania, wdrożenia na wielu kontach i automatyczne wycofywanie modelu. Gwarantuje to, że opisane już możliwości pozwolą na testowanie modelu i uniknięcie przestojów w procesie aktualizacji modelu. Zapewnia również niezawodność i identyfikowalność niezbędne do ciągłego doskonalenia modelu gotowego do produkcji. Ponadto możliwości, takie jak możliwość pakowania istniejących rozwiązań w szablony wielokrotnego użytku i wdrażanie modeli w konfiguracji z wieloma kontami, zapewniają skalowalność wzorców wdrażania modeli omówionych w poście do kilku modeli w całej organizacji.

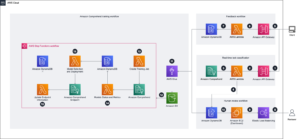

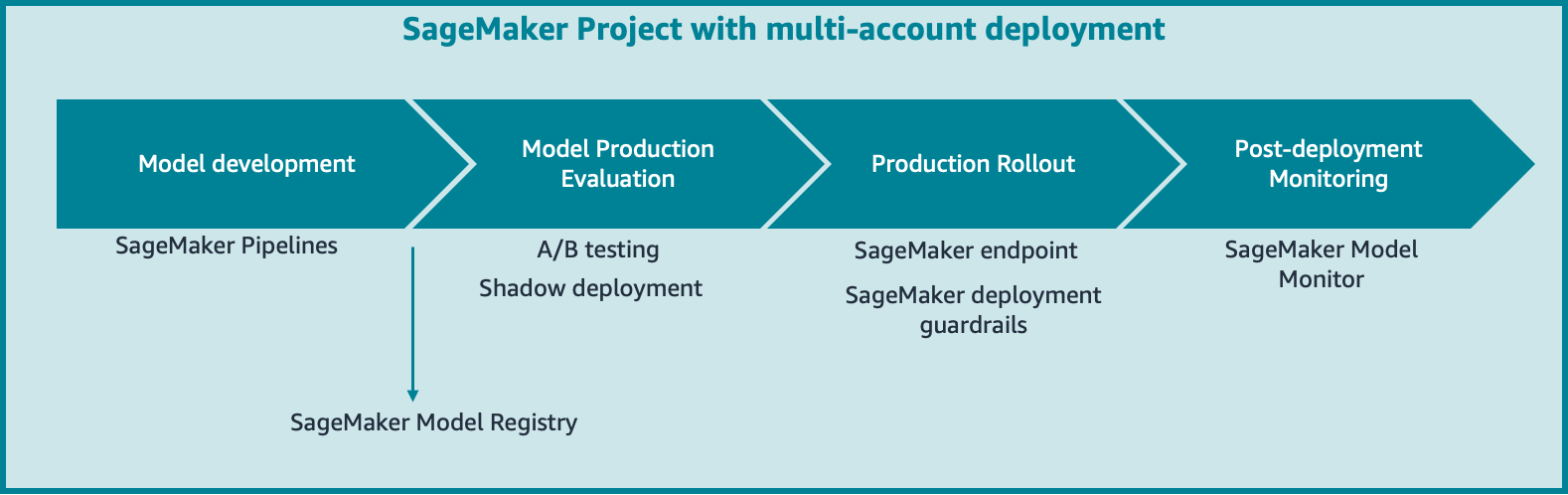

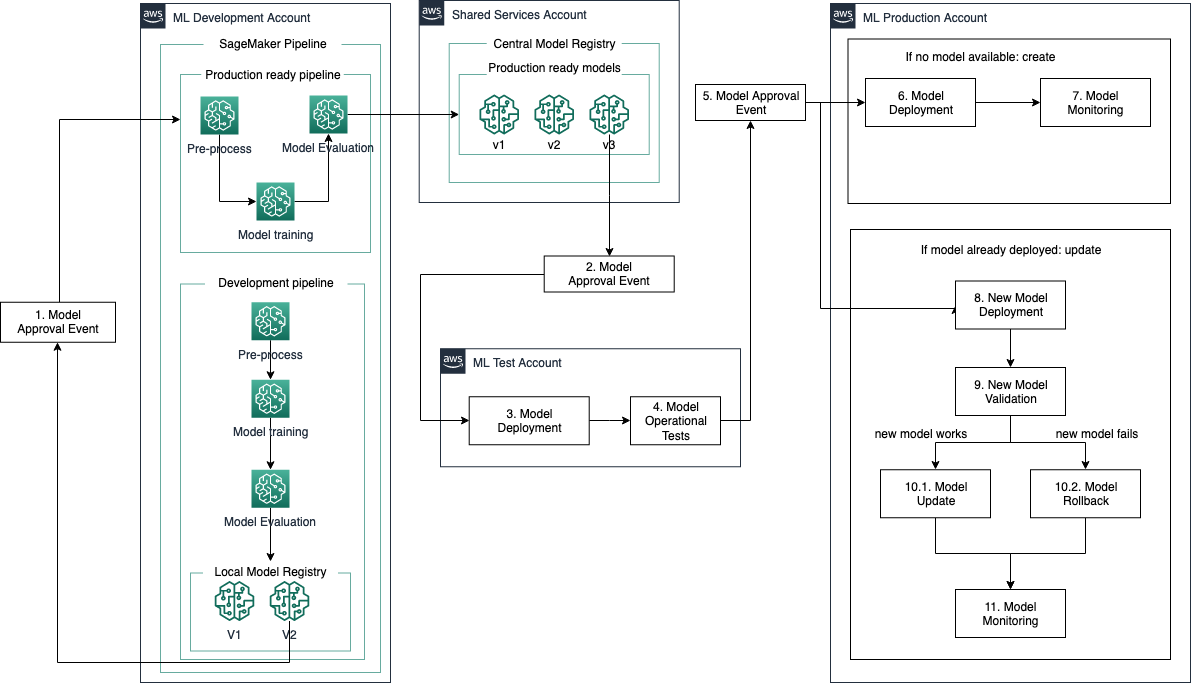

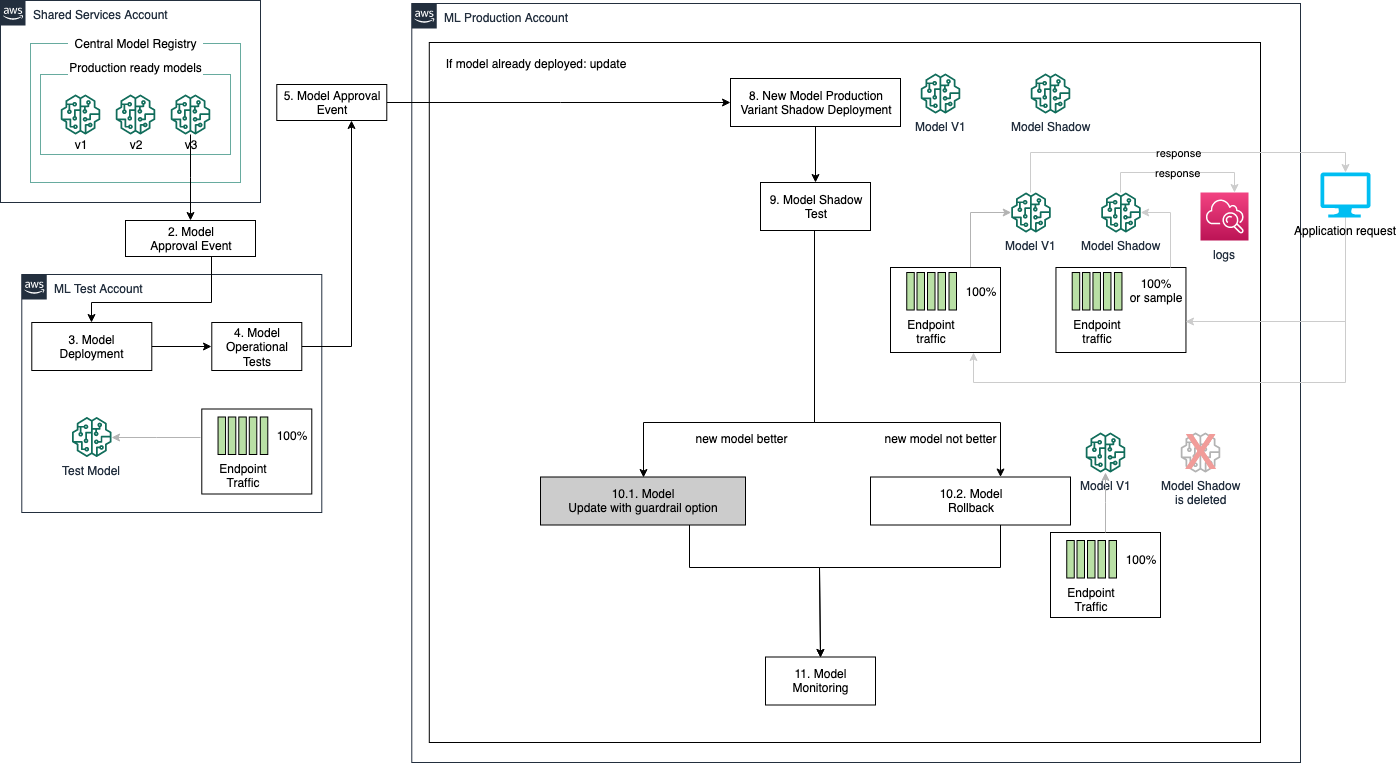

Poniższy rysunek przedstawia typowy wzorzec łączenia możliwości SageMaker w celu stworzenia kompleksowego potoku budowania i wdrażania modeli. W tym przykładzie model jest tworzony w SageMaker przy użyciu Praca w SageMaker Przetwarzanie do uruchomienia kodu przetwarzającego dane, który jest używany do przygotowania danych dla algorytmu ML. Oferty pracy szkoleniowej SageMaker są następnie używane do uczenia modelu ML na danych generowanych przez zadanie przetwarzania. Artefakty modelu i powiązane metadane są przechowywane w pliku Rejestr modeli SageMaker jako ostatni etap procesu szkoleniowego. Jest to zorganizowane przez Rurociągi SageMaker, która jest specjalnie zaprojektowaną usługą CI/CD dla ML, która pomaga automatyzować przepływy pracy ML i zarządzać nimi na dużą skalę.

Po zatwierdzeniu model jest testowany w środowisku produkcyjnym za pomocą testów A/B lub wdrażania w tle. Po zatwierdzeniu modelu w środowisku produkcyjnym używamy rejestru modeli do zatwierdzenia modelu do wdrożenia produkcyjnego w punkcie końcowym SageMaker przy użyciu jednej z opcji poręczy wdrażania.

Po zakończeniu procesu aktualizacji modelu, Monitor modelu SageMaker stale monitoruje wydajność modelu pod kątem odchyleń w modelu i jakości danych. Ten proces jest zautomatyzowany do wielu przypadków użycia Projekt SageMaker szablony mapujące wdrożenie infrastruktury do konfiguracji wielu kont w celu zapewnienia pełnej izolacji zasobów i łatwiejszej kontroli kosztów.

Wzorce wdrażania punktów końcowych z jednym modelem

Podczas wdrażania modeli w środowisku produkcyjnym po raz pierwszy nie masz uruchomionego modelu do porównania, a wdrożony model będzie używany przez aplikację biznesową. Po wdrożeniu i monitorowaniu modelu w środowisku produkcyjnym możesz chcieć aktualizować model regularnie lub na żądanie, gdy dostępne są nowe dane lub gdy w modelu wykryto lukę w wydajności. Aktualizując istniejący model, chcesz mieć pewność, że nowy model działa lepiej niż bieżący i może obsłużyć ruch związany z żądaniami prognoz z aplikacji biznesowych. W tym okresie sprawdzania poprawności chcesz, aby bieżący model był nadal dostępny do ewentualnego wycofania, aby zminimalizować ryzyko przestojów w aplikacjach.

W szerszym obrazie rozwoju modelu modele są zazwyczaj szkolone na koncie rozwoju nauki o danych. Obejmuje to przepływy pracy związane z eksperymentowaniem, często używane w opracowywaniu modeli, a także przepływy pracy ponownego szkolenia używane w potokach gotowych do produkcji. Wszystkie metadane dla tych eksperymentów można śledzić za pomocą Eksperymenty Amazon SageMaker w trakcie rozwoju. Po włączeniu przepływu pracy do potoku do użytku produkcyjnego metadane są automatycznie śledzone przez SageMaker Pipelines. Aby śledzić opłacalne modele produkcyjne w jednym miejscu, po przeprowadzeniu eksperymentów, które doprowadziły metryki wydajności modelu (precyzja, powtarzalność itd.) do poziomu akceptowalnego dla produkcji, krok warunkowy w potoku SageMaker umożliwia zarejestrowanie modelu w rejestrze modeli.

Rejestr modelu umożliwia wyzwolenie wdrożenia tego modelu za pomocą ręcznego lub automatycznego procesu zatwierdzania. To wdrożenie odbywa się na koncie testowym ML, na którym testy operacyjne, takie jak testy integracyjne, testy jednostkowe, opóźnienie modelu i wszelkie dodatkowe walidacje modelu, można przeprowadzić w odniesieniu do nowej wersji modelu. Należy pamiętać, że testy A/B i testy w tle nie są wykonywane na koncie testowym ML, ale raczej na koncie produkcyjnym ML.

Gdy model przejdzie wszystkie walidacje na koncie testowym, jest gotowy do wdrożenia w środowisku produkcyjnym. Nowy proces zatwierdzania uruchamia to wdrożenie, a zabezpieczenia wdrożenia SageMaker pozwalają na kontrolowane wydanie i przejrzysty proces aktualizacji modelu zgodnie z wybranym trybem zmiany ruchu.

Poniższy diagram ilustruje tę architekturę rozwiązania.

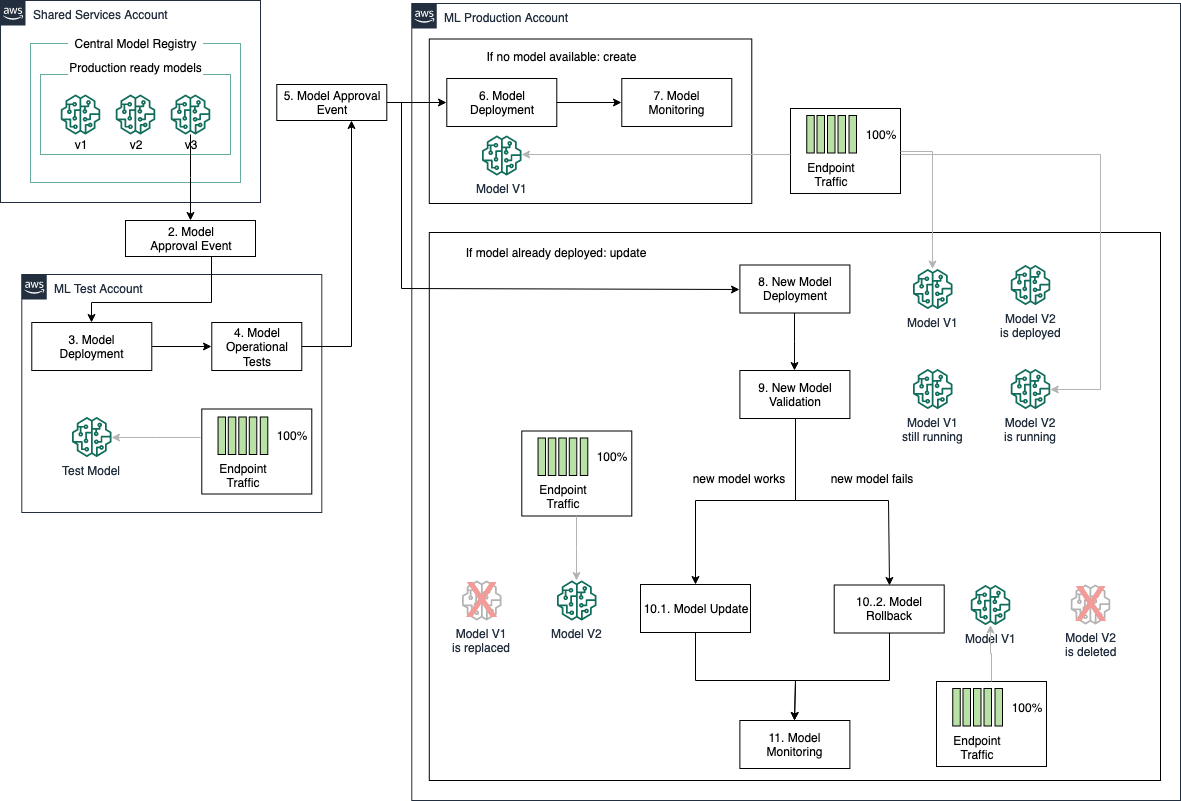

Wszystko na raz zmiana ruchu

Połączenia wszystko na raz w trybie zmiany ruchu umożliwia aktualizację nowej wersji modelu (zielona flota) poprzez całkowite przeniesienie 100% ruchu z obecnego modelu (niebieska flota) do nowego modelu. Dzięki tej opcji możesz skonfigurować okres pieczenia, podczas którego obie wersje Twojego modelu będą nadal działać, i możesz szybko i automatycznie przywrócić bieżącą wersję, jeśli nowy model nie działa zgodnie z oczekiwaniami. Wadą tej opcji jest to, że wpływa to na cały ruch danych jednocześnie, więc jeśli wystąpi problem z wdrożeniem modelu, wpłynie to na wszystkich użytkowników korzystających z aplikacji podczas procesu wdrażania. Następująca architektura pokazuje, w jaki sposób opcja przenoszenia ruchu jednocześnie obsługuje aktualizacje modelu.

Jednoczesne przenoszenie ruchu można włączyć do narzędzi MLOps poprzez zdefiniowanie konfiguracji wdrożenia punktu końcowego za pomocą BlueGreenUpdatePolity Ustawić ALL_AT_ONCE. W potoku MLOps, po zatwierdzeniu nowego modelu do wdrożenia na koncie produkcyjnym ML, SageMaker sprawdza, czy punkt końcowy modelu już istnieje. Jeśli tak, to ALL_AT_ONCE konfiguracja wyzwala aktualizację punktu końcowego zgodną z architekturą. Twoje wycofanie punktu końcowego jest kontrolowane na podstawie Alarmy CloudWatch zdefiniowany przez twój punkt końcowy AutoRollbackConfiguration, który po uruchomieniu automatycznie rozpoczyna przywracanie modelu do bieżącej wersji modelu.

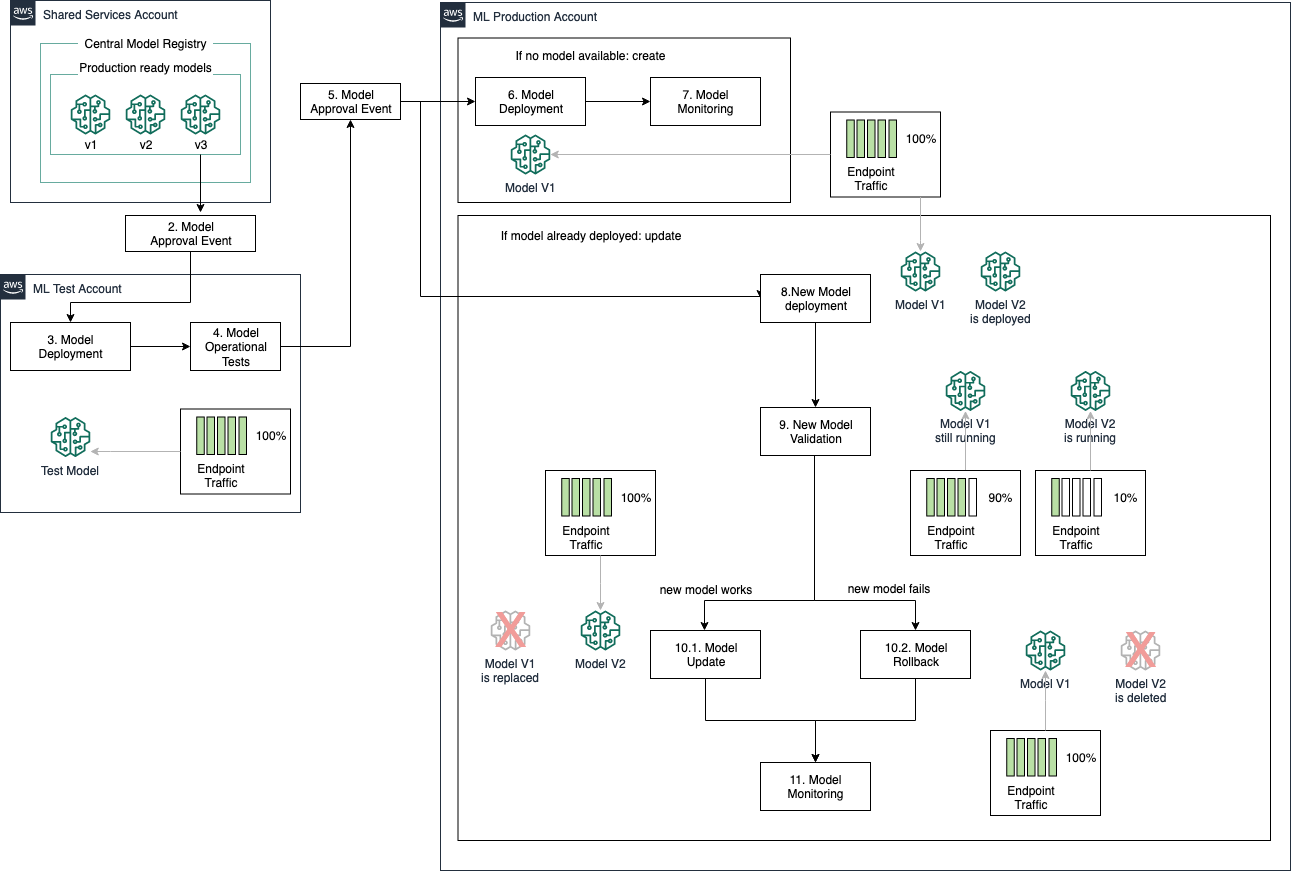

Zmiana ruchu na Kanarach

Połączenia przesunięcie ruchu kanaryjskiego tryb umożliwia przetestowanie nowego modelu (zielonej floty) z niewielką częścią ruchu danych przed aktualizacją działającego modelu (niebieska flota) do nowej wersji lub wycofaniem nowej wersji, w zależności od wyniku testów kanarkowych. Część ruchu używana do testowania nowego modelu nazywana jest kanarkiem, aw tej opcji ryzyko wystąpienia problematycznego nowego modelu jest zminimalizowane do ruchu kanaryjskiego, przy jednoczesnym zminimalizowaniu czasu aktualizacji.

Wdrożenia Canary pozwalają zminimalizować ryzyko wdrożenia nowej wersji modelu poprzez udostępnienie nowej wersji modelu mniejszej grupie użytkowników w celu monitorowania skuteczności w określonym czasie. Wadą jest zarządzanie wieloma wersjami przez okres czasu, który pozwala na gromadzenie metryk wydajności, które są wystarczająco znaczące, aby określić wpływ na wydajność. Zaletą jest możliwość wyodrębnienia ryzyka dla mniejszej grupy użytkowników.

Przesuwanie ruchu Canary można włączyć do narzędzi MLOps, definiując konfigurację wdrożenia punktu końcowego za pomocą pliku BlueGreenUpdatePolity Ustawić CANARY i definiowanie CanarySize aby określić, jaka część ruchu w punkcie końcowym powinna zostać przekierowana do nowej wersji modelu. Podobnie jak w przypadku opcji wszystko na raz, w potoku MLOps, po zatwierdzeniu nowego modelu do wdrożenia na koncie produkcyjnym ML, SageMaker sprawdza, czy punkt końcowy modelu już istnieje. Jeśli tak, to CANARY konfiguracja wyzwala aktualizację punktu końcowego, która jest zgodna z architekturą przedstawioną na poniższym diagramie. Wycofanie Twojego punktu końcowego jest kontrolowane na podstawie alarmów CloudWatch zdefiniowanych przez Twój punkt końcowy AutoRollbackConfiguration który po uruchomieniu automatycznie rozpoczyna przywracanie modelu do bieżącej wersji modelu. Przydatne typy alarmów do wdrożenia to 500 kodów stanu i opóźnienie modelu; jednak te ustawienia alarmów należy dostosować do konkretnego przypadku biznesowego i technologii uczenia maszynowego.

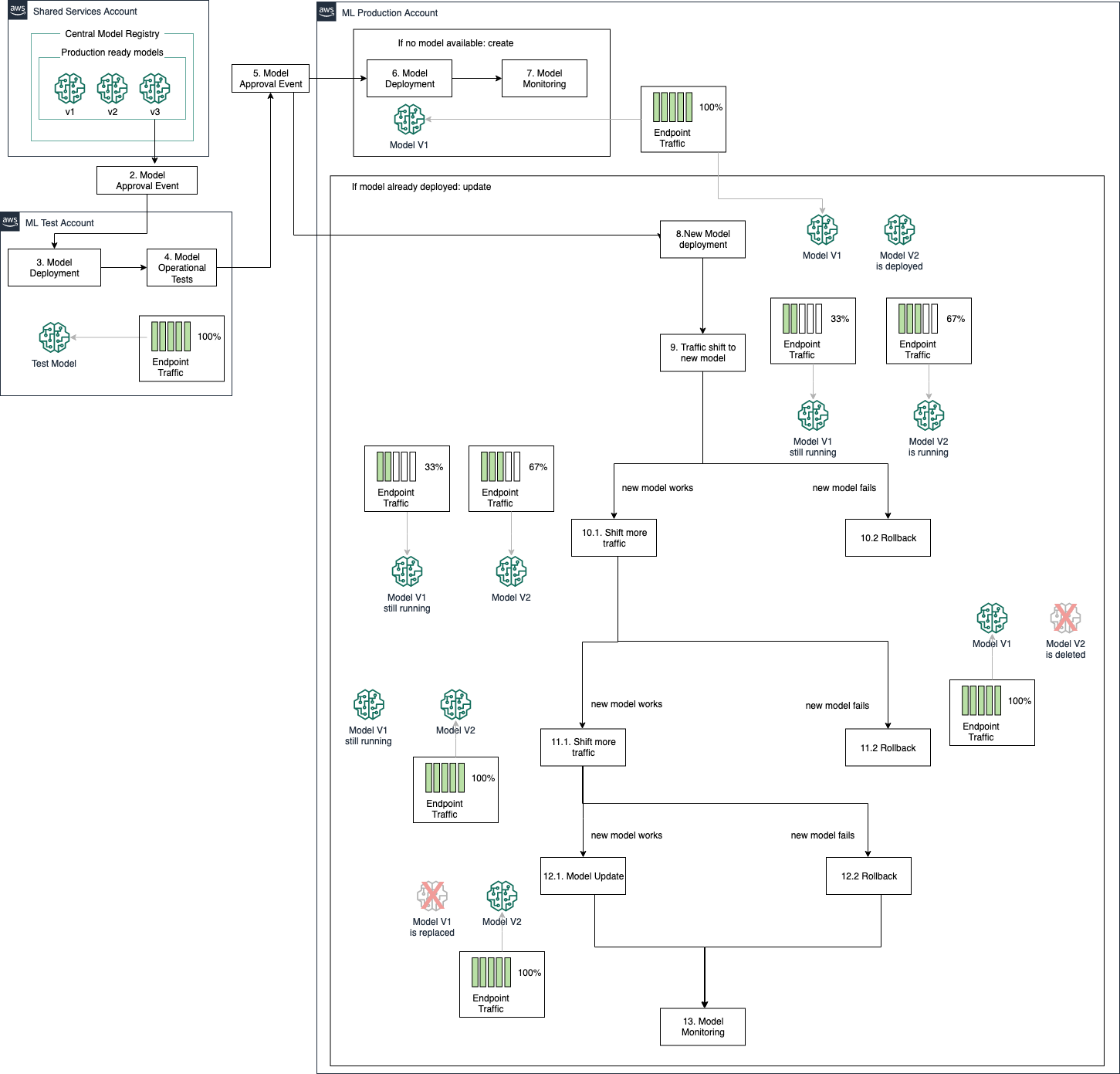

Liniowa zmiana ruchu

W liniowe przesunięcie ruchu modelu, stopniowo zmieniasz ruch z obecnego modelu (niebieska flota) na nową wersję modelu (zielona flota), stopniowo zwiększając ruch danych wysyłanych do nowego modelu. W ten sposób odsetek ruchu używanego do testowania nowej wersji modelu stopniowo wzrasta z każdym krokiem, a czas pieczenia dla każdego kroku zapewnia, że model nadal działa z nowym ruchem. Dzięki tej opcji minimalizujesz ryzyko wdrożenia modelu o niskiej wydajności i stopniowo narażasz nowy model na większy ruch danych. Wadą tego podejścia jest wydłużenie czasu aktualizacji i zwiększenie kosztów równoległego działania obu modeli.

Liniowe przenoszenie ruchu można włączyć do narzędzi MLOps, definiując konfigurację wdrożenia punktu końcowego z ustawieniem BlueGreenUpdatePolicy na LINEAR i definiowanie LinearStepSize aby określić, jaka część ruchu powinna zostać przekierowana do nowego modelu w każdym kroku. Podobnie jak w przypadku opcji wszystko na raz, w potoku MLOps, po zatwierdzeniu nowego modelu do wdrożenia na koncie produkcyjnym ML, SageMaker sprawdza, czy punkt końcowy modelu już istnieje. Jeśli tak, to LINEAR konfiguracja wyzwala aktualizację punktu końcowego, która jest zgodna z architekturą wskazaną na poniższym diagramie. Wycofanie Twojego punktu końcowego jest kontrolowane na podstawie alarmów CloudWatch zdefiniowanych przez Twój punkt końcowy AutoRollbackConfiguration który po uruchomieniu automatycznie rozpoczyna przywracanie modelu do bieżącej wersji modelu.

Wzorce wdrożeniowe z modelowymi wariantami produkcyjnymi

Niezależnie od wzorca wdrożenia wybranego dla aplikacji można również wykorzystać warianty produkcyjne do sprawdzenia wydajności modelu przed aktualizacją punktu końcowego lub zaimplementować dodatkowe wzorce wdrożenia, takie jak wdrożenia w tle. W takim przypadku chcesz dodać proces ręczny lub automatyczny, aby wybrać najlepszy model do wdrożenia przed aktualizacją punktu końcowego. Poniższa architektura pokazuje, jak zachowuje się ruch i odpowiedź punktu końcowego w scenariuszu wdrażania w tle. W tym scenariuszu każde żądanie prognozy jest przesyłane zarówno do nowych, jak i wdrożonych modeli; jednak tylko obecnie wdrożony model obsługuje odpowiedź predykcji dla aplikacji biznesowej, podczas gdy prognoza obsługiwana z nowego modelu jest obsługiwana tylko w celu analizy wydajności względem aktualnie wdrożonego modelu. Po ocenie wydajności modelu nowa wersja modelu może zostać wdrożona w celu prognozowania ruchu w odpowiedzi na usługi w aplikacjach biznesowych.

Wycofywanie

Niezależnie od strategii wdrażania wybranej dla wdrożenia modelu, chcesz mieć możliwość przywrócenia poprzedniej wersji modelu, jeśli wydajność nowego modelu jest niższa niż wydajność bieżącego modelu. Aby to zrobić, jednocześnie minimalizując przestoje aplikacji, musisz utrzymywać bieżący model działający równolegle z nowym, dopóki nie będziesz mieć pewności, że nowy model działa lepiej niż obecny.

Poręcze wdrażania SageMaker umożliwiają ustawienie alarmów i automatyczne przywrócenie poprzednich wersji modelu w okresie walidacji modelu. Po zakończeniu okresu sprawdzania poprawności nadal może być konieczne przywrócenie poprzedniej wersji modelu w celu rozwiązania nowego problemu wykrytego po zakończeniu aktualizacji modelu. Aby to zrobić, możesz skorzystać z rejestru modeli SageMaker modele odrzucone i zatwierdzone i wyzwolić proces przywracania.

Wnioski

W tym poście nauczyłeś się, jak łączyć warianty modeli punktów końcowych SageMaker i zabezpieczenia wdrażania z możliwościami MLOps w celu tworzenia kompleksowych wzorców dla rozwoju modelu. Udostępniliśmy przykładową implementację poręczy wdrożeniowych z przesunięciem kanarkowym i liniowym, połączonych z potokami SageMaker i rejestrem modeli za pośrednictwem niestandardowego projektu SageMaker. W następnym kroku spróbuj dostosować poniższe szablon wdrożyć strategię wdrożeniową Twojej organizacji.

Referencje

O autorach

Maira Ladeira Tanke jest Architektem Rozwiązań ML w AWS. Z doświadczeniem w dziedzinie nauki o danych, ma 9-letnie doświadczenie w architekturze i budowaniu aplikacji ML dla klientów z różnych branż. Jako lider techniczny pomaga klientom przyspieszyć osiąganie wartości biznesowej dzięki pojawiającym się technologiom i innowacyjnym rozwiązaniom. W wolnym czasie Maira lubi podróżować i spędzać czas z rodziną w ciepłym miejscu.

Maira Ladeira Tanke jest Architektem Rozwiązań ML w AWS. Z doświadczeniem w dziedzinie nauki o danych, ma 9-letnie doświadczenie w architekturze i budowaniu aplikacji ML dla klientów z różnych branż. Jako lider techniczny pomaga klientom przyspieszyć osiąganie wartości biznesowej dzięki pojawiającym się technologiom i innowacyjnym rozwiązaniom. W wolnym czasie Maira lubi podróżować i spędzać czas z rodziną w ciepłym miejscu.

Claya Elmore'a jest Architektem Rozwiązań Specjalistycznych AI/ML w AWS. Po spędzeniu wielu godzin w laboratorium badań materiałowych, jego doświadczenie w inżynierii chemicznej szybko porzucił, aby zająć się uczeniem maszynowym. Pracował nad aplikacjami ML w wielu różnych branżach, od handlu energią po marketing hotelarski. Clay jest szczególnie zainteresowany wprowadzaniem praktyk tworzenia oprogramowania do ML i kierowaniem klientów w kierunku powtarzalnych, skalowalnych rozwiązań przy użyciu tych zasad. W wolnym czasie Clay lubi jeździć na nartach, układać kostki Rubika, czytać i gotować.

Claya Elmore'a jest Architektem Rozwiązań Specjalistycznych AI/ML w AWS. Po spędzeniu wielu godzin w laboratorium badań materiałowych, jego doświadczenie w inżynierii chemicznej szybko porzucił, aby zająć się uczeniem maszynowym. Pracował nad aplikacjami ML w wielu różnych branżach, od handlu energią po marketing hotelarski. Clay jest szczególnie zainteresowany wprowadzaniem praktyk tworzenia oprogramowania do ML i kierowaniem klientów w kierunku powtarzalnych, skalowalnych rozwiązań przy użyciu tych zasad. W wolnym czasie Clay lubi jeździć na nartach, układać kostki Rubika, czytać i gotować.

Shelbee Eigenbrode jest głównym architektem rozwiązań specjalizujących się w sztucznej inteligencji i uczeniu maszynowym w AWS. Od 24 lat zajmuje się technologią, obejmując wiele branż, technologii i ról. Obecnie koncentruje się na połączeniu swojego doświadczenia w DevOps i ML w domenie MLOps, aby pomóc klientom w dostarczaniu i zarządzaniu obciążeniami ML na dużą skalę. Z ponad 35 patentami przyznanymi w różnych dziedzinach technologii, pasjonuje ją ciągła innowacyjność i wykorzystywanie danych do osiągania wyników biznesowych. Shelbee jest współtwórcą i instruktorem specjalizacji Practical Data Science na Coursera. Jest także współdyrektorką Women In Big Data (WiBD), oddział Denver. W wolnym czasie lubi spędzać czas z rodziną, przyjaciółmi i nadaktywnymi psami.

Shelbee Eigenbrode jest głównym architektem rozwiązań specjalizujących się w sztucznej inteligencji i uczeniu maszynowym w AWS. Od 24 lat zajmuje się technologią, obejmując wiele branż, technologii i ról. Obecnie koncentruje się na połączeniu swojego doświadczenia w DevOps i ML w domenie MLOps, aby pomóc klientom w dostarczaniu i zarządzaniu obciążeniami ML na dużą skalę. Z ponad 35 patentami przyznanymi w różnych dziedzinach technologii, pasjonuje ją ciągła innowacyjność i wykorzystywanie danych do osiągania wyników biznesowych. Shelbee jest współtwórcą i instruktorem specjalizacji Practical Data Science na Coursera. Jest także współdyrektorką Women In Big Data (WiBD), oddział Denver. W wolnym czasie lubi spędzać czas z rodziną, przyjaciółmi i nadaktywnymi psami.

Qiyun Zhao jest starszym inżynierem ds. rozwoju oprogramowania w zespole Amazon SageMaker Inference Platform. Jest głównym deweloperem poręczy wdrażania i wdrożeń w tle i koncentruje się na pomaganiu klientom w zarządzaniu obciążeniami i wdrożeniami ML na dużą skalę przy wysokiej dostępności. Pracuje również nad ewolucją architektury platformy w celu szybkiego i bezpiecznego wdrażania zadań ML oraz swobodnego przeprowadzania eksperymentów ML online. W wolnym czasie lubi czytać, grać w gry i podróżować.

Qiyun Zhao jest starszym inżynierem ds. rozwoju oprogramowania w zespole Amazon SageMaker Inference Platform. Jest głównym deweloperem poręczy wdrażania i wdrożeń w tle i koncentruje się na pomaganiu klientom w zarządzaniu obciążeniami i wdrożeniami ML na dużą skalę przy wysokiej dostępności. Pracuje również nad ewolucją architektury platformy w celu szybkiego i bezpiecznego wdrażania zadań ML oraz swobodnego przeprowadzania eksperymentów ML online. W wolnym czasie lubi czytać, grać w gry i podróżować.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/mlops-deployment-best-practices-for-real-time-inference-model-serving-endpoints-with-amazon-sagemaker/

- 100

- 2022

- 7

- 9

- a

- zdolność

- Zdolny

- przyśpieszyć

- do przyjęcia

- Stosownie

- Konto

- Księgowość

- Osiągać

- osiągnięcie

- w poprzek

- w dodatku

- dodatek

- Dodatkowy

- do tego

- zaawansowany

- Korzyść

- Po

- przed

- AI

- AI / ML

- alarm

- algorytm

- Wszystkie kategorie

- pozwala

- już

- Amazonka

- Amazon Sage Maker

- ilość

- analiza

- i

- Inne

- Zastosowanie

- aplikacje

- stosowany

- podejście

- zatwierdzenie

- Zatwierdzać

- zatwierdzony

- architektura

- na około

- aspekty

- powiązany

- zautomatyzować

- zautomatyzowane

- automatycznie

- dostępność

- dostępny

- AWS

- z powrotem

- tło

- na podstawie

- podstawa

- bo

- staje się

- zanim

- za

- jest

- korzyści

- BEST

- Najlepsze praktyki

- Ulepsz Swój

- pomiędzy

- Duży

- Big Data

- Niebieski

- Bringing

- szeroki

- szerszy

- przyniósł

- budować

- Budowanie

- wybudowany

- biznes

- Aplikacje biznesowe

- nazywa

- możliwości

- walizka

- Etui

- CD

- pewien

- zmiana

- wymiana pieniędzy

- Rozdział

- Wykrywanie urządzeń szpiegujących

- chemiczny

- Wybierając

- wybrał

- zamknięte

- kod

- połączyć

- połączony

- łączenie

- wspólny

- porównać

- kompletny

- całkowicie

- pojęcie

- pewność

- systemu

- połączony

- połączenie

- Rozważać

- Rozważania

- zawierać

- kontekst

- nieustannie

- ciągły

- bez przerwy

- kontrola

- kontrolowanych

- Koszty:

- Koszty:

- pokrywa

- pokryty

- Stwórz

- Aktualny

- Obecnie

- zwyczaj

- Klientów

- dostosowane

- dane

- analiza danych

- nauka danych

- grudzień

- Podejmowanie decyzji

- Domyślnie

- zdefiniowane

- definiowanie

- dostarczyć

- dostawa

- Kreowanie

- demonstruje

- Denver

- W zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- wdrożenia

- opisane

- wykryte

- Ustalać

- rozwinięty

- Deweloper

- oprogramowania

- różne

- bezpośrednio

- odkryty

- dyskutować

- omówione

- dystrybuowane

- rozdzielczy

- 分配

- Nie

- domena

- domeny

- nie

- minusem

- przestojów

- napęd

- podczas

- każdy

- łatwiej

- z łatwością

- skuteczność

- bądź

- wschodzących

- umożliwiać

- koniec końców

- Punkt końcowy

- energia

- inżynier

- Inżynieria

- dość

- zapewnić

- zapewnia

- zapewnienie

- Środowisko

- niezbędny

- oceniać

- oceniane

- ewolucje

- przykład

- Przede wszystkim system został opracowany

- istnieje

- spodziewany

- doświadczenie

- odkryj

- narażony

- członków Twojej rodziny

- FAST

- Korzyści

- informacja zwrotna

- Postać

- i terminów, a

- pierwszy raz

- FLOTA

- koncentruje

- skupienie

- następujący

- następujący sposób

- Fundamenty

- Framework

- Darmowy

- przyjaciele

- od

- pełny

- Funkcjonalność

- Funkcje

- dalej

- gier

- szczelina

- zebranie

- Ogólne

- miejsce

- Dać

- dany

- stopniowo

- udzielony

- Zielony

- Zarządzanie

- uchwyt

- Uchwyty

- pomoc

- pomoc

- pomaga

- tutaj

- Wysoki

- gościnność

- Hosting

- GODZINY

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- Rezultat

- wdrożenia

- realizacja

- realizowane

- wykonawczych

- poprawa

- in

- zawierać

- obejmuje

- Włącznie z

- Rejestrowy

- wzrosła

- Zwiększenia

- wzrastający

- przemysłowa

- Informacja

- Infrastruktura

- Innowacja

- Innowacyjny

- przykład

- zamiast

- integrować

- Integracja

- integracja

- odsetki

- Wprowadzenie

- izolacja

- problem

- problemy

- IT

- Praca

- Oferty pracy

- Trzymać

- Klawisz

- laboratorium

- Nazwisko

- Utajenie

- uruchomiona

- prowadzić

- dowiedziałem

- nauka

- poziom

- wifecycwe

- Katalogowany

- relacja na żywo

- dłużej

- niski

- maszyna

- uczenie maszynowe

- utrzymać

- zarządzanie

- i konserwacjami

- zarządzający

- podręcznik

- wiele

- mapowanie

- rynek

- Marketing

- materiały

- Maksymalizuj

- wymowny

- mechanizm

- wzmiankowany

- Metadane

- metody

- metryczny

- Metryka

- może

- minimalizowanie

- ML

- MLOps

- Moda

- model

- Testowanie modelu

- modele

- monitor

- monitorowane

- monitorowanie

- monitory

- jeszcze

- większość

- wielokrotność

- Natura

- niezbędny

- Potrzebować

- Nowości

- Następny

- Oferty

- ONE

- Online

- operacyjny

- operacje

- Optymalny

- Option

- Opcje

- zamówienie

- organizacja

- Inne

- Wynik

- opisane

- pakiet

- Parallel

- parametr

- część

- przebiegi

- pasja

- Patenty

- Wzór

- wzory

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonuje

- okres

- obraz

- rurociąg

- Miejsce

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- możliwy

- Post

- Praktyczny

- praktyki

- Detaliczność

- przepowiednia

- Przewidywania

- Przygotować

- teraźniejszość

- poprzedni

- poprzednio

- Główny

- Zasady

- Problem

- wygląda tak

- przetwarzanie

- Wytworzony

- Produkcja

- projekt

- projektowanie

- zaproponowane

- chronić

- zapewniać

- pod warunkiem,

- zapewnia

- cel

- położyć

- jakość

- szybko

- zasięg

- nośny

- Czytający

- gotowy

- real

- w czasie rzeczywistym

- otrzymuje

- odbieranie

- Zalecana

- region

- zarejestrowany

- rejestr

- regularny

- zwolnić

- niezawodność

- rzetelny

- powtarzalne

- otrzymuje

- zażądać

- wywołań

- Badania naukowe

- Zasób

- odpowiedź

- powrót

- wielokrotnego użytku

- Ryzyko

- ryzyko

- role

- Rolka

- Walcowanie

- run

- bieganie

- sagemaker

- Wnioskowanie SageMakera

- Rurociągi SageMaker

- taki sam

- zadowolony

- zadowolony z

- Skalowalność

- skalowalny

- Skala

- scenariusz

- scenariusze

- nauka

- bezpieczne

- wybrany

- wysyłanie

- senior

- oddzielny

- służy

- usługa

- służąc

- zestaw

- w panelu ustawień

- ustawienie

- kilka

- Shadow

- Testowanie cienia

- przesunięcie

- PRZESUNIĘCIE

- powinien

- Targi

- znaczenie

- podobny

- Podobnie

- pojedynczy

- sytuacje

- mały

- mniejszy

- So

- Tworzenie

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Rozwiązywanie

- specjalny

- specjalista

- specyficzny

- wydać

- Spędzanie

- rozpoczęty

- rozpocznie

- statystyczny

- Rynek

- Ewolucja krok po kroku

- Cel

- Nadal

- przechowywany

- strategie

- Strategia

- składane

- taki

- wsparcie

- Przełącznik

- systemy

- Brać

- trwa

- cel

- zespół

- Techniczny

- Technologies

- Technologia

- Szablony

- test

- Testowanie

- Testy

- Połączenia

- ich

- Przez

- wydajność

- TIE

- czas

- do

- narzędzia

- w kierunku

- Możliwość śledzenia

- śledzić

- Handel

- tradycyjny

- ruch drogowy

- Pociąg

- przeszkolony

- Trening

- przezroczysty

- Podróżowanie

- wyzwalać

- rozsierdzony

- typy

- zazwyczaj

- zrozumieć

- wyjątkowy

- jednostka

- Aktualizacja

- zaktualizowane

- Nowości

- aktualizowanie

- posługiwać się

- przypadek użycia

- Użytkownicy

- wykorzystać

- UPRAWOMOCNIĆ

- zatwierdzony

- uprawomocnienie

- wartość

- Wariant

- różnorodny

- wersja

- przez

- wykonalne

- ciepły

- waga

- Co

- Co to jest

- który

- Podczas

- będzie

- w ciągu

- Kobieta

- pracował

- przepływów pracy

- działa

- by

- pisanie

- lat

- You

- Twój

- zefirnet