To jest post gościnny od Kapitał skalowalny, wiodąca firma FinTech w Europie oferująca cyfrowe zarządzanie majątkiem i platformę maklerską ze zryczałtowaną stawką handlową.

Jako szybko rozwijająca się firma, celem Scalable Capital jest nie tylko zbudowanie innowacyjnej, solidnej i niezawodnej infrastruktury, ale także zapewnienie naszym klientom najlepszych doświadczeń, szczególnie jeśli chodzi o obsługę klienta.

Scalable codziennie otrzymuje setki zapytań e-mailowych od naszych klientów. Dzięki wdrożeniu nowoczesnego modelu przetwarzania języka naturalnego (NLP) proces odpowiedzi został ukształtowany znacznie efektywniej, a czas oczekiwania klientów został znacząco skrócony. Model uczenia maszynowego (ML) klasyfikuje nowe przychodzące żądania klientów od razu po ich otrzymaniu i przekierowuje je do predefiniowanych kolejek, co pozwala naszym dedykowanym agentom sukcesu klienta skupić się na treści e-maili zgodnie z ich umiejętnościami i zapewnić odpowiednie odpowiedzi.

W tym poście pokazujemy zalety techniczne zastosowania transformatorów Hugging Face Amazon Sage Maker, takich jak szkolenia i eksperymenty na dużą skalę oraz zwiększona produktywność i efektywność kosztowa.

Instrukcja problemu

Scalable Capital to jeden z najszybciej rozwijających się FinTechów w Europie. Mając na celu demokratyzację inwestycji, firma zapewnia swoim klientom łatwy dostęp do rynków finansowych. Klienci Scalable mogą aktywnie uczestniczyć w rynku za pośrednictwem maklerskiej platformy handlowej firmy lub korzystać z Scalable Wealth Management do inwestowania w inteligentny i zautomatyzowany sposób. W 2021 roku Scalable Capital odnotował dziesięciokrotny wzrost bazy klientów, z kilkudziesięciu tysięcy do setek tysięcy.

Aby zapewnić naszym klientom najwyższej klasy (i spójne) doświadczenie użytkownika w zakresie produktów i obsługi klienta, firma szukała zautomatyzowanych rozwiązań, które generowałyby wydajność w celu uzyskania skalowalnego rozwiązania przy jednoczesnym zachowaniu doskonałości operacyjnej. Zespoły zajmujące się analizą danych i obsługą klienta Scalable Capital stwierdziły, że jednym z największych wąskich gardeł w obsłudze naszych klientów jest odpowiadanie na zapytania e-mailowe. Wąskim gardłem był w szczególności etap klasyfikacji, na którym pracownicy musieli codziennie czytać i oznaczać teksty żądań. Po skierowaniu e-maili do odpowiednich kolejek, odpowiedni specjaliści szybko zaangażowali się i rozwiązali sprawy.

Aby usprawnić proces klasyfikacji, zespół analityki danych w Scalable zbudował i wdrożył wielozadaniowy model NLP, wykorzystując najnowocześniejszą architekturę transformatorową, w oparciu o wstępnie wytrenowane Distilbert-base-niemiecka obudowa model opublikowany przez Hugging Face. Distilbert-base-niemiecka obudowa używa destylacja wiedzy metoda wstępnego uczenia mniejszego modelu reprezentacji języka ogólnego przeznaczenia niż oryginalny model podstawowy BERT. Wersja destylowana osiąga wydajność porównywalną z wersją pierwotną, a jednocześnie jest mniejsza i szybsza. Aby ułatwić nasz proces cyklu życia uczenia maszynowego, zdecydowaliśmy się zastosować SageMaker do tworzenia, wdrażania, obsługi i monitorowania naszych modeli. W następnej sekcji przedstawiamy projekt architektury naszego projektu.

Omówienie rozwiązania

Infrastruktura ML Scalable Capital składa się z dwóch kont AWS: jednego jako środowiska dla etapu rozwoju i drugiego dla etapu produkcji.

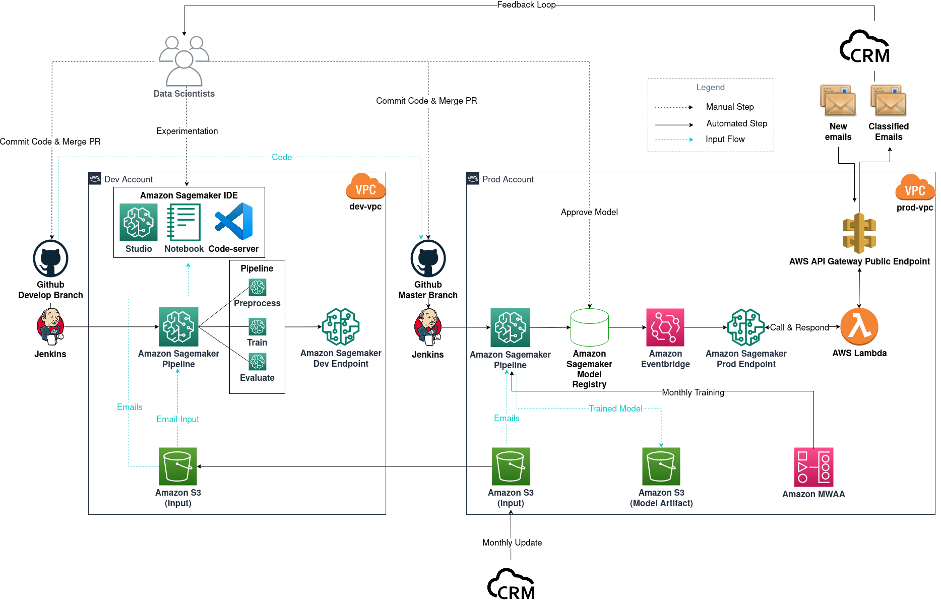

Poniższy diagram przedstawia przepływ pracy w naszym projekcie klasyfikatora poczty e-mail, ale można go również uogólnić na inne projekty związane z analizą danych.

Schemat projektu klasyfikacji wiadomości e-mail

Przepływ pracy składa się z następujących elementów:

- Eksperymenty modelowe – Naukowcy zajmujący się danymi korzystają Studio Amazon SageMaker wykonanie pierwszych kroków w cyklu życia nauki o danych: eksploracyjna analiza danych (EDA), czyszczenie i przygotowanie danych oraz budowanie prototypowych modeli. Po zakończeniu fazy eksploracyjnej zwracamy się do VSCode hostowanego przez notatnik SageMaker jako naszego narzędzia do zdalnego programowania w celu modułyzacji i produkcji naszej bazy kodu. Aby poznać różne typy modeli i konfiguracji modeli, a jednocześnie śledzić nasze eksperymenty, korzystamy z SageMaker Training i SageMaker Experiments.

- Budowa modelu – Po wybraniu modelu dla naszego przypadku użycia produkcyjnego, w tym przypadku wielozadaniowego Distilbert-base-niemiecka obudowa model, dostrojony na podstawie wstępnie wytrenowanego modelu z Hugging Face, zatwierdzamy i wypychamy nasz kod do gałęzi deweloperskiej Githuba. Zdarzenie scalania Github uruchamia nasz potok Jenkins CI, który z kolei rozpoczyna zadanie SageMaker Pipelines z danymi testowymi. Działa to jak test, aby upewnić się, że kody działają zgodnie z oczekiwaniami. Testowy punkt końcowy jest wdrażany do celów testowych.

- Wdrożenie modelu – Po upewnieniu się, że wszystko działa zgodnie z oczekiwaniami, badacze danych łączą gałąź deweloperską z gałęzią podstawową. To zdarzenie scalania wyzwala teraz zadanie SageMaker Pipelines wykorzystujące dane produkcyjne do celów szkoleniowych. Następnie tworzone są artefakty modelu i zapisywane w wynikach Usługa Amazon Simple Storage (Amazon S3), a nowa wersja modelu jest rejestrowana w rejestrze modeli SageMaker. Analitycy danych sprawdzają wydajność nowego modelu, a następnie zatwierdzają, czy jest on zgodny z oczekiwaniami. Zdarzenie zatwierdzenia modelu jest przechwytywane przez Most zdarzeń Amazona, który następnie wdraża model w punkcie końcowym SageMaker w środowisku produkcyjnym.

- MLOps – Ponieważ punkt końcowy SageMaker jest prywatny i nie można do niego dotrzeć usługami spoza VPC, an AWS Lambda funkcja i Brama Amazon API publiczne punkty końcowe są wymagane do komunikacji z CRM. Za każdym razem, gdy do skrzynki odbiorczej CRM dotrą nowe e-maile, CRM wywołuje publiczny punkt końcowy API Gateway, co z kolei wyzwala funkcję Lambda w celu wywołania prywatnego punktu końcowego SageMaker. Funkcja następnie przekazuje klasyfikację z powrotem do systemu CRM za pośrednictwem publicznego punktu końcowego bramy API. Aby monitorować wydajność naszego wdrożonego modelu, wdrażamy pętlę informacji zwrotnej pomiędzy CRM a analitykami danych, aby śledzić metryki predykcyjne z modelu. Co miesiąc CRM aktualizuje dane historyczne wykorzystywane do eksperymentów i uczenia modeli. Używamy Przepływy pracy zarządzane przez Amazon dla Apache Airflow (Amazon MWAA) jako osoba planująca nasze comiesięczne przekwalifikowanie.

W poniższych sekcjach bardziej szczegółowo opisujemy etapy przygotowywania danych, eksperymentowania z modelem i wdrażania modelu.

Przygotowywanie danych

Scalable Capital wykorzystuje narzędzie CRM do zarządzania i przechowywania danych e-mailowych. Odpowiednia treść wiadomości e-mail składa się z tematu, treści i banków depozytariuszy. Do każdego e-maila można przypisać trzy etykiety: z jakiej branży pochodzi e-mail, która kolejka jest odpowiednia i konkretny temat e-maila.

Zanim zaczniemy trenować jakiekolwiek modele NLP, upewniamy się, że dane wejściowe są czyste, a etykiety przypisane zgodnie z oczekiwaniami.

Aby odzyskać czystą treść zapytania od klientów Scalable, usuwamy z surowych danych e-mail oraz dodatkowy tekst i symbole, takie jak podpisy e-mail, impressum, cytaty z poprzednich wiadomości w łańcuchach e-mailowych, symbole CSS i tak dalej. W przeciwnym razie nasze przyszłe przeszkolone modele mogą doświadczyć obniżonej wydajności.

Etykiety do wiadomości e-mail ewoluują z biegiem czasu, w miarę jak zespoły obsługi klienta Scalable dodają nowe i udoskonalają lub usuwają istniejące, aby dostosować je do potrzeb biznesowych. Aby mieć pewność, że etykiety danych szkoleniowych oraz oczekiwane klasyfikacje przewidywań są aktualne, zespół analityki danych ściśle współpracuje z zespołem obsługi klienta, aby zapewnić poprawność etykiet.

Eksperymenty modelowe

Nasz eksperyment rozpoczynamy od łatwo dostępnych, wstępnie przeszkolonych Distilbert-base-niemiecka obudowa model opublikowany przez Hugging Face. Ponieważ wstępnie wytrenowany model jest modelem reprezentacji języka ogólnego przeznaczenia, możemy dostosować architekturę do wykonywania określonych zadań dalszych — takich jak klasyfikacja i odpowiadanie na pytania — poprzez podłączenie odpowiednich głowic do sieci neuronowej. W naszym przypadku kolejnym zadaniem, które nas interesuje, jest klasyfikacja sekwencji. Bez modyfikowania istniejącą architekturę, postanawiamy dostroić trzy osobne, wstępnie wytrenowane modele dla każdej z wymaganych kategorii. Z Pojemniki do głębokiego uczenia się SageMaker Przytulanie twarzy (DLC) rozpoczynanie eksperymentów NLP i zarządzanie nimi jest proste dzięki kontenerom Hugging Face i interfejsowi API SageMaker Experiments.

Poniżej znajduje się fragment kodu train.py:

Poniższy kod jest estymatorem Przytulonej Twarzy:

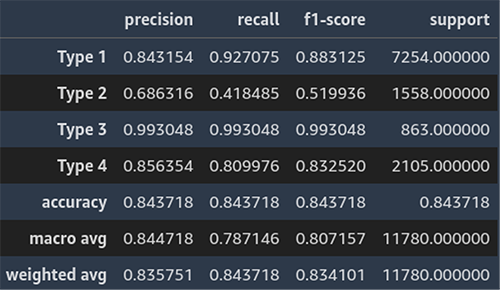

Aby zweryfikować precyzyjnie dostrojone modele, używamy metody Wynik F1 ze względu na niezrównoważony charakter naszego zbioru danych e-mailowych, ale także w celu obliczenia innych wskaźników, takich jak dokładność, precyzja i zapamiętywanie. Aby interfejs API SageMaker Experiments mógł zarejestrować metryki zadania szkoleniowego, musimy najpierw zalogować metryki do konsoli lokalnej zadania szkoleniowego, które są pobierane przez Amazon Cloud Watch. Następnie definiujemy prawidłowy format wyrażenia regularnego do przechwytywania dzienników CloudWatch. Definicje metryk obejmują nazwę metryk i walidację wyrażenia regularnego w celu wyodrębnienia metryk z zadania szkoleniowego:

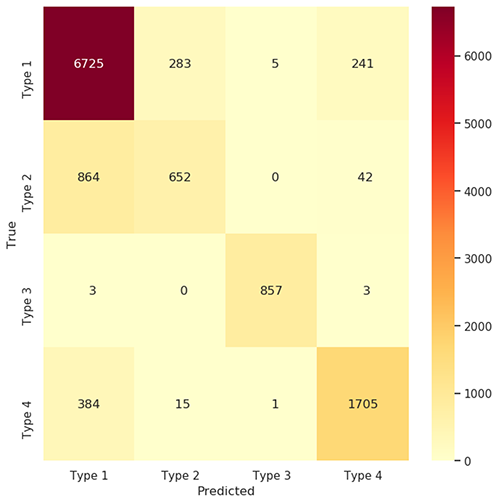

W ramach iteracji szkoleniowej modelu klasyfikatora do oceny wyniku używamy macierzy pomyłek i raportu klasyfikacji. Poniższy rysunek przedstawia macierz zamieszania dla przewidywania branży.

Macierz zamieszania

Poniższy zrzut ekranu przedstawia przykład raportu klasyfikacji dla prognozy branży.

Raport klasyfikacyjny

W kolejnej iteracji naszego eksperymentu skorzystamy z uczenie się wielozadaniowe udoskonalić nasz model. Uczenie się wielozadaniowe to forma szkolenia, w której model uczy się rozwiązywać wiele zadań jednocześnie, ponieważ wspólne informacje między zadaniami mogą poprawić efektywność uczenia się. Dołączając dwie kolejne głowice klasyfikacyjne do oryginalnej architektury Distilbert, możemy przeprowadzić wielozadaniowe dostrajanie, co zapewnia rozsądne wskaźniki dla naszego zespołu obsługi klienta.

Wdrożenie modelu

W naszym przypadku klasyfikator wiadomości e-mail ma zostać wdrożony na punkcie końcowym, do którego nasz potok CRM może wysłać partię niesklasyfikowanych wiadomości e-mail i uzyskać prognozy. Ponieważ oprócz wnioskowania modelu Hugging Face mamy inne mechanizmy — takie jak czyszczenie danych wejściowych i przewidywania wielozadaniowe — musimy napisać niestandardowy skrypt wnioskowania, który będzie zgodny z Standard SageMakera.

Poniżej znajduje się fragment kodu inference.py:

Kiedy wszystko jest już gotowe, używamy SageMaker Pipelines do zarządzania naszym potokiem szkoleniowym i dołączamy go do naszej infrastruktury, aby dokończyć konfigurację MLOps.

Aby monitorować wydajność wdrożonego modelu, budujemy pętlę informacji zwrotnej, dzięki której CRM może informować nas o statusie tajnych wiadomości e-mail po zamknięciu spraw. Na podstawie tych informacji wprowadzamy poprawki mające na celu ulepszenie wdrożonego modelu.

Wnioski

W tym poście omówiliśmy, jak SageMaker ułatwia zespołowi analityki danych w firmie Scalable efektywne zarządzanie cyklem życia projektu analityki danych, a mianowicie projektu klasyfikatora poczty elektronicznej. Cykl życia rozpoczyna się od początkowej fazy analizy i eksploracji danych za pomocą SageMaker Studio; przechodzi do eksperymentowania z modelami i wdrażania dzięki szkoleniom, wnioskowaniom i dodatkom DLC Hugging Face SageMaker; i uzupełnia się o potok szkoleniowy z SageMaker Pipelines zintegrowanym z innymi usługami AWS. Dzięki tej infrastrukturze jesteśmy w stanie efektywniej iterować i wdrażać nowe modele, a co za tym idzie, jesteśmy w stanie ulepszyć istniejące procesy w ramach Scalable oraz doświadczenia naszych klientów.

Aby dowiedzieć się więcej o Hugging Face i SageMaker, zapoznaj się z następującymi zasobami:

O autorach

Doktor Sandra Schmid jest dyrektorem ds. analityki danych w Scalable GmbH. Razem ze swoimi zespołami odpowiada w firmie za podejścia oparte na danych i przypadki użycia. Jej głównym celem jest znalezienie najlepszej kombinacji modeli uczenia maszynowego i nauki o danych oraz celów biznesowych, aby uzyskać jak najwięcej wartości biznesowej i wydajności z danych.

Doktor Sandra Schmid jest dyrektorem ds. analityki danych w Scalable GmbH. Razem ze swoimi zespołami odpowiada w firmie za podejścia oparte na danych i przypadki użycia. Jej głównym celem jest znalezienie najlepszej kombinacji modeli uczenia maszynowego i nauki o danych oraz celów biznesowych, aby uzyskać jak najwięcej wartości biznesowej i wydajności z danych.

Huj Dang Analityk danych w Scalable GmbH. Do jego obowiązków należy analiza danych, budowanie i wdrażanie modeli uczenia maszynowego, a także rozwój i utrzymanie infrastruktury dla zespołu analityki danych. W wolnym czasie lubi czytać, wędrować, wspinać się po skałach i być na bieżąco z najnowszymi osiągnięciami w zakresie uczenia maszynowego.

Huj Dang Analityk danych w Scalable GmbH. Do jego obowiązków należy analiza danych, budowanie i wdrażanie modeli uczenia maszynowego, a także rozwój i utrzymanie infrastruktury dla zespołu analityki danych. W wolnym czasie lubi czytać, wędrować, wspinać się po skałach i być na bieżąco z najnowszymi osiągnięciami w zakresie uczenia maszynowego.

Mia Czang jest architektem rozwiązań ML dla Amazon Web Services. Współpracuje z klientami w regionie EMEA i dzieli się najlepszymi praktykami w zakresie uruchamiania obciążeń AI/ML w chmurze dzięki swojemu doświadczeniu w matematyce stosowanej, informatyce i AI/ML. Koncentruje się na zadaniach specyficznych dla NLP i dzieli się swoim doświadczeniem jako mówca na konferencjach i autorka książek. W wolnym czasie uprawia jogę, gry planszowe i parzy kawę.

Mia Czang jest architektem rozwiązań ML dla Amazon Web Services. Współpracuje z klientami w regionie EMEA i dzieli się najlepszymi praktykami w zakresie uruchamiania obciążeń AI/ML w chmurze dzięki swojemu doświadczeniu w matematyce stosowanej, informatyce i AI/ML. Koncentruje się na zadaniach specyficznych dla NLP i dzieli się swoim doświadczeniem jako mówca na konferencjach i autorka książek. W wolnym czasie uprawia jogę, gry planszowe i parzy kawę.

Moritza Guertlera jest Account Executive w segmencie Digital Native Businesses w AWS. Koncentruje się na klientach z przestrzeni FinTech i wspiera ich w przyspieszaniu innowacji poprzez bezpieczną i skalowalną infrastrukturę chmurową.

Moritza Guertlera jest Account Executive w segmencie Digital Native Businesses w AWS. Koncentruje się na klientach z przestrzeni FinTech i wspiera ich w przyspieszaniu innowacji poprzez bezpieczną i skalowalną infrastrukturę chmurową.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/accelerate-client-success-management-through-email-classification-with-hugging-face-on-amazon-sagemaker/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 13

- 15%

- 17

- 2021

- 26%

- 32

- 500

- 7

- a

- Zdolny

- O nas

- powyżej

- przyśpieszyć

- przyspieszenie

- Akceptuj

- dostęp

- pomieścić

- Stosownie

- Konto

- Konta

- precyzja

- Osiąga

- w poprzek

- aktywnie

- Dzieje Apostolskie

- przystosować

- Dodaj

- dodatek

- Korekty

- przyjąć

- Korzyść

- Po

- potem

- agentów

- AI / ML

- zmierzać

- pozwala

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- wśród

- an

- analiza

- analityka

- i

- każdy

- Apache

- api

- stosowany

- awanse

- właściwy

- zatwierdzenie

- Zatwierdzać

- architektura

- SĄ

- argumenty

- AS

- przydzielony

- At

- dołączać

- autor

- zautomatyzowane

- dostępny

- AWS

- z powrotem

- tło

- Banki

- baza

- na podstawie

- podstawa

- BE

- bo

- być

- jest

- Korzyści

- BEST

- Najlepsze praktyki

- pomiędzy

- deska

- Gry planszowe

- ciało

- książka

- Oddział

- przerwa

- pośrednictwo

- budować

- Budowanie

- wybudowany

- biznes

- biznes

- ale

- by

- CAN

- kapitał

- Stolica

- zdobyć

- Zajęte

- nieść

- walizka

- Etui

- kategorie

- więzy

- klasyfikacja

- sklasyfikowany

- Sprzątanie

- klient

- klientów

- Wspinaczka

- Zamknij

- zamknięte

- Chmura

- infrastruktura chmurowa

- kod

- podstawa kodu

- Kody

- Kawa

- współpraca

- połączenie

- byliśmy spójni, od początku

- popełnić

- komunikować

- sukcesy firma

- Firma

- porównywalny

- kompletny

- Ukończył

- składniki

- obliczać

- komputer

- Computer Science

- Konferencja

- zamieszanie

- zgodny

- składa się

- Konsola

- Pojemniki

- zawartość

- treść

- skorygowania

- CRM

- CSS

- kustosz

- zwyczaj

- klient

- Klientów

- codziennie

- dane

- analiza danych

- Analityka danych

- Przygotowywanie danych

- nauka danych

- naukowiec danych

- sterowane danymi

- Data

- zdecydować

- postanowiła

- dedykowane

- głęboko

- głęboka nauka

- Domyślnie

- określić

- zdefiniowane

- definicje

- zdemokratyzować

- wykazać

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- wdraża się

- Wnętrze

- detal

- rozwijać

- rozwijanie

- oprogramowania

- wydarzenia

- różne

- cyfrowy

- zarządzanie bogactwem cyfrowym

- na dół

- z powodu

- każdy

- łatwo

- efektywność

- skutecznie

- więcej

- e-maile

- EMEA

- pracowników

- umożliwiać

- Punkt końcowy

- zaangażowany

- zapewnić

- Środowisko

- epoka

- szczególnie

- Europie

- oceniać

- ewaluację

- wydarzenie

- wszystko

- ewoluuje

- zbadać

- przykład

- Doskonałość

- wykonawczy

- Przede wszystkim system został opracowany

- oczekiwanie

- oczekiwania

- spodziewany

- doświadczenie

- doświadczony

- Doświadczenia

- eksperyment

- eksperymenty

- eksploracja

- Analiza danych rozpoznawczych

- odkryj

- dodatkowy

- f1

- Twarz

- ułatwiać

- ułatwia

- Moda

- szybciej

- najszybszy

- najszybciej rosnąca

- informacja zwrotna

- Postać

- budżetowy

- znalezieniu

- FINTECH

- fintechy

- i terminów, a

- pierwsze kroki

- mieszkanie

- Skupiać

- koncentruje

- następujący

- W razie zamówieenia projektu

- Nasz formularz

- format

- Darmowy

- od

- funkcjonować

- przyszłość

- Wzrost

- Games

- Bramka

- ogólny cel

- Generować

- otrzymać

- GitHub

- GmBH

- Gole

- Rozwój

- Gość

- Guest Post

- miał

- Have

- he

- głowa

- głowice

- jej

- jego

- historyczny

- hostowane

- W jaki sposób

- HTML

- http

- HTTPS

- Setki

- zidentyfikowane

- if

- wdrożenia

- wykonawczych

- podnieść

- in

- zawierać

- Przybywający

- Zwiększać

- wzrosła

- Informacja

- Infrastruktura

- początkowy

- Innowacja

- Innowacyjny

- wkład

- Zapytania

- zapytanie

- zintegrowany

- Inteligentny

- zainteresowany

- najnowszych

- przedstawiać

- Inwestuj

- inwestycja

- inwokuje

- IT

- iteracja

- JEGO

- Praca

- json

- Trzymać

- Klawisz

- Etykieta

- Etykiety

- język

- największym

- firmy

- prowadzący

- UCZYĆ SIĘ

- nauka

- wifecycwe

- Linia

- załadować

- miejscowy

- log

- zalogowany

- poszukuje

- od

- maszyna

- uczenie maszynowe

- zrobiony

- Utrzymywanie

- robić

- Dokonywanie

- zarządzanie

- zarządzane

- i konserwacjami

- zarządzający

- rynek

- rynki

- matematyka

- Matrix

- Łączyć

- scalanie zdarzenia

- wiadomości

- metoda

- metryczny

- Metryka

- może

- ML

- MLOps

- model

- modele

- Nowoczesne technologie

- monitor

- miesięcznie

- jeszcze

- porusza się

- dużo

- wielokrotność

- Nazwa

- mianowicie

- rodzimy

- Naturalny

- Przetwarzanie języka naturalnego

- Natura

- Potrzebować

- wymagania

- sieć

- nerwowy

- sieci neuronowe

- Nowości

- Następny

- nlp

- notatnik

- już dziś

- numer

- of

- Oferty

- on

- ONE

- te

- tylko

- operacyjny

- or

- zamówienie

- oryginalny

- Inne

- Inaczej

- ludzkiej,

- na zewnątrz

- wydajność

- zewnętrzne

- koniec

- część

- uczestniczyć

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- faza

- doborowy

- rurociąg

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- możliwy

- Post

- praktyki

- Detaliczność

- przepowiednia

- Przewidywania

- przygotowanie

- poprzedni

- pierwotny

- prywatny

- wygląda tak

- procesów

- przetwarzanie

- Wytworzony

- Produkcja

- wydajność

- Produkty

- projekt

- projektowanie

- właściwy

- prototyp

- zapewniać

- zapewnia

- publiczny

- opublikowany

- cele

- Naciskać

- pytanie

- szybko

- cytaty

- podnieść

- Kurs

- Surowy

- osiągnięty

- Czytaj

- Czytający

- gotowy

- rozsądny

- otrzymuje

- dokumentacja

- Zredukowany

- odnosić się

- oczyścić

- regex

- zarejestrować

- rejestr

- rzetelny

- zdalny

- usunąć

- raport

- reprezentacja

- zażądać

- wywołań

- wymagany

- zdecydowany

- Zasoby

- osób

- odpowiadanie

- odpowiedź

- Odpowiedzi

- obowiązki

- odpowiedzialny

- dalsze

- powrót

- krzepki

- skała

- bieganie

- sagemaker

- Rurociągi SageMaker

- taki sam

- skalowalny

- Skala

- nauka

- Naukowiec

- Naukowcy

- scenariusz

- Sekcja

- działy

- bezpieczne

- segment

- wysłać

- oddzielny

- Sekwencja

- służyć

- usługa

- Usługi

- ustawienie

- kształcie

- shared

- Akcje

- ona

- Targi

- Podpisy

- Prosty

- jednocześnie

- umiejętności

- mniejszy

- skrawek

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- wkrótce

- Typ przestrzeni

- Głośnik

- specjalista

- Specjaliści

- specyficzny

- swoiście

- STAGE

- początek

- Startowy

- rozpocznie

- state-of-the-art

- Rynek

- przebywający

- Ewolucja krok po kroku

- Cel

- przechowywanie

- przechowywany

- przechowywania

- opływowy

- studio

- przedmiot

- sukces

- taki

- podpory

- pewnie

- Brać

- Zadanie

- zadania

- zespół

- Zespoły

- Techniczny

- kilkadziesiąt

- test

- Testowanie

- XNUMX

- niż

- Podziękowania

- że

- Połączenia

- ich

- Im

- następnie

- Tam.

- w związku z tym

- one

- to

- tysiące

- trzy

- Przez

- czas

- do

- razem

- narzędzie

- aktualny

- pochodnia

- śledzić

- Handel

- Platforma handlowa

- Pociąg

- przeszkolony

- Trening

- transformator

- Transformatory

- ogromnie

- SKRĘCAĆ

- drugiej

- rodzaj

- typy

- Nowości

- us

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Doświadczenie użytkownika

- zastosowania

- za pomocą

- UPRAWOMOCNIĆ

- uprawomocnienie

- wartość

- wersja

- Czekanie

- była

- we

- Bogactwo

- zarządzanie majątkiem

- sieć

- usługi internetowe

- DOBRZE

- były

- jeśli chodzi o komunikację i motywację

- ilekroć

- który

- Podczas

- w

- w ciągu

- bez

- workflow

- przepływów pracy

- działa

- napisać

- Joga

- zefirnet