Jako broń wojenna niszczenie obiektów dziedzictwa kulturowego jest powszechna metoda przez uzbrojonych najeźdźców, aby pozbawić społeczność jej odrębnej tożsamości. Nic więc dziwnego, że w lutym 2022 r., gdy wojska rosyjskie wkroczyły na Ukrainę, historycy i specjaliści ds. dziedzictwa kulturowego przygotowywali się na nadchodzące zniszczenia. Jak dotąd w przypadku wojny rosyjsko-ukraińskiej UNESCO to zrobiło Zatwierdzony zniszczenia setek budynków sakralnych i historycznych oraz dziesiątek pomników publicznych, bibliotek i muzeów.

Chociaż nowe technologie, takie jak tanie drony, 3D drukowanie, prywatny internet satelitarny może tworzyć pole bitwy wyraźnie na miarę XXI wieku, nieznane armiom konwencjonalnym, inny zestaw technologii stwarza nowe możliwości dla archiwistów obywatelskich znajdujących się poza linią frontu w zakresie ochrony ukraińskich obiektów dziedzictwa kulturowego.

Kopia zapasowa Ukraina, wspólny projekt duńskiej Komisji Krajowej UNESCO i firmy Polycam, narzędzia do tworzenia 3D, umożliwia każdemu, kto ma tylko telefon, skanowanie i przechwytywanie wysokiej jakości, szczegółowych i fotorealistycznych modeli 3D miejsc dziedzictwa kulturowego, co jest możliwe tylko przy kosztownych i uciążliwych sprzęt kilka lat temu.

Według Bilawala Sidhu, technologa, anioła biznesu i byłego menedżera produktu Google, który pracował nad mapami 3D i AR/VR, Backup Ukraine jest godnym uwagi wyrazem oszałamiającej szybkości, z jaką rozwijają się technologie przechwytywania 3D i grafiki.

„Technologie przechwytywania rzeczywistości znajdują się na zdumiewająco wykładniczej krzywej demokratyzacji” – wyjaśnił mi w wywiadzie dla Centrum osobliwości.

Według Sidhu generowanie zasobów 3D było możliwe, ale tylko przy użyciu drogich narzędzi, takich jak lustrzanki cyfrowe, skanery lidarowe i drogie licencje na oprogramowanie. Jako przykład podał pracę CyArk, organizację non-profit założoną dwadzieścia lat temu w celu wykorzystania profesjonalnej technologii przechwytywania 3D do ochrony dziedzictwa kulturowego na całym świecie.

„Szaleniem i tym, co się zmieniło, jest to, że dzisiaj mogę to wszystko zrobić, mając iPhone'a w kieszeni” – mówi.

W naszej dyskusji Sidhu przedstawił trzy odrębne, choć powiązane ze sobą trendy technologiczne, które napędzają ten postęp. Pierwszym z nich jest spadek kosztów kamer i czujników, które mogą uchwycić obiekt lub przestrzeń. Drugi to kaskada nowych technik wykorzystujących sztuczną inteligencję do konstruowania gotowych zasobów 3D. Po trzecie, wzrost mocy obliczeniowej, napędzanej w dużej mierze przez procesory graficzne, zdolnej do renderowania obiektów wymagających dużej ilości grafiki na urządzeniach powszechnie dostępnych dla konsumentów.

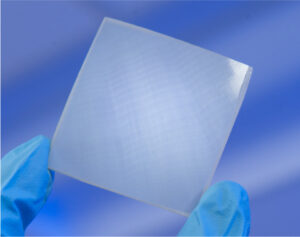

Skanery Lidar są przykładem poprawy stosunku ceny do wydajności czujników. Po raz pierwszy spopularyzowany jako nieporęczne czujniki obrotowe montowane na pojazdach autonomicznych i wyceniony na ok dziesiątki tysięcy dolarów, lidar zadebiutował w technologii konsumenckiej na iPhonie 12 Pro i Pro Max w 2020 roku. Możliwość skanowania przestrzeni w taki sam sposób, w jaki widzą świat samochody autonomiczne, sprawiła, że nagle każdy mógł szybko i tanio generuj szczegółowe zasoby 3D. To jednak nadal było dostępne tylko dla najbogatszych klientów Apple.

Dzień 254: wędrówka po Parku Narodowym Pinnacles i obserwowanie mojej córki, gdy przekraczaliśmy mały, suchy strumień.

Nagrane iPhonem 12 Pro + @Scenario3d. Nie mogę się doczekać, aż za 3 lat zobaczę te wspomnienia w 10D.

On @Sketchfab: https://t.co/mvxtOMhzS5#1skanadadzień #3Dskanowanie #XR pic.twitter.com/9DX1Ltnmh8

— Emm (@emmanuel_2m) 14 września 2021 r.

Jeden z najważniejszych punktów zwrotnych w branży miał miejsce w tym samym roku, gdy badacze z Google wprowadzono neuronowe pola promieniowania, powszechnie określane jako NeRF.

W tym podejściu wykorzystuje się uczenie maszynowe skonstruuj wiarygodny model 3D obiektu lub przestrzeni na podstawie zdjęć lub filmów 2D. Według Sidhu sieć neuronowa „ma halucynacje”, jak wyglądałaby scena w pełnym 3D. Jest to rozwiązanie „syntezy widoku”, wyzwanie związane z grafiką komputerową, mające na celu umożliwienie komuś zobaczenia przestrzeni z dowolnego punktu widzenia na podstawie zaledwie kilku obrazów źródłowych.

„Więc to wyszło na jaw i wszyscy zdali sobie sprawę, że mamy teraz najnowocześniejszą syntezę widoku, która doskonale sprawdza się we wszystkich aspektach, z którymi fotogrametria miała trudności, takich jak przezroczystość, półprzezroczystość i współczynnik odbicia. To trochę szalone” – dodaje.

Społeczność zajmujących się wizją komputerową skierowała swoje emocje na zastosowania komercyjne. W Google Sidhu i jego zespół badali możliwości wykorzystania tej technologii Wciągający widok, trójwymiarowa wersja Map Google. Dla przeciętnego użytkownika rozpowszechnienie przyjaznych dla konsumenta aplikacji, takich jak Sztuczna inteligencja Lumy i inne oznaczały, że każdy, kto miał aparat w smartfonie, mógł tworzyć fotorealistyczne zasoby 3D. Tworzenie wysokiej jakości treści 3D nie było już ograniczone do elity lidarów Apple.

Teraz kolejna potencjalnie jeszcze bardziej obiecująca metoda syntezy poglądów przyciąga uwagę, konkurując z wczesnymi emocjami NeRF. Rozpryski Gaussa to technika renderowania, która naśladuje sposób trójkąty są używane w tradycyjnych zasobach 3D, ale zamiast trójkątów jest to „plamka” koloru wyrażona za pomocą funkcji matematycznej zwanej gaussem. W miarę nakładania kolejnych warstw gaussów widoczny staje się bardzo szczegółowy i teksturowany zasób 3D. Szybkość adaptacji do splattingu jest oszałamiająca.

Minęło dopiero kilka miesięcy, ale dema zalewają X, a zarówno Luma AI, jak i Polycam oferują narzędzia do generowania ikon gaussowskich. Inni programiści już pracują nad sposobami integracji ich z tradycyjnymi silnikami gier, takimi jak Unity i Unreal. Ikony przyciągają również uwagę tradycyjnego przemysłu grafiki komputerowej, ponieważ ich prędkość renderowania jest większa niż w przypadku NeRF i można je edytować w sposób znany już artystom 3D. (NeRF nie pozwalają na to, ponieważ są generowane przez nieczytelną sieć neuronową.)

Świetne wyjaśnienie, jak działa rozpryskiwanie gaussowskie i dlaczego generuje szum, obejrzyj ten film autorstwa Sidhu.

[Osadzone treści]

Niezależnie od szczegółów, dla konsumentów zdecydowanie znajdujemy się w momencie, w którym telefon może generować zasoby 3D na hollywoodzkim poziomie, które jeszcze niedawno mogły wyprodukować tylko dobrze wyposażone zespoły produkcyjne.

Ale dlaczego tworzenie 3D w ogóle ma znaczenie?

Aby docenić przejście w stronę treści 3D, warto zauważyć, że krajobraz technologiczny kieruje się w stronę przyszłości „obliczeń przestrzennych”. Chociaż nadużywane terminy, takie jak metaświat, mogą wywoływać przewracanie oczami, zasadniczym założeniem jest uznanie, że środowiska 3D, takie jak te używane w grach wideo, wirtualnych światach i cyfrowych bliźniakach, mają do odegrania dużą rolę w naszej przyszłości. Zasoby 3D, takie jak te produkowane przez NeRF i splatting, staną się treściami, z którymi będziemy się zajmować w przyszłości.

W tym kontekście ambicja na dużą skalę jest nadzieją na działanie w czasie rzeczywistym Mapa 3D świata. Chociaż dostępne są narzędzia do generowania statycznych map 3D, wyzwaniem pozostaje znalezienie sposobów na zapewnienie aktualności tych map w stale zmieniającym się świecie.

„Następuje budowanie modelu świata, a następnie utrzymywanie tego modelu świata. Myślę, że dzięki tym metodom, o których mówimy, moglibyśmy wreszcie dysponować technologią umożliwiającą rozwiązanie problemu „utrzymania modelu” poprzez crowdsourcing” – mówi Sidhu.

Projekty takie jak Google Immersive View są dobrymi wczesnymi przykładami konsekwencji tego zjawiska dla konsumentów. Choć nie spekulował, kiedy będzie to w końcu możliwe, Sidhu zgodził się, że w pewnym momencie pojawi się technologia, która umożliwi użytkownikowi wirtualnej rzeczywistości poruszanie się po dowolnym miejscu na Ziemi z wciągającym doświadczeniem tego, co się tam dzieje w czasie rzeczywistym . Ten rodzaj technologii przełoży się również na wysiłki w „teleportacja oparta na awatarze”.”, spotkania zdalne i inne spotkania towarzyskie.

Kolejnym powodem do ekscytacji, mówi Sidhu, jest przechwytywanie pamięci 3D. Na przykład Apple mocno się na to opiera Zdjęcia i wideo 3D za zestaw słuchawkowy do rzeczywistości mieszanej Vision Pro. Jako przykład Sidhu powiedział mi, że niedawno stworzył wysokiej jakości replikę domu swoich rodziców, zanim się wyprowadzili. Mógłby następnie zapewnić im możliwość wejścia do środka, korzystając z wirtualnej rzeczywistości.

„Posiadanie tego instynktownego poczucia bycia tam z powrotem jest tak potężne. Dlatego właśnie jestem tak optymistycznie nastawiony do Apple, ponieważ jeśli uda im się wykorzystać ten format multimediów 3D, dla zwykłych ludzi sprawy mogą stać się ekscytujące”.

Jestem przekonany, że zabójczym przypadkiem użycia technologii rekonstrukcji 3D jest przechwytywanie pamięci

moi rodzice przeszli na emeryturę na początku tego roku, a ja na zawsze uwieczniłem ich dom

skanowanie zdjęć to najbardziej przyszłościowe medium, do jakiego mamy dzisiaj dostęp

przeskanuj wszystkie przestrzenie/miejsca/rzeczy pic.twitter.com/kmqX5FYaN6

— Bilawal Sidhu (@bilawalsidhu) Listopad 3, 2023

Od sztuki jaskiniowej po obrazy olejne – impuls do zachowania aspektów naszych doświadczeń zmysłowych jest głęboko ludzki. Tak jak kiedyś fotografia wykorzystywała martwe natury jako środek konserwacji, tak narzędzia do tworzenia 3D wydają się być w stanie zastąpić nasze długotrwałe zainteresowanie obrazami i wideo 2D.

Jednak tak jak fotografia może mieć nadzieję jedynie na uchwycenie ułamka chwili, tak modele 3D nie mogą w pełni zastąpić naszego związku ze światem fizycznym. Jednak dla tych, którzy doświadczają okropności wojny na Ukrainie, być może są to mile widziane wydarzenia oferujące bardziej wciągający sposób na zachowanie tego, czego nigdy tak naprawdę nie da się zastąpić.

Kredytowych Image: Wima Torbeynsa / Unsplash

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://singularityhub.com/2023/11/06/a-revolution-in-computer-graphics-is-bringing-3d-reality-capture-to-the-masses/

- :ma

- :Jest

- :nie

- :Gdzie

- 10

- 12

- 14

- 2020

- 2022

- 21

- 2D

- 3d

- 9

- a

- zdolność

- O nas

- dostęp

- Stosownie

- Dodaje

- Przyjęcie

- temu

- uzgodniony

- AI

- zmierzać

- Wszystkie kategorie

- dopuszczać

- już

- również

- ambicja

- an

- i

- Anioł

- Inne

- każdy

- ktoś

- nigdzie

- zjawić się

- Apple

- aplikacje

- doceniać

- podejście

- AR / VR

- SĄ

- uzbrojony

- na około

- Sztuka

- sztuczny

- sztuczna inteligencja

- Artyści

- AS

- aspekty

- kapitał

- Aktywa

- At

- Uwaga

- autonomiczny

- pojazdy autonomiczne

- dostępny

- średni

- z powrotem

- Battlefield

- BE

- bo

- stają się

- staje się

- być

- zanim

- jest

- pomiędzy

- Duży

- obie

- Bringing

- Budowanie

- Uparty

- ale

- by

- oprawa ołowiana witrażu

- aparat fotograficzny

- kamery

- CAN

- Może uzyskać

- zdolny

- zdobyć

- samochody

- wodospady

- walizka

- jaskinia

- Wiek

- wyzwanie

- zmieniony

- cytowane

- obywatel

- współpracy

- kolor

- przyjście

- handlowy

- prowizja

- powszechnie

- społeczność

- komputer

- Wizja komputerowa

- computing

- moc obliczeniowa

- wynikający

- skonstruować

- konsument

- Konsumenci

- zawartość

- kontekst

- Konwencjonalny

- przekonany

- Koszty:

- mógłby

- zwariowany

- stworzony

- Tworzenie

- tworzenie

- wiarygodny

- kredyt

- Zatoczka

- Crossed

- Crowdsourcing

- kulturalny

- Aktualny

- krzywa

- Klientów

- uszkodzić

- duński

- debiut

- lat

- demokratyzacja

- szczegółowe

- detale

- deweloperzy

- wydarzenia

- urządzenia

- cyfrowy

- Cyfrowe bliźniaki

- dyskusja

- odrębny

- wyraźnie

- do

- robi

- nie

- dziesiątki

- rysować

- napędzany

- jazdy

- Spadek

- suchy

- Wcześniej

- Wcześnie

- Zarobek

- Ziemia

- Ekonomista

- starania

- osadzone

- Umożliwia

- zobowiązany

- silniki

- środowiska

- sprzęt

- wyposażony

- Parzyste

- ostatecznie

- EVER

- ciągle się zmienia

- wszyscy

- przykład

- przykłady

- podniecony

- Podniecenie

- ekscytujący

- istnieć

- drogi

- doświadczenie

- doświadczać

- wyjaśnione

- wyjaśnienie

- zbadane

- wykładniczy

- wyrażone

- wyrażenie

- oko

- znajomy

- daleko

- szybciej

- luty

- kilka

- Łąka

- W końcu

- znalezieniu

- i terminów, a

- W razie zamówieenia projektu

- Dla konsumentów

- na zawsze

- format

- Dawny

- Założony

- frakcja

- od

- pełny

- w pełni

- funkcjonować

- przyszłość

- zyskuje

- gra

- Games

- spotkania

- Generować

- wygenerowane

- generujący

- otrzymać

- Dać

- dany

- dobry

- mapy Google

- Google'a

- got

- GPU

- stopień

- grafika

- wspaniały

- miał

- Wydarzenie

- Ciężko

- Have

- he

- Słuchawki

- ciężko

- dziedzictwo

- wysokiej jakości

- wysoko

- jego

- historyczny

- Strona główna

- nadzieję

- dom

- W jaki sposób

- Jednak

- HTTPS

- człowiek

- Setki

- i

- tożsamość

- if

- zdjęcia

- wciągające

- implikacje

- poprawa

- in

- przemysł

- przemysłu

- SZALONY

- wewnątrz

- zamiast

- Integracja

- Inteligencja

- Wywiad

- najnowszych

- inwestor

- iPhone

- IT

- JEGO

- właśnie

- konserwacja

- Uprzejmy

- znany

- krajobraz

- na dużą skalę

- w dużej mierze

- warstwowy

- nauka

- Legit

- biblioteki

- licencje

- lubić

- Ograniczony

- długo

- od dawna

- dłużej

- maszyna

- uczenie maszynowe

- zrobiony

- Utrzymywanie

- robić

- kierownik

- mapa

- Mapy

- Masy

- matematyczny

- Materia

- max

- Może..

- me

- znaczy

- Oznaczało

- Media

- średni

- Spotkania

- wspomnienia

- Pamięć

- Metaverse

- metoda

- metody

- może

- mieszany

- mieszana rzeczywistość

- model

- modele

- moment

- miesięcy

- zabytki

- jeszcze

- większość

- przeniósł

- Muzea

- my

- narodowy

- Park Narodowy

- Nerf

- netto

- sieć

- nerwowy

- sieci neuronowe

- nigdy

- Nowości

- Nowe technologie

- Nie

- niedochodowy

- dostojnik

- Zauważając

- już dziś

- przedmiot

- obiekty

- miejsce

- of

- poza

- oferuje

- Olej

- on

- pewnego razu

- te

- tylko

- or

- Inne

- Pozostałe

- ludzkiej,

- na zewnątrz

- Malarstwo

- rodzice

- Park

- parlament

- Ludzie

- może

- telefon

- fotografia

- Fotorealistyczne

- fizyczny

- Zdjęcia

- plato

- Analiza danych Platona

- PlatoDane

- Grać

- gracz

- punkt

- Punkt widzenia

- zwrotnica

- Gotowy

- możliwości

- możliwy

- potencjalnie

- power

- mocny

- ochrona

- Pro

- Problem

- produkować

- Wytworzony

- Produkt

- product manager

- Produkcja

- profesjonalny

- Postęp

- postępuje

- projekt

- obiecujący

- dowód

- publiczny

- szybko

- w czasie rzeczywistym

- Rzeczywistość

- realizowany

- powód

- niedawno

- uznanie

- , o którym mowa

- regularny

- związek

- szczątki

- zdalny

- wykonanie

- obsługi produkcji rolnej, która zastąpiła

- otrzymuje

- odpowiedzieć

- Badacze

- Rewolucja

- Rola

- rolki

- Wojna rosyjsko-ukraińska

- Rosyjski

- taki sam

- satelita

- mówią

- skanować

- skanowanie

- scena

- druga

- widzieć

- poszukuje

- wydać się

- czujniki

- zestaw

- przesunięcie

- ponieważ

- Witryny

- mały

- smartphone

- So

- dotychczas

- Obserwuj Nas

- Tworzenie

- rozwiązanie

- ROZWIĄZANIA

- Rozwiązywanie

- kilka

- Ktoś

- coś

- Źródło

- Typ przestrzeni

- Specjaliści

- prędkość

- duch

- rozpiętość

- oszałamiający

- state-of-the-art

- Nadal

- Oszałamiający

- niespodzianka

- synteza

- rozmawiać

- zespół

- Zespoły

- tech

- technika

- Techniki

- Technologies

- technolog

- Technologia

- REGULAMIN

- niż

- że

- Połączenia

- Przyszłość

- metaverse

- świat

- ich

- Im

- następnie

- Tam.

- Te

- one

- rzecz

- rzeczy

- myśleć

- Trzeci

- to

- w tym roku

- tych

- tysiące

- trzy

- Przez

- czas

- do

- już dziś

- razem

- powiedział

- narzędzie

- narzędzia

- Top

- w kierunku

- tradycyjny

- Przezroczystość

- Trendy

- naprawdę

- Obrócenie

- Bliźnięta

- i twitterze

- drugiej

- rodzaj

- Ukraina

- ukraiński

- zasadniczy

- nieznany

- Jedność

- Nierealny

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- zastosowania

- za pomocą

- Pojazdy

- wersja

- Wideo

- gier wideo

- Zobacz i wysłuchaj

- Wirtualny

- Wirtualna rzeczywistość

- wirtualne światy

- widoczny

- wizja

- vr

- czekać

- spacer

- chodzący

- wojna

- Wojna na Ukrainie

- była

- Oglądaj

- Droga..

- sposoby

- we

- powitanie

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- KIM

- dlaczego

- szeroko

- będzie

- w

- Praca

- pracował

- pracujący

- działa

- świat

- świat

- wartość

- by

- X

- rok

- lat

- jeszcze

- Twój

- youtube

- zefirnet