Duże modele językowe (LLM) dzięki swojej szerokiej wiedzy mogą generować tekst przypominający ludzki na niemal każdy temat. Jednak ich szkolenie na ogromnych zbiorach danych ogranicza również ich przydatność do specjalistycznych zadań. Bez ciągłego uczenia się modele te pozostają nieświadome nowych danych i trendów, które pojawiają się po ich wstępnym szkoleniu. Co więcej, koszt szkolenia nowych LLM może okazać się zaporowy dla wielu przedsiębiorstw. Możliwe jest jednak powiązanie odpowiedzi modelu z oryginalną specjalistyczną treścią, unikając w ten sposób konieczności uczenia nowego modelu LLM przy użyciu generacji rozszerzonej wyszukiwania (RAG).

RAG wzmacnia pozycję LLM, dając im możliwość odzyskiwania i włączania wiedzy zewnętrznej. Zamiast polegać wyłącznie na wcześniej przeszkolonej wiedzy, RAG umożliwia modelom pobieranie danych z dokumentów, baz danych i nie tylko. Następnie model umiejętnie integruje te informacje zewnętrzne z wygenerowanym tekstem. Pozyskując dane istotne dla kontekstu, model może zapewnić świadome, aktualne odpowiedzi dostosowane do Twojego przypadku użycia. Poszerzanie wiedzy zmniejsza również prawdopodobieństwo wystąpienia halucynacji oraz niedokładnego lub bezsensownego tekstu. Dzięki RAG modele podstawowe stają się elastycznymi ekspertami, którzy ewoluują wraz z rozwojem Twojej bazy wiedzy.

Dziś z radością prezentujemy trzy wersje demonstracyjne generatywnej sztucznej inteligencji, licencjonowane na podstawie licencji Licencja MIT-0:

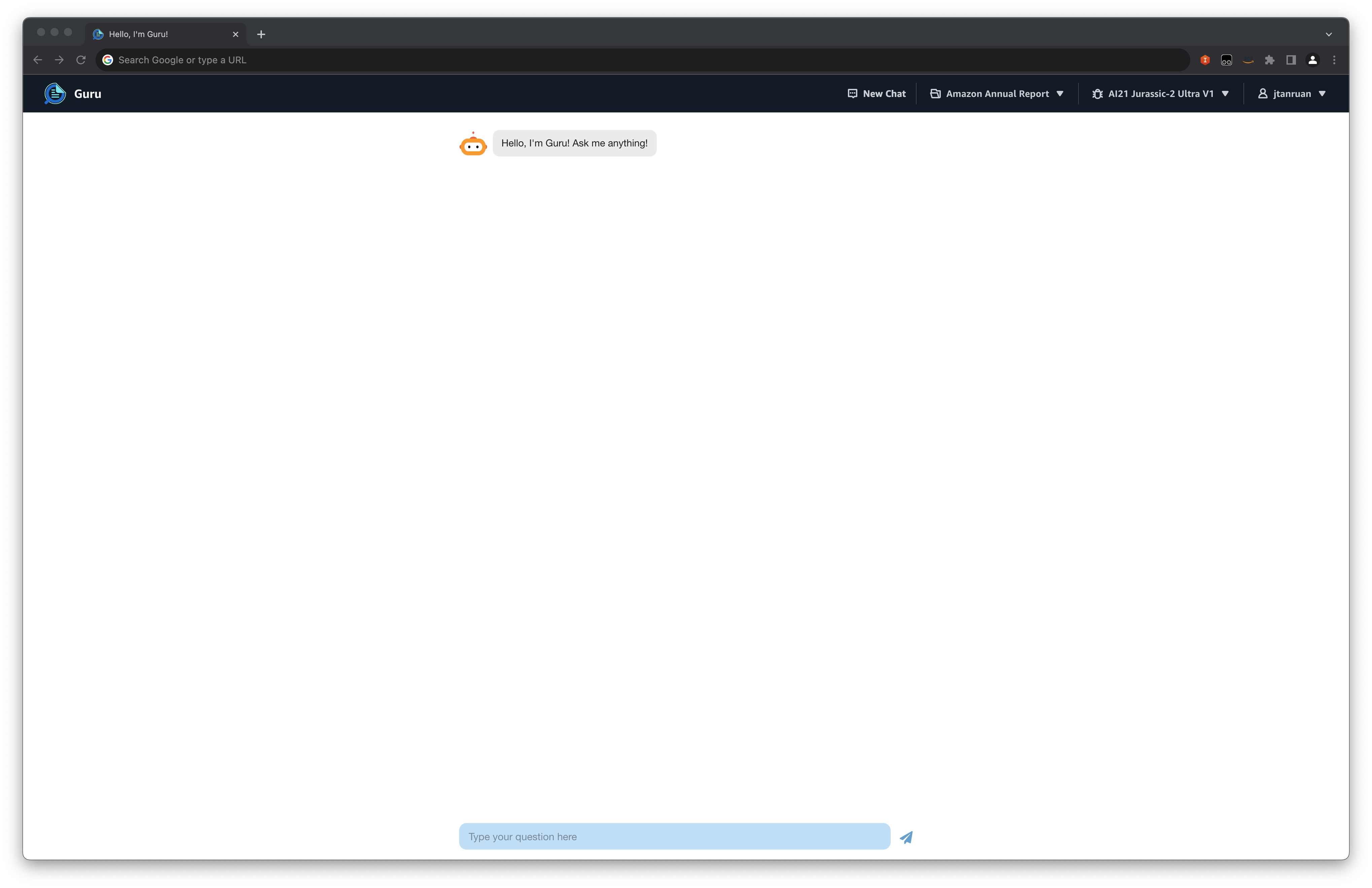

- Amazon Kendra z podstawowym LLM – Wykorzystuje możliwości głębokiego wyszukiwania Amazonka Kendra w połączeniu z rozległą wiedzą LLM. Integracja ta zapewnia precyzyjne i kontekstowe odpowiedzi na złożone zapytania, czerpiąc z różnorodnych źródeł.

- Model osadzania z podstawowym LLM – Łączy moc osadzania – technikę uchwycenia semantycznego znaczenia słów i wyrażeń – z ogromną bazą wiedzy LLM. Ta synergia umożliwia dokładniejsze modelowanie tematów, rekomendowanie treści i możliwości wyszukiwania semantycznego.

- Modele podstawowe Generator reklam farmaceutycznych – Specjalizowana aplikacja dostosowana dla branży farmaceutycznej. Wykorzystując możliwości generacyjne podstawowych modeli, narzędzie to tworzy przekonujące i zgodne reklamy produktów farmaceutycznych, zapewniając zgodność treści ze standardami i przepisami branżowymi.

Te demonstracje można bezproblemowo wdrożyć na koncie AWS, oferując podstawowe spostrzeżenia i wskazówki dotyczące korzystania z usług AWS w celu stworzenia najnowocześniejszego bota generującego pytania i odpowiedzi LLM AI oraz generowania treści.

W tym poście badamy, w jaki sposób RAG w połączeniu z Amazon Kendra lub niestandardowymi osadzaniami może pokonać te wyzwania i zapewnić wyrafinowane odpowiedzi na zapytania w języku naturalnym.

Omówienie rozwiązania

Decydując się na to rozwiązanie możesz zyskać następujące korzyści:

- Lepszy dostęp do informacji – RAG umożliwia modelom pobieranie informacji z rozległych źródeł zewnętrznych, co może być szczególnie przydatne, gdy wiedza wstępnie wyszkolonego modelu jest nieaktualna lub niekompletna.

- Skalowalność – Zamiast trenować model na wszystkich dostępnych danych, RAG umożliwia modelom pobieranie odpowiednich informacji na bieżąco. Oznacza to, że gdy nowe dane staną się dostępne, można je dodać do bazy danych pobierania bez konieczności ponownego uczenia całego modelu.

- Wydajność pamięci – LLM wymagają znacznej ilości pamięci do przechowywania parametrów. Dzięki RAG model może być mniejszy, ponieważ nie musi zapamiętywać wszystkich szczegółów; może je odzyskać w razie potrzeby.

- Dynamiczna aktualizacja wiedzy – W przeciwieństwie do konwencjonalnych modeli z ustalonym punktem końcowym wiedzy, zewnętrzna baza danych RAG może podlegać regularnej aktualizacji, zapewniając modelowi dostęp do aktualnych informacji. Funkcję wyszukiwania można dostosować do różnych zadań. Na przykład w przypadku zadania diagnostyki medycznej można pozyskać dane z czasopism medycznych, co gwarantuje, że model zgromadzi fachowe i trafne spostrzeżenia.

- Łagodzenie uprzedzeń – Możliwość korzystania z dobrze dobranej bazy danych oferuje potencjał minimalizacji uprzedzeń poprzez zapewnienie zrównoważonych i bezstronnych źródeł zewnętrznych.

Zanim zagłębisz się w integrację Amazon Kendra z podstawowymi LLM, ważne jest, aby wyposażyć się w niezbędne narzędzia i wymagania systemowe. Właściwa konfiguracja to pierwszy krok w kierunku bezproblemowego wdrożenia wersji demonstracyjnych.

Wymagania wstępne

Musisz mieć następujące wymagania wstępne:

Chociaż możliwe jest skonfigurowanie i wdrożenie infrastruktury opisanej w tym samouczku z komputera lokalnego, Chmura AWS9 oferuje wygodną alternatywę. Wyposażony w narzędzia takie jak AWS CLI, AWS CDK i Docker, AWS Cloud9 może działać jako stacja robocza wdrożeniowa. Aby skorzystać z tej usługi, po prostu skonfiguruj środowisko za pośrednictwem Konsola AWS Cloud9.

Po spełnieniu wymagań wstępnych przyjrzyjmy się funkcjom i możliwościom Amazon Kendra z podstawowymi LLM.

Amazon Kendra z podstawowym LLM

Amazon Kendra to zaawansowana usługa wyszukiwania korporacyjnego wzbogacona o uczenie maszynowe (ML), która zapewnia gotowe możliwości wyszukiwania semantycznego. Wykorzystując przetwarzanie języka naturalnego (NLP), Amazon Kendra rozumie zarówno treść dokumentów, jak i ukryte intencje zapytań użytkowników, pozycjonując ją jako narzędzie do wyszukiwania treści dla rozwiązań opartych na RAG. Używając treści wyszukiwania o wysokiej dokładności od Kendry jako ładunku RAG, możesz uzyskać lepsze odpowiedzi LLM. Zastosowanie Amazon Kendra w tym rozwiązaniu umożliwia także spersonalizowane wyszukiwanie poprzez filtrowanie odpowiedzi według uprawnień dostępu do treści użytkownika końcowego.

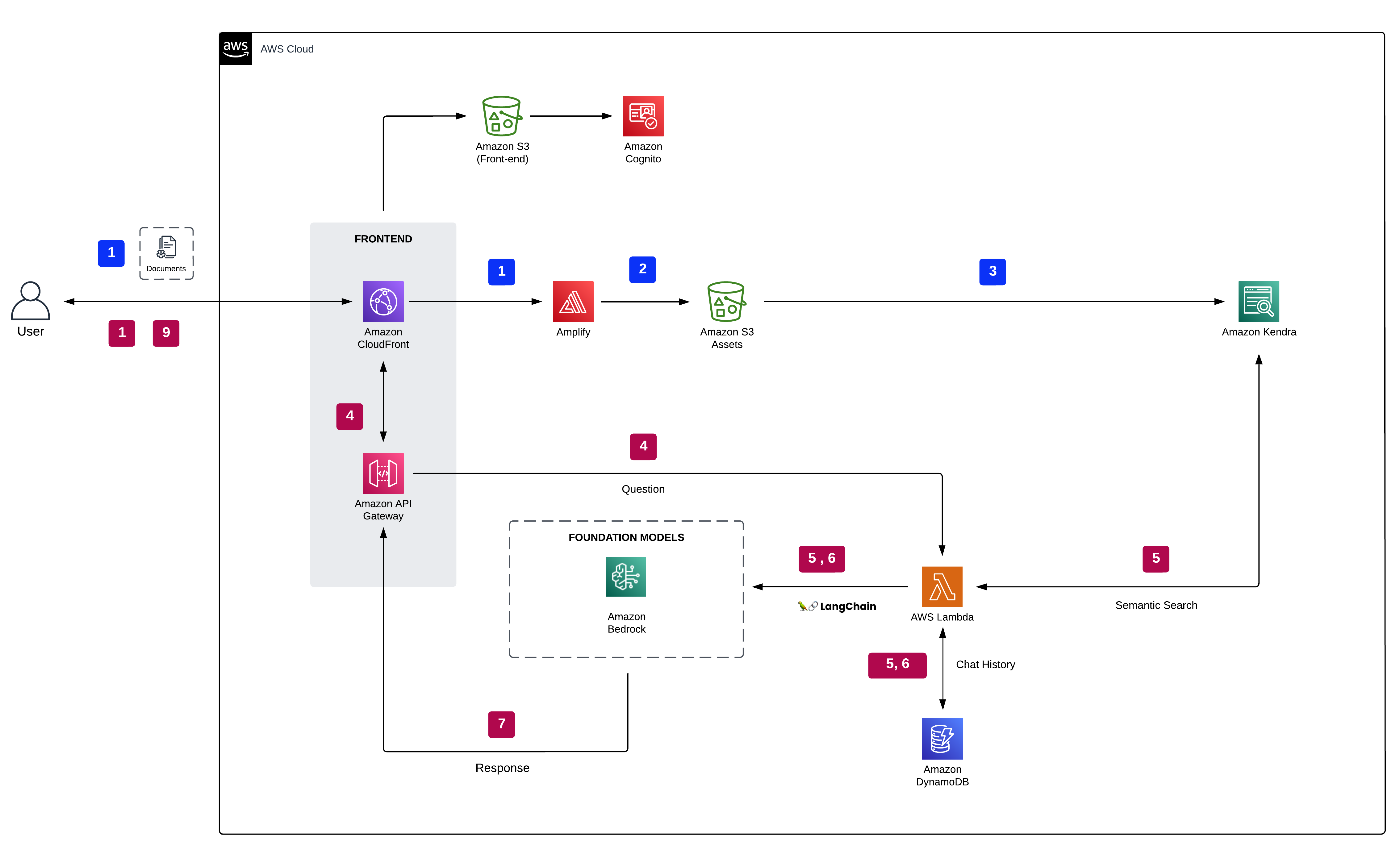

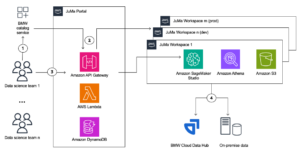

Poniższy diagram przedstawia architekturę generatywnej aplikacji AI wykorzystującej podejście RAG.

Dokumenty są przetwarzane i indeksowane przez Amazon Kendra za pośrednictwem Usługa Amazon Simple Storage (Amazon S3) złącze. Żądania klientów i dane kontekstowe z Amazon Kendra są kierowane do Amazońska skała macierzysta model fundamentu. Wersja demonstracyjna umożliwia wybór pomiędzy modelami Titan firmy Amazon, Jurassic AI21 i Claude firmy Anthropic obsługiwanymi przez Amazon Bedrock. Historia rozmów jest zapisana w Amazon DynamoDB, oferując dodatkowy kontekst dla LLM w celu generowania odpowiedzi.

Udostępniliśmy to demo w pliku GitHub repo. Aby wdrożyć go na koncie AWS, zapoznaj się z instrukcjami wdrażania zawartymi w pliku Readme.

Poniższe kroki opisują proces interakcji użytkownika z generatywną aplikacją AI:

- Użytkownik loguje się do aplikacji internetowej uwierzytelnianej przez Amazon Cognito.

- Użytkownik przesyła jeden lub więcej dokumentów do Amazon S3.

- Użytkownik uruchamia zadanie synchronizacji Amazon Kendra, aby pozyskać dokumenty S3 do indeksu Amazon Kendra.

- Pytanie użytkownika jest kierowane przez bezpieczny interfejs API WebSocket hostowany na serwerze Brama Amazon API wspierane przez AWS Lambda funkcja.

- Funkcja Lambda, wspierana przez LangChain framework — wszechstronne narzędzie przeznaczone do tworzenia aplikacji opartych na modelach językowych AI — łączy się z punktem końcowym Amazon Bedrock, aby przeformułować pytanie użytkownika na podstawie historii czatów. Po przeformułowaniu pytanie jest przekazywane do Amazon Kendra za pomocą interfejsu Retrieve API. W odpowiedzi indeks Amazon Kendra wyświetla wyniki wyszukiwania, dostarczając fragmenty odpowiednich dokumentów pochodzących z danych pozyskanych przez przedsiębiorstwo.

- Pytanie użytkownika wraz z danymi pobranymi z indeksu przesyłane jest jako kontekst w podpowiedzi LLM. Odpowiedź z LLM jest przechowywana jako historia rozmów w DynamoDB.

- Na koniec odpowiedź z LLM jest odsyłana do użytkownika.

Przebieg indeksowania dokumentów

Poniżej przedstawiono procedurę przetwarzania i indeksowania dokumentów:

- Użytkownicy przesyłają dokumenty za pośrednictwem interfejsu użytkownika (UI).

- Dokumenty są przesyłane do zasobnika S3 przy użyciu narzędzia Wzmocnienie AWS API.

- Amazon Kendra indeksuje nowe dokumenty w wiadrze S3 za pośrednictwem złącza Amazon Kendra S3.

Benefity

Poniższa lista prezentuje zalety tego rozwiązania:

- Pobieranie na poziomie przedsiębiorstwa – Amazon Kendra jest przeznaczony do wyszukiwania korporacyjnego, dzięki czemu jest odpowiedni dla organizacji posiadających duże ilości ustrukturyzowanych i nieustrukturyzowanych danych.

- Rozumienie semantyczne – Możliwości ML Amazon Kendra zapewniają, że wyszukiwanie opiera się na głębokim zrozumieniu semantycznym, a nie tylko na dopasowaniu słów kluczowych.

- Skalowalność – Amazon Kendra może obsługiwać źródła danych o dużej skali i zapewnia szybkie i trafne wyniki wyszukiwania.

- Elastyczność – Model podstawowy może generować odpowiedzi w oparciu o szeroki zakres kontekstów, zapewniając wszechstronność systemu.

- Możliwości integracji – Amazon Kendra można zintegrować z różnymi usługami AWS i źródłami danych, dzięki czemu można ją dostosować do różnych potrzeb organizacyjnych.

Model osadzania z podstawowym LLM

An osadzanie to wektor liczbowy reprezentujący istotę różnych typów danych, w tym tekstu, obrazów, dźwięku i dokumentów. Ta reprezentacja nie tylko oddaje wewnętrzne znaczenie danych, ale także dostosowuje je do szerokiego zakresu praktycznych zastosowań. Modele osadzania, gałąź uczenia maszynowego, przekształcają złożone dane, takie jak słowa lub frazy, w ciągłe przestrzenie wektorowe. Wektory te z natury wychwytują powiązania semantyczne między danymi, umożliwiając głębsze i bardziej wnikliwe porównania.

RAG płynnie łączy zalety podstawowych modeli, takich jak transformatory, z precyzją osadzania, aby przeszukiwać ogromne bazy danych w poszukiwaniu istotnych informacji. Po otrzymaniu zapytania system wykorzystuje osadzanie w celu identyfikacji i wyodrębnienia odpowiednich sekcji z obszernego zbioru danych. Model podstawowy formułuje następnie kontekstowo precyzyjną odpowiedź na podstawie wyodrębnionych informacji. Ta doskonała synergia pomiędzy wyszukiwaniem danych i generowaniem odpowiedzi pozwala systemowi udzielać rzetelnych odpowiedzi, czerpiąc z ogromnej wiedzy zgromadzonej w rozbudowanych bazach danych.

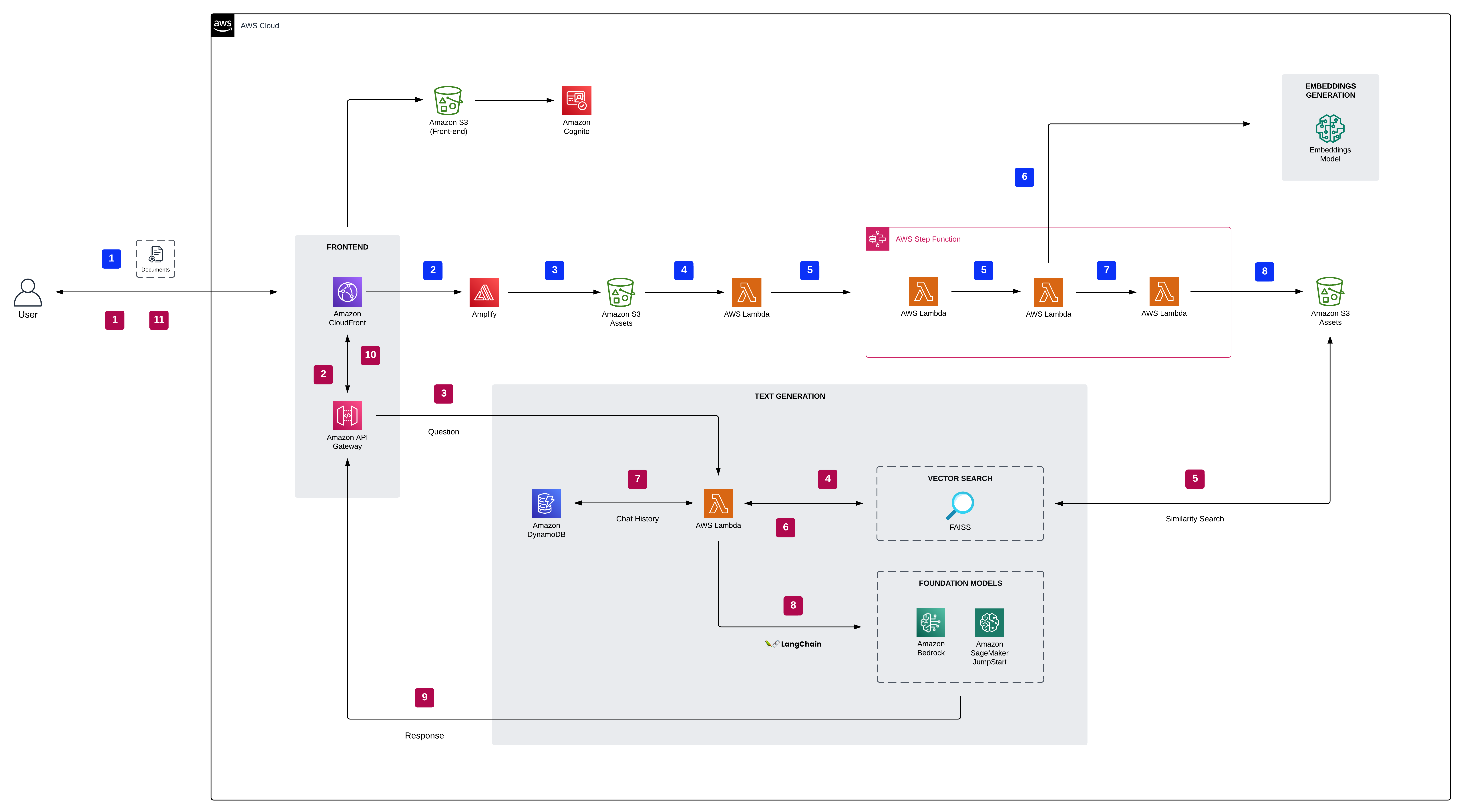

W układzie architektonicznym, w zależności od wybranego interfejsu użytkownika, użytkownicy są prowadzeni do Amazon Bedrock lub Amazon SageMaker JumpStart modele fundamentów. Dokumenty poddawane są obróbce, a osadzanie wektorów tworzone jest na podstawie modelu osadzania. Te osadzania są następnie indeksowane za pomocą FAISS aby umożliwić efektywne wyszukiwanie semantyczne. Historie rozmów są zachowywane w DynamoDB, wzbogacając kontekst dla LLM w celu tworzenia odpowiedzi.

Poniższy diagram ilustruje architekturę rozwiązania i przepływ pracy.

Udostępniliśmy to demo w pliku GitHub repo. Aby wdrożyć go na koncie AWS, zapoznaj się z instrukcjami wdrażania zawartymi w pliku Readme.

Model osadzania

Obowiązki modelu osadzania są następujące:

- Model ten odpowiada za konwersję tekstu (takiego jak dokumenty lub fragmenty) na gęste reprezentacje wektorowe, powszechnie zwane osadzaniami.

- Te osadzania oddają semantyczne znaczenie tekstu, umożliwiając wydajne i semantycznie znaczące porównania pomiędzy różnymi fragmentami tekstu.

- Model osadzania można trenować na tym samym rozległym korpusie, co model podstawowy, lub można specjalizować się w określonych domenach.

Przepływ pytań i odpowiedzi

Poniższe kroki opisują przebieg odpowiedzi na pytanie dotyczące dokumentów:

- Użytkownik loguje się do aplikacji internetowej uwierzytelnionej przez Amazon Cognito.

- Użytkownik przesyła jeden lub więcej dokumentów do Amazon S3.

- Po przesłaniu dokumentu powiadomienie o zdarzeniu S3 uruchamia funkcję Lambda, która następnie wywołuje punkt końcowy modelu osadzania SageMaker w celu wygenerowania osadzania dla nowego dokumentu. Model osadzania przekształca pytanie w gęstą reprezentację wektorową (osadzanie). Powstały plik wektorowy jest bezpiecznie przechowywany w wiadrze S3.

- Retriever FAISS porównuje osadzanie tego pytania z osadzaniem wszystkich dokumentów lub fragmentów w bazie danych, aby znaleźć najbardziej odpowiednie fragmenty.

- Fragmenty wraz z pytaniem użytkownika stanowią kontekst modelu podstawowego. Funkcja Lambda korzysta z biblioteki LangChain i łączy się z punktem końcowym Amazon Bedrock lub SageMaker JumpStart za pomocą zapytania wypełnionego kontekstem.

- Odpowiedź z LLM jest przechowywana w DynamoDB wraz z zapytaniem użytkownika, znacznikiem czasu, unikalnym identyfikatorem i innymi dowolnymi identyfikatorami elementu, takimi jak kategoria pytania. Przechowywanie pytania i odpowiedzi jako odrębnych elementów umożliwia funkcji Lambda łatwe odtworzenie historii rozmów użytkownika na podstawie czasu zadawania pytań.

- Na koniec odpowiedź jest wysyłana z powrotem do użytkownika za pośrednictwem żądania HTTPs za pośrednictwem odpowiedzi integracji interfejsu API API Gateway WebSocket.

Benefity

Poniższa lista opisuje zalety tego rozwiązania:

- Rozumienie semantyczne – Model osadzania gwarantuje, że aporter wybiera fragmenty w oparciu o głębokie zrozumienie semantyki, a nie tylko dopasowania słów kluczowych.

- Skalowalność – Osadzania pozwalają na sprawne porównywanie podobieństw, dzięki czemu możliwe jest szybkie przeszukiwanie rozległych baz dokumentów.

- Elastyczność – Model podstawowy może generować odpowiedzi w oparciu o szeroki zakres kontekstów, zapewniając wszechstronność systemu.

- Możliwość dostosowania domeny – Model osadzania można trenować lub dostrajać pod kątem konkretnych domen, co pozwala na dostosowanie systemu do różnych zastosowań.

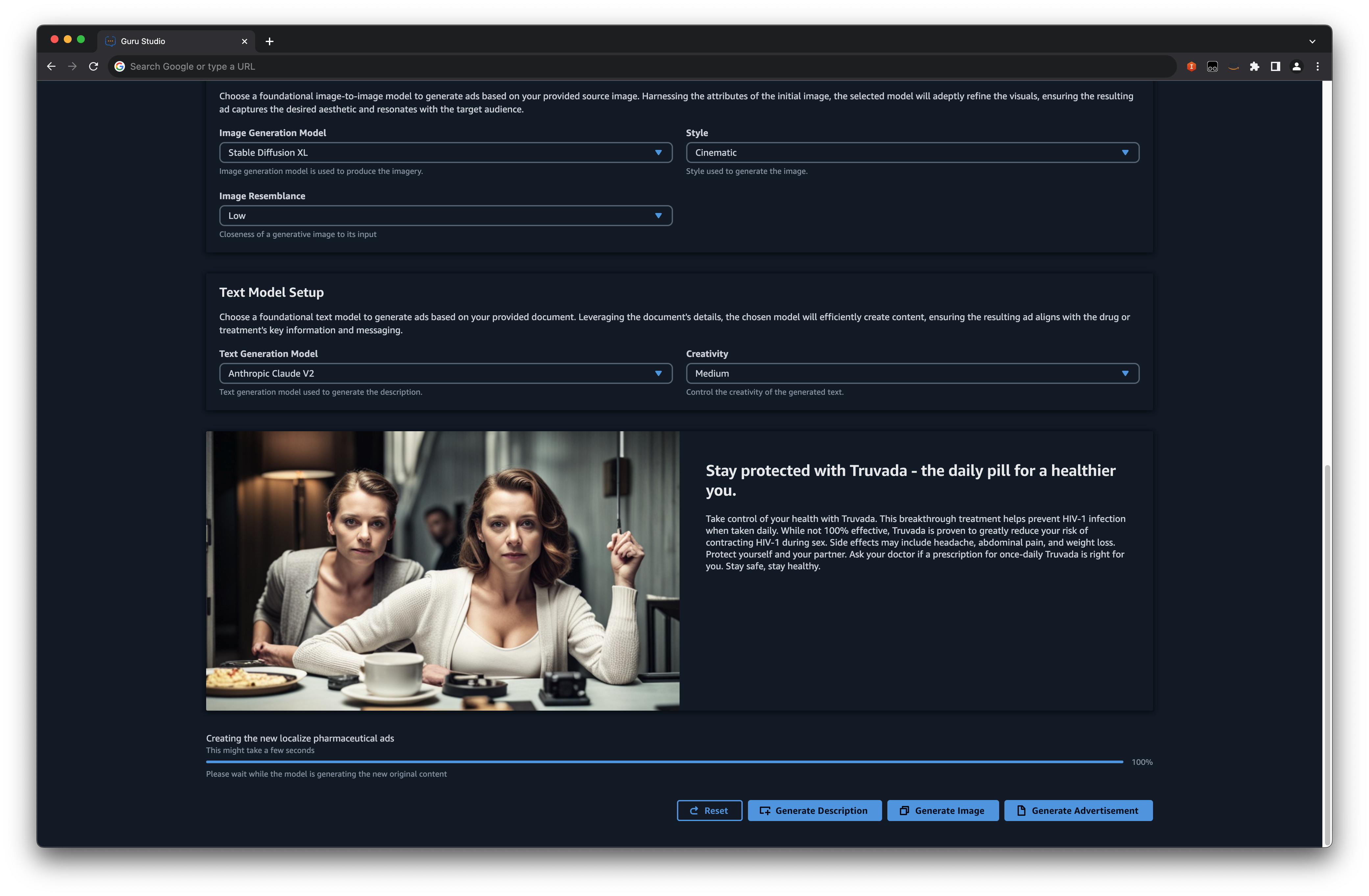

Generator reklam Foundation Models Pharma

W dzisiejszym dynamicznym przemyśle farmaceutycznym skuteczna i zlokalizowana reklama jest ważniejsza niż kiedykolwiek. W tym miejscu wchodzi w grę innowacyjne rozwiązanie, wykorzystujące moc generatywnej sztucznej inteligencji do tworzenia zlokalizowanych reklam produktów farmaceutycznych na podstawie obrazów źródłowych i plików PDF. Takie podejście nie tylko przyspiesza proces generowania reklam, ale także usprawnia proces Medical Legal Review (MLR). MLR to rygorystyczny mechanizm przeglądu, w ramach którego zespoły medyczne, prawne i regulacyjne skrupulatnie oceniają materiały promocyjne, aby zagwarantować ich dokładność, poparcie naukowe i zgodność z przepisami. Tradycyjne metody tworzenia treści mogą być kłopotliwe i często wymagają ręcznych dostosowań i obszernych przeglądów w celu zapewnienia zgodności z regionalnymi przepisami i przydatnością. Jednak wraz z pojawieniem się generatywnej sztucznej inteligencji możemy teraz zautomatyzować tworzenie reklam, które naprawdę przemawiają do lokalnych odbiorców, a wszystko to przy jednoczesnym przestrzeganiu rygorystycznych standardów i wytycznych.

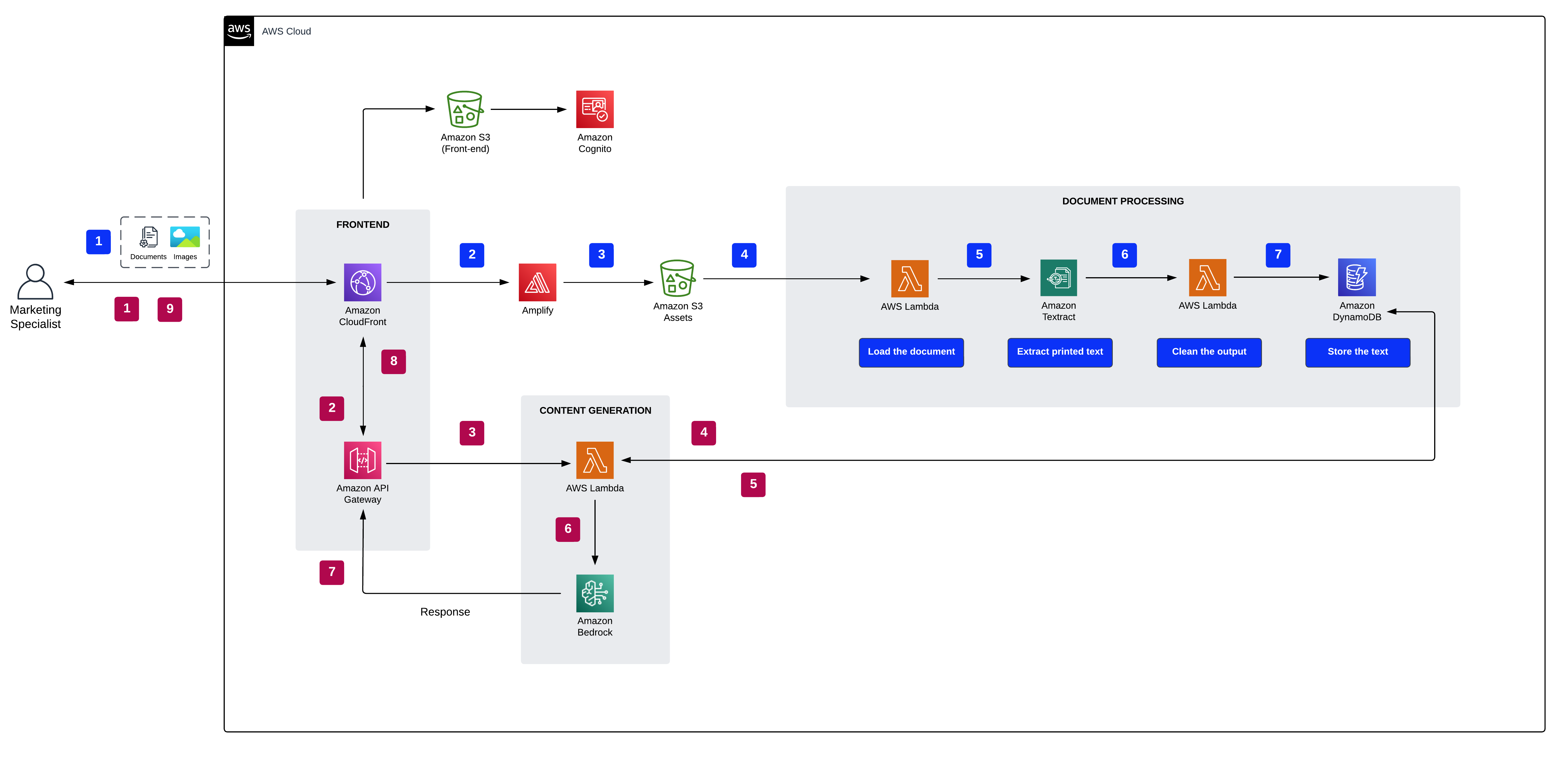

Poniższy schemat ilustruje architekturę rozwiązania.

W układzie architektonicznym, w oparciu o wybrany model i preferencje reklam, użytkownicy są płynnie prowadzeni do modeli fundamentów Amazon Bedrock. To uproszczone podejście gwarantuje, że nowe reklamy będą generowane dokładnie według pożądanej konfiguracji. W ramach tego procesu dokumenty są sprawnie obsługiwane przez Ekstrakt z amazonki, a wynikowy tekst jest bezpiecznie przechowywany w DynamoDB. Wyróżniającą się cechą jest modułowa konstrukcja do generowania obrazów i tekstu, zapewniająca elastyczność niezależnej regeneracji dowolnego komponentu zgodnie z wymaganiami.

Udostępniliśmy to demo w pliku GitHub repo. Aby wdrożyć go na koncie AWS, zapoznaj się z instrukcjami wdrażania zawartymi w pliku Readme.

Proces generowania treści

Poniższe kroki opisują proces generowania treści:

- Użytkownik wybiera dokument, obraz źródłowy, miejsce docelowe reklamy, język i styl obrazu.

- Bezpieczny dostęp do aplikacji internetowej zapewnia uwierzytelnianie Amazon Cognito.

- Interfejs aplikacji internetowej jest hostowany za pośrednictwem Amplify.

- Interfejs API WebSocket zarządzany przez API Gateway ułatwia żądania użytkowników. Żądania te są uwierzytelniane poprzez AWS Zarządzanie tożsamością i dostępem (JESTEM).

- Integracja z Amazon Bedrock obejmuje następujące kroki:

- Funkcja Lambda wykorzystuje bibliotekę LangChain do łączenia się z punktem końcowym Amazon Bedrock za pomocą zapytania kontekstowego.

- Podstawowy model zamiany tekstu na tekst tworzy reklamę odpowiednią kontekstowo na podstawie danego kontekstu i ustawień.

- Podstawowy model zamiany tekstu na obraz tworzy dostosowany obraz, na który wpływa obraz źródłowy, wybrany styl i lokalizacja.

- Użytkownik otrzymuje odpowiedź poprzez żądanie HTTPS za pośrednictwem zintegrowanego interfejsu API Gateway WebSocket API.

Przebieg przetwarzania dokumentów i obrazów

Poniżej przedstawiono procedurę przetwarzania dokumentów i obrazów:

- Użytkownik przesyła zasoby za pośrednictwem określonego interfejsu użytkownika.

- Amplify API przesyła dokumenty do segmentu S3.

- Po przeniesieniu zasobu do Amazon S3 następuje jedna z następujących czynności:

- Jeśli jest to dokument, funkcja Lambda wykorzystuje Amazon Texttract do przetwarzania i wyodrębniania tekstu w celu wygenerowania reklamy.

- Jeśli jest to obraz, funkcja Lambda konwertuje go do formatu base64, odpowiedniego dla modelu Stable Diffusion w celu utworzenia nowego obrazu ze źródła.

- Wyodrębniony tekst lub ciąg obrazu Base64 jest bezpiecznie zapisywany w DynamoDB.

Benefity

Poniższa lista opisuje zalety tego rozwiązania:

- Wydajność – Zastosowanie generatywnej AI znacznie przyspiesza proces generowania reklam, eliminując konieczność ręcznych dostosowań.

- Przestrzeganie zasad – Rozwiązanie gwarantuje, że wygenerowane reklamy będą zgodne z określonymi wytycznymi i przepisami, takimi jak wytyczne marketingowe FDA.

- Ekonomiczne – Automatyzując tworzenie dopasowanych reklam, firmy mogą znacznie obniżyć koszty związane z produkcją i korektami reklam.

- Usprawniony proces MLR – Rozwiązanie upraszcza proces MLR, redukując punkty tarcia i zapewniając płynniejsze recenzje.

- Zlokalizowany rezonans – Generatywna sztuczna inteligencja tworzy reklamy, które przemawiają do lokalnych odbiorców, zapewniając trafność i wpływ w różnych regionach.

- Normalizacja – Rozwiązanie utrzymuje niezbędne standardy i wytyczne, zapewniając spójność wszystkich generowanych reklam.

- Skalowalność – Podejście oparte na sztucznej inteligencji może obsługiwać ogromne bazy danych obrazów źródłowych i plików PDF, dzięki czemu jest możliwe generowanie reklam na dużą skalę.

- Zmniejszona interwencja ręczna – Automatyzacja zmniejsza potrzebę interwencji człowieka, minimalizując błędy i zapewniając spójność.

Możesz wdrożyć infrastrukturę opisaną w tym samouczku z komputera lokalnego lub możesz użyć AWS Cloud9 jako stacji roboczej wdrożeniowej. AWS Cloud9 ma fabrycznie załadowane AWS CLI, AWS CDK i Docker. Jeśli zdecydujesz się na AWS Cloud9, stworzyć środowisko z Konsola AWS Cloud9.

Sprzątać

Aby uniknąć niepotrzebnych kosztów, wyczyść całą infrastrukturę utworzoną za pomocą konsoli AWS CloudFormation lub uruchamiając następującą komendę na swojej stacji roboczej:

Dodatkowo pamiętaj, aby zatrzymać wszystkie punkty końcowe SageMaker zainicjowane za pośrednictwem konsoli SageMaker. Pamiętaj, że usunięcie indeksu Amazon Kendra nie powoduje usunięcia oryginalnych dokumentów z Twojej pamięci.

Wnioski

Generatywna sztuczna inteligencja, uosobiona przez LLM, zwiastuje zmianę paradygmatu w sposobie uzyskiwania dostępu do informacji i ich generowania. Modele te, choć potężne, są często ograniczone ograniczeniami danych szkoleniowych. RAG stawia czoła temu wyzwaniu, zapewniając, że ogromna wiedza zawarta w tych modelach jest konsekwentnie uzupełniana odpowiednimi, aktualnymi spostrzeżeniami.

Nasze dema oparte na RAG stanowią namacalny dowód na to. Pokazują płynną synergię pomiędzy Amazon Kendra, osadzaniem wektorowym i LLM, tworząc system, w którym informacje są nie tylko obszerne, ale także dokładne i aktualne. Zagłębiając się w te demonstracje, z pierwszej ręki odkryjesz potencjał transformacyjny łączenia wstępnie przeszkolonej wiedzy z dynamicznymi możliwościami RAG, w wyniku czego otrzymasz wyniki, które są zarówno godne zaufania, jak i dostosowane do treści przedsiębiorstwa.

Chociaż generatywna sztuczna inteligencja oparta na LLM otwiera nowy sposób uzyskiwania wglądu w informacje, spostrzeżenia te muszą być godne zaufania i ograniczać się do treści przedsiębiorstwa przy użyciu podejścia RAG. Te demonstracje oparte na RAG umożliwiają uzyskanie dokładnych i aktualnych spostrzeżeń. Jakość tych spostrzeżeń zależy od trafności semantycznej, którą umożliwia użycie Amazon Kendra i osadzania wektorów.

Jeśli jesteś gotowy na dalsze odkrywanie i wykorzystanie mocy generatywnej sztucznej inteligencji, oto kolejne kroki:

- Skorzystaj z naszych demonstracji – Doświadczenie praktyczne jest bezcenne. Poznaj funkcjonalności, poznaj integracje i zapoznaj się z interfejsem.

- Pogłębiaj swoją wiedzę – Skorzystaj z dostępnych zasobów. AWS oferuje szczegółową dokumentację, samouczki i wsparcie społeczności, które pomogą Ci w podróży po sztucznej inteligencji.

- Rozpocznij projekt pilotażowy – Rozważ rozpoczęcie od wdrożenia generatywnej sztucznej inteligencji na małą skalę w swoim przedsiębiorstwie. Zapewni to wgląd w praktyczność systemu i jego możliwości adaptacji w konkretnym kontekście.

Więcej informacji na temat generatywnych aplikacji AI w AWS można znaleźć w poniższych artykułach:

Pamiętaj, że krajobraz sztucznej inteligencji stale się rozwija. Bądź na bieżąco, bądź ciekawy i zawsze gotowy na adaptację i innowacje.

O Autorach

Jin Tana Ruana jest programistą zajmującym się prototypowaniem w zespole prototypowania i inżynierii klienta (PACE) AWS Industries, specjalizującym się w NLP i generatywnej sztucznej inteligencji. Mając doświadczenie w tworzeniu oprogramowania i dziewięć certyfikatów AWS, Jin wnosi bogate doświadczenie, aby pomóc klientom AWS w urzeczywistnianiu ich wizji AI/ML i generatywnej sztucznej inteligencji za pomocą platformy AWS. Uzyskał tytuł magistra informatyki i inżynierii oprogramowania na Uniwersytecie w Syracuse. Poza pracą Jin lubi grać w gry wideo i zanurzać się w ekscytującym świecie horrorów.

Jin Tana Ruana jest programistą zajmującym się prototypowaniem w zespole prototypowania i inżynierii klienta (PACE) AWS Industries, specjalizującym się w NLP i generatywnej sztucznej inteligencji. Mając doświadczenie w tworzeniu oprogramowania i dziewięć certyfikatów AWS, Jin wnosi bogate doświadczenie, aby pomóc klientom AWS w urzeczywistnianiu ich wizji AI/ML i generatywnej sztucznej inteligencji za pomocą platformy AWS. Uzyskał tytuł magistra informatyki i inżynierii oprogramowania na Uniwersytecie w Syracuse. Poza pracą Jin lubi grać w gry wideo i zanurzać się w ekscytującym świecie horrorów.

Aravinda Kodandaramaiaha jest starszym konstruktorem kompleksowych rozwiązań prototypowania w zespole AWS Industries Prototyping and Customer Engineering (PACE). Koncentruje się na pomaganiu klientom AWS w przekształcaniu innowacyjnych pomysłów w rozwiązania przynoszące wymierne i zachwycające rezultaty. Pasjonuje się wieloma tematami, w tym bezpieczeństwem w chmurze, DevOps i AI/ML, i zazwyczaj majstruje przy tych technologiach.

Aravinda Kodandaramaiaha jest starszym konstruktorem kompleksowych rozwiązań prototypowania w zespole AWS Industries Prototyping and Customer Engineering (PACE). Koncentruje się na pomaganiu klientom AWS w przekształcaniu innowacyjnych pomysłów w rozwiązania przynoszące wymierne i zachwycające rezultaty. Pasjonuje się wieloma tematami, w tym bezpieczeństwem w chmurze, DevOps i AI/ML, i zazwyczaj majstruje przy tych technologiach.

Arjun Shakdher jest programistą w zespole AWS Industries Prototyping (PACE), którego pasją jest łączenie technologii z tkanką życia. Posiadając tytuł magistra na Uniwersytecie Purdue, obecna rola Arjuna koncentruje się na projektowaniu i budowaniu najnowocześniejszych prototypów obejmujących szereg dziedzin, obecnie dominujących w obszarach AI/ML i IoT. Jeśli nie jesteś zanurzony w kodach i cyfrowych krajobrazach, Arjun oddaje się światu kawy, zgłębia zawiłą mechanikę zegarmistrzostwa lub rozkoszuje się kunsztem samochodów.

Arjun Shakdher jest programistą w zespole AWS Industries Prototyping (PACE), którego pasją jest łączenie technologii z tkanką życia. Posiadając tytuł magistra na Uniwersytecie Purdue, obecna rola Arjuna koncentruje się na projektowaniu i budowaniu najnowocześniejszych prototypów obejmujących szereg dziedzin, obecnie dominujących w obszarach AI/ML i IoT. Jeśli nie jesteś zanurzony w kodach i cyfrowych krajobrazach, Arjun oddaje się światu kawy, zgłębia zawiłą mechanikę zegarmistrzostwa lub rozkoszuje się kunsztem samochodów.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 100

- 150

- 7

- a

- zdolność

- O nas

- przyspiesza

- dostęp

- Stosownie

- Konto

- precyzja

- dokładny

- w poprzek

- działania

- Ad

- przystosować

- dostosowuje się

- w dodatku

- Adresy

- przylegać

- Korekty

- Przyjęcie

- Reklamy

- zaawansowany

- Korzyść

- Zalety

- nadejście

- Reklama

- Po

- AI

- AI / ML

- AID

- wyrównanie

- Wszystkie kategorie

- dopuszczać

- Pozwalać

- pozwala

- prawie

- wzdłuż

- również

- alternatywny

- zawsze

- Amazonka

- Amazon Cognito

- Amazonka Kendra

- Ekstrakt z amazonki

- Amazon Web Services

- kwoty

- wzmacniać

- an

- i

- odpowiedź

- odpowiedzi

- każdy

- api

- Aplikacja

- Zastosowanie

- aplikacje

- podejście

- właściwy

- architektoniczny

- architektura

- SĄ

- na około

- Szyk

- artyzm

- AS

- kapitał

- Aktywa

- pomagać

- powiązany

- publiczność

- audio

- uwierzytelniony

- Uwierzytelnianie

- zautomatyzować

- automatyzacja

- Automatyzacja

- dostępny

- uniknąć

- unikając

- AWS

- Chmura AWS9

- Tworzenie chmury AWS

- z powrotem

- poparła

- tło

- poparcie

- baza

- na podstawie

- BE

- bo

- stają się

- staje się

- Korzyści

- Ulepsz Swój

- pomiędzy

- Poza

- uprzedzenia

- Mieszanie

- ciało

- Bot

- obie

- Oddział

- Przynosi

- szeroki

- budowniczy

- Budowanie

- ale

- by

- Połączenia

- CAN

- Może uzyskać

- możliwości

- zdobyć

- przechwytuje

- walizka

- Kategoria

- certyfikaty

- wyzwanie

- wyzwania

- Dodaj

- wybrany

- kleń

- Chmura

- Cloud Security

- Cloud9

- kod

- Kawa

- połączony

- kombajny

- byliśmy spójni, od początku

- powszechnie

- społeczność

- Firmy

- porównania

- kompleks

- spełnienie

- zgodny

- składnik

- rozumie

- komputer

- Computer Science

- systemu

- Skontaktuj się

- połączenia

- łączy

- Rozważać

- konsekwentnie

- Konsola

- stale

- zawartość

- Generowanie treści

- Tworzenie treści

- kontekst

- konteksty

- kontekstowy

- nadal

- ciągły

- Wygodny

- Konwencjonalny

- Rozmowa

- 轉換

- rdzeń

- Koszty:

- Koszty:

- rzemiosło

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- istotny

- niewygodny

- ciekawy

- Aktualny

- zwyczaj

- klient

- Klientów

- pionierski nowatorski

- dane

- Baza danych

- Bazy danych

- zbiory danych

- Data

- głęboko

- głębiej

- Stopień

- zachwycający

- próbny

- Demos

- zależny

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- opisać

- Wnętrze

- zaprojektowany

- życzenia

- zniszczyć

- szczegółowe

- detale

- Deweloper

- oprogramowania

- diagnostyczny

- różne

- Transmitowanie

- cyfrowy

- skierowany

- wyświetlacze

- odrębny

- nurkować

- inny

- nurkowanie

- Doker

- dokument

- dokumentacja

- dokumenty

- Nie

- domeny

- rysować

- rysunek

- napędzany

- dynamiczny

- z łatwością

- efektywność

- wydajny

- skutecznie

- bądź

- eliminując

- osadzanie

- wyłaniać się

- zatrudnia

- upoważniony

- upoważnia

- umożliwiać

- włączony

- Umożliwia

- umożliwiając

- zakończenia

- Punkt końcowy

- Inżynieria

- wzmocnione

- wzbogacanie

- zapewnić

- zapewnione

- zapewnia

- zapewnienie

- Enterprise

- Cały

- wyposażony

- Błędy

- szczególnie

- istota

- oceniać

- wydarzenie

- EVER

- ewoluuje

- ewoluuje

- przykład

- podniecony

- ekspansywny

- doświadczenie

- ekspert

- eksperci

- odkryj

- Exploring

- rozległy

- zewnętrzny

- wyciąg

- tkanina

- ułatwia

- oswajać

- w szybkim tempie

- FB

- wykonalny

- Cecha

- Korzyści

- Wyposażony w

- filet

- filtracja

- Znajdź

- i terminów, a

- Elastyczność

- koncentruje

- następujący

- następujący sposób

- W razie zamówieenia projektu

- format

- znaleziono

- Fundacja

- tarcie

- od

- z przodu

- Zaczepy

- pełny

- Pełny stos

- funkcjonować

- funkcjonalności

- dalej

- Ponadto

- Wzrost

- zyskuje

- Games

- Bramka

- Generować

- wygenerowane

- generacja

- generatywny

- generatywna sztuczna inteligencja

- generator

- otrzymać

- dany

- Dający

- przyznanie

- chwycić

- Rośnie

- gwarancja

- poradnictwo

- prowadzony

- wytyczne

- uchwyt

- hands-on

- uprząż

- Wykorzystywanie

- Have

- mający

- he

- pomoc

- heroldowie

- tutaj

- pasemka

- samego siebie

- historie

- historia

- przytrzymanie

- posiada

- przerażenie

- hostowane

- W jaki sposób

- Jednak

- HTML

- http

- HTTPS

- człowiek

- pomysły

- identyfikator

- identyfikatory

- zidentyfikować

- tożsamość

- if

- ilustruje

- obraz

- zdjęcia

- zanurzony

- Rezultat

- realizacja

- in

- informacje

- niedokładny

- obejmuje

- Włącznie z

- włączać

- niezależnie

- wskaźnik

- zindeksowane

- indeksy

- przemysłowa

- przemysł

- standardy przemysłowe

- pod wpływem

- Informacja

- poinformowany

- Infrastruktura

- właściwie

- początkowy

- zapoczątkowany

- wprowadzać innowacje

- Innowacyjny

- wnikliwy

- spostrzeżenia

- zamiast

- instrukcje

- zintegrowany

- Integruje się

- integracja

- integracje

- zamiar

- współdziała

- Interfejs

- interwencja

- najnowszych

- wewnętrzny

- nieoceniony

- Internet przedmiotów

- IT

- szt

- JEGO

- Praca

- podróż

- jpg

- właśnie

- wiedza

- znany

- krajobraz

- język

- duży

- na dużą skalę

- układ

- nauka

- Regulamin

- pozwala

- Biblioteka

- Upoważniony

- życie

- lubić

- prawdopodobieństwo

- Ograniczony

- Limity

- Lista

- LLM

- miejscowy

- lokalizacja

- maszyna

- uczenie maszynowe

- utrzymuje

- Dokonywanie

- zarządzane

- podręcznik

- wiele

- Marketing

- masywny

- mistrzowski

- zapałki

- materiały

- znaczenie

- wymowny

- znaczenia

- znaczy

- mechanika

- mechanizm

- medyczny

- Pamięć

- jedynie

- łączy się

- połączenie

- metody

- skrupulatnie

- minimalizowanie

- łagodzenie

- ML

- model

- modelowanie

- modele

- Modułowa

- jeszcze

- większość

- Kino

- musi

- Naturalny

- Przetwarzanie języka naturalnego

- niezbędny

- Potrzebować

- potrzebne

- potrzeba

- wymagania

- Nowości

- Następny

- dziewięć

- nlp

- powiadomienie

- już dziś

- of

- oferuje

- Oferty

- często

- on

- ONE

- tylko

- otwiera

- or

- organizacyjny

- organizacji

- oryginalny

- Inne

- ludzkiej,

- na zewnątrz

- wyniki

- zarys

- Wyjścia

- zewnętrzne

- koniec

- Przezwyciężać

- Pokój

- paradygmat

- parametry

- część

- namiętny

- doskonały

- uprawnienia

- Personalizowany

- Pharma

- Przemysł farmaceutyczny

- Zwroty

- sztuk

- pilot

- Projekt pilotażowy

- Miejsce

- umieszczenie

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- Grać

- gra

- zwrotnica

- pozycjonowanie

- możliwy

- Post

- potencjał

- power

- powered

- mocny

- Praktyczny

- precyzyjny

- precyzyjnie

- Detaliczność

- preferencje

- warunki wstępne

- obecnie

- procedura

- wygląda tak

- Obrobiony

- przetwarzanie

- Wytworzony

- produkuje

- Produkcja

- projekt

- promocyjny

- prototypy

- prototypowanie

- Udowodnij

- zapewniać

- pod warunkiem,

- zapewnia

- że

- jakość

- zapytania

- pytanie

- pytania

- Szybki

- szybko

- zasięg

- gotowy

- królestwa

- otrzymuje

- odbieranie

- Rekomendacja

- zmniejszyć

- zmniejsza

- redukcja

- odnosić się

- rafinowany

- regionalny

- regiony

- regularny

- regulamin

- regulacyjne

- Zgodność z przepisami

- mających znaczenie

- opierając się

- pozostawać

- szczątki

- pamiętać

- usunąć

- przeformułowanie

- reprezentacja

- reprezentuje

- zażądać

- wywołań

- wymagać

- wymagany

- wymagania

- rezonator

- Zasoby

- odpowiedź

- Odpowiedzi

- obowiązki

- odpowiedzialny

- wynikowy

- wynikły

- Efekt

- przeglądu

- Recenzje

- rewizje

- kręci się

- prawo

- rygorystyczny

- Rola

- bieganie

- działa

- sagemaker

- taki sam

- zapisywane

- nauka

- naukowy

- bezszwowy

- płynnie

- Szukaj

- działy

- bezpieczne

- bezpiecznie

- bezpieczeństwo

- wybrany

- wybór

- senior

- wysłany

- usługa

- Usługi

- zestaw

- w panelu ustawień

- ustawienie

- przesunięcie

- prezentacja

- Targi

- Przesiać

- znaczący

- znacznie

- Prosty

- po prostu

- mniejszy

- gładsze

- Tworzenie

- rozwoju oprogramowania

- Inżynieria oprogramowania

- Wyłącznie

- rozwiązanie

- Rozwiązania

- Źródło

- pozyskiwany

- Źródła

- Sourcing

- obowiązuje

- rozpiętość

- wyspecjalizowanym

- specjalizujący się

- specyficzny

- określony

- stabilny

- stos

- standardy

- Startowy

- state-of-the-art

- pobyt

- Ewolucja krok po kroku

- Cel

- Stop

- przechowywanie

- sklep

- przechowywany

- przechowywania

- usprawniony

- silne strony

- sznur

- przekonywający

- zbudowany

- styl

- Zatwierdź

- taki

- odpowiedni

- wsparcie

- Utrzymany

- synergia

- system

- dostosowane

- Brać

- trwa

- namacalny

- Zadanie

- zadania

- zespół

- Zespoły

- technika

- Technologies

- Technologia

- testament

- XNUMX

- niż

- że

- Połączenia

- Krajobraz

- Źródło

- świat

- ich

- Im

- następnie

- a tym samym

- Te

- one

- to

- trzy

- porywający

- Przez

- czas

- aktualny

- znak czasu

- tytan

- do

- dzisiaj

- narzędzie

- narzędzia

- aktualny

- tematy

- w kierunku

- tradycyjny

- Pociąg

- przeszkolony

- Trening

- przenieść

- przeniesione

- transfery

- Przekształcać

- transformacyjny

- Transformatory

- Trendy

- naprawdę

- godny zaufania

- SKRĘCAĆ

- Tutorial

- tutoriale

- typy

- ui

- przejść

- zasadniczy

- zrozumieć

- zrozumienie

- wyjątkowy

- uniwersytet

- w odróżnieniu

- niepotrzebny

- demaskować

- nowomodny

- Aktualizacja

- zaktualizowane

- Nowości

- utrzymanie

- na

- posługiwać się

- przypadek użycia

- Użytkownik

- Interfejs użytkownika

- Użytkownicy

- zastosowania

- za pomocą

- zazwyczaj

- wykorzystuje

- Wykorzystując

- różnorodny

- Naprawiono

- wszechstronny

- przez

- Wideo

- gier wideo

- wizje

- Droga..

- we

- Bogactwo

- sieć

- Aplikacja internetowa

- usługi internetowe

- gniazdo sieciowe

- były

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- KIM

- szeroki

- Szeroki zasięg

- będzie

- w

- w ciągu

- bez

- słowa

- Praca

- workflow

- stacja robocza

- świat

- You

- Twój

- siebie

- zefirnet