Ten post napisali wspólnie z Kostią Kofman i Jenny Tokar z Booking.com.

Jako światowy lider branży turystycznej online, Booking.com zawsze poszukuje innowacyjnych sposobów na ulepszenie swoich usług i zapewnienie klientom dostosowanych i bezproblemowych doświadczeń. Zespół ds. rankingów w Booking.com odgrywa kluczową rolę w zapewnianiu optymalizacji algorytmów wyszukiwania i rekomendacji w celu zapewnienia użytkownikom najlepszych wyników.

Dzieląc się wewnętrznymi zasobami z innymi wewnętrznymi zespołami, naukowcy z zespołu Rankingu zajmujący się uczeniem maszynowym (ML) często napotykali długi czas oczekiwania na dostęp do zasobów na potrzeby szkolenia modeli i eksperymentowania, co stanowiło wyzwanie dla ich zdolności do szybkiego eksperymentowania i wprowadzania innowacji. Dostrzegając potrzebę zmodernizowania infrastruktury ML, zespół Rankingowy wyruszył w podróż, aby wykorzystać moc Amazon Sage Maker do tworzenia, uczenia i wdrażania modeli uczenia maszynowego na dużą skalę.

Booking.com współpracował z Usługi profesjonalne AWS zbudować rozwiązanie przyspieszające czas wprowadzenia na rynek ulepszonych modeli uczenia maszynowego poprzez następujące ulepszenia:

- Krótszy czas oczekiwania na zasoby do celów szkoleniowych i eksperymentalnych

- Integracja podstawowych funkcji uczenia maszynowego, takich jak dostrajanie hiperparametrów

- Skrócony cykl rozwoju modeli ML

Krótszy czas oczekiwania oznaczałby, że zespół mógłby szybko iterować i eksperymentować z modelami, uzyskując szczegółowe informacje w znacznie szybszym tempie. Korzystanie z instancji dostępnych na żądanie SageMaker umożliwiło dziesięciokrotne skrócenie czasu oczekiwania. Lokalnie brakowało podstawowych funkcji uczenia maszynowego, takich jak dostrajanie hiperparametrów i wyjaśnialność modelu. Modernizacja zespołu wprowadziła te funkcje Automatyczne strojenie modeli Amazon SageMaker i Amazon SageMaker Wyjaśnij. Wreszcie aspiracją zespołu było otrzymywanie natychmiastowej informacji zwrotnej na temat każdej zmiany wprowadzonej w kodzie, co skróciłoby pętlę sprzężenia zwrotnego z minut do chwili, a tym samym skróciłoby cykl rozwoju modeli ML.

W tym poście zagłębiamy się w podróż, którą podjął zespół ds. rankingów w Booking.com, gdy wykorzystał możliwości SageMaker do modernizacji swojego środowiska eksperymentów ML. W ten sposób nie tylko pokonali istniejące wyzwania, ale także usprawnili wyszukiwanie, co ostatecznie przyniosło korzyści milionom podróżnych na całym świecie.

Podejście do modernizacji

Zespół rankingowy składa się z kilku naukowców zajmujących się ML, z których każdy musi opracować i przetestować swój własny model w trybie offline. Kiedy model zostanie uznany za pomyślny na podstawie oceny offline, można go przenieść do produkcyjnych testów A/B. Jeśli wykaże poprawę w trybie online, można go wdrożyć u wszystkich użytkowników.

Celem tego projektu było stworzenie przyjaznego dla użytkownika środowiska dla naukowców zajmujących się ML, umożliwiającego łatwe uruchamianie i dostosowywanie go Modele budowy rurociągów Amazon SageMaker testować swoje hipotezy bez konieczności kodowania długich i skomplikowanych modułów.

Jednym z kilku stojących przed nami wyzwań było dostosowanie istniejącego lokalnego rozwiązania potokowego do użytku na platformie AWS. Rozwiązanie obejmowało dwa kluczowe elementy:

- Modyfikowanie i rozszerzanie istniejącego kodu – Pierwsza część naszego rozwiązania polegała na modyfikacji i rozbudowie istniejącego kodu w celu dostosowania go do infrastruktury AWS. Miało to kluczowe znaczenie dla zapewnienia płynnego przejścia z przetwarzania lokalnego na przetwarzanie w chmurze.

- Rozwój pakietu klienta – Opracowano pakiet klienta, który działa jako opakowanie wokół interfejsów API SageMaker i wcześniej istniejącego kodu. Ten pakiet łączy te dwa elementy, umożliwiając naukowcom zajmującym się ML łatwe konfigurowanie i wdrażanie potoków ML bez kodowania.

Konfiguracja potoku SageMaker

Możliwość dostosowania jest kluczem do procesu budowania modelu i została osiągnięta dzięki config.ini, obszerny plik konfiguracyjny. Plik ten służy jako centrum kontroli wszystkich danych wejściowych i zachowań potoku.

Dostępne konfiguracje wewnątrz config.ini zawierać:

- Szczegóły rurociągu – Praktyk może zdefiniować nazwę potoku, określić, które kroki powinny zostać wykonane, określić, gdzie powinny być przechowywane dane wyjściowe Usługa Amazon Simple Storage (Amazon S3) i wybierz zestawy danych, których chcesz użyć

- Dane konta AWS – Możesz zdecydować, w którym regionie ma przebiegać rurociąg i jaką rolę ma pełnić

- Konfiguracja specyficzna dla kroku – Dla każdego etapu potoku możesz określić szczegóły, takie jak liczba i typ instancji, które mają zostać użyte, wraz z odpowiednimi parametrami

Poniższy kod przedstawia przykładowy plik konfiguracyjny:

config.ini to plik z kontrolą wersji zarządzany przez Git, reprezentujący minimalną konfigurację wymaganą do pomyślnego uruchomienia potoku szkoleniowego. Podczas programowania można wykorzystać lokalne pliki konfiguracyjne, które nie podlegają kontroli wersji. Te lokalne pliki konfiguracyjne muszą zawierać jedynie ustawienia istotne dla konkretnego przebiegu, co zapewnia elastyczność i brak złożoności. Klient tworzenia potoku jest przeznaczony do obsługi wielu plików konfiguracyjnych, przy czym najnowszy ma pierwszeństwo przed poprzednimi ustawieniami.

Kroki potoku SageMaker

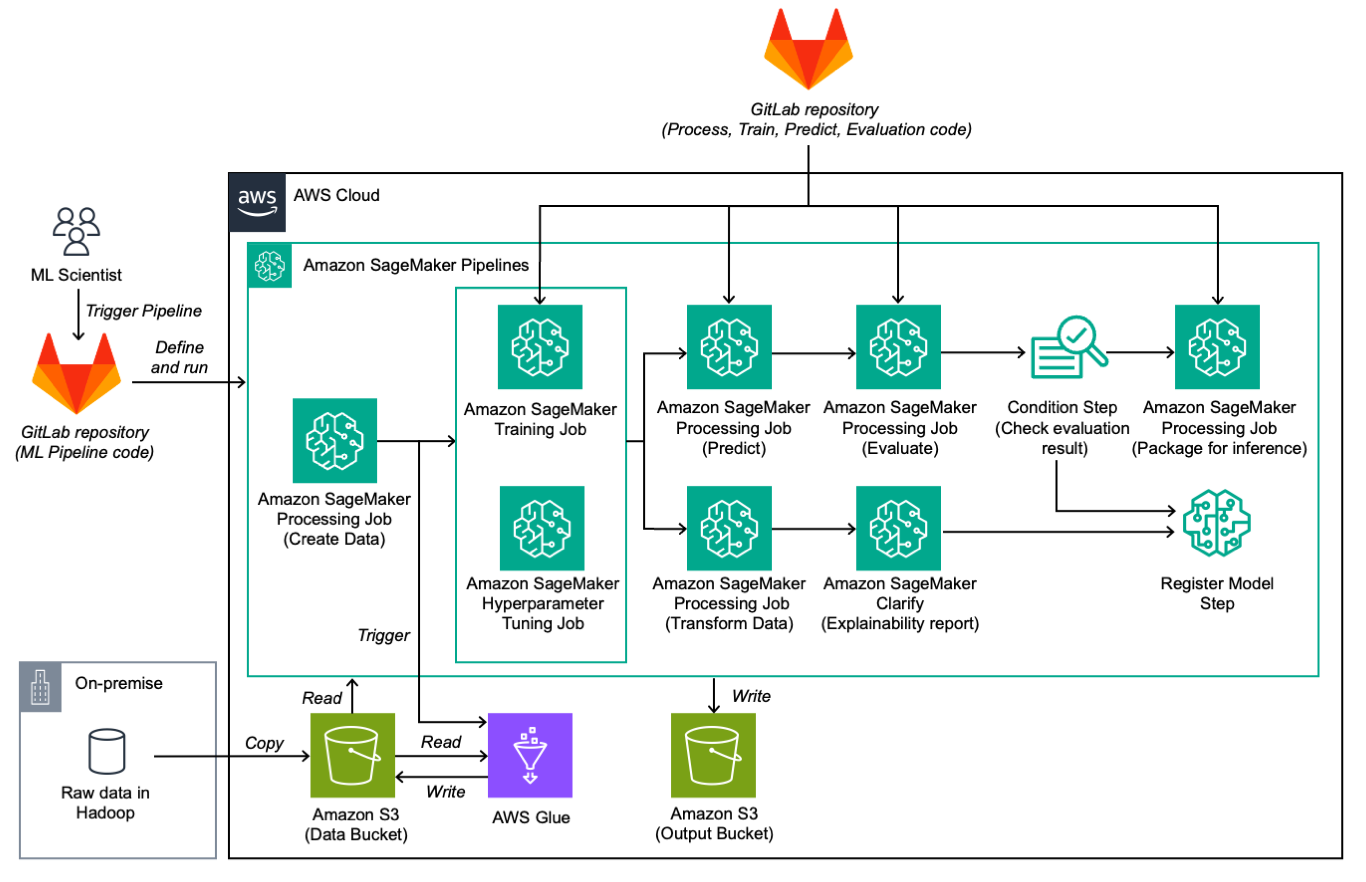

Rurociąg jest podzielony na następujące etapy:

- Przygotowanie danych do trenowania i testowania – Terabajty surowych danych są kopiowane do segmentu S3 i przetwarzane przy użyciu Klej AWS zadania do przetwarzania w platformie Spark, co skutkuje strukturą i formatem danych zapewniających zgodność.

- Pociąg – Na etapie uczenia używany jest estymator TensorFlow dla zadań szkoleniowych SageMaker. Uczenie odbywa się w sposób rozproszony przy użyciu Horovoda, a powstały artefakt modelu jest przechowywany w Amazon S3. W celu dostrajania hiperparametrów można zainicjować zadanie optymalizacji hiperparametrów (HPO), wybierając najlepszy model na podstawie metryki obiektywnej.

- Przewiduj – Na tym etapie zadanie przetwarzania SageMaker wykorzystuje artefakt przechowywanego modelu do tworzenia prognoz. Proces ten przebiega równolegle na dostępnych maszynach, a wyniki predykcji przechowywane są w Amazon S3.

- Oceniać – Zadanie przetwarzania PySpark ocenia model przy użyciu niestandardowego skryptu Spark. Raport z oceny jest następnie przechowywany w Amazon S3.

- Stan – Po ocenie zostaje podjęta decyzja dotycząca jakości modelu. Decyzja ta opiera się na metryce stanu zdefiniowanej w pliku konfiguracyjnym. Jeżeli ocena jest pozytywna, model zostaje zarejestrowany jako zatwierdzony; w przeciwnym razie zostanie zarejestrowany jako odrzucony. W obu przypadkach raport z oceny i wyjaśnialności, jeśli został wygenerowany, jest rejestrowany w rejestrze modeli.

- Model pakietu do wnioskowania – Za pomocą zadania przetwarzania, jeśli wyniki oceny są pozytywne, model jest pakowany, przechowywany w Amazon S3 i przygotowywany do przesłania do wewnętrznego portalu ML.

- Wyjaśniać – SageMaker Clarify generuje raport wyjaśnialności.

Używane są dwa różne repozytoria. Pierwsze repozytorium zawiera definicję i kod kompilacji potoku ML, a drugie repozytorium zawiera kod uruchamiany na każdym etapie, takim jak przetwarzanie, szkolenie, przewidywanie i ocena. To podejście oparte na dwóch repozytorium pozwala na większą modułowość i umożliwia zespołom naukowym i inżynierskim niezależną iterację w kodzie ML i komponentach potoku ML.

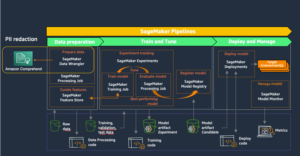

Poniższy schemat ilustruje przepływ pracy rozwiązania.

Automatyczne strojenie modelu

Szkolenie modeli uczenia maszynowego wymaga iteracyjnego podejścia do wielu eksperymentów szkoleniowych w celu zbudowania solidnego i wydajnego modelu końcowego do użytku biznesowego. Naukowcy ML muszą wybrać odpowiedni typ modelu, zbudować prawidłowe zbiory danych wejściowych i dostosować zestaw hiperparametrów kontrolujących proces uczenia się modelu podczas szkolenia.

Dobór odpowiednich wartości hiperparametrów do procesu uczenia modelu może znacząco wpłynąć na końcową wydajność modelu. Nie ma jednak unikalnego ani zdefiniowanego sposobu określenia, które wartości są odpowiednie dla konkretnego przypadku użycia. W większości przypadków naukowcy zajmujący się uczeniem maszynowym będą musieli przeprowadzić wiele zadań szkoleniowych z nieco różnymi zestawami hiperparametrów, obserwować metryki uczenia modelu, a następnie spróbować wybrać bardziej obiecujące wartości do następnej iteracji. Ten proces dostrajania wydajności modelu jest również znany jako optymalizacja hiperparametrów (HPO) i czasami może wymagać setek eksperymentów.

Zespół ds. rankingu wykonywał HPO ręcznie w środowisku lokalnym, ponieważ mógł równolegle uruchamiać jedynie bardzo ograniczoną liczbę zadań szkoleniowych. Dlatego musieli sekwencyjnie uruchamiać HPO, ręcznie testować i wybierać różne kombinacje wartości hiperparametrów oraz regularnie monitorować postęp. Wydłużyło to proces opracowywania i dostrajania modelu oraz ograniczało ogólną liczbę eksperymentów z HPO, które można było przeprowadzić w możliwym czasie.

Po przejściu na AWS zespół ds. rankingu mógł korzystać z funkcji automatycznego dostrajania modelu (AMT) w SageMaker. AMT umożliwia naukowcom Ranking ML automatyczne uruchamianie setek zadań szkoleniowych w interesujących zakresach hiperparametrów, aby znaleźć najskuteczniejszą wersję ostatecznego modelu zgodnie z wybraną metryką. Zespół ds. rankingu może teraz wybierać pomiędzy czterema różnymi strategiami automatycznego dostrajania wyboru hiperparametrów:

- Wyszukiwanie w siatce – AMT będzie oczekiwać, że wszystkie hiperparametry będą wartościami kategorycznymi i uruchomi zadania szkoleniowe dla każdej odrębnej kombinacji kategorii, badając całą przestrzeń hiperparametrów.

- Wyszukiwanie losowe – AMT losowo wybierze kombinacje wartości hiperparametrów w podanych zakresach. Ponieważ nie ma zależności pomiędzy różnymi zadaniami szkoleniowymi a wyborem wartości parametrów, za pomocą tej metody można uruchomić wiele równoległych zadań szkoleniowych, przyspieszając proces wyboru optymalnych parametrów.

- Optymalizacja bayesowska – AMT wykorzystuje implementację optymalizacji Bayesa do odgadnięcia najlepszego zestawu wartości hiperparametrów, traktując to jako problem regresji. Rozważy wcześniej przetestowane kombinacje hiperparametrów i ich wpływ na zadania szkoleniowe modelu przy nowym wyborze parametrów, optymalizując pod kątem mądrzejszego wyboru parametrów przy mniejszej liczbie eksperymentów, ale uruchomi także zadania szkoleniowe tylko sekwencyjnie, aby zawsze móc uczyć się na podstawie poprzednich szkoleń.

- Hiperpasmo – AMT będzie wykorzystywać pośrednie i końcowe wyniki uruchomionych zadań szkoleniowych do dynamicznej realokacji zasobów w kierunku zadań szkoleniowych z konfiguracjami hiperparametrów, które dają bardziej obiecujące wyniki, jednocześnie automatycznie zatrzymując te, które osiągają słabsze wyniki.

AMT w SageMaker umożliwiło zespołowi zajmującemu się rankingiem skrócenie czasu spędzanego na procesie dostrajania hiperparametrów na potrzeby opracowywania modelu, umożliwiając po raz pierwszy przeprowadzanie wielu równoległych eksperymentów, korzystanie ze strategii automatycznego dostrajania i wykonywanie dwucyfrowych przebiegów zadań szkoleniowych w ciągu kilku dni, coś, co nie było możliwe na miejscu.

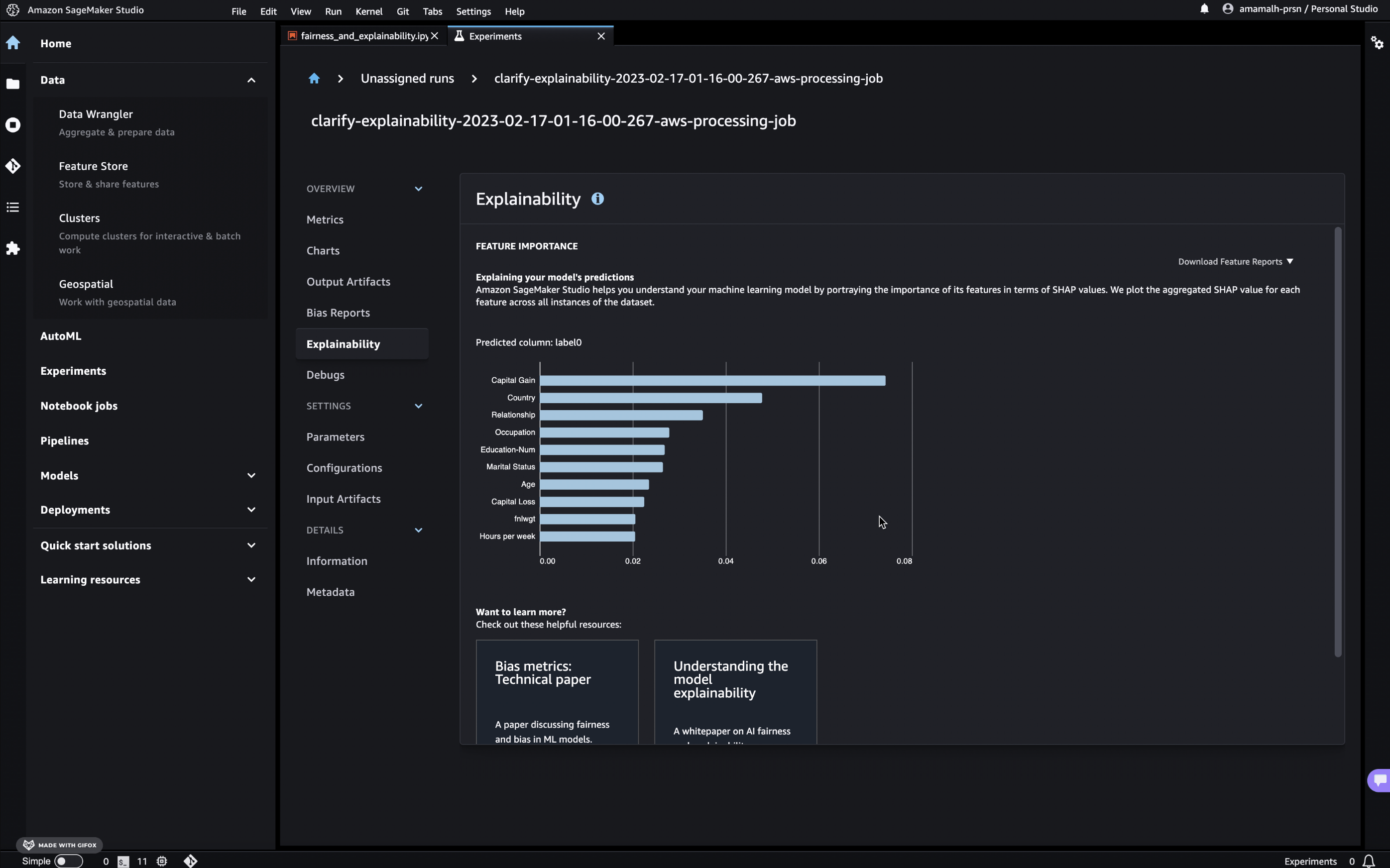

Wyjaśnialność modelu za pomocą SageMaker Clarify

Wyjaśnialność modelu umożliwia specjalistom ML zrozumienie charakteru i zachowania ich modeli ML, dostarczając cennych informacji na potrzeby inżynierii cech i podejmowania decyzji o wyborze, co z kolei poprawia jakość przewidywań modeli. Zespół zajmujący się rankingiem chciał ocenić swoje spostrzeżenia dotyczące wyjaśnialności na dwa sposoby: zrozumieć, w jaki sposób dane wejściowe funkcji wpływają na wyniki modelu w całym zbiorze danych (globalna interpretowalność), a także móc odkryć wpływ cech wejściowych na przewidywanie konkretnego modelu w interesującym punkcie danych ( lokalna interpretowalność). Dzięki tym danym naukowcy zajmujący się Rankingiem ML mogą podejmować świadome decyzje dotyczące dalszego ulepszania wydajności swojego modelu i uwzględniania trudnych wyników przewidywań, które czasami zapewnia model.

SageMaker Clarify umożliwia generowanie raportów wyjaśnialności modelu za pomocą Wyjaśnienia dodatków Shapleya (SHAP) podczas uczenia modeli w SageMaker, obsługując zarówno globalną, jak i lokalną interpretację modelu. Oprócz raportów wyjaśnialności modelu, SageMaker Clarify obsługuje przeprowadzanie analiz metryk błędu przed treningiem, metryk błędu po treningu i wykresów częściowych zależności. Zadanie zostanie uruchomione jako zadanie SageMaker Processing na koncie AWS i integruje się bezpośrednio z potokami SageMaker.

Globalny raport interpretowalności zostanie automatycznie wygenerowany w wynikach zadania i wyświetlony w pliku Studio Amazon SageMaker środowisku w ramach przebiegu eksperymentu szkoleniowego. Jeśli model ten zostanie następnie zarejestrowany w rejestrze modeli SageMaker, raport zostanie dodatkowo powiązany z artefaktem modelu. Korzystając z obu tych opcji, zespół ds. rankingu mógł łatwo śledzić różne wersje modeli i zmiany w ich zachowaniu.

Aby zbadać wpływ funkcji wejściowych na pojedynczą prognozę (wartości lokalnej interpretacji), zespół ds. rankingu włączył ten parametr save_local_shap_values w zadaniach SageMaker Clarify i mogłem załadować je z segmentu S3 do dalszych analiz w notatnikach Jupyter w SageMaker Studio.

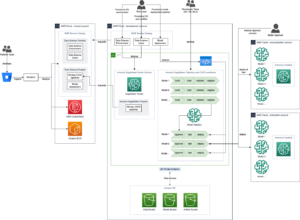

Powyższe obrazy przedstawiają przykład wyjaśniania modelu w przypadku dowolnego modelu ML.

Optymalizacja treningu

Rozwój głębokiego uczenia się (DL) doprowadził do tego, że ML staje się coraz bardziej zależne od mocy obliczeniowej i ogromnych ilości danych. Praktycy uczenia maszynowego często stają przed przeszkodą w efektywnym wykorzystaniu zasobów podczas szkolenia tych złożonych modeli. Kiedy prowadzisz szkolenie w dużych klastrach obliczeniowych, pojawiają się różne wyzwania związane z optymalizacją wykorzystania zasobów, w tym problemy takie jak wąskie gardła we/wy, opóźnienia w uruchamianiu jądra, ograniczenia pamięci i niewykorzystane zasoby. Jeśli konfiguracja zadania szkoleniowego nie jest dostosowana pod kątem wydajności, przeszkody te mogą skutkować nieoptymalnym wykorzystaniem sprzętu, wydłużeniem czasu trwania szkolenia, a nawet niekompletnymi przebiegami szkoleń. Czynniki te zwiększają koszty projektu i opóźniają terminy.

Profilowanie użycia procesora i procesora graficznego pomaga zrozumieć te nieefektywności, określić zużycie zasobów sprzętowych (czasu i pamięci) różnych operacji TensorFlow w modelu, rozwiązać wąskie gardła wydajności i ostatecznie przyspieszyć działanie modelu.

Zespół rankingowy wykorzystał funkcję profilowania frameworku Debuger Amazon SageMaker (obecnie przestarzałe na rzecz Profiler Amazon SageMaker), aby zoptymalizować te zadania szkoleniowe. Umożliwia to śledzenie wszystkich działań na procesorach i procesorach graficznych, takich jak wykorzystanie procesora i procesora graficznego, działanie jądra na procesorach graficznych, uruchamianie jądra na procesorach, operacje synchronizacji, operacje na pamięci na procesorach graficznych, opóźnienia między uruchomieniami jądra i odpowiadającymi im uruchomieniami oraz transfer danych między procesorami i procesory graficzne.

Zespół rankingowy również korzystał z Profiler TensorFlow cechą Tensorboard, co dodatkowo pomogło w profilowaniu szkolenia w zakresie modelu TensorFlow. SageMaker jest teraz dodatkowo zintegrowana z TensorBoard i wprowadza narzędzia wizualizacyjne TensorBoard do SageMaker, zintegrowane ze szkoleniami i domenami SageMaker. TensorBoard umożliwia wykonywanie zadań debugowania modelu przy użyciu wtyczek wizualizacyjnych TensorBoard.

Za pomocą tych dwóch narzędzi zespół ds. rankingu zoptymalizował swój model TensorFlow i był w stanie zidentyfikować wąskie gardła i skrócić średni czas kroku szkoleniowego z 350 milisekund do 140 milisekund na procesorze i ze 170 milisekund do 70 milisekund na GPU, co oznacza przyspieszenie o 60% i 59% odpowiednio.

Wyniki biznesowe

Wysiłki związane z migracją skupiały się na zwiększeniu dostępności, skalowalności i elastyczności, co łącznie doprowadziło środowisko uczenia maszynowego na nowy poziom doskonałości operacyjnej, czego przykładem jest zwiększona częstotliwość uczenia modeli i zmniejszenie liczby awarii, zoptymalizowane czasy szkolenia i zaawansowane możliwości uczenia maszynowego.

Częstotliwość uczenia modelu i niepowodzenia

Liczba miesięcznych zadań szkoleniowych dotyczących modeli wzrosła pięciokrotnie, co doprowadziło do znacznie częstszych optymalizacji modeli. Co więcej, nowe środowisko uczenia maszynowego doprowadziło do zmniejszenia wskaźnika awaryjności przebiegów rurociągów, spadając z około 50% do 20%. Czas przetwarzania nieudanego zadania drastycznie spadł, ze średnio ponad godziny do znikomych 5 sekund. Znacząco zwiększyło to efektywność operacyjną i zmniejszyło marnotrawstwo zasobów.

Zoptymalizowany czas treningu

Migracja przyniosła ze sobą wzrost wydajności dzięki szkoleniu GPU w oparciu o SageMaker. Ta zmiana skróciła czas szkolenia modelu do jednej piątej poprzedniego czasu trwania. Wcześniej procesy uczenia modeli głębokiego uczenia zużywały około 60 godzin na procesorze; zostało to skrócone do około 12 godzin na GPU. To ulepszenie nie tylko oszczędza czas, ale także przyspiesza cykl rozwoju, umożliwiając szybsze iteracje i ulepszenia modelu.

Zaawansowane możliwości uczenia maszynowego

Kluczem do powodzenia migracji jest wykorzystanie zestawu funkcji SageMaker, obejmującego dostrajanie hiperparametrów i wyjaśnianie modelu. Ponadto migracja umożliwiła bezproblemowe śledzenie eksperymentów za pomocą Eksperymenty Amazon SageMaker, umożliwiając bardziej wnikliwe i produktywne eksperymentowanie.

Co najważniejsze, nowe środowisko eksperymentalne ML pomogło w pomyślnym opracowaniu nowego modelu, który jest obecnie w fazie produkcyjnej. Model ten opiera się na uczeniu głębokim, a nie na drzewach i wprowadził zauważalną poprawę wydajności modelu online.

Wnioski

W tym poście omówiono współpracę AWS Professional Services i Booking.com, która zaowocowała wdrożeniem skalowalnego frameworka ML i pomyślnym skróceniem czasu wprowadzania na rynek modeli ML przez zespół ds. rankingu.

Zespół ds. rankingu na Booking.com przekonał się, że migracja do chmury i SageMaker okazała się korzystna, a dostosowanie praktyk operacji uczenia maszynowego (MLops) pozwala inżynierom i naukowcom zajmującym się ML skupić się na swoim rzemiośle i zwiększyć prędkość rozwoju. Zespół dzieli się zdobytą wiedzą i pracą wykonaną z całą społecznością ML na Booking.com poprzez rozmowy i dedykowane sesje z praktykami ML, podczas których dzielą się kodem i możliwościami. Mamy nadzieję, że ten post będzie kolejnym sposobem dzielenia się wiedzą.

Usługi AWS Professional Services są gotowe pomóc Twojemu zespołowi w opracowaniu skalowalnego i gotowego do produkcji systemu ML w AWS. Aby uzyskać więcej informacji, zobacz Usługi profesjonalne AWS lub skontaktuj się z menedżerem konta, aby się z nim skontaktować.

O autorach

Laurensa van der Maasa jest inżynierem uczenia maszynowego w AWS Professional Services. Ściśle współpracuje z klientami budującymi rozwiązania do uczenia maszynowego na AWS, specjalizuje się w szkoleniach rozproszonych, eksperymentowaniu i odpowiedzialnej sztucznej inteligencji, a także pasjonuje się tym, jak uczenie maszynowe zmienia świat, jaki znamy.

Laurensa van der Maasa jest inżynierem uczenia maszynowego w AWS Professional Services. Ściśle współpracuje z klientami budującymi rozwiązania do uczenia maszynowego na AWS, specjalizuje się w szkoleniach rozproszonych, eksperymentowaniu i odpowiedzialnej sztucznej inteligencji, a także pasjonuje się tym, jak uczenie maszynowe zmienia świat, jaki znamy.

Daniel Zagyva jest analitykiem danych w AWS Professional Services. Specjalizuje się w tworzeniu skalowalnych rozwiązań uczenia maszynowego klasy produkcyjnej dla klientów AWS. Jego doświadczenie obejmuje różne obszary, w tym przetwarzanie języka naturalnego, generatywną sztuczną inteligencję i operacje uczenia maszynowego.

Daniel Zagyva jest analitykiem danych w AWS Professional Services. Specjalizuje się w tworzeniu skalowalnych rozwiązań uczenia maszynowego klasy produkcyjnej dla klientów AWS. Jego doświadczenie obejmuje różne obszary, w tym przetwarzanie języka naturalnego, generatywną sztuczną inteligencję i operacje uczenia maszynowego.

Kostia Kofman to starszy menedżer ds. uczenia maszynowego w Booking.com, kierujący zespołem ds. rankingu wyszukiwania ML i nadzorujący najbardziej rozbudowany system ML w Booking.com. Dzięki doświadczeniu w personalizacji i rankingach wykorzystuje najnowocześniejsze technologie w celu poprawy jakości obsługi klientów.

Kostia Kofman to starszy menedżer ds. uczenia maszynowego w Booking.com, kierujący zespołem ds. rankingu wyszukiwania ML i nadzorujący najbardziej rozbudowany system ML w Booking.com. Dzięki doświadczeniu w personalizacji i rankingach wykorzystuje najnowocześniejsze technologie w celu poprawy jakości obsługi klientów.

Jenny Tokar jest starszym inżynierem zajmującym się uczeniem maszynowym w zespole ds. rankingu wyszukiwania Booking.com. Specjalizuje się w opracowywaniu kompleksowych potoków ML charakteryzujących się wydajnością, niezawodnością, skalowalnością i innowacyjnością. Doświadczenie Jenny umożliwia jej zespołowi tworzenie najnowocześniejszych modeli rankingowych, które codziennie służą milionom użytkowników.

Jenny Tokar jest starszym inżynierem zajmującym się uczeniem maszynowym w zespole ds. rankingu wyszukiwania Booking.com. Specjalizuje się w opracowywaniu kompleksowych potoków ML charakteryzujących się wydajnością, niezawodnością, skalowalnością i innowacyjnością. Doświadczenie Jenny umożliwia jej zespołowi tworzenie najnowocześniejszych modeli rankingowych, które codziennie służą milionom użytkowników.

Aleksandra Dokić jest starszym analitykiem danych w AWS Professional Services. Lubi wspierać klientów w budowaniu innowacyjnych rozwiązań AI/ML na AWS i ekscytują ją transformacje biznesowe dzięki sile danych.

Aleksandra Dokić jest starszym analitykiem danych w AWS Professional Services. Lubi wspierać klientów w budowaniu innowacyjnych rozwiązań AI/ML na AWS i ekscytują ją transformacje biznesowe dzięki sile danych.

Luba Protsiva jest menedżerem ds. zaangażowania w AWS Professional Services. Specjalizuje się w dostarczaniu rozwiązań Data i GenAI/ML, które umożliwiają klientom AWS maksymalizację wartości biznesowej i przyspieszenie tempa innowacji.

Luba Protsiva jest menedżerem ds. zaangażowania w AWS Professional Services. Specjalizuje się w dostarczaniu rozwiązań Data i GenAI/ML, które umożliwiają klientom AWS maksymalizację wartości biznesowej i przyspieszenie tempa innowacji.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- zdolność

- Zdolny

- O nas

- przyśpieszyć

- dostęp

- Stosownie

- Konto

- osiągnięty

- w poprzek

- zajęcia

- Dzieje Apostolskie

- adaptacja

- dodatek

- do tego

- zaawansowany

- oddziaływać

- Po

- AI

- AI / ML

- Algorytmy

- Wszystkie kategorie

- dozwolony

- pozwala

- wzdłuż

- również

- zawsze

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- ilość

- kwoty

- an

- analizuje

- i

- Inne

- Pszczoła

- podejście

- właściwy

- zatwierdzony

- w przybliżeniu

- arbitralny

- SĄ

- obszary

- powstać

- na około

- AS

- dążenie

- At

- automatycznie

- automatycznie

- dostępność

- dostępny

- średni

- AWS

- Usługi profesjonalne AWS

- z powrotem

- na podstawie

- Bayesian

- BE

- bo

- staje

- zachowanie

- behawioralne

- zachowania

- korzystny

- korzystne

- BEST

- pomiędzy

- stronniczość

- Rezerwacja

- Booking.com

- obie

- wąskie gardła

- Przynosi

- przyniósł

- budować

- Budowanie

- biznes

- ale

- by

- CAN

- możliwości

- walizka

- Etui

- Centrum

- wyśrodkowany

- wyzwania

- wyzwanie

- zmiana

- Zmiany

- wymiana pieniędzy

- charakteryzuje

- Dodaj

- wybrany

- klient

- dokładnie

- Chmura

- kod

- Kodowanie

- współpracował

- współpraca

- zbiorowo

- COM

- połączenie

- kombinacje

- kombajny

- powszechnie

- społeczność

- zgodność

- zgodny

- kompleks

- kompleksowość

- skomplikowane

- składniki

- obliczeniowy

- moc obliczeniowa

- obliczać

- warunek

- systemu

- Rozważać

- składa się

- Ograniczenia

- spożywane

- konsumpcja

- zawierać

- zawiera

- kontrola

- skorygowania

- Odpowiedni

- Koszty:

- mógłby

- rzemiosło

- Stwórz

- tworzenie

- istotny

- zwyczaj

- klient

- Klientów

- konfigurowalny

- pionierski nowatorski

- najnowocześniejsza technologia

- cykl

- dane

- Przygotowywanie danych

- naukowiec danych

- zbiory danych

- dzień

- Dni

- zdecydować

- decyzja

- Decyzje

- zmniejszony

- dedykowane

- uważane

- głęboko

- głęboka nauka

- określić

- zdefiniowane

- definicja

- opóźnienie

- opóźnienia

- dostarczyć

- dostarczanie

- sięgać

- zależność

- Zależność

- rozwijać

- wdrażane

- przestarzałe

- zaprojektowany

- detale

- Ustalać

- rozwijać

- rozwinięty

- rozwijanie

- oprogramowania

- schemat

- różne

- bezpośrednio

- odkryj

- wystawiany

- odrębny

- dystrybuowane

- szkolenia rozproszone

- podzielony

- robi

- domeny

- zrobić

- drastycznie

- Rzut

- czas trwania

- podczas

- dynamicznie

- każdy

- z łatwością

- efektywność

- skutecznie

- starania

- zaokrętowany

- upoważnia

- umożliwiać

- włączony

- Umożliwia

- umożliwiając

- obejmujący

- koniec końców

- zaręczynowy

- inżynier

- Inżynieria

- Inżynierowie

- wzmacniać

- wzmocnienie

- zapewnienie

- Cały

- Środowisko

- epoki

- niezbędny

- oceniać

- ewaluację

- Parzyste

- Każdy

- codziennie

- przykład

- Doskonałość

- podniecony

- na przykładzie

- Przede wszystkim system został opracowany

- oczekiwać

- przyspiesza

- doświadczenie

- Doświadczenia

- eksperyment

- eksperymenty

- ekspertyza

- Wyjaśniać

- odkryj

- Exploring

- rozsuwalny

- rozciąga się

- rozbudowa

- rozległy

- Twarz

- w obliczu

- Czynniki

- Failed

- Brak

- Awarie

- fałszywy

- szybciej

- faworyzować

- wykonalny

- Cecha

- Korzyści

- informacja zwrotna

- mniej

- filet

- Akta

- finał

- W końcu

- Znajdź

- i terminów, a

- pierwszy raz

- Elastyczność

- Skupiać

- następujący

- W razie zamówieenia projektu

- cztery

- Framework

- Częstotliwość

- częsty

- od

- dalej

- Ponadto

- zyskuje

- Generować

- wygenerowane

- generuje

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- git

- Globalne

- cel

- GPU

- GPU

- większy

- zgadnąć

- miał

- uchwyt

- sprzęt komputerowy

- uzbrojony

- Have

- he

- pomoc

- pomógł

- pomaga

- jej

- jego

- nadzieję

- godzina

- GODZINY

- W jaki sposób

- How To

- Jednak

- HTML

- http

- HTTPS

- Setki

- przeszkoda

- Optymalizacja hiperparametrów

- Dostrajanie hiperparametrów

- zidentyfikować

- if

- ilustruje

- zdjęcia

- Natychmiastowy

- Rezultat

- realizacja

- co ważne

- podnieść

- ulepszony

- poprawa

- ulepszenia

- poprawia

- in

- zawierać

- Włącznie z

- Zwiększać

- wzrosła

- Zwiększenia

- coraz bardziej

- niezależnie

- przemysł

- nieefektywności

- wpływ

- Informacja

- poinformowany

- Infrastruktura

- zapoczątkowany

- wprowadzać innowacje

- Innowacja

- Innowacyjny

- wkład

- Wejścia

- wewnątrz

- wnikliwy

- spostrzeżenia

- natychmiastowy

- zintegrowany

- Integruje się

- odsetki

- wewnętrzny

- najnowszych

- wprowadzono

- wprowadzenie

- zaangażowany

- problemy

- IT

- iteracja

- iteracje

- JEGO

- Praca

- Oferty pracy

- podróż

- jpg

- Klawisz

- Wiedzieć

- wiedza

- znany

- brak

- język

- duży

- firmy

- uruchomić

- uruchomiona

- uruchamia

- lider

- prowadzący

- UCZYĆ SIĘ

- dowiedziałem

- nauka

- Doprowadziło

- poziom

- lewarowanie

- lubić

- Ograniczony

- powiązany

- załadować

- miejscowy

- długo

- Popatrz

- wygląda jak

- maszyna

- uczenie maszynowe

- maszyny

- zrobiony

- robić

- zarządzane

- kierownik

- sposób

- ręcznie

- Maksymalizuj

- oznaczać

- Pamięć

- metoda

- metryczny

- Metryka

- migracja

- migracja

- miliony

- milisekund

- minimalny

- minut

- ML

- MLOps

- model

- modele

- zmodernizować

- Moduły

- monitor

- miesięcznie

- jeszcze

- większość

- ruch

- przeniósł

- dużo

- wielokrotność

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Natura

- Potrzebować

- Nowości

- Następny

- Nie

- już dziś

- numer

- cel

- obserwować

- Przeszkody

- of

- nieaktywny

- często

- on

- Na żądanie

- ONE

- Online

- tylko

- operacyjny

- operacje

- Optymalny

- optymalizacja

- optymalizacje

- Optymalizacja

- zoptymalizowane

- optymalizacji

- Opcje

- or

- Inne

- Inaczej

- ludzkiej,

- na zewnątrz

- wydajność

- Wyjścia

- koniec

- ogólny

- nadzorowanie

- przegląd

- własny

- Pokój

- pakiet

- pakowane

- Parallel

- parametr

- część

- namiętny

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- personalizacja

- rurociąg

- kluczowy

- plato

- Analiza danych Platona

- PlatoDane

- odgrywa

- wtyczki

- punkt

- Portal

- pozytywny

- Post

- power

- praktyki

- poprzedzający

- przewidzieć

- przepowiednia

- Przewidywania

- przygotowanie

- poprzedni

- poprzednio

- Problem

- wygląda tak

- Obrobiony

- procesów

- przetwarzanie

- Produkcja

- produktywny

- profesjonalny

- Profil

- Profilowanie

- Postęp

- projekt

- obiecujący

- okazały

- zapewniać

- pod warunkiem,

- że

- jakość

- szybko

- zakresy

- Ranking

- szybko

- Kurs

- raczej

- Surowy

- dosięgnąć

- gotowy

- otrzymać

- rozpoznawanie

- Rekomendacja

- nagrany

- zmniejszyć

- Zredukowany

- redukcja

- redukcja

- w sprawie

- region

- zarejestrować

- zarejestrowany

- rejestr

- regularnie

- Odrzucony..

- niezawodność

- raport

- Raporty

- składnica

- reprezentowanie

- wymagać

- wymagany

- Wymaga

- rozwiązać

- Zasób

- Zasoby

- odpowiednio

- odpowiedzialny

- dalsze

- wynikły

- Efekt

- Rosnąć

- krzepki

- Rola

- run

- bieganie

- działa

- sagemaker

- Rurociągi SageMaker

- Skalowalność

- skalowalny

- Skala

- nauka

- Naukowiec

- Naukowcy

- scenariusz

- bezszwowy

- Szukaj

- druga

- sekund

- widzieć

- poszukuje

- wybierać

- wybierając

- wybór

- senior

- służyć

- służy

- Usługi

- Sesje

- zestaw

- Zestawy

- w panelu ustawień

- kilka

- Share

- dzielenie

- ona

- przesunięcie

- powinien

- pokazać

- Targi

- znacznie

- Prosty

- pojedynczy

- trochę inny

- mądrzejszy

- gładki

- So

- rozwiązanie

- Rozwiązania

- coś

- Typ przestrzeni

- Iskra

- specjalizuje się

- specyficzny

- prędkość

- spędził

- Ewolucja krok po kroku

- Cel

- zatrzymanie

- przechowywanie

- przechowywany

- strategie

- usprawniony

- strongly

- zbudowany

- studio

- nieoptymalny

- sukces

- udany

- Z powodzeniem

- taki

- Utrzymany

- Wspierający

- podpory

- synchronizacja

- system

- dostosowane

- biorąc

- Rozmowy

- zadania

- zespół

- Zespoły

- Technologia

- tensorflow

- test

- przetestowany

- Testowanie

- niż

- że

- Połączenia

- świat

- ich

- Im

- następnie

- Tam.

- a tym samym

- w związku z tym

- Te

- one

- to

- tych

- kwitnie

- Przez

- czas

- terminy

- czasy

- do

- narzędzia

- Kontakt

- w kierunku

- śledzić

- Śledzenie

- Pociąg

- Trening

- szkolenia

- przenieść

- przemiany

- przejście

- podróżować

- branża turystyczna

- podróżnych

- leczenia

- prawdziwy

- próbować

- strojenie

- SKRĘCAĆ

- drugiej

- rodzaj

- Ostatecznie

- zrozumieć

- wyjątkowy

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- łatwy w obsłudze

- Użytkownicy

- zastosowania

- za pomocą

- wykorzystany

- Cenny

- wartość

- Wartości

- różnorodny

- Naprawiono

- Prędkość

- wersja

- Wersje

- początku.

- wyobrażanie sobie

- czekać

- poszukiwany

- była

- Droga..

- sposoby

- we

- sieć

- usługi internetowe

- były

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- KIM

- będzie

- w

- w ciągu

- bez

- Praca

- workflow

- działa

- świat

- na calym swiecie

- by

- You

- Twój

- zefirnet