Amazon SageMaker JumpStart to centrum uczenia maszynowego (ML) w SageMaker, oferujące wstępnie wytrenowane, publicznie dostępne modele dla szerokiego zakresu typów problemów, które pomogą Ci rozpocząć naukę uczenia maszynowego.

Zrozumienie zachowań klientów jest dziś najważniejsze dla każdej firmy. Uzyskanie wglądu w to, dlaczego i jak klienci kupują, może pomóc w zwiększeniu przychodów. Odpływ klientów to problem, z którym boryka się wiele firm, od telekomunikacyjnych po bankowe, gdzie klienci zazwyczaj tracą klientów na rzecz konkurencji. W najlepszym interesie firmy leży zatrzymanie obecnych klientów zamiast pozyskiwania nowych, ponieważ pozyskanie nowych klientów zwykle kosztuje znacznie więcej. Próbując zatrzymać klientów, firmy często koncentrują swoje wysiłki na klientach, którzy są bardziej skłonni do odejścia. Zachowania użytkowników i dzienniki czatów obsługi klienta mogą zawierać cenne wskaźniki dotyczące prawdopodobieństwa zakończenia usługi przez klienta. W tym rozwiązaniu szkolimy i wdrażamy model przewidywania rezygnacji, który wykorzystuje najnowocześniejszy model przetwarzania języka naturalnego (NLP) w celu znajdowania użytecznych sygnałów w tekście. Oprócz danych tekstowych model ten wykorzystuje tradycyjne dane strukturalne, takie jak pola liczbowe i jakościowe.

Multimodalność to multidyscyplinarna dziedzina badań, która zajmuje się niektórymi z pierwotnych celów sztucznej inteligencji poprzez integrację i modelowanie wielu modalności. Ten post ma na celu zbudowanie modelu, który może przetwarzać i wiązać informacje z wielu modalności, takich jak funkcje tabelaryczne i tekstowe.

Pokażemy Ci, jak trenować, wdrażać i używać modelu przewidywania rezygnacji, który przetwarza funkcje liczbowe, jakościowe i tekstowe w celu wykonania prognozy. Chociaż w tym poście zagłębimy się w przypadek użycia przewidywania rezygnacji, możesz użyć tego rozwiązania jako szablonu do uogólnienia dostrajania wstępnie wytrenowanych modeli z własnym zestawem danych, a następnie uruchomić optymalizację hiperparametrów (HPO) w celu zwiększenia dokładności. Możesz nawet zastąpić przykładowy zestaw danych własnym i uruchomić go od początku do końca, aby rozwiązać własne przypadki użycia. Rozwiązanie opisane w poście jest dostępne na GitHub.

Szablony rozwiązań JumpStart

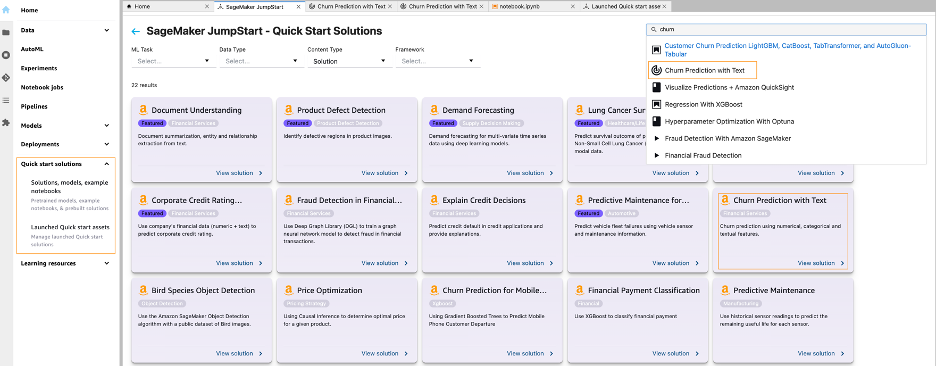

Amazon SageMaker JumpStart zapewnia kompleksowe rozwiązania jednym kliknięciem dla wielu typowych przypadków użycia uczenia maszynowego. Zapoznaj się z poniższymi przypadkami użycia, aby uzyskać więcej informacji na temat dostępnych szablonów rozwiązań:

Szablony rozwiązania JumpStart obejmują różne przypadki użycia, z których każdy oferuje kilka różnych szablonów rozwiązań (to rozwiązanie Document Understanding znajduje się w przypadku użycia „Wyodrębnianie i analizowanie danych z dokumentów”).

Wybierz szablon rozwiązania, który najlepiej pasuje do Twojego przypadku użycia ze strony docelowej JumpStart. Aby uzyskać więcej informacji na temat konkretnych rozwiązań w każdym przypadku użycia oraz sposobu uruchamiania rozwiązania JumpStart, zobacz Szablony rozwiązań.

Omówienie rozwiązania

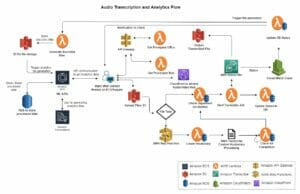

Na poniższym rysunku pokazano, jak można użyć tego rozwiązania z Amazon Sage Maker składniki. Zadania szkoleniowe SageMaker są używane do uczenia różnych modeli NLP, a punkty końcowe SageMaker są używane do wdrażania modeli na każdym etapie. Używamy Usługa Amazon Simple Storage (Amazon S3) wraz z SageMaker do przechowywania danych treningowych i artefaktów modeli oraz Amazon Cloud Watch do rejestrowania wyników szkolenia i punktów końcowych.

Podchodzimy do rozwiązania problemu przewidywania rezygnacji, wykonując następujące kroki:

- Eksploracja danych w celu przygotowania danych do ML ready.

- Wytrenuj model multimodalny z a Transformator zdań do przytulania twarzy i Scikit-learn losowy klasyfikator lasu.

- Dalsza poprawa wydajności modelu za pomocą HPO Automatyczne dostrajanie modelu SageMaker.

- Trenuj dwa Modele multimodalne AutoGluon: multimodalny ważony/skumulowany model zespołowy AutoGluon i multimodalny model fuzji AutoGluon.

- Oceń i porównaj wydajność modelu na danych testowych wstrzymania.

Wymagania wstępne

Aby wypróbować rozwiązanie na własnym koncie upewnij się, że masz na miejscu:

- Konto AWS. Jeśli nie masz konta, możesz zarejestruj się na jeden.

- Rozwiązanie opisane w poście jest częścią SageMaker JumpStart. Aby uruchomić to rozwiązanie JumpStart i wdrożyć infrastrukturę na swoim koncie AWS, musisz utworzyć plik active Studio Amazon SageMaker instancja (patrz Na pokładzie do Amazon SageMaker Studio). Gdy instancja Studio będzie gotowa, skorzystaj z instrukcji w JumpStart, aby uruchomić rozwiązanie.

- Podczas uruchamiania tego notatnik w Studio, upewnij się, że Python 3 (PyTorch 1.10 Python 3.8 zoptymalizowany pod kątem procesora) używany jest obraz/jądro.

Możesz zainstalować wymagane pakiety zgodnie z opisem w rozwiązaniu, aby uruchomić ten notatnik:

Otwórz przypadek użycia przewidywania odejścia

W konsoli Studio wybierz Rozwiązania, modele, przykładowe notebooki dla Szybkie rozwiązania w okienku nawigacji. Przejdź do Przewidywanie rezygnacji z tekstem rozwiązanie w JumpStart.

Teraz możemy przyjrzeć się bliżej niektórym zasobom zawartym w tym rozwiązaniu.

Eksploracja danych

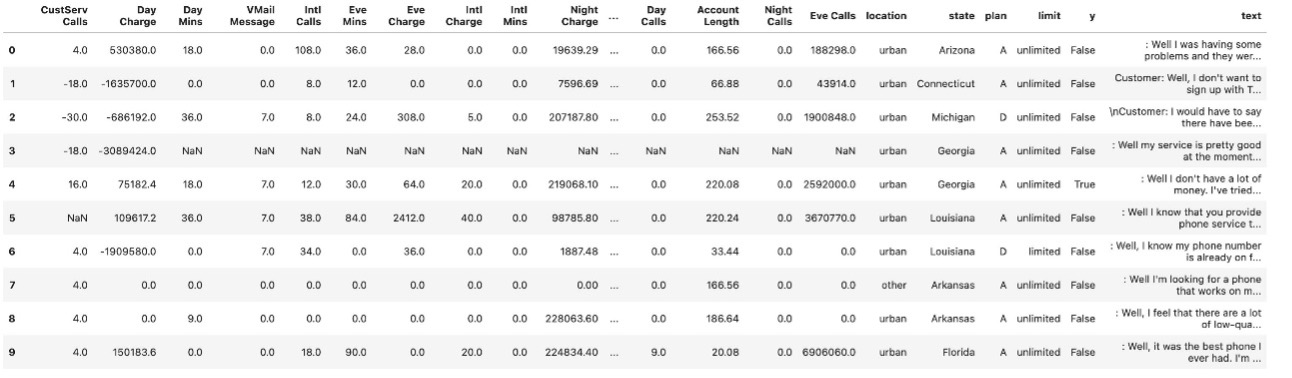

Najpierw pobierzmy zestaw danych testowych, zweryfikujmy i wytrenujmy ze źródłowego zasobnika S3 i prześlijmy go do naszego zasobnika S3. Poniższy zrzut ekranu pokazuje nam 10 obserwacji danych treningowych.

Rozpocznijmy eksplorację zestawu danych pociągu i sprawdzania poprawności.

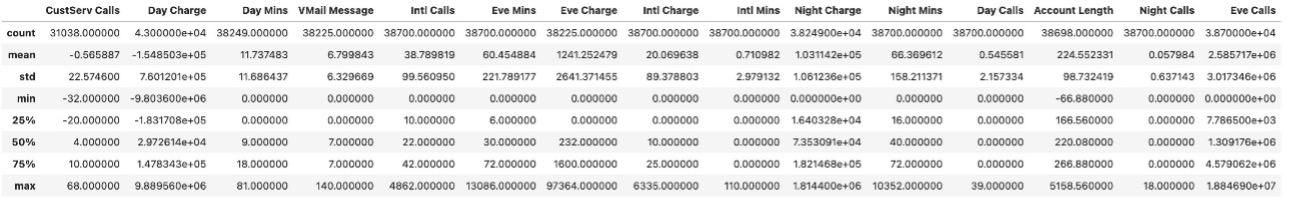

Jak widać, mamy różne funkcje, takie jak CustServ Calls, Day Charge, Day Calls którego używamy do przewidywania kolumny docelowej y (czy klient zrezygnował z usługi).

y jest znany jako atrybut docelowy: atrybut, który ma przewidywać model ML. Ponieważ atrybut target jest binarny, nasz model wykonuje predykcję binarną, znaną również jako klasyfikacja binarna.

Istnieje 21 funkcji, w tym zmienna docelowa. Liczba przykładów danych uczących i walidacyjnych wynosi odpowiednio 43,000 5,000 i XNUMX XNUMX.

Poniższy zrzut ekranu przedstawia podsumowanie statystyk zestawu danych szkoleniowych.

Zbadaliśmy zestaw danych i podzieliliśmy go na zestawy szkoleniowe, sprawdzające walidację i testowe. Zestaw uczący i sprawdzający służy do szkolenia i HPO. Zestaw testowy jest używany jako zestaw wstrzymania do oceny wydajności modelu. Teraz przeprowadzamy etapy inżynierii funkcji, a następnie dopasowujemy model.

Dopasuj multimodalny model za pomocą transformatora zdań Hugging Face i losowego klasyfikatora lasu Scikit-learn

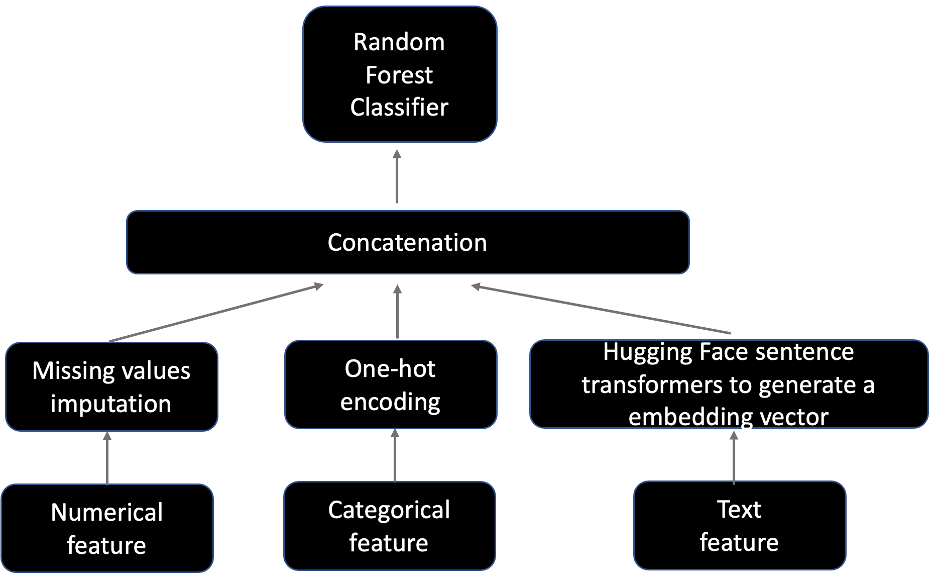

Trening modelu składa się z dwóch komponentów: etapu inżynierii cech, który przetwarza cechy numeryczne, kategoryczne i tekstowe, oraz kroku dopasowania modelu, który dopasowuje przekształcone cechy do Scikit-learn losowy klasyfikator lasu.

W przypadku inżynierii funkcji wykonujemy następujące kroki:

- Uzupełnij brakujące wartości dla cech liczbowych.

- Zakoduj cechy kategoryczne w jednoznaczne wartości, gdzie brakujące wartości są liczone jako jedna z kategorii dla każdej cechy.

- Użyj Transformator zdań do przytulania twarzy do zakodowania funkcji tekstowej w celu wygenerowania gęstego wektora X-wymiarowego, w którym wartość X zależy od konkretnego transformatora zdań.

Wybieramy trzy najczęściej pobierane modele transformatorów zdań i wykorzystujemy je w poniższym dopasowaniu modelu i HPO. Konkretnie używamy all-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1, parafraza-MiniLM-L6-v2. Aby zapoznać się z hiperparametrami losowego klasyfikatora lasu, zobacz GitHub repo.

Poniższy rysunek przedstawia diagram architektury modelu.

Istnieje wiele hiperparametrów, które można dostosować, takich jak n-estymatory, maksymalna głębokość i bootstrap. Aby uzyskać więcej informacji, zapoznaj się z GitHub repo.

W celach demonstracyjnych używamy tylko funkcji numerycznych CustServ Calls i Account Length, cechy kategoryczne plan, limiti funkcja tekstowa text aby dopasować się do modelu. Wiele funkcji należy oddzielić znakiem ,.

Wdrażamy model po zakończeniu szkolenia:

Dzwoniąc do naszego nowego punktu końcowego z notebooka, używamy pakietu SageMaker SDK Urządzenie prognozujące, ZA Predictor służy do wysyłania danych do punktu końcowego (w ramach żądania) i interpretacji odpowiedzi. JSON jest używany jako format zarówno danych wejściowych, jak i wyjściowych, ponieważ jest to standardowy format punktu końcowego, a odpowiedź punktu końcowego może zawierać zagnieżdżone struktury danych.

Po pomyślnym wdrożeniu naszego modelu i skonfigurowaniu predyktora możemy wypróbować model przewidywania rezygnacji na przykładowym wejściu:

Poniższy kod przedstawia odpowiedź (prawdopodobieństwo odejścia) z zapytania do punktu końcowego:

Należy zauważyć, że prawdopodobieństwo zwrócone przez ten model nie zostało skalibrowane. Kiedy model podaje prawdopodobieństwo odejścia na poziomie 20%, niekoniecznie oznacza to, że 20% klientów z prawdopodobieństwem 20% spowodowało odejście. Kalibracja jest przydatną właściwością w pewnych okolicznościach, ale nie jest wymagana w przypadkach, gdy wystarczające jest rozróżnienie przypadków rezygnacji i braku rezygnacji. Kalibrowany KlasyfikatorCV od Nauka scikitu może być używany do kalibracji modelu.

Teraz wysyłamy zapytanie do punktu końcowego, korzystając z danych testu wstrzymania, które składają się z 1,939 przykładów. Poniższa tabela podsumowuje wyniki oceny naszego multimodalnego modelu z transformatorem zdań Hugging Face i losowym klasyfikatorem lasów Scikit-learn.

| metryczny | BERT + losowy las |

| Dokładność | 0.77463 |

| AUC ROC | 0.75905 |

Wydajność modelu zależy od konfiguracji hiperparametrów. Wytrenowanie modelu z jednym zestawem konfiguracji hiperparametrów nie gwarantuje uzyskania optymalnego modelu. W rezultacie uruchamiamy proces HPO w następnej sekcji, aby jeszcze bardziej poprawić wydajność modelu.

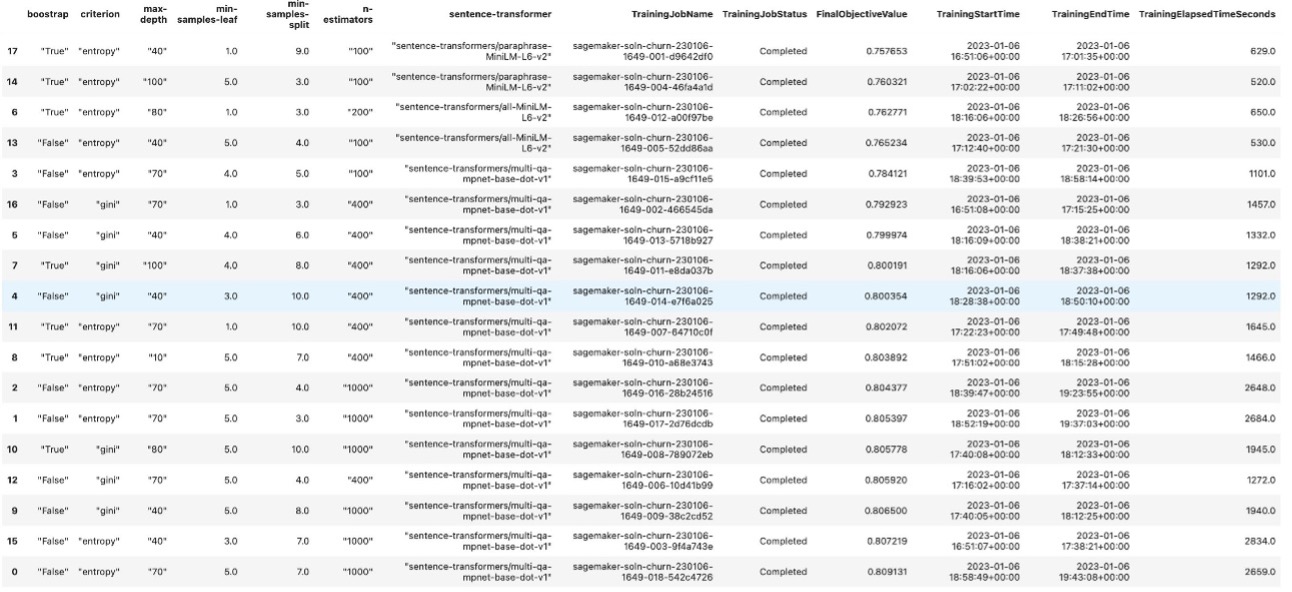

Dopasuj model multimodalny z HPO

W tej sekcji dalej poprawiamy wydajność modelu, dodając strojenie HPO za pomocą Automatyczne dostrajanie modelu SageMaker. Automatyczne dostrajanie modelu SageMaker, znane również jako dostrajanie hiperparametrów, znajduje najlepszą wersję modelu, uruchamiając wiele zadań szkoleniowych na zbiorze danych przy użyciu algorytmu i zakresów hiperparametrów określonych przez użytkownika. Następnie wybiera wartości hiperparametrów, które dają model, który działa najlepiej, mierząc wybraną metryką. Najlepszy model i odpowiadające mu hiperparametry są wybierane na podstawie danych walidacyjnych. Następnie najlepszy model jest oceniany na podstawie danych testu wstrzymania, czyli tych samych danych testowych, które utworzyliśmy w poprzedniej sekcji. Na koniec pokazujemy, że wydajność modelu wyszkolonego z HPO jest znacznie lepsza niż modelu wyszkolonego bez HPO.

Poniżej znajdują się hiperparametry statyczne, których nie dostrajamy, oraz hiperparametry dynamiczne, które chcemy dostroić, oraz ich zakresy wyszukiwania:

Definiujemy nazwę metryki celu, definicję metryki (z wzorcem wyrażenia regularnego) i typ celu dla zadania dostrajania.

Najpierw ustawiamy cel jako wynik dokładności danych walidacyjnych (roc auc score on validation data) i zdefiniowane metryki dla zadania dostrajania, określając nazwę metryki celu i wyrażenie regularne (regex). Wyrażenie regularne służy do dopasowania danych wyjściowych dziennika algorytmu i przechwytywania wartości liczbowych metryk.

Następnie określamy zakresy hiperparametrów, z których wybieramy najlepsze wartości hiperparametrów. Ustawiamy całkowitą liczbę zadań dostrajania na 10 i rozdzielamy te zadania na pięć różnych Elastyczna chmura obliczeniowa Amazon (Amazon EC2) do uruchamiania równoległych zadań dostrajania.

Na koniec przekazujemy te wartości, aby utworzyć instancję obiektu SageMaker Estimator, podobnie jak w poprzednim kroku szkoleniowym. Zamiast wywoływać funkcję dopasowania obiektu Estimator, przekazujemy obiekt Estimator jako parametr do HyperparametrTuner konstruktora i wywołaj jego funkcję dopasowania, aby uruchomić zadania dostrajania:

Po zakończeniu zadania dostrajania możemy wygenerować tabelę podsumowującą wszystkie zadania dostrajania.

Po zakończeniu zadań dostrajania wdrażamy model, który daje najlepszy wynik metryki oceny w zestawie danych do walidacji, przeprowadzamy wnioskowanie na tym samym zestawie danych testowych wstrzymania, które wykonaliśmy w poprzedniej sekcji, i obliczamy metryki oceny.

| metryczny | BERT + losowy las | BERT + losowy las z HPO |

| Dokładność | 0.77463 | 0.9278 |

| AUC ROC | 0.75905 | 0.79861 |

Widzimy, że uruchomienie HPO z automatycznym dostrajaniem modelu SageMaker znacznie poprawia wydajność modelu.

Oprócz HPO wydajność modelu zależy również od algorytmu. Ważne jest, aby wyszkolić wiele najnowocześniejszych algorytmów, porównać ich wydajność na tych samych danych testowych i wybrać optymalny. Dlatego w poniższych sekcjach szkolimy dwa kolejne multimodalne modele AutoGluon.

Dopasuj multimodalny ważony/skumulowany model zespołu AutoGluon

Istnieją dwa rodzaje multimodalności AutoGluon:

- Trenuj wiele modeli tabelarycznych, a także

TextPredictormodel (wykorzystując tzwTextPredictormodel wewnątrzTabularPredictor), a następnie połączyć je za pomocą zestawu ważonego lub zestawu skumulowanego, jak wyjaśniono w AutoGluon-Tabular: Solidny i dokładny AutoML dla danych strukturalnych - Bezpośrednie łączenie wielu modeli sieci neuronowych i obsługa surowego tekstu (które są również w stanie obsługiwać dodatkowe kolumny liczbowe i kategoryczne)

W tej sekcji najpierw szkolimy multimodalny ważony lub skumulowany model zespołowy, a w następnej sekcji szkolimy model sieci neuronowej fuzji.

Najpierw pobieramy obraz treningowy AutoGluon:

Następnie przekazujemy hiperparametry. W przeciwieństwie do istniejących frameworków AutoML, które koncentrują się głównie na wyborze modelu lub hiperparametru, AutoGluonTabular odnosi sukces, łącząc wiele modeli i układając je w wiele warstw. Dlatego HPO zwykle nie jest wymagane w przypadku modeli zespolonych AutoGluon.

Wreszcie tworzymy Estymator SageMakera i zadzwoń estimator.fit() rozpocząć pracę szkoleniową:

Po zakończeniu szkolenia pobieramy obraz wnioskowania AutoGluon i wdrażamy model:

Po wdrożeniu punktów końcowych wysyłamy zapytanie do punktu końcowego przy użyciu tego samego zestawu testów i obliczamy metryki oceny. W poniższej tabeli widzimy, że zespół multimodalny AutoGluon poprawia AUC ROC o około 3% w porównaniu z transformatorem zdań BERT i losowym lasem z HPO.

| metryczny | BERT + losowy las | BERT + losowy las z HPO | Multimodalny zespół AutoGluon |

| Dokładność | 0.77463 | 0.9278 | 0.92625 |

| AUC ROC | 0.75905 | 0.79861 | 0.82918 |

Dopasuj multimodalny model fuzji AutoGluon

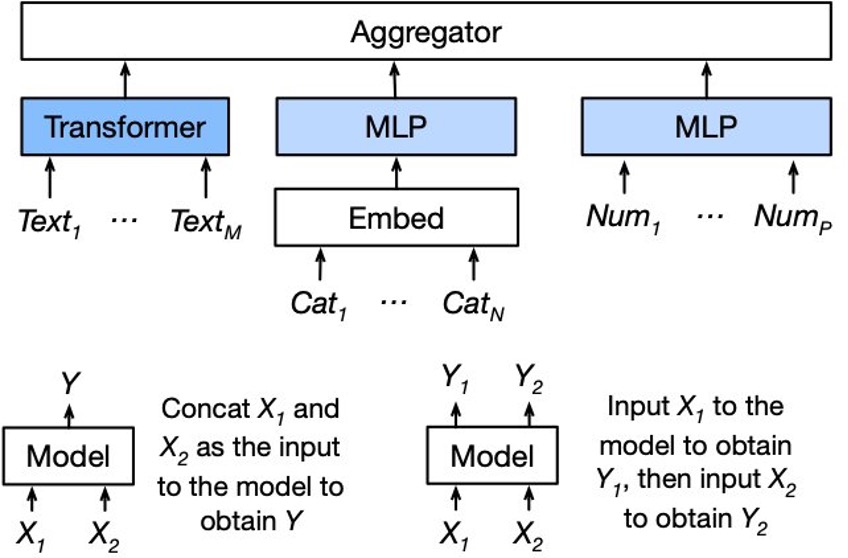

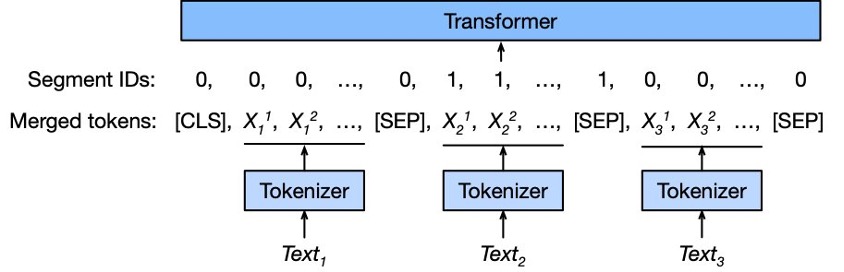

Poniższy diagram ilustruje architekturę modelu. Aby uzyskać szczegółowe informacje, zobacz AutoMM dla tekstu + tabelaryczne — Szybki start.

Wewnętrznie używamy różnych sieci do kodowania kolumn tekstowych, kolumn kategorii i kolumn numerycznych. Funkcje generowane przez poszczególne sieci są agregowane przez agregator późnej fuzji. Agregator może generować zarówno logi, jak i prognozy wyników.

Tutaj używamy wstępnie przeszkolonego szkieletu NLP do wyodrębnienia cech tekstowych, a następnie używamy dwóch innych wież do wyodrębnienia cechy z kolumny kategorialnej i kolumny liczbowej.

Ponadto, aby poradzić sobie z wieloma polami tekstowymi, oddzielamy te pola tokenem [SEP] i alternatywnymi zerami i jedynekami jako identyfikatorami segmentów, jak pokazano na poniższym diagramie.

Podobnie postępujemy zgodnie z instrukcjami z poprzedniej sekcji, aby trenować i wdrażać multimodalny model fuzji AutoGluon:

Poniższa tabela podsumowuje wyniki oceny multimodalnego modelu fuzji AutoGluon, wraz z wynikami trzech modeli, które oceniliśmy w poprzednich sekcjach. Widzimy, jak multimodalny zespół AutoGluon i multimodalne modele fuzji osiągają najlepszą wydajność.

| Metryka | BERT + losowy las | BERT + losowy las z HPO | Multimodalny zespół AutoGluon | Fuzja multimodalna AutoGluon |

| Dokładność | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| AUC ROC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Należy zauważyć, że wyniki i względna wydajność między tymi modelami zależą od zestawu danych używanego do szkolenia. Te wyniki są reprezentatywne i chociaż tendencja niektórych algorytmów do lepszej wydajności opiera się na odpowiednich czynnikach, równowaga wydajności może się zmienić, biorąc pod uwagę inną dystrybucję danych. Możesz zastąpić przykładowy zestaw danych własnymi danymi, aby określić, który model będzie dla Ciebie najlepszy.

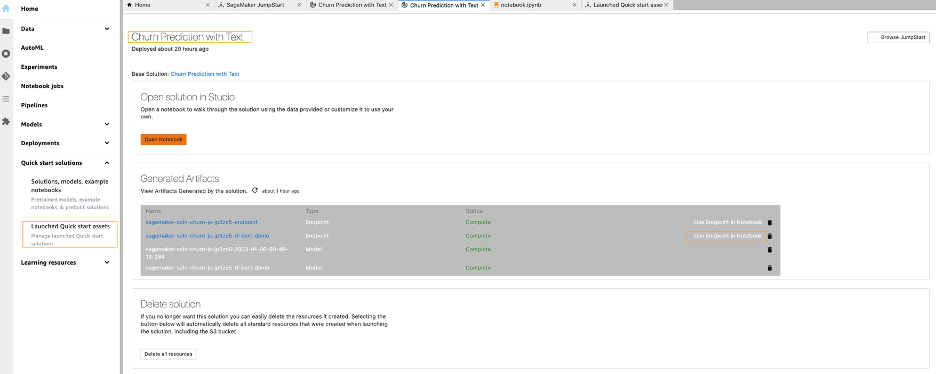

Notatnik demonstracyjny

Notesu demonstracyjnego można użyć do wysłania przykładowych danych do już wdrożonych punktów końcowych modelu. Notatnik demonstracyjny pozwala szybko zdobyć praktyczne doświadczenie, wykonując zapytania dotyczące przykładowych danych. Po uruchomieniu rozwiązania Churn Prediction with Text otwórz notatnik demonstracyjny, wybierając opcję Użyj punktu końcowego w Notatniku.

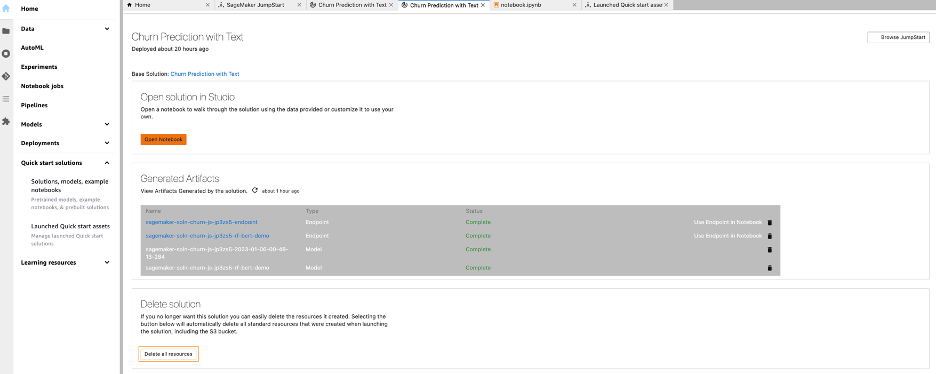

Sprzątać

Po zakończeniu korzystania z tego rozwiązania upewnij się, że usunąłeś wszystkie niechciane zasoby AWS, wybierając opcję Usuń wszystkie zasoby.

Pamiętaj, że musisz ręcznie usunąć wszelkie dodatkowe zasoby, które mogły zostać utworzone w tym notatniku.

Wnioski

W tym poście pokazaliśmy, jak można wykorzystać Sagemaker JumpStart do przewidywania rezygnacji przy użyciu multimodalności tekstu i funkcji tabelarycznych.

Jeśli chcesz dowiedzieć się więcej o modelach rezygnacji klientów, zapoznaj się z następującymi postami:

O autorach

Dr Xin Huang jest naukowcem w zakresie wbudowanych algorytmów Amazon SageMaker JumpStart i Amazon SageMaker. Koncentruje się na tworzeniu skalowalnych algorytmów uczenia maszynowego. Jego zainteresowania badawcze dotyczą przetwarzania języka naturalnego, wyjaśnialnego głębokiego uczenia się na danych tabelarycznych oraz solidnej analizy nieparametrycznego klastrowania przestrzenno-czasowego. Opublikował wiele artykułów na konferencjach ACL, ICDM, KDD oraz Royal Statistical Society: Series A.

Dr Xin Huang jest naukowcem w zakresie wbudowanych algorytmów Amazon SageMaker JumpStart i Amazon SageMaker. Koncentruje się na tworzeniu skalowalnych algorytmów uczenia maszynowego. Jego zainteresowania badawcze dotyczą przetwarzania języka naturalnego, wyjaśnialnego głębokiego uczenia się na danych tabelarycznych oraz solidnej analizy nieparametrycznego klastrowania przestrzenno-czasowego. Opublikował wiele artykułów na konferencjach ACL, ICDM, KDD oraz Royal Statistical Society: Series A.

Rajakumar Sampathkumar jest głównym kierownikiem ds. kont technicznych w AWS, udzielając klientom wskazówek dotyczących dostosowania technologii biznesowych i wspierających na nowo modele i procesy operacyjne w chmurze. Pasjonuje się chmurą i uczeniem maszynowym. Raj jest również specjalistą od uczenia maszynowego i współpracuje z klientami AWS przy projektowaniu, wdrażaniu i zarządzaniu ich obciążeniami i architekturami AWS.

Rajakumar Sampathkumar jest głównym kierownikiem ds. kont technicznych w AWS, udzielając klientom wskazówek dotyczących dostosowania technologii biznesowych i wspierających na nowo modele i procesy operacyjne w chmurze. Pasjonuje się chmurą i uczeniem maszynowym. Raj jest również specjalistą od uczenia maszynowego i współpracuje z klientami AWS przy projektowaniu, wdrażaniu i zarządzaniu ich obciążeniami i architekturami AWS.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- O nas

- Konto

- precyzja

- dokładny

- Osiągać

- nabywanie

- aktywny

- dodatek

- Dodatkowy

- Adresy

- Po

- Agent

- Agregator

- Cele

- algorytm

- Algorytmy

- Wszystkie kategorie

- pozwala

- wzdłuż

- Chociaż

- Amazonka

- Amazon EC2

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- analiza

- w czasie rzeczywistym sprawiają,

- i

- stosowany

- podejście

- architektura

- POWIERZCHNIA

- sztuczny

- sztuczna inteligencja

- Aktywa

- automatycznie

- AutoML

- dostępny

- AWS

- Kręgosłup

- Bilans

- Bankowość

- na podstawie

- bo

- BEST

- Ulepsz Swój

- pomiędzy

- Bootstrap

- budować

- wbudowany

- biznes

- kupować

- wezwanie

- powołanie

- Połączenia

- zdolny

- zdobyć

- nieść

- walizka

- Etui

- kategorie

- pewien

- szansa

- zmiana

- ZOBACZ

- Dodaj

- Wybierając

- okoliczności

- klasyfikacja

- bliższy

- Chmura

- klastrowanie

- kod

- Kolumna

- kolumny

- połączyć

- wspólny

- Firmy

- Firma

- porównać

- w porównaniu

- konkurenci

- kompletny

- składniki

- obliczać

- konferencje

- Konsola

- Pojemnik

- umowa

- umowy

- Odpowiedni

- Koszty:

- pokrywa

- Stwórz

- stworzony

- klient

- zachowanie klienta

- Obsługa klienta

- Obsługa klienta

- Klientów

- dane

- sprawa

- czynienia

- postanowiła

- głęboko

- głęboka nauka

- zależny

- zależy

- rozwijać

- wdrażane

- Wnętrze

- detale

- Ustalać

- rozwijanie

- ZROBIŁ

- różne

- bezpośrednio

- rozprowadzać

- 分配

- Doker

- dokument

- Nie

- nie

- pobieranie

- dynamiczny

- każdy

- starania

- bądź

- koniec końców

- Punkt końcowy

- Inżynieria

- oceniane

- ewaluację

- Parzyste

- przykład

- przykłady

- Przede wszystkim system został opracowany

- doświadczenie

- wyjaśnione

- eksploracja

- odkryj

- zbadane

- Exploring

- wyciąg

- niezwykle

- Twarz

- w obliczu

- Czynniki

- Cecha

- Korzyści

- pole

- Łąka

- Postać

- W końcu

- Znajdź

- znajduje

- i terminów, a

- dopasować

- dopasowywanie

- Skupiać

- koncentruje

- obserwuj

- następujący

- las

- format

- Ramy

- od

- funkcjonować

- dalej

- fuzja

- zyskuje

- Generować

- wygenerowane

- otrzymać

- dany

- daje

- Gluon

- Gole

- dobry

- Rosnąć

- gwarancja

- uchwyt

- Prowadzenie

- hands-on

- pomoc

- pomocny

- W jaki sposób

- How To

- HTML

- HTTPS

- Piasta

- Optymalizacja hiperparametrów

- Dostrajanie hiperparametrów

- zidentyfikować

- obraz

- importować

- ważny

- podnieść

- in

- włączony

- Włącznie z

- Zwiększać

- wskaźniki

- indywidualny

- Informacja

- Infrastruktura

- wkład

- spostrzeżenia

- zainstalować

- przykład

- zamiast

- instrukcje

- Integracja

- Inteligencja

- odsetki

- zainteresowany

- zainteresowania

- zaangażowany

- problemy

- IT

- Praca

- Oferty pracy

- dziennik

- json

- Klawisz

- Uprzejmy

- znany

- lądowanie

- język

- uruchomić

- nioski

- nauka

- Pozostawiać

- Długość

- Prawdopodobnie

- LIMIT

- Linia

- długo

- Popatrz

- maszyna

- uczenie maszynowe

- robić

- zarządzanie

- kierownik

- ręcznie

- wiele

- Mecz

- Maksymalizuj

- maksymalny

- metryczny

- Metryka

- może

- nic

- brakujący

- ML

- model

- modele

- Miesiąc

- miesięcy

- jeszcze

- większość

- multidyscyplinarny

- wielokrotność

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Nawigacja

- Nawigacja

- koniecznie

- Potrzebować

- sieć

- sieci

- sieci neuronowe

- Nowości

- Następny

- nlp

- notatnik

- numer

- przedmiot

- cel

- oferowany

- ONE

- koncepcja

- działanie

- Optymalny

- optymalizacja

- zoptymalizowane

- oryginalny

- Inne

- opisane

- własny

- Pakiety

- chleb

- Papiery

- Parallel

- parametr

- część

- szczególny

- namiętny

- Wzór

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- spektakle

- wykonuje

- telefon

- wybierać

- Miejsce

- krok po kroku

- plato

- Analiza danych Platona

- PlatoDane

- Post

- Wiadomości

- przewidzieć

- przepowiednia

- Przewidywania

- Urządzenie prognozujące

- Przygotować

- poprzedni

- głównie

- Główny

- Problem

- wygląda tak

- Obrobiony

- procesów

- przetwarzanie

- własność

- zapewnia

- że

- publicznie

- opublikowany

- cele

- Python

- płomień

- Szybki

- szybko

- przypadkowy

- zasięg

- Surowy

- RE

- gotowy

- regex

- regularny

- obsługi produkcji rolnej, która zastąpiła

- przedstawiciel

- zażądać

- wymagany

- Badania naukowe

- Zasoby

- odpowiedź

- czuły

- dalsze

- Efekt

- dochód

- krzepki

- królewski

- run

- bieganie

- sagemaker

- Automatyczne strojenie modeli SageMaker

- taki sam

- skalowalny

- Naukowiec

- nauka-scikit

- Sdk

- Szukaj

- poszukiwania

- Sekcja

- działy

- segment

- wybrany

- wybór

- wyrok

- Serie

- Seria A

- usługa

- zestaw

- Zestawy

- kilka

- powinien

- pokazać

- pokazane

- Targi

- Sygnały

- znacznie

- podobny

- Prosty

- So

- Społeczeństwo

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Rozwiązywanie

- kilka

- Źródło

- specjalista

- specyficzny

- swoiście

- dzielić

- sprint

- ułożone w stos

- układanie w stosy

- STAGE

- standard

- początek

- rozpoczęty

- state-of-the-art

- statystyczny

- statystyka

- Ewolucja krok po kroku

- Cel

- przechowywanie

- sklep

- zbudowany

- studio

- Następnie

- Z powodzeniem

- taki

- wystarczający

- PODSUMOWANIE

- wsparcie

- Wspierający

- stół

- Brać

- cel

- tech

- Techniczny

- telekomunikacja

- szablon

- Szablony

- REGULAMIN

- test

- Połączenia

- Strefa

- Źródło

- ich

- w związku z tym

- trzy

- do

- już dziś

- żeton

- Top

- Kwota produktów:

- tradycyjny

- Pociąg

- przeszkolony

- Trening

- przekształcony

- prawdziwy

- typy

- zazwyczaj

- dla

- zrozumienie

- nieograniczone

- niepożądany

- uaktualnienie

- us

- posługiwać się

- przypadek użycia

- Użytkownik

- zazwyczaj

- Wykorzystując

- UPRAWOMOCNIĆ

- uprawomocnienie

- Cenny

- wartość

- Wartości

- różnorodność

- różnorodny

- Ve

- Verizon

- wersja

- przez

- Co

- czy

- który

- KIM

- szeroki

- Szeroki zasięg

- będzie

- bez

- Praca

- działa

- by

- Źle

- X

- You

- Twój

- zefirnet