Agentes de modelo de linguagem grande (LLM) são programas que ampliam os recursos de LLMs independentes com 1) acesso a ferramentas externas (APIs, funções, webhooks, plug-ins e assim por diante) e 2) a capacidade de planejar e executar tarefas de forma independente moda dirigida. Freqüentemente, os LLMs precisam interagir com outros softwares, bancos de dados ou APIs para realizar tarefas complexas. Por exemplo, um chatbot administrativo que agenda reuniões exigiria acesso aos calendários e e-mail dos funcionários. Com acesso a ferramentas, os agentes LLM podem se tornar mais poderosos – ao custo de complexidade adicional.

Nesta postagem, apresentamos os agentes LLM e demonstramos como construir e implantar um agente LLM de comércio eletrônico usando JumpStart do Amazon SageMaker e AWS Lambda. O agente usará ferramentas para fornecer novos recursos, como responder perguntas sobre devoluções (“O meu retorno rtn001 processado?”) e fornecendo atualizações sobre pedidos (“Você poderia me dizer se o pedido 123456 foi enviado?”). Esses novos recursos exigem que os LLMs busquem dados de múltiplas fontes de dados (orders, returns) e realizar geração aumentada de recuperação (RAG).

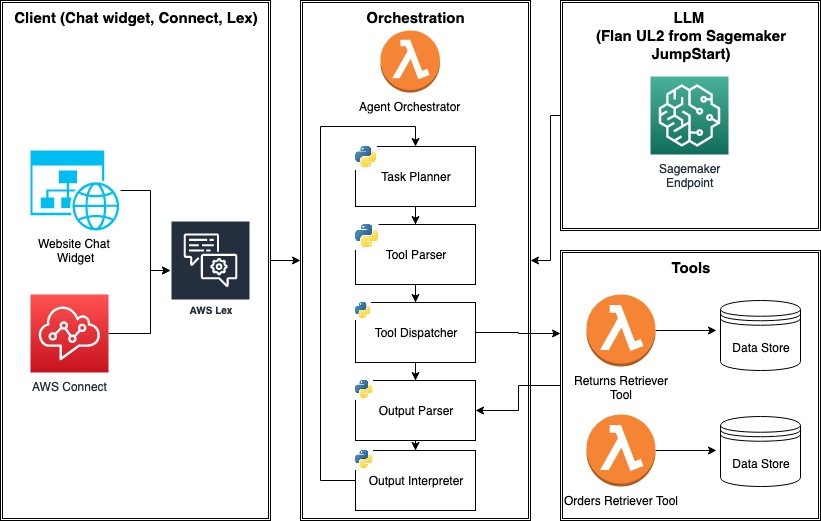

Para alimentar o agente LLM, usamos um Flan-UL2 modelo implantado como um Endpoint SageMaker e use ferramentas de recuperação de dados criadas com AWS Lambda. O agente pode posteriormente ser integrado com Amazon-Lex e usado como chatbot dentro de sites ou AWSConectar. Concluímos a postagem com itens a serem considerados antes de implantar agentes LLM em produção. Para uma experiência totalmente gerenciada na construção de agentes LLM, a AWS também fornece o agentes para o recurso Amazon Bedrock (em versão prévia).

Uma breve visão geral das arquiteturas de agentes LLM

Agentes LLM são programas que usam LLMs para decidir quando e como usar as ferramentas necessárias para concluir tarefas complexas. Com ferramentas e habilidades de planejamento de tarefas, os agentes LLM podem interagir com sistemas externos e superar as limitações tradicionais dos LLMs, como cortes de conhecimento, alucinações e cálculos imprecisos. As ferramentas podem assumir vários formatos, como chamadas de API, funções Python ou plug-ins baseados em webhook. Por exemplo, um LLM pode usar um “plugin de recuperação” para buscar contexto relevante e realizar RAG.

Então, o que significa para um LLM escolher ferramentas e planejar tarefas? Existem inúmeras abordagens (como Reagir, MRKL, Formador de ferramentas, AbraçosGPT e Agente Transformadors) ao uso de LLMs com ferramentas, e os avanços estão acontecendo rapidamente. Mas uma maneira simples é solicitar ao LLM uma lista de ferramentas e pedir-lhe que determine 1) se uma ferramenta é necessária para satisfazer a consulta do usuário e, em caso afirmativo, 2) selecione a ferramenta apropriada. Esse prompt normalmente se parece com o exemplo a seguir e pode incluir exemplos de poucas tentativas para melhorar a confiabilidade do LLM na escolha da ferramenta certa.

Abordagens mais complexas envolvem o uso de um LLM especializado que pode decodificar diretamente “chamadas de API” ou “uso de ferramenta”, como GorilaLLM. Esses LLMs ajustados são treinados em conjuntos de dados de especificação de API para reconhecer e prever chamadas de API com base em instruções. Freqüentemente, esses LLMs exigem alguns metadados sobre as ferramentas disponíveis (descrições, yaml ou esquema JSON para seus parâmetros de entrada) para gerar invocações de ferramentas. Esta abordagem é tomada por agentes da Amazon Bedrock e Chamadas de função OpenAI. Observe que os LLMs geralmente precisam ser suficientemente grandes e complexos para mostrar capacidade de seleção de ferramentas.

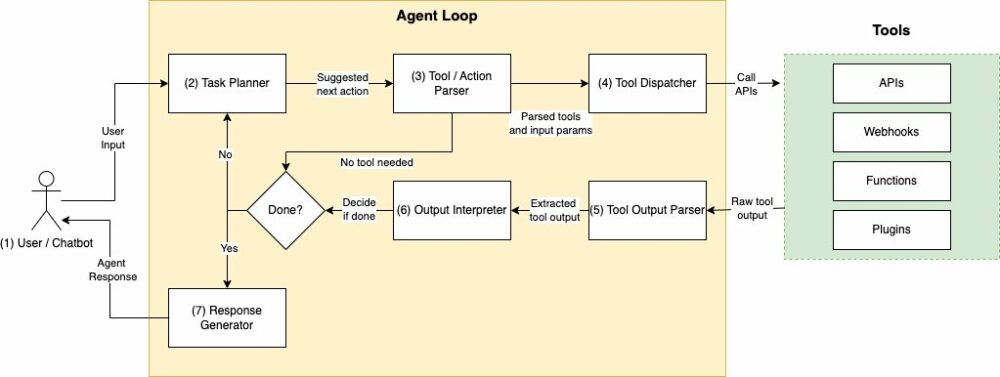

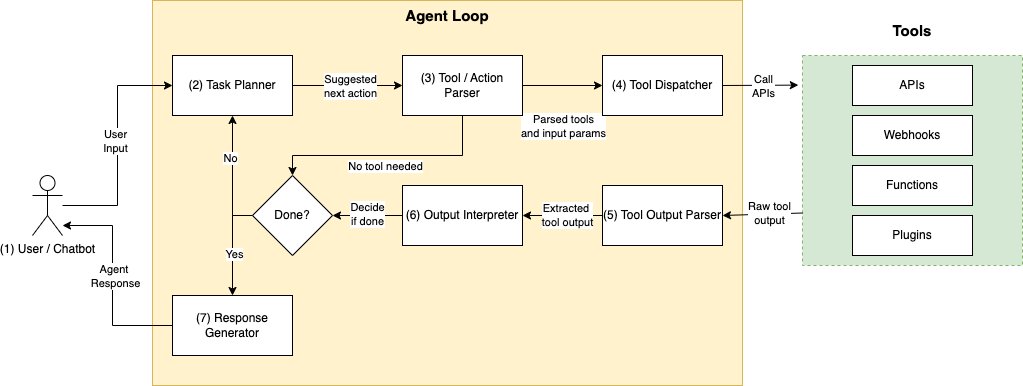

Supondo que os mecanismos de planejamento de tarefas e seleção de ferramentas sejam escolhidos, um programa típico de agente LLM funciona na seguinte sequência:

- Solicitação de usuário – O programa recebe uma entrada do usuário como “Onde está meu pedido

123456?” de algum aplicativo cliente. - Planeje as próximas ações e selecione as ferramentas a serem usadas – Em seguida, o programa usa um prompt para que o LLM gere a próxima ação, por exemplo, “Consulte a tabela de pedidos usando

OrdersAPI.” O LLM é solicitado a sugerir um nome de ferramenta comoOrdersAPIa partir de uma lista predefinida de ferramentas disponíveis e suas descrições. Alternativamente, o LLM poderia ser instruído a gerar diretamente uma chamada de API com parâmetros de entrada comoOrdersAPI(12345).- Observe que a próxima ação pode ou não envolver o uso de uma ferramenta ou API. Caso contrário, o LLM responderia à entrada do usuário sem incorporar contexto adicional das ferramentas ou simplesmente retornaria uma resposta pronta como “Não consigo responder a esta pergunta”.

- Solicitação de ferramenta de análise – Em seguida, precisamos analisar e validar a previsão de ferramenta/ação sugerida pelo LLM. A validação é necessária para garantir que nomes de ferramentas, APIs e parâmetros de solicitação não sejam alucinados e que as ferramentas sejam invocadas corretamente de acordo com as especificações. Esta análise pode exigir uma chamada LLM separada.

- Ferramenta de invocação – Uma vez garantidos os nomes e parâmetros válidos da ferramenta, invocamos a ferramenta. Pode ser uma solicitação HTTP, uma chamada de função e assim por diante.

- Analisar saída – A resposta da ferramenta pode necessitar de processamento adicional. Por exemplo, uma chamada de API pode resultar em uma resposta JSON longa, onde apenas um subconjunto de campos é de interesse para o LLM. Extrair informações em um formato limpo e padronizado pode ajudar o LLM a interpretar o resultado de forma mais confiável.

- Interpretar saída – Dado o resultado da ferramenta, o LLM é novamente solicitado a entendê-lo e decidir se pode gerar a resposta final de volta ao usuário ou se são necessárias ações adicionais.

- Encerre ou continue para a etapa 2 – Retorne uma resposta final ou uma resposta padrão em caso de erros ou tempos limite.

Diferentes estruturas de agentes executam o fluxo do programa anterior de maneira diferente. Por exemplo, Reagir combina a seleção de ferramentas e a geração de respostas finais em um único prompt, em vez de usar prompts separados para seleção de ferramentas e geração de respostas. Além disso, essa lógica pode ser executada em uma única passagem ou em uma instrução while (o “loop do agente”), que termina quando a resposta final é gerada, uma exceção é lançada ou ocorre o tempo limite. O que permanece constante é que os agentes usam o LLM como peça central para orquestrar o planejamento e as invocações de ferramentas até que a tarefa termine. A seguir, mostramos como implementar um loop de agente simples usando serviços AWS.

Visão geral da solução

Para esta postagem do blog, implementamos um agente LLM de suporte ao comércio eletrônico que fornece duas funcionalidades alimentadas por ferramentas:

- Ferramenta de recuperação de status de retorno – Responda a perguntas sobre o status das devoluções, como “O que está acontecendo com minha devolução

rtn001? " - Ferramenta de recuperação de status de pedido – Acompanhe o status dos pedidos, como “Qual é o status do meu pedido

123456? "

O agente usa efetivamente o LLM como roteador de consulta. Dada uma consulta (“Qual é o status do pedido 123456?”), selecione a ferramenta de recuperação apropriada para consultar diversas fontes de dados (ou seja, devoluções e pedidos). Realizamos o roteamento de consultas fazendo com que o LLM escolha entre várias ferramentas de recuperação, que são responsáveis por interagir com uma fonte de dados e buscar o contexto. Isso estende o padrão RAG simples, que assume uma única fonte de dados.

Ambas as ferramentas de recuperação são funções Lambda que recebem um id (orderId or returnId) como entrada, busca um objeto JSON da fonte de dados e converte o JSON em uma string de representação amigável que é adequada para ser usada pelo LLM. A fonte de dados em um cenário do mundo real poderia ser um banco de dados NoSQL altamente escalável, como DynamoDB, mas esta solução emprega Python simples Dict com dados de amostra para fins de demonstração.

Funcionalidades adicionais podem ser adicionadas ao agente adicionando Ferramentas de Recuperação e modificando os prompts de acordo. Este agente pode ser testado como um serviço independente que se integra a qualquer UI via HTTP, o que pode ser feito facilmente com Amazon-Lex.

Aqui estão alguns detalhes adicionais sobre os principais componentes:

- Ponto final de inferência LLM - O núcleo de um programa de agente é um LLM. Usaremos o hub do modelo básico SageMaker JumpStart para implantar facilmente o

Flan-UL2modelo. O SageMaker JumpStart facilita a implantação de endpoints de inferência LLM em servidores dedicados. SageMaker instâncias. - Orquestrador de agentes – O orquestrador de agentes orquestra as interações entre o LLM, as ferramentas e o aplicativo cliente. Para nossa solução, usamos uma função AWS Lambda para conduzir esse fluxo e empregamos o seguinte como funções auxiliares.

- Planejador de tarefas (ferramentas) – O planejador de tarefas usa o LLM para sugerir 1) consulta de devolução, 2) consulta de pedido ou 3) nenhuma ferramenta. Usamos apenas engenharia imediata e

Flan-UL2modelo como está, sem ajuste fino. - Analisador de ferramenta – O analisador de ferramentas garante que a sugestão de ferramenta do planejador de tarefas seja válida. Notavelmente, garantimos que um único

orderIdorreturnIdpode ser analisado. Caso contrário, responderemos com uma mensagem padrão. - Despachante de ferramentas – O despachante de ferramentas invoca ferramentas (funções Lambda) usando os parâmetros válidos.

- Analisador de saída – O analisador de saída limpa e extrai itens relevantes do JSON em uma string legível por humanos. Essa tarefa é realizada tanto por cada ferramenta de recuperação quanto pelo orquestrador.

- Intérprete de saída – A responsabilidade do intérprete de saída é 1) interpretar a saída da invocação da ferramenta e 2) determinar se a solicitação do usuário pode ser atendida ou se são necessárias etapas adicionais. Neste último caso, uma resposta final é gerada separadamente e devolvida ao usuário.

- Planejador de tarefas (ferramentas) – O planejador de tarefas usa o LLM para sugerir 1) consulta de devolução, 2) consulta de pedido ou 3) nenhuma ferramenta. Usamos apenas engenharia imediata e

Agora, vamos nos aprofundar um pouco mais nos componentes principais: orquestrador de agentes, planejador de tarefas e despachante de ferramentas.

Orquestrador de agente

Abaixo está uma versão abreviada do loop do agente dentro da função Lambda do orquestrador do agente. O loop usa funções auxiliares, como task_planner or tool_parser, para modularizar as tarefas. O loop aqui foi projetado para ser executado no máximo duas vezes para evitar que o LLM fique preso em um loop desnecessariamente longo.

Planejador de tarefas (previsão de ferramenta)

O orquestrador de agente usa task planner para prever uma ferramenta de recuperação com base na entrada do usuário. Para nosso agente LLM, usaremos simplesmente engenharia de prompt e poucas solicitações para ensinar ao LLM essa tarefa no contexto. Agentes mais sofisticados poderiam usar um LLM aprimorado para previsão de ferramentas, o que está além do escopo desta postagem. A solicitação é a seguinte:

Despachante de ferramentas

O mecanismo de envio de ferramentas funciona via if/else lógica para chamar funções Lambda apropriadas dependendo do nome da ferramenta. A seguir tool_dispatch implementação da função auxiliar. É usado dentro do agent loop e retorna a resposta bruta da função Lambda da ferramenta, que é então limpa por um output_parser função.

Implante a solução

Pré-requisitos importantes – Para começar a implantação, você precisa atender aos seguintes pré-requisitos:

- O acesso ao Console de gerenciamento da AWS através de um usuário que pode iniciar Pilhas AWS CloudFormation

- Familiaridade com a navegação AWS Lambda e Amazon-Lex consoles

Flan-UL2requer um únicoml.g5.12xlargepara implantação, o que pode exigir o aumento dos limites de recursos por meio de um ticket de suporte. Em nosso exemplo, usamosus-east-1como a Região, portanto, certifique-se de aumentar a cota de serviço (se necessário) emus-east-1.

Implantar usando CloudFormation – Você pode implantar a solução para us-east-1 clicando no botão abaixo:![]()

A implantação da solução levará cerca de 20 minutos e criará um LLMAgentStack pilha, que:

- implanta o endpoint SageMaker usando

Flan-UL2modelo do SageMaker JumpStart; - implanta três funções Lambda:

LLMAgentOrchestrator,LLMAgentReturnsTool,LLMAgentOrdersTool; e - implanta um AWS Lex bot que pode ser usado para testar o agente:

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot.

Teste a solução

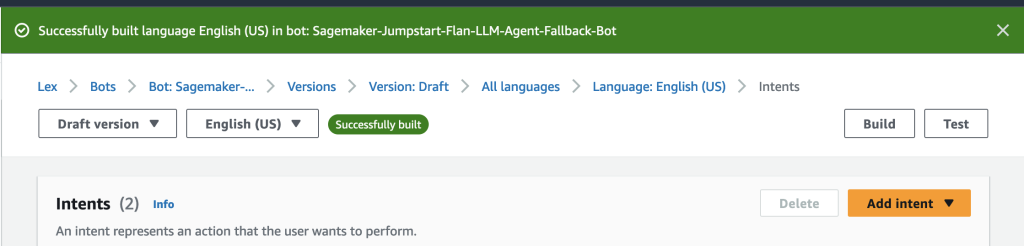

A pilha implanta um bot do Amazon Lex com o nome Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. O bot pode ser usado para testar o agente de ponta a ponta. Aqui está um guia adicional abrangente para testar bots AWS Amazon Lex com uma integração Lambda e como a integração funciona em alto nível. Resumindo, o bot do Amazon Lex é um recurso que fornece uma UI rápida para conversar com o agente LLM em execução dentro de uma função Lambda que construímos (LLMAgentOrchestrator).

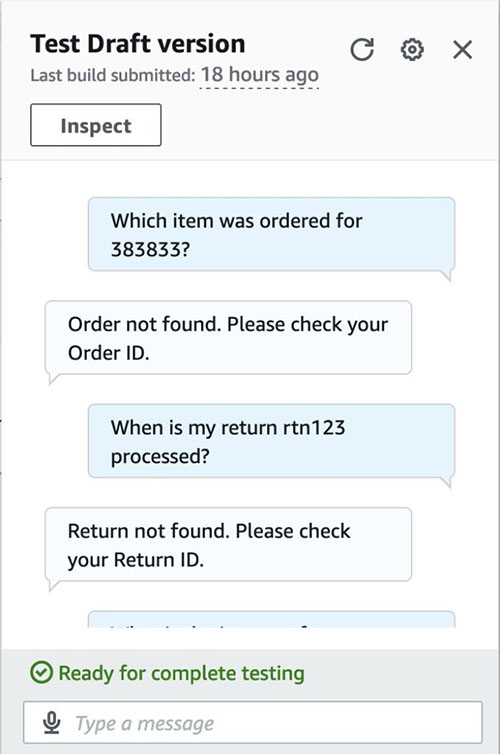

Os exemplos de casos de teste a serem considerados são os seguintes:

- Consulta de pedido válido (por exemplo, “Qual item foi pedido para

123456? ”)- O pedido “123456” é um pedido válido, portanto devemos esperar uma resposta razoável (por exemplo, “Sabonete de ervas”)

- Consulta de devolução válida para um retorno (por exemplo, “Quando é meu retorno

rtn003processado?")- Devemos esperar uma resposta razoável sobre o estado da devolução.

- Irrelevante para devoluções ou pedidos (por exemplo, “Como está o clima na Escócia agora?”)

- Uma pergunta irrelevante para devoluções ou pedidos, portanto, uma resposta padrão deve ser retornada (“Desculpe, não posso responder a essa pergunta.”)

- Consulta de pedido inválida (por exemplo, “Qual item foi pedido para

383833? ”)- O ID 383832 não existe no conjunto de dados de pedidos e, portanto, devemos falhar normalmente (por exemplo, “Pedido não encontrado. Verifique o ID do seu pedido”).

- Consulta de devolução inválida (por exemplo, “Quando é meu retorno

rtn123processado?")- Da mesma forma, identificação

rtn123não existe no conjunto de dados de retorno e, portanto, deve falhar normalmente.

- Da mesma forma, identificação

- Consulta de devolução irrelevante (por exemplo, “Qual é o impacto do retorno

rtn001sobre a paz mundial?”)- Esta questão, embora pareça pertencer a uma ordem válida, é irrelevante. O LLM é usado para filtrar questões com contexto irrelevante.

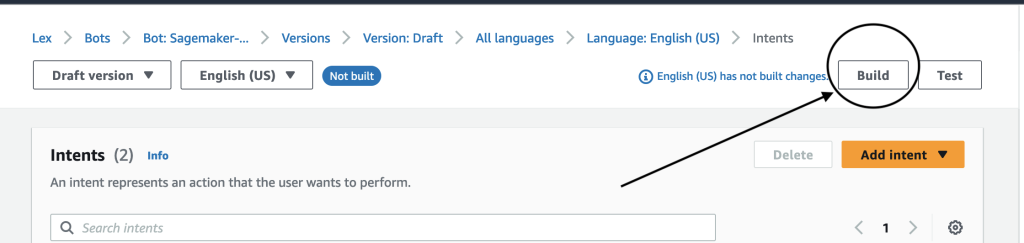

Para executar esses testes você mesmo, aqui estão as instruções.

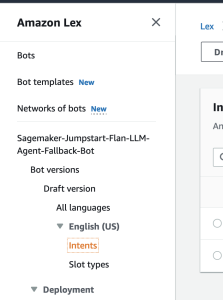

- No console do Amazon Lex (Console AWS > Amazon Lex), navegue até o bot intitulado

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Este bot já foi configurado para chamar oLLMAgentOrchestratorFunção Lambda sempre que oFallbackIntenté acionado. - No painel de navegação, escolha Intenções.

- Escolha Construa no canto superior direito

- 4. Aguarde a conclusão do processo de construção. Quando terminar, você receberá uma mensagem de sucesso, conforme mostrado na imagem a seguir.

- Teste o bot inserindo os casos de teste.

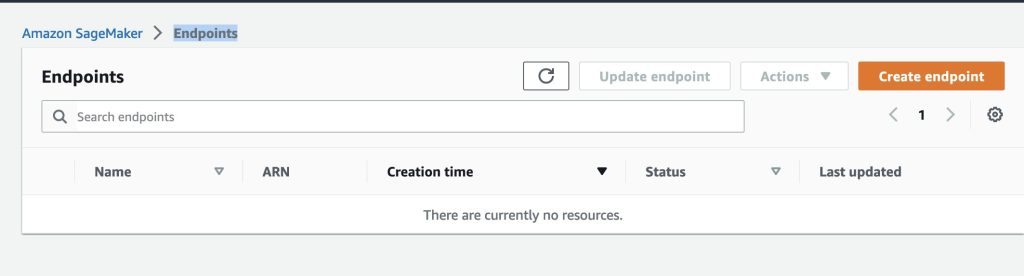

Limpar

Para evitar cobranças adicionais, exclua os recursos criados pela nossa solução seguindo estas etapas:

- No Formação da Nuvem AWS console, selecione a pilha chamada

LLMAgentStack(ou o nome personalizado que você escolheu). - Escolha Apagar

- Verifique se a pilha foi excluída do console do CloudFormation.

Importante: verifique novamente se a pilha foi excluída com sucesso, garantindo que o Flan-UL2 o ponto final de inferência é removido.

- Para verificar, acesse Console AWS > Sagemaker > Endpoints > Inferência Disputas de Comerciais.

- A página deve listar todos os endpoints ativos.

- Certificar-se de que

sm-jumpstart-flan-bot-endpointnão existe como a imagem abaixo.

Considerações para produção

A implantação de agentes LLM na produção requer etapas extras para garantir confiabilidade, desempenho e facilidade de manutenção. Aqui estão algumas considerações antes de implantar agentes na produção:

- Selecionando o modelo LLM para alimentar o loop do agente: Para a solução discutida neste post, usamos um

Flan-UL2modelo sem ajuste fino para realizar planejamento de tarefas ou seleção de ferramentas. Na prática, usar um LLM ajustado para gerar diretamente solicitações de ferramentas ou API pode aumentar a confiabilidade e o desempenho, bem como simplificar o desenvolvimento. Poderíamos ajustar um LLM em tarefas de seleção de ferramentas ou usar um modelo que decodifica diretamente tokens de ferramentas como o Toolformer.- O uso de modelos ajustados também pode simplificar a adição, remoção e atualização de ferramentas disponíveis para um agente. Com abordagens baseadas somente em prompts, a atualização de ferramentas requer a modificação de todos os prompts dentro do orquestrador do agente, como aqueles para planejamento de tarefas, análise de ferramentas e envio de ferramentas. Isto pode ser complicado e o desempenho pode diminuir se muitas ferramentas forem fornecidas no contexto do LLM.

- Confiabilidade e desempenho: Os agentes LLM podem não ser confiáveis, especialmente para tarefas complexas que não podem ser concluídas em poucos loops. Adicionar validações de saída, novas tentativas, estruturar saídas de LLMs em JSON ou yaml e impor tempos limite para fornecer saídas de escape para LLMs presos em loops pode aumentar a confiabilidade.

Conclusão

Nesta postagem, exploramos como construir um agente LLM que pode utilizar várias ferramentas desde o início, usando engenharia de prompt de baixo nível, funções AWS Lambda e SageMaker JumpStart como blocos de construção. Discutimos detalhadamente a arquitetura dos agentes LLM e o loop do agente. Os conceitos e a arquitetura da solução apresentados nesta postagem do blog podem ser apropriados para agentes que usam um pequeno número de um conjunto predefinido de ferramentas. Também discutimos diversas estratégias para usar agentes na produção. Agents for Bedrock, que está em pré-visualização, também fornece uma experiência gerenciada para criar agentes com suporte nativo para invocações de ferramentas de agente.

Sobre o autor

John Hwang é arquiteto de IA generativa na AWS com foco especial em aplicações Large Language Model (LLM), bancos de dados vetoriais e estratégia de produtos de IA generativa. Ele é apaixonado por ajudar empresas no desenvolvimento de produtos de IA/ML e no futuro dos agentes e copilotos de LLM. Antes de ingressar na AWS, ele foi gerente de produto na Alexa, onde ajudou a levar a IA de conversação para dispositivos móveis, bem como negociador de derivativos no Morgan Stanley. Ele é bacharel em ciência da computação pela Universidade de Stanford.

John Hwang é arquiteto de IA generativa na AWS com foco especial em aplicações Large Language Model (LLM), bancos de dados vetoriais e estratégia de produtos de IA generativa. Ele é apaixonado por ajudar empresas no desenvolvimento de produtos de IA/ML e no futuro dos agentes e copilotos de LLM. Antes de ingressar na AWS, ele foi gerente de produto na Alexa, onde ajudou a levar a IA de conversação para dispositivos móveis, bem como negociador de derivativos no Morgan Stanley. Ele é bacharel em ciência da computação pela Universidade de Stanford.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Automotivo / EVs, Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- ChartPrime. Eleve seu jogo de negociação com ChartPrime. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/learn-how-to-build-and-deploy-tool-using-llm-agents-using-aws-sagemaker-jumpstart-foundation-models/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 100

- 15%

- 19

- 20

- 200

- 24

- 27

- 500

- 7

- 9

- a

- habilidades

- habilidade

- Sobre

- Acesso

- realizar

- Segundo

- conformemente

- em

- Açao Social

- ações

- ativo

- adicionado

- acrescentando

- Adicional

- administrativo

- avanços

- Depois de

- novamente

- Agente

- agentes

- AI

- AI / ML

- Alexa

- Todos os Produtos

- já

- tb

- Amazon

- Amazon-Lex

- Amazon Web Services

- entre

- quantidade

- an

- e

- responder

- qualquer

- api

- APIs

- app

- Aplicação

- aplicações

- abordagem

- se aproxima

- apropriado

- arquitetura

- SOMOS

- AS

- perguntar

- assume

- At

- aumentado

- disponível

- evitar

- AWS

- AWS Lambda

- em caminho duplo

- baseado

- BE

- tornam-se

- sido

- antes

- ser

- abaixo

- Berkeley

- Pós

- Pouco

- Blocos

- Blog

- corpo

- Bot

- ambos

- bots

- trazer

- construir

- Prédio

- construído

- negócio

- mas a

- botão

- by

- cálculos

- calendários

- chamada

- chamadas

- CAN

- não podes

- capacidades

- casas

- casos

- acusações

- chatbot

- verificar

- Escolha

- escolhido

- cliente

- combina

- Empresas

- completar

- Efetuado

- integrações

- complexidade

- componentes

- compreensivo

- computador

- Ciência da Computação

- conceitos

- conclui

- configurado

- Considerar

- Considerações

- cônsul

- constante

- contexto

- continuar

- conversação

- IA conversacional

- núcleo

- Custo

- poderia

- crio

- criado

- pesado

- personalizadas

- dados,

- banco de dados

- bases de dados

- conjuntos de dados

- dias

- decidir

- dedicado

- mais profunda

- Padrão

- definições

- demonstração

- demonstrar

- Dependendo

- implantar

- implantado

- Implantação

- desenvolvimento

- implanta

- Derivativos

- projetado

- detalhe

- detalhes

- Determinar

- Desenvolvimento

- Dispositivos/Instrumentos

- diretamente

- discutido

- mergulho

- do

- parece

- feito

- distância

- e

- e-commerce,

- cada

- facilmente

- fácil

- efetivamente

- ou

- outro

- emprega

- end-to-end

- Ponto final

- impor

- Engenharia

- aumentar

- garantir

- assegurada

- garante

- assegurando

- entrar

- intitulado

- erro

- erros

- escapar

- especialmente

- etc.

- Evento

- Cada

- exemplo

- exemplos

- Exceto

- exceção

- executar

- existir

- esperar

- vasta experiência

- Explorado

- estender

- se estende

- externo

- extra

- Extractos

- FALHA

- falso

- Moda

- Característica

- poucos

- Campos

- filtro

- final

- fluxo

- Foco

- seguinte

- segue

- Escolha

- formato

- formas

- encontrado

- Foundation

- enquadramentos

- amigável

- da

- Cumprir

- totalmente

- função

- funcionalidades

- funções

- futuro

- geralmente

- gerar

- gerado

- geração

- generativo

- IA generativa

- ter

- dado

- Go

- Solo

- guia

- Acontecimento

- escotilhas

- Ter

- ter

- he

- ajudar

- ajudou

- ajuda

- conseqüentemente

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- hi

- Alta

- altamente

- detém

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Hub

- humano

- legível para humanos

- i

- ID

- if

- Impacto

- executar

- implementação

- importações

- melhorar

- in

- incluir

- incorporando

- Crescimento

- aumentando

- INFORMAÇÕES

- entrada

- inquérito

- dentro

- instruções

- integrado

- Integra-se

- integração

- intenção

- interagir

- interagindo

- interações

- interesse

- para dentro

- introduzir

- introduzido

- invocado

- invoca

- envolver

- IT

- Unid

- iterações

- juntando

- jpg

- json

- Chave

- Conhecimento

- língua

- grande

- lançamento

- APRENDER

- Nível

- como

- limitações

- limites

- Lista

- LLM

- lógica

- longo

- OLHARES

- fazer

- FAZ

- gerenciados

- de grupos

- Gerente

- muitos

- Posso..

- me

- significar

- mecanismo

- mecanismos

- reuniões

- mensagem

- metadados

- Minutos

- Móvel Esteira

- dispositivos móveis

- modelo

- modelos

- mais

- Morgan

- Morgan Stanley

- a maioria

- múltiplo

- my

- nome

- Nomeado

- nomes

- nativo

- Navegar

- navegação

- Navegação

- necessário

- você merece...

- necessário

- Novo

- Próximo

- não

- nenhum

- notavelmente

- agora

- número

- numeroso

- objeto

- of

- frequentemente

- on

- uma vez

- ONE

- só

- contrário

- or

- ordem

- ordens

- Outros

- de outra forma

- A Nossa

- Fora

- saída

- lado de fora

- Acima de

- Superar

- Visão geral

- página

- pão

- parâmetros

- passar

- apaixonado

- padrão

- paz

- pendente

- Realizar

- atuação

- escolher

- escolhido

- plano

- planejamento

- platão

- Inteligência de Dados Platão

- PlatãoData

- por favor

- plugins

- Privacidade

- Publique

- poder

- alimentado

- prática

- predizer

- predição

- pré-requisitos

- evitar

- visualização

- anterior

- Prévio

- processo

- Processado

- em processamento

- Produto

- desenvolvimento de produtos

- gerente de produto

- Produção

- Agenda

- Programas

- devidamente

- fornecer

- fornecido

- fornece

- fornecendo

- fins

- Python

- questão

- Frequentes

- Links

- aumentar

- rapidamente

- Cru

- mundo real

- razoável

- reconhecer

- reembolsar

- região

- relevante

- confiabilidade

- permanece

- Removido

- removendo

- representação

- solicitar

- pedidos

- requerer

- requeridos

- exige

- recurso

- Recursos

- Responder

- resposta

- responsabilidade

- responsável

- resultar

- retorno

- voltar

- Retorna

- certo

- roteador

- roteamento

- Execute

- corrida

- s

- sábio

- satisfeito

- escalável

- cenário

- Ciência

- escopo

- Pesquisar

- parece

- selecionado

- doadores,

- auto-dirigido

- sentido

- separado

- Seqüência

- serviço

- Serviços

- conjunto

- vários

- enviado

- Envios

- Baixo

- tiro

- rede de apoio social

- mostrar

- mostrando

- simples

- simplificar

- simplesmente

- solteiro

- pequeno

- So

- Software

- solução

- alguns

- sofisticado

- fonte

- Fontes

- especial

- especializado

- específico

- especificação

- pilha

- autônoma

- Stanford

- Universidade de Stanford

- stanley

- começo

- começado

- Declaração

- Status

- Passo

- Passos

- Dê um basta

- loja

- estratégias

- Estratégia

- Tanga

- estruturação

- Subseqüentemente

- sucesso

- entraram com sucesso

- tal

- sugerir

- adequado

- ajuda

- certo

- sistemas

- mesa

- Tire

- tomado

- toma

- tomar

- Tarefa

- tarefas

- dizer

- teste

- testado

- ensaio

- testes

- que

- A

- O Futuro

- deles

- então

- Lá.

- Este

- isto

- aqueles

- três

- Assim

- vezes

- para

- Tokens

- também

- ferramenta

- ferramentas

- topo

- Total

- pista

- trader

- tradicional

- treinado

- desencadeado

- tentar

- dois

- típico

- tipicamente

- ui

- universidade

- desnecessariamente

- até

- Atualizações

- atualização

- usar

- usava

- Utilizador

- usos

- utilização

- utilizar

- VALIDAR

- validação

- variedade

- versão

- via

- esperar

- foi

- Caminho..

- we

- Clima

- web

- serviços web

- sites

- BEM

- O Quê

- O que é a

- quando

- sempre que

- se

- qual

- enquanto

- QUEM

- precisarão

- de

- dentro

- sem

- trabalho

- mundo

- seria

- yaml

- Vocês

- investimentos

- você mesmo

- zefirnet