Un sistem de inteligență artificială (AI) nou creat bazat pe învățarea prin consolidare profundă (DRL) poate reacționa la atacatori într-un mediu simulat și poate bloca 95% din atacurile cibernetice înainte ca acestea să escaladeze.

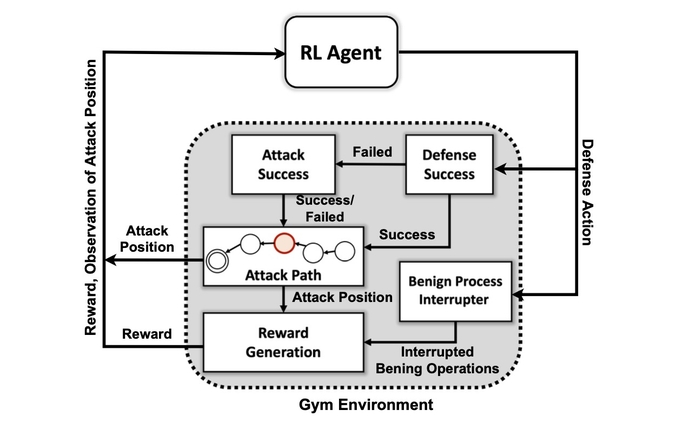

Acest lucru este potrivit cercetătorilor de la Laboratorul Național de Nord-Vest al Departamentului de Energie, care au construit o simulare abstractă a conflictului digital dintre atacatori și apărători într-o rețea și au antrenat patru rețele neuronale DRL diferite pentru a maximiza recompensele pe baza prevenirii compromisurilor și a minimizării întreruperii rețelei.

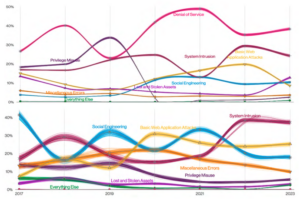

Atacatorii simulați au folosit o serie de tactici bazate pe MITRE ATT & CK clasificarea framework-ului să treacă de la faza inițială de acces și recunoaștere la alte faze de atac până când își ating scopul: faza de impact și exfiltrare.

Antrenamentul cu succes al sistemului AI asupra mediului de atac simplificat demonstrează că răspunsurile defensive la atacuri în timp real ar putea fi gestionate de un model AI, spune Samrat Chatterjee, un cercetător de date care a prezentat munca echipei la reuniunea anuală a Asociației pentru Avansarea inteligenței artificiale la Washington, DC pe 14 februarie.

„Nu vrei să treci în arhitecturi mai complexe dacă nici măcar nu poți arăta promisiunea acestor tehnici”, spune el. „Am vrut mai întâi să demonstrăm că putem antrena cu succes un DRL și să arătăm niște rezultate bune ale testării, înainte de a merge mai departe.”

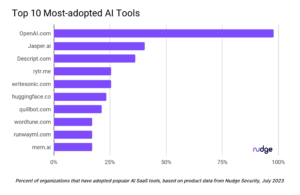

Aplicarea tehnicilor de învățare automată și inteligență artificială în diferite domenii din cadrul securității cibernetice a devenit o tendință fierbinte în ultimul deceniu, de la integrarea timpurie a învățării automate în gateway-urile de securitate pentru e-mail. la începutul anilor 2010 la eforturile mai recente de a utilizați ChatGPT pentru a analiza codul sau efectuează analize criminalistice. Acum, majoritatea produselor de securitate au – sau pretind că deține – câteva funcții alimentate de algoritmi de învățare automată antrenați pe seturi mari de date.

Cu toate acestea, crearea unui sistem AI capabil de apărare proactivă continuă să fie aspirațională, mai degrabă decât practică. În timp ce cercetătorilor rămân o varietate de obstacole, cercetarea PNNL arată că un apărător AI ar putea fi posibil în viitor.

„Evaluarea mai multor algoritmi DRL antrenați în diverse setări adverse este un pas important către soluții practice autonome de apărare cibernetică”, echipa de cercetare PNNL afirmat în lucrarea lor. „Experimentele noastre sugerează că algoritmii DRL fără model pot fi antrenați eficient sub profiluri de atac în mai multe etape, cu diferite niveluri de abilități și persistență, obținând rezultate favorabile de apărare în condiții contestate.”

Cum folosește sistemul MITRE ATT&CK

Primul obiectiv al echipei de cercetare a fost de a crea un mediu de simulare personalizat bazat pe un set de instrumente open source cunoscut sub numele de Deschide AI Gym. Folosind acel mediu, cercetătorii au creat entități atacatoare cu diferite niveluri de abilități și persistență, cu capacitatea de a folosi un subset de 7 tactici și 15 tehnici din cadrul MITRE ATT&CK.

Obiectivele agenților atacatori sunt să treacă prin cei șapte pași ai lanțului de atac, de la accesul inițial la execuție, de la persistență la comandă și control și de la colectare la impact.

Pentru atacator, adaptarea tacticii lor la starea mediului și la acțiunile curente ale apărătorului poate fi complexă, spune Chatterjee de la PNNL.

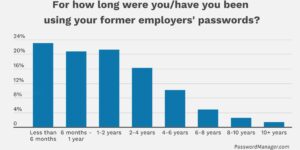

„Adversarul trebuie să-și parcurgă drumul de la o stare de recunoaștere inițială până la o stare de exfiltrare sau de impact”, spune el. „Nu încercăm să creăm un fel de model pentru a opri un adversar înainte ca acesta să intre în mediul înconjurător – presupunem că sistemul este deja compromis.”

Cercetătorii au folosit patru abordări ale rețelelor neuronale bazate pe învățarea prin întărire. Învățarea prin consolidare (RL) este o abordare de învățare automată care emulează sistemul de recompensă al creierului uman. O rețea neuronală învață prin întărirea sau slăbirea anumitor parametri pentru neuronii individuali pentru a recompensa soluții mai bune, măsurate printr-un scor care indică cât de bine funcționează sistemul.

Învățarea prin întărire permite în esență computerului să creeze o abordare bună, dar nu perfectă, a problemei în cauză, spune Mahantesh Halappanavar, cercetător PNNL și autor al lucrării.

„Fără a folosi nicio învățare prin întărire, am putea face-o, dar ar fi o problemă foarte mare, care nu va avea suficient timp pentru a veni cu un mecanism bun”, spune el. „Cercetarea noastră... ne oferă acest mecanism în care învățarea prin consolidare profundă imită într-o oarecare măsură o parte din comportamentul uman în sine și poate explora acest spațiu foarte vast foarte eficient.”

Nu este gata pentru Prime Time

Experimentele au descoperit că o metodă specifică de învățare prin întărire, cunoscută sub numele de Deep Q Network, a creat o soluție puternică pentru problema defensivă, prinzând 97% dintre atacatori în setul de date de testare. Cu toate acestea, cercetarea este doar începutul. Profesioniștii în securitate nu ar trebui să caute un însoțitor AI care să îi ajute să facă răspuns la incident și criminalistică în curând.

Printre numeroasele probleme care rămân de rezolvat se numără obținerea de învățare prin întărire și rețele neuronale profunde pentru a explica factorii care le-au influențat deciziile, o zonă de cercetare numită învățare prin consolidare explicabilă (XRL).

În plus, robustețea algoritmilor AI și găsirea unor modalități eficiente de antrenare a rețelelor neuronale sunt ambele probleme care trebuie rezolvate, spune Chatterjee de la PNNL.

„Crearea unui produs – aceasta nu a fost principala motivație pentru această cercetare”, spune el. „Aceasta a fost mai mult despre experimentarea științifică și descoperirea algoritmică.”

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://www.darkreading.com/emerging-tech/researchers-create-ai-cyber-defender-that-reacts-to-attackers

- 7

- 95%

- a

- capacitate

- Despre Noi

- REZUMAT

- acces

- Conform

- acțiuni

- de fapt

- plus

- avansare

- contradictorialității

- agenţi

- AI

- AI-alimentat

- algoritmică

- algoritmi

- TOATE

- permite

- deja

- analiză

- analiza

- și

- anual

- aplicație

- abordare

- abordari

- ZONĂ

- artificial

- inteligență artificială

- Inteligența artificială (AI)

- Asociație

- ataca

- Atacuri

- autor

- autonom

- bazat

- deveni

- înainte

- Mai bine

- între

- Mare

- Bloca

- Creier

- construit

- denumit

- nu poti

- capabil

- sigur

- lanţ

- Chat GPT

- pretinde

- clasificare

- colectare

- cum

- complex

- compromis

- calculator

- Conduce

- conflict

- continuă

- Control

- ar putea

- crea

- a creat

- Crearea

- Curent

- personalizat

- Cyber

- atacuri cibernetice

- Securitate cibernetică

- de date

- om de știință de date

- set de date

- seturi de date

- dc

- deceniu

- decizie

- Deciziile

- adânc

- apărătorii

- Apărare

- defensivă

- demonstra

- demonstrează

- Departament

- diferit

- digital

- descoperire

- Ruptură

- diferit

- Devreme

- în mod eficient

- eficient

- eficient

- Eforturile

- securitate prin e-mail

- energie

- suficient de

- entități

- Mediu inconjurator

- În esență,

- evaluarea

- Chiar

- execuție

- exfiltrațiile

- Explica

- explora

- factori

- DESCRIERE

- puțini

- Domenii

- descoperire

- First

- debit

- juridic

- criminalistica

- Înainte

- găsit

- Cadru

- din

- viitor

- obține

- obtinerea

- oferă

- scop

- Goluri

- bine

- mână

- ajutor

- FIERBINTE

- Cum

- HTTPS

- uman

- obstacole

- Impactul

- important

- in

- incident

- răspuns la incident

- individ

- influențat

- inițială

- integrare

- Inteligență

- IT

- în sine

- Copil

- cunoscut

- laborator

- mare

- învăţare

- nivelurile de

- Uite

- maşină

- masina de învățare

- Principal

- multe

- max-width

- Maximaliza

- mecanism

- Reuniunea

- metodă

- minimizând

- model

- mai mult

- motivaţia

- muta

- în mişcare

- multiplu

- național

- Navigaţi

- Nevoie

- reţea

- rețele

- rețele neuronale

- rețele neuronale

- neuronii

- deschide

- open-source

- Altele

- Pacific

- Hârtie

- parametrii

- trecut

- Perfect

- efectuează

- persistență

- fază

- Plato

- Informații despre date Platon

- PlatoData

- posibil

- alimentat

- Practic

- prezentat

- prevenirea

- Prim

- Proactivă

- Problemă

- probleme

- Produse

- profesioniști

- Profiluri

- promisiune

- RE

- atins

- Reacţiona

- reacţionează

- gata

- real

- în timp real

- recent

- rămâne

- cercetare

- cercetător

- cercetători

- răspuns

- Răsplăti

- Recompense

- robusteţe

- spune

- ştiinţific

- Om de stiinta

- securitate

- serie

- set

- setări

- Șapte

- să

- Arăta

- Emisiuni

- simplificată

- simulare

- calificare

- soluţie

- soluţii

- unele

- Sursă

- Spaţiu

- specific

- Începe

- Stat

- Pas

- paşi

- Încă

- Stop

- întărire

- puternic

- de succes

- Reușit

- sistem

- tactică

- echipă

- tehnici de

- Testarea

- Statul

- lor

- Prin

- timp

- la

- Toolkit

- spre

- Tren

- dresat

- Pregătire

- tendință

- în

- us

- utilizare

- varietate

- Fixă

- dorit

- Washington

- modalități de

- în timp ce

- OMS

- voi

- în

- fără

- Apartamente

- ar

- elastic

- Tu

- zephyrnet