Deblocarea răspunsurilor precise și perspicace din cantități mari de text este o capacitate interesantă activată de modelele de limbă mari (LLM). Când construiți aplicații LLM, este adesea necesar să vă conectați și să interogați sursele de date externe pentru a oferi un context relevant modelului. O abordare populară este utilizarea Retrieval Augmented Generation (RAG) pentru a crea sisteme de întrebări și răspunsuri care să înțeleagă informații complexe și să ofere răspunsuri naturale la întrebări. RAG permite modelelor să atingă baze vaste de cunoștințe și să ofere un dialog uman pentru aplicații precum chatbot și asistenți de căutare pentru întreprinderi.

În această postare, explorăm cum să valorificăm puterea CallIndex, Lama 2-70B-Chat, și LangChain pentru a construi aplicații puternice de întrebări și răspunsuri. Cu aceste tehnologii de ultimă generație, puteți ingera corpuri de text, puteți indexa cunoștințele critice și puteți genera text care răspunde la întrebările utilizatorilor cu precizie și claritate.

Lama 2-70B-Chat

Llama 2-70B-Chat este un LLM puternic care concurează cu modele de top. Este antrenat în prealabil pe două trilioane de jetoane text și este destinat de Meta să fie folosit pentru asistență prin chat pentru utilizatori. Datele de pre-instruire provin din date disponibile public și se încheie în septembrie 2022, iar datele de reglare fină se încheie în iulie 2023. Pentru mai multe detalii despre procesul de formare al modelului, considerente de siguranță, învățare și utilizări prevăzute, consultați lucrarea Llama 2: Open Foundation și modele de chat bine reglate. Modelele Llama 2 sunt disponibile pe Amazon SageMaker JumpStart pentru o implementare rapidă și simplă.

CallIndex

CallIndex este un cadru de date care permite construirea de aplicații LLM. Oferă instrumente care oferă conectori de date pentru a asimila datele existente cu diverse surse și formate (PDF, documente, API-uri, SQL și multe altele). Indiferent dacă aveți date stocate în baze de date sau în PDF-uri, LlamaIndex simplifică utilizarea acestor date pentru LLM-uri. După cum demonstrăm în această postare, API-urile LlamaIndex fac accesul la date fără efort și vă permit să creați aplicații și fluxuri de lucru LLM personalizate puternice.

Dacă experimentați și construiți cu LLM-uri, probabil că sunteți familiarizat cu LangChain, care oferă un cadru robust, simplificând dezvoltarea și implementarea aplicațiilor bazate pe LLM. Similar cu LangChain, LlamaIndex oferă o serie de instrumente, inclusiv conectori de date, indici de date, motoare și agenți de date, precum și integrări de aplicații, cum ar fi instrumente și observabilitate, urmărire și evaluare. LlamaIndex se concentrează pe reducerea decalajului dintre date și LLM-urile puternice, simplificând sarcinile de date cu funcții ușor de utilizat. LlamaIndex este proiectat și optimizat special pentru construirea de aplicații de căutare și recuperare, cum ar fi RAG, deoarece oferă o interfață simplă pentru interogarea LLM-urilor și preluarea documentelor relevante.

Prezentare generală a soluțiilor

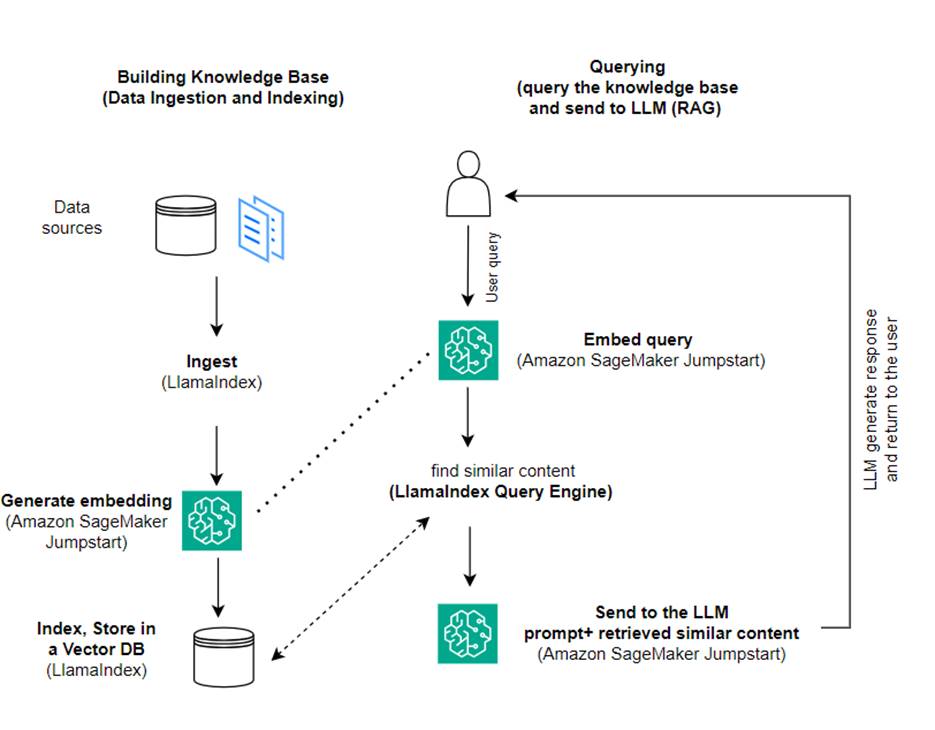

În această postare, demonstrăm cum să creați o aplicație bazată pe RAG folosind LlamaIndex și un LLM. Următoarea diagramă prezintă arhitectura pas cu pas a acestei soluții prezentată în secțiunile următoare.

RAG combină regăsirea informațiilor cu generarea limbajului natural pentru a produce răspunsuri mai perspicace. Când vi se solicită, RAG caută mai întâi corpuri de text pentru a prelua cele mai relevante exemple pentru intrare. În timpul generării răspunsului, modelul ia în considerare aceste exemple pentru a-și spori capacitățile. Prin încorporarea pasajelor relevante preluate, răspunsurile RAG tind să fie mai faptice, mai coerente și mai consecvente cu contextul în comparație cu modelele generative de bază. Acest cadru de recuperare-generare profită de punctele forte atât ale recuperării, cât și ale generării, ajutând la abordarea problemelor precum repetiția și lipsa contextului care pot apărea din modelele conversaționale autoregresive pur. RAG introduce o abordare eficientă pentru construirea de agenți conversaționali și asistenți AI cu răspunsuri contextualizate, de înaltă calitate.

Construirea soluției constă din următorii pași:

- Configurarea Amazon SageMaker Studio ca mediu de dezvoltare și instalați dependențele necesare.

- Implementați un model de încorporare din hub-ul Amazon SageMaker JumpStart.

- Descărcați comunicate de presă pentru a le utiliza ca bază externă de cunoștințe.

- Creați un index din comunicatele de presă pentru a putea interoga și adăuga ca context suplimentar promptului.

- Interogați baza de cunoștințe.

- Creați o aplicație de întrebări și răspunsuri folosind agenții LlamaIndex și LangChain.

Tot codul din această postare este disponibil în GitHub repo.

Cerințe preliminare

Pentru acest exemplu, aveți nevoie de un cont AWS cu un domeniu SageMaker și adecvat Gestionarea identității și accesului AWS permisiuni (IAM). Pentru instrucțiuni de configurare a contului, consultați Creați un cont AWS. Dacă nu aveți deja un domeniu SageMaker, consultați Domeniul Amazon SageMaker prezentare generală pentru a crea unul. În această postare, folosim AmazonSageMakerFullAccess rol. Nu este recomandat să utilizați această acreditare într-un mediu de producție. În schimb, ar trebui să creați și să utilizați un rol cu permisiuni cu cel mai mic privilegiu. De asemenea, puteți explora modul în care puteți utiliza Manager de rol Amazon SageMaker pentru a construi și gestiona roluri IAM bazate pe persoane pentru nevoile comune de învățare automată direct prin consola SageMaker.

În plus, aveți nevoie de acces la minimum următoarele dimensiuni de instanță:

- ml.g5.2xmare pentru utilizarea punctului final la implementarea Față îmbrățișată GPT-J model de încorporare a textului

- ml.g5.48xmare pentru utilizarea punctului final la implementarea punctului final al modelului Llama 2-Chat

Pentru a vă mări cota, consultați Solicitarea unei mariri de cota.

Implementați un model de încorporare GPT-J utilizând SageMaker JumpStart

Această secțiune vă oferă două opțiuni atunci când implementați modele SageMaker JumpStart. Puteți utiliza o implementare bazată pe cod folosind codul furnizat sau puteți utiliza interfața de utilizator (UI) SageMaker JumpStart.

Implementați cu SageMaker Python SDK

Puteți utiliza SDK-ul SageMaker Python pentru a implementa LLM-urile, așa cum se arată în cod disponibil în depozit. Parcurgeți următorii pași:

- Setați dimensiunea instanței care urmează să fie utilizată pentru implementarea modelului de încorporare folosind

instance_type = "ml.g5.2xlarge" - Găsiți ID-ul modelului pe care să îl utilizați pentru încorporare. În SageMaker JumpStart, este identificat ca

model_id = "huggingface-textembedding-gpt-j-6b-fp16" - Preluați containerul model pre-antrenat și implementați-l pentru deducere.

SageMaker va returna numele punctului final al modelului și următorul mesaj când modelul de încorporare a fost implementat cu succes:

Implementați cu SageMaker JumpStart în SageMaker Studio

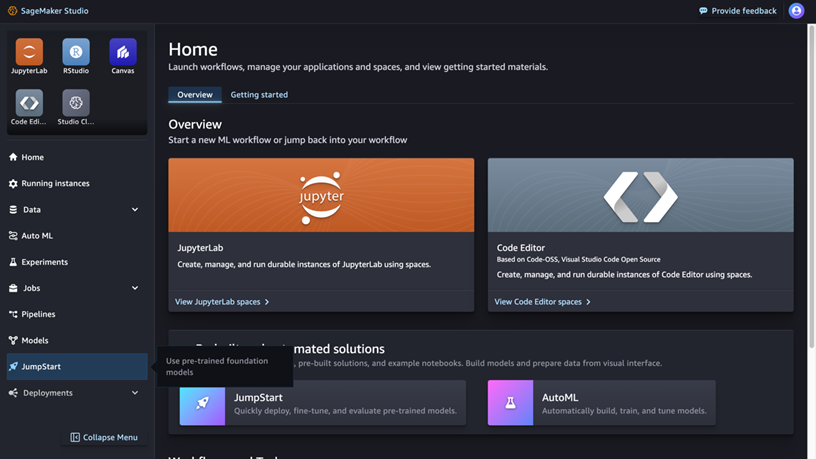

Pentru a implementa modelul utilizând SageMaker JumpStart în Studio, parcurgeți următorii pași:

- Pe consola SageMaker Studio, alegeți JumpStart în panoul de navigare.

- Căutați și alegeți modelul GPT-J 6B Embedding FP16.

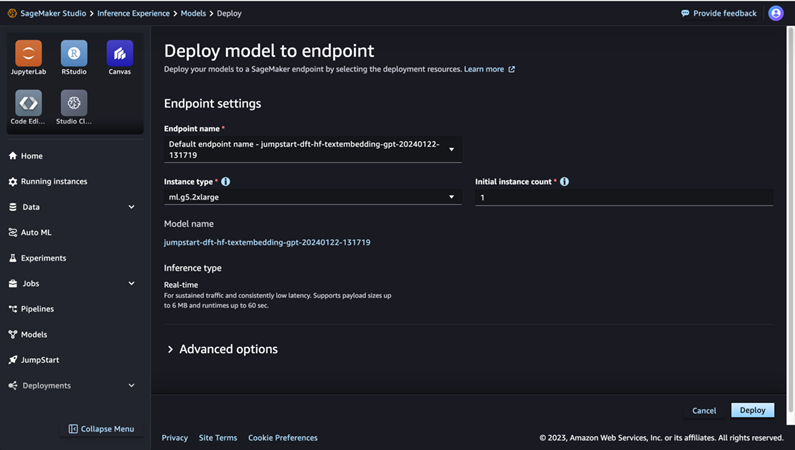

- Alegeți Implementare și personalizați configurația de implementare.

- Pentru acest exemplu, avem nevoie de o instanță ml.g5.2xlarge, care este instanța implicită sugerată de SageMaker JumpStart.

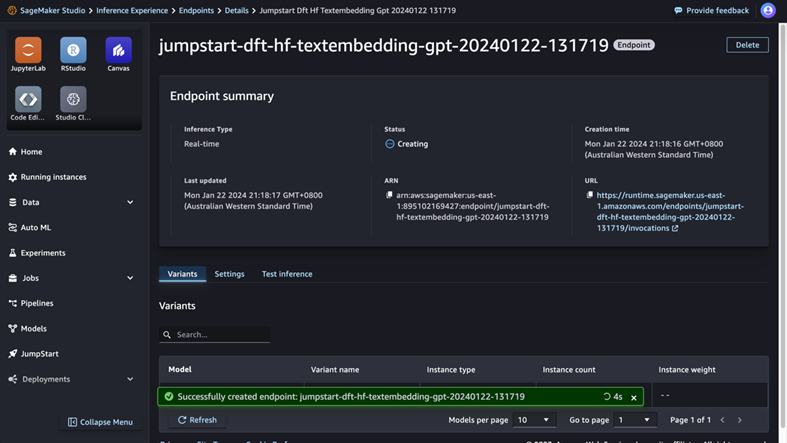

- Alegeți Implementare din nou pentru a crea punctul final.

Punctul final va dura aproximativ 5-10 minute pentru a fi în funcțiune.

După ce ați implementat modelul de încorporare, pentru a utiliza integrarea LangChain cu API-urile SageMaker, trebuie să creați o funcție care să gestioneze intrările (text brut) și să le transformați în înglobări folosind modelul. Faceți acest lucru creând o clasă numită ContentHandler, care preia un JSON de date de intrare și returnează un JSON de încorporare de text: class ContentHandler(EmbeddingsContentHandler).

Transmiteți numele punctului final al modelului către ContentHandler funcție pentru a converti textul și a returna înglobări:

Puteți găsi numele punctului final fie în rezultatul SDK-ului, fie în detaliile de implementare din interfața de utilizare SageMaker JumpStart.

Puteți testa că ContentHandler funcția și punctul final funcționează conform așteptărilor, introducând un text brut și rulând embeddings.embed_query(text) funcţie. Puteți folosi exemplul oferit text = "Hi! It's time for the beach" sau încercați propriul text.

Implementați și testați Llama 2-Chat folosind SageMaker JumpStart

Acum puteți implementa modelul care poate avea conversații interactive cu utilizatorii dvs. În acest caz, alegem unul dintre modelele Llama 2-chat, care este identificat prin

Modelul trebuie să fie implementat la un punct final în timp real folosind predictor = my_model.deploy(). SageMaker va returna numele punctului final al modelului, pe care îl puteți utiliza pentru endpoint_name variabilă pentru referire mai târziu.

Tu definești a print_dialogue funcția pentru a trimite intrare la modelul de chat și a primi răspunsul de ieșire al acestuia. Sarcina utilă include hiperparametri pentru model, inclusiv următorii:

- max_new_tokens – Se referă la numărul maxim de jetoane pe care modelul le poate genera în ieșirile sale.

- sus_p – Se referă la probabilitatea cumulativă a jetoanelor care pot fi reținute de model la generarea rezultatelor sale

- temperatură – Se referă la aleatorietatea rezultatelor generate de model. O temperatură mai mare de 0 sau egală cu 1 crește nivelul de aleatorie, în timp ce o temperatură de 0 va genera cele mai probabile simboluri.

Ar trebui să vă selectați hiperparametrii în funcție de cazul dvs. de utilizare și să-i testați corespunzător. Modele precum familia Llama vă solicită să includeți un parametru suplimentar care indică faptul că ați citit și acceptat Acordul de licență pentru utilizatorul final (EULA):

Pentru a testa modelul, înlocuiți secțiunea de conținut a sarcinii utile de intrare: "content": "what is the recipe of mayonnaise?". Puteți utiliza propriile valori ale textului și puteți actualiza hiperparametrii pentru a le înțelege mai bine.

Similar cu implementarea modelului de încorporare, puteți implementa Llama-70B-Chat utilizând interfața de utilizare SageMaker JumpStart:

- Pe consola SageMaker Studio, alegeți pornire în panoul de navigare

- Căutați și alegeți

Llama-2-70b-Chat model - Acceptați EULA și alegeți Lansa, folosind din nou instanța implicită

Similar modelului de încorporare, puteți utiliza integrarea LangChain creând un șablon de gestionare de conținut pentru intrările și ieșirile modelului dvs. de chat. În acest caz, definiți intrările ca fiind cele care provin de la un utilizator și indicați că sunt guvernate de system prompt. system prompt informează modelul despre rolul său în asistența utilizatorului pentru un anumit caz de utilizare.

Acest handler de conținut este apoi trecut la invocarea modelului, în plus față de hiperparametrii și atributele personalizate menționate mai sus (acceptare EULA). Analizați toate aceste atribute folosind următorul cod:

Când punctul final este disponibil, puteți testa dacă funcționează conform așteptărilor. Puteți actualiza llm("what is amazon sagemaker?") cu propriul text. De asemenea, trebuie să definiți specificul ContentHandler pentru a invoca LLM folosind LangChain, așa cum se arată în cod și următorul fragment de cod:

Utilizați LlamaIndex pentru a construi RAG

Pentru a continua, instalați LlamaIndex pentru a crea aplicația RAG. Puteți instala LlamaIndex folosind pip: pip install llama_index

Mai întâi trebuie să vă încărcați datele (baza de cunoștințe) pe LlamaIndex pentru indexare. Aceasta presupune câțiva pași:

- Alegeți un încărcător de date:

LlamaIndex oferă o serie de conectori de date disponibile pe LlamaHub pentru tipuri obișnuite de date, cum ar fi fișiere JSON, CSV și text, precum și alte surse de date, permițându-vă să ingerați o varietate de seturi de date. În această postare, folosim SimpleDirectoryReader pentru a ingera câteva fișiere PDF așa cum se arată în cod. Eșantionul nostru de date sunt două comunicate de presă Amazon în versiune PDF în comunicate de presă folderul din depozitul nostru de coduri. După ce încărcați PDF-urile, puteți vedea că acestea au fost convertite într-o listă de 11 elemente.

În loc să încărcați direct documentele, puteți, de asemenea, să ascuns Document obiect în Node obiecte înainte de a le trimite la index. Alegerea între trimiterea întregului Document obiect la index sau convertirea Documentului în Node obiectele înainte de indexare depinde de cazul dumneavoastră de utilizare specific și de structura datelor dumneavoastră. Abordarea nodurilor este, în general, o alegere bună pentru documentele lungi, în care doriți să spargeți și să preluați anumite părți ale unui document, mai degrabă decât întregul document. Pentru mai multe informații, consultați Documente / Noduri.

- Instanciați încărcătorul și încărcați documentele:

Acest pas inițializează clasa de încărcare și orice configurație necesară, cum ar fi dacă să ignore fișierele ascunse. Pentru mai multe detalii, consultați SimpleDirectoryReader.

- Sună la încărcător

load_datametodă de a analiza fișierele și datele sursă și de a le converti în obiecte LlamaIndex Document, gata pentru indexare și interogare. Puteți folosi următorul cod pentru a finaliza absorbția de date și pregătirea pentru căutarea textului integral, folosind capabilitățile de indexare și regăsire ale LlamaIndex:

- Construiți indexul:

Caracteristica cheie a LlamaIndex este capacitatea sa de a construi indecși organizați peste date, care sunt reprezentate ca documente sau noduri. Indexarea facilitează interogarea eficientă asupra datelor. Ne creăm indexul cu stocul de vectori implicit în memorie și cu configurația noastră de setări definite. Indexul Llama Setări cont este un obiect de configurare care oferă resurse și setări utilizate în mod obișnuit pentru operațiunile de indexare și interogare într-o aplicație LlamaIndex. Acționează ca un obiect singleton, astfel încât vă permite să setați configurații globale, permițându-vă totodată să suprascrieți componente specifice la nivel local, trecându-le direct în interfețele (cum ar fi LLM-uri, modele de încorporare) care le folosesc. Când o anumită componentă nu este furnizată în mod explicit, cadrul LlamaIndex revine la setările definite în Settings obiect ca implicit global. Pentru a utiliza modelele noastre de încorporare și LLM cu LangChain și configurarea Settings trebuie să instalăm llama_index.embeddings.langchain și llama_index.llms.langchain. Putem configura Settings obiect ca în următorul cod:

În mod implicit, VectorStoreIndex folosește un in-memory SimpleVectorStore care este inițializat ca parte a contextului de stocare implicit. În cazurile de utilizare din viața reală, adesea trebuie să vă conectați la magazine de vectori externe, cum ar fi Serviciul Amazon OpenSearch. Pentru mai multe detalii, consultați Motor vectorial pentru Amazon OpenSearch Serverless.

Acum puteți rula întrebări și răspunsuri asupra documentelor dvs. utilizând query_engine din LlamaIndex. Pentru a face acest lucru, treceți indexul pe care l-ați creat mai devreme pentru interogări și adresați-vă întrebarea. Motorul de interogare este o interfață generică pentru interogarea datelor. Este nevoie de o interogare în limbaj natural ca intrare și returnează un răspuns bogat. Motorul de interogări este de obicei construit pe unul sau mai multe indexurile folosind copoi.

Puteți vedea că soluția RAG este capabilă să preia răspunsul corect din documentele furnizate:

Utilizați instrumentele și agenții LangChain

Loader clasă. Încărcătorul este proiectat pentru a încărca date în LlamaIndex sau ulterior ca instrument în a Agent LangChain. Acest lucru vă oferă mai multă putere și flexibilitate pentru a utiliza acest lucru ca parte a aplicației dvs. Începi prin a-ți defini instrument din clasa agent LangChain. Funcția pe care o transmiteți instrumentului dvs. interogează indexul pe care l-ați creat peste documentele dvs. folosind LlamaIndex.

Apoi selectați tipul potrivit de agent pe care doriți să-l utilizați pentru implementarea RAG. În acest caz, utilizați chat-zero-shot-react-description agent. Cu acest agent, LLM va folosi instrumentul disponibil (în acest scenariu, RAG peste baza de cunoștințe) pentru a oferi răspunsul. Apoi inițializați agentul transmițând instrumentul, LLM și tipul de agent:

Puteți vedea agentul trecând prin thoughts, actions, și observation , utilizați instrumentul (în acest scenariu, interogând documentele dvs. indexate); și returnează un rezultat:

Puteți găsi codul de implementare end-to-end în documentul însoțitor GitHub repo.

A curăța

Pentru a evita costurile inutile, vă puteți curăța resursele, fie prin următoarele fragmente de cod, fie prin interfața de utilizare Amazon JumpStart.

Pentru a utiliza SDK-ul Boto3, utilizați următorul cod pentru a șterge punctul final al modelului de încorporare a textului și punctul final al modelului de generare a textului, precum și configurațiile punctului final:

Pentru a utiliza consola SageMaker, parcurgeți următorii pași:

- Pe consola SageMaker, sub Inferență din panoul de navigare, alegeți Endpoints

- Căutați punctele finale de încorporare și de generare de text.

- Pe pagina de detalii ale punctului final, alegeți Ștergere.

- Alegeți Ștergere din nou pentru a confirma.

Concluzie

Pentru cazurile de utilizare axate pe căutare și regăsire, LlamaIndex oferă capabilități flexibile. Excelează la indexare și regăsire pentru LLM, făcându-l un instrument puternic pentru explorarea profundă a datelor. LlamaIndex vă permite să creați indici de date organizați, să utilizați diverse LLM, să măriți datele pentru o performanță mai bună a LLM și să interogați datele cu limbaj natural.

Această postare a demonstrat câteva concepte și capabilități cheie LlamaIndex. Am folosit GPT-J pentru încorporare și Llama 2-Chat ca LLM pentru a construi o aplicație RAG, dar ați putea folosi orice model potrivit. Puteți explora gama cuprinzătoare de modele disponibile pe SageMaker JumpStart.

De asemenea, am arătat cum LlamaIndex poate oferi instrumente puternice și flexibile pentru a conecta, indexa, prelua și integra date cu alte cadre precum LangChain. Cu integrările LlamaIndex și LangChain, puteți crea aplicații LLM mai puternice, versatile și perspicace.

Despre Autori

Dr. Romina Sharifpour este arhitect senior de soluții de învățare automată și inteligență artificială la Amazon Web Services (AWS). Ea a petrecut peste 10 ani conducând proiectarea și implementarea de soluții inovatoare end-to-end, activate de progresele în ML și AI. Domeniile de interes ale Rominei sunt procesarea limbajului natural, modelele mari de limbaj și MLOps.

Dr. Romina Sharifpour este arhitect senior de soluții de învățare automată și inteligență artificială la Amazon Web Services (AWS). Ea a petrecut peste 10 ani conducând proiectarea și implementarea de soluții inovatoare end-to-end, activate de progresele în ML și AI. Domeniile de interes ale Rominei sunt procesarea limbajului natural, modelele mari de limbaj și MLOps.

Nicole Pinto este un arhitect specializat în soluții AI/ML cu sediul în Sydney, Australia. Experiența ei în domeniul sănătății și al serviciilor financiare îi oferă o perspectivă unică în rezolvarea problemelor clienților. Este pasionată de a permite clienților prin învățarea automată și de a împuternici următoarea generație de femei în STEM.

Nicole Pinto este un arhitect specializat în soluții AI/ML cu sediul în Sydney, Australia. Experiența ei în domeniul sănătății și al serviciilor financiare îi oferă o perspectivă unică în rezolvarea problemelor clienților. Este pasionată de a permite clienților prin învățarea automată și de a împuternici următoarea generație de femei în STEM.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/build-knowledge-powered-conversational-applications-using-llamaindex-and-llama-2-chat/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 10

- 100

- 11

- 13

- 14

- 15%

- 16

- 2022

- 2023

- 22

- 500

- 7

- 8

- 9

- a

- capacitate

- Capabil

- Despre Noi

- acceptare

- admis

- acceptă

- acces

- Conform

- Cont

- precis

- Acte

- adăuga

- plus

- Suplimentar

- adresa

- progresele

- Avantaj

- După

- din nou

- Agent

- agenţi

- Acord

- AI

- cercetare ai

- AI / ML

- TOATE

- Permiterea

- permite

- deja

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amazon Web Services (AWS)

- Sume

- an

- și

- răspunde

- telefonic

- răspunsuri

- Orice

- API-uri

- aplicație

- aplicatii

- abordare

- adecvat

- în mod corespunzător

- aproximativ

- arhitectură

- SUNT

- domenii

- apărea

- artificial

- inteligență artificială

- AS

- cere

- Asistență

- asistenți

- asistarea

- At

- atribute

- spori

- augmented

- Australia

- disponibil

- evita

- AWS

- înapoi

- fundal

- de bază

- bazat

- de bază

- BE

- Plajă

- deoarece

- fost

- înainte

- Mai bine

- între

- atât

- Pauză

- punte

- aduce

- construi

- Clădire

- construit

- dar

- by

- denumit

- CAN

- capacități

- capacitate

- caz

- cazuri

- Chat

- chatbots

- alegere

- Alege

- clasă

- curat

- clar

- client

- cod

- COERENT

- combină

- venire

- Comun

- în mod obișnuit

- companie

- comparație

- concurează

- Completă

- complex

- component

- componente

- înţelege

- cuprinzător

- Concepte

- conchide

- Configuraţie

- configurarea

- Confirma

- Conectați

- conectori

- Considerații

- consideră

- consistent

- constă

- Consoleze

- construi

- Recipient

- conţinut

- context

- continua

- de conversaţie

- conversații

- converti

- convertit

- de conversie a

- corecta

- A costat

- economii

- Cheltuieli

- ar putea

- crea

- a creat

- Crearea

- CREDENTIALĂ

- critic

- personalizat

- client

- clienţii care

- personaliza

- Tăiat

- de date

- accesul la date

- baze de date

- seturi de date

- adânc

- Mod implicit

- defini

- definit

- definire

- livra

- demonstra

- demonstrat

- dependențe

- depinde de

- implementa

- dislocate

- Implementarea

- desfășurarea

- Amenajări

- proiectat

- detalii

- Dezvoltare

- diagramă

- Dialog

- DICT

- direct

- diferit

- do

- docs

- document

- documente

- domeniu

- Dont

- condus

- în timpul

- Mai devreme

- Eficace

- eficient

- fără efort

- oricare

- element

- Încorporarea

- împuternicirea

- activat

- permite

- permițând

- capăt

- un capăt la altul

- Punct final

- Motor

- Motoare

- Afacere

- Întreg

- Mediu inconjurator

- egal

- evaluare

- exemplu

- exemple

- captivant

- existent

- de aşteptat

- experimentarea

- explicit

- explorare

- explora

- extern

- Față

- facilitează

- Falls

- familiar

- familie

- Caracteristică

- DESCRIERE

- puțini

- Fişiere

- financiar

- Servicii financiare

- Găsi

- First

- Flexibilitate

- flexibil

- concentrat

- se concentrează

- următor

- Pentru

- Fundație

- Cadru

- cadre

- din

- funcţie

- decalaj

- în general

- genera

- generată

- generator

- generaţie

- generativ

- oferă

- Caritate

- merge

- bine

- guvernată

- mai mare

- manipula

- valorifica

- Avea

- de asistență medicală

- ajutor

- ei

- Ascuns

- de înaltă calitate

- Cum

- Cum Pentru a

- Totuși

- HTML

- HTTPS

- Butuc

- ID

- identificat

- Identitate

- if

- ignora

- implementarea

- îmbunătățiri

- in

- include

- include

- Inclusiv

- care încorporează

- Crește

- Creșteri

- index

- indexate

- indexurile

- indica

- indicând

- informații

- informează

- Infrastructură

- Inovaţie

- inovatoare

- intrare

- intrări

- introducerea

- profund

- instala

- instanță

- in schimb

- instrucțiuni

- integra

- integrare

- integrările

- Inteligență

- destinate

- interactiv

- interes

- interfaţă

- interfeţe

- în

- Prezintă

- implică

- probleme de

- IT

- ESTE

- jpg

- JSON

- iulie

- Cheie

- cunoştinţe

- lipsă

- limbă

- mare

- mai tarziu

- conducere

- învăţare

- Nivel

- Licență

- ca

- Probabil

- Listă

- Lamă

- LLM

- încărca

- încărcător

- încărcare

- la nivel local

- Lung

- maşină

- masina de învățare

- face

- FACE

- Efectuarea

- administra

- maxim

- Mai..

- menționat

- mesaj

- meta

- metodă

- Migrarea

- migrațiune

- minim

- minute

- ML

- MLOps

- model

- Modele

- mai mult

- cele mai multe

- mult

- nume

- Natural

- Procesarea limbajului natural

- Navigare

- necesar

- Nevoie

- necesar

- nevoilor

- următor

- noduri

- număr

- obiect

- obiecte

- of

- oferi

- promoții

- de multe ori

- on

- ONE

- afară

- pe

- deschide

- operațional

- Operațiuni

- optimizate

- Opţiuni

- or

- comandă

- Organizat

- Altele

- al nostru

- afară

- a subliniat

- producție

- iesiri

- peste

- trece peste

- Prezentare generală

- propriu

- pagină

- pâine

- Hârtie

- parametru

- parametrii

- parte

- special

- piese

- trece

- pasaje

- Trecut

- Care trece

- pasionat

- performanță

- permisiuni

- perspectivă

- Plato

- Informații despre date Platon

- PlatoData

- Popular

- Post

- putere

- puternic

- tocmai

- Predictor

- pregătire

- presa

- Comunicat de presă

- Comunicate de presă

- probleme

- proces

- prelucrare

- produce

- producere

- furniza

- prevăzut

- furnizează

- public

- pur

- Piton

- Q & A

- interogări

- întrebare

- întrebare

- Întrebări

- Rapid

- cârpă

- dezordine

- gamă

- mai degraba

- Crud

- Citeste

- gata

- în timp real

- a primi

- reţetă

- recomandat

- Redus

- trimite

- referință

- se referă

- reinvesti

- eliberaţi

- Lansări

- înlocui

- depozit

- reprezentate

- necesita

- necesar

- cercetare

- cercetare și dezvoltare

- Resurse

- răspuns

- răspunsuri

- rezultat

- regăsire

- reveni

- Returnează

- Bogat

- dreapta

- robust

- Rol

- rolurile

- Alerga

- funcţionare

- s

- Siguranţă

- sagemaker

- probă

- Economie

- scenariu

- sdk

- Caută

- Cautari

- Secțiune

- secțiuni

- vedea

- selecta

- SELF

- trimite

- trimitere

- senior

- Septembrie

- serviciu

- Servicii

- set

- instalare

- setări

- configurarea

- ea

- să

- a arătat

- indicat

- Emisiuni

- asemănător

- simplu

- simplificarea

- întrucât

- Mărimea

- dimensiuni

- fragment

- So

- soluţie

- soluţii

- Rezolvarea

- unele

- Sursă

- provenind

- Surse

- specialist

- specific

- specific

- uzat

- Începe

- de ultimă oră

- Statele

- tijă

- Pas

- paşi

- depozitare

- stoca

- stocate

- magazine

- simplu

- raționalizarea

- puncte forte

- structura

- studio

- Ulterior

- Reușit

- astfel de

- potrivit

- sydney

- sistem

- sisteme

- Lua

- ia

- Robinet

- sarcini

- Tehnologii

- șablon

- Tind

- test

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- decât

- acea

- Lor

- apoi

- Acestea

- ei

- acest

- aceste

- Prin

- timp

- la

- indicativele

- instrument

- Unelte

- top

- calc

- Pregătire

- Transforma

- Trilion

- încerca

- Două

- tip

- Tipuri

- tipic

- ui

- în

- înţelege

- unic

- inutil

- Actualizează

- Folosire

- utilizare

- carcasa de utilizare

- utilizat

- util

- Utilizator

- User Interface

- ușor de utilizat

- utilizatorii

- utilizări

- folosind

- Valori

- variabil

- varietate

- diverse

- Fixă

- multilateral

- versiune

- de

- vrea

- we

- web

- servicii web

- BINE

- Ce

- Ce este

- cand

- întrucât

- dacă

- care

- în timp ce

- voi

- cu

- Femei

- fluxuri de lucru

- de lucru

- ar

- ani

- Tu

- Ta

- zephyrnet