Aceasta este o postare pentru invitați scrisă împreună cu echipa PyTorch a lui Meta și este o continuare a lui Partea 1 din această serie, unde demonstrăm performanța și ușurința de a rula PyTorch 2.0 pe AWS.

Cercetarea învățării automate (ML) a demonstrat că modelele de limbaj mari (LLM) antrenate cu seturi de date semnificativ mari au ca rezultat o calitate mai bună a modelului. În ultimii câțiva ani, dimensiunea modelelor de generație actuală a crescut semnificativ și necesită instrumente și infrastructură moderne pentru a fi instruite eficient și la scară. PyTorch Distributed Data Parallelism (DDP) ajută la procesarea datelor la scară într-un mod simplu și robust, dar necesită ca modelul să se potrivească pe un singur GPU. Biblioteca PyTorch Fully Sharded Data Parallel (FSDP) depășește această barieră, permițând fragmentarea modelelor pentru a antrena modele mari între lucrătorii paraleli de date.

Antrenarea modelului distribuit necesită un grup de noduri de lucru care se pot scala. Serviciul Amazon Elastic Kubernetes (Amazon EKS) este un serviciu popular, conform Kubernetes, care simplifică foarte mult procesul de rulare a sarcinilor de lucru AI/ML, făcându-l mai ușor de gestionat și mai puțin consumator de timp.

În această postare pe blog, AWS colaborează cu echipa PyTorch a Meta pentru a discuta despre cum să utilizați biblioteca PyTorch FSDP pentru a realiza scalarea liniară a modelelor de învățare profundă pe AWS fără probleme folosind Amazon EKS și Containere de învățare profundă AWS (DLC-uri). Demonstrăm acest lucru printr-o implementare pas cu pas a modelelor Llama7 de instruire 13B, 70B și 2B folosind Amazon EKS cu 16 Cloud Elastic de calcul Amazon (Amazon EC2) p4de.24xlarge instanțe (fiecare cu 8 GPU-uri NVIDIA A100 Tensor Core și fiecare GPU cu 80 GB memorie HBM2e) sau 16 EC2 p5.48xmărire instanțe (fiecare cu 8 GPU-uri NVIDIA H100 Tensor Core și fiecare GPU cu 80 GB memorie HBM3), realizând o scalare aproape liniară a debitului și, în cele din urmă, permițând un timp de antrenament mai rapid.

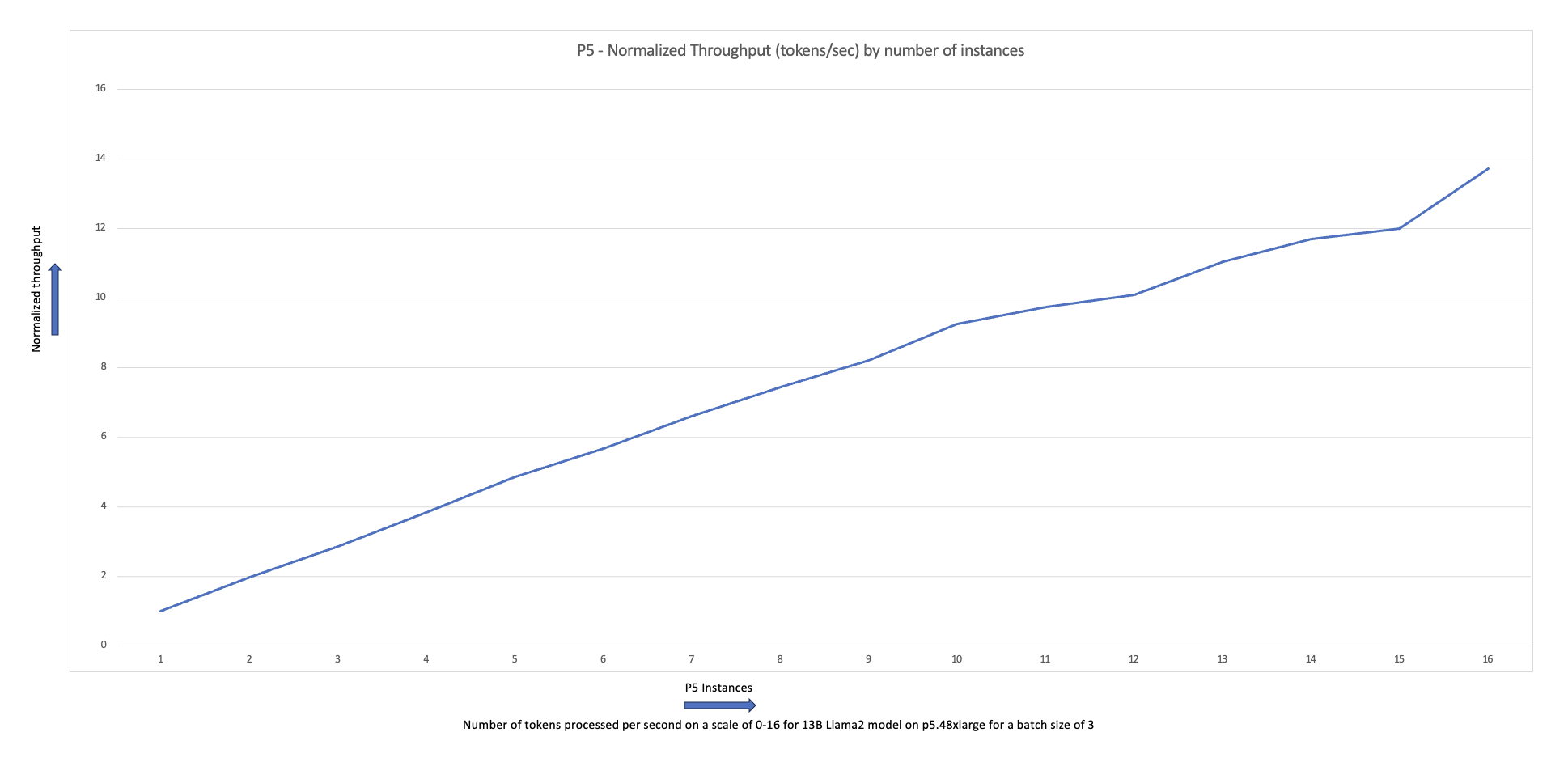

Următorul grafic de scalare arată că instanțele p5.48xlarge oferă o eficiență de scalare de 87% cu reglajul fin FSDP Llama2 într-o configurație de cluster cu 16 noduri.

Provocările formării LLM

Companiile adoptă din ce în ce mai mult LLM-uri pentru o serie de sarcini, inclusiv asistenți virtuali, traducere, creare de conținut și viziune computerizată, pentru a îmbunătăți eficiența și acuratețea într-o varietate de aplicații.

Cu toate acestea, antrenarea sau reglarea fină a acestor modele mari pentru un caz de utilizare personalizat necesită o cantitate mare de date și putere de calcul, ceea ce se adaugă la complexitatea generală de inginerie a stivei ML. Acest lucru se datorează, de asemenea, memoriei limitate disponibile pe un singur GPU, care limitează dimensiunea modelului care poate fi antrenat și limitează, de asemenea, dimensiunea lotului per GPU utilizată în timpul antrenamentului.

Pentru a aborda această provocare, diferite tehnici de paralelism de model, cum ar fi DeepSpeed ZeRO și PyTorch FSDP au fost create pentru a vă permite să depășiți această barieră a memoriei GPU limitate. Acest lucru se realizează prin adoptarea unei tehnici paralele de date fragmentate, în care fiecare accelerator deține doar o felie (o ciob) a unei replici a modelului în locul întregii replici a modelului, ceea ce reduce dramatic amprenta de memorie a sarcinii de formare.

Această postare demonstrează cum puteți utiliza PyTorch FSDP pentru a regla fin modelul Llama2 folosind Amazon EKS. Obținem acest lucru prin extinderea capacității de calcul și GPU pentru a răspunde cerințelor modelului.

Prezentare generală a FSDP

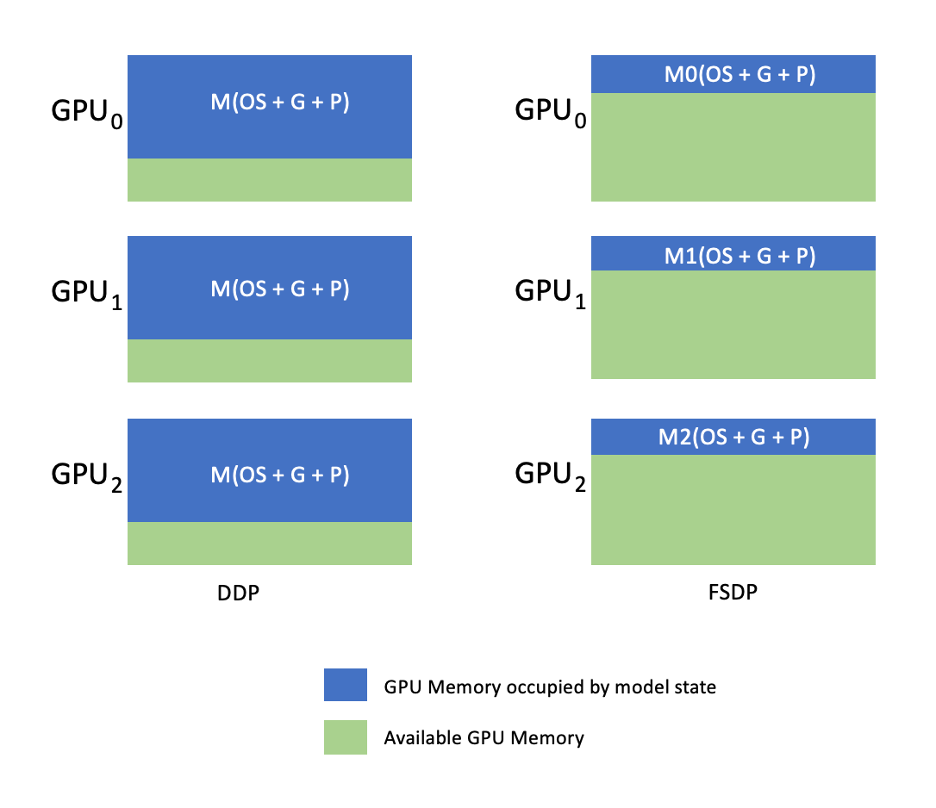

În instruirea PyTorch DDP, fiecare GPU (numit a lucrător în contextul PyTorch) deține o copie completă a modelului, inclusiv greutățile modelului, gradienții și stările de optimizare. Fiecare lucrător procesează un lot de date și, la sfârșitul trecerii înapoi, folosește un toate-reduce operațiune pentru sincronizarea gradienților între diferiți lucrători.

Având o replică a modelului pe fiecare GPU, restricționează dimensiunea modelului care poate fi găzduit într-un flux de lucru DDP. FSDP ajută la depășirea acestei limitări prin împărțirea parametrilor modelului, a stărilor de optimizare și a gradienților între lucrătorii paraleli de date, păstrând în același timp simplitatea paralelismului de date.

Acest lucru este demonstrat în următoarea diagramă, unde, în cazul DDP, fiecare GPU deține o copie completă a stării modelului, inclusiv starea optimizatorului (OS), gradienții (G) și parametrii (P): M(OS + G + P). În FSDP, fiecare GPU deține doar o porțiune din starea modelului, inclusiv starea optimizatorului (OS), gradienții (G) și parametrii (P): M (OS + G + P). Utilizarea FSDP are ca rezultat o amprentă de memorie GPU semnificativ mai mică în comparație cu DDP pentru toți lucrătorii, permițând antrenamentul modelelor foarte mari sau utilizarea unor loturi mai mari pentru joburi de instruire.

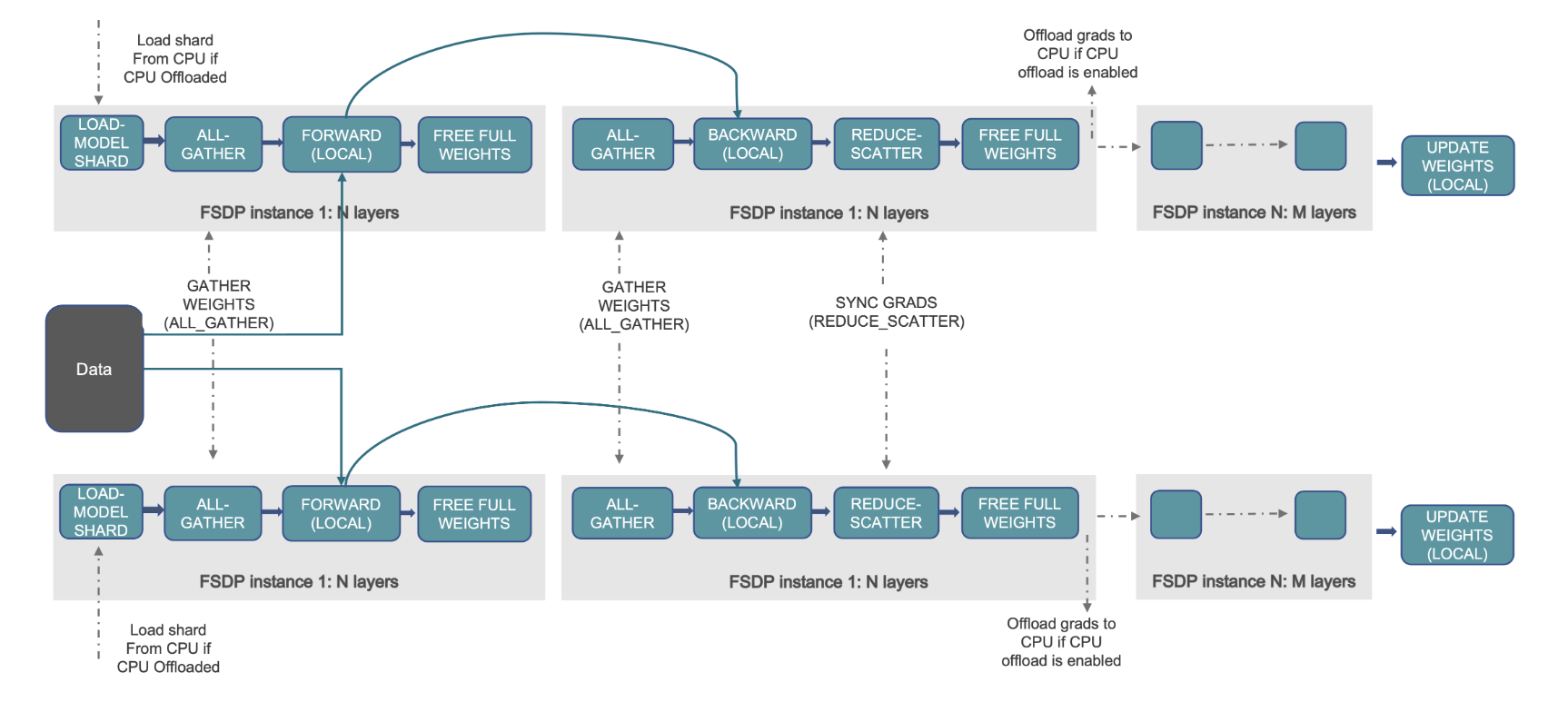

Acest lucru, totuși, vine cu prețul creșterii cheltuielilor generale de comunicare, care este atenuată prin optimizări FSDP, cum ar fi suprapunerea proceselor de comunicare și calcul cu caracteristici precum preluare. Pentru informații mai detaliate, consultați Noțiuni introductive cu Fully Sharded Data Parallel (FSDP).

FSDP oferă diferiți parametri care vă permit să reglați performanța și eficiența joburilor dvs. de formare. Unele dintre caracteristicile și capacitățile cheie ale FSDP includ:

- Politica de ambalare a transformatorului

- Precizie mixtă flexibilă

- Punct de control pentru activare

- Diverse strategii de sharding pentru a se potrivi diferitelor viteze de rețea și topologii de cluster:

- FULL_SHARD – Parametrii modelului fragmentului, gradienții și stările de optimizare

- HYBRID_SHARD – Ciob complet într-un nod DDP între noduri; acceptă un grup de fragmentare flexibil pentru o replică completă a modelului (HSDP)

- SHARD_GRAD_OP – Fragmentați numai gradienți și stări de optimizare

- NO_SHARD – Similar cu DDP

Pentru mai multe informații despre FSDP, consultați Instruire eficientă la scară largă cu Pytorch FSDP și AWS.

Figura următoare arată cum funcționează FSDP pentru două procese paralele de date.

Prezentare generală a soluțiilor

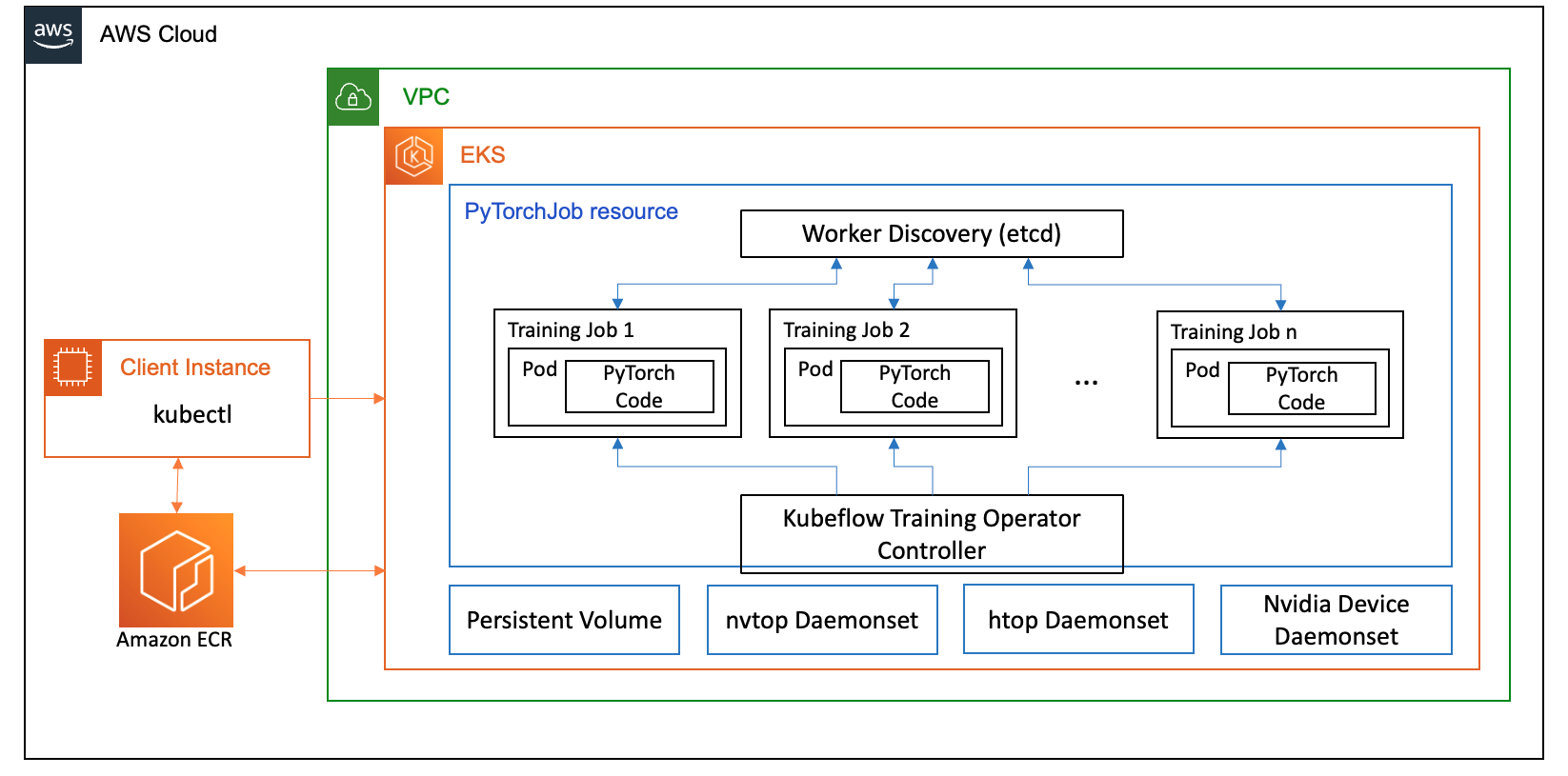

În această postare, am configurat un cluster de calcul folosind Amazon EKS, care este un serviciu gestionat pentru a rula Kubernetes în AWS Cloud și în centrele de date locale. Mulți clienți adoptă Amazon EKS pentru a rula sarcini de lucru AI/ML bazate pe Kubernetes, profitând de performanța, scalabilitatea, fiabilitatea și disponibilitatea acesteia, precum și de integrările sale cu rețelele, securitatea și alte servicii AWS.

Pentru cazul nostru de utilizare FSDP, folosim Operator de formare Kubeflow pe Amazon EKS, care este un proiect nativ Kubernetes care facilitează reglarea fină și instruirea distribuită scalabilă pentru modelele ML. Acceptă diverse cadre ML, inclusiv PyTorch, pe care le puteți utiliza pentru a implementa și gestiona joburile de formare PyTorch la scară.

Folosind resursa personalizată PyTorchJob a Kubeflow Training Operator, rulăm joburi de instruire pe Kubernetes cu un număr configurabil de replici ale lucrătorilor, ceea ce ne permite să optimizăm utilizarea resurselor.

Următoarele sunt câteva componente ale operatorului de instruire care joacă un rol în cazul nostru de utilizare a reglajului fin Llama2:

- Un controler Kubernetes centralizat care orchestrează joburi de instruire distribuite pentru PyTorch.

- PyTorchJob, o resursă personalizată Kubernetes pentru PyTorch, oferită de operatorul de instruire Kubeflow, pentru a defini și implementa joburi de instruire Llama2 pe Kubernetes.

- etcd, care are legătură cu implementarea mecanismului de întâlnire pentru coordonarea antrenării distribuite a modelelor PyTorch. Acest

etcdserverul, ca parte a procesului de întâlnire, facilitează coordonarea și sincronizarea lucrătorilor participanți în timpul instruirii distribuite.

Următoarea diagramă ilustrează arhitectura soluției.

Majoritatea detaliilor vor fi rezumate de scripturile de automatizare pe care le folosim pentru a rula exemplul Llama2.

Folosim următoarele referințe de cod în acest caz de utilizare:

Ce este Llama2?

Llama2 este un LLM pre-antrenat pe 2 trilioane de jetoane de text și cod. Este unul dintre cele mai mari și mai puternice LLM-uri disponibile astăzi. Puteți utiliza Llama2 pentru o varietate de sarcini, inclusiv procesarea limbajului natural (NLP), generarea de text și traducerea. Pentru mai multe informații, consultați Începeți cu Llama.

Llama2 este disponibil în trei dimensiuni diferite de model:

- Lama2-70b – Acesta este cel mai mare model Llama2, cu 70 de miliarde de parametri. Este cel mai puternic model Llama2 și poate fi folosit pentru cele mai solicitante sarcini.

- Lama2-13b – Acesta este un model Llama2 de dimensiuni medii, cu 13 miliarde de parametri. Este un echilibru bun între performanță și eficiență și poate fi folosit pentru o varietate de sarcini.

- Lama2-7b – Acesta este cel mai mic model Llama2, cu 7 miliarde de parametri. Este cel mai eficient model Llama2 și poate fi folosit pentru sarcini care nu necesită cel mai înalt nivel de performanță.

Această postare vă permite să reglați toate aceste modele pe Amazon EKS. Pentru a oferi o experiență simplă și reproductibilă de a crea un cluster EKS și de a rula joburi FSDP pe acesta, folosim aws-do-eks proiect. Exemplul va funcționa și cu un cluster EKS preexistent.

O prezentare cu script este disponibilă pe GitHub pentru o experiență ieșită din cutie. În secțiunile următoare, explicăm procesul de la capăt la capăt mai detaliat.

Furnizați infrastructura soluției

Pentru experimentele descrise în această postare, folosim clustere cu noduri p4de (A100 GPU) și p5 (H100 GPU).

Cluster cu p4de.24xlarge noduri

Pentru clusterul nostru cu noduri p4de, folosim următoarele eks-gpu-p4de-odcr.yaml scenariu:

Utilizarea eksctl și manifestul clusterului precedent, creăm un cluster cu noduri p4de:

Cluster cu noduri p5.48xlarge

Un șablon terraform pentru un cluster EKS cu noduri P5 se află în cele ce urmează GitHub repo.

Puteți personaliza clusterul prin intermediul variabile.tf fișier și apoi creați-l prin CLI Terraform:

Puteți verifica disponibilitatea clusterului rulând o comandă simplă kubectl:

Clusterul este sănătos dacă rezultatul acestei comenzi arată numărul așteptat de noduri în starea Gata.

Implementați cerințele preliminare

Pentru a rula FSDP pe Amazon EKS, folosim PyTorchJob resursă personalizată. Necesita etcd și Operator de formare Kubeflow ca premise.

Implementați etcd cu următorul cod:

Implementați Kubeflow Training Operator cu următorul cod:

Creați și trimiteți o imagine de container FSDP către Amazon ECR

Utilizați următorul cod pentru a crea o imagine de container FSDP și împingeți-o Registrul Amazon de containere elastice (Amazon ECR):

Creați manifestul FSDP PyTorchJob

Introduceți Jeton de îmbrățișare în următorul fragment înainte de a-l rula:

Configurați-vă PyTorchJob cu .și V fișier sau direct în variabilele de mediu, după cum urmează:

Generați manifestul PyTorchJob folosind șablon fsdp și genera.sh sau creați-l direct folosind scriptul de mai jos:

Rulați PyTorchJob

Rulați PyTorchJob cu următorul cod:

Veți vedea numărul specificat de pod-uri de lucru FDSP create și, după ce trageți imaginea, acestea vor intra în starea de rulare.

Pentru a vedea starea PyTorchJob, utilizați următorul cod:

Pentru a opri PyTorchJob, utilizați următorul cod:

După ce o lucrare este finalizată, aceasta trebuie să fie șters înainte de a iniția o nouă rulare. De asemenea, am observat că ștergerea fișieruluietcdpod și lăsarea acestuia să repornească înainte de a lansa o nouă lucrare ajută la evitarea a RendezvousClosedError.

Scala clusterul

Puteți repeta pașii precedenți de creare și rulare a joburilor în timp ce variați numărul și tipul de instanță al nodurilor de lucru din cluster. Acest lucru vă permite să produceți diagrame de scalare precum cea prezentată mai devreme. În general, ar trebui să observați o reducere a amprentei memoriei GPU, o reducere a timpului de epocă și o creștere a debitului atunci când sunt adăugate mai multe noduri la cluster. Diagrama anterioară a fost realizată prin efectuarea mai multor experimente folosind un grup de noduri p5 care variază de la 1 la 16 noduri în dimensiune.

Observați volumul de lucru al instruirii FSDP

Observabilitatea sarcinilor de lucru generative de inteligență artificială este importantă pentru a permite vizibilitatea sarcinilor dvs. în desfășurare, precum și pentru a ajuta la maximizarea utilizării resurselor dvs. de calcul. În această postare, folosim câteva instrumente de observabilitate native și open source Kubernetes în acest scop. Aceste instrumente vă permit să urmăriți erorile, statisticile și comportamentul modelului, făcând observabilitatea AI o parte crucială a oricărui caz de utilizare în afaceri. În această secțiune, prezentăm diverse abordări pentru observarea locurilor de muncă de formare FSDP.

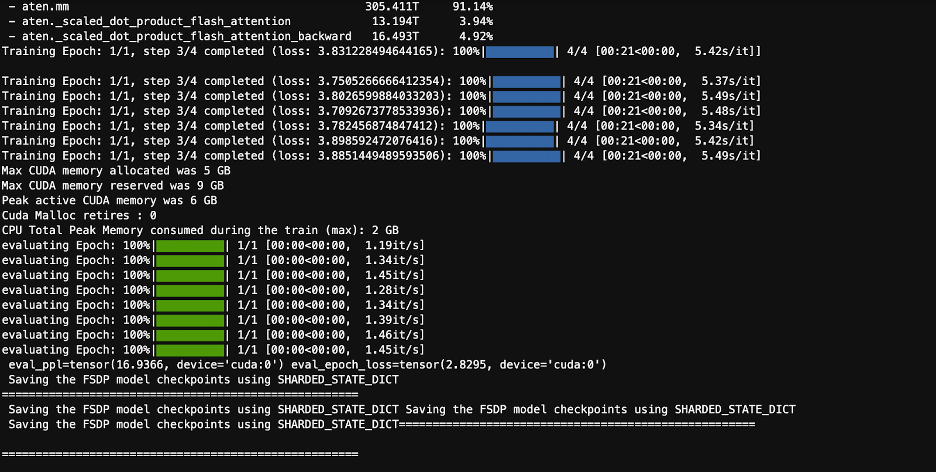

Jurnalele podului lucrătorilor

La cel mai elementar nivel, trebuie să puteți vedea jurnalele podurilor de antrenament. Acest lucru se poate face cu ușurință folosind comenzi native Kubernetes.

Mai întâi, recuperați o listă de poduri și localizați numele celui pentru care doriți să vedeți jurnalele:

Apoi vizualizați jurnalele pentru podul selectat:

Doar un singur log al lucrătorului (lider ales) va lista statisticile generale ale postului. Numele grupului de lider ales este disponibil la începutul fiecărui jurnal al grupului de lucrători, identificat prin cheie master_addr=.

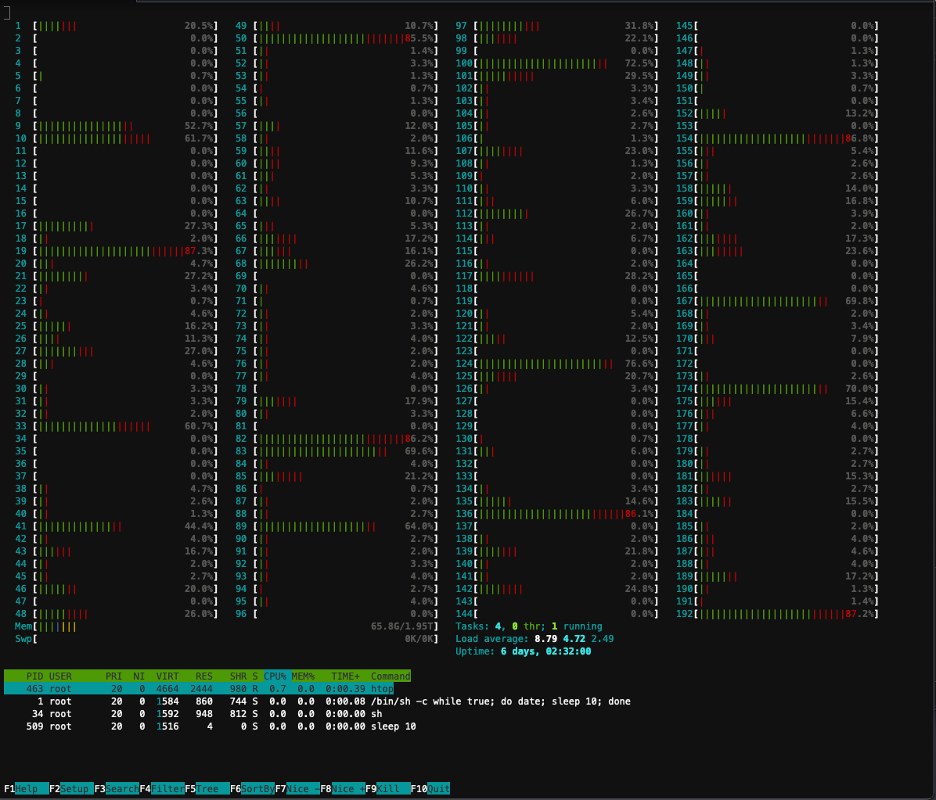

Utilizarea procesorului

Sarcinile de lucru de antrenament distribuite necesită atât resurse CPU, cât și GPU. Pentru a optimiza aceste sarcini de lucru, este important să înțelegeți cum sunt utilizate aceste resurse. Din fericire, sunt disponibile câteva utilități open source grozave care ajută la vizualizarea utilizării CPU și GPU. Pentru vizualizarea utilizării CPU, puteți utilizahtop. Dacă podurile dvs. de lucru conțin acest utilitar, puteți utiliza comanda de mai jos pentru a deschide un shell într-un pod și apoi rulațihtop.

Alternativ, puteți implementa un htopdaemonsetca cel prevăzut în cele ce urmează GitHub repo.

daemonsetva rula un pod htop ușor pe fiecare nod. Puteți executa oricare dintre aceste poduri și rulațihtopcomanda:

Următoarea captură de ecran arată utilizarea CPU pe unul dintre nodurile din cluster. În acest caz, ne uităm la o instanță P5.48xlarge, care are 192 vCPU-uri. Miezurile procesorului sunt inactive în timp ce greutățile modelului sunt descărcate și vedem o utilizare în creștere în timp ce greutățile modelului sunt încărcate în memoria GPU.

Utilizarea GPU

În cazul în carenvtoputilitarul este disponibil în pod, îl puteți executa folosind mai jos și apoi rulaținvtop.

Alternativ, puteți implementa un nvtopdaemonsetca cel prevăzut în cele ce urmează GitHub repo.

Aceasta va rula anvtoppod pe fiecare nod. Puteți executa oricare dintre aceste poduri și puteți rulanvtop:

Următoarea captură de ecran arată utilizarea GPU-ului pe unul dintre nodurile din clusterul de antrenament. În acest caz, ne uităm la o instanță P5.48xlarge, care are 8 GPU-uri NVIDIA H100. GPU-urile sunt inactive în timp ce greutățile modelului sunt descărcate, apoi utilizarea memoriei GPU crește pe măsură ce greutățile modelului sunt încărcate pe GPU, iar utilizarea GPU-ului crește la 100% în timp ce iterațiile de antrenament sunt în curs.

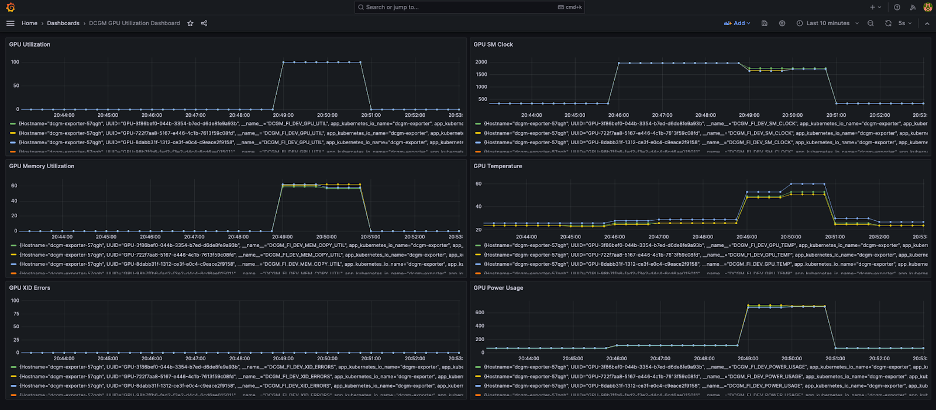

Tabloul de bord Grafana

Acum că înțelegeți cum funcționează sistemul dvs. la nivel de pod și nod, este important să vă uitați și la valorile la nivel de cluster. Valorile de utilizare agregate pot fi colectate de NVIDIA DCGM Exporter și Prometheus și vizualizate în Grafana.

Un exemplu de implementare Prometheus-Grafana este disponibil în cele ce urmează GitHub repo.

Un exemplu de implementare a exportatorului DCGM este disponibil în cele ce urmează GitHub repo.

Un tablou de bord simplu Grafana este afișat în următoarea captură de ecran. A fost construit prin selectarea următoarelor valori DCGM: DCGM_FI_DEV_GPU_UTIL, DCGM_FI_MEM_COPY_UTIL, DCGM_FI_DEV_XID_ERRORS, DCGM_FI_DEV_SM_CLOCK, DCGM_FI_DEV_GPU_TEMP, și DCGM_FI_DEV_POWER_USAGE. Tabloul de bord poate fi importat în Prometheus de la GitHub.

Următorul tablou de bord arată o execuție a unui job de antrenament de o singură epocă Llama2 7b. Graficele arată că, pe măsură ce ceasul multiprocesorului de streaming (SM) crește, consumul de energie și temperatura GPU-urilor cresc, de asemenea, împreună cu GPU și utilizarea memoriei. De asemenea, puteți vedea că nu au existat erori XID și că GPU-urile au fost sănătoase în timpul acestei rulări.

Din martie 2024, observabilitatea GPU pentru EKS este acceptată nativ în Informații despre containerul CloudWatch. Pentru a activa această funcționalitate, trebuie doar să implementați suplimentul CloudWatch Observability în clusterul dvs. EKS. Apoi, veți putea să răsfoiți valorile la nivel de pod, nod și cluster prin tablouri de bord preconfigurate și personalizabile în Container Insights.

A curăța

Dacă v-ați creat clusterul folosind exemplele furnizate în acest blog, puteți executa următorul cod pentru a șterge clusterul și orice resurse asociate acestuia, inclusiv VPC-ul:

De exemplu:

Pentru terraform:

Caracteristici viitoare

Se așteaptă ca FSDP să includă o funcție de fragmentare per parametru, având ca scop să-și îmbunătățească în continuare amprenta de memorie pe GPU. În plus, dezvoltarea continuă a suportului FP8 are ca scop îmbunătățirea performanței FSDP pe GPU-urile H100. În cele din urmă, când FSDP este integrat cutorch.compile, sperăm să vedem îmbunătățiri suplimentare de performanță și activarea unor funcții precum punctele de control selective ale activării.

Concluzie

În această postare, am discutat despre modul în care FSDP reduce amprenta memoriei pe fiecare GPU, permițând antrenarea mai eficientă a modelelor mai mari și realizând o scalare aproape liniară a debitului. Am demonstrat acest lucru printr-o implementare pas cu pas a antrenării unui model Llama2 folosind Amazon EKS pe instanțe P4de și P5 și am folosit instrumente de observabilitate precum kubectl, htop, nvtop și dcgm pentru a monitoriza jurnalele, precum și utilizarea CPU și GPU.

Vă încurajăm să profitați de PyTorch FSDP pentru propriile locuri de muncă de formare LLM. Începeți la aws-do-fsdp.

Despre Autori

Kanwaljit Khurmi este arhitect principal de soluții AI/ML la Amazon Web Services. El lucrează cu clienții AWS pentru a oferi îndrumare și asistență tehnică, ajutându-i să-și îmbunătățească valoarea soluțiilor lor de învățare automată pe AWS. Kanwaljit este specializată în a ajuta clienții cu aplicații de calcul containerizate, distribuite și de deep learning.

Kanwaljit Khurmi este arhitect principal de soluții AI/ML la Amazon Web Services. El lucrează cu clienții AWS pentru a oferi îndrumare și asistență tehnică, ajutându-i să-și îmbunătățească valoarea soluțiilor lor de învățare automată pe AWS. Kanwaljit este specializată în a ajuta clienții cu aplicații de calcul containerizate, distribuite și de deep learning.

Alex Iankoulski este arhitect principal de soluții, învățare automată autogestionată la AWS. Este un inginer de software și infrastructură complet căruia îi place să facă o muncă profundă și practică. În rolul său, el se concentrează pe a ajuta clienții cu containerizarea și orchestrarea sarcinilor de lucru ML și AI pe servicii AWS alimentate de containere. El este și autorul sursei deschise face cadru și un căpitan Docker căruia îi place să aplice tehnologii de containere pentru a accelera ritmul inovației, rezolvând în același timp cele mai mari provocări ale lumii.

Alex Iankoulski este arhitect principal de soluții, învățare automată autogestionată la AWS. Este un inginer de software și infrastructură complet căruia îi place să facă o muncă profundă și practică. În rolul său, el se concentrează pe a ajuta clienții cu containerizarea și orchestrarea sarcinilor de lucru ML și AI pe servicii AWS alimentate de containere. El este și autorul sursei deschise face cadru și un căpitan Docker căruia îi place să aplice tehnologii de containere pentru a accelera ritmul inovației, rezolvând în același timp cele mai mari provocări ale lumii.

Ana Simoes este specialist principal în învățare automată, ML Frameworks la AWS. Ea sprijină clienții care implementează AI, ML și AI generativă la scară largă pe infrastructura HPC din cloud. Ana se concentrează pe sprijinirea clienților pentru a obține un raport preț-performanță pentru noile sarcini de lucru și cazuri de utilizare pentru AI generativă și învățare automată.

Ana Simoes este specialist principal în învățare automată, ML Frameworks la AWS. Ea sprijină clienții care implementează AI, ML și AI generativă la scară largă pe infrastructura HPC din cloud. Ana se concentrează pe sprijinirea clienților pentru a obține un raport preț-performanță pentru noile sarcini de lucru și cazuri de utilizare pentru AI generativă și învățare automată.

Hamid Shojanazeri este inginer partener la PyTorch care lucrează la open source, optimizarea modelelor de înaltă performanță, instruire distribuită (FSDP), și inferență. El este co-creatorul lama-reteta și contribuitor la TorchServe. Principalul său interes este de a îmbunătăți eficiența costurilor, făcând AI mai accesibilă comunității mai largi.

Hamid Shojanazeri este inginer partener la PyTorch care lucrează la open source, optimizarea modelelor de înaltă performanță, instruire distribuită (FSDP), și inferență. El este co-creatorul lama-reteta și contribuitor la TorchServe. Principalul său interes este de a îmbunătăți eficiența costurilor, făcând AI mai accesibilă comunității mai largi.

Mai puțin Wright este un inginer AI/partener în PyTorch. Lucrează pe nuclee Triton/CUDA (Accelerarea Dequant cu descompunerea de lucru SplitK); optimizatori paginați, în flux și cuantificați; și PyTorch Distributed (PyTorch FSDP).

Mai puțin Wright este un inginer AI/partener în PyTorch. Lucrează pe nuclee Triton/CUDA (Accelerarea Dequant cu descompunerea de lucru SplitK); optimizatori paginați, în flux și cuantificați; și PyTorch Distributed (PyTorch FSDP).

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/scale-llms-with-pytorch-2-0-fsdp-on-amazon-eks-part-2/

- :are

- :este

- :Unde

- ][p

- $UP

- 1

- 10

- 100

- 12

- 13

- 16

- 2024

- 28

- 500

- 7

- 70

- 8

- 80

- 800

- a

- Capabil

- Despre Noi

- abstractizată

- accelera

- accelerator

- accesibil

- Cont

- precizie

- Obține

- realizarea

- peste

- Activarea

- Add-on

- adăugat

- Suplimentar

- În plus,

- adresa

- Adaugă

- Adoptarea

- Avantaj

- După

- agregate

- AI

- AI / ML

- Ajutorul

- Urmarind

- isi propune

- TOATE

- permite

- permite

- de asemenea

- mereu

- Amazon

- Amazon EC2

- Amazon Web Services

- sumă

- an

- Ana

- și

- și infrastructură

- Orice

- aplicaţia

- aplicatii

- Aplică

- Aplicarea

- abordari

- arhitectură

- SUNT

- artificial

- inteligență artificială

- AS

- Asistență

- asistenți

- asociate

- At

- autor

- Automatizare

- disponibilitate

- disponibil

- evita

- AWS

- Sold

- barieră

- pocni

- de bază

- BE

- înainte

- Început

- comportament

- fiind

- de mai jos

- Mai bine

- între

- Cea mai mare

- Miliard

- Blog

- atât

- pauze

- mai larg

- construi

- construit

- afaceri

- dar

- by

- CAN

- capacități

- Capacitate

- caz

- cazuri

- CAT

- Centre

- centralizat

- contesta

- provocări

- Diagramă

- Grafice

- cli

- Ceas

- Cloud

- Grup

- cod

- colaborează

- vine

- Comunicare

- comunitate

- comparație

- Completă

- complexitate

- componente

- calcul

- Calcula

- calculator

- Computer Vision

- tehnica de calcul

- efectuarea

- Configuraţie

- conţine

- Recipient

- Containere

- conţinut

- crearea de continut

- context

- continuare

- contribuabil

- controlor

- coordonator

- coordonare

- copiaţi

- Nucleu

- A costat

- crea

- a creat

- Crearea

- creaţie

- crucial

- Curent

- personalizat

- clienţii care

- personalizabil

- personaliza

- tablou de bord

- tablouri de bord

- de date

- centre de date

- seturi de date

- DDP

- adânc

- învățare profundă

- defini

- cerând

- demonstra

- demonstrat

- demonstrează

- implementa

- Implementarea

- desfășurarea

- descrie

- descris

- detaliu

- detaliat

- detalii

- Dezvoltare

- diagramă

- diferit

- direct

- discuta

- discutat

- distribuite

- calcul distribuit

- instruire distribuită

- do

- Docher

- făcut

- Dont

- Descarca

- descărcat

- dramatic

- a desena

- două

- în timpul

- fiecare

- Mai devreme

- uşura

- cu ușurință

- eficiență

- eficient

- eficient

- ales

- îmbrățișare

- permite

- imputernicirea

- permite

- permițând

- încuraja

- capăt

- un capăt la altul

- inginer

- Inginerie

- spori

- Intrați

- Întreg

- Mediu inconjurator

- epocă

- Erori

- exemplu

- exemple

- a executa

- de aşteptat

- experienţă

- experimente

- Explica

- Față

- facilitează

- mai repede

- Caracteristică

- DESCRIERE

- puțini

- Figura

- Fișier

- În cele din urmă

- potrivi

- flexibil

- se concentrează

- următor

- urmă

- Pentru

- din fericire

- cadre

- din

- Complet

- complet

- funcționalitate

- mai mult

- General

- generaţie

- generativ

- AI generativă

- obține

- GitHub

- bine

- GPU

- unități de procesare grafică

- gradienți

- grafice

- mare

- foarte mult

- grup

- Oaspete

- Vizitator Mesaj

- îndrumare

- hands-on

- he

- sănătos

- ajutor

- ajutor

- ajută

- performanta ridicata

- cea mai mare

- lui

- deține

- speranţă

- Cum

- Cum Pentru a

- Totuși

- hpc

- HTML

- http

- HTTPS

- identificat

- Idle

- if

- ilustrează

- imagine

- implementarea

- important

- îmbunătăţi

- îmbunătățiri

- in

- include

- Inclusiv

- Crește

- a crescut

- Creșteri

- tot mai mult

- info

- informații

- Infrastructură

- Inovaţie

- perspective

- instanță

- in schimb

- integrate

- integrările

- Inteligență

- interes

- în

- IT

- iterații

- ESTE

- Loc de munca

- Locuri de munca

- jpeg

- jpg

- JSON

- doar

- Cheie

- Copil

- KubeFlow

- etichete

- limbă

- mare

- pe scară largă

- mai mare

- cea mai mare

- Nume

- lansare

- lider

- învăţare

- mai puțin

- închiriere

- Nivel

- Bibliotecă

- categorie ușoară

- ca

- îi place

- limitare

- Limitat

- Limitele

- liniar

- Listă

- LLM

- situat

- log

- Logare

- Uite

- cautati

- iubeste

- maşină

- masina de învățare

- Principal

- Efectuarea

- administra

- flexibil

- gestionate

- manieră

- multe

- Martie

- Martie 2024

- maximizarea

- Mai..

- mecanism

- Memorie

- meta

- Metadata

- Metrici

- mixt

- ML

- model

- Modele

- Modern

- monitor

- mai mult

- cele mai multe

- nume

- nativ

- Natural

- Procesarea limbajului natural

- În apropiere

- Nevoie

- nevoilor

- reţea

- rețele

- Nou

- nlp

- Nu.

- nod

- noduri

- număr

- Nvidia

- of

- oferi

- promoții

- on

- ONE

- în curs de desfășurare

- afară

- pe

- deschide

- open-source

- operaţie

- operator

- optimizare

- optimizări

- Optimizați

- or

- orchestrație

- OS

- Altele

- al nostru

- afară

- producție

- global

- Învinge

- deasupra

- propriu

- Pace

- Paralel

- parametrii

- parte

- participante

- partener

- trece

- cale

- pentru

- performanță

- plan

- Plato

- Informații despre date Platon

- PlatoData

- Joaca

- Popular

- Post

- putere

- puternic

- precedent

- premise

- păstrarea

- precedent

- Principal

- anterior

- proces

- procese

- prelucrare

- procesor

- produce

- Produs

- proiect

- dovedit

- furniza

- prevăzut

- trăgând

- scop

- Împinge

- pirtorh

- calitate

- gamă

- gata

- reduce

- reducere

- trimite

- referințe

- menționat

- regiune

- registru

- legate de

- încredere

- repeta

- răspunde

- cereri de

- necesita

- Cerinţe

- Necesită

- cercetare

- resursă

- Resurse

- rezultat

- REZULTATE

- în creștere

- robust

- Rol

- Alerga

- funcţionare

- scalabilitate

- scalabil

- Scară

- scalare

- scenariu

- script-uri

- perfect

- Secțiune

- secțiuni

- securitate

- vedea

- selectate

- selectarea

- selectiv

- serie

- serviciu

- Servicii

- set

- câteva

- ascuțit

- sharding

- ea

- Coajă

- să

- Arăta

- indicat

- Emisiuni

- semnificativ

- asemănător

- simplu

- simplitate

- Simplifică

- singur

- Mărimea

- dimensiuni

- Felie

- mai mici

- fragment

- Software

- soluţie

- soluţii

- Rezolvarea

- unele

- Sursă

- specialist

- specializată

- specificată

- viteze

- piroane

- stivui

- început

- Stat

- Statele

- statistică

- Stare

- paşi

- Încă

- Stop

- strategii

- de streaming

- astfel de

- Costum

- a sustine

- Suportat

- De sprijin

- Sprijină

- sincronizare

- SYS

- sistem

- Lua

- luare

- Ţintă

- sarcini

- echipă

- Tehnic

- tehnică

- tehnici de

- Tehnologii

- șablon

- Terraform

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- acea

- lor

- Lor

- apoi

- Acolo.

- Acestea

- ei

- acest

- aceste

- trei

- Prin

- debit

- timp

- consumă timp

- la

- astăzi

- împreună

- indicativele

- Unelte

- urmări

- Tren

- dresat

- Pregătire

- Traducere

- Trilion

- adevărat

- ton

- Două

- tip

- în cele din urmă

- înţelege

- In curs

- us

- utilizare

- carcasa de utilizare

- utilizat

- utilizări

- folosind

- utilitati

- utilitate

- utilizate

- valoare

- varietate

- diverse

- variabil

- verifica

- versiune

- foarte

- de

- Vizualizare

- vizionează

- Virtual

- vizibilitate

- viziune

- imagina

- volume

- walkthrough

- vrea

- a fost

- we

- web

- servicii web

- BINE

- au fost

- cand

- care

- în timp ce

- OMS

- voi

- cu

- în

- Apartamente

- lucrător

- muncitorii

- flux de lucru

- de lucru

- fabrică

- lume

- ambalaj

- yaml

- ani

- Tu

- Ta

- zephyrnet