Amazon RedShift este cel mai popular depozit de date cloud care este folosit de zeci de mii de clienți pentru a analiza exaocteți de date în fiecare zi. Mulți practicieni extind aceste seturi de date Redshift la scară pentru utilizarea machine learning (ML). Amazon SageMaker, un serviciu ML gestionat complet, cu cerințe pentru a dezvolta funcții offline într-un mod de cod sau de cod redus/fără cod, pentru a stoca date prezentate de la Amazon Redshift și pentru a face acest lucru să se întâmple la scară într-un mediu de producție.

În această postare, vă arătăm trei opțiuni pentru a pregăti datele sursă Redshift la scară în SageMaker, inclusiv încărcarea datelor din Amazon Redshift, efectuarea ingineriei caracteristicilor și ingerarea de funcții în Magazinul de caracteristici Amazon SageMaker:

Dacă sunteți utilizator AWS Glue și doriți să faceți procesul în mod interactiv, luați în considerare opțiunea A. Dacă sunteți familiarizat cu SageMaker și scrieți codul Spark, opțiunea B ar putea fi alegerea dvs. Dacă doriți să faceți procesul într-un mod low-code/fără cod, puteți urma opțiunea C.

Amazon Redshift utilizează SQL pentru a analiza date structurate și semi-structurate din depozite de date, baze de date operaționale și lacuri de date, folosind hardware-ul proiectat de AWS și ML pentru a oferi cel mai bun preț-performanță la orice scară.

SageMaker Studio este primul mediu de dezvoltare complet integrat (IDE) pentru ML. Oferă o interfață vizuală unică bazată pe web, unde puteți efectua toți pașii de dezvoltare ML, inclusiv pregătirea datelor și construirea, instruirea și implementarea modelelor.

AWS Glue este un serviciu de integrare a datelor fără server, care facilitează descoperirea, pregătirea și combinarea datelor pentru analiză, ML și dezvoltarea de aplicații. AWS Glue vă permite să colectați, să transformați, să curățați și să pregătiți fără probleme date pentru stocare în lacurile de date și conductele dvs. de date, folosind o varietate de capabilități, inclusiv transformări încorporate.

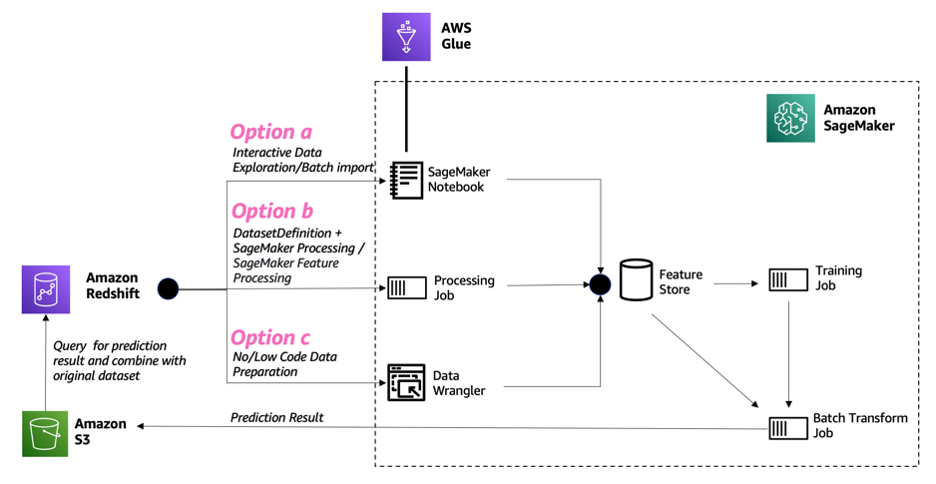

Prezentare generală a soluțiilor

Următoarea diagramă ilustrează arhitectura soluției pentru fiecare opțiune.

Cerințe preliminare

Pentru a continua cu exemplele din această postare, trebuie să creați resursele AWS necesare. Pentru a face acest lucru, oferim un Formarea AWS Cloud șablon pentru a crea o stivă care conține resursele. Când creați stiva, AWS creează o serie de resurse în contul dvs.:

- Un domeniu SageMaker, care include un domeniu asociat Sistem de fișiere elastice Amazon (Amazon EFS) volum

- O listă de utilizatori autorizați și o varietate de securitate, aplicații, politici și Cloud virtual virtual Amazon configurații (Amazon VPC).

- Un cluster Redshift

- Un secret Redshift

- O conexiune AWS Glue pentru Amazon Redshift

- An AWS Lambdas funcția de a configura resursele necesare, roluri de execuție și politici

Asigurați-vă că nu aveți deja două domenii SageMaker Studio în regiunea în care rulați șablonul CloudFormation. Acesta este numărul maxim permis de domenii în fiecare regiune acceptată.

Implementați șablonul CloudFormation

Parcurgeți următorii pași pentru a implementa șablonul CloudFormation:

- Salvați șablonul CloudFormation sm-redshift-demo-vpc-cfn-v1.yaml la nivel local.

- În consola AWS CloudFormation, alegeți Creați stivă.

- Pentru Pregătiți șablonul, Selectați Șablonul este gata.

- Pentru Sursa șablonului, Selectați Încărcați un fișier șablon.

- Alege Alegeți Fișier și navigați la locația de pe computer unde a fost descărcat șablonul CloudFormation și alegeți fișierul.

- Introduceți un nume de stivă, cum ar fi

Demo-Redshift. - Pe Configurați opțiunile stivei pagina, lăsați totul ca implicit și alegeți Pagina Următoare →.

- Pe Recenzie pagina, selectați Recunosc că AWS CloudFormation ar putea crea resurse IAM cu nume personalizate Și alegeți Creați stivă.

Ar trebui să vedeți o nouă stivă CloudFormation cu numele Demo-Redshift fiind creat. Așteptați ca starea stivei să fie CREATE_COMPLETE (aproximativ 7 minute) înainte de a trece mai departe. Puteți naviga la stiva Resurse pentru a verifica ce resurse AWS au fost create.

Lansați SageMaker Studio

Parcurgeți următorii pași pentru a vă lansa domeniul SageMaker Studio:

- Pe consola SageMaker, alegeți domenii în panoul de navigare.

- Alegeți domeniul pe care l-ați creat ca parte a stivei CloudFormation (

SageMakerDemoDomain). - Alege Lansa și Studio.

Încărcarea acestei pagini poate dura 1–2 minute când accesați SageMaker Studio pentru prima dată, după care veți fi redirecționat către un Acasă tab.

Descărcați depozitul GitHub

Parcurgeți următorii pași pentru a descărca depozitul GitHub:

- În caietul SageMaker, pe Fișier meniu, alegeți Nou și Terminal.

- În terminal, introduceți următoarea comandă:

Acum puteți vedea amazon-sagemaker-featurestore-redshift-integration folderul din panoul de navigare al SageMaker Studio.

Configurați asimilarea lotului cu conectorul Spark

Parcurgeți următorii pași pentru a configura asimilarea lotului:

- În SageMaker Studio, deschideți blocnotesul 1-uploadJar.ipynb în

amazon-sagemaker-featurestore-redshift-integration. - Dacă vi se solicită să alegeți un nucleu, alegeți Știința datelor ca imaginea si Python 3 ca nucleu, apoi alegeți Selectați.

- Pentru următoarele notebook-uri, alegeți aceeași imagine și același nucleu, cu excepția blocnotesului AWS Glue Interactive Sessions (4a).

- Rulați celulele apăsând Shift + Enter în fiecare dintre celule.

În timp ce codul rulează, între paranteze pătrate apare un asterisc (*). Când codul s-a terminat de rulat, * va fi înlocuit cu numere. Această acțiune este valabilă și pentru toate celelalte notebook-uri.

Configurați schema și încărcați datele în Amazon Redshift

Următorul pas este să configurați schema și să încărcați datele din Serviciul Amazon de stocare simplă (Amazon S3) către Amazon Redshift. Pentru a face acest lucru, rulați notebook-ul 2-loadredshiftdata.ipynb.

Creați magazine de caracteristici în Magazin de funcții SageMaker

Pentru a vă crea magazinele de caracteristici, rulați blocnotesul 3-createFeatureStore.ipynb.

Efectuați inginerie de caracteristici și asimilați caracteristici în Magazinul de funcții SageMaker

În această secțiune, prezentăm pașii pentru toate cele trei opțiuni pentru a efectua ingineria caracteristicilor și a ingera caracteristicile procesate în Magazinul de funcții SageMaker.

Opțiunea A: Utilizați SageMaker Studio cu o sesiune interactivă AWS Glue fără server

Parcurgeți următorii pași pentru opțiunea A:

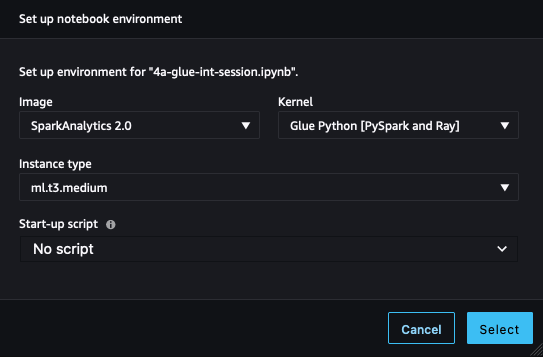

- În SageMaker Studio, deschideți blocnotesul 4a-glue-int-session.ipynb.

- Dacă vi se solicită să alegeți un nucleu, alegeți SparkAnalytics 2.0 ca imaginea si Glue Python [PySpark și Ray] ca nucleu, apoi alegeți Selectați.

Procesul de pregătire a mediului poate dura ceva timp.

Opțiunea B: Utilizați o lucrare de procesare SageMaker cu Spark

În această opțiune, folosim o lucrare de procesare SageMaker cu un script Spark pentru a încărca setul de date original din Amazon Redshift, pentru a efectua inginerie de caracteristici și pentru a ingera datele în Magazinul de caracteristici SageMaker. Pentru a face acest lucru, deschideți blocnotesul 4b-procesare-rs-la-fs.ipynb în mediul dumneavoastră SageMaker Studio.

Aici folosim RedshiftDatasetDefinition pentru a prelua setul de date din clusterul Redshift. RedshiftDatasetDefinition este un tip de intrare a jobului de procesare, care oferă o interfață simplă pentru ca practicieni să configureze parametrii legați de conexiunea Redshift, cum ar fi identificatorul, baza de date, tabelul, șirul de interogări și multe altele. Puteți stabili cu ușurință conexiunea Redshift folosind RedshiftDatasetDefinition fără a menține o conexiune cu normă întreagă. De asemenea, folosim SageMaker Feature Store Biblioteca de conectori Spark în jobul de procesare pentru a vă conecta la SageMaker Feature Store într-un mediu distribuit. Cu acest conector Spark, puteți asimila cu ușurință date în magazinul online și offline al grupului de caracteristici dintr-un Spark DataFrame. De asemenea, acest conector conține funcționalitatea de a încărca automat definițiile caracteristicilor pentru a ajuta la crearea grupurilor de caracteristici. Mai presus de toate, această soluție vă oferă o modalitate nativă Spark de a implementa o conductă de date end-to-end de la Amazon Redshift la SageMaker. Puteți efectua orice inginerie de caracteristică într-un context Spark și puteți asimila caracteristici finale în Magazinul de funcții SageMaker într-un singur proiect Spark.

Pentru a utiliza conectorul SageMaker Feature Store Spark, extindem un conector pre-construit Container SageMaker Spark cu sagemaker-feature-store-pyspark instalat. În scriptul Spark, utilizați comanda executabilă de sistem pentru a rula pip install, instalați această bibliotecă în mediul dvs. local și obțineți calea locală a dependenței de fișier JAR. În API-ul jobului de procesare, furnizați această cale către parametrul de submit_jars la nodul clusterului Spark pe care îl creează jobul de procesare.

În scriptul Spark pentru jobul de procesare, citim mai întâi fișierele originale ale setului de date de pe Amazon S3, care stochează temporar setul de date descărcat de la Amazon Redshift ca mediu. Apoi efectuăm ingineria caracteristicilor într-un mod Spark și utilizăm feature_store_pyspark pentru a ingera date în magazinul de funcții offline.

Pentru lucrarea de procesare, oferim a ProcessingInput cu redshift_dataset_definition. Aici construim o structură conform interfeței, oferind configurații legate de conexiunea Redshift. Poți să folosești query_string pentru a filtra setul de date după SQL și a-l descărca pe Amazon S3. Vezi următorul cod:

Trebuie să așteptați 6–7 minute pentru fiecare lucrare de procesare, inclusiv USER, PLACE, și RATING seturi de date.

Pentru mai multe detalii despre joburile de procesare SageMaker, consultați Procesarea datelor.

Pentru soluțiile native SageMaker pentru procesarea caracteristicilor de la Amazon Redshift, puteți utiliza și Procesarea caracteristicilor în SageMaker Feature Store, care este pentru infrastructura de bază, inclusiv furnizarea de medii de calcul și crearea și întreținerea conductelor SageMaker pentru a încărca și a ingera date. Vă puteți concentra doar pe definițiile procesorului de caracteristici care includ funcții de transformare, sursa Amazon Redshift și receptorul SageMaker Feature Store. Programarea, gestionarea sarcinilor și alte sarcini de lucru din producție sunt gestionate de SageMaker. Conductele de procesor de caracteristici sunt conducte SageMaker, deci mecanisme standard de monitorizare și integrări sunt disponibile.

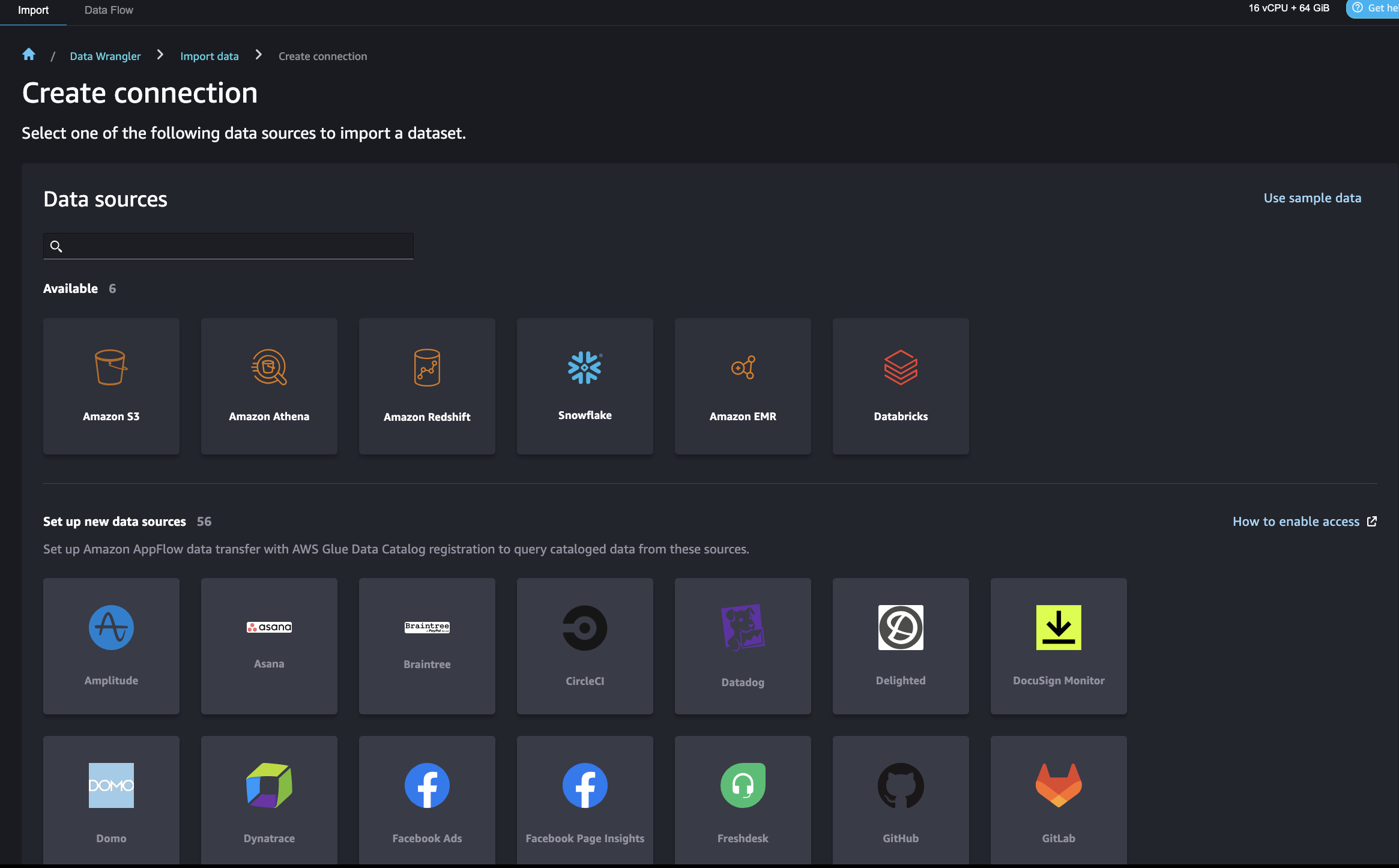

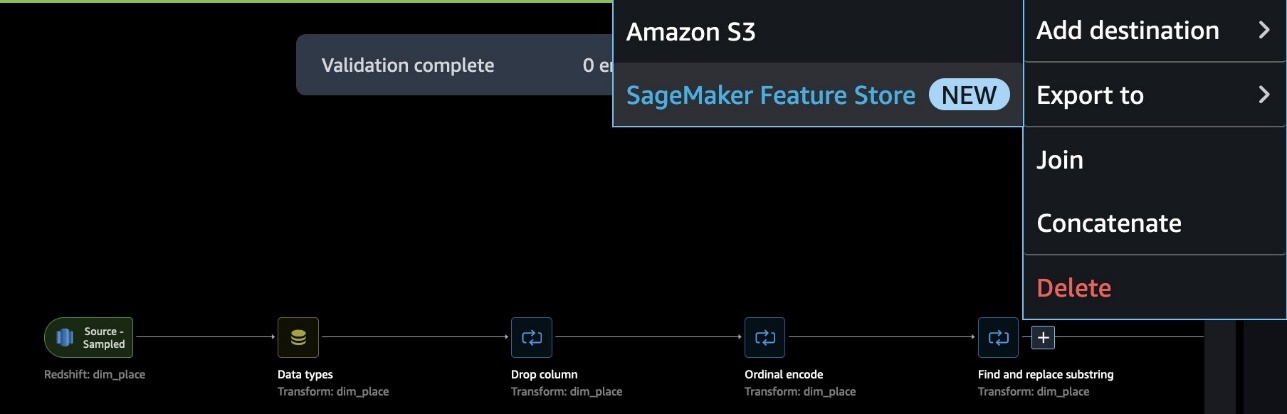

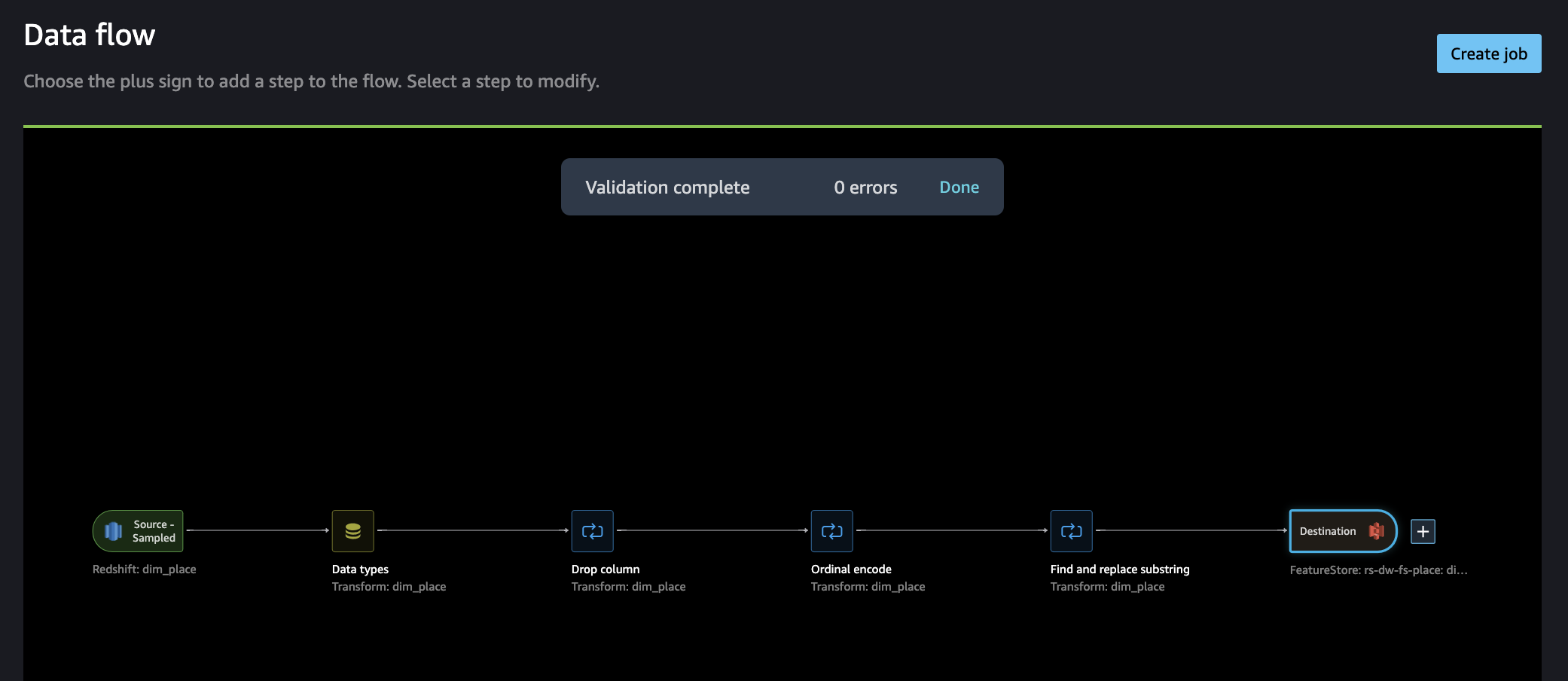

Opțiunea C: Utilizați SageMaker Data Wrangler

SageMaker Data Wrangler vă permite să importați date din diverse surse de date, inclusiv Amazon Redshift, pentru un mod low-code/fără cod de a vă pregăti, transforma și prezenta datele. După ce terminați pregătirea datelor, puteți utiliza SageMaker Data Wrangler pentru a exporta caracteristici în SageMaker Feature Store.

Există unele Gestionarea identității și accesului AWS (IAM) care permit lui SageMaker Data Wrangler să se conecteze la Amazon Redshift. Mai întâi, creați un rol IAM (de exemplu, redshift-s3-dw-connect) care include o politică de acces Amazon S3. Pentru această postare, am atașat AmazonS3FullAccess politică la rolul IAM. Dacă aveți restricții de accesare a unui compartiment S3 specificat, îl puteți defini în politica de acces Amazon S3. Am atașat rolul IAM clusterului Redshift pe care l-am creat mai devreme. Apoi, creați o politică pentru ca SageMaker să acceseze Amazon Redshift obținând acreditările de cluster și atașați politica rolului IAM SageMaker. Politica arată ca următorul cod:

După această configurare, SageMaker Data Wrangler vă permite să interogați Amazon Redshift și să scoateți rezultatele într-o găleată S3. Pentru instrucțiuni privind conectarea la un cluster Redshift și interogarea și importarea datelor din Amazon Redshift în SageMaker Data Wrangler, consultați Importați date din Amazon Redshift.

SageMaker Data Wrangler oferă o selecție de peste 300 de transformări de date pre-construite pentru cazuri de utilizare obișnuite, cum ar fi ștergerea rândurilor duplicate, imputarea datelor lipsă, codificarea one-hot și gestionarea datelor din seria temporală. De asemenea, puteți adăuga transformări personalizate în panda sau PySpark. În exemplul nostru, am aplicat câteva transformări, cum ar fi coloana drop, impunerea tipului de date și codificarea ordinală la date.

Când fluxul de date este complet, îl puteți exporta în SageMaker Feature Store. În acest moment, trebuie să creați un grup de caracteristici: dați un nume grupului de caracteristici, selectați spațiul de stocare online și offline, furnizați numele unui compartiment S3 de utilizat pentru magazinul offline și furnizați un rol care are acces la Magazinul de caracteristici SageMaker . În cele din urmă, puteți crea un job, care creează un job de procesare SageMaker care rulează fluxul SageMaker Data Wrangler pentru a asimila caracteristici din sursa de date Redshift în grupul dvs. de caracteristici.

Iată un flux de date de la capăt la capăt în scenariul ingineriei caracteristicilor PLACE.

Utilizați Magazinul de funcții SageMaker pentru instruirea modelului și predicție

Pentru a utiliza magazinul de funcții SageMaker pentru antrenamentul modelului și predicție, deschideți blocnotesul 5-clasificare-folosind-grupuri-de-caracteristici.ipynb.

După ce datele Redshift sunt transformate în caracteristici și ingerate în Magazinul de caracteristici SageMaker, caracteristicile sunt disponibile pentru căutare și descoperire în cadrul echipelor de cercetători responsabili de multe modele independente ML și cazuri de utilizare. Aceste echipe pot folosi caracteristicile pentru modelare fără a fi nevoie să reconstruiască sau să ruleze din nou conductele de inginerie a caracteristicilor. Grupurile de caracteristici sunt gestionate și scalate independent și pot fi reutilizate și unite, indiferent de sursa de date din amonte.

Următorul pas este de a construi modele ML folosind caracteristici selectate dintr-unul sau mai multe grupuri de caracteristici. Tu decizi ce grupuri de caracteristici să folosești pentru modelele tale. Există două opțiuni pentru a crea un set de date ML din grupuri de caracteristici, ambele utilizând SDK-ul SageMaker Python:

- Utilizați API-ul SageMaker Feature Store DatasetBuilder – Magazinul de funcții SageMaker

DatasetBuilderAPI le permite oamenilor de știință să creeze seturi de date ML din unul sau mai multe grupuri de caracteristici din magazinul offline. Puteți utiliza API-ul pentru a crea un set de date dintr-un singur sau mai multe grupuri de caracteristici și pentru a-l scoate ca fișier CSV sau cadru de date panda. Vedeți următorul exemplu de cod:

- Rulați interogări SQL utilizând funcția athena_query din API FeatureGroup – O altă opțiune este să utilizați catalogul de date AWS Glue construit automat pentru API-ul FeatureGroup. API-ul FeatureGroup include un

Athena_queryfuncție care creează o instanță AthenaQuery pentru a rula șiruri de interogări SQL definite de utilizator. Apoi rulați interogarea Athena și organizați rezultatul interogării într-un Pandas DataFrame. Această opțiune vă permite să specificați interogări SQL mai complicate pentru a extrage informații dintr-un grup de caracteristici. Vedeți următorul exemplu de cod:

Apoi, putem îmbina datele interogate din diferite grupuri de caracteristici în setul nostru de date final pentru instruirea și testarea modelului. Pentru această postare, folosim transformarea lotului pentru inferența modelului. Transformarea lotului vă permite să obțineți model de inferene pe o mare parte de date în Amazon S3, iar rezultatul său de inferență este stocat și în Amazon S3. Pentru detalii despre antrenamentul modelului și inferența, consultați notebook-ul 5-clasificare-folosind-grupuri-de-caracteristici.ipynb.

Rulați o interogare de alăturare pe rezultatele predicției în Amazon Redshift

În cele din urmă, interogăm rezultatul inferenței și îl unim cu profilurile de utilizator originale în Amazon Redshift. Pentru a face acest lucru, folosim Amazon Redshift Spectrum pentru a alătura rezultatelor predicției lot în Amazon S3 cu datele originale Redshift. Pentru detalii, consultați rularea notebook-ului 6-read-results-in-redshift.ipynb.

A curăța

În această secțiune, vă oferim pașii pentru a curăța resursele create ca parte a acestei postări pentru a evita taxele continue.

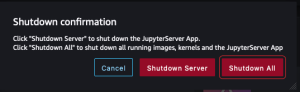

Închideți aplicațiile SageMaker

Parcurgeți următorii pași pentru a vă închide resursele:

- În SageMaker Studio, pe Fișier meniu, alegeți Închide.

- În Confirmarea închiderii dialog, alegeți Închideți toate a continua.

- După ce primiți mesajul „Server oprit”, puteți închide această filă.

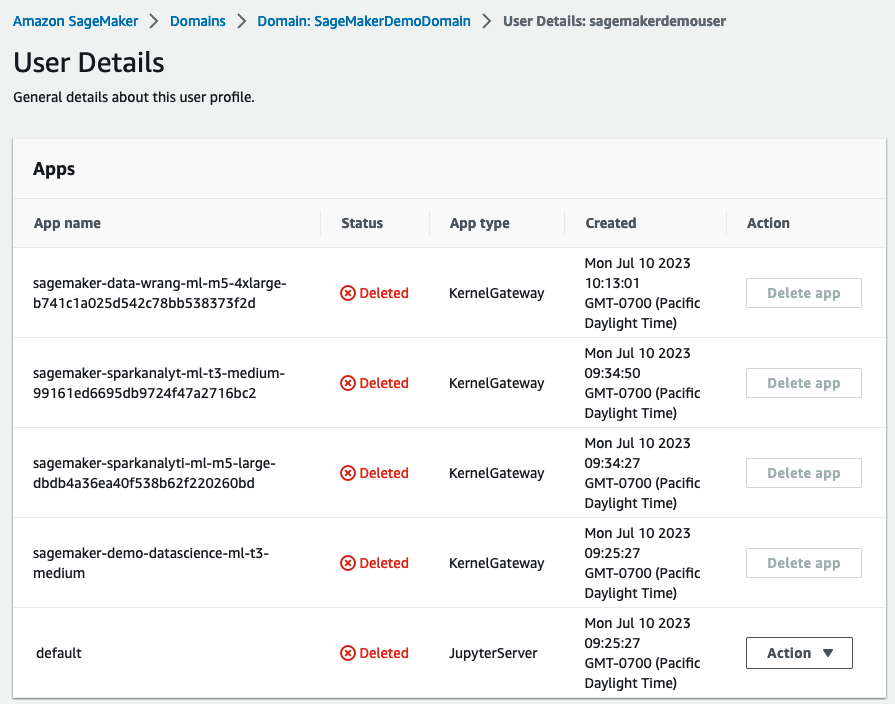

Ștergeți aplicațiile

Parcurgeți următorii pași pentru a vă șterge aplicațiile:

- Pe consola SageMaker, în panoul de navigare, alegeți domenii.

- Pe domenii pagina, alege

SageMakerDemoDomain. - Pe pagina cu detaliile domeniului, sub Profilurile utilizatorilor, alegeți utilizatorul

sagemakerdemouser. - În Aplicații secțiune, în Acțiune coloană, alegeți Ștergeți aplicația pentru orice aplicație activă.

- Asigurați-vă că Stare coloana spune Eliminat pentru toate aplicațiile.

Ștergeți volumul de stocare EFS asociat domeniului dvs. SageMaker

Găsiți volumul dvs. EFS pe consola SageMaker și ștergeți-l. Pentru instrucțiuni, consultați Gestionați-vă volumul de stocare Amazon EFS în SageMaker Studio.

Ștergeți gălețile S3 implicite pentru SageMaker

Ștergeți gălețile S3 implicite (sagemaker-<region-code>-<acct-id>) pentru SageMaker Dacă nu utilizați SageMaker în acea regiune.

Ștergeți stiva CloudFormation

Ștergeți stiva CloudFormation din contul dvs. AWS pentru a curăța toate resursele aferente.

Concluzie

În această postare, am demonstrat un flux de date și ML end-to-end de la un depozit de date Redshift la SageMaker. Puteți utiliza cu ușurință integrarea nativă AWS a motoarelor create special pentru a parcurge fără probleme călătoria datelor. Verificați Blogul AWS pentru mai multe practici despre construirea caracteristicilor ML dintr-un depozit de date modern.

Despre Autori

Akhilesh Dube, un arhitect senior de soluții de analiză la AWS, are peste două decenii de experiență în lucrul cu baze de date și produse de analiză. Rolul său principal implică colaborarea cu clienții întreprinderilor pentru a proiecta soluții robuste de analiză a datelor, oferind în același timp îndrumări tehnice complete pentru o gamă largă de servicii AWS Analytics și AI/ML.

Akhilesh Dube, un arhitect senior de soluții de analiză la AWS, are peste două decenii de experiență în lucrul cu baze de date și produse de analiză. Rolul său principal implică colaborarea cu clienții întreprinderilor pentru a proiecta soluții robuste de analiză a datelor, oferind în același timp îndrumări tehnice complete pentru o gamă largă de servicii AWS Analytics și AI/ML.

Ren Guo este arhitect senior de soluții de specialitate în date în domeniile AI generative, analize și AI/ML tradiționale la AWS, Regiunea Chinei Mari.

Ren Guo este arhitect senior de soluții de specialitate în date în domeniile AI generative, analize și AI/ML tradiționale la AWS, Regiunea Chinei Mari.

Sherry Ding este arhitect senior în soluții de specialitate AI/ML. Are o vastă experiență în învățarea automată cu un doctorat în Informatică. Ea lucrează în principal cu clienții din sectorul public la diverse provocări de afaceri legate de AI/ML, ajutându-i să-și accelereze călătoria de învățare automată pe AWS Cloud. Când nu ajută clienții, îi plac activitățile în aer liber.

Sherry Ding este arhitect senior în soluții de specialitate AI/ML. Are o vastă experiență în învățarea automată cu un doctorat în Informatică. Ea lucrează în principal cu clienții din sectorul public la diverse provocări de afaceri legate de AI/ML, ajutându-i să-și accelereze călătoria de învățare automată pe AWS Cloud. Când nu ajută clienții, îi plac activitățile în aer liber.

Mark Roy este arhitect principal de învățare automată pentru AWS, ajutând clienții să proiecteze și să construiască soluții AI/ML. Lucrarea lui Mark acoperă o gamă largă de cazuri de utilizare ML, cu un interes principal în viziunea computerizată, învățarea profundă și scalarea ML în întreaga întreprindere. El a ajutat companii din multe industrii, inclusiv asigurări, servicii financiare, mass-media și divertisment, asistență medicală, utilități și producție. Mark deține șase certificări AWS, inclusiv certificarea de specialitate ML. Înainte de a se alătura AWS, Mark a fost arhitect, dezvoltator și lider tehnologic timp de peste 25 de ani, inclusiv 19 ani în servicii financiare.

Mark Roy este arhitect principal de învățare automată pentru AWS, ajutând clienții să proiecteze și să construiască soluții AI/ML. Lucrarea lui Mark acoperă o gamă largă de cazuri de utilizare ML, cu un interes principal în viziunea computerizată, învățarea profundă și scalarea ML în întreaga întreprindere. El a ajutat companii din multe industrii, inclusiv asigurări, servicii financiare, mass-media și divertisment, asistență medicală, utilități și producție. Mark deține șase certificări AWS, inclusiv certificarea de specialitate ML. Înainte de a se alătura AWS, Mark a fost arhitect, dezvoltator și lider tehnologic timp de peste 25 de ani, inclusiv 19 ani în servicii financiare.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. Automobile/VE-uri, carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- ChartPrime. Crește-ți jocul de tranzacționare cu ChartPrime. Accesați Aici.

- BlockOffsets. Modernizarea proprietății de compensare a mediului. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/build-ml-features-at-scale-with-amazon-sagemaker-feature-store-using-data-from-amazon-redshift/

- :are

- :este

- :nu

- :Unde

- $UP

- 100

- 11

- 12

- 15%

- 19

- 23

- 25

- 7

- a

- Despre Noi

- mai sus

- accelera

- acces

- accesarea

- Conform

- Cont

- recunoaște

- peste

- Acțiune

- activ

- activităţi de

- adăuga

- După

- AI

- AI / ML

- TOATE

- permite

- permis

- permite

- deja

- de asemenea

- Amazon

- Amazon RedShift

- Amazon SageMaker

- Amazon Web Services

- an

- Google Analytics

- analiza

- și

- O alta

- Orice

- api

- apare

- aplicație

- Dezvoltare de Aplicații

- aplicat

- aproximativ

- Apps

- arhitectură

- SUNT

- AS

- asociate

- At

- atașa

- autorizat

- în mod automat

- disponibil

- evita

- AWS

- Formarea AWS Cloud

- AWS Adeziv

- de bază

- BE

- înainte

- fiind

- CEL MAI BUN

- între

- atât

- construi

- Clădire

- afaceri

- by

- CAN

- capacități

- cazuri

- catalog

- Celule

- Certificare

- certificări

- provocări

- taxe

- verifica

- China

- alegere

- Alege

- clientii

- Închide

- Cloud

- Grup

- cod

- colaborarea

- colecta

- Coloană

- combina

- Comun

- Companii

- Completă

- complicat

- cuprinzător

- Calcula

- calculator

- Informatică

- Computer Vision

- confirmare

- Conectați

- conexiune

- Lua în considerare

- Consoleze

- conține

- context

- continua

- ar putea

- Covers

- crea

- a creat

- creează

- Crearea

- scrisori de acreditare

- personalizat

- clienţii care

- de date

- Analiza datelor

- Pregătirea datelor

- Baza de date

- baze de date

- seturi de date

- zi

- zeci de ani

- decide

- adânc

- învățare profundă

- Mod implicit

- defini

- Definitii

- Grad

- livra

- demonstrat

- Dependenţă

- implementa

- Implementarea

- Amenajări

- detalii

- dezvolta

- Dezvoltator

- Dezvoltare

- diferit

- descoperi

- descoperire

- distribuite

- do

- domeniu

- domenii

- Dont

- jos

- Descarca

- Picătură

- fiecare

- Mai devreme

- cu ușurință

- uşor

- efect

- permite

- un capăt la altul

- executare

- Inginerie

- Motoare

- Intrați

- Afacere

- Divertisment

- Mediu inconjurator

- medii

- stabili

- Fiecare

- in fiecare zi

- tot

- exemplu

- exemple

- Cu excepția

- execuție

- experienţă

- expertiză

- exporturile

- extinde

- extindere

- extensiv

- Experiență vastă

- extrage

- familiar

- Caracteristică

- Recomandate

- FeatureGroup

- DESCRIERE

- Fișier

- Fişiere

- filtru

- final

- În cele din urmă

- financiar

- Servicii financiare

- termina

- First

- prima dată

- debit

- Concentra

- urma

- următor

- Pentru

- din

- Complet

- complet

- funcţie

- funcționalitate

- funcții

- generativ

- AI generativă

- obține

- obtinerea

- GitHub

- Da

- Go

- mai mare

- grup

- Grupului

- îndrumare

- Manipularea

- întâmpla

- Piese metalice

- Avea

- având în

- he

- de asistență medicală

- ajutor

- a ajutat

- ajutor

- aici

- lui

- deține

- HTML

- http

- HTTPS

- identificator

- Identitate

- if

- ilustrează

- imagine

- punerea în aplicare a

- import

- in

- include

- include

- Inclusiv

- independent

- independent

- industrii

- informații

- Infrastructură

- intrare

- instala

- instalat

- instanță

- instrucțiuni

- asigurare

- integrate

- integrare

- interactiv

- interes

- interfaţă

- în

- IT

- ESTE

- Loc de munca

- Locuri de munca

- alătura

- alăturat

- aderarea

- călătorie

- jpg

- doar

- doar unul

- lansa

- lider

- învăţare

- Părăsi

- Bibliotecă

- ca

- Listă

- încărca

- încărcare

- local

- la nivel local

- locaţie

- Se pare

- maşină

- masina de învățare

- mai ales

- Mentine

- face

- FACE

- gestionate

- administrare

- de fabricaţie

- multe

- marca

- Lui Mark

- maxim

- Mai..

- mecanisme

- Mass-media

- mediu

- Meniu

- Îmbina

- mesaj

- ar putea

- minute

- dispărut

- ML

- model

- modelare

- Modele

- Modern

- Monitorizarea

- mai mult

- cele mai multe

- Cel mai popular

- în mişcare

- multiplu

- nume

- nativ

- Navigaţi

- Navigare

- Nevoie

- Nou

- următor

- nod

- caiet

- acum

- număr

- numere

- of

- oferind

- promoții

- Offline

- on

- ONE

- în curs de desfășurare

- on-line

- afară

- deschide

- operațional

- Opțiune

- Opţiuni

- or

- original

- Altele

- al nostru

- afară

- producție

- peste

- pagină

- panda

- pâine

- parametru

- parametrii

- parte

- cale

- Efectua

- efectuarea

- PhD

- conducte

- Loc

- Plato

- Informații despre date Platon

- PlatoData

- Punct

- Politica

- Popular

- Post

- practicile

- prezicere

- pregătire

- Pregăti

- pregătirea

- prezenta

- presare

- primar

- Principal

- anterior

- privat

- proces

- Procesat

- prelucrare

- procesor

- producere

- Produse

- Profiluri

- proiect

- furniza

- furnizează

- furnizarea

- public

- Piton

- interogări

- gamă

- RAY

- Citeste

- Fără deosebire

- regiune

- legate de

- ren

- înlocuiește

- necesar

- Cerinţe

- resursă

- Resurse

- responsabil

- restricții

- rezultat

- REZULTATE

- robust

- Rol

- rolurile

- Roy

- Alerga

- funcţionare

- ruleaza

- sagemaker

- Conducte SageMaker

- acelaşi

- spune

- Scară

- scalare

- scenariu

- programare

- Ştiinţă

- oamenii de stiinta

- sdk

- perfect

- Caută

- Secțiune

- sector

- securitate

- vedea

- selectate

- selecţie

- senior

- serie

- serverless

- serviciu

- Servicii

- Sesiunile

- set

- setări

- configurarea

- ea

- să

- Arăta

- Închide

- simplu

- singur

- SIX

- So

- soluţie

- soluţii

- unele

- Sursă

- Surse

- Scânteie

- specialist

- Specialitate

- specificată

- pătrat

- stivui

- Declarație

- Stare

- Pas

- paşi

- depozitare

- stoca

- stocate

- magazine

- Şir

- structura

- structurat

- studio

- astfel de

- Suportat

- sigur

- sistem

- tabel

- Lua

- echipe

- Tehnic

- Tehnologia

- șablon

- zeci

- Terminal

- Testarea

- decât

- acea

- Sursa

- lor

- Lor

- apoi

- Acolo.

- Acestea

- acest

- mii

- trei

- Prin

- timp

- Seria de timp

- timestamp-ul

- la

- împreună

- tradiţional

- Pregătire

- Transforma

- Transformare

- transformări

- transformat

- Două

- tip

- în

- care stau la baza

- Date din amonte

- utilizare

- utilizat

- Utilizator

- utilizatorii

- utilizări

- folosind

- utilitati

- Utilizand

- varietate

- diverse

- versiune

- Virtual

- viziune

- volum

- aștepta

- vrea

- a fost

- Cale..

- we

- web

- servicii web

- bazat pe web

- BINE

- au fost

- Ce

- cand

- care

- în timp ce

- larg

- Gamă largă

- voi

- cu

- fără

- Apartamente

- de lucru

- fabrică

- ar

- scris

- yaml

- ani

- Tu

- Ta

- zephyrnet