Uneori poate fi foarte benefic să folosiți instrumente precum compilatoare care vă pot modifica și compila modelele pentru performanțe optime de inferență. În această postare, explorăm TensorRT și cum să-l folosim Amazon SageMaker deducere folosind NVIDIA Triton Inference Server. Explorăm cum funcționează TensorRT și cum să găzduim și să optimizăm aceste modele pentru performanță și eficiență a costurilor pe SageMaker. SageMaker oferă puncte finale de model unic (IMM-uri), care vă permit să implementați un singur model ML, sau puncte finale multi-model (MME), care vă permit să specificați mai multe modele pentru a găzdui în spatele unui punct final logic pentru o utilizare mai mare a resurselor.

Pentru a servi modele, Triton acceptă diverse backend-uri ca motoare pentru a susține rularea și difuzarea diferitelor modele ML pentru inferență. Pentru orice implementare Triton, este esențial să știți cum vă afectează comportamentul backend-ului sarcinile de lucru și la ce să vă așteptați pentru a avea succes. În această postare, vă ajutăm să înțelegeți Backend-ul TensorRT care este susținut de Triton pe SageMaker, astfel încât să puteți lua o decizie informată pentru sarcinile dvs. de lucru și să obțineți rezultate excelente.

Aprofundare în backend-ul TensorRT

TensorRT vă permite să optimizați inferența folosind tehnici precum cuantizarea, fuziunea stratului și tensorului, reglarea nucleului și altele pe GPU-urile NVIDIA. Prin adoptarea și compilarea modelelor pentru a utiliza TensorRT, puteți optimiza performanța și utilizarea pentru sarcinile de lucru de inferență. În unele cazuri, există compromisuri, ceea ce este tipic pentru tehnici precum cuantizarea, dar rezultatele pot fi dramatice în avantajul performanței, abordând latența și numărul de tranzacții care pot fi procesate.

Backend-ul TensorRT este utilizat pentru a rula modele TensorRT. TensorRT este un SDK dezvoltat de NVIDIA care oferă o bibliotecă de inferențe de învățare profundă de înaltă performanță. Este optimizat pentru GPU-urile NVIDIA și oferă o modalitate de a accelera deducerea învățării profunde în mediile de producție. TensorRT acceptă cadre majore de învățare profundă și include un optimizator de inferență de învățare profundă de înaltă performanță și un timp de execuție care oferă o latență scăzută, inferență de mare debit pentru aplicațiile AI.

TensorRT este capabil să accelereze performanța modelului folosind o tehnică numită optimizarea graficului pentru a optimiza graficul de calcul generat de un model de învățare profundă. Optimizează graficul pentru a minimiza amprenta memoriei prin eliberarea memoriei inutile și reutilizarea eficientă a acesteia. Compilarea TensorRT fuzionează operațiunile rare din graficul modelului pentru a forma un nucleu mai mare pentru a evita suprasolicitarea mai multor lansări mici de nucleu. Cu reglarea automată a nucleului, motorul selectează cel mai bun algoritm pentru GPU-ul țintă, maximizând utilizarea hardware-ului. În plus, TensorRT folosește fluxuri CUDA pentru a permite procesarea paralelă a modelelor, îmbunătățind în continuare utilizarea și performanța GPU. În cele din urmă, prin cuantizare, TensorRT poate utiliza accelerarea cu precizie mixtă a nucleelor Tensor, permițând modelului să ruleze cu precizie FP32, TF32, FP16 și INT8 pentru cea mai bună performanță de inferență. Cu toate acestea, deși precizia redusă poate îmbunătăți în general performanța latenței, aceasta ar putea veni cu o posibilă instabilitate și degradare a preciziei modelului. În general, combinația de tehnici a lui TensorRT are ca rezultat o inferență mai rapidă și o latență mai mică în comparație cu alte motoare de inferență.

Backend-ul TensorRT pentru Triton Inference Server este proiectat pentru a profita de capabilitățile puternice de inferență ale GPU-urilor NVIDIA. Pentru a utiliza TensorRT ca backend pentru Triton Inference Server, trebuie să creați un motor TensorRT din modelul dvs. antrenat folosind API-ul TensorRT. Acest motor este apoi încărcat în Triton Inference Server și utilizat pentru a efectua inferențe cu privire la cererile primite. Următorii sunt pașii de bază pentru a utiliza TensorRT ca backend pentru Triton Inference Server:

- Transformă-ți modelul antrenat în ONNX format. Triton Inference Server acceptă ONNX ca format de model. ONNX este un standard pentru reprezentarea modelelor de învățare profundă, permițându-le să fie transferate între cadre. Dacă modelul dvs. nu este deja în formatul ONNX, trebuie să îl convertiți folosind instrumentul adecvat specific cadrului. De exemplu, în PyTorch, acest lucru se poate face folosind

torch.onnx.exportmetodă. - Importați modelul ONNX în TensorRT și generați motorul TensorRT. Pentru TensorRT, există mai multe moduri de a construi un TensorRT din modelul tău ONNX. Pentru această postare, folosim

trtexecinstrument CLI.trtexeceste un instrument pentru a utiliza rapid TensorRT fără a fi nevoie să vă dezvoltați propria aplicație. Thetrtexecinstrumentul are trei scopuri principale:- Evaluarea comparativă a rețelelor pe date de intrare aleatorii sau furnizate de utilizator.

- Generarea de motoare serializate din modele.

- Generarea unui cache de sincronizare serializat de la constructor.

- Încărcați motorul TensorRT în Triton Inference Server. După ce motorul TensorRT este generat, acesta poate fi încărcat în Triton Inference Server prin crearea unui configurația modelului fişier. Configurația modelului (

config.pbtxt) ar trebui să includă calea către fișierul motor TensorRT și formele de intrare și de ieșire ale modelului.

Fiecare model dintr-o depozit de modele trebuie să includă o configurație de model care oferă informații obligatorii și opționale despre model. De obicei, această configurație este furnizată în a config.pbtxt fișier specificat ca ModelConfig protobuf. Există câteva puncte cheie de remarcat în acest fișier de configurare:

- nume – Acest câmp definește numele modelului și trebuie să fie unic în depozitul de modele.

- platformă – Acest câmp definește tipul modelului: motor TensorRT, PyTorch sau altceva.

- max_batch_size – Aceasta specifică dimensiunea maximă a lotului care poate fi transmisă acestui model. Dacă dimensiunea lotului modelului este prima dimensiune și toate intrările și ieșirile din model au această dimensiune lot, atunci Triton poate folosi dozator dinamic or dozator de secvențe pentru a utiliza automat lotizarea cu modelul. În acest caz,

max_batch_sizear trebui să fie setată la o valoare mai mare sau egală cu 1, ceea ce indică dimensiunea maximă a lotului pe care Triton ar trebui să o folosească cu modelul. Pentru modelele care nu acceptă loturi sau nu acceptă loturi în modurile specifice pe care le-am descris,max_batch_sizetrebuie setat la 0. - Intrare și de ieșire – Aceste câmpuri sunt obligatorii deoarece NVIDIA Triton are nevoie de metadate despre model. În esență, necesită numele straturilor de intrare și ieșire ale rețelei dvs. și forma intrărilor și ieșirilor menționate.

- grup_instanță – Aceasta determină câte instanțe ale acestui model vor fi create și dacă vor folosi GPU sau CPU.

- dynamic_batching - Loturi dinamice este o caracteristică a lui Triton care permite cererilor de inferență să fie combinate de către server, astfel încât un lot să fie creat dinamic. The

preferred_batch_sizeproprietatea indică dimensiunile loturilor pe care grupul dinamic ar trebui să încerce să le creeze. Pentru majoritatea modelelor,preferred_batch_sizenu trebuie specificat, așa cum este descris în Procesul de configurare recomandat. O excepție o reprezintă modelele TensorRT care specifică mai multe profiluri de optimizare pentru diferite dimensiuni de lot. În acest caz, deoarece unele profiluri de optimizare pot oferi o îmbunătățire semnificativă a performanței în comparație cu altele, ar putea avea sens să fie utilizatepreferred_batch_sizepentru dimensiunile loturilor acceptate de acele profiluri de optimizare cu performanțe mai mari. Puteți, de asemenea, să faceți referire la dimensiunea lotului care a fost utilizat anterior la rularetrtexec. De asemenea, puteți configura timpul de întârziere pentru a permite cererilor să fie întârziate pentru o perioadă limitată de timp în planificator pentru a permite altor solicitări să se alăture lotului dinamic.

Backend-ul TensorRT este îmbunătățit pentru a avea performanțe semnificativ mai bune. Îmbunătățirile includ reducerea conflictului de fire, utilizarea memoriei fixate pentru transferuri mai rapide între CPU și GPU și creșterea suprapunerii de calcul și copiere a memoriei pe GPU. De asemenea, reduce utilizarea memoriei modelelor TensorRT în multe cazuri prin partajarea greutăților în mai multe instanțe de model. În general, backend-ul TensorRT pentru Triton Inference Server oferă o modalitate puternică și flexibilă de a servi modele de învățare profundă cu inferență TensorRT optimizată. Prin ajustarea opțiunilor de configurare, puteți optimiza performanța și comportamentul de control pentru a se potrivi cazului dumneavoastră de utilizare specific.

SageMaker oferă Triton prin intermediul IMM-urilor și IMM-urilor

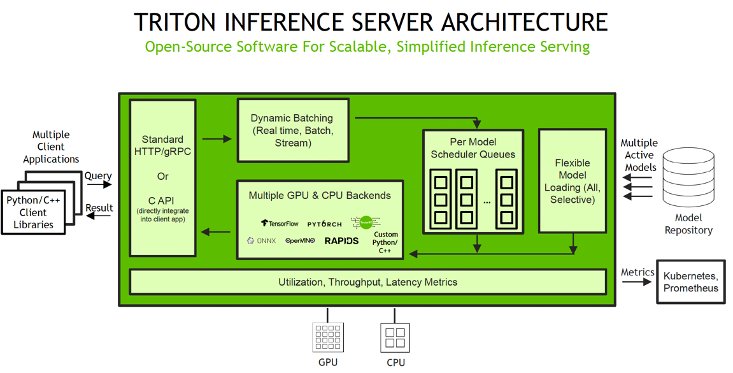

SageMaker vă permite să implementați atât singur și multi-model puncte finale cu Triton Inference Server. Triton acceptă un cluster eterogen atât cu GPU-uri, cât și cu procesoare, ceea ce ajută la standardizarea inferenței pe platforme și se extinde dinamic la orice CPU sau GPU pentru a face față sarcinilor de vârf. Următoarea diagramă ilustrează arhitectura Triton Inference Server. Solicitările de inferență ajung la server prin oricare HTTP/REST sau de către C APIși apoi sunt direcționate către planificatorul corespunzător pentru fiecare model. unelte Triton mai mulți algoritmi de programare și loturi care pot fi configurate model cu model. Planificatorul fiecărui model efectuează opțional lotizarea cererilor de inferență și apoi transmite cererile către backend corespunzător tipului de model. Backend-ul cadru efectuează inferențe folosind intrările furnizate în cererile grupate pentru a produce ieșirile solicitate. Ieșirile sunt apoi formatate și returnate în răspuns. The depozit de modele este un depozit bazat pe sistemul de fișiere al modelelor pe care Triton le va pune la dispoziție pentru deducere.

SageMaker se ocupă de modelarea traficului către punctul final MME și menține copii optime ale modelului pe instanțele GPU pentru performanță la cel mai bun preț. Acesta continuă să direcționeze traficul către instanța în care este încărcat modelul. Dacă resursele instanței ating capacitatea din cauza utilizării mari, SageMaker descarcă modelele cel mai puțin utilizate din container pentru a elibera resurse pentru a încărca modelele utilizate mai frecvent. SageMaker MME oferă capabilități pentru rularea mai multor modele de deep learning sau ML pe GPU, în același timp, cu Triton Inference Server, care a fost extins pentru a implementa Contract MME API. MME-urile permit partajarea instanțelor GPU în spatele unui punct final pe mai multe modele și încarcă și descarcă dinamic modele pe baza traficului de intrare. Cu aceasta, puteți obține cu ușurință o performanță optimă a prețului.

Când un MME SageMaker primește o solicitare de invocare HTTP pentru un anumit model de utilizare TargetModel în cerere, împreună cu sarcina utilă, direcționează traficul către instanța potrivită din spatele punctului final unde este încărcat modelul țintă. SageMaker se ocupă de gestionarea modelului din spatele punctului final. Descarcă dinamic modele de pe Serviciul Amazon de stocare simplă (Amazon S3) la volumul de stocare al instanței dacă modelul invocat nu este disponibil pe volumul de stocare al instanței. Apoi SageMaker încarcă modelul în memoria containerului NVIDIA Triton pe o instanță accelerată de GPU și servește cererea de inferență. Nucleul GPU este partajat de toate modelele dintr-o instanță. Pentru mai multe informații despre SageMaker MME pe GPU, consultați Rulați mai multe modele de deep learning pe GPU cu punctele finale cu mai multe modele Amazon SageMaker.

MME-urile SageMaker se pot scala orizontal folosind o politică de scalare automată și pot furniza instanțe de calcul GPU suplimentare pe baza unor valori specificate. Când vă configurați grupurile de scalare automată pentru punctele finale SageMaker, vă recomandăm să luați în considerare SageMakerVariantInvocationsPerInstance ca criterii primare pentru a determina caracteristicile de scalare ale grupurilor dvs. de scalare automată. În plus, în funcție de faptul dacă modelele dumneavoastră rulează pe GPU sau CPU, puteți lua în considerare și utilizarea CPUUtilization or GPUUtilization ca criterii suplimentare. Pentru punctele finale cu un singur model, deoarece modelele implementate sunt toate aceleași, este destul de simplu să setați politici adecvate pentru a vă îndeplini SLA-urile. Pentru punctele finale cu mai multe modele, vă recomandăm să implementați modele similare în spatele unui anumit punct final pentru a avea performanțe mai stabile și previzibile. În cazurile de utilizare în care sunt utilizate modele de dimensiuni și cerințe diferite, este posibil să doriți să separați acele sarcini de lucru în mai multe puncte finale cu mai multe modele sau să petreceți ceva timp pentru a ajusta politica de grup de scalare automată pentru a obține cel mai bun echilibru între costuri și performanță.

Prezentare generală a soluțiilor

Cu NVIDIA Triton imagine container pe SageMaker, acum puteți utiliza backend-ul TensorRT al Triton, care vă permite să implementați modele TensorRT. The TensorRT_backend repo conține documentația și sursa pentru backend. În secțiunile următoare, vă prezentăm exemplu caiet care demonstrează cum se utilizează NVIDIA Triton Inference Server pe SageMaker MME cu caracteristica GPU pentru a implementa un model de procesare a limbajului natural (NLP) BERT.

Configurați mediul înconjurător

Începem prin a configura mediul necesar. Instalăm dependențele necesare pentru a împacheta conducta noastră de model și pentru a rula inferențe folosind Triton Inference Server. De asemenea, definim Gestionarea identității și accesului AWS (IAM) care oferă SageMaker acces la artefactele modelului și la NVIDIA Triton Registrul Amazon de containere elastice (Amazon ECR) imagine. Puteți folosi următorul exemplu de cod pentru a prelua imaginea Triton ECR prefabricată:

Adăugați metode utilitare pentru pregătirea sarcinii utile de solicitare

Creăm funcțiile pentru a transforma textul eșantion pe care îl folosim pentru inferență în sarcina utilă care poate fi trimisă pentru inferență la Triton Inference Server. The tritonclient pachet, care a fost instalat la început, oferă metode utilitare pentru a genera sarcina utilă fără a fi nevoie să cunoașteți detaliile specificației. Folosim metodele create pentru a converti cererea noastră de inferență într-un format binar, care oferă latențe mai mici pentru inferență. Aceste funcții sunt utilizate în timpul pasului de inferență.

Pregătiți modelul TensorRT

În acest pas, încărcăm model BERT pre-antrenat și convertiți la reprezentarea ONNX folosind exportatorul ONNX torță și onnx_exporter.py scenariu. După ce modelul ONNX este creat, folosim TensorRT trtexec comandă pentru a crea planul model care va fi găzduit cu Triton. Acesta este rulat ca parte a generate_model.sh script din celula următoare. Rețineți că celula durează aproximativ 30 de minute pentru a se finaliza.

În timp ce așteptați ca comanda să se termine, puteți verifica scripturile utilizate în acest pas. În onnx_exporter.py scriptul, folosim torch.onnx.export funcție pentru crearea modelului ONNX:

Linia de comandă din fișierul generate_model.sh creează planul modelului TensorRT. Pentru mai multe informații, consultați instrument de linie de comandă trtexec.

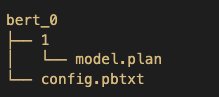

Construiți un depozit de modele TensorRT NLP BERT

Utilizarea Triton pe SageMaker necesită mai întâi să configuram a depozit de modele folder care conține modelele pe care dorim să le servim. Pentru fiecare model, trebuie să creăm un director de model constând din artefactul model și să definim config.pbtxt pentru a specifica configurația modelului pe care Triton o folosește pentru a încărca și a servi modelul. Pentru a afla mai multe despre setările de configurare, consultați Configurația modelului. Structura depozitului de modele pentru modelul BERT este următoarea:

Rețineți că Triton are cerințe specifice pentru aspectul depozitului de modele. În directorul de depozit de modele de nivel superior, fiecare model are propriul său subdirector care conține informațiile pentru modelul corespunzător. Fiecare director de model din Triton trebuie să aibă cel puțin un subdirector numeric reprezentând o versiune a modelului. Aici, folderul 1 reprezintă versiunea 1 a modelului BERT. Fiecare model este rulat de un backend specific, astfel încât în cadrul fiecărui subdirector de versiune trebuie să existe artefactele de model cerute de acel backend. Aici, folosim backend-ul TensorRT, care necesită fișierul plan TensorRT care este utilizat pentru difuzare (pentru acest exemplu, model.plan). Dacă am folosi un backend PyTorch, a model.pt ar fi necesar un dosar. Pentru mai multe detalii despre convențiile de denumire pentru fișierele model, consultați Fișiere model.

Fiecare model TensorRT trebuie să ofere un config.pbtxt fișier care descrie configurația modelului. Pentru a utiliza acest backend, trebuie să setați backend domeniul modelului dvs config.pbtxt fișier de tensorrt_plan. Următoarea secțiune de cod arată un exemplu de definire a fișierului de configurare pentru modelul BERT care este servit prin backend-ul TensorRT al Triton:

SageMaker se așteaptă ca un fișier .tar.gz care să conțină fiecare depozit de modele Triton să fie găzduit pe punctul final cu mai multe modele. Pentru a simula mai multe modele similare care sunt găzduite, s-ar putea să credeți că tot ce este nevoie este să tarați depozitul de modele pe care l-am construit deja și apoi să îl copiați cu nume de fișiere diferite. Cu toate acestea, Triton necesită nume unice de model. Prin urmare, copiem mai întâi repo-ul modelului de N ori, schimbând numele directorului modelului și corespunzătoare acestora config.pbtxt fișiere. Puteți modifica numărul de N pentru a avea mai multe copii ale modelului care pot fi încărcate dinamic la punctul final de găzduire pentru a simula acțiunea de încărcare/descărcare a modelului gestionată de SageMaker. Vezi următorul cod:

Creați un punct final SageMaker

Acum că am încărcat artefactele modelului pe Amazon S3, putem crea obiectul model SageMaker, configurația punctului final și punctul final.

În primul rând, trebuie să definim recipientul de servire. În definiția containerului, definiți ModelDataUrl pentru a specifica directorul S3 care conține toate modelele pe care punctul final cu mai multe modele SageMaker le va folosi pentru a încărca și a servi predicții. A stabilit Mode la MultiModel pentru a indica SageMaker va crea punctul final cu specificațiile containerului MME. Vezi următorul cod:

Apoi creăm obiectul model SageMaker folosind create_model boto3 API prin specificarea ModelName și definiția containerului:

Folosim acest model pentru a crea un configurația punctului final unde putem specifica tipul și numărul de instanțe pe care le dorim în punctul final. Aici implementăm pe o instanță GPU NVIDIA g5.xlarge:

Cu această configurație a punctului final, creăm un nou punct final SageMaker și așteptăm finalizarea implementării. Starea se va schimba în InService când implementarea are succes.

Invocați modelul dvs. găzduit pe punctul final SageMaker

Când punctul final rulează, putem folosi câteva mostre de date brute pentru a efectua inferențe folosind fie JSON, fie binar+JSON ca format de încărcare utilă. Pentru formatul cererii de inferență, Triton utilizează standardul comunității KFServing protocoale de inferență. Putem trimite cererea de inferență către punctul final cu mai multe modele folosind invoke_enpoint API. Precizăm TargetModel în apelul de invocare și transmiteți sarcina utilă pentru fiecare tip de model. Aici invocăm punctul final într-o buclă for pentru a solicita punctul final încărcarea sau descărcarea dinamică a modelelor pe baza cererilor:

Puteți monitoriza starea de încărcare și descărcare a modelului folosind Amazon CloudWatch metrici și jurnalele. Punctele finale cu mai multe modele SageMaker oferă valori la nivel de instanță de monitorizat; pentru mai multe detalii, consultați Monitorizați Amazon SageMaker cu Amazon CloudWatch. LoadedModelCount metrica arată numărul de modele încărcate în containere. The ModelCacheHit valoarea arată numărul de invocări la model care sunt deja încărcate în container pentru a vă ajuta să obțineți informații la nivel de invitație de model. Pentru a verifica dacă modelele sunt descărcate din memorie, puteți căuta intrările de jurnal descărcate cu succes în jurnalele CloudWatch ale punctului final.

Caietul poate fi găsit în GitHub depozit.

Cele mai bune practici

Înainte de a începe orice efort de optimizare cu TensorRT, este esențial să determinați ce ar trebui să fie măsurat. Fără măsurători, este imposibil să faci progrese fiabile sau să măsori dacă succesul a fost atins. Iată câteva dintre cele mai bune practici de luat în considerare atunci când utilizați backend-ul TensorRT pentru Triton Inference Server:

- Optimizați-vă modelul TensorRT – Înainte de a implementa un model pe Triton cu backend-ul TensorRT, asigurați-vă că optimizați modelul urmând TensorRT Cele mai bune practici ghid. Acest lucru vă va ajuta să obțineți performanțe mai bune prin reducerea timpului de inferență și a consumului de memorie.

- Folosiți TensorRT în loc de alte backend-uri Triton atunci când este posibil – TensorRT este conceput pentru a optimiza modelele de învățare profundă pentru implementarea pe GPU-uri NVIDIA, astfel încât utilizarea acestuia poate îmbunătăți semnificativ performanța de inferență în comparație cu utilizarea altor backend-uri Triton acceptate.

- Utilizați precizia potrivită – TensorRT acceptă mai multe precizii (FP32, FP16, INT8), iar selectarea preciziei potrivite pentru modelul dvs. poate avea un impact semnificativ asupra performanței. Luați în considerare utilizarea unei precizii mai mici atunci când este posibil.

- Utilizați dimensiuni de lot care se potrivesc cu hardware-ul dvs – Asigurați-vă că alegeți dimensiuni de lot care se potrivesc cu memoria și capacitățile de calcul ale GPU-ului dvs. Utilizarea dimensiunilor loturilor prea mari sau prea mici poate avea un impact negativ asupra performanței.

Concluzie

În această postare, ne-am adâncit în backend-ul TensorRT pe care Triton Inference Server îl acceptă pe SageMaker. Acest backend oferă atât accelerarea procesorului, cât și a GPU-ului modelelor dvs. TensorRT. Există multe opțiuni de luat în considerare pentru a obține cea mai bună performanță pentru inferență, cum ar fi dimensiunile loturilor, formatele de introducere a datelor și alți factori care pot fi ajustați pentru a satisface nevoile dvs. SageMaker vă permite să profitați de această capacitate folosind puncte finale unice pentru performanță garantată și puncte finale cu mai multe modele pentru a obține un echilibru mai bun între performanță și economii de costuri. Pentru a începe cu suportul MME pentru GPU, consultați Algoritmi, cadre și instanțe acceptate.

Vă invităm să încercați containerele Triton Inference Server în SageMaker și să vă împărtășiți feedbackul și întrebările în comentarii.

Despre Autori

Melanie Li este specialist senior AI/ML TAM la AWS cu sediul în Sydney, Australia. Ea ajută clienții întreprinderilor să construiască soluții utilizând instrumentele de IA/ML de ultimă generație pe AWS și oferă îndrumări privind arhitectura și implementarea soluțiilor de învățare automată cu cele mai bune practici. În timpul liber, îi place să exploreze natura în aer liber și să petreacă timp cu familia și prietenii.

Melanie Li este specialist senior AI/ML TAM la AWS cu sediul în Sydney, Australia. Ea ajută clienții întreprinderilor să construiască soluții utilizând instrumentele de IA/ML de ultimă generație pe AWS și oferă îndrumări privind arhitectura și implementarea soluțiilor de învățare automată cu cele mai bune practici. În timpul liber, îi place să exploreze natura în aer liber și să petreacă timp cu familia și prietenii.

James Park este arhitect de soluții la Amazon Web Services. Lucrează cu Amazon pentru a proiecta, construi și implementa soluții tehnologice pe AWS și are un interes deosebit pentru inteligența artificială și învățarea automată. În timpul liber, îi place să caute noi culturi, noi experiențe și să fie la curent cu cele mai recente tendințe tehnologice.

James Park este arhitect de soluții la Amazon Web Services. Lucrează cu Amazon pentru a proiecta, construi și implementa soluții tehnologice pe AWS și are un interes deosebit pentru inteligența artificială și învățarea automată. În timpul liber, îi place să caute noi culturi, noi experiențe și să fie la curent cu cele mai recente tendințe tehnologice.

Jiahong Liu este arhitect de soluții în echipa de furnizori de servicii cloud de la NVIDIA. El ajută clienții să adopte soluții de învățare automată și inteligență artificială care folosesc calcularea accelerată NVIDIA pentru a-și aborda provocările de formare și inferență. În timpul liber, îi place origami, proiecte de bricolaj și joacă baschet.

Jiahong Liu este arhitect de soluții în echipa de furnizori de servicii cloud de la NVIDIA. El ajută clienții să adopte soluții de învățare automată și inteligență artificială care folosesc calcularea accelerată NVIDIA pentru a-și aborda provocările de formare și inferență. În timpul liber, îi place origami, proiecte de bricolaj și joacă baschet.

Kshitiz Gupta este arhitect de soluții la NVIDIA. Îi face plăcere să educe clienții din cloud despre tehnologiile GPU AI pe care le oferă NVIDIA și să-i ajute să-și accelereze învățarea automată și aplicațiile de deep learning. În afara serviciului, îi place să alerge, să facă drumeții și să urmărească fauna sălbatică.

Kshitiz Gupta este arhitect de soluții la NVIDIA. Îi face plăcere să educe clienții din cloud despre tehnologiile GPU AI pe care le oferă NVIDIA și să-i ajute să-și accelereze învățarea automată și aplicațiile de deep learning. În afara serviciului, îi place să alerge, să facă drumeții și să urmărească fauna sălbatică.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoAiStream. Web3 Data Intelligence. Cunoștințe amplificate. Accesați Aici.

- Mintând viitorul cu Adryenn Ashley. Accesați Aici.

- Cumpărați și vindeți acțiuni în companii PRE-IPO cu PREIPO®. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/host-ml-models-on-amazon-sagemaker-using-triton-tensorrt-models/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 23

- 30

- 7

- 8

- a

- Capabil

- Despre Noi

- accelera

- accelerat

- accelerarea

- acces

- precizie

- Obține

- realizat

- peste

- Acțiune

- plus

- Suplimentar

- În plus,

- adresa

- adresare

- Adoptarea

- Avantaj

- După

- AI

- AI / ML

- Algoritmul

- algoritmi

- TOATE

- permite

- permite

- de-a lungul

- deja

- de asemenea

- Cu toate ca

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- și

- Orice

- api

- aplicație

- aplicatii

- adecvat

- arhitectură

- SUNT

- în jurul

- AS

- asistă

- At

- Australia

- Auto

- în mod automat

- disponibil

- evita

- AWS

- Backend

- Sold

- de bază

- bazat

- de bază

- bază

- Baschet

- BE

- deoarece

- fost

- înainte

- începe

- Început

- în spatele

- fiind

- benefică

- beneficiind

- CEL MAI BUN

- Cele mai bune practici

- Mai bine

- între

- corp

- atât

- construi

- constructor

- construit

- dar

- by

- Cache

- apel

- denumit

- CAN

- capacități

- Capacitate

- pasă

- caz

- cazuri

- provocări

- Schimbare

- schimbarea

- Caracteristici

- verifica

- Alege

- client

- clientii

- Cloud

- Grup

- cod

- COM

- combinaţie

- combinate

- cum

- comentarii

- comunitate

- comparație

- Completă

- calcul

- Calcula

- tehnica de calcul

- Configuraţie

- Lua în considerare

- Constând

- consum

- Recipient

- Containere

- conține

- continuă

- Control

- converti

- Nucleu

- Corespunzător

- A costat

- economii

- crea

- a creat

- creează

- Crearea

- creaţie

- Criteriile de

- crucial

- clienţii care

- de date

- Data

- decizie

- adânc

- învățare profundă

- defineste

- întârziere

- Întârziat

- Oferă

- demonstrează

- implementa

- dislocate

- Implementarea

- desfășurarea

- descris

- Amenajări

- proiectat

- detalii

- Determina

- determină

- dezvolta

- dezvoltat

- diferit

- Dimensiune

- diy

- documentaţie

- făcut

- Dont

- porumbel

- download-uri

- dramatic

- două

- în timpul

- dinamic

- dinamic

- fiecare

- cu ușurință

- Margine

- educarea

- eficiență

- eficient

- efort

- oricare

- angajează

- permite

- permite

- permițând

- Punct final

- Motor

- Motoare

- Afacere

- Mediu inconjurator

- medii

- egal

- esenţial

- În esență,

- exemplu

- excepție

- aștepta

- se așteaptă

- Experiențe

- explora

- factori

- destul de

- familie

- mai repede

- Caracteristică

- feedback-ul

- camp

- Domenii

- Fișier

- Fişiere

- aripioară

- În cele din urmă

- termina

- First

- potrivi

- flexibil

- următor

- urmează

- urmă

- Pentru

- formă

- format

- găsit

- Cadru

- cadre

- Gratuit

- frecvent

- Prietenii lui

- din

- funcţie

- funcții

- mai mult

- fuziune

- în general

- genera

- generată

- obține

- Da

- dat

- oferă

- GPU

- unități de procesare grafică

- grafic

- mare

- mai mare

- grup

- Grupului

- garantat

- îndrumare

- ghida

- manipula

- Piese metalice

- Avea

- având în

- he

- ajutor

- ajută

- ei

- aici

- Înalt

- performanta ridicata

- superior

- lui

- orizontal

- gazdă

- găzduit

- găzduire

- Cum

- Cum Pentru a

- Totuși

- HTML

- http

- HTTPS

- i

- ID

- Identitate

- if

- ilustrează

- imagine

- Impactul

- Impacturi

- punerea în aplicare a

- Punere în aplicare a

- ustensile

- import

- imposibil

- îmbunătăţi

- îmbunătățit

- îmbunătățire

- îmbunătățiri

- îmbunătățirea

- in

- include

- include

- Intrare

- crescând

- creştere

- indica

- indică

- informații

- informat

- intrare

- intrări

- perspective

- instabilitate

- instala

- instalat

- instanță

- in schimb

- interes

- în

- invita

- invocat

- IT

- ESTE

- alătura

- jpg

- JSON

- Cheie

- Copil

- Cunoaște

- limbă

- mare

- mai mare

- Latență

- Ultimele

- lansează

- strat

- straturi

- Aspect

- AFLAȚI

- învăţare

- cel mai puțin

- Pârghie

- efectului de pârghie

- Bibliotecă

- Limitat

- Linie

- încărca

- încărcare

- loturile

- log

- logic

- Uite

- Jos

- LOWER

- maşină

- masina de învățare

- Principal

- susține

- major

- face

- gestionate

- administrare

- multe

- Meci

- maximizarea

- maxim

- Mai..

- măsura

- măsurători

- Întâlni

- Memorie

- Metadata

- metodă

- Metode

- metric

- Metrici

- ar putea

- minute

- ML

- mod

- model

- Modele

- modifica

- monitor

- mai mult

- cele mai multe

- Punct final cu mai multe modele

- multiplu

- trebuie sa

- nume

- nume

- denumire

- Natural

- Procesarea limbajului natural

- Natură

- Nevoie

- nevoilor

- negativ

- rețele

- Nou

- nlp

- caiet

- acum

- număr

- Nvidia

- obiect

- obține

- of

- oferi

- on

- ONE

- deschide

- Operațiuni

- optimă

- optimizare

- Optimizați

- optimizate

- Optimizează

- Opţiuni

- or

- comandă

- OS

- Altele

- Altele

- al nostru

- afară

- în aer liber

- producție

- exterior

- global

- propriu

- pachet

- Paralel

- parte

- special

- trece

- Trecut

- trece

- cale

- Vârf

- Efectua

- performanță

- efectuează

- conducte

- plan

- platformă

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- joc

- puncte

- Politicile

- Politica

- posibil

- Post

- puternic

- practicile

- Precizie

- predictibil

- Predictii

- pregătirea

- precedent

- în prealabil

- preţ

- primar

- Procesat

- prelucrare

- produce

- producere

- Profiluri

- Progres

- Proiecte

- adecvat

- proprietate

- Proto

- furniza

- prevăzut

- furnizorul

- furnizează

- dispoziţie

- scopuri

- pirtorh

- Întrebări

- repede

- ridica

- aleator

- Crud

- ajunge

- primește

- recomanda

- Redus

- reduce

- reducerea

- regiune

- de încredere

- depozit

- reprezentare

- reprezentând

- reprezintă

- solicita

- cereri de

- necesar

- Cerinţe

- Necesită

- resursă

- Resurse

- răspuns

- REZULTATE

- Rol

- Traseul

- rute

- rt

- Alerga

- funcţionare

- s

- sagemaker

- Said

- acelaşi

- Economisiți

- Economie

- Scară

- cântare

- scalare

- programare

- script-uri

- sdk

- Secțiune

- secțiuni

- vedea

- caută

- selectarea

- trimite

- senior

- sens

- distinct

- servi

- servește

- serviciu

- Furnizor de servicii

- Servicii

- servire

- set

- instalare

- setări

- câteva

- Modela

- forme

- fasonarea

- Distribuie

- comun

- partajarea

- ea

- să

- Emisiuni

- semnificativ

- semnificativ

- asemănător

- simplu

- singur

- Mărimea

- dimensiuni

- mic

- IMM-urile

- So

- soluţie

- soluţii

- unele

- ceva

- Sursă

- specialist

- specific

- specificație

- Specificaţii

- specificată

- petrece

- standard

- început

- Pornire

- de ultimă oră

- Stare

- constant

- Pas

- paşi

- depozitare

- simplu

- fluxuri

- structura

- succes

- de succes

- astfel de

- Costum

- a sustine

- Suportat

- Sprijină

- sydney

- Lua

- ia

- Ţintă

- echipă

- tehnici de

- Tehnologii

- Tehnologia

- decât

- acea

- Graficul

- informațiile

- lor

- Lor

- apoi

- Acolo.

- prin urmare

- Acestea

- ei

- crede

- acest

- aceste

- trei

- Prin

- timp

- ori

- sincronizare

- la

- de asemenea

- instrument

- Unelte

- nivel superior

- lanternă

- trafic

- dresat

- Pregătire

- Tranzacții

- transferat

- Transferuri

- Transforma

- transformatoare

- Tendinţe

- Triton

- tip

- tipic

- tipic

- înţelege

- unic

- încărcat

- us

- Folosire

- utilizare

- carcasa de utilizare

- utilizat

- folosind

- utilitate

- folosi

- valoare

- diverse

- versiune

- foarte

- de

- volum

- aștepta

- Aşteptare

- vrea

- a fost

- vizionarea

- Cale..

- modalități de

- we

- web

- servicii web

- au fost

- Ce

- cand

- dacă

- care

- voi

- cu

- în

- fără

- Apartamente

- fabrică

- ar

- Tu

- Ta

- zephyrnet