Asistăm la o creștere rapidă a adoptării de modele lingvistice mari (LLM) care alimentează aplicațiile AI generatoare în toate industriile. LLM-urile sunt capabile să realizeze o varietate de sarcini, cum ar fi generarea de conținut creativ, răspunsul la întrebări prin chatbot, generarea de cod și multe altele.

Organizațiile care doresc să folosească LLM-uri pentru a-și alimenta aplicațiile sunt din ce în ce mai precaute cu privire la confidențialitatea datelor pentru a se asigura că încrederea și siguranța sunt menținute în aplicațiile lor generative AI. Aceasta include gestionarea corectă a datelor despre informațiile de identificare personală (PII) ale clienților. De asemenea, include prevenirea transmiterii conținutului abuziv și nesigur către LLM și verificarea faptului că datele generate de LLM respectă aceleași principii.

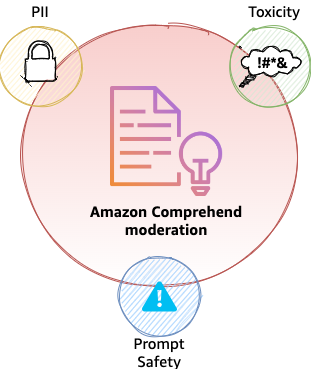

În această postare, discutăm despre noi funcții dezvoltate de Amazon Comprehend care permit integrarea perfectă pentru a asigura confidențialitatea datelor, siguranța conținutului și siguranța promptă în aplicațiile AI generative noi și existente.

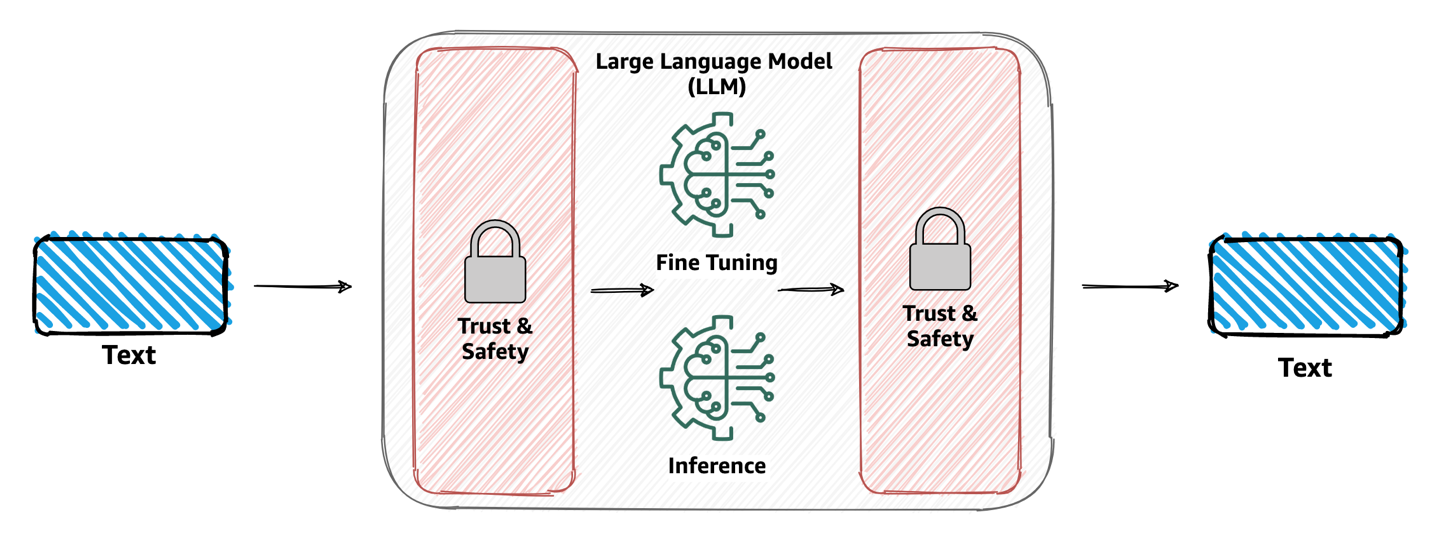

Amazon Comprehend este un serviciu de procesare a limbajului natural (NLP) care utilizează învățarea automată (ML) pentru a descoperi informații din date nestructurate și text din documente. În această postare, discutăm de ce încrederea și siguranța cu LLM sunt importante pentru sarcinile dvs. de lucru. De asemenea, aprofundăm modul în care aceste noi capabilități de moderare sunt utilizate cu cadrul popular de dezvoltare generativă AI LangChain pentru a introduce un mecanism de încredere și siguranță personalizabil pentru cazul dvs. de utilizare.

De ce contează încrederea și siguranța cu LLM

Încrederea și siguranța sunt esențiale atunci când lucrați cu LLM-uri datorită impactului lor profund asupra unei game largi de aplicații, de la chatbot de asistență pentru clienți până la generarea de conținut. Pe măsură ce aceste modele procesează cantități mari de date și generează răspunsuri asemănătoare omului, crește potențialul de utilizare greșită sau de rezultate nedorite. Asigurarea faptului că aceste sisteme AI funcționează în limite etice și de încredere este crucială, nu doar pentru reputația companiilor care le folosesc, ci și pentru păstrarea încrederii utilizatorilor finali și clienților.

Mai mult, pe măsură ce LLM-urile devin mai integrate în experiențele noastre digitale zilnice, influența lor asupra percepțiilor, convingerilor și deciziilor noastre crește. Asigurarea încrederii și siguranței cu LLM depășește doar măsurile tehnice; se referă la responsabilitatea mai largă a practicienilor și organizațiilor AI de a susține standardele etice. Prin acordarea de prioritate încrederii și siguranței, organizațiile nu numai că își protejează utilizatorii, ci și asigură o creștere durabilă și responsabilă a inteligenței artificiale în societate. De asemenea, poate ajuta la reducerea riscului de a genera conținut dăunător și poate ajuta la respectarea cerințelor de reglementare.

În domeniul încrederii și siguranței, moderarea conținutului este un mecanism care abordează diverse aspecte, inclusiv, dar fără a se limita la:

- Privacy – Utilizatorii pot furniza din neatenție text care conține informații sensibile, punându-le în pericol confidențialitatea. Detectarea și redactarea oricărui PII este esențială.

- Toxicitate – Recunoașterea și filtrarea conținutului dăunător, cum ar fi discursul instigator la ură, amenințările sau abuzul, este de cea mai mare importanță.

- Intenția utilizatorului – Identificarea dacă introducerea utilizatorului (prompt) este sigură sau nesigură este critică. Solicitările nesigure pot exprima în mod explicit sau implicit intenții rău intenționate, cum ar fi solicitarea de informații personale sau private și generarea de conținut ofensator, discriminatoriu sau ilegal. Solicitările pot, de asemenea, să exprime sau să solicite în mod implicit sfaturi medicale, juridice, politice, controversate, personale sau financiare

Moderarea conținutului cu Amazon Comprehend

În această secțiune, discutăm despre beneficiile moderării conținutului cu Amazon Comprehend.

Abordarea confidențialității

Amazon Comprehend abordează deja confidențialitatea prin abilitățile sale existente de detectare și redactare a PII prin intermediul DetectPIIEntities și ConținePIIEntities API-uri. Aceste două API-uri sunt susținute de modele NLP care pot detecta un număr mare de entități PII, cum ar fi numere de securitate socială (SSN), numere de card de credit, nume, adrese, numere de telefon și așa mai departe. Pentru o listă completă a entităților, consultați Tipuri de entități universale PII. DetectPII oferă, de asemenea, poziția la nivel de caracter a entității PII într-un text; de exemplu, poziția caracterului de început a entității NAME (John Doe) în propoziția „Numele meu este John Doe” este 12, iar poziția finală a caracterului este 19. Aceste compensații pot fi utilizate pentru a efectua mascarea sau redactarea valorilor, reducând astfel riscurile de propagare a datelor private în LLM-uri.

Abordarea toxicității și siguranța promptă

Astăzi, anunțăm două noi funcții Amazon Comprehend sub formă de API: detectarea toxicității prin intermediul DetectToxicContent API și clasificarea promptă a siguranței prin intermediul ClassifyDocument API. Rețineți că DetectToxicContent este un nou API, în timp ce ClassifyDocument este un API existent care acceptă acum clasificarea promptă a siguranței.

Detectarea toxicității

Cu detectarea toxicității Amazon Comprehend, puteți identifica și semnala conținut care poate fi dăunător, ofensator sau inadecvat. Această capacitate este deosebit de valoroasă pentru platformele în care utilizatorii generează conținut, cum ar fi site-uri de social media, forumuri, chatbot, secțiuni de comentarii și aplicații care folosesc LLM-uri pentru a genera conținut. Scopul principal este de a menține un mediu pozitiv și sigur prin prevenirea răspândirii conținutului toxic.

În esență, modelul de detectare a toxicității analizează textul pentru a determina probabilitatea ca acesta să conțină conținut instigator la ură, amenințări, obscenități sau alte forme de text dăunător. Modelul este antrenat pe seturi vaste de date care conțin exemple atât de conținut toxic, cât și de conținut netoxic. Toxicitatea API evaluează o anumită bucată de text pentru a oferi clasificarea toxicității și scorul de încredere. Aplicațiile generative de inteligență artificială pot folosi apoi aceste informații pentru a lua măsuri adecvate, cum ar fi oprirea propagarii textului către LLM-uri. În momentul scrierii acestui articol, etichetele detectate de API-ul de detectare a toxicității sunt HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULT, și PROFANITY. Următorul cod demonstrează apelul API cu Python Boto3 pentru detectarea toxicității Amazon Comprehend:

Clasificare promptă de siguranță

Clasificarea promptă a siguranței cu Amazon Comprehend ajută la clasificarea unui text introdus ca fiind sigur sau nesigur. Această capacitate este crucială pentru aplicații precum chatbot-uri, asistenți virtuali sau instrumente de moderare a conținutului în care înțelegerea siguranței unui prompt poate determina răspunsuri, acțiuni sau propagarea conținutului către LLM-uri.

În esență, clasificarea promptă a siguranței analizează aportul uman pentru orice intenție rău intenționată explicită sau implicită, cum ar fi solicitarea de informații personale sau private și generarea de conținut ofensator, discriminatoriu sau ilegal. De asemenea, semnalează solicitările care caută sfaturi pe subiecte medicale, juridice, politice, controversate, personale sau financiare. Clasificarea promptă returnează două clase, UNSAFE_PROMPT și SAFE_PROMPT, pentru un text asociat, cu un scor de încredere asociat pentru fiecare. Scorul de încredere variază între 0–1 și combinat se va însuma până la 1. De exemplu, într-un chatbot de asistență pentru clienți, textul „Cum îmi resetez parola?” semnalează intenția de a căuta îndrumare cu privire la procedurile de resetare a parolei și este etichetat ca SAFE_PROMPT. În mod similar, o declarație de genul „Îmi doresc să ți se întâmple ceva rău” poate fi marcat ca având o intenție potențial dăunătoare și etichetat ca UNSAFE_PROMPT. Este important de reținut că clasificarea promptă a siguranței se concentrează în primul rând pe detectarea intenției din intrările umane (indemnizații), mai degrabă decât pe textul generat de mașină (ieșiri LLM). Următorul cod demonstrează cum să accesați funcția de clasificare promptă a siguranței cu ClassifyDocument API-uri:

Rețineți că endpoint_arn în codul precedent este furnizat de AWS Numărul resursei Amazon (ARN) al modelului arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safety, În cazul în care <region> este regiunea AWS la alegerea dvs. unde Amazon Comprehend este disponibil.

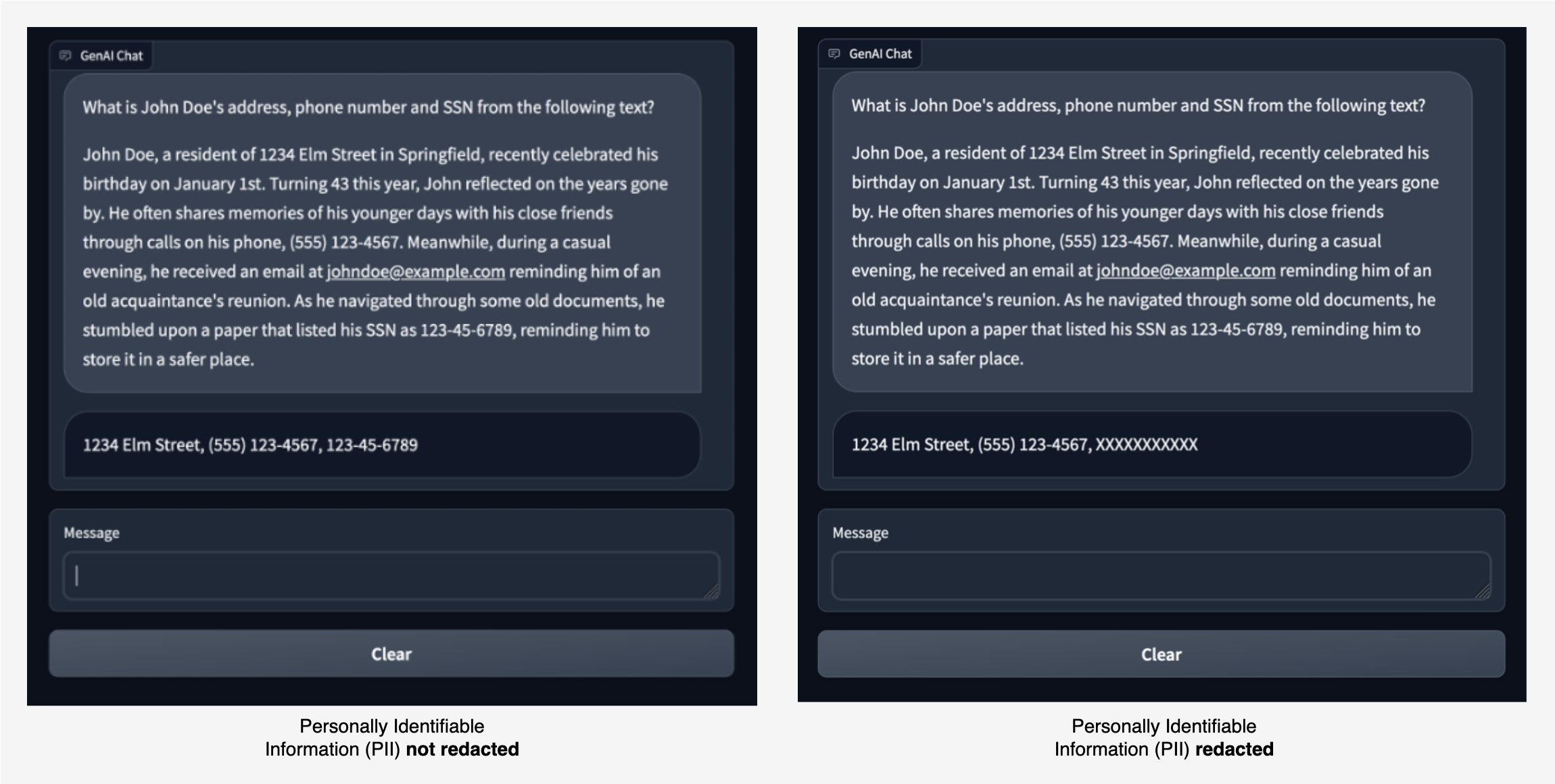

Pentru a demonstra aceste capabilități, am creat un exemplu de aplicație de chat în care îi cerem unui LLM să extragă entități PII, cum ar fi adresa, numărul de telefon și SSN dintr-o anumită bucată de text. LLM găsește și returnează entitățile PII corespunzătoare, așa cum se arată în imaginea din stânga.

Cu moderarea Amazon Comprehend, putem redacta intrarea în LLM și ieșirea din LLM. În imaginea din dreapta, valoarea SSN poate fi transmisă la LLM fără redactare. Cu toate acestea, orice valoare SSN din răspunsul LLM este redactată.

Următorul este un exemplu despre modul în care un prompt care conține informații PII poate fi împiedicat să ajungă complet la LLM. Acest exemplu demonstrează un utilizator care pune o întrebare care conține informații PII. Folosim moderarea Amazon Comprehend pentru a detecta entitățile PII în prompt și pentru a arăta o eroare prin întreruperea fluxului.

Exemplele de chat precedente arată modul în care moderarea Amazon Comprehend aplică restricții privind trimiterea datelor către un LLM. În secțiunile următoare, explicăm modul în care acest mecanism de moderare este implementat folosind LangChain.

Integrare cu LangChain

Cu posibilitățile nesfârșite de aplicare a LLM-urilor în diferite cazuri de utilizare, a devenit la fel de importantă simplificarea dezvoltării aplicațiilor AI generative. LangChain este un cadru popular cu sursă deschisă, care face fără efort dezvoltarea de aplicații AI generative. Moderarea Amazon Comprehend extinde cadrul LangChain pentru a oferi identificarea și redactarea PII, detectarea toxicității și capabilități prompte de clasificare a siguranței prin AmazonComprehendModerationChain.

AmazonComprehendModerationChain este o implementare personalizată a Lanț de bază LangChain interfata. Aceasta înseamnă că aplicațiile pot folosi acest lanț cu propriile lor Lanțuri LLM pentru a aplica moderarea dorită promptului de intrare, precum și textului de ieșire din LLM. Lanțurile pot fi construite prin îmbinarea a numeroase lanțuri sau prin amestecarea lanțurilor cu alte componente. Poți să folosești AmazonComprehendModerationChain cu alte lanțuri LLM pentru a dezvolta aplicații complexe de IA într-o manieră modulară și flexibilă.

Pentru a explica în continuare, oferim câteva exemple în secțiunile următoare. Codul sursă pentru AmazonComprehendModerationChain implementarea poate fi găsită în cadrul Depozitul cu sursă deschisă LangChain. Pentru documentația completă a interfeței API, consultați documentația LangChain API pentru Amazon Comprehend lanț de moderare. Utilizarea acestui lanț de moderare este la fel de simplă ca inițializarea unei instanțe a clasei cu configurații implicite:

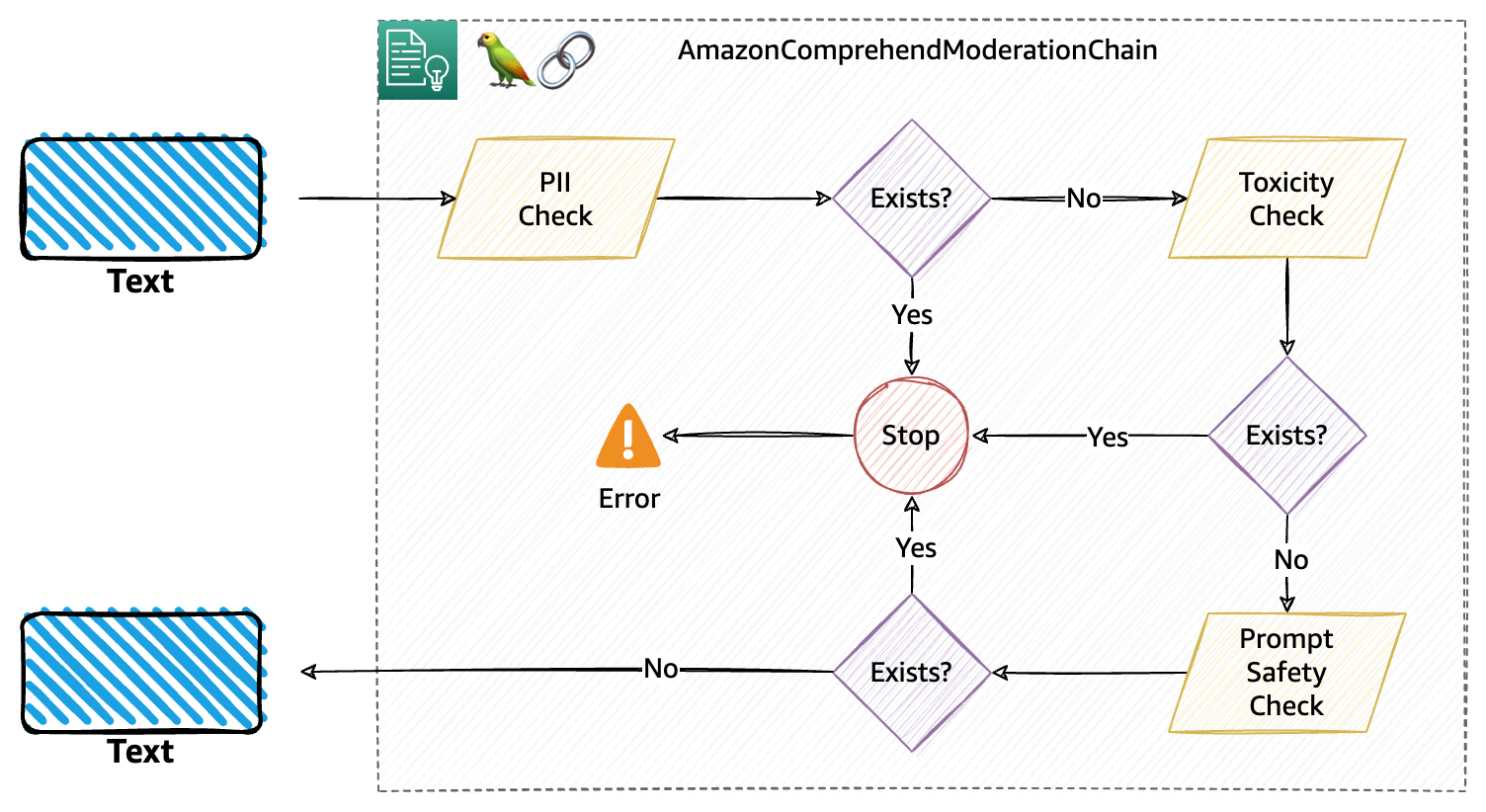

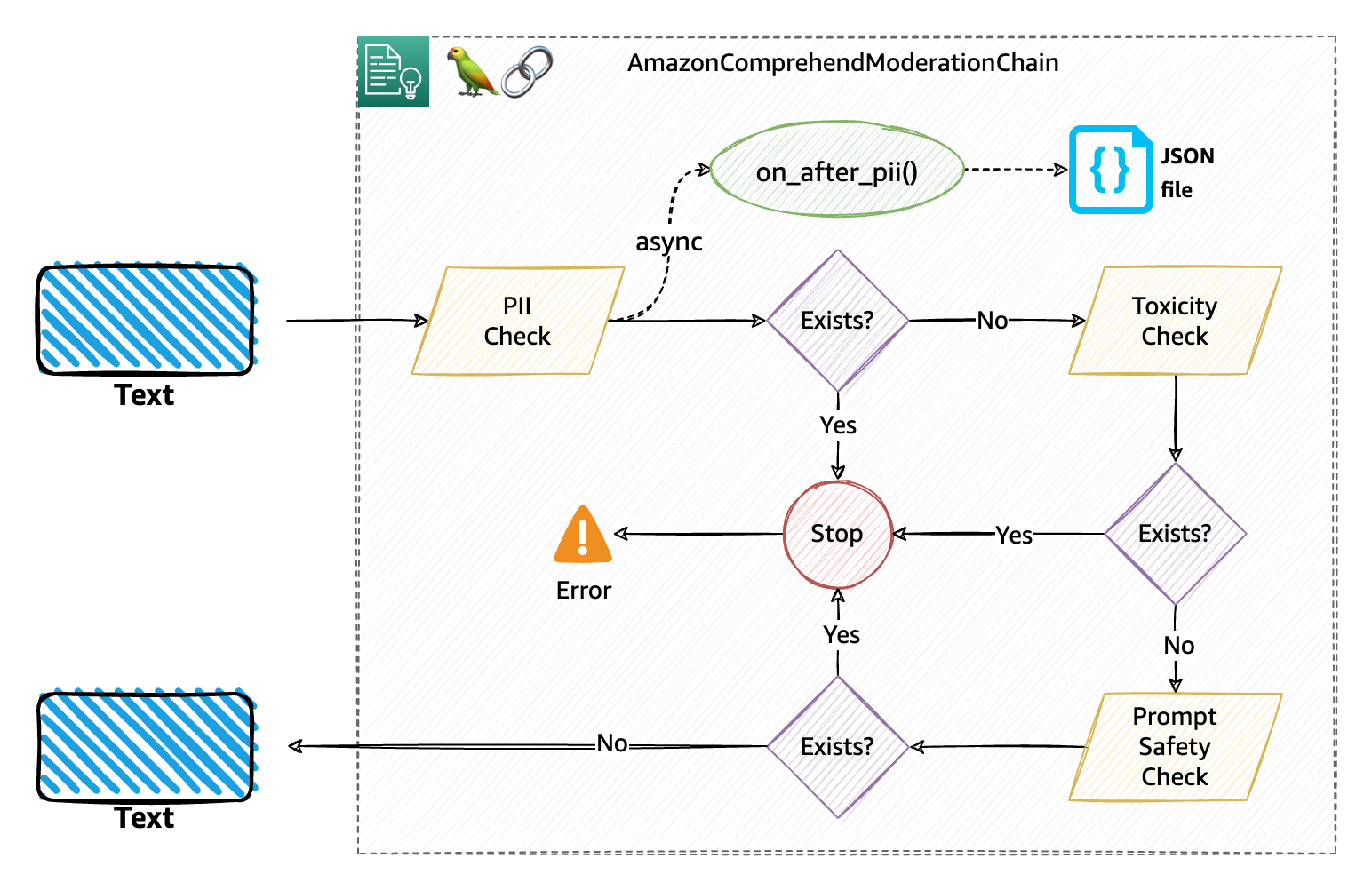

În culise, lanțul de moderare efectuează trei verificări consecutive de moderare, și anume PII, toxicitate și siguranță promptă, așa cum se explică în diagrama următoare. Acesta este fluxul implicit pentru moderare.

Următorul fragment de cod arată un exemplu simplu de utilizare a lanțului de moderare cu Amazon FalconLite LLM (care este o versiune cuantificată a Model Falcon 40B SFT OASST-TOP1) găzduit în Hugging Face Hub:

În exemplul precedent, ne mărim lanțul cu comprehend_moderation atât pentru textul care intră în LLM, cât și pentru textul generat de LLM. Aceasta va efectua moderarea implicită care va verifica IPI, toxicitatea și clasificarea promptă a siguranței în acea secvență.

Personalizați-vă moderarea cu configurații de filtru

Aveți posibilitatea să utilizați AmazonComprehendModerationChain cu configurații specifice, care vă oferă posibilitatea de a controla ce moderații doriți să efectuați în aplicația dvs. generativă bazată pe AI. În centrul configurației, aveți trei configurații de filtre disponibile.

- ModerationPiiConfig – Folosit pentru a configura filtrul PII.

- ModerationToxicityConfig – Folosit pentru a configura filtrul de conținut toxic.

- ModerationIntentConfig – Folosit pentru a configura filtrul de intenție.

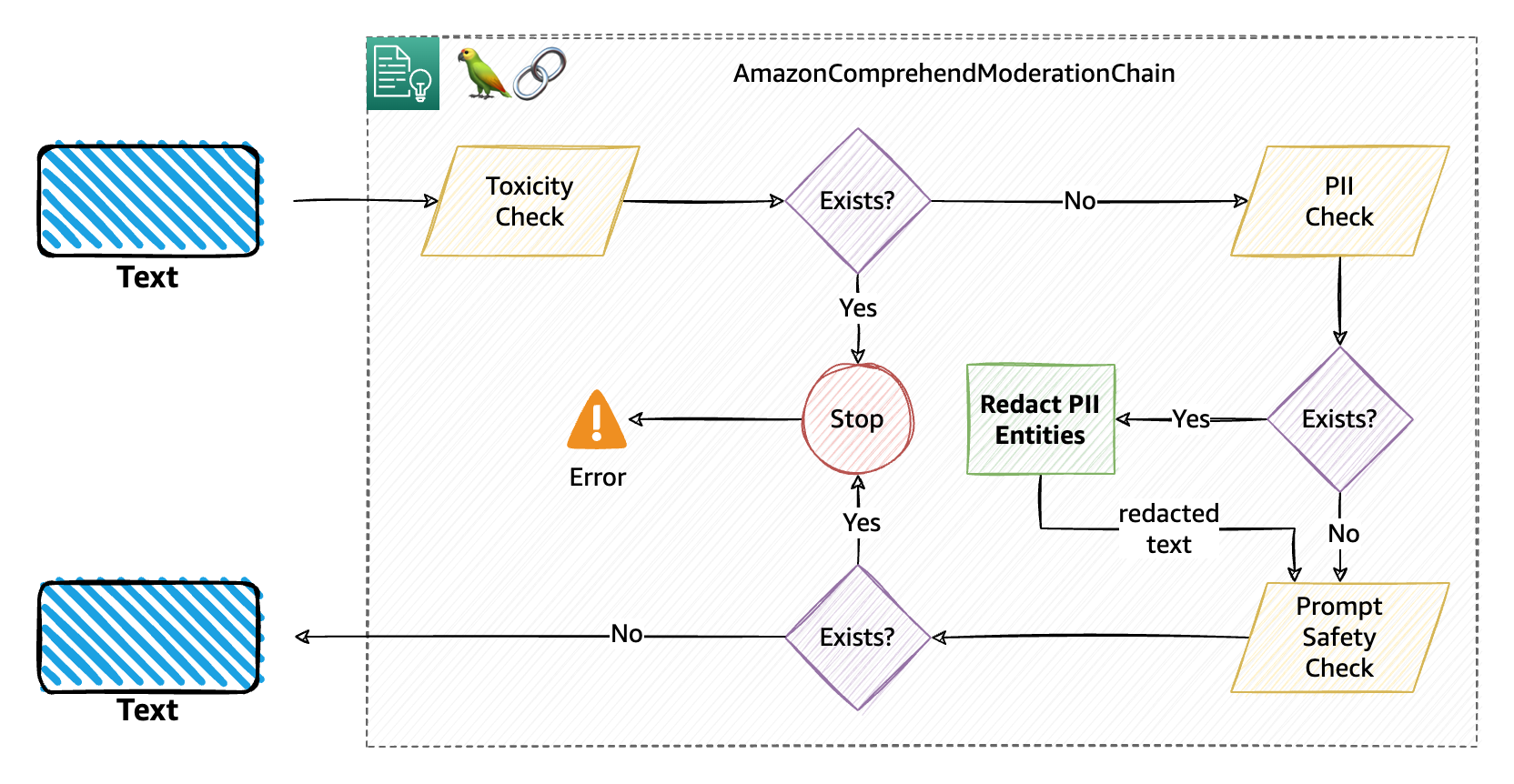

Puteți folosi fiecare dintre aceste configurații de filtru pentru a personaliza comportamentul modului în care se comportă moderațiile dvs. Configurațiile fiecărui filtru au câțiva parametri comuni și câțiva parametri unici cu care pot fi inițializați. După ce definiți configurațiile, utilizați BaseModerationConfig clasa pentru a defini succesiunea în care filtrele trebuie să se aplice textului. De exemplu, în codul următor, definim mai întâi cele trei configurații de filtru și, ulterior, specificăm ordinea în care trebuie să se aplice:

Să ne aprofundăm puțin pentru a înțelege ce realizează această configurație:

- În primul rând, pentru filtrul de toxicitate, am specificat un prag de 0.6. Aceasta înseamnă că dacă textul conține oricare dintre etichetele sau entitățile toxice disponibile cu un scor mai mare decât pragul, întregul lanț va fi întrerupt.

- Dacă nu se găsește conținut toxic în text, o verificare a PII. În acest caz, suntem interesați să verificăm dacă textul conține valori SSN. Deoarece

redactparametrul este setat laTrue, lanțul va masca valorile SSN detectate (dacă există) în cazul în care scorul de încredere al entității SSN este mai mare sau egal cu 0.5, cu caracterul de mască specificat (X). Dacăredacteste setat laFalse, lanțul va fi întrerupt pentru orice SSN detectat. - În cele din urmă, lanțul efectuează o clasificare promptă de siguranță și va opri conținutul să se propage mai în jos în lanț dacă conținutul este clasificat cu

UNSAFE_PROMPTcu un scor de încredere mai mare sau egal cu 0.8.

Următoarea diagramă ilustrează acest flux de lucru.

În cazul întreruperii lanțului de moderare (în acest exemplu, aplicabil pentru filtrele de clasificare a toxicității și siguranței prompte), lanțul va ridica un Excepție Python, în esență oprind lanțul în curs și permițându-vă să capturați excepția (într-un bloc try-catch) și să efectuați orice acțiune relevantă. Cele trei tipuri posibile de excepții sunt:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

Puteți configura un filtru sau mai mult de un filtru folosind BaseModerationConfig. De asemenea, puteți avea același tip de filtru cu configurații diferite în cadrul aceluiași lanț. De exemplu, dacă cazul dvs. de utilizare se referă numai la PII, puteți specifica o configurație care trebuie să întrerupă lanțul în cazul în care este detectat un SSN; în caz contrar, trebuie să efectueze redacția pe vârsta și numele entităților PII. O configurație pentru aceasta poate fi definită după cum urmează:

Utilizarea apelurilor inverse și a identificatorilor unici

Dacă sunteți familiarizat cu conceptul de fluxuri de lucru, este posibil să fiți familiarizat cu apeluri de apel. Apelurile înapoi în fluxurile de lucru sunt bucăți independente de cod care rulează atunci când sunt îndeplinite anumite condiții în cadrul fluxului de lucru. Un apel invers poate fi blocant sau neblocant fluxului de lucru. Lanțurile LangChain sunt, în esență, fluxuri de lucru pentru LLM. AmazonComprehendModerationChain vă permite să vă definiți propriile funcții de apel invers. Inițial, implementarea este limitată doar la funcții de apel invers asincrone (neblocante).

Acest lucru înseamnă efectiv că, dacă utilizați apeluri inverse cu lanțul de moderare, acestea vor rula independent de rularea lanțului, fără a-l bloca. Pentru lanțul de moderare, aveți opțiuni pentru a rula bucăți de cod, cu orice logică de afaceri, după rularea fiecărei moderare, independent de lanț.

De asemenea, puteți furniza opțional un șir de identificare unic arbitrar atunci când creați un AmazonComprehendModerationChain pentru a activa mai târziu înregistrarea și analiza. De exemplu, dacă utilizați un chatbot alimentat de un LLM, este posibil să doriți să urmăriți utilizatorii care sunt abuzivi în mod constant sau care expun informații personale în mod deliberat sau fără să știe. În astfel de cazuri, devine necesar să urmăriți originea unor astfel de solicitări și poate să le stocați într-o bază de date sau să le înregistrați corespunzător pentru acțiuni ulterioare. Puteți transmite un ID unic care identifică în mod distinct un utilizator, cum ar fi numele de utilizator sau e-mailul acestuia, sau numele unei aplicații care generează solicitarea.

Combinația de apeluri inverse și identificatori unici vă oferă o modalitate puternică de a implementa un lanț de moderare care se potrivește cazului dvs. de utilizare într-un mod mult mai coeziv, cu mai puțin cod, care este mai ușor de întreținut. Managerul de apel invers este disponibil prin intermediul BaseModerationCallbackHandler, cu trei apeluri disponibile: on_after_pii(), on_after_toxicity(), și on_after_prompt_safety(). Fiecare dintre aceste funcții de apel invers este apelată asincron după ce verificarea de moderare respectivă este efectuată în cadrul lanțului. Aceste funcții primesc și doi parametri impliciti:

- moderare_beacon – Un dicționar care conține detalii precum textul pe care a fost efectuată moderarea, rezultatul complet JSON al API-ului Amazon Comprehend, tipul de moderare și dacă etichetele furnizate (în configurație) au fost găsite sau nu în text

- ID unic – ID-ul unic pe care l-ați atribuit în timp ce inițializați o instanță a

AmazonComprehendModerationChain.

Următorul este un exemplu despre cum funcționează o implementare cu apel invers. În acest caz, am definit un singur callback pe care dorim ca lanțul să ruleze după efectuarea verificării PII:

Apoi folosim my_callback obiect în timp ce inițializați lanțul de moderare și, de asemenea, treceți a unique_id. Puteți utiliza apeluri inverse și identificatori unici cu sau fără o configurație. Când subclasați BaseModerationCallbackHandler, trebuie să implementați una sau toate metodele de apel invers, în funcție de filtrele pe care intenționați să le utilizați. Pentru concizie, următorul exemplu arată o modalitate de a utiliza apelurile inverse și unique_id fara nicio configuratie:

Următoarea diagramă explică modul în care funcționează acest lanț de moderare cu apeluri inverse și identificatori unici. Mai exact, am implementat apelul PII care ar trebui să scrie un fișier JSON cu datele disponibile în moderation_beacon si unique_id trecut (e-mailul utilizatorului în acest caz).

În cele ce urmează Caiet Python, am compilat câteva moduri diferite în care puteți configura și utiliza lanțul de moderare cu diferite LLM-uri, cum ar fi LLM-urile găzduite cu Amazon SageMaker JumpStart și găzduit în Hugging Face Hub. Am inclus, de asemenea, exemplul de aplicație de chat despre care am discutat mai devreme cu următoarele Caiet Python.

Concluzie

Potențialul transformator al modelelor de limbaj mari și al IA generativă este de netăgăduit. Cu toate acestea, utilizarea lor responsabilă și etică depinde de abordarea preocupărilor legate de încredere și siguranță. Recunoscând provocările și implementând în mod activ măsuri pentru atenuarea riscurilor, dezvoltatorii, organizațiile și societatea în general pot valorifica beneficiile acestor tehnologii, păstrând în același timp încrederea și siguranța care stau la baza integrării lor cu succes. Utilizați Amazon Comprehend ContentModerationChain pentru a adăuga caracteristici de încredere și siguranță oricărui flux de lucru LLM, inclusiv fluxurile de lucru Retrieval Augmented Generation (RAG) implementate în LangChain.

Pentru informații despre construirea de soluții bazate pe RAG folosind LangChain și Amazon Kendra, bazat pe învățare automată (ML) de înaltă precizie căutare inteligentă, vedea - Creați rapid aplicații AI generative de înaltă precizie pe datele întreprinderii folosind Amazon Kendra, LangChain și modele de limbaj mari. Ca pas următor, consultați mostre de cod am creat pentru a utiliza moderarea Amazon Comprehend cu LangChain. Pentru documentația completă a API-ului Amazon Comprehend pentru lanțul de moderare, consultați LangChain Documentație API.

Despre autori

Wrick Talukdar este arhitect senior cu echipa Amazon Comprehend Service. El lucrează cu clienții AWS pentru a-i ajuta să adopte învățarea automată la scară largă. În afara serviciului, îi place să citească și să fotografieze.

Wrick Talukdar este arhitect senior cu echipa Amazon Comprehend Service. El lucrează cu clienții AWS pentru a-i ajuta să adopte învățarea automată la scară largă. În afara serviciului, îi place să citească și să fotografieze.

Anjan Biswas este un arhitect senior de soluții de servicii AI, cu accent pe AI/ML și Data Analytics. Anjan face parte din echipa de servicii AI la nivel mondial și lucrează cu clienții pentru a-i ajuta să înțeleagă și să dezvolte soluții la problemele de afaceri cu AI și ML. Anjan are peste 14 ani de experiență de lucru cu lanțul global de aprovizionare, producție și organizații de vânzare cu amănuntul și ajută în mod activ clienții să înceapă și să se extindă pe serviciile AWS AI.

Anjan Biswas este un arhitect senior de soluții de servicii AI, cu accent pe AI/ML și Data Analytics. Anjan face parte din echipa de servicii AI la nivel mondial și lucrează cu clienții pentru a-i ajuta să înțeleagă și să dezvolte soluții la problemele de afaceri cu AI și ML. Anjan are peste 14 ani de experiență de lucru cu lanțul global de aprovizionare, producție și organizații de vânzare cu amănuntul și ajută în mod activ clienții să înceapă și să se extindă pe serviciile AWS AI.

Nikhil Jha este Senior Technical Account Manager la Amazon Web Services. Domeniile sale de interes includ AI/ML și analize. În timpul liber, îi place să joace badminton cu fiica sa și să exploreze în aer liber.

Nikhil Jha este Senior Technical Account Manager la Amazon Web Services. Domeniile sale de interes includ AI/ML și analize. În timpul liber, îi place să joace badminton cu fiica sa și să exploreze în aer liber.

Chin Rane este arhitect specializat în soluții AI/ML la Amazon Web Services. Este pasionată de matematică aplicată și învățare automată. Ea se concentrează pe proiectarea de soluții inteligente de procesare a documentelor pentru clienții AWS. În afara serviciului, îi place dansul salsa și bachata.

Chin Rane este arhitect specializat în soluții AI/ML la Amazon Web Services. Este pasionată de matematică aplicată și învățare automată. Ea se concentrează pe proiectarea de soluții inteligente de procesare a documentelor pentru clienții AWS. În afara serviciului, îi place dansul salsa și bachata.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- abilități

- capacitate

- Despre Noi

- abuz

- acces

- Cont

- precis

- Realizeaza

- peste

- Acțiune

- acțiuni

- activ

- adăuga

- adresa

- adrese

- adresare

- adera

- adopta

- Adoptare

- sfat

- După

- vârstă

- AI

- Servicii AI

- Sisteme AI

- AI / ML

- TOATE

- permis

- Permiterea

- permite

- deja

- de asemenea

- întru totul

- Amazon

- Amazon Comprehend

- Amazon Kendra

- Amazon Web Services

- Sume

- an

- Google Analytics

- analize

- și

- anunțare

- răspunde

- Orice

- api

- API-uri

- aplicabil

- aplicație

- aplicatii

- aplicat

- se aplică

- Aplică

- adecvat

- în mod corespunzător

- SUNT

- domenii

- AS

- cere

- solicitând

- aspecte

- alocate

- asistenți

- asociate

- At

- spori

- augmented

- disponibil

- AWS

- sprijinit

- Rău

- de bază

- bazat

- BE

- deoarece

- deveni

- devine

- comportament

- fiind

- convingerile

- Beneficiile

- între

- Dincolo de

- Bloca

- blocarea

- atât

- limitele

- mai larg

- construi

- a cladi increderea

- Clădire

- construit

- afaceri

- întreprinderi

- dar

- by

- apel

- apeluri de apel

- denumit

- CAN

- capacități

- capacitate

- capabil

- capital

- card

- caz

- cazuri

- Captură

- sigur

- lanţ

- lanţuri

- provocări

- caracter

- chatbot

- chatbots

- verifica

- control

- Verificări

- bărbie

- alegere

- clasă

- clase

- clasificare

- clasificate

- Clasifica

- client

- cod

- coeziv

- COM

- combinaţie

- combinate

- comentariu

- Comun

- complex

- componente

- înţelege

- concept

- îngrijorat

- preocupările

- Condiții

- încredere

- Configuraţie

- consecutiv

- consecvent

- conține

- conţinut

- Generare de conținut

- Control

- controversat

- Nucleu

- a creat

- Crearea

- Creator

- credit

- card de credit

- critic

- crucial

- personalizat

- client

- Relații Clienți

- clienţii care

- personalizabil

- personaliza

- zilnic

- Dans

- de date

- Analiza datelor

- confidențialitatea datelor

- Baza de date

- seturi de date

- Deciziile

- Mai adânc

- Mod implicit

- defini

- definit

- se îngropa

- demonstra

- demonstrează

- În funcție

- proiect

- dorit

- detalii

- detecta

- detectat

- Detectare

- Determina

- dezvolta

- Dezvoltatorii

- Dezvoltare

- diferit

- digital

- discuta

- discutat

- distinct

- scufunda

- do

- document

- documentaţie

- documente

- căprioară

- jos

- două

- e

- fiecare

- Mai devreme

- mai ușor

- în mod eficient

- fără efort

- oricare

- altfel

- permite

- capăt

- Fără sfârşit

- asigura

- asigurare

- Afacere

- entități

- entitate

- Mediu inconjurator

- egal

- la fel de

- eroare

- esenţă

- esenţial

- În esență,

- etic

- exemplu

- exemple

- Cu excepția

- excepție

- existent

- experienţă

- Experiențe

- Explica

- a explicat

- explică

- explicit

- Explorarea

- expres

- extinde

- extrage

- Față

- familiar

- Caracteristică

- DESCRIERE

- puțini

- Fișier

- filtru

- filtrare

- Filtre

- financiar

- Găsi

- descoperiri

- First

- fanionat

- steaguri

- flexibil

- debit

- Concentra

- concentrat

- se concentrează

- următor

- urmează

- Pentru

- formă

- format

- formulare

- forumuri

- găsit

- Cadru

- Franţa

- din

- Complet

- funcții

- mai mult

- genera

- generată

- generator

- generaţie

- generativ

- AI generativă

- obține

- gif

- Da

- dat

- oferă

- Caritate

- scop

- Merge

- merge

- bine

- mai mare

- creste

- Creștere

- îndrumare

- Manipularea

- se întâmplă

- nociv

- valorifica

- ură

- Avea

- având în

- he

- ajutor

- ajutor

- ajută

- extrem de

- balamale

- lui

- găzduit

- Cum

- Cum Pentru a

- Totuși

- HTML

- HTTPS

- Butuc

- uman

- asemănător omului

- i

- ID

- Identificare

- identificator

- identificatorii

- identifică

- identifica

- identificarea

- if

- Ilegal

- ilustrează

- imagine

- Impactul

- punerea în aplicare a

- implementarea

- implementat

- Punere în aplicare a

- import

- importanță

- important

- in

- neatenție

- include

- inclus

- include

- Inclusiv

- Crește

- Creșteri

- tot mai mult

- independent

- independent

- industrii

- influență

- informații

- inițial

- intrare

- intrări

- Cereri

- instanță

- integrate

- integrare

- Inteligent

- Procesarea inteligentă a documentelor

- intenţionează

- scop

- interesat

- interfaţă

- întrerupt

- în

- introduce

- IT

- ESTE

- Ioan

- JOHN DOE

- jpg

- JSON

- doar

- etichete

- limbă

- mare

- mai tarziu

- învăţare

- stânga

- Legal

- mai puțin

- ca

- probabilitate

- Limitat

- Listă

- mic

- puțin mai adânc

- LLM

- log

- logare

- logică

- cautati

- maşină

- masina de învățare

- menține

- FACE

- manager

- manieră

- de fabricaţie

- masca

- matematică

- materie

- Mai..

- me

- mijloace

- măsuri

- mecanism

- Mass-media

- medical

- care fuzionează

- cu

- Metode

- folosire greșită

- diminua

- Amestecarea

- ML

- model

- Modele

- moderare

- modular

- mai mult

- mult

- trebuie sa

- my

- nume

- și anume

- nume

- Natural

- Procesarea limbajului natural

- necesar

- Nou

- Funcții noi

- următor

- nlp

- Nu.

- acum

- număr

- numere

- numeroși

- obiect

- of

- ofensator

- oferi

- compensările

- on

- ONE

- afară

- deschide

- open-source

- funcionar

- de operare

- Opţiuni

- or

- comandă

- organizații

- origine

- Altele

- in caz contrar

- al nostru

- afară

- rezultate

- în aer liber

- producție

- iesiri

- exterior

- peste

- propriu

- parametru

- parametrii

- Suprem

- parte

- în special

- trece

- Trecut

- pasionat

- Parolă

- resetare parola

- Model

- Efectua

- efectuată

- efectuează

- poate

- personal

- Personal

- telefon

- fotografie

- bucată

- piese

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- joc

- politic

- Popular

- poziţie

- pozitiv

- posibilităţile de

- posibil

- Post

- potenţial

- potenţial

- putere

- alimentat

- puternic

- păstrarea

- prevenirea

- în primul rând

- primar

- Principiile

- Stabilirea priorităților

- intimitate

- privat

- informații private

- probleme

- Proceduri

- proces

- prelucrare

- profund

- Progres

- cum se cuvine

- proteja

- furniza

- furnizează

- Piton

- întrebare

- ridica

- gamă

- game

- rapid

- mai degraba

- ajungând

- Citind

- tărâm

- a primi

- recunoscând

- reduce

- reducerea

- trimite

- regiune

- autoritățile de reglementare

- de încredere

- reputație

- solicita

- Cerinţe

- resursă

- respectiv

- răspuns

- răspunsuri

- responsabilitate

- responsabil

- restricții

- cu amănuntul

- Returnează

- dreapta

- Risc

- Riscurile

- Alerga

- s

- sigur

- Siguranţă

- sagemaker

- acelaşi

- Scară

- scene

- scor

- fără sudură

- Secțiune

- secțiuni

- securitate

- vedea

- Căuta

- SELF

- senior

- sensibil

- trimis

- propoziție

- Secvenţă

- serviciu

- Servicii

- set

- ea

- să

- Arăta

- prezenta

- indicat

- Emisiuni

- semnalele

- asemănător

- simplu

- simplifica

- singur

- Centre de cercetare

- fragment

- So

- Social

- social media

- Societate

- soluţii

- unele

- ceva

- Sursă

- cod sursă

- vorbeşte

- specialist

- specific

- specific

- specificată

- discurs

- standarde

- Începe

- început

- Declarație

- Pas

- Stop

- oprire

- stoca

- Şir

- Ulterior

- de succes

- astfel de

- furnizat

- livra

- lanțului de aprovizionare

- a sustine

- Sprijină

- durabilă

- sisteme

- Lua

- sarcini

- echipă

- Tehnic

- Tehnologii

- șablon

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- decât

- acea

- Capitala

- Sursa

- lor

- Lor

- apoi

- Acolo.

- astfel

- Acestea

- ei

- acest

- amenințări

- trei

- prag

- Prin

- timp

- la

- Unelte

- urmări

- dresat

- transformativă

- Încredere

- încerca

- Două

- tip

- Tipuri

- descoperi

- netăgăduit

- sprijini

- înţelege

- înţelegere

- unic

- Universal

- susține

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- utilizatorii

- utilizări

- folosind

- folosi

- utilizate

- Valoros

- valoare

- Valori

- varietate

- diverse

- Fixă

- versiune

- de

- Virtual

- W

- vrea

- a fost

- Cale..

- modalități de

- we

- web

- servicii web

- BINE

- au fost

- Ce

- Ce este

- cand

- întrucât

- dacă

- care

- în timp ce

- OMS

- întreg

- de ce

- larg

- Gamă largă

- voi

- dori

- cu

- în

- fără

- martori

- Apartamente

- flux de lucru

- fluxuri de lucru

- de lucru

- fabrică

- scrie

- scris

- X

- ani

- Tu

- Ta

- zephyrnet