În peisajul actual al asistenței medicale în evoluție rapidă, medicii se confruntă cu cantități mari de date clinice din diverse surse, cum ar fi notele îngrijitorilor, dosarele electronice de sănătate și rapoartele imagistice. Această bogăție de informații, deși esențială pentru îngrijirea pacientului, poate fi, de asemenea, copleșitoare și consumatoare de timp pentru ca profesioniștii medicali să verifice și să analizeze. Rezumarea și extragerea eficientă a perspectivelor din aceste date este crucială pentru o mai bună îngrijire a pacientului și luarea deciziilor. Informațiile rezumate ale pacientului pot fi utile pentru o serie de procese din aval, cum ar fi agregarea datelor, codificarea eficientă a pacienților sau gruparea pacienților cu diagnostice similare pentru revizuire.

Modelele de inteligență artificială (AI) și de învățare automată (ML) s-au dovedit foarte promițătoare în abordarea acestor provocări. Modelele pot fi antrenate să analizeze și să interpreteze volume mari de date text, condensând efectiv informațiile în rezumate concise. Prin automatizarea procesului de rezumare, medicii pot obține rapid acces la informații relevante, permițându-le să se concentreze pe îngrijirea pacientului și să ia decizii mai informate. Vezi următoarele studiu de caz pentru a afla mai multe despre un caz de utilizare real.

Amazon SageMaker, un serviciu ML gestionat complet, oferă o platformă ideală pentru găzduirea și implementarea diferitelor modele și abordări de rezumare bazate pe AI/ML. În această postare, explorăm diferite opțiuni pentru implementarea tehnicilor de rezumare pe SageMaker, inclusiv utilizarea Amazon SageMaker JumpStart modele de fundație, ajustarea fină a modelelor pre-antrenate de la Hugging Face și construirea de modele personalizate de rezumat. De asemenea, discutăm avantajele și dezavantajele fiecărei abordări, permițând profesioniștilor din domeniul sănătății să aleagă cea mai potrivită soluție pentru a genera rezumate concise și precise ale datelor clinice complexe.

Doi termeni importanți de știut înainte de a începe: pre-antrenat și reglaj fin. Un model pre-instruit sau de bază este unul care a fost construit și antrenat pe un corp mare de date, de obicei pentru cunoștințe generale de limbă. Reglarea fină este procesul prin care unui model pre-antrenat i se oferă un alt set de date mai specific domeniului pentru a-și îmbunătăți performanța la o anumită sarcină. Într-un cadru de asistență medicală, aceasta ar însemna oferirea modelului de date, inclusiv expresii și terminologie referitoare în mod specific la îngrijirea pacientului.

Creați modele personalizate de rezumare pe SageMaker

Deși abordarea cu cel mai mare efort, unele organizații ar putea prefera să construiască modele personalizate de rezumare pe SageMaker de la zero. Această abordare necesită cunoștințe mai aprofundate despre modelele AI/ML și poate implica crearea unei arhitecturi de model de la zero sau adaptarea modelelor existente pentru a se potrivi nevoilor specifice. Construirea modelelor personalizate poate oferi o mai mare flexibilitate și control asupra procesului de rezumare, dar necesită și mai mult timp și resurse în comparație cu abordările care pornesc de la modele pre-instruite. Este esențial să cântăriți cu atenție beneficiile și dezavantajele acestei opțiuni înainte de a continua, deoarece este posibil să nu fie potrivită pentru toate cazurile de utilizare.

Modele de fond de ten SageMaker JumpStart

O opțiune excelentă pentru implementarea rezumatului pe SageMaker este utilizarea modelelor de fundație JumpStart. Aceste modele, dezvoltate de organizații de cercetare IA de vârf, oferă o gamă de modele de limbaj pre-antrenate optimizate pentru diferite sarcini, inclusiv rezumarea textului. SageMaker JumpStart oferă două tipuri de modele de fundație: modele proprietare și modele open-source. SageMaker JumpStart oferă, de asemenea, eligibilitatea HIPAA, făcându-l util pentru sarcinile de lucru din domeniul sănătății. În cele din urmă, este la latitudinea clientului să asigure conformitatea, așa că asigurați-vă că luați măsurile adecvate. Vedea Arhitectură pentru securitate și conformitate HIPAA pe Amazon Web Services pentru mai multe detalii.

Modele de fundație proprietare

Modelele proprietare, cum ar fi modelele Jurassic de la AI21 și modelul Cohere Generate de la Cohere, pot fi descoperite prin SageMaker JumpStart pe Consola de administrare AWS și sunt în prezent în previzualizare. Utilizarea modelelor proprietare pentru rezumare este ideală atunci când nu trebuie să vă ajustați modelul pe date personalizate. Aceasta oferă o soluție ieșită din cutie, ușor de utilizat, care poate îndeplini cerințele dvs. de rezumare cu o configurație minimă. Folosind capacitățile acestor modele pre-instruite, puteți economisi timp și resurse care altfel ar fi cheltuite pentru formarea și reglarea fină a unui model personalizat. În plus, modelele proprietare vin de obicei cu API-uri și SDK-uri ușor de utilizat, simplificând procesul de integrare cu sistemele și aplicațiile existente. Dacă nevoile dvs. de rezumat pot fi satisfăcute de modele brevetate pre-instruite fără a necesita personalizare specifică sau reglare fină, acestea oferă o soluție convenabilă, rentabilă și eficientă pentru sarcinile dvs. de rezumare a textului. Deoarece aceste modele nu sunt instruite special pentru cazurile de utilizare în domeniul sănătății, calitatea nu poate fi garantată pentru limbajul medical din cutie fără reglaj fin.

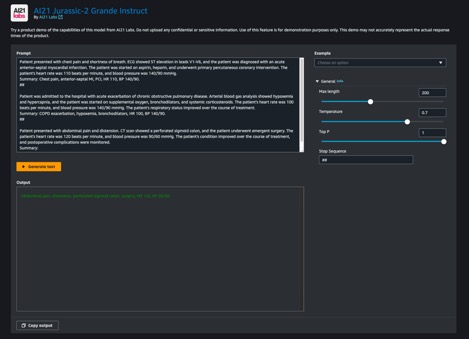

Jurassic-2 Grande Instruct este un model de limbaj mare (LLM) de AI21 Labs, optimizat pentru instrucțiuni în limbaj natural și aplicabil la diferite sarcini lingvistice. Oferă un API ușor de utilizat și un SDK Python, echilibrând calitatea și accesibilitatea. Utilizările populare includ generarea de copii de marketing, alimentarea chatbot-urilor și rezumarea textului.

Pe consola SageMaker, navigați la SageMaker JumpStart, găsiți modelul AI21 Jurassic-2 Grande Instruct și alegeți Încearcă modelul.

Dacă doriți să implementați modelul într-un punct final SageMaker pe care îl gestionați, puteți urma pașii din acest exemplu caiet, care vă arată cum să implementați Jurassic-2 Large folosind SageMaker.

Modele de fundații open-source

Modelele open-source includ modele FLAN T5, Bloom și GPT-2 care pot fi descoperite prin SageMaker JumpStart în Amazon SageMaker Studio UI, SageMaker JumpStart pe consola SageMaker și API-urile SageMaker JumpStart. Aceste modele pot fi reglate fin și implementate la punctele finale din contul dvs. AWS, oferindu-vă proprietatea deplină a greutăților modelului și a codurilor de script.

Flan-T5 XL este un model puternic și versatil conceput pentru o gamă largă de sarcini lingvistice. Prin reglarea fină a modelului cu datele specifice domeniului dvs., îi puteți optimiza performanța pentru cazul dvs. particular de utilizare, cum ar fi rezumarea textului sau orice altă sarcină NLP. Pentru detalii despre cum să reglați fin Flan-T5 XL utilizând interfața de utilizare SageMaker Studio, consultați Reglarea fină a instrucțiunilor pentru FLAN T5 XL cu Amazon SageMaker Jumpstart.

Reglați fin modelele pre-antrenate cu Hugging Face pe SageMaker

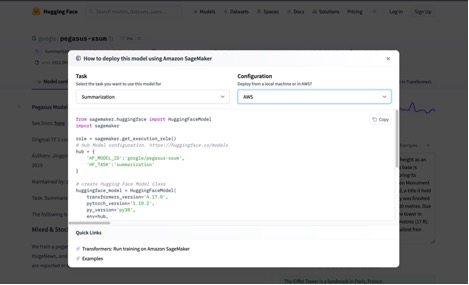

Una dintre cele mai populare opțiuni pentru implementarea rezumatului pe SageMaker este reglarea fină a modelelor pre-antrenate folosind Hugging Face transformatoare bibliotecă. Hugging Face oferă o gamă largă de modele de transformatoare pre-antrenate special concepute pentru diverse sarcini de procesare a limbajului natural (NLP), inclusiv rezumarea textului. Cu biblioteca Hugging Face Transformers, puteți ajusta cu ușurință aceste modele pre-antrenate pe datele specifice domeniului dvs. folosind SageMaker. Această abordare are mai multe avantaje, cum ar fi timpi mai rapidi de antrenament, performanțe mai bune pe domenii specifice și împachetare și implementare mai ușoară a modelului folosind instrumente și servicii încorporate SageMaker. Dacă nu reușiți să găsiți un model potrivit în SageMaker JumpStart, puteți alege orice model oferit de Hugging Face și îl puteți regla cu SageMaker.

Pentru a începe să lucrați cu un model pentru a afla despre capabilitățile ML, tot ce trebuie să faceți este să deschideți SageMaker Studio, să găsiți un model pre-antrenat pe care doriți să îl utilizați în Hugging Face Model Hubși alegeți SageMaker ca metodă de implementare. Hugging Face vă va oferi codul pentru a copia, lipi și rula în blocnotes. E la fel de simplu! Nu este necesară experiența în inginerie ML.

Biblioteca Hugging Face Transformers le permite constructorilor să opereze pe modele pre-antrenate și să facă sarcini avansate, cum ar fi reglarea fină, pe care le explorăm în secțiunile următoare.

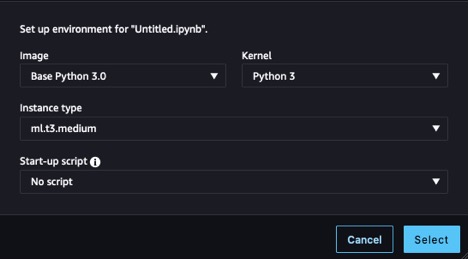

Asigurarea resurselor

Înainte de a începe, trebuie să punem la dispoziție un notebook. Pentru instrucțiuni, consultați pașii 1 și 2 in Construiți și instruiți un model de învățare automată la nivel local. Pentru acest exemplu, am folosit setările prezentate în următoarea captură de ecran.

De asemenea, trebuie să creăm un Serviciul Amazon de stocare simplă (Amazon S3) pentru a stoca datele de antrenament și artefactele de antrenament. Pentru instrucțiuni, consultați Crearea unei găleți.

Pregătiți setul de date

Pentru a ne ajusta modelul pentru a avea cunoștințe mai bune despre domeniu, trebuie să obținem date potrivite pentru sarcină. Când vă instruiți pentru un caz de utilizare al întreprinderii, va trebui să parcurgeți o serie de sarcini de inginerie a datelor pentru a vă pregăti propriile date pentru a fi pregătiți pentru instruire. Aceste sarcini nu fac obiectul acestui post. Pentru acest exemplu, am generat câteva date sintetice pentru a emula note de îngrijire și le-am stocat în Amazon S3. Stocarea datelor noastre în Amazon S3 ne permite proiectați sarcinile noastre de lucru pentru conformitatea HIPAA. Începem prin a obține acele note și a le încărca pe instanța în care rulează notebook-ul nostru:

Notele sunt compuse dintr-o coloană care conține intrarea completă, notă și o coloană care conține o versiune scurtată care exemplifica ceea ce ar trebui să fie rezultatul dorit, rezumat. Scopul utilizării acestui set de date este de a îmbunătăți vocabularul biologic și medical al modelului nostru, astfel încât să fie mai adaptat la rezumatul într-un context de asistență medicală, numit reglajul fin al domeniuluiși arată modelului nostru cum să-și structureze rezultatul rezumat. În unele cazuri de rezumat, este posibil să dorim să creăm un rezumat dintr-un articol sau un rezumat dintr-o linie al unei recenzii, dar în acest caz, încercăm să facem ca modelul nostru să scoată o versiune prescurtată a simptomelor și acțiunilor întreprinse. pentru un pacient de până acum.

Încărcați modelul

Modelul pe care îl folosim ca bază este o versiune a lui Google Pegasus, disponibilă în Hugging Face Hub, numită pegasus-xsum. Este deja pregătit în prealabil pentru rezumat, astfel încât procesul nostru de reglare fină se poate concentra pe extinderea cunoștințelor de domeniu. Modificarea sarcinii pe care o rulează modelul nostru este un alt tip de reglare fină care nu este tratată în această postare. Biblioteca Transformer ne oferă o clasă pentru a încărca definiția modelului din nostru model_checkpoint: google/pegasus-xsum. Acest lucru va încărca modelul din hub și îl va instanția în notebook-ul nostru, astfel încât să îl putem folosi mai târziu. Deoarece pegasus-xsum este un model secvență-la-secvență, dorim să folosim tipul Seq2Seq al AutoModel clasă:

Acum că avem modelul nostru, este timpul să ne punem atenția asupra celorlalte componente care ne vor permite să rulăm bucla de antrenament.

Creați un tokenizer

Prima dintre aceste componente este tokenizer-ul. tokenizarea este procesul prin care cuvintele din datele de intrare sunt transformate în reprezentări numerice pe care modelul nostru le poate înțelege. Din nou, biblioteca Transformer oferă o clasă pentru a încărca o definiție de tokenizer din același punct de control pe care l-am folosit pentru a instanția modelul:

Cu acest obiect tokenizer, putem crea o funcție de preprocesare și o mapam pe setul nostru de date pentru a ne oferi token-uri gata să fie introduse în model. În cele din urmă, formatăm rezultatul tokenizat și eliminăm coloanele care conțin textul nostru original, deoarece modelul nu le va putea interpreta. Acum am rămas cu o intrare tokenizată gata de a fi introdusă în model. Vezi următorul cod:

Cu datele noastre tokenizate și modelul nostru instanțiat, suntem aproape gata să rulăm o buclă de antrenament. Următoarele componente pe care vrem să le creăm sunt colatorul de date și optimizatorul. Colaboratorul de date este o altă clasă oferită de Hugging Face prin biblioteca Transformers, pe care o folosim pentru a crea loturi de date tokenizate pentru antrenament. Putem construi cu ușurință acest lucru folosind tokenizer-ul și obiectele model pe care le avem deja doar prin găsirea tipului de clasă corespunzător pe care l-am folosit anterior pentru modelul nostru (Seq2Seq) pentru clasa colator. Funcția optimizatorului este de a menține starea de antrenament și de a actualiza parametrii pe baza pierderii noastre de antrenament pe măsură ce lucrăm prin buclă. Pentru a crea un optimizator, putem importa optim pachet din modulul torță, unde sunt disponibili o serie de algoritmi de optimizare. Unele obișnuite pe care le-ați mai întâlnit înainte sunt Stochastic Gradient Descent și Adam, acesta din urmă fiind aplicat în exemplul nostru. Constructorul lui Adam preia parametrii modelului și rata de învățare parametrizată pentru cursa de antrenament dată. Vezi următorul cod:

Ultimii pași înainte de a începe antrenamentul sunt să construim acceleratorul și programatorul ratei de învățare. Acceleratorul provine dintr-o bibliotecă diferită (folosim în principal Transformers) produsă de Hugging Face, numită corect Accelerate și va abstrage logica necesară pentru a gestiona dispozitivele în timpul antrenamentului (folosind mai multe GPU-uri, de exemplu). Pentru componenta finală, revedem biblioteca Transformers mereu utilă pentru a implementa programatorul nostru de rate de învățare. Prin specificarea tipului de planificator, a numărului total de pași de antrenament din bucla noastră și a optimizatorului creat anterior, get_scheduler funcția returnează un obiect care ne permite să ne ajustam rata de învățare inițială pe tot parcursul procesului de formare:

Acum suntem complet pregătiți pentru antrenament! Să înființăm un job de formare, începând prin a instanția training_args folosind biblioteca Transformers și alegerea valorilor parametrilor. Le putem transmite, împreună cu celelalte componente pregătite și setul de date, direct către antrenor și începeți antrenamentul, așa cum se arată în codul următor. În funcție de dimensiunea setului de date și de parametrii aleși, acest lucru poate dura o perioadă semnificativă de timp.

Pachetați modelul pentru inferență

După rularea antrenamentului, obiectul model este gata pentru a fi utilizat pentru inferență. Ca cea mai bună practică, să ne salvăm munca pentru utilizare ulterioară. Trebuie să ne creăm artefactele modelului, să le comprimam împreună și să încărcăm tarball-ul nostru pe Amazon S3 pentru stocare. Pentru a pregăti modelul nostru pentru zipping, trebuie să despachetăm modelul acum reglat, apoi să salvăm binarul modelului și fișierele de configurare asociate. De asemenea, trebuie să ne salvăm tokenizerul în același director în care am salvat artefactele modelului, astfel încât să fie disponibil atunci când folosim modelul pentru inferență. Al nostru model_dir folderul ar trebui să arate acum ceva ca următorul cod:

Tot ce rămâne este să rulăm o comandă tar pentru a arhiva directorul nostru și a încărca fișierul tar.gz pe Amazon S3:

Modelul nostru recent reglat este acum gata și disponibil pentru a fi utilizat pentru inferență.

Efectuați inferența

Pentru a utiliza acest artefact model pentru inferență, deschideți un fișier nou și utilizați următorul cod, modificând model_data parametru pentru a se potrivi locației dvs. de salvare a artefactului în Amazon S3. The HuggingFaceModel constructorul va reconstrui modelul nostru de la punctul de control în care am salvat model.tar.gz, pe care apoi îl putem implementa pentru inferență folosind metoda deploy. Implementarea punctului final va dura câteva minute.

După ce punctul final este implementat, putem folosi predictorul pe care l-am creat pentru a-l testa. Treceți predict metoda o sarcină utilă de date și rulați celula și veți primi răspunsul de la modelul dvs. reglat fin:

Pentru a vedea beneficiul reglajului fin al unui model, haideți să facem un test rapid. Următorul tabel include un prompt și rezultatele transmiterii acelui prompt către model înainte și după reglare fină.

| Prompt | Răspuns fără reglaj fin | Răspuns cu reglaj fin |

| Rezumați simptomele pe care le întâmpină pacientul. Pacientul este un bărbat în vârstă de 45 de ani, cu plângeri de durere toracică substernală care iradiază către brațul stâng. Durerea apare brusc în timp ce lucra în curte, asociată cu scurtarea ușoară a respirației și diaforeza. La sosire, ritmul cardiac al pacientului a fost 120, ritmul respirator 24, tensiunea arterială 170/95. Electrocardiograma cu 12 derivații efectuată la sosirea la urgență și trei nitroglicerine sublinguale administrate fără ameliorarea durerii toracice. Electrocardiograma arată supradenivelarea ST în derivațiile anterioare demonstrând infarct miocardic anterior acut. Am contactat laboratorul de cateterism cardiac și am pregătit pentru cateterismul cardiac de către un cardiolog. | Prezentăm un caz de infarct miocardic acut. | Dureri toracice, IM anterior, PCI. |

După cum puteți vedea, modelul nostru bine ajustat utilizează terminologia de sănătate în mod diferit și am reușit să schimbăm structura răspunsului pentru a se potrivi scopurilor noastre. Rețineți că rezultatele depind de setul de date și de alegerile de proiectare făcute în timpul antrenamentului. Versiunea dvs. a modelului ar putea oferi rezultate foarte diferite.

A curăța

Când ați terminat cu notebook-ul SageMaker, asigurați-vă că îl închideți pentru a evita costurile legate de resursele de lungă durată. Rețineți că închiderea instanței vă va face să pierdeți orice date stocate în memoria efemeră a instanței, așa că ar trebui să vă salvați toată munca pe stocarea persistentă înainte de curățare. De asemenea, va trebui să mergeți la Puncte finale pagina din consola SageMaker și ștergeți toate punctele finale implementate pentru inferență. Pentru a elimina toate artefactele, trebuie să accesați consola Amazon S3 pentru a șterge fișierele încărcate în găleată.

Concluzie

În această postare, am explorat diferite opțiuni pentru implementarea tehnicilor de rezumare a textului pe SageMaker pentru a ajuta profesioniștii din domeniul sănătății să proceseze și să extragă în mod eficient informații din cantități mari de date clinice. Am discutat despre utilizarea modelelor de fond de ten SageMaker Jumpstart, ajustarea modelelor pre-antrenate de la Hugging Face și construirea de modele personalizate de rezumat. Fiecare abordare are propriile sale avantaje și dezavantaje, răspunzând nevoilor și cerințelor diferite.

Construirea modelelor de rezumat personalizate pe SageMaker permite multă flexibilitate și control, dar necesită mai mult timp și resurse decât utilizarea modelelor pre-instruite. Modelele de fundație SageMaker Jumpstart oferă o soluție ușor de utilizat și rentabilă pentru organizațiile care nu necesită personalizare sau reglare fină specifică, precum și unele opțiuni pentru reglarea fină simplificată. Reglarea fină a modelelor pre-antrenate de la Hugging Face oferă timpi de antrenament mai rapizi, performanțe mai bune specifice domeniului și integrare perfectă cu instrumentele și serviciile SageMaker într-un catalog larg de modele, dar necesită un efort de implementare. La momentul scrierii acestei postări, Amazon a anunțat o altă opțiune, Amazon Bedrock, care va oferi capabilități de rezumat într-un mediu și mai gestionat.

Înțelegând avantajele și dezavantajele fiecărei abordări, profesioniștii din domeniul sănătății și organizațiile pot lua decizii informate cu privire la cea mai potrivită soluție pentru a genera rezumate concise și precise ale datelor clinice complexe. În cele din urmă, utilizarea modelelor de rezumat bazate pe AI/ML pe SageMaker poate îmbunătăți în mod semnificativ îngrijirea pacienților și luarea deciziilor, permițând profesioniștilor medicali să acceseze rapid informații relevante și să se concentreze pe furnizarea de îngrijiri de calitate.

Resurse

Pentru scriptul complet discutat în această postare și câteva exemple de date, consultați GitHub repo. Pentru mai multe informații despre cum să rulați încărcături de lucru ML pe AWS, consultați următoarele resurse:

Despre autori

Cody Collins este un arhitect de soluții cu sediul în New York la Amazon Web Services. Lucrează cu clienții ISV pentru a construi soluții de vârf în industrie în cloud. El a livrat cu succes proiecte complexe pentru diverse industrii, optimizând eficiența și scalabilitatea. În timpul liber, îi place să citească, să călătorească și să antreneze jiu jitsu.

Cody Collins este un arhitect de soluții cu sediul în New York la Amazon Web Services. Lucrează cu clienții ISV pentru a construi soluții de vârf în industrie în cloud. El a livrat cu succes proiecte complexe pentru diverse industrii, optimizând eficiența și scalabilitatea. În timpul liber, îi place să citească, să călătorească și să antreneze jiu jitsu.

Ameer Hakme este un arhitect de soluții AWS cu domiciliul în Pennsylvania. Accentul său profesional implică colaborarea cu furnizori independenți de software din nord-est, îndrumându-i în proiectarea și construirea de platforme scalabile, de ultimă generație, pe AWS Cloud.

Ameer Hakme este un arhitect de soluții AWS cu domiciliul în Pennsylvania. Accentul său profesional implică colaborarea cu furnizori independenți de software din nord-est, îndrumându-i în proiectarea și construirea de platforme scalabile, de ultimă generație, pe AWS Cloud.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. Automobile/VE-uri, carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- BlockOffsets. Modernizarea proprietății de compensare a mediului. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Capabil

- Despre Noi

- REZUMAT

- accelera

- accelerator

- acces

- Cont

- precis

- peste

- acțiuni

- Adam

- adresare

- administrată

- avansat

- Avantajele

- După

- din nou

- agregare

- AI

- cercetare ai

- AI / ML

- algoritmi

- TOATE

- Permiterea

- permite

- de-a lungul

- deja

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon Web Services

- sumă

- Sume

- an

- analiza

- și

- a anunțat

- O alta

- Orice

- api

- API-uri

- aplicabil

- aplicatii

- aplicat

- abordare

- abordari

- adecvat

- arhitectură

- SUNT

- ARM

- sosire

- articol

- AS

- asociate

- At

- atenţie

- automatizarea

- disponibil

- evita

- departe

- AWS

- de echilibrare

- bazat

- BE

- deoarece

- fost

- înainte

- începe

- beneficia

- Beneficiile

- CEL MAI BUN

- Mai bine

- BIN

- sânge

- Tensiune arterială

- Floare

- Cutie

- Respirație

- larg

- construi

- constructori

- Clădire

- construit

- construit-in

- dar

- by

- apel

- denumit

- CAN

- capacități

- pasă

- cu grijă

- caz

- cazuri

- catalog

- Provoca

- provocări

- Schimbare

- chatbots

- alegeri

- Alege

- alegere

- ales

- clasă

- clinic

- Cloud

- cod

- Coduri

- Codificare

- colaborarea

- Coloană

- Coloane

- cum

- vine

- Comun

- comparație

- plângeri

- complex

- conformitate

- component

- componente

- compuse

- concis

- Configuraţie

- Contra

- Consoleze

- construirea

- context

- Control

- Convenabil

- Corespunzător

- cost-eficiente

- Cheltuieli

- ar putea

- acoperit

- crea

- a creat

- Crearea

- crucial

- În prezent

- personalizat

- client

- clienţii care

- personalizare

- de date

- seturi de date

- Luarea deciziilor

- Deciziile

- definiție

- livrate

- demonstrând

- Departament

- Dependent/ă

- În funcție

- implementa

- dislocate

- Implementarea

- desfășurarea

- Amenajări

- proiectat

- proiect

- dorit

- detalii

- dezvoltat

- Dispozitive

- diferit

- direct

- a descoperit

- discuta

- discutat

- diferit

- do

- Medici

- face

- domeniu

- domenii

- făcut

- Dont

- jos

- dezavantaje

- în timpul

- fiecare

- mai ușor

- cu ușurință

- uşor

- ușor de folosit

- în mod eficient

- eficiență

- eficient

- eficient

- efort

- Electronic

- Evidențe electronice de sănătate

- eligibilitate

- caz de urgență

- permite

- permite

- permițând

- Punct final

- Inginerie

- spori

- asigura

- Afacere

- intrare

- Mediu inconjurator

- epocă

- esenţial

- Chiar

- evoluție

- exemplu

- existent

- experienţă

- confruntă

- explora

- explorat

- Explorarea

- extindere

- extrage

- Față

- cu care se confruntă

- departe

- mai repede

- fed-

- puțini

- Fișier

- Fişiere

- final

- În cele din urmă

- Găsi

- descoperire

- First

- potrivi

- Flexibilitate

- Concentra

- urma

- următor

- Pentru

- format

- Fundație

- din

- Complet

- complet

- funcţie

- În plus

- viitor

- Câştig

- General

- genera

- generată

- generator

- obține

- obtinerea

- Da

- dat

- Oferirea

- Go

- unități de procesare grafică

- mare

- mai mare

- garantat

- Avea

- he

- Sănătate

- de asistență medicală

- inimă

- ajutor

- lui

- găzduire

- Cum

- Cum Pentru a

- HTML

- http

- HTTPS

- Butuc

- Față îmbrățișată

- ideal

- if

- Imaging

- punerea în aplicare a

- implementarea

- Punere în aplicare a

- import

- important

- îmbunătăţi

- in

- în profunzime

- include

- include

- Inclusiv

- independent

- industrii

- industrie

- informații

- informat

- inițială

- intrare

- intrări

- perspective

- instanță

- instrucțiuni

- integrare

- Inteligență

- în

- implica

- IT

- ESTE

- Loc de munca

- JSON

- doar

- Cunoaște

- cunoştinţe

- de laborator

- Labs

- peisaj

- limbă

- mare

- Nume

- mai tarziu

- conduce

- conducere

- Conduce

- AFLAȚI

- învăţare

- stânga

- Bibliotecă

- ca

- LLM

- încărca

- încărcare

- locaţie

- logică

- Uite

- pierde

- de pe

- maşină

- masina de învățare

- făcut

- menține

- face

- Efectuarea

- administra

- gestionate

- administrare

- Hartă

- Marketing

- Mai..

- însemna

- medical

- Întâlni

- Memorie

- cu

- metodă

- ar putea

- minim

- minute

- ML

- model

- Modele

- Module

- mai mult

- cele mai multe

- Cel mai popular

- multiplu

- Numit

- Natural

- Procesarea limbajului natural

- Navigaţi

- Nevoie

- nevoilor

- Nou

- New York

- recent

- următor

- nlp

- Nu.

- caiet

- notițe

- acum

- număr

- obiect

- obiecte

- of

- oferi

- oferit

- promoții

- Vechi

- on

- ONE

- cele

- atac

- pe

- deschide

- open-source

- funcionar

- optimizare

- Optimizați

- optimizate

- optimizarea

- Opțiune

- Opţiuni

- or

- comandă

- organizații

- original

- Altele

- in caz contrar

- al nostru

- afară

- producție

- exterior

- peste

- propriu

- proprietate

- pachet

- ambalaje

- pagină

- Durere

- parametru

- parametrii

- special

- trece

- Care trece

- pacient

- pacientes

- Pegasus

- Pennsylvania

- performanță

- aparținând

- Expresii

- platformă

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- Punct

- Popular

- Post

- puternic

- Alimentarea

- practică

- Predictor

- a prefera

- Pregăti

- pregătit

- prezenta

- presiune

- Anunţ

- în prealabil

- în primul rând

- proces

- procese

- prelucrare

- Produs

- profesional

- profesioniști

- Proiecte

- promisiune

- proprietate

- PROS

- furniza

- prevăzut

- furnizează

- furnizarea

- dispoziţie

- scop

- scopuri

- pune

- Piton

- calitate

- Rapid

- repede

- gamă

- repede

- rată

- Citind

- gata

- lumea reală

- înregistrări

- relief

- scoate

- Rapoarte

- necesita

- necesar

- Cerinţe

- Necesită

- cercetare

- Resurse

- răspuns

- REZULTATE

- Returnează

- revizuiască

- Rol

- Alerga

- funcţionare

- ruleaza

- sagemaker

- acelaşi

- Economisiți

- scalabilitate

- scalabil

- domeniu

- zgâria

- sdk

- sdks

- fără sudură

- secțiuni

- securitate

- vedea

- distinct

- serviciu

- Servicii

- set

- instalare

- setări

- câteva

- scurtat

- să

- Arăta

- indicat

- Emisiuni

- închide

- cerne

- semnificativ

- semnificativ

- asemănător

- simplu

- simplificată

- Mărimea

- So

- până acum

- Software

- soluţie

- soluţii

- unele

- ceva

- Surse

- specific

- specific

- uzat

- Începe

- Pornire

- Stat

- de ultimă oră

- paşi

- depozitare

- stoca

- stocate

- stocarea

- raționalizarea

- structura

- studio

- sublinguală

- Reușit

- astfel de

- brusc

- Costum

- potrivit

- REZUMAT

- sigur

- Simptome

- rezumat

- sintetic

- date sintetice

- sisteme

- tabel

- Lua

- luate

- ia

- Sarcină

- sarcini

- tehnici de

- terminologie

- termeni

- test

- decât

- acea

- hubul

- Lor

- apoi

- Acestea

- ei

- acest

- aceste

- trei

- Prin

- de-a lungul

- timp

- consumă timp

- ori

- la

- azi

- împreună

- cuvinte pot

- indicativele

- Unelte

- lanternă

- Total

- Tren

- dresat

- Pregătire

- transformat

- transformator

- transformatoare

- Traveling

- Două

- tip

- Tipuri

- tipic

- ui

- în cele din urmă

- incapabil

- în

- înţelege

- înţelegere

- Actualizează

- încărcat

- us

- utilizare

- carcasa de utilizare

- utilizat

- ușor de utilizat

- utilizări

- folosind

- Utilizand

- validare

- Valori

- diverse

- Fixă

- furnizori

- multilateral

- versiune

- foarte

- volume

- vrea

- a fost

- we

- Bogatie

- web

- servicii web

- cântări

- BINE

- Ce

- cand

- care

- în timp ce

- larg

- Gamă largă

- voi

- cu

- fără

- cuvinte

- Apartamente

- de lucru

- fabrică

- ar

- scris

- an

- York

- Tu

- Ta

- zephyrnet

- Zip