KT Corporation este unul dintre cei mai mari furnizori de telecomunicații din Coreea de Sud, oferind o gamă largă de servicii, inclusiv servicii de telefonie fixă, comunicații mobile și internet și servicii AI. KT’s AI Food Tag este o soluție de management alimentară bazată pe inteligență artificială care identifică tipul și conținutul nutrițional al alimentelor în fotografii folosind un model de viziune computerizată. Acest model de viziune dezvoltat de KT se bazează pe un model pre-antrenat cu o cantitate mare de date de imagine neetichetate pentru a analiza conținutul nutrițional și informațiile de calorii ale diferitelor alimente. Eticheta AI Food Tag poate ajuta pacienții cu boli cronice, cum ar fi diabetul, să își gestioneze dieta. KT a folosit AWS și Amazon SageMaker pentru a antrena acest model AI Food Tag de 29 de ori mai rapid decât înainte și a-l optimiza pentru implementarea în producție cu o tehnică de distilare a modelului. În această postare, descriem călătoria de dezvoltare a modelului KT și succesul utilizând SageMaker.

Prezentarea proiectului KT și definirea problemei

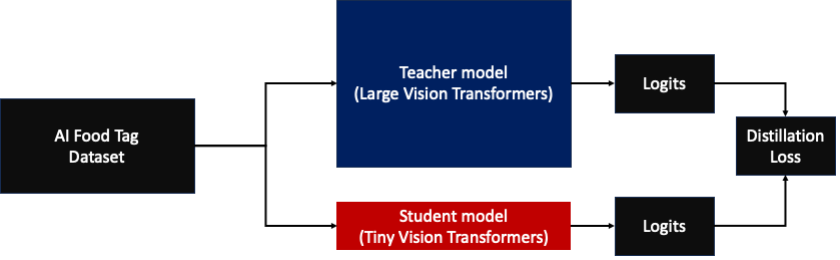

Modelul AI Food Tag pre-antrenat de KT se bazează pe arhitectura transformatoarelor de viziune (ViT) și are mai mulți parametri de model decât modelul lor de viziune anterior pentru a îmbunătăți acuratețea. Pentru a micșora dimensiunea modelului pentru producție, KT folosește o tehnică de distilare a cunoștințelor (KD) pentru a reduce numărul de parametri ai modelului fără un impact semnificativ asupra preciziei. Cu distilare de cunoștințe, modelul pre-antrenat se numește a model de profesor, iar un model de ieșire ușor este antrenat ca a model de student, după cum este ilustrat în figura următoare. Modelul de elev ușor are mai puțini parametri de model decât profesorul, ceea ce reduce cerințele de memorie și permite implementarea în instanțe mai mici și mai puțin costisitoare. Elevul menține o acuratețe acceptabilă chiar dacă este mai mică prin învățarea din rezultatele modelului profesorului.

Modelul profesorului rămâne neschimbat în timpul KD, dar modelul elevului este antrenat utilizând logit-urile de ieșire ale modelului profesorului ca etichete pentru a calcula pierderea. Cu această paradigmă KD, atât profesorul, cât și elevul trebuie să fie pe o singură memorie GPU pentru antrenament. KT a folosit inițial două GPU-uri (A100 80 GB) în mediul lor intern, on-premises, pentru a antrena modelul studentului, dar procesul a durat aproximativ 40 de zile pentru a acoperi 300 de epoci. Pentru a accelera formarea și a genera un model de student în mai puțin timp, KT a încheiat un parteneriat cu AWS. Împreună, echipele au redus semnificativ timpul de pregătire a modelului. Această postare descrie modul în care echipa a folosit Instruire Amazon SageMaker, Biblioteca de paralelism de date SageMaker, Debugger Amazon SageMaker, și Amazon SageMaker Profiler pentru a dezvolta cu succes un model ușor de AI Food Tag.

Construirea unui mediu de instruire distribuit cu SageMaker

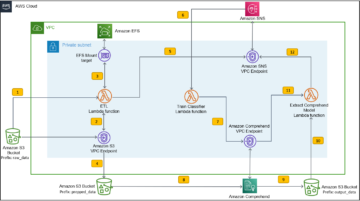

SageMaker Training este un mediu de instruire gestionat de învățare automată (ML) pe AWS care oferă o suită de caracteristici și instrumente pentru a simplifica experiența de instruire și poate fi util în calculul distribuit, așa cum este ilustrat în diagrama următoare.

Clienții SageMaker pot accesa, de asemenea, imagini Docker încorporate cu diverse cadre de învățare profundă preinstalate și pachetele necesare Linux, NCCL și Python pentru instruirea modelului. Oamenii de știință de date sau inginerii ML care doresc să desfășoare formarea modelului pot face acest lucru fără sarcina de a configura infrastructura de instruire sau de a gestiona Docker și compatibilitatea diferitelor biblioteci.

În timpul unui atelier de 1 zi, am reușit să setăm o configurație de instruire distribuită bazată pe SageMaker în contul AWS al KT, să accelerăm scripturile de instruire ale KT utilizând biblioteca SageMaker Distributed Data Parallel (DDP) și chiar să testăm un job de formare folosind doi ml. p4d.24xmari instanțe. În această secțiune, descriem experiența lui KT în lucrul cu echipa AWS și folosind SageMaker pentru a-și dezvolta modelul.

În dovada conceptului, am dorit să accelerăm un job de formare prin utilizarea bibliotecii SageMaker DDP, care este optimizată pentru infrastructura AWS în timpul instruirii distribuite. Pentru a trece de la PyTorch DDP la SageMaker DDP, trebuie pur și simplu să declarați torch_smddp pachet și schimbați backend-ul în smddp, așa cum se arată în următorul cod:

Pentru a afla mai multe despre biblioteca SageMaker DDP, consultați Biblioteca de paralelism de date SageMaker.

Analizarea cauzelor vitezei lente de antrenament cu SageMaker Debugger și Profiler

Primul pas în optimizarea și accelerarea volumului de lucru de formare implică înțelegerea și diagnosticarea unde apar blocajele. Pentru munca de formare a lui KT, am măsurat timpul de antrenament per iterație a încărctorului de date, trecere înainte și trecere înapoi:

| Timp de 1 iter – încărcător de date: 0.00053 sec, înainte: 7.77474 sec, înapoi: 1.58002 sec |

| Timp de 2 iter – încărcător de date: 0.00063 sec, înainte: 0.67429 sec, înapoi: 24.74539 sec |

| Timp de 3 iter – încărcător de date: 0.00061 sec, înainte: 0.90976 sec, înapoi: 8.31253 sec |

| Timp de 4 iter – încărcător de date: 0.00060 sec, înainte: 0.60958 sec, înapoi: 30.93830 sec |

| Timp de 5 iter – încărcător de date: 0.00080 sec, înainte: 0.83237 sec, înapoi: 8.41030 sec |

| Timp de 6 iter – încărcător de date: 0.00067 sec, înainte: 0.75715 sec, înapoi: 29.88415 sec |

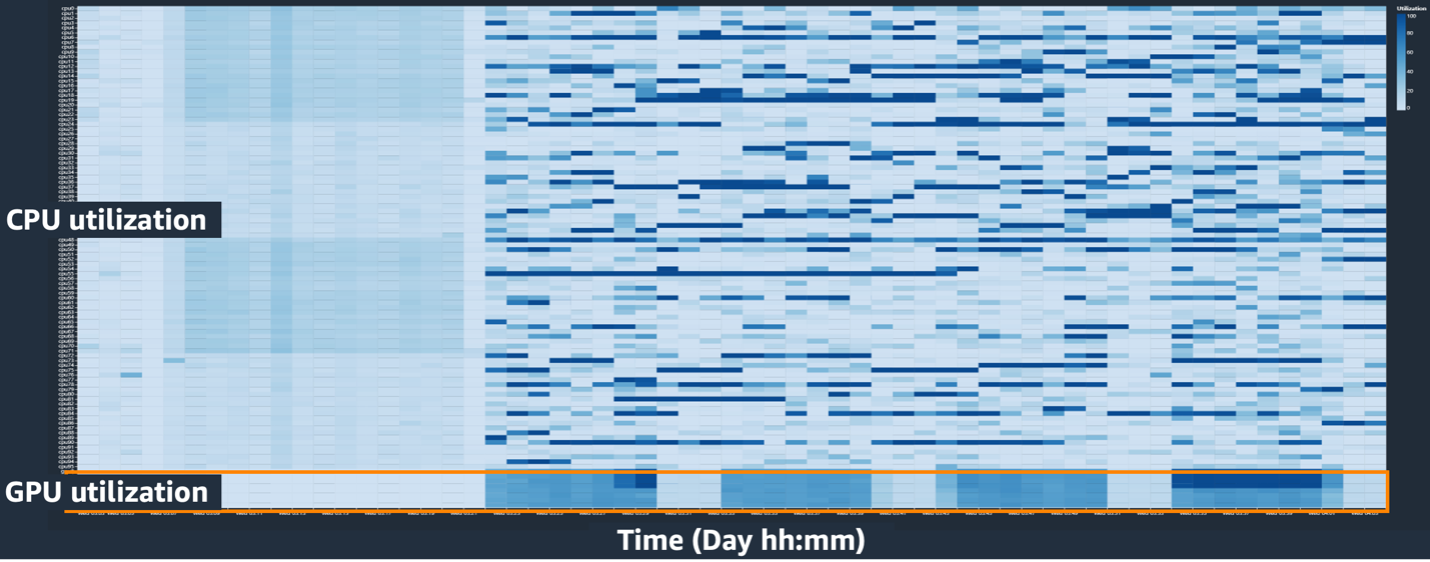

Privind timpul din ieșirea standard pentru fiecare iterație, am văzut că timpul de rulare al trecerii înapoi a fluctuat semnificativ de la o iterație la alta. Această variație este neobișnuită și poate afecta timpul total de antrenament. Pentru a găsi cauza acestei viteze de antrenament inconsecvente, am încercat mai întâi să identificăm blocajele resurselor utilizând System Monitor (SageMaker Debugger UI), care vă permite să depanați joburile de instruire pe SageMaker Training și să vedeți starea resurselor, cum ar fi platforma de instruire gestionată. CPU, GPU, rețea și I/O într-un număr stabilit de secunde.

Interfața de utilizare SageMaker Debugger oferă date detaliate și esențiale care pot ajuta la identificarea și diagnosticarea blocajelor într-o activitate de formare. Mai exact, ne-au atras atenția graficul cu linii de utilizare a procesorului și tabelele cu harta termică a utilizării CPU/GPU per instanță.

În diagrama cu linii de utilizare a procesorului, am observat că unele procesoare au fost utilizate 100%.

În harta termică (unde culorile mai închise indică o utilizare mai mare), am observat că câteva nuclee CPU au avut o utilizare ridicată pe tot parcursul antrenamentului, în timp ce utilizarea GPU-ului nu a fost constant ridicată de-a lungul timpului.

De aici, am început să bănuim că unul dintre motivele vitezei lente de antrenament a fost un blocaj al procesorului. Am revizuit codul scriptului de antrenament pentru a vedea dacă ceva a cauzat blocarea procesorului. Partea cea mai suspectă a fost valoarea mare a num_workers în încărcătorul de date, așa că am schimbat această valoare la 0 sau 1 pentru a reduce utilizarea CPU. Apoi am rulat din nou sarcina de antrenament și am verificat rezultatele.

Următoarele capturi de ecran arată graficul cu linii de utilizare a procesorului, utilizarea GPU-ului și harta termică după atenuarea blocajului procesorului.

Prin simpla schimbare num_workers, am observat o scădere semnificativă a utilizării CPU și o creștere generală a utilizării GPU. Aceasta a fost o schimbare importantă care a îmbunătățit semnificativ viteza de antrenament. Totuși, am vrut să vedem unde putem optimiza utilizarea GPU-ului. Pentru aceasta, am folosit SageMaker Profiler.

SageMaker Profiler ajută la identificarea indicii de optimizare, oferind vizibilitate asupra utilizării de către operațiuni, inclusiv urmărirea valorilor de utilizare a GPU și CPU și a consumului de kernel al GPU/CPU în cadrul scripturilor de antrenament. Ajută utilizatorii să înțeleagă ce operațiuni consumă resurse. În primul rând, pentru a utiliza SageMaker Profiler, trebuie să adăugați ProfilerConfig la funcția care invocă jobul de instruire folosind SDK-ul SageMaker, așa cum se arată în următorul cod:

În SDK-ul SageMaker Python, aveți flexibilitatea de a adăuga annotate funcții pentru SageMaker Profiler pentru a selecta codul sau pașii din scriptul de antrenament care necesită profilare. Următorul este un exemplu de cod pe care ar trebui să-l declarați pentru SageMaker Profiler în scripturile de antrenament:

După adăugarea codului precedent, dacă rulați un job de antrenament folosind scripturile de antrenament, puteți obține informații despre operațiunile consumate de nucleul GPU (după cum se arată în figura următoare) după rularea antrenamentului pentru o perioadă de timp. În cazul scripturilor de antrenament ale KT, l-am rulat pentru o epocă și am obținut următoarele rezultate.

Când am verificat primii cinci timpi de consum de operațiuni ai nucleului GPU printre rezultatele SageMaker Profiler, am constatat că pentru scriptul de antrenament KT, cel mai mult timp este consumat de operarea produsului matrice, care este o operație de multiplicare generală a matricei (GEMM). pe GPU-uri. Cu această perspectivă importantă din SageMaker Profiler, am început să investigăm modalități de a accelera aceste operațiuni și de a îmbunătăți utilizarea GPU-ului.

Accelerarea timpului de antrenament

Am analizat diferite moduri de a reduce timpul de calcul al înmulțirii matricei și am aplicat două funcții PyTorch.

Stările de optimizare a fragmentelor cu ZeroRedundancyOptimizer

Dacă te uiți la Zero Redundancy Optimizer (ZeRO), tehnica DeepSpeed/ZeRO permite antrenamentul unui model mare în mod eficient, cu o viteză de antrenament mai bună, eliminând redundanțele în memorie utilizate de model. ZeroRedundancyOptimizer în PyTorch utilizează tehnica de fragmentare a stării optimizatorului pentru a reduce utilizarea memoriei pe un proces în Distributed Data Parallel (DDP). DDP utilizează gradienți sincronizați în trecerea înapoi, astfel încât toate replicile optimizatorului să itereze peste aceiași parametri și valori de gradient, dar în loc să aibă toți parametrii modelului, fiecare stare de optimizare este menținută prin fragmentare numai pentru diferite procese DDP pentru a reduce utilizarea memoriei.

Pentru a-l folosi, puteți lăsa Optimizer existent optimizer_class și declară a ZeroRedundancyOptimizer cu restul parametrilor modelului și rata de învățare ca parametri.

Precizie mixtă automată

Precizie mixtă automată (AMP) folosește tipul de date torch.float32 pentru unele operațiuni și torță.bfloat16 sau torch.float16 pentru alții, pentru confortul calculării rapide și utilizarea redusă a memoriei. În special, deoarece modelele de învățare profundă sunt de obicei mai sensibile la biții exponenți decât biții de fracție în calculele lor, torch.bfloat16 este echivalent cu biții exponenți ai torch.float32, permițându-le să învețe rapid cu pierderi minime. torch.bfloat16 rulează numai pe instanțe cu arhitectură NVIDIA A100 (Ampere) sau mai mare, cum ar fi ml.p4d.24xlarge, ml.p4de.24xlarge și ml.p5.48xlarge.

Pentru a aplica AMP, puteți declara torch.cuda.amp.autocast în scripturile de antrenament, așa cum se arată în codul de mai sus și declarați dtype ca torţă.bfloat16.

Rezultate în SageMaker Profiler

După ce am aplicat cele două funcții la scripturile de antrenament și am rulat din nou un job de tren pentru o epocă, am verificat primii cinci timpi de consum de operațiuni pentru nucleul GPU în SageMaker Profiler. Următoarea figură arată rezultatele noastre.

Putem vedea că operațiunea GEMM, care era în fruntea listei înainte de aplicarea celor două funcții Torch, a dispărut din primele cinci operațiuni, înlocuită de operațiunea ReduceScatter, care apare de obicei în antrenamentul distribuit.

Rezultatele vitezei de antrenament ale modelului distilat KT

Am mărit dimensiunea lotului de instruire cu încă 128 pentru a ține cont de economiile de memorie din aplicarea celor două funcții Torch, rezultând o dimensiune finală a lotului de 1152 în loc de 1024. Antrenamentul modelului final de student a putut rula 210 epoci pe 1 zi. ; timpul de antrenament și accelerarea dintre mediul intern de antrenament al KT și SageMaker sunt rezumate în tabelul următor.

| Mediul de antrenament | Specificații GPU de antrenament. | Numărul de GPU | Timp de antrenament (ore) | Epocă | Ore pe Epocă | Raportul de reducere |

| Mediul intern de instruire al KT | A100 (80 GB) | 2 | 960 | 300 | 3.20 | 29 |

| Amazon SageMaker | A100 (40 GB) | 32 | 24 | 210 | 0.11 | 1 |

Scalabilitatea AWS ne-a permis să finalizăm munca de formare de 29 de ori mai rapid decât înainte, utilizând 32 de GPU-uri în loc de 2 în local. Ca rezultat, utilizarea mai multor GPU-uri pe SageMaker ar fi redus semnificativ timpul de antrenament fără nicio diferență în costurile totale de instruire.

Concluzie

Park Sang-min (Vision AI Serving Technology Team Leader) de la AI2XL Lab din KT's Convergence Technology Center a comentat despre colaborarea cu AWS pentru a dezvolta modelul AI Food Tag:

„Recent, deoarece există mai multe modele bazate pe transformatoare în domeniul vederii, parametrii modelului și memoria GPU necesară sunt în creștere. Folosim tehnologie ușoară pentru a rezolva această problemă și este nevoie de mult timp, aproximativ o lună pentru a învăța o dată. Prin acest PoC cu AWS, am reușit să identificăm blocajele de resurse cu ajutorul SageMaker Profiler și Debugger, să le rezolvăm și apoi să folosim biblioteca de paralelism de date SageMaker pentru a finaliza instruirea în aproximativ o zi cu codul de model optimizat pe patru ml.p4d. 24 de cazuri mari.”

SageMaker a ajutat să economisească echipei lui Sang-min săptămâni de timp în pregătirea și dezvoltarea modelelor.

Pe baza acestei colaborări asupra modelului de viziune, AWS și echipa SageMaker vor continua să colaboreze cu KT la diferite proiecte de cercetare AI/ML pentru a îmbunătăți dezvoltarea modelului și productivitatea serviciilor prin aplicarea capabilităților SageMaker.

Pentru a afla mai multe despre funcțiile asociate din SageMaker, consultați următoarele:

Despre autori

Youngjoon Choi, AI/ML Expert SA, are experiență în IT pentru întreprinderi în diverse industrii, cum ar fi producția, high-tech și finanțele, ca dezvoltator, arhitect și cercetător de date. El a efectuat cercetări privind învățarea automată și învățarea profundă, în special pe subiecte precum optimizarea hiperparametrilor și adaptarea domeniilor, prezentând algoritmi și lucrări. La AWS, el este specializat în AI/ML în diverse industrii, oferind validare tehnică folosind serviciile AWS pentru formare distribuită/modele la scară mare și construirea de MLOps. El propune și revizuiește arhitecturi, cu scopul de a contribui la extinderea ecosistemului AI/ML.

Youngjoon Choi, AI/ML Expert SA, are experiență în IT pentru întreprinderi în diverse industrii, cum ar fi producția, high-tech și finanțele, ca dezvoltator, arhitect și cercetător de date. El a efectuat cercetări privind învățarea automată și învățarea profundă, în special pe subiecte precum optimizarea hiperparametrilor și adaptarea domeniilor, prezentând algoritmi și lucrări. La AWS, el este specializat în AI/ML în diverse industrii, oferind validare tehnică folosind serviciile AWS pentru formare distribuită/modele la scară mare și construirea de MLOps. El propune și revizuiește arhitecturi, cu scopul de a contribui la extinderea ecosistemului AI/ML.

Jung Hoon Kim este un cont SA al AWS Coreea. Pe baza experiențelor în proiectarea arhitecturii aplicațiilor, dezvoltarea și modelarea sistemelor în diverse industrii, cum ar fi hi-tech, producție, finanțe și sectorul public, el lucrează la optimizarea AWS Cloud și a sarcinilor de lucru pe AWS pentru clienții întreprinderilor.

Jung Hoon Kim este un cont SA al AWS Coreea. Pe baza experiențelor în proiectarea arhitecturii aplicațiilor, dezvoltarea și modelarea sistemelor în diverse industrii, cum ar fi hi-tech, producție, finanțe și sectorul public, el lucrează la optimizarea AWS Cloud și a sarcinilor de lucru pe AWS pentru clienții întreprinderilor.

Rock Sakong este cercetător la KT R&D. A condus cercetări și dezvoltare pentru viziune AI în diverse domenii și a condus în principal atribute faciale (gen/ochelari, pălării etc.)/tehnologie de recunoaștere a feței legate de față. În prezent, el lucrează la tehnologie ușoară pentru modelele de viziune.

Rock Sakong este cercetător la KT R&D. A condus cercetări și dezvoltare pentru viziune AI în diverse domenii și a condus în principal atribute faciale (gen/ochelari, pălării etc.)/tehnologie de recunoaștere a feței legate de față. În prezent, el lucrează la tehnologie ușoară pentru modelele de viziune.

Manoj Ravi este Senior Product Manager pentru Amazon SageMaker. Este pasionat de construirea de produse AI de ultimă generație și lucrează la software și instrumente pentru a facilita învățarea automată la scară largă pentru clienți. El deține un MBA de la Haas School of Business și un masterat în managementul sistemelor informaționale de la Universitatea Carnegie Mellon. În timpul liber, lui Manoj îi place să joace tenis și să facă fotografie de peisaj.

Manoj Ravi este Senior Product Manager pentru Amazon SageMaker. Este pasionat de construirea de produse AI de ultimă generație și lucrează la software și instrumente pentru a facilita învățarea automată la scară largă pentru clienți. El deține un MBA de la Haas School of Business și un masterat în managementul sistemelor informaționale de la Universitatea Carnegie Mellon. În timpul liber, lui Manoj îi place să joace tenis și să facă fotografie de peisaj.

Robert Van Dusen este Senior Product Manager cu Amazon SageMaker. El conduce cadre, compilatoare și tehnici de optimizare pentru formarea de deep learning.

Robert Van Dusen este Senior Product Manager cu Amazon SageMaker. El conduce cadre, compilatoare și tehnici de optimizare pentru formarea de deep learning.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/kts-journey-to-reduce-training-time-for-a-vision-transformers-model-using-amazon-sagemaker/

- :are

- :este

- :Unde

- $UP

- 1

- 10

- 100

- 11

- 12

- 15%

- 22

- 29

- 32

- 378

- 40

- 7

- 710

- 80

- a

- Capabil

- Despre Noi

- mai sus

- accelera

- accelerarea

- acceptabil

- acces

- Cont

- precizie

- peste

- adaptare

- adăuga

- adăugare

- După

- din nou

- AI

- Servicii AI

- AI / ML

- Urmarind

- algoritmi

- TOATE

- permis

- Permiterea

- permite

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon Web Services

- printre

- sumă

- amp

- an

- analiza

- și

- nimic

- aplicatii

- aplicat

- Aplică

- Aplicarea

- arhitectură

- SUNT

- AS

- At

- atribute

- AWS

- Backend

- bazat

- BE

- deoarece

- înainte

- început

- fiind

- Mai bine

- între

- atât

- blocaje

- Clădire

- construit-in

- povară

- afaceri

- dar

- by

- calcula

- denumit

- CAN

- Poate obține

- capacități

- Carnegie Mellon

- caz

- prins

- Provoca

- cauze

- provocând

- Centru

- Schimbare

- si-a schimbat hainele;

- schimbarea

- Diagramă

- verifica

- verificat

- Cloud

- cod

- colabora

- colaborare

- a comentat

- Comunicare

- compatibilitate

- Completă

- calcul

- calcule

- calculator

- Computer Vision

- tehnica de calcul

- concept

- efectuat

- Configuraţie

- consecvent

- consumate

- mistuitor

- consum

- conţinut

- continua

- a contribui

- comoditate

- Convergenţă

- Cheltuieli

- ar putea

- acoperi

- În prezent

- clienţii care

- mai întunecat

- de date

- om de știință de date

- zi

- Zi

- DDP

- scădea

- adânc

- învățare profundă

- definire

- desfășurarea

- descrie

- Amenajări

- detaliat

- dezvolta

- dezvoltat

- Dezvoltator

- Dezvoltare

- Diabet

- diagnosticând

- diferenţă

- diferit

- boli

- distribuite

- calcul distribuit

- instruire distribuită

- do

- Docher

- domeniu

- în timpul

- fiecare

- mai ușor

- ecosistem

- eficient

- eliminarea

- activat

- permite

- inginerii

- Afacere

- Mediu inconjurator

- epocă

- epoci

- Echivalent

- esenţial

- etc

- Chiar

- exemplu

- existent

- expansiune

- scump

- experienţă

- cu experienţă

- Experiențe

- expert

- ochi

- Față

- facial

- FAST

- mai repede

- DESCRIERE

- puțini

- mai puține

- camp

- Domenii

- Figura

- final

- finanţa

- Găsi

- First

- cinci

- Flexibilitate

- fluctuat

- următor

- alimente

- alimente

- Pentru

- Înainte

- găsit

- patru

- fracțiune

- cadre

- din

- funcţie

- funcții

- General

- genera

- obține

- am

- GPU

- unități de procesare grafică

- gradienți

- HAD

- Avea

- având în

- he

- ajutor

- a ajutat

- ajută

- aici

- hi-tech

- Înalt

- superior

- lui

- deține

- ORE

- Cum

- HTML

- HTTPS

- Optimizarea hiperparametrului

- identifică

- identifica

- identificarea

- if

- imagine

- imagini

- Impactul

- import

- important

- îmbunătăţi

- îmbunătățit

- in

- Inclusiv

- Crește

- a crescut

- crescând

- indica

- industrii

- informații

- Sisteme de informare

- Infrastructură

- inițial

- înţelegere

- instanță

- in schimb

- intern

- Internet

- în

- investigare

- invocă

- problema

- IT

- repetare

- Loc de munca

- Locuri de munca

- călătorie

- cunoştinţe

- Coreea

- de laborator

- etichete

- peisaj

- mare

- pe scară largă

- cea mai mare

- lider

- Conduce

- AFLAȚI

- învăţare

- Părăsi

- mai puțin

- biblioteci

- Bibliotecă

- categorie ușoară

- ca

- Linie

- linux

- Listă

- încărcător

- Uite

- de pe

- Lot

- maşină

- masina de învățare

- mai ales

- susține

- face

- administra

- gestionate

- administrare

- Soluție de management

- manager

- de conducere

- de fabricaţie

- Hartă

- Matrice

- pepene

- Memorie

- Metrici

- minim

- atenuant

- mixt

- ML

- MLOps

- Mobil

- model

- modelare

- Modele

- monitor

- Lună

- mai mult

- cele mai multe

- necesar

- Nevoie

- nevoilor

- reţea

- Nu.

- notat

- număr

- nutrițional

- Nvidia

- of

- oferind

- on

- dată

- ONE

- afară

- operaţie

- Operațiuni

- optimizare

- Optimizați

- optimizate

- optimizarea

- or

- Altele

- al nostru

- afară

- producție

- iesiri

- peste

- global

- pachet

- ofertele

- lucrări

- paradigmă

- Paralel

- parametrii

- parte

- special

- parteneriat

- trece

- pasionat

- pacientes

- pentru

- perioadă

- fotografie

- Fotografii

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- joc

- PoC

- Post

- Precizie

- precedent

- Problemă

- proces

- procese

- Produs

- manager de produs

- producere

- productivitate

- Produse

- profilare

- proiect

- Proiecte

- dovadă

- dovada de concept

- propune

- furnizori

- furnizează

- furnizarea

- public

- Piton

- pirtorh

- repede

- C&D

- gamă

- rank

- rată

- motive

- recunoaştere

- reduce

- Redus

- reduce

- trimite

- legate de

- rămășițe

- înlocuiește

- necesar

- Cerinţe

- cercetare

- cercetare și dezvoltare

- cercetător

- rezolvă

- resursă

- Resurse

- REST

- rezultat

- rezultând

- REZULTATE

- revizuite

- Recenzii

- Alerga

- funcţionare

- ruleaza

- SA

- sagemaker

- acelaşi

- Economisiți

- Economie

- văzut

- scalabilitate

- Scară

- Şcoală

- Om de stiinta

- oamenii de stiinta

- capturi de ecran

- scenariu

- script-uri

- sdk

- SEC

- secunde

- Secțiune

- sector

- vedea

- senior

- sensibil

- serviciu

- Servicii

- servire

- set

- sharding

- să

- Arăta

- indicat

- Emisiuni

- semnificativ

- semnificativ

- simplifica

- pur şi simplu

- singur

- Mărimea

- încetini

- mai mici

- So

- Software

- soluţie

- REZOLVAREA

- unele

- Sud

- Coreea de Sud

- specializată

- specific

- viteză

- uzat

- standard

- Stat

- Statele

- Stare

- Pas

- paşi

- Încă

- student

- succes

- Reușit

- astfel de

- suită

- suspicios

- sistem

- sisteme

- tabel

- TAG

- ia

- Ţintă

- echipă

- echipe

- Tehnic

- tehnică

- tehnici de

- Tehnologia

- de telecomunicaţii

- test

- decât

- acea

- Matrix

- lor

- Lor

- apoi

- Acolo.

- Acestea

- acest

- deşi?

- Prin

- de-a lungul

- timp

- ori

- la

- împreună

- a luat

- Unelte

- top

- subiecte

- lanternă

- Total

- Urmărire

- Tren

- dresat

- Pregătire

- transformatoare

- încercat

- adevărat

- Două

- tip

- tipic

- ui

- înţelege

- înţelegere

- universitate

- us

- Folosire

- utilizare

- utilizat

- utilizatorii

- utilizări

- folosind

- Utilizand

- validare

- valoare

- Valori

- diverse

- Vizualizare

- vizibilitate

- viziune

- vrea

- dorit

- a fost

- modalități de

- we

- web

- servicii web

- săptămâni

- au fost

- întrucât

- care

- OMS

- larg

- Gamă largă

- Wikipedia

- voi

- cu

- în

- fără

- de lucru

- fabrică

- atelier

- ar

- Tu

- Ta

- zephyrnet

- zero