Ta objava v spletnem dnevniku je napisana skupaj s Tuano Çelik iz deepset.

Iskanje v podjetju je ključna komponenta organizacijske učinkovitosti z digitalizacijo dokumentov in upravljanjem znanja. Iskanje v podjetju zajema shranjevanje dokumentov, kot so digitalne datoteke, indeksiranje dokumentov za iskanje in zagotavljanje ustreznih rezultatov na podlagi uporabniških poizvedb. S pojavom velikih jezikovnih modelov (LLM) lahko implementiramo pogovorne izkušnje pri zagotavljanju rezultatov uporabnikom. Vendar pa moramo zagotoviti, da LLM-ji omejijo odzive na podatke podjetja in tako ublažijo halucinacije modela.

V tej objavi prikazujemo, kako zgraditi generativno aplikacijo AI od konca do konca za iskanje v podjetju z Retrieval Augmented Generation (RAG) z uporabo cevovodov Haystack in modela Falcon-40b-instruct iz Amazon SageMaker JumpStart in Storitev Amazon OpenSearch. Izvorna koda za vzorec, prikazan v tej objavi, je na voljo v GitHub repozitorij

Pregled rešitev

Če želimo omejiti generativne odzive aplikacije AI samo na podatke podjetja, moramo uporabiti tehniko, imenovano Retrieval Augmented Generation (RAG). Aplikacija, ki uporablja pristop RAG, pridobi informacije, ki so najbolj pomembne za uporabnikovo zahtevo iz baze znanja ali vsebine podjetja, jih poveže kot kontekst skupaj z uporabnikovo zahtevo kot poziv in jih nato pošlje LLM, da dobi odgovor. LLM-ji imajo omejitve glede največjega števila besed za vnosne pozive, zato izbira pravih odlomkov med tisoči ali milijoni dokumentov v podjetju neposredno vpliva na natančnost LLM-ja.

Tehnika RAG postaja vedno bolj pomembna pri iskanju podjetij. V tej objavi prikazujemo potek dela, ki izkorišča prednosti SageMaker JumpStart za uvajanje modela Falcon-40b-instruct in uporablja Haystack za načrtovanje in izvajanje cevovoda za pridobivanje razširjenih odgovorov na vprašanja. Končni tok dela za izboljšanje iskanja zajema naslednje korake na visoki ravni:

- Uporabniška poizvedba se uporablja za komponento za pridobivanje, ki izvaja vektorsko iskanje, da pridobi najbolj relevanten kontekst iz naše baze podatkov.

- Ta kontekst je vdelan v poziv, ki je zasnovan tako, da LLM-ju naroči, naj ustvari odgovor samo iz podanega konteksta.

- LLM ustvari odgovor na prvotno poizvedbo tako, da upošteva samo kontekst, vdelan v poziv, ki ga je prejel.

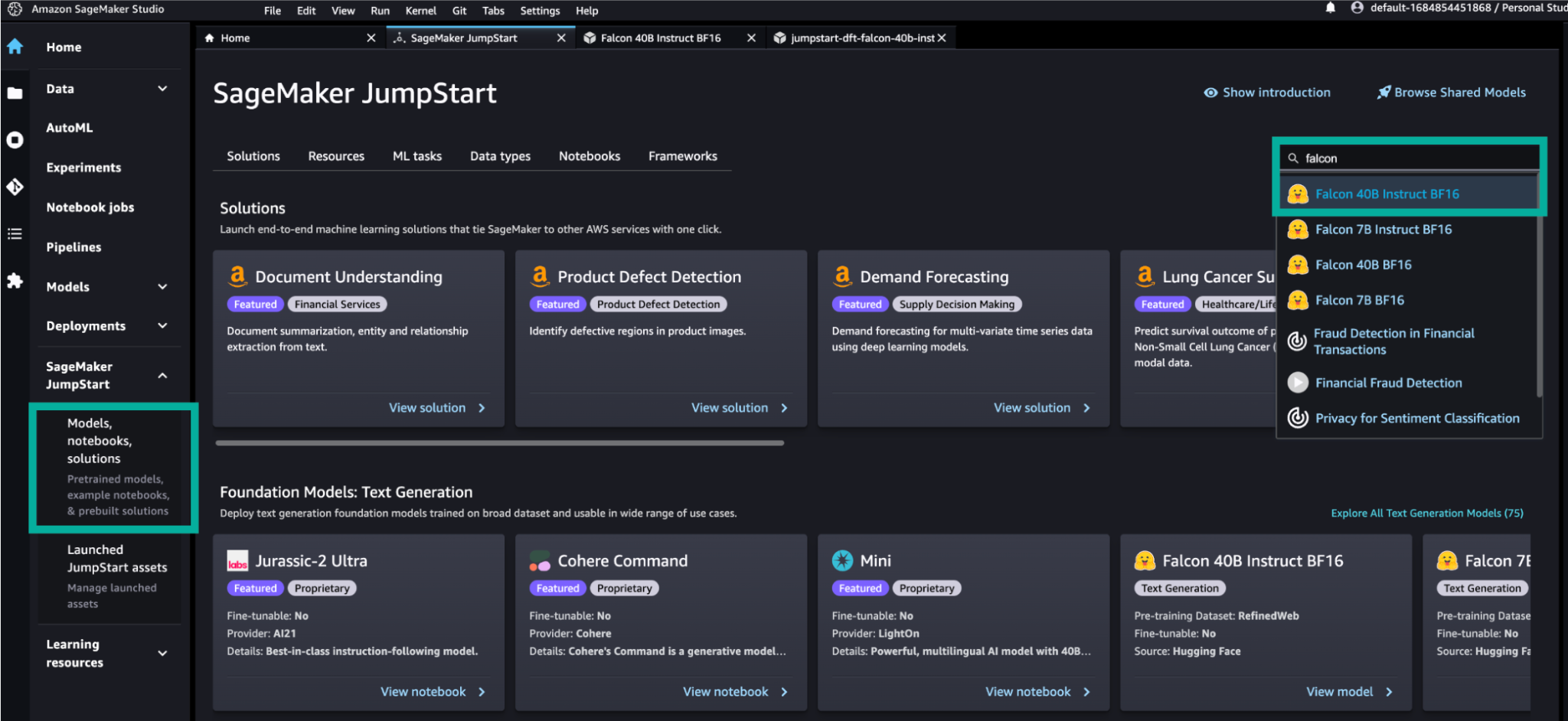

SageMaker JumpStart

SageMaker JumpStart služi kot vozlišče modelov, ki zajema široko paleto modelov globokega učenja za primere uporabe besedila, vida, zvoka in vdelave. Njegovo središče modelov z več kot 500 modeli obsega javne in lastniške modele partnerjev AWS, kot so AI21, Stability AI, Cohere in LightOn. Gosti tudi osnovne modele, ki jih je razvil izključno Amazon, kot je AlexaTM. Nekateri modeli ponujajo zmožnosti, da jih natančno prilagodite z lastnimi podatki. SageMaker JumpStart ponuja tudi predloge rešitev, ki nastavijo infrastrukturo za pogoste primere uporabe, in primere izvedljivih prenosnih računalnikov za strojno učenje (ML) s SageMakerjem.

Kozolec

Kozolec je odprtokodno ogrodje podjetja deepset, ki razvijalcem omogoča, da orkestrirajo aplikacije LLM, sestavljene iz različnih komponent, kot so modeli, vektorske baze podatkov, pretvorniki datotek in nešteto drugih modulov. Kozolec zagotavlja cevovodov in Agenti, dve zmogljivi strukturi za oblikovanje aplikacij LLM za različne primere uporabe, vključno z iskanjem, odgovarjanjem na vprašanja in pogovorno umetno inteligenco. Z velikim poudarkom na najsodobnejših metodah iskanja in trdnih metrikah vrednotenja vam ponuja vse, kar potrebujete za pošiljanje zanesljive in zaupanja vredne aplikacije. Cevovode lahko serializirate v datoteke YAML, jih izpostavite prek a REST API, in jih prilagodljivo prilagodite svojim delovnim obremenitvam, kar olajša premik vaše aplikacije iz faze prototipa v proizvodnjo.

Amazon OpenSearch

Storitev OpenSearch je popolnoma upravljana storitev, ki omogoča preprosto uvajanje, prilagajanje in upravljanje OpenSearch v oblaku AWS. OpenSearch je razširljiva, prilagodljiva in razširljiva zbirka odprtokodne programske opreme za iskanje, analitiko, nadzor varnosti in aplikacije za opazovanje, licencirana pod licenco Apache 2.0.

V zadnjih letih postajajo tehnike ML vse bolj priljubljene za izboljšanje iskanja. Med njimi so uporaba vgradni modeli, vrsta modela, ki lahko kodira veliko količino podatkov v n-dimenzionalni prostor, kjer je vsaka entiteta kodirana v vektor, podatkovna točka v tem prostoru in organizirana tako, da so podobne entitete bližje skupaj. Vektorska zbirka podatkov zagotavlja učinkovito iskanje podobnosti vektorjev z zagotavljanjem specializiranih indeksov, kot so indeksi k-NN.

Z zmožnostmi vektorske baze podatkov storitve OpenSearch lahko implementirate semantično iskanje, RAG z LLM-ji, mehanizme za priporočila in iskanje po obogatenih medijih. V tej objavi uporabljamo RAG, ki nam omogoča dopolnjevanje generativnih LLM z zunanjo bazo znanja, ki je običajno zgrajena z uporabo vektorske baze podatkov, obogatene z vektorsko kodiranimi članki znanja.

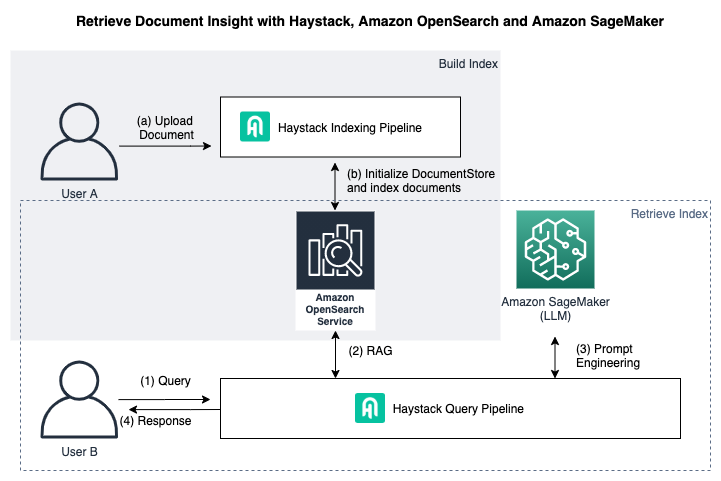

Pregled uporabe

Naslednji diagram prikazuje strukturo končne aplikacije.

V tej aplikaciji uporabljamo Haystack Indexing Pipeline za upravljanje naloženih dokumentov in indeksnih dokumentov ter Haystack Query Pipeline za izvajanje pridobivanja znanja iz indeksiranih dokumentov.

Cevovod za indeksiranje Haystack vključuje naslednje korake na visoki ravni:

- Naložite dokument.

- Inicializiraj

DocumentStorein indeksne dokumente.

OpenSearch uporabljamo kot naš DocumentStore in kozolec cevovod za indeksiranje za predhodno obdelavo in indeksiranje naših datotek v OpenSearch. Kozolec Pretvorniki datotek in Predprocesor vam omogočajo, da očistite in pripravite neobdelane datoteke, da bodo v obliki in formatu, ki ju lahko obravnavata vaš cevovod za obdelavo naravnega jezika (NLP) in izbrani jezikovni model. Cevovod za indeksiranje, ki smo ga uporabili tukaj, prav tako uporablja sentence-transformers/all-MiniLM-L12-v2 za ustvarjanje vdelav za vsak dokument, ki jih uporabljamo za učinkovito iskanje.

Cevovod poizvedbe Haystack vključuje naslednje korake na visoki ravni:

- Povpraševanje pošljemo na cevovod RAG.

- An EmbeddingRetriever komponenta deluje kot filter, ki pridobi najbolj relevantne

top_kdokumentov iz naših indeksiranih dokumentov v OpenSearch. Svojo izbiro modela vdelave uporabljamo za vdelavo tako poizvedbe kot dokumentov (pri indeksiranju), da to dosežemo. - Pridobljeni dokumenti so vdelani v naš poziv k modelu Falcon-40b-instruct.

- LLM se vrne z odgovorom, ki temelji na pridobljenih dokumentih.

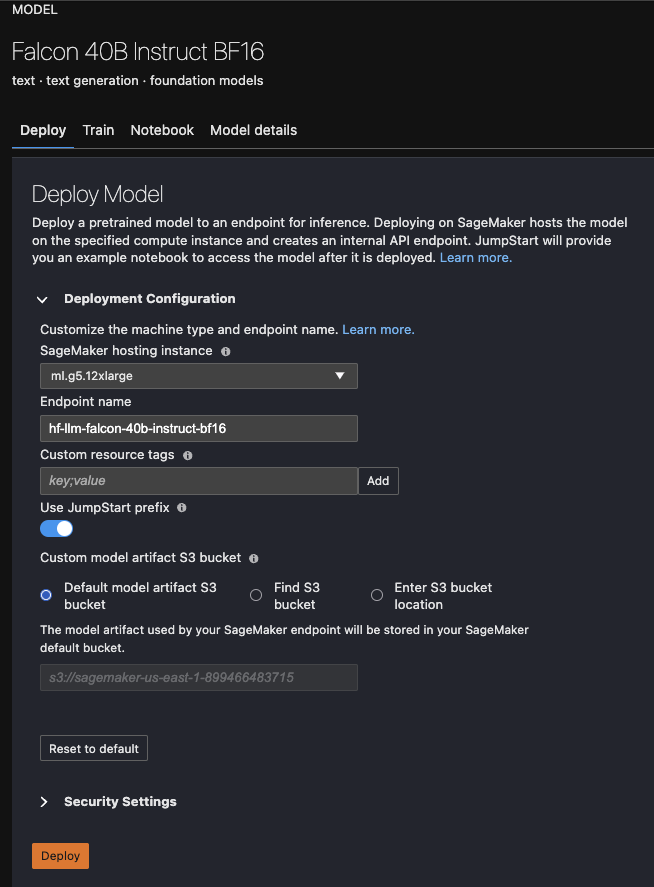

Za uvajanje modela uporabljamo SageMaker JumpStart, ki poenostavi uvajanje modelov s preprostim pritiskom na gumb. Čeprav smo za ta primer uporabili in preizkusili Falcon-40b-instruct, lahko uporabite kateri koli model Hugging Face, ki je na voljo na SageMakerju.

Končna rešitev je na voljo na kozolec-sagemaker repozitorij in uporablja spletno mesto in dokumentacijo OpenSearch (za OpenSearch 2.7) kot naše primere podatkov za izvajanje odgovarjanja na vprašanja z razširjenim iskanjem.

Predpogoji

Prva stvar, ki jo moramo narediti, preden lahko uporabimo katero koli storitev AWS, je, da se prepričamo, da smo se prijavili in ustvarili račun AWS. Nato bi morali ustvariti skrbniškega uporabnika in skupino. Za navodila o obeh korakih glejte Nastavite predpogoje za Amazon SageMaker.

Če želite uporabljati Haystack, boste morali namestiti farm-haystack paket z zahtevanimi odvisnostmi. Če želite to narediti, uporabite requirements.txt datoteko v GitHub repozitorij s tekom pip install requirements.txt.

Indeksirajte dokumente v OpenSearch

Haystack ponuja številne priključke za baze podatkov, ki se imenujejo DocumentStores. Za ta potek dela RAG uporabljamo OpenSearchDocumentStore. Primer Skladišče vključuje cevovod za indeksiranje in Oblikovanje oblaka AWS Predloga za nastavitev OpenSearchDocumentStore z dokumenti, pajkanimi s spletnega mesta OpenSearch in strani z dokumentacijo.

Da bi NLP aplikacija delovala za primere produkcijske uporabe, moramo pogosto razmišljati o pripravi in čiščenju podatkov. To je pokrito z Cevovodi za indeksiranje kozolca, ki vam omogoča, da oblikujete lastne korake priprave podatkov, ki na koncu zapišejo vaše dokumente v zbirko podatkov po vaši izbiri.

Cevovod za indeksiranje lahko vključuje tudi korak za ustvarjanje vdelav za vaše dokumente. To je zelo pomembno za korak priklica. V našem primeru uporabljamo stavek-transformatorji/vse-MiniLM-L12-v2 kot naš vgradni model. Ta model se uporablja za ustvarjanje vdelav za vse naše indeksirane dokumente, pa tudi za uporabnikovo poizvedbo ob času poizvedbe.

Za indeksiranje dokumentov v OpenSearchDocumentStore, nudimo dve možnosti s podrobnimi navodili v README vzorčnega repozitorija. Tukaj se sprehodimo skozi korake za indeksiranje v storitev OpenSearch, nameščeno na AWS.

Zaženite storitev OpenSearch

Uporabite priloženo Predloga za oblikovanje v oblaku za nastavitev storitve OpenSearch na AWS. Če zaženete naslednji ukaz, boste imeli prazno storitev OpenSearch. Nato se lahko odločite za indeksiranje primerov podatkov, ki smo jih posredovali, ali pa uporabite svoje podatke, ki jih lahko očistite in predhodno obdelate z Cevovod za indeksiranje kozolca. Upoštevajte, da s tem ustvarite primerek, ki je odprt v internet, kar ni priporočljivo za produkcijsko uporabo.

Počakajte približno 30 minut, da se zagon sklada zaključi. Njegov napredek lahko preverite na konzoli AWS CloudFormation tako, da se pomaknete do Skladovnice strani in išče sklad z imenom HaystackOpensearch.

Indeksirajte dokumente v OpenSearch

Zdaj, ko imamo delujočo storitev OpenSearch, lahko uporabimo razred OpenSearchDocumentStore, da se povežemo z njo in vanj napišemo svoje dokumente.

Če želite pridobiti ime gostitelja za OpenSearch, zaženite naslednji ukaz:

Najprej izvozite naslednje:

Nato lahko uporabite opensearch_indexing_pipeline.py skript za predhodno obdelavo in indeksiranje predloženih predstavitvenih podatkov.

Če želite uporabiti svoje podatke, spremenite cevovod indeksiranja opensearch_indexing_pipeline.py vključiti FileConverter in Predprocesor nastavitvene korake, ki jih potrebujete.

Implementirajte cevovod za iskanje razširjenih odgovorov na vprašanja

Zdaj, ko imamo indeksirane podatke v OpenSearch, lahko na teh dokumentih odgovarjamo na vprašanja. Za ta cevovod RAG uporabljamo model Falcon-40b-instruct, ki smo ga namestili na SageMaker JumpStart.

Imate tudi možnost programske uvedbe modela iz prenosnega računalnika Jupyter. Za navodila glejte GitHub repo.

- Poiščite model Falcon-40b-instruct na SageMaker JumpStart.

- Namestite svoj model na SageMaker JumpStart in si zapomnite ime končne točke.

- Izvozi naslednje vrednosti:

- Run

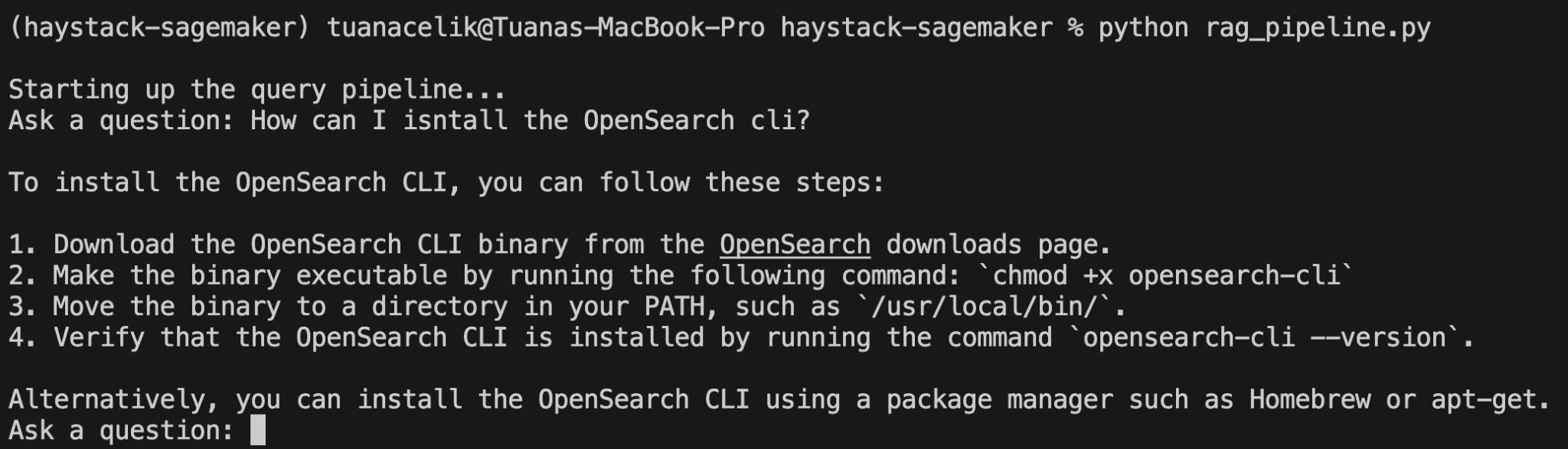

python rag_pipeline.py.

To bo zagnalo pripomoček ukazne vrstice, ki čaka na uporabnikovo vprašanje. Na primer, vprašajmo se "Kako lahko namestim OpenSearch cli?"

Ta rezultat je dosežen, ker smo svoj poziv opredelili v Haystack PromptTemplate naj bo naslednje:

Nadaljnje prilagoditve

Izvedete lahko dodatne prilagoditve različnih elementov v rešitvi, na primer naslednje:

- Podatki – Zagotovili smo OpenSearch Dokumentacija in spletna stran podatki kot primer podatkov. Ne pozabite spremeniti

opensearch_indexing_pipeline.pyskript, ki ustreza vašim potrebam, če se odločite za uporabo lastnih podatkov. - Model – V tem primeru smo uporabili model Falcon-40b-instruct. Na SageMakerju lahko prosto uvedete in uporabite kateri koli drug model Hugging Face. Upoštevajte, da bo sprememba modela verjetno pomenila, da morate svoj poziv prilagoditi nečemu, za kar je zasnovan.

- Poziv – Za to objavo smo ustvarili svoje

PromptTemplateki modelu naroči, naj odgovori na vprašanja na podlagi podanega konteksta in odgovori »ne vem«, če kontekst ne vključuje ustreznih informacij. Ta poziv lahko spremenite tako, da eksperimentirate z različnimi pozivi s Falcon-40b-instruct. Prav tako lahko preprosto povlečete nekaj naših pozivov iz PromptHub. - Model vdelave – Za korak priklica uporabljamo lahek model vdelave: stavek-transformatorji/vse-MiniLM-L12-v2. Vendar pa lahko to tudi spremenite glede na svoje potrebe. Ne pozabite spremeniti pričakovanih vgradnih dimenzij v vašem

DocumentStoreustrezno. - Število pridobljenih dokumentov – Lahko se tudi poigrate s številom dokumentov, ki jih zahtevate

EmbeddingRetrieverza pridobitev za vsako poizvedbo. V naši nastavitvi je to nastavljeno na top_k=5. Lahko poskusite spremeniti to številko, da vidite, ali zagotavljanje več konteksta izboljša natančnost vaših rezultatov.

Pripravljenost na proizvodnjo

Predlagana rešitev v tej objavi lahko pospeši čas do vrednosti procesa razvoja projekta. Z okoljem varnosti in zasebnosti v oblaku AWS lahko zgradite projekt, ki ga je enostavno prilagoditi.

Za varnost in zasebnost storitev OpenSearch zagotavlja zaščito podatkov s upravljanje identitete in dostopa in preprečevanje zmedenega proxyja med storitvami. Uporabite lahko natančen nadzor uporabniškega dostopa, tako da lahko uporabnik dostopa le do podatkov, za katere ima dovoljenje. Poleg tega SageMaker ponuja nastavljive varnostne nastavitve za nadzor dostopa, Varstvo podatkovin beleženje in spremljanje. Svoje podatke med mirovanjem in med prenosom lahko zaščitite z AWS Service Key Management (AWS KMS). Prav tako lahko sledite dnevniku uvajanja modela SageMaker ali dostopa do končne točke z uporabo amazoncloudwatch. Za več informacij glejte Spremljajte Amazon SageMaker z Amazon CloudWatch.

Za visoko razširljivost v storitvi OpenSearch jo lahko prilagodite za določanje velikosti vaših domen OpenSearch Service in zaposlujejo najboljše operativne prakse. Izkoristite lahko tudi prednosti samodejnega prilagajanja vaše končne točke SageMaker – lahko samodejno spreminja velikost modelov SageMaker za prilagoditev končne točke tako, ko je promet povečan ali se viri ne uporabljajo.

Čiščenje

Če želite prihraniti stroške, izbrišite vse vire, ki ste jih uporabili kot del te objave. Če ste zagnali sklad CloudFormation, ga lahko izbrišete prek konzole AWS CloudFormation. Podobno lahko izbrišete vse končne točke SageMaker, ki ste jih morda ustvarili prek konzole SageMaker.

zaključek

V tej objavi smo predstavili, kako zgraditi generativno aplikacijo umetne inteligence od konca do konca za iskanje v podjetju z RAG z uporabo cevovodov Haystack in modela Falcon-40b-instruct iz SageMaker JumpStart in OpenSearch Service. Pristop RAG je ključnega pomena pri iskanju v podjetjih, saj zagotavlja, da so ustvarjeni odgovori znotraj domene in zato ublažijo halucinacije. Z uporabo cevovodov Haystack lahko orkestriramo aplikacije LLM, sestavljene iz različnih komponent, kot so modeli in vektorske baze podatkov. SageMaker JumpStart nam ponuja rešitev z enim klikom za uvajanje LLM-jev, storitev OpenSearch pa smo uporabili kot vektorsko bazo podatkov za naše indeksirane podatke. Lahko začnete eksperimentirati in graditi dokaze koncepta RAG za generativne aplikacije umetne inteligence v vašem podjetju z uporabo korakov, opisanih v tej objavi, in izvorne kode, ki je na voljo v GitHub repozitorij.

O avtorjih

Tuana Čelik je glavni zagovornik razvijalcev pri deepsetu, kjer se osredotoča na odprtokodno skupnost za Haystack. Vodi funkcijo odnosov z razvijalci in redno govori na dogodkih o NLP ter ustvarja učna gradiva za skupnost.

Tuana Čelik je glavni zagovornik razvijalcev pri deepsetu, kjer se osredotoča na odprtokodno skupnost za Haystack. Vodi funkcijo odnosov z razvijalci in redno govori na dogodkih o NLP ter ustvarja učna gradiva za skupnost.

Roy Allela je višji strokovnjak za rešitve AI/ML pri AWS s sedežem v Münchnu v Nemčiji. Roy pomaga strankam AWS – od majhnih novoustanovljenih podjetij do velikih podjetij – pri usposabljanju in učinkovitem uvajanju velikih jezikovnih modelov v AWS. Roy se navdušuje nad problemi računalniške optimizacije in izboljšanjem učinkovitosti delovnih obremenitev umetne inteligence.

Roy Allela je višji strokovnjak za rešitve AI/ML pri AWS s sedežem v Münchnu v Nemčiji. Roy pomaga strankam AWS – od majhnih novoustanovljenih podjetij do velikih podjetij – pri usposabljanju in učinkovitem uvajanju velikih jezikovnih modelov v AWS. Roy se navdušuje nad problemi računalniške optimizacije in izboljšanjem učinkovitosti delovnih obremenitev umetne inteligence.

Mia Chang je specialist za rešitve ML za Amazon Web Services. Dela s strankami v EMEA in deli najboljše prakse za izvajanje delovnih obremenitev AI/ML v oblaku s svojim znanjem iz uporabne matematike, računalništva in AI/ML. Osredotoča se na delovne obremenitve, specifične za NLP, in deli svoje izkušnje kot predavateljica na konferencah in avtorica knjig. V prostem času uživa v pohodništvu, družabnih igrah in kuhanju kave.

Mia Chang je specialist za rešitve ML za Amazon Web Services. Dela s strankami v EMEA in deli najboljše prakse za izvajanje delovnih obremenitev AI/ML v oblaku s svojim znanjem iz uporabne matematike, računalništva in AI/ML. Osredotoča se na delovne obremenitve, specifične za NLP, in deli svoje izkušnje kot predavateljica na konferencah in avtorica knjig. V prostem času uživa v pohodništvu, družabnih igrah in kuhanju kave.

Inaam Syed je arhitekt za zagonske rešitve pri AWS, z močnim poudarkom na pomoči zagonskim podjetjem B2B in SaaS pri povečanju in doseganju rasti. Ima globoko strast do brezstrežniških arhitektur in AI/ML. V prostem času Inaam uživa v kakovostnih trenutkih s svojo družino in se prepusti svoji ljubezni do kolesarjenja in badmintona.

Inaam Syed je arhitekt za zagonske rešitve pri AWS, z močnim poudarkom na pomoči zagonskim podjetjem B2B in SaaS pri povečanju in doseganju rasti. Ima globoko strast do brezstrežniških arhitektur in AI/ML. V prostem času Inaam uživa v kakovostnih trenutkih s svojo družino in se prepusti svoji ljubezni do kolesarjenja in badmintona.

David Tippett je višji zagovornik razvijalcev, ki dela na odprtokodnem OpenSearch pri AWS. Njegovo delo vključuje vsa področja OpenSearch od iskanja in ustreznosti do opazljivosti in varnostne analitike.

David Tippett je višji zagovornik razvijalcev, ki dela na odprtokodnem OpenSearch pri AWS. Njegovo delo vključuje vsa področja OpenSearch od iskanja in ustreznosti do opazljivosti in varnostne analitike.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Avtomobili/EV, Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- ChartPrime. Izboljšajte svojo igro trgovanja s ChartPrime. Dostopite tukaj.

- BlockOffsets. Posodobitev okoljskega offset lastništva. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :ima

- : je

- :ne

- :kje

- $GOR

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- Sposobna

- O meni

- pospeši

- dostop

- doseganje

- ustrezno

- Račun

- natančnost

- Doseči

- doseže

- doseganju

- aktov

- prilagodijo

- Dodatne

- Poleg tega

- upravno

- Prednost

- prihod

- zagovornik

- AI

- AI / ML

- vsi

- omogočajo

- omogoča

- skupaj

- Prav tako

- Čeprav

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- med

- an

- analitika

- in

- odgovor

- kaj

- Apache

- uporaba

- aplikacije

- uporabna

- pristop

- približno

- SE

- območja

- okoli

- Array

- Umetnost

- članki

- AS

- pomoč

- At

- audio

- Povečana

- Avtor

- pooblaščeni

- avto

- Na voljo

- AWS

- Oblikovanje oblaka AWS

- B2B

- ozadje

- baza

- temeljijo

- BE

- ker

- postanejo

- pred

- počutje

- spodaj

- BEST

- najboljše prakse

- Big

- Blog

- svet

- Namizne igre

- telo

- Knjiga

- tako

- široka

- izgradnjo

- Building

- zgrajena

- svežnji

- vendar

- Gumb

- by

- se imenuje

- CAN

- Zmogljivosti

- primeri

- spremenite

- spreminjanje

- preveriti

- izbira

- Izberite

- izbiri

- izbral

- razred

- čiščenje

- bližje

- Cloud

- Koda

- Kava

- Skupno

- skupnost

- podjetje

- Dopolnilo

- dokončanje

- komponenta

- deli

- obsega

- računalnik

- Računalništvo

- Koncept

- Konferenca

- zmeden

- Connect

- upoštevamo

- Konzole

- vseboval

- vsebina

- ozadje

- nadzor

- pogovorni

- pogovorni AI

- stroški

- zajeti

- Ovitki

- ustvarjajo

- ustvaril

- ustvari

- kritično

- Stranke, ki so

- datum

- Priprava podatkov

- Varstvo podatkov

- Baze podatkov

- baze podatkov

- DBS

- ponudba

- globoko

- globoko učenje

- opredeljen

- demo

- odvisnosti

- razporedi

- razporejeni

- uvajanja

- uvajanje

- Oblikovanje

- zasnovan

- oblikovanje

- podrobno

- razvili

- Razvojni

- Razvijalci

- Razvoj

- drugačen

- digitalni

- digitalizacija

- dimenzije

- neposredna

- do

- dokument

- Dokumentacija

- Dokumenti

- ne

- Ne

- don

- dont

- vsak

- lahka

- učinkovitosti

- učinkovite

- učinkovito

- bodisi

- elementi

- Embed

- vgrajeni

- vdelava

- EMEA

- omogočajo

- konec

- konec koncev

- Končna točka

- Motorji

- okrepi

- zagotovitev

- zagotavlja

- Podjetje

- subjekti

- entiteta

- okolje

- Ocena

- dogodki

- vse

- Primer

- Pričakuje

- izkušnje

- Doživetja

- poskus

- izvoz

- zunanja

- Obraz

- družina

- Slika

- file

- datoteke

- filter

- končna

- prva

- fit

- prilagodljiv

- prilagodljivo

- Osredotočite

- Osredotoča

- po

- za

- format

- Fundacija

- Okvirni

- brezplačno

- iz

- v celoti

- funkcija

- Games

- ustvarjajo

- ustvarila

- ustvarja

- generacija

- generativno

- Generativna AI

- Nemčija

- dobili

- dana

- skupina

- Rast

- ročaj

- Imajo

- ob

- he

- Pomaga

- jo

- tukaj

- visoka

- na visoki ravni

- zelo

- njegov

- Gostitelji

- Kako

- Kako

- Vendar

- HTML

- http

- HTTPS

- Hub

- i

- identiteta

- if

- vpliv

- izvajati

- Pomembno

- izboljšanju

- in

- vključujejo

- vključuje

- Vključno

- povečal

- vedno

- Indeks

- indeksirane

- indekse

- Podatki

- Infrastruktura

- vhod

- namestitev

- primer

- Navodila

- Internet

- v

- IT

- ITS

- jpg

- Ključne

- tipke

- Vedite

- znanje

- Upravljanje znanja

- jezik

- velika

- kosilo

- začela

- vodi

- Interesenti

- učenje

- Licenca

- Licencirano

- lahek

- kot

- Verjeten

- LIMIT

- omejitve

- vrstica

- LLM

- prijavi

- sečnja

- si

- ljubezen

- stroj

- strojno učenje

- je

- Znamka

- IZDELA

- Izdelava

- upravljanje

- upravlja

- upravljanje

- materiali

- matematika

- največja

- Maj ..

- pomeni

- mediji

- Metode

- Meritve

- milijoni

- Minute

- ublažitev

- ML

- Model

- modeli

- spremenite

- Moduli

- Trenutki

- spremljanje

- več

- Najbolj

- premikanje

- Ime

- Imenovan

- naravna

- Obdelava Natural Language

- krmarjenje

- Nimate

- potrebe

- nlp

- prenosnik

- Številka

- of

- ponudba

- Ponudbe

- on

- samo

- odprite

- open source

- Odprtokodna programska oprema

- deluje

- optimizacija

- Možnost

- možnosti

- or

- organizacijsko

- Organizirano

- izvirno

- Ostalo

- naši

- opisano

- več

- lastne

- paket

- Stran

- strani

- del

- partnerji

- strast

- strastno

- Izvedite

- performance

- plinovod

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Predvajaj

- prosim

- Točka

- Popular

- Prispevek

- močan

- vaje

- Priprava

- Pripravimo

- zasebnost

- Težave

- Postopek

- obravnavati

- proizvodnja

- Napredek

- Projekt

- dokazov

- predlagano

- lastniško

- zaščito

- zaščita

- Prototip

- zagotavljajo

- če

- zagotavlja

- zagotavljanje

- proxy

- javnega

- Push

- kakovost

- poizvedbe

- vprašanje

- vprašanja

- Surovi

- prejetih

- nedavno

- Priporočilo

- priporočeno

- redno

- Odnosi

- ustreznost

- pomembno

- zanesljiv

- ne pozabite

- Skladišče

- zahteva

- zahteva

- obvezna

- Zahteve

- viri

- Odgovor

- odgovorov

- REST

- omejiti

- povzroči

- Rezultati

- vrne

- Rich

- Pravica

- roy

- Run

- tek

- SaaS

- sagemaker

- Shrani

- pravijo,

- Prilagodljivost

- razširljive

- Lestvica

- skaliranje

- Znanost

- Iskalnik

- varnost

- glej

- pošljite

- pošlje

- višji

- Brez strežnika

- služi

- Storitev

- Storitve

- nastavite

- nastavitve

- nastavitev

- Oblikujte

- Delnice

- je

- LADJE

- shouldnt

- Prikaži

- predstavitev

- predstavljeni

- podpisano

- Podoben

- podobno

- Enostavno

- preprosto

- majhna

- So

- Software

- Izključno

- trdna

- Rešitev

- rešitve

- nekaj

- Nekaj

- vir

- Izvorna koda

- Vesolje

- Zvočniki

- Govori

- specialist

- specializirani

- Stabilnost

- sveženj

- Stage

- Začetek

- zagon

- Ustanavljanjem

- Korak

- Koraki

- shranjevanje

- močna

- Struktura

- taka

- apartma

- Preverite

- Bodite

- meni

- tehnike

- predloge

- Testiran

- da

- O

- Vir

- Njih

- POTEM

- s tem

- zato

- te

- jih

- stvar

- mislim

- ta

- tisoče

- skozi

- čas

- do

- skupaj

- sledenje

- Prometa

- tranzit

- zaupanja

- dva

- tip

- tipično

- Konec koncev

- pod

- naložili

- us

- uporaba

- Rabljeni

- uporabnik

- Uporabniki

- uporablja

- uporabo

- pripomoček

- vrednost

- Vrednote

- različnih

- preko

- Vizija

- čaka

- we

- web

- spletne storitve

- Spletna stran

- kdaj

- ki

- bo

- z

- v

- beseda

- delo

- potek dela

- deluje

- deluje

- bi

- pisati

- yaml

- let

- Vi

- Vaša rutina za

- zefirnet