Det var tvunget att hända förr eller senare. För vad som ser ut som första gången någonsin använde buggjägare ChatGPT i en framgångsrik Pwn2Own-exploatering, och hjälpte forskare att kapa programvara som används i industriella applikationer och vinna $20,000 XNUMX.

För att vara tydlig: AI:n hittade inte sårbarheten och skrev och körde inte kod för att utnyttja ett specifikt fel. Men dess framgångsrika användning i felrapporteringstävlingen kan vara ett förebud om kommande hacks.

"Detta är inte att tolka Rosetta-stenen," berättade Dustin Childs, chef för hotmedvetenhet vid Trend Micros Zero Day Initiative (ZDI) Registret.

– Det är ett första steg mot något mer. Vi tror inte att AI är framtiden för hacking, men det kan säkert bli en bra assistent när en forskare stöter på en kod som de inte är bekant med eller ett försvar de inte förväntade sig.”

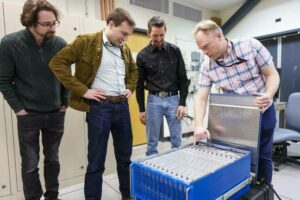

Vid förra veckans tävling i Miami, Florida, Clarotys Team82 bad ChatGPT att hjälpa dem att utveckla en extern kodexekveringsattack mot Softing edgeAggregator Siemens — programvara som tillhandahåller anslutning i gränssnittet mellan OT (operativ teknologi) och IT i industriella applikationer.

De tekniska detaljerna är begränsade på grund av Pwn2Owns natur: människor hittar säkerhetshål, demonstrerar dem på scenen, avslöjar privat hur de gjorde det för utvecklaren eller leverantören, gör anspråk på ett pris och vi väntar alla på att detaljerna och korrigeringarna ska komma ut så småningom när den är klar.

Under tiden kan vi säga detta: människorna som är inblandade i exploateringen, säkerhetsforskarna Noam Moshe och Uri Katz, identifierade en sårbarhet i en OPC Unified Architecture (OPC UA)-klient, förmodligen inom edgeAggregator industriella mjukvarusvit. OPC UA är ett maskin-till-maskin kommunikationsprotokoll som används inom industriell automation.

Efter att ha hittat felet bad forskarna ChatGPT att utveckla en backend-modul för en OPC UA-server för att testa deras fjärrexekveringsexploatering. Det verkar som att denna modul behövdes för att i princip bygga en skadlig server för att attackera den sårbara klienten via sårbarheten som duon hittade.

"Eftersom vi var tvungna att göra många modifieringar för att vår exploateringsteknik skulle fungera, var vi tvungna att göra många ändringar i befintliga OPC UA-projekt med öppen källkod," sa Moshe och Katz till Registret.

"Eftersom vi inte var bekanta med den specifika server-SDK-implementeringen använde vi ChatGPT för att påskynda processen genom att hjälpa oss att använda och modifiera den befintliga servern."

Teamet försåg AI med instruktioner och var tvungna att göra några omgångar med korrigeringar och "mindre" ändringar tills det kom fram till en fungerande backend-servermodul, medgav de.

Men totalt sett, får vi veta, tillhandahöll chatboten ett användbart verktyg som sparade tid, särskilt när det gäller att fylla i kunskapsluckor som att lära sig att skriva en backend-modul och låta människor fokusera mer på att implementera utnyttjandet.

"ChatGPT har kapaciteten att vara ett utmärkt verktyg för att påskynda kodningsprocessen," sa duon och tillade att det ökade deras effektivitet.

"Det är som att göra många omgångar av Google-sökningar efter en specifik kodmall och sedan lägga till flera omgångar av ändringar av koden baserat på våra specifika behov, enbart genom att instruera den vad vi ville uppnå," sa Moshe och Katz.

Enligt Childs är det förmodligen så vi kommer att se cyberkriminella använda ChatGPT i verkliga attacker mot industriella system.

"Att utnyttja komplexa system är utmanande, och ofta är hotaktörer inte bekanta med varje aspekt av ett visst mål", sa han. Childs tillade att han inte förväntar sig att se AI-genererade verktyg skriva bedrifter, "men ger den sista pusselbiten som behövs för framgång."

Och han är inte oroad över att AI tar över Pwn2Own. Åtminstone inte än.

"Det är fortfarande ganska långt kvar," sa Childs. "Men användningen av ChatGPT här visar hur AI kan hjälpa till att förvandla en sårbarhet till ett utnyttjande – förutsatt att forskaren vet hur man ställer rätt frågor och ignorerar fel svar. Det är en intressant utveckling i tävlingens historia, och vi ser fram emot att se vart det kan leda.” ®

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://go.theregister.com/feed/www.theregister.com/2023/02/22/chatgpt_pwn2own_ai/

- 000

- 7

- a

- Om oss

- accelererande

- Uppnå

- aktörer

- lagt till

- medgav

- mot

- AI

- Alla

- tillåta

- och

- svar

- tillämpningar

- arkitektur

- aspekt

- Assistent

- attackera

- Attacker

- Automation

- medvetenhet

- backend

- baserat

- I grund och botten

- därför att

- mellan

- ökat

- Bunden

- Bug

- SLUTRESULTAT

- Kapacitet

- säkerligen

- utmanande

- Förändringar

- chatbot

- ChatGPT

- patentkrav

- klar

- klient

- koda

- Kodning

- komma

- Kommunikation

- konkurrens

- komplex

- aktuella

- Anslutningar

- Korrigeringar

- kunde

- nätbrottslingar

- dag

- Försvar

- demonstrera

- detaljer

- utveckla

- Utvecklare

- Utveckling

- DID

- Avslöja

- gör

- effektivitet

- speciellt

- så småningom

- NÅGONSIN

- Varje

- utförande

- befintliga

- förvänta

- väntar

- Exploit

- utnyttjande

- bedrifter

- bekant

- få

- hitta

- finna

- Förnamn

- första gången

- fel

- florida

- Fokus

- Framåt

- hittade

- framtida

- stor

- hacking

- hacka

- hända

- huvud

- hjälpa

- hjälpa

- här.

- kapa

- historia

- Hål

- Hur ser din drömresa ut

- How To

- Men

- HTTPS

- Människa

- identifierade

- genomförande

- genomföra

- in

- industriell

- Initiativ

- instruktioner

- intressant

- Gränssnitt

- involverade

- IT

- kunskap

- Efternamn

- leda

- inlärning

- Begränsad

- se

- UTSEENDE

- Lot

- göra

- många

- under tiden

- Miami

- mindre

- modifieringar

- modifiera

- Modulerna

- mer

- multipel

- Natur

- behov

- öppet

- öppen källkod

- operativa

- övergripande

- särskilt

- Plåster

- Personer

- bit

- plato

- Platon Data Intelligence

- PlatonData

- Priset

- förmodligen

- process

- projekt

- protokoll

- förutsatt

- ger

- tillhandahålla

- pussel

- Pwn2Own

- frågor

- RE

- redo

- avlägsen

- forskaren

- forskare

- omgångar

- Körning

- Nämnda

- sDK

- säkerhet

- se

- Visar

- siemens

- eftersom

- Mjukvara

- något

- Källa

- specifik

- Etapp

- Steg

- Fortfarande

- STEN

- framgång

- framgångsrik

- sådana

- svit

- System

- tar

- Målet

- grupp

- Teknisk

- Teknologi

- mall

- villkor

- testa

- Smakämnen

- deras

- hot

- hotaktörer

- tid

- till

- verktyg

- verktyg

- mot

- Trend

- SVÄNG

- enhetlig

- us

- Användning

- användning

- leverantör

- via

- sårbarhet

- Sårbara

- vänta

- ville

- vecka

- Vad

- vinna

- inom

- Vann

- Arbete

- skulle

- skriva

- skrivning

- Fel

- zephyrnet

- noll-

- Zero Day