En individs hälsa är ett otroligt personligt ämne, och att gå till doktorn kan vara en skrämmande och stressande upplevelse. Detta gäller särskilt för människor som ingår i grupper som det medicinska systemet historiskt har misslyckats med. Dessa strukturella frågor inom hälso- och sjukvården har genomsyrat de algoritmer som i allt högre grad används vid diagnostik och behandling av patienter. CCC organiserade en panel, "Health Equity: How Can Algorithms and Data Mitigate, Not Exacerbate, Harms?" som tog upp dessa frågor. Paneldeltagarna var Dr Amaka Eneanya (Fresenius Medical Care), Dr Mona Singh (Princeton University), Dr Melanie Moses (University of New Mexico) och Dr Katie Siek (Indiana University).

En individs hälsa är ett otroligt personligt ämne, och att gå till doktorn kan vara en skrämmande och stressande upplevelse. Detta gäller särskilt för människor som ingår i grupper som det medicinska systemet historiskt har misslyckats med. Dessa strukturella frågor inom hälso- och sjukvården har genomsyrat de algoritmer som i allt högre grad används vid diagnostik och behandling av patienter. CCC organiserade en panel, "Health Equity: How Can Algorithms and Data Mitigate, Not Exacerbate, Harms?" som tog upp dessa frågor. Paneldeltagarna var Dr Amaka Eneanya (Fresenius Medical Care), Dr Mona Singh (Princeton University), Dr Melanie Moses (University of New Mexico) och Dr Katie Siek (Indiana University).

Dr. Eneanya inledde panelen med att diskutera hur en ekvation systematiskt underskattade njursjukdomse i Black Americans i decennier. Hon förklarade att i USA skrivs alla patienter som har njursjukdom in i ett register. Förekomsten av sjukdomen har ökat totalt sett under de senaste decennierna, och för svarta individer tenderar den att vara ännu mer utbredd och allvarlig.

Dr. Eneanya beskrev dessa rasmässiga/etniska skillnader i riskfaktorer för kronisk njursjukdom (CKD) och utfall (Eneanya ND et al. Nature Rev Neph. 2021, United States Renal Data System.):

- Prevalensen av diabetes är högst bland svarta individer jämfört med andra rasgrupper

- Svarta och latinamerikanska individer diagnostiseras i yngre åldrar jämfört med vita individer

- Svarta individer har betydligt högre nivåer av hypertoni jämfört med vita individer

- Hypertonikontroll är mindre bland svarta och latinamerikanska individer jämfört med vita individer

- Svarta individer är mindre benägna att få nefrologisk vård innan de påbörjar dialys jämfört med andra rasgrupper

- Risk för att utveckla njursvikt som kräver dialys eller njurtransplantation

- 4 gånger högre hos svarta mot vita individer

- 1.3 gånger högre hos latinamerikanska jämfört med vita individer

- Svarta individer är mindre benägna att få njurtransplantation jämfört med andra rasgrupper

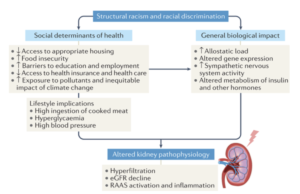

Strukturell rasism bidrar till dåliga hälsoresultat från njurrelaterade sjukdomar, utvecklade Dr. Eneanya (Eneanya ND et al. Nature Rev Neph. 2021.):

Vilka livsstilsvanor du har råd med – som vad du äter, och biologiska effekter som stressen av rasism och diskriminering leder alla till metabola förändringar i kroppen, vilket kan leda till nedsatt njurfunktion.

Dr. Eneanya pekade på ett exempel på hur en algoritm som för närvarande används av läkare har verkliga konsekvenser. eGFR-ekvationen är en algoritm som används för att bestämma hur stark en patients njurfunktion är. En högre eGFR representerar bättre njurfunktion. En patients eGFR-nivå avgör om de är kvalificerade för vissa behandlingar, och, kanske mest avgörande, en njurtransplantation. Algoritmen visar dock att en svart och icke-svart person som är av samma ålder, kön och har samma kreatininmått (ett blodprov som mäter njurfunktionen), har olika eGFR-nivåer. Algoritmen beräknar att en svart person har en högre eGFR, förmodligen överlägsen njurfunktion, än den icke-svarta personen. Detta begränsar den behandling de är berättigad till och innebär att de behöver bli sjukare för att få den hjälp de borde ha rätt till.

Dr. Eneanya förklarade historien om algoritmen som avslöjar varför den beräknar på detta missriktade sätt: en studie från 1999 tillskrev högre serumkreatinin till svarta individer på grund av det felaktiga antagandet att de hade högre muskelmassa. Studien utvecklade den första eGFR-ekvationen som användes i USA och inkorporerade en multiplikationsfaktor för "svart ras" som orsakar högre eGFR bland svarta individer. Användningen av eGFR är problematisk eftersom läkare lämnas att bedöma någons ras baserat på utseende eller medicinska journaler (som kan ha ras listat som ett överblivet antagande från en tidigare läkare). Det finns inte heller någon skillnad för blandrasindivider, eller en metod för att klassificera dem.

Dr. Eneanya var en författare till en artikel som ändrade hur eGFR beräknas inom sjukvården genom att förespråka en ekvation som inte tar ras i uppskattningen (Inker LA, Eneanya ND, et al. NEJM 2021, Delgado C, et al. JASN 2021). Dr. Eneanya och hennes kollegor återvände till den ursprungliga studien från 1999 och tog bort ras från ekvationen och återförde den med andra input. Idag använder ⅓ av sjukhus och kliniker i USA den nya ekvationen, och United Network for Organ Sharing (UNOS) begränsade särskilt alla transplantationscentra från att använda den rasbaserade ekvationen i juni 2022. De tog det ett steg längre i januari 2023 och förklarade att alla amerikanska transplantationscenter måste granska alla svarta patienter på njurtransplantationsväntlistan och ändra deras väntelista om den påverkades av den rasbaserade eGFR-ekvationen. Dr. Eneanya specificerade att medan UNOS är en del av den federala regeringen, var regeringen inte direkt involverad i beslutet att förbjuda användningen av den rasbaserade ekvationen.

Förutom ett universellt antagande av den nya eGFR-ekvationen, hade Dr. Eneanya några fler framtida tillvägagångssätt som hon ser som nyckeln till rättvis tillgång till behandling av njursjukdom:

- Utveckla policyer och processer för att förbättra tillgången till förebyggande vård av kronisk njursjukdom

- Utveckla policyer för att öka tillgången till njurtransplantation

- Undersök miljöeffekter (t.ex. stress, diskriminering) på njurfunktion och sjukdomsprogression

- Transparens i att diskutera njurfunktionsbestämning med patienter (inklusive begränsningar av eGFR-ekvationer)

Dr. Eneanya utvecklade att att reta stereotyper om svart ras handlar om att eliminera villfarelser och falska nyheter som inte har någon vetenskaplig grund. Till exempel ändras medicinskolans läroplaner för att visa att det inte finns någon antropologisk grund för att det finns mer muskelmassa i en ras än en annan. Media har också gjort ett bra jobb med att dela denna sönderslagna myt, och Dr. Eneanya rådfrågade till och med ett avsnitt av Grey's Anatomy som belyste de förödande effekterna av eGFR-ekvationen för svarta patienter i behov av en njurtransplantation.

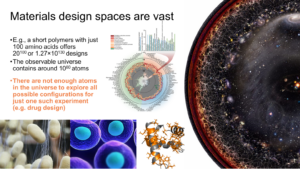

Dr. Singh fortsatte samtalet om hälsoskillnader genom att förklara att i USA har svarta individer högre dödlighet i cancer jämfört med vita individer. Detta faktum exemplifierar att det finns många utmaningar som läkare och dataforskare måste möta, det finns också många möjligheter att utveckla metoder som inte vidgar befintliga skillnader.

Dr. Singh förklarade först cancerns biologi: "Cancer är en sjukdom där våra egna celler förvärvar mutationer som gör att de kan växa okontrollerat. Så om vi vill förstå den molekylära grunden för cancer hos vilken EN individ som helst, kan vi titta på genomen av hans eller hennes cancerceller och hans eller hennes icke-cancerceller, och sekvensera. När vi väl har sekvenserat normala celler och cancerceller kan vi jämföra genomen och avslöja vilka mutationer vi förvärvat i cancerceller, och detta kan ge oss en fingervisning om vilka förändringar som kan vara de som är relevanta för den individens cancer. Detta är precis vad som har gjorts under de senaste 15 eller så åren, där tumörer från tiotusentals individer har sekvenserats och mutationer inom dem identifierats."

I stort sett alla känner någon som har fått diagnosen cancer, och det finns inget universellt botemedel. Men Dr. Singh diskuterade därefter löftet om precision onkologi, där en forskare sekvenserar en patients tumör, identifierar deras DNA-mutationer och utför beräkningsanalys för att avgöra vilka förändringar som kan riktas mot. Immunterapi är ett tillvägagångssätt för att utnyttja någons eget immunsystem för att rikta in sig på sina tumörer. En lovande immunterapi är att designa vacciner som är anpassade för varje individ och dessa vacciner framkallar ett immunsvar mot deras tumörer.

Dr. Singh förklarar hur detta fungerar är att vart och ett av våra immunsystem har 6 olika kopior av det klassiska major histocompatibility complex (MHC) klass I-gener. Det finns över 13,000 XNUMX olika MHC-varianter av dessa gener, så varje person har olika MHC-gener. Vissa mutationer i cancerceller resulterar i "främmande" proteiner och några av dessa kan bindas av en individs MHC. Dessa komplex av MHC bundna med ett fragment av cancerhärlett protein känns igen av immunceller och kan aktivera ett immunsvar. Detta är mycket personligt eftersom varje individs tumör kan ha olika mutationer och varje individ har olika MHC. Forskare använder maskininlärning för att förutsäga vilka MHC-varianter som binder vilka peptider, vilket förhoppningsvis kommer att förbättra effektiviteten av immunterapi och i slutändan leda till utformningen av personliga neoantigenvacciner.

Mångfalden av MHC-gener varierar enormt över hela världen, utvecklar Dr. Singh. De flesta MHC-alleler har inga bindningsdata associerade med dem, och de som har data om deras bindning är partiska till förmån för vissa rasgrupper. Det är viktigt när man testar en datamängd att inte bara fokusera på övergripande prestanda, utan också att överväga delpopulationer av data så att alla har lika tillgång till de potentiella fördelarna med denna forskning.

Utbildningssetet måste analyseras för bias innan det tillämpas. Dessutom kan metoder för att uppskatta prestanda på osynliga data avslöja bias i den data som den tränades på. Att samla in data på ett opartiskt sätt är viktigt för att begränsa möjligheten till partiskhet senare i användningen av algoritmen. Områden för framtida arbete med detta ämne fokuserar på alternativa utbildningsprocedurer och algoritmiska strategier för riktad datainsamling. Sammantaget är det avgörande att prioritera utvecklingen av rättvisa precisionsmedicinska tillvägagångssätt så att terapier och forskning nedströms är rättvisa.

Dr. Moses talade härnäst och hon kontextualiserade hur eGFR- och MHC-peptidbindningsalgoritmerna passar in i ett större ekosystem av hur medicinska algoritmer påverkar sociala resultat. Hon förklarar att forskare använder algoritmer och AI för att förutsäga resultat vi bryr oss om från proxyservrar som lätt kan mätas, och dessa proxyservrar kan vara felaktiga. För att göra medicinska algoritmer ännu mer komplicerade interagerar de ständigt med varandra på oförutsägbara sätt, så den fulla omfattningen av algoritmer för diagnosen av en patient är vanligtvis oklart. Därför är det avgörande att använda algoritmer med försiktighet, särskilt för att när algoritmerna misslyckas kan de vara mest skadliga för de mest utsatta.

Att ta reda på vem en algoritm påverkar och varför är en viktig del av medicinsk rättvisa. Dr Moses tar ett steg tillbaka och definierar eget kapital. Den vanliga grafiken används för att skilja jämlikhet från jämlikhet, med individer med 3 olika höjder som kämpar för att se en basebollmatch och olika sätt att stödja dem, är felaktig även i den tredje bilden som tar bort barriären eftersom den antyder att det finns något inneboende för personen i fråga om varför de behöver stödet snarare än sociala skäl som kan ha orsakat orättvisan i första hand.

Dr. Moses visade en alternativ grafik för att definiera hur rättvisa ser ut i ett samhälle med systemiska orättvisor (Copyright 2020 av Nicolás E. Barceló och Sonya Shadravan (konstnär: Aria Ghalili)):

Den här grafiken visar att inte alla kan dra nytta av att barriären tas bort, men det finns djupt rotade problem som måste hanteras för att uppnå rättvisa.

Dataforskare bör alltid ha detta viktiga sammanhang i åtanke, hävdar Dr. Moses. Det är ofta svårt att identifiera de antaganden som fanns i skapandet av algoritmer, även med de mest enkla algoritmerna. Det är också lätt att använda en statistisk korrelation för att förutsäga ett utfall och anta att korrelation är lika med orsakssamband, men det är en felaktighet.

Dr Moses fortsätter med att ge konkreta exempel på orättvisa algoritmer som används i samhället idag inom andra områden. Till exempel algoritmer i det straffrättsliga systemet som ersätter ekonomisk borgen för frihetsberövande. Avsikten är att processen ska vara en datadriven, opartisk metod för att kvarhålla de som är en fara eller riskerar att inte inställa sig för rättegång. Algoritmerna har dock många brister både vad gäller algoritmens förmåga att göra rättvisa och korrekta förutsägelser och fördomarna i systemet algoritmen ingår i, inklusive partiska indata och partiska tolkningar av utdata. Ett annat exempel på hur rasfördomar vidmakthålls i det straffrättsliga systemet av algoritmer är mjukvara för ansiktsigenkänning. Medan ansiktsigenkänning har visat sig vara minst exakt när det gäller att identifiera mörkhyade kvinnliga ansikten, är det svarta manliga ansikten som oftast har felidentifierats av dessa algoritmer som leder till falska arresteringar. Detta visar hur partiskhet som mest påverkar en grupp (svarta kvinnor) när det gäller korrekt klassificering kan ha störst inverkan på en annan grupp (svarta män) på grund av partiskhet i det straffrättsliga systemet

Algoritmer kan förvärra mänsklig fördom och kan också avfärdas om de inte förstärker den bedömning du skulle ha gjort utan att konsultera algoritmen. Detta är sant i partiska algoritmer inom medicin också. Till exempel är pulsoximetrar mindre exakta när det gäller att upptäcka syrenivåer i mörkare hud, vilket kan resultera i underdiagnostik av luftvägssjukdomar som svår covid. Att använda mängden pengar som spenderas på sjukvård som en proxy för hur frisk någon är är ett annat orättvist mått. Exemplen som Dr. Eneanya och Dr. Singh beskrev, eGFR-nedsättningen av njurarna hos afroamerikaner, och genomiska datauppsättningar som överrepresenterar europeisk härkomst, är andra framträdande exempel på partiska algoritmer inom medicin som har farliga nedströmskonsekvenser för de drabbade. eGFR-ekvationen användes för att identifiera fångar som var tillräckligt sjuka för att släppas ur fängelset under covid, vilket resulterade i att en afroamerikansk man nekades frigivning eftersom hans njurfunktion var överskattad.

Feedback kan förbättra algoritmer eller förvärra deras skador. Algoritmer är inte en enkelriktad gata, eftersom de syftar till att förutsäga beteende från data och ett års förutsägelse påverkar nästa års data. Algoritmer bör syfta till att minska fördomar över tid; till exempel bör utfrågningar mot borgen hjälpa tilltalade att dyka upp för rättegång snarare än att förutsäga misslyckanden; polisverksamheten bör syfta till att minska både brottslighet och falska gripanden. Algoritmer som används över domäner bör aldrig vara huggna i sten eftersom det kommer att finnas feedback mellan människor, algoritmer och sociala sammanhang.

Dr. Moses föreslog också ytterligare vägar framåt: ta bort partiskhet från datauppsättningar, ifrågasätta antaganden, vända (inte förstärka) systemisk fördom, utvärdera med en mångfald av perspektiv, kräva transparenta och förklarliga algoritmer och använda gradvisa, adaptiva implementeringar. Den vanliga uppfattningen är att algoritmer på något sätt tar bort bias, men i verkligheten kodar de ofta bias och vi måste vara försiktiga med algoritmer och deras resultat.

Den sista delen av panelen var en Q&A. Moderator Dr. Siek inledde sessionen med att fråga, "hur kan algoritmer och data inte förvärra skadorna?"

- Dr. Eneanya: Om en forskare slutar med ras när han letar efter differentiatorer i en algoritm, är det lat och vetenskapligt ogiltigt. Genetiskt ser människor mer lika ut mellan raser än inom dem. Det är viktigare att tänka på biologiska egenskaper som faktiskt påverkar ett mänskligt system som njurar. Till exempel, när de testar pulsoximetern, borde forskare ha rådfrågat en hudläkare för att testa och validera pulsoximetrar baserat på olika hudtoner – snarare än att använda en typ av enhet för personer med olika hudtoner.

- Dr. Moses: Vi bör använda samma tillvägagångssätt för att validera algoritmer efter att de har tagits i bruk. Att erkänna ras som en social konstruktion gör det möjligt att märka rasblinda studier har inverkan. Det är viktigt att leta efter distinktion mellan grupper för att identifiera potentiella skillnader som algoritmen förstärker. Måste man utvärdera om algoritmen minimerar problem eller gör den bättre?

- Dr. Singh: Ras bör aldrig användas som indata, men det kan användas för att utvärdera utdata för bias. Om vi inte tänkte på ras skulle vi inte ens kunna säga att det finns hälsoskillnader. Att samla in genomisk data och kategorisera efter härkomst är också en felaktig metod. Vi måste se till att utvärdera om metoder fungerar bra över populationer.

- Dr. Eneanya: När vi diversifierar en studiepopulation måste vi gå bort från att bara ta in grupper av vita eller svarta människor. Vi måste titta på fler skillnader inom dessa grupper såsom faktorer som social status, kön, sexualitet etc. Vi måste titta på helheten och inte bara mångfaldsdatauppsättningar baserade på ras.

- Dr Moses: Algoritmer är exakt de typer av verktyg som borde hjälpa oss att göra det, det finns många potentiella datorstrategier som kan hjälpa.

- Dr. Singh: Jag håller med om att algoritmer spelar en stor roll här, så hur prioriterar vi datainsamling? Vi måste fundera på hur vi gör det mycket noggrant.

En publikmedlem frågade sedan: "Med tanke på den stora brådskan att utveckla algoritmer baserade på aktuella datamängder med fördomar, finns det sätt att motverka bias i algoritmen utöver att bli av med fördomar i datasetet?"

- Dr. Singh: Det är svårt att övervinna partiskhet i en datamängd; det är ett aktivt forskningsområde. Det är lätt att över- eller underskatta exempeldata. Det finns olika sätt att träna ML-modeller där det övergripande målet (typiskt en funktion man försöker minimera, vanligtvis med hjälp av hela datamängden) är hur optimering ska se ut.

- Dr. Eneanya: Många medicinska algoritmer anses behöva inkludera ras för att vara mer exakt. Men människor måste kritiskt undersöka varför ras introduceras i första hand? Att ta bort ras som en variabel kanske inte förändrar algoritmens prestanda så mycket som du kanske tror. Betyder det någonting (kliniskt) när resultaten bara ändras med en liten bit efter att man tagit bort en variabel som ras?

- Dr. Singh: Det betyder särskilt ingenting när ditt träningsset och setet du använder det på är väldigt olika.

Dr. Siek fick paneldeltagarna med en annan fråga, "Om vi kunde göra det här igen, vad skulle vi göra annorlunda?"

- Dr. Eneanya: Att sluta med ras när man utvärderar orsaker till skillnader i hälsoresultat borde inte ha hänt. Till exempel med kreatininnivåer bör vi tänka på vad mer som kan påverka kreatinin? Vi behöver bättre datauppsättningar, vilket kräver att man bygger förtroende i samhällen. Detta kan se ut som att förbättra mångfalden av försökspopulationer, utvärdera hur din studiepersonal ser ut, etc. National Institute of Health-anslag kräver i allt högre grad samhällsbaserade partners och hälsorättsspecialister som en del av forskargruppen. Vi måste förändra de gamla uppsättningarna, men måste också bygga bättre uppsättningar i framtiden. Vi kan bara göra så mycket med att försöka omkonfigurera det som finns där ute.

- Dr. Moses: Utöver vad vi skulle kunna göra om vi startade om, tycker jag om att tänka på algoritmer som speglar av samhället. De tränas av alla på internet. Genom att använda det som en input till nästa nivå av algoritm kan vi bestämma var fördomarna finns, varför de finns där och vad den framtida effekten är. Vi måste fråga oss hur man använder dessa kvantitativa verktyg för att ta reda på hur man fixar dessa situationer snarare än att förvärra dem.

- Dr. Singh: Många genom som har samlats in representerar inte befolkningen i stort. Vi måste börja med engagemang från olika grupper av människor.

Den sista publikfrågan var: "Tills vi kommer till en punkt där vi har en fullständig genomisk bild av alla människor, kommer det att finnas entusiasm att använda ML och algoritmer. Vad är det för riktiga saker på peer review-nivå som vi kan göra nu så att vi inte behöver fixa dem om 30 år?”

- Dr. Eneanya: Perfekt är det godas fiende. Vi måste göra så gott vi kan. Vi kan identifiera fördomar och sedan göra så gott vi kan framåt. Det finns barriärer som inte har med kliniska algoritmer att göra. Att bara fixa eGFR-algoritmen genom att bli av med ras kommer inte att lösa skillnader i njursjukdomar. Mycket arbete måste göras på multivariabla aspekter av förtryck.

- Dr. Moses: Verket du [Dr. Eneanya] har gjort för att omkonstruera algoritmen för alla är exakt hur man ska gå vidare. Vi måste fixa systemet. Använder också det faktum att det måste fixas; det var lätt att se bias inskriven i ekvationen. Njurekvationen fungerar som en spegel för ett samhälle som tillät ras att kodas på ett sätt som missgynnade afroamerikaner i årtionden. Fördomen i den ekvationen var tydlig och avsiktlig. Det kommer att bli mycket svårare att identifiera bias i mer komplexa algoritmer i framtiden.

Håll utkik efter ytterligare en AAAS 2023 CCC-sponsrad panelrecap!

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://feeds.feedblitz.com/~/733934357/0/cccblog~Health-Equity-How-Can-Algorithms-and-Data-Mitigate-Not-Exacerbate-Harms-AAAS-Panel-Recap/

- :är

- $UPP

- 000

- 1

- 1999

- 2020

- 2021

- 2022

- 2023

- 7

- a

- förmåga

- Able

- Om oss

- tillgång

- exakt

- Uppnå

- förvärva

- förvärvade

- tvärs

- aktiv

- faktiskt

- Annat

- Lägger

- Antagande

- avancera

- språkar

- påverka

- afrikansk

- Efter

- Åldrar

- AI

- AL

- algoritm

- algoritmisk

- algoritmer

- Alla

- tillåter

- alternativ

- alltid

- amerikan

- Amerikaner

- bland

- mängd

- analys

- anatomi

- och

- Annan

- visas

- tillämpas

- tillvägagångssätt

- tillvägagångssätt

- ÄR

- OMRÅDE

- områden

- argumenterar

- luft

- anhållanden

- Artikeln

- konstnär

- AS

- aspekter

- associerad

- Antagandet

- At

- publik

- Författaren

- tillbaka

- borgen

- Förbjuda

- barriär

- barriärer

- Baseboll

- baserat

- grund

- BE

- därför att

- började

- Där vi får lov att vara utan att konstant prestera,

- fördel

- Fördelarna

- BÄST

- Bättre

- mellan

- Bortom

- förspänning

- binda

- bindande

- biologi

- Bit

- Svart

- blod

- kropp

- Bunden

- Föra

- SLUTRESULTAT

- Byggnad

- by

- beräknat

- beräknar

- KAN

- Cancer

- Cancerceller

- vilken

- försiktigt

- kategorisera

- orsakas

- Orsakerna

- ccc

- Celler

- Centers

- vissa

- utmaningar

- byta

- Förändringar

- byte

- egenskaper

- klass

- klassificering

- klassificera

- Klinisk

- kliniker

- kollegor

- Samla

- samling

- kommande

- Gemensam

- samhällen

- Gemenskapsbaserat

- jämföra

- jämfört

- fullborda

- komplex

- komplicerad

- databehandling

- Konsekvenser

- Tänk

- ständigt

- konstruera

- rådgivning

- sammanhang

- fortsatte

- fortsätter

- kontroll

- Konversation

- upphovsrätt

- Korrelation

- kunde

- Covidien

- skapande

- Brott

- Kriminell

- avgörande

- avgörande

- härdning

- Aktuella

- För närvarande

- FARA

- Dangerous

- datum

- datauppsättning

- datauppsättningar

- datauppsättningar

- årtionden

- Beslutet

- minskning

- djup

- talade

- definierar

- Efterfrågan

- demonstrerar

- distributioner

- beskriven

- Designa

- internering

- bestämning

- Bestämma

- bestämd

- förödande

- utveckla

- utvecklade

- utveckla

- Utveckling

- anordning

- Diabetes

- skillnader

- olika

- skilja

- svårt

- direkt

- rabatt

- diskuteras

- diskutera

- Sjukdom

- sjukdomar

- flera

- Mångfald

- DNA-

- läkare

- inte

- domäner

- inte

- ner

- driven

- under

- e

- varje

- lätt

- ät

- ekosystemet

- effekter

- utarbetad

- berättigad

- eliminera

- tillräckligt

- gick in i

- entusiasm

- miljömässigt

- jämlikhet

- lika

- ekvationer

- eget kapital

- speciellt

- väsentlig

- uppskatta

- etc

- Giltigt körkort

- utvärdera

- utvärdering

- Även

- alla

- exakt

- exempel

- exempel

- exemplifierar

- befintliga

- erfarenhet

- förklarade

- förklara

- Förklarar

- Ansikte

- ytorna

- ansikts

- ansiktsigenkänning

- faktorer

- MISSLYCKAS

- Misslyckades

- Misslyckande

- verkligt

- fejka

- falska nyheter

- gynna

- Federal

- Federala regeringen

- återkoppling

- kvinna

- få

- Figur

- slutlig

- Förnamn

- passa

- Fast

- fixerad

- bristfällig

- Fokus

- fokusering

- För

- Framåt

- från

- full

- fungera

- ytterligare

- Vidare

- framtida

- lek

- Kön

- skaffa sig

- få

- Ge

- Ge

- globen

- Målet

- kommer

- god

- bra jobb

- Regeringen

- gradvis

- bidrag

- Grafisk

- störst

- Grupp

- Gruppens

- Väx

- hänt

- Hård

- skadliga

- skador

- sele

- Har

- Hälsa

- hälsobidrag

- hälso-och sjukvård

- friska

- höjder

- hjälpa

- här.

- hög risk

- högre

- högsta

- Markerad

- höggradigt

- historiskt

- historia

- Förhoppningsvis

- sjukhus

- Hur ser din drömresa ut

- How To

- Men

- HTTPS

- stor

- humant

- Människa

- Hypertension

- i

- identifierade

- identifierar

- identifiera

- identifiera

- bild

- Immunförsvar

- immunterapi

- Inverkan

- påverkade

- Konsekvenser

- nedsättning

- med Esport

- förbättra

- förbättra

- in

- I andra

- felaktig

- innefattar

- Inklusive

- Inkorporerad

- Öka

- ökat

- alltmer

- oerhört

- individuellt

- individer

- inneboende

- ingång

- exempel

- Institute

- uppsåt

- interagera

- Internet

- hotfull

- introducerade

- involverade

- inblandning

- problem

- IT

- Januari

- Jobb

- Domaren

- Rättvisa

- Ha kvar

- Nyckel

- njure

- Large

- större

- leda

- ledande

- inlärning

- Överbliven

- Nivå

- nivåer

- Lifestyle

- tycka om

- sannolikt

- BEGRÄNSA

- begränsningar

- gränser

- Noterade

- se

- ser ut som

- du letar

- UTSEENDE

- Lot

- Maskinen

- maskininlärning

- gjord

- större

- göra

- Framställning

- människa

- sätt

- många

- Massa

- max-bredd

- betyder

- mäta

- åtgärder

- Media

- medicinsk

- Sjukvård

- läkemedel

- medlem

- Män

- metod

- Metodik

- metoder

- Mexico

- kanske

- emot

- minimerande

- spegel

- Mildra

- blandad

- ML

- modeller

- modifiera

- molekylär

- Monetär

- pengar

- mer

- mest

- flytta

- gå framåt

- rörliga

- nationell

- Natur

- Behöver

- behöver

- behov

- nät

- Nya

- nyheter

- Nästa

- normala

- i synnerhet

- of

- ofta

- Gamla

- on

- ONE

- möjligheter

- Möjlighet

- optimering

- beställa

- Organiserad

- ursprungliga

- Övriga

- Resultat

- skisse

- övergripande

- Övervinna

- egen

- Syrgas

- panel

- del

- partner

- Tidigare

- Patienten

- patienter

- jämlikar

- Personer

- varseblivning

- perfekt

- prestanda

- utför

- kanske

- personen

- personlig

- personlig

- perspektiv

- Bild

- Plats

- plato

- Platon Data Intelligence

- PlatonData

- Spela

- Punkt

- Strategier

- polisarbete

- dålig

- befolkning

- populationer

- potentiell

- exakt

- exakt

- Precision

- förutse

- förutsägelse

- Förutsägelser

- presentera

- förhärskande

- föregående

- Innan

- Prioritera

- fängelse

- fångar

- problem

- förfaranden

- process

- processer

- yrkesmän/kvinnor

- framträdande

- löfte

- lovande

- föreslagen

- Protein

- Proteiner

- ombud

- puls

- sätta

- Frågor och svar

- kvantitativ

- fråga

- Lopp

- Racial bias

- rasism

- rates

- snarare

- verklig

- verkliga världen

- Verkligheten

- skäl

- resumé

- motta

- senaste

- erkännande

- erkänt

- register

- minska

- register

- förstärka

- frigöra

- frigörs

- relevanta

- ta bort

- avlägsnas

- bort

- ersätta

- representerar

- representerar

- Obligatorisk

- Kräver

- forskning

- forskaren

- forskare

- respons

- startas

- begränsad

- resultera

- Resultat

- avslöjar

- avslöjar

- vända

- översyn

- Befria

- Risk

- riskfaktorer

- Roll

- rusa

- Samma

- Skola

- vetenskaplig

- Forskare

- vetenskapsmän

- ser

- Sekvens

- Serum

- serverar

- session

- in

- uppsättningar

- svår

- delning

- skall

- show

- visas

- Visar

- signifikant

- liknande

- situationer

- Hud

- So

- Social hållbarhet

- Samhället

- Mjukvara

- LÖSA

- några

- någon

- något

- specialister

- specificerade

- spent

- Personal

- starta

- Starta

- Stater

- statistisk

- status

- Steg

- STEN

- stoppa

- okomplicerad

- strategier

- gata

- påkänning

- stark

- strukturell

- Kämpar

- studier

- Läsa på

- ämne

- sådana

- Föreslår

- överlägsen

- stödja

- system

- systemisk

- System

- Ta

- tar

- Målet

- riktade

- grupp

- villkor

- testa

- Testning

- den där

- Smakämnen

- Framtiden

- deras

- Dem

- därför

- Dessa

- saker

- tusentals

- tid

- till

- i dag

- alltför

- verktyg

- ämne

- Tåg

- tränad

- Utbildning

- transparent

- behandling

- rättegång

- sann

- Litar

- typer

- typiskt

- Ytterst

- avslöja

- under

- underlag

- förstå

- United

- USA

- Universell

- universitet

- oförutsägbar

- us

- Användning

- användning

- vanligen

- BEKRÄFTA

- mängd

- Kontra

- Sårbara

- Sätt..

- sätt

- VÄL

- Vad

- Vad är

- som

- medan

- vit

- VEM

- Hela

- kommer

- med

- inom

- utan

- Kvinnor

- Arbete

- fungerar

- skulle

- skriven

- år

- Om er

- Yngre

- Din

- zephyrnet