ความสำเร็จของแอปพลิเคชั่น generative AI ในหลากหลายอุตสาหกรรมได้ดึงดูดความสนใจและความสนใจของบริษัทต่างๆ ทั่วโลกที่กำลังมองหาการทำซ้ำและก้าวข้ามความสำเร็จของคู่แข่ง หรือแก้ไขกรณีการใช้งานใหม่ๆ ที่น่าตื่นเต้น ลูกค้าเหล่านี้กำลังมองหาโมเดลพื้นฐาน เช่น TII Falcon, Stable Diffusion XL หรือ GPT-3.5 ของ OpenAI เพื่อเป็นกลไกที่ขับเคลื่อนนวัตกรรม AI แบบสร้างสรรค์

โมเดลพื้นฐานคือคลาสของโมเดล AI เชิงสร้างสรรค์ที่สามารถทำความเข้าใจและสร้างเนื้อหาที่เหมือนมนุษย์ได้ ต้องขอบคุณข้อมูลที่ไม่มีโครงสร้างจำนวนมหาศาลที่พวกเขาได้รับการฝึกฝน โมเดลเหล่านี้ได้ปฏิวัติงานคอมพิวเตอร์วิทัศน์ (CV) และการประมวลผลภาษาธรรมชาติ (NLP) ต่างๆ รวมถึงการสร้างภาพ การแปล และการตอบคำถาม สิ่งเหล่านี้ทำหน้าที่เป็นรากฐานสำหรับแอปพลิเคชัน AI มากมาย และได้กลายเป็นองค์ประกอบสำคัญในการพัฒนาระบบอัจฉริยะขั้นสูง

อย่างไรก็ตาม การใช้งานโมเดลพื้นฐานอาจมาพร้อมกับความท้าทายที่สำคัญ โดยเฉพาะอย่างยิ่งในแง่ของต้นทุนและความต้องการทรัพยากร โมเดลเหล่านี้ขึ้นชื่อในเรื่องขนาด ซึ่งมักจะมีตั้งแต่พารามิเตอร์หลายร้อยล้านไปจนถึงหลายพันล้านพารามิเตอร์ ขนาดใหญ่ต้องการทรัพยากรการคำนวณที่กว้างขวาง รวมถึงฮาร์ดแวร์ที่ทรงพลังและความจุหน่วยความจำจำนวนมาก ในความเป็นจริง การปรับใช้โมเดลพื้นฐานมักจะต้องใช้ GPU อย่างน้อยหนึ่งตัว (มักจะมากกว่านั้น) เพื่อรองรับภาระการคำนวณอย่างมีประสิทธิภาพ ตัวอย่างเช่น โมเดลคำสั่ง TII Falcon-40B ต้องมีอินสแตนซ์ ml.g5.12xlarge เป็นอย่างน้อยจึงจะโหลดลงในหน่วยความจำได้สำเร็จ แต่จะทำงานได้ดีที่สุดกับอินสแตนซ์ที่ใหญ่กว่า เป็นผลให้ผลตอบแทนจากการลงทุน (ROI) ของการปรับใช้และการบำรุงรักษาโมเดลเหล่านี้อาจต่ำเกินไปที่จะพิสูจน์มูลค่าทางธุรกิจ โดยเฉพาะอย่างยิ่งในระหว่างรอบการพัฒนาหรือสำหรับปริมาณงานที่แหลมคม นี่เป็นเพราะต้นทุนการดำเนินงานของการมีอินสแตนซ์ที่ขับเคลื่อนด้วย GPU สำหรับเซสชันที่ยาวนาน ซึ่งอาจเกิดขึ้นตลอด 24 ชั่วโมงทุกวัน

เมื่อต้นปีที่ผ่านมาเราได้ประกาศ อเมซอน เบดร็อคซึ่งเป็น API แบบไร้เซิร์ฟเวอร์เพื่อเข้าถึงโมเดลพื้นฐานจาก Amazon และพันธมิตร AI สร้างสรรค์ของเรา แม้ว่าปัจจุบันจะอยู่ในการแสดงตัวอย่างแบบส่วนตัว แต่ API แบบไร้เซิร์ฟเวอร์ช่วยให้คุณสามารถใช้โมเดลพื้นฐานจาก Amazon, Anthropic, Stability AI และ AI21 ได้โดยไม่ต้องปรับใช้ตำแหน่งข้อมูลใดๆ ด้วยตนเอง อย่างไรก็ตาม โมเดลโอเพ่นซอร์สจากชุมชน เช่น Hugging Face มีการเติบโตอย่างมาก และไม่ใช่ทุกโมเดลจะพร้อมใช้งานผ่าน Amazon Bedrock

ในโพสต์นี้ เรากำหนดเป้าหมายสถานการณ์เหล่านี้และแก้ไขปัญหาการเสี่ยงต่อต้นทุนสูงโดยการปรับใช้โมเดลพื้นฐานขนาดใหญ่ อเมซอน SageMaker จุดสิ้นสุดแบบอะซิงโครนัส ราคาเริ่มต้นที่ Amazon SageMaker JumpStart. วิธีนี้สามารถช่วยลดค่าใช้จ่ายของสถาปัตยกรรมได้ โดยอนุญาตให้อุปกรณ์ปลายทางทำงานได้เฉพาะเมื่อมีการร้องขออยู่ในคิวและในช่วงเวลาสั้นๆ เท่านั้น ในขณะที่ลดขนาดลงเหลือศูนย์เมื่อไม่มีคำขอใดรอรับบริการ ฟังดูดีสำหรับกรณีการใช้งานมากมาย อย่างไรก็ตาม จุดสิ้นสุดที่ลดขนาดลงเหลือศูนย์จะแนะนำเวลาเริ่มต้นแบบ Cold ก่อนที่จะสามารถให้บริการการอนุมานได้

ภาพรวมโซลูชัน

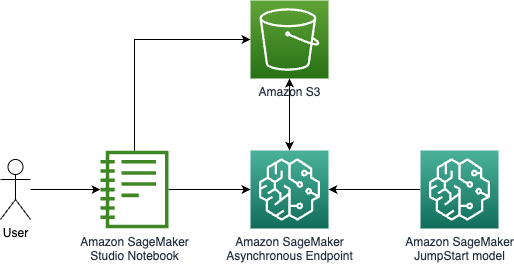

ไดอะแกรมต่อไปนี้แสดงสถาปัตยกรรมโซลูชันของเรา

สถาปัตยกรรมที่เราปรับใช้นั้นตรงไปตรงมามาก:

- อินเทอร์เฟซผู้ใช้คือโน้ตบุ๊ก ซึ่งสามารถแทนที่ได้ด้วย UI บนเว็บที่สร้างบน Streamlit หรือเทคโนโลยีที่คล้ายกัน ในกรณีของเรา โน้ตบุ๊กคือ สตูดิโอ Amazon SageMaker โน้ตบุ๊กที่ทำงานบนอินสแตนซ์ ml.m5.large พร้อมด้วยเคอร์เนล CPU PyTorch 2.0 Python 3.10

- สมุดบันทึกสืบค้นตำแหน่งข้อมูลด้วยสามวิธี: SageMaker Python SDK, AWS SDK สำหรับ Python (Boto3) และ LangChain

- ตำแหน่งข้อมูลทำงานแบบอะซิงโครนัสบน SageMaker และที่ตำแหน่งข้อมูล เราปรับใช้โมเดลคำสั่ง Falcon-40B ปัจจุบันมีความทันสมัยในแง่ของโมเดลการสอนและมีอยู่ใน SageMaker JumpStart การเรียก API เพียงครั้งเดียวช่วยให้เราสามารถปรับใช้โมเดลบนตำแหน่งข้อมูลได้

การอนุมานแบบอะซิงโครนัสของ SageMaker คืออะไร

การอนุมานแบบอะซิงโครนัสของ SageMaker เป็นหนึ่งในสี่ตัวเลือกการใช้งานใน SageMaker ร่วมกับจุดสิ้นสุดแบบเรียลไทม์ การอนุมานแบบแบตช์ และการอนุมานแบบไร้เซิร์ฟเวอร์ หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับตัวเลือกการใช้งานต่างๆ โปรดดูที่ ปรับใช้โมเดลสำหรับการอนุมาน.

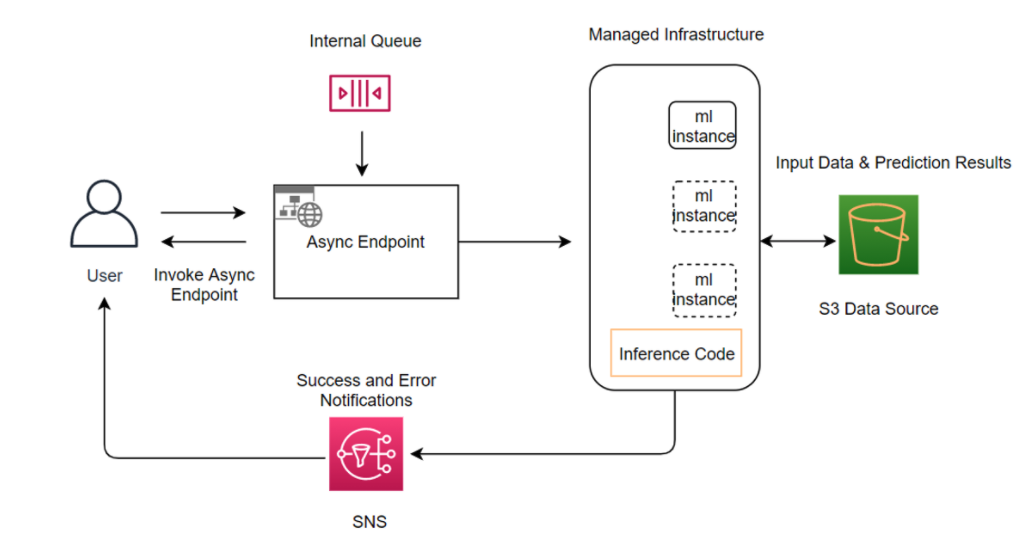

SageMaker การอนุมานแบบอะซิงโครนัสจัดคิวคำขอขาเข้าและประมวลผลคำขอแบบอะซิงโครนัส ทำให้ตัวเลือกนี้เหมาะสำหรับคำขอที่มีขนาดเพย์โหลดขนาดใหญ่สูงสุด 1 GB เวลาประมวลผลที่ยาวนาน และข้อกำหนดด้านเวลาแฝงที่เกือบจะเรียลไทม์ อย่างไรก็ตาม ข้อได้เปรียบหลักที่ได้รับเมื่อต้องรับมือกับโมเดลพื้นฐานขนาดใหญ่ โดยเฉพาะอย่างยิ่งระหว่างการพิสูจน์แนวคิด (POC) หรือระหว่างการพัฒนา คือความสามารถในการกำหนดค่าการอนุมานแบบอะซิงโครนัสเพื่อปรับขนาดเป็นจำนวนอินสแตนซ์เป็นศูนย์เมื่อไม่มีการร้องขอ กระบวนการจึงช่วยประหยัดต้นทุน สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการอนุมานแบบอะซิงโครนัสของ SageMaker โปรดดูที่ การอนุมานแบบอะซิงโครนัส. แผนภาพต่อไปนี้แสดงสถาปัตยกรรมนี้

หากต้องการปรับใช้ตำแหน่งข้อมูลการอนุมานแบบอะซิงโครนัส คุณต้องสร้าง AsyncInferenceConfig วัตถุ. ถ้าคุณสร้าง AsyncInferenceConfig โดยไม่ต้องระบุอาร์กิวเมนต์เป็นค่าเริ่มต้น S3OutputPath จะ s3://sagemaker-{REGION}-{ACCOUNTID}/async-endpoint-outputs/{UNIQUE-JOB-NAME} และ S3FailurePath จะ s3://sagemaker-{REGION}-{ACCOUNTID}/async-endpoint-failures/{UNIQUE-JOB-NAME}.

SageMaker JumpStart คืออะไร

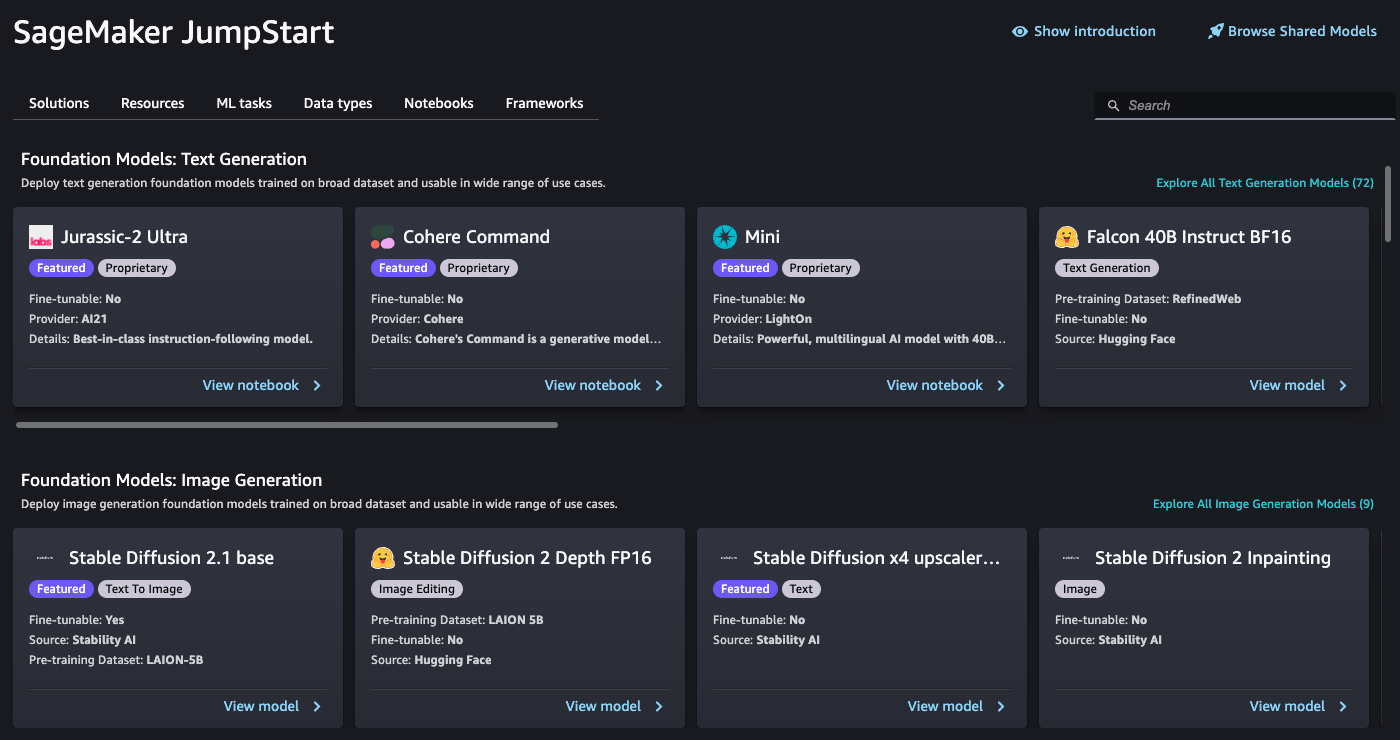

โมเดลของเรามาจาก SageMaker JumpStart ซึ่งเป็นฟีเจอร์ของ SageMaker ที่เร่งการเดินทางของแมชชีนเลิร์นนิง (ML) โดยนำเสนอโมเดลที่ได้รับการฝึกอบรมล่วงหน้า เทมเพลตโซลูชัน และสมุดบันทึกตัวอย่าง โดยให้สิทธิ์เข้าถึงโมเดลที่ได้รับการฝึกอบรมล่วงหน้าที่หลากหลายสำหรับประเภทปัญหาต่างๆ ช่วยให้คุณสามารถเริ่มต้นงาน ML ของคุณด้วยรากฐานที่มั่นคง SageMaker JumpStart ยังมีเทมเพลตโซลูชันสำหรับกรณีการใช้งานทั่วไปและสมุดบันทึกตัวอย่างสำหรับการเรียนรู้ ด้วย SageMaker JumpStart คุณสามารถลดเวลาและความพยายามที่จำเป็นในการเริ่มต้นโปรเจ็กต์ ML ของคุณด้วยการเปิดตัวโซลูชันในคลิกเดียวและทรัพยากรที่ครอบคลุมสำหรับประสบการณ์ ML ที่ใช้งานได้จริง

ภาพหน้าจอต่อไปนี้แสดงตัวอย่างเพียงบางรุ่นที่มีอยู่ใน SageMaker JumpStart UI

ปรับใช้โมเดล

ขั้นตอนแรกของเราคือการปรับใช้โมเดลกับ SageMaker ในการทำเช่นนั้น เราสามารถใช้ UI สำหรับ SageMaker JumpStart หรือ SageMaker Python SDK ซึ่งมี API ที่เราสามารถใช้เพื่อปรับใช้โมเดลกับตำแหน่งข้อมูลแบบอะซิงโครนัส:

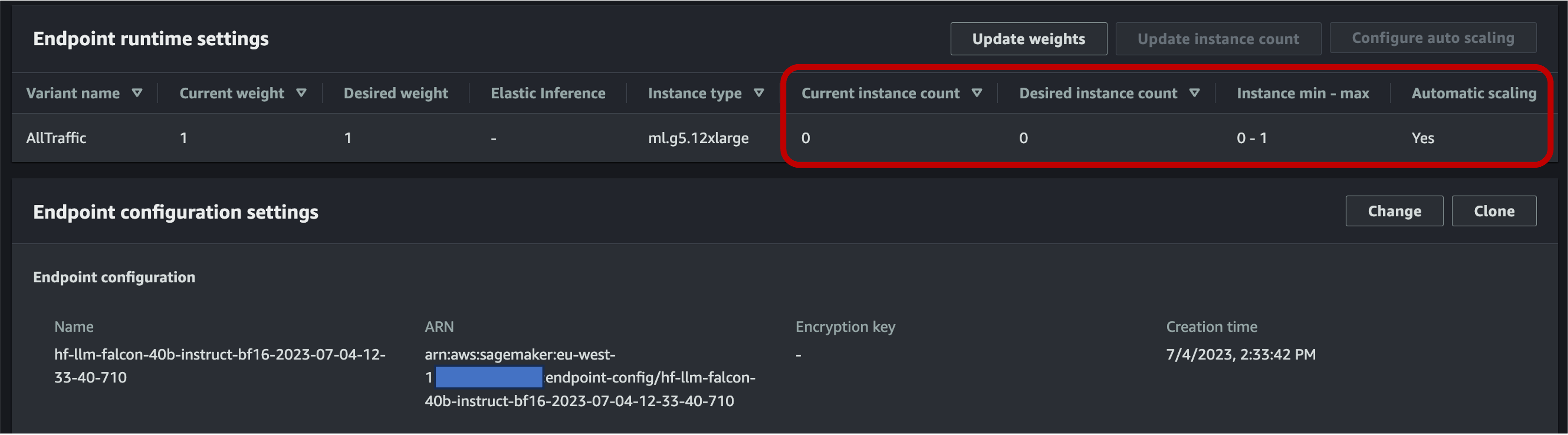

การโทรนี้อาจใช้เวลาประมาณ 10 นาทีจึงจะเสร็จสิ้น ในช่วงเวลานี้ ตำแหน่งข้อมูลจะถูกหมุน คอนเทนเนอร์พร้อมกับสิ่งประดิษฐ์ของโมเดลจะถูกดาวน์โหลดไปยังตำแหน่งข้อมูล การกำหนดค่าโมเดลจะถูกโหลดจาก SageMaker JumpStart จากนั้นตำแหน่งข้อมูลแบบอะซิงโครนัสจะถูกเปิดเผยผ่านตำแหน่งข้อมูล DNS เพื่อให้แน่ใจว่าตำแหน่งข้อมูลของเราสามารถลดขนาดลงเหลือศูนย์ได้ เราจำเป็นต้องกำหนดค่าการปรับขนาดอัตโนมัติบนตำแหน่งข้อมูลแบบอะซิงโครนัสโดยใช้ Application Auto Scaling คุณต้องลงทะเบียนตัวแปรตำแหน่งข้อมูลกับ Application Auto Scaling ก่อน จากนั้นกำหนดนโยบายการปรับขนาด จากนั้นจึงใช้นโยบายการปรับขนาด ในการกำหนดค่านี้ เราใช้เมตริกที่กำหนดเองโดยใช้ CustomizedMetricSpecificationที่เรียกว่า ApproximateBacklogSizePerInstanceดังแสดงในโค้ดต่อไปนี้ สำหรับรายการโดยละเอียดของ อเมซอน คลาวด์วอตช์ เมตริกที่ใช้ได้กับจุดสิ้นสุดการอนุมานแบบอะซิงโครนัสของคุณ โปรดดูที่ การตรวจสอบด้วย CloudWatch.

คุณสามารถตรวจสอบว่านโยบายนี้ได้รับการตั้งค่าเรียบร้อยแล้วโดยไปที่คอนโซล SageMaker โดยเลือก ปลายทาง ภายใต้ การอนุมาน ในบานหน้าต่างนำทาง และค้นหาตำแหน่งข้อมูลที่เราเพิ่งปรับใช้

เรียกใช้จุดสิ้นสุดแบบอะซิงโครนัส

หากต้องการเรียกใช้ตำแหน่งข้อมูล คุณต้องวางเพย์โหลดคำขอไว้ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) และจัดให้มีตัวชี้ไปยังเพย์โหลดนี้โดยเป็นส่วนหนึ่งของ InvokeEndpointAsync ขอ. เมื่อมีการเรียกใช้ SageMaker จะจัดคิวคำขอเพื่อประมวลผลและส่งคืนตัวระบุและตำแหน่งเอาต์พุตเป็นการตอบกลับ เมื่อประมวลผล SageMaker จะวางผลลัพธ์ในตำแหน่ง Amazon S3 คุณสามารถเลือกรับการแจ้งเตือนความสำเร็จหรือข้อผิดพลาดได้ บริการแจ้งเตือนแบบง่ายของ Amazon (อเมซอน SNS).

SageMaker Python SDK

หลังจากการปรับใช้เสร็จสมบูรณ์ มันจะส่งคืนไฟล์ AsyncPredictor วัตถุ. หากต้องการทำการอนุมานแบบอะซิงโครนัส คุณต้องอัปโหลดข้อมูลไปยัง Amazon S3 และใช้ไฟล์ predict_async() วิธีการที่มี S3 URI เป็นอินพุต มันจะส่งคืน AsyncInferenceResponse object และคุณสามารถตรวจสอบผลลัพธ์ได้โดยใช้ get_response() วิธี

หรือหากคุณต้องการตรวจสอบผลลัพธ์เป็นระยะและส่งคืนตามรุ่น ให้ใช้ predict() วิธี. เราใช้วิธีที่สองนี้ในรหัสต่อไปนี้:

โบโต3

ตอนนี้เรามาสำรวจกัน invoke_endpoint_async วิธีการจาก Boto3's sagemaker-runtime ลูกค้า. ช่วยให้นักพัฒนาสามารถเรียกใช้ตำแหน่งข้อมูล SageMaker แบบอะซิงโครนัส โดยมอบโทเค็นสำหรับการติดตามความคืบหน้าและเรียกข้อมูลการตอบสนองในภายหลัง Boto3 ไม่มีวิธีรอให้การอนุมานแบบอะซิงโครนัสเสร็จสิ้นเหมือนกับ SageMaker Python SDK get_result() การดำเนินการ. ดังนั้นเราจึงใช้ประโยชน์จากข้อเท็จจริงที่ว่า Boto3 จะจัดเก็บเอาต์พุตการอนุมานใน Amazon S3 ไว้ในไฟล์ response["OutputLocation"]. เราสามารถใช้ฟังก์ชันต่อไปนี้เพื่อรอให้ไฟล์การอนุมานถูกเขียนลงใน Amazon S3:

ด้วยฟังก์ชันนี้ เราสามารถสืบค้นจุดสิ้นสุดได้:

หลังเชน

LangChain เป็นเฟรมเวิร์กโอเพ่นซอร์สที่เปิดตัวในเดือนตุลาคม 2022 โดย Harrison Chase ช่วยให้การพัฒนาแอปพลิเคชันโดยใช้โมเดลภาษาขนาดใหญ่ (LLM) ง่ายขึ้นโดยการผสานรวมกับระบบและแหล่งข้อมูลต่างๆ LangChain ช่วยให้สามารถวิเคราะห์เอกสาร การสรุป การสร้างแชทบอท การวิเคราะห์โค้ด และอื่นๆ อีกมากมาย มันได้รับความนิยม โดยได้รับการสนับสนุนจากนักพัฒนาหลายร้อยคนและได้รับเงินทุนจำนวนมากจากบริษัทร่วมทุน LangChain ช่วยให้สามารถเชื่อมต่อ LLM กับแหล่งข้อมูลภายนอก ทำให้สามารถสร้างแอปพลิเคชันแบบไดนามิกและตอบสนองต่อข้อมูลได้ มีไลบรารี, API และเอกสารประกอบเพื่อปรับปรุงกระบวนการพัฒนา

LangChain จัดเตรียมไลบรารีและตัวอย่างสำหรับการใช้ตำแหน่งข้อมูล SageMaker พร้อมเฟรมเวิร์ก ทำให้ง่ายต่อการใช้โมเดล ML ที่โฮสต์บน SageMaker เป็น “สมอง” ของเชน หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับวิธีที่ LangChain ทำงานร่วมกับ SageMaker โปรดดูที่ จุดสิ้นสุด SageMaker ในเอกสารประกอบของ LangChain

ข้อจำกัดประการหนึ่งของการใช้งาน LangChain ในปัจจุบันก็คือมันไม่รองรับจุดสิ้นสุดแบบอะซิงโครนัสโดยกำเนิด หากต้องการใช้จุดสิ้นสุดแบบอะซิงโครนัสกับ LangChain เราต้องกำหนดคลาสใหม่ SagemakerAsyncEndpointที่ขยาย SagemakerEndpoint มีคลาสอยู่แล้วใน LangChain นอกจากนี้เรายังให้ข้อมูลต่อไปนี้:

- บัคเก็ต S3 และคำนำหน้าซึ่งการอนุมานแบบอะซิงโครนัสจะจัดเก็บอินพุต (และเอาต์พุต)

- จำนวนวินาทีสูงสุดในการรอก่อนที่จะหมดเวลา

- An

updated _call()ฟังก์ชั่นในการสืบค้นจุดสิ้นสุดด้วยinvoke_endpoint_async()แทนinvoke_endpoint() - วิธีการปลุกจุดสิ้นสุดแบบอะซิงโครนัสหากอยู่ในสถานะ Cold Start (ลดขนาดลงเหลือศูนย์)

เพื่อทบทวนสิ่งที่สร้างขึ้นใหม่ SagemakerAsyncEndpointคุณสามารถเช็คเอาท์ sagemaker_async_endpoint.py ไฟล์ ใช้ได้กับ GitHub.

ทำความสะอาด

เมื่อคุณทดสอบการสร้างการอนุมานจากปลายทางเสร็จแล้ว อย่าลืมลบปลายทางเพื่อหลีกเลี่ยงค่าใช้จ่ายเพิ่มเติม:

สรุป

เมื่อปรับใช้โมเดลพื้นฐานขนาดใหญ่ เช่น TII Falcon การเพิ่มประสิทธิภาพต้นทุนเป็นสิ่งสำคัญ โมเดลเหล่านี้ต้องการฮาร์ดแวร์ที่ทรงพลังและความจุหน่วยความจำสูง ส่งผลให้ต้นทุนโครงสร้างพื้นฐานสูง การอนุมานแบบอะซิงโครนัสของ SageMaker ซึ่งเป็นตัวเลือกการปรับใช้ที่ประมวลผลคำขอแบบอะซิงโครนัส ช่วยลดค่าใช้จ่ายโดยปรับขนาดจำนวนอินสแตนซ์ให้เป็นศูนย์เมื่อไม่มีคำขอที่รอดำเนินการ ในโพสต์นี้ เราได้สาธิตวิธีการปรับใช้โมเดลพื้นฐาน SageMaker JumpStart ขนาดใหญ่กับจุดสิ้นสุดแบบอะซิงโครนัสของ SageMaker เราได้จัดเตรียมตัวอย่างโค้ดโดยใช้ SageMaker Python SDK, Boto3 และ LangChain เพื่อแสดงวิธีการต่างๆ สำหรับการเรียกใช้จุดสิ้นสุดแบบอะซิงโครนัสและการดึงผลลัพธ์ เทคนิคเหล่านี้ช่วยให้นักพัฒนาและนักวิจัยสามารถปรับต้นทุนให้เหมาะสมในขณะที่ใช้ความสามารถของแบบจำลองพื้นฐานสำหรับระบบการทำความเข้าใจภาษาขั้นสูง

หากต้องการเรียนรู้เพิ่มเติมเกี่ยวกับการอนุมานแบบอะซิงโครนัสและ SageMaker JumpStart โปรดดูโพสต์ต่อไปนี้:

เกี่ยวกับผู้เขียน

ดาวิเด้ กัลลิเตลลี่ เป็น Specialist Solutions Architect สำหรับ AI/ML ในภูมิภาค EMEA เขาอยู่ในบรัสเซลส์และทำงานอย่างใกล้ชิดกับลูกค้าทั่วเบเนลักซ์ เขาเป็นนักพัฒนาตั้งแต่ยังเด็ก เริ่มเขียนโค้ดเมื่ออายุ 7 ขวบ เขาเริ่มเรียน AI/ML ที่มหาวิทยาลัย และตกหลุมรักมันตั้งแต่นั้นเป็นต้นมา

ดาวิเด้ กัลลิเตลลี่ เป็น Specialist Solutions Architect สำหรับ AI/ML ในภูมิภาค EMEA เขาอยู่ในบรัสเซลส์และทำงานอย่างใกล้ชิดกับลูกค้าทั่วเบเนลักซ์ เขาเป็นนักพัฒนาตั้งแต่ยังเด็ก เริ่มเขียนโค้ดเมื่ออายุ 7 ขวบ เขาเริ่มเรียน AI/ML ที่มหาวิทยาลัย และตกหลุมรักมันตั้งแต่นั้นเป็นต้นมา

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ChartPrime. ยกระดับเกมการซื้อขายของคุณด้วย ChartPrime เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/optimize-deployment-cost-of-amazon-sagemaker-jumpstart-foundation-models-with-amazon-sagemaker-asynchronous-endpoints/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 12

- 13

- 15%

- 1M

- 2022

- 25

- 7

- a

- สามารถ

- เกี่ยวกับเรา

- เร่ง

- ยอมรับ

- เข้า

- ความสำเร็จ

- ข้าม

- อยากทำกิจกรรม

- นอกจากนี้

- สูง

- ความได้เปรียบ

- หลังจาก

- อายุ

- AI

- โมเดล AI

- AI / ML

- การอนุญาต

- ช่วยให้

- แล้ว

- ด้วย

- แม้ว่า

- อเมซอน

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- จำนวน

- จำนวน

- an

- การวิเคราะห์

- และ

- ประกาศ

- อื่น

- มานุษยวิทยา

- ใด

- API

- APIs

- การใช้งาน

- การใช้งาน

- ใช้

- สถาปัตยกรรม

- เป็น

- ข้อโต้แย้ง

- ศิลปะ

- AS

- At

- ความสนใจ

- ดึงดูด

- รถยนต์

- ใช้ได้

- เฉลี่ย

- หลีกเลี่ยง

- AWS

- ตาม

- BE

- กลายเป็น

- รับ

- ก่อน

- กำลัง

- ที่ดีที่สุด

- ที่ใหญ่กว่า

- พันล้าน

- Blocks

- ร่างกาย

- ทำลาย

- บรัสเซลส์

- การก่อสร้าง

- สร้าง

- ธุรกิจ

- แต่

- by

- โทรศัพท์

- ที่เรียกว่า

- CAN

- ความสามารถในการ

- ความสามารถ

- สามารถ

- ความจุ

- กรณี

- กรณี

- โซ่

- ห่วงโซ่

- ความท้าทาย

- โหลด

- การไล่ล่า

- chatbot

- ตรวจสอบ

- Choose

- เลือก

- ชั้น

- ไคลเอนต์

- อย่างใกล้ชิด

- รหัส

- ผู้สมัครที่ไม่รู้จัก

- อย่างไร

- มา

- ร่วมกัน

- ชุมชน

- บริษัท

- คู่แข่ง

- สมบูรณ์

- เสร็จ

- เสร็จสิ้น

- ส่วนประกอบ

- ครอบคลุม

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- แนวคิด

- องค์ประกอบ

- การเชื่อมต่อ

- ปลอบใจ

- ภาชนะ

- เนื้อหา

- ผลงาน

- ราคา

- ค่าใช้จ่าย

- สร้าง

- ที่สร้างขึ้น

- การสร้าง

- สำคัญมาก

- ปัจจุบัน

- ขณะนี้

- ประเพณี

- ลูกค้า

- ตัด

- ลดต้นทุน

- รอบ

- ข้อมูล

- การซื้อขาย

- ค่าเริ่มต้น

- กำหนด

- ความต้องการ

- แสดงให้เห็นถึง

- ปรับใช้

- นำไปใช้

- ปรับใช้

- การใช้งาน

- รายละเอียด

- dev

- ผู้พัฒนา

- นักพัฒนา

- พัฒนาการ

- Dict

- ต่าง

- การจัดจำหน่าย

- มิติ

- พิการ

- DNS

- do

- เอกสาร

- เอกสาร

- ไม่

- ทำ

- ลง

- สอง

- ในระหว่าง

- พลวัต

- e

- ง่ายดาย

- อย่างมีประสิทธิภาพ

- ความพยายาม

- อื่น

- EMEA

- ทำให้สามารถ

- ช่วยให้

- ปลายทาง

- เครื่องยนต์

- พอ

- ความผิดพลาด

- โดยเฉพาะอย่างยิ่ง

- ทุกๆ

- ตัวอย่าง

- ตัวอย่าง

- ยกเว้น

- ข้อยกเว้น

- น่าตื่นเต้น

- รายจ่าย

- ประสบการณ์

- สำรวจ

- ที่เปิดเผย

- ขยาย

- กว้างขวาง

- ภายนอก

- พิเศษ

- ใบหน้า

- ความจริง

- ลดลง

- เท็จ

- ลักษณะ

- เนื้อไม่มีมัน

- บริษัท

- ชื่อจริง

- ดังต่อไปนี้

- สำหรับ

- รากฐาน

- สี่

- กรอบ

- ราคาเริ่มต้นที่

- ฟังก์ชัน

- การระดมทุน

- ที่ได้รับ

- สร้าง

- การสร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- GitHub

- ดี

- GPUs

- ยิ่งใหญ่

- การเจริญเติบโต

- จัดการ

- ฮาร์ดแวร์

- มี

- มี

- he

- ช่วย

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- เป็นเจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- อย่างไรก็ตาม

- HTML

- ที่ http

- HTTPS

- ร้อย

- หลายร้อยล้าน

- ในอุดมคติ

- ระบุ

- if

- แสดงให้เห็นถึง

- ภาพ

- การดำเนินงาน

- นำเข้า

- in

- รวมทั้ง

- ขาเข้า

- บ่งชี้ว่า

- อุตสาหกรรม

- ข้อมูล

- โครงสร้างพื้นฐาน

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- อินพุต

- ปัจจัยการผลิต

- ตัวอย่าง

- แทน

- รวม

- การผสานรวม

- ฉลาด

- อยากเรียนรู้

- อินเตอร์เฟซ

- เข้าไป

- แนะนำ

- การลงทุน

- IT

- ITS

- การเดินทาง

- jpg

- JSON

- เพียงแค่

- ที่รู้จักกัน

- ภาษา

- ใหญ่

- ความแอบแฝง

- ต่อมา

- เปิดตัว

- การเปิดตัว

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- น้อยที่สุด

- ห้องสมุด

- กดไลก์

- ขีด จำกัด

- รายการ

- โหลด

- ที่ตั้ง

- นาน

- ที่ต้องการหา

- Lot

- ความรัก

- ต่ำ

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- หลัก

- การบำรุงรักษา

- ทำ

- การทำ

- หลาย

- แม็กซ์

- สูงสุด

- หน่วยความจำ

- วิธี

- วิธีการ

- เมตริก

- ตัวชี้วัด

- ล้าน

- นาที

- ML

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- ชื่อ

- โดยธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- การนำทาง

- การเดินเรือ

- จำเป็นต้อง

- ใหม่

- ใหม่

- ถัดไป

- NLP

- ไม่

- สมุดบันทึก

- การประกาศ

- การแจ้งเตือน

- ตอนนี้

- จำนวน

- วัตถุ

- ตุลาคม

- of

- เสนอ

- การเสนอ

- เสนอ

- มักจะ

- on

- ONE

- เพียง

- โอเพนซอร์ส

- การดำเนินการ

- เพิ่มประสิทธิภาพ

- การเพิ่มประสิทธิภาพ

- ตัวเลือกเสริม (Option)

- Options

- or

- ของเรา

- ออก

- เอาท์พุต

- บานหน้าต่าง

- พารามิเตอร์

- ส่วนหนึ่ง

- โดยเฉพาะ

- พาร์ทเนอร์

- คาราคาซัง

- ดำเนินการ

- ดำเนินการ

- ภาพ

- สถานที่

- สถานที่

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- PoC

- นโยบาย

- ความนิยม

- เป็นไปได้

- โพสต์

- โพสต์

- ที่อาจเกิดขึ้น

- อำนาจ

- ที่มีประสิทธิภาพ

- ประยุกต์

- คำทำนาย

- Predictor

- ดูตัวอย่าง

- พิมพ์

- ส่วนตัว

- ปัญหา

- กระบวนการ

- กระบวนการ

- การประมวลผล

- ความคืบหน้า

- โครงการ

- พิสูจน์

- พิสูจน์แนวคิด

- พิสูจน์

- ให้

- ให้

- ให้

- การให้

- หลาม

- ไฟฉาย

- คำสั่ง

- คำถาม

- ยก

- พิสัย

- ตั้งแต่

- อ่าน

- พร้อม

- เรียลไทม์

- รับ

- ลด

- ลด

- ภูมิภาค

- ทะเบียน

- จำ

- เอาออก

- แทนที่

- ขอ

- การร้องขอ

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- นักวิจัย

- ทรัพยากร

- แหล่งข้อมูล

- คำตอบ

- ผล

- ผลสอบ

- กลับ

- รับคืน

- ทบทวน

- ปฏิวัติ

- การเสี่ยง

- ผลตอบแทนการลงทุน

- วิ่ง

- วิ่ง

- sagemaker

- ประหยัด

- ที่ปรับขนาดได้

- ขนาด

- ปรับ

- SDK

- ที่สอง

- วินาที

- ตนเอง

- ให้บริการ

- serverless

- บริการ

- บริการ

- ครั้ง ราคา

- ชุด

- สั้น

- แสดง

- แสดงให้เห็นว่า

- สำคัญ

- คล้ายคลึงกัน

- ง่าย

- ตั้งแต่

- เดียว

- สถานการณ์

- ขนาด

- ขนาด

- ของแข็ง

- ทางออก

- โซลูชัน

- แก้

- บาง

- แหล่งที่มา

- ผู้เชี่ยวชาญ

- ปั่น

- Stability

- มั่นคง

- เริ่มต้น

- ข้อความที่เริ่ม

- ที่เริ่มต้น

- สถานะ

- ขั้นตอน

- หยุด

- การเก็บรักษา

- จัดเก็บ

- ซื่อตรง

- เพรียวลม

- เป็นกอบเป็นกำ

- ความสำเร็จ

- ประสบความสำเร็จ

- อย่างเช่น

- สนับสนุน

- รองรับ

- แน่ใจ

- เกิน

- ระบบ

- เอา

- เป้า

- งาน

- เทคนิค

- เทคโนโลยี

- แม่แบบ

- เงื่อนไขการใช้บริการ

- การทดสอบ

- ขอบคุณ

- ที่

- พื้นที่

- รัฐ

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ดังนั้น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- ในปีนี้

- สาม

- ตลอด

- ตลอด

- เวลา

- ครั้ง

- ระยะเวลา

- ไปยัง

- ร่วมกัน

- โทเค็น

- เกินไป

- การติดตาม

- ผ่านการฝึกอบรม

- การแปลภาษา

- จริง

- ลอง

- ชนิด

- ui

- ภายใต้

- ความเข้าใจ

- มหาวิทยาลัย

- จนกระทั่ง

- เมื่อ

- us

- ใช้

- ผู้ใช้งาน

- ส่วนติดต่อผู้ใช้

- การใช้

- มักจะ

- ความคุ้มค่า

- ตัวแปร

- ต่างๆ

- กว้างใหญ่

- บริษัท ร่วมทุน

- ตรวจสอบ

- มาก

- ผ่านทาง

- วิสัยทัศน์

- รอ

- ที่รอ

- ปลุก

- ตื่นนอน

- ต้องการ

- คือ

- ทาง..

- วิธี

- we

- เว็บ

- บริการเว็บ

- เมื่อ

- ว่า

- ที่

- ในขณะที่

- WHO

- กว้าง

- ช่วงกว้าง

- จะ

- กับ

- ไม่มี

- วอน

- โรงงาน

- ทั่วโลก

- จะ

- เขียน

- ปี

- คุณ

- หนุ่มสาว

- ของคุณ

- ด้วยตัวคุณเอง

- ลมทะเล

- เป็นศูนย์