Підтримка робочих процесів машинного навчання (ML) у виробництві є складним завданням, оскільки воно вимагає створення конвеєрів безперервної інтеграції та безперервної доставки (CI/CD) для коду та моделей ML, версії моделі, моніторингу даних і дрейфу концепцій, перепідготовки моделі та керівництва процес затвердження, щоб переконатися, що нові версії моделі задовольняють вимогам продуктивності та відповідності.

У цій публікації ми описуємо, як створити робочий процес MLOps для пакетного висновку, який автоматизує планування завдань, моніторинг моделі, перенавчання та реєстрацію, а також обробку помилок і сповіщення за допомогою Amazon SageMaker, Amazon EventBridge, AWS Lambda, Служба простих сповіщень Amazon (Amazon SNS), HashiCorp Terraform і GitLab CI/CD. Представлений робочий процес MLOps надає багаторазовий шаблон для керування життєвим циклом ML за допомогою автоматизації, моніторингу, можливості аудиту та масштабованості, тим самим зменшуючи складність і витрати на підтримку робочих навантажень пакетного висновку у виробництві.

Огляд рішення

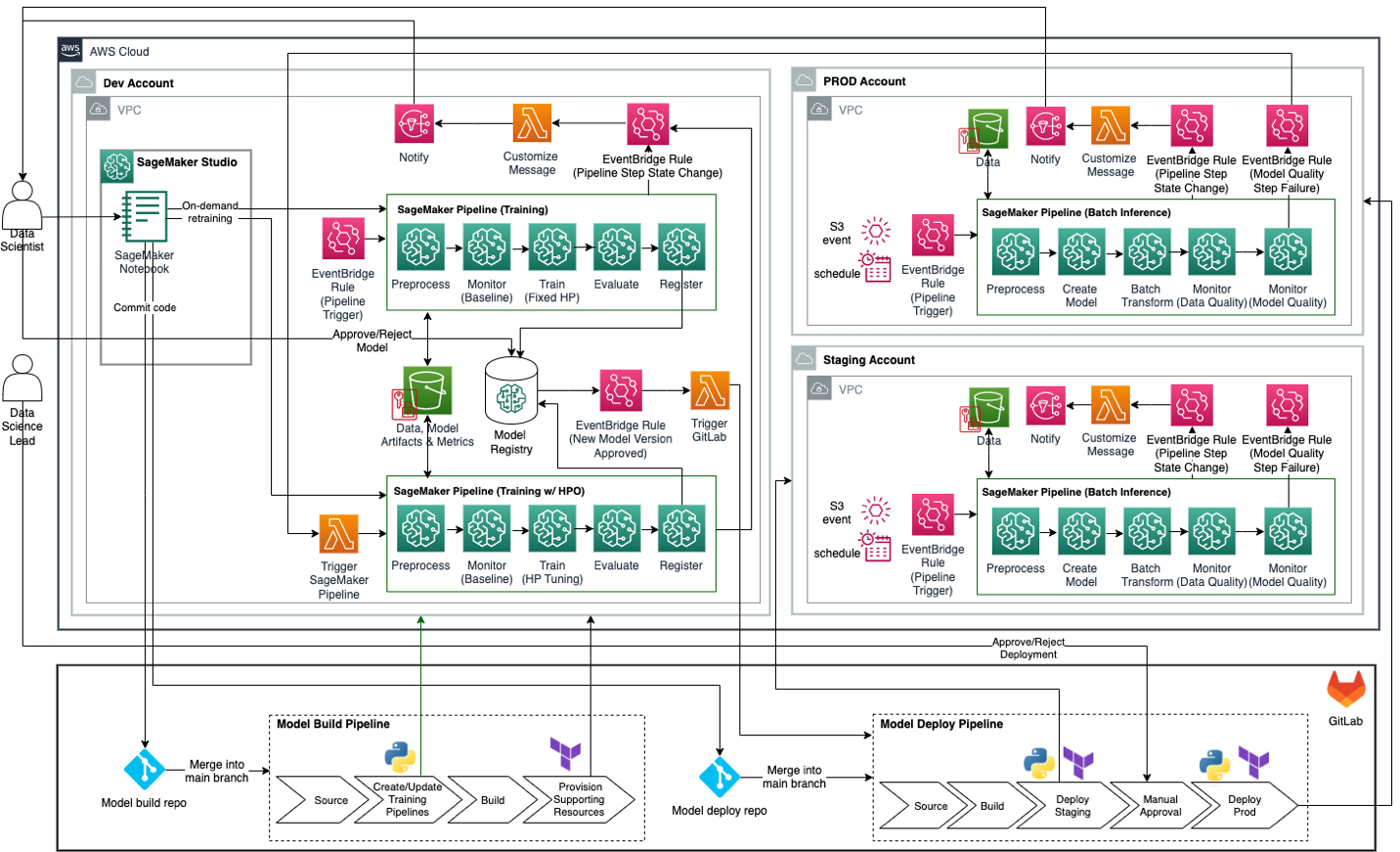

Наступний малюнок ілюструє запропоновану цільову архітектуру MLOps для корпоративного пакетного висновку для організацій, які використовують GitLab CI/CD та інфраструктуру Terraform як код (IaC) у поєднанні з інструментами та службами AWS. GitLab CI/CD виступає макрооркестровником, керуючим model build та model deploy конвеєрів, які включають пошук, будівництво та забезпечення Трубопроводи Amazon SageMaker і допоміжні ресурси за допомогою SageMaker Python SDK і Terraform. SDK SageMaker Python використовується для створення або оновлення конвеєрів SageMaker для навчання, навчання з оптимізацією гіперпараметрів (HPO) і пакетного висновку. Terraform використовується для створення додаткових ресурсів, таких як правила EventBridge, функції Lambda та теми SNS для моніторингу конвеєрів SageMaker і надсилання сповіщень (наприклад, коли крок конвеєра не вдається або виконується успішно). SageMaker Pipelines слугує оркестром для навчання моделі ML і робочих процесів висновків.

Цей дизайн архітектури представляє стратегію з декількома обліковими записами, де моделі ML будуються, навчаються та реєструються в центральному реєстрі моделей в обліковому записі розробки наукових даних (який має більше елементів керування, ніж типовий обліковий запис розробки програм). Потім конвеєри висновків розгортаються в проміжних і робочих облікових записах за допомогою автоматизації за допомогою інструментів DevOps, таких як GitLab CI/CD. Реєстр центральної моделі можна додатково розмістити в обліковому записі спільних служб. Відноситься до Операційна модель для найкращих практик щодо стратегії кількох облікових записів для ML.

У наступних підрозділах ми детально обговорюємо різні аспекти проектування архітектури.

Інфраструктура як код

IaC пропонує спосіб керування ІТ-інфраструктурою за допомогою машинозчитуваних файлів, забезпечуючи ефективний контроль версій. У цій публікації та супровідному прикладі коду ми демонструємо, як використовувати HashiCorp Terraform з GitLab CI/CD для ефективного керування ресурсами AWS. Цей підхід підкреслює ключову перевагу IAC, пропонуючи прозорий і повторюваний процес управління ІТ-інфраструктурою.

Зразкове навчання та перепідготовка

У цій конструкції навчальний конвеєр SageMaker працює за розкладом (через EventBridge) або на основі Служба простого зберігання Amazon (Amazon S3) тригер події (наприклад, коли файл тригера або нові навчальні дані, у випадку одного об’єкта навчальних даних, розміщено в Amazon S3) для регулярного повторного калібрування моделі новими даними. Цей конвеєр не вносить структурних або суттєвих змін у модель, оскільки він використовує фіксовані гіперпараметри, які були затверджені під час процесу перегляду корпоративної моделі.

Навчальний конвеєр реєструє щойно навчену версію моделі в Реєстр моделей Amazon SageMaker якщо модель перевищує попередньо визначений поріг ефективності моделі (наприклад, RMSE для регресії та бал F1 для класифікації). Коли нова версія моделі реєструється в реєстрі моделей, вона запускає сповіщення відповідального спеціаліста з даних через Amazon SNS. Потім фахівець з даних повинен переглянути та вручну затвердити останню версію моделі в Студія Amazon SageMaker Інтерфейс користувача або через виклик API за допомогою Інтерфейс командного рядка AWS (AWS CLI) або AWS SDK для Python (Boto3), перш ніж нову версію моделі можна буде використовувати для висновків.

Конвеєр навчання SageMaker і допоміжні ресурси створені GitLab model build конвеєра, або через ручний запуск конвеєра GitLab, або автоматично, коли код об’єднується в main відділення model build Git репозиторій.

Пакетний висновок

Конвеєр пакетного висновку SageMaker працює за розкладом (через EventBridge) або також на основі тригера події S3. Конвеєр пакетного висновку автоматично отримує останню затверджену версію моделі з реєстру моделей і використовує її для висновку. Конвеєр пакетного висновку включає кроки для перевірки якості даних порівняно з базовою лінією, створеною навчальним конвеєром, а також якість моделі (продуктивність моделі), якщо доступні основні мітки істинності.

Якщо конвеєр пакетного висновку виявить проблеми з якістю даних, він повідомить відповідального спеціаліста з даних через Amazon SNS. Якщо він виявить проблеми з якістю моделі (наприклад, RMSE перевищує попередньо визначене порогове значення), крок конвеєра для перевірки якості моделі не вдасться, що, у свою чергу, ініціює подію EventBridge для початку навчання з конвеєром HPO.

Конвеєр пакетного висновку SageMaker і його допоміжні ресурси створені GitLab model deploy конвеєра, або через ручний запуск конвеєра GitLab, або автоматично, коли код об’єднується в main відділення model deploy Git репозиторій.

Тюнінг і перенастроювання моделі

Навчання SageMaker із конвеєром HPO запускається, коли етап перевірки якості моделі конвеєра пакетного висновку не вдається. Перевірка якості моделі виконується шляхом порівняння прогнозів моделі з фактичними базовими мітками істинності. Якщо метрика якості моделі (наприклад, RMSE для регресії та оцінка F1 для класифікації) не відповідає заздалегідь визначеному критерію, етап перевірки якості моделі позначається як невдалий. Навчання SageMaker з конвеєром HPO також може бути запущено вручну (в інтерфейсі користувача SageMaker Studio або через виклик API за допомогою AWS CLI або SageMaker Python SDK), якщо це необхідно. Оскільки гіперпараметри моделі змінюються, відповідальний фахівець з даних повинен отримати схвалення від комісії з перевірки моделей підприємства, перш ніж нову версію моделі можна буде затвердити в реєстрі моделей.

Навчання SageMaker з конвеєром HPO та допоміжні ресурси створено GitLab model build конвеєра, або через ручний запуск конвеєра GitLab, або автоматично, коли код об’єднується в main відділення model build Git репозиторій.

Моніторинг моделі

Статистичні дані та базові лінії обмежень генеруються як частина навчання та навчання конвеєрам HPO. Вони зберігаються в Amazon S3 і також реєструються разом із навченою моделлю в реєстрі моделей, якщо модель пройшла оцінку. Запропонована архітектура для конвеєра пакетного висновку використовує Монітор моделі Amazon SageMaker для перевірки якості даних під час використання настроюваних Обробка Amazon SageMaker етапи перевірки якості моделі. Цей дизайн роз’єднує перевірки якості даних і моделі, що, у свою чергу, дозволяє надсилати попереджувальні сповіщення, лише коли виявлено дрейф даних; і запускати навчання за допомогою конвеєра HPO, коли виявлено порушення якості моделі.

Затвердження моделі

Після того як нова навчена модель зареєстрована в реєстрі моделей, відповідальний фахівець з даних отримує сповіщення. Якщо модель було навчено конвеєром навчання (повторне калібрування з новими навчальними даними під час фіксації гіперпараметрів), немає потреби в схваленні комісії з перевірки моделей підприємства. Спеціаліст з обробки даних може самостійно переглянути та затвердити нову версію моделі. З іншого боку, якщо модель була навчена під час навчання з конвеєром HPO (повторне налаштування шляхом зміни гіперпараметрів), нову версію моделі потрібно пройти через процес перевірки підприємства, перш ніж її можна буде використовувати для висновків у виробництві. Після завершення процесу перегляду спеціаліст із даних може продовжити та затвердити нову версію моделі в реєстрі моделей. Зміна статусу пакета моделі на Approved запустить функцію Lambda через EventBridge, яка, у свою чергу, запустить GitLab model deploy конвеєр через виклик API. Це автоматично оновить конвеєр пакетного висновку SageMaker для використання останньої схваленої версії моделі для висновку.

Існує два основних способи схвалити або відхилити нову версію моделі в реєстрі моделей: за допомогою AWS SDK для Python (Boto3) або з інтерфейсу SageMaker Studio. За замовчуванням налаштовано як конвеєр навчання, так і конвеєр навчання з HPO ModelApprovalStatus до PendingManualApproval. Відповідальний фахівець із даних може оновити статус схвалення для моделі, зателефонувавши на номер update_model_package API від Boto3. Відноситься до Оновіть статус затвердження моделі щоб дізнатися більше про оновлення статусу схвалення моделі через інтерфейс SageMaker Studio.

Конструкція введення/виведення даних

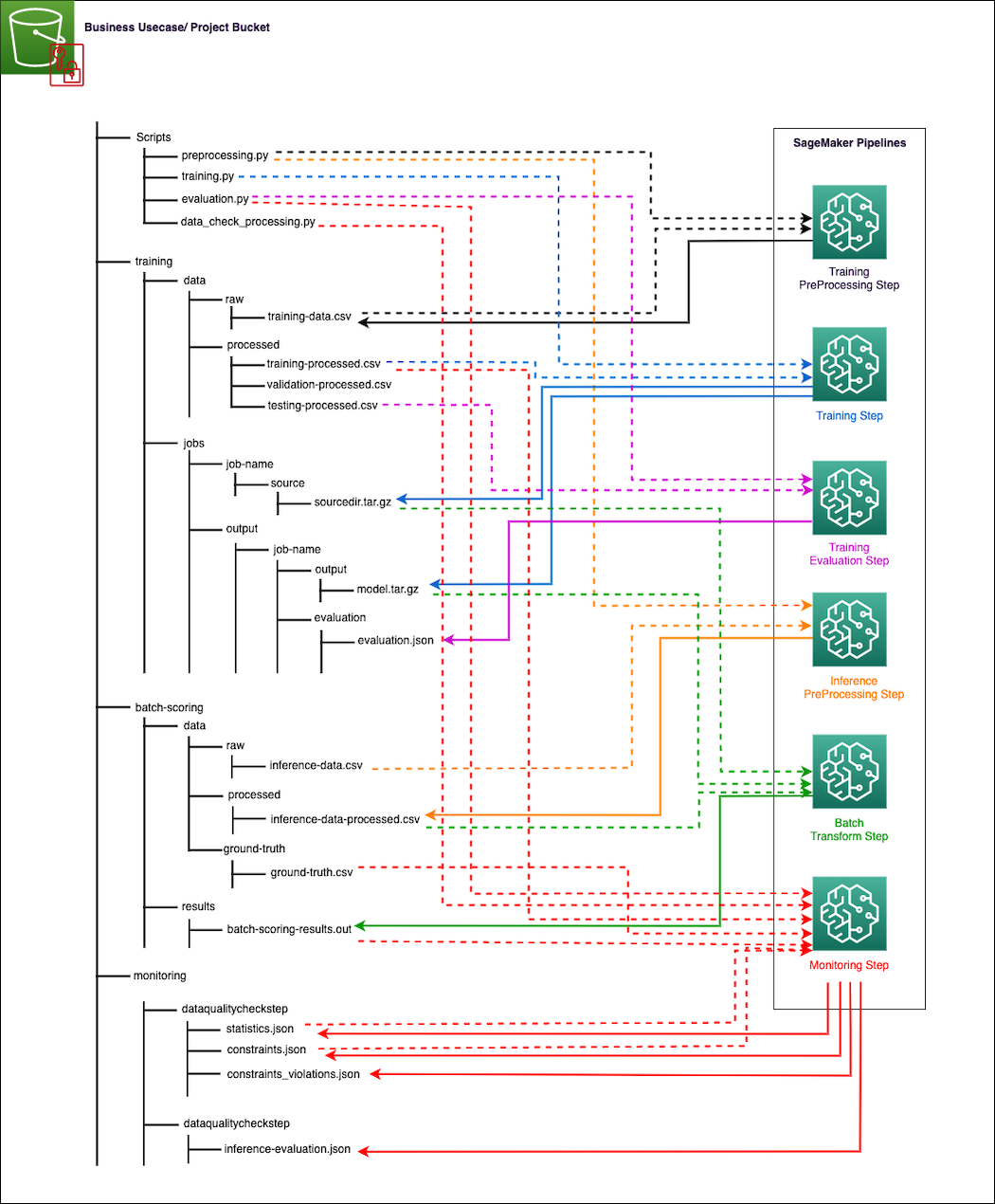

SageMaker безпосередньо взаємодіє з Amazon S3 для зчитування вхідних даних і збереження результатів окремих кроків у конвеєрах навчання та висновку. На наступній діаграмі показано, як різні сценарії Python, необроблені та оброблені навчальні дані, необроблені та оброблені дані висновків, результати висновків і базові мітки істинності (якщо вони доступні для моніторингу якості моделі), артефакти моделі, метрики оцінки навчання та висновку (моніторинг якості моделі), а також базові показники якості даних і звіти про порушення (для моніторингу якості даних) можна організувати в сегменті S3. Напрямок стрілок на діаграмі вказує на те, які файли є вхідними або вихідними з відповідних кроків у конвеєрах SageMaker. Стрілки позначено кольором залежно від типу кроку трубопроводу, щоб їх було легше читати. Конвеєр автоматично завантажуватиме сценарії Python зі сховища GitLab і зберігатиме вихідні файли або артефакти моделі з кожного кроку у відповідному шляху S3.

Інженер даних відповідає за наступне:

- Завантаження позначених навчальних даних у відповідний шлях в Amazon S3. Це включає регулярне додавання нових навчальних даних, щоб гарантувати, що конвеєр навчання та навчання за допомогою конвеєра HPO мають доступ до останніх даних навчання для перепідготовки та переналаштування моделі відповідно.

- Завантаження вхідних даних для висновку у відповідний шлях у сегменті S3 перед запланованим запуском конвеєра висновку.

- Завантаження наземних міток істинності у відповідний шлях S3 для моніторингу якості моделі.

Спеціаліст з даних відповідає за наступне:

- Підготовка базових міток істинності та надання їх групі розробки даних для завантаження в Amazon S3.

- Проведення версій моделі, навчених під час навчання з конвеєром HPO, через процес перевірки підприємства та отримання необхідних схвалень.

- Ручне затвердження або відхилення нових навчених версій моделі в реєстрі моделей.

- Схвалення виробничого шлюзу для конвеєра висновків і допоміжних ресурсів, які будуть просуватися до виробництва.

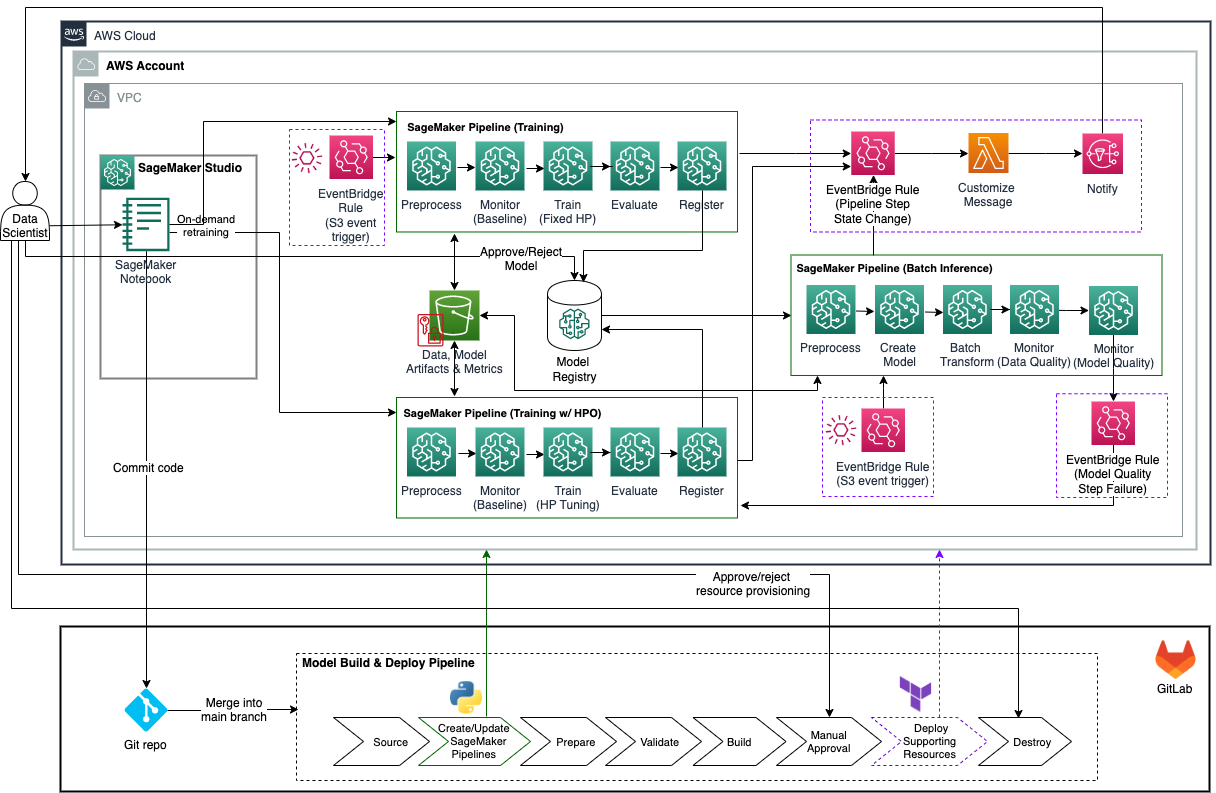

Зразок коду

У цьому розділі ми представляємо зразок коду для операцій пакетного висновку з налаштуванням одного облікового запису, як показано на наведеній нижче схемі архітектури. Зразок коду можна знайти в GitHub сховище, і може слугувати відправною точкою для пакетного висновку з моніторингом моделі та автоматичним перенавчанням за допомогою воріт якості, які часто потрібні підприємствам. Зразок коду відрізняється від цільової архітектури такими способами:

- Він використовує єдиний обліковий запис AWS для створення та розгортання моделі ML і допоміжних ресурсів. Відноситься до Організація середовища AWS за допомогою кількох облікових записів для вказівок щодо налаштування кількох облікових записів на AWS.

- Він використовує єдиний конвеєр GitLab CI/CD для створення та розгортання моделі ML і допоміжних ресурсів.

- Коли нова версія моделі навчена та схвалена, конвеєр GitLab CI/CD не запускається автоматично, і його потрібно запустити вручну відповідальним спеціалістом з даних, щоб оновити конвеєр пакетного висновку SageMaker останньою затвердженою версією моделі.

- Він підтримує лише тригери на основі подій S3 для запуску конвеєрів навчання та висновків SageMaker.

Передумови

Перед розгортанням цього рішення ви повинні мати такі передумови:

- Обліковий запис AWS

- Студія SageMaker

- Роль виконання SageMaker із читанням/записом і Amazon S3 Служба управління ключами AWS (AWS KMS) дозволи на шифрування/дешифрування

- Відро S3 для зберігання даних, сценаріїв і артефактів моделі

- Terraform версія 0.13.5 або новіша

- GitLab із робочим бігуном Docker для запуску конвеєрів

- AWS CLI

- jq

- розстебнути блискавку

- Python3 (Python 3.7 або новішої версії) і наступні пакети Python:

- boto3

- мудрець

- панди

- pyyaml

Структура репозитарію

Команда GitHub сховище містить наступні каталоги та файли:

/code/lambda_function/– Цей каталог містить файл Python для функції Lambda, яка готує та надсилає сповіщення (через Amazon SNS) про зміни стану конвеєрів SageMaker./data/– Цей каталог містить файли необроблених даних (навчання, висновки та базові істинні дані)/env_files/– Цей каталог містить файл вхідних змінних Terraform/pipeline_scripts/– Цей каталог містить три сценарії Python для створення й оновлення навчання, висновків і навчання за допомогою конвеєрів HPO SageMaker, а також файли конфігурації для визначення параметрів кожного конвеєра./scripts/– Цей каталог містить додаткові сценарії Python (такі як попередня обробка та оцінка), на які посилається навчання, висновок і навчання за допомогою конвеєрів HPO.gitlab-ci.yml– Цей файл визначає конфігурацію конвеєра GitLab CI/CD/events.tf– Цей файл визначає ресурси EventBridge/lambda.tf– Цей файл визначає функцію лямбда-повідомлення та пов’язану з нею функцію Управління ідентифікацією та доступом AWS (IAM) ресурси/main.tf– Цей файл визначає джерела даних Terraform і локальні змінні/sns.tf– Цей файл визначає ресурси Amazon SNS/tags.json– Цей файл JSON дозволяє оголошувати спеціальні пари ключ-значення та додавати їх до ресурсів Terraform за допомогою локальної змінної/variables.tf– Цей файл оголошує всі змінні Terraform

Змінні та конфігурація

У наведеній нижче таблиці показано змінні, які використовуються для параметризації цього рішення. Зверніться до ./env_files/dev_env.tfvars файл для більш детальної інформації.

| ІМ'Я | Опис |

bucket_name |

Відро S3, яке використовується для зберігання даних, сценаріїв і артефактів моделі |

bucket_prefix |

Префікс S3 для проекту ML |

bucket_train_prefix |

Префікс S3 для навчальних даних |

bucket_inf_prefix |

Префікс S3 для даних висновку |

notification_function_name |

Назва функції Lambda, яка готує та надсилає сповіщення про зміни стану конвеєрів SageMaker |

custom_notification_config |

Конфігурація для налаштування сповіщень для певних кроків конвеєра SageMaker, коли виявлено певний стан конвеєра |

email_recipient |

Список адрес електронної пошти для отримання сповіщень про зміну стану конвеєрів SageMaker |

pipeline_inf |

Назва конвеєра виведення SageMaker |

pipeline_train |

Назва конвеєра навчання SageMaker |

pipeline_trainwhpo |

Назва навчання SageMaker з конвеєром HPO |

recreate_pipelines |

Якщо встановлено значення true, три існуючі конвеєри SageMaker (навчання, висновок, навчання з HPO) буде видалено, а нові будуть створені під час запуску GitLab CI/CD |

model_package_group_name |

Назва групи пакетів моделі |

accuracy_mse_threshold |

Максимальне значення MSE перед вимогою оновлення моделі |

role_arn |

Роль IAM ARN ролі виконання конвеєра SageMaker |

kms_key |

ARN ключа KMS для шифрування Amazon S3 і SageMaker |

subnet_id |

Ідентифікатор підмережі для конфігурації мережі SageMaker |

sg_id |

Ідентифікатор групи безпеки для конфігурації мережі SageMaker |

upload_training_data |

Якщо встановлено значення true, навчальні дані буде завантажено в Amazon S3, і ця операція завантаження запустить конвеєр навчання |

upload_inference_data |

Якщо встановлено значення true, дані висновків буде завантажено в Amazon S3, і ця операція завантаження запустить конвеєр висновків |

user_id |

Ідентифікатор працівника користувача SageMaker, який додається як тег до ресурсів SageMaker |

Розгорніть рішення

Щоб розгорнути рішення в обліковому записі AWS, виконайте наведені нижче дії.

- Клонуйте репозиторій GitHub у свій робочий каталог.

- Перегляньте та змініть конфігурацію конвеєра GitLab CI/CD відповідно до вашого середовища. Конфігурація вказана в

./gitlab-ci.ymlфайлу. - Зверніться до файлу README, щоб оновити загальні змінні рішення в

./env_files/dev_env.tfvarsфайл. Цей файл містить змінні як для сценаріїв Python, так і для автоматизації Terraform.- Перевірте додаткові параметри SageMaker Pipelines, які визначено у файлах YAML нижче

./batch_scoring_pipeline/pipeline_scripts/. Перегляньте та за потреби оновіть параметри.

- Перевірте додаткові параметри SageMaker Pipelines, які визначено у файлах YAML нижче

- Перегляньте сценарії створення конвеєра SageMaker у

./pipeline_scripts/а також сценарії, на які вони посилаються в./scripts/папку. Приклади сценаріїв, надані в сховищі GitHub, засновані на Набір даних Abalone. Якщо ви збираєтеся використовувати інший набір даних, переконайтеся, що ви оновили сценарії відповідно до вашої конкретної проблеми. - Помістіть файли даних у

./data/папку з використанням наведеної нижче угоди про іменування. Якщо ви використовуєте набір даних Abalone разом із наданими прикладами сценаріїв, переконайтеся, що файли даних без заголовків, навчальні дані містять як незалежні, так і цільові змінні зі збереженням початкового порядку стовпців, дані висновку містять лише незалежні змінні, а основна правда файл містить лише цільову змінну.training-data.csvinference-data.csvground-truth.csv

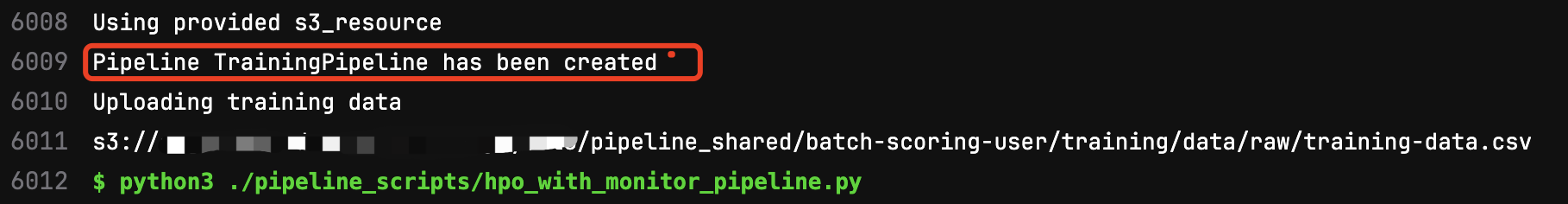

- Зафіксуйте та надішліть код до репозиторію, щоб ініціювати конвеєр GitLab CI/CD (перший запуск). Зауважте, що перший запуск конвеєра буде невдалим

pipelineстадії, оскільки ще немає схваленої версії моделі для використання сценарієм конвеєра висновку. Перегляньте журнал кроків і перевірте новий конвеєр SageMaker під назвоюTrainingPipelineуспішно створено.

-

- Відкрийте інтерфейс SageMaker Studio, потім перегляньте та запустіть навчальний конвеєр.

- Після успішного запуску конвеєра навчання підтвердьте зареєстровану версію моделі в реєстрі моделей, а потім повторно запустіть весь конвеєр GitLab CI/CD.

- Перегляньте результати плану Terraform у

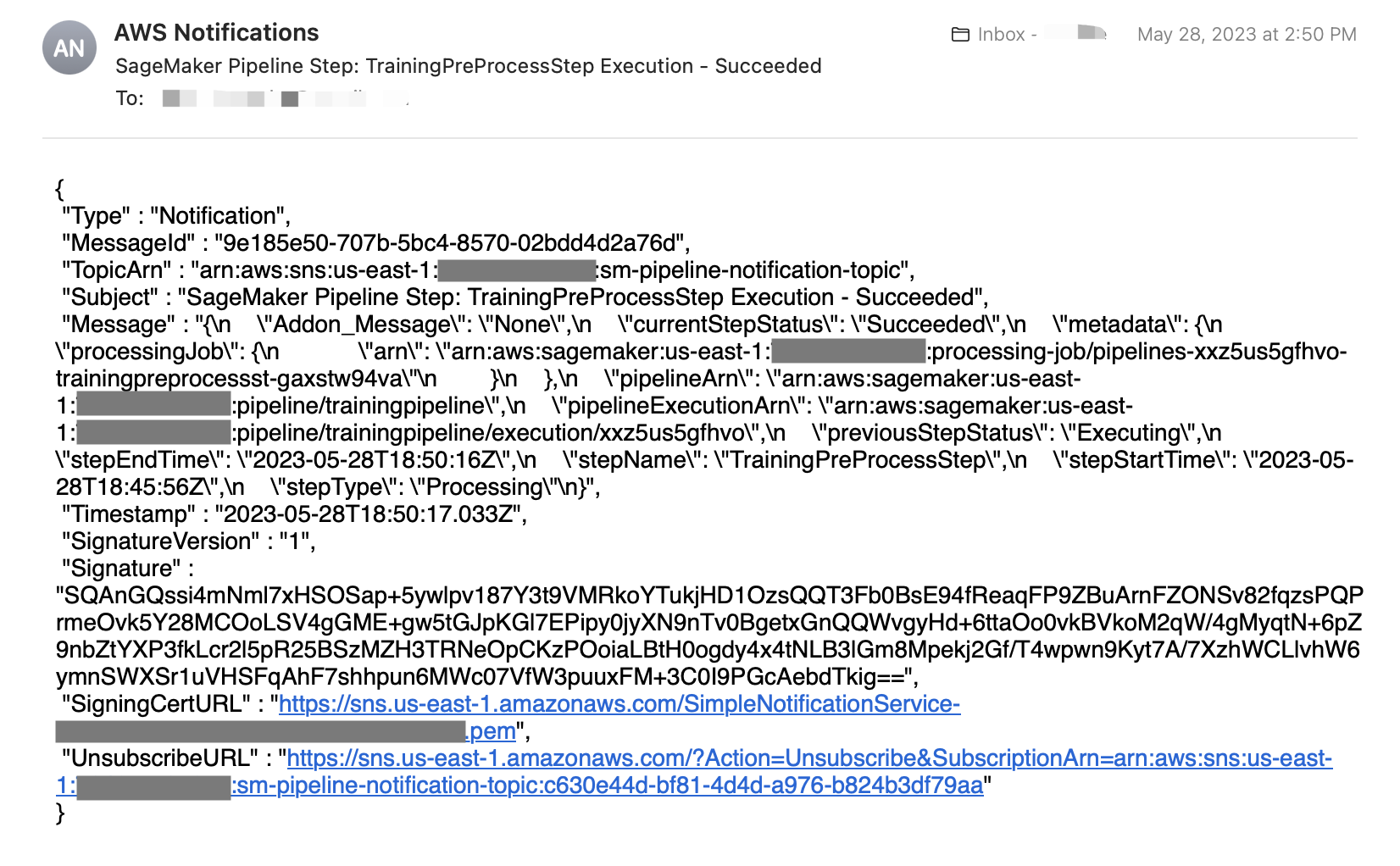

buildетап. Затвердити посібникapplyу конвеєрі GitLab CI/CD, щоб відновити роботу конвеєра та дозволити Terraform створити ресурси моніторингу та сповіщень у вашому обліковому записі AWS. - Нарешті, перегляньте стан виконання та виведення конвеєрів SageMaker в інтерфейсі користувача SageMaker Studio та перевірте свою електронну пошту на наявність сповіщень, як показано на наступному знімку екрана. Тіло повідомлення за замовчуванням має формат JSON.

Конвеєри SageMaker

У цьому розділі ми описуємо три конвеєри SageMaker у робочому процесі MLOps.

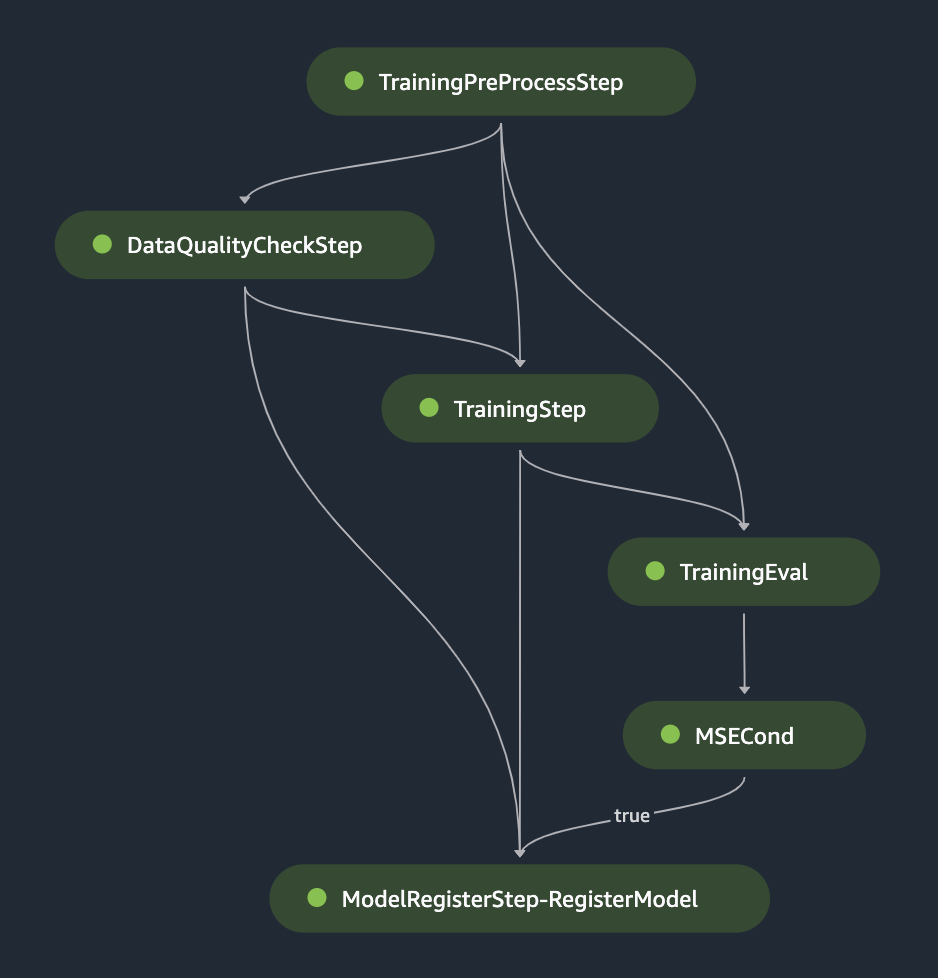

Навчальний конвеєр

Конвеєр навчання складається з таких кроків:

- Етап попередньої обробки, включаючи перетворення ознак і кодування

- Етап перевірки якості даних для генерації статистики даних і базового рівня обмежень за допомогою навчальних даних

- Тренувальний крок

- Етап оцінки навчання

- Крок умови, щоб перевірити, чи навчена модель відповідає попередньо визначеному порогу продуктивності

- Крок реєстрації моделі для реєстрації нової навченої моделі в реєстрі моделей, якщо навчена модель відповідає необхідному порогу продуктивності

Обидва skip_check_data_quality та register_new_baseline_data_quality параметри встановлені на True у навчальному конвеєрі. Ці параметри вказують конвеєру пропустити перевірку якості даних і просто створити та зареєструвати нову статистику даних або базові лінії обмежень, використовуючи навчальні дані. На наступному малюнку показано успішний запуск навчального конвеєра.

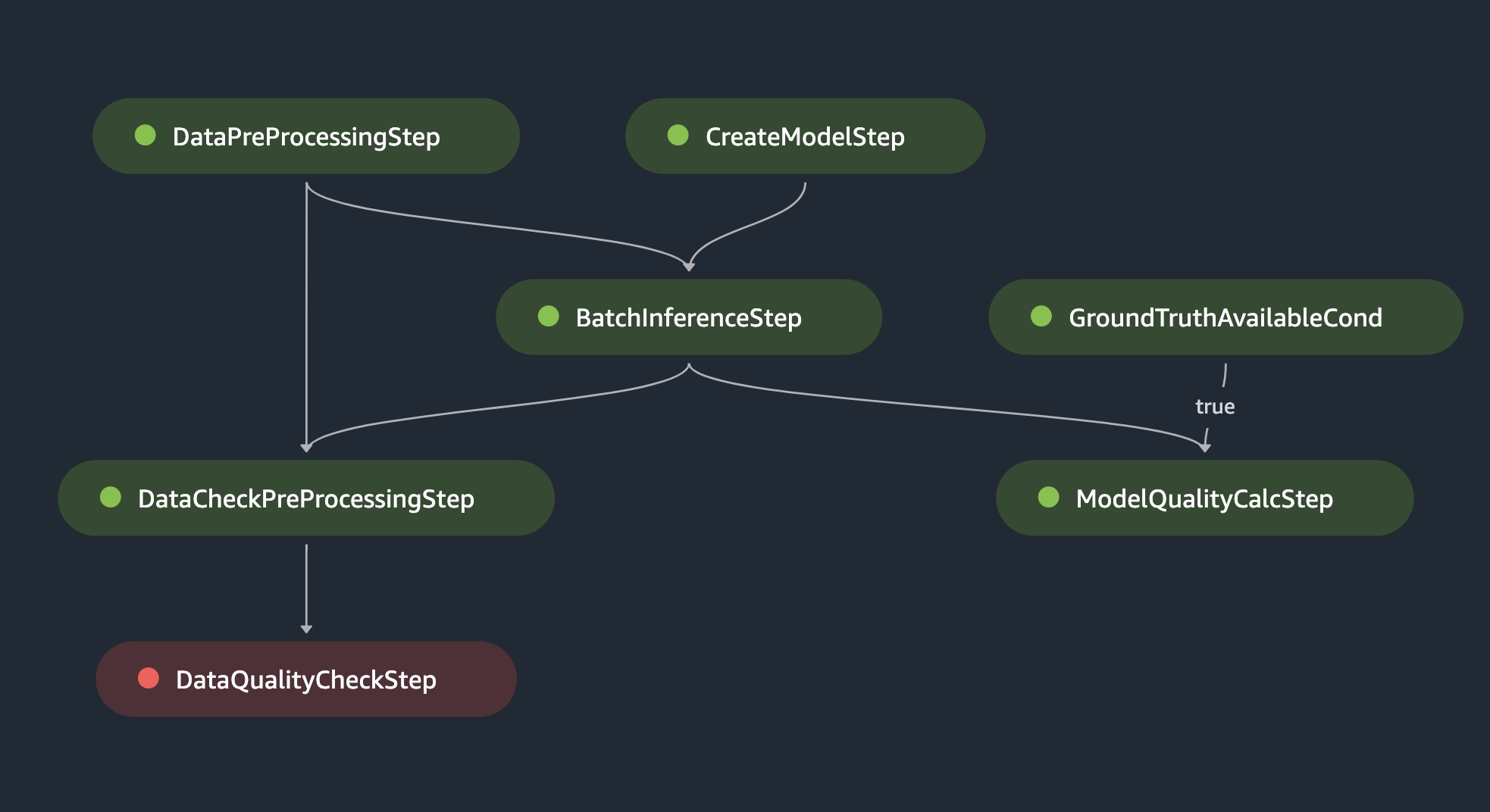

Конвеєр пакетного висновку

Конвеєр пакетного висновку складається з таких кроків:

- Створення моделі з останньої затвердженої версії моделі в реєстрі моделей

- Етап попередньої обробки, включаючи перетворення ознак і кодування

- Крок пакетного висновку

- Етап попередньої обробки перевірки якості даних, який створює новий файл CSV, що містить як вхідні дані, так і прогнози моделі для використання для перевірки якості даних

- Етап перевірки якості даних, який перевіряє вхідні дані на базову статистику та обмеження, пов’язані із зареєстрованою моделлю

- Крок умови, щоб перевірити, чи доступні наземні істинні дані. Якщо наземні дані доступні, буде виконано етап перевірки якості моделі

- Етап розрахунку якості моделі, який обчислює продуктивність моделі на основі базових міток істинності

Обидва skip_check_data_quality та register_new_baseline_data_quality параметри встановлені на False у конвеєрі висновку. Ці параметри вказують конвеєру виконати перевірку якості даних, використовуючи статистику даних або базову лінію обмежень, пов’язану із зареєстрованою моделлю (supplied_baseline_statistics_data_quality та supplied_baseline_constraints_data_quality) і пропустіть створення або реєстрацію нових статистичних даних і базових ліній обмежень під час висновку. На наступному малюнку показано запуск конвеєра пакетного висновку, де етап перевірки якості даних не вдався через низьку продуктивність моделі на даних висновку. У цьому конкретному випадку навчання з конвеєром HPO буде запущено автоматично для точного налаштування моделі.

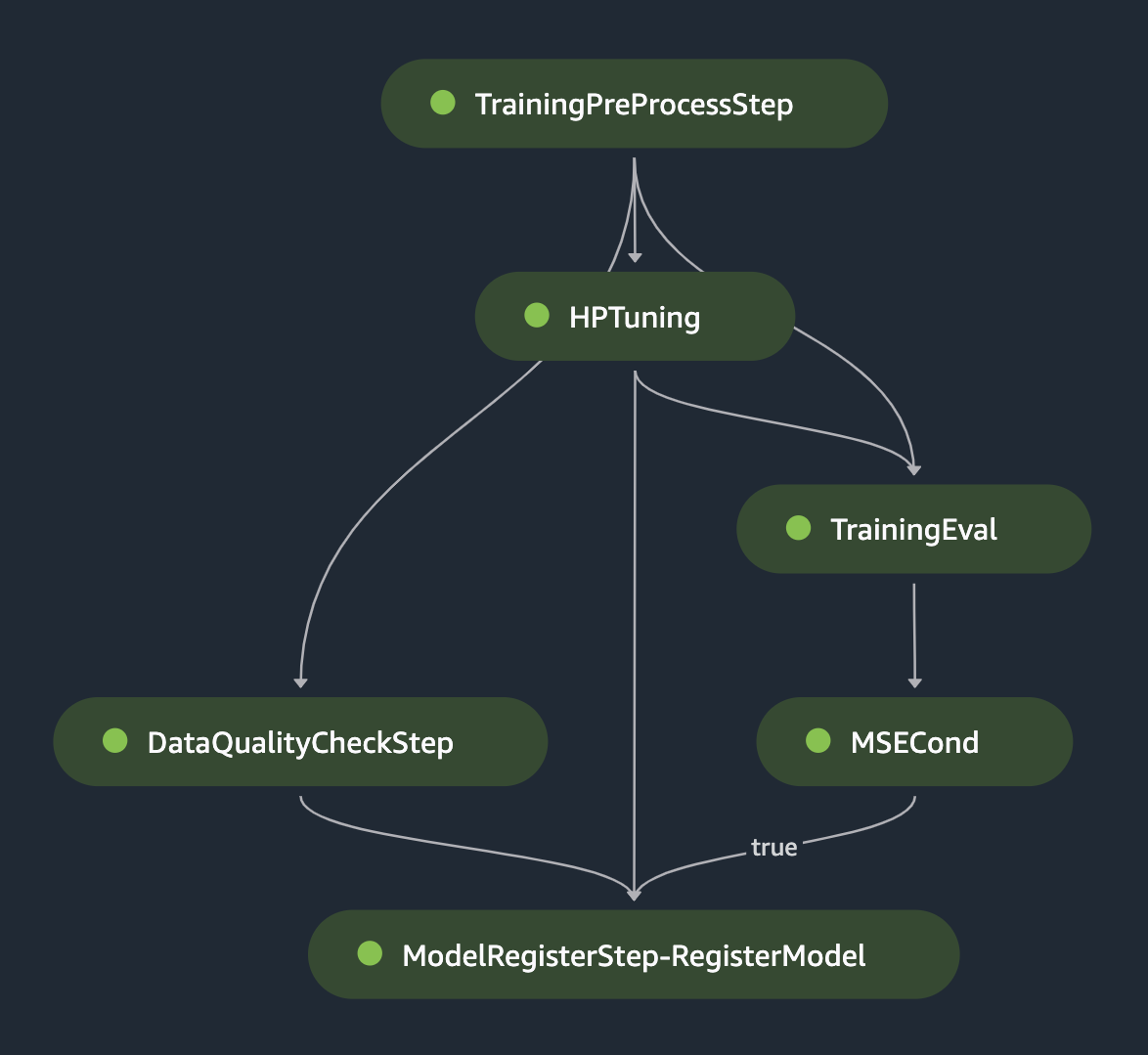

Навчання конвеєру HPO

Навчання конвеєру HPO складається з наступних кроків:

- Етап попередньої обробки (перетворення ознак і кодування)

- Етап перевірки якості даних для генерації статистики даних і базового рівня обмежень за допомогою навчальних даних

- Крок налаштування гіперпараметрів

- Етап оцінки навчання

- Крок умови, щоб перевірити, чи навчена модель відповідає попередньо визначеному порогу точності

- Етап реєстрації моделі, якщо найкраще навчена модель відповідає необхідному порогу точності

Обидва skip_check_data_quality та register_new_baseline_data_quality параметри встановлені на True у навчанні з конвеєром HPO. На наступному малюнку зображено успішний запуск навчання з конвеєром HPO.

Прибирати

Виконайте наступні кроки, щоб очистити свої ресурси:

- Найняти

destroyу конвеєрі GitLab CI/CD, щоб усунути всі ресурси, надані Terraform. - Використовуйте AWS CLI, щоб список та видаляти будь-які інші конвеєри, створені сценаріями Python.

- За бажанням видаліть інші ресурси AWS, як-от сегмент S3 або роль IAM, створені поза конвеєром CI/CD.

Висновок

У цій публікації ми продемонстрували, як підприємства можуть створювати робочі процеси MLOps для своїх завдань пакетного висновку за допомогою Amazon SageMaker, Amazon EventBridge, AWS Lambda, Amazon SNS, HashiCorp Terraform і GitLab CI/CD. Представлений робочий процес автоматизує моніторинг даних і моделей, перепідготовку моделей, а також пакетне виконання завдань, версії коду та надання інфраструктури. Це може призвести до значного зниження складності та витрат на підтримку завдань пакетного висновку у виробництві. Щоб отримати додаткові відомості про деталі реалізації, перегляньте GitHub репо.

Про авторів

Хасан Шоджаї є старшим спеціалістом із обробки даних у AWS Professional Services, де він допомагає клієнтам із різних галузей, таких як спорт, страхування та фінансові послуги, вирішувати їхні бізнес-завдання за допомогою великих даних, машинного навчання та хмарних технологій. До цієї посади Хасан керував кількома ініціативами з розробки нових методів моделювання на основі фізики та даних для провідних енергетичних компаній. Поза роботою Хасан захоплюється книгами, походами, фотографією та історією.

Хасан Шоджаї є старшим спеціалістом із обробки даних у AWS Professional Services, де він допомагає клієнтам із різних галузей, таких як спорт, страхування та фінансові послуги, вирішувати їхні бізнес-завдання за допомогою великих даних, машинного навчання та хмарних технологій. До цієї посади Хасан керував кількома ініціативами з розробки нових методів моделювання на основі фізики та даних для провідних енергетичних компаній. Поза роботою Хасан захоплюється книгами, походами, фотографією та історією.

Веньсінь Лю є старшим архітектором хмарної інфраструктури. Wenxin консультує корпоративні компанії щодо того, як прискорити впровадження хмари, і підтримує їхні інновації в хмарі. Він любитель домашніх тварин і захоплений сноубордом і подорожами.

Веньсінь Лю є старшим архітектором хмарної інфраструктури. Wenxin консультує корпоративні компанії щодо того, як прискорити впровадження хмари, і підтримує їхні інновації в хмарі. Він любитель домашніх тварин і захоплений сноубордом і подорожами.

Вівек Лакшманан є інженером машинного навчання в Amazon. Він має ступінь магістра з програмної інженерії зі спеціалізацією Data Science і кілька років досвіду MLE. Вівек у захваті від застосування передових технологій і створення рішень AI/ML для клієнтів у хмарі. Він захоплюється статистикою, НЛП та можливістю пояснення моделей у AI/ML. У вільний час він любить грати в крикет і подорожувати.

Вівек Лакшманан є інженером машинного навчання в Amazon. Він має ступінь магістра з програмної інженерії зі спеціалізацією Data Science і кілька років досвіду MLE. Вівек у захваті від застосування передових технологій і створення рішень AI/ML для клієнтів у хмарі. Він захоплюється статистикою, НЛП та можливістю пояснення моделей у AI/ML. У вільний час він любить грати в крикет і подорожувати.

Енді Краккіоло є архітектором хмарної інфраструктури. Маючи понад 15 років роботи в ІТ-інфраструктурі, Енді є досвідченим ІТ-фахівцем, орієнтованим на результати. Окрім оптимізації ІТ-інфраструктури, операцій і автоматизації, Енді має підтверджений досвід аналізу ІТ-операцій, виявлення невідповідностей і впровадження вдосконалень процесів, які підвищують ефективність, зменшують витрати та збільшують прибуток.

Енді Краккіоло є архітектором хмарної інфраструктури. Маючи понад 15 років роботи в ІТ-інфраструктурі, Енді є досвідченим ІТ-фахівцем, орієнтованим на результати. Окрім оптимізації ІТ-інфраструктури, операцій і автоматизації, Енді має підтверджений досвід аналізу ІТ-операцій, виявлення невідповідностей і впровадження вдосконалень процесів, які підвищують ефективність, зменшують витрати та збільшують прибуток.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- ChartPrime. Розвивайте свою торгову гру за допомогою ChartPrime. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/mlops-for-batch-inference-with-model-monitoring-and-retraining-using-amazon-sagemaker-hashicorp-terraform-and-gitlab-ci-cd/

- : має

- :є

- : ні

- :де

- $UP

- 100

- 125

- 13

- 15 роки

- 15%

- 26%

- 29

- 500

- 7

- a

- МЕНЮ

- прискорювати

- доступ

- виконано

- рахунки

- Рахунки

- точність

- через

- фактичний

- доданий

- додати

- доповнення

- Додатковий

- адреса

- Прийняття

- проти

- AI / ML

- ВСІ

- дозволяє

- по

- Також

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- Аналізуючи

- та

- та інфраструктури

- будь-який

- API

- додаток

- Розробка додатка

- Застосування

- підхід

- відповідний

- твердження

- погодження

- схвалювати

- затверджений

- архітектура

- ЕСТЬ

- AS

- аспекти

- асоційований

- At

- ревізійність

- авторизувати

- автоматичний

- автоматизує

- автоматичний

- автоматично

- Автоматизація

- доступний

- AWS

- AWS Lambda

- Професійні послуги AWS

- заснований

- Базова лінія

- BE

- оскільки

- було

- перед тим

- користь

- КРАЩЕ

- передового досвіду

- Великий

- Великий даних

- рада

- тіло

- книги

- обидва

- Філія

- Створюємо

- побудований

- бізнес

- by

- обчислює

- розрахунок

- call

- покликання

- CAN

- випадок

- центральний

- проблеми

- складні

- зміна

- Зміни

- заміна

- перевірка

- контроль

- Перевірки

- класифікація

- хмара

- прийняття хмари

- інфраструктура хмари

- код

- Колони

- Компанії

- порівняння

- повний

- складності

- дотримання

- складається

- концепція

- конфігурація

- зв'язок

- обмеження

- містить

- безперервний

- контроль

- управління

- Конвенція

- витрати

- може

- створювати

- створений

- створює

- створення

- створення

- крикет

- виготовлений на замовлення

- Клієнти

- передовий

- дані

- наука про дані

- вчений даних

- керовані даними

- заявляє

- дефолт

- певний

- Визначає

- Ступінь

- доставка

- демонструвати

- продемонстрований

- розгортання

- розгорнути

- розгортання

- описувати

- дизайн

- деталь

- деталі

- виявлено

- розвивати

- розробка

- різний

- напрям

- безпосередньо

- каталоги

- виявляє

- обговорювати

- Docker

- робить

- Ні

- два

- під час

- кожен

- легше

- фактично

- ефективність

- ефективний

- або

- усунутий

- Співробітник

- енергія

- інженер

- Машинобудування

- Удосконалення

- забезпечувати

- забезпечення

- підприємство

- підприємств

- Весь

- Навколишнє середовище

- помилка

- оцінка

- Event

- приклад

- перевищує

- збуджений

- виконання

- існуючий

- досвід

- f1

- FAIL

- не вдалося

- зазнає невдачі

- особливість

- Рисунок

- філе

- Файли

- фінансовий

- фінансові послуги

- Перший

- фіксованою

- після

- для

- формат

- знайдений

- від

- функція

- Функції

- Гейтс

- Загальне

- генерується

- породжує

- Git

- GitHub

- Go

- буде

- великий

- Земля

- Group

- керівництво

- рука

- Обробка

- Мати

- he

- допомагає

- його

- історія

- Як

- How To

- HTML

- HTTP

- HTTPS

- Оптимізація гіперпараметрів

- ID

- ідентифікує

- Особистість

- if

- ілюструє

- реалізація

- реалізації

- in

- включати

- includes

- У тому числі

- Augmenter

- незалежний

- самостійно

- вказує

- індивідуальний

- промисловості

- інформація

- Інфраструктура

- ініціативи

- інновації

- вхід

- витрати

- страхування

- інтеграція

- взаємодіє

- в

- вводити

- питання

- IT

- ЙОГО

- робота

- Джобс

- JPG

- json

- просто

- ключ

- етикетки

- останній

- вести

- вивчення

- Led

- Життєвий цикл

- Лінія

- список

- місцевий

- журнал

- машина

- навчання за допомогою машини

- головний

- Підтримка

- зробити

- управляти

- управління

- управління

- керівництво

- вручну

- позначено

- магістра

- матеріал

- Зустрічатися

- відповідає

- повідомлення

- повідомлення

- метрика

- Метрика

- ML

- MLOps

- модель

- моделювання

- Моделі

- змінювати

- моніторинг

- більше

- множинний

- Названий

- іменування

- необхідно

- Необхідність

- необхідний

- потреби

- мережа

- Нові

- нещодавно

- nlp

- немає

- сповіщення

- Повідомлення

- роман

- об'єкт

- отримувати

- отримання

- of

- пропонує

- Пропозиції

- часто

- on

- ті,

- тільки

- операція

- операції

- оптимізація

- оптимізуючий

- or

- порядок

- організації

- Організований

- оригінал

- Інше

- вихід

- поза

- пакет

- пакети

- пар

- параметри

- частина

- приватність

- проходить

- пристрасний

- шлях

- Виконувати

- продуктивність

- виконується

- малюнок

- трубопровід

- план

- запланований

- plato

- Інформація про дані Платона

- PlatoData

- ігри

- точка

- бідні

- пошта

- практики

- Прогнози

- Готує

- передумови

- представити

- представлений

- попередній

- Проблема

- продовжити

- процес

- Оброблено

- Production

- професійний

- прибутку

- Підвищено

- запропонований

- доведений

- за умови

- забезпечує

- забезпечення

- Тягне

- Штовхати

- Python

- якість

- Сировина

- Читати

- читання

- отримує

- отримання

- останній

- запис

- зменшити

- зниження

- про

- реєструвати

- зареєстрований

- реєструючий

- регістри

- Реєстрація

- реєстру

- регулярно

- решті

- повторюваний

- Звіти

- Сховище

- представляє

- вимагається

- Вимога

- Вимагається

- ресурси

- ті

- відповідно

- відповідальний

- результати

- резюме

- багаторазовий

- огляд

- дорога

- Роль

- Правила

- прогін

- бігун

- біг

- пробіжки

- мудрець

- Висновок SageMaker

- Трубопроводи SageMaker

- масштабованість

- розклад

- планування

- наука

- вчений

- рахунок

- scripts

- Sdk

- розділ

- послати

- відправка

- посилає

- служити

- служить

- Послуги

- комплект

- установка

- кілька

- загальні

- Повинен

- показаний

- Шоу

- значний

- простий

- один

- Софтвер

- розробка програмного забезпечення

- рішення

- Рішення

- ВИРІШИТИ

- Джерела

- Про

- конкретний

- зазначений

- SPORTS

- Стажування

- інсценування

- старт

- Починаючи

- стан

- статистика

- Статус

- Крок

- заходи

- зберігання

- зберігати

- зберігання

- Стратегія

- структурний

- студія

- успішний

- Успішно

- такі

- костюм

- Підтримуючий

- Опори

- таблиця

- TAG

- взяття

- Мета

- Завдання

- команда

- методи

- Технології

- шаблон

- Terraform

- ніж

- Що

- Команда

- їх

- Їх

- потім

- Там.

- тим самим

- Ці

- вони

- це

- три

- поріг

- через

- час

- до

- інструменти

- топ

- теми

- трек

- послужний список

- навчений

- Навчання

- Перетворення

- прозорий

- Подорож

- викликати

- спрацьовує

- Правда

- ПЕРЕГЛЯД

- два

- тип

- типовий

- ui

- при

- нижнє підкреслення

- Оновити

- оновлення

- завантажено

- Завантаження

- використання

- використовуваний

- користувач

- використовує

- використання

- використовувати

- використовувати

- значення

- змінна

- перевірити

- версія

- версії

- через

- ПОРУШЕННЯ

- попередження

- шлях..

- способи

- we

- Web

- веб-сервіси

- ДОБРЕ

- коли

- Чи

- який

- в той час як

- ВООЗ

- волі

- з

- в

- Work

- робочий

- Робочі процеси

- робочий

- ямл

- років

- ще

- Ти

- вашу

- зефірнет