Amazon SageMaker JumpStart er Machine Learning (ML)-hubben i SageMaker, der leverer forudtrænede, offentligt tilgængelige modeller til en lang række problemtyper for at hjælpe dig med at komme i gang med maskinlæring.

At forstå kundeadfærd er i højsædet for enhver virksomhed i dag. At få indsigt i, hvorfor og hvordan kunder køber, kan hjælpe med at øge omsætningen. Kundeafgang er et problem, som en lang række virksomheder står over for, lige fra telekommunikation til bank, hvor kunderne typisk går tabt til konkurrenter. Det er i en virksomheds interesse at fastholde eksisterende kunder i stedet for at skaffe nye kunder, fordi det normalt koster væsentligt mere at tiltrække nye kunder. Når de forsøger at fastholde kunder, fokuserer virksomheder ofte deres indsats på kunder, der er mere tilbøjelige til at forlade. Brugeradfærd og kundesupport chatlogs kan indeholde værdifulde indikatorer på sandsynligheden for, at en kunde afslutter tjenesten. I denne løsning træner og implementerer vi en churn-forudsigelsesmodel, der bruger en state-of-the-art NLP-model (natural language processing) til at finde nyttige signaler i tekst. Ud over tekstinput bruger denne model traditionelle strukturerede datainput såsom numeriske og kategoriske felter.

Multimodalitet er et tværfagligt forskningsfelt, der adresserer nogle af de oprindelige mål for kunstig intelligens ved at integrere og modellere flere modaliteter. Dette indlæg har til formål at bygge en model, der kan behandle og relatere information fra flere modaliteter såsom tabel- og tekstfunktioner.

Vi viser dig, hvordan du træner, implementerer og bruger en churn-forudsigelsesmodel, der har behandlet numeriske, kategoriske og tekstmæssige funktioner til at lave sin forudsigelse. Selvom vi dykker dybt ned i en churn prediction use case i dette indlæg, kan du bruge denne løsning som en skabelon til at generalisere finjustering af præ-trænede modeller med dit eget datasæt og efterfølgende køre hyperparameter optimering (HPO) for at forbedre nøjagtigheden. Du kan endda erstatte eksempeldatasættet med dit eget og køre det fra ende til anden for at løse dine egne use cases. Løsningen skitseret i indlægget er tilgængelig på GitHub.

JumpStart løsningsskabeloner

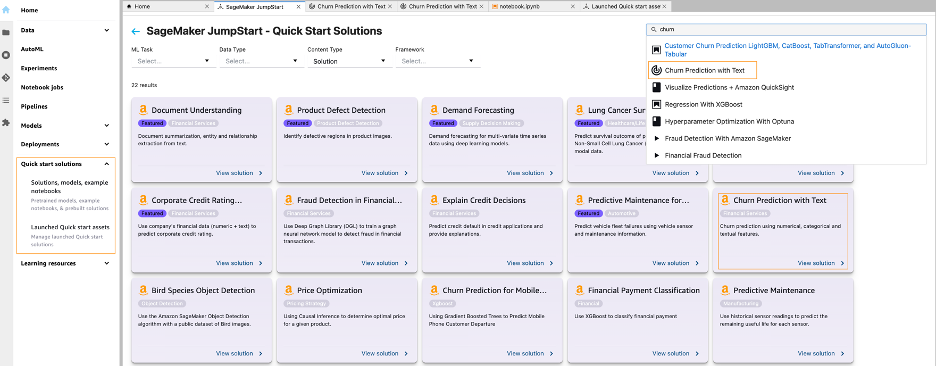

Amazon SageMaker JumpStart leverer end-to-end-løsninger med ét klik til mange almindelige ML-brugssager. Udforsk følgende use cases for at få flere oplysninger om tilgængelige løsningsskabeloner:

JumpStart-løsningsskabelonerne dækker en række forskellige use cases, hvorunder hver af dem tilbydes flere forskellige løsningsskabeloner (denne Document Understanding-løsning er under "Udtræk og analyser data fra dokumenter" use case).

Vælg den løsningsskabelon, der passer bedst til din brugssituation, fra JumpStart-landingssiden. For mere information om specifikke løsninger under hver use case, og hvordan man starter en JumpStart-løsning, se Løsningsskabeloner.

Løsningsoversigt

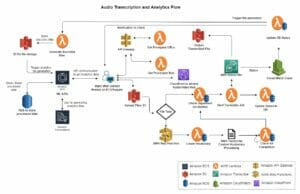

Følgende figur viser, hvordan du kan bruge denne løsning med Amazon SageMaker komponenter. SageMaker træningsjobs bruges til at træne de forskellige NLP-modeller, og SageMaker-endepunkter bruges til at implementere modellerne i hvert trin. Vi bruger Amazon Simple Storage Service (Amazon S3) sammen med SageMaker for at gemme træningsdata og modelartefakter, og amazoncloudwatch at logge trænings- og slutpunktsoutput.

Vi nærmer os løsningen af churn-forudsigelsesproblemet med følgende trin:

- Dataudforskning for at forberede dataene til at være ML-klare.

- Træn en multimodal model med en Krammer ansigt sætning transformer , Scikit-lær tilfældig skovklassificering.

- Forbedre modellens ydeevne yderligere med HPO-brug SageMaker automatisk model tuning.

- Træn to AutoGluon multimodale modeller: en AutoGluon multimodal vægtet/stablet ensemblemodel og en AutoGluon multimodal fusionsmodel.

- Evaluer og sammenlign modellens ydeevne på holdout-testdataene.

Forudsætninger

For at prøve løsninger på din egen konto skal du sørge for, at du har følgende på plads:

- En AWS-konto. Hvis du ikke har en konto, kan du tilmeld dig en.

- Løsningen skitseret i indlægget er en del af SageMaker JumpStart. For at køre denne JumpStart-løsning og få infrastrukturen til at implementere på din AWS-konto, skal du oprette en aktiv Amazon SageMaker Studio eksempel (se Ombord på Amazon SageMaker Studio). Når din Studio-instans er klar, skal du bruge instruktionerne i JumpStart til at starte løsningen.

- Når du kører dette notesbog på Studio, skal du sørge for Python 3 (PyTorch 1.10 Python 3.8 CPU-optimeret) billede/kerne bruges.

Du kan installere de nødvendige pakker som beskrevet i løsningen for at køre denne notesbog:

Åbn churn-forudsigelsesbrugssagen

På Studio-konsollen skal du vælge Løsninger, modeller, eksempel notesbøger under Lynstartløsninger i navigationsruden. Naviger til Churn-forudsigelse med tekst løsning i JumpStart.

Nu kan vi se nærmere på nogle af de aktiver, der indgår i denne løsning.

Data efterforskning

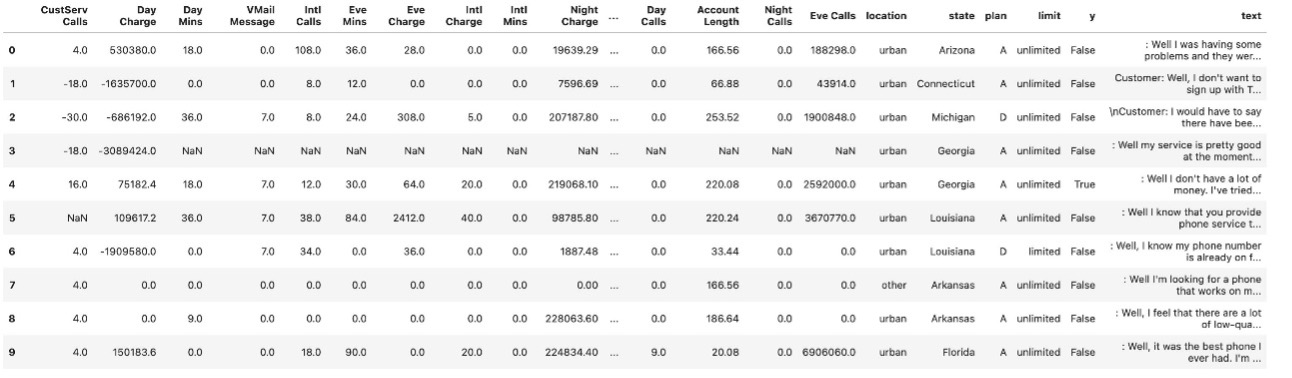

Lad os først downloade testen, validere og træne datasættet fra S3-kilden og uploade den til vores S3-bøtte. Følgende skærmbillede viser os 10 observationer af træningsdataene.

Lad os begynde at udforske tog- og valideringsdatasættet.

Som du kan se, har vi forskellige funktioner som f.eks CustServ Calls, Day Chargeog Day Calls som vi bruger til at forudsige målkolonnen y (om kunden forlod tjenesten).

y er kendt som mål attribut: den egenskab, som vi ønsker, at ML-modellen skal forudsige. Fordi target-attributten er binær, udfører vores model binær forudsigelse, også kendt som binær klassifikation.

Der er 21 funktioner, inklusive målvariablen. Antallet af eksempler på trænings- og valideringsdata er henholdsvis 43,000 og 5,000.

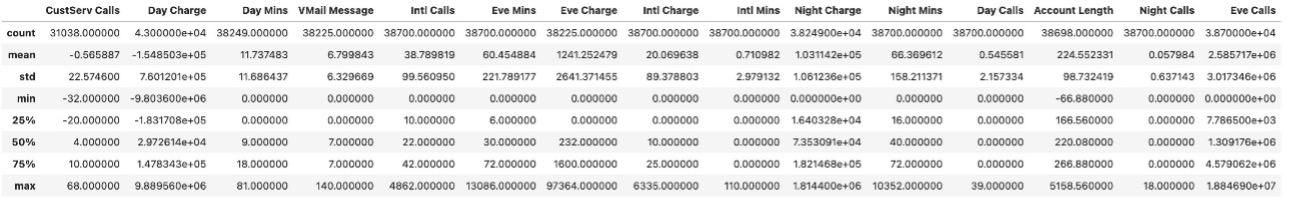

Følgende skærmbillede viser oversigtsstatistikken for træningsdatasættet.

Vi har udforsket datasættet og opdelt det i trænings-, validerings- og testsæt. Trænings- og valideringssættet bruges til træning og HPO. Testsættet bruges som holdout-sættet til evaluering af modellens ydeevne. Vi udfører nu funktionstekniske trin og tilpasser derefter modellen.

Tilpas en multimodal model med en Hugging Face-sætningstransformator og Scikit-learn random forest classifier

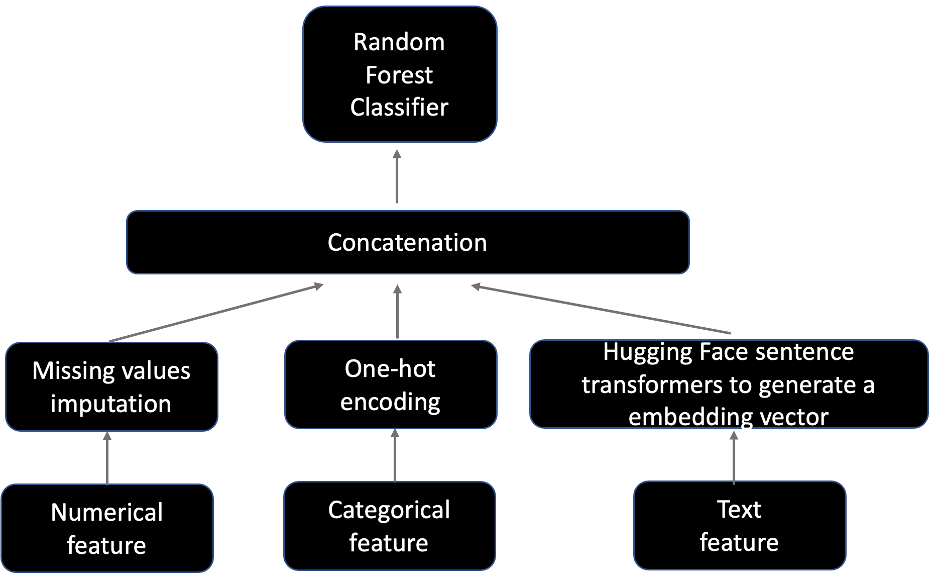

Modeluddannelsen består af to komponenter: et funktionsingeniørtrin, der behandler numeriske, kategoriske og teksttræk, og et modeltilpasningstrin, der tilpasser de transformerede funktioner til et Scikit-lær tilfældig skovklassificering.

Til feature engineering udfører vi følgende trin:

- Udfyld de manglende værdier for numeriske funktioner.

- Indkod kategoriske funktioner til one-hot-værdier, hvor de manglende værdier tælles som en af kategorierne for hver funktion.

- Brug Krammer ansigt sætning transformer at indkode tekstfunktionen for at generere en X-dimensional tæt vektor, hvor værdien af X afhænger af en bestemt sætningstransformator.

Vi vælger de tre mest downloadede sætningstransformatormodeller og bruger dem i følgende modeltilpasning og HPO. Konkret bruger vi alle-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1og parafrase-MiniLM-L6-v2. For hyperparametre for den tilfældige skovklassifikator henvises til GitHub repo.

Følgende figur viser modelarkitekturdiagrammet.

Der er mange hyperparametre, du kan tune, såsom n-estimatorer, max-depth og bootstrap. For flere detaljer henvises til GitHub repo.

Til demonstrationsformål bruger vi kun numeriske funktioner CustServ Calls , Account Length, kategoriske træk planog limit, og tekstfunktion text for at passe til modellen. Flere funktioner skal adskilles af ,.

Vi implementerer modellen efter træningen er afsluttet:

Når vi kalder vores nye slutpunkt fra notesbogen, bruger vi et SageMaker SDK Predictor. En Predictor bruges til at sende data til et slutpunkt (som en del af en anmodning) og fortolke svaret. JSON bruges som format for både inputdata og outputsvar, fordi det er et standardslutpunktsformat, og slutpunktsvaret kan indeholde indlejrede datastrukturer.

Med vores model implementeret med succes og vores prædiktor konfigureret, kan vi prøve churn-forudsigelsesmodellen på et eksempel på input:

Følgende kode viser svaret (sandsynlighed for churn) fra forespørgsel om slutpunktet:

Bemærk, at sandsynligheden returneret af denne model ikke er blevet kalibreret. Når modellen giver en sandsynlighed for churn på for eksempel 20 %, betyder det ikke nødvendigvis, at 20 % af kunderne med en sandsynlighed på 20 % resulterede i churn. Kalibrering er en nyttig egenskab under visse omstændigheder, men er ikke påkrævet i tilfælde, hvor diskrimination mellem tilfælde af churn og non-churn er tilstrækkelig. KalibreretClassifierCV fra Scikit-lære kan bruges til at kalibrere en model.

Nu forespørger vi endepunktet ved hjælp af hold-out testdata, som består af 1,939 eksempler. Følgende tabel opsummerer evalueringsresultaterne for vores multimodale model med en Hugging Face-sætningstransformator og Scikit-learn tilfældig skovklassifikator.

| metric | BERT + Random Forest |

| Nøjagtighed | 0.77463 |

| ROC AUC | 0.75905 |

Modelydelsen afhænger af hyperparameterkonfigurationer. Træning af en model med ét sæt hyperparameterkonfigurationer garanterer ikke en optimal model. Som et resultat kører vi HPO-processen i det følgende afsnit for yderligere at forbedre modellens ydeevne.

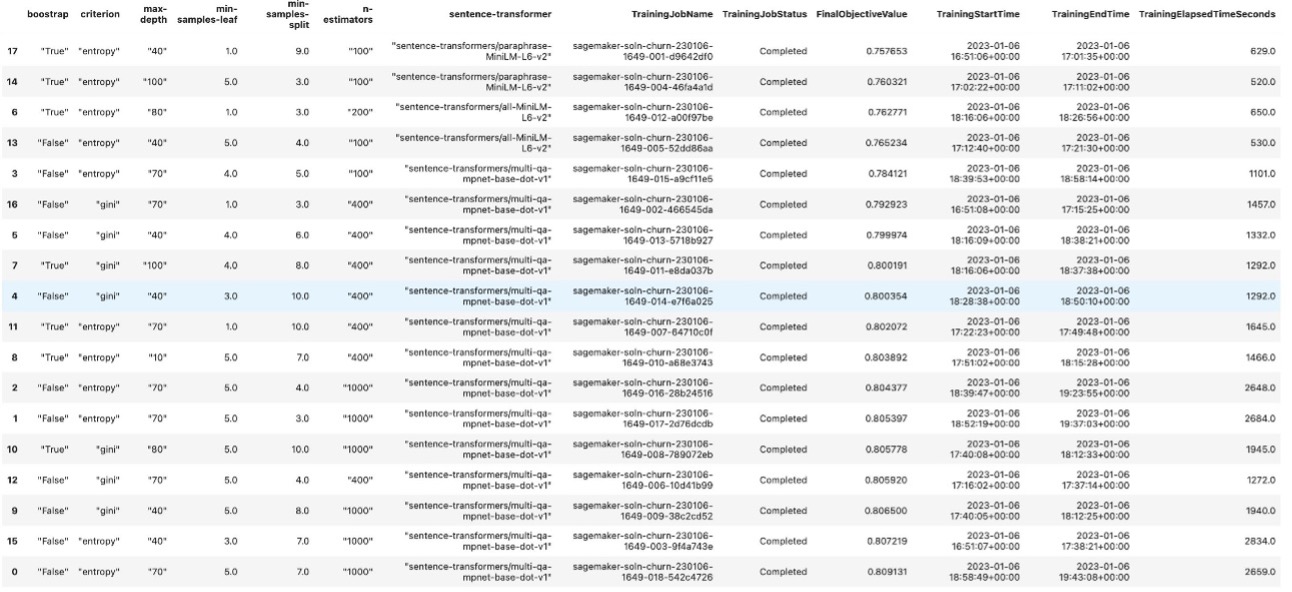

Monter en multimodal model med HPO

I dette afsnit forbedrer vi modellens ydeevne yderligere ved at tilføje HPO-tuning med SageMaker automatisk model tuning. SageMaker automatisk modeljustering, også kendt som hyperparameterjustering, finder den bedste version af en model ved at køre mange træningsjob på dit datasæt ved hjælp af algoritmen og intervaller af hyperparametre, som du angiver. Den vælger derefter de hyperparameterværdier, der resulterer i en model, der yder bedst, målt med en metrik, som du vælger. Den bedste model og dens tilsvarende hyperparametre vælges på valideringsdataene. Dernæst vurderes den bedste model på hold-out-testdataene, som er de samme testdata, som vi lavede i forrige afsnit. Til sidst viser vi, at ydelsen af modellen trænet med HPO er væsentligt bedre end den, der trænes uden HPO.

Følgende er statiske hyperparametre, vi ikke tuner, og dynamiske hyperparametre, vi ønsker at tune, og deres søgeområder:

Vi definerer det objektive metriske navn, metriske definition (med regex-mønster) og objektivtype for tuning-jobbet.

Først sætter vi målet som nøjagtighedsscore på valideringsdataene (roc auc score on validation data) og definerede metrics for tuning-jobbet ved at angive det objektive metriske navn og et regulært udtryk (regex). Det regulære udtryk bruges til at matche algoritmens logoutput og fange de numeriske værdier af metrikker.

Dernæst specificerer vi hyperparameterområder for at vælge de bedste hyperparameterværdier fra. Vi sætter det samlede antal tuningjobs til 10 og fordeler disse job på fem forskellige Amazon Elastic Compute Cloud (Amazon EC2) forekomster til at køre parallelle tuningjob.

Til sidst videregiver vi disse værdier for at instantiere et SageMaker Estimator-objekt, svarende til det, vi gjorde i det forrige træningstrin. I stedet for at kalde tilpasningsfunktionen for Estimator-objektet sender vi Estimator-objektet ind som en parameter til HyperparameterTuner konstruktør og kald dens tilpasningsfunktion for at starte tuningjobs:

Når tuning-jobbet er afsluttet, kan vi generere oversigtstabellen over alle tuning-job.

Når tuning-jobbene er fuldført, implementerer vi den model, der giver den bedste evaluerings-metriske score på valideringsdatasættet, udfører konklusioner på det samme hold-out-testdatasæt, som vi gjorde i det foregående afsnit, og beregner evalueringsmetrikker.

| metric | BERT + Random Forest | BERT + Random Forest med HPO |

| Nøjagtighed | 0.77463 | 0.9278 |

| ROC AUC | 0.75905 | 0.79861 |

Vi kan se at køre HPO med SageMaker automatisk modeljustering forbedrer modellens ydeevne markant.

Ud over HPO er modelydelsen også afhængig af algoritmen. Det er vigtigt at træne flere state-of-the-art algoritmer, sammenligne deres ydeevne på de samme hold-out testdata og finde den optimale. Derfor træner vi yderligere to AutoGluon multimodale modeller i de følgende afsnit.

Monter en AutoGluon multimodal vægtet/stablet ensemblemodel

Der er to typer AutoGluon multimodalitet:

- Træn flere tabelmodeller såvel som

TextPredictormodel (ved at brugeTextPredictormodel indeniTabularPredictor), og kombiner dem derefter via enten et vægtet ensemble eller stablet ensemble, som forklaret i AutoGluon-tabel: Robust og nøjagtig AutoML til strukturerede data - Sammensmelte flere neurale netværksmodeller direkte og håndtere rå tekst (som også er i stand til at håndtere yderligere numeriske og kategoriske kolonner)

Vi træner først en multimodal vægtet eller stablet ensemblemodel i dette afsnit, og træner en fusionsneuralt netværksmodel i næste afsnit.

Først henter vi AutoGluon træningsbilledet:

Dernæst sender vi hyperparametre ind. I modsætning til eksisterende AutoML-frameworks, der primært fokuserer på model- eller hyperparametervalg, lykkes AutoGluonTabular ved at samle flere modeller og stable dem i flere lag. Derfor er HPO normalt ikke påkrævet for AutoGluon-ensemblemodeller.

Til sidst skaber vi en SageMaker Estimator og ring estimator.fit() for at starte et træningsjob:

Når træningen er afsluttet, henter vi AutoGluon-inferensbilledet og implementerer modellen:

Når vi har implementeret endepunkterne, forespørger vi endepunktet ved hjælp af det samme testsæt og beregner evalueringsmetrikker. I den følgende tabel kan vi se, at AutoGluon multimodalt ensemble forbedrer omkring 3% i ROC AUC sammenlignet med BERT-sætningstransformatoren og tilfældig skov med HPO.

| metric | BERT + Random Forest | BERT + Random Forest med HPO | AutoGluon Multimodal Ensemble |

| Nøjagtighed | 0.77463 | 0.9278 | 0.92625 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 |

Monter en AutoGluon multimodal fusionsmodel

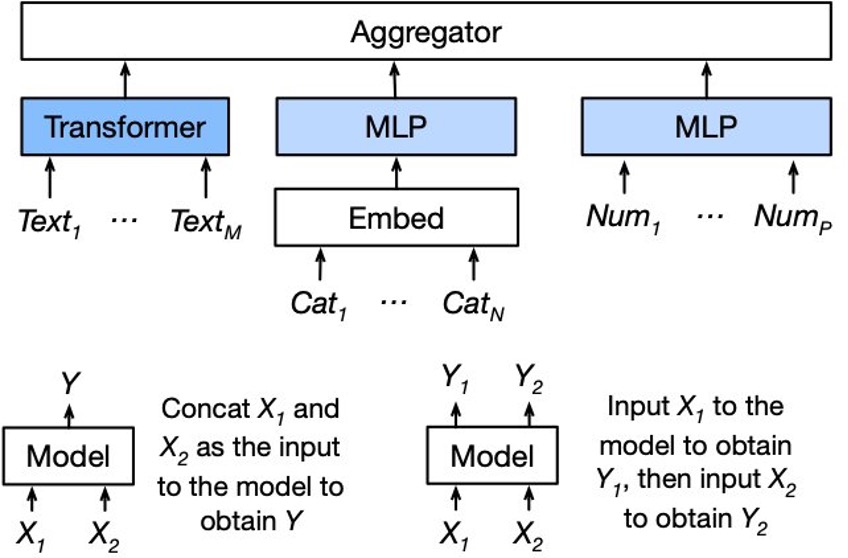

Følgende diagram illustrerer modellens arkitektur. For detaljer, se AutoMM til tekst + tabel – hurtig start.

Internt bruger vi forskellige netværk til at kode tekstkolonner, kategoriske kolonner og numeriske kolonner. Funktionerne genereret af individuelle netværk er aggregeret af en senfusionsaggregator. Aggregatet kan udlæse både logits eller scoreforudsigelser.

Her bruger vi den fortrænede NLP-rygrad til at udtrække tekstfunktionerne og bruger derefter to andre tårne til at udtrække funktionen fra den kategoriske kolonne og numeriske kolonne.

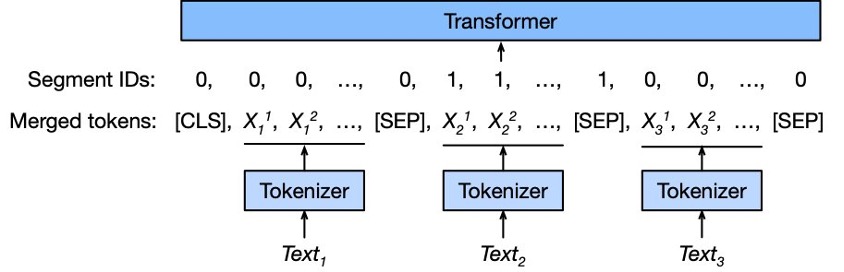

For at håndtere flere tekstfelter adskiller vi desuden disse felter med [SEP]-tokenet og skifter 0'er og 1'er som segment-id'erne, som vist i det følgende diagram.

På samme måde følger vi instruktionerne i det foregående afsnit for at træne og implementere AutoGluon multimodale fusionsmodel:

Følgende tabel opsummerer evalueringsresultaterne for AutoGluon multimodale fusionsmodel sammen med de tre modeller, som vi evaluerede i de foregående afsnit. Vi kan se AutoGluon multimodale ensemble og multimodale fusionsmodeller opnå den bedste ydeevne.

| Metrics | BERT + Random Forest | BERT + Random Forest med HPO | AutoGluon Multimodal Ensemble | AutoGluon Multimodal Fusion |

| Nøjagtighed | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Bemærk, at resultaterne og den relative ydeevne mellem disse modeller afhænger af det datasæt, du bruger til træning. Disse resultater er repræsentative, og selvom tendensen til, at visse algoritmer klarer sig bedre, er baseret på relevante faktorer, kan balancen i ydeevne ændre sig givet en anden datafordeling. Du kan erstatte eksempeldatasættet med dine egne data for at bestemme, hvilken model der fungerer bedst for dig.

Demo notesbog

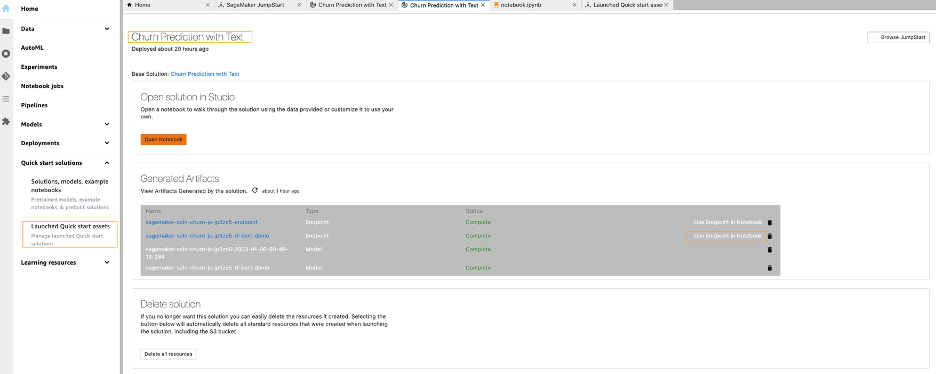

Du kan bruge demo-notesbogen til at sende eksempeldata til allerede implementerede modelslutpunkter. Demo-notebooken giver dig hurtigt mulighed for at få praktisk oplevelse ved at forespørge på eksempeldataene. Når du har startet Churn Prediction with Text-løsningen, skal du åbne demo-notesbogen ved at vælge Brug Endpoint i Notebook.

Ryd op

Når du er færdig med denne løsning, skal du sørge for at slette alle uønskede AWS-ressourcer ved at vælge Slet alle ressourcer.

Bemærk, at du manuelt skal slette eventuelle yderligere ressourcer, som du måtte have oprettet i denne notesbog.

Konklusion

I dette indlæg viste vi, hvordan du kan bruge Sagemaker JumpStart til at forudsige churn ved hjælp af multimodalitet af tekst og tabelfunktioner.

Hvis du er interesseret i at lære mere om kundefrafaldsmodeller, så tjek følgende indlæg:

Om forfatterne

Dr. Xin Huang er en Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker indbyggede algoritmer. Han fokuserer på at udvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er inden for området naturlig sprogbehandling, forklarlig dyb læring på tabeldata og robust analyse af ikke-parametrisk rum-tid-klynger. Han har publiceret mange artikler i ACL, ICDM, KDD-konferencer og Royal Statistical Society: Series A journal.

Dr. Xin Huang er en Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker indbyggede algoritmer. Han fokuserer på at udvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er inden for området naturlig sprogbehandling, forklarlig dyb læring på tabeldata og robust analyse af ikke-parametrisk rum-tid-klynger. Han har publiceret mange artikler i ACL, ICDM, KDD-konferencer og Royal Statistical Society: Series A journal.

Rajakumar Sampathkumar er en Principal Technical Account Manager hos AWS, der giver kunderne vejledning om forretningsteknologisk tilpasning og understøtter genopfindelsen af deres cloud-driftsmodeller og -processer. Han brænder for cloud og machine learning. Raj er også maskinlæringsspecialist og arbejder med AWS-kunder for at designe, implementere og administrere deres AWS-arbejdsbelastninger og -arkitekturer.

Rajakumar Sampathkumar er en Principal Technical Account Manager hos AWS, der giver kunderne vejledning om forretningsteknologisk tilpasning og understøtter genopfindelsen af deres cloud-driftsmodeller og -processer. Han brænder for cloud og machine learning. Raj er også maskinlæringsspecialist og arbejder med AWS-kunder for at designe, implementere og administrere deres AWS-arbejdsbelastninger og -arkitekturer.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- Om

- Konto

- nøjagtighed

- præcis

- opnå

- erhverve

- aktiv

- Desuden

- Yderligere

- adresser

- Efter

- Agent

- aggregator

- målsætninger

- algoritme

- algoritmer

- Alle

- tillader

- langs med

- Skønt

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon SageMaker JumpStart

- analyse

- analysere

- ,

- anvendt

- tilgang

- arkitektur

- OMRÅDE

- kunstig

- kunstig intelligens

- Aktiver

- Automatisk Ur

- AutoML

- til rådighed

- AWS

- Backbone

- Balance

- Bank

- baseret

- fordi

- BEDSTE

- Bedre

- mellem

- Bootstrap

- bygge

- indbygget

- virksomhed

- købe

- ringe

- ringer

- Opkald

- stand

- fange

- bære

- tilfælde

- tilfælde

- kategorier

- vis

- chance

- lave om

- kontrollere

- Vælg

- vælge

- omstændigheder

- klassificering

- tættere

- Cloud

- klyngedannelse

- kode

- Kolonne

- Kolonner

- kombinerer

- Fælles

- Virksomheder

- Selskabs

- sammenligne

- sammenlignet

- konkurrenter

- fuldføre

- komponenter

- Compute

- konferencer

- Konsol

- Container

- kontrakt

- kontrakter

- Tilsvarende

- Omkostninger

- dæksel

- skabe

- oprettet

- kunde

- kundeadfærd

- Kundeservice

- Kunde support

- Kunder

- data

- deal

- beskæftiger

- besluttede

- dyb

- dyb læring

- afhængig

- afhænger

- indsætte

- indsat

- Design

- detaljer

- Bestem

- udvikling

- DID

- forskellige

- direkte

- distribuere

- fordeling

- Docker

- dokumentet

- Er ikke

- Dont

- downloade

- dynamisk

- hver

- indsats

- enten

- ende til ende

- Endpoint

- Engineering

- evalueret

- evaluering

- Endog

- eksempel

- eksempler

- eksisterende

- erfaring

- forklarede

- udforskning

- udforske

- udforsket

- Udforskning

- ekstrakt

- ekstremt

- Ansigtet

- konfronteret

- faktorer

- Feature

- Funktionalitet

- felt

- Fields

- Figur

- Endelig

- Finde

- fund

- Fornavn

- passer

- montering

- Fokus

- fokuserer

- følger

- efter

- skov

- format

- rammer

- fra

- funktion

- yderligere

- fusion

- vinder

- generere

- genereret

- få

- given

- giver

- gluon

- Mål

- godt

- Grow

- garanti

- håndtere

- Håndtering

- hands-on

- hjælpe

- hjælpsom

- Hvordan

- How To

- HTML

- HTTPS

- Hub

- Hyperparameter optimering

- Tuning af hyperparameter

- identificere

- billede

- importere

- vigtigt

- Forbedre

- in

- medtaget

- Herunder

- Forøg

- Indikatorer

- individuel

- oplysninger

- Infrastruktur

- indgang

- indsigt

- installere

- instans

- i stedet

- anvisninger

- Integration

- Intelligens

- interesse

- interesseret

- interesser

- involverede

- spørgsmål

- IT

- Job

- Karriere

- tidsskrift

- json

- Nøgle

- Venlig

- kendt

- landing

- Sprog

- lancere

- lag

- læring

- Forlade

- Længde

- Sandsynlig

- GRÆNSE

- Line (linje)

- Lang

- Se

- maskine

- machine learning

- lave

- administrere

- leder

- manuelt

- mange

- Match

- Maksimer

- maksimal

- metrisk

- Metrics

- måske

- tankerne

- mangler

- ML

- model

- modeller

- Måned

- måned

- mere

- mest

- tværfagligt

- flere

- navn

- Natural

- Natural Language Processing

- Naviger

- Navigation

- nødvendigvis

- Behov

- netværk

- net

- neurale netværk

- Ny

- næste

- NLP

- notesbog

- nummer

- objekt

- objektiv

- tilbydes

- ONE

- åbent

- drift

- optimal

- optimering

- optimeret

- original

- Andet

- skitseret

- egen

- pakker

- brød

- papirer

- Parallel

- parameter

- del

- særlig

- lidenskabelige

- Mønster

- Udfør

- ydeevne

- forestillinger

- udfører

- telefon

- pick

- Place

- fly

- plato

- Platon Data Intelligence

- PlatoData

- Indlæg

- Indlæg

- forudsige

- forudsigelse

- Forudsigelser

- Predictor

- Forbered

- tidligere

- primært

- Main

- Problem

- behandle

- Behandlet

- Processer

- forarbejdning

- ejendom

- giver

- leverer

- offentligt

- offentliggjort

- formål

- Python

- pytorch

- Hurtig

- hurtigt

- tilfældig

- rækkevidde

- Raw

- RE

- klar

- regulært udtryk

- fast

- relevant

- erstatte

- repræsentativt

- anmode

- påkrævet

- forskning

- Ressourcer

- svar

- lydhør

- resultere

- Resultater

- indtægter

- robust

- Royal

- Kør

- kører

- sagemaker

- SageMaker Automatisk Model Tuning

- samme

- skalerbar

- Videnskabsmand

- scikit-lære

- SDK

- Søg

- søgning

- Sektion

- sektioner

- segment

- valgt

- valg

- dømme

- Series

- Serie A

- tjeneste

- sæt

- sæt

- flere

- bør

- Vis

- vist

- Shows

- signaler

- betydeligt

- lignende

- Simpelt

- So

- Samfund

- løsninger

- Løsninger

- SOLVE

- Løsning

- nogle

- Kilde

- specialist

- specifikke

- specifikt

- delt

- Sprint

- stablet

- stabling

- Stage

- standard

- starte

- påbegyndt

- state-of-the-art

- statistiske

- statistik

- Trin

- Steps

- opbevaring

- butik

- struktureret

- Studio

- Efterfølgende

- Succesfuld

- sådan

- tilstrækkeligt

- RESUMÉ

- support

- Støtte

- bord

- Tag

- mål

- tech

- Teknisk

- telekommunikation

- skabelon

- skabeloner

- vilkår

- prøve

- Området

- The Source

- deres

- derfor

- tre

- til

- i dag

- token

- top

- I alt

- traditionelle

- Tog

- uddannet

- Kurser

- omdannet

- sand

- typer

- typisk

- under

- forståelse

- ubegrænset

- uønsket

- opgradering

- us

- brug

- brug tilfælde

- Bruger

- sædvanligvis

- Ved hjælp af

- VALIDATE

- validering

- Værdifuld

- værdi

- Værdier

- række

- forskellige

- Ve

- Tele Danmark Mobil

- udgave

- via

- Hvad

- hvorvidt

- som

- WHO

- bred

- Bred rækkevidde

- vilje

- uden

- Arbejde

- virker

- ville

- Forkert

- X

- Du

- Din

- zephyrnet