Vi har for nylig introduceret en ny funktion i Amazon SageMaker Python SDK der lader datavidenskabsfolk køre deres maskinlæringskode (ML) skrevet i deres foretrukne integrerede udviklermiljø (IDE) og notebooks sammen med de tilhørende runtime-afhængigheder som Amazon SageMaker træningsjob med minimale kodeændringer til eksperimentet udført lokalt. Dataforskere udfører typisk flere gentagelser af eksperimenter i databehandlings- og træningsmodeller, mens de arbejder på ethvert ML-problem. De ønsker at køre denne ML-kode og udføre eksperimentet med brugervenlighed og minimal kodeændring. Amazon SageMaker Model træning hjælper datavidenskabsfolk med at køre fuldt administrerede storskala træningsjob på AWS's computerinfrastruktur. SageMaker Training hjælper også data scientists med avancerede værktøjer som f.eks Amazon SageMaker Debugger og Profiler til at fejlsøge og analysere deres store træningsjob.

For kunder med små budgetter, små teams og stramme tidslinjer gør hvert eneste nyt koncept og kodelinje, der er omskrevet til at køre på SageMaker, dem mindre produktive i forhold til deres kerneopgaver, nemlig databehandling og træning af ML-modeller. De ønsker at skrive kode én gang inden for rammerne af deres valg og være i stand til at bevæge sig problemfrit fra kørende kode i deres notebooks eller bærbare computere til at køre kode i skala ved hjælp af SageMaker-funktioner.

Med denne nye kapacitet i SageMaker Python SDK kan dataforskere ombord på deres ML-kode til SageMaker Training-platformen på få minutter. Du skal blot tilføje en enkelt kodelinje til din ML-kode, og SageMaker forstår intelligent din kode sammen med opsætningen af datasæt og arbejdsområdemiljøet og kører det som et SageMaker Training-job. Du kan derefter drage fordel af nøglefunktionerne i SageMaker Training-platformen, såsom evnen til nemt at skalere job og andre tilknyttede værktøjer som Debugger og Profiler. I denne udgivelse kan du køre din lokale maskinlæring (ML) Python-kode som et enkelt-node Amazon SageMaker træningsjob eller flere parallelle job. Distribuerede træningsjob (på tværs af flere noder) understøttes ikke af fjernfunktioner.

I dette indlæg viser vi dig, hvordan du bruger denne nye evne til at køre lokal ML-kode som et SageMaker-uddannelsesjob.

Løsningsoversigt

Du kan nu køre din ML-kode skrevet i din IDE eller notesbog som et SageMaker-træningsjob ved at annotere funktionen, der fungerer som en indgang til brugerens kodebase, med en simpel dekorator. Ved påkaldelse tager denne funktion automatisk et øjebliksbillede af alle de tilknyttede variabler, funktioner, pakker, miljøvariabler og andre runtime-krav fra din ML-kode, serialiserer dem og indsender dem som et SageMaker Training-job. Det integreres med den nyligt annoncerede SageMaker Python SDK-funktion til indstilling af standardværdier for parametre. Denne funktion forenkler SageMaker-konstruktionerne, som du skal lære for at kunne køre kode ved hjælp af SageMaker Training. Dataforskere kan skrive, fejlsøge og iterere deres kode i enhver foretrukket IDE (f.eks. Amazon SageMaker Studio, notebooks, VS-kode eller PyCharm). Når du er klar, kan du annotere din Python-funktion med @remote dekoratør og køre det som et SageMaker-job i stor skala.

Denne funktion tager velkendte open source Python-objekter som argumenter og output. Desuden behøver du ikke at forstå containerlivscyklusstyring og kan simpelthen køre dine arbejdsbelastninger på tværs af forskellige computerkontekster (såsom en lokal IDE, Studio eller træningsjob) med minimale konfigurationsomkostninger. For at køre enhver lokal kode som et SageMaker Training-job, udleder denne funktion de konfigurationer, der kræves for at køre jobs, som f.eks. AWS identitets- og adgangsstyring (IAM) rolle, krypteringsnøgle og netværkskonfiguration fra Studio- eller IDE-indstillingerne (som kan være standardindstillinger) og sender dem til platformen som standard. Du har fleksibiliteten til at tilpasse din runtime i SageMaker-administrerede infrastruktur ved hjælp af den udledte konfiguration eller tilsidesætte dem på SDK-niveau ved at videregive dem som argumenter til dekoratøren.

Denne nye funktion i SageMaker Python SDK transformerer din ML-kode i et eksisterende arbejdsmiljømiljø og enhver tilhørende databehandlingskode og datasæt til et SageMaker Training-job. Denne funktion leder efter ML-kode pakket ind i en @remote decorator og automatisk oversætter det til et job, der kører i enten Studio eller en lokal IDE såsom PyCharm.

I de følgende afsnit gennemgår vi funktionerne i denne nye funktion, og hvordan man starter python-funktioner som SageMaker Training-job.

Forudsætninger

For at bruge denne nye SageMaker Python SDK-funktion og køre den kode, der er knyttet til dette indlæg, har du brug for følgende forudsætninger:

- En AWS-konto, der vil indeholde alle dine AWS-ressourcer

- En IAM-rolle for at få adgang til SageMaker

- Adgang til Studio eller en SageMaker notebook-instans eller en IDE såsom PyCharm

Brug SDK'et fra Studio og SageMaker notesbøger

Du kan bruge denne funktion fra Studio ved at starte en notesbog og pakke din kode med en @remote dekoratør inde i notesbogen. Du skal først importere fjernbetjeningsfunktionen ved hjælp af følgende kode:

from sagemaker.remote_function import remoteNår du bruger dekorationsfunktionen, vil denne funktion automatisk fortolke funktionen af din kode og køre den som et SageMaker Training job.

Du kan også bruge denne funktion fra en SageMaker notebook-instans. Du skal først starte en notesbogsforekomst, åbne Jupyter eller Jupyter Lab på den og starte en notesbog. Importer derefter fjernbetjeningsfunktionen som vist i den foregående kode, og indpak din kode med @remote dekoratør. Vi inkluderer et eksempel på, hvordan du bruger dekorationsfunktionen og de tilhørende indstillinger senere i dette indlæg.

Brug SDK'et fra dit lokale miljø

Du kan også bruge denne funktion fra din lokale IDE. Som forudsætning skal du have AWS kommandolinjegrænseflade (AWS CLI), SageMaker Python SDK og AWS SDK til Python (Boto3) installeret i dit lokale miljø. Du skal importere disse biblioteker i din kode, indstille SageMaker-sessionen, angive indstillinger og dekorere din funktion med @remote dekoratør. I følgende eksempelkode kører vi en simpel opdelingsfunktion som et SageMaker Training job:

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))Vi kan bruge en lignende metode til at køre avancerede funktioner som træningsjob, som vist i næste afsnit.

Start Python-funktioner som SageMaker-job

Den nye SageMaker Python SDK-funktion giver dig mulighed for at køre Python-funktioner som SageMaker Training jobs. Enhver Python-kode, ML-træningskode udviklet af dataforskere ved hjælp af deres foretrukne lokale IDE'er (PyCharm, VS Code), SageMaker-notebooks eller Studio-notebooks kan lanceres som et administreret SageMaker-job.

I ML-arbejdsbelastninger, der bruger denne funktion, serialiseres tilknyttede datasæt, afhængigheder og arbejdsområdemiljøopsætninger ved hjælp af ML-koden og køres som et SageMaker-job synkront og asynkront.

Du kan tilføje en @remote dekoratør-annotering til enhver Python-kode inklusive en lokal ML-behandlings- eller træningsfunktion for at lancere det som et administreret SageMaker Training-job og derved drage fordel af skalaen, ydeevnen og omkostningsfordelene ved SageMaker. Dette kan opnås med minimale kodeændringer ved at tilføje en dekorator til Python-funktionskoden. Opkald til den dekorerede funktion køres synkront, og funktionskørslen venter, indtil SageMaker-jobbet er færdigt.

I det følgende eksempel bruger vi @remote decorator for at starte SageMaker-job i dekoratørtilstand ved hjælp af en ml.m5.large-instans. SageMaker bruger træningsjob til at starte denne funktion som et administreret job.

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])Du kan også bruge dekorationstilstand til at starte SageMaker-job, Python-pakker og afhængigheder. Du kan inkludere miljøvariabler såsom VPC, undernet og sikkerhedsgrupper for at starte SageMaker træningsjob i environment.yml fil. Dette giver ML-ingeniører og -administratorer mulighed for at konfigurere disse miljøvariabler, så dataforskere kan fokusere på ML-modelopbygning og iterere hurtigere. Se følgende kode:

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultDu kan bruge RemoteExecutor at starte Python-funktioner som SageMaker-job asynkront. Eksekutøren poller asynkront SageMaker Training-job for at opdatere status for jobbet. Det RemoteExecutor klasse er en implementering af concurrent.futures.Executor, som bruges til at indsende SageMaker Training jobs asynkront. Se følgende kode:

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)Tilpas runtime-miljøet

Dekorationstilstand og RemoteExecutor giver dig mulighed for at definere og tilpasse runtime-miljøerne for SageMaker-jobbet. Kørselsafhængighederne, inklusive Python-pakker og miljøvariabler for SageMaker-job, kan specificeres for at tilpasse kørselstiden. For at køre lokal Python-kode som SageMaker-administrerede job, skal Python-pakken og afhængigheder gøres tilgængelige for SageMaker. ML-ingeniører eller datavidenskabsadministratorer kan konfigurere netværks- og sikkerhedskonfigurationer såsom VPC, undernet og sikkerhedsgrupper til SageMaker-job, så dataforskere kan bruge disse centralt administrerede konfigurationer, mens de starter SageMaker-job. Du kan bruge enten en requirements.txt fil eller en Conda environment.yaml fil.

Når afhængigheder er defineret med requirements.txt, vil pakkerne blive installeret ved hjælp af pip i jobbets runtime. Hvis billedet, der bruges til at køre jobbet, kommer med Conda-miljøer, vil pakker blive installeret i det Conda-miljø, der er erklæret til brug for job. Følgende kode viser et eksempel requirements.txt fil:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0Du kan bestå din Conda environment.yaml fil for at oprette det Conda-miljø, du gerne vil have din kode til at køre i under træningsjobbet. Hvis billedet, der bruges til at køre jobbet, erklærer et Conda-miljø at køre koden under, vil vi opdatere det erklærede Conda-miljø med den givne specifikation. Følgende kode er et eksempel på en Conda environment.yaml fil:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerAlternativt kan du indstille dependencies=”auto_capture” at lade SageMaker Python SDK fange de installerede afhængigheder i det aktive Conda-miljø. Du skal have et aktivt Conda miljø for auto_capture at arbejde. Bemærk at der er forudsætninger for auto_capture at arbejde; vi anbefaler, at du videregiver dine afhængigheder som en requirement.txt or Conda environment.yml fil som beskrevet i forrige afsnit.

For flere detaljer henvises til Kør din lokale kode som et SageMaker Training job.

Konfigurationer til SageMaker-job

Infrastrukturrelaterede indstillinger kan overføres til en konfigurationsfil, som administratorbrugere kan hjælpe med at konfigurere. Du behøver kun at sætte det op én gang. Infrastrukturindstillinger dækker netværkskonfigurationen, IAM-roller, Amazon Simple Storage Service (Amazon S3) mappe til input, output data og tags. Henvise til Konfiguration og brug af standardindstillinger med SageMaker Python SDK for flere detaljer.

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyidImplementering

Deep learning-modeller som PyTorch eller TensorFlow kan også køres i Studio ved at køre koden som et træningsjob i notesbogen. For at vise denne evne i Studio kan du klone denne repo ind i dit Studio og køre notesbogen, der er placeret i GitHub repository.

Dette eksempel demonstrerer en ende-til-ende binær tekstklassificering. Vi bruger Hugging Face-transformatorerne og datasætbiblioteket til at finjustere en fortrænet transformer til binær tekstklassificering. Især den fortrænede model vil blive finjusteret ved hjælp af IMDb datasæt.

Når du kloner depotet, skal du finde følgende filer:

- config.yaml – De fleste af dekorationsargumenterne kan overføres til konfigurationsfilen for at adskille de infrastrukturrelaterede indstillinger fra kodebasen

- huggingface.ipynb – Dette indeholder koden til at træne en forudtrænet HuggingFace-model, som vil blive finjusteret ved hjælp af IMDB-datasættet

- krav.txt – Denne fil indeholder alle afhængigheder til at køre funktionen, der vil blive brugt i denne notesbog til at køre koden og køre træningen eksternt i en GPU-instans som et træningsjob

Når du åbner notesbogen, bliver du bedt om at konfigurere notebookmiljøet. Du kan vælge Data Science 3.0-billedet med Python 3-kernen og ml.m5.large som hurtigstart-instanstypen til at køre notebook-koden. Denne instanstype er betydeligt hurtigere til at skabe et miljø.

Træningsjobbet vil blive kørt i en ml.g4dn.xlarge instans som defineret i config.yaml fil:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txt requirements.txt filafhængigheder til at køre funktionen til træning af Hugging Face-modellen inkluderer følgende:

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Hugging Face-notebooken viser, hvordan du kører træningen eksternt via @remote funktion, som køres synkront. Derfor vil funktionen, der kører til træning af modellen, vente, indtil SageMaker Training-jobbet er fuldført. Træningen vil blive kørt eksternt med en GPU-instans, hvor instanstypen er defineret i den foregående konfigurationsfil.

Når du har kørt træningsjobbet, kan du køre resten af cellerne i notesbogen for at inspicere evalueringsmetrikken og klassificere teksten på vores trænede model.

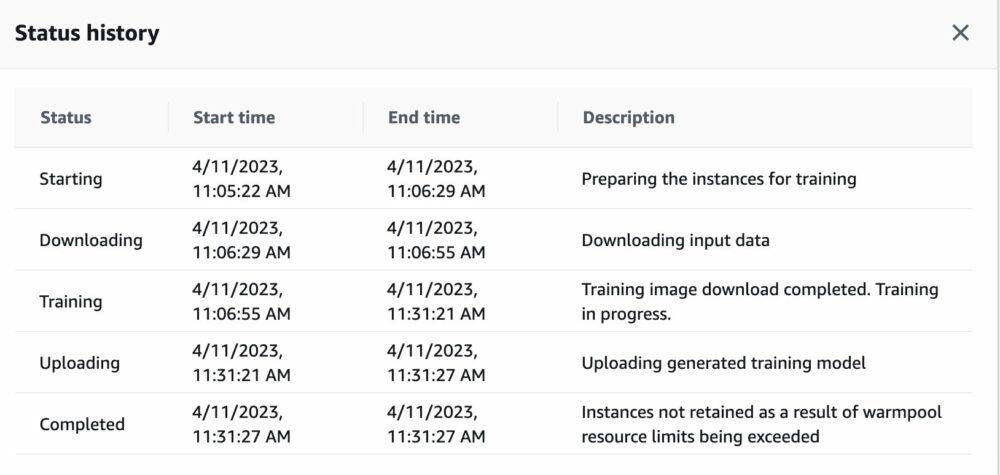

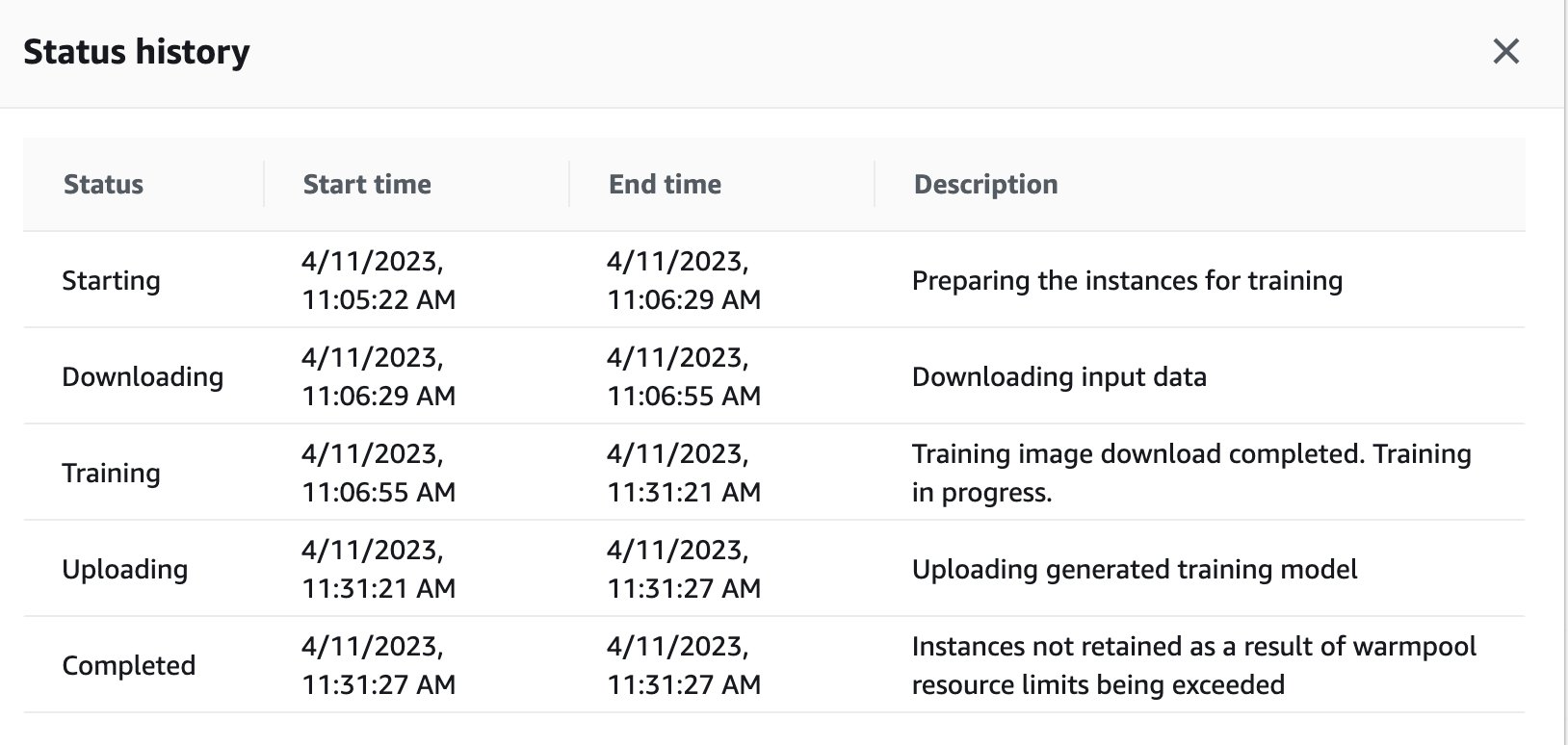

Du kan også se status for træningsjob, der blev fjernudløst i GPU-forekomsten på SageMaker-dashboardet ved at navigere tilbage til SageMaker-konsollen.

Så snart træningsopgaven er fuldført, fortsætter den med at køre instruktionerne i notesbogen til evaluering og klassificering. Lignende job kan trænes og køres via fjernudførelsesfunktionen, der er indlejret i Studio-notebooks, for at udføre kørslerne asynkront.

Integration med SageMaker-eksperimenter inde i en @remote-funktion

Du kan overføre dit eksperimentnavn, kørselsnavn og andre parametre til din fjernfunktion for at oprette en SageMaker-eksperimentkørsel. Følgende kodeeksempel importerer eksperimentnavnet, navnet på kørslen og de parametre, der skal logges for hver kørsel:

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") I det foregående eksempel er parametrene p1 , p2 logges over tid inde i en træningsløkke. Fælles parametre kan omfatte batchstørrelse eller epoker. I eksemplet metrics A , B logges til et løb over tid inde i en træningsløkke. Almindelige målinger kan omfatte nøjagtighed eller tab. For mere information, se Opret et Amazon SageMaker-eksperiment.

Konklusion

I dette indlæg introducerede vi en ny SageMaker Python SDK-funktion, der gør det muligt for datavidenskabsfolk at køre deres ML-kode i deres foretrukne IDE som SageMaker Training-job. Vi diskuterede de nødvendige forudsætninger for at bruge denne funktion sammen med dens funktioner. Vi viste også, hvordan du bruger denne funktion i Studio, SageMaker notebook-forekomster og din lokale IDE. Derudover har vi givet eksempler på kode for at demonstrere, hvordan man bruger denne funktion. Som et næste trin anbefaler vi at prøve denne funktion i din IDE eller SageMaker ved at følge kodeeksempler refereret i dette indlæg.

Om forfatterne

Dipankar Patro er softwareudviklingsingeniør hos AWS SageMaker, der innoverer og bygger MLOps-løsninger for at hjælpe kunder med at adoptere AI/ML-løsninger i stor skala. Han har en MS i datalogi og hans interesseområder er computersikkerhed, distribuerede systemer og AI/ML.

Dipankar Patro er softwareudviklingsingeniør hos AWS SageMaker, der innoverer og bygger MLOps-løsninger for at hjælpe kunder med at adoptere AI/ML-løsninger i stor skala. Han har en MS i datalogi og hans interesseområder er computersikkerhed, distribuerede systemer og AI/ML.

Farooq Sabir er senior specialist i kunstig intelligens og maskinlæringsløsninger hos AWS. Han har ph.d.- og MS-grader i elektroteknik fra University of Texas i Austin og en MS i datalogi fra Georgia Institute of Technology. Han har over 15 års erhvervserfaring og kan også lide at undervise og vejlede universitetsstuderende. Hos AWS hjælper han kunder med at formulere og løse deres forretningsproblemer inden for datavidenskab, maskinlæring, computersyn, kunstig intelligens, numerisk optimering og relaterede domæner. Baseret i Dallas, Texas, elsker han og hans familie at rejse og tage på lange roadtrips.

Farooq Sabir er senior specialist i kunstig intelligens og maskinlæringsløsninger hos AWS. Han har ph.d.- og MS-grader i elektroteknik fra University of Texas i Austin og en MS i datalogi fra Georgia Institute of Technology. Han har over 15 års erhvervserfaring og kan også lide at undervise og vejlede universitetsstuderende. Hos AWS hjælper han kunder med at formulere og løse deres forretningsproblemer inden for datavidenskab, maskinlæring, computersyn, kunstig intelligens, numerisk optimering og relaterede domæner. Baseret i Dallas, Texas, elsker han og hans familie at rejse og tage på lange roadtrips.

Manoj Ravi er Senior Product Manager for Amazon SageMaker. Han brænder for at bygge næste generations AI-produkter og arbejder på software og værktøjer for at gøre maskinlæring i stor skala nemmere for kunderne. Han har en MBA fra Haas School of Business og en Master i Information Systems Management fra Carnegie Mellon University. I sin fritid nyder Manoj at spille tennis og dyrke landskabsfotografering.

Manoj Ravi er Senior Product Manager for Amazon SageMaker. Han brænder for at bygge næste generations AI-produkter og arbejder på software og værktøjer for at gøre maskinlæring i stor skala nemmere for kunderne. Han har en MBA fra Haas School of Business og en Master i Information Systems Management fra Carnegie Mellon University. I sin fritid nyder Manoj at spille tennis og dyrke landskabsfotografering.

Shikhar Kwatra er en AI/ML Specialist Solutions Architect hos Amazon Web Services, der arbejder med en førende global systemintegrator. Han har opnået titlen som en af de yngste indiske mesteropfindere med over 500 patenter inden for AI/ML og IoT-domænerne. Shikhar hjælper med at arkitekture, bygge og vedligeholde omkostningseffektive, skalerbare cloudmiljøer for organisationen og understøtter GSI-partneren med at bygge strategiske industriløsninger på AWS. Shikhar nyder at spille guitar, komponere musik og øve mindfulness i sin fritid.

Shikhar Kwatra er en AI/ML Specialist Solutions Architect hos Amazon Web Services, der arbejder med en førende global systemintegrator. Han har opnået titlen som en af de yngste indiske mesteropfindere med over 500 patenter inden for AI/ML og IoT-domænerne. Shikhar hjælper med at arkitekture, bygge og vedligeholde omkostningseffektive, skalerbare cloudmiljøer for organisationen og understøtter GSI-partneren med at bygge strategiske industriløsninger på AWS. Shikhar nyder at spille guitar, komponere musik og øve mindfulness i sin fritid.

Vikram Elango er en Sr. AI/ML Specialist Solutions Architect hos AWS, baseret i Virginia, USA. Han er i øjeblikket fokuseret på generativ AI, LLM'er, prompt engineering, optimering af store modelslutninger og skalering af ML på tværs af virksomheder. Vikram hjælper finans- og forsikringsbranchens kunder med design og tankelederskab med at bygge og implementere maskinlæringsapplikationer i stor skala. I sin fritid nyder han at rejse, vandre, lave mad og campere.

Vikram Elango er en Sr. AI/ML Specialist Solutions Architect hos AWS, baseret i Virginia, USA. Han er i øjeblikket fokuseret på generativ AI, LLM'er, prompt engineering, optimering af store modelslutninger og skalering af ML på tværs af virksomheder. Vikram hjælper finans- og forsikringsbranchens kunder med design og tankelederskab med at bygge og implementere maskinlæringsapplikationer i stor skala. I sin fritid nyder han at rejse, vandre, lave mad og campere.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :har

- :er

- :ikke

- $OP

- 1

- 10

- 100

- 15 år

- 500

- 7

- a

- evne

- I stand

- Om

- adgang

- Konto

- nøjagtighed

- opnået

- tværs

- aktiv

- handlinger

- tilføje

- tilføje

- Desuden

- admin

- administratorer

- vedtage

- fremskreden

- Fordel

- AI

- AI / ML

- hjælpemidler

- Alle

- tillader

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analysere

- ,

- annoncerede

- enhver

- applikationer

- ER

- områder

- argumenter

- kunstig

- kunstig intelligens

- Kunstig intelligens og maskinlæring

- AS

- forbundet

- At

- austin

- automatisk

- til rådighed

- AWS

- tilbage

- bund

- baseret

- BE

- fordele

- Budgetter

- bygge

- Bygning

- virksomhed

- by

- CAN

- kapaciteter

- fange

- Carnegie Mellon

- bære

- tilfælde

- Celler

- lave om

- Ændringer

- kanaler

- valg

- klasse

- klassificering

- Klassificere

- Cloud

- kode

- kodebase

- Kollegium

- kommer

- Fælles

- kompatibel

- fuldføre

- Compute

- computer

- Datalogi

- Computersikkerhed

- Computer Vision

- Konceptet

- Konfiguration

- Konsol

- indeholder

- Container

- indeholder

- sammenhænge

- fortsætter

- Core

- Koste

- kunne

- dæksel

- skabe

- For øjeblikket

- Kunder

- tilpasse

- Dallas

- instrumentbræt

- data

- databehandling

- datalogi

- datasæt

- erklærer

- Standard

- defaults

- definerede

- demonstrere

- demonstrerer

- Afhængighed

- indsætte

- beskrevet

- Design

- detaljer

- udviklet

- Udvikler

- Udvikling

- forskellige

- drøftet

- distribueret

- distribuerede systemer

- distribueret træning

- Domæner

- færdig

- Dont

- i løbet af

- e

- hver

- optjent

- brugervenlighed

- lettere

- nemt

- enten

- indlejret

- muliggør

- kryptering

- ende til ende

- ingeniør

- Engineering

- Ingeniører

- virksomheder

- indrejse

- Miljø

- miljøer

- epoke

- epoker

- evaluering

- Hver

- eksempel

- eksempler

- udførelse

- eksisterende

- erfaring

- eksperiment

- Ansigtet

- bekendt

- familie

- FAST

- hurtigere

- Feature

- Funktionalitet

- få

- File (Felt)

- Filer

- finansielle

- Fornavn

- Fleksibilitet

- Fokus

- fokuserede

- efter

- Til

- Framework

- fra

- fuldt ud

- funktion

- funktioner

- Endvidere

- fremtiden

- Futures

- generative

- Generativ AI

- Georgien

- given

- Global

- Go

- GPU

- Gruppens

- Have

- he

- hjælpe

- hjælper

- hans

- besidder

- Hvordan

- How To

- HTML

- http

- HTTPS

- KrammerFace

- Identity

- if

- billede

- implementering

- importere

- import

- in

- omfatter

- Herunder

- indiske

- industrien

- oplysninger

- Informationssystemer

- Infrastruktur

- fornyelse

- indgang

- installeret

- instans

- Institut

- anvisninger

- forsikring

- integreret

- Integrerer

- Intelligens

- interesse

- ind

- indføre

- introduceret

- Opfindere

- tingenes internet

- IT

- iterationer

- ITS

- Job

- Karriere

- jpg

- lige

- Nøgle

- lab

- landskab

- laptops

- stor

- storstilet

- seneste

- lancere

- lanceret

- lancering

- Leadership" (virkelig menneskelig ledelse)

- førende

- LÆR

- læring

- lad

- Lets

- biblioteker

- Bibliotek

- livscyklus

- ligesom

- synes godt om

- Line (linje)

- lokale

- lokalt

- placeret

- log

- logget

- Lang

- UDSEENDE

- off

- kærlighed

- maskine

- machine learning

- lavet

- Vedligeholdelse

- lave

- maerker

- lykkedes

- ledelse

- leder

- Master

- Kan..

- Mellon

- Metode

- Metrics

- Mindfulness

- mindste

- minutter

- ML

- MLOps

- tilstand

- model

- modeller

- Moduler

- mere

- mest

- bevæge sig

- MS

- flere

- Musik

- navn

- nemlig

- navigering

- Behov

- behov

- netværk

- netværk

- Ny

- næste

- noder

- notesbog

- nu

- bedøvet

- objekter

- of

- on

- Ombord

- engang

- ONE

- kun

- åbent

- open source

- optimering

- or

- ordrer

- organisation

- OS

- Andet

- vores

- ud

- output

- i løbet af

- overstyring

- pakke

- pakker

- pandaer

- Parallel

- parametre

- særlig

- partner

- passerer

- gennemløb

- Passing

- lidenskabelige

- Patenter

- sti

- ydeevne

- fotografering

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Punkt

- Indlæg

- foretrækkes

- forudsætninger

- tidligere

- Problem

- problemer

- forarbejdning

- Produkt

- produktchef

- produktiv

- Produkter

- forudsat

- Python

- pytorch

- klar

- nylige

- for nylig

- anbefaler

- relaterede

- frigive

- fjern

- erstatte

- Repository

- påkrævet

- Krav

- REST

- afkast

- vej

- roller

- roller

- Kør

- kører

- sagemaker

- skalerbar

- Scale

- skalering

- Skole

- Videnskab

- forskere

- scikit-lære

- SDK

- problemfrit

- Sektion

- sektioner

- sikkerhed

- se

- senior

- adskille

- Tjenester

- Session

- sæt

- indstilling

- indstillinger

- setup

- flere

- bør

- Vis

- udstillingsvindue

- vist

- Shows

- betydeligt

- lignende

- Simpelt

- ganske enkelt

- enkelt

- Størrelse

- lille

- Snapshot

- So

- Software

- softwareudvikling

- Løsninger

- SOLVE

- specialist

- specifikke

- specifikation

- specificeret

- starte

- Starter

- Status

- Trin

- opbevaring

- Strategisk

- Studerende

- Studio

- indsende

- undernet

- sådan

- Understøttet

- Understøtter

- systemet

- Systemer

- Tag

- tager

- tager

- opgaver

- hold

- Teknologier

- tensorflow

- Texas

- Tekstklassificering

- at

- deres

- Them

- derefter

- Der.

- derved

- derfor

- Disse

- de

- denne

- tænkte

- tænkt lederskab

- Gennem

- tid

- Titel

- til

- værktøjer

- fakkel

- mod

- Tog

- uddannet

- Kurser

- transformers

- rejse

- Traveling

- udløst

- typen

- typisk

- under

- forstå

- universitet

- Opdatering

- us

- brug

- brug tilfælde

- anvendte

- brugere

- ved brug af

- værdi

- Værdier

- udgave

- via

- Specifikation

- Virginia

- vision

- vs

- vs kode

- vente

- ønsker

- we

- web

- webservices

- hvornår

- som

- mens

- vilje

- med

- inden for

- Arbejde

- arbejder

- virker

- ville

- wrap

- Indpakket

- skriver

- skriv kode

- skriftlig

- X

- år

- Du

- yngste

- Din

- zephyrnet