Machine learning (ML) revolutionerer løsninger på tværs af brancher og driver nye former for indsigt og intelligens fra data. Mange ML-algoritmer træner over store datasæt, generaliserer mønstre, de finder i dataene og udleder resultater fra disse mønstre, efterhånden som nye usete registreringer behandles. Normalt, hvis datasættet eller modellen er for stor til at blive trænet på en enkelt forekomst, distribueret træning giver mulighed for, at flere instanser inden for en klynge kan bruges og distribuere enten data eller modelpartitioner på tværs af disse instanser under træningsprocessen. Indbygget støtte til distribueret træning tilbydes gennem Amazon SageMaker SDK, sammen med eksempel notesbøger i populære rammer.

Men nogle gange på grund af sikkerheds- og fortrolighedsbestemmelser inden for eller på tværs af organisationer, er dataene decentraliseret på tværs af flere konti eller i forskellige regioner, og de kan ikke centraliseres til én konto eller på tværs af regioner. I dette tilfælde bør fødereret læring (FL) overvejes for at få en generaliseret model på hele data.

I dette indlæg diskuterer vi, hvordan man implementerer fødereret læring på Amazon SageMaker for at køre ML med decentraliserede træningsdata.

Hvad er fødereret læring?

Federated learning er en ML-tilgang, der giver mulighed for flere separate træningssessioner, der løber parallelt for at løbe på tværs af store grænser, for eksempel geografisk, og aggregere resultaterne for at bygge en generaliseret model (global model) i processen. Mere specifikt bruger hver træningssession sit eget datasæt og får sin egen lokale model. Lokale modeller i forskellige træningssessioner vil blive aggregeret (for eksempel modelvægtsammenlægning) til en global model under træningsprocessen. Denne tilgang står i modsætning til centraliserede ML-teknikker, hvor datasæt flettes til en træningssession.

Fødereret læring vs. distribueret træning i skyen

Når disse to tilgange kører på skyen, foregår distribueret træning i én region på én konto, og træningsdata starter med en centraliseret træningssession eller job. Under den distribuerede træningsproces bliver datasættet opdelt i mindre delmængder, og afhængigt af strategien (dataparallelisme eller modelparallelisme) sendes delsæt til forskellige træningsknuder eller går gennem noder i en træningsklynge, hvilket betyder, at individuelle data ikke nødvendigvis ophold i en knude i klyngen.

I modsætning hertil, med fødereret læring, foregår træning normalt på flere separate konti eller på tværs af regioner. Hver konto eller region har sine egne træningsinstanser. Træningsdataene er decentraliseret på tværs af konti eller regioner fra begyndelsen til slutningen, og individuelle data læses kun af dens respektive træningssession eller job mellem forskellige konti eller regioner under den fødererede læringsproces.

Blomsterforbundet læringsramme

Adskillige open source-rammer er tilgængelige for fødereret læring, som f.eks SKÆBNE, Flower, PySyft, OpenFL, FedML, NVFlareog Tensorflow Federated. Når vi vælger et FL-framework, overvejer vi normalt dets understøttelse af modelkategori, ML-framework og enhed eller operativsystem. Vi er også nødt til at overveje FL-rammernes udvidelsesmuligheder og pakkestørrelse for at køre det effektivt i skyen. I dette indlæg vælger vi en let udvidelsesbar, tilpasselig og let ramme, Flower, til at udføre FL-implementeringen ved hjælp af SageMaker.

Flower er en omfattende FL-ramme, der adskiller sig fra eksisterende rammer ved at tilbyde nye faciliteter til at køre store FL-eksperimenter og muliggør rigt heterogene FL-enhedsscenarier. FL løser udfordringer relateret til databeskyttelse og skalerbarhed i scenarier, hvor deling af data ikke er muligt.

Designprincipper og implementering af Flower FL

Flower FL er sprogagnostisk og ML framework-agnostisk af design, er fuldt ud udvidelsesbar og kan inkorporere nye algoritmer, træningsstrategier og kommunikationsprotokoller. Flower er open source under Apache 2.0-licens.

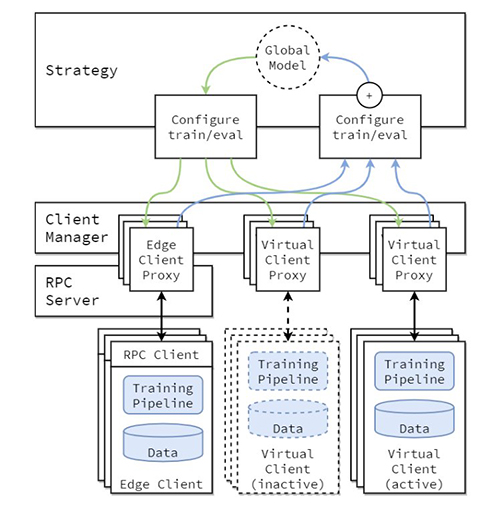

Den konceptuelle arkitektur af FL-implementeringen er beskrevet i papiret Blomst: En venlig fødereret læringsramme og er fremhævet i den følgende figur.

I denne arkitektur lever edge-klienter på rigtige edge-enheder og kommunikerer med serveren over RPC. Virtuelle klienter bruger på den anden side tæt på nul ressourcer, når de er inaktive, og indlæser kun model og data i hukommelsen, når klienten bliver udvalgt til træning eller evaluering.

Flower-serveren bygger strategien og konfigurationerne, der skal sendes til Flower-klienterne. Det serialiserer disse konfigurationsordbøger (eller config dict for kort) til deres ProtoBuf-repræsentation, transporterer dem til klienten ved hjælp af gRPC og deserialiserer dem derefter tilbage til Python-ordbøger.

Flower FL strategier

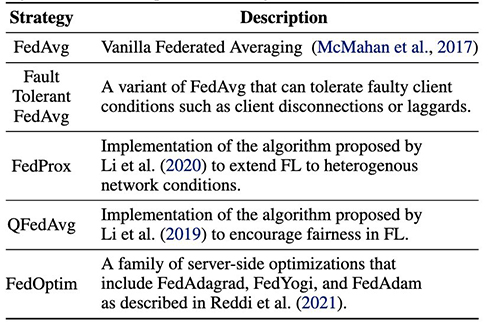

Flower giver mulighed for tilpasning af læringsprocessen gennem strategi abstraktion. Strategien definerer hele føderationsprocessen, der specificerer parameterinitialisering (uanset om det er server- eller klientinitialiseret), det mindste antal tilgængelige klienter, der kræves for at initialisere en kørsel, vægten af klientens bidrag og trænings- og evalueringsdetaljer.

Flower har en omfattende implementering af FL-gennemsnitsalgoritmer og en robust kommunikationsstak. For en liste over implementerede gennemsnitsalgoritmer og tilhørende forskningspapirer henvises til følgende tabel fra Blomst: En venlig fødereret læringsramme.

Fødereret læring med SageMaker: Løsningsarkitektur

En fødereret læringsarkitektur, der bruger SageMaker med Flower-rammen, er implementeret oven på tovejs gRPC (fundament)-strømme. gRPC definerer de typer meddelelser, der udveksles, og bruger compilere til derefter at generere effektiv implementering til Python, men den kan også generere implementeringen til andre sprog, såsom Java eller C++.

Flower-klienterne modtager instruktioner (beskeder) som råbyte-arrays via netværket. Derefter deserialiserer klienterne og kører instruktionen (træning i lokale data). Resultaterne (modelparametre og vægte) serialiseres derefter og kommunikeres tilbage til serveren.

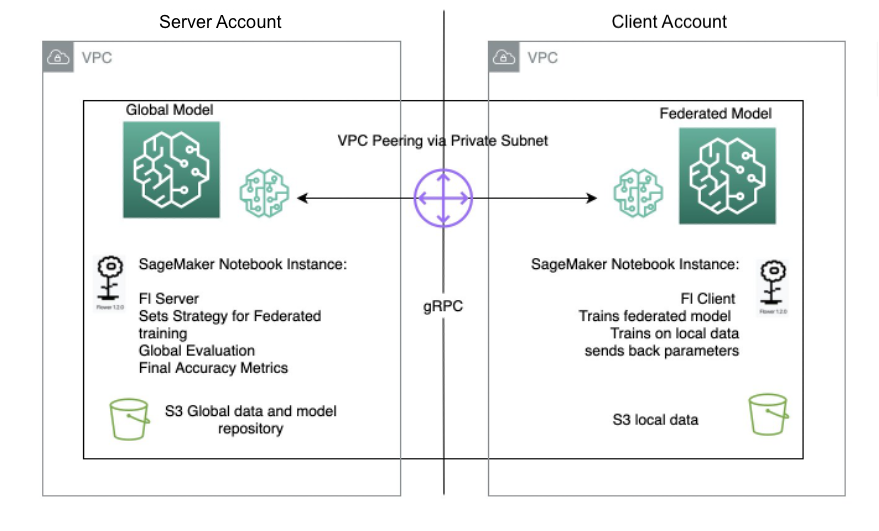

Server/klient-arkitekturen for Flower FL er defineret i SageMaker ved hjælp af notebook-forekomster på forskellige konti i samme region som Flower-serveren og Flower-klienten. Trænings- og evalueringsstrategierne defineres på serveren såvel som de globale parametre, derefter serialiseres konfigurationen og sendes til klienten via VPC-peering.

Notebook-instansklienten starter et SageMaker-træningsjob, der kører et brugerdefineret script for at udløse instansieringen af Flower-klienten, som deserialiserer og læser serverkonfigurationen, udløser træningsjobbet og sender parametersvaret.

Det sidste trin opstår på serveren, når evalueringen af de nyligt aggregerede parametre udløses ved afslutning af antallet af kørsler og klienter, der er fastsat i serverstrategien. Evalueringen finder sted på et testdatasæt, der kun eksisterer på serveren, og de nye forbedrede nøjagtighedsmålinger produceres.

Følgende diagram illustrerer arkitekturen af FL-opsætningen på SageMaker med Flower-pakken.

Implementer fødereret læring ved hjælp af SageMaker

SageMaker er en fuldt administreret ML-tjeneste. Med SageMaker kan dataforskere og udviklere hurtigt bygge og træne ML-modeller og derefter implementere dem i et produktionsklart hostet miljø.

I dette indlæg demonstrerer vi, hvordan man bruger den administrerede ML-platform til at levere et notebook-oplevelsesmiljø og udføre fødereret læring på tværs af AWS-konti ved hjælp af SageMaker-uddannelsesjob. De rå træningsdata forlader aldrig den konto, der ejer dataene, og kun de afledte vægte sendes på tværs af peerforbindelsen.

Vi fremhæver følgende kernekomponenter i dette indlæg:

- netværk – SageMaker giver mulighed for hurtig opsætning af standard netværkskonfiguration samtidig med, at du kan tilpasse netværket fuldt ud afhængigt af din organisations krav. Vi bruger en VPC peering konfiguration inden for regionen i dette eksempel.

- Indstillinger for adgang på tværs af konti – For at give en bruger på serverkontoen mulighed for at starte et modeloplæringsjob på klientkontoen, har vi delegere adgang på tværs af konti ved brug af AWS identitets- og adgangsstyring (IAM) roller. På denne måde behøver en bruger på serverkontoen ikke at logge ud af kontoen og logge ind på klientkontoen for at udføre handlinger på SageMaker. Denne indstilling er kun med det formål at starte SageMaker-uddannelsesjob, og den har ingen adgangstilladelse eller deling af data på tværs af konti.

- Implementering af fødereret læringsklientkode i klientkontoen og serverkode i serverkontoen – Vi implementerer fødereret læringsklientkode på klientkontoen ved at bruge Flower-pakken og SageMaker-administreret træning. I mellemtiden implementerer vi serverkode i serverkontoen ved at bruge Flower-pakken.

Opsæt VPC-peering

En VPC-peering-forbindelse er en netværksforbindelse mellem to VPC'er, der giver dig mulighed for at dirigere trafik mellem dem ved hjælp af private IPv4-adresser eller IPv6-adresser. Forekomster i begge VPC kan kommunikere med hinanden, som om de er inden for det samme netværk.

For at oprette en VPC-peering-forbindelse skal du først oprette en anmodning om at peere med en anden VPC. Du kan anmode om en VPC-peering-forbindelse med en anden VPC på den samme konto, eller i vores brugstilfælde, oprette forbindelse til en VPC på en anden AWS-konto. For at aktivere anmodningen skal ejeren af VPC'et acceptere anmodningen. For flere detaljer om VPC-peering, se Opret en VPC-peering-forbindelse.

Start SageMaker notebook-forekomster i VPC'er

En SageMaker notebook-instans leverer en Jupyter notebook-app gennem en fuldt administreret ML Amazon Elastic Compute Cloud (Amazon EC2) forekomst. SageMaker Jupyter-notebooks bruges til at udføre avanceret dataudforskning, skabe træningsjob, implementere modeller til SageMaker-hosting og teste eller validere dine modeller.

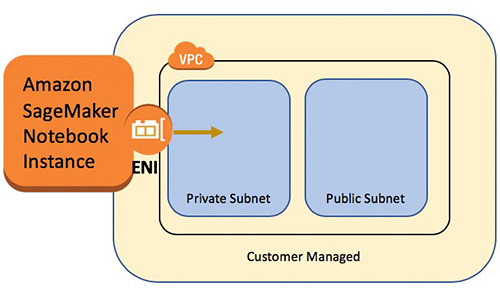

Notebook-instansen har en række tilgængelige netværkskonfigurationer. I denne opsætning kører vi notebook-forekomsten i et privat undernet af VPC'en og har ikke direkte internetadgang.

Konfigurer indstillinger for adgang på tværs af konti

Indstillinger for adgang på tværs af konti omfatter to trin til at delegere adgang fra serverkontoen til klientkontoen ved at bruge IAM-roller:

- Opret en IAM-rolle på klientkontoen.

- Giv adgang til rollen på serverkontoen.

For detaljerede trin til opsætning af et lignende scenario, se Deleger adgang på tværs af AWS-konti ved hjælp af IAM-roller.

På klientkontoen opretter vi en IAM-rolle kaldet FL-kickoff-client-job med politikken FL-sagemaker-actions knyttet til rollen. Det FL-sagemaker-actions politik har JSON-indhold som følger:

Vi ændrer derefter tillidspolitikken i tillidsforholdet FL-kickoff-client-job rolle:

I serverkontoen tilføjes tilladelser til en eksisterende bruger (f.eks. developer) for at tillade skift til FL-kickoff-client-job rolle i kundekonto. For at gøre dette opretter vi en inline politik kaldet FL-allow-kickoff-client-job og fastgør den til brugeren. Følgende er JSON-politikkens indhold:

Prøvedatasæt og dataforberedelse

I dette indlæg bruger vi en kurateret datasæt til afsløring af svindel i Medicare-udbyderes data udgivet af Centers for Medicare & Medicaid Services (CMS). Data er opdelt i et træningsdatasæt og et testdatasæt. Da størstedelen af dataene ikke er svig, anvender vi SMOTE at balancere træningsdatasættet og yderligere opdele træningsdatasættet i trænings- og valideringsdele. Både trænings- og valideringsdata uploades til en Amazon Simple Storage Service (Amazon S3)-bøtte til modeltræning i klientkontoen, og testdatasættet bruges kun til testformål på serverkontoen. Detaljer om dataforberedelseskoden er i det følgende notesbog.

Med SageMaker forudbyggede Docker-billeder til scikit-learn-rammen og SageMaker-styret træningsproces træner vi en logistisk regressionsmodel på dette datasæt ved hjælp af fødereret læring.

Implementer en fødereret læringsklient i klientkontoen

I klientkontoens SageMaker notebook-instans forbereder vi en client.py manuskript og en utils.py manuskript. Det client.py filen indeholder kode til klienten, og utils.py filen indeholder kode til nogle af de hjælpefunktioner, der er nødvendige for vores træning. Vi bruger scikit-learn-pakken til at bygge den logistiske regressionsmodel.

In client.py, definerer vi en blomsterklient. Klienten stammer fra klassen fl.client.NumPyClient. Det skal definere følgende tre metoder:

- get_parameters – Det returnerer de aktuelle lokale modelparametre. Hjælpefunktionen

get_model_parametersvil gøre dette. - passer – Den definerer trinene til at træne modellen på træningsdataene på kundens konto. Den modtager også globale modelparametre og andre konfigurationsoplysninger fra serveren. Vi opdaterer den lokale models parametre ved hjælp af de modtagne globale parametre og fortsætter med at træne den på datasættet på klientkontoen. Denne metode sender også den lokale models parametre efter træning, størrelsen af træningssættet og en ordbog, der kommunikerer vilkårlige værdier tilbage til serveren.

- evaluere – Den evaluerer de angivne parametre ved hjælp af valideringsdataene på klientkontoen. Det returnerer tabet sammen med andre detaljer såsom størrelsen af valideringssættet og nøjagtigheden tilbage til serveren.

Følgende er et kodestykke til Flower-klientdefinitionen:

Vi bruger derefter SageMaker script-tilstand at forberede resten af client.py fil. Dette inkluderer at definere parametre, der vil blive videregivet til SageMaker-træning, indlæsning af trænings- og valideringsdata, initialisering og træning af modellen på klienten, opsætning af Flower-klienten til at kommunikere med serveren og til sidst lagring af den trænede model.

utils.py indeholder nogle få hjælpefunktioner, der kaldes ind client.py:

- get_model_parameters – Det returnerer scikit-learn Logistisk regression model parametre.

- set_model_params – Den sætter modellens parametre.

- set_initial_params – Den initialiserer modellens parametre som nuller. Dette er påkrævet, fordi serveren beder om indledende modelparametre fra klienten ved lancering. Men i scikit-learn-rammen,

LogisticRegressionmodelparametre initialiseres ikke førmodel.fit()Hedder. - indlæs_data – Den indlæser trænings- og testdata.

- gem_model – Det sparer model som en

.joblibfil.

Fordi Flower ikke er en pakke installeret i SageMaker forudbygget scikit-learn Docker container, lister vi flwr==1.3.0 i en requirements.txt fil.

Vi lægger alle tre filer (client.py, utils.pyog requirements.txt) under en mappe og tær zip den. .tar.gz-filen (navngivet source.tar.gz i dette indlæg) uploades derefter til en S3-bøtte på klientkontoen.

Implementer en fødereret læringsserver i serverkontoen

I serverkontoen forbereder vi kode på en Jupyter notesbog. Dette omfatter to dele: Serveren påtager sig først en rolle for at starte et træningsjob på klientkontoen, derefter forbinder serveren modellen ved hjælp af Flower.

Påtag en rolle til at køre træningsjobbet på klientkontoen

Vi bruger Boto3 Python SDK at oprette en AWS Security Token Service (AWS STS) klient til at påtage sig FL-kickoff-client-job rolle og oprette en SageMaker-klient for at køre et træningsjob på klientkontoen ved at bruge SageMaker-administrerede træningsproces:

Ved at bruge den påtagne rolle opretter vi et SageMaker træningsjob på kundekonto. Træningsjobbet bruger SageMaker indbyggede scikit-learn-ramme. Bemærk, at alle S3-buckets og SageMaker IAM-rollen i følgende kodestykke er relateret til klientkontoen:

Aggreger lokale modeller til en global model ved hjælp af Flower

Vi forbereder kode til at føderere modellen på serveren. Dette inkluderer at definere strategien for føderation og dens initialiseringsparametre. Vi bruger hjælpefunktioner i utils.py script beskrevet tidligere for at initialisere og indstille modelparametre. Flower giver dig mulighed for at definere dine egne tilbagekaldsfunktioner for at tilpasse en eksisterende strategi. Vi bruger FedGns strategi med tilpassede tilbagekald til evaluering og tilpasningskonfiguration. Se følgende kode:

De følgende to funktioner er nævnt i det foregående kodestykke:

- fit_round – Det bruges til at sende det runde nummer til kunden. Vi videregiver dette tilbagekald som

on_fit_config_fnstrategiens parameter. Vi gør dette blot for at demonstrere brugen afon_fit_config_fnparameter. - get_evaluate_fn – Det bruges til modelevaluering på serveren.

Til demoformål bruger vi testdatasættet, som vi sætter til side i dataforberedelsen, til at evaluere modellen, der er forbundet fra klientens konto, og kommunikere resultatet tilbage til klienten. Det er dog værd at bemærke, at i næsten alle reelle brugstilfælde er de data, der bruges på serverkontoen, ikke opdelt fra det datasæt, der bruges på klientkontoen.

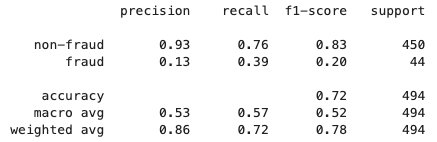

Efter den fødererede læringsproces er afsluttet, a model.tar.gz filen gemmes af SageMaker som en modelartefakt i en S3-bøtte på klientkontoen. I mellemtiden, a model.joblib filen gemmes på SageMaker notebook-instansen på serverkontoen. Til sidst bruger vi testdatasættet til at teste den endelige model (model.joblib) på serveren. Testoutput af den endelige model er som følger:

Ryd op

Når du er færdig, skal du rydde op i ressourcerne på både serverkontoen og klientkontoen for at undgå yderligere gebyrer:

- Stop SageMaker-notebook-forekomsterne.

- Slet VPC-peering-forbindelser og tilsvarende VPC'er.

- Tøm og slet den S3-bøtte, du oprettede til datalagring.

Konklusion

I dette indlæg gennemgik vi, hvordan man implementerer fødereret læring på SageMaker ved at bruge Flower-pakken. Vi viste, hvordan man konfigurerer VPC-peering, konfigurerer adgang på tværs af konti og implementerer FL-klienten og serveren. Dette indlæg er nyttigt for dem, der har brug for at træne ML-modeller på SageMaker ved hjælp af decentraliserede data på tværs af konti med begrænset datadeling. Fordi FL i dette indlæg er implementeret ved hjælp af SageMaker, er det værd at bemærke, at mange flere funktioner i SageMaker kan bringes ind i processen.

Implementering af fødereret læring på SageMaker kan drage fordel af alle de avancerede funktioner, som SageMaker leverer gennem ML-livscyklussen. Der er andre måder at opnå eller anvende fødereret læring på AWS Cloud, såsom at bruge EC2-instanser eller på kanten. For detaljer om disse alternative tilgange henvises til Fødereret læring på AWS med FedML , Anvendelse af Federated Learning til ML på kanten.

Om forfatterne

Sherry Ding er senior AI/ML-specialistløsningsarkitekt hos Amazon Web Services (AWS). Hun har stor erfaring med maskinlæring med en ph.d.-grad i datalogi. Hun arbejder hovedsageligt med kunder i den offentlige sektor om forskellige AI/ML-relaterede forretningsudfordringer, og hjælper dem med at accelerere deres maskinlæringsrejse på AWS Cloud. Når hun ikke hjælper kunder, nyder hun udendørsaktiviteter.

Sherry Ding er senior AI/ML-specialistløsningsarkitekt hos Amazon Web Services (AWS). Hun har stor erfaring med maskinlæring med en ph.d.-grad i datalogi. Hun arbejder hovedsageligt med kunder i den offentlige sektor om forskellige AI/ML-relaterede forretningsudfordringer, og hjælper dem med at accelerere deres maskinlæringsrejse på AWS Cloud. Når hun ikke hjælper kunder, nyder hun udendørsaktiviteter.

Lorea Arrizabalaga er en Solutions Architect tilpasset den britiske offentlige sektor, hvor hun hjælper kunder med at designe ML-løsninger med Amazon SageMaker. Hun er også en del af Technical Field Community dedikeret til hardwareacceleration og hjælper med at teste og benchmarke AWS Inferentia og AWS Trainium-arbejdsbelastninger.

Lorea Arrizabalaga er en Solutions Architect tilpasset den britiske offentlige sektor, hvor hun hjælper kunder med at designe ML-løsninger med Amazon SageMaker. Hun er også en del af Technical Field Community dedikeret til hardwareacceleration og hjælper med at teste og benchmarke AWS Inferentia og AWS Trainium-arbejdsbelastninger.

Ben Snively er en AWS Public Sector Senior Principal Specialist Solutions Architect. Han arbejder med offentlige, non-profit- og uddannelseskunder på big data, analytiske og AI/ML-projekter og hjælper dem med at bygge løsninger ved hjælp af AWS.

Ben Snively er en AWS Public Sector Senior Principal Specialist Solutions Architect. Han arbejder med offentlige, non-profit- og uddannelseskunder på big data, analytiske og AI/ML-projekter og hjælper dem med at bygge løsninger ved hjælp af AWS.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Automotive/elbiler, Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- ChartPrime. Løft dit handelsspil med ChartPrime. Adgang her.

- BlockOffsets. Modernisering af miljømæssig offset-ejerskab. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/machine-learning-with-decentralized-training-data-using-federated-learning-on-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 11

- 12

- 15 %

- 24

- 25

- 500

- 7

- a

- Om

- fremskynde

- Acceptere

- adgang

- Konto

- Konti

- nøjagtighed

- opnå

- tværs

- Handling

- aktioner

- aktiviteter

- tilføjet

- Yderligere

- adresser

- fremskreden

- Fordel

- Efter

- aggregat

- aggregering

- AI / ML

- algoritmer

- justeret

- Alle

- tillade

- tillade

- tillader

- sammen

- også

- alternativ

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- Analytisk

- ,

- En anden

- enhver

- Apache

- app

- Indløs

- tilgang

- tilgange

- arkitektur

- ER

- AS

- forbundet

- antage

- antaget

- antager

- At

- vedhæfte

- til rådighed

- gennemsnit

- undgå

- AWS

- AWS-inferens

- tilbage

- Balance

- BE

- fordi

- før

- Begyndelse

- være

- benchmarking

- mellem

- Big

- Big data

- både

- grænser

- bragte

- bygge

- bygger

- indbygget

- virksomhed

- men

- by

- C + +

- kaldet

- CAN

- tilfælde

- tilfælde

- Boligtype

- centraliseret

- udfordringer

- afgifter

- Vælg

- vælge

- klasse

- kunde

- kunder

- Luk

- Cloud

- Cluster

- cms

- kode

- kommunikere

- kommunikere

- Kommunikation

- samfund

- færdiggørelse

- komponenter

- omfattende

- Compute

- computer

- Datalogi

- konceptuelle

- betingelse

- Konfiguration

- Tilslut

- tilsluttet

- tilslutning

- Tilslutninger

- Overvej

- betragtes

- forbruge

- indeholder

- indhold

- fortsæt

- kontrast

- bidrag

- Core

- Tilsvarende

- skabe

- oprettet

- Legitimationsoplysninger

- Nuværende

- skik

- Kunder

- tilpasses

- tilpasning

- tilpasse

- data

- dataadgang

- Dataforberedelse

- databeskyttelse

- datadeling

- data opbevaring

- datasæt

- decentral

- dedikeret

- Standard

- definere

- definerede

- definerer

- definere

- definition

- Degree

- demo

- demonstrere

- Afhængigt

- indsætte

- Afledt

- beskrevet

- Design

- detaljeret

- detaljer

- Detektion

- udviklere

- enhed

- Enheder

- forskellige

- direkte

- diskutere

- distribuere

- distribueret

- distribueret træning

- do

- Docker

- Er ikke

- færdig

- Dont

- kørsel

- grund

- i løbet af

- hver

- tidligere

- nemt

- Edge

- Uddannelse

- effekt

- effektiv

- effektivt

- enten

- smergel

- muliggør

- ende

- Hele

- Miljø

- evaluere

- evaluering

- eksempel

- udveksles

- eksisterende

- erfaring

- eksperimenter

- udforskning

- omfattende

- Omfattende oplevelse

- faciliteter

- Funktionalitet

- Føderation

- få

- felt

- Figur

- File (Felt)

- Filer

- endelige

- Endelig

- fund

- Fornavn

- passer

- efter

- følger

- Til

- formularer

- Foundation

- Framework

- rammer

- bedrageri

- bedrageri afsløring

- venlige

- fra

- fuldt ud

- funktion

- funktioner

- yderligere

- generere

- få

- Global

- Go

- Regering

- hånd

- sker

- Hardware

- Have

- he

- hjælpe

- hjælper

- Fremhæv

- Fremhævet

- hostede

- Hosting

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- Identity

- if

- illustrerer

- billeder

- gennemføre

- implementering

- implementeret

- forbedret

- in

- inaktive

- omfatter

- omfatter

- indarbejde

- individuel

- industrier

- oplysninger

- initial

- indsigt

- installeret

- instans

- anvisninger

- Intelligens

- grænseflade

- Internet

- Internetadgang

- ind

- IT

- ITS

- selv

- Java

- Job

- Karriere

- rejse

- jpg

- json

- l2

- Sprog

- stor

- storstilet

- Efternavn

- lancere

- læring

- Licens

- livscyklus

- letvægt

- Liste

- leve

- belastning

- lastning

- belastninger

- lokale

- off

- Lot

- maskine

- machine learning

- hovedsageligt

- Flertal

- lykkedes

- mange

- midler

- I mellemtiden

- Medicare

- Hukommelse

- nævnte

- beskeder

- metode

- metoder

- Metrics

- minimum

- ML

- model

- modeller

- ændre

- mere

- flere

- skal

- Som hedder

- indfødte

- nødvendigvis

- Behov

- behov

- behov

- netværk

- netværk

- aldrig

- Ny

- nyligt

- næste

- node

- noder

- non-profit

- notesbog

- bemærke

- nummer

- of

- tilbydes

- tilbyde

- on

- ONE

- kun

- open source

- drift

- or

- ordrer

- organisationer

- Andet

- vores

- ud

- output

- i løbet af

- egen

- ejer

- ejer

- pakke

- Papir

- papirer

- Parallel

- parameter

- parametre

- del

- dele

- passerer

- Bestået

- mønstre

- peer

- Udfør

- tilladelse

- Tilladelser

- phd

- Place

- perron

- plato

- Platon Data Intelligence

- PlatoData

- politik

- Populær

- mulig

- Indlæg

- forberedelse

- Forbered

- Main

- principper

- Beskyttelse af personlige oplysninger

- private

- behandle

- Behandlet

- produceret

- projekter

- protokoller

- give

- forudsat

- giver

- offentlige

- formål

- sætte

- Python

- Hurtig

- hurtigt

- Raw

- Læs

- ægte

- modtage

- modtaget

- modtager

- optegnelser

- region

- regioner

- regler

- relaterede

- Relationer

- frigivet

- repræsentation

- anmode

- påkrævet

- Krav

- forskning

- ressource

- Ressourcer

- dem

- svar

- REST

- begrænset

- resultere

- Resultater

- afkast

- afkast

- Revolutionerende

- robust

- roller

- roller

- rod

- rundt

- runder

- R

- Kør

- kører

- løber

- sagemaker

- samme

- besparelse

- Skalerbarhed

- scenarie

- scenarier

- Videnskab

- forskere

- scikit-lære

- SDK

- sektor

- sikkerhed

- sikkerhedsbogstav

- se

- valgt

- SELV

- send

- sender

- senior

- sendt

- adskille

- tjeneste

- Tjenester

- Session

- sessioner

- sæt

- sæt

- indstilling

- indstillinger

- setup

- deling

- hun

- Kort

- bør

- viste

- underskrive

- lignende

- Simpelt

- ganske enkelt

- enkelt

- Størrelse

- mindre

- uddrag

- So

- løsninger

- Løsninger

- Løser

- nogle

- specialist

- specifikt

- delt

- stable

- står

- starte

- Starter

- starter

- Statement

- forblive

- Trin

- Steps

- opbevaring

- strategier

- Strategi

- vandløb

- subnet

- undernet

- sådan

- support

- systemet

- bord

- Tag

- tager

- Teknisk

- teknikker

- tensorflow

- prøve

- Test

- at

- UK

- deres

- Them

- derefter

- Der.

- Disse

- de

- denne

- dem

- tre

- Gennem

- til

- sammen

- token

- også

- top

- Trafik

- Tog

- uddannet

- Kurser

- udløse

- udløst

- Stol

- to

- typer

- Uk

- under

- indtil

- Opdatering

- uploadet

- på

- brug

- brug tilfælde

- anvendte

- Bruger

- bruger

- ved brug af

- sædvanligvis

- nytte

- VALIDATE

- validering

- Værdier

- række

- forskellige

- udgave

- via

- Virtual

- vs

- gik

- Vej..

- måder

- we

- web

- webservices

- vægt

- GODT

- hvornår

- hvorvidt

- som

- mens

- WHO

- Hele

- vilje

- med

- inden for

- virker

- værd

- Du

- Din

- zephyrnet

- nul

- Zip