Da maschinelles Lernen (ML) zum Mainstream wird und eine breitere Akzeptanz findet, werden ML-gestützte Inferenzanwendungen immer häufiger zur Lösung einer Reihe komplexer Geschäftsprobleme eingesetzt. Die Lösung dieser komplexen Geschäftsprobleme erfordert häufig die Verwendung mehrerer ML-Modelle und -Schritte. In diesem Beitrag erfahren Sie, wie Sie eine ML-Anwendung mit benutzerdefinierten Containern erstellen und hosten Amazon Sage Maker.

Amazon SageMaker-Angebote eingebaute Algorithmen und vorgefertigter SageMaker Docker-Images für die Modellbereitstellung. Wenn diese jedoch nicht Ihren Anforderungen entsprechen, können Sie Ihre eigenen Container (BYOC) zum Hosten auf Amazon SageMaker mitbringen.

Es gibt mehrere Anwendungsfälle, in denen Benutzer möglicherweise BYOC für das Hosting auf Amazon SageMaker benötigen.

- Benutzerdefinierte ML-Frameworks oder -Bibliotheken: Wenn Sie vorhaben, ein ML-Framework oder Bibliotheken zu verwenden, die nicht von den integrierten Algorithmen oder vorgefertigten Containern von Amazon SageMaker unterstützt werden, müssen Sie einen benutzerdefinierten Container erstellen.

- Spezialisierte Modelle: Für bestimmte Domänen oder Branchen benötigen Sie möglicherweise spezielle Modellarchitekturen oder maßgeschneiderte Vorverarbeitungsschritte, die in den integrierten Amazon SageMaker-Angeboten nicht verfügbar sind.

- Proprietäre Algorithmen: Wenn Sie Ihre eigenen proprietären Algorithmen intern entwickelt haben, benötigen Sie einen benutzerdefinierten Container, um sie auf Amazon SageMaker bereitzustellen.

- Komplexe Inferenz-Pipelines: Wenn Ihr ML-Inferenz-Workflow eine benutzerdefinierte Geschäftslogik umfasst – eine Reihe komplexer Schritte, die in einer bestimmten Reihenfolge ausgeführt werden müssen – kann BYOC Ihnen dabei helfen, diese Schritte effizienter zu verwalten und zu orchestrieren.

Lösungsüberblick

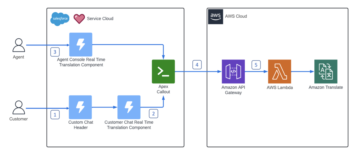

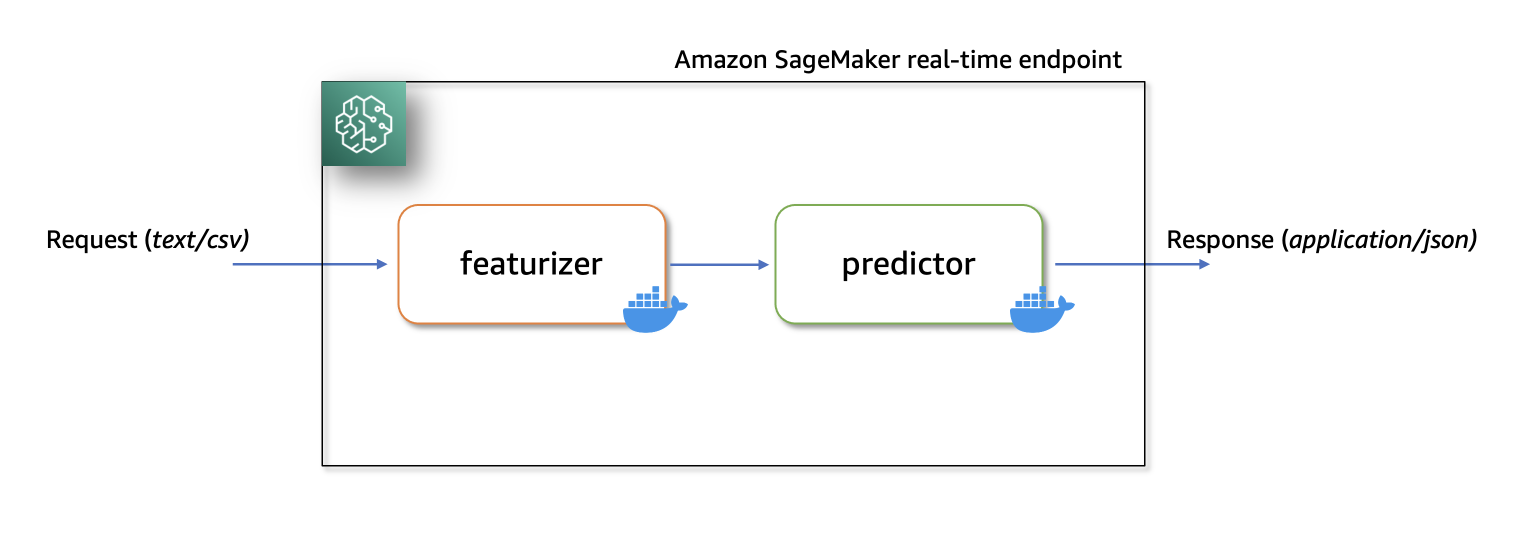

In dieser Lösung zeigen wir, wie Sie eine serielle ML-Inferenzanwendung auf Amazon SageMaker mit Echtzeitendpunkten unter Verwendung von zwei benutzerdefinierten Inferenzcontainern mit der neuesten Version hosten scikit-learn und xgboost Pakete.

Der erste Container verwendet a scikit-learn Modell zur Umwandlung von Rohdaten in funktionsfähige Spalten. Es gilt Standardskala für numerische Spalten und OneHotEncoder zu kategorischen.

Der zweite Container beherbergt ein vorab trainiertes XGboost Modell (d. h. Prädiktor). Das Prädiktormodell akzeptiert die vorgestellten Eingabe- und Ausgabevorhersagen.

Zuletzt stellen wir die bereit Featureizer und Anzeichen in einer seriellen Inferenzpipeline zu einem Amazon SageMaker-Echtzeitendpunkt.

Hier sind einige verschiedene Überlegungen dazu, warum Sie möglicherweise separate Container in Ihrer Inferenzanwendung haben möchten.

- Die Entkoppelung – Verschiedene Schritte der Pipeline haben einen klar definierten Zweck und müssen aufgrund der zugrunde liegenden Abhängigkeiten auf separaten Containern ausgeführt werden. Dies trägt auch dazu bei, die Pipeline gut strukturiert zu halten.

- Frameworks – Verschiedene Schritte der Pipeline verwenden spezifische zweckdienliche Frameworks (z. B. scikit oder Spark ML) und müssen daher auf separaten Containern ausgeführt werden.

- Ressourcenisolation – Verschiedene Schritte der Pipeline haben unterschiedliche Ressourcenverbrauchsanforderungen und müssen daher für mehr Flexibilität und Kontrolle in separaten Containern ausgeführt werden.

- Wartung und Upgrades – Aus betrieblicher Sicht fördert dies die funktionale Isolation und Sie können einzelne Schritte weiterhin viel einfacher nachrüsten oder ändern, ohne dass andere Modelle davon betroffen sind.

Darüber hinaus hilft die lokale Erstellung der einzelnen Container beim iterativen Entwicklungs- und Testprozess mit bevorzugten Tools und integrierten Entwicklungsumgebungen (IDEs). Sobald die Container bereit sind, können Sie sie zur Inferenz mithilfe von Amazon SageMaker-Endpunkten in der AWS-Cloud bereitstellen.

Die vollständige Implementierung, einschließlich Codeausschnitten, ist in diesem Github-Repository verfügbar hier.

Voraussetzungen:

Da wir diese benutzerdefinierten Container zunächst lokal testen, muss Docker Desktop auf Ihrem lokalen Computer installiert sein. Sie sollten mit dem Erstellen von Docker-Containern vertraut sein.

Sie benötigen außerdem ein AWS-Konto mit Zugriff auf Amazon SageMaker, Amazon ECR und Amazon S3, um diese Anwendung durchgängig testen zu können.

Stellen Sie sicher, dass Sie die neueste Version von haben Boto3 und die installierten Amazon SageMaker Python-Pakete:

Lösungsdurchgang

Erstellen Sie einen benutzerdefinierten Featurer-Container

Um den ersten Container, den Featurizer-Container, zu erstellen, trainieren wir a scikit-learn Modell zur Verarbeitung von Rohmerkmalen im Seeohr Datensatz. Das Vorverarbeitungsskript verwendet SimpleImputer zum Umgang mit fehlenden Werten, Standardskala zum Normalisieren numerischer Spalten und OneHotEncoder zum Transformieren kategorialer Spalten. Nach dem Einbau des Transformators speichern wir das Modell Joblib Format. Anschließend komprimieren wir dieses gespeicherte Modellartefakt und laden es in einen Amazon Simple Storage Service hoch (Amazon S3) Eimer.

Hier ist ein Beispielcodeausschnitt, der dies demonstriert. Beziehen auf featurizer.ipynb zur vollständigen Umsetzung:

Um als Nächstes einen benutzerdefinierten Inferenzcontainer für das Featurizer-Modell zu erstellen, erstellen wir ein Docker-Image mit Nginx-, Gunicorn- und Flask-Paketen sowie anderen erforderlichen Abhängigkeiten für das Featurizer-Modell.

Als Modell-Serving-Stack dienen Nginx, Gunicorn und die Flask-App auf Amazon SageMaker-Echtzeitendpunkten.

Wenn wir benutzerdefinierte Container zum Hosten auf Amazon SageMaker bereitstellen, müssen wir sicherstellen, dass das Inferenzskript die folgenden Aufgaben ausführt, nachdem es im Container gestartet wurde:

- Laden des Modells: Inferenzskript (

preprocessing.py) sollte sich beziehen auf/opt/ml/modelVerzeichnis, um das Modell in den Container zu laden. Modellartefakte in Amazon S3 werden heruntergeladen und im Container im Pfad bereitgestellt/opt/ml/model. - Umgebungsvariablen: Um benutzerdefinierte Umgebungsvariablen an den Container zu übergeben, müssen Sie diese während des angeben Modell Erstellungsschritt oder während Endpunkt Entstehung aus einem Ausbildungsberuf.

- API-Anforderungen: Das Inferenzskript muss beides implementieren

/pingund/invocationsRouten als Flask-Anwendung. Der/pingDie API wird für Gesundheitsprüfungen verwendet, während die/invocationsDie API verarbeitet Inferenzanfragen. - Protokollierung: Ausgabeprotokolle im Inferenzskript müssen in die Standardausgabe geschrieben werden (stdout) und Standardfehler (stderr) Streams. Diese Protokolle werden dann gestreamt Amazon CloudWatch von Amazon SageMaker.

Hier ist ein Ausschnitt aus preprocessing.py die die Umsetzung zeigen /ping und /invocations.

Beziehen auf Vorverarbeitung.py im Featurizer-Ordner für die vollständige Implementierung.

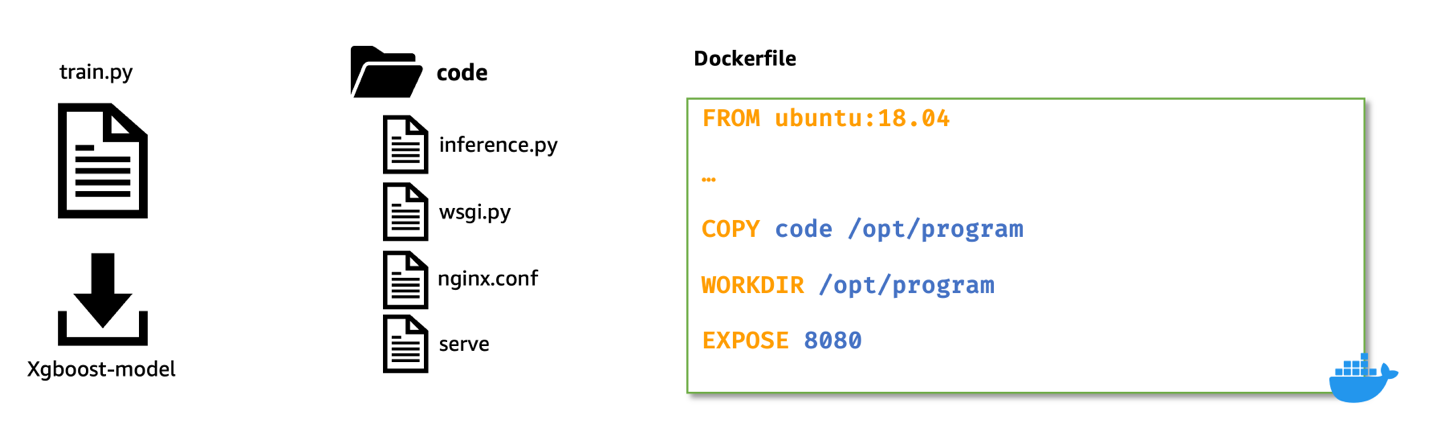

Erstellen Sie ein Docker-Image mit Featurizer und Modell-Serving-Stack

Lassen Sie uns nun eine Docker-Datei mit einem benutzerdefinierten Basis-Image erstellen und die erforderlichen Abhängigkeiten installieren.

Hierfür verwenden wir python:3.9-slim-buster als Basisbild. Sie können jedes andere Basis-Image ändern, das für Ihren Anwendungsfall relevant ist.

Anschließend kopieren wir die Nginx-Konfiguration, die Webserver-Gateway-Datei von Gunicorn und das Inferenzskript in den Container. Wir erstellen außerdem ein Python-Skript namens „serve“, das Nginx- und Gunicorn-Prozesse im Hintergrund startet und das Inferenzskript (d. h. die Flask-Anwendung „preprocessing.py“) als Einstiegspunkt für den Container festlegt.

Hier ist ein Ausschnitt der Docker-Datei zum Hosten des Featurizer-Modells. Die vollständige Implementierung finden Sie unter Dockerfile für Featureizer -Ordner.

Testen Sie das benutzerdefinierte Inferenzbild lokal mit dem Featurizer

Erstellen und testen Sie nun den benutzerdefinierten Inferenzcontainer mit Featurizer lokal mit Amazon Lokaler SageMaker-Modus. Der lokale Modus eignet sich perfekt zum Testen Ihrer Verarbeitungs-, Trainings- und Inferenzskripte, ohne Jobs auf Amazon SageMaker zu starten. Nachdem Sie die Ergebnisse Ihrer lokalen Tests bestätigt haben, können Sie die Trainings- und Inferenzskripte mit minimalen Änderungen problemlos für die Bereitstellung auf Amazon SageMaker anpassen.

Um das benutzerdefinierte Featurizer-Image lokal zu testen, erstellen Sie zunächst das Image unter Verwendung der zuvor definierten Dockerfile. Starten Sie dann einen Container, indem Sie das Verzeichnis bereitstellen, das das Featurizer-Modell enthält (preprocess.joblib) zum /opt/ml/model Verzeichnis im Container. Ordnen Sie außerdem Port 8080 vom Container zum Host zu.

Nach dem Start können Sie Inferenzanfragen an senden http://localhost:8080/invocations.

Um den Container zu erstellen und zu starten, öffnen Sie ein Terminal und führen Sie die folgenden Befehle aus.

Beachten Sie, dass Sie das ersetzen sollten <IMAGE_NAME>, wie im folgenden Code gezeigt, mit dem Bildnamen Ihres Containers.

Der folgende Befehl geht ebenfalls davon aus, dass der trainierte scikit-learn Modell (preprocess.joblib) befindet sich in einem Verzeichnis namens models.

Nachdem der Container betriebsbereit ist, können wir beide testen /Klingeln und /invocations Routen mithilfe von Curl-Befehlen.

Führen Sie die folgenden Befehle von einem Terminal aus

Wenn rohe (untransformierte) Daten an gesendet werden http://localhost:8080/invocations, antwortet der Endpunkt mit transformierten Daten.

Die Antwort sollte in etwa wie folgt aussehen:

Wir beenden nun den laufenden Container und markieren dann das lokale benutzerdefinierte Image und übertragen es in eine private Amazon Elastic Container Registry (Amazon ECR) Repository.

Sehen Sie sich die folgenden Befehle an, um sich bei Amazon ECR anzumelden, wodurch das lokale Bild mit dem vollständigen Amazon ECR-Bildpfad markiert und das Bild dann an Amazon ECR übertragen wird. Stellen Sie sicher, dass Sie ersetzen region und account Variablen, die zu Ihrer Umgebung passen.

Beziehen auf Erstellen Sie ein Repository und Übertragen Sie ein Bild an Amazon ECR AWS-Befehlszeilenschnittstelle (AWS-CLI)-Befehle für weitere Informationen.

Optionaler Schritt

Optional können Sie einen Live-Test durchführen, indem Sie das Featurizer-Modell mit dem benutzerdefinierten Docker-Image in Amazon ECR auf einem Echtzeit-Endpunkt bereitstellen. Beziehen auf featurizer.ipynb Notebook für die vollständige Implementierung des Erstellens, Testens und Übertragens des benutzerdefinierten Images an Amazon ECR.

Amazon SageMaker initialisiert den Inferenzendpunkt und kopiert die Modellartefakte in den /opt/ml/model Verzeichnis im Container. Sehen So lädt SageMaker Ihre Modellartefakte.

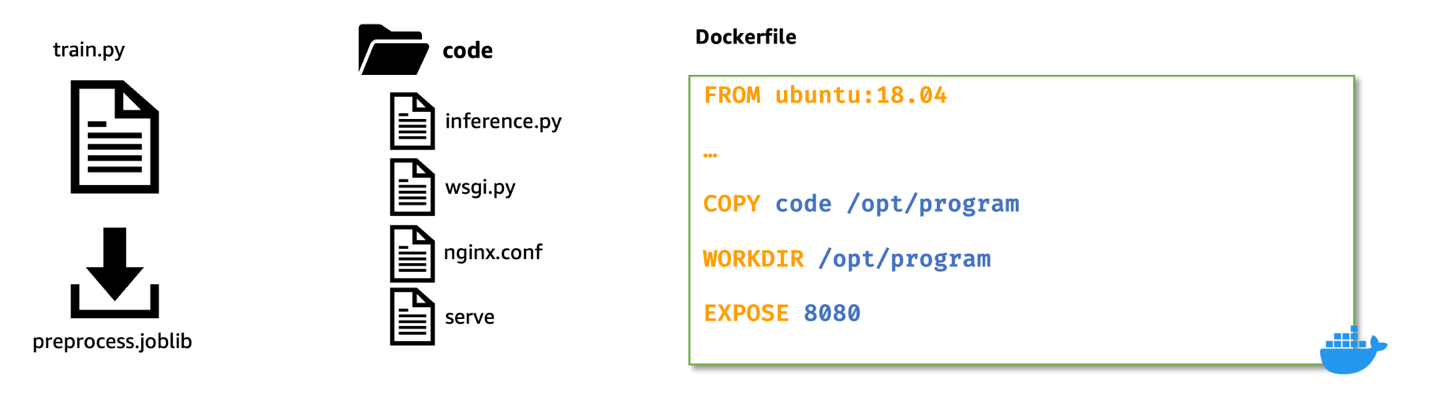

Erstellen Sie einen benutzerdefinierten XGBoost-Vorhersagecontainer

Zum Erstellen des XGBoost-Inferenzcontainers folgen wir ähnlichen Schritten wie beim Erstellen des Images für den Featurizer-Container:

- Vorab trainiert herunterladen

XGBoostModell von Amazon S3. - erstellen Sie

inference.pySkript, das das vorab trainierte lädtXGBoostModell, konvertiert die vom Featurizer empfangenen transformierten Eingabedaten und konvertiert inXGBoost.DMatrixFormat, läuftpredictauf dem Booster und gibt Vorhersagen im JSON-Format zurück. - Skripte und Konfigurationsdateien, die den Modellbereitstellungsstapel bilden (d. h.

nginx.conf,wsgi.pyundservebleibt gleich und bedarf keiner Änderung. - Wir verwenden

Ubuntu:18.04als Basis-Image für die Docker-Datei. Dies ist keine Voraussetzung. Wir verwenden das Ubuntu-Basis-Image, um zu demonstrieren, dass Container mit jedem Basis-Image erstellt werden können. - Die Schritte zum Erstellen des Kunden-Docker-Images, zum lokalen Testen des Images und zum Übertragen des getesteten Images an Amazon ECR bleiben die gleichen wie zuvor.

Der Kürze halber, da die oben gezeigten Schritte ähnlich sind; Im Folgenden zeigen wir jedoch nur die geänderte Codierung.

Zuerst wird der inference.py Skript. Hier ist ein Ausschnitt, der die Implementierung von zeigt /ping und /invocations. Beziehen auf inference.py unter dem Anzeichen Ordner für die vollständige Implementierung dieser Datei.

Hier ist ein Ausschnitt der Docker-Datei zum Hosten des Vorhersagemodells. Die vollständige Implementierung finden Sie unter Dockerfile im Prädiktorordner.

Anschließend erstellen, testen und übertragen wir dieses benutzerdefinierte Prädiktor-Image weiter in ein privates Repository in Amazon ECR. Beziehen auf prädiktor.ipynb Notebook für die vollständige Implementierung des Erstellens, Testens und Übertragens des benutzerdefinierten Images an Amazon ECR.

Stellen Sie eine serielle Inferenzpipeline bereit

Nachdem wir sowohl die Featurizer- als auch die Prediktorbilder getestet und an Amazon ECR übertragen haben, laden wir nun unsere Modellartefakte in einen Amazon S3-Bucket hoch.

Dann erstellen wir zwei Modellobjekte: eines für das featurizer (dh preprocess.joblib) und andere für die predictor (dh xgboost-model), indem Sie die benutzerdefinierte Image-URI angeben, die wir zuvor erstellt haben.

Hier ist ein Ausschnitt, der das zeigt. Beziehen auf serial-inference-pipeline.ipynb für die vollständige Umsetzung.

Um diese Container nun seriell bereitzustellen, erstellen wir zunächst einen Pipeline-Modell Objekt und übergeben Sie die featurizer Modell und die predictor Modell in derselben Reihenfolge in ein Python-Listenobjekt umwandeln.

Dann rufen wir die .deploy() Methode auf der Pipeline-Modell Angabe des Instanztyps und der Instanzanzahl.

In dieser Phase stellt Amazon SageMaker die serielle Inferenzpipeline auf einem Echtzeit-Endpunkt bereit. Wir warten darauf, dass der Endpunkt erreicht ist InService.

Wir können den Endpunkt nun testen, indem wir einige Inferenzanfragen an diesen Live-Endpunkt senden.

Beziehen auf serial-inference-pipeline.ipynb für die vollständige Umsetzung.

Aufräumen

Nachdem Sie den Test abgeschlossen haben, befolgen Sie bitte die Anweisungen im Bereinigungsabschnitt des Notebooks, um die in diesem Beitrag bereitgestellten Ressourcen zu löschen und unnötige Kosten zu vermeiden. Beziehen auf Amazon SageMaker Preise Einzelheiten zu den Kosten der Inferenzinstanzen finden Sie hier.

Zusammenfassung

In diesem Beitrag habe ich gezeigt, wie wir mithilfe benutzerdefinierter Inferenzcontainer eine serielle ML-Inferenzanwendung erstellen und für Echtzeitendpunkte auf Amazon SageMaker bereitstellen können.

Diese Lösung zeigt, wie Kunden auf kosteneffiziente Weise ihre eigenen benutzerdefinierten Container zum Hosten auf Amazon SageMaker bereitstellen können. Mit der BYOC-Option können Kunden ihre ML-Anwendungen schnell erstellen und anpassen, um sie auf Amazon SageMaker bereitzustellen.

Wir empfehlen Ihnen, diese Lösung mit einem Datensatz auszuprobieren, der für die Key Performance Indicators (KPIs) Ihres Unternehmens relevant ist. Die gesamte Lösung finden Sie hier GitHub-Repository.

Bibliographie

Über den Autor

Praveen Chamarthi ist Senior AI/ML Specialist bei Amazon Web Services. Er hat eine Leidenschaft für KI/ML und alles rund um AWS. Er hilft Kunden in ganz Amerika, ML-Workloads effizient auf AWS zu skalieren, zu innovieren und zu betreiben. In seiner Freizeit liest Praveen gerne und mag Science-Fiction-Filme.

Praveen Chamarthi ist Senior AI/ML Specialist bei Amazon Web Services. Er hat eine Leidenschaft für KI/ML und alles rund um AWS. Er hilft Kunden in ganz Amerika, ML-Workloads effizient auf AWS zu skalieren, zu innovieren und zu betreiben. In seiner Freizeit liest Praveen gerne und mag Science-Fiction-Filme.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-and-deploy-ml-inference-applications-from-scratch-using-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 08

- 09

- 1

- 10

- 100

- 11

- 13

- 14

- 150

- 16

- 17

- 20

- 200

- 2023

- 25

- 28

- 30

- 500

- 7

- 8

- 87

- 9

- a

- Über Uns

- Akzeptieren

- Akzeptiert

- Zugang

- entsprechend

- Konto

- über

- automatisch

- zusätzlich

- Adoption

- beeinflussen

- Nach der

- AI / ML

- Algorithmen

- Alle

- entlang

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amerika

- an

- und

- jedem

- Bienen

- App

- Anwendung

- Anwendungen

- gilt

- Apr

- SIND

- Feld

- AS

- übernimmt

- At

- verfügbar

- vermeiden

- AWS

- Hintergrund

- Base

- basierend

- BE

- Werden

- Bevor

- Sein

- unten

- Körper

- Booster

- beide

- bringen

- Bringing

- bauen

- Building

- erbaut

- eingebaut

- bündeln

- Geschäft

- aber

- by

- rufen Sie uns an!

- namens

- CAN

- Häuser

- Fälle

- CAT

- sicher

- Übernehmen

- geändert

- Änderungen

- Gebühren

- aus der Ferne überprüfen

- Schecks

- Cloud

- Code

- Programmierung

- Kolonne

- Spalten

- COM

- gemeinsam

- Komplex

- Computer

- Konfiguration

- Sie

- Verbindung

- Überlegungen

- konstante

- konstruieren

- Verbrauch

- Container

- Behälter

- Inhalt

- Inhalt

- fortsetzen

- Smartgeräte App

- verkaufen

- Kosten

- könnte

- erstellen

- Erstellen

- Schaffung

- Referenzen

- Original

- Kunde

- Kunden

- technische Daten

- Datum

- definieren

- definiert

- zeigen

- zeigt

- Abhängigkeiten

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- setzt ein

- Desktop

- Details

- entschlossen

- entwickelt

- Entwicklung

- DICT

- DID

- anders

- Docker

- Domains

- erledigt

- Nicht

- zwei

- im

- e

- Früher

- leicht

- effizient

- sonst

- ermutigen

- End-to-End

- Endpunkt

- gewährleisten

- Ganz

- Eintrag

- Arbeitsumfeld

- Umgebungen

- Fehler

- etc

- Beispiel

- Außer

- Ausnahme

- ausgeführt

- vertraut

- Fashion

- Favorit

- Eigenschaften

- wenige

- Reichen Sie das

- Mappen

- Vorname

- passen

- passend zu

- Flexibilität

- folgen

- Folgende

- Aussichten für

- unten stehende Formular

- Format

- gefunden

- Unser Ansatz

- Gerüste

- für

- voller

- Funktion

- funktional

- Gewinne

- Tor

- bekommen

- GitHub

- GMT

- Goes

- Griff

- Griffe

- Handling

- Haben

- he

- Gesundheit

- Höhe

- Hilfe

- hilft

- seine

- Gastgeber

- Hosting

- Gastgeber

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- i

- if

- Image

- Bilder

- implementieren

- Implementierung

- importieren

- in

- Dazu gehören

- Einschließlich

- zunehmend

- Anzeigen

- Krankengymnastik

- Branchen

- Information

- Inhouse-

- wir innovieren

- Varianten des Eingangssignals:

- innerhalb

- installieren

- installiert

- Instanz

- Anleitung

- integriert

- Schnittstelle

- in

- beteiligt

- Isolierung

- IT

- Job

- Jobs

- jpg

- JSON

- Behalten

- Wesentliche

- Label

- neueste

- starten

- ins Leben gerufen

- startet

- Start

- lernen

- links

- Länge

- Bibliotheken

- Line

- Liste

- Gelistet

- leben

- Belastung

- Laden

- Belastungen

- aus einer regionalen

- örtlich

- Logik

- login

- liebt

- Maschine

- Maschinelles Lernen

- Mainstream

- MACHT

- Making

- verwalten

- Weise

- Karte

- Kennzeichen

- Spiel

- Kann..

- Methode

- könnte

- minimal

- Kommt demnächst...

- ML

- Model

- Modell

- für

- ändern

- mehr

- Filme

- viel

- mehrere

- sollen

- Name

- Namen

- Need

- Bedürfnisse

- nicht

- Andere

- Notizbuch

- jetzt an

- Anzahl

- numpig

- Objekt

- Objekte

- of

- Angebote

- Angebote

- vorgenommen,

- on

- einmal

- EINEM

- Einsen

- einzige

- auf zu

- XNUMXh geöffnet

- betreiben

- Betriebs-

- Option

- or

- Auftrag

- OS

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- besitzen

- Pakete

- Pandas

- Parameter

- besondere

- passieren

- leidenschaftlich

- Weg

- perfekt

- Ausführen

- Leistung

- führt

- Pipeline

- Plan

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- Points

- Post

- Prognose

- Prognosen

- Predictor

- Gegenwart

- vorher

- privat

- Probleme

- Prozessdefinierung

- anpassen

- Verarbeitung

- Prozessor

- fördert

- Eigentums-

- Zweck

- Push

- geschoben

- Schieben

- Python

- schnell

- erhöhen

- Angebot

- Roh

- Lesen Sie mehr

- bereit

- Echtzeit

- Received

- siehe

- Registratur

- relevant

- bleiben

- ersetzen

- Quelle

- Anforderung

- Zugriffe

- erfordern

- falls angefordert

- Voraussetzungen:

- erfordert

- Ressourcen

- Downloads

- Antwort

- Folge

- Die Ergebnisse

- Rückkehr

- Rückkehr

- Rückgabe

- Ring

- Straße

- Routen

- REIHE

- Führen Sie

- Laufen

- läuft

- sagemaker

- gleich

- Speichern

- Gerettet

- Skalieren

- Science-Fiction

- kratzen

- Skript

- Skripte

- Zweite

- Abschnitt

- sehen

- senden

- Sendung

- Senior

- geschickt

- getrennte

- seriell

- Modellreihe

- brauchen

- Server

- Lösungen

- Dienst

- Sitzung

- kompensieren

- Sets

- mehrere

- Geschlecht

- sollte

- erklären

- zeigte

- gezeigt

- Konzerte

- ähnlich

- Einfacher

- Schnipsel

- So

- Lösung

- LÖSEN

- einige

- etwas

- Spark

- Spezialist

- spezifisch

- Stapel

- Stufe

- Standard

- Standpunkt

- Status

- Schritt

- Shritte

- Lagerung

- gestreamt

- Ströme

- Schnur

- strukturierte

- Erfolgreich

- so

- Sun

- Unterstützte

- Unterstützung

- Unterstützt

- TAG

- zugeschnitten

- nimmt

- und Aufgaben

- Terminal

- Test

- getestet

- Testen

- Tests

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- deswegen

- Diese

- fehlen uns die Worte.

- Zeit

- zu

- Werkzeuge

- Training

- trainiert

- Ausbildung

- Transformieren

- verwandelt

- Transformator

- Transformer

- Transformieren

- versuchen

- Versuch

- XNUMX

- tippe

- Ubuntu

- für

- zugrunde liegen,

- unnötig

- mehr Stunden

- verwendbar

- -

- Anwendungsfall

- benutzt

- Nutzer

- verwendet

- Verwendung von

- Werte

- verschiedene

- Variieren

- verifizieren

- Version

- warten

- wollen

- wurde

- we

- Netz

- Web-Server

- Web-Services

- GUT

- welche

- während

- warum

- breiter

- werden wir

- mit

- .

- ohne

- Arbeitsablauf.

- arbeiten,

- geschrieben

- X

- XGBoost

- Du

- Ihr

- Zephyrnet