Die letzten Jahre haben ein erstaunliches Wachstum bei Deep-Learning-Neuronalen Netzen (DNNs) gezeigt. Dieses Wachstum zeigt sich in genaueren Modellen und eröffnet sogar neue Möglichkeiten mit generativer KI: große Sprachmodelle (LLMs), die natürliche Sprache synthetisieren, Text-zu-Bild-Generatoren und mehr. Diese erhöhten Fähigkeiten von DNNs gehen mit den Kosten für umfangreiche Modelle einher, deren Training erhebliche Rechenressourcen erfordert. Das verteilte Training löst dieses Problem mit zwei Techniken: Datenparallelität und Modellparallelität. Datenparallelität wird verwendet, um den Trainingsprozess über mehrere Knoten und Worker zu skalieren, und Modellparallelität teilt ein Modell auf und passt es an die vorgesehene Infrastruktur an. Amazon Sage Maker verteiltes Training Mit Jobs können Sie mit einem Klick (oder einem API-Aufruf) einen verteilten Rechencluster einrichten, ein Modell trainieren und das Ergebnis speichern Amazon Simple Storage-Service (Amazon S3) und fahren Sie den Cluster herunter, wenn er fertig ist. Darüber hinaus hat SageMaker im verteilten Schulungsbereich kontinuierlich Innovationen hervorgebracht, indem es Funktionen wie eingeführt hat heterogene Cluster und verteilte Schulungsbibliotheken für Datenparallelität und Modellparallelität.

Für ein effizientes Training in einer verteilten Umgebung müssen Hyperparameter angepasst werden. Ein gängiges Beispiel für eine bewährte Vorgehensweise beim Training auf mehreren GPUs ist das Multiplizieren der Batch- (oder Mini-Batch-)Größe mit der GPU-Nummer, um die gleiche Batch-Größe pro GPU beizubehalten. Die Anpassung von Hyperparametern wirkt sich jedoch häufig auf die Modellkonvergenz aus. Daher muss das verteilte Training drei Faktoren ausbalancieren: Verteilung, Hyperparameter und Modellgenauigkeit.

In diesem Beitrag untersuchen wir die Auswirkung von verteiltem Training auf die Konvergenz und deren Verwendung Automatische Modelloptimierung von Amazon SageMaker zur Feinabstimmung von Modellhyperparametern für verteiltes Training mithilfe von Datenparallelität.

Der in diesem Beitrag erwähnte Quellcode ist auf der zu finden GitHub-Repository (Eine m5.xlarge-Instanz wird empfohlen).

Skalieren Sie das Training von einer einzelnen auf eine verteilte Umgebung

Datenparallelität ist eine Möglichkeit, den Trainingsprozess auf mehrere Rechenressourcen zu skalieren und eine schnellere Trainingszeit zu erreichen. Bei der Datenparallelität werden die Daten auf die Rechenknoten aufgeteilt, und jeder Knoten berechnet die Gradienten basierend auf seiner Aufteilung und aktualisiert das Modell. Diese Aktualisierungen können mithilfe eines oder mehrerer Parameterserver asynchron, eins-zu-viele oder alle-zu-alle durchgeführt werden. Eine andere Möglichkeit kann die Verwendung eines AllReduce-Algorithmus sein. Beispielsweise kommuniziert beim Ring-Allreduce-Algorithmus jeder Knoten nur mit zwei seiner Nachbarknoten, wodurch die Gesamtdatenübertragungen reduziert werden. Weitere Informationen zu Parameterservern und Ring-Allreduce finden Sie unter Einfaches Starten des verteilten TensorFlow-Trainings mit Horovod oder Parameterservern in Amazon SageMaker. Im Hinblick auf die Datenpartitionierung, falls vorhanden n Rechenknoten, dann sollte jeder Knoten eine Teilmenge der Daten erhalten, ungefähr 1/n in Größe.

Um die Auswirkung des Scale-out-Trainings auf die Modellkonvergenz zu demonstrieren, führen wir zwei einfache Experimente durch:

Jedes Modelltraining wurde zweimal ausgeführt: auf einer einzelnen Instanz und verteilt auf mehrere Instanzen. Für das verteilte DNN-Training haben wir die Mini-Batch-Größe mit der Anzahl der Instanzen (vier) multipliziert, um die verteilten Prozessoren vollständig auszunutzen. Die folgende Tabelle fasst den Aufbau und die Ergebnisse zusammen.

| Problemtyp | Bildklassifizierung | Binäre Klassifizierung | ||

| Modell | DNN | XGBoost | ||

| Beispiel | ml.c4.xlarge | ml.m5.2xgroß | ||

| Datensatz |

(Beschriftete Bilder) |

Direktmarketing (tabellarische, numerische und vektorisierte Kategorien) |

||

| Validierungsmetrik | Genauigkeit | AUC | ||

| Epocs/Runden | 20 | 150 | ||

| Anzahl der Instanzen | 1 | 4 | 1 | 3 |

| Verteilungsart | N / A | Parameterserver | N / A | AllReduce |

| Trainingszeit (Minuten) | 8 | 3 | 3 | 1 |

| Endergebnis der Validierung | 0.97 | 0.11 | 0.78 | 0.63 |

Bei beiden Modellen wurde die Trainingszeit nahezu linear durch den Verteilungsfaktor reduziert. Allerdings erlitt die Modellkonvergenz einen deutlichen Rückgang. Dieses Verhalten ist für die beiden unterschiedlichen Modelle, die unterschiedlichen Recheninstanzen, die unterschiedlichen Verteilungsmethoden und die unterschiedlichen Datentypen konsistent. Warum wirkte sich die Verteilung des Trainingsprozesses auf die Modellgenauigkeit aus?

Es gibt eine Reihe von Theorien, die diesen Effekt zu erklären versuchen:

- Wenn Tensoraktualisierungen sehr umfangreich sind, kann der Datenverkehr zwischen Workern und dem Parameterserver überlastet werden. Daher leiden asynchrone Parameterserver aufgrund von Verzögerungen bei der Aktualisierung der Gewichtungen unter einer deutlich schlechteren Konvergenz [1].

- Eine zunehmende Chargengröße kann zu einer Überanpassung und einer schlechten Generalisierung führen und dadurch die Validierungsgenauigkeit verringern [2].

- Bei der asynchronen Aktualisierung von Modellparametern verwenden einige DNNs möglicherweise nicht die zuletzt aktualisierten Modellgewichte. Daher berechnen sie Farbverläufe auf der Grundlage von Gewichten, die einige Iterationen zurückliegen. Dies führt zu Übergewicht [3] und kann verschiedene Ursachen haben.

- Einige Hyperparameter sind modell- oder optimiererspezifisch. In der offiziellen XGBoost-Dokumentation heißt es beispielsweise, dass die

exactWert für dietree_modeHyperparameter unterstützt kein verteiltes Training, da XGBoost eine zeilenaufteilende Datenverteilung verwendet, während dieexactDie Baummethode arbeitet mit einem sortierten Spaltenformat. - Einige Forscher schlugen vor, dass die Konfiguration einer größeren Mini-Charge zu Gradienten mit geringerer Stochastik führen könnte. Dies kann passieren, wenn die Verlustfunktion lokale Minima und Sattelpunkte enthält und keine Änderung an der Schrittgröße vorgenommen wird, was dazu führen kann, dass die Optimierung in solchen lokalen Minima oder Sattelpunkten stecken bleibt [4].

Optimieren Sie für verteiltes Training

Unter Hyperparameteroptimierung (HPO) versteht man den Prozess der Suche und Auswahl einer Reihe von Hyperparametern, die für einen Lernalgorithmus optimal sind. SageMaker Automatic Model Tuning (AMT) stellt HPO als verwalteten Dienst bereit, indem es mehrere Trainingsjobs für den bereitgestellten Datensatz ausführt. SageMaker AMT durchsucht die von Ihnen angegebenen Bereiche der Hyperparameter und gibt die besten Werte zurück, gemessen anhand einer von Ihnen gewählten Metrik. Sie können SageMaker AMT mit den integrierten Algorithmen verwenden oder Ihre benutzerdefinierten Algorithmen und Container verwenden.

Die Optimierung für verteiltes Training unterscheidet sich jedoch vom herkömmlichen HPO, da nicht eine einzelne Instanz pro Trainingsjob gestartet wird, sondern jeder Job tatsächlich einen Cluster von Instanzen startet. Dies bedeutet eine größere Auswirkung auf die Kosten (insbesondere wenn man kostspielige GPU-beschleunigte Instanzen berücksichtigt, die typisch für DNN sind). Zusätzlich zu AMT-Grenzwerte, du könntest möglicherweise treffen Limits für SageMaker-Konten für die gleichzeitige Anzahl von Trainingsinstanzen. Schließlich kann das Starten von Clustern aufgrund der längeren Startzeit zu einem betrieblichen Mehraufwand führen. SageMaker AMT verfügt über spezielle Funktionen zur Behebung dieser Probleme. Hyperband mit Frühstopp Stellt sicher, dass gut funktionierende Hyperparameterkonfigurationen optimiert werden und solche mit schlechter Leistung automatisch gestoppt werden. Dies ermöglicht eine effiziente Nutzung der Schulungszeit und reduziert unnötige Kosten. Darüber hinaus unterstützt SageMaker AMT vollständig die Verwendung von Amazon EC2 Spot-Instances, wodurch die Optimierung möglich ist Schulungskosten bis zu 90 % über On-Demand-Instanzen. Im Hinblick auf lange Startzeiten verwendet SageMaker AMT automatisch Trainingsinstanzen innerhalb jedes Tuning-Jobs wieder und reduziert so die durchschnittliche Startzeit jedes einzelnen Ausbildungsauftrag um das 20-fache. Darüber hinaus sollten Sie folgen AMT-Best PracticesB. die Auswahl der relevanten Hyperparameter, ihrer geeigneten Bereiche und Skalen sowie der besten Anzahl gleichzeitiger Trainingsjobs und das Festlegen eines zufälligen Startwerts zur Reproduktion der Ergebnisse.

Im nächsten Abschnitt sehen wir diese Funktionen in Aktion, während wir einen AMT-Job anhand des zuvor besprochenen XGBoost-Beispiels konfigurieren, ausführen und analysieren.

Konfigurieren, ausführen und analysieren Sie einen Optimierungsjob

Wie bereits erwähnt, finden Sie den Quellcode auf der GitHub Repo. In den Schritten 1–5 laden wir die Daten herunter, bereiten sie vor und erstellen die xgb3 Schätzer (der verteilte XGBoost-Schätzer ist auf die Verwendung von drei Instanzen eingestellt), führen Sie die Trainingsjobs aus und beobachten Sie die Ergebnisse. In diesem Abschnitt beschreiben wir, wie Sie den Optimierungsjob für diesen Schätzer einrichten, vorausgesetzt, Sie haben die Schritte 1–5 bereits durchlaufen.

Ein Optimierungsjob berechnet optimale Hyperparameter für die von ihm gestarteten Trainingsjobs, indem er eine Metrik zur Leistungsbewertung verwendet. Du kannst Konfigurieren Sie Ihre eigene Metrik, den SageMaker basierend auf der von Ihnen konfigurierten und an ihn gesendeten Regex analysiert stdout, oder verwenden Sie die Metriken von Integrierte SageMaker-Algorithmen. In diesem Beispiel verwenden wir die integrierte XGBoost-Zielmetrik, daher müssen wir keinen regulären Ausdruck konfigurieren. Um die Modellkonvergenz zu optimieren, optimieren wir basierend auf der Validierungs-AUC-Metrik:

Wir optimieren sieben Hyperparameter:

- num_round – Anzahl der Boost-Runden während des Trainings.

- eta – Schrumpfung der Schrittgröße, die in Updates verwendet wird, um eine Überanpassung zu verhindern.

- Alpha – L1-Regularisierungsterm für Gewichte.

- min_child_weight – Mindestsumme des Instanzgewichts (Hessian), das bei einem Kind benötigt wird. Wenn der Baumpartitionierungsschritt zu einem Blattknoten führt, dessen Summe der Instanzgewichte kleiner ist als

min_child_weight, der Bauprozess verzichtet auf eine weitere Partitionierung. - maximale Tiefe – Maximale Tiefe eines Baumes.

- colsample_bylevel – Teilstichprobenverhältnis der Spalten für jede Aufteilung auf jeder Ebene. Diese Unterabtastung erfolgt einmal für jede neue Tiefenebene, die in einem Baum erreicht wird.

- colsample_bytree – Teilstichprobenverhältnis der Spalten beim Aufbau jedes Baums. Für jeden erstellten Baum erfolgt die Unterabtastung einmal.

Weitere Informationen zu XGBoost-Hyperparametern finden Sie unter XGBoost-Hyperparameter. Der folgende Code zeigt die sieben Hyperparameter und ihre Bereiche:

Als nächstes stellen wir die bereit Konfiguration für die Hyperband-Strategie und die Tuner-Objektkonfiguration mit dem SageMaker SDK. HyperbandStrategyConfig kann zwei Parameter verwenden: max_resource (optional) für die maximale Anzahl von Iterationen, die für einen Trainingsjob verwendet werden sollen, um das Ziel zu erreichen, und min_resource – die Mindestanzahl von Iterationen, die ein Trainingsjob verwenden muss, bevor das Training beendet wird. Wir gebrauchen HyperbandStrategyConfig konfigurieren StrategyConfig, der später von der Optimierungsjobdefinition verwendet wird. Siehe den folgenden Code:

Jetzt erstellen wir eine HyperparameterTuner Objekt, an das wir folgende Informationen weitergeben:

- Der XGBoost-Schätzer, der mit drei Instanzen ausgeführt werden soll

- Der Name und die Definition der objektiven Metrik

- Unsere Hyperparameterbereiche

- Optimieren Sie Ressourcenkonfigurationen, z. B. die Anzahl der insgesamt auszuführenden Trainingsjobs und die Anzahl der Trainingsjobs, die parallel ausgeführt werden können

- Hyperband-Einstellungen (die Strategie und Konfiguration, die wir im letzten Schritt konfiguriert haben)

- Frühes Anhalten (

early_stopping_type) einstellenOff

Warum stellen wir „Frühes Stoppen“ auf „Aus“? Trainingsjobs können frühzeitig gestoppt werden, wenn es unwahrscheinlich ist, dass sie die objektive Metrik des Hyperparameter-Tuning-Jobs verbessern. Dies kann dazu beitragen, die Rechenzeit zu verkürzen und eine Überanpassung Ihres Modells zu vermeiden. Hyperband verwendet jedoch einen fortschrittlichen integrierten Mechanismus, um ein frühzeitiges Stoppen vorzunehmen. Daher der Parameter early_stopping_type muss auf eingestellt sein Off bei Verwendung der internen Frühstoppfunktion von Hyperband. Siehe den folgenden Code:

Abschließend starten wir den Job zur automatischen Modelloptimierung durch den Aufruf von passen Methode. Wenn Sie den Job asynchron starten möchten, legen Sie fest wait zu False. Siehe folgenden Code:

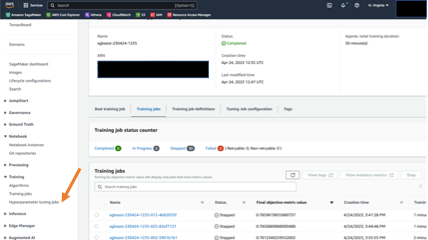

Sie können den Auftragsfortschritt und die Zusammenfassung auf der SageMaker-Konsole verfolgen. Im Navigationsbereich unter Ausbildung, wählen Hyperparameter-Tuning-Jobs, und wählen Sie dann den entsprechenden Tuning-Job aus. Der folgende Screenshot zeigt den Tuning-Job mit Details zum Status und der Leistung der Trainingsjobs.

Wenn die Tuningarbeiten abgeschlossen sind, können wir die Ergebnisse überprüfen. Im Notebook-Beispiel zeigen wir, wie Ergebnisse mit dem SageMaker SDK extrahiert werden. Zunächst untersuchen wir, wie die Optimierungsaufgabe die Modellkonvergenz erhöhte. Sie können das anhängen HyperparameterTuner Objekt mithilfe des Jobnamens und rufen Sie das auf beschreiben Methode. Die Methode gibt ein Wörterbuch zurück, das Metadaten und Ergebnisse des Optimierungsjobs enthält.

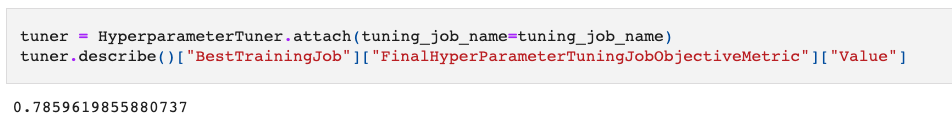

Im folgenden Code rufen wir den Wert des Trainingsjobs mit der besten Leistung ab, gemessen anhand unserer objektiven Metrik (Validierungs-AUC):

Das Ergebnis beträgt 0.78 AUC im Validierungssatz. Das ist eine deutliche Verbesserung gegenüber den anfänglichen 0.63!

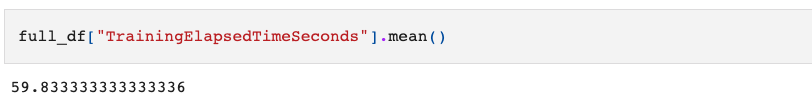

Schauen wir uns als Nächstes an, wie schnell unser Trainingsjob lief. Dafür verwenden wir die HyperparameterTuningJobAnalytics Methode im SDK, um Ergebnisse zum Optimierungsauftrag abzurufen und zur Analyse und Visualisierung in einen Pandas-Datenrahmen einzulesen:

Sehen wir uns die durchschnittliche Zeit an, die ein Schulungsjob mit der Hyperband-Strategie in Anspruch genommen hat:

Die durchschnittliche Zeit betrug etwa 1 Minute. Dies steht im Einklang mit dem Hyperband-Strategiemechanismus, der leistungsschwache Trainingsjobs frühzeitig stoppt. Was die Kosten angeht, haben wir für den Tuning-Auftrag insgesamt 30 Minuten Schulungszeit in Rechnung gestellt. Ohne die vorzeitige Beendigung von Hyperband würde die gesamte abrechenbare Schulungsdauer voraussichtlich 90 Minuten betragen (30 Jobs * 1 Minute pro Job * 3 Instanzen pro Job). Das ist eine dreimal bessere Kosteneinsparung! Schließlich sehen wir, dass der Tuning-Job 30 Trainingsjobs ausgeführt hat und insgesamt 12 Minuten gedauert hat. Das ist fast 50 % weniger als die erwartete Zeit (30 Jobs/4 Jobs parallel * 3 Minuten pro Job).

Zusammenfassung

In diesem Beitrag haben wir einige beobachtete Konvergenzprobleme beim Training von Modellen mit verteilten Umgebungen beschrieben. Wir haben gesehen, dass SageMaker AMT mithilfe von Hyperband die Hauptprobleme ausgeräumt hat, die durch die Optimierung des datenparallel verteilten Trainings entstanden sind: Konvergenz (die sich um mehr als 10 % verbesserte) und betriebliche Effizienz (der Optimierungsauftrag nahm 50 % weniger Zeit in Anspruch als ein sequenzieller, nicht optimierter Auftrag). in Anspruch genommen haben) und Kosteneffizienz (30 vs. 90 abrechenbare Minuten Trainingszeit). Die folgende Tabelle fasst unsere Ergebnisse zusammen:

| Verbesserungsmetrik | Keine Tuning-/naive Modelloptimierungsimplementierung | SageMaker Hyperband Automatische Modelloptimierung | Gemessene Verbesserung |

| Modellqualität (Gemessen anhand der Validierungs-AUC) |

0.63 | 0.78 | 15% |

| Kosten (Gemessen an abrechenbaren Schulungsminuten) |

90 | 30 | 66% |

| Betriebseffizienz (Gemessen an der Gesamtlaufzeit) |

24 | 12 | 50% |

Zur Feinabstimmung im Hinblick auf die Skalierung (Clustergröße) können Sie den Optimierungsauftrag mit mehreren Clusterkonfigurationen wiederholen und die Ergebnisse vergleichen, um die optimalen Hyperparameter zu finden, die Geschwindigkeit und Modellgenauigkeit erfüllen.

Wir haben die Schritte, um dies zu erreichen, im letzten Abschnitt des aufgeführt Notizbuch.

Bibliographie

[1] Lian, Xiangru et al. „Asynchroner dezentraler paralleler stochastischer Gradientenabstieg.“ Internationale Konferenz zum maschinellen Lernen. PMLR, 2018.

[2] Keskar, Nitish Shirish et al. „Zum Großserientraining für Deep Learning: Generalisierungslücke und scharfe Minima.“ arXiv-Vorabdruck arXiv: 1609.04836 (2016).

[3] Dai, Wei et al. „Auf dem Weg zum Verständnis der Auswirkungen von Veraltung beim verteilten maschinellen Lernen.“ arXiv-Vorabdruck arXiv: 1810.03264 (2018).

[4] Dauphin, Yann N., et al. „Identifizierung und Bekämpfung des Sattelpunktproblems bei der hochdimensionalen nichtkonvexen Optimierung.“ Fortschritte in neuronalen Informationsverarbeitungssystemen 27 (2014).

Über den Autor

Uri Rosenberg ist der AI & ML Specialist Technical Manager für Europa, den Nahen Osten und Afrika. Uri hat seinen Sitz in Israel und arbeitet daran, Unternehmenskunden in die Lage zu versetzen, ML-Workloads in großem Maßstab zu entwerfen, aufzubauen und zu betreiben. In seiner Freizeit fährt er gerne Rad, wandert und beschäftigt sich gerne mit der Datenaufbereitung.

Uri Rosenberg ist der AI & ML Specialist Technical Manager für Europa, den Nahen Osten und Afrika. Uri hat seinen Sitz in Israel und arbeitet daran, Unternehmenskunden in die Lage zu versetzen, ML-Workloads in großem Maßstab zu entwerfen, aufzubauen und zu betreiben. In seiner Freizeit fährt er gerne Rad, wandert und beschäftigt sich gerne mit der Datenaufbereitung.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/effectively-solve-distributed-training-convergence-issues-with-amazon-sagemaker-hyperband-automatic-model-tuning/

- :hast

- :Ist

- :nicht

- $UP

- 1

- 10

- 100

- 12

- 15%

- 20

- 200

- 2014

- 2016

- 2018

- 24

- 27

- 30

- 7

- 8

- 9

- a

- Über Uns

- Konto

- Genauigkeit

- genau

- Erreichen

- Action

- berührt das Schneidwerkzeug

- Zusatz

- zusätzlich

- Adresse

- Adressen

- advanced

- beeinflussen

- Afrika

- AI

- AL

- Algorithmus

- Algorithmen

- Aftershave

- bereits

- ebenfalls

- erstaunlich

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- unter

- an

- Analyse

- Analytik

- analysieren

- und

- Ein anderer

- Bienen

- Bewerbung

- angemessen

- ca.

- SIND

- AS

- At

- anhängen

- Offensives

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- durchschnittlich

- vermeiden

- AWS

- Balance

- basierend

- BE

- weil

- Bevor

- Verhalten

- hinter

- BESTE

- Besser

- zwischen

- Big

- Stärkung

- beide

- bauen

- Building

- eingebaut

- by

- Berechnung

- rufen Sie uns an!

- Aufruf

- CAN

- Kann bekommen

- Fähigkeiten

- Kategorien

- verursacht

- Übernehmen

- berechnet

- der

- Auswählen

- Auswahl

- klicken Sie auf

- Cluster

- Code

- Kolonne

- Spalten

- wie die

- gemeinsam

- vergleichen

- abschließen

- Berechnen

- Bedenken

- Wettbewerber

- Konferenz

- Konfiguration

- konfiguriert

- Geht davon

- konsistent

- Konsul (Console)

- Bau

- Behälter

- enthält

- ständig

- Konvergenz

- Kosten

- teuer werden

- Kosten

- könnte

- erstellen

- Original

- Kunden

- DAI

- technische Daten

- Datenaufbereitung

- dezentralisiert

- tief

- tiefe Lernen

- Definition

- Verzögerungen

- zeigen

- Tiefe

- beschreiben

- beschrieben

- Design

- bezeichnet

- Details

- DID

- anders

- diskutiert

- verteilt

- verteiltes Training

- verteilen

- Verteilung

- do

- Dokumentation

- Tut nicht

- erledigt

- Nicht

- nach unten

- herunterladen

- Drop

- zwei

- Dauer

- im

- E & T

- jeder

- Früher

- Früh

- leicht

- Osten

- bewirken

- effektiv

- Effizienz

- effizient

- beschäftigt

- ermächtigen

- ermöglichen

- ermöglicht

- sorgt

- Unternehmen

- Arbeitsumfeld

- Umgebungen

- insbesondere

- Europa

- bewerten

- Sogar

- Jedes

- untersuchen

- Beispiel

- erwartet

- Experimente

- Erklären

- ERKUNDEN

- Extrakt

- Faktor

- Faktoren

- Fashion

- FAST

- beschleunigt

- Merkmal

- Eigenschaften

- wenige

- Endlich

- Finden Sie

- Vorname

- passen

- folgen

- Folgende

- Aussichten für

- Format

- gefunden

- vier

- FRAME

- für

- voll

- Funktion

- weiter

- Außerdem

- Lücke

- generativ

- Generative KI

- Generatoren

- bekommen

- bekommen

- gibt

- gut

- GPU

- GPUs

- Steigungen

- mehr

- Wachstum

- passieren

- Haben

- mit

- he

- Hilfe

- seine

- Hit

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- Hyperparameter-Tuning

- if

- Bilder

- Impact der HXNUMXO Observatorien

- Einfluss hat

- zu unterstützen,

- verbessert

- Verbesserung

- in

- inklusive

- hat

- Information

- Infrastruktur

- Anfangs-

- Instanz

- beantragen müssen

- intern

- in

- einführen

- eingeführt

- Israel

- Probleme

- IT

- Iterationen

- SEINE

- Job

- Jobs

- Behalten

- L1

- Sprache

- grosse

- größer

- Nachname

- später

- starten

- startet

- Start

- führen

- umwandeln

- LERNEN

- lernen

- weniger

- Niveau

- Bibliotheken

- Gefällt mir

- aus einer regionalen

- Lang

- länger

- Verlust

- Maschine

- Maschinelles Lernen

- gemacht

- Main

- verwaltet

- Manager

- viele

- massiv

- maximal

- Kann..

- Mittel

- Mechanismus

- erwähnt

- Metadaten

- Methode

- Methoden

- Metrisch

- Metrik

- Mitte

- Mittlerer Osten

- könnte

- Minimum

- Minute

- Minuten

- ML

- Modell

- für

- mehr

- vor allem warme

- mehrere

- multipliziert

- sollen

- Name

- Natürliche

- Menü

- Need

- erforderlich

- Bedürfnisse

- Netzwerke

- Neuronale Netze

- Neu

- weiter

- nicht

- Knoten

- Fiber Node

- Notizbuch

- Anzahl

- Objekt

- Ziel

- beobachten

- of

- WOW!

- offiziell

- vorgenommen,

- on

- On-Demand

- einmal

- EINEM

- einzige

- Eröffnung

- betreiben

- Betriebs-

- optimal

- Optimierung

- Optimieren

- Optimierung

- or

- Auftrag

- UNSERE

- übrig

- Gesamt-

- besitzen

- Pandas

- Brot

- Parallel

- Parameter

- Parameter

- passieren

- für

- Leistung

- Ort

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Punkte

- Arm

- Möglichkeiten

- gegebenenfalls

- Post

- Praxis

- Vorbereitung

- Danach

- verhindern

- Aufgabenstellung:

- Prozessdefinierung

- Verarbeitung

- Prozessoren

- Fortschritt

- vorgeschlage

- die

- vorausgesetzt

- bietet

- zufällig

- Verhältnis

- erreicht

- Lesen Sie mehr

- Gründe

- kürzlich

- empfohlen

- Veteran

- Reduziert

- reduziert

- Reduzierung

- Grüße

- Regex

- relevant

- wiederholen

- erfordern

- erfordert

- Forscher

- Ressourcen

- Downloads

- Folge

- Die Ergebnisse

- Rückgabe

- Überprüfen

- Runde

- REIHE

- Führen Sie

- Laufen

- sagemaker

- Automatisches SageMaker-Modelltuning

- gleich

- Speichern

- sah

- sagt

- SC

- Skalieren

- Waage

- Skalierung

- Sdk

- Suche

- Abschnitt

- sehen

- Samen

- gesehen

- Auswahl

- Fertige Server

- Lösungen

- kompensieren

- Einstellung

- Einstellungen

- Setup

- sieben

- scharf

- sollte

- erklären

- gezeigt

- Konzerte

- schließen

- signifikant

- bedeutend

- Einfacher

- Single

- Größe

- So

- LÖSEN

- einige

- Quelle

- Quellcode

- Raumfahrt

- Spezialist

- spezifisch

- Geschwindigkeit

- gespalten

- Spagat

- Spot

- Anfang

- Beginnen Sie

- Anfang

- Status

- Schritt

- Shritte

- gestoppt

- Einstellung

- Stoppt

- Lagerung

- Strategie

- so

- erlitt

- ZUSAMMENFASSUNG

- Support

- Unterstützt

- Tabelle

- gemacht

- nimmt

- Technische

- Techniken

- Tensorfluss

- Begriff

- AGB

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Quelle

- ihr

- Sie

- dann

- Dort.

- damit

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- Zeit

- mal

- zu

- nahm

- Gesamt

- der Verkehr

- Training

- trainiert

- Ausbildung

- Transfers

- Baum

- versuchen

- Twice

- XNUMX

- Typen

- typisch

- für

- Verständnis

- unwahrscheinlich

- unnötig

- aktualisiert

- Updates

- Aktualisierung

- us

- -

- benutzt

- verwendet

- Verwendung von

- Nutzen

- Bestätigung

- Wert

- Werte

- Visualisierung

- vs

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- Gewicht

- ging

- wann

- während

- welche

- warum

- Wikipedia

- werden wir

- mit

- .

- ohne

- Arbeiter

- Werk

- schlimmer

- würde

- XGBoost

- Jahr

- Du

- Ihr

- Zephyrnet