Wir freuen uns, das zu verkünden Amazon SageMaker-JumpStart kann jetzt LLM-Inferenzantworten (Large Language Model) streamen. Durch Token-Streaming können Sie die Modellantwortausgabe sehen, während sie generiert wird, anstatt darauf zu warten, dass LLMs die Antwortgenerierung abgeschlossen haben, bevor sie Ihnen zur Verwendung oder Anzeige zur Verfügung gestellt wird. Die Streaming-Funktion in SageMaker JumpStart kann Ihnen dabei helfen, Anwendungen mit einem besseren Benutzererlebnis zu erstellen, indem sie dem Endbenutzer den Eindruck einer geringen Latenz vermittelt.

In diesem Beitrag erfahren Sie, wie Sie die Antwort von a bereitstellen und streamen Falcon 7B Instruct-Modell Endpunkt.

Zum Zeitpunkt des Verfassens dieses Artikels unterstützen die folgenden in SageMaker JumpStart verfügbaren LLMs Streaming:

- Mistral AI 7B, Mistral AI 7B Instruct

- Falcon 180B, Falcon 180B Chat

- Falcon 40B, Falcon 40B Instruct

- Falcon 7B, Falcon 7B Instruct

- Rinna Japanische GPT NeoX 4B Anleitung PPO

- Rinna Japanische GPT NeoX 3.6B Anleitung PPO

Um nach Updates für die Liste der Modelle zu suchen, die Streaming in SageMaker JumpStart unterstützen, suchen Sie nach „huggingface-llm“ unter Eingebaute Algorithmen mit vortrainierter Modelltabelle.

Beachten Sie, dass Sie die Streaming-Funktion of Amazon Sage Maker Sofortiges Hosting für jedes Modell, das mit dem SageMaker TGI Deep Learning Container (DLC) bereitgestellt wird, wie in beschrieben Ankündigung der Einführung neuer Hugging Face LLM-Inferenzcontainer auf Amazon SageMaker.

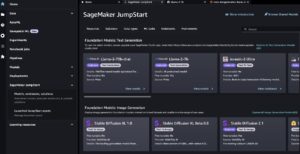

Foundation-Modelle in SageMaker

SageMaker JumpStart bietet Zugriff auf eine Reihe von Modellen beliebter Modell-Hubs, darunter Hugging Face, PyTorch Hub und TensorFlow Hub, die Sie in Ihrem ML-Entwicklungsworkflow in SageMaker verwenden können. Die jüngsten Fortschritte im ML haben zu einer neuen Klasse von Modellen geführt, die als bekannt ist Gründungsmodelle, die typischerweise auf Milliarden von Parametern trainiert werden und an eine breite Kategorie von Anwendungsfällen angepasst werden können, wie z. B. Textzusammenfassung, Generierung digitaler Kunst und Sprachübersetzung. Da das Trainieren dieser Modelle teuer ist, möchten Kunden vorhandene vorab trainierte Basismodelle verwenden und diese nach Bedarf verfeinern, anstatt diese Modelle selbst zu trainieren. SageMaker bietet eine kuratierte Liste von Modellen, aus denen Sie auf der SageMaker-Konsole auswählen können.

Sie können jetzt in SageMaker JumpStart Grundlagenmodelle von verschiedenen Modellanbietern finden, sodass Sie schnell mit Grundlagenmodellen beginnen können. SageMaker JumpStart bietet Basismodelle basierend auf verschiedenen Aufgaben oder Modellanbietern, und Sie können Modelleigenschaften und Nutzungsbedingungen einfach überprüfen. Sie können diese Modelle auch mit einem Test-UI-Widget ausprobieren. Wenn Sie ein Grundmodell im großen Maßstab verwenden möchten, können Sie dies tun, ohne SageMaker zu verlassen, indem Sie vorgefertigte Notebooks von Modellanbietern verwenden. Da die Modelle auf AWS gehostet und bereitgestellt werden, können Sie darauf vertrauen, dass Ihre Daten, unabhängig davon, ob sie zur Bewertung oder Verwendung des Modells im großen Maßstab verwendet werden, nicht an Dritte weitergegeben werden.

Token-Streaming

Durch das Token-Streaming kann die Inferenzantwort zurückgegeben werden, während sie vom Modell generiert wird. Auf diese Weise können Sie sehen, wie die Antwort inkrementell generiert wird, anstatt auf die Fertigstellung des Modells zu warten, bevor Sie die vollständige Antwort bereitstellen. Streaming kann dazu beitragen, ein besseres Benutzererlebnis zu ermöglichen, da es die Latenzwahrnehmung für den Endbenutzer verringert. Sie können die Ausgabe bereits bei der Generierung sehen und die Generierung daher vorzeitig beenden, wenn die Ausgabe für Ihre Zwecke nicht nützlich erscheint. Streaming kann einen großen Unterschied machen, insbesondere bei Abfragen mit langer Laufzeit, da Sie bereits bei der Generierung Ausgaben sehen können, was den Eindruck einer geringeren Latenz erwecken kann, obwohl die End-to-End-Latenz gleich bleibt.

Zum jetzigen Zeitpunkt können Sie Streaming in SageMaker JumpStart für Modelle verwenden, die Hugging Face LLM verwenden Inferenz zur Textgenerierung DLC.

| Antwort ohne Dampf | Antwort mit Streaming |

Lösungsüberblick

Für diesen Beitrag verwenden wir das Falcon 7B Instruct-Modell, um die Streaming-Funktion von SageMaker JumpStart vorzustellen.

Sie können den folgenden Code verwenden, um andere Modelle in SageMaker JumpStart zu finden, die Streaming unterstützen:

Wir erhalten die folgenden Modell-IDs, die Streaming unterstützen:

Voraussetzungen:

Bevor Sie das Notebook in Betrieb nehmen, sind einige erste Schritte zur Einrichtung erforderlich. Führen Sie die folgenden Befehle aus:

Stellen Sie das Modell bereit

Als ersten Schritt verwenden Sie SageMaker JumpStart, um ein Falcon 7B Instruct-Modell bereitzustellen. Vollständige Anweisungen finden Sie unter Das Fundamentmodell Falcon 180B von TII ist jetzt über Amazon SageMaker JumpStart erhältlich. Verwenden Sie den folgenden Code:

Fragen Sie den Endpunkt und die Stream-Antwort ab

Erstellen Sie als Nächstes eine Nutzlast, mit der Sie Ihren bereitgestellten Endpunkt aufrufen. Wichtig ist, dass die Nutzlast das Schlüssel/Wert-Paar enthält "stream": True. Dies weist den Textgenerierungs-Inferenzserver an, eine Streaming-Antwort zu generieren.

Bevor Sie den Endpunkt abfragen, müssen Sie einen Iterator erstellen, der die Byte-Stream-Antwort vom Endpunkt analysieren kann. Daten für jedes Token werden als separate Zeile in der Antwort bereitgestellt, sodass dieser Iterator jedes Mal ein Token zurückgibt, wenn eine neue Zeile im Streaming-Puffer identifiziert wird. Dieser Iterator ist minimal konzipiert und Sie möchten möglicherweise sein Verhalten an Ihren Anwendungsfall anpassen. Während dieser Iterator beispielsweise Token-Strings zurückgibt, enthalten die Zeilendaten andere Informationen, wie etwa Token-Log-Wahrscheinlichkeiten, die von Interesse sein könnten.

Jetzt können Sie den Boto3 verwenden invoke_endpoint_with_response_stream API auf dem Endpunkt, den Sie erstellt haben, und aktivieren Sie das Streaming, indem Sie über a iterieren TokenIterator Beispiel:

Angabe eines Leerzeichens end Parameter auf die print Die Funktion ermöglicht einen visuellen Stream, ohne dass neue Zeilenzeichen eingefügt werden. Dies erzeugt die folgende Ausgabe:

Sie können diesen Code in einem Notebook oder anderen Anwendungen wie Streamlit oder Gradio verwenden, um das Streaming in Aktion zu sehen und das Erlebnis, das es Ihren Kunden bietet.

Aufräumen

Denken Sie abschließend daran, Ihr bereitgestelltes Modell und Ihren Endpunkt zu bereinigen, um zusätzliche Kosten zu vermeiden:

Zusammenfassung

In diesem Beitrag haben wir Ihnen gezeigt, wie Sie die neu eingeführte Streaming-Funktion in SageMaker JumpStart nutzen können. Wir hoffen, dass Sie die Token-Streaming-Funktion nutzen, um interaktive Anwendungen zu erstellen, die eine geringe Latenz für ein besseres Benutzererlebnis erfordern.

Über die Autoren

Rachna Chadha ist Principal Solution Architect AI/ML in Strategic Accounts bei AWS. Rachna ist eine Optimistin, die glaubt, dass ein ethischer und verantwortungsvoller Einsatz von KI die Gesellschaft in Zukunft verbessern und wirtschaftlichen und sozialen Wohlstand bringen kann. In ihrer Freizeit verbringt Rachna gerne Zeit mit ihrer Familie, wandert und hört Musik.

Rachna Chadha ist Principal Solution Architect AI/ML in Strategic Accounts bei AWS. Rachna ist eine Optimistin, die glaubt, dass ein ethischer und verantwortungsvoller Einsatz von KI die Gesellschaft in Zukunft verbessern und wirtschaftlichen und sozialen Wohlstand bringen kann. In ihrer Freizeit verbringt Rachna gerne Zeit mit ihrer Familie, wandert und hört Musik.

Kyle Ulrich ist Angewandte Wissenschaftlerin bei der Integrierte Amazon SageMaker-Algorithmen Team. Seine Forschungsinteressen umfassen skalierbare Algorithmen für maschinelles Lernen, Computer Vision, Zeitreihen, bayessche nichtparametrische Verfahren und Gaußsche Prozesse. Er hat an der Duke University promoviert und Artikel in NeurIPS, Cell und Neuron veröffentlicht.

Kyle Ulrich ist Angewandte Wissenschaftlerin bei der Integrierte Amazon SageMaker-Algorithmen Team. Seine Forschungsinteressen umfassen skalierbare Algorithmen für maschinelles Lernen, Computer Vision, Zeitreihen, bayessche nichtparametrische Verfahren und Gaußsche Prozesse. Er hat an der Duke University promoviert und Artikel in NeurIPS, Cell und Neuron veröffentlicht.

Dr. Ashish Khetan ist Senior Applied Scientist mit integrierten Amazon SageMaker-Algorithmen und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana-Champaign. Er ist ein aktiver Forscher auf dem Gebiet des maschinellen Lernens und der statistischen Inferenz und hat viele Artikel auf den Konferenzen NeurIPS, ICML, ICLR, JMLR, ACL und EMNLP veröffentlicht.

Dr. Ashish Khetan ist Senior Applied Scientist mit integrierten Amazon SageMaker-Algorithmen und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana-Champaign. Er ist ein aktiver Forscher auf dem Gebiet des maschinellen Lernens und der statistischen Inferenz und hat viele Artikel auf den Konferenzen NeurIPS, ICML, ICLR, JMLR, ACL und EMNLP veröffentlicht.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/stream-large-language-model-responses-in-amazon-sagemaker-jumpstart/

- :hast

- :Ist

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 19

- 7

- 8

- a

- Über Uns

- Zugang

- Trading Konten

- Action

- aktiv

- hinzufügen

- Zusätzliche

- Vorschüsse

- Beratung

- AI

- AI / ML

- Algorithmen

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- an

- und

- Bekannt geben

- jedem

- Bienen

- Anwendungen

- angewandt

- SIND

- Kunst

- AS

- At

- verfügbar

- vermeiden

- AWS

- basierend

- Bayesianisch

- BE

- weil

- Bevor

- Verhalten

- Sein

- glaubt,

- Besser

- Big

- Milliarden

- Körper

- Box

- bringen

- puffern

- bauen

- eingebaut

- aber

- by

- CAN

- capability

- Häuser

- Fälle

- Kategorie

- Charakteristik

- Zeichen

- aus der Ferne überprüfen

- Auswählen

- Klasse

- reinigen

- Auftraggeber

- Code

- abschließen

- Komplex

- Computer

- Computer Vision

- Kongressbegleitung

- Konsul (Console)

- konstruieren

- enthalten

- Container

- Behälter

- enthält

- Inhalt

- Kosten

- könnte

- erstellen

- erstellt

- Erstellen

- CSS

- kuratiert

- Kunden

- technische Daten

- sinkt

- tief

- tiefe Lernen

- einsetzen

- Einsatz

- beschrieben

- Design

- entworfen

- Designer

- Bestimmen

- entwickeln

- Entwickler:in / Unternehmen

- Entwicklung

- Unterschied

- anders

- digital

- digitale Kunst

- Display

- do

- Domain

- Domain Name

- Herzog

- Duke University

- jeder

- Früh

- leicht

- Wirtschaftlich

- ermöglichen

- ermöglichen

- End-to-End

- Endpunkt

- Motor (en)

- gewährleisten

- insbesondere

- ethisch

- Auswerten

- Sogar

- Beispiel

- aufgeregt

- vorhandenen

- teuer

- ERFAHRUNGEN

- Gesicht

- Familie

- Merkmal

- Filter

- Finden Sie

- Fertig

- Vorname

- Folgende

- Aussichten für

- Foundation

- Unser Ansatz

- für

- voller

- Funktion

- Zukunft

- allgemein

- erzeugen

- erzeugt

- Erzeugung

- Generation

- bekommen

- gegeben

- Ziele

- habe

- Guide

- Haben

- he

- Hilfe

- hilfreich

- hilft

- hier (auf dänisch)

- seine

- ein Geschenk

- gehostet

- Hosting

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Nabe

- Hubs

- Umarmendes Gesicht

- i

- identifiziert

- ids

- if

- Illinois

- importieren

- wichtig

- zu unterstützen,

- in

- das

- Einschließlich

- zeigt

- Information

- Anfangs-

- Eingänge

- installieren

- Instanz

- beantragen müssen

- Anleitung

- interaktive

- Interesse

- Interessen

- IT

- SEINE

- Japanisch

- JavaScript

- JSON

- Behalten

- bekannt

- kyle

- Sprache

- grosse

- Latency

- starten

- ins Leben gerufen

- lernen

- Verlassen

- Gefällt mir

- Gleichen

- Line

- Liste

- Hören

- LLM

- Log

- suchen

- Sneaker

- senken

- Maschine

- Maschinelles Lernen

- gemacht

- halten

- um

- viele

- Kann..

- könnte

- ML

- Modell

- für

- Musik

- Name

- Need

- erforderlich

- Neu

- neu

- nicht

- Notizbuch

- jetzt an

- of

- Angebote

- on

- Online

- Optimieren

- or

- Andere

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- übrig

- Paar

- Papiere

- Parameter

- Parameter

- Parteien

- Wahrnehmung

- phd

- Plato

- Datenintelligenz von Plato

- PlatoData

- Beliebt

- Post

- Predictor

- Principal

- Prozessdefinierung

- anpassen

- produziert

- richtig

- Wohlstand

- vorausgesetzt

- Versorger

- Anbieter

- bietet

- Bereitstellung

- veröffentlicht

- Zweck

- Zwecke

- Pytorch

- Abfragen

- schnell

- Angebot

- lieber

- kürzlich

- siehe

- regelmäßig

- merken

- falls angefordert

- Forschungsprojekte

- Forscher

- Downloads

- Antwort

- Antworten

- für ihren Verlust verantwortlich.

- Rückkehr

- Rückgabe

- Überprüfen

- Rise

- Führen Sie

- Laufen

- sagemaker

- gleich

- skalierbaren

- Skalieren

- Wissenschaftler

- Suche

- Suchmaschinen

- sehen

- Sehen

- Suchen

- SELF

- Senior

- getrennte

- Modellreihe

- Server

- Lösungen

- Setup

- von Locals geführtes

- sollte

- Vitrine

- zeigte

- glatt

- So

- Social Media

- Gesellschaft

- Lösung

- einige

- Ausgabe

- Anfang

- begonnen

- statistisch

- Schritt

- Shritte

- Stoppen

- Strategisch

- Strom

- Streaming

- so

- Support

- Unterstützung

- Aufgabe

- und Aufgaben

- Team

- Vorlagen

- Tensorfluss

- AGB

- Test

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Linie

- Sie

- sich

- Dort.

- deswegen

- Diese

- Dritte

- dritte seite

- fehlen uns die Worte.

- obwohl?

- Durch

- Zeit

- Zeitfolgen

- zu

- Zeichen

- Training

- trainiert

- Übersetzungen

- was immer dies auch sein sollte.

- Vertrauen

- versuchen

- Tutorials

- typisch

- ui

- Universität

- Aktualisierung

- Updates

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Mitglied

- Benutzererfahrung

- Verwendung von

- Nutzen

- Seh-

- warten

- Warten

- Spaziergang

- wollen

- Weg..

- we

- Netz

- Web-Services

- Webseite

- wann

- ob

- welche

- während

- WHO

- breit

- werden wir

- mit

- .

- ohne

- Arbeitsablauf.

- arbeiten,

- Schreiben

- Du

- Ihr

- Zephyrnet