Olemme iloisia voidessamme ilmoittaa vastausten suoratoiston saatavuudesta Amazon Sage Maker reaaliaikainen johtopäätös. Nyt voit jatkuvasti suoratoistaa johtopäätösvastauksia takaisin asiakkaalle, kun käytät SageMakerin reaaliaikaista päättelyä, joka auttaa sinua rakentamaan interaktiivisia kokemuksia generatiivisille tekoälysovelluksille, kuten chatboteille, virtuaalisille avustajille ja musiikkigeneraattoreille. Tämän uuden ominaisuuden avulla voit aloittaa vastausten suoratoiston heti, kun ne ovat saatavilla, sen sijaan, että odotat koko vastauksen luomista. Tämä lyhentää generatiivisten AI-sovellustesi aikaa ensimmäiseen tavuun.

Tässä viestissä näytämme, kuinka luodaan suoratoistoverkkosovellus SageMakerin reaaliaikaisten päätepisteiden avulla uudella vastaussuoratoistoominaisuuden avulla interaktiiviseen chat-käyttötapaukseen. Käytämme Streamlitiä esittelysovelluksen käyttöliittymänä.

Ratkaisun yleiskatsaus

Saadaksesi vastaukset takaisin SageMakerista, voit käyttää uutta InvokeEndpointWithResponseStream API. Se auttaa parantamaan asiakastyytyväisyyttä toimittamalla nopeamman ensimmäisen vastauksen tavun. Tämä asiakkaiden havaitseman latenssin pieneneminen on erityisen tärkeää generatiivisilla tekoälymalleilla rakennetuissa sovelluksissa, joissa välitöntä käsittelyä arvostetaan koko hyötykuorman odottamisen sijaan. Lisäksi se ottaa käyttöön tarttuvan istunnon, joka mahdollistaa vuorovaikutuksen jatkuvuuden, mikä hyödyttää käyttötapauksia, kuten chatbotteja, luomaan luonnollisempia ja tehokkaampia käyttökokemuksia.

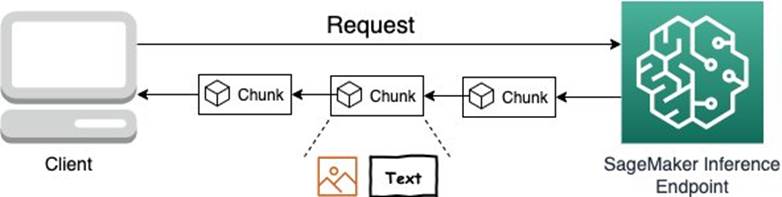

Vastausten suoratoiston toteutus SageMakerin reaaliaikaisissa päätepisteissä saavutetaan HTTP 1.1 lohkottu koodaus, joka on mekanismi useiden vastausten lähettämiseen. Tämä on HTTP-standardi, joka tukee binaarisisältöä ja jota useimmat asiakas/palvelin-kehykset tukevat. HTTP-lohkokoodaus tukee sekä teksti- että kuvatietojen suoratoistoa, mikä tarkoittaa, että SageMaker-päätepisteissä isännöidyt mallit voivat lähettää takaisin suoratoistettuja vastauksia tekstinä tai kuvana, kuten Haukka, Laama 2ja Vakaa diffuusio mallit. Turvallisuuden kannalta sekä tulo että lähtö on suojattu TLS:n avulla AWS Sigv4 Auth. Muut suoratoistotekniikat, kuten Palvelimen lähettämät tapahtumat (SSE) on myös toteutettu käyttämällä samaa HTTP-lohkokoodausmekanismia. Jotta voit hyödyntää uutta suoratoistosovellusliittymää, sinun on varmistettava, että mallisäilö palauttaa suoratoistetun vastauksen lohkotettuna koodattuna datana.

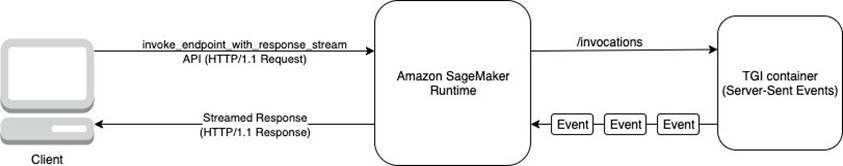

Seuraava kaavio havainnollistaa korkean tason arkkitehtuuria vastausten suoratoistolle SageMaker-päätelmäpäätepisteen kanssa.

Yksi käyttötapauksista, jotka hyötyvät suoratoistovastauksesta, ovat generatiiviset AI-mallipohjaiset chatbotit. Perinteisesti käyttäjät lähettävät kyselyn ja odottavat, että koko vastaus on luotu, ennen kuin he saavat vastauksen. Tämä voi viedä arvokkaita sekunteja tai jopa kauemmin, mikä voi heikentää sovelluksen suorituskykyä. Vastauksen suoratoistolla chatbot voi alkaa lähettää takaisin osittaisia päättelytuloksia niitä luotaessa. Tämä tarkoittaa, että käyttäjät näkevät alkuperäisen vastauksen lähes välittömästi, vaikka tekoäly jatkaa vastaustaan taustalla. Tämä luo saumattoman ja mukaansatempaavan keskusteluvirran, jossa käyttäjät tuntevat keskustelevan tekoälyn kanssa, joka ymmärtää ja vastaa reaaliajassa.

Tässä viestissä esittelemme kaksi säilövaihtoehtoa SageMaker-päätepisteen luomiseksi vastausten suoratoistolla: AWS:n avulla Suuri mallipäätelmä (LMI) ja Hugging Face Tekstin luomisen päättely (TGI) kontti. Seuraavissa osioissa opastamme sinut läpi yksityiskohtaiset käyttöönottovaiheet, joiden avulla voit ottaa käyttöön ja testata Falcon-7B-Ohje malli käyttää sekä LMI- että TGI-säiliöitä SageMakerissa. Valitsimme esimerkkinä Falcon 7B:n, mutta mikä tahansa malli voi hyödyntää tätä uutta suoratoistoominaisuutta.

Edellytykset

Tarvitset AWS-tilin, jossa on AWS-henkilöllisyyden ja käyttöoikeuksien hallinta (IAM) rooli, jolla on oikeudet hallita resursseja, jotka on luotu osana ratkaisua. Katso lisätietoja kohdasta AWS-tilin luominen. Jos tämä on ensimmäinen kerta, kun työskentelet Amazon SageMaker Studio, sinun on ensin luotava a SageMaker-verkkotunnus. Lisäksi saatat joutua pyytämään palvelukiintiön korotusta vastaaville SageMaker-isännöintiesiintymille. Falcon-7B-Instruct-mallissa käytämme ml.g5.2xlarge SageMaker-isännöintiesiintymää. Falcon-40B-Instruct-mallin isännöintiin käytämme ml.g5.48xlarge SageMaker-isännöintiesiintymää. Voit pyytää kiintiön korotusta Palvelukiintiöiden käyttöliittymä. Lisätietoja on kohdassa Pyydetään kiintiön korotusta.

Vaihtoehto 1: Ota käyttöön reaaliaikainen suoratoistopäätepiste käyttämällä LMI-säilöä

LMI-säilö on yksi SageMakerin isännöimistä Deep Learning Container -säilöistä suurten mallipäätelmien tekemiseen. Se helpottaa suurten kielimallien (LLM) isännöintiä AWS-infrastruktuurissa matalan viiveen päättelytapauksissa. LMI-säiliö käyttää Deep Java Library (DJL) -palvelu, joka on avoimen lähdekoodin korkeatasoinen, moottoriagnostinen Java-kehys syvään oppimiseen. Näillä säilöillä voit käyttää vastaavia avoimen lähdekoodin kirjastoja, kuten Syvä nopeus, Kiihdyttää, Transformers-neuronxja FasterTransformer osioida malliparametreja käyttämällä mallin rinnakkaisuustekniikoita useiden grafiikkasuorittimien tai kiihdyttimien muistin käyttämiseksi päätelmien tekemiseen. Katso lisätietoja LMI-säilön eduista suurten mallien käyttöönotossa SageMakerissa Ota käyttöön suuria malleja korkealla suorituskyvyllä käyttämällä FasterTransformeria Amazon SageMakerissa ja Ota suuria malleja käyttöön Amazon SageMakerissa käyttämällä DJLServing- ja DeepSpeed-mallin rinnakkaisjohtopäätöstä. Löydät myös lisää esimerkkejä avoimen lähdekoodin LLM:ien isännöimisestä SageMakerissa käyttämällä LMI-säilöjä tästä GitHub repo.

Odotamme LMI-säilön osalta seuraavien artefaktien auttavan mallin määrittämisessä johtopäätöstä varten:

- serving.properties (pakollinen) – Määrittää mallipalvelimen asetukset

- model.py (valinnainen) – Python-tiedosto, joka määrittää pääjohtologiikan ydin

- vaatimukset.txt (valinnainen) – Kaikki ylimääräiset pippipyörät on asennettava

LMI-säilöjä voidaan käyttää isännöimään malleja ilman omaa päättelykoodiasi. Tämä on erittäin hyödyllistä, kun syöttödatan mukautettua esikäsittelyä tai mallin ennusteiden jälkikäsittelyä ei ole. Käytämme seuraavaa kokoonpanoa:

- Tässä esimerkissä isännöimme Falcon-7B-Instruct-mallia. Meidän on luotava a

serving.propertiesmääritystiedosto halutuilla isännöintivaihtoehdoilla ja pakkaa se tar.gz-artefaktiksi. Vastausten suoratoisto voidaan ottaa käyttöön DJL-palvelussa asettamallaenable_streamingvaihtoehtoserving.propertiestiedosto. Katso kaikki tuetut parametrit kohdasta Python-määritysten suoratoisto. - Tässä esimerkissä käytämme DJL Servingin oletuskäsittelijöitä vastausten suoratoistoon, joten välitämme vain pyyntöjen lähettämisestä ja lähtövastauksen jäsentämisestä. Voit myös tarjota

entrypointkoodi mukautetun käsittelijän kanssa kohdassa amodel.pytiedosto syötteiden ja tulosten käsittelijöiden mukauttamiseksi. Lisätietoja mukautetusta käsittelijästä on kohdassa Mukautettu model.py-käsittelijä. - Koska isännöimme Falcon-7B-Instruct-mallia yhdessä GPU-esiintymässä (ml.g5.2xlarge), asetamme

option.tensor_parallel_degree1. Jos aiot käyttää useita grafiikkasuorituksia, käytä tätä asettaaksesi GPU:iden määrä työntekijää kohti. - Käytämme

option.output_formatterohjata tulosteen sisältötyyppiä. Oletustulosteen sisältötyyppi onapplication/json, joten jos sovelluksesi vaatii eri tulosteen, voit korvata tämän arvon. Lisätietoja käytettävissä olevista vaihtoehdoista on kohdassa Kokoonpanot ja asetukset ja Kaikki DJL-kokoonpanovaihtoehdot.

Luo SageMaker-malli hakemalla säilön kuvan URI:

Käytä SageMaker Python SDK luodaksesi SageMaker-mallin ja ottaaksesi sen käyttöön SageMakerin reaaliaikaisessa päätepisteessä käyttämällä sijoittaa menetelmä:

Kun päätepiste on käytössä, voit käyttää InvokeEndpointWithResponseStream API-kutsu mallin käynnistämiseksi. Tämän API:n avulla malli voi vastata täyden vastauksen hyötykuorman osien virtana. Tämän ansiosta mallit voivat vastata suuremmilla vastauksilla ja mahdollistaa nopeamman siirtymisen ensimmäiseen tavuun malleissa, joissa vastauksen ensimmäisen ja viimeisen tavun välillä on merkittävä ero.

Vastauksen sisältötyyppi, joka näkyy kohdassa x-amzn-sagemaker-content-type LMI-säiliölle on application/jsonlines kuten mallin ominaisuuksien kokoonpanossa on määritetty. Koska se on osa yleisiä tietomuotoja tuetaan päätelmien tekemiseen, voimme käyttää SageMaker Python SDK JSON-rivien tietojen sarjoittamiseksi. Luomme avustajan LineIterator luokka jäsentääksesi päättelypyynnöstä saadun vastausvirran:

Kun luokka on edellisessä koodissa, joka kerta kun vastaus lähetetään suoratoistona, se palauttaa binäärimerkkijonon (esim. b'{"outputs": [" a"]}n'), joka voidaan deserialisoida uudelleen Python-sanakirjaksi JSON-paketin avulla. Voimme käyttää seuraavaa koodia iteroidaksemme jokaisen suoratoistetun tekstirivin läpi ja palauttaaksemme tekstivastauksen:

Seuraava kuvakaappaus näyttää, miltä se näyttäisi, jos käynnistäisit mallin SageMaker-muistikirjan kautta käyttämällä LMI-säilöä.

Vaihtoehto 2: Ota chatbot käyttöön Hugging Face TGI -säilön avulla

Edellisessä osiossa näit kuinka Falcon-7B-Instruct-malli otetaan käyttöön LMI-säilön avulla. Tässä osiossa näytämme kuinka tehdä sama käyttämällä a Halaaminen kasvot Tekstin luomisen päättely (TGI) astia SageMakerissa. TGI on avoimen lähdekoodin, tarkoitukseen rakennettu ratkaisu LLM:ien käyttöönottoon. Se sisältää optimointeja, kuten tensorin rinnakkaisuuden useiden grafiikkasuorittimien päättelyn nopeuttamiseksi, dynaamisen erän lisäämisen kokonaissuorituskyvyn parantamiseksi ja optimoidun muuntajakoodin, joka käyttää flash-attention suosittuja malliarkkitehtuureja, kuten BLOOM, T5, GPT-NeoX, StarCoder ja LLaMa.

TGI-syväoppimissäiliöiden tuki tokenin suoratoisto käyttämällä Palvelimen lähettämät tapahtumat (SSE). Token-suoratoistolla palvelin voi aloittaa vastaamisen ensimmäisen jälkeen prefill kulkea suoraan odottamatta koko sukupolven valmistumista. Erittäin pitkillä kyselyillä tämä tarkoittaa, että asiakkaat voivat alkaa nähdä jotain tapahtuvan suuruusluokkaa ennen kuin työ on valmis. Seuraava kaavio näyttää korkean tason päästä päähän -pyyntö/vastaus-työnkulun LLM:ien isännöimiseksi SageMaker-päätepisteessä TGI-säilöä käyttäen.

Käytämme Falcon-7B-Instruct-mallin käyttöönottoa SageMaker-päätepisteessä HuggingFaceModel luokka SageMaker Python SDK:sta. Aloitamme asettamalla parametrimme seuraavasti:

Verrattuna tavallisiin Hugging Face -mallien käyttöön, meidän on ensin haettava kontin URI ja toimitettava se HuggingFaceModel malliluokan kanssa image_uri osoittaa kuvaa. Uuden Hugging Face LLM DLC:n hakemiseksi SageMakerissa voimme käyttää get_huggingface_llm_image_uri SageMaker SDK:n tarjoama menetelmä. Tämän menetelmän avulla voimme noutaa URI:n halutulle Hugging Face LLM DLC:lle määritetyn taustajärjestelmän, istunnon, alueen ja version perusteella. Lisätietoja saatavilla olevista versioista on kohdassa HuggingFace Text Generation -päätelmäsäiliöt.

Luomme sitten HuggingFaceModel ja ota se käyttöön SageMakerissa käyttämällä deploy menetelmä:

Suurin ero LMI-säilöön verrattuna on se, että otat vastausten suoratoiston käyttöön, kun kutsut päätepisteen toimittamalla stream=true osana kutsupyynnön hyötykuormaa. Seuraava koodi on esimerkki hyötykuormasta, jota käytetään TGI-säilön kutsumiseen suoratoistolla:

Sitten voit kutsua päätepisteen ja vastaanottaa suoratoistovastauksen käyttämällä seuraavaa komentoa:

Vastauksen sisältötyyppi, joka näkyy kohdassa x-amzn-sagemaker-content-type TGI-säiliölle on text/event-stream. Käytämme StreamDeserializeria deserialoimaan vastauksen Tapahtumavirta luokka ja jäsennä vastauksen runko käyttäen samaa LineIterator luokkaa kuten LMI-säiliöosiossa käytetään.

Huomaa, että suoratoistettu vastaus TGI-säiliöistä palauttaa binäärimerkkijonon (esim. b`data:{"token": {"text": " sometext"}}`), joka voidaan deserialisoida uudelleen Python-sanakirjaksi JSON-paketin avulla. Voimme käyttää seuraavaa koodia iteroidaksemme jokaisen suoratoistetun tekstirivin läpi ja palauttaaksemme tekstivastauksen:

Seuraava kuvakaappaus näyttää, miltä se näyttäisi, jos käynnistäisit mallin SageMaker-muistikirjan kautta TGI-säilön avulla.

Suorita chatbot-sovellus SageMaker Studiossa

Tässä käyttötapauksessa rakennamme dynaamisen chatbotin SageMaker Studioon käyttämällä Virtaviivainen, joka käyttää Falcon-7B-Instruct-mallia, joka on isännöity SageMakerin reaaliaikaisessa päätepisteessä suoratoistovastausten tarjoamiseksi. Ensin voit testata, että suoratoistovastaukset toimivat muistikirjassa edellisen osan osoittamalla tavalla. Sitten voit määrittää Streamlit-sovelluksen SageMaker Studio JupyterServer -päätteessä ja käyttää chatbotin käyttöliittymää selaimellasi suorittamalla seuraavat vaiheet:

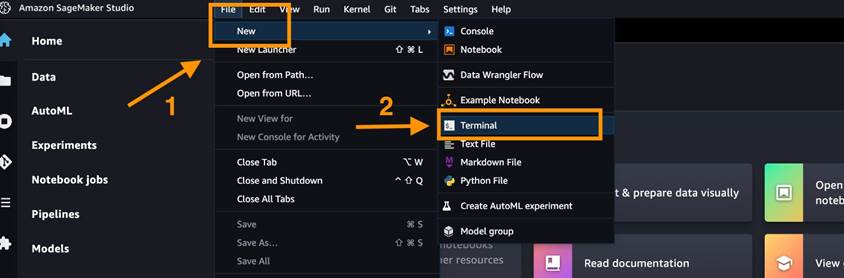

- Avaa järjestelmäpääte SageMaker Studiossa.

- Valitse SageMaker Studio -konsolin ylävalikosta filee, sitten Uusi, sitten terminaali.

- Asenna vaaditut Python-paketit, jotka on määritetty requirements.txt tiedosto:

- Määritä ympäristömuuttuja, jonka päätepisteen nimi on otettu käyttöön tilissäsi:

- Käynnistä Streamlit-sovellus osoitteesta

streamlit_chatbot_<LMI or TGI>.pytiedosto, joka päivittää automaattisesti komentosarjan päätepisteiden nimet aiemmin määritetyn ympäristömuuttujan perusteella: - Päästäksesi Streamlit-käyttöliittymään, kopioi SageMaker Studion URL-osoite toiseen välilehteen selaimessasi ja vaihda se

lab?withproxy/[PORT NUMBER]/. Koska määritimme palvelinportiksi 6006, URL-osoitteen pitäisi näyttää seuraavalta:

Korvaa verkkotunnuksen tunnus ja alue edellisessä URL-osoitteessa tililläsi ja alueellasi päästäksesi chatbotin käyttöliittymään. Vasemmassa ruudussa on joitakin ehdotettuja kehotteita aloittaaksesi.

Seuraava esittely näyttää, kuinka vastaussuoratoisto mullistaa käyttökokemuksen. Se voi saada vuorovaikutuksen tuntumaan sujuvalta ja reagoivalta, mikä viime kädessä parantaa käyttäjien tyytyväisyyttä ja sitoutumista. Viittaavat GitHub repo saadaksesi lisätietoja chatbotin toteutuksesta.

Puhdistaa

Kun olet valmis mallien testaamisen, poista päätepiste parhaana käytäntönä kustannusten säästämiseksi, jos päätepistettä ei enää tarvita:

Yhteenveto

Tässä viestissä esitimme yleiskatsauksen sovellusten rakentamisesta generatiivisella tekoälyllä, haasteista ja siitä, kuinka SageMakerin reaaliaikainen vastaussuoratoisto auttaa sinua vastaamaan näihin haasteisiin. Esitimme, kuinka luodaan chatbot-sovellus Falcon-7B-Instruct-mallin käyttöönottamiseksi vastaussuoratoiston käyttämiseksi sekä SageMaker LMI- että HuggingFace TGI -säilöillä käyttämällä esimerkkiä, joka on saatavilla osoitteessa GitHub.

Aloita omien huippuluokan suoratoistosovellusten rakentaminen LLM:n ja SageMakerin avulla jo tänään! Ota meihin yhteyttä saadaksesi asiantuntija-apua ja hyödynnä laajan mallin suoratoiston mahdollisuudet projekteillesi.

Tietoja Tekijät

Raghu Ramesha on vanhempi ML-ratkaisuarkkitehti Amazon SageMaker Service -tiimissä. Hän keskittyy auttamaan asiakkaita rakentamaan, ottamaan käyttöön ja siirtämään ML-tuotannon työmäärät SageMakeriin suuressa mittakaavassa. Hän on erikoistunut koneoppimiseen, tekoälyyn ja tietokonenäköalueisiin, ja hänellä on tietojenkäsittelytieteen maisterin tutkinto UT Dallasista. Vapaa-ajallaan hän nauttii matkustamisesta ja valokuvaamisesta.

Raghu Ramesha on vanhempi ML-ratkaisuarkkitehti Amazon SageMaker Service -tiimissä. Hän keskittyy auttamaan asiakkaita rakentamaan, ottamaan käyttöön ja siirtämään ML-tuotannon työmäärät SageMakeriin suuressa mittakaavassa. Hän on erikoistunut koneoppimiseen, tekoälyyn ja tietokonenäköalueisiin, ja hänellä on tietojenkäsittelytieteen maisterin tutkinto UT Dallasista. Vapaa-ajallaan hän nauttii matkustamisesta ja valokuvaamisesta.

Abhi Shivaditya on AWS:n vanhempi ratkaisuarkkitehti, joka työskentelee strategisten globaalien yritysorganisaatioiden kanssa helpottaakseen AWS-palvelujen käyttöönottoa sellaisilla aloilla kuin tekoäly, hajautettu tietojenkäsittely, verkko ja tallennus. Hänen asiantuntemuksensa on syväoppiminen luonnollisen kielen käsittelyn (NLP) ja tietokonenäön aloilla. Abhi auttaa asiakkaita ottamaan käyttöön tehokkaita koneoppimismalleja tehokkaasti AWS-ekosysteemissä.

Abhi Shivaditya on AWS:n vanhempi ratkaisuarkkitehti, joka työskentelee strategisten globaalien yritysorganisaatioiden kanssa helpottaakseen AWS-palvelujen käyttöönottoa sellaisilla aloilla kuin tekoäly, hajautettu tietojenkäsittely, verkko ja tallennus. Hänen asiantuntemuksensa on syväoppiminen luonnollisen kielen käsittelyn (NLP) ja tietokonenäön aloilla. Abhi auttaa asiakkaita ottamaan käyttöön tehokkaita koneoppimismalleja tehokkaasti AWS-ekosysteemissä.

Alan Tan on SageMakerin vanhempi tuotepäällikkö, joka johtaa suuria mallipäätelmiä. Hän on intohimoinen koneoppimisen soveltamisesta analytiikan alalla. Työn ulkopuolella hän viihtyy ulkona.

Alan Tan on SageMakerin vanhempi tuotepäällikkö, joka johtaa suuria mallipäätelmiä. Hän on intohimoinen koneoppimisen soveltamisesta analytiikan alalla. Työn ulkopuolella hän viihtyy ulkona.

Melaniei, PhD, on vanhempi AI/ML-asiantuntija TAM AWS:ssä Sydneyssä, Australiassa. Hän auttaa yritysasiakkaita rakentamaan ratkaisuja uusimpien AI/ML-työkalujen avulla AWS:ssä ja opastaa ML-ratkaisujen suunnittelussa ja toteuttamisessa parhaiden käytäntöjen avulla. Vapaa-ajallaan hän rakastaa tutkia luontoa ja viettää aikaa perheen ja ystävien kanssa.

Melaniei, PhD, on vanhempi AI/ML-asiantuntija TAM AWS:ssä Sydneyssä, Australiassa. Hän auttaa yritysasiakkaita rakentamaan ratkaisuja uusimpien AI/ML-työkalujen avulla AWS:ssä ja opastaa ML-ratkaisujen suunnittelussa ja toteuttamisessa parhaiden käytäntöjen avulla. Vapaa-ajallaan hän rakastaa tutkia luontoa ja viettää aikaa perheen ja ystävien kanssa.

Sam Edwards, on pilvi-insinööri (AI/ML) AWS Sydneyssä ja on erikoistunut koneoppimiseen ja Amazon SageMakeriin. Hän haluaa auttaa asiakkaita ratkaisemaan koneoppimisen työnkulkuihin liittyviä ongelmia ja luomaan heille uusia ratkaisuja. Työn ulkopuolella hän harrastaa mailaurheilua ja matkustamista.

Sam Edwards, on pilvi-insinööri (AI/ML) AWS Sydneyssä ja on erikoistunut koneoppimiseen ja Amazon SageMakeriin. Hän haluaa auttaa asiakkaita ratkaisemaan koneoppimisen työnkulkuihin liittyviä ongelmia ja luomaan heille uusia ratkaisuja. Työn ulkopuolella hän harrastaa mailaurheilua ja matkustamista.

James Sanders on vanhempi ohjelmistosuunnittelija Amazon Web Services -palvelussa. Hän työskentelee Amazon SageMakerin reaaliaikaisella päättelyalustalla.

James Sanders on vanhempi ohjelmistosuunnittelija Amazon Web Services -palvelussa. Hän työskentelee Amazon SageMakerin reaaliaikaisella päättelyalustalla.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. Autot / sähköautot, hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- ChartPrime. Nosta kaupankäyntipeliäsi ChartPrimen avulla. Pääsy tästä.

- BlockOffsets. Ympäristövastuun omistuksen nykyaikaistaminen. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/elevating-the-generative-ai-experience-introducing-streaming-support-in-amazon-sagemaker-hosting/

- :On

- :ei

- :missä

- $ YLÖS

- 1

- 10

- 100

- 11

- 13

- 14

- 16

- 1900

- 23

- 7

- 8

- 9

- a

- Meistä

- kiihdyttimiä

- pääsy

- Tili

- Tilit

- saavutettu

- poikki

- lisä-

- Lisäksi

- osoite

- Hyväksyminen

- Etu

- Jälkeen

- uudelleen

- AI

- AI-mallit

- AI / ML

- Kaikki

- mahdollistaa

- melkein

- Myös

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytics

- ja

- Ilmoittaa

- Toinen

- vastaus

- Kaikki

- api

- sovelluksen

- Hakemus

- sovellukset

- Hakeminen

- arkkitehtuuri

- OVAT

- ALUE

- alueet

- Ryhmä

- keinotekoinen

- tekoäly

- AS

- avustajat

- avustaa

- At

- Australia

- automaattisesti

- saatavuus

- saatavissa

- AWS

- takaisin

- taustaosa

- tausta

- perustua

- BE

- koska

- ennen

- alkaa

- hyödyttää

- hyötyvät

- Hyödyt

- PARAS

- parhaat käytännöt

- välillä

- Kukinta

- elin

- edistää

- sekä

- selain

- puskuri

- rakentaa

- Rakentaminen

- rakennettu

- mutta

- by

- soittaa

- CAN

- joka

- tapaus

- tapauksissa

- haasteet

- haastava

- merkki

- chatbot

- chatbots

- chattailuun

- tarkastaa

- Valita

- valitsi

- luokka

- asiakas

- asiakkaat

- pilvi

- koodi

- kommentti

- verrattuna

- Suoritettuaan

- tietokone

- Tietojenkäsittelyoppi

- Tietokoneen visio

- tietojenkäsittely

- Konfigurointi

- Console

- sisältää

- Kontti

- Kontit

- pitoisuus

- jatkaa

- jatkuu

- jatkuvuus

- jatkuvasti

- ohjaus

- Keskustelu

- Ydin

- vastaava

- kustannukset

- voisi

- luoda

- luotu

- luo

- Luominen

- ratkaiseva

- asiakassuhde

- asiakas

- Asiakastyytyväisyys

- Asiakkaat

- räätälöidä

- leikkaamisreuna

- Dallas

- tiedot

- syvä

- syvä oppiminen

- oletusarvo

- määritellä

- määrittelee

- Aste

- tuottaa

- esittely

- sijoittaa

- käyttöön

- levityspinnalta

- haluttu

- yksityiskohtainen

- yksityiskohdat

- ero

- eri

- suoraan

- jaettu

- hajautettu laskenta

- do

- verkkotunnuksen

- verkkotunnuksia

- tehty

- dynaaminen

- kukin

- Aikaisemmin

- ekosysteemi

- tehokas

- tehokkaasti

- ponnisteluja

- ylentävä

- mahdollistaa

- käytössä

- mahdollistaa

- loppu

- päittäin

- pääte

- päätepiste

- sitoumus

- harjoittaa

- insinööri

- parantaa

- parantaa

- varmistaa

- yritys

- Koko

- ympäristö

- Jopa

- tapahtuma

- Tapahtumat

- esimerkki

- Esimerkit

- Paitsi

- innoissaan

- odottaa

- experience

- Elämykset

- asiantuntija

- asiantuntemus

- tutkia

- vienti

- avoin

- erittäin

- Kasvot

- helpottamaan

- väärä

- perhe

- nopeampi

- Ominaisuus

- tuntea

- filee

- Löytää

- Etunimi

- ensimmäistä kertaa

- virtaus

- neste

- keskittyy

- jälkeen

- seuraa

- varten

- muoto

- Puitteet

- puitteet

- Ilmainen

- ystäviä

- alkaen

- koko

- toiminto

- syntyy

- sukupolvi

- generatiivinen

- Generatiivinen AI

- generaattorit

- saada

- gif

- Global

- GPU

- GPU

- taattu

- ohjaus

- Happening

- he

- terveys

- auttaa

- auttaa

- auttaa

- hänen

- Korkea

- korkean tason

- korkea suorituskyky

- hänen

- pitää

- isäntä

- isännöi

- hotellit

- Miten

- Miten

- HTML

- http

- HTTPS

- HalaaKasvot

- ID

- Identiteetti

- if

- havainnollistaa

- kuva

- Välitön

- heti

- toteuttaa

- täytäntöönpano

- täytäntöön

- täytäntöönpanosta

- tuoda

- in

- Mukaan lukien

- Kasvaa

- tiedot

- Infrastruktuuri

- ensimmäinen

- panos

- tuloa

- asentaa

- esimerkki

- välittömästi

- sen sijaan

- Älykkyys

- vuorovaikutukset

- vuorovaikutteinen

- tulee

- Esittelee

- käyttöön

- kutsuttuihin

- vedotaan

- kysymykset

- IT

- SEN

- Jaava

- jpg

- json

- Kieli

- suuri

- suurempi

- Sukunimi

- Viive

- johtava

- oppiminen

- vasemmalle

- Pituus

- kirjastot

- Kirjasto

- piilee

- elämä

- pitää

- linja

- linjat

- liekki

- OTK

- Pitkät

- kauemmin

- katso

- näyttää joltakin

- rakastaa

- kone

- koneoppiminen

- tärkein

- ylläpitää

- tehdä

- hoitaa

- johtaja

- maisterin

- max

- Saattaa..

- me

- välineet

- mekanismi

- Muisti

- valikko

- menetelmä

- vaeltaa

- minuuttia

- ML

- malli

- mallit

- lisää

- Lisäksi

- eniten

- moninkertainen

- Musiikki

- nimi

- nimet

- Luonnollinen

- Luonnollinen kielen käsittely

- luonto

- Tarve

- verkostoituminen

- Uusi

- NLP

- Nro

- muistikirja

- nyt

- numero

- esineet

- of

- on

- ONE

- vain

- avata

- avoimen lähdekoodin

- optimoitu

- Vaihtoehto

- Vaihtoehdot

- or

- määräys

- organisaatioiden

- Muut

- meidän

- ulos

- ulkona

- ulostulo

- ulkopuolella

- yli

- yleinen

- yleiskatsaus

- oma

- paketti

- paketit

- lasi

- Parallel

- parametrit

- osa

- erityisesti

- osat

- kulkea

- intohimoinen

- varten

- suorituskyky

- Oikeudet

- phd

- valokuvaus

- suunnitelma

- foorumi

- Platon

- Platonin tietotieto

- PlatonData

- pelaa

- Kohta

- Suosittu

- sijainti

- Kirje

- mahdollinen

- mahdollisesti

- harjoitusta.

- käytännöt

- Kallisarvoinen

- Ennusteet

- edellinen

- Ongelma

- käsittely

- Tuotteet

- tuotepäällikkö

- tuotanto

- hankkeet

- ominaisuudet

- toimittaa

- mikäli

- tarjoaa

- tarjoamalla

- Python

- kyselyt

- nostaa

- tavoittaa

- Lue

- todellinen

- reaaliaikainen

- vastaanottaa

- sai

- vastaanottava

- vähentäminen

- jalostus

- alue

- säännöllinen

- liittyvä

- korvata

- pyyntö

- pyynnöt

- tarvitaan

- vaatimukset

- Vaatii

- Esittelymateriaalit

- Vastata

- vastaus

- vasteet

- herkkä

- tulokset

- palata

- Tuotto

- mullistaa

- Rooli

- ajaa

- sagemaker

- SageMaker-johtopäätös

- sama

- tyytyväisyys

- Säästä

- näki

- Asteikko

- tiede

- sdk

- saumaton

- sekuntia

- Osa

- osiot

- turvattu

- turvallisuus

- nähdä

- SELF

- lähettää

- lähettäminen

- vanhempi

- tuomita

- palvelu

- Palvelut

- palvelevat

- Istunto

- setti

- asetus

- hän

- shouldnt

- näyttää

- näyteikkuna

- malliesimerkki

- esitetty

- Näytä

- merkittävä

- single

- Koko

- So

- Tuotteemme

- Software Engineer

- ratkaisu

- Ratkaisumme

- SOLVE

- jonkin verran

- jotain

- lähde

- asiantuntija

- erikoistunut

- erikoistunut

- määritelty

- viettää

- jakaa

- Urheilu

- standardi

- Alkaa

- alkoi

- huippu-

- Askeleet

- tahmea

- Levytila

- Strateginen

- virta

- virtasi

- streaming

- jono

- studio

- niin

- toimittaa

- tuki

- Tuetut

- Tukee

- varma

- sydney

- järjestelmä

- ottaa

- joukkue-

- tekniikat

- kertoa

- terminaali

- ehdot

- testi

- Testaus

- että

- -

- Alue

- Niitä

- sitten

- Siellä.

- Nämä

- ne

- tätä

- Kautta

- suoritusteho

- aika

- että

- symbolinen

- työkalut

- ylin

- perinteisesti

- muuntajat

- Matkustaminen

- totta

- yrittää

- kaksi

- tyyppi

- ui

- Lopulta

- ymmärtää

- tuntematon

- avata

- Päivitykset

- URL

- us

- käyttää

- käyttölaukku

- käytetty

- käyttäjä

- Käyttäjäkokemus

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- yleensä

- arvo

- arvostettu

- muuttuja

- versio

- versiot

- kautta

- Virtual

- visio

- odottaa

- odotus

- oli

- we

- verkko

- Web-sovellus

- verkkopalvelut

- Mitä

- Mikä on

- Pyörä

- kun

- joka

- vaikka

- wikipedia

- tulee

- with

- sisällä

- ilman

- Referenssit

- työnkulku

- työnkulkuja

- työskentely

- toimii

- olisi

- kirjoittaa

- kirjallinen

- Voit

- Sinun

- zephyrnet