Tänään meillä on ilo ilmoittaa, että Metan kehittämät Llama 2 -pohjamallit ovat asiakkaiden saatavilla kautta Amazon SageMaker JumpStart. Llama 2 -perhe suuria kielimalleja (LLM) on kokoelma esikoulutettuja ja hienosäädettyjä generatiivisia tekstimalleja, joiden skaala vaihtelee 7 miljardista 70 miljardiin parametriin. Hienosäädetyt LLM:t, nimeltään Llama-2-chat, on optimoitu dialogikäyttöön. Voit helposti kokeilla näitä malleja ja käyttää niitä SageMaker JumpStartin kanssa, joka on koneoppimiskeskus (ML), joka tarjoaa pääsyn algoritmeihin, malleihin ja ML-ratkaisuihin, jotta pääset nopeasti alkuun ML:n kanssa.

Tässä viestissä käymme läpi, kuinka Llama 2 -malleja käytetään SageMaker JumpStartin kautta.

Mikä on Llama 2

Llama 2 on automaattisesti regressiivinen kielimalli, joka käyttää optimoitua muuntajaarkkitehtuuria. Llama 2 on tarkoitettu kaupalliseen ja tutkimuskäyttöön englanniksi. Sitä on saatavana eri parametrikokoina – 7 miljardia, 13 miljardia ja 70 miljardia – sekä esikoulutettuja ja hienosäädettyjä muunnelmia. Metan mukaan viritetyt versiot käyttävät valvottua hienosäätöä (SFT) ja vahvistusoppimista ihmisen palautteen avulla (RLHF) mukautuakseen ihmisten auttavaisuuden ja turvallisuuden mieltymyksiin. Llama 2 oli esikoulutettu 2 biljoonalla datatunnisteella julkisista lähteistä. Viritetyt mallit on tarkoitettu assistentin kaltaiseen chattiin, kun taas valmiiksi koulutetut mallit voidaan mukauttaa erilaisiin luonnollisen kielen generointitehtäviin. Riippumatta siitä, mitä mallin versiota kehittäjä käyttää, Metan vastuullinen käyttöopas voi auttaa ohjaamaan ylimääräisiä hienosäätöjä, jotka voivat olla tarpeen mallien mukauttamiseen ja optimointiin asianmukaisin turvatoimin.

Mikä on SageMaker JumpStart

SageMaker JumpStartin avulla ML-harjoittajat voivat valita laajasta valikoimasta avoimen lähdekoodin perustusmalleja. ML-ammattilaiset voivat ottaa käyttöön perustamismalleja omistettuihin Amazon Sage Maker instansseja verkosta eristetystä ympäristöstä ja mukauta malleja SageMakerin avulla mallin koulutusta ja käyttöönottoa varten.

Voit nyt löytää ja ottaa Llama 2:n käyttöön muutamalla napsautuksella Amazon SageMaker Studio tai ohjelmallisesti SageMaker Python SDK:n kautta, jonka avulla voit johtaa mallin suorituskykyä ja MLOps-säätimiä SageMaker-ominaisuuksilla, kuten Amazon SageMaker -putkistot, Amazon SageMaker -korjaamotai konttitukkeja. Malli on otettu käyttöön suojatussa AWS-ympäristössä ja VPC-ohjaimissasi, mikä auttaa varmistamaan tietoturvan. Llama 2 -mallit ovat saatavilla tänään Amazon SageMaker Studiossa, aluksi vuonna us-east 1 ja us-west 2 alueilla.

Tutustu malleihin

Voit käyttää perusmalleja SageMaker JumpStartin kautta SageMaker Studion käyttöliittymässä ja SageMaker Python SDK:ssa. Tässä osiossa käymme läpi kuinka löytää mallit SageMaker Studiossa.

SageMaker Studio on integroitu kehitysympäristö (IDE), joka tarjoaa yhden web-pohjaisen visuaalisen käyttöliittymän, jossa voit käyttää tarkoitukseen rakennettuja työkaluja kaikkien ML-kehitysvaiheiden suorittamiseen tietojen valmistelusta ML-mallien rakentamiseen, koulutukseen ja käyttöönottoon. Katso lisätietoja SageMaker Studion aloittamisesta ja määrittämisestä Amazon SageMaker Studio.

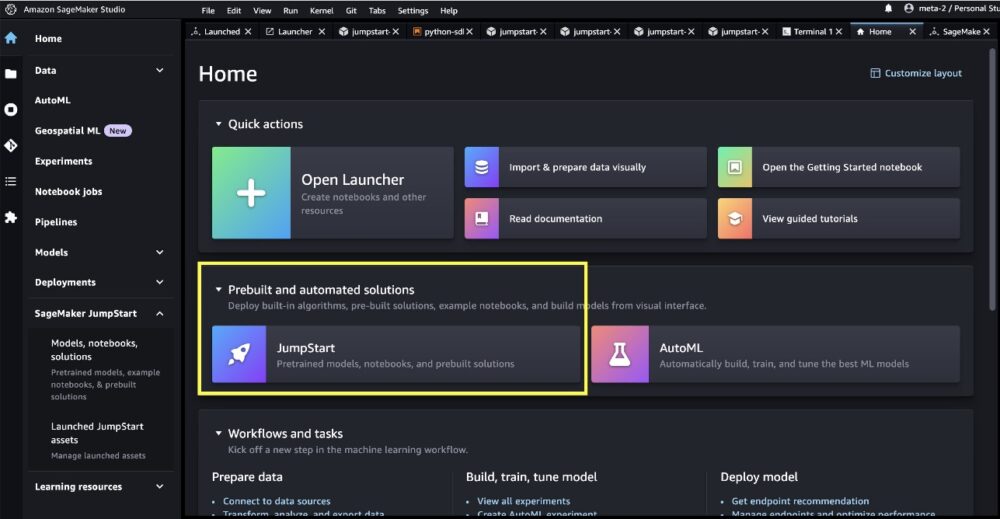

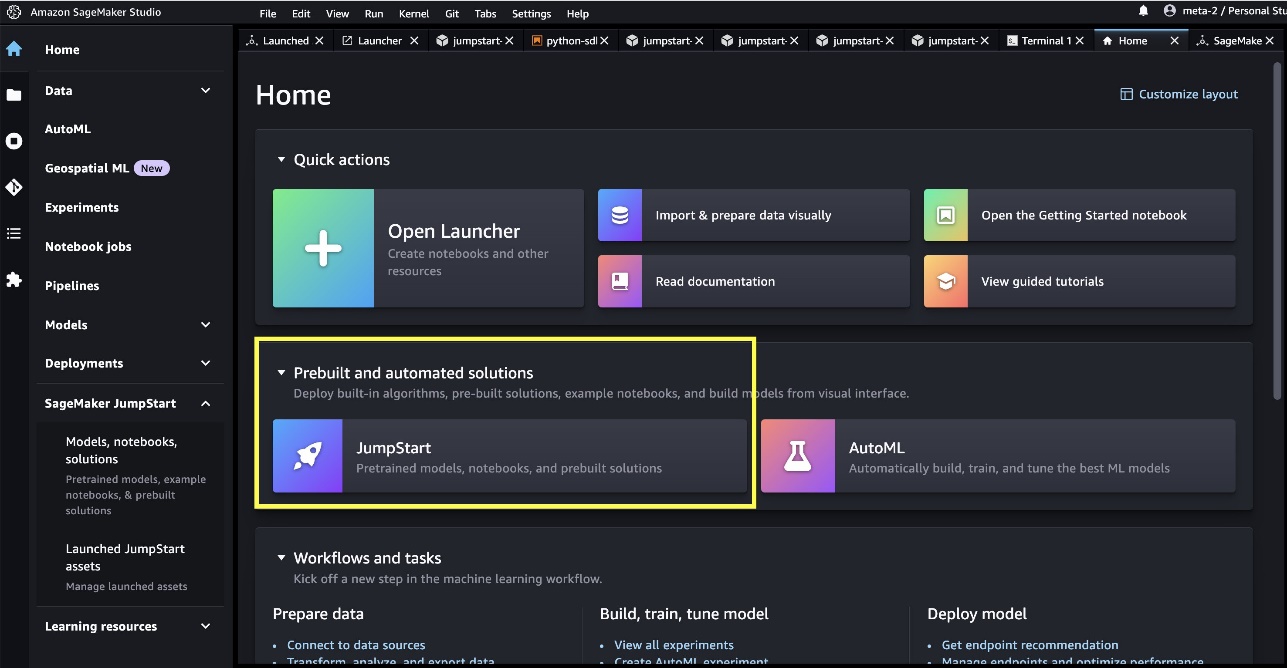

Kun olet SageMaker Studiossa, voit käyttää SageMaker JumpStartia, joka sisältää valmiiksi koulutetut mallit, muistikirjat ja valmiiksi rakennetut ratkaisut. Valmiiksi rakennetut ja automatisoidut ratkaisut.

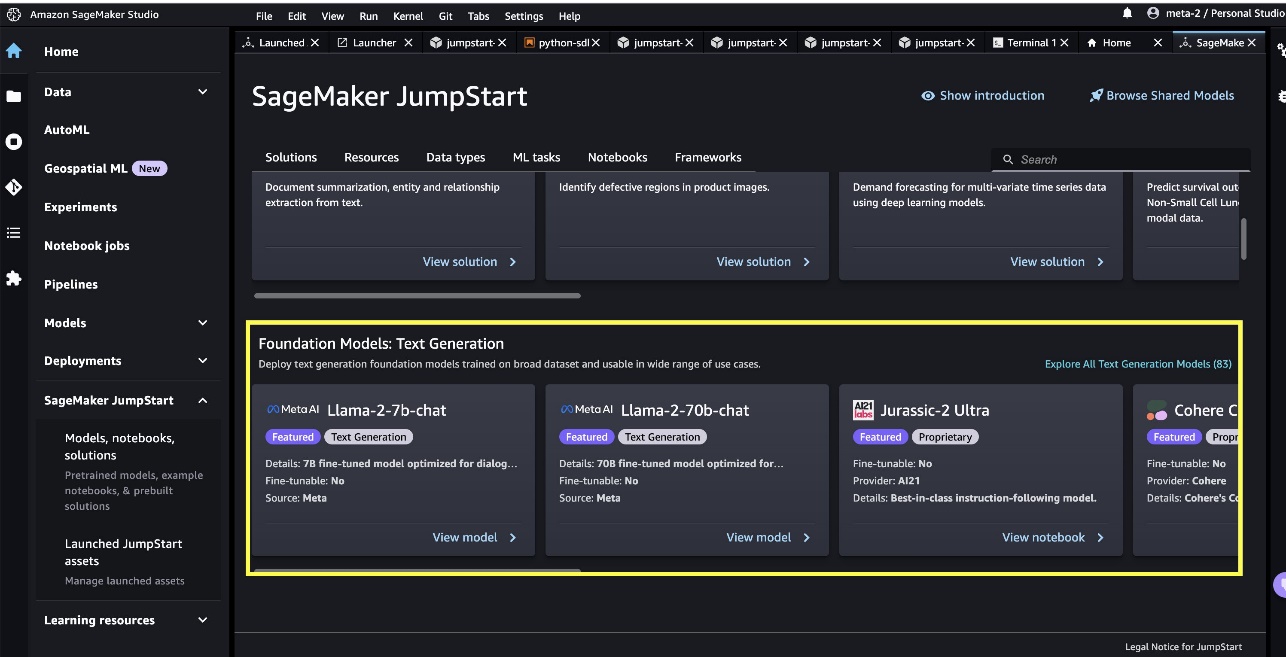

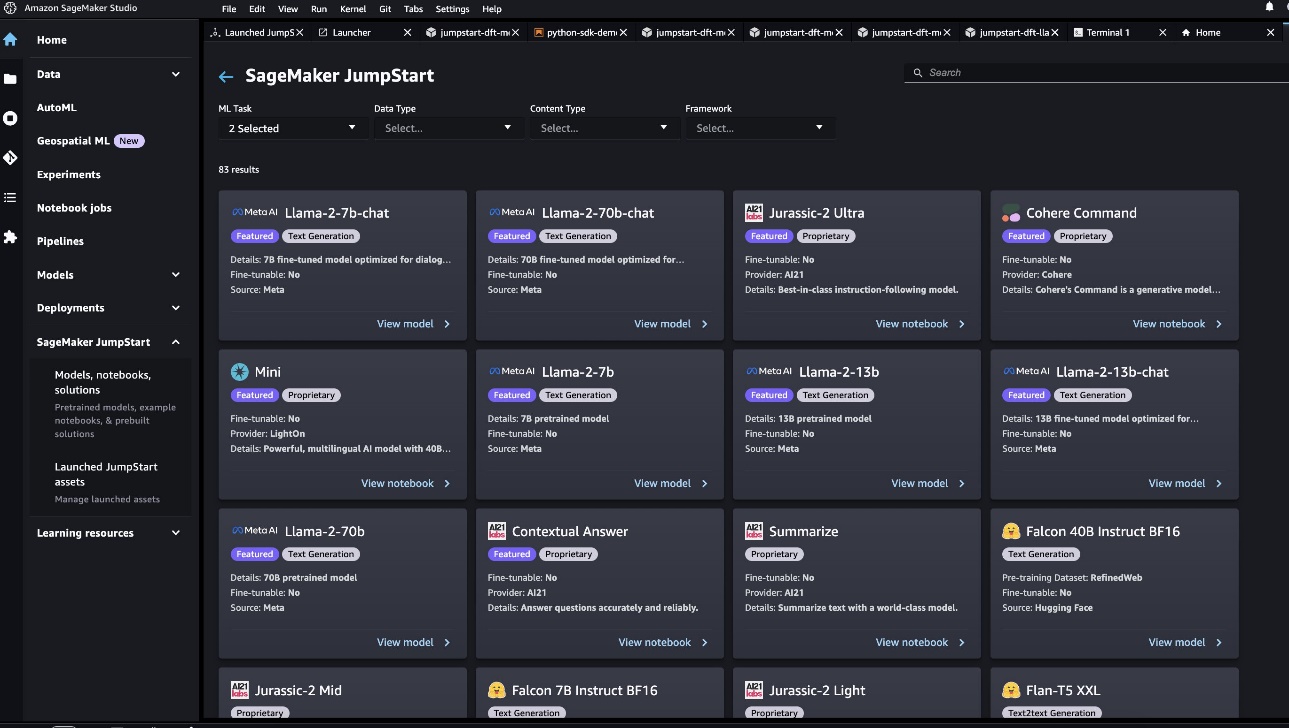

SageMaker JumpStart -aloitussivulta voit selata ratkaisuja, malleja, muistikirjoja ja muita resursseja. Löydät kaksi lippulaiva Llama 2 -mallia Pohjamallit: Tekstin luominen karuselli. Jos et näe Llama 2 -malleja, päivitä SageMaker Studio -versio sammuttamalla ja käynnistämällä uudelleen. Lisätietoja versiopäivityksistä on kohdassa Sammuta ja päivitä Studio-sovellukset.

Löydät myös neljä muuta mallivaihtoehtoa valitsemalla Tutustu kaikkiin tekstinluontimalleihin tai etsivät llama hakukenttään.

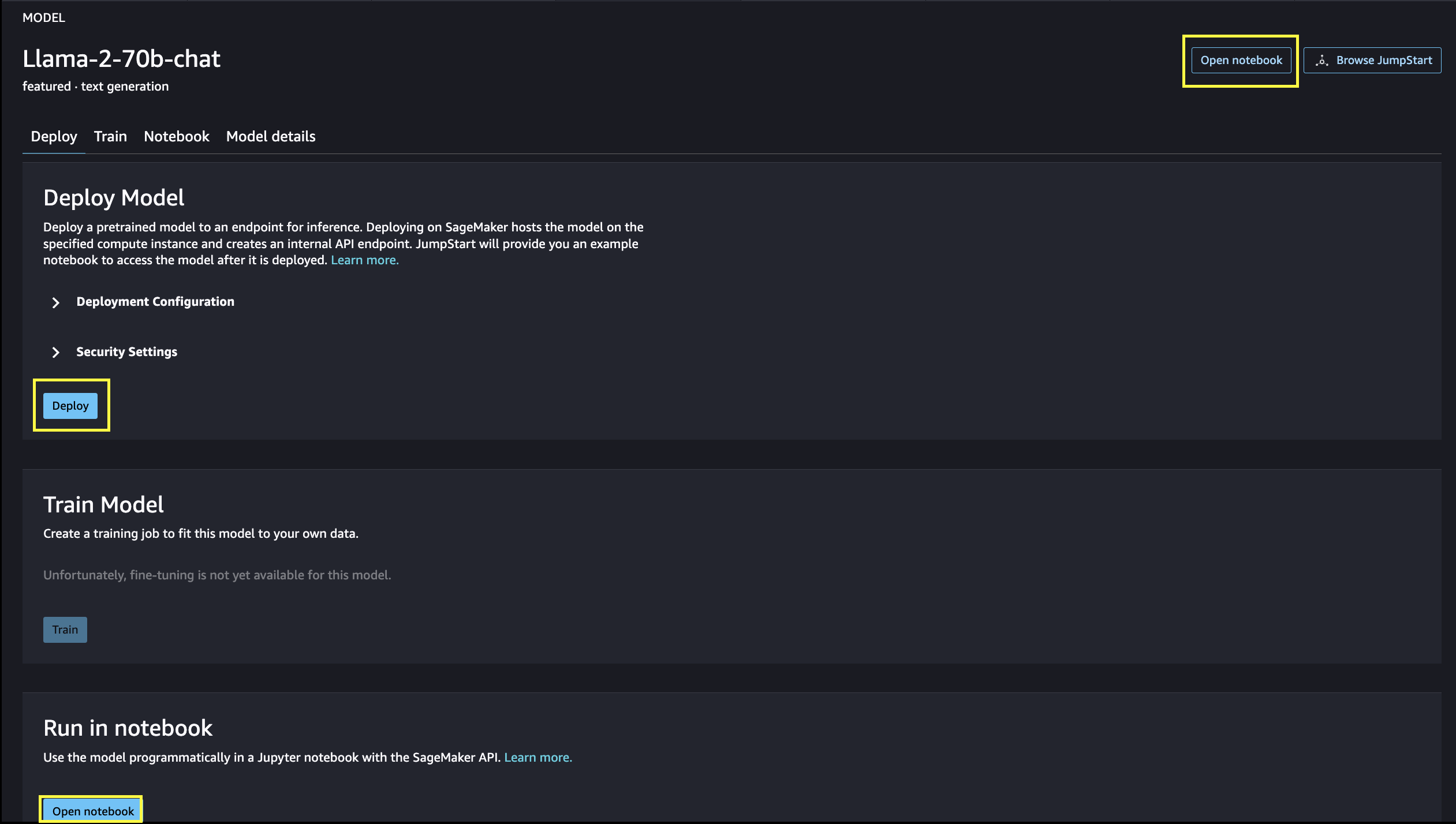

Voit valita mallikortin nähdäksesi mallin tiedot, kuten lisenssin, koulutuksessa käytetyt tiedot ja käytön. Löydät myös kaksi painiketta, Sijoittaa ja Avaa Muistikirja, jotka auttavat sinua käyttämään mallia.

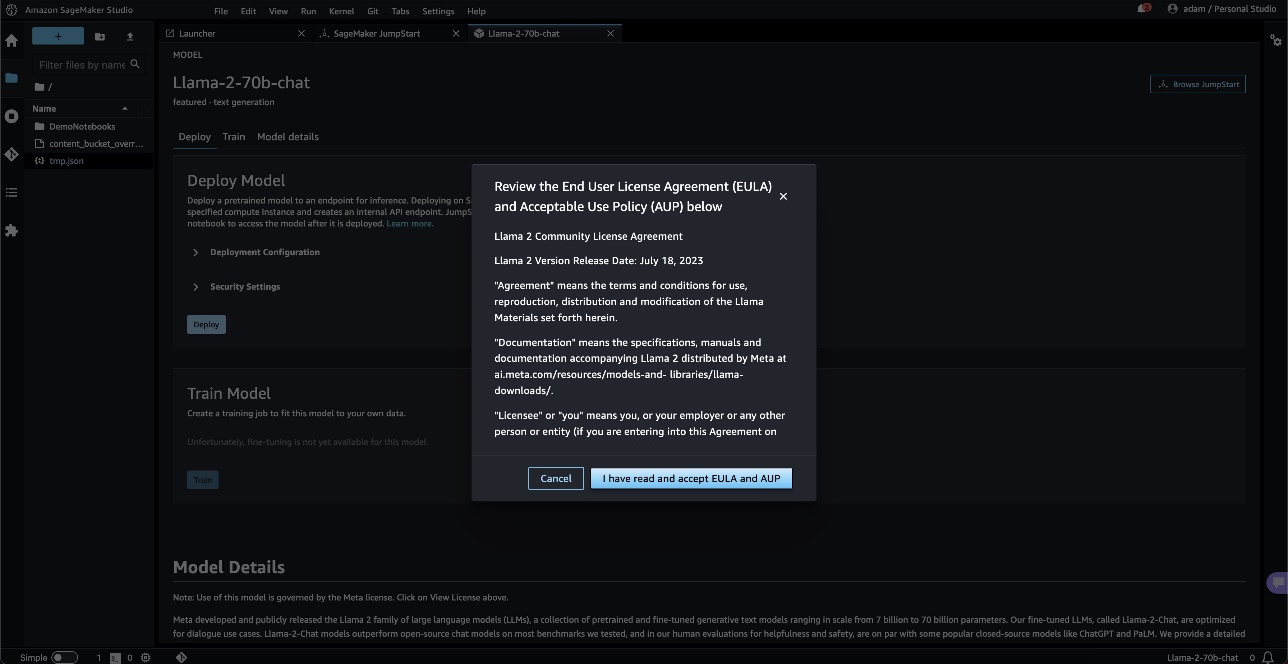

Kun valitset jommankumman painikkeen, ponnahdusikkuna näyttää loppukäyttäjän lisenssisopimuksen ja hyväksyttävän käyttökäytännön, jotka sinun on hyväksyttävä.

Hyväksyttyäsi siirryt mallin käyttöön seuraavaan vaiheeseen.

Ota malli käyttöön

Kun valitset Sijoittaa ja hyväksy ehdot, mallin käyttöönotto alkaa. Vaihtoehtoisesti voit ottaa käyttöön esimerkkimuistikirjan, joka tulee näkyviin valitsemalla Avaa Muistikirja. Esimerkkimuistikirja tarjoaa päästä päähän -ohjeita mallin käyttöönotosta päättelyyn ja resurssien puhdistamiseen.

Ottaaksesi käyttöön kannettavan tietokoneen, aloitamme valitsemalla sopivan mallin, jonka määrittelee model_id. Voit ottaa käyttöön mitä tahansa valituista malleista SageMakerissa seuraavalla koodilla:

Tämä ottaa mallin käyttöön SageMakerissa oletuskokoonpanoilla, mukaan lukien oletusinstanssityypit ja oletusarvoiset VPC-kokoonpanot. Voit muuttaa näitä määrityksiä määrittämällä ei-oletusarvoja JumpStartModel. Kun se on otettu käyttöön, voit suorittaa päättelyn käyttöön otettua päätepistettä vastaan SageMaker-ennustajan kautta:

Hienosäädetyt chat-mallit (Llama-2-7b-chat, Llama-2-13b-chat, Llama-2-70b-chat) hyväksyvät keskusteluhistorian käyttäjän ja chat-avustajan välillä ja luovat seuraavan chatin. Esiopetetut mallit (Llama-2-7b, Llama-2-13b, Llama-2-70b) vaativat merkkijonokehotteen ja suorittavat tekstin täydennyksen mukana tulleessa kehotteessa. Katso seuraava koodi:

Huomaa, että oletuksena accept_eula on asetettu epätosi. Sinun on asetettava accept_eula=true kutsua päätepiste onnistuneesti. Näin tekemällä hyväksyt aiemmin mainitun käyttöoikeussopimuksen ja hyväksyttävän käyttökäytännön. Voit myös download lisenssisopimus.

Custom_attributes EULA:n läpäisemiseen käytetään avain/arvo-pareja. Avain ja arvo on erotettu toisistaan = ja parit erotetaan toisistaan ;. Jos käyttäjä välittää saman avaimen useammin kuin kerran, viimeinen arvo säilytetään ja välitetään komentosarjan käsittelijälle (eli tässä tapauksessa käytetään ehdolliseen logiikkaan). Esimerkiksi jos accept_eula=false; accept_eula=true siirretään sitten palvelimelle accept_eula=true säilytetään ja välitetään komentosarjan käsittelijälle.

Päätelmäparametrit ohjaavat tekstin luontiprosessia päätepisteessä. Uusien tokenien maksimiohjaus viittaa mallin tuottaman lähdön kokoon. Huomaa, että tämä ei ole sama kuin sanojen määrä, koska mallin sanasto ei ole sama kuin englannin kielen sanasto, ja jokainen merkki ei välttämättä ole englanninkielinen sana. Lämpötila ohjaa lähdön satunnaisuutta. Korkeampi lämpötila johtaa luovempiin ja hallusinoituneempiin tuloksiin. Kaikki päättelyparametrit ovat valinnaisia.

Seuraavassa taulukossa luetellaan kaikki SageMaker JumpStartissa saatavilla olevat Llama-mallit sekä model_ids, oletusilmentymien tyypit ja kunkin mallin tuettujen merkkien kokonaismäärä (syöttötunnusten lukumäärän ja luotujen merkkien lukumäärän summa).

| Mallin nimi | Model ID | Tokenien enimmäismäärä | Oletusinstanssityyppi |

| Laama-2-7b | meta-tekstin sukupolvi-laama-2-7b | 4096 | ml.g5.2xsuuri |

| Laama-2-7b-chat | meta-tekstin sukupolvi-laama-2-7b-f | 4096 | ml.g5.2xsuuri |

| Laama-2-13b | meta-tekstin sukupolvi-laama-2-13b | 4096 | ml.g5.12xsuuri |

| Laama-2-13b-chat | meta-tekstin sukupolvi-laama-2-13b-f | 4096 | ml.g5.12xsuuri |

| Laama-2-70b | meta-tekstin sukupolvi-laama-2-70b | 4096 | ml.g5.48xsuuri |

| Laama-2-70b-chat | meta-tekstin sukupolvi-laama-2-70b-f | 4096 | ml.g5.48xsuuri |

Huomaa, että SageMaker-päätepisteiden aikaraja on 60 sekuntia. Näin ollen, vaikka malli voi pystyä luomaan 4096 merkkiä, jos tekstin luominen kestää yli 60 sekuntia, pyyntö epäonnistuu. 7B-, 13B- ja 70B-malleille suosittelemme asetusta max_new_tokens enintään 1500 1000, 500 4 ja XNUMX, samalla kun merkkien kokonaismäärä on pienempi kuin XNUMXK.

Päätelmä- ja esimerkkikehotteet Llama-2-70b:lle

Voit käyttää Llama-malleja minkä tahansa tekstin tekstin täydentämiseen. Tekstin luomisen avulla voit suorittaa erilaisia tehtäviä, kuten vastata kysymyksiin, kääntää kieliä, analysoida tunteita ja paljon muuta. Syötetty hyötykuorma päätepisteeseen näyttää seuraavalta koodilta:

Seuraavassa on esimerkkejä esimerkkikehotteista ja mallin luomasta tekstistä. Kaikki lähdöt generoidaan päättelyparametreilla {"max_new_tokens":256, "top_p":0.9, "temperature":0.6}.

Seuraavassa esimerkissä näytämme kuinka Llama-malleja käytetään muutaman otoksen kontekstin sisäisessä oppimisessa, jossa tarjoamme mallille saatavilla olevia koulutusnäytteitä. Huomaa, että teemme päätelmiä vain käyttöönotetusta mallista, ja tämän prosessin aikana mallien painot eivät muutu.

Päätelmä- ja esimerkkikehotteet Llama-2-70b-chatille

Dialogikäyttöön optimoiduissa Llama-2-Chat-malleissa keskustelumallin päätepisteiden syöte on chat-avustajan ja käyttäjän välinen aikaisempi historia. Voit esittää kysymyksiä, jotka liittyvät tähän mennessä tapahtuneeseen keskusteluun. Voit myös antaa järjestelmämääritykset, kuten henkilöt, jotka määrittävät chat-avustajan toiminnan. Päätepisteen syöttökuorma näyttää seuraavalta koodilta:

Seuraavassa on esimerkkejä esimerkkikehotteista ja mallin luomasta tekstistä. Kaikki lähdöt generoidaan päättelyparametreilla {"max_new_tokens": 512, "top_p": 0.9, "temperature": 0.6}.

Seuraavassa esimerkissä käyttäjä on keskustellut avustajan kanssa Pariisin matkailukohteista. Seuraavaksi käyttäjä tiedustelee chat-avustajan suosittelemaa ensimmäistä vaihtoehtoa.

Seuraavissa esimerkeissä asetamme järjestelmän asetukset:

Puhdistaa

Kun olet lopettanut muistikirjan käyttämisen, muista poistaa kaikki resurssit, jotta kaikki prosessissa luomasi resurssit poistetaan ja laskutuksesi lopetetaan:

Yhteenveto

Tässä viestissä näytimme sinulle, kuinka pääset alkuun Llama 2 -mallien kanssa SageMaker Studiossa. Tämän avulla sinulla on pääsy kuuteen Llama 2 -pohjamalliin, jotka sisältävät miljardeja parametreja. Koska perusmallit ovat valmiiksi koulutettuja, ne voivat myös auttaa alentamaan koulutus- ja infrastruktuurikustannuksia ja mahdollistaa räätälöinnin käyttötarpeisiisi. Pääset alkuun SageMaker JumpStartin kanssa käymällä seuraavissa resursseissa:

Tietoja kirjoittajista

Kesäkuu voitti on SageMaker JumpStartin tuotepäällikkö. Hän keskittyy tekemään perusmalleista helposti löydettäviä ja käyttökelpoisia auttamaan asiakkaita luomaan luovia tekoälysovelluksia. Hänen kokemukseensa Amazonista kuuluu myös mobiiliostossovellus ja viimeinen mailitoimitus.

Kesäkuu voitti on SageMaker JumpStartin tuotepäällikkö. Hän keskittyy tekemään perusmalleista helposti löydettäviä ja käyttökelpoisia auttamaan asiakkaita luomaan luovia tekoälysovelluksia. Hänen kokemukseensa Amazonista kuuluu myös mobiiliostossovellus ja viimeinen mailitoimitus.

Tohtori Vivek Madan on soveltuva tutkija Amazon SageMaker JumpStart -tiimin kanssa. Hän sai tohtorin tutkinnon Illinoisin yliopistosta Urbana-Champaignissa ja oli tutkijatohtorina Georgia Techissä. Hän on aktiivinen koneoppimisen ja algoritmisuunnittelun tutkija ja julkaissut julkaisuja EMNLP-, ICLR-, COLT-, FOCS- ja SODA-konferensseissa.

Tohtori Vivek Madan on soveltuva tutkija Amazon SageMaker JumpStart -tiimin kanssa. Hän sai tohtorin tutkinnon Illinoisin yliopistosta Urbana-Champaignissa ja oli tutkijatohtorina Georgia Techissä. Hän on aktiivinen koneoppimisen ja algoritmisuunnittelun tutkija ja julkaissut julkaisuja EMNLP-, ICLR-, COLT-, FOCS- ja SODA-konferensseissa.  Tohtori Kyle Ulrich on soveltuva tutkija Amazon SageMaker JumpStart -tiimin kanssa. Hänen tutkimusalueitaan ovat skaalautuvat koneoppimisalgoritmit, tietokonenäkö, aikasarjat, Bayesin ei-parametrit ja Gaussin prosessit. Hänen tohtorinsa on Duken yliopistosta ja hän on julkaissut artikkeleita NeurIPS-, Cell- ja Neuron-julkaisuissa.

Tohtori Kyle Ulrich on soveltuva tutkija Amazon SageMaker JumpStart -tiimin kanssa. Hänen tutkimusalueitaan ovat skaalautuvat koneoppimisalgoritmit, tietokonenäkö, aikasarjat, Bayesin ei-parametrit ja Gaussin prosessit. Hänen tohtorinsa on Duken yliopistosta ja hän on julkaissut artikkeleita NeurIPS-, Cell- ja Neuron-julkaisuissa.  Tohtori Ashish Khetan on vanhempi soveltuva tutkija Amazon SageMaker JumpStartissa ja auttaa kehittämään koneoppimisalgoritmeja. Hän sai tohtorin tutkinnon Illinois Urbana-Champaignin yliopistosta. Hän on aktiivinen koneoppimisen ja tilastollisen päättelyn tutkija, ja hän on julkaissut monia artikkeleita NeurIPS-, ICML-, ICLR-, JMLR-, ACL- ja EMNLP-konferensseissa.

Tohtori Ashish Khetan on vanhempi soveltuva tutkija Amazon SageMaker JumpStartissa ja auttaa kehittämään koneoppimisalgoritmeja. Hän sai tohtorin tutkinnon Illinois Urbana-Champaignin yliopistosta. Hän on aktiivinen koneoppimisen ja tilastollisen päättelyn tutkija, ja hän on julkaissut monia artikkeleita NeurIPS-, ICML-, ICLR-, JMLR-, ACL- ja EMNLP-konferensseissa.  Sundar Ranganathan on AWS:n GenAI/Frameworks GTM -asiantuntijoiden globaali johtaja. Hän keskittyy GTM-strategian kehittämiseen suurille kielimalleille, GenAI:lle ja suurille ML-työkuormille AWS-palveluissa, kuten Amazon EC2, EKS, EFA, AWS Batch ja Amazon SageMaker. Hänen kokemuksensa sisältää johtotehtäviä tuotehallinnassa ja tuotekehityksessä NetAppilla, Micron Technologylla, Qualcommilla ja Mentor Graphicsilla.

Sundar Ranganathan on AWS:n GenAI/Frameworks GTM -asiantuntijoiden globaali johtaja. Hän keskittyy GTM-strategian kehittämiseen suurille kielimalleille, GenAI:lle ja suurille ML-työkuormille AWS-palveluissa, kuten Amazon EC2, EKS, EFA, AWS Batch ja Amazon SageMaker. Hänen kokemuksensa sisältää johtotehtäviä tuotehallinnassa ja tuotekehityksessä NetAppilla, Micron Technologylla, Qualcommilla ja Mentor Graphicsilla.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. Autot / sähköautot, hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- BlockOffsets. Ympäristövastuun omistuksen nykyaikaistaminen. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/llama-2-foundation-models-from-meta-are-now-available-in-amazon-sagemaker-jumpstart/

- :on

- :On

- :ei

- :missä

- $ YLÖS

- 1

- 10

- 100

- 11

- 13

- 15%

- 17

- 19

- 20

- 30

- 31

- 33

- 360 asteen

- 40

- 4k

- 500

- 7

- 70

- 8

- 9

- a

- pystyy

- Meistä

- Hyväksyä

- hyväksyttävä

- pääsy

- saavutettavuus

- saatavilla

- Mukaan

- tunnustaa

- poikki

- aktiivinen

- lisätä

- lisää

- lisä-

- osoite

- Jälkeen

- uudelleen

- vastaan

- sopimus

- AI

- algoritmi

- algoritmit

- kohdista

- Kaikki

- sallia

- pitkin

- Myös

- aina

- am

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon SageMaker Studio

- Amazon Web Services

- Amerikkalainen

- an

- analyysi

- ja

- ja infrastruktuuri

- Ilmoittaa

- Toinen

- vastaus

- Kaikki

- joku

- Hakemus

- sovellukset

- sovellettu

- arvostaa

- sopiva

- Kaari

- arkkitehtuuri

- OVAT

- Art

- AS

- auttaa

- Avustaja

- At

- Tunnelma

- nähtävyyksiä

- Automatisoitu

- saatavissa

- AWS

- Banaani

- perustiedot

- Taistelu

- Bayes

- BE

- kaunis

- Kauneus

- tuli

- koska

- tulevat

- ollut

- olut

- ennen

- käyttäytyminen

- Beijing

- Uskoa

- uskoi

- PARAS

- välillä

- laskutus

- Miljardi

- miljardeja

- Musta

- Laatikko

- Tauko

- henkeäsalpaava

- laaja

- rakentaa

- Rakentaminen

- rakennettu

- mutta

- nappia

- by

- nimeltään

- CAN

- pääoma

- auto

- kortti

- karuselli

- tapaus

- tapauksissa

- KISSA

- muuttaa

- Suklaa

- Valita

- valita

- Kaupunki

- klassinen

- koodi

- kokoelma

- yhdistetty

- yhdistää

- tulee

- tuleva

- kaupallinen

- yritys

- valmistuminen

- tietokone

- Tietokoneen visio

- konferenssit

- luottavainen

- Konfigurointi

- harkittu

- vakio

- rakentaminen

- sisältää

- Kontti

- sisältää

- pitoisuus

- asiayhteyteen

- jatkaa

- jatkuvasti

- ohjaus

- valvonta

- Mukava

- Keskustelu

- kustannukset

- maa

- rohkeus

- kattaa

- luoda

- luotu

- Luova

- kulttuurinen

- Kulttuuri

- Kuppi

- Asiakkaat

- räätälöinnin

- räätälöidä

- tiedot

- tietoturva

- omistautunut

- omistautuminen

- oletusarvo

- määritellä

- toimitus

- sijoittaa

- käyttöön

- levityspinnalta

- käyttöönotto

- lauennut

- Malli

- suunniteltu

- haluttu

- määränpää

- kohteet

- yksityiskohdat

- kehittää

- kehitetty

- Kehittäjä

- kehittämällä

- Kehitys

- Vuoropuhelu

- ero

- eri

- vaikea

- löytää

- selvästi erottuva

- do

- dokumentteja

- tekee

- tehty

- Dont

- kaksinkertaistunut

- alas

- Herttua

- herttua yliopisto

- aikana

- e

- kukin

- Aikaisemmin

- helposti

- helppo

- Edward

- Einstein

- myöskään

- mahdollistaa

- mahdollistaa

- loppu

- päittäin

- päätepiste

- Tekniikka

- Englanti

- nauttia

- tarpeeksi

- varmistaa

- ympäristö

- laitteet

- Eetteri

- Jopa

- Tapahtumat

- jokainen

- esimerkki

- Esimerkit

- innoissaan

- experience

- kokeilu

- kokeiluja

- ilmaista

- FAIL

- Epäonnistui

- oikeudenmukainen

- väärä

- perhe

- kuuluisa

- paljon

- saavutus

- varustellun

- Ominaisuudet

- palaute

- jalat

- harvat

- elokuvat

- lopullinen

- Vihdoin

- Löytää

- Etunimi

- lippulaiva

- kellua

- virrat

- keskittyy

- jälkeen

- varten

- Eteenpäin

- löytyi

- perusta

- neljä

- Ranska

- Ranskan

- alkaen

- täysin

- edelleen

- tulevaisuutta

- general

- tuottaa

- syntyy

- sukupolvi

- generatiivinen

- Generatiivinen AI

- Georgia

- saada

- Antaa

- lasi-

- Global

- Go

- menee

- grafiikka

- suuri

- suurempi

- uraauurtava

- Kasvaa

- ohjaus

- ohjaavat

- HAD

- Vetimet

- tapahtui

- onnellinen

- Kova

- kovaa työtä

- Olla

- ottaa

- he

- pää

- auttaa

- auttaa

- auttaa

- tätä

- hi

- Korkea

- korkeampi

- hänen

- historiallinen

- historia

- kotelo

- Miten

- Miten

- HTML

- HTTPS

- Napa

- ihmisen

- i

- ikoninen

- ajatus

- if

- ii

- Illinois

- Vaikutus

- tuoda

- tärkeä

- vaikuttava

- in

- sisältää

- sisältää

- Mukaan lukien

- yhdistetty

- tiedot

- Infrastruktuuri

- ensin

- panos

- innoittamana

- innoittava

- esimerkki

- heti

- ohjeet

- integroitu

- tarkoitettu

- etu

- liitäntä

- tulee

- yksittäinen

- IT

- SEN

- matka

- jpg

- vain

- pito

- säilytetään

- avain

- laji

- Tietää

- tunnettu

- lasku

- maamerkki

- Kieli

- suuri

- laaja

- suurin

- Sukunimi

- Myöhään

- käynnistää

- Lait

- Johto

- OPPIA

- Opi ja kasva

- oppiminen

- vähiten

- vähemmän

- tasot

- Lisenssi

- elämä

- valo

- pitää

- RAJOITA

- Listat

- kirjallisuus

- ll

- liekki

- logiikka

- Pitkät

- pitkä aika

- näköinen

- ulkonäkö

- rakkaus

- rakastettu

- alentaa

- kone

- koneoppiminen

- tehty

- tehdä

- TEE

- Tekeminen

- johto

- johtaja

- monet

- ihme

- asia

- maksimi

- Saattaa..

- merkitys

- mitata

- Media

- keskikokoinen

- mainitsi

- viesti

- Meta

- mikroni

- minuutti

- minuuttia

- seos

- ML

- MLOps

- Puhelinnumero

- malli

- mallit

- hetki

- kk

- lisää

- eniten

- Suosituin

- liike

- elokuva

- paljon

- museo

- museot

- Musiikki

- nimi

- Luonnollinen

- välttämätön

- Tarve

- tarvitaan

- verkko

- Uusi

- New York

- seuraava

- Nro

- muistikirja

- nyt

- numero

- useat

- NY

- of

- kampanja

- tarjoamalla

- Tarjoukset

- Öljy

- on

- kerran

- ONE

- vain

- avata

- avoimen lähdekoodin

- Optimoida

- optimoitu

- Vaihtoehto

- or

- Muut

- Muuta

- muuten

- meidän

- ulos

- ulostulo

- yli

- yleinen

- sivulla

- paria

- Paperi

- paperit

- parametri

- parametrit

- Pariisi

- osa

- kulkea

- Hyväksytty

- kulkee

- Ohi

- rauha

- Suorittaa

- suorituskyky

- pysyvä

- puhelin

- valokuvia

- Fysiikka

- kappale

- Pizza

- muovi

- Platon

- Platonin tietotieto

- PlatonData

- pelataan

- politiikka

- pop-up

- Suosittu

- Kirje

- posti-

- Predictor

- mieltymykset

- valmistelee

- esittää

- edellinen

- prosessi

- Prosessit

- Tuotteet

- tuotekehitys

- tuotehallinta

- tuotepäällikkö

- ehdotukset

- ylpeä

- toimittaa

- mikäli

- tarjoaa

- tarjoamalla

- julkinen

- julkinen liikenne

- julkisesti

- julkaistu

- tarkoitus

- laittaa

- Python

- Qualcomm

- kysymykset

- nopea

- nopeasti

- rampit

- satunnaisuuden

- alue

- alainen

- valmis

- syistä

- vastaanottaa

- resepti

- suositella

- suositeltu

- viittaa

- riippumatta

- alueet

- suhteellinen

- suhteellisuus

- toistuva

- edustaa

- pyyntö

- Vaatii

- tutkimus

- tutkija

- Esittelymateriaalit

- vastaavasti

- Vastata

- REST

- johtua

- tulokset

- Joki

- Rooli

- roolit

- ajaa

- juoksu

- s

- Turvallisuus

- sagemaker

- suolaa

- sama

- skaalautuva

- Asteikko

- Tiedemies

- tutkijat

- sdk

- SEA

- Haku

- haku

- Osa

- turvallinen

- turvallisuus

- nähdä

- koska

- näytti

- valittu

- valitsemalla

- valinta

- lähettää

- vanhempi

- näkemys

- Sarjat

- Palvelut

- palvelevat

- setti

- asetus

- Muoto

- hai

- Ostokset

- shouldnt

- näyttää

- osoittivat

- Näytä

- sammutetaan

- merkitys

- merkittävä

- Yksinkertainen

- yksinkertaisesti

- single

- paikka

- Sivustot

- SIX

- Koko

- Hitaasti

- pieni

- So

- niin kaukana

- sosiaalinen

- sosiaalinen media

- Ratkaisumme

- jonkin verran

- lähde

- Lähteet

- erityinen

- asiantuntijat

- määritelty

- nopeus

- seisoo

- Alkaa

- alkoi

- Osavaltio

- Valtiot

- tilastollinen

- Vaihe

- Askeleet

- pysähtynyt

- Strategia

- jono

- rakenne

- studio

- Upea

- aihe

- myöhempi

- menestys

- Onnistuneesti

- niin

- Tuetut

- varma

- symboli

- järjestelmä

- taulukko

- ottaa

- vie

- tehtävät

- näppäimet

- joukkue-

- teknologia

- Elektroniikka

- tilapäinen

- ehdot

- kuin

- Kiitos

- että

- -

- Pääkaupunki

- Tulevaisuus

- Lähde

- maailma

- heidän

- Niitä

- teoria

- Siellä.

- Nämä

- ne

- asiat

- ajatella

- tätä

- vaikka?

- Kautta

- Tiikeri

- aika

- Aikasarja

- kertaa

- Otsikko

- että

- tänään

- yhdessä

- symbolinen

- tokens

- työkalut

- ylin

- Yhteensä

- Tower

- Juna

- koulutus

- muuntaja

- Kääntää

- Kääntäminen

- kuljetus

- Biljoona

- yrittää

- kaksi

- tyyppi

- tyypit

- ui

- varten

- unohtumaton

- unique

- yliopisto

- asti

- Päivitykset

- Päivitykset

- käyttökelpoinen

- käyttää

- käyttölaukku

- käytetty

- käyttäjä

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- arvo

- arvot

- lajike

- versio

- versiot

- hyvin

- kautta

- Näytä

- näkymät

- visio

- Vierailla

- Vierailijat

- tilavuus

- halusi

- sota

- oli

- we

- verkko

- verkkopalvelut

- Web-pohjainen

- Verkkosivu

- HYVIN

- Valas

- Mitä

- Mikä on

- kun

- taas

- joka

- vaikka

- miksi

- tulee

- ikkunat

- with

- sana

- sanoja

- Referenssit

- toimii

- maailman-

- maailmankuulu

- kääri

- vuotta

- york

- Voit

- Sinun

- itse

- zephyrnet

- Postinumero