Amazon SageMaker többmodell végpontok (MME) egy teljesen felügyelt SageMaker következtetés, amely lehetővé teszi több ezer modell telepítését egyetlen végponton. Korábban az MME-k előre meghatározott CPU számítási teljesítményt statikusan allokáltak a modellekre, függetlenül a modell forgalmi terhelésétől. Multi Model Server (MMS) mint modellkiszolgálója. Ebben a bejegyzésben egy olyan megoldást tárgyalunk, amelyben az MME dinamikusan állíthatja be az egyes modellekhez rendelt számítási teljesítményt a modell forgalmi mintája alapján. Ez a megoldás lehetővé teszi az MME-k mögöttes számításának hatékonyabb használatát és költségmegtakarítást.

Az MME-k dinamikusan töltik be és töltik be a modelleket a végpontra érkező forgalom alapján. Amikor MMS-t használnak modellszerverként, az MME-k rögzített számú modellmunkásokat osztanak ki minden modellhez. További információkért lásd: Modelltárolási minták az Amazon SageMakerben, 3. rész: Futtassa és optimalizálja a többmodelles következtetést az Amazon SageMaker többmodell végpontjaival.

Ez azonban néhány problémához vezethet, ha a forgalmi minta változó. Tegyük fel, hogy egyetlen vagy néhány modellje van, amelyek nagy forgalmat kapnak. Beállíthatja az MMS-t úgy, hogy nagy számú dolgozót rendeljen hozzá ezekhez a modellekhez, de ez az MME mögötti összes modellhez hozzá van rendelve, mivel ez egy statikus konfiguráció. Ez ahhoz vezet, hogy nagyszámú dolgozó használ hardveres számítást – még a tétlen modelleket is. Az ellenkező probléma fordulhat elő, ha kis értéket állít be a dolgozók számára. A népszerű modelleknél nem lesz elég dolgozó a modellkiszolgáló szintjén ahhoz, hogy megfelelő hardvert rendeljenek el a végpont mögött ezekhez a modellekhez. A fő probléma az, hogy nehéz a forgalmi minták agnosztikusnak maradni, ha nem tudja dinamikusan skálázni a dolgozókat a modellkiszolgáló szintjén a szükséges számítási mennyiség lefoglalásához.

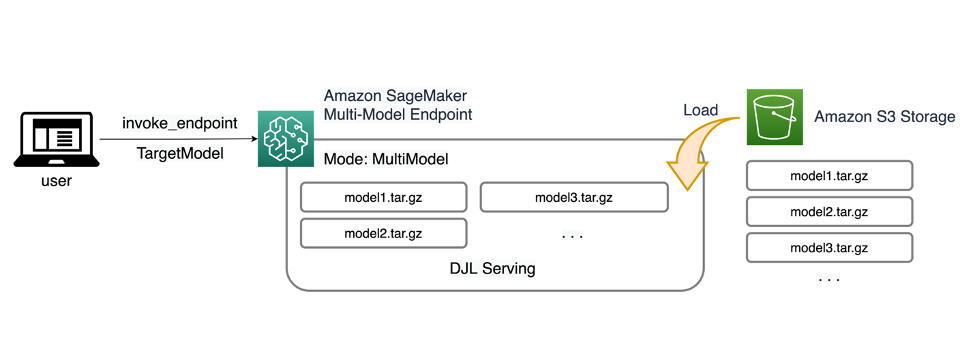

Az ebben a bejegyzésben tárgyalt megoldást használja DJLS-szolgáltatás mint modellszerver, amely segíthet enyhíteni az általunk megvitatott problémák egy részét, lehetővé teszi a modellenkénti skálázást, és lehetővé teszi az MME-k számára, hogy a forgalmi minták agnosztikusak legyenek.

MME architektúra

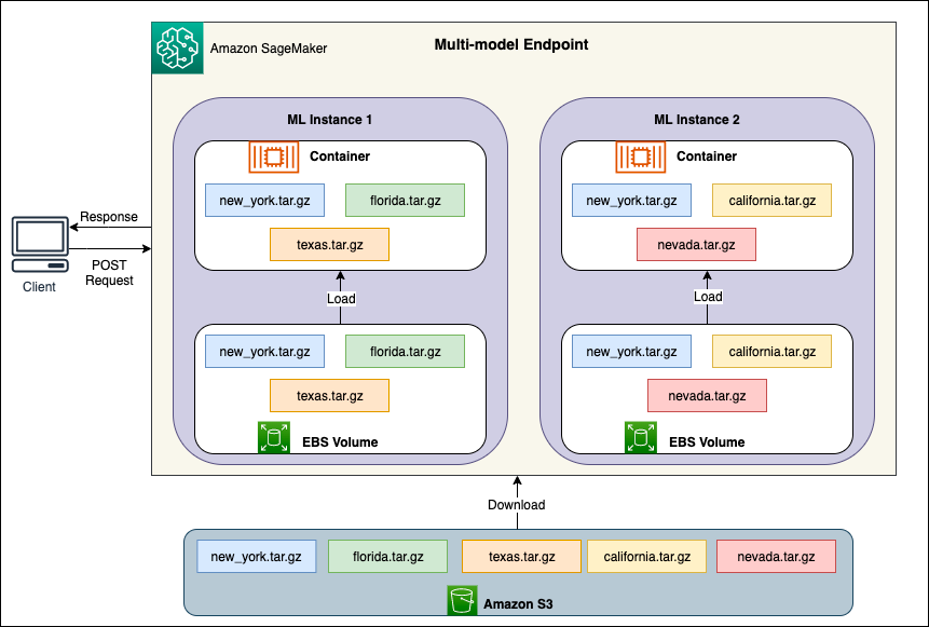

A SageMaker MME-k lehetővé teszik több modell telepítését egyetlen következtetési végpont mögé, amely egy vagy több példányt tartalmazhat. Mindegyik példányt több modell betöltésére és kiszolgálására tervezték, egészen a memória és a CPU/GPU kapacitásig. Ezzel az architektúrával a szoftver, mint szolgáltatás (SaaS) üzletág megtörheti a több modell hosztolásának lineárisan növekvő költségeit, és elérheti az infrastruktúra újrafelhasználását, amely összhangban van az alkalmazásveremben máshol alkalmazott többbérleti modellel. A következő diagram ezt az architektúrát szemlélteti.

A SageMaker MME dinamikusan betölti a modelleket innen Amazon egyszerű tárolási szolgáltatás (Amazon S3) meghívásakor, ahelyett, hogy a végpont első létrehozásakor letöltené az összes modellt. Ennek eredményeként egy modell kezdeti meghívása magasabb következtetési késleltetést láthat, mint a későbbi következtetések, amelyek alacsony késleltetéssel fejeződnek be. Ha a modell meghívásakor már be van töltve a tárolóba, akkor a letöltési lépés kimarad, és a modell alacsony késleltetéssel adja vissza a következtetéseket. Tegyük fel például, hogy van egy modellje, amelyet naponta csak néhány alkalommal használnak. Igény szerint automatikusan betöltődik, míg a gyakran használt modellek a memóriában maradnak, és következetesen alacsony késleltetéssel hívódnak meg.

Az egyes MME mögött modelltárhely-példányok találhatók, amint az a következő ábrán látható. Ezek a példányok több modellt töltenek be a memóriába és a memóriából a modellek forgalmi mintái alapján.

A SageMaker továbbra is a modellhez tartozó következtetési kérelmeket arra a példányra irányítja, ahol a modell már be van töltve, így a kérések egy gyorsítótárazott modellmásolatból kerülnek kiszolgálásra (lásd a következő diagramot, amely az első előrejelzési kérelem kérési útvonalát mutatja a gyorsítótárazott előrejelzéssel szemben kérési útvonal). Ha azonban a modell sok hívási kérelmet kap, és vannak további példányok az MME-hez, a SageMaker egyes kéréseket egy másik példányhoz irányít a növekedéshez. A SageMaker automatizált modellméretezésének előnyeinek kihasználásához győződjön meg arról, hogy rendelkezik példány automatikus skálázás beállítása további példánykapacitás biztosítására. Állítsa be a végpont-szintű skálázási szabályzatot egyéni paraméterekkel vagy percenkénti hívásokkal (ajánlott), hogy további példányokat adjon a végpontflottához.

Modellszerver áttekintése

A modellkiszolgáló egy szoftverösszetevő, amely futási környezetet biztosít a gépi tanulási (ML) modellek üzembe helyezéséhez és kiszolgálásához. Interfészként működik a betanított modellek és a kliensalkalmazások között, amelyek előrejelzéseket szeretnének készíteni ezen modellek használatával.

A modellszerver elsődleges célja, hogy lehetővé tegye az ML-modellek zökkenőmentes integrációját és hatékony telepítését a termelési rendszerekbe. Ahelyett, hogy a modellt közvetlenül egy alkalmazásba vagy egy adott keretrendszerbe ágyazza be, a modellkiszolgáló egy központi platformot biztosít, ahol több modell telepíthető, kezelhető és kiszolgálható.

A modellszerverek általában a következő funkciókat kínálják:

- Modell betöltése – A szerver betölti a betanított ML modelleket a memóriába, így készen áll az előrejelzések kiszolgálására.

- Következtetés API – A szerver elérhetővé tesz egy API-t, amely lehetővé teszi az ügyfélalkalmazások bemeneti adatok küldését és előrejelzések fogadását a telepített modellektől.

- Scaling – A modellszervereket úgy tervezték, hogy több klienstől érkező egyidejű kéréseket kezeljenek. Mechanizmusokat biztosítanak a párhuzamos feldolgozáshoz és az erőforrások hatékony kezeléséhez a nagy átviteli sebesség és az alacsony késleltetés biztosítása érdekében.

- Integráció háttérmotorokkal – A modellkiszolgálók integrálhatók olyan háttér-keretrendszerekkel, mint a DeepSpeed és a FasterTransformer a nagy modellek particionálásához és rendkívül optimalizált következtetések futtatásához.

DJL architektúra

DJL tálalás egy nyílt forráskódú, nagy teljesítményű, univerzális modellszerver. A DJL Serving a tetejére épül Djl, egy Java programozási nyelven írt mély tanulási könyvtár. Szükség lehet egy mély tanulási modellre, több modellre vagy munkafolyamatokra, és elérhetővé teheti őket egy HTTP-végponton keresztül. A DJL Serving támogatja a több keretrendszerből származó modellek telepítését, mint például a PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer és még sok más.

A DJL Serving számos olyan funkciót kínál, amelyek lehetővé teszik a modellek nagy teljesítményű üzembe helyezését:

- Egyszerű használat – A DJL Serving a legtöbb modellt már a dobozból is ki tudja szolgálni. Csak hozza magával a modellműtárgyakat, és a DJL Serving fogadja őket.

- Több eszköz és gyorsító támogatása – A DJL Serving támogatja a modellek CPU-n, GPU-n és GPU-n történő telepítését AWS Inferentia.

- teljesítmény – A DJL Serving többszálú következtetést futtat egyetlen JVM-ben az átviteli sebesség növelése érdekében.

- Dinamikus kötegelés – A DJL Serving támogatja a dinamikus kötegelést az átviteli sebesség növelése érdekében.

- Automatikus méretezés – A DJL Serving automatikusan felfelé és lefelé skálázza a dolgozókat a forgalmi terhelés alapján.

- Többmotoros támogatás – A DJL Serving egyidejűleg üzemeltethet különböző keretrendszereket (például PyTorch és TensorFlow) használó modelleket.

- Együttes és munkafolyamat modellek – A DJL Serving támogatja a több modellből álló összetett munkafolyamatok telepítését, és a munkafolyamat egy részét CPU-n, egyes részeit pedig GPU-n futtatja. A munkafolyamaton belüli modellek különböző keretrendszereket használhatnak.

Különösen a DJL Serving automatikus skálázási funkciója teszi egyszerűvé annak biztosítását, hogy a modellek a bejövő forgalomnak megfelelően legyenek méretezve. Alapértelmezés szerint a DJL-szolgáltatás a rendelkezésre álló hardver (CPU magok, GPU-eszközök) alapján határozza meg a támogatott modellek maximális számát. Minden modellhez beállíthat alsó és felső korlátot, hogy biztosítsa, hogy egy minimális forgalmi szint mindig kiszolgálható legyen, és hogy egyetlen modell ne használja fel az összes rendelkezésre álló erőforrást.

A DJL Serving a Netty frontend a backend dolgozói szálkészletek tetején. A frontend egyetlen Netty-beállítást használ többel HttpRequestHandlers. Különböző kéréskezelők nyújtanak támogatást a Következtetés API, Menedzsment API, vagy más, különböző bővítményekből elérhető API-k.

A háttérrendszer a WorkLoadManager (WLM) modul. A WLM több feldolgozói szálról gondoskodik minden modellhez, valamint a kötegelést, és kéri a hozzájuk intézett útválasztást. Több modell kiszolgálásakor a WLM először minden modellnél ellenőrzi a következtetéskérés-sor méretét. Ha a sor mérete nagyobb, mint a modell kötegméretének kétszerese, a WLM növeli a modellhez rendelt dolgozók számát.

Megoldás áttekintése

A DJL MME-vel való megvalósítása eltér az alapértelmezett MMS-beállítástól. Az MME-vel végzett DJL-kiszolgáláshoz a következő fájlokat a SageMaker Inference által elvárt model.tar.gz formátumban tömörítjük:

- modell.joblib – Ehhez a megvalósításhoz közvetlenül a modell metaadatait toljuk be a tarballba. Ebben az esetben dolgozunk a

.joblibfájlt, ezért biztosítjuk azt a fájlt a tarballunkban, hogy a következtetési szkriptünk elolvashassa. Ha a műtermék túl nagy, leküldheti az Amazon S3-ra is, és erre mutathat a DJL-hez megadott kiszolgálási konfigurációban. - kiszolgáló.tulajdonságok – Itt konfigurálhat bármilyen szerverrel kapcsolatos modellt Környezeti változók. A DJL ereje itt az, hogy konfigurálható

minWorkersés amaxWorkersminden egyes modell tarballhoz. Ez lehetővé teszi, hogy minden modell felfelé és lefelé skálázzon a modellkiszolgáló szintjén. Például, ha egy szinguláris modell fogadja az MME forgalmának nagy részét, a modellszerver dinamikusan méretezi a dolgozókat. Ebben a példában nem konfiguráljuk ezeket a változókat, és hagyjuk, hogy a DJL határozza meg a szükséges dolgozók számát a forgalmi mintánktól függően. - modell.py – Ez a következtetési szkript minden olyan egyéni elő- vagy utófeldolgozáshoz, amelyet meg szeretne valósítani. A model.py azt várja, hogy a logikája alapértelmezés szerint egy kezelő metódusba kerüljön.

- követelmények.txt (nem kötelező) – Alapértelmezés szerint a DJL a PyTorch-szal együtt érkezik, de az összes szükséges függőség ide tolható.

Ebben a példában bemutatjuk a DJL erejét MME-vel egy minta SKLearn modell segítségével. Ezzel a modellel egy képzési munkát futtatunk, majd ebből a modellműtermékből 1,000 másolatot készítünk az MME támogatására. Ezután bemutatjuk, hogyan tud a DJL dinamikusan skálázni, hogy kezelje az MME által esetleg fogadott bármilyen típusú forgalmi mintát. Ez magában foglalhatja a forgalom egyenletes eloszlását az összes modell között, vagy akár néhány népszerű modellt is, amely a forgalom nagy részét kapja. Az összes kódot megtalálja az alábbiakban GitHub repo.

Előfeltételek

Ebben a példában egy SageMaker notebook példányt használunk conda_python3 kernellel és ml.c5.xlarge példánysal. A terhelési tesztek elvégzéséhez használhat egy Amazon rugalmas számítási felhő (Amazon EC2) példány vagy egy nagyobb SageMaker notebook példány. Ebben a példában több mint ezer tranzakcióra skálázunk másodpercenként (TPS), ezért azt javasoljuk, hogy teszteljen egy nehezebb EC2-példányon, például egy ml.c5.18xlarge-en, így több számítási feladatot kell elvégeznie.

Hozzon létre egy modellműterméket

Először létre kell hoznunk a modellműtermékünket és az ebben a példában használt adatokat. Ebben az esetben mesterséges adatokat generálunk a NumPy segítségével, és egy SKLearn lineáris regressziós modellt használunk a következő kódrészlettel:

Az előző kód futtatása után rendelkeznie kell a model.joblib a helyi környezetben létrehozott fájl.

Húzza ki a DJL Docker képet

A Docker-kép djl-inference:0.23.0-cpu-full-v1.0 a példában használt DJL-kiszolgáló tárolónk. A következő URL-t a régiótól függően módosíthatja:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

Opcionálisan ezt a képet alapképként is használhatja, és kibővítheti saját Docker-képének létrehozásához Amazon Elastic Container Registry (Amazon ECR) minden más szükséges függőséggel.

Hozza létre a modellfájlt

Először létrehozunk egy fájlt, melynek neve serving.properties. Ez arra utasítja a DJLServinget, hogy használja a Python motort. Meghatározzuk azt is max_idle_time egy munkás 600 másodperc. Ez biztosítja, hogy tovább tartson a modellenkénti alkalmazottak számának csökkentése. Nem alkalmazkodunk minWorkers és a maxWorkers amit meghatározhatunk, és hagyjuk, hogy a DJL dinamikusan kiszámolja a szükséges dolgozók számát az egyes modellek által fogadott forgalom függvényében. A tálalási.tulajdonságok az alábbiak szerint láthatók. A konfigurációs opciók teljes listájának megtekintéséhez lásd: A motor konfigurációja.

Ezután létrehozzuk a model.py fájlunkat, amely meghatározza a modell betöltési és következtetési logikáját. Az MME-k esetében minden model.py fájl egy adott modellre vonatkozik. A modellek a saját útvonalukon tárolódnak a modelltároló alatt (általában /opt/ml/model/). A modellek betöltésekor a rendszer a modelltároló elérési útja alá tölti be a saját könyvtárukban. A demo teljes model.py példája megtekinthető a GitHub repo.

Létrehozunk egy model.tar.gz fájl, amely tartalmazza a modellünket (model.joblib), model.pyés serving.properties:

Bemutató célból 1,000 példányt készítünk belőle model.tar.gz fájl a tárolni kívánt nagyszámú modell megjelenítéséhez. A termelésben létre kell hozni a model.tar.gz fájlt az egyes modellekhez.

Végül feltöltjük ezeket a modelleket az Amazon S3-ra.

Hozzon létre egy SageMaker modellt

Most létrehozunk a SageMaker modell. A SageMaker modell létrehozásához a korábban definiált ECR-képet és az előző lépésből származó modellterméket használjuk. A modell beállításánál a Mode-ot MultiModelként konfiguráljuk. Ez jelzi a DJLServingnek, hogy MME-t hozunk létre.

Hozzon létre egy SageMaker végpontot

Ebben a bemutatóban 20 ml.c5d.18xlarge példányt használunk a több ezer tartományba eső TPS-re skálázáshoz. Ha szükséges, győződjön meg arról, hogy növeli a példánytípus korlátját, hogy elérje a megcélzott TPS-t.

Terhelési tesztelés

A cikk írásakor a SageMaker házon belüli terhelést vizsgáló eszköz Amazon SageMaker Inference Recommender natívan nem támogatja az MME-k tesztelését. Ezért a nyílt forráskódú Python eszközt használjuk Sáska. A Locust egyszerűen beállítható, és nyomon tudja követni az olyan mutatókat, mint a TPS és a végpontok közötti késés. A SageMakerrel történő beállításának teljes megértéséhez lásd: Az Amazon SageMaker valós idejű következtetési végpontok terheléses tesztelésének bevált gyakorlatai.

Ebben a használati esetben három különböző forgalmi mintát szeretnénk szimulálni az MME-kkel, ezért van a következő három Python-szkriptünk, amelyek igazodnak az egyes mintákhoz. Itt az a célunk, hogy bebizonyítsuk, hogy forgalmi mintázatunktól függetlenül ugyanazt a cél-TPS-t és megfelelő méretezést tudjuk elérni.

Megadhatunk egy súlyt a Locust szkriptünkben, hogy hozzárendelhessük a forgalmat modelljeink különböző részeihez. Például egyetlen forró modellünkkel két módszert valósítunk meg az alábbiak szerint:

Ezután minden metódushoz hozzárendelhetünk egy bizonyos súlyt, ami azt jelenti, hogy egy adott módszer a forgalom meghatározott százalékát kapja:

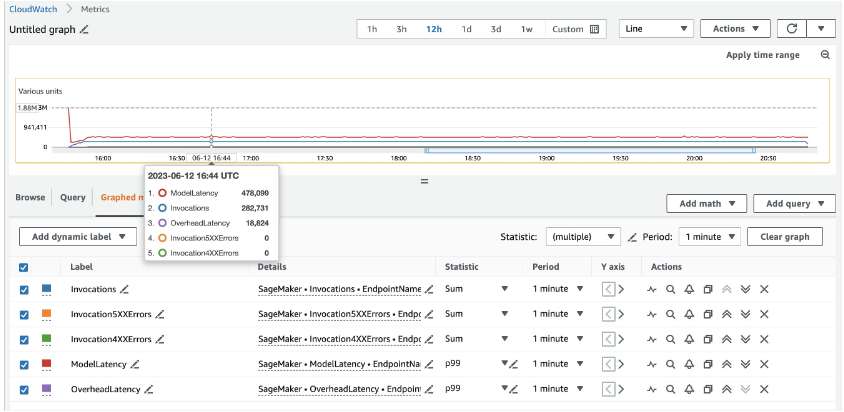

20 ml.c5d.18xlarge példányok esetén a következő hívási mutatókat látjuk a amazonfelhőóra konzol. Ezek az értékek meglehetősen konzisztensek maradnak mindhárom forgalmi mintában. A SageMaker valós idejű következtetések és az MME-k CloudWatch-mutatóinak jobb megértéséhez tekintse meg a következőt: SageMaker végpont-hívási metrikák.

A többi Locust szkriptet megtalálja a locust-utils könyvtár a GitHub adattárban.

Összegzésként

Ebben a bejegyzésben megvitattuk, hogyan tudja az MME dinamikusan beállítani az egyes modellekhez rendelt számítási teljesítményt a modell forgalmi mintázata alapján. Ez az újonnan bevezetett funkció minden AWS-régióban elérhető, ahol a SageMaker elérhető. Vegye figyelembe, hogy a bejelentés időpontjában csak a CPU-példányok támogatottak. További információért lásd: Támogatott algoritmusok, keretrendszerek és példányok.

A szerzőkről

Ram Vegiraju ML építész a SageMaker Service csapatánál. Arra összpontosít, hogy segítse ügyfeleit AI/ML megoldásaik kiépítésében és optimalizálásában az Amazon SageMakeren. Szabadidejében szeret utazni és írni.

Ram Vegiraju ML építész a SageMaker Service csapatánál. Arra összpontosít, hogy segítse ügyfeleit AI/ML megoldásaik kiépítésében és optimalizálásában az Amazon SageMakeren. Szabadidejében szeret utazni és írni.

Qingwei Li az Amazon Web Services gépi tanulási szakértője. Ph.D fokozatot szerzett. az Operations Researchben, miután feltörte tanácsadója kutatási támogatási számláját, és nem teljesítette az ígért Nobel-díjat. Jelenleg a pénzügyi szolgáltatási és biztosítási ágazatban tevékenykedő ügyfeleknek segít abban, hogy gépi tanulási megoldásokat építsenek az AWS-re. Szabadidejében szeret olvasni és tanítani.

Qingwei Li az Amazon Web Services gépi tanulási szakértője. Ph.D fokozatot szerzett. az Operations Researchben, miután feltörte tanácsadója kutatási támogatási számláját, és nem teljesítette az ígért Nobel-díjat. Jelenleg a pénzügyi szolgáltatási és biztosítási ágazatban tevékenykedő ügyfeleknek segít abban, hogy gépi tanulási megoldásokat építsenek az AWS-re. Szabadidejében szeret olvasni és tanítani.

James Wu az AWS vezető AI/ML specialista megoldástervezője. segít az ügyfeleknek AI/ML megoldások tervezésében és kivitelezésében. James munkája az ML felhasználási esetek széles skáláját fedi le, elsősorban a számítógépes látás, a mély tanulás és az ML méretezése a vállalaton belül. Mielőtt csatlakozott az AWS-hez, James több mint 10 évig építész, fejlesztő és technológiai vezető volt, ebből 6 évig mérnöki és 4 évig marketing és reklámiparban dolgozott.

James Wu az AWS vezető AI/ML specialista megoldástervezője. segít az ügyfeleknek AI/ML megoldások tervezésében és kivitelezésében. James munkája az ML felhasználási esetek széles skáláját fedi le, elsősorban a számítógépes látás, a mély tanulás és az ML méretezése a vállalaton belül. Mielőtt csatlakozott az AWS-hez, James több mint 10 évig építész, fejlesztő és technológiai vezető volt, ebből 6 évig mérnöki és 4 évig marketing és reklámiparban dolgozott.

Saurabh Trikande az Amazon SageMaker Inference vezető termékmenedzsere. Szenvedélyesen dolgozik az ügyfelekkel, és a gépi tanulás demokratizálásának célja motiválja. A komplex ML-alkalmazások telepítésével, a több bérlős ML-modellekkel, a költségoptimalizálással és a mély tanulási modellek bevezetésének elérhetőbbé tételével kapcsolatos alapvető kihívásokra összpontosít. Szabadidejében Saurabh szeret túrázni, innovatív technológiákat tanulni, követi a TechCrunch-ot és a családjával tölt időt.

Saurabh Trikande az Amazon SageMaker Inference vezető termékmenedzsere. Szenvedélyesen dolgozik az ügyfelekkel, és a gépi tanulás demokratizálásának célja motiválja. A komplex ML-alkalmazások telepítésével, a több bérlős ML-modellekkel, a költségoptimalizálással és a mély tanulási modellek bevezetésének elérhetőbbé tételével kapcsolatos alapvető kihívásokra összpontosít. Szabadidejében Saurabh szeret túrázni, innovatív technológiákat tanulni, követi a TechCrunch-ot és a családjával tölt időt.

Xu Deng a SageMaker csapat szoftvermérnöki menedzsere. Arra összpontosít, hogy segítse az ügyfeleket az AI/ML következtetési élményük kialakításában és optimalizálásában az Amazon SageMakeren. Szabadidejében szeret utazni és snowboardozni.

Xu Deng a SageMaker csapat szoftvermérnöki menedzsere. Arra összpontosít, hogy segítse az ügyfeleket az AI/ML következtetési élményük kialakításában és optimalizálásában az Amazon SageMakeren. Szabadidejében szeret utazni és snowboardozni.

Siddharth Venkatesan az AWS Deep Learning szoftvermérnöke. Jelenleg a nagy modellkövetkeztetések megoldására összpontosít. Az AWS előtt az Amazon Grocery szervezetben dolgozott, új fizetési funkciókat épített ki az ügyfelek számára világszerte. Munkán kívül szeret síelni, a szabadban lenni és sportokat nézni.

Siddharth Venkatesan az AWS Deep Learning szoftvermérnöke. Jelenleg a nagy modellkövetkeztetések megoldására összpontosít. Az AWS előtt az Amazon Grocery szervezetben dolgozott, új fizetési funkciókat épített ki az ügyfelek számára világszerte. Munkán kívül szeret síelni, a szabadban lenni és sportokat nézni.

Rohith Nallamaddi az AWS szoftverfejlesztő mérnöke. A GPU-k mély tanulási munkaterhelésének optimalizálásán, a nagy teljesítményű ML következtetések felépítésén és a megoldások kiszolgálásán dolgozik. Ezt megelőzően az Amazon F3 üzletág számára AWS-en alapuló mikroszolgáltatások kiépítésén dolgozott. A munkán kívül szívesen játszik és sportol.

Rohith Nallamaddi az AWS szoftverfejlesztő mérnöke. A GPU-k mély tanulási munkaterhelésének optimalizálásán, a nagy teljesítményű ML következtetések felépítésén és a megoldások kiszolgálásán dolgozik. Ezt megelőzően az Amazon F3 üzletág számára AWS-en alapuló mikroszolgáltatások kiépítésén dolgozott. A munkán kívül szívesen játszik és sportol.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :is

- :ahol

- $ UP

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- Rólunk

- gázpedál

- igénybe vett

- hozzáférhető

- elhelyezésére

- Fiók

- Elérése

- át

- cselekmények

- hozzá

- További

- Előny

- Hirdetés

- Után

- AI / ML

- algoritmusok

- összehangolása

- Minden termék

- kioszt

- elkülönített

- lehetővé

- lehetővé teszi, hogy

- mentén

- már

- Is

- mindig

- amazon

- Amazon EC2

- Amazon SageMaker

- Az Amazon Web Services

- összeg

- an

- és a

- Közlemény

- Másik

- bármilyen

- Apache

- api

- API-k

- Alkalmazás

- alkalmazások

- alkalmazott

- megfelelő

- építészet

- VANNAK

- körül

- mesterséges

- AS

- kijelölt

- feltételezni

- At

- auto

- Automatizált

- automatikusan

- elérhető

- AWS

- vissza

- háttér

- bázis

- alapján

- adagoló

- BE

- mert

- mögött

- Jobb

- között

- test

- fellendítésére

- határokat

- Doboz

- szünet

- hoz

- Törött

- épít

- Épület

- épült

- üzleti

- de

- by

- hívott

- TUD

- képesség

- Kapacitás

- ami

- eset

- esetek

- sejt

- központosított

- bizonyos

- kihívások

- Ellenőrzések

- osztály

- vásárló

- ügyfél részére

- kód

- jön

- teljes

- Befejezett

- bonyolult

- összetevő

- Tartalmaz

- Kiszámít

- számítógép

- Számítógépes látás

- számítástechnika

- számítási teljesítmény

- egyidejű

- Configuration

- következetes

- következetesen

- Konzol

- fogyaszt

- tartalmaz

- Konténer

- kontextus

- tovább

- Mag

- Költség

- kiadások

- Covers

- teremt

- készítette

- létrehozása

- Jelenleg

- szokás

- Ügyfelek

- dátum

- nap

- mély

- mély tanulás

- alapértelmezett

- meghatározott

- meghatározott

- Annak meghatározása,

- szállít

- Kereslet

- demó

- demokratizálásának

- függőségek

- attól

- ábrázolt

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- Design

- tervezett

- Határozzuk meg

- meghatározza

- Fejlesztő

- Fejlesztés

- eszköz

- Eszközök

- diagram

- különböző

- nehéz

- közvetlenül

- könyvtár

- megvitatni

- tárgyalt

- terjesztés

- Dokkmunkás

- Nem

- ne

- le-

- letöltés

- letöltései

- dinamikus

- dinamikusan

- minden

- Korábban

- hatékony

- eredményesen

- megerőltetés nélküli

- bármelyik

- máshol

- beágyazás

- lehetővé

- lehetővé teszi

- tokozott

- végtől végig

- Endpoint

- Motor

- mérnök

- Mérnöki

- elég

- biztosítására

- Vállalkozás

- Környezet

- hiba

- Még

- példa

- kivétel

- vár

- elvárja

- tapasztalat

- terjed

- Arc

- Sikertelen

- meglehetősen

- család

- Funkció

- Jellemzők

- kevés

- filé

- Fájlok

- pénzügyi

- pénzügyi szolgáltatás

- Találjon

- vezetéknév

- rögzített

- FLOTTA

- koncentrál

- következő

- következik

- A

- formátum

- Keretrendszer

- keretek

- gyakran

- ból ből

- frontend

- Tele

- teljesen

- funkciós

- generál

- kap

- jelentkeznek

- GitHub

- cél

- GPU

- GPU

- biztosít

- nagyobb

- fogantyú

- történik

- hardver

- Legyen

- he

- segít

- segít

- segít

- itt

- Magas

- <p></p>

- nagyon

- övé

- vendéglátó

- házigazdája

- tárhely

- FORRÓ

- Hogyan

- How To

- azonban

- HTML

- http

- HTTPS

- Idle

- if

- illusztrálja

- kép

- végre

- végrehajtás

- importál

- in

- tartalmaz

- magában foglalja a

- Beleértve

- Bejövő

- Növelje

- növekvő

- iparágak

- ipar

- információ

- Infrastruktúra

- kezdetben

- újító

- innovatív technológiák

- bemenet

- telepítve

- példa

- helyette

- biztosítás

- integráció

- integrációk

- kamat

- Felület

- bele

- hivatkozni

- kérdés

- kérdések

- IT

- ITS

- james

- Jáva

- Munka

- csatlakozott

- jpg

- éppen

- nyelv

- nagy

- nagyobb

- Késleltetés

- legutolsó

- indított

- vezet

- vezető

- vezetékek

- TANUL

- tanulás

- hadd

- szint

- könyvtár

- mint

- Kedvencek

- LIMIT

- lineáris

- Lista

- kiszámításának

- betöltés

- terhelések

- helyi

- logika

- hosszabb

- szeret

- Elő/Utó

- alacsonyabb

- gép

- gépi tanulás

- Fő

- Többség

- csinál

- KÉSZÍT

- Gyártás

- sikerült

- menedzser

- kezelése

- sok

- Marketing

- Marketing és reklám

- maximális

- Lehet..

- mechanizmusok

- Memory design

- Metaadatok

- módszer

- mód

- Metrics

- microservices

- esetleg

- minimum

- perc

- Enyhít

- ML

- Mód

- modell

- modellek

- Modulok

- több

- a legtöbb

- motivált

- többszörös

- név

- natívan

- elengedhetetlen

- Szükség

- szükséges

- Új

- újonnan

- Nóbel díj

- Egyik sem

- megjegyezni

- jegyzetfüzet

- Most

- szám

- számtalan

- of

- ajánlat

- Ajánlatok

- on

- ONE

- csak

- nyitva

- nyílt forráskódú

- Művelet

- szemben

- optimalizáció

- Optimalizálja

- optimalizált

- optimalizálása

- Opciók

- or

- Más

- mi

- ki

- szabadban

- teljesítmény

- kívül

- felett

- saját

- Párhuzamos

- paraméterek

- rész

- különös

- alkatrészek

- szenvedélyes

- ösvény

- utak

- Mintás

- minták

- fizetés

- mert

- százalék

- Teljesít

- teljesítmény

- cső

- emelvény

- Plató

- Platón adatintelligencia

- PlatoData

- játék

- Plugins

- pont

- politika

- medencék

- Népszerű

- állás

- hatalom

- gyakorlat

- megelőző

- előrejelzés

- Tippek

- előző

- korábban

- elsődleges

- Előzetes

- díj

- Probléma

- folyamat

- feldolgozás

- Termékek

- termék menedzser

- Termelés

- Programozás

- igért

- megfelelően

- ingatlanait

- Bizonyít

- ad

- biztosít

- ellátás

- cél

- célokra

- Nyomja

- meglökött

- Piton

- pytorch

- véletlen

- hatótávolság

- Olvass

- Olvasás

- kész

- real-time

- kap

- kapott

- kap

- fogadó

- ajánlott

- utal

- Tekintet nélkül

- vidék

- régiók

- összefüggő

- marad

- cserélni

- raktár

- képvisel

- kérni

- kéri

- követelmények

- kutatás

- Tudástár

- válasz

- REST

- eredményez

- Visszatér

- újra

- Útvonal

- útvonalak

- routing

- futás

- fut

- futásidejű

- SaaS

- sagemaker

- SageMaker következtetés

- azonos

- minta

- Megtakarítás

- azt mondják

- Skála

- pikkelyes

- Mérleg

- skálázás

- forgatókönyv

- szkriptek

- Második

- másodperc

- lát

- látott

- MAGA

- küld

- idősebb

- szolgál

- szolgált

- szerver

- Szerverek

- szolgáltatás

- Szolgáltatások

- szolgáló

- készlet

- Szettek

- felépítés

- számos

- kellene

- kirakat

- mutatott

- Műsorok

- Egyszerű

- szimulálni

- egyszerre

- egyetlen

- egyedülálló

- Méret

- kicsi

- töredék

- So

- szoftver

- szoftver mint szolgáltatás

- szoftverfejlesztés

- Software Engineer

- megoldások

- Megoldások

- néhány

- forrás

- szakember

- különleges

- Költési

- osztott

- Sport

- verem

- statikus

- Lépés

- tárolás

- tárolni

- memorizált

- egyértelmű

- későbbi

- ilyen

- javasol

- támogatás

- Támogatott

- Támogatja

- biztos

- Systems

- Vesz

- tart

- bevétel

- cél

- célzás

- Tanítási

- csapat

- TechCrunch

- Technologies

- Technológia

- megmondja

- tensorflow

- Tesztelés

- tesztek

- mint

- hogy

- A

- azok

- Őket

- akkor

- Ott.

- ebből adódóan

- Ezek

- ők

- ezt

- azok

- ezer

- ezer

- három

- Keresztül

- áteresztőképesség

- idő

- alkalommal

- nak nek

- is

- szerszám

- felső

- felé

- idő

- vágány

- forgalom

- Vonat

- kiképzett

- Képzések

- Tranzakciók

- transzformerek

- Utazó

- megpróbál

- kettő

- típus

- jellemzően

- alatt

- mögöttes

- megért

- megértés

- Egyetemes

- URL

- használ

- használati eset

- használt

- használ

- segítségével

- rendszerint

- kihasználva

- érték

- Értékek

- változó

- különféle

- látomás

- vs

- akar

- volt

- őrzés

- we

- háló

- webes szolgáltatások

- súly

- Mit

- amikor

- mivel

- ami

- széles

- Széleskörű

- lesz

- val vel

- belül

- Munka

- dolgozott

- munkás

- dolgozók

- munkafolyamat

- munkafolyamatok

- dolgozó

- művek

- lenne

- írás

- írott

- X

- év

- te

- A te

- zephyrnet