Ahogy az ügyfelek felgyorsítják a felhőbe való migrációt és átalakítják vállalkozásukat, egyesek olyan helyzetbe kerülnek, amikor többfelhős környezetben kell IT-műveleteket kezelniük. Például előfordulhat, hogy megvásárolt egy olyan vállalatot, amely már egy másik felhőszolgáltatón fut, vagy olyan munkaterheléssel rendelkezik, amely értéket generál az AWS által biztosított egyedi képességekből. Egy másik példa a független szoftverszállítók (ISV-k), amelyek termékeiket és szolgáltatásaikat különböző felhőplatformokon teszik elérhetővé, hogy végfelhasználóik javát szolgálják. Vagy előfordulhat, hogy egy szervezet olyan Régióban működik, ahol nem érhető el elsődleges felhőszolgáltató, és az adatszuverenitási vagy az adatok tartózkodási helyére vonatkozó követelmények teljesítése érdekében másodlagos felhőszolgáltatót is használhat.

Ezekben a forgatókönyvekben, amikor elkezdi a generatív mesterséges intelligencia, a nagy nyelvi modellek (LLM) és a gépi tanulási (ML) technológiákat üzleti tevékenysége alapvető részeként felkarolni, előfordulhat, hogy olyan lehetőségeket keres, amelyekkel kihasználhatja AWS AI és ML Az AWS-en kívüli képességek multicloud környezetben. Például érdemes lehet használni Amazon SageMaker ML modell felépítéséhez és betanításához, vagy használatához Amazon SageMaker Jumpstart előre elkészített alapozó vagy harmadik féltől származó ML modellek üzembe helyezéséhez, amelyeket néhány gomb kattintással telepíthet. Vagy esetleg szeretné kihasználni Amazon alapkőzet generatív AI-alkalmazások létrehozásához és méretezéséhez, vagy kihasználhatja Az AWS előre kiképzett AI szolgáltatásai, amelyekhez nem szükséges gépi tanulási készségek elsajátítása. Az AWS olyan forgatókönyvekhez nyújt támogatást, ahol a szervezetek ezt szeretnék saját modelljüket hozzák az Amazon SageMakerhez or az Amazon SageMaker Canvasba az előrejelzésekért.

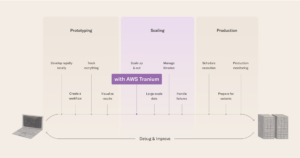

Ebben a bejegyzésben bemutatjuk a számos lehetőség egyikét, amellyel kihasználhatja az AWS legszélesebb és legmélyebb AI/ML képességeit multicloud környezetben. Megmutatjuk, hogyan építhet és taníthat ML-modellt az AWS-ben, és hogyan telepítheti a modellt egy másik platformon. Az Amazon SageMaker segítségével betanítjuk a modellt, tároljuk a modell műtermékeit Amazon egyszerű tárolási szolgáltatás (Amazon S3), és telepítse és futtassa a modellt az Azure-ban. Ez a megközelítés akkor előnyös, ha az AWS-szolgáltatásokat az ML-hez használja annak legátfogóbb szolgáltatáskészletéhez, de a modellt egy másik felhőszolgáltatónál kell futtatnia az általunk tárgyalt helyzetek egyikében.

Kulcsfogalmak

Amazon SageMaker Studio egy webalapú, integrált fejlesztői környezet (IDE) a gépi tanuláshoz. A SageMaker Studio lehetővé teszi az adattudósok, ML-mérnökök és adatmérnökök számára, hogy egyetlen webes felületen készítsenek elő adatokat, építsenek, képezzenek és telepítsenek ML-modelleket. A SageMaker Studio segítségével az ML fejlesztési életciklus minden szakaszához hozzáférhet a célra épített eszközökhöz, az adatok előkészítésétől az ML-modellek felépítéséig, betanításáig és üzembe helyezéséig, így akár tízszeresére növelheti az adattudományi csapatok termelékenységét. SageMaker Studio notebookok gyors indulású, együttműködő notebookok, amelyek integrálhatók a SageMaker és más AWS-szolgáltatások erre a célra kialakított ML-eszközeivel.

A SageMaker egy átfogó ML-szolgáltatás, amely lehetővé teszi az üzleti elemzők, adattudósok és MLOps-mérnökök számára, hogy ML-modelleket építsenek, képezzenek és telepítsenek bármilyen felhasználási esetre, függetlenül az ML-szakértelemtől.

Az AWS biztosítja Mélytanulási tárolók (DLC-k) olyan népszerű ML-keretrendszerekhez, mint a PyTorch, TensorFlow és Apache MXNet, amelyeket a SageMakerrel használhatunk oktatáshoz és következtetésekhez. A DLC-k Docker-képként érhetők el Amazon Elastic Container Registry (Amazon ECR). A Docker lemezképek előre telepítve és tesztelve vannak a népszerű mély tanulási keretrendszerek legújabb verzióival, valamint a képzéshez és következtetésekhez szükséges egyéb függőségekkel. A SageMaker által kezelt előre elkészített Docker-képek teljes listáját lásd: Docker regisztrációs útvonalak és példakód. Az Amazon ECR támogatja a biztonsági szkennelést, és integrálva van vele Amazon ellenőr sérülékenység-kezelési szolgáltatás, amely megfelel a szervezet képmegfelelőségi biztonsági követelményeinek, és automatizálja a sebezhetőség-értékelési vizsgálatot. A szervezetek is használhatják AWS Trainium és a AWS Inferentia a jobb ár-teljesítmény érdekében ML képzési feladatok futtatásához vagy következtetésekhez.

Megoldás áttekintése

Ebben a részben leírjuk, hogyan építhet fel és taníthat fel egy modellt a SageMaker használatával, és hogyan telepítheti a modellt az Azure Functionsba. A modell felépítéséhez, betanításához és üzembe helyezéséhez SageMaker Studio notebookot használunk. A modellt a SageMakerben betanítjuk egy előre elkészített Docker-kép segítségével a PyTorch számára. Bár ebben az esetben a betanított modellt telepítjük az Azure-ba, ugyanezt a megközelítést használhatja a modell más platformokon, például telephelyen vagy más felhőplatformokon történő üzembe helyezéséhez.

Amikor létrehozunk egy betanítási feladatot, a SageMaker elindítja az ML számítási példányokat, és a betanítási kódunkat és a betanítási adatkészletet használja a modell betanításához. Az eredményül kapott modelltermékeket és egyéb kimeneteket egy S3 tárolóba menti, amelyet a betanítási feladat bemeneteként adunk meg. A modellképzés befejeztével használjuk a Nyissa meg a Neural Network Exchange alkalmazást (ONNX) futásidejű könyvtár a PyTorch-modell ONNX-modellként történő exportálásához.

Végül telepítjük az ONNX-modellt a Pythonban írt egyéni következtetési kóddal együtt az Azure Functionsba az Azure parancssori felület használatával. Az ONNX a legtöbbet támogatja gyakran használt ML keretrendszerek és eszközök. Egy dolog, amit meg kell jegyezni, hogy egy ML-modell ONNX-re konvertálása hasznos, ha egy másik céltelepítési keretrendszert szeretne használni, például a PyTorch-ot TensorFlow-ra. Ha ugyanazt a keretrendszert használja a forráson és a célon is, akkor nem kell átalakítania a modellt ONNX formátumba.

A következő ábra szemlélteti ennek a megközelítésnek az architektúráját.

A SageMaker Studio notebookot használjuk a SageMaker Python SDK modellünk elkészítéséhez és betanításához. A SageMaker Python SDK egy nyílt forráskódú könyvtár az ML modellek betanítására és telepítésére a SageMakeren. További részletekért lásd: Hozzon létre vagy nyisson meg egy Amazon SageMaker Studio notebookot.

A következő szakaszokban található kódrészleteket a SageMaker Studio notebook-környezetben tesztelték a Data Science 3.0 képfájl és a Python 3.0 kernel használatával.

Ebben a megoldásban a következő lépéseket mutatjuk be:

- Tanítsd meg a PyTorch modellt.

- Exportálja a PyTorch-modellt ONNX-modellként.

- Csomagolja be a modellt és a következtetési kódot.

- Telepítse a modellt az Azure Functionsba.

Előfeltételek

A következő előfeltételekkel kell rendelkeznie:

- AWS-fiók.

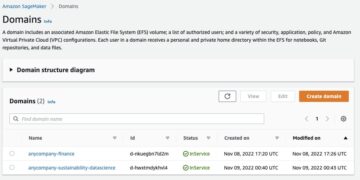

- SageMaker tartomány és SageMaker Studio felhasználó. Ezek létrehozására vonatkozó utasításokért lásd: Bekapcsolva az Amazon SageMaker tartományba a gyors beállítás segítségével.

- Az Azure parancssori felület.

- Hozzáférés az Azure-hoz és az Azure Functions létrehozásához és kezeléséhez jogosult szolgáltatás egyszerű hitelesítő adataihoz.

Tanítson modellt a PyTorch segítségével

Ebben a részben részletezzük a PyTorch-modell betanításának lépéseit.

Függőségek telepítése

Telepítse a könyvtárakat a modell betanításához és a modell üzembe helyezéséhez szükséges lépések végrehajtásához:

pip install torchvision onnx onnxruntimeA kezdeti beállítás befejezése

Az importálással kezdjük a AWS SDK Pythonhoz (Boto3) és a SageMaker Python SDK. A beállítás részeként a következőket határozzuk meg:

- Egy munkamenet-objektum, amely kényelmi módszereket biztosít a SageMaker és a saját fiókunk kontextusában.

- A SageMaker ARN szerepkör az oktatási és tárhelyszolgáltatás engedélyeinek delegálására szolgál. Erre azért van szükségünk, hogy ezek a szolgáltatások hozzáférhessenek az S3 tárolókhoz, ahol az adatainkat és a modellünket tárolják. Az üzleti igényeinek megfelelő szerepkör létrehozására vonatkozó utasításokért lásd: SageMaker szerepek. Ebben a bejegyzésben ugyanazt a végrehajtási szerepet használjuk, mint a Studio jegyzetfüzet-példányunk. Ezt a szerepet hívással kapjuk meg

sagemaker.get_execution_role(). - Az alapértelmezett régió, ahol a képzési feladatunk futni fog.

- Az alapértelmezett vödör és az előtag, amelyet a modell kimenetének tárolására használunk.

Lásd a következő kódot:

import sagemaker

import boto3

import os execution_role = sagemaker.get_execution_role()

region = boto3.Session().region_name

session = sagemaker.Session()

bucket = session.default_bucket()

prefix = "sagemaker/mnist-pytorch"Hozza létre a képzési adatkészletet

A nyilvános tárolóban elérhető adatkészletet használjuk sagemaker-example-files-prod-{region}. Az adatkészlet a következő fájlokat tartalmazza:

- train-images-idx3-ubyte.gz – Edzőkészlet képeket tartalmaz

- train-labels-idx1-ubyte.gz – Edzőkészlet címkéket tartalmaz

- t10k-images-idx3-ubyte.gz – Tesztkészlet képeket tartalmaz

- t10k-labels-idx1-ubyte.gz – Tesztkészlet-címkéket tartalmaz

Az általunk használttorchvision.datasets modul segítségével töltheti le helyben az adatokat a nyilvános tárolóból, mielőtt feltöltené azokat a képzési adatgyűjtőnkbe. Ezt a vödör helyét a SageMaker képzési feladat bemeneteként adjuk át. A képzési szkriptünk ezt a helyet használja a képzési adatok letöltéséhez és előkészítéséhez, majd betanítja a modellt. Lásd a következő kódot:

MNIST.mirrors = [ f"https://sagemaker-example-files-prod-{region}.s3.amazonaws.com/datasets/image/MNIST/"

] MNIST( "data", download=True, transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))] ),

)

Készítse el a képzési szkriptet

A SageMaker segítségével saját modellt hozhat magával script mód. A szkript módban használhatja az előre elkészített SageMaker tárolókat, és megadhatja saját képzési szkriptjét, amely tartalmazza a modell definícióját, valamint az egyéni könyvtárakat és függőségeket. A SageMaker Python SDK forgatókönyvünket mint an adja át entry_point a konténerbe, amely betölti és futtatja a vonat funkciót a megadott szkriptből, hogy betanítsa a modellünket.

Amikor a betanítás befejeződött, a SageMaker elmenti a modell kimenetét az S3 tárolóba, amelyet paraméterként adtunk meg a betanítási feladathoz.

Képzési kódunk a következőkből készült PyTorch példaszkript. A kód következő kivonata a modell definícióját és a vonat funkcióját mutatja be:

# define network class Net(nn.Module): def __init__(self): super(Net, self).__init__() self.conv1 = nn.Conv2d(1, 32, 3, 1) self.conv2 = nn.Conv2d(32, 64, 3, 1) self.dropout1 = nn.Dropout(0.25) self.dropout2 = nn.Dropout(0.5) self.fc1 = nn.Linear(9216, 128) self.fc2 = nn.Linear(128, 10) def forward(self, x): x = self.conv1(x) x = F.relu(x) x = self.conv2(x) x = F.relu(x) x = F.max_pool2d(x, 2) x = self.dropout1(x) x = torch.flatten(x, 1) x = self.fc1(x) x = F.relu(x) x = self.dropout2(x) x = self.fc2(x) output = F.log_softmax(x, dim=1) return output# train def train(args, model, device, train_loader, optimizer, epoch): model.train() for batch_idx, (data, target) in enumerate(train_loader): data, target = data.to(device), target.to(device) optimizer.zero_grad() output = model(data) loss = F.nll_loss(output, target) loss.backward() optimizer.step() if batch_idx % args.log_interval == 0: print('Train Epoch: {} [{}/{} ({:.0f}%)]tLoss: {:.6f}'.format( epoch, batch_idx * len(data), len(train_loader.dataset), 100. * batch_idx / len(train_loader), loss.item())) if args.dry_run: breakTanítsd meg a modellt

Most, hogy beállítottuk a környezetünket, létrehoztuk a bemeneti adatkészletünket és az egyéni képzési szkriptünket, elindíthatjuk a modell betanítását a SageMaker segítségével. A SageMaker Python SDK PyTorch becslőjét használjuk a SageMaker oktatási feladatának elindításához. A szükséges paramétereket átadjuk a becslőnek, és meghívjuk az illeszkedési módszert. Amikor a PyTorch becslőben fittinget hívunk, a SageMaker edzési feladatot indít el, a mi scriptünket használva képzési kódként:

from sagemaker.pytorch import PyTorch output_location = f"s3://{bucket}/{prefix}/output"

print(f"training artifacts will be uploaded to: {output_location}") hyperparameters={ "batch-size": 100, "epochs": 1, "lr": 0.1, "gamma": 0.9, "log-interval": 100

} instance_type = "ml.c4.xlarge"

estimator = PyTorch( entry_point="train.py", source_dir="code", # directory of your training script role=execution_role, framework_version="1.13", py_version="py39", instance_type=instance_type, instance_count=1, volume_size=250, output_path=output_location, hyperparameters=hyperparameters

) estimator.fit(inputs = { 'training': f"{inputs}", 'testing': f"{inputs}"

})Exportálja a betanított modellt ONNX-modellként

Miután a képzés befejeződött, és a modellünket az Amazon S3 előre meghatározott helyére mentettük, az ONNX futtatókörnyezet használatával exportáljuk a modellt egy ONNX modellbe.

A modellünk ONNX-be exportálásához szükséges kódot belefoglaljuk a képzési szkriptünkbe, amely a képzés befejezése után futni fog.

A PyTorch úgy exportálja a modellt az ONNX-be, hogy futtatja a modellt a mi bemenetünk segítségével, és rögzíti a kimenet kiszámításához használt operátorok nyomát. A megfelelő típusú véletlenszerű bemenetet használjuk a PyTorch-al torch.onnx.export funkcióval exportálhatja a modellt az ONNX-be. A bemenetünk első dimenzióját dinamikusnak adjuk meg, így a modellünk változót fogad el batch_size bemenetek a következtetés során.

def export_to_onnx(model, model_dir, device): logger.info("Exporting the model to onnx.") dummy_input = torch.randn(1, 1, 28, 28).to(device) input_names = [ "input_0" ] output_names = [ "output_0" ] path = os.path.join(model_dir, 'mnist-pytorch.onnx') torch.onnx.export(model, dummy_input, path, verbose=True, input_names=input_names, output_names=output_names, dynamic_axes={'input_0' : {0 : 'batch_size'}, # variable length axes 'output_0' : {0 : 'batch_size'}})Az ONNX a mélytanulási modellek nyílt szabványos formátuma, amely lehetővé teszi a mély tanulási keretrendszerek, például a PyTorch, a Microsoft Cognitive Toolkit (CNTK) és egyebek közötti együttműködést. Ez azt jelenti, hogy ezen keretrendszerek bármelyikét használhatja a modell betanításához, majd az előre betanított modellek ONNX formátumban történő exportálásához. A modell ONNX-be exportálásával a telepítési eszközök és platformok szélesebb választékát élvezheti.

Töltse le és bontsa ki a modelltermékeket

A képzési szkriptünk által mentett ONNX-modellt a SageMaker az Amazon S3-ra másolta a képzési feladat megkezdésekor megadott kimeneti helyre. A modell melléktermékei tömörített archív fájlként, ún model.tar.gz. Ezt az archív fájlt letöltjük a Studio notebook példányunk egyik helyi könyvtárába, és kibontjuk a modell melléktermékeit, nevezetesen az ONNX modellt.

import tarfile local_model_file = 'model.tar.gz'

model_bucket,model_key = estimator.model_data.split('/',2)[-1].split('/',1)

s3 = boto3.client("s3")

s3.download_file(model_bucket,model_key,local_model_file) model_tar = tarfile.open(local_model_file)

model_file_name = model_tar.next().name

model_tar.extractall('.')

model_tar.close()Érvényesítse az ONNX modellt

Az ONNX modell egy nevű fájlba kerül exportálásra mnist-pytorch.onnx képzési forgatókönyvünk szerint. Miután letöltöttük és kicsomagoltuk ezt a fájlt, opcionálisan ellenőrizhetjük az ONNX modellt a onnx.checker modul. A check_model funkció ebben a modulban ellenőrzi a modell konzisztenciáját. Kivételt képez, ha a teszt sikertelen.

import onnx onnx_model = onnx.load("mnist-pytorch.onnx")

onnx.checker.check_model(onnx_model)Csomagolja be a modellt és a következtetési kódot

Ebben a bejegyzésben .zip-alapú telepítést használunk az Azure Functions számára. Ezzel a módszerrel a modellünket, a kísérő kódot és az Azure Functions beállításait egy .zip fájlba csomagoljuk, és közzétesszük az Azure Functionsban. A következő kód bemutatja a telepítési csomagunk könyvtárstruktúráját:

mnist-onnx├── function_app.py├── model│ └── mnist-pytorch.onnx└── requirements.txt

Függőségek listázása

Felsoroljuk a következtetési kódunk függőségeit a requirements.txt fájlt a csomagunk gyökerében. Ez a fájl az Azure Functions-környezet felépítésére szolgál, amikor közzétesszük a csomagot.

azure-functionsnumpyonnxruntime

Írjon következtetési kódot

A Python segítségével írjuk meg a következő következtetési kódot, az ONNX Runtime könyvtárat pedig a modell betöltéséhez és a következtetés futtatásához. Ez arra utasítja az Azure Functions alkalmazást, hogy tegye elérhetővé a végpontot a webhelyen /classify relatív út.

import logging

import azure.functions as func

import numpy as np

import os

import onnxruntime as ort

import json app = func.FunctionApp() def preprocess(input_data_json): # convert the JSON data into the tensor input return np.array(input_data_json['data']).astype('float32') def run_model(model_path, req_body): session = ort.InferenceSession(model_path) input_data = preprocess(req_body) logging.info(f"Input Data shape is {input_data.shape}.") input_name = session.get_inputs()[0].name # get the id of the first input of the model try: result = session.run([], {input_name: input_data}) except (RuntimeError) as e: print("Shape={0} and error={1}".format(input_data.shape, e)) return result[0] def get_model_path(): d=os.path.dirname(os.path.abspath(__file__)) return os.path.join(d , './model/mnist-pytorch.onnx') @app.function_name(name="mnist_classify")

@app.route(route="classify", auth_level=func.AuthLevel.ANONYMOUS)

def main(req: func.HttpRequest) -> func.HttpResponse: logging.info('Python HTTP trigger function processed a request.') # Get the img value from the post. try: req_body = req.get_json() except ValueError: pass if req_body: # run model result = run_model(get_model_path(), req_body) # map output to integer and return result string. digits = np.argmax(result, axis=1) logging.info(type(digits)) return func.HttpResponse(json.dumps({"digits": np.array(digits).tolist()})) else: return func.HttpResponse( "This HTTP triggered function successfully.", status_code=200 )Telepítse a modellt az Azure Functionsba

Most, hogy a kódot a szükséges .zip formátumba csomagoltuk, készen állunk annak közzétételére az Azure Functionsban. Ezt az Azure CLI-vel, az Azure-erőforrások létrehozására és kezelésére szolgáló parancssori segédprogrammal tesszük. Telepítse az Azure CLI-t a következő kóddal:

!pip install -q azure-cliEzután hajtsa végre a következő lépéseket:

- Jelentkezzen be az Azure-ba:

!az login - Állítsa be az erőforrás-létrehozási paramétereket:

import random random_suffix = str(random.randint(10000,99999)) resource_group_name = f"multicloud-{random_suffix}-rg" storage_account_name = f"multicloud{random_suffix}" location = "ukwest" sku_storage = "Standard_LRS" functions_version = "4" python_version = "3.9" function_app = f"multicloud-mnist-{random_suffix}" - Használja a következő parancsokat az Azure Functions alkalmazás létrehozásához az előfeltétel erőforrásokkal együtt:

!az group create --name {resource_group_name} --location {location} !az storage account create --name {storage_account_name} --resource-group {resource_group_name} --location {location} --sku {sku_storage} !az functionapp create --name {function_app} --resource-group {resource_group_name} --storage-account {storage_account_name} --consumption-plan-location "{location}" --os-type Linux --runtime python --runtime-version {python_version} --functions-version {functions_version} - Állítsa be az Azure Functions-t úgy, hogy a Functions-csomag telepítésekor a

requirements.txtfájlt az alkalmazásfüggőségeink felépítésére használjuk:!az functionapp config appsettings set --name {function_app} --resource-group {resource_group_name} --settings @./functionapp/settings.json - Állítsa be a Functions alkalmazást a Python v2 modell futtatására, és hajtson végre egy összeállítást a .zip telepítése után kapott kódon:

{ "AzureWebJobsFeatureFlags": "EnableWorkerIndexing", "SCM_DO_BUILD_DURING_DEPLOYMENT": true } - Miután az erőforráscsoport, a tárolótároló és a Functions alkalmazás megfelelő konfigurációval rendelkezik, tegye közzé a kódot a Functions alkalmazásban:

!az functionapp deployment source config-zip -g {resource_group_name} -n {function_app} --src {function_archive} --build-remote true

Tesztelje a modellt

Az ML-modellt az Azure Functionsban HTTP-triggerként telepítettük, ami azt jelenti, hogy a Functions alkalmazás URL-címével HTTP-kérést küldhetünk a függvénynek a függvény meghívásához és a modell futtatásához.

A bemenet előkészítéséhez töltse le a tesztképfájlokat a SageMaker példafájl-tárolójából, és készítsen elő egy mintakészletet a modell által igényelt formátumban:

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

import matplotlib.pyplot as plt transform=transforms.Compose( [transforms.ToTensor(), transforms.Normalize((0.1307,), (0.3081,))]

) test_dataset = datasets.MNIST(root='../data', download=True, train=False, transform=transform)

test_loader = DataLoader(test_dataset, batch_size=16, shuffle=True) test_features, test_labels = next(iter(test_loader))A kérések könyvtár segítségével küldjön egy feladási kérelmet a következtetési végpontra a mintabemenetekkel. A következtetési végpont a következő kódban látható formátumot veszi fel:

import requests, json def to_numpy(tensor): return tensor.detach().cpu().numpy() if tensor.requires_grad else tensor.cpu().numpy() url = f"https://{function_app}.azurewebsites.net/api/classify"

response = requests.post(url, json.dumps({"data":to_numpy(test_features).tolist()}) )

predictions = json.loads(response.text)['digits']Tisztítsuk meg

Ha végzett a modell tesztelésével, törölje az erőforráscsoportot a benne lévő erőforrásokkal együtt, beleértve a tárolótárolót és a Functions alkalmazást:

!az group delete --name {resource_group_name} --yesEzenkívül a költségek csökkentése érdekében ajánlatos leállítani a tétlen erőforrásokat a SageMaker Studio-ban. További információkért lásd: Takarítson meg költségeket azáltal, hogy automatikusan leállítja a tétlen erőforrásokat az Amazon SageMaker Studio-ban.

Következtetés

Ebben a bejegyzésben bemutattuk, hogyan építhet és taníthat meg egy ML-modellt a SageMaker segítségével, és hogyan helyezheti üzembe egy másik felhőszolgáltatónál. A megoldásban SageMaker Studio notebookot használtunk, de az éles munkaterheléshez a használatát javasoltuk MLOps megismételhető képzési munkafolyamatok létrehozása a modellfejlesztés és a telepítés felgyorsítása érdekében.

Ez a bejegyzés nem mutatta be az összes lehetséges módot a modell multicloud környezetben történő üzembe helyezésére és futtatására. Például a modellt egy tárolóképbe is csomagolhatja a következtetési kóddal és a függőségi könyvtárakkal együtt, hogy a modellt konténeres alkalmazásként futtassa bármely platformon. Erről a megközelítésről további információért lásd: Telepítsen konténeralkalmazásokat többfelhős környezetben az Amazon CodeCatalyst segítségével. A bejegyzés célja, hogy bemutassa, hogyan használhatják a szervezetek az AWS AI/ML képességeit többfelhős környezetben.

A szerzőkről

Raja Vaidyanathan az AWS megoldástervezője, aki a globális pénzügyi szolgáltatások ügyfeleit támogatja. A Raja az ügyfelekkel együttműködve olyan komplex problémák megoldását tervezi, amelyek hosszú távon pozitív hatással vannak vállalkozásukra. Erős mérnöki szakember, aki jártas az IT-stratégiában, a vállalati adatkezelésben és az alkalmazás-architektúrában, és különösen érdeklődik az analitika és a gépi tanulás iránt.

Raja Vaidyanathan az AWS megoldástervezője, aki a globális pénzügyi szolgáltatások ügyfeleit támogatja. A Raja az ügyfelekkel együttműködve olyan komplex problémák megoldását tervezi, amelyek hosszú távon pozitív hatással vannak vállalkozásukra. Erős mérnöki szakember, aki jártas az IT-stratégiában, a vállalati adatkezelésben és az alkalmazás-architektúrában, és különösen érdeklődik az analitika és a gépi tanulás iránt.

Amandeep Bajwa az AWS vezető megoldástervezője, pénzügyi szolgáltatásokat nyújtó vállalkozásokat támogat. Segíti a szervezeteket üzleti eredményeik elérésében azáltal, hogy meghatározza a megfelelő felhőalapú átalakítási stratégiát az iparági trendek és a szervezeti prioritások alapján. Az Amandeep tanácsai közé tartozik a felhőalapú migráció, a felhőstratégia (beleértve a hibrid és a multicloudot is), a digitális átalakítás, az adatok és elemzések, valamint általában a technológia.

Amandeep Bajwa az AWS vezető megoldástervezője, pénzügyi szolgáltatásokat nyújtó vállalkozásokat támogat. Segíti a szervezeteket üzleti eredményeik elérésében azáltal, hogy meghatározza a megfelelő felhőalapú átalakítási stratégiát az iparági trendek és a szervezeti prioritások alapján. Az Amandeep tanácsai közé tartozik a felhőalapú migráció, a felhőstratégia (beleértve a hibrid és a multicloudot is), a digitális átalakítás, az adatok és elemzések, valamint általában a technológia.

Prema Iyer az AWS Enterprise Support vezető műszaki ügyfélmenedzsere. Különféle projekteken dolgozik külső ügyfelekkel, segítve őket megoldásaik értékének növelésében az AWS használata során.

Prema Iyer az AWS Enterprise Support vezető műszaki ügyfélmenedzsere. Különféle projekteken dolgozik külső ügyfelekkel, segítve őket megoldásaik értékének növelésében az AWS használata során.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/train-and-deploy-ml-models-in-a-multicloud-environment-using-amazon-sagemaker/

- :van

- :is

- :nem

- :ahol

- $ UP

- 1

- 10

- 100

- 13

- 25

- 28

- 32

- 7

- 9

- a

- Rólunk

- gyorsul

- elfogadja

- hozzáférés

- Fiók

- Elérése

- szerzett

- Előny

- Után

- AI

- AI / ML

- Minden termék

- lehetővé teszi, hogy

- mentén

- már

- Is

- Bár

- amazon

- Amazon SageMaker

- Amazon SageMaker Canvas

- Amazon SageMaker Studio

- Az Amazon Web Services

- an

- Az elemzők

- analitika

- és a

- Névtelenül

- Másik

- bármilyen

- Apache

- app

- Alkalmazás

- alkalmazások

- megközelítés

- megfelelő

- építészet

- Archív

- VANNAK

- területek

- AS

- értékelés

- At

- automatizált

- automatikusan

- elérhető

- AWS

- TENGELYEK

- Égszínkék

- alapján

- BE

- óta

- előtt

- kezdődik

- előnyös

- haszon

- Jobb

- között

- mindkét

- hoz

- tágabb

- épít

- Épület

- üzleti

- de

- by

- hívás

- hívott

- hívás

- TUD

- vászon

- képességek

- visz

- eset

- Ellenőrzések

- osztály

- osztályoz

- kettyenés

- felhő

- kód

- kognitív

- kollaboratív

- vállalat

- teljes

- bonyolult

- teljesítés

- átfogó

- Kiszámít

- Configuration

- tartalmazott

- Konténer

- Konténerek

- tartalmaz

- kontextus

- kényelem

- megtérít

- konvertáló

- Mag

- kiadások

- tudott

- teremt

- készítette

- létrehozása

- teremtés

- Hitelesítő adatok

- szokás

- Ügyfelek

- dátum

- adatkezelés

- Adatok előkészítése

- adat-tudomány

- adatkészletek

- mély

- mély tanulás

- legmélyebb

- alapértelmezett

- meghatározott

- definíció

- bizonyítani

- függőségek

- Függőség

- telepíteni

- telepített

- bevezetéséhez

- bevetés

- leírni

- részlet

- részletek

- Fejlesztés

- eszköz

- Eszközök

- különböző

- digitális

- digitális átalakítás

- számjegy

- Dimenzió

- tárgyalt

- do

- Dokkmunkás

- domain

- csinált

- ne

- le-

- letöltés

- alatt

- dinamikus

- e

- más

- ölelés

- lehetővé teszi

- lehetővé téve

- végén

- Endpoint

- Mérnöki

- Mérnökök

- Vállalkozás

- Vállalatok

- Környezet

- korszak

- korszakok

- Minden

- példa

- Kivéve

- kivétel

- végrehajtás

- szakvélemény

- export

- export

- külső

- kivonat

- nem sikerül

- Jellemzők

- kevés

- filé

- Fájlok

- pénzügyi

- pénzügyi szolgáltatások

- Találjon

- vezetéknév

- megfelelő

- következő

- A

- formátum

- Alapítvány

- Keretrendszer

- keretek

- ból ből

- funkció

- funkciók

- általános

- generál

- nemző

- Generatív AI

- kap

- Globális

- globális pénzügyi

- Csoport

- Legyen

- he

- segít

- segít

- tárhely

- Hogyan

- How To

- HTML

- http

- HTTPS

- hibrid

- ID

- azonosító

- Idle

- if

- illusztrálja

- kép

- képek

- Hatás

- importál

- importáló

- javul

- javuló

- in

- tartalmaz

- Beleértve

- független

- ipar

- információ

- kezdetben

- bemenet

- bemenet

- telepíteni

- példa

- utasítás

- integrálni

- integrált

- A szándék

- érdekek

- Felület

- Az interoperabilitás

- bele

- IT

- ITS

- Munka

- Állások

- jpg

- json

- nyelv

- nagy

- legutolsó

- elindítja

- TANUL

- tanulás

- Hossz

- Tőkeáttétel

- könyvtárak

- könyvtár

- életciklus

- vonal

- linux

- Lista

- kiszámításának

- terhelések

- helyi

- helyileg

- elhelyezkedés

- fakitermelés

- hosszú lejáratú

- keres

- le

- gép

- gépi tanulás

- csinál

- kezelése

- sikerült

- vezetés

- menedzser

- sok

- térkép

- matplotlib

- Lehet..

- eszközök

- Találkozik

- Megfelel

- módszer

- mód

- microsoft

- esetleg

- elvándorlás

- ML

- MLOps

- Mód

- modell

- modellek

- Modulok

- több

- a legtöbb

- név

- Nevezett

- ugyanis

- Szükség

- szükséges

- igények

- háló

- hálózat

- ideg-

- neurális hálózat

- jegyzetfüzet

- számtalan

- tárgy

- of

- on

- ONE

- nyitva

- nyílt forráskódú

- üzemeltetési

- Művelet

- üzemeltetők

- Opciók

- or

- érdekében

- szervezet

- szervezeti

- szervezetek

- OS

- Más

- mi

- ki

- eredmények

- teljesítmény

- kívül

- saját

- csomag

- becsomagolt

- paraméter

- paraméterek

- rész

- különös

- párt

- elhalad

- bérletek

- ösvény

- Teljesít

- engedélyek

- emelvény

- Platformok

- Plató

- Platón adatintelligencia

- PlatoData

- Népszerű

- pozitív

- lehetséges

- állás

- Tippek

- előkészítés

- Készít

- előfeltételek

- elsődleges

- Fő

- problémák

- Feldolgozott

- Termelés

- termelékenység

- Termékek

- szakmai

- projektek

- ad

- feltéve,

- ellátó

- biztosít

- nyilvános

- közzétesz

- Piton

- pytorch

- Quick

- emelt

- véletlen

- kész

- kap

- ajánlott

- felvétel

- csökkenteni

- utal

- Tekintet nélkül

- vidék

- iktató hivatal

- relatív

- megismételhető

- kérni

- kéri

- szükség

- kötelező

- követelmények

- forrás

- Tudástár

- válasz

- eredményez

- kapott

- visszatérés

- jobb

- Szerep

- gyökér

- futás

- futás

- fut

- sagemaker

- azonos

- mentett

- Skála

- letapogatás

- forgatókönyvek

- Tudomány

- tudósok

- forgatókönyv

- sdk

- másodlagos

- Rész

- szakaszok

- biztonság

- lát

- kiválasztás

- MAGA

- küld

- idősebb

- szolgáltatás

- Szolgáltatások

- ülés

- készlet

- beállítások

- felépítés

- Alak

- ő

- kellene

- előadás

- kimutatta,

- mutatott

- Műsorok

- Állítsa le

- leállítás

- Egyszerű

- helyzetek

- szakképzett

- készségek

- So

- szoftver

- megoldások

- Megoldások

- néhány

- forrás

- szuverenitás

- meghatározott

- Színpad

- standard

- kezdet

- kezdődött

- kezdődik

- Lépései

- tárolás

- tárolni

- memorizált

- Stratégia

- Húr

- erős

- struktúra

- stúdió

- Később

- sikeresen

- ilyen

- támogatás

- Támogató

- Támogatja

- Vesz

- tart

- cél

- csapat

- Műszaki

- Technologies

- Technológia

- tíz

- tensorflow

- teszt

- kipróbált

- Tesztelés

- szöveg

- hogy

- A

- The Source

- azok

- Őket

- maguk

- akkor

- Ezek

- ők

- dolog

- Harmadik

- ezt

- alkalommal

- nak nek

- eszköztár

- szerszámok

- fáklya

- Torchvision

- Nyom

- Vonat

- kiképzett

- Képzések

- Átalakítás

- Átalakítás

- Átalakítási stratégia

- transzformáció

- Trends

- kiváltó

- váltott

- igaz

- megpróbál

- típus

- egyedi

- feltöltve

- Feltöltés

- URL

- használ

- használati eset

- használt

- használó

- használ

- segítségével

- hasznosság

- ÉRVÉNYESÍT

- érték

- változó

- fajta

- gyártók

- verzió

- sebezhetőség

- akar

- volt

- módon

- we

- háló

- webes szolgáltatások

- web-alapú

- JÓL

- amikor

- ami

- lesz

- val vel

- belül

- munkafolyamatok

- művek

- ír

- írott

- X

- még

- te

- A te

- zephyrnet

- Postai irányítószám