これは、Iambic Therapeutics のリーダーシップ チームと共同で執筆されたゲスト投稿です。

弱強療法学 は、より優れた医薬品をより迅速にがん患者に提供する革新的な AI 駆動テクノロジーを開発するという使命を持った創薬スタートアップ企業です。

当社の高度な生成および予測人工知能 (AI) ツールにより、可能性のある薬剤分子の広大な空間をより迅速かつ効果的に検索できるようになります。当社の技術は多用途であり、治療分野、タンパク質クラス、作用機序全体に適用できます。差別化された AI ツールを作成するだけでなく、AI ソフトウェア、クラウドベースのデータ、スケーラブルな計算インフラストラクチャ、高スループットの化学および生物学の機能を統合する統合プラットフォームを確立しました。このプラットフォームは、モデルを改良するためのデータを提供することで AI を有効にし、自動化された意思決定とデータ処理の機会を活用して AI を有効にします。

当社は、患者の緊急ニーズに応えるための優れた臨床候補者を前例のないスピードで生み出す能力によって成功を評価しています。プログラムの立ち上げから臨床候補者までわずか 24 か月で進み、競合他社よりも大幅に早くなりました。

この投稿では、どのように使用したかに焦点を当てます カーペンター on Amazon Elastic Kubernetesサービス (Amazon EKS) を使用して、Iambic 検出プラットフォームの中核要素である AI トレーニングと推論を拡張します。

スケーラブルな AI トレーニングと推論の必要性

Iambic は毎週、数十のモデルと数百万の分子にわたって AI 推論を実行し、次の 2 つの主なユースケースに対応します。

- 医薬品化学者やその他の科学者は、当社の Web アプリケーション Insight を使用して、化学空間を探索し、実験データにアクセスして解釈し、新しく設計された分子の特性を予測します。この作業はすべてリアルタイムでインタラクティブに実行されるため、低遅延で中程度のスループットの推論が必要になります。

- 同時に、当社の生成 AI モデルは、多数の特性にわたる改善をターゲットとした分子を自動的に設計し、数百万の候補を検索し、膨大なスループットと中程度の待ち時間を必要とします。

AI テクノロジーとドラッグハンターの専門家によって導かれ、当社の実験プラットフォームは毎週何千ものユニークな分子を生成し、それぞれが複数の生物学的アッセイに供されます。生成されたデータ ポイントは自動的に処理され、AI モデルを毎週微調整するために使用されます。当初、モデルの微調整には数時間の CPU 時間がかかるため、GPU 上でモデルの微調整をスケーリングするためのフレームワークが不可欠でした。

当社の深層学習モデルには、重要な要件があります。サイズがギガバイトであり、多数かつ異種混合であり、高速推論と微調整のために GPU を必要とします。クラウド インフラストラクチャに目を向けると、GPU にアクセスし、急激な異種ワークロードを処理するために迅速にスケールアップおよびスケールダウンし、大規模な Docker イメージを実行できるシステムが必要でした。

私たちは、AI のトレーニングと推論をサポートするスケーラブルなシステムを構築したいと考えていました。私たちは Amazon EKS を使用しており、ワーカーノードを自動スケールするための最適なソリューションを探していました。 Kubernetes ノードの自動スケーリングに Karpenter を選択したのには、次のような理由があります。

- Kubernetes との統合が容易。Kubernetes セマンティクスを使用してスケーリングのためのノード要件とポッド仕様を定義します。

- ノードの低遅延スケールアウト

- コードとしてのインフラストラクチャ ツール (Terraform) との統合が容易

ノード プロビジョナーは、Amazon EKS や他の AWS リソースとの簡単な統合をサポートします。 アマゾン エラスティック コンピューティング クラウド (Amazon EC2) インスタンスと Amazon Elastic Blockストア ボリューム。プロビジョナーによって使用される Kubernetes セマンティクスは、テイントや許容、アフィニティや反アフィニティの仕様などの Kubernetes 構造を使用した指示されたスケジューリングをサポートします。また、Karpenter によってスケジュールされる GPU インスタンスの数と種類の制御も容易になります。

ソリューションの概要

このセクションでは、独自のワークロードに使用しているものと同様の汎用アーキテクチャを紹介します。これにより、カスタム メトリクスに基づいた効率的な自動スケーリングを使用してモデルを柔軟にデプロイできます。

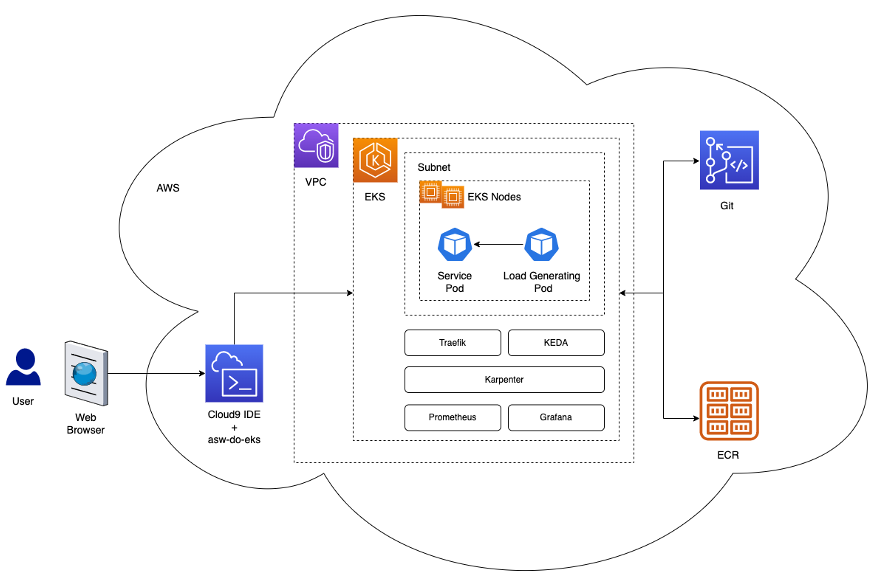

次の図は、ソリューションのアーキテクチャを示しています。

このアーキテクチャでは、 シンプルなサービス Kubernetes ポッド内の EKSクラスター。これは、モデル推論、データ シミュレーション、または HTTP リクエストによってアクセスできるその他のコンテナ化されたサービスである可能性があります。サービスは、次を使用してリバースプロキシの背後で公開されます。 トレフィク。 リバース プロキシは、サービスへの呼び出しに関するメトリクスを収集し、標準メトリクス API を介してそれらを公開します。 プロメテウス。 Kubernetes イベント駆動型オートスケーラー (毛田) は、Prometheus で利用可能なカスタム メトリクスに基づいて、サービス ポッドの数を自動的にスケールするように構成されています。ここでは、カスタム メトリックとして 1 秒あたりのリクエスト数を使用します。ワークロードに別のメトリックを選択した場合も、同じアーキテクチャ アプローチが適用されます。

Karpenter は、クラスター内に十分なリソースがないために実行できない保留中のポッドを監視します。そのようなポッドが検出された場合、Karpenter は必要なリソースを提供するためにクラスターにノードを追加します。逆に、スケジュールされたポッドに必要な数より多くのノードがクラスター内にある場合、Karpenter はワーカー ノードの一部を削除し、ポッドが再スケジュールされ、より少ないインスタンスに統合されます。 1 秒あたりの HTTP リクエストの数とノードの数は、 グラファナ ダッシュボード。自動スケーリングをデモンストレーションするために、1 つ以上のコマンドを実行します。 単純な負荷生成ポッドを使用してサービスに HTTP リクエストを送信します。 curl.

ソリューションの展開

段階的なチュートリアル、 を使用しております AWS クラウド9 アーキテクチャをデプロイする環境として。これにより、すべての手順を Web ブラウザから完了できるようになります。ローカル コンピューターまたは EC2 インスタンスからソリューションをデプロイすることもできます。

導入を簡素化し、再現性を向上させるために、次の原則に従います。 ドゥーフレームワーク との構造 docker テンプレートに依存。クローンを作成します aws-do-eks プロジェクトと、それを使用して デッカー、必要なツールとスクリプトを備えたコンテナー イメージを構築します。コンテナ内で、Karpenter を使用した EKS クラスターの作成からスケーリングまで、エンドツーエンドのウォークスルーのすべてのステップを実行します。 EC2インスタンス.

この投稿の例では、次のものを使用します EKS クラスター マニフェスト:

apiVersion: eksctl.io/v1alpha5

kind: ClusterConfig

metadata:

name: do-eks-yaml-karpenter

version: '1.28'

region: us-west-2

tags:

karpenter.sh/discovery: do-eks-yaml-karpenter

iam:

withOIDC: true

addons:

- name: aws-ebs-csi-driver

version: v1.26.0-eksbuild.1

wellKnownPolicies:

ebsCSIController: true

managedNodeGroups:

- name: c5-xl-do-eks-karpenter-ng

instanceType: c5.xlarge

instancePrefix: c5-xl

privateNetworking: true

minSize: 0

desiredCapacity: 2

maxSize: 10

volumeSize: 300

iam:

withAddonPolicies:

cloudWatch: true

ebs: trueこのマニフェストは、という名前のクラスターを定義します。 do-eks-yaml-karpenter EBS CSI ドライバーがアドオンとしてインストールされています。 2 つの管理対象ノード グループ c5.xlarge クラスターに必要なシステム ポッドを実行するためにノードが含まれています。ワーカー ノードはプライベート サブネットでホストされ、クラスター API エンドポイントはデフォルトでパブリックです。

EKS クラスターを作成する代わりに、既存の EKS クラスターを使用することもできます。以下に従って Karpenter をデプロイします。 説明書 Karpenter のドキュメントを参照するか、次のコマンドを実行します。 スクリプト、展開手順を自動化します。

次のコードは、この例で使用する Karpenter 構成を示しています。

apiVersion: karpenter.sh/v1beta1

kind: NodePool

metadata:

name: default

spec:

template:

metadata: null

labels:

cluster-name: do-eks-yaml-karpenter

annotations:

purpose: karpenter-example

spec:

nodeClassRef:

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

name: default

requirements:

- key: karpenter.sh/capacity-type

operator: In

values:

- spot

- on-demand

- key: karpenter.k8s.aws/instance-category

operator: In

values:

- c

- m

- r

- g

- p

- key: karpenter.k8s.aws/instance-generation

operator: Gt

values:

- '2'

disruption:

consolidationPolicy: WhenUnderutilized

#consolidationPolicy: WhenEmpty

#consolidateAfter: 30s

expireAfter: 720h

---

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

metadata:

name: default

spec:

amiFamily: AL2

subnetSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

securityGroupSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

role: "KarpenterNodeRole-do-eks-yaml-karpenter"

tags:

app: autoscaling-test

blockDeviceMappings:

- deviceName: /dev/xvda

ebs:

volumeSize: 80Gi

volumeType: gp3

iops: 10000

deleteOnTermination: true

throughput: 125

detailedMonitoring: true次の要件を持つデフォルトの Karpenter NodePool を定義します。

- Karpenter は両方からインスタンスを起動できます

spotおよびon-demand容量プール - インスタンスは「」のものである必要があります。

c” (最適化されたコンピューティング)、”m" (一般的用途)、 "r" (メモリ最適化)、または "g"と"p」 (GPU アクセラレーション) コンピューティング ファミリ - インスタンスの生成は 2 より大きくなければなりません。例えば、

g3許容されますが、g2ではありません

デフォルトの NodePool は中断ポリシーも定義します。十分に活用されていないノードは削除されるため、ポッドを統合してより少数または小規模のノードで実行できるようになります。あるいは、指定した期間後に空のノードが削除されるように構成することもできます。の expireAfter この設定では、ノードが停止され、必要に応じて交換されるまでの、ノードの最大存続期間を指定します。これは、セキュリティの脆弱性を軽減するだけでなく、ファイルの断片化やメモリ リークなど、稼働時間の長いノードによくある問題を回避するのに役立ちます。

デフォルトでは、Karpenter はルート ボリュームが小さいノードをプロビジョニングしますが、AI または機械学習 (ML) ワークロードを実行するには不十分な場合があります。一部のディープ ラーニング コンテナー イメージのサイズは数十 GB になるため、これらのイメージを使用してポッドを実行するのに十分なストレージ領域がノード上にあることを確認する必要があります。そのために、次のように定義します。 EC2NodeClass blockDeviceMappings前述のコードに示すように。

Karpenter はクラスター レベルでの自動スケーリングを担当します。ポッド レベルで自動スケーリングを構成するには、KEDA を使用して というカスタム リソースを定義します。 ScaledObject、次のコードに示すように:

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

name: keda-prometheus-hpa

namespace: hpa-example

spec:

scaleTargetRef:

name: php-apache

minReplicaCount: 1

cooldownPeriod: 30

triggers:

- type: prometheus

metadata:

serverAddress: http://prometheus- server.prometheus.svc.cluster.local:80

metricName: http_requests_total

threshold: '1'

query: rate(traefik_service_requests_total{service="hpa-example-php-apache-80@kubernetes",code="200"}[2m])前述のマニフェストでは、 ScaledObject 命名 keda-prometheus-hpa、php-apache デプロイメントのスケーリングを担当し、常に少なくとも 1 つのレプリカを実行し続けます。メトリクスに基づいてこのデプロイメントのポッドをスケーリングします。 http_requests_total 指定されたクエリによって取得された Prometheus で利用可能であり、各ポッドが 30 秒あたり XNUMX つ以上のリクエストを処理しないようにポッドをスケールアップすることを目標としています。リクエストの負荷が XNUMX 秒を超えてしきい値を下回った後、レプリカをスケールダウンします。

導入仕様 この例のサービスには次のものが含まれます リソースのリクエストと制限:

resources:

limits:

cpu: 500m

nvidia.com/gpu: 1

requests:

cpu: 200m

nvidia.com/gpu: 1この構成では、各サービス ポッドは 1 つの NVIDIA GPU をのみ使用します。新しいポッドが作成されると、GPU が使用可能になるまで保留状態になります。 Karpenter は、保留中のポッドに対応するために、必要に応じて GPU ノードをクラスターに追加します。

A 負荷生成ポッド 事前に設定された頻度でサービスに HTTP リクエストを送信します。内のレプリカの数を増やすことでリクエストの数を増やします。 ロードジェネレーターの展開.

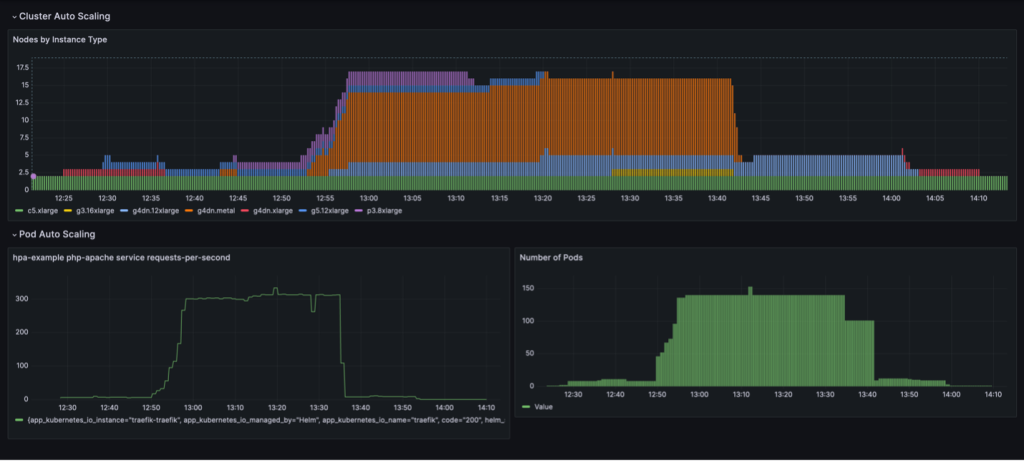

使用率ベースのノード統合によるフル スケーリング サイクルは、Grafana ダッシュボードで視覚化されます。次のダッシュボードには、インスタンス タイプ別のクラスター内のノード数 (上)、1 秒あたりのリクエスト数 (左下)、およびポッドの数 (右下) が表示されます。

クラスターの作成に使用した 5 つの c4.xlarge CPU インスタンスだけから始めます。次に、単一の GPU を必要とする 3.8 つのサービス インスタンスをデプロイします。 Karpenter は、このニーズに対応するために g8dn.xlarge インスタンスを追加します。次に、ロード ジェネレーターをデプロイします。これにより、KEDA はサービス ポッドを追加し、Karpenter は GPU インスタンスを追加します。最適化後、状態は 5.12 GPU を備えた 4 つの pXNUMXxlarge インスタンスと XNUMX GPU を備えた XNUMX つの gXNUMXxlarge インスタンスに落ち着きます。

負荷を生成するデプロイメントを 40 個のレプリカに拡張すると、KEDA は追加のサービス ポッドを作成して、ポッドごとに必要なリクエスト負荷を維持します。 Karpenter は、追加のポッドに必要な GPU を提供するために、g4dn.metal ノードと g4dn.12xlarge ノードをクラスターに追加します。スケーリングされた状態では、クラスターには 16 の GPU ノードが含まれており、300 秒あたり約 1 のリクエストを処理します。ロード ジェネレーターを 4 つのレプリカにスケールダウンすると、逆のプロセスが発生します。クールダウン期間の後、KEDA はサービス ポッドの数を減らします。その後、実行されるポッドが少なくなると、Karpenter は十分に活用されていないノードをクラスターから削除し、サービス ポッドはより少ないノードで実行されるように統合されます。ロード ジェネレーター ポッドが削除されても、1 つの GPU を備えた単一の gXNUMXdn.xlarge インスタンス上の単一のサービス ポッドは実行されたままになります。サービス ポッドも削除すると、クラスターは XNUMX つの CPU ノードのみを備えた初期状態のままになります。

この動作は次の場合に観察できます。 NodePool 設定があります consolidationPolicy: WhenUnderutilized.

この設定を使用すると、Karpenter は、すべてのポッドの実行に十分なリソースを提供し、コストを最小限に抑えながら、可能な限り少ないノードでクラスターを動的に構成します。

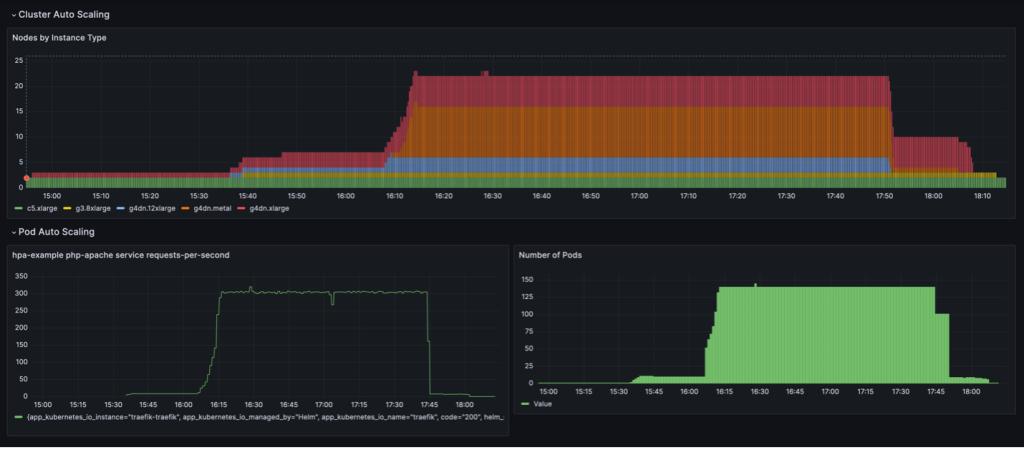

次のダッシュボードに示されているスケーリング動作は、 NodePool 統合ポリシーは次のように設定されています WhenEmpty、 に加えて consolidateAfter: 30s.

このシナリオでは、クールオフ期間後にノード上で実行されているポッドがない場合にのみノードが停止されます。使用率ベースの統合ポリシーと比較すると、スケーリング曲線は滑らかに見えます。ただし、スケーリングされた状態では、より多くのノードが使用されていることがわかります (22 対 16)。

全体として、ポッドとクラスターの自動スケーリングを組み合わせることで、クラスターがワークロードに合わせて動的にスケーリングされ、必要なときにリソースが割り当てられ、使用されていないときはリソースが削除されるため、使用率が最大化され、コストが最小限に抑えられます。

成果

Iambic はこのアーキテクチャを使用して、AWS で GPU を効率的に使用し、ワークロードを CPU から GPU に移行しました。 EC2 GPU を利用したインスタンス、Amazon EKS、Karpenter を使用することで、物理ベースのモデルの推論を高速化し、サービスとしてのトレーニングに依存する応用科学者向けに実験の反復時間を短縮することができました。

次の表は、この移行の時間指標の一部をまとめたものです。

| 仕事 | CPU | GPU |

| 物理ベースの ML モデルの拡散モデルを使用した推論 | 3,600 seconds |

100 seconds (GPU の固有のバッチ処理のため) |

| サービスとしての ML モデルのトレーニング | 180 minutes | 4 minutes |

次の表は、時間とコストの指標の一部をまとめたものです。

| 仕事 | 性能・コスト | |

| CPU | GPU | |

| ML モデルのトレーニング |

240 minutes トレーニング タスクあたり平均 0.70 ドル |

20 minutes トレーニング タスクあたり平均 0.38 ドル |

まとめ

この投稿では、Iambic が Karpenter と KEDA を使用して Amazon EKS インフラストラクチャを拡張し、AI 推論とトレーニングのワークロードのレイテンシー要件を満たす方法を紹介しました。 Karpenter と KEDA は、EKS クラスターとその上で実行されるワークロードの自動スケールを支援する強力なオープン ソース ツールです。これは、パフォーマンス要件を満たしながら、コンピューティング コストを最適化するのに役立ちます。このコードの完全なチュートリアルに従うことで、コードをチェックアウトし、同じアーキテクチャを独自の環境にデプロイできます。 GitHubレポ.

著者について

マシュー・ウェルボーン Iambic Therapeutics の機械学習部門のディレクターです。彼と彼のチームは AI を活用して新しい治療法の特定と開発を加速し、命を救う薬をより早く患者に提供します。

マシュー・ウェルボーン Iambic Therapeutics の機械学習部門のディレクターです。彼と彼のチームは AI を活用して新しい治療法の特定と開発を加速し、命を救う薬をより早く患者に提供します。

ポール・ホイットモア Iambic Therapeutics の主任エンジニアです。彼は、Iambic AI 主導の創薬プラットフォームのインフラストラクチャの提供をサポートしています。

ポール・ホイットモア Iambic Therapeutics の主任エンジニアです。彼は、Iambic AI 主導の創薬プラットフォームのインフラストラクチャの提供をサポートしています。

アレックス・イアンクルスキ ML/AI フレームワークのプリンシパル ソリューション アーキテクトであり、AWS 上のコンテナと高速化されたコンピューティング インフラストラクチャを使用して顧客が AI ワークロードをオーケストレーションできるよう支援することに重点を置いています。

アレックス・イアンクルスキ ML/AI フレームワークのプリンシパル ソリューション アーキテクトであり、AWS 上のコンテナと高速化されたコンピューティング インフラストラクチャを使用して顧客が AI ワークロードをオーケストレーションできるよう支援することに重点を置いています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/scale-ai-training-and-inference-for-drug-discovery-through-amazon-eks-and-karpenter/

- :持っている

- :は

- :not

- ][p

- $UP

- 1

- 10

- 100

- 125

- 16

- 200

- 200m

- 22

- 24

- 視聴者の38%が

- 28

- 30

- 300

- 40

- 600

- 7

- 70

- 8

- 80

- a

- 能力

- できる

- 私たちについて

- 加速する

- 加速された

- ことができます。

- アクセス

- アクセス可能な

- 対応する

- 越えて

- Action

- 加えます

- アドオン

- NEW

- 住所

- 追加

- 高度な

- 相性

- 後

- AI

- AIモデル

- AIトレーニング

- すべて

- ことができます

- 沿って

- また

- 常に

- Amazon

- Amazon EC2

- Amazon Webサービス

- an

- および

- どれか

- API

- アプリ

- 登場する

- 適用可能な

- 申し込み

- 適用された

- 適用

- アプローチ

- 建築の

- 建築

- です

- エリア

- 人工の

- 人工知能

- 人工知能(AI)

- AS

- At

- オート

- 自動化

- 自動化する

- 自動的に

- 利用できます

- 避ける

- AWS

- ベース

- バッチング

- BE

- き

- 行動

- 背後に

- 以下

- BEST

- より良いです

- 越えて

- 生物学

- ブロック

- 両言語で

- ボトム

- 持って来る

- 持参

- ブラウザ

- ビルド

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 呼ばれます

- コール

- 缶

- 癌

- 候補

- 機能

- 容量

- 大文字

- 例

- 原因

- チェック

- 化学物質

- 化学

- 選択する

- 選んだ

- クラス

- 臨床

- クラウド

- クラウドインフラ

- クラスタ

- コード

- 集める

- 結合

- 比べ

- 競合他社

- コンプリート

- 記入済みの

- 計算

- 計算

- コンピュータ

- コンピューティング

- 設定された

- 統合

- 圧密

- 構成

- コンテナ

- コンテナ

- 含まれています

- コントロール

- 逆に

- クールダウン

- 基本

- 費用

- コスト

- 可能性

- 作ります

- 作成した

- 作成します。

- 作成

- CSI

- 曲線

- カスタム

- Customers

- サイクル

- ダッシュボード

- データ

- データポイント

- データ処理

- 意思決定

- 深いです

- 深い学習

- デフォルト

- 定義します

- 定義する

- 配達

- 実証します

- 展開します

- 展開

- 配備する

- 設計

- 設計

- 検出された

- 開発

- ダイアグラム

- 異なります

- 差別化された

- 指示された

- 取締役

- 発見

- 途絶

- do

- デッカー

- ドキュメント

- 行われ

- ダウン

- 数十

- ドリブン

- ドライバー

- 薬

- 原因

- 動的に

- 各

- 効果的に

- 効率的な

- 楽な

- 要素は

- enable

- 使用可能

- 可能

- 端から端まで

- エンドポイント

- エンジニア

- 巨大な

- 十分な

- 環境

- 装備

- 設立

- イベント

- あらゆる

- 正確に

- 例

- 既存の

- 実験

- 実験的

- エキスパート

- 探る

- 露出した

- 容易にする

- スピーディー

- 速いです

- 少数の

- より少ない

- File

- フォーカス

- 焦点を当てて

- フォロー中

- フラグメンテーション

- フレームワーク

- フレームワーク

- 周波数

- から

- フル

- 生成された

- 生成

- 世代

- 生々しい

- 生成AI

- ジェネレータ

- 取得する

- GPU

- GPU

- 大きい

- グループ

- ゲスト

- ゲストのポスト

- ハンドル

- 持ってる

- he

- 助けます

- 助け

- ことができます

- こちら

- 彼の

- 主催

- HOURS

- 認定条件

- しかしながら

- HTTP

- HTTPS

- 識別

- if

- 説明する

- 画像

- 画像

- 命令的

- 改善します

- 改善

- in

- 含まれました

- 増える

- の増加

- インフラ

- 固有の

- 初期

- 当初

- 革新的な

- 洞察力

- インストール

- を取得する必要がある者

- 説明書

- 統合された

- 統合

- インテリジェンス

- 解釈する

- 問題

- IT

- 繰り返し

- JPG

- ただ

- 続けて

- キー

- 種類

- ラベル

- 欠如

- 大

- レイテンシ

- 起動する

- リーダーシップ

- リーク

- 学習

- 最低

- 左

- レベル

- 活用します

- 一生

- 制限

- 負荷

- ローカル

- 長い

- より長いです

- 探して

- ロー

- 機械

- 機械学習

- 維持する

- make

- 作る

- マネージド

- 最大化

- 五月..

- だけど

- メカニズム

- ミディアム

- 大会

- ご相談

- メモリ

- マージ

- 金属

- メトリック

- メトリック

- 移動します

- 移行

- 何百万

- 最小化

- ミッション

- ML

- モデル

- モニター

- ヶ月

- 他には?

- の試合に

- しなければなりません

- 名

- 名前付き

- 必要

- 必要

- 必要とされる

- 新作

- 新しく

- いいえ

- ノード

- 小説

- 数

- 多数の

- Nvidia

- 観察する

- 得

- of

- on

- オンデマンド

- ONE

- の

- 開いた

- オープンソース

- オペレータ

- 機会

- 最適化

- 最適化

- 最適化

- or

- その他

- 私たちの

- でる

- が

- 自分の

- 患者

- 患者

- ペンディング

- 以下のために

- パフォーマンス

- 実行する

- 期間

- 場所

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- ポリシー

- 方針

- 可能

- ポスト

- パワード

- 強力な

- 先行

- 予測する

- 現在

- 主要な

- 校長

- 原則

- プライベート

- プロセス

- 処理済み

- 処理

- 作り出す

- 演奏曲目

- プロジェクト

- プロパティ

- タンパク質

- 提供します

- 提供

- 代理

- 公共

- 目的

- クエリー

- すぐに

- R

- リアル

- への

- 理由は

- 減らします

- 軽減

- リファイン

- 地域

- 頼る

- 残っている

- 削除します

- 削除済み

- 除去する

- 除去

- 置き換え

- 返信

- 要求

- リクエスト

- 必要とする

- の提出が必要です

- 要件

- 必要

- リソースを追加する。

- リソース

- 責任

- 逆

- 右

- 職種

- ルート

- ラン

- ランニング

- 同じ

- ド電源のデ

- 規模

- スケールai

- 縮尺

- 秤

- スケーリング

- シナリオ

- 予定の

- スケジューリング

- 科学者たち

- スクリプト

- を検索

- 検索

- 二番

- 秒

- セクション

- セキュリティ

- 見て

- 意味論

- 送信

- 送る

- 仕える

- サービス

- サービス

- サービング

- セッションに

- 設定

- 落ち着く

- ショーケース

- 示す

- 作品

- 著しく

- 同様の

- 簡素化する

- サイズ

- 小さい

- より小さい

- スムーズ

- So

- ソフトウェア

- 溶液

- ソリューション

- 一部

- ソース

- スペース

- 仕様

- 指定の

- スペック

- スピード

- Spot

- 標準

- start

- スタートアップ

- 都道府県

- ステップ

- 停止

- ストレージ利用料

- 構造

- サブネット

- 成功

- そのような

- 十分な

- 優れた

- 補給

- サポート

- サポート

- 確か

- SVC

- テーブル

- 取り

- ターゲット

- ターゲット

- チーム

- テクノロジー

- template

- 十

- テラフォーム

- より

- それ

- ステート

- アプリ環境に合わせて

- それら

- その後

- 治療薬

- そこ。

- それによって

- ボーマン

- 彼ら

- この

- 数千

- しきい値

- 介して

- スループット

- 時間

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- 取った

- 豊富なツール群

- top

- トレーニング

- true

- 2

- type

- 典型的な

- ユニーク

- 前例のない

- まで

- 稼働時間

- 緊急

- us

- つかいます

- 中古

- v1

- 価値観

- 広大な

- 多才な

- バージョン

- 、

- ボリューム

- ボリューム

- vs

- 脆弱性

- ウォークスルー

- wanted

- ました

- we

- ウェブ

- ウェブアプリケーション

- ウェブブラウザ

- Webサービス

- 週間

- WELL

- した

- この試験は

- 何ですか

- いつ

- which

- while

- 誰

- 意志

- 以内

- 仕事

- ワーカー

- ヤムル

- You

- あなたの

- ゼファーネット