最近、新しい機能を導入しました Amazon SageMaker Python SDK これにより、データ サイエンティストは、好みの統合開発者環境 (IDE) とノートブックで作成された機械学習 (ML) コードを、関連するランタイム依存関係と共に次のように実行できます。 アマゾンセージメーカー ローカルで行われた実験へのコード変更を最小限に抑えたトレーニング ジョブ。 通常、データ サイエンティストは、ML の問題に取り組みながら、データ処理とトレーニング モデルの実験を数回繰り返します。 彼らはこの ML コードを実行し、使いやすさと最小限のコード変更で実験を行いたいと考えています。 Amazon SageMaker モデルトレーニング は、データ サイエンティストが AWS のコンピューティング インフラストラクチャで完全に管理された大規模なトレーニング ジョブを実行できるように支援します。 SageMaker トレーニングは、次のような高度なツールを使用してデータ サイエンティストにも役立ちます。 Amazon SageMakerデバッガ 大規模なトレーニング ジョブをデバッグおよび分析する Profiler。

予算が少なく、チームが小さく、タイムラインが厳しいお客様の場合、SageMaker で実行するためにすべての新しい概念とコード行を書き直すと、コアタスク、つまりデータ処理と ML モデルのトレーニングに対する生産性が低下します。 彼らは、選択したフレームワークで一度コードを書き、ノートブックやラップトップでコードを実行することから、SageMaker 機能を使用して大規模にコードを実行することへとシームレスに移行できることを望んでいます。

SageMaker Python SDK のこの新しい機能により、データ サイエンティストは ML コードを SageMaker Training プラットフォームに数分でオンボードできます。 ML コードに XNUMX 行のコードを追加するだけで、SageMaker はコードをデータセットとワークスペース環境のセットアップとともにインテリジェントに理解し、SageMaker トレーニングジョブとして実行します。 その後、ジョブを簡単にスケーリングする機能や、Debugger や Profiler などのその他の関連ツールなど、SageMaker Training プラットフォームの主要な機能を利用できます。 このリリースでは、ローカルの機械学習 (ML) Python コードを、単一ノードの Amazon SageMaker トレーニング ジョブまたは複数の並列ジョブとして実行できます。 (複数のノードにまたがる) 分散トレーニング ジョブは、リモート関数ではサポートされていません。

この投稿では、この新しい機能を使用してローカル ML コードを SageMaker Training ジョブとして実行する方法を紹介します。

ソリューションの概要

ユーザーのコードベースへのエントリポイントとして機能する関数に単純なデコレータで注釈を付けることで、IDE またはノートブックで記述された ML コードを SageMaker Training ジョブとして実行できるようになりました。 この機能は、呼び出し時に、関連付けられているすべての変数、関数、パッケージ、環境変数、およびその他のランタイム要件のスナップショットを ML コードから自動的に取得し、それらをシリアル化し、SageMaker トレーニング ジョブとして送信します。 最近発表された パラメータのデフォルト値を設定するための SageMaker Python SDK 機能. この機能により、SageMaker トレーニングを使用してコードを実行できるようにするために学習する必要がある SageMaker 構造が簡素化されます。 データ サイエンティストは、好みの IDE (たとえば、 Amazon SageMakerスタジオ、ノートブック、VS Code、または PyCharm)。 準備ができたら、Python 関数に注釈を付けることができます。 @remote デコレータを作成し、SageMaker ジョブとして大規模に実行します。

この機能は、使い慣れたオープンソースの Python オブジェクトを引数と出力として受け取ります。 さらに、コンテナーのライフサイクル管理を理解する必要はなく、構成のオーバーヘッドを最小限に抑えて、さまざまなコンピューティング コンテキスト (ローカル IDE、Studio、トレーニング ジョブなど) でワークロードを簡単に実行できます。 任意のローカル コードを SageMaker トレーニング ジョブとして実行するために、この機能はジョブの実行に必要な構成を推測します。 AWS IDおよびアクセス管理 (IAM) ロール、暗号化キー、およびネットワーク構成 (Studio または IDE 設定から) (これは、 デフォルト設定)、デフォルトでそれらをプラットフォームに渡します。 推論された構成を使用して SageMaker マネージドインフラストラクチャでランタイムをカスタマイズしたり、デコレーターに引数として渡すことで SDK レベルでそれらをオーバーライドしたりする柔軟性があります。

SageMaker Python SDK のこの新しい機能は、既存のワークスペース環境で ML コードを変換し、関連するデータ処理コードとデータセットを SageMaker トレーニング ジョブに変換します。 この機能は、 @remote デコレーターを作成し、Studio または PyCharm などのローカル IDE で実行されるジョブに自動的に変換します。

以下のセクションでは、この新しい機能の機能と、python 関数を SageMaker Training ジョブとして起動する方法について説明します。

前提条件

この新しい SageMaker Python SDK 機能を使用して、この記事に関連するコードを実行するには、次の前提条件が必要です。

- すべての AWS リソースを含む AWS アカウント

- SageMaker にアクセスするための IAM ロール

- Studio または SageMaker ノートブック インスタンス、または PyCharm などの IDE へのアクセス

Studio および SageMaker ノートブックの SDK を使用する

ノートブックを起動し、コードを @remote ノートブック内のデコレータ。 最初に、次のコードを使用してリモート関数をインポートする必要があります。

from sagemaker.remote_function import remoteデコレータ関数を使用すると、この機能はコードの関数を自動的に解釈し、SageMaker トレーニング ジョブとして実行します。

SageMaker ノートブックインスタンスからこの機能を使用することもできます。 最初にノートブック インスタンスを起動し、その上で Jupyter または Jupyter Lab を開き、ノートブックを起動する必要があります。 次に、前のコードに示すようにリモート関数をインポートし、コードを次のようにラップします。 @remote デコレータ。 この投稿の後半で、デコレータ機能と関連する設定の使用方法の例を示します。

ローカル環境から SDK を使用する

この機能は、ローカル IDE からも使用できます。 前提条件として、 AWSコマンドラインインターフェイス (AWS CLI)、SageMaker Python SDK、および AWS SDK for Python(Boto3) ローカル環境にインストールされます。 これらのライブラリをコードにインポートし、SageMaker セッションを設定し、設定を指定し、関数を @remote デコレータ。 次のコード例では、単純な除算関数を SageMaker Training ジョブとして実行します。

import boto3

import sagemaker

from sagemaker.remote_function import remote sm_session = sagemaker.Session(boto_session=boto3.session.Session(region_name="us-west-2"))

settings = dict(

sagemaker_session=sm_session,

role=<IAM_ROLE_NAME>

instance_type="ml.m5.xlarge",

)

@remote(**settings)

def divide(x, y):

return x / y

if __name__ == "__main__":

print(divide(2, 3.0))次のセクションで示すように、同様の方法を使用して高度な機能をトレーニング ジョブとして実行できます。

SageMaker ジョブとして Python 関数を起動する

新しい SageMaker Python SDK 機能により、Python 関数を次のように実行できます。 SageMaker トレーニング ジョブ. Python コード、データ サイエンティストが好みのローカル IDE (PyCharm、VS Code)、SageMaker ノートブック、または Studio ノートブックを使用して開発した ML トレーニング コードは、マネージド SageMaker ジョブとして起動できます。

この機能を使用する ML ワークロードでは、関連するデータセット、依存関係、およびワークスペース環境のセットアップが ML コードを使用してシリアル化され、SageMaker ジョブとして同期的および非同期的に実行されます。

URLに @remote ローカル ML 処理またはトレーニング関数を含む任意の Python コードへのデコレータ アノテーションを追加して、管理された SageMaker Training ジョブとして起動し、SageMaker のスケール、パフォーマンス、およびコスト上の利点を活用します。 これは、Python 関数コードにデコレータを追加することで、最小限のコード変更で実現できます。 装飾された関数への呼び出しは同期的に実行され、関数の実行は SageMaker ジョブが完了するまで待機します。

次の例では、 @remote ml.m5.large インスタンスを使用して、decorator モードで SageMaker ジョブを起動するための decorator。 SageMaker はトレーニングジョブを使用して、この機能をマネージドジョブとして起動します。

from sagemaker.remote_function import remote

from numpy as np @remote(instance_type="ml.m5.large")

def matrix_multiply(a, b): return np.matmul(a, b) a = np.array([[1, 0], [0, 1]])

b = np.array([1, 2]) assert matrix_multiply(a, b) == np.array([1,2])デコレーターモードを使用して、SageMaker ジョブ、Python パッケージ、および依存関係を起動することもできます。 VPC、サブネット、セキュリティ グループなどの環境変数を含めて、SageMaker トレーニング ジョブを environment.yml ファイル。 これにより、ML エンジニアと管理者はこれらの環境変数を構成できるため、データ サイエンティストは ML モデルの構築と反復処理に集中できます。 次のコードを参照してください。

from sagemaker.remote_function import remote @remote(instance_type="ml.g4dn.xlarge",dependencies = "./environment.yml")

def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

... <TRUCNATED>

return os.path.join(s3_output_path, model_dir), eval_resultあなたが使用することができます RemoteExecutor Python 関数を SageMaker ジョブとして非同期的に起動します。 エグゼキューターは、SageMaker Training ジョブを非同期的にポーリングして、ジョブのステータスを更新します。 の RemoteExecutor クラスはの実装です 同時実行.先物.実行者、SageMaker Training ジョブを非同期的に送信するために使用されます。 次のコードを参照してください。

from sagemaker.remote_function import RemoteExecutor def train_hf_model(

train_input_path,test_input_path,s3_output_path = None,

*,epochs = 1, train_batch_size = 32, eval_batch_size = 64,

warmup_steps = 500,learning_rate = 5e-5

):

model_name = "distilbert-base-uncased"

model = AutoModelForSequenceClassification.from_pretrained(model_name)

...<TRUNCATED>

return os.path.join(s3_output_path, model_dir), eval_result with RemoteExecutor(instance_type="ml.g4dn.xlarge", dependencies = './requirements.txt') as e:

future = e.submit(train_hf_model, train_input_path,test_input_path,s3_output_path,

epochs, train_batch_size, eval_batch_size,warmup_steps,learning_rate)ランタイム環境をカスタマイズする

デコレータモードと RemoteExecutor SageMaker ジョブのランタイム環境を定義およびカスタマイズできます。 Python パッケージや SageMaker ジョブの環境変数など、ランタイムの依存関係を指定して、ランタイムをカスタマイズできます。 ローカルの Python コードを SageMaker が管理するジョブとして実行するには、Python パッケージと依存関係を SageMaker で利用できるようにする必要があります。 ML エンジニアまたはデータ サイエンス管理者は、SageMaker ジョブの VPC、サブネット、セキュリティ グループなどのネットワークおよびセキュリティ構成を構成できるため、データ サイエンティストは、SageMaker ジョブの起動中にこれらの一元管理された構成を使用できます。 次のいずれかを使用できます requirements.txt ファイルまたは Conda environment.yaml ファイルにソフトウェアを指定する必要があります。

依存関係が定義されている場合 requirements.txt、パッケージはジョブ ランタイムで pip を使用してインストールされます。 ジョブの実行に使用されるイメージに Conda 環境が付属している場合、パッケージは、ジョブに使用するように宣言された Conda 環境にインストールされます。 次のコードは例を示しています requirements.txt ファイル:

datasets

transformers

torch

scikit-learn

s3fs==0.4.2

sagemaker>=2.148.0あなたはあなたを渡すことができます Conda environment.yaml ファイルを使用して、トレーニング ジョブ中にコードを実行する Conda 環境を作成します。 ジョブの実行に使用されるイメージで、コードを実行する Conda 環境が宣言されている場合、指定された仕様で宣言された Conda 環境を更新します。 次のコードは、 Conda environment.yaml ファイル:

name: sagemaker_example

channels: - conda-forge

dependencies: - python=3.10 - pandas - pip: - sagemakerまたは、次のように設定することもできます dependencies=”auto_capture” SageMaker Python SDK がアクティブな Conda 環境にインストールされている依存関係をキャプチャできるようにします。 アクティブな Conda 環境が必要です。 auto_capture 仕事に。 には前提条件があることに注意してください。 auto_capture 働く; 依存関係を として渡すことをお勧めします。 requirement.txt or Conda environment.yml 前のセクションで説明したファイル。

詳細については、 ローカルコードを SageMaker Training ジョブとして実行する.

SageMaker ジョブの設定

インフラストラクチャ関連の設定は、管理者ユーザーがセットアップを支援できる構成ファイルにオフロードできます。 一度だけ設定する必要があります。 インフラストラクチャ設定は、ネットワーク構成、IAM ロール、 Amazon シンプル ストレージ サービス 入力、出力データ、およびタグ用の (Amazon S3) フォルダー。 参照する SageMaker Python SDK でのデフォルトの構成と使用 のガイドをご参照ください。

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

Dependencies: path/to/requirements.txt

EnvironmentVariables: {"EnvVarKey": "EnvVarValue"}

ImageUri: 366666666666.dkr.ecr.us-west-2.amazonaws.com/my-image:latest

InstanceType: ml.m5.large

RoleArn: arn:aws:iam::366666666666:role/MyRole

S3KmsKeyId: somekmskeyid

S3RootUri: s3://my-bucket/my-project

SecurityGroupIds:

- sg123

Subnets:

- subnet-1234

Tags:

- {"Key": "someTagKey", "Value": "someTagValue"}

VolumeKmsKeyId: somekmskeyid製品の導入

PyTorch や TensorFlow などのディープ ラーニング モデルも、ノートブック内でトレーニング ジョブとしてコードを実行することにより、Studio 内で実行できます。 Studio でこの機能を紹介するには、このリポジトリを Studio に複製し、次の場所にあるノートブックを実行します。 GitHubの リポジトリ。

この例は、エンド ツー エンドのバイナリ テキスト分類のユース ケースを示しています。 Hugging Face トランスフォーマーとデータセット ライブラリを使用して、バイナリ テキスト分類の事前トレーニング済みトランスフォーマーを微調整します。 特に、事前トレーニング済みのモデルは、 IMDb データセット.

リポジトリを複製するときは、次のファイルを見つける必要があります。

- config.yaml – インフラストラクチャ関連の設定をコード ベースから分離するために、ほとんどのデコレータ引数を構成ファイルにオフロードできます

- ハグフェイス.ipynb – これには、IMDB データセットを使用して微調整される事前トレーニング済みの HuggingFace モデルをトレーニングするためのコードが含まれています

- Requirements.txt – このファイルには、コードを実行し、トレーニング ジョブとして GPU インスタンスでトレーニングをリモートで実行するために、このノートブックで使用される関数を実行するためのすべての依存関係が含まれています。

ノートブックを開くと、ノートブック環境をセットアップするように求められます。 ノートブック コードを実行するための高速起動インスタンス タイプとして、Python 3.0 カーネルと ml.m3.large を含む Data Science 5 イメージを選択できます。 このインスタンス タイプは、環境の起動が大幅に高速です。

トレーニング ジョブは、ml.g4dn.xlarge インスタンスで実行されます。 config.yaml ファイル:

SchemaVersion: '1.0'

SageMaker:

PythonSDK:

Modules:

RemoteFunction:

# role arn is not required if in SageMaker Notebook instance or SageMaker Studio

# Uncomment the following line and replace with the right execution role if in a local IDE

# RoleArn: <IAM_ROLE_ARN>

InstanceType: ml.g4dn.xlarge

Dependencies: ./requirements.txt requirements.txt Hugging Face モデルをトレーニングするための関数を実行するためのファイルの依存関係には、次のものがあります。

datasets

transformers

torch

scikit-learn

# lock s3fs to this specific version as more recent ones introduce dependency on aiobotocore, which is not compatible with botocore

s3fs==0.4.2

sagemaker>=2.148.0,<3Hugging Face ノートブックは、トレーニングをリモートで実行する方法を示しています。 @remote 同期的に実行される関数。 したがって、モデルをトレーニングするために実行される関数は、SageMaker Training ジョブが完了するまで待機します。 トレーニングは、インスタンス タイプが前述の構成ファイルで定義されている GPU インスタンスを使用してリモートで実行されます。

トレーニング ジョブを実行した後、ノートブックの残りのセルを実行して、評価指標を調べ、トレーニング済みモデルのテキストを分類できます。

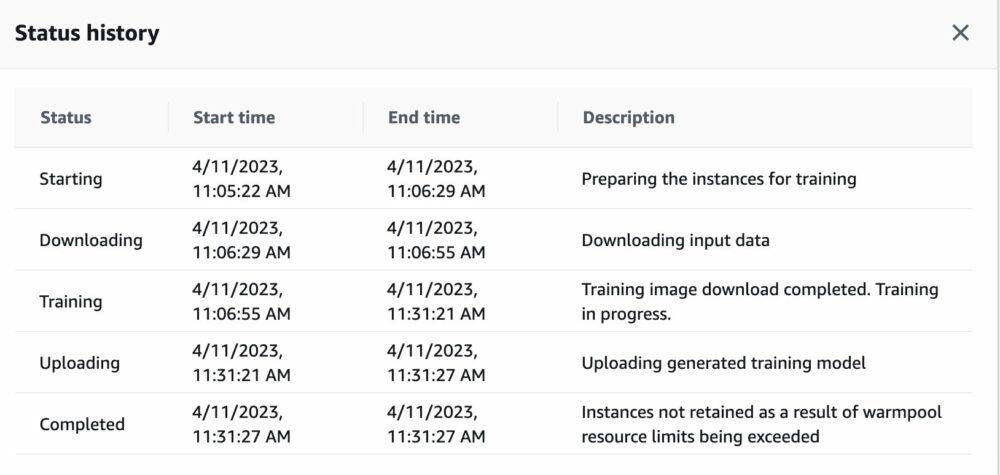

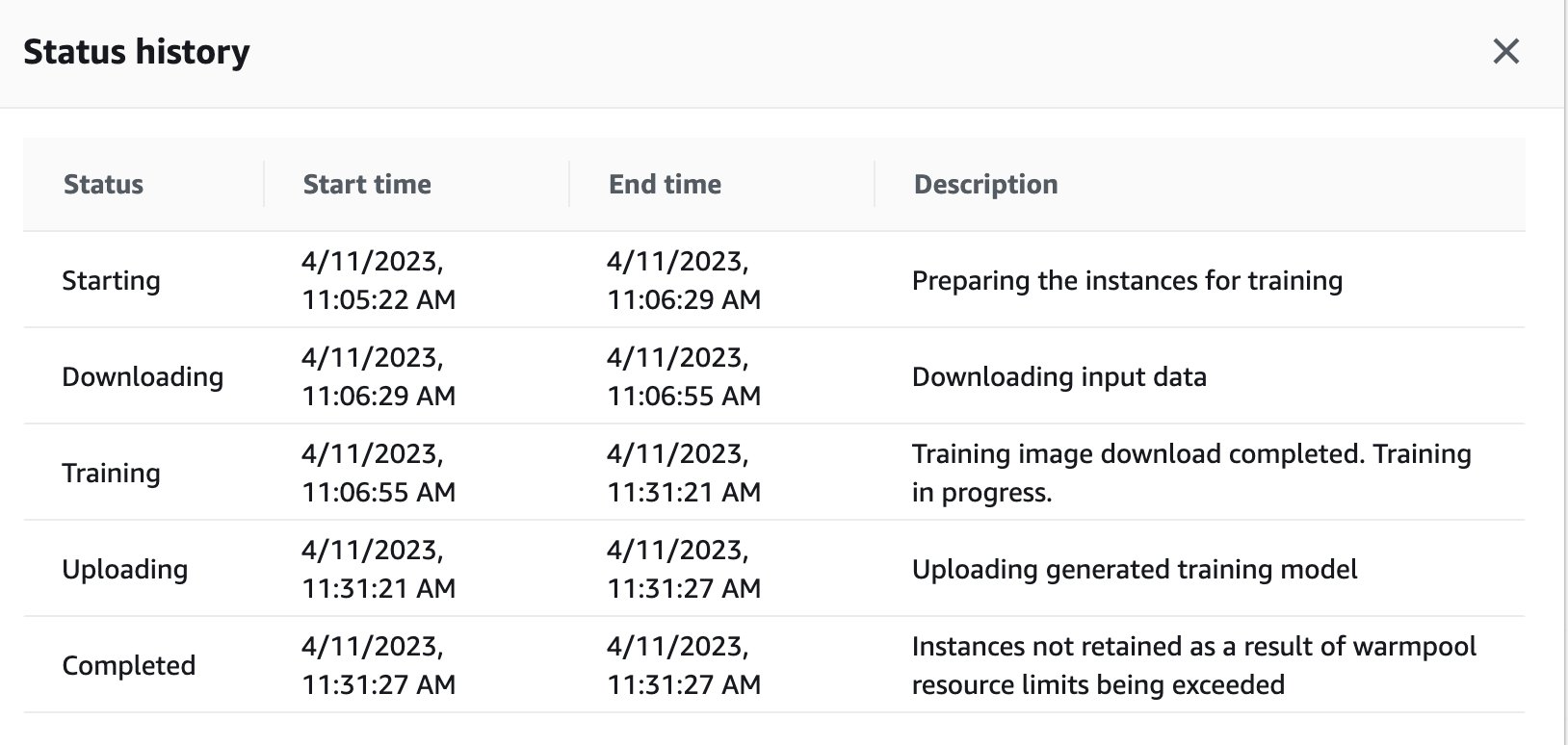

SageMaker コンソールに戻ることで、SageMaker ダッシュボードの GPU インスタンスでリモートでトリガーされたトレーニングジョブのステータスを表示することもできます。

トレーニング ジョブが完了するとすぐに、評価と分類のためにノートブックの命令が実行され続けます。 同様のジョブは、Studio ノートブックに組み込まれたリモート エグゼキューター機能を介してトレーニングおよび実行し、実行を非同期で実行できます。

@remote 関数内の SageMaker 実験との統合

実験名、実行名、およびその他のパラメータをリモート関数に渡して、SageMaker 実験の実行を作成できます。 次のコード例では、実験名、実行の名前、実行ごとにログに記録するパラメーターをインポートします。

from sagemaker.remote_function import remote

from sagemaker.experiments.run import Run

# Define your remote function

@remote

def train(value_1, value_2, exp_name, run_name):

...

...

#Creates the experiment

with Run( experiment_name=exp_name, run_name=run_name, sagemaker_session=sagemaker_session

) as run:

...

...

#Define values for the parameters to log

run.log_parameter("param_1", value_1)

run.log_parameter("param_2", value_2)

...

...

#Define metrics to log

run.log_metric("metric_a", 0.5)

run.log_metric("metric_b", 0.1) # Invoke your remote function

train(1.0, 2.0, "my-exp-name", "my-run-name") 前の例では、パラメータ p1 および p2 トレーニング ループ内で経時的にログに記録されます。 一般的なパラメータには、バッチ サイズまたはエポックが含まれる場合があります。 この例では、メトリクス A および B トレーニング ループ内で時間の経過とともにログに記録されます。 一般的な指標には、精度または損失が含まれる場合があります。 詳細については、次を参照してください。 Amazon SageMaker 実験を作成する.

まとめ

この投稿では、データ サイエンティストが SageMaker トレーニング ジョブとして好みの IDE で ML コードを実行できるようにする新しい SageMaker Python SDK 機能を紹介しました。 この機能を使用するために必要な前提条件とその機能について説明しました。 また、Studio、SageMaker ノートブック インスタンス、およびローカル IDE でこの機能を使用する方法も示しました。 さらに、この機能の使用方法を示すサンプル コード例を提供しました。 次のステップとして、次の手順に従って、IDE または SageMaker でこの機能を試すことをお勧めします。 コード例 この投稿で参照されています。

著者について

ディパンカー・パトロ AWS SageMaker のソフトウェア開発エンジニアであり、顧客が AI/ML ソリューションを大規模に採用できるように MLOps ソリューションを革新および構築しています。 彼はコンピューター サイエンスの修士号を取得しており、関心のある分野はコンピューター セキュリティ、分散システム、AI/ML です。

ディパンカー・パトロ AWS SageMaker のソフトウェア開発エンジニアであり、顧客が AI/ML ソリューションを大規模に採用できるように MLOps ソリューションを革新および構築しています。 彼はコンピューター サイエンスの修士号を取得しており、関心のある分野はコンピューター セキュリティ、分散システム、AI/ML です。

ファルーク・サビール AWS のシニア人工知能および機械学習スペシャリスト ソリューション アーキテクトです。 テキサス大学オースティン校で電気工学の博士号と修士号を取得し、ジョージア工科大学でコンピューター サイエンスの修士号を取得しています。 彼は15年以上の実務経験があり、大学生を教えたり指導したりすることも好きです. AWS では、データ サイエンス、機械学習、コンピューター ビジョン、人工知能、数値最適化、および関連分野におけるビジネス上の問題を顧客が定式化して解決するのを支援しています。 テキサス州ダラスを拠点とする彼と彼の家族は、旅行が大好きで、長いドライブ旅行に出かけます。

ファルーク・サビール AWS のシニア人工知能および機械学習スペシャリスト ソリューション アーキテクトです。 テキサス大学オースティン校で電気工学の博士号と修士号を取得し、ジョージア工科大学でコンピューター サイエンスの修士号を取得しています。 彼は15年以上の実務経験があり、大学生を教えたり指導したりすることも好きです. AWS では、データ サイエンス、機械学習、コンピューター ビジョン、人工知能、数値最適化、および関連分野におけるビジネス上の問題を顧客が定式化して解決するのを支援しています。 テキサス州ダラスを拠点とする彼と彼の家族は、旅行が大好きで、長いドライブ旅行に出かけます。

マノジ・ラヴィ Amazon SageMaker のシニアプロダクトマネージャーです。 彼は次世代の AI 製品の構築に情熱を傾けており、顧客が大規模な機械学習をより簡単に行えるようにするためのソフトウェアとツールに取り組んでいます。 ハース ビジネス スクールで MBA を取得し、カーネギー メロン大学で情報システム管理の修士号を取得しています。 余暇には、テニスをしたり、風景写真を撮ったりしています。

マノジ・ラヴィ Amazon SageMaker のシニアプロダクトマネージャーです。 彼は次世代の AI 製品の構築に情熱を傾けており、顧客が大規模な機械学習をより簡単に行えるようにするためのソフトウェアとツールに取り組んでいます。 ハース ビジネス スクールで MBA を取得し、カーネギー メロン大学で情報システム管理の修士号を取得しています。 余暇には、テニスをしたり、風景写真を撮ったりしています。

シカール・クワトラ アマゾン ウェブ サービスの AI/ML スペシャリスト ソリューション アーキテクトであり、大手グローバル システム インテグレーターと協力しています。 彼は、AI/ML および IoT ドメインで 500 件を超える特許を取得し、最年少のインドのマスター発明家の XNUMX 人の称号を獲得しています。 Shikhar は、組織の費用対効果が高くスケーラブルなクラウド環境の設計、構築、および維持を支援し、AWS で戦略的な業界ソリューションを構築する GSI パートナーをサポートします。 Shikhar は余暇にギターを弾いたり、作曲したり、マインドフルネスを実践したりすることを楽しんでいます。

シカール・クワトラ アマゾン ウェブ サービスの AI/ML スペシャリスト ソリューション アーキテクトであり、大手グローバル システム インテグレーターと協力しています。 彼は、AI/ML および IoT ドメインで 500 件を超える特許を取得し、最年少のインドのマスター発明家の XNUMX 人の称号を獲得しています。 Shikhar は、組織の費用対効果が高くスケーラブルなクラウド環境の設計、構築、および維持を支援し、AWS で戦略的な業界ソリューションを構築する GSI パートナーをサポートします。 Shikhar は余暇にギターを弾いたり、作曲したり、マインドフルネスを実践したりすることを楽しんでいます。

ヴィクラムエランゴ 米国バージニア州を拠点とする AWS のシニア AI/ML スペシャリスト ソリューション アーキテクトです。 彼は現在、ジェネレーティブ AI、LLM、迅速なエンジニアリング、大規模モデル推論の最適化、および企業全体での ML のスケーリングに焦点を当てています。 Vikram は、機械学習アプリケーションを大規模に構築および展開するための設計およびソート リーダーシップを提供して、金融および保険業界のお客様を支援します。 余暇には、旅行、ハイキング、料理、キャンプを楽しんでいます。

ヴィクラムエランゴ 米国バージニア州を拠点とする AWS のシニア AI/ML スペシャリスト ソリューション アーキテクトです。 彼は現在、ジェネレーティブ AI、LLM、迅速なエンジニアリング、大規模モデル推論の最適化、および企業全体での ML のスケーリングに焦点を当てています。 Vikram は、機械学習アプリケーションを大規模に構築および展開するための設計およびソート リーダーシップを提供して、金融および保険業界のお客様を支援します。 余暇には、旅行、ハイキング、料理、キャンプを楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- プラトアイストリーム。 Web3 データ インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- 未来を鋳造する w エイドリエン・アシュリー。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/run-your-local-machine-learning-code-as-amazon-sagemaker-training-jobs-with-minimal-code-changes/

- :持っている

- :は

- :not

- $UP

- 1

- 10

- 100

- 15年

- 500

- 7

- a

- 能力

- できる

- 私たちについて

- アクセス

- 精度

- 達成

- 越えて

- アクティブ

- 使徒行伝

- 加えます

- 追加

- 添加

- 管理人

- 管理者

- 採用

- 高度な

- 利点

- AI

- AI / ML

- エイズ

- すべて

- ことができます

- 沿って

- また

- Amazon

- アマゾンセージメーカー

- Amazon Webサービス

- an

- 分析します

- および

- 発表の

- どれか

- です

- エリア

- 引数

- 人工の

- 人工知能

- 人工知能と機械学習

- AS

- 関連する

- At

- オースティン

- 自動的に

- 利用できます

- AWS

- バック

- ベース

- ベース

- BE

- 利点

- 予算

- ビルド

- 建物

- ビジネス

- by

- 缶

- 機能

- キャプチャー

- カーネギーメロン

- キャリー

- 場合

- 細胞

- 変化する

- 変更

- チャンネル

- 選択

- class

- 分類

- 分類します

- クラウド

- コード

- コードベース

- カレッジ

- comes

- コマンドと

- 互換性のあります

- コンプリート

- 計算

- コンピュータ

- コンピュータサイエンス

- コンピュータセキュリティ

- Computer Vision

- コンセプト

- 領事

- 含む

- コンテナ

- 含まれています

- 文脈

- 続ける

- 基本

- 費用

- 可能性

- カバー

- 作ります

- 現在

- Customers

- カスタマイズ

- ダラス

- ダッシュボード

- データ

- データ処理

- データサイエンス

- データセット

- 宣言してい

- デフォルト

- デフォルト

- 定義済みの

- 実証します

- 実証

- 依存関係

- 展開します

- 記載された

- 設計

- 細部

- 発展した

- Developer

- 開発

- 異なります

- 議論する

- 配布

- 分散システム

- 分散トレーニング

- ドメイン

- 行われ

- ドント

- 間に

- e

- 各

- 獲得

- 使いやすさ

- 容易

- 簡単に

- どちら

- 埋め込まれた

- 可能

- 暗号化

- 端から端まで

- エンジニア

- エンジニアリング

- エンジニア

- 企業

- エントリ

- 環境

- 環境

- 時代

- エポック

- 評価

- あらゆる

- 例

- 例

- 実行

- 既存の

- 体験

- 実験

- 顔

- おなじみの

- 家族

- スピーディー

- 速いです

- 特徴

- 特徴

- 少数の

- File

- ファイナンシャル

- 名

- 柔軟性

- フォーカス

- 焦点を当て

- フォロー中

- フレームワーク

- から

- 完全に

- function

- 機能

- さらに

- 未来

- 先物

- 生々しい

- 生成AI

- 与えられた

- グローバル

- Go

- GPU

- グループの

- 持ってる

- he

- 助けます

- ことができます

- 彼の

- 保持している

- 認定条件

- How To

- HTML

- HTTP

- HTTPS

- 抱き合う顔

- アイデンティティ

- if

- 画像

- 実装

- import

- 輸入

- in

- include

- 含めて

- インディアン

- 産業を変えます

- 情報

- 情報機器

- インフラ関連事業

- 革新的

- インストール

- 機関

- 説明書

- 保険

- 統合された

- 統合する

- インテリジェンス

- 関心

- に

- 紹介する

- 導入

- 発明者

- IOT

- IT

- 繰り返し

- ITS

- ジョブ

- Jobs > Create New Job

- JPG

- ただ

- キー

- ラボ

- 風景

- ノートパソコン

- 大

- 大規模

- 最新の

- 起動する

- 打ち上げ

- 発射

- リーダーシップ

- 主要な

- LEARN

- 学習

- う

- ことができます

- ライブラリ

- 図書館

- wifecycwe

- ような

- 好き

- LINE

- ローカル

- 局部的に

- 位置して

- ログ

- ログインして

- 長い

- LOOKS

- 損失

- 愛

- 機械

- 機械学習

- 製

- 保守

- make

- 作る

- マネージド

- 管理

- マネージャー

- マスター

- 五月..

- メロン

- 方法論

- メトリック

- マインドフルネス

- 最小限の

- 分

- ML

- MLOps

- モード

- モデル

- モジュール

- 他には?

- 最も

- MS

- の試合に

- 音楽を聴く際のスピーカーとして

- 名

- すなわち

- ナビゲート

- 必要

- 必要とされる

- ネットワーク

- ネットワーキング

- 新作

- 次の

- ノード

- ノート

- 今

- numpy

- オブジェクト

- of

- on

- オンボード

- かつて

- ONE

- の

- 開いた

- オープンソース

- 最適化

- or

- 注文

- 組織

- OS

- その他

- 私たちの

- でる

- 出力

- が

- オーバーライド

- パッケージ

- パッケージ

- パンダ

- 並列シミュレーションの設定

- パラメータ

- 特定の

- パートナー

- パス

- パス

- 通過

- 情熱的な

- 特許

- path

- パフォーマンス

- 写真撮影

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 再生

- ポイント

- ポスト

- 優先

- 前提条件

- 前

- 問題

- 問題

- 処理

- プロダクト

- プロダクトマネージャー

- 生産性の高い

- 製品

- 提供

- Python

- パイトーチ

- 準備

- 最近

- 最近

- 推奨する

- 関連する

- リリース

- リモート

- replace

- 倉庫

- の提出が必要です

- 要件

- REST

- return

- ロード

- 職種

- 役割

- ラン

- ランニング

- セージメーカー

- ド電源のデ

- 規模

- スケーリング

- 学校

- 科学

- 科学者たち

- scikit-学ぶ

- SDDK

- シームレス

- セクション

- セクション

- セキュリティ

- シニア

- 別

- サービス

- セッション

- セッションに

- 設定

- 設定

- いくつかの

- すべき

- 表示する

- ショーケース

- 示す

- 作品

- 著しく

- 同様の

- 簡単な拡張で

- 単に

- サイズ

- 小さい

- Snapshot

- So

- ソフトウェア

- ソフトウェア開発

- ソリューション

- 解決する

- 専門家

- 特定の

- 仕様

- 指定の

- start

- 起動

- Status:

- 手順

- ストレージ利用料

- 戦略的

- 生徒

- 研究

- 提出する

- サブネット

- そのような

- サポート

- サポート

- システム

- 取る

- 取り

- 取得

- タスク

- チーム

- テクノロジー

- テンソルフロー

- テキサス州

- テキスト分類

- それ

- アプリ環境に合わせて

- それら

- その後

- そこ。

- それによって

- したがって、

- ボーマン

- 彼ら

- この

- 考え

- 思考リーダーシップ

- 介して

- 時間

- 役職

- 〜へ

- 豊富なツール群

- トーチ

- に向かって

- トレーニング

- 訓練された

- トレーニング

- トランスフォーマー

- 旅行

- 旅行

- トリガ

- type

- 一般的に

- 下

- わかる

- 大学

- アップデイト

- us

- つかいます

- 使用事例

- 中古

- users

- 値

- 価値観

- バージョン

- 、

- 詳しく見る

- バージニア州

- ビジョン

- vs

- vsコード

- wait

- 欲しいです

- we

- ウェブ

- Webサービス

- いつ

- which

- while

- 意志

- 以内

- 仕事

- ワーキング

- 作品

- でしょう

- ラップ

- 包まれました

- 書きます

- コードを書く

- 書かれた

- X

- 年

- You

- 最年少

- あなたの

- ゼファーネット