このブログ投稿は、deepset の Tuana Çelik との共同執筆です。

エンタープライズ検索は、文書のデジタル化とナレッジ管理を通じて組織の効率性を高める重要な要素です。 エンタープライズ検索では、デジタル ファイルなどのドキュメントの保存、検索用のドキュメントのインデックス作成、およびユーザー クエリに基づいた関連結果の提供がカバーされます。 大規模言語モデル (LLM) の出現により、結果をユーザーに提供する際の会話エクスペリエンスを実装できるようになりました。 ただし、LLM が企業データへの応答を制限し、それによってモデルの幻覚を軽減するようにする必要があります。

この投稿では、Haystack パイプラインと Falcon-40b-instruct モデルを使用して、検索拡張生成 (RAG) を備えたエンタープライズ検索用のエンドツーエンドの生成 AI アプリケーションを構築する方法を紹介します。 Amazon SageMaker ジャンプスタート および AmazonOpenSearchサービス。 この投稿で紹介されているサンプルのソース コードは、次の場所にあります。 GitHubリポジトリ

ソリューションの概要

生成 AI アプリケーションの応答を企業データのみに制限するには、検索拡張生成 (RAG) と呼ばれる手法を使用する必要があります。 RAG アプローチを使用するアプリケーションは、エンタープライズ ナレッジ ベースまたはコンテンツからユーザーのリクエストに最も関連する情報を取得し、それをプロンプトとしてのユーザーのリクエストとともにコンテキストとしてバンドルし、LLM に送信して応答を取得します。 LLM には入力プロンプトの最大単語数に関する制限があるため、企業内の数千または数百万の文書の中から適切な文章を選択することは、LLM の精度に直接影響します。

RAG 技術は、エンタープライズ検索においてますます重要になっています。 この投稿では、SageMaker JumpStart を利用して Falcon-40b-instruct モデルをデプロイし、Haystack を使用して検索拡張質問応答パイプラインを設計および実行するワークフローを示します。 最終的な取得拡張ワークフローには、次の高レベルの手順が含まれます。

- ユーザー クエリは、ベクトル検索を実行してデータベースから最も関連性の高いコンテキストを取得する取得コンポーネントに使用されます。

- このコンテキストは、提供されたコンテキストからのみ回答を生成するように LLM に指示するように設計されたプロンプトに埋め込まれます。

- LLM は、受信したプロンプトに埋め込まれたコンテキストのみを考慮して、元のクエリに対する応答を生成します。

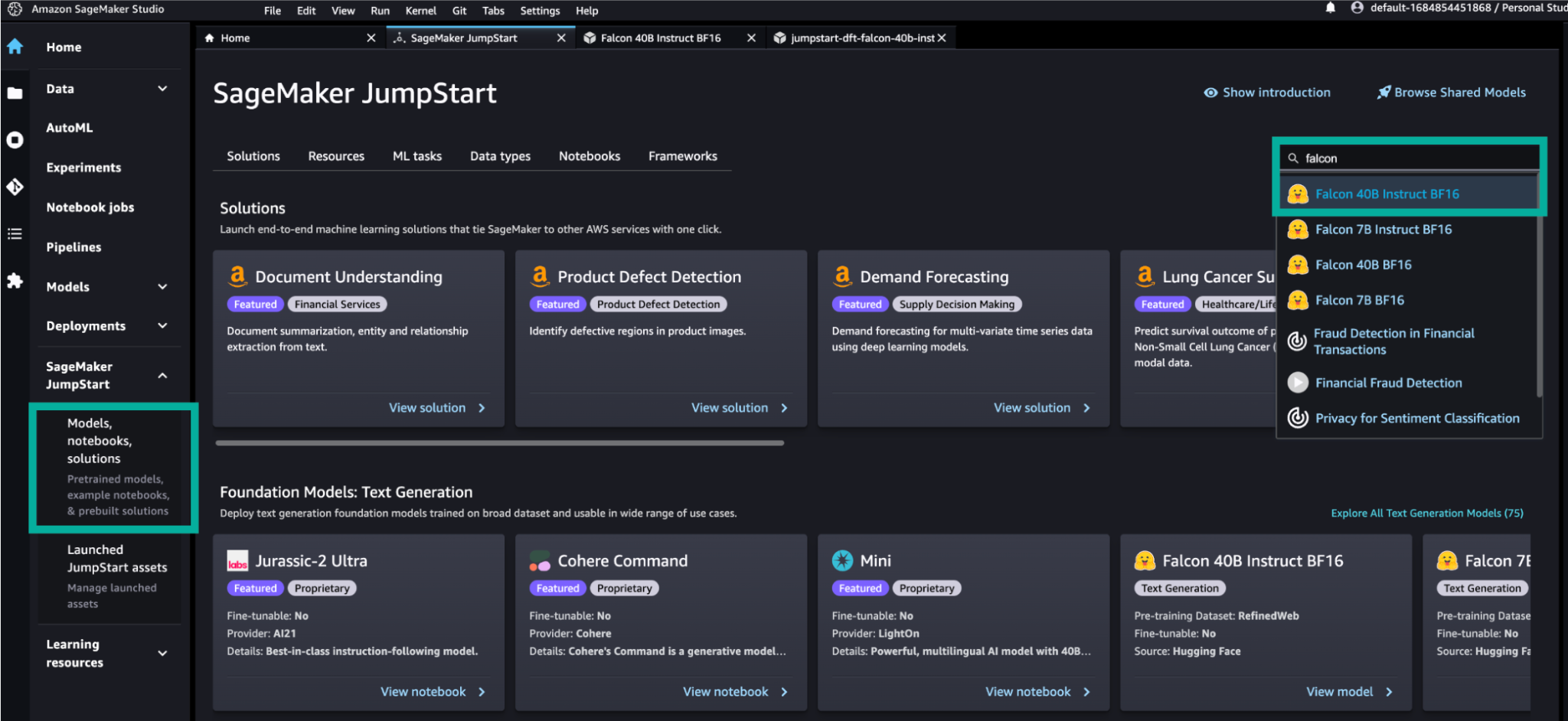

SageMaker ジャンプスタート

SageMaker JumpStart は、テキスト、ビジョン、オーディオ、埋め込みのユースケース向けの幅広い深層学習モデルをカプセル化するモデル ハブとして機能します。 500 を超えるモデルを備えたそのモデル ハブは、AI21、Stability AI、Cohere、LightOn などの AWS パートナーのパブリック モデルと独自モデルの両方で構成されています。 また、AlexaTM など、Amazon が独自に開発した基盤モデルもホストします。 一部のモデルは、独自のデータを使用してモデルを微調整する機能を提供します。 SageMaker JumpStart は、一般的なユースケース用のインフラストラクチャをセットアップするソリューション テンプレートと、SageMaker を使用した機械学習 (ML) 用の実行可能なサンプル ノートブックも提供します。

干し草の山

干し草の山 はディープセットによるオープンソース フレームワークで、開発者はこれを使用して、モデル、ベクトル DB、ファイル コンバータ、その他無数のモジュールなどのさまざまなコンポーネントで構成される LLM アプリケーションを調整できます。 ヘイスタックが提供する パイプライン および エージェント、検索、質問応答、会話型 AI など、さまざまなユースケース向けの LLM アプリケーションを設計するための XNUMX つの強力な構造。 最先端の取得方法と確かな評価基準に重点を置き、信頼性の高いアプリケーションを出荷するために必要なすべてを提供します。 パイプラインをシリアル化して、 YAMLファイル、経由して公開します REST APIワークロードに合わせて柔軟に拡張できるため、アプリケーションをプロトタイプ段階から運用環境に簡単に移行できます。

AmazonOpenSearch

OpenSearch Service は、AWS クラウドでの OpenSearch のデプロイ、拡張、運用を簡単にするフルマネージド サービスです。 OpenSearch は、Apache 2.0 ライセンスに基づいてライセンス供与されている、検索、分析、セキュリティ監視、および可観測性アプリケーションのための、スケーラブルで柔軟かつ拡張可能なオープンソース ソフトウェア スイートです。

近年、検索を強化するために ML 技術がますます普及しています。 その中には、 埋め込みモデル、大規模なデータ本体を n 次元空間にエンコードできるモデルのタイプで、各エンティティが XNUMX つの空間にエンコードされます。 ベクトル、その空間内のデータ ポイントであり、類似したエンティティが互いに近づくように編成されます。 ベクトル データベースは、k-NN インデックスのような特殊なインデックスを提供することにより、効率的なベクトル類似性検索を提供します。

OpenSearch Service のベクトル データベース機能を使用すると、セマンティック検索、LLM を使用した RAG、推奨エンジン、および検索リッチ メディアを実装できます。 この投稿では、RAG を使用して、通常、ベクトルでエンコードされたナレッジ記事を組み込んだベクトル データベースを使用して構築される外部ナレッジ ベースで生成 LLM を補完できるようにします。

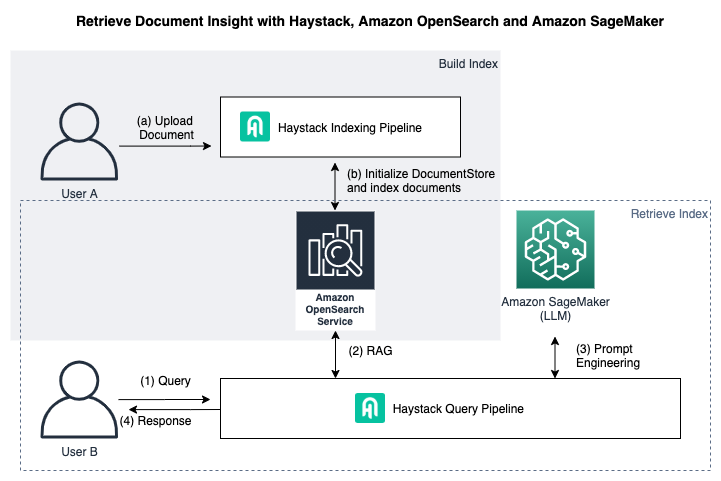

アプリケーションの概要

次の図は、最終的なアプリケーションの構造を示しています。

このアプリケーションでは、Haystack インデックス パイプラインを使用してアップロードされたドキュメントを管理し、ドキュメントにインデックスを付けます。また、Haystack クエリ パイプラインを使用してインデックス付きドキュメントからナレッジを取得します。

Haystack インデックス作成パイプラインには、次の高レベルの手順が含まれています。

- ドキュメントをアップロードします。

- 初期化します

DocumentStoreそして文書のインデックスを作成します。

私たちは OpenSearch を ドキュメントストア そして干し草の山 インデックス作成パイプライン ファイルを前処理して OpenSearch にインデックス付けします。 干し草の山 ファイルコンバータ および プリプロセッサ これにより、生ファイルをクリーンアップして、自然言語処理 (NLP) パイプラインと選択した言語モデルが処理できる形式と形式になるように準備できます。 ここで使用したインデックス作成パイプラインでも、 sentence-transformers/all-MiniLM-L12-v2 各ドキュメントの埋め込みを作成し、効率的な検索に使用します。

Haystack クエリ パイプラインには、次の高レベルの手順が含まれています。

- クエリを RAG パイプラインに送信します。

- An 埋め込みレトリバー コンポーネントは、最も関連性の高いものを取得するフィルターとして機能します。

top_kOpenSearch のインデックス付きドキュメントからのドキュメント。 これを実現するために、選択した埋め込みモデルを使用してクエリとドキュメントの両方を (インデックス作成時に) 埋め込みます。 - 取得されたドキュメントは、Falcon-40b-instruct モデルへのプロンプトに埋め込まれます。

- LLM は、取得したドキュメントに基づく応答を返します。

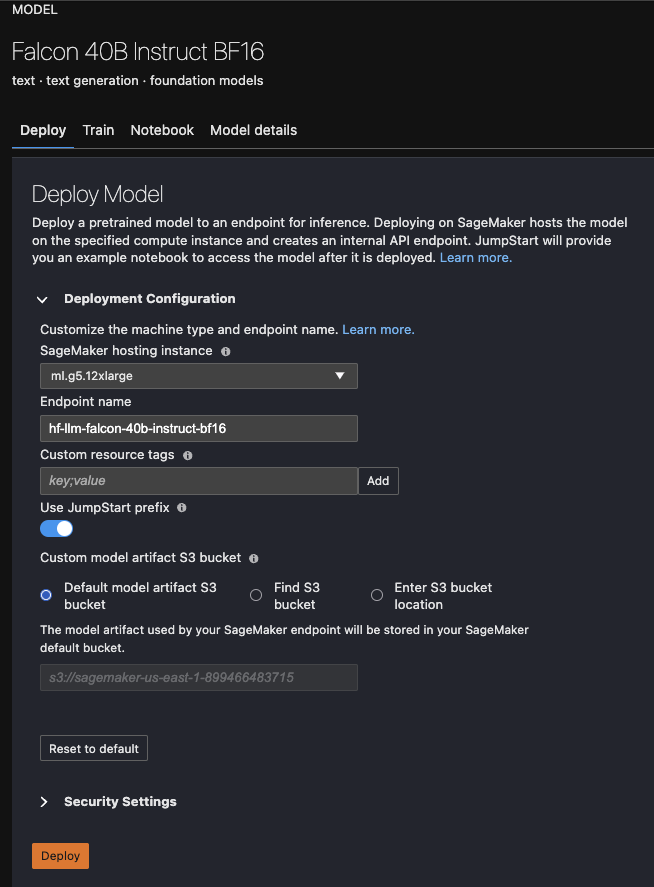

モデルのデプロイメントには、ボタンを押すだけでモデルのデプロイメントを簡素化する SageMaker JumpStart を使用します。 この例では Falcon-40b-instruct を使用してテストしましたが、SageMaker で利用可能な任意の Hugging Face モデルを使用することができます。

最終的な解決策は、 干し草の山-セージメーカー リポジトリを作成し、検索拡張質問応答を実行するためのサンプル データとして OpenSearch Web サイトとドキュメント (OpenSearch 2.7 用) を使用します。

前提条件

AWS のサービスを使用する前に最初に行うことは、AWS アカウントにサインアップして作成したことを確認することです。 次に、管理ユーザーとグループを作成する必要があります。 両方の手順の手順については、次を参照してください。 Amazon SageMaker の前提条件をセットアップする.

Haystack を使用できるようにするには、 farm-haystack 必要な依存関係を含むパッケージ。 これを実現するには、 requirements.txt 内のファイル GitHubリポジトリ 実行することにより pip install requirements.txt.

OpenSearch へのドキュメントのインデックス付け

Haystack は、データベースへのコネクタを多数提供しています。 DocumentStores。 この RAG ワークフローでは、 OpenSearchDocumentStore。 例 倉庫 インデックス作成パイプラインが含まれており、 AWS CloudFormation template を設定するには OpenSearchDocumentStore OpenSearch Web サイトおよびドキュメント ページからクロールされたドキュメントを使用します。

多くの場合、NLP アプリケーションを実稼働ユースケースで機能させるには、最終的にデータの準備とクリーニングについて考える必要があります。 これはで覆われています ヘイスタックのインデックス作成パイプラインを使用すると、独自のデータ準備手順を設計でき、最終的には選択したデータベースにドキュメントを書き込むことができます。

インデックス作成パイプラインには、ドキュメントの埋め込みを作成するステップが含まれる場合もあります。 これは取得ステップにとって非常に重要です。 この例では、次のように使用します。 センテンストランスフォーマー/all-MiniLM-L12-v2 埋め込みモデルとして。 このモデルは、すべてのインデックス付きドキュメントの埋め込みを作成するために使用されますが、クエリ時のユーザーのクエリにも使用されます。

ドキュメントにインデックスを付けるには、 OpenSearchDocumentStore、詳細な手順を含む XNUMX つのオプションが用意されています。 README サンプルリポジトリの。 ここでは、AWS にデプロイされた OpenSearch サービスにインデックスを作成する手順を説明します。

OpenSearch サービスを開始する

提供されているものを使用してください CloudFormationテンプレート AWS で OpenSearch サービスをセットアップします。 次のコマンドを実行すると、空の OpenSearch サービスが作成されます。 その後、提供されたサンプル データにインデックスを付けるか、独自のデータを使用するかを選択できます。このデータは、 ヘイスタックインデックス作成パイプライン。 これにより、インターネットに開かれたインスタンスが作成されるため、運用環境での使用はお勧めできません。

スタックの起動が完了するまでに約 30 分かかります。 AWS CloudFormation コンソールで進行状況を確認するには、 スタック ページで、という名前のスタックを探しています HaystackOpensearch.

ドキュメントを OpenSearch にインデックス付けする

OpenSearch サービスが実行されているので、OpenSearchDocumentStore クラスを使用してサービスに接続し、ドキュメントを書き込むことができます。

OpenSearch のホスト名を取得するには、次のコマンドを実行します。

まず、以下をエクスポートします。

次に、 opensearch_indexing_pipeline.py 提供されたデモ データを前処理してインデックスを作成するスクリプト。

独自のデータを使用したい場合は、インデックス作成パイプラインを変更します。 opensearch_indexing_pipeline.py 含める ファイルコンバーター および プリプロセッサ 必要なセットアップ手順を実行します。

検索拡張質問応答パイプラインを実装する

OpenSearch でデータのインデックスを作成したので、これらのドキュメントに対して質問応答を実行できます。 この RAG パイプラインでは、SageMaker JumpStart にデプロイした Falcon-40b-instruct モデルを使用します。

Jupyter ノートブックからプログラムでモデルをデプロイするオプションもあります。 手順については、を参照してください。 GitHubレポ.

- SageMaker JumpStart で Falcon-40b-instruct モデルを検索します。

- モデルを SageMaker JumpStart にデプロイし、エンドポイント名をメモします。

- 次の値をエクスポートします。

- ラン

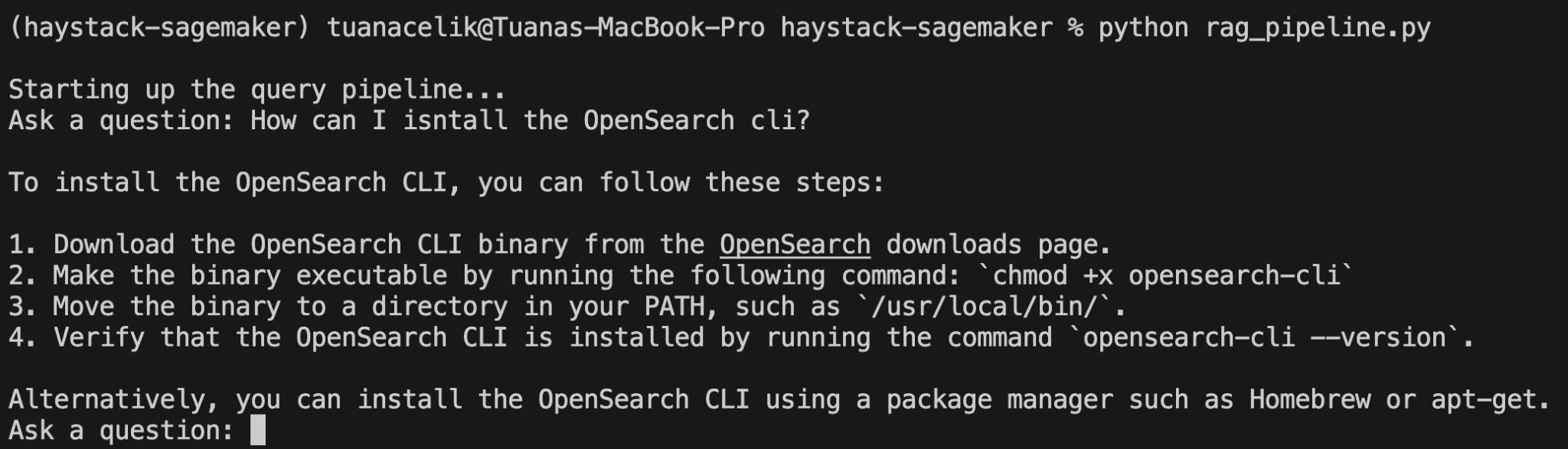

python rag_pipeline.py.

これにより、ユーザーの質問を待つコマンド ライン ユーティリティが起動します。 たとえば、「OpenSearch cli をインストールするにはどうすればよいですか?」と尋ねてみましょう。

この結果は、プロンプトを 干し草の山プロンプトテンプレート 次のようになります。

さらなるカスタマイズ

ソリューション内のさまざまな要素に対して、次のような追加のカスタマイズを行うことができます。

- データ – OpenSearch を提供しました ドキュメント および ウェブサイト データはサンプルデータです。 忘れずに変更してください

opensearch_indexing_pipeline.py独自のデータを使用することを選択した場合は、ニーズに合わせてスクリプトを作成します。 - モデル – この例では、Falcon-40b-instruct モデルを使用しました。 SageMaker 上で他のハグ顔モデルを自由にデプロイして使用できます。 モデルを変更するということは、プロンプトをそれが処理できるように設計されたものに適合させる必要があることを意味する可能性があることに注意してください。

- プロンプト – この投稿のために、私たちは独自のものを作成しました

PromptTemplateこれは、提供されたコンテキストに基づいて質問に答え、コンテキストに関連情報が含まれていない場合は「わかりません」と答えるようにモデルに指示します。 このプロンプトを変更して、Falcon-40b-instruct を使用して別のプロンプトを試すことができます。 また、プロンプトの一部を単に次から取得することもできます。 プロンプトハブ. - 埋め込みモデル – 取得ステップでは、軽量の埋め込みモデルを使用します。 センテンストランスフォーマー/all-MiniLM-L12-v2。 ただし、これを必要に応じて変更することもできます。 予想される埋め込みサイズを忘れずに変更してください。

DocumentStoreそれに応じて。 - 取得した文書の数 – 質問する書類の数を試してみることもできます。

EmbeddingRetrieverクエリごとに取得します。 私たちのセットアップでは、これは次のように設定されています トップ_k=5。 この数値を変更して実験して、より多くのコンテキストを提供することで結果の精度が向上するかどうかを確認してください。

実稼働の準備状況

この投稿で提案するソリューションにより、プロジェクト開発プロセスの価値実現までの時間を短縮できます。 AWS クラウド上のセキュリティとプライバシー環境を利用して、簡単に拡張できるプロジェクトを構築できます。

セキュリティとプライバシーのために、OpenSearch Service は次のようなデータ保護を提供します。 アイデンティティとアクセス管理 および クロスサービスの混乱したプロキシの防止。 ユーザーがアクセスを許可されたデータにのみアクセスできるように、きめ細かいユーザー アクセス制御を採用できます。 さらに、SageMaker は、構成可能なセキュリティ設定を提供します。 アクセス制御, データ保護, ロギングとモニタリング。 保存中および転送中のデータを保護するには、 AWSキー管理サービス (AWS KMS) キー。 また、次を使用して、SageMaker モデルのデプロイメントまたはエンドポイント アクセスのログを追跡することもできます。 アマゾンクラウドウォッチ。 詳細については、を参照してください。 Amazon CloudWatchでAmazon SageMakerを監視する.

OpenSearch サービスの高いスケーラビリティを実現するには、次のように調整できます。 OpenSearch Service ドメインのサイジング そして採用 運用上のベストプラクティス。 SageMaker エンドポイントの自動スケーリングを利用することもできます。 SageMaker モデルを自動的にスケールする トラフィックが増加したとき、またはリソースが使用されていないときの両方でエンドポイントを調整します。

クリーンアップ

コストを節約するには、この投稿の一部としてデプロイしたすべてのリソースを削除してください。 CloudFormation スタックを起動した場合は、AWS CloudFormation コンソールから削除できます。 同様に、SageMaker コンソール経由で作成した SageMaker エンドポイントを削除できます。

まとめ

この投稿では、Haystack パイプラインと、SageMaker JumpStart および OpenSearch Service の Falcon-40b-instruct モデルを使用して、RAG でエンタープライズ検索用のエンドツーエンドの生成 AI アプリケーションを構築する方法を紹介しました。 RAG アプローチは、生成された応答がドメイン内にあることが保証されるため、幻覚を軽減できるため、エンタープライズ検索では重要です。 Haystack パイプラインを使用することで、モデルやベクトル データベースなどのさまざまなコンポーネントで構成される LLM アプリケーションを調整できます。 SageMaker JumpStart は、LLM をデプロイするためのワンクリック ソリューションを提供し、インデックス付きデータのベクトル データベースとして OpenSearch Service を使用しました。 この投稿で概説した手順と、 GitHubリポジトリ.

著者について

トゥアナ・チェリク Deepset のリード デベロッパー アドボケートであり、Haystack のオープンソース コミュニティに重点を置いています。 彼女は開発者関係部門を率いており、NLP に関するイベントで定期的に講演し、コミュニティ向けの学習教材を作成しています。

トゥアナ・チェリク Deepset のリード デベロッパー アドボケートであり、Haystack のオープンソース コミュニティに重点を置いています。 彼女は開発者関係部門を率いており、NLP に関するイベントで定期的に講演し、コミュニティ向けの学習教材を作成しています。

ロイ・アレラ は、ドイツのミュンヘンを拠点とする AWS のシニア AI/ML スペシャリスト ソリューション アーキテクトです。 Roy は、小規模なスタートアップから大企業まで、AWS の顧客が AWS 上で大規模な言語モデルを効率的にトレーニングしてデプロイできるよう支援します。 Roy は、計算最適化問題と AI ワークロードのパフォーマンスの向上に情熱を注いでいます。

ロイ・アレラ は、ドイツのミュンヘンを拠点とする AWS のシニア AI/ML スペシャリスト ソリューション アーキテクトです。 Roy は、小規模なスタートアップから大企業まで、AWS の顧客が AWS 上で大規模な言語モデルを効率的にトレーニングしてデプロイできるよう支援します。 Roy は、計算最適化問題と AI ワークロードのパフォーマンスの向上に情熱を注いでいます。

ミア・チャン は、アマゾン ウェブ サービスの ML スペシャリスト ソリューション アーキテクトです。 彼女は EMEA の顧客と協力し、応用数学、コンピューター サイエンス、AI/ML のバックグラウンドを活かして、クラウド上で AI/ML ワークロードを実行するためのベスト プラクティスを共有しています。 彼女は NLP 固有のワークロードに焦点を当てており、カンファレンスの講演者および本の著者としての経験を共有しています。 自由時間には、ハイキング、ボードゲーム、コーヒー淹れを楽しんでいます。

ミア・チャン は、アマゾン ウェブ サービスの ML スペシャリスト ソリューション アーキテクトです。 彼女は EMEA の顧客と協力し、応用数学、コンピューター サイエンス、AI/ML のバックグラウンドを活かして、クラウド上で AI/ML ワークロードを実行するためのベスト プラクティスを共有しています。 彼女は NLP 固有のワークロードに焦点を当てており、カンファレンスの講演者および本の著者としての経験を共有しています。 自由時間には、ハイキング、ボードゲーム、コーヒー淹れを楽しんでいます。

イナーム・サイード AWS のスタートアップ ソリューション アーキテクトであり、B2B および SaaS スタートアップのスケーリングと成長の達成を支援することに重点を置いています。 彼はサーバーレス アーキテクチャと AI/ML に対して深い情熱を持っています。 余暇には、イナームは家族と充実した時間を過ごし、サイクリングとバドミントンに熱中しています。

イナーム・サイード AWS のスタートアップ ソリューション アーキテクトであり、B2B および SaaS スタートアップのスケーリングと成長の達成を支援することに重点を置いています。 彼はサーバーレス アーキテクチャと AI/ML に対して深い情熱を持っています。 余暇には、イナームは家族と充実した時間を過ごし、サイクリングとバドミントンに熱中しています。

デビッド・ティペット は、AWS でオープンソース OpenSearch に取り組んでいる上級開発者擁護者です。 彼の仕事には、検索や関連性から可観測性やセキュリティ分析に至るまで、OpenSearch のあらゆる領域が含まれます。

デビッド・ティペット は、AWS でオープンソース OpenSearch に取り組んでいる上級開発者擁護者です。 彼の仕事には、検索や関連性から可観測性やセキュリティ分析に至るまで、OpenSearch のあらゆる領域が含まれます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 自動車/EV、 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- チャートプライム。 ChartPrime でトレーディング ゲームをレベルアップしましょう。 こちらからアクセスしてください。

- ブロックオフセット。 環境オフセット所有権の近代化。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :持っている

- :は

- :not

- :どこ

- $UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- できる

- 私たちについて

- 加速する

- アクセス

- こちらからお申し込みください。

- それに応じて

- 精度

- 達成する

- 達成

- 達成する

- 使徒行伝

- 適応する

- NEW

- さらに

- 行政の

- 利点

- 出現

- 支持者

- AI

- AI / ML

- すべて

- 許す

- ことができます

- 沿って

- また

- しかし

- Amazon

- アマゾンセージメーカー

- Amazon SageMaker ジャンプスタート

- Amazon Webサービス

- 間で

- an

- 分析論

- および

- 回答

- どれか

- アパッチ

- 申し込み

- 適用された

- アプローチ

- 約

- です

- エリア

- 周りに

- 配列

- 宝品

- 物品

- AS

- 支援する

- At

- オーディオ

- 増強された

- 著者

- 許可

- オート

- 利用できます

- AWS

- AWS CloudFormation

- B2B

- 背景

- ベース

- ベース

- BE

- なぜなら

- になる

- さ

- 以下

- BEST

- ベストプラクティス

- ビッグ

- ブログ

- ボード

- ボードゲーム

- ボディ

- 本

- 両言語で

- 広い

- ビルド

- 建物

- 内蔵

- バンドル

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- (Comma Separated Values) ボタンをクリックして、各々のジョブ実行の詳細(開始/停止時間、変数値など)のCSVファイルをダウンロードします。

- by

- 呼ばれます

- 缶

- 機能

- 例

- 変化する

- 変化

- チェック

- 選択

- 選択する

- 選択する

- 選んだ

- class

- クリーニング

- クローザー

- クラウド

- コード

- コーヒー

- コマンドと

- コミュニティ

- 会社

- 補体

- コンプリート

- コンポーネント

- コンポーネント

- 含む

- コンピュータ

- コンピュータサイエンス

- コンセプト

- 講演

- 混乱

- お問合せ

- 考えると

- 領事

- 含まれている

- コンテンツ

- コンテキスト

- コントロール

- 会話

- 会話型AI

- コスト

- カバー

- カバー

- 作ります

- 作成した

- 作成します。

- 重大な

- Customers

- データ

- データの準備

- データ保護

- データベース

- データベースを追加しました

- DBS

- 取引

- 深いです

- 深い学習

- 定義済みの

- デモ

- 依存関係

- 展開します

- 展開

- 展開する

- 展開

- 設計

- 設計

- 設計

- 詳細な

- 発展した

- Developer

- 開発者

- 開発

- 異なります

- デジタル

- デジタル化

- 大きさ

- 直接

- do

- ドキュメント

- ドキュメント

- ドキュメント

- ありません

- そうではありません

- ドン

- ドント

- 各

- 簡単に

- 効率

- 効率的な

- 効率良く

- どちら

- 要素は

- 埋め込みます

- 埋め込まれた

- 埋め込み

- EMEA

- enable

- end

- 端から端まで

- エンドポイント

- エンジン

- 高めます

- 確保

- 確実に

- Enterprise

- エンティティ

- エンティティ

- 環境

- 評価

- イベント

- すべてのもの

- 例

- 予想される

- 体験

- エクスペリエンス

- 実験

- export

- 外部

- 顔

- 家族

- フィギュア

- File

- filter

- ファイナル

- 名

- フィット

- フレキシブル

- 柔軟に

- フォーカス

- 焦点を当てて

- フォロー中

- 形式でアーカイブしたプロジェクトを保存します.

- Foundation

- フレームワーク

- 無料版

- から

- 完全に

- function

- Games

- 生成する

- 生成された

- 生成

- 世代

- 生々しい

- 生成AI

- ドイツ

- 取得する

- 与えられた

- グループ

- 成長性

- ハンドル

- 持ってる

- 持って

- he

- ことができます

- 彼女の

- こちら

- ハイ

- ハイレベル

- 非常に

- 彼の

- ホスト

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- ハブ

- i

- アイデンティティ

- if

- 影響

- 実装する

- 重要

- 改善

- in

- include

- 含ま

- 含めて

- 増加した

- ますます

- index

- 索引付けされた

- インデックス

- 情報

- インフラ

- install

- 説明書

- インターネット

- に

- IT

- ITS

- JPG

- キー

- キー

- 知っている

- 知識

- データ管理

- 言語

- 大

- 起動する

- 打ち上げ

- つながる

- リード

- 学習

- ライセンス

- ライセンス供与

- 軽量

- ような

- 可能性が高い

- LIMIT

- 制限

- LINE

- LLM

- ログ

- ロギング

- 探して

- 愛

- 機械

- 機械学習

- 製

- make

- 作る

- 作成

- 管理します

- マネージド

- 管理

- 材料

- 数学

- 五月..

- 意味する

- メディア

- メソッド

- メトリック

- 何百万

- 分

- 緩和する

- ML

- モデル

- 修正する

- モジュール

- モーメント

- モニタリング

- 他には?

- 最も

- 名

- 名前付き

- ナチュラル

- 自然言語処理

- ナビゲート

- 必要

- ニーズ

- NLP

- ノート

- 数

- of

- 提供

- オファー

- on

- の

- 開いた

- オープンソース

- オープンソースソフトウェア

- 操作する

- 最適化

- オプション

- オプション

- or

- 組織の

- 整理

- オリジナル

- その他

- 私たちの

- 概説

- が

- 自分の

- パッケージ

- ページ

- ページ

- 部

- パートナー

- 情熱

- 情熱的な

- 実行する

- パフォーマンス

- パイプライン

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- プレイ

- お願いします

- ポイント

- 人気

- ポスト

- 強力な

- プラクティス

- 準備

- 準備

- プライバシー

- 問題

- プロセス

- 処理

- 生産

- 進捗

- プロジェクト

- 証拠

- 提案された

- 所有権

- 守る

- 保護

- プロトタイプ

- 提供します

- 提供

- は、大阪で

- 提供

- 代理

- 公共

- プッシュ

- 品質

- クエリ

- 質問

- 質問

- Raw

- 受け

- 最近

- おすすめ

- 推奨される

- 定期的に

- 関係

- 関連性

- 関連した

- 信頼性のある

- 覚えています

- 倉庫

- 要求

- 必要とする

- の提出が必要です

- 要件

- リソース

- 応答

- 回答

- REST

- 制限する

- 結果

- 結果

- 収益

- 富裕層

- 右

- ロイ

- ラン

- ランニング

- SaaSの

- セージメーカー

- Save

- 言う

- スケーラビリティ

- ド電源のデ

- 規模

- スケーリング

- 科学

- を検索

- セキュリティ

- 送信

- 送る

- シニア

- サーバレス

- 仕える

- サービス

- サービス

- セッションに

- 設定

- 形状

- 株式

- 彼女

- 船

- すべき

- 表示する

- ショーケース

- ショーケース

- 署名されました

- 同様の

- 同様に

- 簡単な拡張で

- 単に

- 小さい

- So

- ソフトウェア

- もっぱら

- 固体

- 溶液

- ソリューション

- 一部

- 何か

- ソース

- ソースコード

- スペース

- スピーカー

- スピークス

- 専門家

- 専門の

- 安定性

- スタック

- ステージ

- start

- スタートアップ

- スタートアップ

- 手順

- ステップ

- 保存

- 強い

- 構造

- そのような

- スイート

- 確か

- 取る

- 取り

- テクニック

- テンプレート

- テスト

- それ

- ソース

- それら

- その後

- それによって

- したがって、

- ボーマン

- 彼ら

- もの

- 考える

- この

- 数千

- 介して

- 時間

- 〜へ

- 一緒に

- 追跡する

- トラフィック

- トランジット

- 信頼できる

- 2

- type

- 一般的に

- 最終的に

- 下

- アップロード

- us

- つかいます

- 中古

- ユーザー

- users

- 使用されます

- ユーティリティ

- 値

- 価値観

- さまざまな

- 、

- ビジョン

- 待つ

- we

- ウェブ

- Webサービス

- ウェブサイト

- いつ

- which

- 意志

- 以内

- Word

- 仕事

- ワークフロー

- ワーキング

- 作品

- でしょう

- 書きます

- ヤムル

- 年

- You

- あなたの

- ゼファーネット