本日は、 ジェマ を使用している顧客がモデルを利用できるようになりました。 Amazon SageMaker ジャンプスタート。ジェマは家族です 言語モデル Google の Gemini モデルに基づいており、最大 6 兆のテキスト トークンでトレーニングされています。 Gemma ファミリは、7 億パラメータ モデルと 2 億パラメータ モデルの 2 つのサイズで構成されます。今後は、Gemma 7B および Gemma XNUMXB の事前トレーニングおよび命令調整されたモデルを内で使用できるようになりました。 SageMaker ジャンプスタート. JumpStart は SageMaker の機械学習 (ML) ハブであり、組み込みアルゴリズムとエンドツーエンドのソリューション テンプレートに加えて基盤モデルへのアクセスを提供し、ML をすばやく開始するのに役立ちます。

この投稿では、SageMaker JumpStart で Gemma モデルをデプロイし、ユースケースに合わせて微調整する方法を説明します。完全なノートブックは次のサイトから入手できます。 GitHubの.

ジェマモデル

ジェマ 軽量で最先端の製品群です モデル の作成に使用されたのと同じ研究とテクノロジーから構築されています。 双子座 モデル。 Gemma は、Google DeepMind と Google 全体の他のチームによって開発され、Gemini からインスピレーションを受けています。 Gemma は、テキスト領域における強力なジェネラリスト能力と、大規模な最先端の理解および推論スキルを示します。質問応答、常識的推論、数学と科学、コーディングなどのさまざまな領域にわたって、同様またはより大規模な他の公開モデルと比較して、より優れたパフォーマンスを実現します。 Gemma は、Gemma モデルを使用した開発者のイノベーションをサポートするために、モデルの重みをリリースしました。 Gemma は新しい機能とともに発売されました 責任ある生成 AI ツールキット Gemma を使用してより安全な AI アプリケーションを作成するためのガイダンスと重要なツールを提供します。

SageMaker の基盤モデル

JumpStart は、Hugging Face、PyTorch Hub、TensorFlow Hub などの一般的なモデル ハブからのさまざまなモデルへのアクセスを提供し、SageMaker の ML 開発ワークフロー内で使用できます。 ML の最近の進歩により、次のモデルとして知られる新しいクラスのモデルが生まれました。 基礎モデル、通常は数十億のパラメーターでトレーニングされており、テキストの要約、デジタル アートの生成、言語翻訳など、幅広いカテゴリのユース ケースに適応できます。 これらのモデルはトレーニングに費用がかかるため、顧客は、これらのモデルを自分でトレーニングするのではなく、既存の事前トレーニング済みの基盤モデルを使用し、必要に応じて微調整することを望んでいます。 SageMaker は、SageMaker コンソールで選択できる厳選されたモデルのリストを提供します。

JumpStart 内でさまざまなモデル プロバイダーの基礎モデルを検索できるようになり、基礎モデルをすぐに開始できるようになりました。さまざまなタスクまたはモデル プロバイダーに基づいて基礎モデルを検索し、モデルの特性と使用条件を確認できます。テスト UI ウィジェットを使用してこれらのモデルを試すこともできます。基礎モデルを大規模に使用したい場合は、モデルプロバイダーから事前に構築されたノートブックを使用することで、SageMaker を離れることなく使用できます。モデルは AWS でホストおよびデプロイされるため、モデルの評価に使用される場合でも、大規模な使用に使用される場合でも、データが第三者と共有されることはありません。

JumpStart で Llama Guard モデルを使用する方法を見てみましょう。

Jumpstart で Gemma モデルを探索する

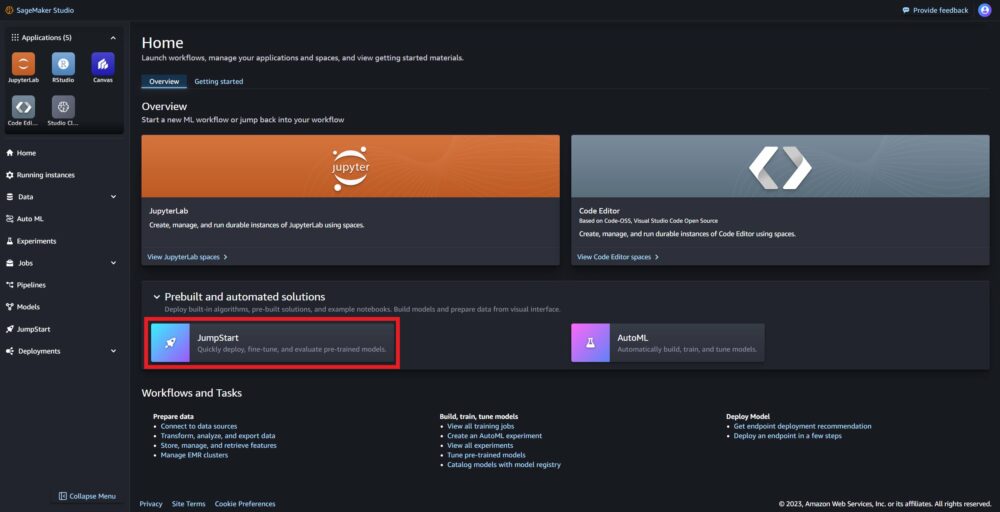

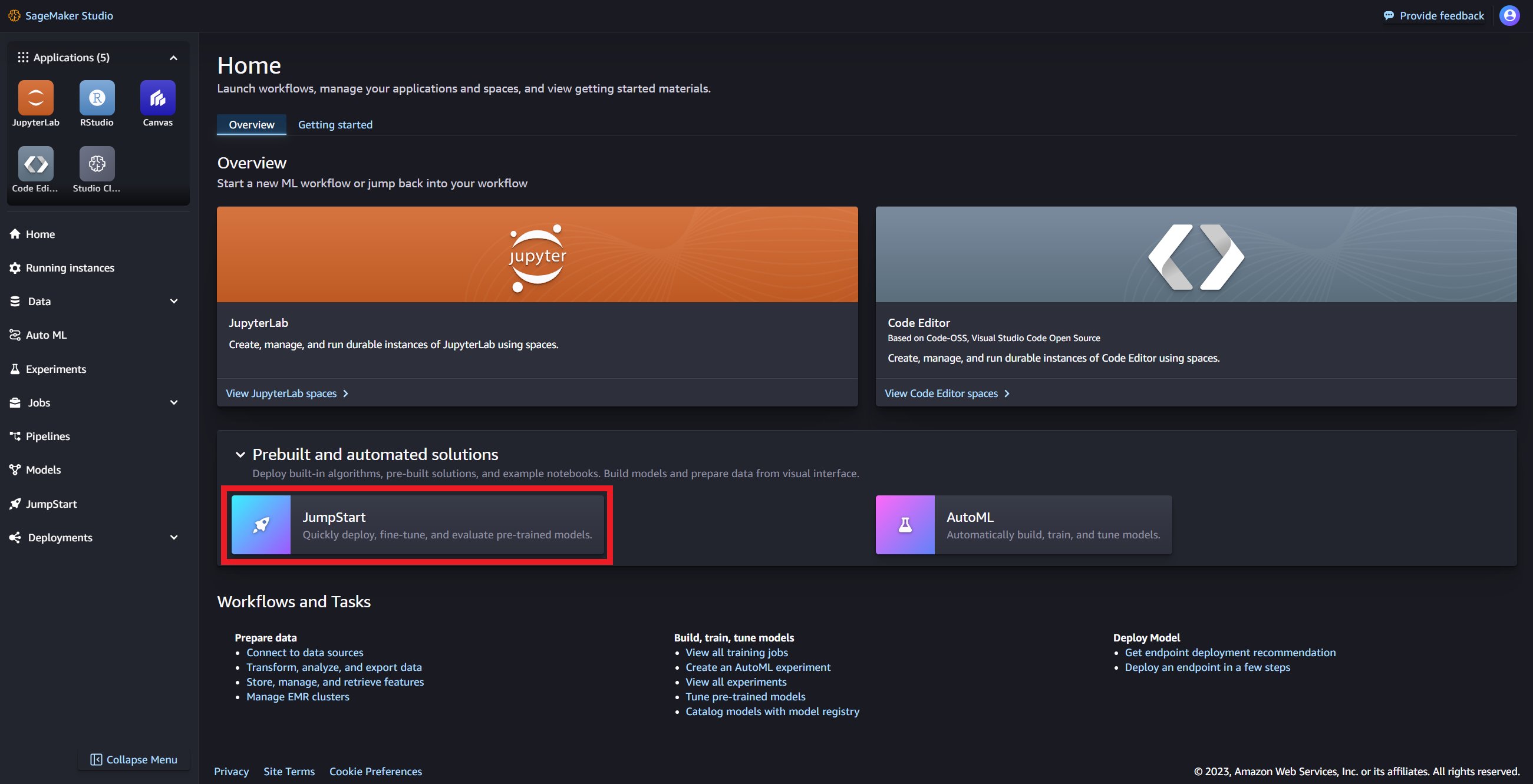

Gemma 基盤モデルには、SageMaker Studio UI の SageMaker JumpStart および SageMaker Python SDK を通じてアクセスできます。このセクションでは、SageMaker Studio でモデルを検出する方法について説明します。

SageMaker Studio は、単一の Web ベースのビジュアル インターフェイスを提供する統合開発環境 (IDE) であり、専用ツールにアクセスして、データの準備から ML モデルの構築、トレーニング、デプロイまで、すべての ML 開発ステップを実行できます。 SageMaker Studio の開始方法とセットアップ方法の詳細については、次を参照してください。 Amazon SageMakerスタジオ.

SageMaker Studio の AWS マネジメントコンソールで、以下の SageMaker JumpStart に移動します。 事前に構築された自動化されたソリューション。 Jumpstart には、事前トレーニングされたモデル、ノートブック、事前構築されたソリューションが含まれています。

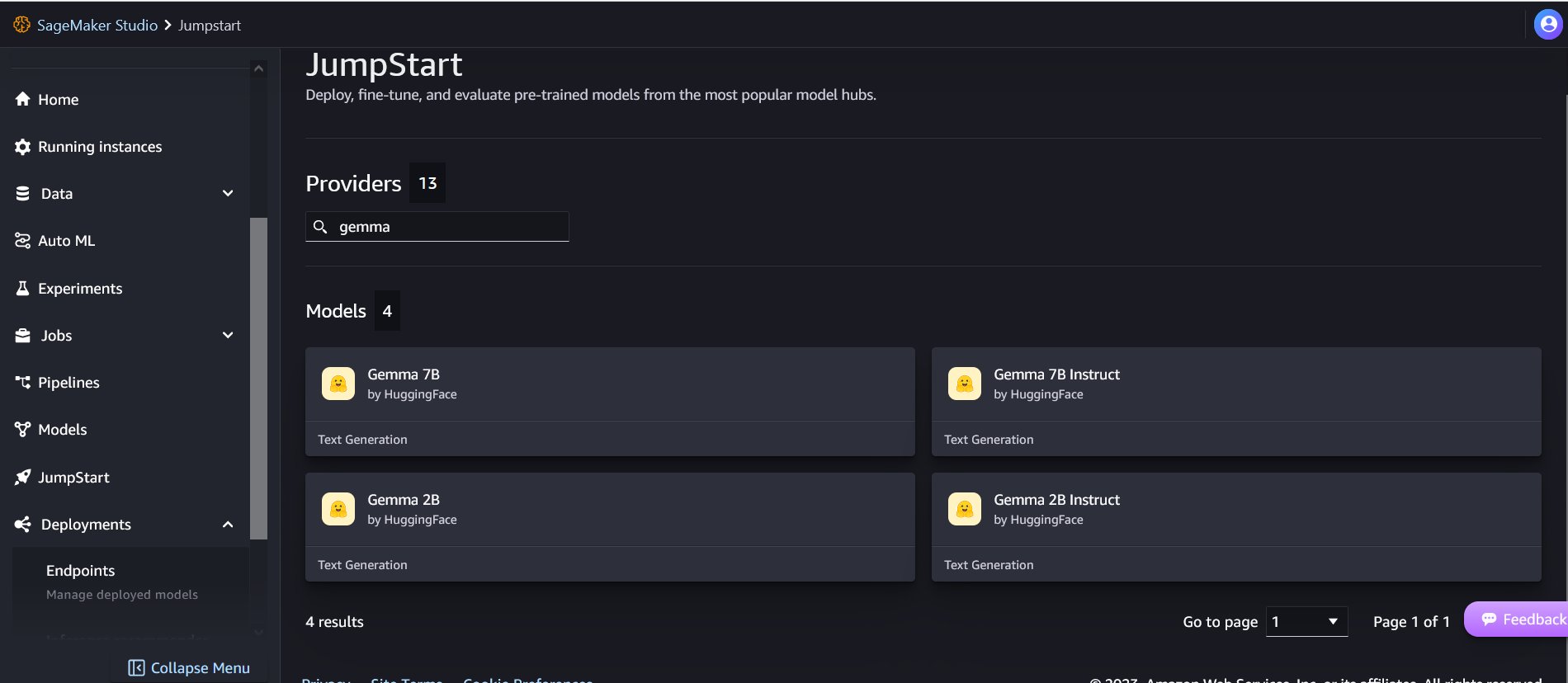

SageMaker JumpStart ランディング ページで、Gemma を検索すると、Gemma モデルを見つけることができます。

その後、Gemma 2B、Gemma 7B、Gemma 2B 命令、Gemma 7B 命令などのさまざまな Gemma モデル バリアントから選択できます。

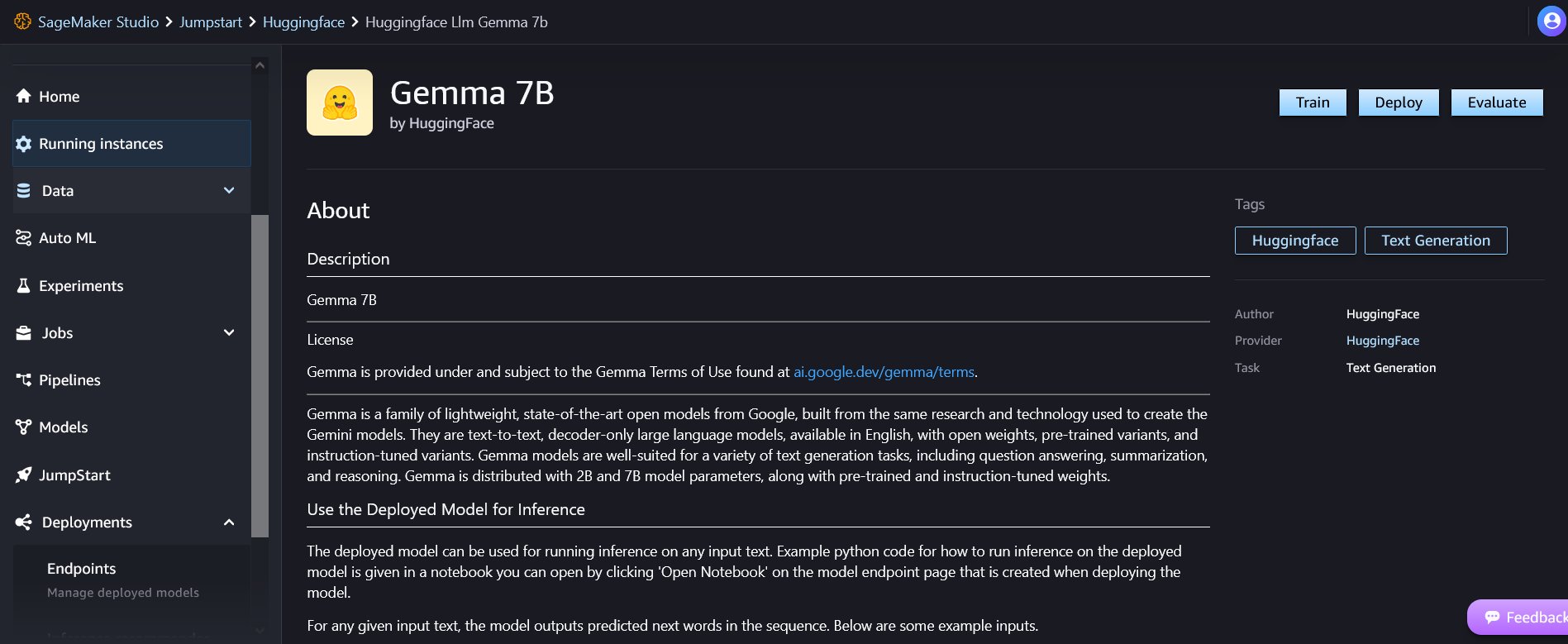

モデル カードを選択すると、ライセンス、トレーニングに使用されるデータ、モデルの使用方法など、モデルに関する詳細が表示されます。また、 配備します ボタンをクリックすると、サンプル ペイロードを使用して推論をテストできるランディング ページに移動します。

SageMaker Python SDK を使用して Gemma をデプロイする

JumpStart で Gemma のデプロイメントを示すコードと、デプロイされたモデルの使用方法の例を次の場所に見つけることができます。 この GitHub ノートブック。

まず、Gemma をデプロイするときに使用する SageMaker Model Hub のモデル ID とモデル バージョンを選択します。

JumpStart 導入のデフォルト構成オプションの詳細を示す次の表からモデル ID を選択します。語彙サイズが 256 トークンと大きいため、Gemma 7B は、10 のコンテキスト長をサポートする場合、単一の A1G GPU にのみ適合します。このため、JumpStart は Gemma 7B に対してより大きなデフォルト インスタンスを使用します。

| モデルID | デフォルトの推論インスタンス | テンソル並列度 | サポートされているコンテキストの長さ |

| ハグフェイス-llm-ジェマ-2b | ml.g5.xlarge | 1 | 8k |

| ハグフェイス-llm-gemma-2b-instruct | ml.g5.xlarge | 1 | 8k |

| ハグフェイス-llm-ジェマ-7b | ml.g5.12xラージ | 4 | 8k |

| ハグフェイス-llm-gemma-7b-instruct | ml.g5.12xラージ | 4 | 8k |

これで、SageMaker JumpStart を使用してモデルをデプロイできるようになりました。次のコードはデフォルトのインスタンスを使用します ml.g5.12xlarge 推論エンドポイントの場合、渡すことで他のインスタンスタイプにモデルをデプロイできます。 instance_type セクションに JumpStartModel クラス。導入には 5 ~ 10 分かかる場合があります。

導入を成功させるには、手動で変更する必要があります。 accept_eula モデルのデプロイメソッドの引数を次のように指定します。 True。このモデルは、テキスト生成推論 (TGI) 深層学習コンテナーを使用してデプロイされます。

エンドポイントの呼び出し

サンプル ペイロードをプログラムで取得できます。 JumpStartModel 物体。これは、Gemma が取り込むことができる事前にフォーマットされた指示プロンプトを観察することから始めるのに役立ちます。

特定のプロンプトを確認する前に、Gemma Instruct モデルのチャット テンプレートについて考えてみましょう。

ここでは、プロンプトを [USER_PROMPT] 位置。システム命令はサポートされていません。代わりに、ユーザー プロンプトの前に必要な指示を追加できます。さらに、複数ターンの会話がある場合は、必要に応じてモデル プロンプトをユーザーとアシスタントの間で切り替えることができます。

次に、いくつかの指示のプロンプトの例を考えてみましょう。ここでは、Gemma に Hello World プログラムを作成するように依頼します。

予想される出力は次のとおりです。

次に、ジェマを呼び出して、詩を書くという創造的なタスクを実行します。

出力は次のとおりです。

これはかなり良さそうです!

次に、デフォルトの JumpStart デプロイメント構成で提供されるモデルのレイテンシとスループットのパフォーマンスのベンチマークを見てみましょう。ここでは、典型的なエンドポイント ワークロードに対してモデルのパフォーマンスがどのように異なるかを示します。次の表では、小規模なクエリ (256 個の入力ワードと 256 個の出力トークン) が多数の同時ユーザーの下で非常にパフォーマンスが高く、XNUMX 秒あたり XNUMX ~ XNUMX トークン程度のトークン スループットに達していることがわかります。ただし、入力ワードの数が Gemma でサポートされている最大コンテキスト長である XNUMX トークンに近づくと、インスタンスのメモリ制限により、エンドポイントのバッチ処理能力 (同時に処理できる同時リクエストの数) が飽和状態になります。

この情報を考慮し、特定のユースケースに合わせて展開構成を調整する方法の詳細については、次を参照してください。 Amazon SageMaker JumpStart でエンドポイントのデプロイメントをベンチマークして最適化する.

| . | スループット (トークン/秒) | ||||||||||

| 同時ユーザー | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| インスタンスタイプ | 入力単語 | 出力トークン | . | . | . | . | . | . | . | . | |

| gemma-2b-命令 | ml.g5.xlarge | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-命令 | ml.g5.12xラージ | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | P50 レイテンシー (ミリ秒/トークン) | ||||||||||

| 同時ユーザー | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| インスタンスタイプ | 入力単語 | 出力トークン | . | . | . | . | . | . | . | . | |

| gemma-2b-命令 | ml.g5.xlarge | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| ジェマ-7b-指示 | ml.g5.12xラージ | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

SageMaker Python SDK を使用して Gemma を微調整する

次に、会話形式のデータセット上で Gemma 7B 命令モデルを微調整する方法を示します。 QLoRA 技術。前述したように、語彙サイズが 256 とコンテキスト長が 8 と大きいため、JumpStart は QLoRA 微調整用に次のデフォルト構成を提供します。

| モデルID | デフォルトのトレーニング インスタンス | 入力シーケンスの最大長 | デバイスごとのトレーニング バッチ サイズ | 勾配累積ステップ |

| ハグフェイス-llm-ジェマ-2b | ml.g5.2xラージ | 1024 | 1 | 4 |

| ハグフェイス-llm-gemma-2b-instruct | ml.g5.2xラージ | 1024 | 1 | 4 |

| ハグフェイス-llm-ジェマ-7b | ml.g5.12xラージ | 2048 | 1 | 4 |

| ハグフェイス-llm-gemma-7b-instruct | ml.g5.12xラージ | 2048 | 1 | 4 |

データセットを会話形式でロードして処理してみましょう。このデモンストレーションのサンプル データセットは次のとおりです。 OpenAssistant のトップ 1 会話スレッド.

トレーニング データは JSON 行 (.jsonl) 形式で、各行は一連の会話を表す辞書です。 JSON 行ファイル内の 1 つの例を以下に示します。データセットの処理方法の詳細については、次のノートブックを参照してください。 GitHubの.

トレーニング スクリプトの基礎として、JumpStart は HuggingFace を使用します。 SFTトレーナー QLoRA および フラッシュ注意。 Flash アテンションによりスケーリング効率が向上し、トレーニングと推論の高速化につながります。 JumpStart は、チャットベースの微調整に加えて、QLoRA を使用した指示とドメイン適応の微調整もサポートしています。詳細については、次のノートブックを参照してください。 GitHubの.

微調整後、微調整されたモデルを SageMaker エンドポイントにデプロイできます。

SageMaker エンドポイントの会話データに基づいて微調整されたモデルをデプロイすることを選択できます。 HuggingFace メッセージ API 機能 代替アプローチとして。 Message API 機能を使用する利点は、次の表に示すように、ユーザーがクエリの例を生の形式で渡すことができ、エンドポイント内の chat_template がクエリの例をモデルに送信する前に適切な形式に変換できることです。詳細については、微調整後の展開セクションを参照してください。 ノート.

微調整されたモデルをエンドポイントにデプロイした後、事前トレーニングされた Gemma モデルと微調整された Gemma モデルからの出力応答を比較できます。サンプルは、トレーニング データからのホールドアウト セットであるテスト データから収集されます。推論パラメータは次のとおりです。 max_tokens 512のように、 top_p 0.9のように、 temperature 0.4として、および top_k 50年として。

微調整の結果からわかるように、エージェントの回答はより正確になっています。

微調整されたモデルをさらに評価するには、次のことを検討してください。 Amazon SageMaker Clear を使用した FM 評価 微調整されたモデルが基本モデルと比較してどのようにパフォーマンスを発揮するかを確認します。

| 入力 | グラウンド トゥルース | からの応答 ベース | 微調整されたモデルからの応答 | |

| 1 |

ユーザー: 語彙力を鍛えたいのですが、文章の多様性を高めるために使用できる新しい単語を見つける簡単な方法をいくつか教えていただけますか? アシスタント:確かに!語彙力を向上させることは継続的なプロセスですが、新しい単語を見つけて文章の多様性を高めるための簡単な方法をいくつか紹介します。 1. 幅広く読む: さまざまなジャンルやテーマの本、記事、ブログを読むと、新しい単語やフレーズに出会うことができます。出てきた未知の単語をメモし、その意味を調べます。 2. シソーラスを使用する: 書いたり読んだりするときは常に、シソーラスを使用して、一般的に使用される単語の同義語を見つけます。これは、新しい単語を学ぶのに役立つだけでなく、意味の微妙な違いに対する理解も深まります。 3. XNUMX 日単語カレンダーまたはアプリ: XNUMX 日単語メールを購読するか、語彙構築アプリをダウンロードします。これらのツールは、毎日新しい単語を、その意味、発音、使用例とともに紹介します。 4. 読書クラブやディスカッション グループに参加する: 本、記事、またはその他のトピックに関する会話やディスカッションに参加すると、さまざまな視点や新しい語彙に触れることができます。他の人の話を注意深く聞き、文脈に応じて新しい言葉を使ってみてください。 5. 単語ゲームをプレイする: スクラブル、ボグル、クロスワード パズルなどのゲームは、語彙力に挑戦し、楽しい方法で新しい単語を学ぶのに役立ちます。 6. 映画、テレビ番組、またはドキュメンタリーを見る: 視覚メディアでは、さまざまな言語、俗語、専門用語が使用されることがよくあります。字幕付きで映画、テレビ番組、ドキュメンタリーを見ると、新しい単語をより深く理解し、覚えるのに役立ちます。 7. 書く練習をする: 物語、エッセイ、日記のエントリーを定期的に書くと、新しい単語やフレーズを使うようになります。語彙を増やすために、さまざまな文体やジャンルを試してください。 8. 新しい単語の語源を学ぶ: 単語の起源と歴史を理解すると、覚えやすくなり、正しく使用できるようになります。語源を調べると、関連する単語や概念も明らかになります。 9. フラッシュカードまたは間隔をあけて反復するソフトウェアを使用します。新しい単語、その意味、例文を含むフラッシュカードを作成します。定期的に復習するか、Anki などの間隔をあけて反復するソフトウェアを使用して学習を最適化します。 10. 個人的な目標を設定する: 週に XNUMX つの新しい単語を学習するなど、達成可能な目標を設定します。進捗状況を追跡し、目標を達成した自分にご褒美を与えましょう。 これらの戦略を日常生活に一貫して組み込むことで、徐々に多様で強力な語彙を構築できるようになります。 ユーザー: うーん、私は読書というアイデアがとても好きです。私が読めるクールな SF スリラーを教えてください。 |

アシスタント:確かに!ここでは、楽しめるかもしれない SF スリラーのおすすめをいくつか紹介します。 1. 劉慈欣著「三体問題」 – この受賞歴のある小説は、人類と異星文明との最初の接触と、その結果生じる政治的および個人的な影響を探求しています。存在と宇宙の性質についての深い疑問を掘り下げた、魅力的で示唆に富む読み物です。 2. ジェフ・ヴァンダーミア著「Annihilation」 – この小説は、科学者のグループが「エリア X」として知られる謎の地域に足を踏み入れ、そこで奇妙で不安な現象に遭遇する様子を描いています。彼らはその地域を深く調査するにつれて、現実と周囲の世界の性質に関する暗い秘密を明らかにし始めます。 3. ブレイク・クラウチ著「ダークマター」 – この小説は、ジェイソン・デッセンという名の優秀な物理学者が誘拐され、平行世界に転送される物語です。彼は自分の現実に戻る方法を見つけようとしながら、自分自身の選択と自分の行動の結果に直面しなければなりません。 4. マイケル・クライトン著「アンドロメダ株」 – この古典的な小説は、地球に上陸した致命的な地球外微生物を封じ込め、研究しようとする科学者チームを描いています。微生物を無力化する方法を見つけるために時間と競う一方で、政治的な陰謀や個人的な対立とも闘わなければなりません。 5. アーネスト・クライン著「レディ・プレイヤー XNUMX」 – この小説は、人口の大多数がオアシスとして知られる仮想現実世界で過ごすディストピア的な未来を舞台としています。オアシスの創設者が亡くなり、隠されたイースターエッグを見つけるという挑戦を残して、若い主人公は彼の人生を永遠に変えるスリル満点の探求に乗り出します。 これらの推奨事項の 1 つがあなたの興味を引くことを願っています。 |

アシスタント: 本文にはあなたの読書の好みや興味に関する情報が含まれていないため、おすすめの本を提供することはできません。 |

アシスタント: もちろん、あなたが楽しめるかもしれないおすすめの SF スリラーをいくつか紹介します。 – フランク・ハーバート著「デューン」: この壮大な SF 小説は、砂漠の惑星アラキスを舞台にしています。そこでポール・アトレイデスという名の若い王子は、敵対的な環境と危険な政治情勢の課題に直面しなければなりません。 – アンディ・ウィアー著「The Martian」: この魅力的な SF スリラーは、砂嵐の後火星に取り残された宇宙飛行士、マーク・ワトニーが創意工夫と機知を駆使して生き残り、最終的には地球へ帰還する物語を描いています。 – HG ウェルズの「タイムマシン」: この古典的な SF 小説は、タイムトラベルの概念に哲学的なアプローチをとり、過去と未来を変えることの結果を探ります。 – フィリップ K. ディックの「ブレードランナー」: このネオノワール SF 小説は、未来のロサンゼルスを舞台に、人間と人工知能の交差点、および社会と現実の性質に対するその影響を探求しています。 – アイザック・アシモフ著「アンドロイド」: この SF 小説は、人工知能の概念と、特に人間が伝統的な人間の価値観や信念に挑戦する高度なアンドロイドを開発した場合のその潜在的な結果を探求しています。 これらはほんの数例であり、最終的にあなたにとって最適な本は、あなたの個人的な好みと、SF スリラーにどのような種類の体験を求めているかによって異なります。ただし、これらの推奨事項がこのジャンルを探索するための良い出発点となることを願っています。 他にご質問がある場合、または何かお手伝いできることがございましたら、お知らせください。 |

| 2 |

ユーザー: VB.NET で Hello World プログラムを作成します。 アシスタント: どうぞ: 「`vbnet」 ユーザー: $ から入力を受け取り、「Hello, World!」の代わりに「Hello, $」と言うようにします。 |

アシスタント: パブリック モジュール HelloWorld パブリック サブ メイン() System.Console.WriteLine(“あなたの名前は何ですか?”) Dim 名 As String = System.Console.ReadLine() System.Console.WriteLine(“こんにちは、” & 名前 & “!”) End Subの エンドモジュール |

アシスタント: 「`vbnet」 パブリックモジュールHelloWorld パブリック サブ メイン() Dim 名 As String = Console.ReadLine() Console.WriteLine(“こんにちは、” & 名前) End Subの エンドモジュール |

アシスタント: そうですね!以下に例を示します。 「`vbnet」 |

| 3 |

ユーザー: 人間の質問を理解して応答できる大規模な言語モデルをトレーニングするプロジェクトを開始するときに行うべき項目のリストを教えてください アシスタント: 以下の手順は、人間の問い合わせを理解して応答できる大規模な言語モデルをトレーニングするプロジェクトを開始するときに実行する手順を要約したリストです。 1. プロジェクトの範囲と目的、対象者を確立します。 これにより、必要な手順が何であるかについての基本的なアイデアが得られるはずです。いずれかの点についてさらに詳しく説明する必要がありますか? ユーザー: これらのタスクをさらに細分化する必要があります。今後のタスクをより詳細に分類した最新の To Do リストを提供していただけますか |

アシスタント: 各ステップのより詳細な内訳は次のとおりです。 1. プロジェクトの範囲と目的を確立する: プロジェクトの目標と対象ユーザーを明確に定義することが重要です。これは、どのタイプのデータを収集するか、どのモデル アーキテクチャが適切であるかを決定するのに役立ちます。 2. データの収集と前処理: データの品質と多様性がモデルのパフォーマンスに直接影響するため、これは重要なステップです。前処理には、データのクリーニング、テキストのトークン化、単語の数値表現への変換などが含まれる場合があります。 3. モデル アーキテクチャの選択: リカレント ニューラル ネットワーク (RNN)、トランスフォーマー モデル、畳み込みニューラル ネットワーク (CNN) など、さまざまな種類のモデルから選択できます。どちらを選択するかは、プロジェクトの特定の要件と利用可能なデータの量によって異なります。 4. データセットを分割し、データ拡張を実装する: データをトレーニング、検証、およびテストのサブセットに分割することは、トレーニング中にモデルのパフォーマンスを監視するために重要です。データ拡張を使用すると、データセットのサイズを人為的に増加させ、モデルの堅牢性を向上させることができます。 5. モデルのトレーニングと進行状況の監視: このステップでは、検証セットを使用してトレーニング データに基づいてモデルをトレーニングし、進行状況を監視し、必要に応じてハイパーパラメーターを調整します。モデルが検証セットで適切に実行されるまで、このプロセスを数回繰り返すことが必要な場合があります。 6. テスト セットでモデルを評価する: モデルがトレーニングされたら、別のテスト セットでそのパフォーマンスを評価して、一般化能力を把握することが重要です。これは、モデルの予測を実際の結果と比較し、誤差を分析することで実行できます。 7. 特定のタスクまたはドメインの微調整: このステップには、タスク固有のデータでモデルをさらにトレーニングして、特定のドメインのパフォーマンスを向上させることが含まれます。これは、事前トレーニングされたモデルを新しいデータで微調整する転移学習を通じて、または新しいデータでモデルを最初からトレーニングする微調整を通じて行うことができます。 8. ユーザー入力用のインターフェイスを作成します。これには、ユーザーが質問や要求を入力し、モデルから応答を受け取ることができるインターフェイスの設計が含まれます。 9. 制御された環境でテストする: モデルを実際の環境に展開する前に、制御された環境でテストし、ユーザーからのフィードバックを収集することが重要です。これは、モデル内のエラーやバイアスを特定し、改善の機会を提供するのに役立ちます。 10. パフォーマンスを継続的に監視して改善する: 最後に、モデルのパフォーマンスを継続的に監視し、必要に応じて更新や改善を行うことが重要です。これには、新しいデータでのモデルの再トレーニング、ハイパーパラメーターの微調整、またはアーキテクチャの更新が含まれる場合があります。 |

アシスタント: ## 質問応答用の大規模言語モデルをトレーニングするための To-Do リスト **1.プロジェクトの範囲と目的:** * プロジェクトの目標と必要な機能を定義します。 **2.データの取得と前処理:** * トレーニング データのソースを特定し、多様なテキスト データセットを収集します。 **3.モデルの選択と構成:** * タスクの複雑さと必要なパフォーマンスに基づいて、適切なモデル アーキテクチャを選択します。 **4.トレーニングと評価:** * トレーニング データをトレーニング、検証、およびテストのサブセットに分割します。 **5.微調整とインターフェース開発:** * 転移学習を通じて、特定のタスクまたはドメインに合わせてモデルを微調整します。 **6.テストと改善:** * さまざまな入力シナリオを使用して、制御された環境でモデルをテストします。 **追加の考慮事項:** * プロジェクトのスケジュールと予算を設定します。 **注:** このリストは網羅的なものではなく、特定のプロジェクト要件に基づいて調整する必要がある場合があります。 |

アシスタント: そうですね。人間の質問を理解し、それに応答するために大規模な言語モデルをトレーニングする際に必要なタスクのより詳細な内訳は次のとおりです。 **1.プロジェクトの範囲と目的を確立する** **2.包括的/多様なテキスト データセットの収集と前処理** **3.適切なモデル アーキテクチャを選択し、精度/速度のためにハイパーパラメータを調整します** **4.データセットをトレーニング、検証、テストのサブセットに分割し、データ拡張を実装します** **5.モデルをトレーニングし、検証セットの進行状況を監視し、必要に応じて調整します** **6.テストセットでのモデルの評価、ベンチマークとの比較、エラーとバイアスの分析** **7。転移学習または微調整による特定のタスクまたはドメインの微調整** **8.ユーザー入力とモデル応答のインターフェイスを作成** **9.制御された環境でテストし、改善のためのフィードバックを収集します** **10.継続的にモニタリングし、再トレーニングと微調整を通じてパフォーマンスを向上させます** これらは、人間の質問を理解し、それに応答するために大規模な言語モデルをトレーニングする際に必要な手順です。ご質問がございましたらお知らせください。 |

クリーンアップ

エンドポイントをテストした後、料金の発生を避けるために、SageMaker 推論エンドポイントとモデルを削除します。

まとめ

この投稿では、SageMaker Studio で Gemma を使い始めて、推論用のモデルをデプロイする方法を説明しました。また、SageMaker Jumpstart で Gemma モデルを微調整する方法についても説明しました。

基礎モデルは事前にトレーニングされているため、トレーニングとインフラストラクチャのコストを削減し、ユースケースに合わせたカスタマイズを可能にすることができます。今すぐ SageMaker Studio の SageMaker JumpStart にアクセスして開始してください。

このガイダンスは情報提供のみを目的としています。 それでも、独自の独立した評価を実行し、独自の品質管理慣行と基準、およびあなた、あなたのコンテンツ、このガイダンスで参照されているサードパーティ モデル。 AWS は、このガイダンスで参照されているサードパーティ モデルに対する管理や権限を持たず、サードパーティ モデルが安全であるか、ウイルスに感染していないか、運用可能であるか、運用環境や標準と互換性があるかについて、いかなる表明も保証も行いません。 AWS は、このガイダンスの情報が特定の結果または結果をもたらすことについて、いかなる表明、保証も行いません。

著者について

カイル・ウルリッヒ博士 応用科学者であり、 AmazonSageMakerの組み込みアルゴリズム チーム。 彼の研究対象には、スケーラブルな機械学習アルゴリズム、コンピューター ビジョン、時系列、ベイジアン ノンパラメトリック、およびガウス過程が含まれます。 彼はデューク大学で博士号を取得しており、NeurIPS、Cell、Neuron で論文を発表しています。

カイル・ウルリッヒ博士 応用科学者であり、 AmazonSageMakerの組み込みアルゴリズム チーム。 彼の研究対象には、スケーラブルな機械学習アルゴリズム、コンピューター ビジョン、時系列、ベイジアン ノンパラメトリック、およびガウス過程が含まれます。 彼はデューク大学で博士号を取得しており、NeurIPS、Cell、Neuron で論文を発表しています。

XinHuang博士 Amazon SageMaker JumpStart および Amazon SageMaker 組み込みアルゴリズムの上級応用科学者です。 スケーラブルな機械学習アルゴリズムの開発に注力しています。 彼の研究対象は、自然言語処理、表形式データの説明可能なディープ ラーニング、およびノンパラメトリック時空クラスタリングの堅牢な分析の分野です。 彼は、ACL、ICDM、KDD カンファレンス、Royal Statistical Society: Series A で多くの論文を発表しています。

XinHuang博士 Amazon SageMaker JumpStart および Amazon SageMaker 組み込みアルゴリズムの上級応用科学者です。 スケーラブルな機械学習アルゴリズムの開発に注力しています。 彼の研究対象は、自然言語処理、表形式データの説明可能なディープ ラーニング、およびノンパラメトリック時空クラスタリングの堅牢な分析の分野です。 彼は、ACL、ICDM、KDD カンファレンス、Royal Statistical Society: Series A で多くの論文を発表しています。

ラクナ チャダ は、AWS の戦略アカウントにおける AI/ML のプリンシパル ソリューション アーキテクトです。 Rachna は楽観主義者で、AI を倫理的かつ責任を持って使用することで将来の社会を改善し、経済的および社会的繁栄をもたらすことができると信じています。余暇には、家族と一緒に時間を過ごしたり、ハイキングをしたり、音楽を聴いたりするのが好きです。

ラクナ チャダ は、AWS の戦略アカウントにおける AI/ML のプリンシパル ソリューション アーキテクトです。 Rachna は楽観主義者で、AI を倫理的かつ責任を持って使用することで将来の社会を改善し、経済的および社会的繁栄をもたらすことができると信じています。余暇には、家族と一緒に時間を過ごしたり、ハイキングをしたり、音楽を聴いたりするのが好きです。

エヴァン・クラヴィッツ アマゾンウェブサービスのソフトウェアエンジニアであり、SageMakerJumpStartに取り組んでいます。 彼はニューヨーク市で料理やランニングを楽しんでいます。

エヴァン・クラヴィッツ アマゾンウェブサービスのソフトウェアエンジニアであり、SageMakerJumpStartに取り組んでいます。 彼はニューヨーク市で料理やランニングを楽しんでいます。

アシッシュ・ケタン博士 は、Amazon SageMaker 組み込みアルゴリズムを使用する上級応用科学者であり、機械学習アルゴリズムの開発を支援しています。 イリノイ大学アーバナシャンペーン校で博士号を取得。 彼は機械学習と統計的推論の活発な研究者であり、NeurIPS、ICML、ICLR、JMLR、ACL、および EMNLP カンファレンスで多くの論文を発表しています。

アシッシュ・ケタン博士 は、Amazon SageMaker 組み込みアルゴリズムを使用する上級応用科学者であり、機械学習アルゴリズムの開発を支援しています。 イリノイ大学アーバナシャンペーン校で博士号を取得。 彼は機械学習と統計的推論の活発な研究者であり、NeurIPS、ICML、ICLR、JMLR、ACL、および EMNLP カンファレンスで多くの論文を発表しています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- 能力

- 私たちについて

- 上記の.

- 同意

- アクセス

- 接近性

- アカウント

- 累積

- 精度

- 正確な

- 達成可能な

- 達成する

- 買収

- 越えて

- 行動

- アクティブ

- 実際の

- 適応

- 添加

- さらに

- 調整します

- 高度な

- 進歩

- 後

- に対して

- エージェント

- AI

- AI / ML

- 航空機

- アルゴリズム

- 外国人

- すべて

- 許す

- 許可されて

- ことができます

- 沿って

- また

- 代替案

- Amazon

- アマゾンセージメーカー

- Amazon SageMaker ジャンプスタート

- Amazon Webサービス

- 量

- an

- 分析

- 分析します

- 分析

- 分析する

- および

- とインフラ

- アンドロメダ

- アンヘレス

- アナウンス

- 回答

- 応答

- 回答

- どれか

- 何でも

- API

- アプリ

- 適用された

- 申し込む

- アプローチ

- アプローチ

- 適切な

- アプリ

- 建築

- です

- AREA

- エリア

- 引数

- 周りに

- 宝品

- 物品

- 人工の

- 人工知能

- AS

- 頼む

- 評価

- アシスタント

- 宇宙飛行士

- At

- 聴衆

- 権威

- 自動化

- 利用できます

- 避ける

- 受賞歴のある

- AWS

- AWSマネジメントコンソール

- バック

- ベース

- ベース

- 基本

- バッチング

- ベイジアン

- BE

- なぜなら

- 始まる

- 背後に

- さ

- 信念

- と考えています

- 以下

- ベンチマーク

- ベンチマーク

- 恩恵

- ほかに

- BEST

- より良いです

- の間に

- バイアス

- バイアス

- 10億

- 億

- 刃

- ブロック

- ブログ

- ブログ

- ブルーム

- ボディ

- 本

- 本

- 内訳

- 鮮やかな

- 持って来る

- 持参

- もたらす

- 壊れた

- 予算

- ビルド

- 建物

- 内蔵

- 内蔵

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- (Comma Separated Values) ボタンをクリックして、各々のジョブ実行の詳細(開始/停止時間、変数値など)のCSVファイルをダウンロードします。

- by

- カレンダー

- コール

- 呼ばれます

- 缶

- キャンバス

- 機能

- できる

- カード

- 場合

- 例

- カテゴリー

- 注意

- セル

- 挑戦する

- 課題

- 変化する

- 特性

- 課金

- チャット

- 小切手

- 選択

- 選択肢

- 選択する

- 市町村

- Civilization

- class

- クラシック

- クリーニング

- はっきりと

- クリック

- クラブ

- クラスタリング

- コード

- コーディング

- 環境、テクノロジーを推奨

- 来ます

- 一般に

- 比較します

- 比べ

- 比較

- 比較

- 互換性のあります

- コンプリート

- 複雑さ

- 複雑さ

- 従う

- コンピュータ

- Computer Vision

- コンセプト

- コンセプト

- 同時

- 会議

- 競合

- 結果

- 検討

- 検討事項

- 考えると

- 一貫して

- からなる

- 領事

- 定数

- 制約

- 接触

- 含む

- コンテナ

- 含まれています

- 争う

- コンテンツ

- コンテキスト

- 連続的に

- コントロール

- 制御

- 会話

- 会話

- 会話

- 変換

- 変換

- クール

- コスト

- 可能性

- 作ります

- 作成

- クリエイティブ

- クリエイター

- クロスワードパズル

- キュレーション

- 興味深い

- 電流プローブ

- Customers

- カスタム化

- daily

- ダンス

- 暗いです

- データ

- データセット

- 中

- 決定

- 深いです

- 深い学習

- より深い

- ディープマインド

- デフォルト

- 定義します

- 定義する

- 掘り下げる

- 探求する

- デモンストレーション

- 決まる

- 展開します

- 展開

- 展開する

- 展開

- 砂漠

- 設計

- 設計

- 希望

- 詳細

- 詳細な

- 細部

- 決定する

- 開発する

- 発展した

- Developer

- 開発

- 開発

- デバイス

- 診断する

- 対話

- 異なる

- の違い

- 異なります

- デジタル

- デジタルアート

- 直接に

- ディレクトリにジョブを開始します。

- 発見する

- 議論

- 議論

- 病気

- ダイビング

- 異なる

- 多様性

- 分割

- do

- ドキュメント

- ドキュメンタリー

- ありません

- ドメイン

- ドメイン

- 行われ

- ダウン

- ダウンロード

- 原因

- デューク

- デューク大学

- 間に

- ほこり

- 陰鬱な

- 各

- EARTH

- 容易

- 効率

- 8

- 帝国

- enable

- 可能

- 有効にする

- 出会い

- 励ます

- 端から端まで

- エンドポイント

- 魅力的

- エンジニア

- 強化

- 楽しみます

- 楽しい

- 確保

- 環境

- EPIC

- エラー

- 本質的な

- 確立する

- 倫理的な

- 評価する

- 評価します

- 評価

- 最終的に

- あらゆる

- 例

- 例

- 興奮した

- 包括的

- 展示

- 存在

- 既存の

- 詳細

- 予想される

- 高価な

- 体験

- 実験

- 専門家

- 探る

- 探検する

- 探る

- 顔

- 公平

- false

- 家族

- 速いです

- 特徴

- フィードバック

- 足

- 少数の

- フィールド

- 戦い

- File

- 最後に

- もう完成させ、ワークスペースに掲示しましたか?

- 調査結果

- 終わり

- 名

- 第一接触

- フィット

- 五

- フラッシュ

- フライト

- 焦点を当てて

- フォロー中

- 次

- に前進

- 形式でアーカイブしたプロジェクトを保存します.

- Foundation

- フレームワーク

- 率直な

- から

- function

- 機能性

- 機能性

- 機能します

- さらに

- 未来

- 未来の

- Games

- 集める

- 双子座

- 生成

- 生々しい

- 生成AI

- ジャンル

- ジャンル

- 取得する

- GitHubの

- 与える

- 与えられた

- Go

- 目標

- 行く

- 良い

- でログイン

- Googleの

- だ

- GPU

- 猶予期間

- 徐々に

- 素晴らしい

- すげえ力

- グループ

- 保証

- ガード

- ガイダンス

- ガイド

- 案内

- ハンド

- ハーネス

- 持ってる

- he

- 高さ

- こんにちは

- 助けます

- ことができます

- 彼女の

- こちら

- 隠されました

- 彼の

- history

- 希望

- 主催

- 認定条件

- How To

- しかしながら

- HTML

- HTTPS

- ハブ

- ハブ

- 抱き合う顔

- 人間

- 人類

- 人間

- i

- ID

- アイデア

- 識別する

- if

- イリノイ州

- 画像

- 影響

- 実装する

- 実装

- import

- 重要

- 改善します

- 改善

- 改善

- 改善

- in

- include

- 含めて

- 組み込む

- 増える

- 独立しました

- 産業を変えます

- 業界標準

- 影響

- 情報

- 情報

- インフラ

- 独創性

- 革新的手法

- 入力

- お問い合わせ

- 洞察

- インスピレーションある

- を取得する必要がある者

- 統合する

- 統合された

- インテリジェンス

- 意図

- 相互作用

- 利益

- インタフェース

- 交差点

- に

- 紹介する

- 直観的な

- 巻き込む

- 関係する

- 関与

- IT

- リーディングシート

- ITS

- 専門用語

- join

- ジャーナル

- 旅

- JPG

- JSON

- ただ

- キープ

- 種類

- 知っている

- 知識

- 既知の

- カイル

- 着陸

- 風景

- 言語

- 大

- より大きい

- レイテンシ

- 打ち上げ

- 法制

- 主要な

- LEARN

- 学習

- 学ぶ

- 残す

- 長さ

- う

- レベル

- 活用します

- ライセンス

- ライセンス

- 生活

- 稲妻

- ライトニングスピード

- 軽量

- ような

- 好き

- LINE

- ライン

- リスト

- 聞く

- 耳を傾ける

- 聞く

- ラマ

- 負荷

- ローカル

- 場所

- 見て

- 探して

- LOOKS

- インクルード

- ロサンゼルス

- 下側

- 機械

- 機械学習

- 大多数

- make

- 悪意のある

- 管理

- 手動で

- 多くの

- マーク

- 火星

- 数学

- 五月..

- me

- 意味

- 意味

- 措置

- メディア

- 薬

- ご相談

- 言及した

- メッセージ

- メッセージ

- 方法

- Michael Liebreich

- かもしれない

- マインド

- 分

- ML

- モデル

- モジュール

- モニター

- モニタリング

- 他には?

- 最も

- 動画

- 音楽を聴く際のスピーカーとして

- しなければなりません

- my

- 神秘的な

- 名

- 名前付き

- ナチュラル

- 自然言語処理

- 自然

- 必要

- 必要

- 必要とされる

- ニーズ

- ネットワーク

- ニューラル

- ニューラルネットワーク

- 決して

- 新作

- ニューヨーク

- ニューヨーク市

- 夜

- いいえ

- 注意

- ノート

- 小説

- 今

- 数

- オアシス

- オブジェクト

- 目的

- 観察する

- of

- オファー

- 頻繁に

- on

- かつて

- ONE

- 継続

- の

- オペレーショナル

- 機会

- 最適化

- 最適化

- オプション

- or

- 注文

- 起源

- OS

- その他

- その他

- でる

- 結果

- 成果

- 出力

- が

- 自分の

- ページ

- 論文

- 並列シミュレーションの設定

- パラメーター

- パラメータ

- 特定の

- 特に

- パーティー

- パス

- 通過

- 過去

- path

- パターン

- Paul Cairns

- のワークプ

- 以下のために

- 実行する

- パフォーマンス

- 実行

- 実行する

- 個人的な

- 視点

- 博士号

- フレーズ

- 物理学者

- パイロット

- 場所

- 惑星

- プラン

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- プレイ

- プレイヤー

- お願いします

- ポイント

- ポイント

- 政治的

- 人気

- 人口

- ポスト

- 潜在的な

- 電力

- 練習

- プラクティス

- 予測

- Predictor

- プ

- 準備中

- かなり

- 前に

- プリンス

- 校長

- プリント

- プロセス

- 処理済み

- ラボレーション

- 処理

- 生産

- 演奏曲目

- 進捗

- プロジェクト

- プロンプト

- 適切な

- 繁栄

- 提供します

- プロバイダ

- は、大阪で

- 公共

- 公然と

- 公表

- 目的

- パズル

- Python

- パイトーチ

- 品質

- クエリ

- クエリー

- クエスト

- 質問

- 質問

- すぐに

- 非常に

- レース

- 影響

- 範囲

- むしろ

- Raw

- 到達

- 読む

- リーディング

- 現実の世界

- 現実

- 本当に

- realm

- 理由

- 受け取ります

- 最近

- おすすめ

- 提言

- 推薦する

- 再発

- 参照

- 参照

- 反映

- 定期的に

- 規制

- 関連する

- リリース

- 関連した

- 覚えています

- 繰り返す

- 表します

- リクエスト

- の提出が必要です

- 要件

- 研究

- 研究者

- 反応します

- 応答

- 応答

- 回答

- 責任

- 責任

- 結果

- 結果

- レビュー

- 報いる

- 上昇

- 堅牢な

- 丈夫

- 職種

- ルーチン

- ロイヤル

- ルール

- ラン

- 実行

- s

- より安全な

- セージメーカー

- SageMaker の推論

- 同じ

- Save

- 言う

- ド電源のデ

- 規模

- 秤

- スケーリング

- シナリオ

- サイエンスフィクション

- 科学

- 科学者

- 科学者たち

- スコープ

- スクラッチ

- スクリプト

- スクリプト

- SDDK

- シームレス

- 検索

- 二番

- 秘密

- セクション

- 安全に

- select

- 選択

- 選択

- 選択

- 送信

- シニア

- 別

- シーケンス

- シリーズ

- シリーズA

- サービス

- サービング

- セッション

- セッションに

- セット

- 設定

- いくつかの

- shared

- すべき

- 表示する

- 示されました

- 表示

- 示す

- 作品

- 側

- 同様の

- 簡単な拡張で

- サイズ

- サイズ

- スキル

- So

- 社会

- 社会

- ソフトウェア

- ソフトウェアエンジニア

- 溶液

- ソリューション

- 一部

- ソース

- スパークス

- 特定の

- スピード

- 支出

- 支出

- スタンド

- 規格

- 開始

- 起動

- 都道府県

- 最先端の

- ステートメント

- 統計的

- 手順

- ステップ

- まだ

- ストーリー

- ストーム

- ストーリー

- 奇妙な

- 戦略的

- 作戦

- 文字列

- 強い

- 研究

- 勉強

- 申し込む

- サブタイトル

- 成功した

- そのような

- 適当

- サポート

- サポート

- 支援する

- サポート

- 確か

- 生き残る

- テーブル

- 取る

- 取り

- 物語

- ターゲット

- ターゲット

- 仕事

- タスク

- チーム

- チーム

- 技術

- テクニック

- テクノロジー

- template

- テンプレート

- テンソルフロー

- 条件

- test

- テスト

- テスト

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- より

- それ

- エリア

- 未来

- 世界

- アプリ環境に合わせて

- それら

- 自分自身

- その後

- そこ。

- したがって、

- ボーマン

- 彼ら

- 三番

- 第三者

- サードパーティ

- この

- それらの

- 考え

- 考えさせられる

- 千

- スリリング

- 介して

- スループット

- 時間

- 時系列

- タイムトラベル

- タイムライン

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- トークン

- トークン化

- トークン

- 言われ

- ツール

- 豊富なツール群

- トピック

- トータル

- 追跡する

- 伝統的な

- トレーニング

- 訓練された

- トレーニング

- 転送

- 転送

- トランス

- インタビュー

- 旅行

- 1兆

- true

- 試します

- 曲

- 調整された

- チューニング

- tv

- 2

- type

- 典型的な

- 一般的に

- ui

- 最終的に

- 明らかにする

- 下

- わかる

- 理解する

- 未知

- 宇宙

- 大学

- 比類のない

- まで

- 発表

- 更新しました

- 更新版

- 更新

- us

- 使いやすさ

- 使用法

- つかいます

- 使用事例

- 中古

- ユーザー

- 「DeckleBenchは非常に使いやすく最適なソリューションを簡単に見つけることができるため、稼働率が向上しコストも削減した。当社の旧システムは良かったが改善は期待していなかった。

- users

- 使用されます

- 価値観

- 多様

- さまざまな

- ベンチャー

- バージョン

- 詳しく見る

- バーチャル

- バーチャルリアリティ

- ビジョン

- 訪問

- ビジュアル

- ビジュアルメディア

- ボリューム

- 歩く

- 欲しいです

- 保証

- ました

- よく見る

- 見ている

- 仕方..

- 方法

- we

- ウェブ

- Webサービス

- ウェブベースの

- 週間

- WELL

- ウェルズ

- この試験は

- 何ですか

- いつ

- たびに

- かどうか

- which

- 誰

- ワイド

- 広く

- ウィジェット

- 意志

- 知恵

- 以内

- 無し

- Word

- 言葉

- 仕事

- ワークフロー

- ワーキング

- 世界

- 書きます

- 書き込み

- X

- ヨーク

- You

- 若い

- あなたの

- あなた自身

- ゼファーネット