フェイクニュースは、虚偽の情報、捏造された情報、または意図的に誤解を招く情報を伝えたり組み込んだりするニュースとして定義され、印刷機の出現以来存在していました。 オンラインでのフェイクニュースや偽情報の急速な拡散は、国民を欺くだけでなく、社会、政治、経済、文化に重大な影響を与える可能性があります。 例としては次のものが挙げられます。

- メディアに対する不信感を募らせる

- 民主的プロセスの弱体化

- 虚偽の科学または信用されていない科学を広める(反ワクチン運動など)

人工知能 (AI) と機械学習 (ML) の進歩により、フェイク ニュースを作成および共有するためのツールの開発がさらに簡単になりました。 初期の例には、フェイク ニュース拡散の初期段階を大幅に強化する高度なソーシャル ボットや自動アカウントが含まれます。 一般に、一般の人々にとって、そのようなアカウントが人間であるかボットであるかを判断することは簡単ではありません。 さらに、ソーシャル ボットは違法なツールではなく、多くの企業がマーケティング戦略の一環として合法的に購入しています。 したがって、ソーシャルボットの使用を体系的に制限するのは簡単ではありません。

生成 AI の分野における最近の発見により、大規模言語モデル (LLM) の助けを借りて、前例のないペースでテキスト コンテンツを作成できるようになりました。 LLM は 1 億を超えるパラメータを持つ生成 AI テキスト モデルであり、高品質のテキストの合成が容易になります。

この投稿では、LLM を使用して、フェイク ニュースの検出という一般的な問題に取り組む方法を検討します。 特に、次のようなプロンプト技術が改善されている場合には、LLM がこのタスクに対して十分に高度であることをお勧めします。 思考の連鎖 および 反応します 情報検索ツールと組み合わせて使用されます。

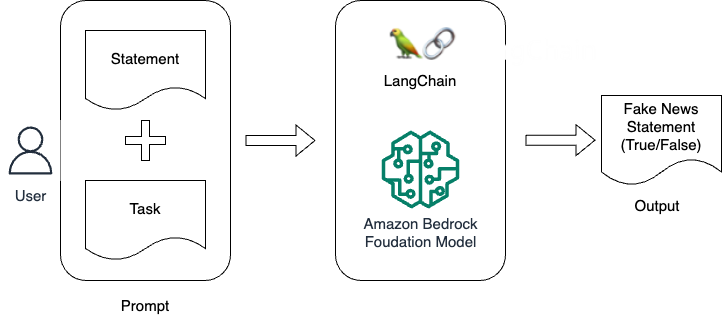

これを次のように作成して説明します。 ラングチェーン ニュースを受け取ると、自然言語を使用してその記事が真実か偽物かをユーザーに通知するアプリケーション。 このソリューションではまた、 アマゾンの岩盤は、Amazon およびサードパーティ モデル プロバイダーの基盤モデル (FM) にアクセスできるようにするフルマネージド サービスです。 AWSマネジメントコンソール そしてAPI。

LLM とフェイクニュース

フェイクニュース現象は、インターネット、より具体的にはソーシャルメディアの出現とともに急速に進化し始めました(Nielsen et al。、2017)。 ソーシャル メディアでは、フェイク ニュースがユーザーのネットワーク内ですぐに共有され、一般大衆が誤った集団的意見を形成するように仕向けられる可能性があります。 さらに、人々は、ニュースが自分の個人的な規範に共鳴する場合、内容の事実を無視して、フェイク ニュースを衝動的に広めることがよくあります (チプルスキーら。 2018年)。 社会科学の研究では、認知バイアス (確証バイアス、バンドワゴン効果、選択支持バイアス) が、フェイク ニュースの作成と消費の両方に関して非合理な決定を下す最も重要な要因の XNUMX つであることが示唆されています (キム他、2021)。 これは、ニュース消費者が自分たちの信念を強化する方向でのみ情報を共有し、消費していることも意味します。

前例のないペースでテキストやリッチなコンテンツを生成する生成 AI の力が、フェイク ニュースの問題を悪化させています。 言及する価値のある例は、元のビデオにさまざまな画像を組み合わせて別のビデオを生成するディープフェイク技術です。 人間の行為者がもたらす偽情報の意図に加えて、LLM はまったく新しい一連の課題を追加します。

- 事実誤認 – LLM は、トレーニングの性質と、文内の次の単語を生成する際に創造性を発揮する能力により、事実誤認を含むリスクが高くなります。 LLM トレーニングは、不完全な入力を含むモデルを繰り返し提示し、ギャップが正しく埋められるまで ML トレーニング手法を使用することに基づいており、それによって言語構造と言語ベースの世界モデルを学習します。 したがって、LLM は優れたパターン マッチャーおよび再結合者 (「確率的オウム」) ではありますが、論理的推論や数学的演繹を必要とする多くの単純なタスクでは失敗し、答えが幻覚に見える可能性があります。 さらに、温度は、文内の次の単語を生成する際のモデルの動作を制御する LLM 入力パラメーターの XNUMX つです。 より高い温度を選択すると、モデルは確率の低い単語を使用し、よりランダムな応答を提供します。

- 長い – 生成されたテキストは長くなる傾向があり、個々の事実について明確に定義された粒度が不足しています。

- 事実確認の欠如 – テキスト生成プロセス中にファクトチェックに使用できる標準化されたツールはありません。

全体として、人間の心理と AI システムの限界が組み合わさって、オンラインでのフェイク ニュースや誤った情報の蔓延という完璧な嵐を引き起こしています。

ソリューションの概要

LLM は、言語の生成、理解、および数回の学習で優れた能力を発揮しています。 彼らはインターネットからの膨大なテキストのコーパスを使用してトレーニングされますが、抽出された自然言語の品質と正確性は保証されていない可能性があります。

この記事では、思考連鎖と Re-Act (推論と行動) のプロンプト アプローチの両方に基づいてフェイク ニュースを検出するソリューションを提供します。 まず、これら XNUMX つのプロンプト エンジニアリング手法について説明し、次に LangChain と Amazon Bedrock を使用した実装を示します。

次のアーキテクチャ図は、フェイク ニュース検出器のソリューションの概要を示しています。

フェイクニュース検出のためのアーキテクチャ図。

のサブセットを使用します。 発熱データセット 虚偽、真実、または検証不可能な主張を示す声明と、その声明に関する真実を含むもの (ソーン J. 他、2018).

ワークフローは次のステップに分類できます。

- ユーザーはステートメントの XNUMX つを選択して、虚偽か真実かを確認します。

- ステートメントとフェイク ニュース検出タスクがプロンプトに組み込まれています。

- プロンプトは LangChain に渡され、Amazon Bedrock の FM が呼び出されます。

- Amazon Bedrock は、ユーザーのリクエストに対して True または False のステートメントを含む応答を返します。

この記事では、Anthrophic の Claude v2 モデル (anthropic.claude-v2) を使用します。 クロード は、信頼性が高く、解釈可能で、操作可能な AI システムを作成するための Anthropic の研究に基づいた生成 LLM です。 憲法 AI や無害化トレーニングなどの技術を使用して作成されたクロードは、思慮深い対話、コンテンツ作成、複雑な推論、創造性、コーディングに優れています。 ただし、Amazon Bedrock とソリューション アーキテクチャを使用することで、Amazon Bedrock が提供する他の FM の中から柔軟に選択することもできます。 Amazon, AI21labs, 密着, 安定性.ai.

実装の詳細については、次のセクションで説明します。 ソースコードは次の場所で入手できます。 GitHubリポジトリ.

前提条件

このチュートリアルでは、Linux、Mac、または Linux 用 Windows サブシステムに Python 3.9 以降がインストールされた bash ターミナルと AWS アカウントが必要です。

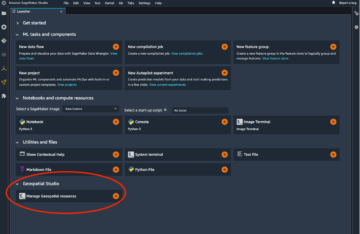

また、次のいずれかを使用することをお勧めします Amazon SageMakerスタジオ ノート、 AWS クラウド9 インスタンス、または アマゾン エラスティック コンピューティング クラウド (Amazon EC2)インスタンス。

Amazon Bedrock API を使用してフェイクニュース検出を展開する

このソリューションでは、Amazon Bedrock API を使用します。これには、 AWSコマンドラインインターフェイス (AWS CLI)、 AWS SDK for Python(Boto3)、または アマゾンセージメーカー ノート。 を参照してください。 Amazon Bedrock ユーザーガイド 詳細については。 この投稿では、AWS SDK for Python 経由で Amazon Bedrock API を使用します。

Amazon Bedrock API 環境をセットアップする

Amazon Bedrock API 環境をセットアップするには、次の手順を実行します。

- 最新の Boto3 をダウンロードするか、アップグレードします。

- 必ず AWS 認証情報を設定してください。

aws configureコマンドを使用するか、Boto3 クライアントに渡します。 - の最新バージョンをインストールする ラングチェーン:

次の Python シェル スクリプトを使用してセットアップをテストできるようになりました。 このスクリプトは、Boto3 を使用して Amazon Bedrock クライアントをインスタンス化します。 次に、 list_foundation_models 使用可能な基礎モデルのリストを取得する API。

前述のコマンドが正常に実行された後、Amazon Bedrock から FM のリストを取得する必要があります。

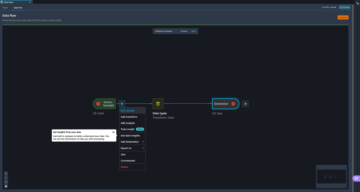

プロンプトチェーンソリューションとしての LangChain

特定の文のフェイク ニュースを検出するには、ゼロショットの思考連鎖推論プロセスに従います (Wei J. 他、2022)、これは次のステップで構成されます。

- 最初に、モデルは、プロンプトされたニュースに関するステートメントを作成しようとします。

- モデルはアサーションの箇条書きリストを作成します。

- モデルはアサーションごとに、そのアサーションが真か偽かを判断します。 この方法論を使用すると、モデルは内部知識 (トレーニング前のフェーズで計算された重み) のみに依存して判定を下すことに注意してください。 現時点では、この情報は外部データに対して検証されていません。

- 事実を考慮すると、モデルはプロンプト内の指定されたステートメントに対して TRUE または FALSE を返します。

これらの手順を達成するために、言語モデルを利用したアプリケーション開発用のフレームワークである LangChain を使用します。 このフレームワークを使用すると、さまざまなコンポーネントを連鎖させて FM を強化し、高度なユースケースを作成できます。 このソリューションでは、組み込みの シンプルシーケンシャルチェーン LangChain で単純なシーケンシャル チェーンを作成します。 あるチェーンから出力を取得し、それを別のチェーンへの入力として使用できるため、これは非常に便利です。

Amazon Bedrock は LangChain と統合されているため、インスタンスを作成する必要があるのは、 model_id Amazon Bedrock オブジェクトをインスタンス化するとき。 必要に応じて、モデル推論パラメータは、 model_kwargs 次のような引数:

- maxTokenCount – 生成された応答内のトークンの最大数

- 停止シーケンス – モデルで使用される停止シーケンス

- 温度 – 0 ~ 1 の範囲の値。0 が最も決定的で、1 が最も創造的です。

- top – 0 ~ 1 の範囲の値。潜在的な選択肢の確率に基づいてトークンの選択肢を制御するために使用されます。

Amazon Bedrock 基本モデルを初めて使用する場合は、必ずモデルのリストから選択してモデルへのアクセスをリクエストしてください。 モデルアクセス Amazon Bedrock コンソールのページ。この場合、Anthropic の claude-v2 です。

次の関数は、フェイク ニュースを検出するために前述した思考連鎖プロンプト チェーンを定義します。 この関数は、Amazon Bedrock オブジェクト (llm) とユーザー プロンプト (q) を引数として受け取ります。 ラングチェーンの プロンプトテンプレート ここでは、プロンプトを生成するためのレシピを事前定義するために機能が使用されます。

次のコードは、前に定義した関数を呼び出し、答えを提供します。 その声明は、 TRUE or FALSE. TRUE 提供された陳述には正しい事実が含まれていることを意味し、 FALSE は、ステートメントに少なくとも XNUMX つの誤った事実が含まれていることを意味します。

ステートメントとモデル応答の例を次の出力に示します。

ReAct とツール

前の例では、モデルはステートメントが false であることを正しく識別しました。 ただし、クエリを再度送信すると、モデルが事実の正しさを区別できないことがわかります。 このモデルには、自身のトレーニング メモリを超えてステートメントの真実性を検証するツールがないため、同じプロンプトを後続で実行すると、偽のステートメントを真実であると誤ってラベル付けしてしまう可能性があります。 次のコードでは、同じ例を別の方法で実行しています。

真実性を保証するための手法の XNUMX つが ReAct です。 反応 (Yao S. 他、2023) は、エージェントのアクション スペースで基礎モデルを拡張する迅速な手法です。 この記事と ReAct 論文では、アクション スペースは、単純な Wikipedia Web API からの検索、ルックアップ、終了アクションを使用した情報取得を実装しています。

Chain-of-Thought と比較して ReAct を使用する理由は、外部の知識の取得を使用して基礎モデルを強化し、特定のニュースがフェイクか真実かを検出するためです。

この投稿では、エージェントを介して LangChain の ReAct 実装を使用します。 ZERO_SHOT_REACT_DESCRIPTION。 ReAct を実装し、Wikipedia を使用するために、前の関数を変更します。 langchain.agents。

Wikipedia パッケージもインストールする必要があります。

!pip install Wikipedia

以下は新しいコードです。

以下は、前に使用したのと同じステートメントを使用した場合の、前述の関数の出力です。

クリーンアップ

コストを節約するには、チュートリアルの一環としてデプロイしたすべてのリソースを削除します。 AWS Cloud9 または EC2 インスタンスを起動した場合は、コンソールまたは AWS CLI を使用して削除できます。 同様に、SageMaker コンソール経由で作成した SageMaker ノートブックを削除できます。

制限事項と関連作業

フェイクニュース検出の分野は、科学界で積極的に研究されています。 この投稿では、思考連鎖と ReAct 手法を使用しました。手法の評価では、プロンプト手法の分類の精度 (特定のステートメントが真か偽か) のみに焦点を当てました。 したがって、応答速度などの他の重要な側面を考慮したり、Wikipedia 以外の追加の知識ベース ソースにソリューションを拡張したりしていません。

この投稿では、Chain-of-Thought と ReAct という XNUMX つの手法に焦点を当てましたが、LLM がどのようにフェイク ニュースを検出、排除、または軽減できるかについては、広範な研究が行われています。 リーら。 は、マスクされたトークンが言語モデルにエンコードされた知識を実際に使用していることを保証するために、NER (名前付きエンティティ認識) を使用して名前付きエンティティをマスクするエンコーダ/デコーダ モデルの使用を提案しました。 チャーンら。 は、思考連鎖の原則を使用してプロンプトから主張を抽出し、その結果、主張の関連証拠を収集する FacTool を開発しました。 次に、LLM は、取得した証拠のリストを基に、主張の事実性を判断します。 Du E. et al. は、共通の最終答えに到達するために、複数の LLM が複数のラウンドにわたって個別の応答と推論プロセスを提案および議論する補完的なアプローチを示しています。

文献に基づくと、LLM が外部の知識とマルチエージェントの会話機能で強化されると、フェイク ニュースの検出における LLM の有効性が高まることがわかります。 ただし、これらのアプローチは、複数のモデル呼び出しと対話、より長いプロンプト、および長時間のネットワーク層呼び出しを必要とするため、計算がより複雑になります。 最終的に、この複雑さは全体的なコストの増加につながります。 同様のソリューションを運用環境に導入する前に、コストとパフォーマンスの比率を評価することをお勧めします。

まとめ

この投稿では、今日の社会の大きな課題の XNUMX つであるフェイク ニュースの蔓延する問題に対処するために LLM を使用する方法を詳しく掘り下げました。 私たちはまず、フェイクニュースが国民感情を揺さぶり、社会的混乱を引き起こす可能性を強調しながら、フェイクニュースがもたらす課題の概要を説明しました。

次に、大量のデータでトレーニングされる高度な AI モデルとして LLM の概念を導入しました。 この広範なトレーニングにより、これらのモデルは言語に対する優れた理解を誇り、人間のようなテキストを生成できるようになります。 この機能を利用して、Chain-of-Thought と ReAct という XNUMX つの異なるプロンプト手法を使用して、フェイク ニュースとの戦いで LLM をどのように活用できるかを実証しました。

私たちは、膨大な量のテキストを迅速に処理および分析する LLM の能力を考慮すると、LLM がいかにして比類のない規模でファクトチェック サービスを促進できるかを強調しました。 このリアルタイム分析の可能性により、フェイク ニュースの早期発見と封じ込めにつながる可能性があります。 私たちは、ステートメントが与えられたときに、その記事が真実か偽かを自然言語を使用してユーザーに強調表示する Python スクリプトを作成することで、これを説明しました。

私たちは、現在のアプローチの限界を強調して結論を導き、適切な保護手段と継続的な機能強化により、LLM がフェイク ニュースとの戦いに不可欠なツールになる可能性があることを強調し、希望に満ちた言葉で締めくくりました。

あなたからの御一報をお待ちしています。 コメントセクションでご意見をお聞かせいただくか、問題フォーラムをご利用ください。 GitHub リポジトリ。

免責事項: この投稿で提供されるコードは、教育および実験のみを目的としています。 現実世界の運用システムでフェイク ニュースや誤った情報を検出するために依存すべきではありません。 このコードを使用したフェイク ニュース検出の正確性または完全性については保証されません。 ユーザーは、機密性の高いアプリケーションでこれらの技術を利用する前に、注意を払い、デューデリジェンスを実行する必要があります。

Amazon Bedrock の使用を開始するには、次のサイトにアクセスしてください。 Amazon Bedrock コンソール.

著者について

アナマリア・トドール デンマークのコペンハーゲンを拠点とするプリンシパル ソリューション アーキテクトです。 彼女は 4 歳のときに初めてコンピューターに触れ、それ以来、コンピューター サイエンス、ビデオ ゲーム、エンジニアリングを手放すことはありませんでした。 彼女はデンマークのさまざまな企業で、ゲーム業界と広告業界を中心に、フリーランサー、フルスタック開発者からデータ エンジニア、テクニカル リード、CTO まで、さまざまな技術的役割を果たしてきました。 彼女は AWS に 3 年以上勤務し、プリンシパル ソリューション アーキテクトとして、主にライフ サイエンスと AI/ML に重点を置いて働いています。 Anamaria は、応用工学とコンピューター サイエンスの学士号、コンピューター サイエンスの修士号を取得しており、AWS で 10 年以上の経験があります。 仕事やビデオゲームをしていないときは、女子生徒や女性専門家にテクノロジーを理解し、テクノロジーを通じて自分の道を見つけるよう指導しています。

アナマリア・トドール デンマークのコペンハーゲンを拠点とするプリンシパル ソリューション アーキテクトです。 彼女は 4 歳のときに初めてコンピューターに触れ、それ以来、コンピューター サイエンス、ビデオ ゲーム、エンジニアリングを手放すことはありませんでした。 彼女はデンマークのさまざまな企業で、ゲーム業界と広告業界を中心に、フリーランサー、フルスタック開発者からデータ エンジニア、テクニカル リード、CTO まで、さまざまな技術的役割を果たしてきました。 彼女は AWS に 3 年以上勤務し、プリンシパル ソリューション アーキテクトとして、主にライフ サイエンスと AI/ML に重点を置いて働いています。 Anamaria は、応用工学とコンピューター サイエンスの学士号、コンピューター サイエンスの修士号を取得しており、AWS で 10 年以上の経験があります。 仕事やビデオゲームをしていないときは、女子生徒や女性専門家にテクノロジーを理解し、テクノロジーを通じて自分の道を見つけるよう指導しています。

マルセル・カストロ ノルウェーのオスロを拠点とするシニア ソリューション アーキテクトです。 マルセルはその役割において、クラウドに最適化されたインフラストラクチャのアーキテクチャ、設計、開発を支援します。 彼は AWS Generative AI アンバサダー チームのメンバーであり、EMEA の顧客の生成 AI への取り組みを推進およびサポートすることを目標としています。 彼はスウェーデンでコンピュータ サイエンスの博士号を取得し、ブラジルで電気工学と電気通信の修士号と学士号を取得しています。

マルセル・カストロ ノルウェーのオスロを拠点とするシニア ソリューション アーキテクトです。 マルセルはその役割において、クラウドに最適化されたインフラストラクチャのアーキテクチャ、設計、開発を支援します。 彼は AWS Generative AI アンバサダー チームのメンバーであり、EMEA の顧客の生成 AI への取り組みを推進およびサポートすることを目標としています。 彼はスウェーデンでコンピュータ サイエンスの博士号を取得し、ブラジルで電気工学と電気通信の修士号と学士号を取得しています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :持っている

- :は

- :not

- :どこ

- 100万ドル

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21

- 視聴者の38%が

- 27

- 32

- 36

- 7

- 9

- a

- 能力

- 私たちについて

- 上記の.

- AC

- アカデミック

- 学術研究

- アカデミー

- アクセス

- アクセス

- アクセス可能な

- アカウント

- 精度

- 達成する

- 実績

- 越えて

- 演技

- Action

- 行動

- 積極的に

- 俳優

- 実際に

- 加えます

- 添加

- NEW

- 高度な

- 出現

- 広告運用

- 再び

- に対して

- エージェント

- エージェント

- AI

- AIモデル

- AIシステム

- AI / ML

- AL

- すべて

- ことができます

- 一人で

- また

- しかし

- Amazon

- Amazon EC2

- Amazon Webサービス

- 大使

- アメリカ

- 間で

- 金額

- an

- 分析

- 分析します

- 古代

- および

- 年単位

- 別の

- 回答

- 回答

- 人間原理

- どれか

- API

- API

- 登場する

- 申し込み

- 適用された

- 任命された

- アプローチ

- アプローチ

- 約

- 建築

- です

- 引数

- 引数

- 周りに

- 記事

- 人工の

- 人工知能

- 人工知能(AI)

- 芸術

- AS

- 側面

- 評価中

- アセスメント

- 前提条件

- 確実な

- 天文学

- At

- 試み

- 増強

- 増強された

- 補強します

- 自動化

- 利用できます

- 受賞

- AWS

- AWS クラウド9

- ベース

- ベース

- bash

- 戦い

- BE

- なぜなら

- になる

- になる

- き

- 行動

- 背後に

- さ

- 信念

- ほかに

- の間に

- 越えて

- バイアス

- 10億

- 生物学

- 生物医学

- ボディ

- 両言語で

- ボット

- ブラジル

- 持って来る

- 壊れた

- 内蔵

- ビジネスマン

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- コール

- コール

- 缶

- 機能

- 機能

- 容量

- 場合

- 例

- 原因となる

- 注意

- 世紀

- チェーン

- チェーン

- 課題

- チャン

- チェック

- 化学

- 中国語

- 選択肢

- 選択する

- クレーム

- クレーム

- class

- 分類

- はっきりと

- クライアント

- 閉じる

- Cloud9

- コーチング

- コード

- コーディング

- 認知

- 収集する

- 集団

- カレッジ

- COLUMBIA

- 組み合わせ

- 注釈

- コマンドと

- 一般に

- コミュニティ

- 企業

- 比較

- 補完的

- コンプリート

- 複雑な

- 複雑さ

- コンポーネント

- 構成

- 計算

- コンピュータ

- コンピュータサイエンス

- コンセプト

- 終了する

- 確認します

- 確認

- 共同

- その結果

- 見なさ

- 整合性のある

- からなる

- 領事

- 消費する

- 消費者

- 消費

- 封じ込め

- 含まれています

- コンテンツ

- コンテンツ作成

- 連続的な

- 貢献

- コントロール

- controls

- 会話

- 正しい

- 費用

- コスト

- 可能性

- 国

- 国

- 作ります

- 作成した

- 作成します。

- 作成

- 創造

- クリエイティブ

- 創造性

- Credentials

- CTO

- 文化

- 歯止めをかける

- 電流プローブ

- Customers

- データ

- 議論

- 決定

- 定義済みの

- 定義する

- 度

- 民主的な

- 実証

- 実証

- デモ

- デンマーク

- 部門

- 展開

- 展開する

- 設計

- 細部

- 検出

- 検出

- 決定する

- 決定する

- 発展した

- Developer

- 開発

- 開発

- 進展

- 対話

- 異なります

- 勤勉

- 方向

- 話し合います

- 虚偽情報

- ディスプレイ

- 混乱

- 見分けます

- 不信

- 医師

- ありません

- そうではありません

- ダウン

- dr

- ドライブ

- 原因

- 間に

- e

- E&T

- 各

- 前

- 早い

- 稼ぐ

- 獲得

- EARTH

- 容易

- 簡単に

- Economics

- 経済

- 教育の

- 教育

- 効果

- 有効

- どちら

- 排除する

- 他の場所で

- EMEA

- 出現

- 強調

- 有効にする

- 終わった

- エンジニア

- エンジニアリング

- 強化

- 確保

- 入る

- エンティティ

- エンティティ

- 環境

- 平等

- エラー

- 特に

- 設立

- 評価します

- さらに

- イベント

- 進化

- 例

- 例

- 排他的に

- 運動

- 体験

- 説明する

- 探る

- 調査済み

- 広範囲

- 外部

- エキス

- 容易にする

- 促進された

- 実際

- 要因

- 事実

- フェイル

- 偽

- 偽のニュース

- false

- 有名な

- 女性

- フィールド

- 戦い

- 塗りつぶし

- ファイナル

- ファイナンシャル

- もう完成させ、ワークスペースに掲示しましたか?

- 発見

- 仕上げ

- 名

- 初回

- 柔軟性

- 焦点を当て

- 焦点を当てて

- 焦点

- フォロー中

- フォーム

- フォーマル

- フォーラム

- Foundation

- 基礎的な

- 設立

- フレームワーク

- から

- fu

- 完全に

- function

- 機能性

- Games

- 賭博

- ギャップ

- 性別

- 男女平等

- 生成する

- 生成された

- 生成

- 世代

- 生々しい

- 生成AI

- 取得する

- 女の子

- GitHubの

- 与えられた

- Go

- 目標

- 素晴らしい

- 陸上

- 保証

- 持っていました

- ハーネス

- 持ってる

- he

- 聞く

- 助けます

- ことができます

- 彼女の

- こちら

- 高品質

- より高い

- ハイライト

- 非常に

- 彼の

- history

- 保持している

- 名誉

- 希望に満ちた

- 住宅

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- 人間

- i

- IBM

- 特定され

- if

- 違法

- 説明します

- 画像

- 影響

- 実装する

- 実装

- 実装する

- import

- 重要

- 印象的

- 改善されました

- in

- できないこと

- include

- 含ま

- 含めて

- Incorporated

- 組み込む

- 増加した

- 増加

- を示し

- 個人

- 産業

- 情報

- インフォーム

- インフラ関連事業

- 初期

- 内部

- install

- インストール

- 機関

- 機関

- 統合された

- インテリジェンス

- 意図

- 相互作用

- 内部

- インターネット

- に

- 導入

- 呼び出す

- 関係する

- 問題

- 問題

- IT

- ITS

- 旅

- JPG

- JSON

- 裁判官

- ケニス

- 知っている

- 知識

- 既知の

- 欠如

- 言語

- 大

- 遅く

- 最新の

- ローマ字

- 打ち上げ

- 層

- つながる

- 主要な

- 学習

- 最低

- 合法的に

- う

- 生活

- 生命科学

- ような

- 制限

- LINE

- リンク

- linuxの

- リスト

- リストされた

- レポート

- LLM

- 論理的な

- より長いです

- 検索

- 愛

- MAC

- 機械

- 機械学習

- 製

- 主に

- 維持

- 主要な

- make

- 作る

- 作成

- マネージド

- 管理

- 多くの

- マーケティング

- mask

- マスターの

- 数学的

- 数学

- 五月..

- 手段

- 意味した

- メディア

- 医療の

- 薬

- メンバー

- メンバー

- メモリ

- 言及した

- 方法論

- ミシガン州

- 百万

- 鉱山

- 誤報

- 誤解を招く

- マサチューセッツ工科大学(MIT)

- 軽減する

- ミックス

- ML

- モデル

- 修正する

- 他には?

- 最も

- 運動

- の試合に

- my

- 名前付き

- 米航空宇宙局(NASA)

- 国民

- ナチュラル

- 自然

- 必要

- 必要とされる

- ネットワーク

- 決して

- 新作

- ニュース

- 次の

- いいえ

- ノーベル賞受賞者

- 規範

- ノルウェー

- 注目すべき

- ノート

- 今

- 数

- オブジェクト

- 観察

- 10月

- of

- 提供

- 頻繁に

- 古い

- on

- ONE

- オンライン

- の

- 業務執行統括

- 意見

- or

- 注文

- オリジナル

- その他

- さもないと

- 私たちの

- 輪郭

- 概説する

- 出力

- 傑出した

- が

- 全体

- 自分の

- 所有している

- 平和

- パッケージ

- ページ

- ページ

- 紙素材

- パラメータ

- 部

- パス

- 渡された

- 通過

- 特許

- path

- パターン

- のワークプ

- 完璧

- 実行する

- 個人的な

- 相

- 博士号

- 現象

- 哲学

- 物理学

- ピース

- 極めて重要な

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 再生

- ポイント

- 政治

- 可能

- ポスト

- 潜在的な

- 電力

- パワード

- PLM platform.

- プレゼント

- 流行している

- 前

- 前に

- 主に

- 校長

- 原則

- printing

- 印刷機

- 事前の

- 賞品

- 問題

- プロセス

- ラボレーション

- 作り出す

- 生産

- 専門家

- 深遠な

- 演奏曲目

- 提案する

- 提案された

- 提供します

- 提供

- プロバイダ

- は、大阪で

- 提供

- Psychology

- 公共

- 購入

- 目的

- Python

- 品質

- 量

- すぐに

- ラジオ

- ランダム

- 範囲

- ランク

- 急速な

- 急速に

- 比

- リーチ

- 反応する

- 現実の世界

- への

- 理由

- 受け取ります

- 受け

- レシピ

- 認識

- 推奨する

- 参照する

- 指し

- 関連する

- 相対的に

- 関連した

- 信頼性のある

- 繰り返し

- 倉庫

- 要求

- 必要とする

- の提出が必要です

- 研究

- 共鳴する

- リソース

- 反応します

- 応答

- 回答

- 責任

- return

- 収益

- 富裕層

- リスク

- 職種

- 役割

- ラウンド

- ラン

- ランニング

- runs

- s

- 保障措置

- セージメーカー

- 同じ

- Save

- 見ました

- 規模

- 学校

- 工学系研究科

- 科学

- 科学

- 科学的な

- 科学者たち

- スクリプト

- SDDK

- を検索

- セクション

- セクション

- 選択

- シニア

- 敏感な

- 文

- 感情

- シーケンス

- サービス

- サービス

- セッションに

- シェアする

- shared

- 株式

- シェアリング

- 彼女

- シェル(Shell)

- すべき

- 表示する

- 同様の

- 同様に

- 簡単な拡張で

- から

- 姉妹

- So

- 社会

- ソーシャルメディア

- 社会的

- 社会

- 溶液

- ソリューション

- 一部

- ソース

- ソースコード

- ソース

- スペース

- 緊張

- 特に

- スピード

- 広がる

- 広がる

- ステージ

- 標準

- スタンフォード

- スタンフォード大学

- 開始

- ステートメント

- 文

- 米国

- ステップ

- Force Stop

- ストーム

- 戦略

- 強化

- 構造

- 生徒

- 勉強

- それに続きます

- かなりの

- 首尾よく

- そのような

- 示唆する

- 概要

- スーパーチャージ

- サポート

- 確か

- スウェイ

- Sweden

- 素早く

- 合成

- システム

- タックル

- 取る

- 取り

- 仕事

- タスク

- チーム

- 技術的

- 技術

- テクニック

- 技術の

- テクノロジー

- 電気通信

- template

- ターミナル

- 条件

- test

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- テキスト

- それ

- 情報

- ソース

- 世界

- アプリ環境に合わせて

- それら

- その後

- そこ。

- それによって

- したがって、

- ボーマン

- 彼ら

- 考える

- サードパーティ

- この

- それらの

- 考え

- 介して

- 全体

- TIE

- 時間

- タイムライン

- 〜へ

- 一緒に

- トークン

- トークン

- 豊富なツール群

- 訓練された

- トレーニング

- true

- 真実

- チュートリアル

- 2

- 最終的に

- 下線

- 理解する

- ユナイテッド

- 米国

- 大学

- 大学

- 圧倒的な

- 前例のない

- まで

- アップグレード

- に

- us

- つかいます

- 中古

- ユーザー

- users

- 使用されます

- 活用

- 値

- さまざまな

- 広大な

- 評決

- 検証

- 確認する

- バージョン

- 非常に

- 、

- ビデオ

- ビデオゲーム

- 訪問

- ました

- we

- ウェブ

- Webサービス

- WELL

- この試験は

- いつ

- かどうか

- which

- while

- 誰

- 全体

- なぜ

- Wikipedia

- 意志

- ウィンドウズ

- 以内

- 女性

- レディース

- 勝った

- Word

- 言葉

- 仕事

- 働いていました

- ワークフロー

- ワーキング

- 世界

- 価値

- 間違った

- 年

- You

- あなたの

- ゼファーネット