人工知能 (AI) と機械学習 (ML) の世界では、人間のようなテキスト、画像、コード、音声を作成できるジェネレーティブ AI モデルの台頭により、パラダイム シフトが起きています。 従来の ML モデルと比較して、ジェネレーティブ AI モデルは非常に大きく複雑です。 ただし、複雑さが増すと、推論にかかるコストが高くなり、強力なコンピューティング リソースの必要性が高まります。 ジェネレーティブ AI モデルの推論コストが高いことは、限られたリソースを持つ企業や研究者にとって参入障壁となる可能性があり、より効率的で費用対効果の高いソリューションが必要になります。 さらに、ジェネレーティブ AI のユースケースの大部分は、人間の相互作用または現実世界のシナリオに関係しているため、低レイテンシのパフォーマンスを提供できるハードウェアが必要です。 AWS は、強力で効率的で費用対効果の高いコンピューティング ハードウェアに対する高まるニーズに対応するために、専用のチップを使用して革新を続けてきました。

本日は、 アマゾンセージメーカー サポート AWS インフェレンシア 2 (ml.inf2) および AWS トレーニング (ml.trn1) ベースの SageMaker インスタンスで、リアルタイムおよび非同期推論用の生成 AI モデルをホストします。 ml.inf2 インスタンスは、米国東部 (オハイオ) の SageMaker と米国東部 (バージニア北部) の ml.trn1 インスタンスでのモデル展開に使用できます。

これらのインスタンスを SageMaker で使用して、ラージ言語モデル (LLM)、Stable Diffusion、ビジョン トランスフォーマーなどの生成 AI モデルで低コストで高いパフォーマンスを実現できます。 さらに、使用できます AmazonSageMaker推論レコメンダー 負荷テストを実行し、これらのインスタンスにモデルをデプロイすることのコスト パフォーマンスの利点を評価するのに役立ちます。

ml.inf2 および ml.trn1 インスタンスを使用して、SageMaker で ML アプリケーションを実行して、テキストの要約、コード生成、ビデオと画像の生成、音声認識、パーソナライズ、不正検出などを行うことができます。 SageMaker エンドポイントを設定するときに ml.trn1 または ml.inf2 インスタンスを指定することで、簡単に開始できます。 PyTorch、TensorFlow、Hugging Face、大規模モデル推論 (LMI) 用の ml.trn1 および ml.inf2 互換の AWS Deep Learning Containers (DLC) を使用して、簡単に開始できます。 バージョンの完全なリストについては、を参照してください。 利用可能なディープラーニングコンテナの画像.

この投稿では、LMI コンテナを利用して、追加のコーディングを必要とせずに、SageMaker を使用して AWS Inferentia2 に大規模な言語モデルをデプロイするプロセスを示します。 私たちは、 GPT4ALL-J、微調整された GPT-J 7B モデルで、チャットボット スタイルの対話を提供します。

ml.trn1 および ml.inf2 インスタンスの概要

ml.trn1 インスタンスは、LLM を含む生成 AI モデルの高性能ディープラーニング トレーニングを主な目的として構築された、Trainium アクセラレータを利用しています。 ただし、これらのインスタンスは、Inf2 に収まるものよりもさらに大きなモデルの推論ワークロードもサポートします。 最大のインスタンス サイズである trn1.32xlarge インスタンスには、16 個の機能があります トレニウム加速器 512 つのインスタンスで 3.4 GB のアクセラレータ メモリを使用して、最大 16 ペタフロップスの FP16/BF16 コンピューティング パワーを提供します。 2台のTrainiumアクセラレータが超高速のNeuronLinkvXNUMXに接続され、集合通信が合理化されます。

ml.Inf2 インスタンスは、 AWS Inferentia2 アクセラレーター、推論専用のアクセラレータ。 第 10 世代の AWS Inferentia と比較して、2.48 倍のコンピューティング パフォーマンス、最大 12 倍のスループット、最大 2 分の 384 のレイテンシーを実現します。 最大のインスタンス サイズである Inf2.3xlarge は、16 つのインスタンスに 16 GB のアクセラレータ メモリを備えた 175 個の AWS Inferentia2 アクセラレータを備えており、BF2/FPXNUMX で合計 XNUMX ペタフロップスの計算能力を発揮します。 XNUMX つのインスタンスで最大 XNUMX 億のパラメーター モデルをデプロイできます。 InfXNUMX は、より高価なトレーニング インスタンスでのみ利用可能な機能であるこの相互接続を提供する唯一の推論最適化インスタンスです。 単一のアクセラレータに収まらない超大規模モデルの場合、データは NeuronLink を使用してアクセラレータ間を直接流れ、CPU を完全にバイパスします。 NeuronLink を使用すると、InfXNUMX はより高速な分散推論をサポートし、スループットとレイテンシを改善します。

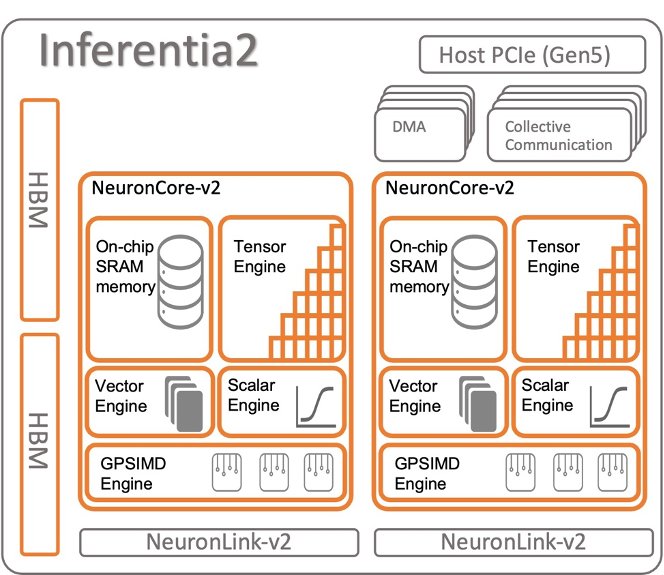

AWS Inferentia2 と Trainium アクセラレータの両方に XNUMX つの ニューロンコア-v2、32 GB HBM メモリ スタック、およびマルチ アクセラレータの推論を行う際に計算と通信をオーバーラップさせることによりランタイムを自動的に最適化する専用の集合計算エンジン。 アーキテクチャの詳細については、次を参照してください。 Trainium および Inferentia デバイス.

次の図は、AWS Inferentia2 を使用したアーキテクチャの例を示しています。

AWS ニューロン SDK

AWS ニューロン AWS Inferentia および Trainium ベースのインスタンスで深層学習ワークロードを実行するために使用される SDK です。 AWS Neuron には、深層学習コンパイラ、ランタイム、および TensorFlow と PyTorch にネイティブに統合されたツールが含まれています。 Neuron を使用すると、ml.trn1 と ml.inf2 で高性能 ML ワークロードを開発、プロファイリング、デプロイできます。

ニューロン コンパイラ さまざまな形式 (TensorFlow、PyTorch、XLA HLO) の ML モデルを受け入れ、Neuron デバイスで実行できるように最適化します。 Neuron コンパイラは ML フレームワーク内で呼び出され、そこで ML モデルが Neuron フレームワーク プラグインによってコンパイラに送信されます。 結果のコンパイラ アーティファクトは NEFF ファイル (Neuron Executable File Format) と呼ばれ、Neuron ランタイムによって Neuron デバイスにロードされます。

ニューロンの実行時間 AWS Inferentia および Trainium Neuron デバイスにアクセスするための API を提供するカーネルドライバーと C/C++ ライブラリで構成されています。 TensorFlow および PyTorch 用の Neuron ML フレームワーク プラグインは、Neuron ランタイムを使用して、NeuronCore でモデルをロードおよび実行します。 Neuron ランタイムは、コンパイルされた深層学習モデル (NEFF) を Neuron デバイスにロードし、高スループットと低遅延のために最適化されています。

SageMaker ml.inf2 インスタンスを使用して NLP モデルをホストする

LLM の提供について深く掘り下げる前に、 トランスフォーマー・ニューロンクスは、モデルの大きな重み行列を複数の NeuronCore に分割するためのオープンソース ライブラリです。単一の NeuronCore に収まるモデルの一般的な展開フローを簡単に見ていきましょう。

チェック 対応機種一覧 モデルが AWS Inferentia2 でサポートされていることを確認します。 次に、モデルを Neuron Compiler で事前にコンパイルする必要があります。 SageMaker ノートブックまたは アマゾン エラスティック コンピューティング クラウド (Amazon EC2) インスタンスを使用してモデルをコンパイルします。 次のコードに示すように、SageMaker Python SDK を使用して、PyTorch などの一般的な深層学習フレームワークを使用してモデルをデプロイできます。 モデルを SageMaker ホスティング サービスにデプロイし、推論に使用できるエンドポイントを取得できます。 これらのエンドポイントは完全に管理されており、自動スケーリングをサポートしています。

参照する 開発者フロー サンプル スクリプトを使用した SageMaker での Inf2 の一般的な開発フローの詳細については、こちらをご覧ください。

SageMaker ml.inf2 インスタンスを使用して LLM をホストする

数十億のパラメーターを持つ大規模な言語モデルは、多くの場合、大きすぎて単一のアクセラレーターに収まりません。 これには、複数のアクセラレータにわたって LLM をホストするためのモデル並列手法の使用が必要になります。 LLM をホストするためのもう XNUMX つの重要な要件は、高性能モデル サービス ソリューションの実装です。 このソリューションは、モデルを効率的にロードし、パーティショニングを管理し、HTTP エンドポイントを介してリクエストをシームレスに処理する必要があります。

SageMaker には、モデルの並列処理と大規模なモデルの推論に特化した深層学習コンテナ (DLC)、ライブラリ、ツールが含まれています。 SageMaker で LMI を開始するためのリソースについては、以下を参照してください。 モデルの並列処理と大規模なモデルの推論. SageMaker は、AWS インフラストラクチャで GPT、T5、OPT、BLOOM、Stable Diffusion などの大規模モデルをホストするための一般的なオープンソース ライブラリを使用して DLC を維持しています。 これらの特殊な DLC は、SageMaker LMI コンテナと呼ばれます。

SageMaker LMI コンテナ Transformers-neuronx ライブラリと統合されたモデル サーバーである DJLServing を使用して、NeuronCore 全体でテンソルの並列処理をサポートします。 DJLServing の仕組みの詳細については、次を参照してください。 DJLServing と DeepSpeed モデルの並列推論を使用して、Amazon SageMaker に大規模なモデルをデプロイする. DJL モデル サーバーと Transformers-neuronx ライブラリは、コンテナのコア コンポーネントとして機能し、Neuron SDK も含まれています。 この設定により、AWS Inferentia2 アクセラレータへのモデルのロードが容易になり、複数の NeuronCore でモデルが並列化され、HTTP エンドポイントを介したサービスが可能になります。

LMI コンテナは、コンテナからのモデルのロードをサポートしています。 Amazon シンプル ストレージ サービス (Amazon S3) バケットまたはハグ フェイス ハブ。 デフォルトのハンドラー スクリプトはモデルをロードし、コンパイルして Neuron に最適化された形式に変換し、ロードします。 LMI コンテナーを使用して LLM をホストするには、次の XNUMX つのオプションがあります。

- ノーコード (推奨) – これは、LMI コンテナーを使用して LLM を展開する最も簡単な方法です。 このメソッドでは、提供された デフォルトのハンドラー モデル名と必要なパラメータを渡すだけです

serving.propertiesファイルをロードしてモデルをホストします。 デフォルトのハンドラーを使用するには、entryPointパラメータとしてdjl_python.transformers-neuronx. - 自分のスクリプトを持ってくる – このアプローチでは、モデルのロードと提供に必要なコードを含む独自の model.py ファイルを作成するオプションがあります。 このファイルは、

DJLServingAPI とtransformers-neuronxAPI。 モデルのロード プロセスをカスタマイズするには、以下を指定できます。serving.properties構成可能なパラメーターを使用します。 利用可能な構成可能なパラメーターの包括的なリストについては、次を参照してください。 すべての DJL 構成オプション。 これが例です モデル.py ファイルにソフトウェアを指定する必要があります。

ランタイム アーキテクチャ

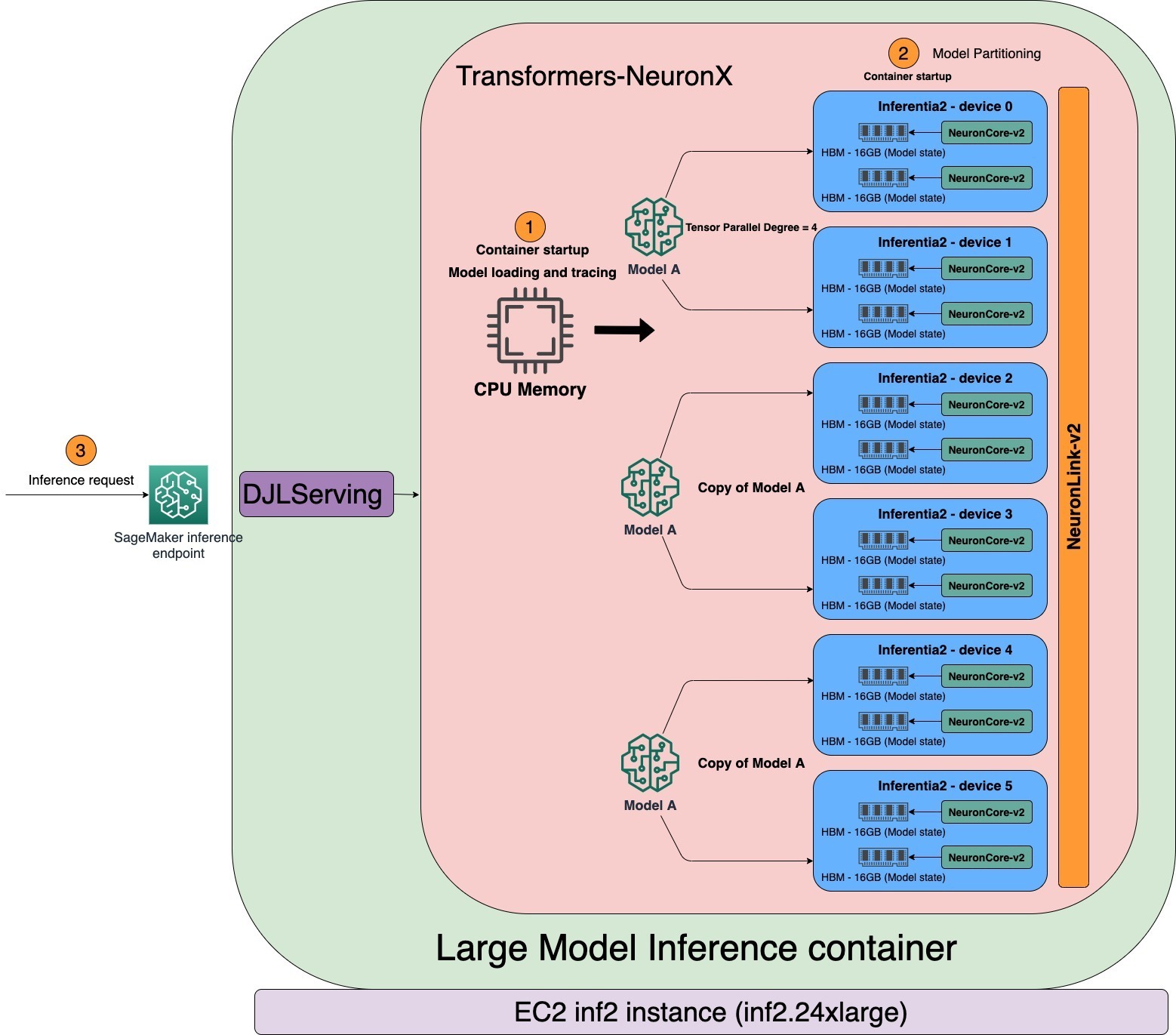

tensor_parallel_degree プロパティ値は、複数の NeuronCore にわたるテンソル並列モジュールの分散を決定します。 たとえば、inf2.24xlarge には 2 つの AWS Inferentia2 アクセラレーターがあります。 各 AWS Inferentia16 アクセラレーターには 4 つの NeuronCore があります。 各 NeuronCore には、テンソル並列モジュールを格納する XNUMX GB の専用の高帯域幅メモリ (HBM) があります。 テンソルの並列度が XNUMX の場合、LMI は同じモデルの XNUMX つのモデル コピーを割り当て、それぞれが XNUMX つの NeuronCore を使用します。 次の図に示すように、LMI コンテナーが開始すると、モデルがロードされ、最初に CPU のアドレス指定可能なメモリにトレースされます。 トレースが完了すると、テンソルの並列度に基づいてモデルが NeuronCore に分割されます。

LMI は、そのモデル サービング スタックとして DJLServing を使用します。 SageMaker でコンテナのヘルスチェックに合格すると、コンテナは推論リクエストを処理する準備が整います。 DJLServing は、に相当する複数の Python プロセスを起動します。 TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. 各 Python プロセスには、C++ に相当するスレッドが含まれています。 TENSOR_PARALLEL_DEGREE. 各 C++ スレッドは、XNUMX つの NeuronCore でモデルの XNUMX つのシャードを保持します。

多くの実践者 (Python プロセス) は、サーバーが複数の独立した要求で呼び出されると、推論を順次実行する傾向があります。 セットアップは簡単ですが、通常、アクセラレータの計算能力を利用することはベスト プラクティスではありません。 これに対処するために、DJLServing は動的バッチ処理の組み込みの最適化を提供し、サーバー側でこれらの独立した推論要求を組み合わせてより大きなバッチを動的に形成し、スループットを向上させます。 すべての要求は、最初に動的バッチャーに到達してから、実際のジョブ キューに入って推論を待ちます。 を使用して、動的バッチ処理の優先バッチ サイズを設定できます。 batch_size の設定 serving.properties. 構成することもできます max_batch_delay レイテンシの要件に基づいて、他のリクエストがバッチに参加するのを待つバッチャーの最大遅延時間を指定します。 スループットは、モデル コピーの数とコンテナーで起動された Python プロセス グループにも依存します。 次の図に示すように、テンソルの並列度を 4 に設定すると、LMI コンテナーは XNUMX つの Python プロセス グループを起動し、それぞれがモデルの完全なコピーを保持します。 これにより、バッチ サイズを増やしてスループットを向上させることができます。

LLM をデプロイするための SageMaker ノートブック

このセクションでは、FP4 で 6 GB の 24 億パラメーター モデルである GPT32All-J を展開するための段階的なウォークスルーを提供します。 GPT4All-J は、文章問題、会話、コード、詩、歌、物語など、さまざまなインタラクション コンテンツでトレーニングされた人気のチャットボットです。 GPT4all-J は微調整された GPT-J モデルで、人間とのやり取りに似た応答を生成します。

この例の完全なノートブックは、 GitHubの. SageMaker Python SDK を使用して、モデルを Inf2 インスタンスにデプロイできます。 提供されたものを使用します デフォルトのハンドラー モデルをロードします。 これで、提供する必要があるのは サービング.プロパティ ファイル。 このファイルには、DJL モデル サーバーがモデルをダウンロードしてホストするために必要な構成が含まれています。 を使用して、Hugging Face モデルの名前を指定できます。 model_id パラメータを使用して、Hugging Face リポジトリからモデルを直接ダウンロードします。 または、Amazon S3 からモデルをダウンロードすることもできます。 s3url パラメータ。 ザ・ entryPoint パラメータは、モデルをロードするライブラリを指すように構成されています。 詳細については、 djl_python.fastertransformerを参照してください。 GitHubコード.

tensor_parallel_degree プロパティ値は、複数のデバイス間でのテンソル並列モジュールの分散を決定します。 たとえば、12 個の NeuronCore と 4 のテンソル並列度の場合、LMI は XNUMX つのモデル コピーを割り当て、それぞれが XNUMX 個の NeuronCore を使用します。 プロパティを使用して精度タイプを定義することもできます dtype. n_position パラメーターは、モデルの最大入力シーケンス長と出力シーケンス長の合計を定義します。 次のコードを参照してください。

構築する tarball 含む serving.properties S3 バケットにアップロードします。 この例ではデフォルトのハンドラーが使用されていますが、 model.py 読み込みと提供のプロセスをカスタマイズするためのファイル。 インストールが必要なパッケージがある場合は、それらを requirements.txt ファイル。 次のコードを参照してください。

DJL コンテナ イメージを取得し、SageMaker モデルを作成します。

次に、前に定義したモデル構成で SageMaker エンドポイントを作成します。 コンテナはモデルを /tmp SageMaker が /tmp 〜へ Amazon Elastic Blockストア (Amazon EBS)。 追加する必要があります volume_size パラメータを確保する /tmp ディレクトリには、モデルをダウンロードしてコンパイルするのに十分なスペースがあります。 設定しました container_startup_health_check_timeout モデルの準備が整った後にヘルスチェックが確実に開始されるように、3,600 秒まで。 ml.inf2.8xlarge インスタンスを使用します。 次のコードを参照してください。

SageMaker エンドポイントが作成されたら、以下を使用して SageMaker エンドポイントに対してリアルタイムの予測を行うことができます。 Predictor オブジェクト:

クリーンアップ

テストが終了したら、コストを節約するためにエンドポイントを削除します。

まとめ

この投稿では、生成 AI モデルをホストするために ml.inf2 および ml.trn1 インスタンスをサポートするようになった SageMaker の新しくリリースされた機能を紹介しました。 コードを一切記述せずに、SageMaker と LMI コンテナを使用して、生成 AI モデルである GPT4ALL-J を AWS Inferentia2 にデプロイする方法を示しました。 また、DJLServing と transformers-neuronx モデルをロードし、分割して提供します。

Inf2 インスタンスは、AWS でジェネレーティブ AI モデルを実行するための最も費用対効果の高い方法を提供します。 性能の詳細については、 Inf2 パフォーマンス.

チェックアウトします GitHubの サンプルノートブックのレポ。 試してみて、ご不明な点がありましたらお知らせください。

著者について

Vivek ガンガサニ アマゾン ウェブ サービスのシニア機械学習ソリューション アーキテクトです。 彼は Machine Learning Startups と協力して、AWS で AI/ML アプリケーションを構築およびデプロイしています。 彼は現在、MLOps、ML 推論、およびローコード ML のソリューションの提供に注力しています。 彼は、自然言語処理やコンピューター ビジョンなど、さまざまな分野のプロジェクトに取り組んできました。

Vivek ガンガサニ アマゾン ウェブ サービスのシニア機械学習ソリューション アーキテクトです。 彼は Machine Learning Startups と協力して、AWS で AI/ML アプリケーションを構築およびデプロイしています。 彼は現在、MLOps、ML 推論、およびローコード ML のソリューションの提供に注力しています。 彼は、自然言語処理やコンピューター ビジョンなど、さまざまな分野のプロジェクトに取り組んできました。

常世博 AWS Annapurna Labs のソリューション アーキテクトです。 日本に拠点を置き、AWS による買収前から Annapurna Labs に参加し、Annapurna Labs テクノロジーで一貫して顧客を支援してきました。 彼の最近の焦点は、専用のシリコン、AWS Inferentia、Trainium に基づく機械学習ソリューションです。

常世博 AWS Annapurna Labs のソリューション アーキテクトです。 日本に拠点を置き、AWS による買収前から Annapurna Labs に参加し、Annapurna Labs テクノロジーで一貫して顧客を支援してきました。 彼の最近の焦点は、専用のシリコン、AWS Inferentia、Trainium に基づく機械学習ソリューションです。

ダワル・パテル AWSのプリンシパル機械学習アーキテクトです。 彼は、分散コンピューティングや人工知能に関連する問題について、大企業から中規模の新興企業に至るまでの組織と協力してきました。 彼は、NLPおよびコンピュータービジョンドメインを含むディープラーニングに焦点を当てています。 彼は、顧客がSageMakerで高性能モデルの推論を実現するのを支援します。

ダワル・パテル AWSのプリンシパル機械学習アーキテクトです。 彼は、分散コンピューティングや人工知能に関連する問題について、大企業から中規模の新興企業に至るまでの組織と協力してきました。 彼は、NLPおよびコンピュータービジョンドメインを含むディープラーニングに焦点を当てています。 彼は、顧客がSageMakerで高性能モデルの推論を実現するのを支援します。

青蘭 AWS のソフトウェア開発エンジニアです。 彼は、高性能 ML 推論ソリューションや高性能ロギング システムなど、Amazon でいくつかの挑戦的な製品に取り組んできました。 Qing のチームは、Amazon Advertising で最初の XNUMX 億パラメータ モデルを成功裏に立ち上げ、非常に低いレイテンシーを必要としました。 Qing は、インフラストラクチャの最適化とディープ ラーニングの高速化に関する深い知識を持っています。

青蘭 AWS のソフトウェア開発エンジニアです。 彼は、高性能 ML 推論ソリューションや高性能ロギング システムなど、Amazon でいくつかの挑戦的な製品に取り組んできました。 Qing のチームは、Amazon Advertising で最初の XNUMX 億パラメータ モデルを成功裏に立ち上げ、非常に低いレイテンシーを必要としました。 Qing は、インフラストラクチャの最適化とディープ ラーニングの高速化に関する深い知識を持っています。

チンウェイ・リー アマゾンウェブサービスの機械学習スペシャリストです。 彼は博士号を取得しました。 アドバイザーの研究助成金口座を破り、約束したノーベル賞を授与できなかった後、オペレーションズリサーチで。 現在、彼は金融サービスおよび保険業界の顧客がAWSで機械学習ソリューションを構築するのを支援しています。 暇なときは、読書と教育が好きです。

チンウェイ・リー アマゾンウェブサービスの機械学習スペシャリストです。 彼は博士号を取得しました。 アドバイザーの研究助成金口座を破り、約束したノーベル賞を授与できなかった後、オペレーションズリサーチで。 現在、彼は金融サービスおよび保険業界の顧客がAWSで機械学習ソリューションを構築するのを支援しています。 暇なときは、読書と教育が好きです。

アランタン 大規模モデルの推論に関する SageMaker の主要な取り組みのシニア プロダクト マネージャーです。 彼は機械学習を分析の分野に適用することに情熱を注いでいます。 仕事以外では、アウトドアを楽しんでいます。

アランタン 大規模モデルの推論に関する SageMaker の主要な取り組みのシニア プロダクト マネージャーです。 彼は機械学習を分析の分野に適用することに情熱を注いでいます。 仕事以外では、アウトドアを楽しんでいます。

ヴァルン・シャル ML 推論プラットフォームの重要な顧客向け機能に取り組んでいる AWS Sagemaker のソフトウェア開発エンジニアです。 彼は、分散システムと AI の分野で働くことに情熱を注いでいます。 余暇には、読書とガーデニングが好きです。

ヴァルン・シャル ML 推論プラットフォームの重要な顧客向け機能に取り組んでいる AWS Sagemaker のソフトウェア開発エンジニアです。 彼は、分散システムと AI の分野で働くことに情熱を注いでいます。 余暇には、読書とガーデニングが好きです。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- プラトアイストリーム。 Web3 データ インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- 未来を鋳造する w エイドリエン・アシュリー。 こちらからアクセスしてください。

- PREIPO® を使用して PRE-IPO 企業の株式を売買します。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :持っている

- :は

- :not

- :どこ

- $UP

- 10

- 100

- 12

- 13

- 14

- 視聴者の38%が

- 22

- 24

- 7

- 8

- 9

- a

- 私たちについて

- 加速器

- 加速器

- 受け入れる

- アクセス

- 達成する

- 買収

- 越えて

- 使徒行伝

- 加えます

- 添加

- 住所

- アドレス可能

- 利点

- 広告運用

- 後

- に対して

- AI

- aiのユースケース

- AI / ML

- すべて

- ことができます

- また

- しかし

- Amazon

- Amazon EC2

- アマゾンセージメーカー

- Amazon Webサービス

- an

- 分析論

- および

- アナウンス

- 別の

- どれか

- API

- 適用

- アプローチ

- 建築

- です

- AREA

- 人工の

- 人工知能

- 人工知能(AI)

- AS

- At

- オーディオ

- オート

- 自動的に

- 利用できます

- AWS

- AWSインフェレンティア

- 玉

- 帯域幅

- バリア

- ベース

- BE

- なぜなら

- き

- 利点

- BEST

- の間に

- ビッグ

- より大きい

- 億

- ブロック

- ブログ

- ブルーム

- 簡潔に

- 壊れた

- ビルド

- 内蔵

- 内蔵

- ビジネス

- by

- C + +

- 呼ばれます

- 缶

- 例

- 挑戦

- チャットボット

- チェック

- チップ

- コード

- コーディング

- 集団

- 組み合わせる

- 組み合わせた

- comes

- コミュニケーション

- 通信部

- 比べ

- 互換性のあります

- コンプリート

- 完全に

- 複雑な

- 複雑さ

- コンポーネント

- 包括的な

- 計算

- 計算

- コンピュータ

- Computer Vision

- コンピューティング

- 交流

- コンテナ

- コンテナ

- 含まれています

- コンテンツ

- 基本

- 費用

- コスト効率の良い

- コスト

- 作ります

- 作成した

- 重大な

- 重大な

- 現在

- 顧客

- Customers

- カスタマイズ

- データ

- 専用の

- 深いです

- 深い学習

- デフォルト

- 定義済みの

- 定義する

- 度

- 遅らせる

- 配信する

- 配信する

- 提供します

- 実証

- 依存

- 展開します

- 展開する

- 展開

- 細部

- 検出

- 決定する

- 開発する

- 開発

- デバイス

- Devices

- 異なります

- 直接に

- 配布

- 分散コンピューティング

- 分散システム

- ディストリビューション

- すること

- ドメイン

- ドント

- ダウンロード

- ダウンロード

- ドライバー

- ダイナミック

- 動的に

- 各

- 前

- 容易

- 最も簡単

- 簡単に

- 東

- 効率的な

- 効率良く

- 努力

- 可能

- end

- エンドポイント

- エンジニア

- エンジン

- 十分な

- 確保

- 入る

- 企業

- エントリ

- 同等の

- 評価する

- さらに

- 例

- 興奮した

- 高価な

- 余分な

- 顔

- 促進する

- 向い

- Failed:

- 速いです

- 特徴

- 特徴

- File

- ファイナンシャル

- 金融サービス

- 仕上げ

- 名

- フィット

- フロー

- 流れ

- フォーカス

- 焦点を当て

- 焦点を当てて

- フォロー中

- フォーム

- 形式でアーカイブしたプロジェクトを保存します.

- 4

- フレームワーク

- フレームワーク

- 詐欺

- 不正検出

- から

- フル

- 完全に

- さらに

- 生成

- 世代

- 生々しい

- 生成AI

- 取得する

- Go

- 助成金

- グループの

- 成長

- Hardware

- 持ってる

- he

- 健康

- 助けます

- 助けました

- ことができます

- こちら

- ハイ

- ハイパフォーマンス

- より高い

- 彼の

- 開催

- 保持している

- host

- ホスティング

- ホスティングサービス

- お家の掃除

- 認定条件

- How To

- しかしながら

- HTML

- HTTP

- HTTPS

- ハブ

- 人間

- if

- 画像

- 画像

- 実装

- import

- in

- 綿密な

- include

- 含ま

- 含めて

- 増える

- の増加

- 独立しました

- 産業を変えます

- インフラ

- 革新的

- 入力

- インストール

- 保険

- 統合された

- インテリジェンス

- 相互作用

- 相互作用

- 中間の

- に

- 呼び出された

- 巻き込む

- IT

- ITS

- 日本

- ジョブ

- join

- 参加した

- JPG

- JSON

- ただ

- 知っている

- 知識

- ラボ

- 言語

- 大

- 大企業

- より大きい

- 最大の

- レイテンシ

- 打ち上げ

- 起動

- 主要な

- LEARN

- 学習

- 長さ

- う

- ライブラリ

- 図書館

- ような

- 好き

- 限定的

- リスト

- LLM

- 負荷

- ローディング

- 負荷

- ロギング

- ロー

- 下側

- 最低

- 機械

- 機械学習

- 主に

- 維持

- 大多数

- make

- 管理します

- マネージド

- マネージャー

- ゲレンデマップ

- マックス

- メモリ

- 方法

- ML

- MLOps

- モデル

- モジュール

- 他には?

- もっと効率的

- 最も

- の試合に

- 名

- ナチュラル

- 自然言語処理

- 必要

- 必要

- ニーズ

- 新作

- ニューヨーク

- 次の

- NLP

- ノーベル賞

- ノート

- 今

- 数

- オブジェクト

- of

- 提供

- オファー

- 頻繁に

- オハイオ

- on

- ONE

- の

- オープンソース

- 業務執行統括

- 最適化

- 最適化

- 最適化

- 最適化

- オプション

- オプション

- or

- 組織

- その他

- 私たちの

- でる

- 屋外で

- 出力

- 外側

- 自分の

- パッケージ

- パラダイム

- 並列シミュレーションの設定

- パラメーター

- パラメータ

- パス

- パス

- 情熱的な

- パフォーマンス

- 個人化

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- プラグイン

- プラグイン

- ポイント

- 人気

- ポスト

- 電力

- パワード

- 強力な

- 練習

- 精度

- 予測

- Predictor

- 優先

- 校長

- 賞

- 問題

- プロセス

- ラボレーション

- 処理

- プロダクト

- プロダクトマネージャー

- 製品

- プロフィール

- プロジェクト(実績作品)

- 約束された

- プロパティ

- 財産

- 提供します

- 提供

- は、大阪で

- 提供

- 目的

- Python

- パイトーチ

- 測距

- リーチ

- リーディング

- 準備

- 現実の世界

- への

- 受け

- 最近

- 認識

- 言及

- 関連する

- 要求

- リクエスト

- の提出が必要です

- 要件

- 要件

- 研究

- 研究者

- リソース

- 回答

- 結果として

- 上昇

- ラン

- セージメーカー

- SageMaker の推論

- 同じ

- Save

- スケーリング

- シナリオ

- スクリプト

- SDDK

- シームレス

- 秒

- セクション

- シニア

- シーケンス

- 役立つ

- サービス

- サービス

- サービング

- セッションに

- 設定

- いくつかの

- シフト

- すべき

- 表示する

- ショーケース

- 示す

- 作品

- 側

- 著しく

- シリコン

- 同様の

- 簡単な拡張で

- SIX

- サイズ

- サイズ

- So

- ソフトウェア

- ソフトウェア開発

- 溶液

- ソリューション

- スペース

- 専門家

- 専門の

- スピーチ

- 音声認識

- 安定した

- スタック

- スタック

- start

- 開始

- 開始

- スタートアップ

- ストレージ利用料

- ストーリー

- 保存

- 合理化された

- 首尾よく

- そのような

- サポート

- サポート

- サポート

- システム

- 取得

- ティーチング

- チーム

- テクニック

- テクノロジー

- テンソルフロー

- テスト

- より

- それ

- エリア

- アプリ環境に合わせて

- それら

- そこ。

- ボーマン

- この

- 三

- 介して

- スループット

- 時間

- <font style="vertical-align: inherit;">回数</font>

- 〜へ

- あまりに

- 豊富なツール群

- トレーシング

- 訓練された

- トレーニング

- トランスフォーマー

- 順番

- 2

- type

- 典型的な

- アップロード

- us

- つかいます

- 中古

- 通常

- 活用する

- 活用

- 値

- 多様

- さまざまな

- 広大な

- 非常に

- 、

- ビデオ

- バージニア州

- ビジョン

- wait

- ウォークスルー

- 仕方..

- we

- ウェブ

- Webサービス

- 重量

- この試験は

- いつ

- which

- 意志

- 以内

- 無し

- 目撃

- Word

- 仕事

- 働いていました

- ワーキング

- 作品

- 世界

- 書きます

- 書き込み

- ヨーク

- You

- あなたの

- ゼファーネット