大規模言語モデル (LLM) は幅広い知識を備えており、ほぼすべてのトピックについて人間のようなテキストを生成できます。 ただし、大規模なデータセットでのトレーニングにより、特殊なタスクでの有用性も制限されます。 学習を継続しないと、これらのモデルは、最初のトレーニング後に出現する新しいデータや傾向に気付かないままになります。 さらに、新しい LLM をトレーニングするコストは、多くの企業環境にとって法外なコストとなる可能性があります。 ただし、模範解答を元の特殊なコンテンツと相互参照することは可能であるため、検索拡張生成 (RAG) を使用して新しい LLM モデルをトレーニングする必要がなくなります。

RAG は、LLM に外部の知識を取得して組み込む機能を提供することで、LLM に権限を与えます。 RAG を使用すると、モデルは事前トレーニングされた知識だけに依存するのではなく、ドキュメントやデータベースなどからデータを取得できます。 次に、モデルはこの外部情報を生成されたテキストに巧みに統合します。 コンテキスト関連データを取得することで、モデルはユースケースに合わせた情報に基づいた最新の応答を提供できます。 知識の増強により、幻覚や不正確または無意味なテキストが表示される可能性も低くなります。 RAG を使用すると、基礎モデルは知識ベースの成長に応じて進化する、適応可能なエキスパートになります。

本日、私たちは次のライセンスを取得した XNUMX つの生成 AI デモを発表できることを嬉しく思います。 MIT-0ライセンス:

- 基本的な LLM を備えた Amazon Kendra – の詳細な検索機能を利用します。 アマゾンケンドラ LLM の広範な知識と組み合わせることができます。 この統合により、さまざまなソースから取得することで、複雑なクエリに対する正確でコンテキストを認識した回答が提供されます。

- 基本的な LLM を使用した埋め込みモデル – 埋め込みの力 (単語やフレーズの意味論的な意味を捕捉する技術) と、LLM の膨大な知識ベースを統合します。 この相乗効果により、より正確なトピック モデリング、コンテンツの推奨、およびセマンティック検索機能が可能になります。

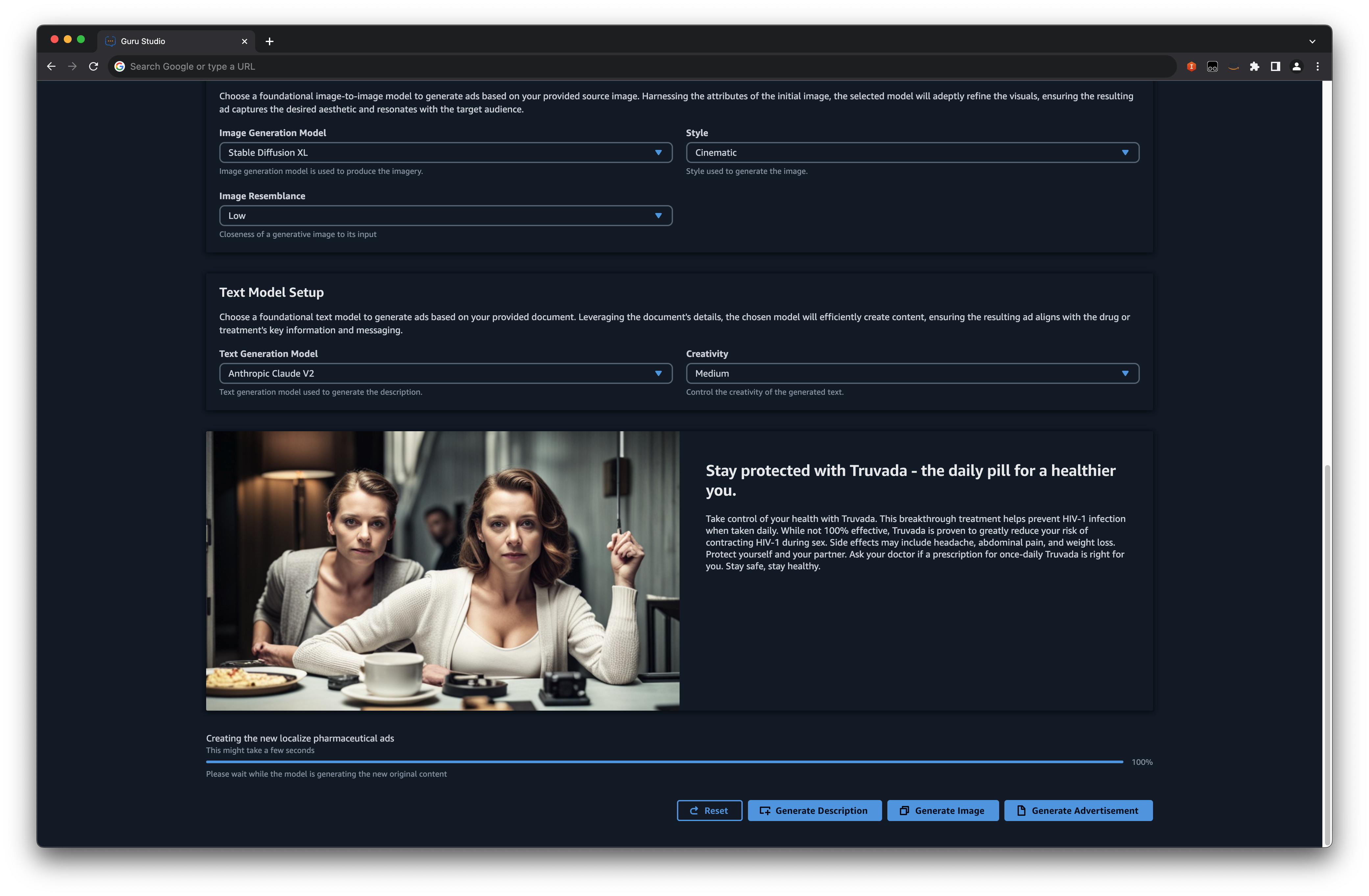

- 基礎モデル製薬広告ジェネレーター – 製薬業界向けに特化したアプリケーション。 このツールは、基礎モデルの生成機能を利用して、説得力のある準拠した医薬品広告を作成し、コンテンツが業界標準と規制に準拠していることを保証します。

これらのデモは AWS アカウントにシームレスにデプロイでき、AWS サービスを利用して最先端の LLM 生成 AI 質問応答ボットとコンテンツ生成を作成するための基礎的な洞察とガイダンスを提供します。

この投稿では、RAG と Amazon Kendra またはカスタム埋め込みを組み合わせることで、これらの課題をどのように克服し、自然言語クエリに対して洗練された応答を提供できるかを検討します。

ソリューションの概要

このソリューションを採用すると、次の利点が得られます。

- 情報アクセスの向上 – RAG を使用すると、モデルは膨大な外部ソースから情報を取り込むことができます。これは、事前トレーニングされたモデルの知識が古いか不完全な場合に特に役立ちます。

- スケーラビリティ – RAG を使用すると、利用可能なすべてのデータでモデルをトレーニングするのではなく、モデルが関連情報をその場で取得できるようになります。 これは、新しいデータが利用可能になると、モデル全体を再トレーニングすることなく、そのデータを検索データベースに追加できることを意味します。

- メモリ効率 – LLM はパラメータを保存するために大量のメモリを必要とします。 RAG を使用すると、すべての詳細を記憶する必要がないため、モデルを小さくできます。 必要に応じてそれらを取得できます。

- 動的な知識の更新 – ナレッジエンドポイントが設定されている従来のモデルとは異なり、RAG の外部データベースは定期的に更新されるため、モデルは最新の情報にアクセスできます。 検索機能は、個別のタスクに合わせて微調整できます。 たとえば、医療診断タスクでは医学ジャーナルからデータを入手し、モデルが専門家と適切な洞察を確実に獲得できます。

- バイアスの軽減 – よく厳選されたデータベースから情報を取得できるため、バランスの取れた公平な外部ソースを確保することでバイアスを最小限に抑える可能性が得られます。

Amazon Kendra と基本的な LLM の統合に入る前に、必要なツールとシステム要件を備えておくことが重要です。 適切なセットアップを行うことが、デモのシームレスな展開への第一歩です。

前提条件

次の前提条件が必要です。

このチュートリアルで詳しく説明されているインフラストラクチャをローカル コンピューターからセットアップして展開することは可能ですが、 AWS クラウド9 便利な代替手段を提供します。 AWS CLI、AWS CDK、Docker などのツールがあらかじめ装備されている AWS Cloud9 は、デプロイワークステーションとして機能します。 このサービスを利用するには、簡単に 環境をセットアップする ビア AWS Cloud9 コンソール.

前提条件を説明したので、基本的な LLM を使用した Amazon Kendra の機能を詳しく見ていきましょう。

基本的な LLM を備えた Amazon Kendra

Amazon Kendra は、機械学習 (ML) によって強化された高度なエンタープライズ検索サービスで、すぐに使えるセマンティック検索機能を提供します。 Amazon Kendra は、自然言語処理 (NLP) を利用して、ドキュメントのコンテンツとユーザーのクエリの根本的な意図の両方を理解し、RAG ベースのソリューションのコンテンツ取得ツールとして位置付けています。 Kendra からの高精度検索コンテンツを RAG ペイロードとして使用することで、より良い LLM 応答を得ることができます。 このソリューションで Amazon Kendra を使用すると、エンドユーザーのコンテンツへのアクセス許可に従って応答をフィルタリングすることで、パーソナライズされた検索も可能になります。

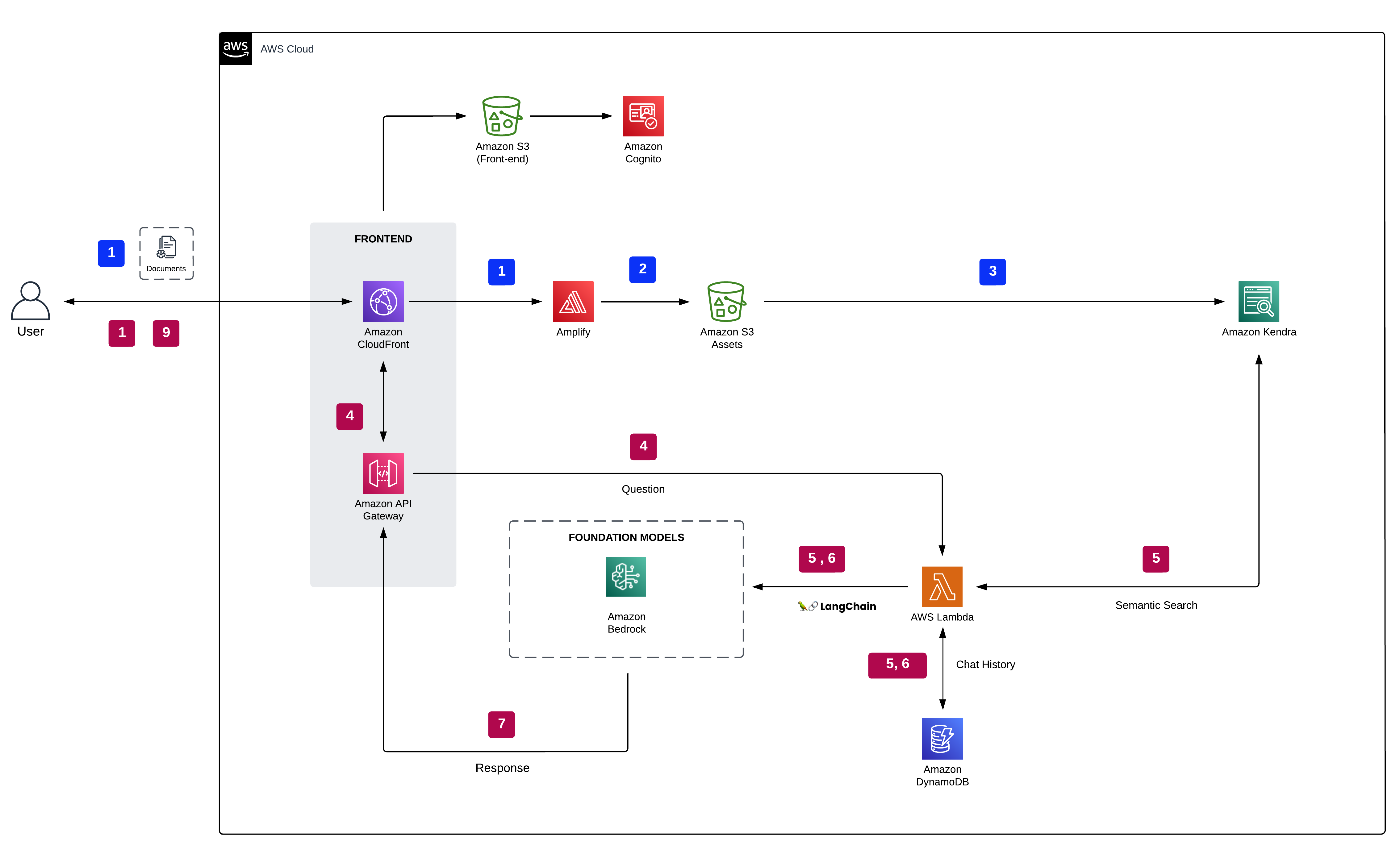

次の図は、RAG アプローチを使用した生成 AI アプリケーションのアーキテクチャを示しています。

ドキュメントは Amazon Kendra によって処理され、インデックス付けされます。 Amazon Simple Storage Service(Amazon S3) コネクタ。 Amazon Kendra からの顧客リクエストとコンテキスト データは、 アマゾンの岩盤 基礎モデル。 このデモでは、Amazon Bedrock でサポートされている Amazon の Titan、AI21 の Jurassic、Anthropic の Claude モデルから選択できます。 会話履歴は次の場所に保存されます Amazon DynamoDB、LLM が応答を生成するための追加のコンテキストを提供します。

このデモは、 GitHubレポ。 AWS アカウントにデプロイするには、readme ファイル内のデプロイ手順を参照してください。

次の手順は、ユーザーが生成 AI アプリを操作するときのプロセスの概要を示しています。

- ユーザーは認証された Web アプリにログインします。 アマゾンコグニート.

- ユーザーは 3 つ以上のドキュメントを Amazon SXNUMX にアップロードします。

- ユーザーは Amazon Kendra 同期ジョブを実行して、S3 ドキュメントを Amazon Kendra インデックスに取り込みます。

- ユーザーの質問は、でホストされている安全な WebSocket API を通じてルーティングされます。 アマゾンAPIゲートウェイ に支えられて AWSラムダ 機能。

- Lambda 関数は、 ラングチェーン AI 言語モデルによって駆動されるアプリケーションを作成するために設計された多用途ツールであるフレームワークは、Amazon Bedrock エンドポイントに接続し、チャット履歴に基づいてユーザーの質問を言い換えます。 言い換えた後、質問は Retrieve API を使用して Amazon Kendra に転送されます。 これに応じて、Amazon Kendra インデックスは検索結果を表示し、企業が取り込んだデータから取得した関連ドキュメントの抜粋を提供します。

- ユーザーの質問は、インデックスから取得されたデータとともに、LLM プロンプトのコンテキストとして送信されます。 LLM からの応答は、DynamoDB 内にチャット履歴として保存されます。

- 最後に、LLM からの応答がユーザーに返されます。

ドキュメントのインデックス作成ワークフロー

ドキュメントの処理とインデックス作成の手順は次のとおりです。

- ユーザーはユーザー インターフェイス (UI) を介してドキュメントを送信します。

- ドキュメントは、 AWS 増幅 APIです。

- Amazon Kendra は、Amazon Kendra S3 コネクタを介して S3 バケット内の新しいドキュメントのインデックスを作成します。

福利厚生

次のリストは、このソリューションの利点を示しています。

- エンタープライズレベルの取得 – Amazon Kendra はエンタープライズ検索用に設計されており、膨大な量の構造化データと非構造化データを扱う組織に適しています。

- 意味の理解 – Amazon Kendra の ML 機能により、単なるキーワード一致ではなく、深い意味理解に基づいて検索が行われることが保証されます。

- スケーラビリティ – Amazon Kendra は大規模なデータソースを処理でき、関連性の高い検索結果を迅速に提供します。

- 柔軟性 – 基本モデルは、幅広いコンテキストに基づいて回答を生成できるため、システムの汎用性が確保されます。

- 統合機能 – Amazon Kendra はさまざまな AWS サービスおよびデータソースと統合できるため、さまざまな組織のニーズに適応できます。

基本的な LLM を使用した埋め込みモデル

An 埋め込み は、テキスト、画像、音声、ドキュメントなど、さまざまなデータ型の中核となる本質を表す数値ベクトルです。 この表現は、データの本質的な意味を捉えるだけでなく、それを幅広い実用的なアプリケーションに適応させます。 ML の一分野である埋め込みモデルは、単語や語句などの複雑なデータを連続ベクトル空間に変換します。 これらのベクトルは本質的にデータ間の意味的なつながりを把握し、より深く洞察力に富んだ比較を可能にします。

RAG は、変圧器などの基本モデルの長所と埋め込みの精度をシームレスに組み合わせて、関連情報を得るために膨大なデータベースをふるいにかけます。 クエリを受信すると、システムはエンベディングを利用して、広範なデータ本体から関連するセクションを識別して抽出します。 次に、基本モデルは、この抽出された情報に基づいて、状況に応じて正確な応答を定式化します。 データ検索と応答生成の間のこの完璧な相乗効果により、システムは、広大なデータベースに保存されている膨大な知識を活用して、完全な回答を提供することができます。

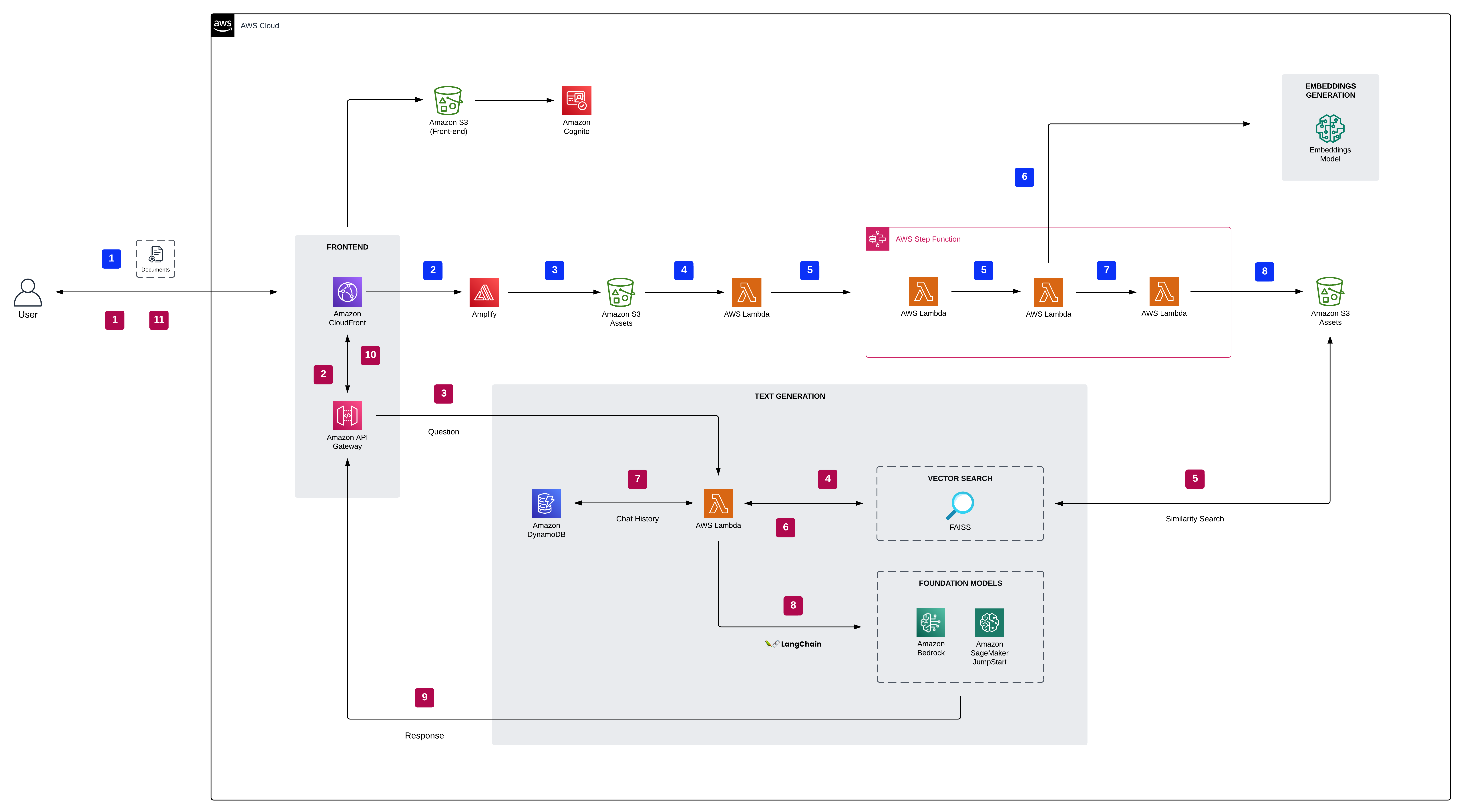

アーキテクチャ レイアウトでは、UI の選択に基づいて、ユーザーは Amazon Bedrock または Amazon SageMaker ジャンプスタート 基礎モデル。 ドキュメントは処理され、ベクトル埋め込みが埋め込みモデルによって生成されます。 これらの埋め込みには、次を使用してインデックスが付けられます。 フェイス 効率的なセマンティック検索を可能にします。 会話履歴は DynamoDB に保存され、LLM が応答を作成するためのコンテキストを強化します。

次の図は、ソリューションのアーキテクチャとワークフローを示しています。

このデモは、 GitHubレポ。 AWS アカウントにデプロイするには、readme ファイル内のデプロイ手順を参照してください。

埋め込みモデル

エンベディング モデルの役割は次のとおりです。

- このモデルは、テキスト (文書や文章など) を、一般に埋め込みとして知られる高密度ベクトル表現に変換する役割を果たします。

- これらの埋め込みはテキストの意味論的な意味を捕捉し、異なるテキスト部分間で効率的かつ意味論的に意味のある比較を可能にします。

- エンベディング モデルは、基礎モデルと同じ膨大なコーパス上でトレーニングすることも、特定のドメインに特化することもできます。

Q&Aのワークフロー

次の手順では、文書に対する質問応答のワークフローを説明します。

- ユーザーは、Amazon Cognito によって認証されたウェブアプリにログインします。

- ユーザーは 3 つ以上のドキュメントを Amazon SXNUMX にアップロードします。

- ドキュメントの転送時に、S3 イベント通知によって Lambda 関数がトリガーされ、SageMaker 埋め込みモデルのエンドポイントが呼び出されて、新しいドキュメントの埋め込みが生成されます。 エンベディング モデルは、質問を密なベクトル表現 (エンベディング) に変換します。 結果のベクター ファイルは S3 バケット内に安全に保存されます。

- FAISS リトリーバーは、この質問の埋め込みをデータベース内のすべての文書または文章の埋め込みと比較して、最も関連性の高い文章を見つけます。

- これらの文章は、ユーザーの質問とともに、基本モデルのコンテキストとして提供されます。 Lambda 関数は LangChain ライブラリを使用し、コンテキストを詰め込んだクエリで Amazon Bedrock または SageMaker JumpStart エンドポイントに接続します。

- LLM からの応答は、ユーザーのクエリ、タイムスタンプ、一意の識別子、および質問カテゴリなどのアイテムのその他の任意の識別子とともに DynamoDB に保存されます。 質問と回答を個別のアイテムとして保存すると、Lambda 関数で質問が行われた時刻に基づいてユーザーの会話履歴を簡単に再作成できます。

- 最後に、応答は、API Gateway WebSocket API 統合応答を介した HTTPS リクエストを介してユーザーに返されます。

福利厚生

次のリストでは、このソリューションの利点を説明します。

- 意味の理解 – 埋め込みモデルにより、検索者はキーワードの一致だけでなく、深い意味理解に基づいてパッセージを選択することが保証されます。

- スケーラビリティ – 埋め込みにより効率的な類似性比較が可能になり、膨大な文書データベースを迅速に検索できるようになります。

- 柔軟性 – 基本モデルは、幅広いコンテキストに基づいて回答を生成できるため、システムの汎用性が確保されます。

- ドメイン適応性 – 埋め込みモデルは特定のドメインに合わせてトレーニングまたは微調整できるため、システムをさまざまなアプリケーションに適応させることができます。

基礎モデル 製薬広告ジェネレーター

今日のペースの速い製薬業界では、効率的かつローカライズされた広告がこれまで以上に重要になっています。 ここで革新的なソリューションが登場します。生成 AI の力を利用して、ソース画像と PDF からローカライズされた製薬広告を作成します。 このアプローチは、単に広告生成プロセスを高速化するだけでなく、医療法的審査 (MLR) プロセスを合理化します。 MLR は、医療、法務、規制当局のチームがプロモーション資料を細心の注意を払って評価し、その正確性、科学的裏付け、規制遵守を保証する厳格な審査メカニズムです。 従来のコンテンツ作成方法は煩雑な場合があり、地域のコンプライアンスと関連性を確保するために手動での調整や広範なレビューが必要になることがよくあります。 しかし、生成 AI の出現により、厳しい基準とガイドラインを守りながら、地元の視聴者の心に響く広告の作成を自動化できるようになりました。

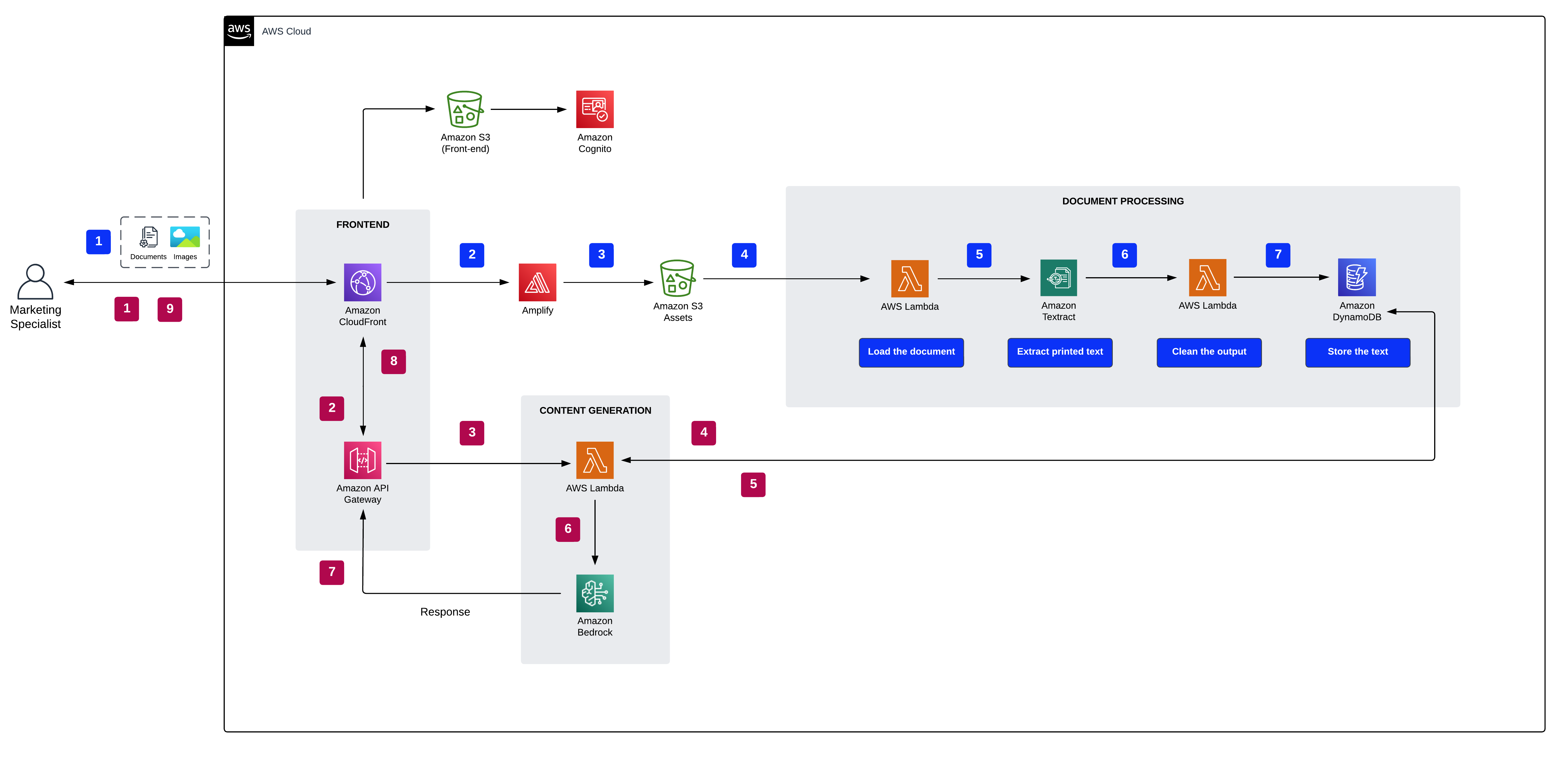

次の図は、ソリューションのアーキテクチャを示しています。

アーキテクチャレイアウトでは、選択したモデルと広告設定に基づいて、ユーザーは Amazon Bedrock 基盤モデルにシームレスに誘導されます。 この合理化されたアプローチにより、新しい広告が希望の構成に従って正確に生成されることが保証されます。 プロセスの一環として、文書は効率的に処理されます。 アマゾンテキストラック、結果のテキストは DynamoDB に安全に保存されます。 際立った機能は、画像とテキスト生成のモジュラー設計で、必要に応じてコンポーネントを個別に再生成できる柔軟性を提供します。

このデモは、 GitHubレポ。 AWS アカウントにデプロイするには、readme ファイル内のデプロイ手順を参照してください。

コンテンツ生成ワークフロー

次の手順は、コンテンツ生成プロセスの概要を示しています。

- ユーザーは、ドキュメント、ソース画像、広告の配置、言語、画像スタイルを選択します。

- ウェブアプリケーションへの安全なアクセスは、Amazon Cognito 認証によって確保されます。

- Web アプリケーションのフロントエンドは Amplify 経由でホストされます。

- API Gateway によって管理される WebSocket API により、ユーザーのリクエストが容易になります。 これらのリクエストは次の方法で認証されます。 AWS IDおよびアクセス管理 (わたし)。

- Amazon Bedrock との統合には、次の手順が含まれます。

- Lambda 関数は、LangChain ライブラリを使用して、コンテキストリッチなクエリを使用して Amazon Bedrock エンドポイントに接続します。

- テキストツーテキストの基本モデルは、指定されたコンテキストと設定に基づいて、コンテキストに応じて適切な広告を作成します。

- テキストから画像への基本モデルは、ソース画像、選択したスタイル、場所の影響を受けて、調整された画像を作成します。

- ユーザーは、統合された API Gateway WebSocket API を介して HTTPS リクエストを通じて応答を受け取ります。

ドキュメントと画像の処理ワークフロー

文書や画像を処理する手順は次のとおりです。

- ユーザーは、指定された UI を介してアセットをアップロードします。

- Amplify API はドキュメントを S3 バケットに転送します。

- アセットが Amazon S3 に転送された後、次のいずれかのアクションが実行されます。

- ドキュメントの場合、Lambda 関数は Amazon Textract を使用して、広告生成用のテキストを処理および抽出します。

- 画像の場合、Lambda 関数はそれを、安定拡散モデルがソースから新しい画像を作成するのに適した Base64 形式に変換します。

- 抽出されたテキストまたは Base64 画像文字列は、DynamoDB に安全に保存されます。

福利厚生

次のリストでは、このソリューションの利点を説明します。

- 効率化 – 生成 AI の使用により、広告生成プロセスが大幅に加速され、手動調整の必要がなくなりました。

- コンプライアンスの遵守 – このソリューションにより、生成された広告が FDA のマーケティング ガイドラインなどの特定のガイダンスや規制に準拠していることが保証されます。

- お財布に優しい – カスタマイズされた広告の作成を自動化することで、企業は広告の制作と修正に関連するコストを大幅に削減できます。

- 合理化された MLR プロセス – このソリューションは MLR プロセスを簡素化し、摩擦点を減らし、よりスムーズなレビューを保証します。

- 局所的な共鳴 – ジェネレーティブ AI は、地元の視聴者の共感を呼ぶ広告を生成し、さまざまな地域での関連性と影響力を確保します。

- 標準化 – このソリューションは必要な標準とガイドラインを維持し、生成されたすべての広告の一貫性を確保します。

- スケーラビリティ – AI 主導のアプローチは、ソース画像と PDF の膨大なデータベースを処理できるため、大規模な広告生成が可能になります。

- 手動介入の削減 – 自動化により人間の介入の必要性が減り、エラーが最小限に抑えられ、一貫性が確保されます。

このチュートリアルのインフラストラクチャはローカル コンピューターからデプロイすることも、AWS Cloud9 をデプロイメント ワークステーションとして使用することもできます。 AWS Cloud9 には、AWS CLI、AWS CDK、Docker がプリロードされています。 AWS Cloud9 を選択した場合、 環境を作る AWS Cloud9 コンソール.

クリーンアップ

不必要なコストを回避するには、AWS CloudFormation コンソールを介して、またはワークステーションで次のコマンドを実行して、作成されたすべてのインフラストラクチャをクリーンアップします。

さらに、SageMaker コンソール経由で開始した SageMaker エンドポイントを必ず停止してください。 Amazon Kendra インデックスを削除しても、元のドキュメントはストレージから削除されないことに注意してください。

まとめ

LLM に代表される生成 AI は、情報へのアクセスと生成の方法におけるパラダイム シフトの到来を告げます。 これらのモデルは強力ですが、多くの場合、トレーニング データの制限によって制限されます。 RAG はこの課題に対処し、これらのモデル内の膨大な知識に、関連する最新の洞察が一貫して注入されるようにします。

RAG ベースのデモは、これを明確に証明しています。 これらは、Amazon Kendra、ベクター埋め込み、LLM 間のシームレスな相乗効果を示し、情報が膨大であるだけでなく、正確かつタイムリーなシステムを構築します。 これらのデモを詳しく見てみると、事前トレーニングされた知識と RAG の動的な機能を統合することによる変革の可能性を直接体験することができ、その結果、信頼性があり、エンタープライズ コンテンツに合わせた出力が得られます。

LLM を活用した生成 AI は、情報の洞察を得る新しい方法を切り開きますが、これらの洞察は信頼できるものであり、RAG アプローチを使用するエンタープライズ コンテンツに限定される必要があります。 これらの RAG ベースのデモにより、正確で最新の洞察を得ることができます。 これらの洞察の品質は、Amazon Kendra とベクトル埋め込みを使用することで有効になるセマンティック関連性に依存します。

生成 AI の力をさらに探索して活用する準備ができている場合は、次のステップを実行してください。

- デモに参加してください – 実践的な経験は非常に貴重です。 機能を調べ、統合を理解し、インターフェイスに慣れてください。

- 知識を深める – 利用可能なリソースを活用します。 AWS は、AI への取り組みを支援する詳細なドキュメント、チュートリアル、コミュニティサポートを提供します。

- パイロットプロジェクトを開始する – 企業内での生成 AI の小規模な実装から始めることを検討してください。 これにより、特定の状況におけるシステムの実用性と適応性についての洞察が得られます。

AWS 上の生成 AI アプリケーションの詳細については、以下を参照してください。

AI の状況は常に進化していることを忘れないでください。 常に最新情報を入手し、好奇心を持ち、常に適応して革新する準備を整えてください。

著者について

ジン・タン・ルアン は、AWS Industries プロトタイピングおよびカスタマー エンジニアリング (PACE) チームのプロトタイピング開発者であり、NLP と生成 AI を専門としています。 ソフトウェア開発のバックグラウンドと XNUMX つの AWS 認定資格を持つ Jin は、AWS プラットフォームを使用して AI/ML および生成 AI のビジョンを具体化する際に AWS の顧客を支援する豊富な経験をもたらします。 彼はシラキュース大学でコンピュータ サイエンスとソフトウェア エンジニアリングの修士号を取得しています。 仕事以外では、ジンはビデオ ゲームをプレイしたり、ホラー映画のスリル満点の世界に浸ることを楽しんでいます。

ジン・タン・ルアン は、AWS Industries プロトタイピングおよびカスタマー エンジニアリング (PACE) チームのプロトタイピング開発者であり、NLP と生成 AI を専門としています。 ソフトウェア開発のバックグラウンドと XNUMX つの AWS 認定資格を持つ Jin は、AWS プラットフォームを使用して AI/ML および生成 AI のビジョンを具体化する際に AWS の顧客を支援する豊富な経験をもたらします。 彼はシラキュース大学でコンピュータ サイエンスとソフトウェア エンジニアリングの修士号を取得しています。 仕事以外では、ジンはビデオ ゲームをプレイしたり、ホラー映画のスリル満点の世界に浸ることを楽しんでいます。

アラヴィンド・コダンダラマイア は、AWS Industries Prototyping and Customer Engineering (PACE) チーム内のシニア プロトタイピング フルスタック ソリューション ビルダーです。 彼は、AWS の顧客が革新的なアイデアを、測定可能で素晴らしい成果をもたらすソリューションに変換できるよう支援することに重点を置いています。 彼はクラウド セキュリティ、DevOps、AI/ML などのさまざまなトピックに情熱を持っており、通常はこれらのテクノロジをいじくり回しています。

アラヴィンド・コダンダラマイア は、AWS Industries Prototyping and Customer Engineering (PACE) チーム内のシニア プロトタイピング フルスタック ソリューション ビルダーです。 彼は、AWS の顧客が革新的なアイデアを、測定可能で素晴らしい成果をもたらすソリューションに変換できるよう支援することに重点を置いています。 彼はクラウド セキュリティ、DevOps、AI/ML などのさまざまなトピックに情熱を持っており、通常はこれらのテクノロジをいじくり回しています。

アルジュン・シャクデル は、AWS Industries Prototyping (PACE) チームの開発者であり、テクノロジーを生活構造に融合させることに情熱を持っています。 パデュー大学で修士号を取得した Arjun の現在の役割は、さまざまな領域にわたる最先端のプロトタイプの設計と構築を中心に展開しており、現在は AI/ML と IoT の領域が顕著です。 コードやデジタルの世界に浸っていないときは、アルジュンはコーヒーの世界に耽ったり、時計の複雑な仕組みを探求したり、自動車の芸術性を楽しんだりしていることがわかります。

アルジュン・シャクデル は、AWS Industries Prototyping (PACE) チームの開発者であり、テクノロジーを生活構造に融合させることに情熱を持っています。 パデュー大学で修士号を取得した Arjun の現在の役割は、さまざまな領域にわたる最先端のプロトタイプの設計と構築を中心に展開しており、現在は AI/ML と IoT の領域が顕著です。 コードやデジタルの世界に浸っていないときは、アルジュンはコーヒーの世界に耽ったり、時計の複雑な仕組みを探求したり、自動車の芸術性を楽しんだりしていることがわかります。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :は

- :not

- :どこ

- $UP

- 100

- 150

- 7

- a

- 能力

- 私たちについて

- 加速する

- アクセス

- 従った

- 精度

- 正確な

- 越えて

- 行動

- Ad

- 適応する

- 適応する

- 追加されました

- アドレス

- 付着します

- 調整

- 採用

- 広告

- 高度な

- 利点

- 利点

- 出現

- 広告運用

- 後

- AI

- AI / ML

- 援助

- アラインメント

- すべて

- 許す

- 許可

- ことができます

- ほとんど

- 沿って

- また

- 代替案

- 常に

- Amazon

- アマゾンコグニート

- アマゾンケンドラ

- アマゾンテキストラック

- Amazon Webサービス

- 金額

- 増幅する

- an

- および

- 回答

- 回答

- どれか

- API

- アプリ

- 申し込み

- アプローチ

- 適切な

- 建築の

- 建築

- です

- 周りに

- 配列

- 芸術性

- AS

- 資産

- 資産

- アシスト

- 関連する

- ヒアリング

- オーディオ

- 認証された

- 認証

- 自動化する

- 自動化する

- オートメーション

- 利用できます

- 避ける

- 回避

- AWS

- AWS クラウド9

- AWS CloudFormation

- バック

- 支持された

- 背景

- バッキング

- ベース

- ベース

- BE

- なぜなら

- になる

- になる

- 利点

- より良いです

- の間に

- 越えて

- バイアス

- 混合

- ボディ

- ロボット

- 両言語で

- ブランチ

- もたらす

- 広い

- ビルダー

- 建物

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- コール

- 缶

- 取得することができます

- 機能

- キャプチャー

- キャプチャ

- 場合

- カテゴリー

- 認定

- 挑戦する

- 課題

- 選択する

- 選ばれた

- クラウド

- クラウドセキュリティ

- Cloud9

- コード

- コーヒー

- 組み合わせた

- 組み合わせ

- comes

- 一般に

- コミュニティ

- 企業

- 比較

- 複雑な

- コンプライアンス

- 準拠した

- コンポーネント

- 理解する

- コンピュータ

- コンピュータサイエンス

- お問合せ

- Connections

- コネクト

- 検討

- 一貫して

- 領事

- 絶えず

- コンテンツ

- コンテンツ生成

- コンテンツ作成

- コンテキスト

- 文脈

- 文脈上の

- 継続します

- 連続的な

- 便利

- 従来の

- 会話

- 変換

- 基本

- 費用

- コスト

- クラフト

- 作ります

- 作成した

- 作成します。

- 作成

- 創造

- 重大な

- 面倒

- 興味深い

- 電流プローブ

- カスタム

- 顧客

- Customers

- 最先端

- データ

- データベース

- データベースを追加しました

- データセット

- 日付

- 深いです

- より深い

- 度

- 楽しい

- デモ

- デモ

- 依存

- 展開します

- 展開

- 展開する

- 展開

- 説明する

- 設計

- 設計

- 希望

- 破壊する

- 詳細な

- 細部

- Developer

- 開発

- 診断

- 異なります

- デジタル

- 指示された

- ディスプレイ

- 明確な

- ダイビング

- 異なる

- ダイビング

- デッカー

- ドキュメント

- ドキュメント

- ドキュメント

- そうではありません

- ドメイン

- ドロー

- 描画

- ドリブン

- ダイナミック

- 簡単に

- 効率

- 効率的な

- 効率良く

- どちら

- 排除

- 埋め込み

- 出てくる

- 従業員

- 権限を与え

- 力を与える

- enable

- 使用可能

- 可能

- 有効にする

- end

- エンドポイント

- エンジニアリング

- 強化された

- 濃縮

- 確保

- 確実

- 確実に

- 確保する

- Enterprise

- 全体

- 装備

- エラー

- 特に

- 本質

- 評価する

- イベント

- EVER

- 進化

- 進化

- 例

- 興奮した

- 広大な

- 体験

- エキスパート

- 専門家

- 探る

- 探る

- 広範囲

- 外部

- エキス

- ファブリック

- 促進する

- 慣れる

- テンポの速い

- FB

- 実行可能な

- 特徴

- 特徴

- 特色

- File

- フィルタリング

- もう完成させ、ワークスペースに掲示しましたか?

- 名

- 柔軟性

- 焦点を当てて

- フォロー中

- 次

- 形式でアーカイブしたプロジェクトを保存します.

- 発見

- Foundation

- 摩擦

- から

- フロント

- フロントエンド

- フル

- フルスタック

- function

- 機能性

- さらに

- さらに

- 利得

- 獲得

- Games

- ゲートウェイ

- 生成する

- 生成された

- 世代

- 生々しい

- 生成AI

- ジェネレータ

- 取得する

- 与えられた

- 与え

- 付与

- 把握

- 育ちます

- 保証

- ガイダンス

- ガイド付きの

- ガイドライン

- ハンドル

- 実践的な

- ハーネス

- 利用する

- 持ってる

- 持って

- he

- 助け

- 使者

- こちら

- ハイライト

- 彼自身

- 歴史

- history

- 開催

- 保持している

- ホラー

- 主催

- 認定条件

- しかしながら

- HTML

- HTTP

- HTTPS

- 人間

- 考え

- 識別子

- 識別子

- 識別する

- アイデンティティ

- if

- 説明する

- 画像

- 画像

- 浸した

- 影響

- 実装

- in

- 綿密な

- 不正確

- 含ま

- 含めて

- 組み込む

- 単独で

- index

- 索引付けされた

- インデックス

- 産業

- 産業を変えます

- 業界標準

- 影響を受け

- 情報

- 情報に基づく

- インフラ

- 本質的に

- 初期

- 開始

- 革新します

- 革新的な

- 洞察力のある

- 洞察

- を取得する必要がある者

- 説明書

- 統合された

- 統合する

- 統合

- 統合

- 意図

- 相互作用する

- インタフェース

- 介入

- に

- 本質的な

- 貴重な

- IOT

- IT

- リーディングシート

- ITS

- ジョブ

- 旅

- JPG

- ただ

- 知識

- 既知の

- 風景

- 言語

- 大

- 大規模

- レイアウト

- 学習

- リーガルポリシー

- ことができます

- 図書館

- ライセンス供与

- 生活

- ような

- 尤度

- 限定的

- 制限

- リスト

- LLM

- ローカル

- 場所

- 機械

- 機械学習

- 維持

- 作成

- マネージド

- マニュアル

- 多くの

- マーケティング

- 大規模な

- マスターの

- マッチ

- 材料

- 意味

- 意味のある

- 意味

- 手段

- 力学

- メカニズム

- 医療の

- メモリ

- 単に

- マージ

- マージ

- メソッド

- 細心の注意を払って

- 最小化

- 緩和

- ML

- モデリング

- モデル

- モジュラー

- 他には?

- 最も

- 動画

- しなければなりません

- ナチュラル

- 自然言語処理

- 必要

- 必要

- 必要とされる

- 必要

- ニーズ

- 新作

- 次の

- 9

- NLP

- 通知

- 今

- of

- 提供すること

- オファー

- 頻繁に

- on

- ONE

- の

- 開きます

- or

- 組織の

- 組織

- オリジナル

- その他

- 私たちの

- でる

- 成果

- アウトライン

- outputs

- 外側

- が

- 克服する

- 平和

- パラダイム

- パラメータ

- 部

- 情熱的な

- 完璧

- パーミッション

- カスタマイズ

- ファーマ

- 薬剤

- フレーズ

- ピース

- パイロット

- パイロットプロジェクト

- 場所

- 配置

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- プレイ

- 再生

- ポイント

- ポジショニング

- 可能

- ポスト

- 潜在的な

- 電力

- パワード

- 強力な

- 実用的

- 正確な

- 正確に

- 精度

- プ

- 前提条件

- 現在

- 手続き

- プロセス

- 処理済み

- 処理

- 生産された

- 生産する

- 生産

- プロジェクト

- 昇進の

- プロトタイプ

- プロトタイピング

- 受験する

- 提供します

- 提供

- は、大阪で

- 提供

- 品質

- クエリ

- 質問

- 質問

- クイック

- すぐに

- 範囲

- 準備

- レルム

- 受け取り

- 受け入れ

- おすすめ

- 減らします

- 軽減

- 縮小

- 参照する

- 洗練された

- 地域の

- 地域

- レギュラー

- 規制

- レギュレータ

- 企業コンプライアンス

- 関連性

- 関連した

- 信頼

- 残る

- 残っている

- 覚えています

- 削除します

- 言い換えると

- 表現

- 表し

- 要求

- リクエスト

- 必要とする

- の提出が必要です

- 要件

- 共鳴する

- リソース

- 応答

- 回答

- 責任

- 責任

- 結果

- 結果として

- 結果

- レビュー

- レビュー

- リビジョン

- 回転する

- 右

- 厳しい

- 職種

- ランニング

- runs

- セージメーカー

- 同じ

- 保存されました

- 科学

- 科学的な

- シームレス

- シームレス

- を検索

- セクション

- 安全に

- しっかりと

- セキュリティ

- 選択

- 選択

- シニア

- 送信

- サービス

- サービス

- セッションに

- 設定

- シフト

- ショーケース

- 作品

- ふるいにかける

- 重要

- 著しく

- 簡単な拡張で

- 単に

- より小さい

- より滑らかに

- ソフトウェア

- ソフトウェア開発

- ソフトウェア工学

- もっぱら

- 溶液

- ソリューション

- ソース

- 調達

- ソース

- 部品調達

- スペース

- スパン

- 専門の

- 特化

- 特定の

- 指定の

- 安定した

- スタック

- 規格

- 起動

- 最先端の

- 滞在

- 手順

- ステップ

- Force Stop

- ストレージ利用料

- 店舗

- 保存され

- 保存

- 合理化された

- 強み

- 文字列

- 厳しい

- 構造化された

- 提出する

- そのような

- 適当

- サポート

- サポート

- 相乗効果

- テーラード

- 取る

- 取り

- 有形

- 仕事

- タスク

- チーム

- チーム

- 技術

- テクノロジー

- テクノロジー

- 遺言

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- より

- それ

- 風景

- ソース

- 世界

- アプリ環境に合わせて

- それら

- その後

- それによって

- ボーマン

- 彼ら

- この

- 三

- スリリング

- 介して

- 時間

- タイムリーな

- タイムスタンプ

- タイタン

- 〜へ

- 今日の

- ツール

- 豊富なツール群

- トピック

- トピック

- に向かって

- 伝統的な

- トレーニング

- 訓練された

- トレーニング

- 転送

- 転送

- 転送

- 最適化の適用

- 変形的

- トランスフォーマー

- トレンド

- 真に

- 信頼できる

- 順番

- チュートリアル

- チュートリアル

- ui

- 受ける

- 根本的な

- わかる

- 理解する

- ユニーク

- 大学

- 異なり、

- 不要

- 発表する

- 最新

- アップデイト

- 更新しました

- 更新版

- 支持

- に

- つかいます

- 使用事例

- ユーザー

- ユーザーインターフェース

- users

- 使用されます

- 通常

- 利用

- 活用

- さまざまな

- 広大な

- 多才な

- 、

- ビデオ

- ビデオゲーム

- ビジョン

- 仕方..

- we

- 富

- ウェブ

- ウェブアプリケーション

- Webサービス

- ウェブソケット

- した

- いつ

- which

- while

- 誰

- ワイド

- 広い範囲

- 意志

- 以内

- 無し

- 言葉

- 仕事

- ワークフロー

- 世界

- You

- あなたの

- あなた自身

- ゼファーネット