今日の情報化時代において、無数のドキュメントに格納された膨大な量のデータは、ビジネスにとって課題であると同時にチャンスでもあります。 従来の文書処理方法では効率や精度が不十分なことが多く、イノベーション、コスト効率、最適化の余地が残されています。 インテリジェント ドキュメント処理 (IDP) の出現により、ドキュメント処理は大幅に進歩しました。 IDP を使用すると、企業はさまざまな種類のドキュメントの非構造化データを構造化された実用的な洞察に変換し、効率を大幅に向上させ、手作業を削減できます。 ただし、可能性はそれだけではありません。 生成人工知能 (AI) をプロセスに統合することで、IDP 機能をさらに強化できます。 生成 AI は、文書処理の強化された機能を導入するだけでなく、変化するデータ パターンに対する動的な適応性も導入します。 この投稿では、IDP と生成 AI の相乗効果について説明し、これらが文書処理の次のフロンティアをどのように表現しているかを明らかにします。

IDP については、AWS AI サービスによるインテリジェントなドキュメント処理シリーズ (第1部 および 第2部)。 この投稿では、新規または既存の IDP アーキテクチャを大規模言語モデル (LLM) で拡張する方法について説明します。 より具体的には、どのように統合できるかについて話し合います。 アマゾンテキストラック ラングチェーン ドキュメントローダーとして、そして アマゾンの岩盤 ドキュメントからデータを抽出し、さまざまな IDP フェーズ内で生成 AI 機能を使用します。

Amazon Textract は、スキャンされたドキュメントからテキスト、手書き文字、データを自動的に抽出する機械学習 (ML) サービスです。 Amazon Bedrock は、使いやすい API を通じて高性能の基盤モデル (FM) の選択肢を提供するフルマネージド サービスです。

次の図は、基盤モデルを使用して IDP ワークフローをさらに強化する方法を説明する高レベルのリファレンス アーキテクチャです。 LLM は、ユースケースと望ましい結果に応じて、IDP の XNUMX つまたはすべてのフェーズで使用できます。

次のセクションでは、Amazon Textract が LangChain を使用して生成 AI ワークフローに統合され、これらの特定のタスクごとにドキュメントを処理する方法について詳しく説明します。 ここで提供されるコード ブロックは、簡潔にするために切り詰められています。 弊社を参照してください。 GitHubリポジトリ 詳細な Python ノートブックと段階的なチュートリアルについては、こちらをご覧ください。

LLM を使用してドキュメントを処理する場合、ドキュメントからのテキスト抽出は重要な側面です。 Amazon Textract を使用すると、ドキュメントから非構造化生テキストを抽出し、ドキュメント内に存在するキーと値のペアやテーブルなどの元の半構造化オブジェクトまたは構造化オブジェクトを保存できます。 医療保険や保険請求、住宅ローンなどのドキュメント パッケージは、構造化、半構造化、非構造化フォーマットにわたる多くの情報を含む複雑なフォームで構成されています。 LLM はリッチ コンテンツの恩恵を受けて、より正確で関連性の高い応答を生成できますが、そうでないと LLM の出力の品質に影響を与える可能性があるため、ドキュメントの抽出はここで重要なステップです。

LangChain は、LLM と統合するための強力なオープンソース フレームワークです。 LLM は一般に多用途ですが、より深いコンテキストや微妙な応答が必要なドメイン固有のタスクでは困難を伴う場合があります。 LangChain を使用すると、開発者はこのようなシナリオで、複雑なタスクをより小さなサブタスクに分割できるエージェントを構築できます。 サブタスクは、LLM プロンプトを接続してチェーンすることによって、LLM にコンテキストとメモリを導入できます。

ラングチェーンのオファー ドキュメントローダー ドキュメントからデータをロードして変換できます。 これらを使用して、LLM で処理できる優先形式にドキュメントを構造化できます。 の AmazonTextPDFLoader は、Amazon Textract と LangChain を組み合わせて使用することでドキュメント処理を自動化する迅速な方法を提供するドキュメントローダーのサービスローダータイプです。 詳細については、 AmazonTextractPDFLoaderを参照してください。 ラングチェーン ドキュメンテーション。 Amazon Textract ドキュメントローダーを使用するには、まず、LangChain ライブラリからドキュメントローダーをインポートします。

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()で説明されているように、ドキュメントを Amazon S3 に保存し、s3:// URL パターンを使用して参照することもできます。 S3:// を使用したバケットへのアクセスを作成し、この S3 パスを Amazon Textract PDF ローダーに渡します。

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()複数ページのドキュメントには複数ページのテキストが含まれており、ページのリストであるドキュメント オブジェクトを介してアクセスできます。 次のコードは、ドキュメント オブジェクト内のページをループし、ドキュメント テキストを印刷します。これは、 page_content 属性:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend と LLM は、ドキュメントの分類に効果的に利用できます。 Amazon Comprehend は、ML を使用してテキストから洞察を抽出する自然言語処理 (NLP) サービスです。 Amazon Comprehend は、PDF、Word、画像形式などのドキュメントのレイアウトを認識したカスタム分類モデルのトレーニングもサポートしています。 Amazon Comprehend ドキュメント分類子の使用の詳細については、を参照してください。 Amazon Comprehend ドキュメント分類子は、より高い精度のためにレイアウトのサポートを追加します.

LLM と組み合わせると、文書分類は大量の文書を管理するための強力なアプローチになります。 LLM は、自然言語理解を使用して文書内のテキスト、パターン、コンテキスト要素を分析できるため、文書の分類に役立ちます。 特定のドキュメント クラスに合わせて微調整することもできます。 IDP パイプラインに導入された新しいドキュメント タイプに分類が必要な場合、LLM はテキストを処理し、一連のクラスを指定してドキュメントを分類できます。 以下は、Amazon Textract を利用した LangChain ドキュメントローダーを使用してドキュメントからテキストを抽出し、ドキュメントの分類に使用するサンプルコードです。 私たちが使用するのは、 人間的クロード v2 Amazon Bedrock 経由でモデルを作成し、分類を実行します。

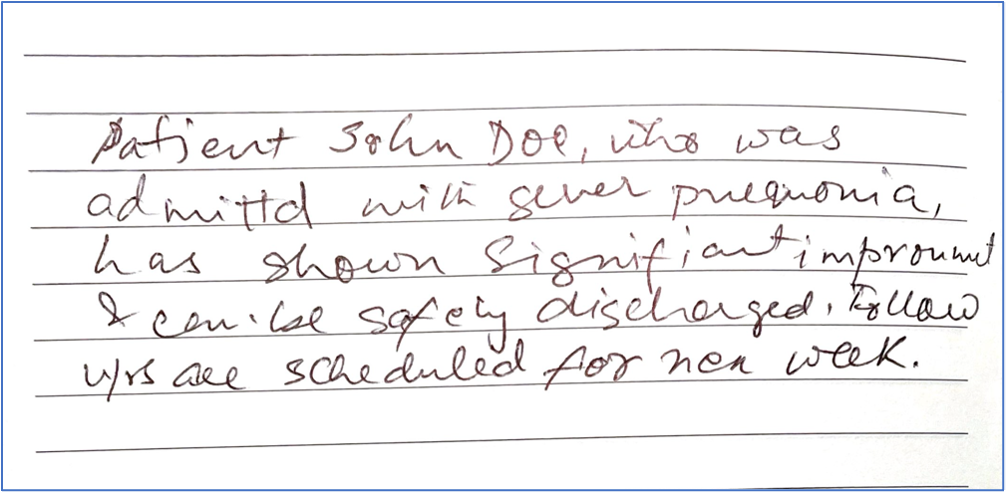

次の例では、最初に患者の退院報告書からテキストを抽出し、LLM を使用して XNUMX つの異なる文書タイプのリストに基づいて分類します。DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION。 次のスクリーンショットはレポートを示しています。

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

要約には、重要な情報を保持しながら、特定のテキストまたは文書を短いバージョンに要約することが含まれます。 この技術は効率的な情報検索に役立ち、ユーザーは内容全体を読まなくても文書の重要なポイントを素早く把握できます。 Amazon Textract はテキストの要約を直接実行しませんが、ドキュメントからテキスト全体を抽出する基本的な機能を提供します。 この抽出されたテキストは、テキスト要約タスクを実行するための LLM モデルへの入力として機能します。

同じサンプル排出レポートを使用して、 AmazonTextractPDFLoader この文書からテキストを抽出します。 前と同様に、Amazon Bedrock 経由で Claude v2 モデルを使用し、テキスト (この場合は要約) の処理方法に関する指示を含むプロンプトを使用してモデルを初期化します。 最後に、ドキュメント ローダーから抽出したテキストを渡して LLM チェーンを実行します。 これにより、要約する指示と、 Document。 次のコードを参照してください。

このコードは、患者の退院概要レポートの概要を生成します。

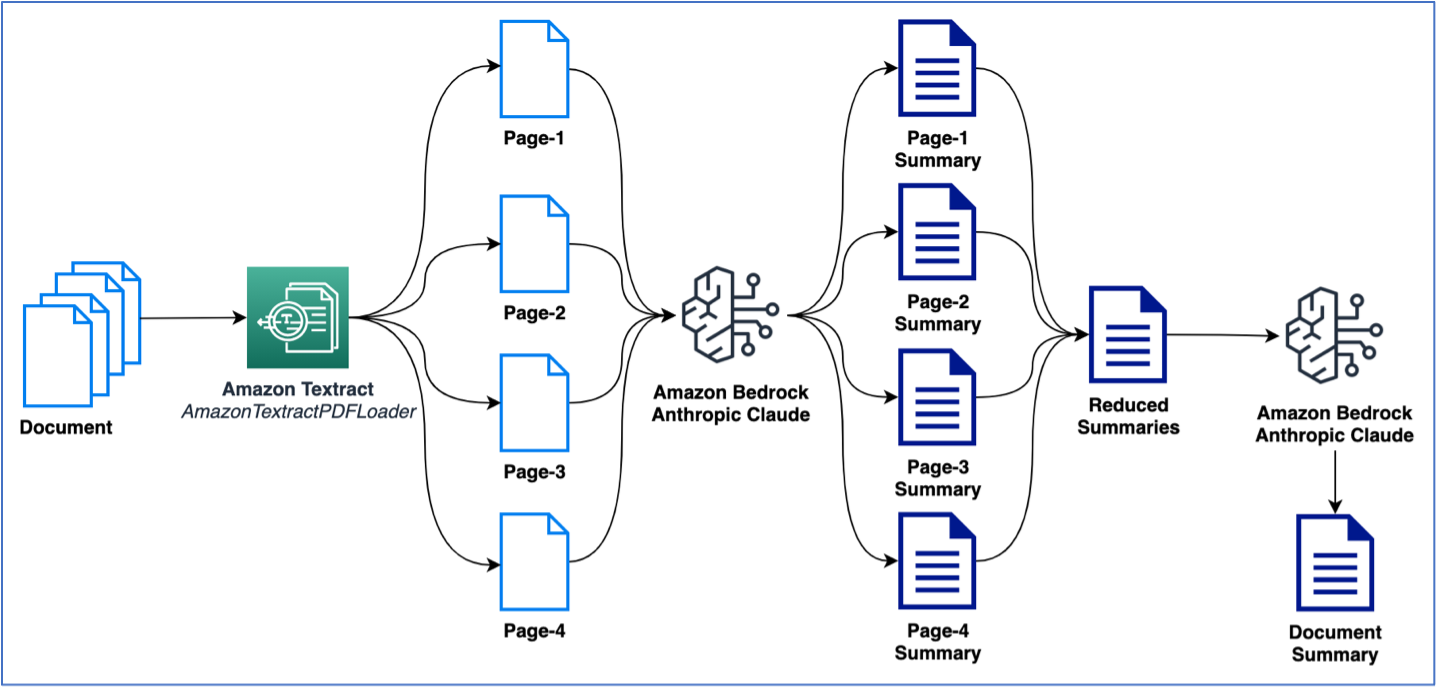

前の例では、単一ページのドキュメントを使用して要約を実行しました。 ただし、要約が必要な複数のページを含む文書を扱うことになるでしょう。 複数のページで要約を実行する一般的な方法は、最初に小さなテキストの塊について要約を生成し、次に小さな要約を結合して文書の最終的な要約を取得することです。 このメソッドでは LLM を複数回呼び出す必要があることに注意してください。 このためのロジックは簡単に作成できます。 ただし、LangChain は、(複数ページのドキュメントからの) 大きなテキストを要約できる組み込みの要約チェーンを提供します。 要約は次のいずれかの方法で実行できます。 map_reduce または stuff これらのオプションは、LLM への複数の呼び出しを管理するためのオプションとして使用できます。 次の例では、 map_reduce 複数ページの文書を要約するために。 次の図はワークフローを示しています。

まずドキュメントを抽出して、ページごとの合計トークン数と合計ページ数を確認しましょう。

次に、LangChain の組み込みを使用します。 load_summarize_chain 文書全体を要約するには:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())標準化とQ&A

このセクションでは、標準化と Q&A タスクについて説明します。

標準化

出力の標準化は、LLM を使用して出力テキストの一貫した書式設定を提供するテキスト生成タスクです。 このタスクは、出力を目的の形式に揃える必要があるキー エンティティ抽出の自動化に特に役立ちます。 たとえば、プロンプト エンジニアリングのベスト プラクティスに従って、データベースの DATE 列と互換性のある日付を MM/DD/YYYY 形式にフォーマットするように LLM を微調整できます。 次のコード ブロックは、LLM とプロンプト エンジニアリングを使用してこれを行う方法の例を示しています。 日付値の出力形式を標準化するだけでなく、ダウンストリーム アプリケーションで簡単に利用できるように、モデルに最終出力を JSON 形式で生成するように促します。 を使用しております LangChain 式言語 (LCEL) XNUMX つのアクションを連鎖させます。 最初のアクションでは、LLM に、ドキュメントの日付のみの JSON 形式の出力を生成するよう求めます。 XNUMX 番目のアクションは、JSON 出力を取得し、日付形式を標準化します。 正規化とテンプレート化で説明するように、この XNUMX 段階のアクションは、適切なプロンプト エンジニアリングを使用して XNUMX 段階で実行することもできることに注意してください。

前述のコード サンプルの出力は、日付が 07/09/2020 と 08/09/2020 である JSON 構造であり、形式は DD/MM/YYYY であり、それぞれ患者の入院日と退院日です。退院概要レポートへ。

検索拡張生成に関する Q&A

LLM は、世界知識や世界観と呼ばれることが多い事実情報を保持することが知られています。 微調整すると、最先端の結果が得られます。 ただし、LLM がこの知識にいかに効果的にアクセスして操作できるかには制限があります。 その結果、特定の知識に大きく依存するタスクでは、特定の使用例ではパフォーマンスが最適化されない可能性があります。 たとえば、Q&A シナリオでは、モデルがその世界の知識だけに依存するのではなく、ドキュメント内で提供されるコンテキストに厳密に従うことが不可欠です。 これを逸脱すると、虚偽の表現、不正確さ、さらには不正確な応答につながる可能性があります。 この問題に対処するために最も一般的に使用される方法は、次のように知られています。 検索拡張生成 (ラグ)。 このアプローチは、検索モデルと言語モデルの両方の長所を相乗して、生成される応答の精度と品質を向上させます。

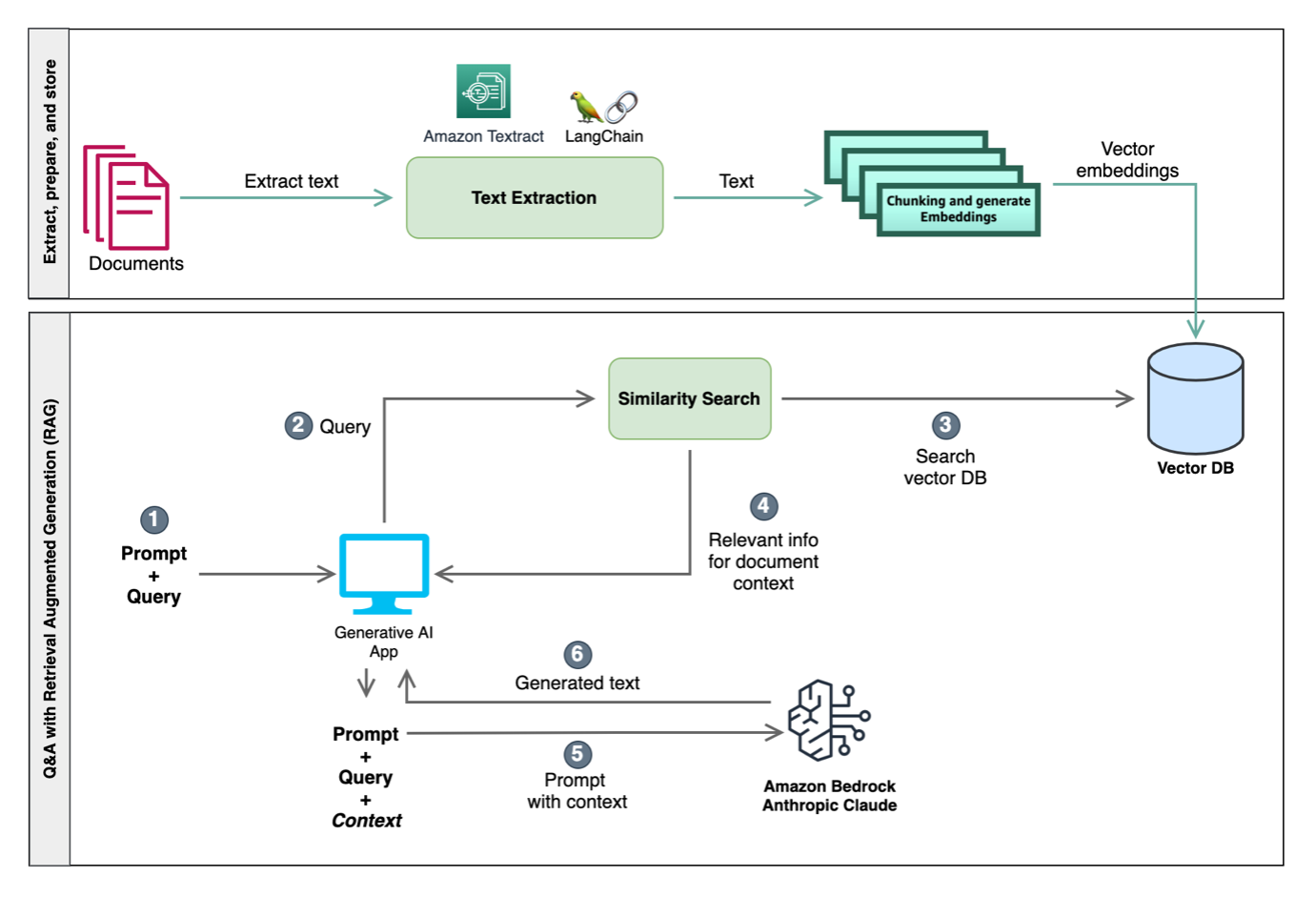

LLM は、メモリの制約や実行されるハードウェアの制限により、トークンに制限を課すこともあります。 この問題に対処するには、チャンキングなどの手法を使用して、大きなドキュメントを LLM のトークン制限内に収まる小さな部分に分割します。 一方、NLP では、埋め込みは主に単語の意味論的な意味や、高次元空間内の他の単語との関係を捉えるために使用されます。 これらの埋め込みにより単語がベクトルに変換され、モデルがテキスト データを効率的に処理して理解できるようになります。 埋め込みにより、単語とフレーズの間の意味上のニュアンスを理解することで、LLM は一貫した文脈に関連した出力を生成できるようになります。 次の重要な用語に注意してください。

- チャンキング – このプロセスでは、ドキュメントの大量のテキストが、より小さく意味のあるテキストの塊に分割されます。

- 埋め込み – これらは、チャンクからの意味情報を保持する各チャンクの固定次元ベクトル変換です。 これらの埋め込みは、その後ベクトル データベースにロードされます。

- ベクトルデータベース – これは、単語のコンテキストを表す単語埋め込みまたはベクトルのデータベースです。 これは、文書処理パイプラインの NLP タスクを支援する知識ソースとして機能します。 ここでのベクトル データベースの利点は、次のセクションで説明するように、テキスト生成中に必要なコンテキストのみを LLM に提供できることです。

RAG は、埋め込み機能を利用して、取得フェーズ中に関連するドキュメント セグメントを理解してフェッチします。 そうすることで、RAG は LLM のトークン制限内で動作し、最も適切な情報が生成用に選択されるようになり、より正確でコンテキストに関連した出力が得られます。

次の図は、LLM への入力を作成するためのこれらの手法の統合を示しており、LLM のコンテキストの理解を強化し、より適切なコンテキスト内の応答を可能にします。 XNUMX つのアプローチには、ベクトル データベースとチャンキングの両方を利用した類似性検索が含まれます。 ベクトル データベースには意味情報を表す埋め込みが格納され、チャンク化によりテキストが管理可能なセクションに分割されます。 類似性検索からのこのコンテキストを使用して、LLM は質問応答などのタスクや、分類や強化などのドメイン固有の操作を実行できます。

この投稿では、RAG ベースのアプローチを使用して、ドキュメントに対してコンテキスト内の Q&A を実行します。 次のコード サンプルでは、ドキュメントからテキストを抽出し、ドキュメントを小さなテキストの塊に分割します。 大きな複数ページのドキュメントがあり、LLM にトークン制限がある可能性があるため、チャンク化が必要です。 これらのチャンクは、後続のステップで類似性検索を実行するためにベクトル データベースにロードされます。 次の例では、ドキュメントチャンクのベクトル埋め込みを実行する Amazon Titan Embed Text v1 モデルを使用します。

このコードは、ベクトル データベースからの類似性検索アクションによって返されるテキストのチャンクを使用して、LLM に関連するコンテキストを作成します。 この例では、オープンソースを使用します。 FAISS ベクター ストア テキストの各チャンクのベクトル埋め込みを保存するサンプル ベクトル データベースとして。 次に、ベクトル データベースを次のように定義します。 LangChain レトリーバーに渡されます。 RetrievalQA 鎖。 これにより、ベクトル データベースに対して類似性検索クエリが内部的に実行され、質問に関連するテキストの上位 n (この例では n=3) のチャンクが返されます。 最後に、LLM チェーンは、関連するコンテキスト (テキストの関連するチャンクのグループ) と LLM が答える質問を使用して実行されます。 RAG を使用した Q&A の段階的なコード ウォークスルーについては、次の Python ノートブックを参照してください。 GitHubの.

FAISS の代わりに、以下を使用することもできます。 Amazon OpenSearch Service のベクトルデータベース機能, PostgreSQL用のAmazonリレーショナルデータベースサービス(Amazon RDS) ベクター ベクトル データベース、またはオープンソースの Chroma データベースとして拡張されます。

表形式データを使用した Q&A

ドキュメント内の表形式データは、構造が複雑であるため、LLM が処理するのが困難な場合があります。 Amazon Textract は、ページ、テーブル、セルなどの要素のネストされた形式でドキュメントからテーブルを抽出できるため、LLM で拡張できます。 表形式のデータを使用して Q&A を実行することは複数のステップからなるプロセスであり、次の方法で実行できます。 自己クエリ。 手順の概要は次のとおりです。

- Amazon Textract を使用してドキュメントからテーブルを抽出します。 Amazon Textract を使用すると、ドキュメントから表構造 (行、列、ヘッダー) を抽出できます。

- 表形式のデータを、ヘッダー名や各ヘッダーの説明などのメタデータ情報とともにベクトル データベースに保存します。

- プロンプトを使用して、LLM を使用して構造化クエリを作成し、テーブルからデータを取得します。

- クエリを使用して、ベクター データベースから関連するテーブル データを抽出します。

たとえば、銀行取引明細書で「預金額が 1000 ドルを超える取引は何ですか」というプロンプトが表示されると、LLM は次の手順を実行します。

- 次のようなクエリを作成します。

“Query: transactions” , “filter: greater than (Deposit$)”. - クエリを構造化クエリに変換します。

- テーブル データが保存されているベクトル データベースに構造化クエリを適用します。

表形式を使用した Q&A のサンプル コードの段階的なチュートリアルについては、次の Python ノートブックを参照してください。 GitHubの.

テンプレート化と正規化

このセクションでは、プロンプト エンジニアリング手法と LangChain の組み込みメカニズムを使用して、指定されたスキーマ内のドキュメントから抽出された出力を生成する方法を説明します。 また、前述の手法を使用して、抽出されたデータに対して標準化も実行します。 まず、目的の出力のテンプレートを定義します。 これはスキーマとして機能し、ドキュメントのテキストから抽出したい各エンティティの詳細をカプセル化します。

LLM がドキュメントのテキストから値を抽出するのを支援するために、エンティティごとに説明を使用してそのエンティティが何であるかを説明していることに注意してください。 次のサンプル コードでは、このテンプレートを使用して、LLM のプロンプトとドキュメントから抽出したテキストを作成します。 AmazonTextractPDFLoader その後、モデルを使用して推論を実行します。

あなたが見ることができるように、 {keys} プロンプトの一部はテンプレートのキーであり、 {details} はキーとその説明です。 この場合、JSON 形式で出力を生成するように命令で指定する以外に、モデルに出力形式を明示的に要求することはありません。 これはほとんどの場合機能します。 ただし、LLM からの出力は非決定的なテキスト生成であるため、プロンプトの指示の一部として形式を明示的に指定する必要があります。 これを解決するには、LangChain の 構造化出力パーサー モジュールを使用して、テンプレートを指示プロンプト形式に変換するのに役立つ自動プロンプト エンジニアリングを利用します。 前に定義したテンプレートを使用して、次のようにフォーマット指示プロンプトを生成します。

次に、この変数を元のプロンプト内で LLM への指示として使用します。これにより、プロンプトに少し変更を加えることで、出力が目的のスキーマで抽出およびフォーマットされます。

これまでのところ、目的のスキーマでドキュメントからデータを抽出しただけです。 ただし、まだいくつかの標準化を行う必要があります。 たとえば、患者の入院日と退院日を DD/MM/YYYY 形式で抽出したいとします。 この場合、 description キーのフォーマット命令:

の Python ノートブックを参照してください。 GitHubの 完全なステップバイステップのウォークスルーと説明を参照してください。

スペルチェックと修正

LLM は、人間のようなテキストを理解して生成するという優れた能力を実証してきました。 LLM のあまり議論されていないものの、非常に有用なアプリケーションの XNUMX つは、文書内の文法チェックや文章の修正における可能性です。 事前に定義された一連のルールに依存する従来の文法チェッカーとは異なり、LLM は膨大な量のテキスト データから特定したパターンを使用して、何が正しい言語または流暢な言語であるかを判断します。 これは、ルールベースのシステムが見逃してしまう可能性のあるニュアンス、コンテキスト、微妙な点を検出できることを意味します。

患者の退院概要から抽出された次のようなテキストを想像してください。「重度の肺炎で入院した患者ジョン・ドゥは、大幅な改善を示し、安全に退院できます。」 フォローアップは来週に予定されています。」 従来のスペルチェッカーでは、「admitd」、「pneumonia」、「improvement」、および「nex」がエラーとして認識される可能性があります。 ただし、これらのエラーの内容によっては、さらなる間違いや一般的な提案につながる可能性があります。 広範な訓練を受けた LLM は、次のように提案するかもしれません。「重度の肺炎で入院した患者 John Doe は、大幅な改善を示しており、安全に退院できます。 フォローアップは来週に予定されている。」

以下は、前に説明したものと同じテキストを含む、下手に手書きされたサンプル文書です。

Amazon Textract ドキュメントローダーを使用してドキュメントを抽出し、プロンプトエンジニアリングによって LLM に、抽出されたテキストを修正してスペルや文法の間違いを修正するように指示します。

上記のコードの出力は、ドキュメント ローダーによって抽出された元のテキストと、その後に LLM によって生成された修正されたテキストを示しています。

LLM は強力ですが、LLM の提案を単なる提案として捉えることが重要であることに留意してください。 これらは言語の複雑さを見事にうまく捉えていますが、絶対確実というわけではありません。 提案によっては、元のテキストの意図された意味や調子が変わる可能性があります。 したがって、人間のレビュー担当者にとって、LLM によって生成された修正を絶対的なものではなくガイドとして使用することが重要です。 人間の直感と LLM 機能のコラボレーションにより、書面によるコミュニケーションに誤りがないだけでなく、より豊かでニュアンスのあるコミュニケーションが可能になる未来が約束されています。

まとめ

Generative AI は、IDP でドキュメントを処理して洞察を引き出す方法を変えています。 ポストで 生成 AI による AWS インテリジェントな文書処理の強化では、パイプラインのさまざまな段階と、AWS の顧客であるリコーが LLM を使用して IDP パイプラインをどのように強化しているかについて説明しました。 この投稿では、Amazon Bedrock、Amazon Textract、および人気のある LangChain フレームワークを介して LLM で IDP ワークフローを強化するさまざまなメカニズムについて説明しました。 で入手可能なサンプルノートブックを使用して、LangChain を使用した新しい Amazon Textract ドキュメントローダーを今すぐ開始できます。 GitHubリポジトリ。 AWS での生成 AI の操作の詳細については、以下を参照してください。 AWS でジェネレーティブ AI を使用して構築するための新しいツールを発表.

著者について

ソナリ・サフ は、AWS の AI/ML サービス チームとともにインテリジェントなドキュメント処理を主導しています。 彼女は作家であり、思想的リーダーであり、情熱的な技術者でもあります。 彼女の主な焦点分野は AI と ML であり、世界中の AI と ML のカンファレンスやミートアップで頻繁に講演しています。 彼女はテクノロジーとテクノロジー業界で幅広く深い経験を持ち、ヘルスケア、金融セクター、保険の業界専門知識を備えています。

ソナリ・サフ は、AWS の AI/ML サービス チームとともにインテリジェントなドキュメント処理を主導しています。 彼女は作家であり、思想的リーダーであり、情熱的な技術者でもあります。 彼女の主な焦点分野は AI と ML であり、世界中の AI と ML のカンファレンスやミートアップで頻繁に講演しています。 彼女はテクノロジーとテクノロジー業界で幅広く深い経験を持ち、ヘルスケア、金融セクター、保険の業界専門知識を備えています。

アンジャンビスワス AI/ML とデータ分析を専門とするシニア AI サービス ソリューション アーキテクトです。 Anjan は、世界規模の AI サービス チームの一員であり、お客様と協力して、AI と ML を使用したビジネス上の問題に対するソリューションの理解と開発を支援しています。 Anjan は、グローバルサプライチェーン、製造、および小売組織との 14 年以上の経験を持ち、お客様が AWS AI サービスを開始してスケールするのを積極的に支援しています。

アンジャンビスワス AI/ML とデータ分析を専門とするシニア AI サービス ソリューション アーキテクトです。 Anjan は、世界規模の AI サービス チームの一員であり、お客様と協力して、AI と ML を使用したビジネス上の問題に対するソリューションの理解と開発を支援しています。 Anjan は、グローバルサプライチェーン、製造、および小売組織との 14 年以上の経験を持ち、お客様が AWS AI サービスを開始してスケールするのを積極的に支援しています。

チンマイ・レーン アマゾン ウェブ サービスの AI/ML スペシャリスト ソリューション アーキテクトです。 彼女は応用数学と機械学習に情熱を持っています。 彼女は、AWS の顧客向けのインテリジェントなドキュメント処理と生成 AI ソリューションの設計に重点を置いています。 仕事以外では、サルサとバチャータのダンスを楽しんでいます。

チンマイ・レーン アマゾン ウェブ サービスの AI/ML スペシャリスト ソリューション アーキテクトです。 彼女は応用数学と機械学習に情熱を持っています。 彼女は、AWS の顧客向けのインテリジェントなドキュメント処理と生成 AI ソリューションの設計に重点を置いています。 仕事以外では、サルサとバチャータのダンスを楽しんでいます。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :持っている

- :は

- :not

- :どこ

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 視聴者の38%が

- 16

- 22

- 23

- 33

- 視聴者の38%が

- 7

- 9

- a

- 能力

- 私たちについて

- 絶対の

- アクセス

- アクセス

- 従った

- 精度

- 正確な

- 達成

- 越えて

- Action

- 行動

- 積極的に

- アクティビティ

- 使徒行伝

- Ad

- 住所

- 追加

- 付着します

- 認める

- 認められた

- 進歩

- 利点

- 出現

- 年齢

- エージェント

- AI

- AIサービス

- AI / ML

- 整列した

- すべて

- 許可

- ことができます

- 沿って

- また

- 代替案

- しかし

- Amazon

- Amazon Comprehend

- アマゾンRDS

- アマゾンテキストラック

- Amazon Webサービス

- 金額

- an

- 分析論

- 分析します

- および

- 回答

- 人間原理

- どれか

- API

- 適用された

- 予定

- アプローチ

- 建築

- です

- AREA

- 周りに

- 宝品

- 人工の

- 人工知能

- 人工知能(AI)

- AS

- 側面

- アシスト

- アシスタント

- At

- 増強

- 増強された

- 著者

- 自動化する

- 自動化

- 自動的に

- オートメーション

- 利用できます

- 認知度

- AWS

- AWS のお客様

- 銀行

- BE

- なぜなら

- になる

- き

- 有益な

- 恩恵

- BEST

- ベストプラクティス

- の間に

- ブロック

- ブロック

- 両言語で

- 幅

- ブレーク

- 休憩

- ビルド

- 建物

- 内蔵

- ビジネス

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- コール

- 缶

- 取得することができます

- 機能

- キャプチャー

- 場合

- 例

- 細胞

- 一定

- チェーン

- チェーン

- 挑戦する

- 挑戦

- 変化する

- 変更

- 変化

- 小切手

- 選択

- クレーム

- class

- クラス

- 分類

- 分類します

- コード

- コヒーレント

- 環境、テクノロジーを推奨

- コラム

- コラム

- 組み合わせ

- 組み合わせる

- comes

- コマンドと

- 一般に

- コミュニケーション

- 互換性のあります

- コンプリート

- 複雑な

- 複雑さ

- 理解する

- 特徴

- 会議

- 接続する

- 整合性のある

- からなる

- 制約

- 構築する

- 含む

- 含まれている

- 含まれています

- コンテンツ

- コンテキスト

- 文脈上の

- 変換

- 基本

- 正しい

- 訂正さ

- 補正

- 可能性

- クラフト

- 細工された

- 作成します。

- 重大な

- カスタム

- 顧客

- Customers

- ダンシング

- データ

- データ分析

- データベース

- データベースを追加しました

- 日付

- 試合日

- 取引

- 深いです

- より深い

- 定義します

- 定義済みの

- 定義

- 実証

- によっては

- 預金

- 深さ

- 記載された

- 説明

- 設計

- 希望

- 詳細

- 詳細な

- 細部

- 検出

- 決定する

- 開発する

- 開発者

- ダイエット

- 異なります

- 直接に

- 話し合います

- 議論する

- ダイビング

- 分割

- 分ける

- do

- 医師

- ドキュメント

- ドキュメント

- ドキュメント

- doe

- そうではありません

- すること

- ドン

- 行われ

- ドント

- ダウン

- 劇的に

- 原因

- 間に

- ダイナミック

- e

- 各

- 前

- 簡単に

- 使いやすい

- 効果的に

- 効率

- 効率的な

- 効率良く

- 努力

- どちら

- 要素は

- 埋め込みます

- 採用

- 力を与える

- enable

- 可能

- 有効にする

- end

- エンジニアリング

- 高めます

- 強化された

- 強化

- 確保

- 確保する

- 全体

- エンティティ

- エンティティ

- 装備

- エラー

- 本質的な

- さらに

- 例

- 除く

- 例外

- 既存の

- 体験

- 専門知識

- 説明する

- 説明

- 説明

- 説明

- 明示的

- 表現

- 伸ばす

- 広範囲

- エキス

- 抽出

- 抽出物

- 秋

- false

- 遠く

- 疲労

- フィールズ

- フィギュア

- ファイナル

- 最後に

- ファイナンシャル

- 金融部門

- 名

- フィット

- フォーカス

- 焦点を当てて

- 続いて

- フォロー中

- 次

- 形式でアーカイブしたプロジェクトを保存します.

- フォーム

- 発見

- Foundation

- フレームワーク

- 無料版

- 頻繁に

- から

- フロンティア

- フル

- 完全に

- さらに

- 未来

- 生成する

- 生成された

- 生成

- 生成

- 世代

- 生々しい

- 生成AI

- 取得する

- 与える

- 与えられた

- グローバル

- 文法

- 把握

- 大きい

- グループ

- ガイド

- ハンド

- ハンドル

- 起こる

- 出来事

- Hardware

- 持ってる

- ヘッダーの

- ヘルスケア

- 重く

- 助けます

- 役立つ

- 助け

- ことができます

- 彼女の

- こちら

- ハイレベル

- 高性能

- より高い

- 保持している

- 病院

- 認定条件

- How To

- しかしながら

- HTML

- HTTPS

- 人間

- i

- ID

- 特定され

- if

- 説明する

- 画像

- とてつもなく

- 影響

- import

- 重要

- インポート

- 課す

- 改善

- in

- 含めて

- index

- 産業を変えます

- 情報

- 情報化時代

- 革新的手法

- 洞察

- 説明書

- 保険

- 統合する

- 統合された

- 統合

- 統合

- インテリジェンス

- インテリジェント-

- インテリジェントなドキュメント処理

- 意図された

- 内部で

- に

- 複雑さ

- 紹介する

- 導入

- 紹介します

- IT

- ITS

- Jackson (ジェームズ・ジャクソン)

- John Redfern

- JOHN DOE

- ジョン

- JPG

- JSON

- ただ

- キー

- キー

- 知っている

- 知識

- 既知の

- 言語

- 大

- レイアウト

- つながる

- リーダー

- 主要な

- 学習

- 残す

- 図書館

- ような

- 可能性が高い

- 制限

- 制限

- リスト

- LLM

- 負荷

- ローダ

- ロジック

- 見て

- たくさん

- 機械

- 機械学習

- 作成

- 管理します

- 扱いやすいです

- マネージド

- 管理する

- マニュアル

- 製造業

- マークされた

- 数学

- 五月..

- me

- 意味

- 意味のある

- 手段

- メカニズム

- メカニズム

- ミートアップ

- メモリ

- Meta

- 方法

- メソッド

- かもしれない

- マインド

- ミス

- ミス

- ML

- モデル

- モジュール

- 他には?

- 住宅ローン

- 最も

- の試合に

- 名

- 名

- ナチュラル

- 自然言語処理

- 必要

- 必要

- 必要とされる

- ニーズ

- 新作

- 次の

- 来週

- NLP

- ノート

- 今

- ニュアンス

- 数

- オブジェクト

- オブジェクト

- of

- オファー

- 頻繁に

- on

- ONE

- の

- オープンソース

- 業務執行統括

- 機会

- 最適な

- オプション

- or

- 組織

- オリジナル

- その他

- さもないと

- 私たちの

- でる

- 結果

- 出力

- outputs

- 外側

- が

- 概要

- パッケージ

- ページ

- ページ

- 痛み

- 対になった

- 足

- 部

- 特に

- パス

- 渡された

- 通過

- 情熱的な

- path

- 患者

- パターン

- パターン

- 以下のために

- 実行する

- パフォーマンス

- 実行

- 実行

- 実行する

- 相

- 博士号

- フレーズ

- パイプライン

- 計画

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- お願いします

- 肺炎

- ポイント

- 人気

- 可能

- ポスト

- 潜在的な

- 電力

- パワード

- 強力な

- プラクティス

- 正確に

- 精度

- 優先

- 現在

- 前に

- 主に

- 印刷物

- プリント

- 問題

- 問題

- プロセス

- 処理済み

- 処理

- 作り出す

- 約束

- 適切な

- 提供します

- 提供

- プロバイダー

- は、大阪で

- Python

- 質問と回答

- 品質

- 質問

- クイック

- すぐに

- Raw

- リーディング

- 認識する

- 縮小

- 参照する

- 参照

- 言及

- の関係

- 関連した

- 頼る

- 信頼

- 顕著

- レポート

- 表す

- 表します

- の提出が必要です

- 必要

- それぞれ

- 回答

- 制限

- 結果

- 結果として

- 結果

- 小売

- リテンションを維持

- 保持

- 収益

- 富裕層

- ルーム

- ルール

- ラン

- runs

- s

- 安全に

- 同じ

- 言う

- 規模

- シナリオ

- 予定の

- を検索

- 二番

- セクション

- セクション

- セクター

- セグメント

- 選択

- シニア

- 文

- シリーズ

- 役立つ

- 仕える

- サービス

- サービス

- セッションに

- 厳しい

- 彼女

- ショート

- すべき

- 示す

- 作品

- 重要

- 小さい

- より小さい

- スニペット

- So

- もっぱら

- ソリューション

- 解決する

- 一部

- ソース

- スペース

- スピークス

- 専門家

- 特定の

- 特に

- 指定の

- 綴り

- split

- ステージ

- 標準化

- start

- 開始

- 最先端の

- ステートメント

- 手順

- ステップ

- まだ

- 店舗

- 保存され

- 店舗

- 強み

- 文字列

- 構造の

- 構造

- 構造化された

- 奮闘

- それに続きます

- 続いて

- そのような

- 示唆する

- まとめる

- 概要

- 供給

- サプライチェーン

- サポート

- サポート

- 相乗効果

- システム

- テーブル

- 取る

- 取り

- 仕事

- タスク

- チーム

- 技術

- テクニック

- 技術者

- テクノロジー

- template

- 条件

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- テキスト

- より

- それ

- 世界

- アプリ環境に合わせて

- それら

- その後

- そこ。

- したがって、

- ボーマン

- 彼ら

- この

- 考え

- 三

- 介して

- タイタン

- 〜へ

- 今日

- 今日の

- 一緒に

- トークン

- トークン

- TONE

- 豊富なツール群

- top

- トータル

- 伝統的な

- 引きずる

- トレーニング

- 取引

- 最適化の適用

- 変換

- true

- 試します

- 2

- type

- わかる

- 理解する

- 異なり、

- 発表

- URL

- つかいます

- 使用事例

- 中古

- users

- 使用されます

- 利用された

- 活用

- v1

- 値

- 価値観

- 変数

- さまざまな

- 広大な

- 多才な

- バージョン

- 、

- 詳しく見る

- ボリューム

- ウォークスルー

- 欲しいです

- ました

- 仕方..

- we

- ウェブ

- Webサービス

- 週間

- WELL

- この試験は

- いつ

- which

- while

- 誰

- 意志

- 以内

- 無し

- 目撃

- Word

- 言葉

- 仕事

- ワークフロー

- ワークフロー

- ワーキング

- 作品

- 世界

- でしょう

- 書かれた

- X

- 年

- You

- ゼファーネット