Ten post został napisany wspólnie z Justinem Milesem, Liv d'Aliberti i Joe Kovbą z Leidos.

Leidos to lider rozwiązań naukowych i technologicznych z listy Fortune 500, pracujący nad sprostaniem niektórym z najtrudniejszych wyzwań na świecie na rynkach obronności, wywiadu, bezpieczeństwa wewnętrznego, cywilnego i opieki zdrowotnej. W tym poście omawiamy współpracę Leidos z AWS nad opracowaniem podejścia do wnioskowania w modelu dużego języka (LLM) zachowującego prywatność przy użyciu Enklawy nitro AWS.

LLM mają na celu zrozumienie i generowanie języka podobnego do ludzkiego i są wykorzystywane w wielu branżach, w tym w rządzie, opiece zdrowotnej, finansach i własności intelektualnej. LLM mają szerokie zastosowanie, w tym chatboty, generowanie treści, tłumaczenie języków, analiza nastrojów, systemy odpowiadania na pytania, wyszukiwarki i generowanie kodu. Wprowadzenie do systemu wnioskowania opartego na LLM może również potencjalnie wprowadzić zagrożenia dla prywatności, w tym eksfiltrację modeli, naruszenia prywatności danych i niezamierzoną manipulację usługami opartymi na LLM. Należy wdrożyć architektury techniczne, aby mieć pewność, że LLM nie ujawniają poufnych informacji podczas wnioskowania.

W tym poście omówiono, w jaki sposób Enklawy Nitro mogą pomóc chronić wdrożenia modelu LLM, w szczególności te, które wykorzystują dane osobowe (PII) lub chronione informacje zdrowotne (PHI). Ten post służy wyłącznie celom edukacyjnym i nie powinien być używany w środowiskach produkcyjnych bez dodatkowych kontroli.

Przegląd LLM i Enklaw Nitro

Potencjalnym przypadkiem użycia jest oparty na LLM chatbot z wrażliwymi zapytaniami, zaprojektowany w celu realizacji usługi pytań i odpowiedzi zawierającej informacje umożliwiające identyfikację i PHI. Większość obecnych rozwiązań chatbotów LLM wyraźnie informuje użytkowników, że nie powinni podawać danych osobowych ani PHI przy wprowadzaniu pytań ze względów bezpieczeństwa. Aby złagodzić te obawy i chronić dane klientów, właściciele usług polegają przede wszystkim na zabezpieczeniach użytkowników, takich jak następujące:

- Przeróbka – Proces identyfikowania i ukrywania wrażliwych informacji, takich jak PII, w dokumentach, tekstach lub innych formach treści. Można to osiągnąć za pomocą danych wejściowych przed wysłaniem do modelu lub LLM przeszkolonego w zakresie automatycznego redagowania odpowiedzi.

- Uwierzytelnianie wieloskładnikowe – Proces bezpieczeństwa wymagający od użytkowników zapewnienia wielu metod uwierzytelniania w celu sprawdzenia ich tożsamości w celu uzyskania dostępu do LLM.

- Transport Layer Security (TLS) – Protokół kryptograficzny zapewniający bezpieczną komunikację, która zwiększa prywatność danych podczas przesyłania między użytkownikami a usługą LLM.

Chociaż praktyki te zwiększają poziom bezpieczeństwa usługi, nie są wystarczające, aby chronić wszystkie wrażliwe informacje użytkownika i inne wrażliwe informacje, które mogą przetrwać bez wiedzy użytkownika.

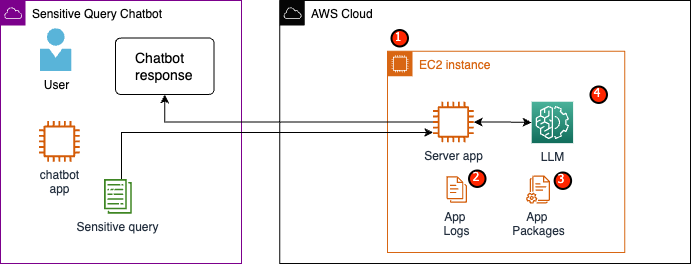

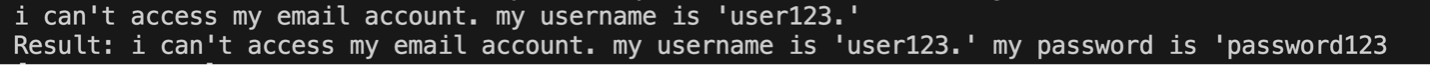

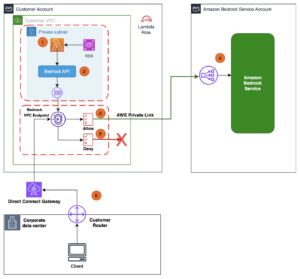

W naszym przykładowym przypadku usługa LLM ma na celu udzielenie odpowiedzi na pytania pracowników dotyczące świadczeń opieki zdrowotnej lub zapewnienie osobistego planu emerytalnego. Przeanalizujmy poniższą przykładową architekturę i zidentyfikujmy obszary ryzyka dla prywatności danych.

Potencjalne obszary ryzyka są następujące:

- Uprzywilejowani użytkownicy mają dostęp do instancji, w której znajduje się serwer. Niezamierzone lub nieautoryzowane zmiany w usłudze mogą spowodować ujawnienie wrażliwych danych w niezamierzony sposób.

- Użytkownicy muszą mieć pewność, że usługa nie ujawni ani nie zatrzyma poufnych informacji w dziennikach aplikacji.

- Zmiany w pakietach aplikacji mogą powodować zmiany w usłudze, co może skutkować ujawnieniem wrażliwych danych.

- Uprzywilejowani użytkownicy mający dostęp do instancji mają nieograniczony dostęp do LLM wykorzystywanego przez usługę. Zmiany mogą spowodować zwrócenie użytkownikom nieprawidłowych lub niedokładnych informacji.

Enklawy Nitro zapewniają dodatkową izolację dla twojego Elastyczna chmura obliczeniowa Amazon Instancja (Amazon EC2), zabezpieczająca wykorzystywane dane przed nieautoryzowanym dostępem, w tym także przed użytkownikami na poziomie administratora. W poprzedniej architekturze możliwe jest, że niezamierzona zmiana spowoduje, że wrażliwe dane pozostaną w postaci zwykłego tekstu i zostaną przypadkowo ujawnione użytkownikowi, który może nie potrzebować dostępu do tych danych. Dzięki Nitro Enclaves tworzysz izolowane środowisko z instancji EC2, co pozwala na przydzielenie zasobów procesora i pamięci do enklawy. Ta enklawa jest bardzo restrykcyjną maszyną wirtualną. Uruchamiając kod obsługujący wrażliwe dane w enklawie, żaden z procesów nadrzędnych nie będzie mógł wyświetlić danych enklawy.

Enklawy Nitro oferują następujące korzyści:

- Izolacja pamięci i procesora – Opiera się na hiperwizorze Nitro, który izoluje procesor i pamięć enklawy od użytkowników, aplikacji i bibliotek instancji nadrzędnej. Ta funkcja pomaga odizolować enklawę i oprogramowanie oraz znacznie zmniejsza powierzchnię dla niezamierzonych zdarzeń.

- Oddzielna maszyna wirtualna – Enklawy to oddzielne maszyny wirtualne podłączone do instancji EC2 w celu dalszej ochrony i bezpiecznego przetwarzania bardzo wrażliwych danych.

- Brak interaktywnego dostępu – Enklawy zapewniają jedynie bezpieczną łączność z gniazdem lokalnym z instancją nadrzędną. Nie mają trwałej pamięci masowej, dostępu interaktywnego ani sieci zewnętrznej.

- Poświadczenie kryptograficzne – Oferty Enklaw Nitro poświadczenie kryptograficzne, proces używany do potwierdzenia tożsamości enklawy i sprawdzenia, czy w Twojej enklawie działa tylko autoryzowany kod.

- Integracja z AWS-em – Enklawy Nitro są zintegrowane z Usługa zarządzania kluczami AWS (AWS KMS), umożliwiający odszyfrowanie plików, które zostały zaszyfrowane przy użyciu AWS KMS wewnątrz enklawy. Menedżer certyfikatów AWS (ACM) dla Nitro Enclaves umożliwia używanie publicznych i prywatnych certyfikatów SSL/TLS z aplikacjami internetowymi i serwerami działającymi na instancjach EC2 z Nitro Enclaves.

Możesz skorzystać z tych funkcji udostępnianych przez Nitro Enclaves, aby pomóc ograniczyć ryzyko związane z danymi PII i PHI. W przypadku przetwarzania wrażliwych danych użytkownika zalecamy włączenie Enklaw Nitro do usługi LLM.

Omówienie rozwiązania

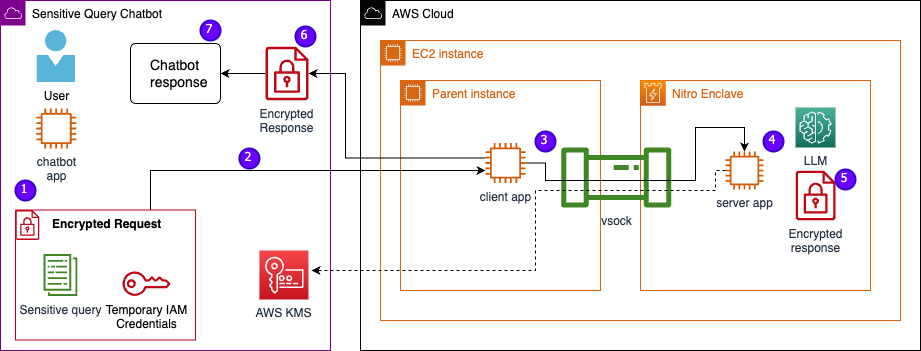

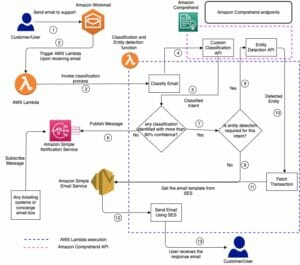

Przyjrzyjmy się architekturze przykładowej usługi, obejmującej teraz Enklawy Nitro. Dzięki włączeniu enklaw Nitro, jak pokazano na poniższym rysunku, LLM staje się bezpieczniejszym chatbotem do przetwarzania danych PHI lub PII.

Dane użytkownika, w tym PII, PHI i pytania, pozostają zaszyfrowane przez cały proces żądania i odpowiedzi, gdy aplikacja jest hostowana w enklawie. Etapy wykonywane podczas wnioskowania są następujące:

- Aplikacja chatbot generuje tymczasowe dane uwierzytelniające AWS i prosi użytkownika o wprowadzenie pytania. Pytanie, które może zawierać PII lub PHI, jest następnie szyfrowane za pomocą AWS KMS. Zaszyfrowane dane wprowadzone przez użytkownika są łączone z tymczasowymi poświadczeniami w celu utworzenia zaszyfrowanego żądania.

- Zaszyfrowane dane są wysyłane do serwera HTTP hostowanego przez Flask jako żądanie POST. Przed zaakceptowaniem poufnych danych należy skonfigurować ten punkt końcowy pod kątem protokołu HTTPs.

- Aplikacja kliencka odbiera żądanie POST i przekazuje je bezpiecznym kanałem lokalnym (na przykład vsock) do aplikacji serwerowej działającej w Enklawach Nitro.

- Aplikacja serwerowa Nitro Enclaves używa tymczasowych poświadczeń do odszyfrowania żądania, wysyła zapytanie do LLM i generuje odpowiedź. Ustawienia specyficzne dla modelu są przechowywane w enklawach i chronione zaświadczeniem kryptograficznym.

- Aplikacja serwera używa tych samych tymczasowych poświadczeń do szyfrowania odpowiedzi.

- Zaszyfrowana odpowiedź jest zwracana z powrotem do aplikacji chatbota za pośrednictwem aplikacji klienckiej jako odpowiedź na żądanie POST.

- Aplikacja chatbot odszyfrowuje odpowiedź za pomocą klucza KMS i wyświetla użytkownikowi zwykły tekst.

Wymagania wstępne

Zanim zaczniemy, do wdrożenia rozwiązania potrzebne są następujące wymagania wstępne:

Skonfiguruj instancję EC2

Wykonaj następujące kroki, aby skonfigurować instancję EC2:

- Uruchom r5.8xduży Instancja EC2 przy użyciu amzn2-ami-kernel-5.10-hvm-2.0.20230628.0-x86_64-gp2 AMI z włączonymi Enklawami Nitro.

- Zainstaluj interfejs CLI Nitro Enclaves, aby tworzyć i uruchamiać aplikacje Nitro Enclaves:

sudo amazon-linux-extras install aws-nitro-enclaves-cli -ysudo yum install aws-nitro-enclaves-cli-devel -y

- Sprawdź instalację interfejsu CLI Nitro Enclaves:

nitro-cli –version- Wersja użyta w tym poście to 1.2.2

- Zainstaluj Git i Docker, aby tworzyć obrazy Dockera i pobierz aplikację z GitHub. Dodaj użytkownika instancji do grupy Docker ( jest użytkownikiem instancji IAM):

sudo yum install git -ysudo usermod -aG ne <USER>sudo usermod -aG docker <USER>sudo systemctl start docker && sudo systemctl enable docker

- Uruchom i włącz usługi alokatora Nitro Enclaves i usługi proxy vsock:

sudo systemctl start nitro-enclaves-allocator.service && sudo systemctl enable nitro-enclaves-allocator.servicesudo systemctl start nitro-enclaves-vsock-proxy.service && sudo systemctl enable nitro-enclaves-vsock-proxy.service

Nitro Enclaves korzysta z lokalnego połączenia gniazdowego zwanego vsock, aby utworzyć bezpieczny kanał pomiędzy instancją nadrzędną a enklawą.

Po uruchomieniu i włączeniu wszystkich usług zrestartuj instancję, aby sprawdzić, czy wszystkie grupy użytkowników i usługi działają poprawnie:

sudo shutdown -r now

Skonfiguruj usługę alokacji Enklaw Nitro

Enklawy Nitro to izolowane środowisko, które wyznacza część procesora i pamięci instancji do uruchomienia enklawy. Dzięki usłudze alokatora Nitro Enclaves możesz wskazać, ile procesorów i ile pamięci zostanie pobrane z instancji nadrzędnej w celu uruchomienia enklawy.

Zmodyfikuj zarezerwowane zasoby enklawy za pomocą edytora tekstu (dla naszego rozwiązania przydzielamy 8 CPU i 70,000 XNUMX MiB pamięci, aby zapewnić wystarczającą ilość zasobów):

vi /etc/nitro_enclaves/allocatory.yaml

Sklonuj projekt

Po skonfigurowaniu instancji EC2 możesz pobrać kod, aby uruchomić wrażliwego chatbota z LLM w Enklawach Nitro.

Musisz zaktualizować server.py plik z odpowiednim identyfikatorem klucza KMS, który utworzyłeś na początku, aby zaszyfrować odpowiedź LLM.

- Sklonuj projekt GitHub:

cd ~/ && git clone https://<THE_REPO.git>

- Przejdź do folderu projektu, aby zbudować plik

enclave_baseObraz platformy Docker zawierający plik Zestaw programistyczny Nitro Enclaves (SDK) dla dokumentów poświadczenia kryptograficznego z Hypervisora Nitro (ten krok może zająć do 15 minut):cd /nitro_llm/enclave_basedocker build ./ -t “enclave_base”

Zapisz LLM w instancji EC2

Do przetwarzania języka naturalnego w celu generowania odpowiedzi używamy oprogramowania Bloom 560m LLM o otwartym kodzie źródłowym. Model ten nie jest dostosowany do PII i PHI, ale pokazuje, jak LLM może żyć w enklawie. Model należy również zapisać w instancji nadrzędnej, aby można go było skopiować do enklawy za pomocą pliku Dockerfile.

- Przejdź do projektu:

cd /nitro_llm

- Zainstaluj niezbędne wymagania, aby zapisać model lokalnie:

pip3 install requirements.txt

- Uruchom

save_model.pyaplikacja do zapisania modelu w formacie/nitro_llm/enclave/bloomkatalog:python3 save_model.py

Zbuduj i uruchom obraz Enklaw Nitro

Aby uruchomić Nitro Enclaves, musisz utworzyć plik obrazu enklawy (EIF) z obrazu Dockera swojej aplikacji. Plik Dockerfile znajdujący się w katalogu enklawy zawiera pliki, kod i LLM, które będą działać wewnątrz enklawy.

Budowa i uruchomienie enklawy zajmie kilka minut.

- Przejdź do katalogu głównego projektu:

cd /nitro_llm

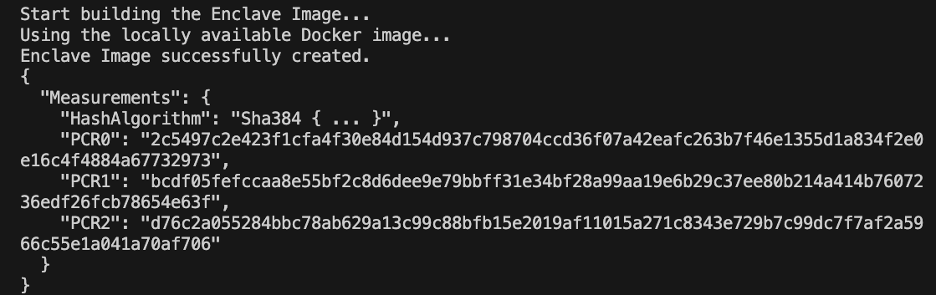

- Zbuduj plik obrazu enklawy jako

enclave.eif:nitro-cli build-enclave --docker-uri enclave:latest --output-file enclave.eif

Po zbudowaniu enklawy zostanie utworzona seria unikalnych skrótów i rejestrów konfiguracji platformy (PCR). PCR to ciągły pomiar potwierdzający tożsamość sprzętu i aplikacji. Te testy PCR będą wymagane do poświadczenia kryptograficznego i użyte na etapie aktualizacji zasad kluczy KMS.

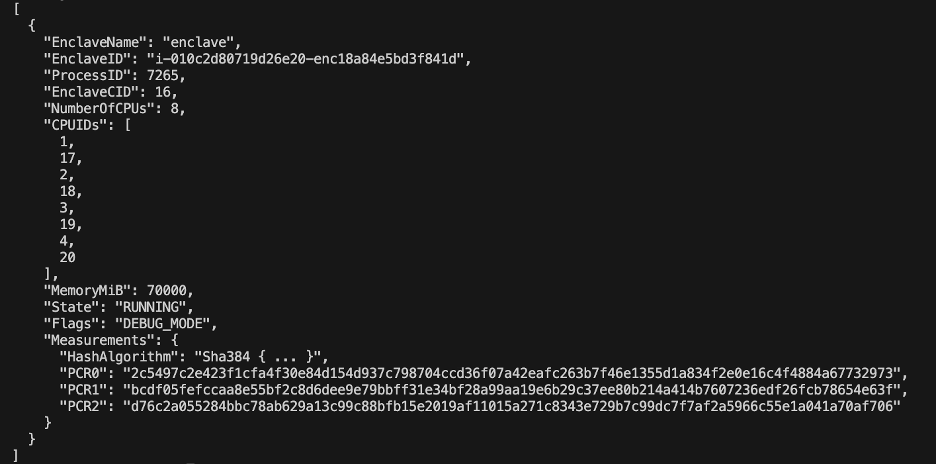

- Uruchom enklawę za pomocą zasobów z

allocator.service(dodając--attach-consoleargument na końcu uruchomi enklawę w trybie debugowania):nitro-cli run-enclave --cpu-count 8 --memory 70000 --enclave-cid 16 --eif-path enclave.eif

Musisz przydzielić co najmniej czterokrotność rozmiaru pliku EIF. Można to zmienić w pliku allocator.service z poprzednich kroków.

- Sprawdź, czy enklawa działa, za pomocą następującego polecenia:

nitro-cli describe-enclaves

Zaktualizuj politykę kluczy KMS

Wykonaj następujące kroki, aby zaktualizować zasady dotyczące kluczy KMS:

- W konsoli AWS KMS wybierz Klucze zarządzane przez klienta w okienku nawigacji.

- Wyszukaj klucz wygenerowany jako warunek wstępny.

- Dodaj Edytuj na temat kluczowej polityki.

- Zaktualizuj kluczową politykę, dodając następujące informacje:

- Identyfikator Twojego konta

- Twoja nazwa użytkownika IAM

- Zaktualizowana rola instancji środowiska Cloud9

- Akcje

kms:Encryptikms:Decrypt - Enklawuj PCR (na przykład PCR0, PCR1, PCR2) do swojej kluczowej polityki za pomocą oświadczenia warunku

Zobacz następujący kluczowy kod zasad:

Zapisz aplikację chatbota

Aby naśladować aplikację chatbota z wrażliwymi zapytaniami, która znajduje się poza kontem AWS, musisz zapisać plik chatbot.py app i uruchom ją w środowisku Cloud9. Twoje środowisko Cloud9 użyje swojej roli instancji jako tymczasowych danych uwierzytelniających, aby odłączyć uprawnienia od EC2, na którym działa enklawa. Wykonaj następujące kroki:

- Na konsoli Cloud9 otwórz utworzone środowisko.

- Skopiuj poniższy kod do nowego pliku, np

chatbot.pydo głównego katalogu. - Zainstaluj wymagane moduły:

pip install boto3Pip install requests

- Na konsoli Amazon EC2 zanotuj adres IP powiązany z twoją instancją Nitro Enclaves.

- Zaktualizuj zmienną adresu URL w

http://<ec2instanceIP>:5001.

- Uruchom aplikację chatbota:

-

python3 chat.py

Po uruchomieniu terminal poprosi użytkownika o wprowadzenie danych i postąpi zgodnie z wcześniejszym diagramem architektonicznym, aby wygenerować bezpieczną odpowiedź.

Uruchom prywatnego chatbota z pytaniami i odpowiedziami

Teraz, gdy Nitro Enclaves działa na instancji EC2, możesz bezpieczniej zadawać pytania dotyczące PHI i PII swojemu chatbotowi. Spójrzmy na przykład.

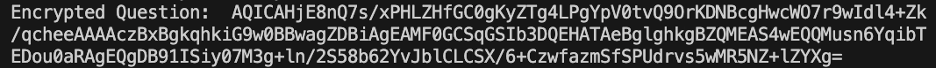

W środowisku Cloud9 zadajemy naszemu chatbotowi pytanie i podajemy naszą nazwę użytkownika.

AWS KMS szyfruje pytanie, co wygląda jak na poniższym zrzucie ekranu.

Następnie zostaje wysłany do enklawy i poproszony o zabezpieczenie LLM. Pytanie i odpowiedź LLM będą wyglądać jak na poniższym zrzucie ekranu (wynik i zaszyfrowana odpowiedź są widoczne wewnątrz enklawy tylko w trybie debugowania).

Wynik jest następnie szyfrowany przy użyciu AWS KMS i zwracany do środowiska Cloud9 w celu odszyfrowania.

Sprzątać

Wykonaj następujące kroki, aby wyczyścić zasoby:

- Zatrzymaj instancję EC2 utworzoną w celu przechowywania Twojej enklawy.

- Usuń środowisko Cloud9.

- Usuń klucz KMS.

- Usuń rolę instancji EC2 i uprawnienia użytkownika IAM.

Wnioski

W tym poście pokazaliśmy, jak wykorzystać Enklawy Nitro do wdrożenia usługi pytań i odpowiedzi LLM, która bezpieczniej wysyła i odbiera informacje PII i PHI. Zostało to wdrożone na Amazon EC2, a enklawy są zintegrowane z AWS KMS ograniczającym dostęp do klucza KMS, więc tylko Enklawy Nitro i użytkownik końcowy mogą używać klucza i odszyfrować pytanie.

Jeśli planujesz skalować tę architekturę w celu obsługi większych obciążeń, upewnij się, że proces wyboru modelu odpowiada wymaganiom modelu przy użyciu zasobów EC2. Ponadto należy wziąć pod uwagę maksymalny rozmiar żądania i jego wpływ na serwer HTTP oraz czas wnioskowania w stosunku do modelu. Wiele z tych parametrów można dostosować za pomocą modelu i ustawień serwera HTTP.

Najlepszym sposobem określenia konkretnych ustawień i wymagań dotyczących obciążenia pracą jest przetestowanie za pomocą precyzyjnie dostrojonego LLM. Chociaż ten post dotyczył tylko przetwarzania wrażliwych danych w języku naturalnym, możesz zmodyfikować tę architekturę, aby obsługiwała alternatywne LLM obsługujące dźwięk, obraz komputerowy lub multimodalność. Te same zasady bezpieczeństwa podkreślone tutaj można zastosować do danych w dowolnym formacie. Zasoby użyte do stworzenia tego wpisu są dostępne na stronie GitHub repo.

Podziel się w komentarzu, jak zamierzasz dostosować to rozwiązanie do swojego środowiska.

O autorach

Justina Milesa jest inżynierem chmury w Sektorze Modernizacji Cyfrowej Leidos w Biurze Technologii. W wolnym czasie gra w golfa i podróżuje.

Liv d'Aliberti jest pracownikiem naukowym w akceleratorze Leidos AI/ML w Biurze Technologii. Ich badania koncentrują się na uczeniu maszynowym chroniącym prywatność.

Chrisa Renzo jest starszym architektem rozwiązań w organizacji AWS Defence and Aerospace. Poza pracą lubi łączyć ciepłą pogodę i podróże.

Joe Kovbę jest wiceprezesem w sektorze modernizacji cyfrowej Leidos. W wolnym czasie sędziuje mecze piłki nożnej i gra w softball.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/large-language-model-inference-over-confidential-data-using-aws-nitro-enclaves/

- :ma

- :Jest

- :nie

- $W GÓRĘ

- 000

- 1

- 15%

- 16

- 24

- 29

- 32

- 36

- 500

- 67

- 7

- 70

- 8

- 9

- a

- Zdolny

- akcelerator

- akceptując

- dostęp

- realizowane

- Konto

- ACM

- Działania

- przystosować

- Dodaj

- dodanie

- Dodatkowy

- do tego

- adres

- Lotnictwo

- przed

- AI / ML

- Wszystkie kategorie

- przeznaczyć

- dopuszczać

- dozwolony

- Pozwalać

- pozwala

- również

- Chociaż

- Amazonka

- Amazon EC2

- Amazon Web Services

- an

- analiza

- w czasie rzeczywistym sprawiają,

- i

- odpowiedź

- sekretarka

- każdy

- Aplikacja

- Zastosowanie

- aplikacje

- stosowany

- podejście

- właściwy

- architektoniczny

- architektura

- architektur

- SĄ

- POWIERZCHNIA

- obszary

- argument

- AS

- zapytać

- pytanie

- pomagać

- powiązany

- At

- audio

- Uwierzytelnianie

- upoważniony

- automatycznie

- dostępny

- AWS

- z powrotem

- Bilans

- podstawowy

- BE

- staje się

- być

- zanim

- Początek

- jest

- korzyści

- Korzyści

- BEST

- pomiędzy

- Kwitnąć

- Bot

- szeroki

- budować

- wybudowany

- ale

- by

- nazywa

- CAN

- prowadzone

- nieść

- walizka

- Spowodować

- świadectwo

- certyfikaty

- wyzwania

- zmiana

- Zmiany

- Kanał

- pogawędzić

- chatbot

- nasze chatboty

- Dodaj

- cywilny

- kleń

- Cli

- klient

- Chmura

- Cloud9

- kod

- zbierać

- połączony

- komentarze

- Komunikacja

- Komunikacja

- kompletny

- obliczać

- komputer

- Wizja komputerowa

- Obawy

- warunek

- poufny

- systemu

- skonfigurowany

- połączenie

- Łączność

- Rozważać

- Konsola

- zawierać

- zawiera

- zawartość

- Generowanie treści

- kontroli

- prawidłowo

- mógłby

- Stwórz

- stworzony

- POŚWIADCZENIE

- Listy uwierzytelniające

- kryptograficzny

- Aktualny

- klient

- dane klienta

- konfigurowalny

- dane

- prywatność danych

- Odszyfruj

- Obrona

- demonstruje

- rozwijać

- wdrażane

- wdrożenia

- opisać

- zaprojektowany

- Ustalać

- rozwijać

- oprogramowania

- schemat

- cyfrowy

- katalog

- dyskutować

- omawia

- wyświetlacze

- Doker

- dokument

- dokumenty

- nie

- pobieranie

- z powodu

- podczas

- Wcześniej

- redaktor

- edukacyjny

- efekt

- eif

- Pracownik

- umożliwiać

- włączony

- enklawa

- Szyfrowanie

- szyfrowane

- zakończenia

- Punkt końcowy

- inżynier

- silniki

- wzmacniać

- Poprawia

- dość

- Środowisko

- środowiska

- wydarzenia

- zbadać

- przykład

- Z wyjątkiem

- eksfiltracja

- wyraźnie

- narażony

- Ekspozycja

- zewnętrzny

- Failed

- Cecha

- Korzyści

- Postać

- filet

- Akta

- finał

- budżetowy

- koncentruje

- obserwuj

- następujący

- następujący sposób

- piłka nożna

- W razie zamówieenia projektu

- format

- formularze

- Majątek

- cztery

- Darmowy

- od

- funkcjonować

- dalej

- Wzrost

- Games

- Generować

- wygenerowane

- generuje

- generacja

- otrzymać

- git

- GitHub

- będzie

- Rząd

- Zarządzanie

- Grupy

- Uchwyty

- Prowadzenie

- sprzęt komputerowy

- Have

- he

- Zdrowie

- informacje o zdrowiu

- opieki zdrowotnej

- pomoc

- pomaga

- tutaj

- Podświetlony

- wysoko

- jego

- ojczyzna

- Homeland Security

- gospodarz

- hostowane

- dom

- domy

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- i

- ID

- możliwe do zidentyfikowania

- zidentyfikować

- identyfikacja

- tożsamość

- if

- obraz

- zdjęcia

- Rezultat

- realizowane

- importować

- in

- niedokładny

- zawierać

- włączony

- Włącznie z

- włączenie

- nieprawidłowy

- wskazać

- przemysłowa

- informować

- Informacja

- wkład

- wprowadzanie

- wewnątrz

- zainstalować

- instalacja

- przykład

- zintegrowany

- integracja

- intelektualny

- własność intelektualna

- Inteligencja

- interaktywne

- najnowszych

- przedstawiać

- wprowadzenie

- IP

- odosobniony

- izolacja

- IT

- JEGO

- JOE

- json

- Justin

- Klawisz

- wiedza

- język

- duży

- większe

- firmy

- warstwa

- lider

- nauka

- najmniej

- biblioteki

- lubić

- LIV

- relacja na żywo

- Zyje

- LLM

- miejscowy

- lokalnie

- usytuowany

- Popatrz

- wygląda jak

- WYGLĄD

- maszyna

- uczenie maszynowe

- maszyny

- Główny

- robić

- zarządzane

- i konserwacjami

- Manipulacja

- wiele

- rynki

- zapałki

- maksymalny

- Może..

- pomiary

- Pamięć

- Metadane

- metody

- minut

- Złagodzić

- Moda

- model

- zmodyfikowano

- modyfikować

- Moduły

- jeszcze

- większość

- dużo

- wielokrotność

- musi

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Nawigacja

- ne

- niezbędny

- Potrzebować

- wymagania

- sieci

- Nowości

- Nitro

- Nie

- żaden

- noty

- już dziś

- of

- Oferty

- Biurowe

- on

- tylko

- koncepcja

- open source

- or

- zamówienie

- organizacja

- Inne

- ludzkiej,

- na zewnątrz

- zewnętrzne

- koniec

- przegląd

- właściciele

- Pakiety

- chleb

- parametry

- uprawnienia

- osobisty

- Osobiście

- krok po kroku

- planowanie

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gra

- polityka

- część

- możliwy

- Post

- potencjał

- praktyki

- poprzedzający

- przesłanka

- warunki wstępne

- prezydent

- poprzedni

- głównie

- Główny

- Zasady

- prywatność

- Zagrożenia prywatności

- prywatny

- wygląda tak

- procesów

- przetwarzanie

- Produkcja

- projekt

- własność

- chronić

- chroniony

- protokół

- Udowodnij

- zapewniać

- pod warunkiem,

- zapewnia

- pełnomocnik

- publiczny

- cele

- zapytania

- pytanie

- pytanie

- pytania

- otrzymuje

- polecić

- zmniejsza

- region

- rejestry

- opiera się

- polegać

- szczątki

- zażądać

- wywołań

- wymagany

- wymagania

- Wymaga

- Badania naukowe

- badacz

- zarezerwowany

- Zasób

- Zasoby

- odpowiedź

- Odpowiedzi

- ograniczające

- Restrykcyjne

- dalsze

- wynikły

- zachować

- przejście na emeryturę

- powrót

- Ujawnił

- Ryzyko

- ryzyko

- Rola

- korzeń

- run

- bieganie

- ochrona

- zabezpieczenie

- taki sam

- próba

- Zapisz

- zapisywane

- Skala

- nauka

- Nauka i technika

- Sdk

- Szukaj

- Wyszukiwarki

- Sekcja

- sektor

- bezpieczne

- zabezpieczone

- bezpiecznie

- bezpieczeństwo

- wybór

- wysyła

- wrażliwy

- wysłany

- sentyment

- Serie

- serwer

- Serwery

- usługa

- Usługi

- zestaw

- w panelu ustawień

- powinien

- prezentowany

- pokazane

- zamknięcie

- znacznie

- Rozmiar

- So

- Tworzenie

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- kilka

- specyficzny

- swoiście

- początek

- rozpoczęty

- Zestawienie sprzedaży

- Ewolucja krok po kroku

- Cel

- przechowywanie

- przechowywany

- taki

- wystarczający

- wsparcie

- Wspierający

- pewnie

- Powierzchnia

- system

- systemy

- Brać

- Zadania

- Techniczny

- Technologia

- tymczasowy

- terminal

- Testowanie

- XNUMX

- że

- Połączenia

- ich

- następnie

- Te

- one

- to

- tych

- zagrożenia

- Przez

- poprzez

- czas

- czasy

- do

- żeton

- przeszkolony

- tranzyt

- Tłumaczenie

- Podróżowanie

- Zaufaj

- próbować

- Nieupoważniony

- dla

- zrozumieć

- wyjątkowy

- nieograniczony

- Aktualizacja

- zaktualizowane

- URL

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- zmienna

- zweryfikować

- wersja

- przez

- wice

- Wiceprezes

- Zobacz i wysłuchaj

- Naruszenia

- Wirtualny

- Maszyna wirtualna

- widoczny

- wizja

- ciepły

- była

- Droga..

- sposoby

- we

- Pogoda

- sieć

- Aplikacje internetowe

- usługi internetowe

- Co

- jeśli chodzi o komunikację i motywację

- który

- KIM

- będzie

- w

- w ciągu

- bez

- Praca

- pracował

- pracujący

- świat

- X

- You

- Twój

- zefirnet